REVUES

18.02.2026 à 11:54

Quand l’odeur devient preuve : l’odorologie au cœur de la police scientifique

Texte intégral (2178 mots)

À Écully, dans le Rhône, se trouvent les seuls chiens capables de comparer une trace olfactive laissée sur une scène d’infraction par l’odeur corporelle d’un suspect ou d’une victime. Découvrez l’odorologie.

En janvier 2012, à Montceau-les-Mines (Saône-et-Loire), un homme cagoulé braque une banque dès l’ouverture. Quelques mois plus tard, un second établissement de la même ville est attaqué selon un mode opératoire similaire.

Les enquêteurs disposent de vidéos de surveillance, mais les images sont trop imprécises pour identifier formellement le suspect. L’ADN, habituellement décisif, ne livre aucun résultat exploitable. Reste une trace, plus discrète, presque invisible : l’odeur laissée dans le véhicule utilisé pour la fuite. C’est cette trace que la police scientifique va exploiter grâce à une de ses techniques d’expertise : l’odorologie, une discipline encore méconnue du grand public où des chiens spécialement formés procèdent à la comparaison et à l’identification d’odeurs humaines. Au procès, cette expertise permet la condamnation du braqueur.

Des chiens à l’expertise unique

Lorsque nous évoquons les chiens policiers, l’image des unités déployées sur le terrain, mobilisées dans la détection d’explosifs, de stupéfiants ou encore la recherche de personnes disparues, s’impose naturellement. Cependant, à côté de cette réalité opérationnelle se déploie une autre activité, moins visible : celle des chiens et de leurs maîtres œuvrant au sein de la police scientifique.

En France, il existe un lieu unique appelé le plateau national d’odorologie, qui réunit les seuls chiens capables de comparer une trace odorante laissée sur une scène d’infraction avec l’odeur corporelle d’un suspect ou d’une victime. Cette spécialité cynophile, créée en 2000 (par Daniel Grignon, cynotechnicien formé en Hongrie) devient pleinement opérationnelle à partir de 2003.

Aujourd’hui, l’activité d’odorologie s’appuie sur quatre agents et sept chiens (bergers belges malinois, bergers allemands, épagneul English Springer) qui, comme les experts humains en laboratoire, n’interviennent pas sur le terrain mais travaillent exclusivement au sein du plateau national d’Écully (à côté de Lyon, Rhône), où ils procèdent aux comparaisons odorantes. Deux autres chiens sont actuellement en formation, entamée à l’âge de six mois pour une durée d’environ un an.

Toute analyse en odorologie débute par une phase de prélèvement, déterminante pour la suite de la procédure. Réalisés exclusivement par des policiers habilités (500 préleveurs habilités de la police nationale en 2025), les prélèvements portent sur deux types d’odeurs complémentaires.

D’une part, les traces odorantes sont recueillies sur les lieux de l’infraction, à partir de tout support ayant été en contact avec une personne, qu’il s’agisse d’un siège, d’un volant, d’une poignée ou d’un vêtement. D’autre part, les odeurs corporelles sont directement prélevées sur les individus mis en cause ou sur les victimes : ceux-ci malaxent pendant plusieurs minutes des tissus spécifiques afin d’y transférer les molécules odorantes caractéristiques de leur signature chimique. Ces dernières sont stockées dans une pièce spécifique : l’odorothèque où, à ce jour, 9 600 scellés judiciaires sont stockés.

Une parade d’identification

Une fois les prélèvements réalisés, débute alors la phase d’analyses. Les traces odorantes prélevées sur la scène d’infraction sont comparées à l’odeur corporelle du mis en cause ou de la victime lors d’une parade d’identification réalisée par les chiens spécialement formés.

La trace est d’abord présentée au chien, qui la sent et la mémorise, puis il progresse le long d’une ligne composée de cinq bocaux contenant chacun une odeur corporelle différente : un seul correspond à l’odeur du mis en cause ou de la victime à identifier, les quatre autres servant d’odeurs de comparaison.

S’il reconnaît l’odeur à identifier, le chien se couche devant le bocal correspondant ; s’il ne reconnaît aucune des odeurs, il revient vers son maître. L’ensemble du processus dure environ 0,6 seconde, le temps pour le chien de placer son museau dans le bocal, de découvrir l’odeur qu’il contient, de l’analyser et de décider s’il doit marquer l’arrêt ou non.

La position des cinq bocaux est ensuite modifiée de façon aléatoire et le travail est répété une seconde fois avant qu’un troisième passage soit effectué sur une ligne de contrôle ne contenant pas l’odeur du mis en cause ou de la victime. Lorsque le premier chien a terminé son travail, la même opération est réalisée avec, au moins un second chien.

Une identification est considérée comme établie lorsque deux chiens ont marqué la même odeur, chacun au cours d’au moins deux passages, et que chacun d’eux a également réalisé au moins une ligne à vide.

La science de l’odeur humaine : une signature chimique individuelle

Chaque être humain possède une odeur corporelle propre, constituée de molécules volatiles issues principalement de la dégradation bactérienne des sécrétions de la peau, comme la sueur et le sébum. Cette odeur n’est pas uniforme : elle se compose de plusieurs éléments. Seule la composante primaire de l’odeur humaine demeure stable au cours du temps. C’est précisément cette composante primaire qui est utilisée par les chiens d’odorologie pour identifier un individu, celle-ci ne pouvant pas être altérée par des composantes variables, comme le parfum.

Elle constitue une véritable signature chimique individuelle, comparable, dans son principe, à une empreinte biologique. Le chien reste le seul capable de reconnaître cette composante invariable, indispensable à l’identification. Son système olfactif explique cette performance. Lorsque les molécules odorantes pénètrent dans la cavité nasale, elles se lient aux récepteurs de l’épithélium olfactif, déclenchant un influx nerveux transmis au bulbe olfactif, puis au cerveau, où l’odeur est analysée et mémorisée.

L’odorologie, un réel outil d’enquête

L’odorologie s’appuie sur un protocole rigoureux, conçu pour garantir la fiabilité à la fois scientifique et judiciaire des résultats obtenus. Son recours s’inscrit dans un cadre juridique strict et est réservé aux infractions d’une certaine gravité, à partir du délit aggravé (vol avec violence, cambriolage aggravé, séquestration…) et jusqu’aux crimes.

Cette expertise, pleinement intégrée aux pratiques de la police scientifique, ne statue pas à elle seule sur la culpabilité d’un individu, mais apporte un élément objectif essentiel au raisonnement judiciaire. Lorsqu’un rapprochement est établi, elle atteste un fait précis : la présence d’un individu (auteurs ou victimes) sur une scène d’infraction ou un contact avec des objets.

Cette technique intervient souvent en complément d’autres moyens d’investigation, mais elle peut aussi devenir déterminante lorsque les images sont floues, les témoignages fragiles ou les traces biologiques absentes. Depuis 2003, 787 dossiers ont été traités par le plateau national d’odorologie, aboutissant à 195 identifications. Les experts ont été appelés à témoigner 44 fois devant des cours d’assises, preuve de la reconnaissance judiciaire de cette discipline.

À l’heure où les avancées technologiques occupent une place centrale dans la police scientifique, l’odorologie rappelle que le vivant demeure parfois irremplaçable. Fondée sur un processus complexe et rigoureux, conforme aux exigences de la norme NF EN ISO/CEI 17025, la comparaison d’odeurs ne laisse aucune place au hasard. Elle s’inscrit dans un faisceau d’indices, contribuant à la manifestation de la vérité.

Invisible, silencieuse, mais persistante, cette expertise rappelle que le crime laisse toujours une trace, faisant écho au principe formulé dès 1920 par Edmond Locard : « Nul ne peut agir avec l’intensité que suppose l’action criminelle sans laisser des marques multiples de son passage. »

Créé en 2023, le Centre de recherche de la police nationale pilote la recherche appliquée au sein de la police nationale. Il coordonne l’activité des opérateurs scientifiques pour développer des connaissances, des outils et des méthodes au service de l’action opérationnelle et stratégique.

Estelle Davet ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

18.02.2026 à 11:53

Souriez, vous êtes filmés : ce que l’« emotion AI » voit vraiment sur nos visages

Texte intégral (2451 mots)

Aujourd’hui, on peut lire vos émotions sur votre visage et adapter un flux vidéo en temps réel en fonction de votre réaction. Vraiment ? Quelles sont les utilisations autorisées de l’« emotion AI », et ses limites ? Éclairage par deux spécialistes.

Dans un magasin de cosmétiques, une cliente s’arrête devant une borne interactive. Une caméra intégrée filme son visage pendant quelques secondes pendant qu’elle regarde l’écran. Le système ne cherche pas à l’identifier, mais à observer ses réactions : sourit-elle ? détourne-t-elle le regard ? fronce-t-elle légèrement les sourcils ? À partir de ces signaux, la borne adapte le contenu affiché.

Ces technologies, qui s’inscrivent dans le domaine de l’emotion AI, sont déjà utilisées pour tester des publicités, analyser l’attention d’un public lors d’une conférence ou mesurer l’engagement face à une interface.

Mais que fait réellement cette technologie lorsqu’elle « analyse » un visage ? Et jusqu’où peut-on aller lorsqu’on cherche à interpréter des expressions faciales à l’aide de l’intelligence artificielle ?

Qu’est-ce que l’« emotion AI » ?

L’emotion AI désigne un ensemble de méthodes informatiques qui consistent à analyser des expressions faciales afin d’en extraire des informations sur les réactions émotionnelles probables d’une personne.

Dans la pratique, ces systèmes captent les mouvements du visage : ouverture de la bouche, haussement des sourcils, plissement des yeux, dynamique des expressions dans le temps. L’objectif n’est pas de savoir ce qu’une personne ressent au fond d’elle-même, mais d’associer ces indices faciaux à certaines réactions comme l’intérêt, la surprise ou le désengagement. Les résultats prennent la forme de scores ou de catégories, qui indiquent la probabilité qu’une expression corresponde à un état donné.

Cette approche s’inscrit dans une longue tradition de recherche sur les expressions faciales, bien antérieure à l’intelligence artificielle. Dès les années 1970, des travaux fondateurs en psychologie ont proposé des méthodes systématiques pour décrire et coder les mouvements du visage, reposant sur des observations humaines expertes.

Ce que l’emotion AI apporte, c’est la capacité à automatiser l’analyse, à grande échelle et en temps quasi réel de ces signaux, que les chercheurs et praticiens étudient depuis longtemps de manière manuelle ou semi-automatisée. Cette automatisation s’est développée à partir des années 2000 avec l’essor de la vision par ordinateur, puis s’est accélérée avec les méthodes d’apprentissage automatique et d’apprentissage profond.

Comment ça marche ?

Les systèmes actuels analysent des flux vidéo image par image, à des fréquences comparables à celles de la vidéo standard. Selon la complexité des modèles et le matériel utilisé, l’estimation des réactions faciales peut être produite avec une latence de l’ordre de la centaine de millisecondes, ce qui permet par exemple d’adapter dynamiquement le contenu affiché sur une borne interactive.

Le logiciel détecte d’abord un visage à l’écran, puis suit les changements de son expression d’une image à l’autre. À partir de ces informations, le système calcule des descripteurs faciaux, puis les compare à des modèles appris à partir de bases de données d’expressions faciales annotées, c’est-à-dire des ensembles d’images ou de vidéos de visages pour lesquelles des experts humains ont préalablement identifié et étiqueté les mouvements ou expressions observés.

En effet, lors de la phase d’apprentissage du modèle d’IA, le système a appris à associer certaines configurations faciales à des catégories ou à des scores correspondant à des réactions données. Lorsqu’il est ensuite appliqué à un nouveau visage, il ne fait que mesurer des similarités statistiques avec les données sur lesquelles il a été entraîné.

Concrètement, lorsqu’un système indique qu’un visage exprime une émotion donnée, il ne fait que dire ceci : « cette configuration faciale ressemble, statistiquement, à d’autres configurations associées à cet état dans les données d’entraînement » (on parle d’inférence probabiliste).

Ces méthodes ont aujourd’hui atteint un niveau de performance suffisant pour certains usages bien définis – par exemple lors de tests utilisateurs, d’études marketing ou dans certaines interfaces interactives, où les conditions d’observation peuvent être partiellement maîtrisées.

Quelles sont les limites techniques ?

Néanmoins, cette fiabilité reste très variable selon les contextes d’application et les objectifs poursuivis. Les performances sont en effet meilleures lorsque le visage est bien visible, avec un bon éclairage, peu de mouvements et sans éléments masquant les traits, comme des masques ou des lunettes à monture épaisse. En revanche, lorsque ces systèmes sont déployés en conditions réelles et non contrôlées, leurs résultats doivent être interprétés avec davantage d’incertitude.

Les limites de l’emotion AI tiennent d’abord à la nature même des expressions faciales. Une expression ne correspond pas toujours à une émotion unique : un sourire peut signaler la joie, la politesse, l’ironie ou l’inconfort. Le contexte joue un rôle essentiel dans l’interprétation.

Les performances des systèmes dépendent également des données utilisées pour les entraîner. Les bases de données d’entraînement peu diversifiées peuvent conduire entre autres à des erreurs ou à des biais. Par exemple, si la base de données est principalement composée d’images de femmes de moins de 30 ans de type caucasien, le système aura du mal à interpréter correctement des mouvements faciaux d’individus de plus de 65 ans et de type asiatique.

Enfin, il ne faut pas se limiter aux seules expressions faciales, qui ne constituent qu’un canal parmi d’autres de l’expression émotionnelle. Elles fournissent des informations précieuses, mais partielles. Les systèmes d’emotion AI sont donc surtout pertinents lorsqu’ils sont utilisés en complément d’autres sources d’information, comme des indices vocaux, comportementaux ou déclaratifs. Cette approche ne remet pas en cause l’automatisation, mais en précise la portée : l’emotion AI automatise l’analyse de certains signaux observables, sans prétendre à une interprétation exhaustive des émotions.

Des risques à ne pas ignorer

Utilisée sans cadre clair, l’emotion AI peut alimenter des usages problématiques, notamment lorsqu’elle est intégrée à des dispositifs d’influence commerciale ou de surveillance.

Dans le domaine commercial, ces technologies sont par exemple envisagées pour ajuster en temps réel des messages publicitaires ou des interfaces en fonction des réactions faciales supposées des consommateurs. Ce type de personnalisation émotionnelle soulève des questions de manipulation, en particulier lorsque les personnes concernées ne sont pas pleinement informées de l’analyse de leurs réactions.

À lire aussi : Quand l’IA nous manipule : comment réguler les pratiques qui malmènent notre libre arbitre ?

Les risques sont également importants dans les contextes de surveillance, notamment lorsque l’analyse automatisée des expressions faciales est utilisée pour inférer des états mentaux ou des intentions dans des espaces publics, des environnements professionnels ou des contextes sécuritaires. De tels usages reposent sur des inférences incertaines et peuvent conduire à des interprétations erronées, voire discriminatoires.

Ces risques sont aujourd’hui largement documentés par la recherche scientifique, ainsi que par plusieurs institutions publiques et autorités de régulation. À l’échelle internationale, ces réflexions ont notamment conduit à l’adoption de recommandations éthiques, comme celles portées par l’Unesco, qui ne sont toutefois pas juridiquement contraignantes et visent surtout à orienter les pratiques et les politiques publiques.

En revanche, en Europe, le règlement sur l’IA interdit ou restreint fortement les usages de l’analyse émotionnelle automatisée lorsqu’ils visent à surveiller, classer ou évaluer des personnes dans des contextes grand public, notamment dans les espaces publics, au travail ou à l’école.

Ces technologies ne peuvent pas être utilisées pour inférer des états mentaux ou guider des décisions ayant un impact sur les individus, en raison du caractère incertain et potentiellement discriminatoire de ces inférences. En France, la mise en œuvre de ce cadre s’appuie notamment sur l’action de la Commission nationale de l’informatique et des libertés (Cnil), chargée de veiller au respect des droits fondamentaux dans le déploiement de ces technologies.

Ces débats rappellent un point essentiel : les expressions faciales ne parlent jamais d’elles-mêmes. Leur analyse repose sur des inférences incertaines, qui exigent à la fois des modèles théoriques solides, une interprétation critique des résultats et un cadre d’usage clairement défini.

Les enjeux éthiques et réglementaires ne sont donc pas extérieurs aux questions scientifiques et techniques, mais en constituent un prolongement direct. C’est précisément dans cette articulation entre compréhension fine des expressions, limites des modèles et conditions d’usage responsables que se joue l’avenir de l’emotion AI.

Charlotte De Sainte Maresville a reçu des financements de ANR dans le cadre d'une convention CIFRE.

Christine PETR a reçu des financements de ANR dans le cadre d'une CIFRE.

17.02.2026 à 17:06

La loi de Moore ayant atteint ses limites, que nous réserve l’avenir de l’informatique ?

Texte intégral (1347 mots)

Après un demi-siècle de gains réguliers en puissance de calcul, l’informatique entre dans une nouvelle ère. La miniaturisation ne suffit plus : les progrès dépendent désormais de l’architecture, de l’énergie et de logiciels optimisés.

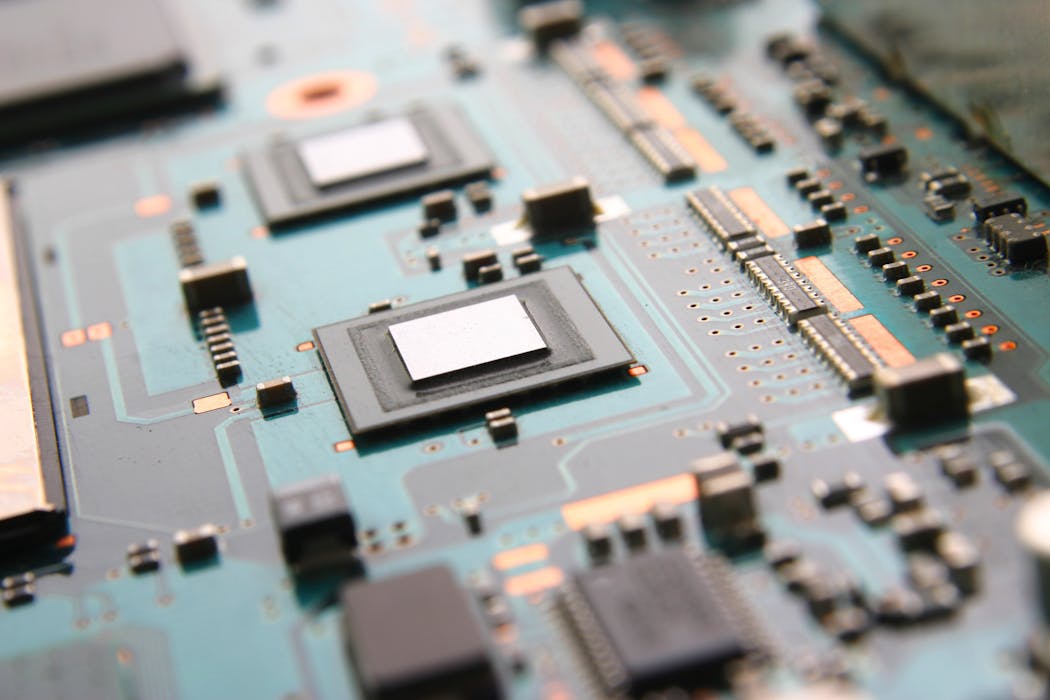

Pendant un demi-siècle, l’informatique a progressé de manière rassurante et prévisible. Les transistors – ces dispositifs qui servent à contrôler le passage des signaux électriques sur une puce informatique – sont devenus de plus en plus petits, ce qui permet d’en amasser davantage sur une seule puce. En conséquence, les puces ont gagné en rapidité, et la société a intégré ces avancées presque sans s’en rendre compte.

Ces puces plus rapides ont offert une puissance de calcul accrue en permettant aux appareils d’exécuter les tâches plus efficacement. On a ainsi vu les simulations scientifiques s’améliorer, les prévisions météorologiques gagner en précision, les images devenir plus réalistes, puis les systèmes d’apprentissage automatique émerger et se développer. Tout se passait comme si la puissance de calcul obéissait à une loi naturelle.

La fin des certitudes

Ce phénomène a pris le nom de loi de Moore, d’après l’homme d’affaires et scientifique Gordon Moore. Elle résumait l’observation empirique selon laquelle le nombre de transistors sur une puce doublait approximativement tous les deux ans. Cela permettait aussi de réduire la taille des appareils et alimentait en conséquence la miniaturisation.

Ce sentiment de certitude et de prévisibilité a désormais disparu, non pas parce que l’innovation se serait arrêtée, mais parce que les hypothèses physiques qui la soutenaient autrefois ne sont plus valables.

Qu’est-ce qui remplace alors l’ancien modèle d’augmentation automatique des performances ? La réponse ne tient pas à une seule avancée technologique, mais à plusieurs stratégies qui se superposent.

De nouvelles approches

L’une d’elles repose sur de nouveaux matériaux et de nouvelles architectures de transistors. Les ingénieurs améliorent encore leur conception afin de limiter les pertes d’énergie et les fuites électriques indésirables. Ces évolutions apportent des gains plus modestes et plus progressifs qu’autrefois, mais elles permettent de mieux maîtriser la consommation énergétique.

Une autre approche consiste à modifier l’organisation physique des puces. Au lieu de disposer tous les composants sur une surface plane unique, les puces modernes empilent de plus en plus les éléments les uns sur les autres ou les rapprochent davantage. Cela réduit la distance que doivent parcourir les données, ce qui permet de gagner à la fois en temps et en énergie.

Le changement le plus important est sans doute la spécialisation. Au lieu de confier toutes les tâches à un unique processeur polyvalent, les systèmes modernes combinent différents types de processeurs. Les unités de traitement traditionnelles, ou CPU, assurent le contrôle et la prise de décision. Les processeurs graphiques sont des unités de calcul très puissantes, conçues à l’origine pour répondre aux exigences du rendu graphique dans les jeux vidéo et d’autres usages. Les accélérateurs d’IA (du matériel spécialisé qui accélère les tâches liées à l’intelligence artificielle) se concentrent sur l’exécution en parallèle d’un très grand nombre de calculs simples. Les performances dépendent désormais de la manière dont ces composants fonctionnent ensemble, plutôt que de la vitesse de chacun pris isolément.

Des technologies expérimentales

Parallèlement à ces évolutions, les chercheurs explorent des technologies plus expérimentales, notamment les processeurs quantiques (qui exploitent les principes de la physique quantique) et les processeurs photoniques, qui utilisent la lumière plutôt que l’électricité.

Il ne s’agit pas d’ordinateurs polyvalents, et ils ont peu de chances de remplacer les machines classiques. Leur intérêt réside dans des domaines très spécifiques, comme certains problèmes d’optimisation ou de simulation, pour lesquels les ordinateurs traditionnels peinent à explorer efficacement un grand nombre de solutions possibles. En pratique, ces technologies doivent être envisagées comme des coprocesseurs spécialisés, utilisés de manière ciblée et en complément des systèmes traditionnels.

Pour la plupart des usages informatiques du quotidien, les progrès des processeurs conventionnels, des systèmes de mémoire et de la conception logicielle resteront bien plus déterminants que ces approches expérimentales.

Pour les utilisateurs, l’ère post-Moore ne signifie pas que les ordinateurs cesseront de s’améliorer. Cela veut juste dire que les progrès se manifesteront de manière plus inégale et plus dépendante des usages. Certaines applications — comme les outils fondés sur l’IA, le diagnostic, la navigation ou la modélisation complexe — pourraient connaître de vraies avancées, tandis que les performances généralistes progresseront plus lentement.

Nouvelles technologies

Lors de la conférence Supercomputing SC25 à Saint-Louis, plusieurs systèmes hybrides associant CPU (processeurs), GPU (processeurs graphiques) et technologies émergentes — comme les processeurs quantiques ou photoniques — ont été présentés comme des prolongements concrets de l’informatique classique. Pour l’immense majorité des usages quotidiens, ce sont toutefois les progrès des processeurs traditionnels, des mémoires et des logiciels qui continueront d’apporter les gains les plus significatifs.

On note un intérêt croissant pour les dispositifs quantiques et photoniques comme coprocesseurs, et non comme remplaçants. Ils sont particulièrement utiles pour des problèmes très spécifiques, comme l’optimisation ou le routage complexes, où les machines classiques seules peinent à trouver des solutions efficaces.

Dans ce rôle d’appoint, ils offrent un moyen crédible d’allier la fiabilité de l’informatique classique à de nouvelles techniques de calcul, élargissant ainsi les capacités des systèmes.

Un nouveau récit

La suite n’est pas une histoire de déclin, mais un processus de transformation et d’évolution permanentes. Les progrès en informatique reposent désormais sur la spécialisation des architectures, une gestion rigoureuse de l’énergie et des logiciels conçus en tenant pleinement compte des contraintes matérielles. Le risque est de confondre complexité et inéluctabilité, ou narratifs marketing et problèmes réellement résolus.

L’ère post-Moore impose une relation plus réaliste avec l’informatique : la performance n’est plus un acquis automatique lié à la miniaturisation des transistors, mais un résultat qu’il faut concevoir, justifier et payer – en énergie, en complexité et en compromis.

Domenico Vicinanza ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

⬅️ 21 / 25 ➡️

- GÉNÉRALISTES

- Ballast

- Fakir

- Interstices

- Issues

- Korii

- Lava

- La revue des médias

- Time [Fr]

- Mouais

- Multitudes

- Positivr

- Regards

- Slate

- Smolny

- Socialter

- UPMagazine

- Le Zéphyr

- Idées ‧ Politique ‧ A à F

- Accattone

- À Contretemps

- Alter-éditions

- Contre-Attaque

- Contretemps

- CQFD

- Comptoir (Le)

- Déferlante (La)

- Esprit

- Frustration

- Idées ‧ Politique ‧ i à z

- L'Intimiste

- Jef Klak

- Lignes de Crêtes

- NonFiction

- Nouveaux Cahiers du Socialisme

- Période

- ARTS

- L'Autre Quotidien

- Villa Albertine

- THINK-TANKS

- Fondation Copernic

- Institut La Boétie

- Institut Rousseau

- TECH

- Dans les algorithmes

- Framablog

- Gigawatts.fr

- Goodtech.info

- Quadrature du Net

- INTERNATIONAL

- Alencontre

- Alterinfos

- Gauche.Media

- CETRI

- ESSF

- Inprecor

- Guitinews

- MULTILINGUES

- Kedistan

- Quatrième Internationale

- Viewpoint Magazine

- +972 mag

- PODCASTS

- Arrêt sur Images

- Le Diplo

- LSD

- Thinkerview