28.05.2026 à 13:06

La Fête des mères aux États-Unis et en France : objet de calculs commerciaux et politiques

Texte intégral (3551 mots)

Si les mères sont honorées de longue date dans de nombreuses civilisations, le concept de « Fête des mères » s’est réellement imposé au début du XXᵉ siècle. Des deux côtés de l’Atlantique, ce jour censé célébrer l’amour filial et le travail invisible des mères a été largement instrumentalisé par les entreprises commerciales et par divers responsables politiques, en particulier Donald Trump.

Malgré une croyance populaire, la Fête des mères n’a pas été inventée par le maréchal Pétain. Soulignons d’abord que ses origines remontent à l’Antiquité grecque et romaine. Pendant les fêtes printanières, les Grecs célébraient Rhéa, la mère des dieux de l’Olympe tandis que les Romains rendaient hommage aux matronas, les mères de famille, ainsi qu’à la déesse Cybèle, assimilée à Rhéa. Avec la chute de l’Empire romain et l’essor du christianisme, cette tradition s’efface au profit du culte de la Vierge Marie, mère du Christ.

La Fête des mères, telle que nous la connaissons aujourd’hui, a été instaurée au début du XXᵉ siècle aux États-Unis, notamment grâce aux efforts d’Anna Jarvis. En France, sous le régime de Vichy, le maréchal Pétain s’empare de cette fête et lui donne une nouvelle dimension dans le cadre de son idéologie politique.

Aujourd’hui, quelle est l’essence de la Fête des mères, célébrée le 10 mai aux États-Unis et le 31 mai en France ?

À lire aussi : From ancient goddesses to modern peace activists − Mother’s Day celebrates women’s political power

Le double combat d’Anna Jarvis aux États-Unis

Évoquer le double combat d’Anna Jarvis dans le cadre de la Fête des mères mérite de rappeler d’abord la figure qui l’a inspirée : sa propre mère, Ann Reeves Jarvis (1832-1905).

Femme pieuse, cette dernière était aussi connue pour son militantisme pacifique durant la guerre de Sécession (1861-1865). Sensible aux mortalités infantile et juvénile, elle-même ayant perdu neuf de ses treize enfants, elle créa en 1858 des ateliers de travail de mères dénommés « Mother’s Day Work Clubs ». L’objectif initial de ces ateliers était d’apprendre aux femmes à prendre soin de leurs enfants afin de lutter contre les maladies contagieuses, comme la rougeole et la tuberculose, qui sévissaient dans sa communauté à Grafton, en Virginie-Occidentale, et par la suite de soigner les militaires des deux camps de la guerre civile.

La consécration d’une journée spéciale pour célébrer les mères lui tenait également à cœur. Dans cette perspective, Ann Reeves Jarvis organisa en 1868 le « Mother’s Friendship Day », afin de réunir les familles des deux camps, confrontées à des tensions majeures malgré la fin de la guerre entre les États du Nord et les États du Sud trois ans plus tôt, et en dépit des menaces de violence que suscita cette initiative.

À sa mort, le 9 mai 1905, sa fille Anna Jarvis (1864-1948) prit le relais. Le 10 mai 1908, elle organisa une cérémonie en hommage à sa mère et à toutes les mères à l’église méthodiste de Grafton. Parallèlement, elle militait pour qu’une « Journée de la mère » soit instaurée au niveau national. En 1914, le président Woodrow Wilson (1856-1924) instaure officiellement le Mother’s Day, célébré le deuxième dimanche de mai.

Mais très vite, le Mother’s Day prit une tournure commerciale. Anna Jarvis passa alors le reste de sa vie à essayer de faire annuler cette célébration. Elle lança des appels au boycott et multiplia les actions en justice contre des associations et des commerçants, sans succès.

La vision pétainiste de la Fête des mères sous le régime de Vichy

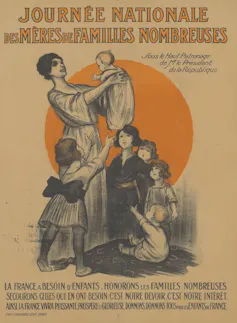

En France, les premiers événements liés à la Fête des mères eurent lieu en 1906 à Artas, en Isère, pour honorer les mères de familles nombreuses, puis en 1918 à Lyon pour rendre hommage aux mères et aux épouses ayant perdu leur fils ou leur mari pendant la Première Guerre mondiale. L’objectif, dans les deux cas, était de promouvoir la natalité, en berne dans le pays depuis la fin du XIXe siècle.

En 1920, une fête des mères de familles nombreuses est instaurée par le gouvernement, suivie d’une première cérémonie officielle organisée en ce sens avec une remise de « médaille de la famille française » en 1926. Trois ans plus tard, les pouvoirs publics organisent la « Journée des mères » à l’échelle nationale. Philippe Pétain (1856-1951) n’a donc rien inventé.

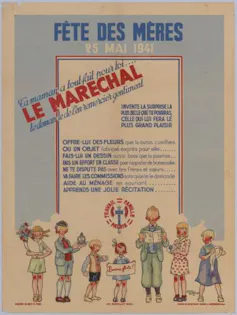

Toutefois, dès l’avènement du régime de Vichy, le maréchal Pétain s’empare de la « Journée des mères » comme outil de propagande dans le cadre de son idéologie politique « Travail, Famille, Patrie ». Il l’inscrit dans le calendrier en 1941 et lui confère une certaine solennité. Le régime se charge lui-même de l’organisation de cette célébration. Les instituteurs sont sommés de confectionner des cadeaux avec leurs élèves et les communes contraintes d’organiser des festivités à cette occasion. Des affiches portant le slogan « Ta Maman a tout fait pour toi, le Maréchal te demande de l'en remercier gentiment » sont apposées dans les écoles, et la presse est mobilisée. Des actions similaires sont renouvelées les années suivantes. Comme le rappelle l’historienne Françoise Thébaud, « le régime va systématiser la célébration de cette fête ».

Cette propagande vise ainsi à véhiculer une certaine image de la femme, qui devait être cantonnée au rôle de la mère au foyer, afin de mettre en œuvre une politique nataliste dynamique. Dans cette optique, le régime tente de limiter l’accès des femmes au marché du travail, notamment avec la loi du 11 octobre 1940 qui interdit de recruter des femmes mariées dans l’administration.

À la chute de Vichy, la « Journée des Mères » n’est pas remise en cause. La loi du 24 mai 1950 inscrit la « Fête des mères » dans le calendrier républicain au dernier dimanche de mai (sauf lorsque la Pentecôte coïncide avec cette date, auquel cas elle est célébrée le premier dimanche de juin).

Par la suite, comme le précise l’historien Louis-Pascal Jacquemond dans son ouvrage Histoire de la fête des Mères (2019), « la marchandisation a fait le reste ».

Une marchandisation accrue sous le prisme d’un marketing sexiste

Si le Mother’s Day est la troisième fête la plus célébrée après Noël et Thanksgiving, aux États-Unis, cette tradition est également largement présente dans les familles en France. Mais dans les deux pays, cette fête s’est aussi transformée en un véritable événement commercial, générant un marché estimé à 38 milliards de dollars (33 milliards d’euros) en 2026 aux États-Unis et à plus de 3 milliards d’euros en 2025 en France rien que pour le commerce de proximité.

Ainsi, malgré les tensions sur le pouvoir d’achat, les Américains et les Français ont respectivement alloué en moyenne 259 dollars (223 euros) et 77 euros à la Fête des mères en 2025. Outre-Atlantique comme dans l’Hexagone, les fleurs, les bijoux, les sorties au restaurant et les présents personnalisés figurent parmi les cadeaux les plus populaires offerts ce jour-là. S’y ajoutent, aux États-Unis, les cartes de vœux, très prisées.

Pour séduire les clients, les sites de vente en ligne des deux côtés de l’Atlantique proposent des idées de cadeaux annoncés comme « irrésistibles », « élégants », « parfaits », « incontournables », « à offrir absolument », « pour la gâter en beauté », « qui font plaisir à tous les coups », etc. Dans les deux pays, de nombreuses marques et boutiques multiplient les stratégies publicitaires et promotionnelles pour tirer profit de la fête des Mères.

Depuis les années 1950, certaines publicités et promotions mises en place dans le cadre de cette fête sont épinglées pour leur sexisme, car elles renvoient les femmes à une image de ménagère, notamment lorsqu’elles portent sur les appareils électroménagers et les produits d’entretien, ou la réduisent à son physique lorsqu’elles concernent les produits cosmétiques.

Une occasion saisie par Donald Trump à l’approche des Midterms ?

Cette année, à l’occasion du Mother’s Day, Donald Trump a rendu hommage aux mères dans un communiqué publié sur le site officiel de la Maison-Blanche, tout en évoquant la politique nataliste, économique et migratoire mise en œuvre depuis son retour à la présidence – une politique dont il prétend qu’elle serait au bénéfice des mères. À l’approche des élections de mi-mandat de novembre prochain, qui s’annoncent difficiles pour son parti, Trump espère sans doute ainsi accroître sa popularité. Il n’en demeure pas moins que certaines des décisions qu’il présente comme étant favorables aux familles américaines suscitent d’importantes critiques.

L’augmentation du Child Credit Tax (CTC, crédit d’impôt par enfant), qui est passé de 2 000 à 2 200 dollars (soit entre 1 700 et 1 890 euros environ) par enfant depuis l’année d’imposition 2025, dont il se vante, aurait plutôt tendance à creuser les inégalités raciales en matière de richesse.

La mise en place des comptes d’investissement de 1 000 dollars ouverts (858 euros) pour chaque nouveau-né entre 2025-2028 et de nationalité américaine, dits « Trump Accounts », lesquels entreront en vigueur à partir de juillet 2026, sont eux aussi inégalitaires et profiteront davantage aux familles blanches et aisées.

Dans son communiqué, Trump s’enorgueillit par ailleurs d’avoir obtenu une baisse du coût de la vie. Les données publiées le 12 mai par le Bureau de la statistique du travail (BLS) indiquent au contraire que l’inflation a augmenté de 3,8 % sur un an en avril, s’établissant ainsi à son niveau le plus élevé depuis mai 2023. De nombreux secteurs sont touchés : le carburant, le loyer, l’alimentation… en raison principalement de la guerre au Moyen-Orient. Interrogé par la presse sur ce point, Trump a assuré que cette inflation élevée était « de court terme » et qu’elle ralentirait quand le conflit en Iran prendrait fin. En attendant, le nouveau Gilded Age (Âge doré) qu’il a promis à ses concitoyens n’est pas encore au rendez-vous.

À lire aussi : Recréer un second « Gilded Age » (Âge doré) : les illusions de Trump

Enfin, le président se félicite dans son communiqué d’avoir interrompu l’afflux de « dangereux immigrants illégaux » et de fentanyl dans le pays, grâce à quoi les Angel Moms ne seraient plus endeuillées par la perte de leurs enfants. Rappelons que l’expression « Angel Moms » désigne les mères ayant perdu leur enfant, quelle qu’en soit la cause (maladie, accident…) et qu’elle trouve son origine dans une organisation composée de femmes éprouvées par ce deuil, créée en 2000.

En août 2016, Trump popularise et instrumentalise ce terme lors d’un meeting de campagne en Arizona, en invitant des mères dont les enfants ont été tués par des migrants sans papiers à venir témoigner sur scène. L’opération est réussie : aujourd’hui encore, Trump continue d’exploiter l’expression « Angel Moms » pour justifier sa politique anti-immigration – alors même que parmi les migrants illégaux ou présumés tels arrêtés et expulsés par la police de l’immigration (ICE), la grande majorité ne sont pas « de dangereux criminels » comme il le prétend, loin de là.

À lire aussi : Tout comprendre à l’ICE, la police de l’immigration au cœur des polémiques aux États-Unis

On l’aura compris : la Fête des mères est encore, voire avant tout, l’objet de calculs commerciaux et politiques ; toutefois, embrasser le sens réel de cette fête, à savoir l’amour filial qu’Anna Jarvis a voulu mettre en avant en son temps, laisse place à l’espérance en une société meilleure…

Allane Madanamoothoo ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

28.05.2026 à 13:03

La compositrice Antonia Bembo a fui Venise pour échapper à son mari violent. Plus de trois siècles plus tard, son opéra est enfin mis en scène

Texte intégral (2430 mots)

Jusqu’à une date récente, l’intérêt pour la compositrice et chanteuse lyrique italienne de l’époque baroque Antonia Bembo et pour sa musique était relativement modeste, son nom ne figurant que parmi tant d’autres consœurs. Une première européenne consacrée à son œuvre, à l’Opéra Bastille, à Paris, marque une avancée majeure.

L’Opéra de Paris a mis en scène nombre d’œuvres emblématiques, telles que Don Carlos et les Troyens, ainsi que des ballets célèbres comme les Indes galantes et le Sacre du printemps. Mais on vous pardonnera de ne pas avoir entendu parler d’Antonia Bembo, dont l’opéra de 1707 Ercole Amante (Hercule amoureux) a été mis en scène pour la première fois à l’Opéra Bastille le 28 mai 2026.

Née vers 1640, Antonia Bembo, comme son opéra, est restée méconnue pendant des siècles, en raison des aléas liés à ses partitions et de la négligence historique dont ont fait l’objet les compositrices.

J’étudie la vie et l’œuvre d’Antonia Bembo depuis 1990. À l’époque, les chercheurs ne savaient rien de sa biographie ; elle n’était qu’un nom figurant sur les pages de garde de ses partitions. Dès que j’ai confirmé qu’elle n’était pas née dans la famille patricienne des Bembo mais qu’elle avait été mariée à un Bembo, j’ai pu non seulement l’identifier, mais aussi raconter son histoire dans un livre Desperate Measures: The Life and Music of Antonia Padoani Bembo (2006, non traduit en français).

Fuite de Venise

Si Bembo a été oubliée, c’est en partie de son propre fait.

Formée à la musique à Venise, elle fuit un mari violent et s’installe à Paris en 1677. Là, elle chante devant Louis XIV, qui lui fournit les moyens de vivre dans une communauté pour femmes près de la porte Saint-Denis nouvellement construite – un arc de triomphe situé aujourd’hui dans le Xᵉ arrondissement, à la jonction des boulevards de Bonne Nouvelle et Saint-Denis.

L’Italienne compose de la musique et l’offre au roi pour le remercier de sa générosité, produisant de nombreuses cantates, arias, motets solennels et des œuvres dramatiques. Elle doit néanmoins vivre dans la crainte constante d’être retrouvée à Paris par son mari. Ce n’est qu’en 1703, à la mort de ce dernier, qu’elle se sent libre de rassembler ses partitions en volumes achevés et présentables.

Au moment de sa mort, vers 1720, elle a relié huit volumes d’œuvres musicales. Quatre d’entre eux se trouvent à la Bibliothèque nationale de France depuis des siècles, deux ont été perdus et les deux contenant Ercole Amante ont été acquis aux enchères par le département de musique de la Bibliothèque nationale en 1937. La même année, la musicologue Yvonne Rokseth publia un article dans The Musical Quarterly dans lequel elle évoquait le contenu de l’opéra ainsi que les compositions figurant dans les autres volumes de Bembo.

J’étais étudiante en master à l’Université Duke (Caroline du Nord), à la recherche d’un sujet de thèse, en 1990, lorsque je suis tombée sur l’article de Rokseth. C’était la première fois que j’entendais parler de Bembo. J’ai obtenu les microfilms de la musique de Bembo, et mon directeur de thèse m’a donné son feu vert pour mener une étude sur sa vie et son œuvre.

Pendant des mois, j’ai cherché des documents mentionnant la compositrice aux Archives nationales de Paris, mais sans résultat. Lors d’un bref séjour à Venise en 1991, j’ai trouvé un livre répertoriant les noms de femmes ayant épousé des membres de familles nobles. D’après son contenu, j’ai émis l’hypothèse qu’elle était née Antonia Padoani et qu’elle avait épousé un membre de la famille Bembo, Lorenzo. L’année suivante, j’ai fait une découverte décisive : j’ai trouvé une liasse de documents aux Archives d’État de Venise qui révélaient qu’elle avait laissé la plupart de ses biens au couvent de San Bernardo à Murano. Elle avait également confié sa fille de 14 ans, Diana, au couvent afin de la protéger de son père.

Grâce à ces indices, j’ai pu trouver davantage d’informations sur la vie de Bembo dans des documents conservés aux Archives du patriarcat de Venise, au musée Correr et à la bibliothèque Marciana de Venise.

Au fil du temps, j’ai pu rassembler suffisamment de détails sur la vie et l’œuvre de Bembo pour écrire une biographie.

Une vie se dessine

Fille unique du docteur en médecine et poète amateur Giacomo Padoani et de Diana Paresco, Antonia Padoani a reçu une éducation musicale et grammaticale à Venise.

Giacomo Padoani s’est arrangé pour que Francesco Cavalli, le plus grand compositeur vénitien de l’époque, enseigne à sa fille.

On sait que Cavalli avait été appelé à Paris en 1660 pour composer un opéra à l’occasion du mariage de Louis XIV et de l’infante d’Espagne, Marie-Thérèse. Cet opéra, Ercole Amante, était basé sur un livret de Francesco Buti.

Le contemporain vénitien de Giacomo Padoani, le poète Giulio Strozzi, a également engagé Cavalli pour enseigner à sa fille, Barbara. Mais alors que Barbara allait publier une série de ses compositions, Antonia emprunta une voie différente qui déçut probablement son père. Au lieu de poursuivre une carrière de musicienne ou de poétesse, elle épousa Lorenzo Bembo. Il lui apporta un statut noble et trois enfants, mais lui causa aussi de nombreux problèmes.

En 1672, Antonia Bembo – qui vivait alors à l’arrière d’une maison connue sous le nom de Cà Bembo, dans le quartier de Santa Maria Nova – demanda le divorce, invoquant l’infidélité de Lorenzo ainsi que des violences physiques et psychologiques. La procédure échoua, si bien que cinq ans plus tard, elle quitta la ville en catimini pour commencer une nouvelle vie à Paris, laissant derrière elle son mari et ses enfants.

En 1707, Bembo acheva la composition d’une nouvelle partition musicale pour le livret d’opéra de Buti. À l’instar de l’opéra de Cavalli, celui-ci suit Hercule, qui devient obsédé par Iole, la fille d’un homme qu’il a tué. Il se trouve qu’Iole entretient également une relation avec le fils d’Hercule, et la poursuite d’Hercule finit par déclencher une série de rivalités entre dieux et mortels.

À certains égards, Bembo a amélioré l’opéra original de Cavalli. Une histoire mettant en scène un Hercule vieillissant au XVIIIᵉ siècle correspondait mieux au parcours de vie de Louis XIV que lorsque Cavalli avait composé l’opéra pour le mariage du roi alors âgé de 22 ans. Et alors que le public français avait critiqué l’italien utilisé par Cavalli dans son opéra, la fusion des styles musicaux italien et français opérée par Bembo – reflétant ce qu’elle avait entendu et appris à Venise et à Paris – rendait l’œuvre plus accessible.

L’heure de gloire d’Antonia Bembo

Alors pourquoi l’opéra de Bembo ne sera-t-il mis en scène qu’en 2026 ?

Tout d’abord, sa partition manuscrite était difficile à déchiffrer. Contrairement aux partitions de Barbara Strozzi, qui ont été imprimées et publiées de son vivant, les manuscrits de Bembo ont posé des défis aux interprètes. L’Opéra de Paris a créé une partition de scène d’Ercole Amante en faisant appel à une équipe éditoriale qui a corrigé les erreurs et rectifié les incohérences.

Deuxièmement, les compositrices d’opéras de musique ancienne – traditionnellement exclues du canon lyrique – ne voient leurs œuvres mises en scène que depuis peu. En 2023, par exemple, Céphale et Procris, un opéra écrit par Élisabeth-Claude Jacquet de La Guerre, contemporaine française de Bembo, ainsi qu’Alcina, de Francesca Caccini, ont été présentés au Boston Early Music Festival, aux États-Unis.

Claire Fontijn ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

28.05.2026 à 12:24

Les débuts prometteurs de la voiture électrique au XIXᵉ siècle

Texte intégral (2998 mots)

On ne le sait pas toujours, mais l’histoire de l’automobile électrique commence au XIXᵉ siècle, époque où elle battait des records de vitesse et dominait parmi les flottes de taxis de grandes villes comme New York. Alors que le véhicule électrique s’impose aujourd’hui comme une alternative incontournable pour un transport individuel moins carboné, retour sur ses débuts oubliés et les raisons de son déclin avec Gilles Garel, professeur titulaire de la chaire de gestion de l’innovation du Cnam et membre du conseil scientifique de l’exposition à succès Flops ? ! du Musée des arts et métiers.

L’histoire de l’automobile est indissociable de celle des moteurs. À la fin du XIXᵉ siècle, trois modes de propulsion se partagent le marché naissant de l’automobile : le moteur à essence (ou thermique), le moteur électrique et le moteur à vapeur.

En 1800, Alessandro Volta invente la pile voltaïque zinc-argent, permettant de stocker de l’énergie électrique. Avec l’invention de la première batterie rechargeable au plomb-acide en 1850, puis les améliorations du physicien Gaston Planté et de l’ingénieur chimiste Camille Alphonse Faure, les premiers véhicules électriques (VEL) apparaissent en Europe et aux États-Unis à la fin des années 1880, même si des prototypes isolés ont déjà circulé cinquante ans auparavant. L’essor des VEL s’appuie ensuite sur trois grandes pratiques.

Du sport et des records de vitesse

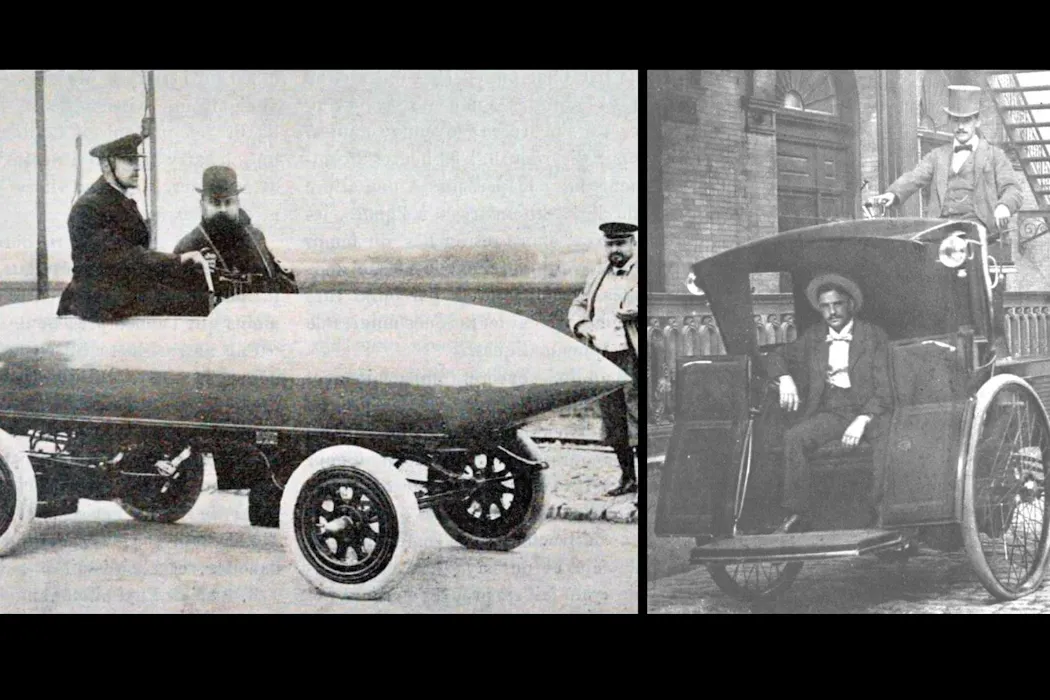

Les usages sportifs jouent d’abord un rôle essentiel dans la mise au point et la fiabilisation. Les moteurs électriques fournissent alors un couple maximal dès le démarrage, c’est-à-dire qu’ils délivrent une forte puissance pendant un court moment sans la complexité mécanique des moteurs thermiques de l’époque (vibrations, surchauffe, carburateurs imprécis…).

Dès 1895, des VEL participent ainsi aux premières grandes courses automobiles. Entre 1896 et 1904, plusieurs records de vitesse sont battus : le pilote belge Camille Jenatzy franchit les 100 km/h en 1899 avec la Jamais Contente, tandis que la Baker Torpedo Kid atteint 167 km/h en 1904 aux États-Unis. La presse est friande de ces exploits et relate les exploits des pilotes.

Des taxis fiables

Les flottes de taxis pour le service urbain, en lieu et place des fiacres hippomobiles, constituent un second usage des premiers VEL. Ici, la vitesse importe moins que la fiabilité et l’autonomie.

Dès les années 1890, des compagnies se développent aux États-Unis et en Europe avec des infrastructures de recharge et d’échange de batteries. Les producteurs d’électricité y voient un débouché pour lisser leur production grâce à des recharges nocturnes.

À l’instar de la London Electric Cab Company, créée en 1896, ou de l’Electric Vehicle Company Service, créée en 1897, à New York, des sociétés investissent dans les infrastructures électriques de transports, support d’un service urbain intégrant tramways, trolleys et taxis électriques. D’autres grandes villes américaines, comme Boston et à Baltimore, installent des centres d’échanges de batteries. Ces dernières sont remplacées en quelques minutes. À New York, plus de 600 taxis Electrobat circulent en 1900 sur un total de 1 000 VEL et le marché projeté à cinq ans est alors évalué à 15 000 taxis.

À Paris, plusieurs entreprises lancent des fiacres électriques et organisent la reconversion des cochers en chauffeurs. La Compagnie française des voitures électromobiles est créée en 1898 et exploite des fiacres électriques. Sa station de recharge parisienne traite 40 véhicules à la fois. L’année suivante, la puissante Compagnie générale des voitures, alors en charge d’une cavalerie de 12 000 chevaux, franchit le pas de la mécanisation.

Des véhicules pour les femmes aisées

Enfin, un premier marché privé du VEL va se développer en Europe et aux États-Unis. Le cas américain est intéressant, car en raison du piètre réseau routier interurbain, la faible autonomie des VEL permet de concentrer les trajets sur les grandes villes où se trouve aussi une clientèle aisée et féminisée. Lorsque la Ford T est lancée en 1908, le démarrage de son moteur (à essence) nécessite l’activation d’une grosse manivelle, là où les VEL de la fin du XIXᵉ siècle se démarrent en activant un interrupteur.

À New York en 1900, 38 % des voitures sont des VEL, 22 % sont des voitures à moteur à thermique et 40 % sont des voitures à vapeur. L’Electric Vehicle Association of America est fondée en 1909. Elle offre des tarifs préférentiels en heures creuses, exploite directement des garages publics, promeut les VEL dans un système intermodal taxi-train.

Toutefois, en dépit de ces débuts prometteurs, les VEL disparaissent presque en près d’une génération. Comment expliquer cela ?

Une autonomie limitée et un conflit mondial

Les partisans de l’approche déterministe expliquent la marginalisation du VEL par des facteurs techniques et économiques qui le rendent intrinsèquement inférieur aux véhicules à essence : autonomie limitée (l’essence stocke énormément plus d’énergie par kilogramme qu’une batterie), contrainte de recharge, manque de fiabilité des batteries et prix.

Alors que la guerre de 1914 justifie des besoins d’autonomie et d’approvisionnement distribués, les progrès sur les batteries stagnent. Le lancement de la Ford T en 1908 a déjà commencé à démocratiser le véhicule thermique personnel.

La production de masse abaisse durablement les prix par l’effet d’économie d’échelle. En 1913, la production annuelle atteint 180 000 véhicules. Le prix de vente passe de 850 $ en 1909 (soit entre 27 000 et 31 000 euros selon le taux de change, NDLR) à 260 $ en 1925 (soit 4 500 euros environ, NDLR).

En 1912, un véhicule thermique se vend pour environ 650 $ (environ 18 000 euros, NDLR) contre 1 750 $ pour un VEL (environ 50 000 euros, NLDR. Dans le même temps, l’offre pétrolière s’élargit avec la découverte de nouveaux gisements et les prix baissent.

Des facteurs sociaux et institutionnels

De son côté, l’approche constructiviste analyse l’échec des technologies par des facteurs contingents, sociaux, culturels et institutionnels. Le conflit de 1914 développe une formation massive à la conduite de camions à essence et une construction massive de grandes usines de fabrication. Après la guerre, ces développements facilitent l’expansion de la motorisation à essence.

La bascule se joue aussi du côté des usages et des infrastructures. L’arrivée du démarreur électrique chez Cadillac en 1912, puis chez rapidement tous les constructeurs, rend inutile la manivelle de démarrage du moteur thermique. Cette innovation met fin à l’avantage du démarrage facile et non salissant des premiers VEL.

En parallèle, les fonctions aval se structurent pour le véhicule thermique : entretien, distribution, réparation, alors que l’électrique demeure organisé autour de dépôts et de recharges planifiées de flotte et ne parvient pas à développer le marché individuel.

Un verrouillage progressif

Les recherches historiques ne montrent pas l’existence d’un « complot » délibéré des lobbies pétroliers pour éliminer le VEL, mais un verrouillage progressif du système automobile autour du pétrole et du moteur thermique.

On peut toutefois citer le célèbre cas de National City Lines, une entreprise de transport en commun créée en 1936 à Chicago (Illinois) par des actionnaires des secteurs de l’automobile, du pétrole et des pneumatiques, qui ont intérêt à voir disparaître les transports publics et, en particulier, les tramways électriques qui occupent la chaussée, entravant la circulation de leurs voitures.

National City Lines rachète de très nombreux réseaux de tramways américains, officiellement pour les gérer, en réalité pour les remplacer par des bus. L’entreprise sera condamnée lors d’un procès antitrust en 1949, mais aura anéanti les réseaux de tramways.

Relevons aussi que les constructeurs, les agences publicitaires et les industries pétrolières contribueront à la construction d’un imaginaire et d’une mythologie virilisée de l’automobile thermique.

La généralisation des stations-essence

Ainsi, aux États-Unis, malgré les efforts de l’Electric Vehicle Association of America, les infrastructures de recharge restent insuffisantes, freinées par une électrification domestique incomplète. Les difficultés de l’Electric Vehicle Company (retards, incendies, faillite) fragilisent durablement la filière.

Parallèlement, le développement des liaisons interurbaines favorise le moteur thermique, plus adapté aux longs trajets et au ravitaillement rapide. L’accès à l’essence est aussi facilité. Si les stations-service se généralisent en Occident après la Première Guerre mondiale, on trouve déjà de l’essence auparavant chez les commerçants de proximité. Plus il y a de voitures thermiques, plus les infrastructures essence deviennent rentables et se développent.

Des pénuries de pétrole qui questionnent

Le VEL ne disparaît pas complètement, mais se niche sur des petits marchés (taxis, livraison). En 1942, une étonnante petite voiture en aluminium, l’Œuf électrique, œuvre du designer français Paul Arzens, avec son autonomie de 100 kilomètres et une vitesse de 70 km/h, circule à Paris, en pleine période de pénurie de carburant. Mais il s’agit d’un exemplaire unique.

Le choc pétrolier de 1973 relance temporairement l’intérêt pour l’électrique. En France, une petite série de Renault 5 électrique est développée avec EDF. L’ère moderne du VEL débute véritablement en 1996 avec le lancement de l’EV1 par General Motors, mais le véritable tournant intervient en 2017 avec la Tesla Model 3, dont le lancement suscite 450 000 précommandes en une semaine. À partir de 2020, le marché mondial des VEL et des hybrides rechargeables connaît une forte accélération, dominée par la Chine.

Qualifié par certains d’« éternellement émergent », le VEL traverse actuellement le début de la période qui lui permettra enfin de s’imposer.

Gilles Garel ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

27.05.2026 à 16:40

Joueuses de tennis : derrière les paillettes de Roland-Garros, la fragilité des carrières sportives

Texte intégral (1426 mots)

Derrière les stars de tennis qui accèdent aux demi-finales et aux finales des grands tournois, une majorité d’athlètes participent activement au circuit, sans pour autant en vivre pleinement. Éclairer ces carrières invisibles remet en question notre vision parfois idéalisée du sport de haut niveau.

Chaque année, Roland-Garros remet le tennis au centre de l’attention médiatique. Pendant trois semaines, de nombreuses athlètes retiennent l’attention de milliers de spectateurs et marquent le souvenir des passionnés de la petite balle jaune. Des figures emblématiques du tournoi, comme Iga Świątek, d’Aryna Sabalenka ou de Coco Gauff, constituent l’élite du tennis. Elles ne représentent pourtant que la partie émergée de l’iceberg.

Loin des lumières des Internationaux de France et de ses millions de gains se cache une réalité bien plus sombre : des athlètes « invisibles » qui participent activement au circuit sans pour autant en vivre pleinement.

Avant d’atteindre le court central, les joueuses traversent des trajectoires longues, coûteuses et particulièrement sélectives. Comment y sont-elles parvenues ? Et surtout, à quel prix ?

À partir de 29 récits de vie recueillis auprès de joueuses françaises de haut niveau, nos travaux montrent que, pour comprendre les carrières tennistiques, il faut dépasser l’image idéalisée du sport de haut niveau et interroger les conditions sociales qui rendent possibles certaines trajectoires, et en fragilisent d’autres.

Une vocation qui ne doit rien au hasard

Dans l’imaginaire collectif, on retrouve souvent l’idée que les athlètes auraient des prédispositions qui les distingueraient dès l’enfance. En réalité, les carrières des joueuses de tennis se construisent tôt, dans des environnements familiaux, scolaires et sportifs particuliers.

Si l’entrée dans le monde tennistique peut s’expliquer par des histoires singulières, toutes les joueuses qui commencent ce sport ne disposent pas des mêmes ressources pour poursuivre une carrière au plus haut niveau. On voit peser, dès l’entrée dans la pratique, les conditions sociales et familiales qui expliquent l’engagement des joueuses : le fait d’être porteur d’un capital à la fois culturel et économique et d’avoir été socialisées précocement à l’activité par la famille (en moyenne à l’âge de 5 ans).

Des transformations profondes sont ensuite opérées dans le quotidien des joueuses pour augmenter leurs chances de réussite : en moyenne trente-cinq heures d’entraînements par semaine, mise à distance de la scolarité classique, relations sociales recentrées sur le milieu tennistique, éloignement de toute activité susceptible de compromettre les performances sportives.

L’univers tennistique tend à devenir le seul horizon possible, au détriment des autres aspects de leur vie.

Deux voies pour atteindre le haut niveau

Contrairement à des pratiques sportives, comme le football ou encore le basket-ball, dans lesquelles la formation se réalise essentiellement au sein d’une « organisation enveloppante », articulant les différents aspects de la vie des jeunes sportifs, le tennis voit coexister deux voies distinctes pour tenter d’atteindre le plus haut niveau.

D’une part, la voie fédérale, réservée à une infime partie des joueuses sélectionnées, donne accès à « un monde à part ». Cette voie offre des conditions favorables – encadrement qualifié, accompagnement en tournois, aides financières, double cursus aménagé –, mais impose ses propres contraintes. Organisée selon des paliers d’âge, elle exige un rythme de progression qui ne correspond pas toujours au développement de chaque joueuse, au risque d’écarter celles dont l’évolution est plus tardive.

D’autre part, une partie des joueuses passent par la voie privée ou familiale. En l’absence de soutien fédéral, ce sont les parents qui ont la charge organisationnelle, temporelle, administrative ou encore financière : identifier les entraîneurs, organiser les déplacements en tournoi, négocier les aménagements scolaires, financer la pratique. Malgré le caractère incertain de la carrière, la famille devient donc un relais indispensable dans un projet qui engage l’ensemble du foyer.

L’entrée sur le circuit international

L’entrée sur le circuit international constitue un passage clé dans leur carrière. Si les joueuses ont connu une réussite rapide sur le plan national, elles font face à une réalité bien souvent éloignée de l’image des championnes. Le circuit repose sur une logique de tournois dans lesquels les revenus sont directement indexés sur les résultats.

Il n’existe ni contrat de travail, ni salaire fixe, ni protection sociale. Ce système, que les économistes qualifient de « théorie des tournois », concentre l’essentiel des gains sur une infime fraction des joueuses, laissant la majorité dans une instabilité financière.

Deux profils de joueuses se distinguent à ce stade de la carrière. D’un côté, les « équilibristes », qui font de leur pratique leur activité principale, sans parvenir à sortir de la précarité. Ces « sans-grades » du tennis s’accrochent à leur « rêve », dans l’espoir de devenir un jour la « consacrée ». Se tenant sur un fil, elles adoptent des stratégies court-termistes : emprunts bancaires, mutualisation des frais d’hébergement avec d’autres joueuses, choix des tournois dictés davantage par les contraintes financières, transports et hôtels à bas coûts.

C’est à cette étape que les effets de l’origine sociale se manifestent. Les joueuses issues de milieux favorisés qui disposent de ressources suffisantes peuvent continuer leur carrière et maintenir un encadrement de qualité. Celles qui ne disposent pas de ces ressources sont parfois contraintes d’interrompre leur parcours faute de moyen.

De l’autre côté, les « consacrées » parviennent à sortir de la précarité financière grâce aux résultats obtenus sur les tournois de la Women’s Tennis Association (WTA) et aux avantages qu’ils procurent : prise en charge de l’hébergement et de la restauration, partenaire d’entraînement mis à disposition, gains significatifs, dispositif de retraite proposé par la WTA.

Ces joueuses peuvent désormais envisager plus sereinement leur carrière au quotidien et anticiper leur reconversion. Elles sont moins tributaires de facteurs externes, tels que le soutien de la famille qui était nécessaire pour faire face aux frais dans les débuts de leur carrière. Leur trajectoire illustre ce que Rosen (1981) désignait par le terme de « Supertars », c’est-à-dire un système dans lequel une infime minorité concentre la quasi-totalité des bénéfices symboliques et matériels, au détriment du plus grand nombre.

Dans un sport dont les coûts annuels atteignent rapidement 60 000 euros, cette réalité signifie que toutes les joueuses ne disposent pas des mêmes chances d’envisager une carrière de haut niveau. Le nombre restreint de championnes qui arrivent à se démarquer en gagnant des tournois du Grand Chelem ou à se situer parmi les meilleures mondiales interroge, alors même que la France dispose de structures propices au développement de carrières sportives.

Lauréate du prix de thèse de l’INJEP et de l’Observatoire national du sport 2024 – Mention « Sport et pratiques sportives »

27.05.2026 à 16:40

Et si une caméra couplée à l’IA pouvait aider à diagnostiquer des troubles moteurs chez le nourrisson ? L’exemple de l’amyotrophie spinale

Texte intégral (1491 mots)

Détecter le plus tôt possible après la naissance une motricité altérée grâce à une caméra ordinaire couplée à des systèmes intelligents et aider ainsi à établir le diagnostic dans des maladies du nourrisson caractérisées par une hypotonie, c’est-à-dire la baisse ou la disparition des mouvements actifs, des muscles. C’est la piste que poursuit une équipe de recherche à partir de travaux menés sur des bébés atteints d’amyotrophie spinale, une maladie neuromusculaire génétique rare.

En 2019, le médicament Zolgensma défrayait la chronique en étant le traitement le plus cher du monde. Le prix de ce médicament contre l’amyotrophie spinale (SMA) a été fixé à près de 2 millions d’euros l’injection.

Et, en même temps, quel progrès extraordinaire ! Il promet de traiter de manière définitive, une maladie génétique létale, qui entraîne en cas de survie des handicaps extrêmement lourds chez les enfants atteints par ce qui est la première maladie neurologique périphérique héréditaire au monde.

Derrière ces chiffres vertigineux se cachait une réalité médicale urgente. Pour que ces thérapies fonctionnent, il est essentiel d’identifier la maladie le plus tôt possible. C’est précisément ce défi que notre équipe a cherché à relever, en utilisant une caméra ordinaire couplée à des systèmes intelligents.

L’objectif était clair, dès le départ. Trop de retards diminuent de manière drastique l’efficacité du traitement. En effet, le traitement peut empêcher les neurones de mourir, mais ne peut pas les ressusciter. Tout retard à la mise en place du traitement et, donc, au diagnostic est une perte de chance intolérable pour les patients.

Qu’est-ce que l’amyotrophie spinale ?

La SMA est une maladie génétique rare qui entraîne la dégénérescence progressive des neurones moteurs qui commandent les muscles.

Quand elle frappe sous sa version la plus sévère – qui correspond à l’amyotrophie spinale de type 1 –, les nourrissons atteints perdent rapidement la capacité de bouger, de s’asseoir puis de respirer. Sans traitement, l’espérance de vie dépasse rarement deux ans. En France, on compte un cas toutes les 6 000 à 10 000 naissances.

Depuis l’arrivée de nouveaux traitements, le pronostic s’est radicalement transformé pour les enfants traités très tôt. L’amyotrophie spinale est, d’ailleurs, intégrée depuis 2025 au dépistage néonatal systématique en France. Tous les pays ne disposent pas encore de ce dépistage. Et même là où il existe, un outil complémentaire d’évaluation clinique rapide garde toute son utilité.

L’hypotonie désigne la diminution, voire la disparition, des mouvements actifs. Ce symptôme n’est pas spécifique et peut concerner beaucoup d’autres maladies de l’enfant, mais il reste le premier point d’appel, celui qui permet d’évoquer rapidement le diagnostic.

Un enjeu autour du diagnostic clinique

Avant les tests génétiques, le diagnostic repose sur l’observation clinique. Un spécialiste scrute le tonus musculaire chez le nouveau-né et ses réflexes. Souvent, on parle de « nourrisson hypotonique » : le bébé semble mou, ses membres retombent sans résistance.

Mais cette évaluation est subjective, car elle varie selon les praticiens, en plus d’intervenir trop souvent bien tard alors que les signes ont déjà largement progressé.

Le vrai défi est donc là : la fenêtre thérapeutique est étroite.

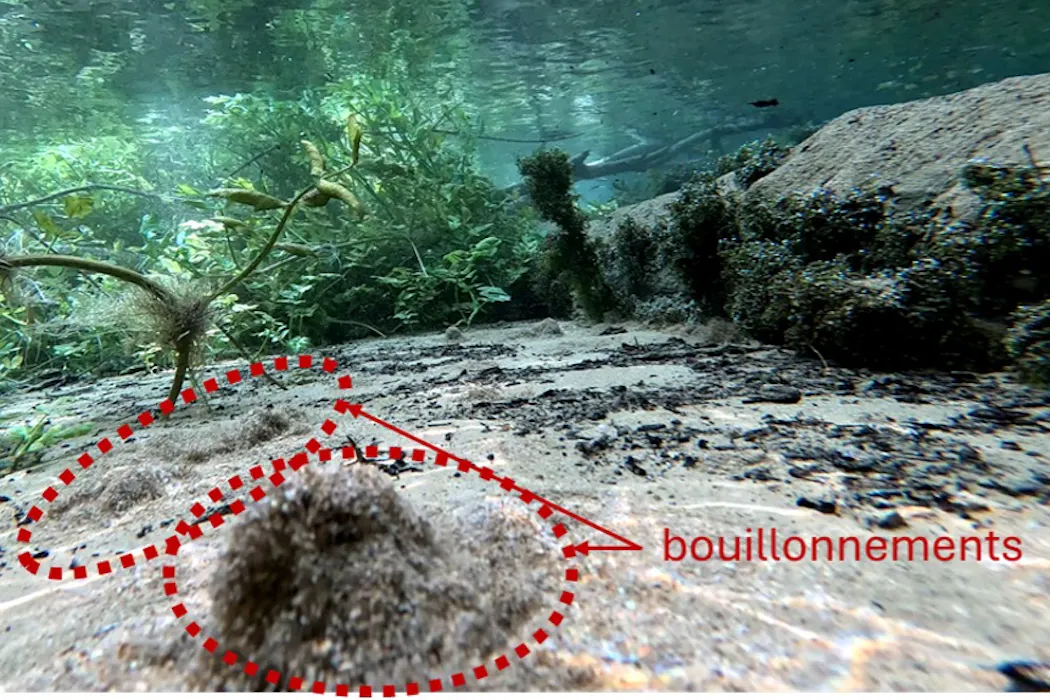

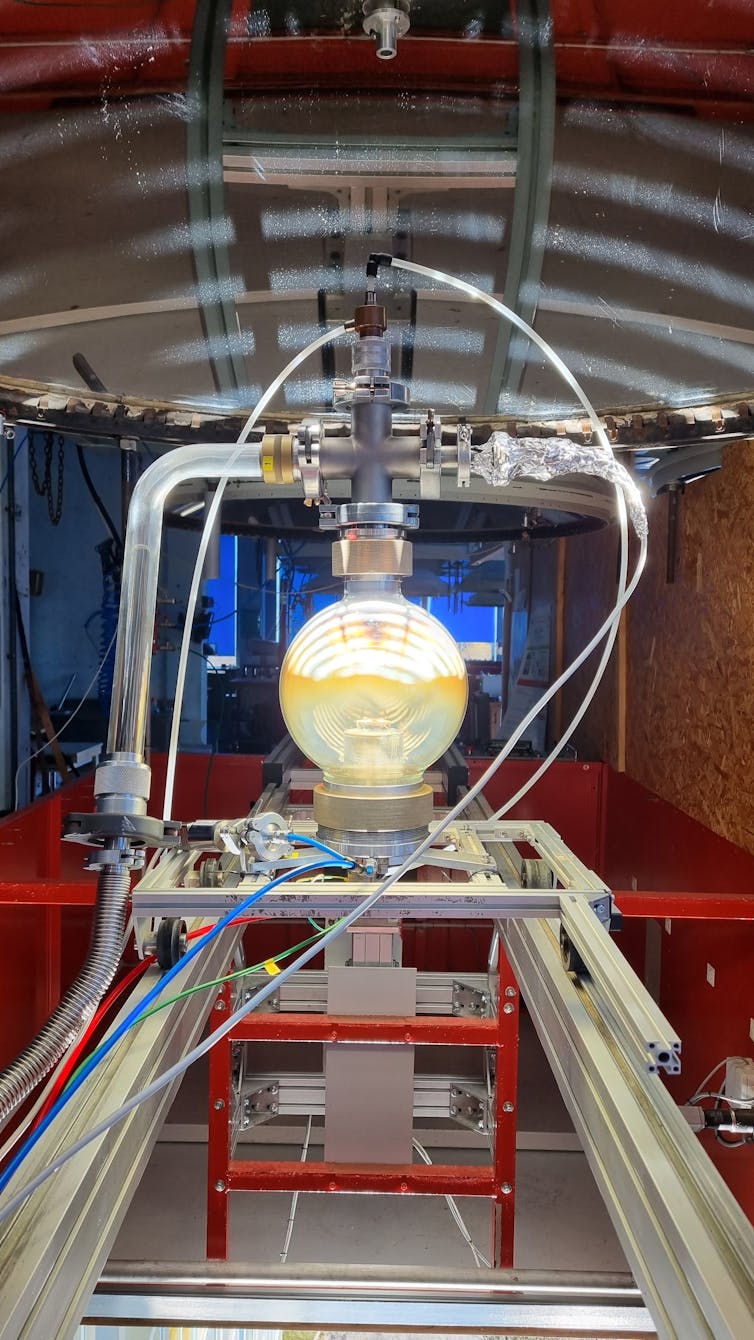

Notre approche : filmer pour analyser

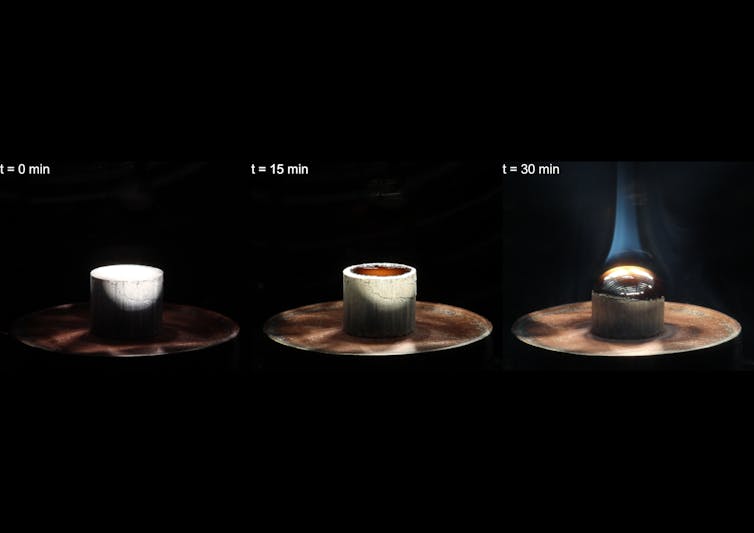

Notre étude a porté sur 25 nourrissons hospitalisés en réanimation pédiatrique : 5 ayant une SMA confirmée génétiquement et 20 témoins avec un examen neurologique normal. Nous avons utilisé la vision par ordinateur pour analyser les mouvements spontanés des nourrissons. Le principe est simple : le nourrisson repose sur un fond uni pendant qu’une caméra classique le filme durant soixante secondes ; un algorithme d’intelligence artificielle analyse ensuite cette vidéo image par image.

Concrètement, cette étude repose sur un pipeline d’analyse vidéo en trois étapes, comme le montre la figure 1.

Le système reconstruit d’abord un « squelette numérique » du nourrisson, sous forme de douze points articulaires, huit segments correspondant aux membres, et quatre angles de mouvement (estimation de la pose), grâce à une méthode d’estimation de la pose humaine en temps réel appelée Alpha Pose.

À partir de ce squelette animé sont calculés des centaines de paramètres (amplitude des gestes, profondeur des mouvements, symétrie, fréquence…). Au total, 108 caractéristiques ont été extraites. Nous avons ensuite entraîné un algorithme d’apprentissage supervisé (de type XGBoost) capable de distinguer une motricité typique d’une motricité altérée, caractéristique de l’amyotrophie spinale.

Des résultats prometteurs

Les résultats sont encourageants : l’algorithme a classifié correctement les deux groupes avec une précision de 97 %.

En tête des paramètres les plus discriminants, on trouve la profondeur des mouvements, autrement dit la capacité du nourrisson à déplacer ses membres dans l’espace. Les bébés atteints de SMA présentent une différence significative de motricité dans l’axe de la profondeur avec une sensibilité de détection supérieure à 97 %. L’outil développé le mesure avec rigueur, transformant une impression visuelle en données objectives. Ce que l’œil du clinicien perçoit intuitivement, l’algorithme le quantifie avec précision.

Pour rendre la décision de l’IA explicable, et donc utilisable en pratique clinique, nous avons utilisé une méthode mathématique appelée Shapley Additive Explanations (SHAP), qui permet de visualiser les paramètres qui ont le plus pesé dans chaque décision de l’algorithme.

Un outil pour d’autres maladies provoquant une hypotonie chez le nourrisson

Notre étude a été menée avant 2025, à une époque où aucun dépistage systématique n’existait encore en France. Depuis, la SMA a été intégrée au programme national de dépistage néonatal, ce qui confirme rétrospectivement l’urgence qui motivait notre étude.

Mais au-delà de la SMA, de nombreuses autres maladies provoquent une hypotonie chez le nourrisson sans qu’aucun outil d’évaluation rapide n’existe. C’est vers cette direction que nos travaux se poursuivent. Cet outil ne cherche pas à remplacer le médecin, mais à lui donner, en quelques minutes et sans équipement spécialisé, un premier signal objectif pour orienter son diagnostic.

L’intelligence artificielle ne fait pas de miracle, mais elle peut rendre visible ce qui est difficile à percevoir à l’œil nu. Son apport devient précieux quand chaque semaine compte pour un nourrisson.

Le mécénat scientifique d’AXA fait désormais partie du Fonds Axa pour le progrès humain, qui regroupe les engagements philanthropiques du Groupe et des mutuelles d’assurances Axa dans les domaines de la science, de la nature, de la solidarité et de la culture. Avant 2025, ce mécénat scientifique global était assuré par le Fonds Axa pour la recherche, qui a soutenu plus de 750 projets à travers le monde depuis sa création en 2007. Pour en savoir plus, rendez-vous sur Fonds Axa pour le progrès humain.

Imen Trabelsi a reçu des financements du fonds AXA.

François Jouen a reçu des financements du fonds AXA.

Jean Bergounioux a reçu des financements du fonds AXA.

27.05.2026 à 16:36

Antony Gormley, l’art de redéfinir la nature et les limites du corps humain

Texte intégral (3012 mots)

Le sculpteur britannique Antony Gormley, 75 ans, a été, comme Anish Kapoor en 1991, Damien Hirst en 1995 ou la Française Laure Prouvost en 2013, l’un des récipiendaires en 1994 du prix Turner, décerné au Royaume-Uni depuis 1984 aux jeunes artistes contemporains. Son œuvre explore notamment la représentation du corps humain, de sa nature et de ses relations au monde. Un travail qui questionne la nature même de la sculpture.

Antony Gormley a étudié l’anthropologie, l’archéologie et l’histoire de l’art au Trinity College de Cambridge, puis passé trois ans en Inde. Son œuvre, surtout présente au Royaume-Uni, s’inscrit dans une quête qui est au cœur de la sculpture depuis toujours : le corps humain. En déconstruisant sa représentation, il explore, au-delà du corps, notre relation à l’espace et aux autres, à l’aide d’une grande variété de matériaux : acier, fer, pierre, béton…

Ses sculptures soulèvent d’emblée une question : où sont les limites du corps humain ? A-t-il même des limites ? Dans son œuvre, la sculpture devient une mise en scène matérielle qui explore notre présence au-delà de notre enveloppe corporelle. Pourtant, la sculpture s’appuie habituellement sur une caractéristique immédiate de la matière solide : sa surface.

Les physiciens, les chimistes et les biologistes décrivent la surface de la matière dense (les solides mais aussi les liquides) comme une interface sans épaisseur : on passe du plein au vide en une distance atomique. Cette surface est la même pour tous, scientifiques et artistes. La sculpture, comme, en particulier, la physique et la chimie des surfaces, se construit sur cette caractéristique de la plupart de ses matériaux : le marbre, les métaux, le bois, la cire, le plâtre… Les œuvres de Richard Serra et de César Baldaccini explorent explicitement ces notions d’intérieur (la matière dense), d’extérieur (l’air qui peut être vu ici comme le vide) et de surface comme lieu de la séparation brutale entre les deux.

Pour que la sculpture puisse utiliser ces matériaux pour reproduire le corps humain, il faut que ces notions de vide et de plein séparés par une surface abrupte s’appliquent au corps humain mou comme à la matière dense dure. Et c’est bien le cas – dans le cas du corps, cette surface est celle de la peau. Les physiciens des matériaux, eux par contre, se séparent ici. Il y a les spécialistes de la soft condensed matter, la matière dense molle, (c’est donc notamment la matière biologique faite de carbone), et de la hard condensed matter, la matière dense dure (comme le silicium à la base du numérique et de l’intelligence artificielle, ou les aciers).

Copier les formes de la nature

Un des défis permanents de la sculpture a été la reproduction des formes de la nature, y compris des corps humains, souvent en les idéalisant ou en les interprétant. À travers les siècles, la variété des styles est inouïe, et la taille du marbre ou du bois, le moulage du plâtre, de la cire ou des métaux a révélé une variété de techniques et une maîtrise impressionnantes, sidérantes même. Il en résulte aussi une impression de court-circuit temporel : avec l’aurige de Delphes, le siécle de Périclés est là devant nous, aujourd’hui.

En 1770, Voltaire donne son accord à Jean-Baptiste Pigalle pour être représenté en vieillard quasi nu. Le réalisme de la représentation est saisissant. Cette précision dans la reproduction de la surface du corps telle que nous la voyons toujours a aussi permis d’inscrire une expression fascinante du visage. Avec cette statue criante de vérité, Voltaire est toujours là. Sept cent trente-cinq kilos de marbre ont permis ce tour de force. Cette statue est évidemment pleine – comment faire autrement en taillant du marbre ? Mais elle pourrait aussi bien être vide et avoir la même apparence. Seule compte ici la surface extérieure qui définit la forme dans tous ses détails. Plus précisément, seuls comptent les détails que notre vision est capable de percevoir… mais notre vue est très exigeante.

« Pas seulement la forme mais la vie »

Dans le livre Rodin, le livre du centenaire, l’historienne d’art Catherine Lampert, ancienne directrice de la célèbre Whitechapel Gallery à Londres, rapporte cette citation d’un anonyme :

« Mon principe, disait Rodin, ce n’est pas d’imiter seulement la forme mais d’imiter la vie. Cette vie, je la cherche dans la nature, mais en l’amplifiant, en exagérant les trous et les bosses, afin de donner plus de lumière ; puis je cherche dans l’ensemble une synthèse. »

L’homme qui marche manifeste ces trous et ces bosses qui sont au service de la volonté d’imiter la vie, d’imiter ses expressions. Effectivement, nous voyons d’une part à quel point la vie paraît émerger ainsi de la matière inerte, et d’autre part combien Rodin s’éloigne ici du projet de Jean-Baptiste Pigalle. Il n’y a pas de trous et de bosses sur la statue représentant Voltaire autres que ceux de la peau et des muscles fatigués !

Avec Antony Gormley, on explore l’étendu de ce corps vivant

Antony Gormley a exposé au musée Rodin en 2023.

Paradoxalement, il me semble que les œuvres montrées dans la vidéo ci-dessous rapprochent beaucoup Antony Gormley du propos de Rodin alors que son œuvre Feeling Material XIV à l’image d’une multitude d’autres, me semble s’inscrire dans une vision radicalement différente. Je le vois comme une marque de la richesse du travail d’Antony Gormley. Toujours dans Rodin, le livre du centenaire, Sophie Biass-Fabiani, conservatrice au musée Rodin, souligne, dans son article « L’expressionisme aujourd’hui : filiations et confrontations », à propos d’Antony Gormley :

« Antony Gormley, tout en se limitant à la forme humaine, déplace le sujet de son travail en direction du rapport de l’espace du corps à l’espace environnant. »

Dans mon langage de physicien, après Jean-Baptiste Pigalle et Auguste Rodin, on passe ici à un troisième modèle qui fonde une nouvelle sculpture et une autre forme de perception de l’objet. Ici, pour le montrer dans l’espace, l’artiste revient sur la nature même d’un corps vivant, sur sa présence, son extension. L’œuvre ne rend plus si évidents le vide et le plein, l’extérieur et l’intérieur. Au contraire, elle les questionne immédiatement par le choix des matériaux.

Il est pratiquement impossible de créer une masse compacte avec le fil métallique utilisé par l’artiste. Pour obtenir une structure métallique compacte, on passe en général par la phase liquide, comme l’indique cette explication sur le site du musée Rodin :

« Deux procédés permettent de passer du modèle en plâtre au bronze : la fonte à la cire perdue et la fonte au sable, utilisée à l’époque de Rodin mais très rare aujourd’hui. Dans les deux cas, le bronze en fusion est coulé dans un moule autour d’un noyau qui sera ensuite retiré. Au final, l’œuvre en bronze est creuse, ce qui allège son poids et son coût. »

À l’image d’un grand nombre d’œuvres de cet artiste, les fils métalliques de Feeling Material XIV installent une figure humaine au centre de l’œuvre. Autour et au loin tourbillonnent les mêmes fils pour figurer un corps vivant qui ne saurait se limiter à son enveloppe corporelle. Parce qu’un corps vivant parle, bouge, se déplace, mais aussi respire, transpire, émet sans arrêt des particules de natures et de tailles multiples, de la vapeur d’eau, voire des liquides, etc. Mais bien sûr Antony Gormley permet de penser une infinité d’autres échanges entre une personne et le reste du monde, au-delà du regard scientifique sur le corps.

Un corps toujours renouvelé par la technologie, mais est-il encore humain ?

Parmi les sculptures de Gormley, ces corps-pixels semblent nous demander si un corps transformé par la technologie est encore humain.

Sur cette image, on voit Antony Gormley et deux de ses sculptures à l’échelle un – sont de la taille de l’artiste. Ce ne sont pas des robots, même si on pourrait le croire au premier abord. L’intérieur et l’extérieur du corps ne sont plus si évidents tant ils s’interpénètrent. Et si le corps est matérialisé par un réseau de barres métalliques très denses, extrêmement rigides, elles enserrent du vide – on aperçoit des espaces entre les barres. Un corps humain vivant, ce sont au contraire des organes mous qui se lient, s’enchevêtrent, des organes aux courbes arrondies, lisses, compacts, ronds ou allongés, qui ne laissent aucun espace vide.

Les deux statues de droite semblent nier systématiquement le corps de l’artiste : des lignes droites verticales et horizontales, uniquement des angles droits. Les vides viennent souligner la brutalité de cette structure. Ces corps, très semblables, semblent restructurés par une technologie omniprésente qui n’aime rien tant que les formes évidentes et binaires, à l’opposé de la complexité, de la singularité, de la subtilité, de la finesse, voire de la souplesse – pensons au Voltaire de Jean-Baptiste Pigalle.

En physicien des solides rigides, qui travaille sa proximité avec la physique de la matière molle, celle du vivant, je me sens ici dans une forme de proximité. C’est ainsi que je reçois ces œuvres et cette seconde métaphore : la figuration d’un monde toujours moins humain…

Joël Chevrier ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

27.05.2026 à 16:27

Le double dilemme de Kevin Warsh : satisfaire Donald Trump (et accroître l’inflation) ou les membres de la Fed (et obtenir un taux de croissance moins élevé)

Texte intégral (1946 mots)

Resserrement monétaire, statu quo ou assouplissement : le futur président de la Réserve fédérale états-unienne Kevin Warsh devra choisir entre ces trois politiques monétaires. Dans un contexte de crise géopolitique avec l’Iran et de hausse des prix énergétiques, ses décisions seront scrutées de près. Se montrera-t-il conciliant avec la volonté de Donald Trump de privilégier la croissance quitte à accroître l’inflation, ou sera-t-il le garant de l’indépendance de la banque centrale des États-Unis ?

Le 13 mai 2026, le Sénat a approuvé la nomination de Kevin Warsh à la tête de la Réserve fédérale. Le candidat choisi par Donald Trump fin janvier pour succéder à Jerome Powell – dont le mandat en tant que président s’est terminé le 15 mai 2026 – devrait donc diriger la prochaine réunion de politique monétaire prévue les 16 et 17 juin.

Dans un contexte marqué par un rebond de l’inflation et les pressions exercées par Donald Trump sur la conduite de la politique monétaire, les premiers pas de Kevin Warsh seront attentivement scrutés.

À court terme, il est probable que la Réserve fédérale maintiendra son taux directeur entre 3,5 et 3,75 %. Mais ensuite, va-t-elle augmenter ce taux pour lutter contre l’inflation ou ne pas le faire pour soutenir la croissance et, ainsi, satisfaire le locataire de la Maison-Blanche ?

Prudence de la Fed

Alors que l’inflation baissait progressivement depuis son pic de juin 2022, la forte augmentation des droits de douane imposés par les États-Unis sur les importations, puis l’envolée récente des prix de l’énergie ont conduit à une nouvelle accélération des prix. Selon le BLS (Bureau of Labor Statistics), l’inflation est passée de 2,4 % en février à 3,8 % en avril 2026. Dans le même temps, l’activité a ralenti en 2025, avec une croissance de 2,1 % en 2025 contre 2,8 % l’année précédente ; les créations d’emplois ont nettement baissé, passant de plus de 1,8 million en 2024 à moins de 750 000 en 2025.

Jusqu’ici, la Réserve fédérale s’est montrée prudente quant à l’orientation de la politique monétaire états-unienne. Après une première série de baisses du taux d’intérêt en 2024, elle a marqué une pause début 2025, invoquant l’incertitude liée aux effets de la guerre commerciale sur les prix et l’activité.

La crainte d’une dégradation de la situation sur le marché du travail l’a conduite à décider de trois nouvelles baisses d’un quart de point lors des réunions de septembre, octobre puis décembre 2025, portant ainsi le taux directeur à 3,75 %. Le déclenchement de la guerre contre l’Iran s’est traduit par une inflation plus élevée que la cible de 2 % retenue par la Réserve fédérale, compromettant la poursuite de l’assouplissement.

Resserrement monétaire

Kevin Warsh devrait être confronté à l’éternel arbitrage des banques centrales, lorsque l’économie est frappée par des chocs qui ont à la fois pour effet d’augmenter l’inflation et de réduire la croissance.

Contrairement à la Banque centrale européenne, dont l’objectif prioritaire est la stabilité des prix, le mandat de la Réserve fédérale n’établit pas de hiérarchie entre la stabilité des prix et le plein-emploi. Les autorités monétaires états-uniennes doivent arbitrer entre le risque de maintenir l’inflation au-dessus de sa cible si le choc est plus durable que ce qu’elle avait anticipé et celui de peser sur la croissance avec un resserrement monétaire.

Lorsque ces chocs sont temporaires, il est préférable de ne pas (trop) resserrer la politique monétaire, c’est-à-dire augmenter les taux d’intérêt directeurs, le principal outil dont disposent les banques centrales pour atteindre leur objectif de croissance et d’inflation. Une hausse de taux directeurs se répercute en effet sur les conditions de financement, ce qui réduit le crédit, les dépenses d’investissement et de consommation. Le ralentissement induit de la demande conduit ensuite à une baisse de l’inflation.

D’une part, la hausse des taux d’intérêt n’aura pas d’effet sur les sources de l’inflation puisque celle-ci est tirée par les droits de douane et le prix du pétrole, sur lesquels la politique monétaire n’a pas d’effet. En effet, les prix des biens importés augmentent du fait de la guerre commerciale, et la hausse du prix de l’énergie est directement liée au conflit engagé contre l’Iran. Un resserrement monétaire se traduirait alors par une baisse de l’inflation domestique hors énergie provoquée par un ralentissement de la demande.

D’autre part, les effets de la politique monétaire se font sentir après plusieurs trimestres et donc, potentiellement, une fois la crise terminée. Il pourrait alors y avoir un sous-ajustement de l’inflation par rapport à sa cible si les prix de l’énergie sont revenus à leur niveau initial et si les prix hors énergie ont ralenti.

Un resserrement monétaire peut être optimal en cas d’effet de second tour, c’est-à-dire si la hausse des prix des biens importés et de l’énergie se diffuse aux autres prix ou aux salaires. Dans ce cas, les entreprises répercutent la hausse de leurs coûts de production sur les prix et les salariés cherchent à compenser leur perte de pouvoir d’achat en demandant des hausses de salaire. Il en résulterait une hausse de l’inflation hors énergie.

Inversement, la baisse du pouvoir d’achat des ménages réduit la demande et peut entraîner une baisse de l’inflation domestique. Selon l’importance relative de ces effets, la réponse optimale de politique monétaire peut alors être restrictive (une hausse des taux d’intérêt) ou expansionniste (une baisse des taux d’intérêt).

Pressions politiques

Kevin Warsh tiendra nécessairement compte du contexte politique. Depuis janvier 2025, Donald Trump n’a cessé de faire pression pour que les taux soient réduits plus fortement et rapidement. Il a régulièrement critiqué Jerome Powell, allant même jusqu’à faire planer la menace de son renvoi, portant de fait atteinte à l’indépendance de la Réserve fédérale.

La désignation des gouverneurs de banque centrale est une décision souvent très politique. En choisissant Kevin Warsh, on peut imaginer que Donald Trump espère obtenir une politique monétaire plus en phase avec son souhait de baisse des taux, même si lors de son audition devant le Sénat, Kevin Warsh a indiqué que le président n’avait pas formulé de telle demande, et a tenu à affirmer son indépendance.

À lire aussi : Vent de panique sur l’indépendance des banques centrales avec la nomination de Kevin Warsh et la succession de Christine Lagarde

Les premières décisions qu’il prendra ne devraient pas forcément nous éclairer, car comme indiqué précédemment, le contexte actuel pourrait justifier un resserrement monétaire, un statu quo ou un assouplissement. Cette dernière option semble la moins légitime à court terme avec une inflation qui devrait rester au-dessus de 2 % jusqu’en fin 2027 et un taux de chômage – 4,4 % au premier trimestre 2026 – proche de son niveau naturel estimé par le CBO (Congressional Budget Office).

Des travaux académiques récents, comme ceux de Carola Binder (2021) ou de Thomas Drechsel (2025), suggèrent que les pressions politiques conduisent in fine la banque centrale à mener une politique monétaire plus accommodante, ce qui se traduit par une inflation plus élevée.

Dans le contexte actuel, reléguer au second plan l’objectif de lutte contre l’inflation pourrait réduire la crédibilité de l’action de la Réserve fédérale et éroder encore un peu plus la confiance des Américains après l’épisode inflationniste de 2021-2023, comme le suggère l’enquête du Michigan Survey.

Obtenir un consensus

Kevin Warsh devra donc choisir entre mécontenter le président qui vient de le nommer et risquer de réduire la crédibilité de la Réserve fédérale.

Rappelons que les décisions de politique monétaire ne seront pas prises par Kevin Warsh seul, mais par les douze membres du Federal Open Market Committee (FOMC), un organe de la Fed. Quand bien même Warsh agirait sous l’influence de Donald Trump, encore faudra-t-il qu’il parvienne à convaincre les onze autres membres de le suivre, ce qui semble peu réaliste. Les votes sur les décisions prises depuis janvier 2025 montrent un large consensus sur l’orientation de la politique monétaire américaine.

Sur les douze membres, il n’y a jamais eu plus de deux voix en faveur d’une politique plus accommodante que celle proposée par Jerome Powell. Avec un renouvellement régulier mais partiel des membres du FOMC, l’équilibre entre les « colombes », plus enclines à soutenir l’activité, et les « faucons » qui accordent plus d’importance à l’inflation évolue lentement. Dans les faits, Kevin Warsh cherchera à obtenir un large consensus entre ces positions.

Paradoxalement, c’est sans doute Donald Trump qui a en main les clés d’un éventuel assouplissement monétaire. En mettant un terme au conflit au Moyen-Orient et en renonçant à sa guerre commerciale, il pourrait agir assez rapidement sur l’inflation, ce qui donnerait alors à la Réserve fédérale les marges de manœuvre nécessaires pour qu’elle baisse le taux directeur.

Christophe Blot ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

27.05.2026 à 16:25

« Magnifica Humanitas » : le manifeste politique de Léon XIV

Texte intégral (2002 mots)

Sous-titrée « Sur la protection de la personne humaine à l’ère de l’intelligence artificielle », l’encyclique (lettre solennelle du pape adressée à l’ensemble de l’Église catholique) « Magnifica Humanitas », premier texte de ce type publié par Léon XIV depuis qu’il a accédé au fauteuil de saint Pierre, est un document fondateur. Non seulement pour ses réflexions sur l’IA, mais aussi pour ses prises de position sur diverses questions politiques et sociales actuelles de première importance.

L’encyclique « Magnifica Humanitas » (« Magnifique humanité »), publiée le 25 avril 2026 par le pape Léon XIV, revêt une importance particulière. Sous le pontificat précédent, celui de François, « Laudato Si’ » (2015) avait constitué un jalon en matière de prise de conscience par l’Église du changement climatique et des problématiques écologiques, tandis que « Fratelli Tutti » (2020) apparaissait comme un plaidoyer pour la fraternité au-delà des appartenances religieuses – un message loin d’être anodin dans un contexte marqué par des débats politiques intenses autour de la question des migrations.

Ces deux textes s’inscrivaient dans le cadre d’un magistère global et prolongeaient la doctrine sociale de l’Église catholique, qui entend ne pas séparer la sphère spirituelle de la sphère temporelle en investissant le terrain de l’action politique et sociale.

« Magnifica Humanitas » s’impose d’ores et déjà comme une étape majeure. Publiée quelques semaines après la passe d’armes ayant opposé Donald Trump et son vice-président J. D. Vance au pape Léon XIV, elle apparaît, à bien des égards, comme une critique fondamentale des versions les plus modernes de la puissance – et donc de l’évolution actuelle du pouvoir aux États-Unis.

Un texte en écho à une encyclique fameuse de Léon XIII

Le texte s’ouvre sur le rappel de « Rerum Novarum », l’encyclique publiée en 1891 par Léon XIII (pape de 1878 à sa mort en 1903, en hommage duquel Mgr Prevost a choisi le nom de Léon XIV quand il a été élu pape à son tour en mai 2025).

« Rerum Novarum » avait été un moment fondateur de la doctrine sociale de l’Église ; « Magnifica Humanitas » entend donc se placer au même niveau que ce texte de la fin du XIXᵉ siècle qui, face aux déchirures sociales causées par la condition ouvrière de l’époque – époque déjà marquée par les interrogations relatives à l’impact des évolutions techniques sur la société –, positionnait l’Église comme actrice sociale et politique.

Dans « Magnifica Humanitas », la mise en avant des principes du « bien commun » et de la « destination universelle des biens » constitue un rappel à l’ordre visant à condamner les tendances à la concentration industrielle en matière de technologies digitales et d’algorithmes, une situation qui produit de nouvelles formes d’exclusion.

Mais ce n’est pas la seule référence : Léon XIV prend également en exemple l’action du pape Pie XII (1939-1958) pour rappeler qu’il est indispensable de défendre les syndicats et les corps intermédiaires, fonctions nécessaires à l’équilibre sociétal.

Par ailleurs, à de nombreux endroits, le texte défend l’État de droit et la démocratie, et souligne que l’économie de marché ne doit pas se déployer au détriment de la solidarité.

De même, les différentes mentions de la question migratoire, guidées par les concepts de justice sociale et de fraternité, apparaissent comme une prise de position nette contre les tendances de rejet et de traitement policier à l’œuvre dans les contextes européen et états-unien.

La nécessaire régulation de l’IA

Dès l’introduction, le sujet de l’intelligence artificielle est abordé de front. L’encyclique pose le constat de la dangerosité d’un paradigme techno-démocratique dans lequel des technologies jugées plus efficaces exercent de facto un contrôle déterministe sur les choix personnels et sociaux. « Magnifica Humanitas » approfondit l’analyse critique d’une intelligence artificielle définie comme moralement non neutre.

Pour faire face à ces risques avérés, l’encyclique défend les instruments juridiques et, partant, l’État de droit, appelant à une régulation renforcée. Elle prône également de « désarmer l’IA », c’est-à-dire d’empêcher que celle-ci ne contrôle l’humain, un concept qui pourrait même se prolonger par des formes d’interdiction, comme le suggèrent les mises en garde sur la dangerosité des technologies numériques pour la formation psychologique des enfants.

The movie tag contains https://politiqueinternationale.com/revue/revue-n-191/article/donald-contre-leon-qui-lemportera, which is an unsupported URL, in the src attribute. Please try again with youtube or vimeo.

Cet ensemble de considérations sur l’IA reprend et systématise les réflexions apparues depuis quelques années au Vatican. Par exemple, l’Académie pontificale pour la vie avait organisé, en février 2020, le lancement de la plateforme Rome Call for AI Ethics, un appel à promouvoir une intelligence artificielle respectueuse de la dignité humaine signé par IBM, Microsoft, l’Organisation des Nations unies pour l’alimentation et l’agriculture (FAO) et le gouvernement italien.

Ces réflexions ont depuis progressé, tant au sein des différentes instances vaticanes que des institutions italiennes, dans une forme de symbiose romaine où a émergé le concept d’« algor-éthique », proposé par l’universitaire franciscain Paolo Benanti. Benanti promeut une régulation éthique des algorithmes, sans exclure que, au-delà de certains niveaux de dangerosité, on puisse interdire ou limiter leur usage, comme dans le cas des systèmes militaires.

Cette contamination culturelle entre le Saint-Siège et l’État italien se reflète également dans la convergence des positions de « Magnifica Humanitas » avec l’approche européenne en matière de régulation numérique.

Une Église résolument impliquée dans les affaires du monde

Fait significatif : la demande de pardon formulée dans l’encyclique pour la condamnation tardive de l’esclavage par l’Église catholique (en 1888) sonne comme un manifeste politique. Par cette repentance, Léon XIV renforce l’image d’une Église ouverte et capable d’autocritique et donne l’exemple aux États ou auxforces politiques qui se cloisonnent dans des récits historiques nationaux en occultant les erreurs passées.

Cette reconnaissance de culpabilité permet de renforcer la légitimité de la dénonciation des nouvelles formes de colonisation ou d’esclavage présentes dans les chaînes de production technologique (notamment l’extraction de terres rares, indispensables à la fabrication des appareils) et de l’utilisation de l’IA par des réseaux criminels, notamment pour la traite des êtres humains.

Le passage de l’encyclique qui s’oppose au réalisme, conçu comme une pensée « naturelle » des relations internationales, mérite d’être mis en exergue. Si, d’un côté, le pape réfute le concept de « guerre juste » récemment évoqué par l’administration Trump à propos de son action en Iran, il s’inscrit également dans un débat intellectuel qui a longtemps structuré les relations internationales, pour dénoncer fermement l’approche de la realpolitik, qui privilégie une lecture fondée sur les rapports de force et conçoit la guerre comme inévitable. Il faut peut-être ici se souvenir que ce concept était apparu dans le débat allemand du XIXᵉ siècle, un moment historique marqué par l’opposition entre le chancelier Otto von Bismark et l’Église catholique.

Le pape introduit une évaluation éthique et morale pour rejeter cette vision de l’inéluctabilité d’une guerre permanente, qu’il qualifie de « Mal ». Mais il le fait aussi en appelant les intellectuels et les responsables à ne pas se contenter de cette lecture simpliste et univoque, pour produire une appréhension du monde plus nuancée, sans pour autant basculer dans un idéalisme béat. Le concept de « sain réalisme » adopté par le pape invite à la recherche d’une voie de progrès qui, tout en acceptant le constat réaliste, privilégie la conciliation pacifique comme scénario d’amélioration.

Léon face à Donald

Cette encyclique apparaît donc comme un texte charnière, par lequel le magistère de l’Église catholique entend se projeter dans une série de stratégies concrètes. La défense globale de la doctrine sociale de l’Église se présente comme le socle à partir duquel sont formulées des critiques qui appellent immédiatement une confrontation avec le modèle de puissance technologique, capitaliste et militaire dont les États-Unis de la présidence Trump apparaissent comme un archétype.

La présence aux côtés du pape d’un des fondateurs d’Anthropic Christopher Olah, lors de la conférence de presse de présentation de l’encyclique, illustre la volonté de mobiliser différentes communautés dans le cadre d’une stratégie globale qui se positionne également à l’échelon des États-Unis, en cherchant à peser sur le débat interne. Ce texte dessine par ailleurs les contours d’une défense de la social-démocratie, matérialisant ainsi une volonté de peser sur un débat européen marqué par la progression des formations souverainistes.

Le pape Léon XIV, d’origine américaine, prend ainsi pied dans le débat politique mondial en définissant les coordonnées d’une action politique réformatrice – un dessein qui n’est pas sans rappeler celui de Jean-Paul II dans le contexte de la fin de la guerre froide.

Jean-Pierre Darnis ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

27.05.2026 à 16:24

Pourquoi le pouvoir du peuple n'est pas illimité dans les démocraties libérales

Texte intégral (2316 mots)

Dans les démocraties libérales, le peuple est tenu pour souverain, mais son pouvoir est aussi limité par l’État de droit. Or ce dilemme fondamental n’est jamais résolu. Les démocraties illibérales prétendent résoudre cette contradiction, en donnant la primauté à la logique majoritaire au détriment de l’État de droit.

La démocratie libérale est un modèle singulier en ce qu’il repose sur une tension constitutive qui traverse l’ensemble de son édifice juridique et politique. Elle articule deux exigences a priori incompatibles. Il y a, d’une part, une exigence démocratique : affirmer la souveraineté du peuple. Il y a, de l’autre, une exigence libérale : limiter l’exercice du pouvoir afin de garantir le respect de droits fondamentaux. Cette tension n’est ni accidentelle ni transitoire. Elle constitue l’un des fondements mêmes du modèle tel qu’il s’est historiquement construit.

En démocratie, l’exercice de la souveraineté est classiquement associé au moment où un peuple se donne une Constitution. Le peuple est conçu comme l’auteur originaire de ce texte fondamental, placé en haut de la pyramide des normes. Une fois la Constitution entrée en vigueur, l’exercice du pouvoir est transféré aux organes qu’elle met en place, lesquels, n’étant pas souverains, seront soumis au respect du droit.

Cette construction permet de préserver l’État de droit, mais elle entre en contradiction avec l’affirmation persistante de la souveraineté du peuple dans les textes constitutionnels contemporains. En effet, nombre de Constitutions contemporaines établissent un lien explicite entre le peuple et la souveraineté. Certaines visent directement le peuple comme titulaire de la souveraineté, comme en Italie (art. 1), au Portugal (art. 3), en Lettonie (art. 2), en Andorre (art. 1) ou en Biélorussie (art. 3). D’autres l’attachent non au peuple, mais aux citoyens, comme en Serbie (art. 2) ou en Macédoine du Nord (art. 2). Certaines constitutions font de la souveraineté populaire le fondement du régime comme en Grèce (art. 1). D’autres encore énoncent que la souveraineté nationale appartient au peuple, comme en France (art. 3), en Espagne (art. 1), en Roumanie (art. 2), en Moldavie (art. 2), en Algérie (art. 7), au Cameroun (art. 2) ou au Sénégal (art. 3).

À travers ces différentes formulations, un lien explicite est établi entre le peuple et la souveraineté. Une telle rédaction au présent de l’indicatif semble indiquer une forme de permanence de la souveraineté populaire après l’entrée en vigueur de la Constitution. C’est cette idée que résume la formule bien connue de l’article 28 de la Déclaration des droits de l’homme de 1793, selon laquelle « un peuple a toujours le droit de revoir, de réformer et de changer sa Constitution. Une génération ne peut assujettir à ses lois les générations futures ». Mais une telle conception fragilise en retour les fondements mêmes de l’État de droit, qui suppose la primauté du droit sur les décisions du pouvoir politique.

Il en résulte une aporie. Si le peuple demeure souverain après l’entrée en vigueur de la Constitution, aucune norme ne saurait juridiquement le contraindre. À l’inverse, si le peuple est soumis aux limites constitutionnelles, la souveraineté qui lui est attribuée perd son caractère absolu. Il faut donc partir du constat d’une coexistence paradoxale entre souveraineté populaire et État de droit, le peuple étant tenu pour souverain à certains égards, tout en se trouvant limité à d’autres. Ce dilemme ne peut être résolu sans sacrifier l’une des deux logiques. Pourtant, la démocratie libérale fonctionne durablement sans jamais opérer ce choix.

L’indétermination : clé de lecture des fondements de la démocratie libérale

Pour appréhender et expliquer cette apparente contradiction, il est possible de mobiliser le concept d’« indétermination ». On peut le comprendre par analogie avec l’expérience de pensée formulée par Erwin Schrödinger en 1935, qui montre comment un même objet peut se trouver simultanément dans deux états incompatibles tant qu’aucune observation ne vient trancher. Le physicien imaginait un chat placé dans une boîte. Au sein de celle-ci, on trouverait aussi une fiole de poison, susceptible de se briser à tout instant. Tant que personne n’ouvre la boîte, on ne sait pas si le chat est vivant ou mort.

Transposée au droit constitutionnel, cette métaphore permet d’éclairer le statut du peuple dans la démocratie libérale. Tant que personne n’ouvre la boîte, on ne sait pas si le peuple est souverain ou soumis à des limites : il reste potentiellement souverain et potentiellement limité. L’indétermination n’est alors pas levée et le système peut fonctionner sans contradiction manifeste.

C’est le fonctionnement institutionnel des démocraties libérales qui évite d’avoir à ouvrir la « boîte ». Deux figures y sont centrales : les représentants élus et les juges constitutionnels. Les premiers exercent le pouvoir au nom du peuple, ce qui répond à l’exigence démocratique, sans que la question de l’exercice de la souveraineté soit posée. Les seconds veillent à ce que cet exercice demeure conforme aux exigences de l’État de droit et à la protection des droits fondamentaux.

Le fonctionnement ordinaire de la démocratie libérale repose sur cet équilibre et permet de différer le moment où l’indétermination à propos du peuple est levée.