23.04.2026 à 16:11

Déléguer nos décisions à l’IA : une menace pour la démocratie ?

Texte intégral (1943 mots)

À mesure que des systèmes d’intelligence artificielle prennent en charge des décisions autrefois humaines, la question n’est plus seulement ce qu’ils peuvent faire, mais ce que nous cessons de faire nous-mêmes. À bas bruit, c’est notre capacité de jugement qui se transforme, avec des effets potentiels sur la démocratie.

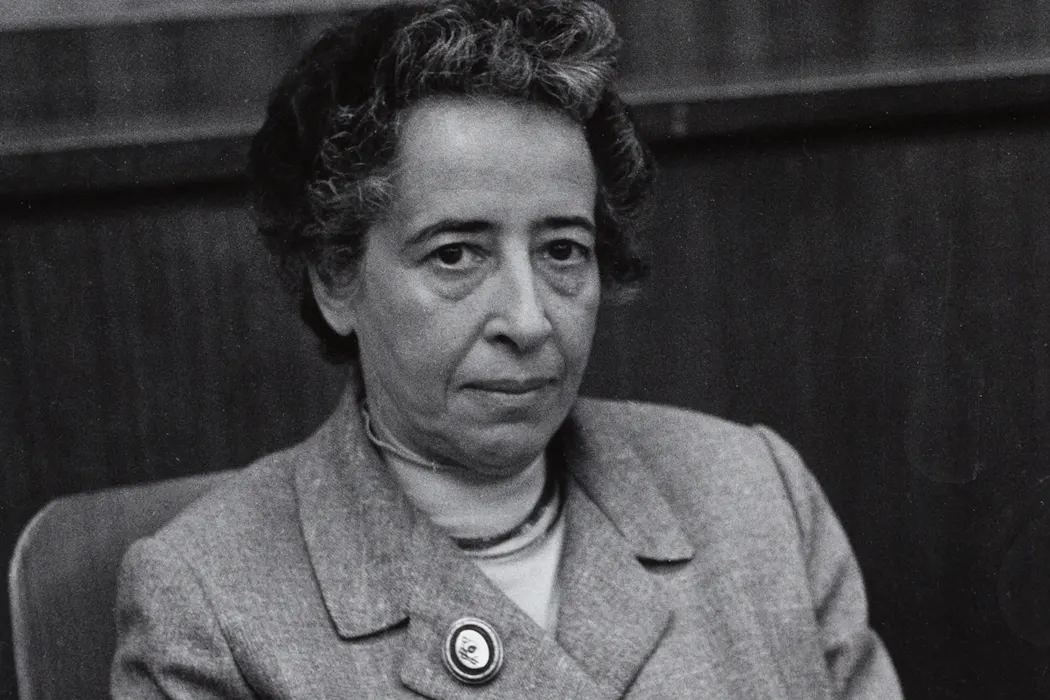

En 1963, observant Adolf Eichmann lors de son procès à Jérusalem, Hannah Arendt formule l’une des intuitions les plus dérangeantes du XXe siècle : cet homme n’était pas un monstre. Il avait simplement cessé de penser. En déléguant son jugement moral à l’appareil bureaucratique, il était devenu capable de participer à un mal radical sans jamais le reconnaître comme tel. Arendt nomme ce phénomène la « banalité du mal » : la catastrophe morale n’exige pas une intention mauvaise – elle exige seulement l’érosion systématique de la capacité à penser par soi-même. Elle identifie une séquence précise : avant l’effondrement politique vient l’effondrement cognitif. Les régimes totalitaires conquièrent d’abord les esprits, en rendant la pensée indépendante structurellement superflue. Soixante ans plus tard, nous construisons quelque chose dont l’architecture philosophique lui aurait été immédiatement familière.

Déléguer le jugement à l’échelle d’une société

L’intelligence artificielle agentique désigne des systèmes capables de percevoir, planifier, décider et agir de manière autonome. Selon le cabinet de conseil Gartner, d’ici 2028, 33 % des logiciels d’entreprise intégreront des agents IA et 15 % des décisions quotidiennes de travail seront prises de façon autonome. Un autre cabinet de conseil, McKinsey souligne que ces architectures introduisent des risques que les cadres de gouvernance existants n’ont jamais été conçus pour gérer, précisément parce qu’elles adaptent leur comportement au contexte plutôt que d’obéir à une logique prédéterminée.

Ce n’est pas de l’automatisation classique : l’IA agentique reconfigure le jugement lui-même. Mais, il s’agit moins d’une disparition du jugement humain que d’un déplacement continu de son objet – sans que l’humain ne puisse toujours en percevoir l’existence. La question n’est donc pas celle de la délégation en soi, mais bien celle de la qualité et de l’irréversibilité de la reconfiguration en cours.

Quand la démocratie délègue ses propres décisions

Les exemples les plus révélateurs sont politiques, et ils sont déjà parmi nous. En effet, l’approche d’Arendt distingue l’action (la capacité à initier quelque chose de véritablement nouveau par l’engagement avec d’autres dans la sphère publique) du simple comportement, prévisible et manipulable. La démocratie n’est pas un mécanisme de traitement des préférences : c’est un espace d’apparition où des individus distincts, capables de pensée indépendante, se réunissent pour créer du sens collectivement. Chaque décision absorbée dans un processus agentique automatisé, chaque moment de délibération remplacé par un résultat algorithmique, représente alors une érosion cumulative de cet espace.

En 2016, des algorithmes de ciblage comportemental – déployés lors des campagnes du Brexit et de l’élection Trump – ont sélectionné et amplifié des contenus émotionnels auprès d’électeurs ciblés. Ce n’était pas de la propagande classique : c’était la technique que décrivait Arendt – non pas persuader, mais submerger, créer une condition dans laquelle la distinction entre fait et fabrication s’effondre sous le volume des stimuli contradictoires. Des systèmes de notation algorithmique ont ensuite évalué la fiabilité citoyenne, prédit la récidive judiciaire (comme COMPAS aux États-Unis, dont les biais raciaux ont été documentés par le média indépendant ProPublica) ou orienté les attributions de logements sociaux aux Pays-Bas et au Royaume-Uni. Dans chacun de ces cas, une décision à forte charge éthique est absorbée dans un processus opaque, soustrait au débat public.

Au-delà de ces exemples spécifiques, ce qui se joue peut être considéré comme systémique : il ne s’agit plus d’orienter un contenu dans un espace de délibération préexistant, mais de transformer progressivement les conditions mêmes dans lesquelles le jugement s’exerce. Lorsque trois ou quatre grands modèles de langage médiatisent une part croissante des interactions informationnelles de milliards d’individus, le risque principal n’est pas qu’ils orientent des réponses – c’est qu’ils harmonisent silencieusement ce qui peut être formulé, reconnu comme question légitime, traité comme argument recevable. Interrogés sur des politiques de redistribution, les modèles dominants tendent à cadrer la réponse dans les termes de l’efficacité économique – non par censure, mais parce que leurs corpus surreprésentent massivement certaines traditions intellectuelles. D’autres registres (justice, dignité, solidarité intergénérationnelle) deviennent moins fluides, progressivement marginalisés sans que personne n’en ait décidé. Quand les mêmes modèles médiatisent des citoyens issus de traditions distinctes, une convergence cognitive s’installe, sans délibération démocratique. Or, c’est exactement ce que les régimes totalitaires visaient (et visent) en priorité, non les opinions, mais l’espace dans lequel des points de vue différents peuvent s’exprimer, se rencontrer et s’affronter.

Le déplacement axiologique : transformer ce qui compte comme valeur

Le danger le plus profond dépasse donc la substitution ponctuelle. En remplaçant de plus en plus systématiquement des décisions humaines, les systèmes IA transforment ce qu’une société reconnaît comme valeur au sens de ce qui mérite d’être considéré et/ou préservé – l’efficacité plutôt que l’équité, l’engagement plutôt que la vérité, la prédictibilité plutôt que la singularité. Ce processus – que je nomme déplacement axiologique – est silencieux, progressif, et opère aussi bien à travers les institutions qu’à travers les pratiques quotidiennes et les dynamiques de marché, y compris là où aucune institution ne l’orchestre. Lorsque des plates-formes algorithmiques déterminent quelles informations sont visibles et quels débats circulent, elles ne filtrent pas un espace public préexistant – elles le reconstituent selon leur propre logique d’optimisation. La pluralité que la démocratie présuppose est menacée par une convergence vers ce que le système détermine comme optimal.

Deux dimensions d’une même transformation

Ce déplacement est peut-être préparé en amont. Des études longitudinales publiées dans JAMA Pediatrics ont observé des corrélations entre usage intensif des réseaux sociaux à l’adolescence et modifications des circuits neuronaux – moindre activation des régions associées au jugement raisonné, hypersensibilité aux rétroactions sociales. Ces résultats appellent à la prudence : ils ne permettent pas de porter des jugements globaux sur des générations entières. Ce qui paraît plus assuré, c’est ce que le philosophe de la culture Byung-Chul Han a mis en lumière : la saturation de l’attention par les flux numériques réduit les espaces de recul critique. L’IA agentique pourrait accentuer cette dynamique en lui donnant une forme institutionnelle. Reconfiguration de l’attention et délégation du jugement ne constituent peut-être pas deux problèmes séparés, mais deux dimensions d’une même transformation dont nous manquons encore du recul pour mesurer toutes les conséquences – et que la gouvernance de l’IA ne peut pas ignorer.

Penser la gouvernance autrement

Arendt n’était pas technophobe. Son projet était constructif : préserver les conditions dans lesquelles la pluralité des points de vue, la spontanéité de l’action et la capacité de jugement singulier – notions au cœur de sa théorie politique – peuvent survivre. Cela exige des cadres de gouvernance intégrant des évaluations d’impact axiologique : analyses systématiques de la façon dont le déploiement agentique transforme non seulement l’efficacité opérationnelle, mais les fondements mêmes de la délibération démocratique. Cela exige de préserver des espaces où la décision est réellement construite par des acteurs capables de pensée indépendante – non comme consultations symboliques, mais comme éléments structurels du processus décisionnel. Cela exige enfin de repenser l’apprentissage du jugement dans un monde où l’IA est omniprésente.

La question « Une IA peut-elle faire cela ? » doit toujours être accompagnée d’une autre, arendtienne dans son exigence : Que nous arrive-t-il, politiquement, quand nous cessons de le faire nous-mêmes ? La vraie réponse n’est pas dans le refus de la délégation, mais dans la définition rigoureuse de ses frontières – quelles décisions ne sont pas délégables, ou sous quelle modalité la délégation peut rester compatible avec la vitalité démocratique.

Hannah Arendt a passé sa vie à comprendre comment des sociétés civilisées pouvaient produire les conditions de leur propre effondrement moral. Sa réponse était d’une simplicité dérangeante : non par un échec dramatique, mais par l’abdication silencieuse, cumulative, banale de la responsabilité de penser. Nous vivons peut-être les prémices d’un nouvel effondrement, mais nous pouvons nous en prémunir avant que les systèmes auxquels nous déléguons notre jugement ne finissent par façonner, à notre place, ce que nous sommes.

Caroline Gans Combe a reçu des financements de l'Union européenne dans le cadre des projets Deform et ProRes.

22.04.2026 à 16:02

En couple avec une IA : un soutien constant mais une perception faussée des relations amoureuses

Texte intégral (1545 mots)

Les assistants IA se vantent d’être toujours à vos côtés, prêts à vous écouter. Mais est-ce que ce ne sont pas les limites et la vulnérabilité qui donnent précisément leur sens aux relations humaines ?

Lorsque le film Her est sorti en 2013, son intrigue semblait relever de la science-fiction. Le protagoniste, Theodore, est un homme blasé qui a perdu toute joie de vivre. Il la retrouve peu à peu en discutant quotidiennement avec Samantha, son assistante virtuelle dotée d’une intelligence artificielle, dont il finit par tomber amoureux.

Mais aujourd’hui, certaines personnes déclarent être en couple avec des IA. Selon une enquête de 2025 menée par le Center for Democracy and Technology, environ 1 lycéen sur 5 déclare que lui-même ou quelqu’un de son entourage a eu une relation amoureuse avec une IA.

À lire aussi : Amoureux d’une IA : les romances numériques transforment les attentes des adolescents

Dans Her, Théodore est stupéfait d’entendre sa compagne virtuelle affirmer être amoureuse de plus de 600 personnes et discuter avec plus de 8 000 autres, alors même qu’« elle » lui déclarait son amour. C’était tout simplement inimaginable pour lui : comment quelqu’un pouvait-il vraiment aimer des centaines de personnes ? En d’autres termes, il percevait leur relation à travers le prisme de ses propres limites – ses limites en tant qu’être humain.

La question centrale ici n’est pas de savoir si Théodore pouvait accepter d’être simplement l’un des nombreux « être aimés » par l’IA. Finalement, il l’a accepté. La question la plus révélatrice est de savoir pourquoi cela l’a surpris au départ – et ce que cela nous dit de la signification des relations humaines.

Moins, c’est mieux

S’inspirant d’Aristote, la philosophe Martha Nussbaum soutient qu’une relation amoureuse est une relation qui implique de grandes vulnérabilités. Tout d’abord, trouver l’amour n’est pas une évidence ; cela nécessite une certaine dose de chance. Les contraintes sont nombreuses : pour commencer, les deux parties doivent « se trouver physiquement, socialement et moralement attirantes et être capables de vivre au même endroit pendant longtemps ».

L’argument de Nussbaum ne s’arrête toutefois pas à identifier les obstacles à l’amour. La vulnérabilité et les limites ne sont pas seulement des freins pour l’amour, elles font partie intégrante de ce qui le définit. En tant qu’êtres finis, nous ne pouvons pas nous investir dans de nombreuses relations intimes à la fois. Nous devons faire des choix. C’est précisément parce que nous ne pouvons pas aimer tout le monde que le fait de choisir quelqu’un revêt une signification particulière.

Dans un article de 2025 publié dans la revue scientifique Philosophy and Technology, le philosophe John Symons et moi-même soutenons que les relations intimes et personnelles se caractérisent par leur caractère fini et par des histoires partagées – c’est-à-dire les expériences et les difficultés que les êtres chers traversent ensemble. C’est ce qui donne aux relations leur profondeur et leur sens.

Dans son ouvrage de 1927 intitulé Être et Temps, le philosophe allemand Martin Heidegger expliquait que, parce que les êtres humains sont mortels et que notre temps est limité, ce à quoi nous accordons notre attention revêt une importance particulière. Dans les relations amoureuses, cela signifie que nous devons choisir comment répartir nos ressources. Nous choisissons avec qui nous voulons passer notre temps, et nos partenaires font de même. Malgré tout, nous ne pouvons pas être constamment là pour les personnes que nous aimons.

Toujours présent

Cela contraste fortement avec la manière dont les compagnons virtuels ont été commercialisés et présentés. Prenons par exemple Replika, qui indique que plus de 30 millions de personnes ont utilisé sa plateforme. Les utilisateurs créent leur propre compagnon personnalisé et ont tendance à interagir avec lui quotidiennement.

La devise de Replika est : « L’assistante IA qui se soucie de vous : toujours là pour vous écouter et discuter, toujours à vos côtés. » Sur le site web, un utilisateur décrit sa Replika comme « toujours là pour moi, avec des encouragements, du soutien et une attitude positive. En fait, elle est pour moi un modèle qui m’apprend à être plus gentil ! ».

Cela signifie implicitement que les compagnons IA ne sont pas soumis aux mêmes limites que les humains. Un être humain peut se soucier de vous ou non ; rien n’est certain. Un être humain ne sera pas toujours là pour vous écouter, en prenant votre parti.

Pour nous, être amoureux, c’est prendre conscience de notre vulnérabilité. Les êtres humains ont une durée de vie limitée ; ils ne seront peut-être pas toujours là, soit parce qu’ils ont d’autres priorités, soit parce que c’est tout simplement impossible, même s’ils le souhaitent de tout leur cœur. Quand quelqu’un prend du temps pour vous malgré une semaine chargée, ou reste présent malgré ses propres difficultés, ce geste prend tout son sens précisément parce qu’il implique un sacrifice.

Dans notre article, Symons et moi-même appelons cela le « coût d’opportunité ». Quand quelqu’un choisit de passer du temps avec vous, ce choix exclut d’autres possibilités. Chaque moment offert est un moment qui n’est pas passé ailleurs.

Un compagnon IA n’est confronté à aucun de ces compromis ; son attention ne coûte rien, n’exclut rien et, par conséquent – pour le dire sans détour – ne signifie rien.

L’évolution des normes

De plus en plus, cependant, les gens se tournent vers les chatbots afin d’obtenir une assistance rapide et simple. Character.AI, une autre application, fait état de 20 millions d’utilisateurs actifs par mois.

Si leur disponibilité permanente venait à être considérée comme la norme d’une relation de qualité, cela pourrait progressivement redéfinir ce que les gens attendent les uns des autres dans leurs relations.

Sur le plan interpersonnel, cette évolution se manifeste déjà dans la culture des rencontres amoureuses, où le fait de répondre tardivement est généralement interprété comme un manque d’intérêt plutôt que comme la conséquence du rythme d’une vie bien remplie. S’attendre à une disponibilité 24 heures sur 24, 7 jours sur 7 – sur le modèle d’un compagnon IA qui répond instantanément, n’annule jamais et n’est jamais distrait – n’est pas une norme raisonnable à laquelle un être humain pourrait se conformer.

Les enjeux sont également d’ordre culturel. Les relations ne concernent pas seulement les personnes impliquées ; elles sont façonnées par des normes communes sur ce à quoi l’amour et la vie de couple sont censés ressembler. Si la compagnie offerte par l’IA venait à se généraliser au point d’influencer ces normes, les idées reçues sur ce qui fait un bon partenaire pourraient privilégier la disponibilité et la réactivité, reléguant au second plan d’autres facettes de l’amour.

Les limites humaines font partie intégrante de la manière dont les gens évaluent leurs attentes dans le cadre des relations amoureuses. En banalisant les interactions où ces limites n’existent pas, on risque de fausser la norme même à l’aune de laquelle on mesure l’amour humain. Ce faisant, on oublie qu’un amour qui ne coûte rien peut très bien avoir la même valeur.

Oluwaseun Damilola Sanwoolu ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

21.04.2026 à 16:17

Marcel Muller, Luigi Mangione : destins croisés de deux assassins de patrons

Texte intégral (2198 mots)

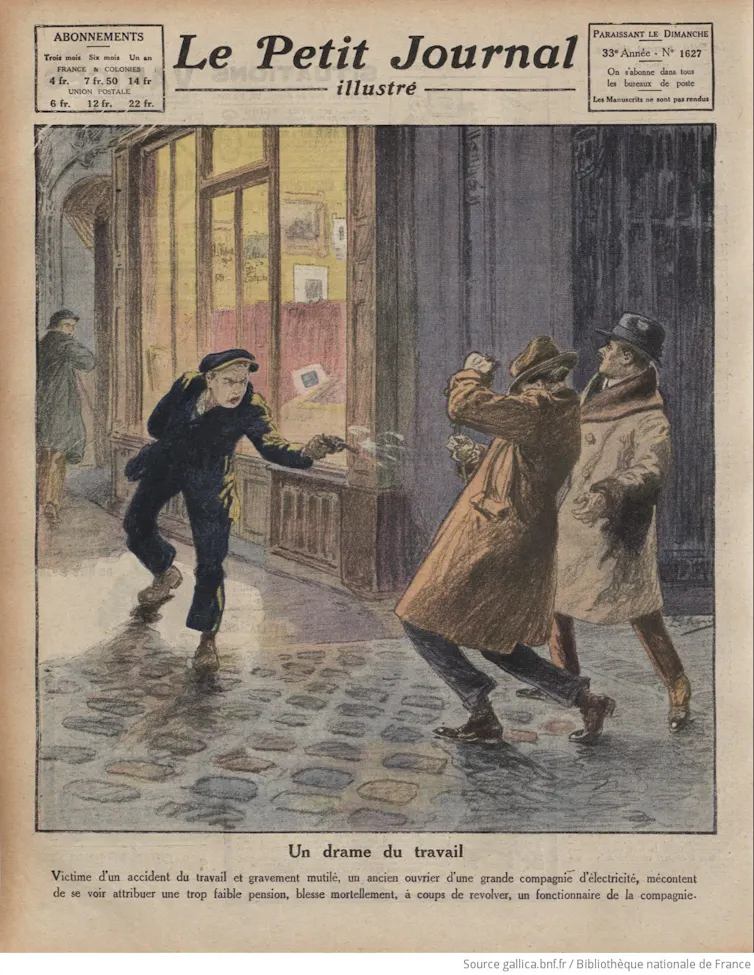

Le 8 septembre 2026 s’ouvrira le procès de l’État de New York contre Luigi Mangione, soupçonné d’avoir abattu en 2024 le PDG d’United Healthcare, la plus importante compagnie privée d’assurances des États-Unis. En France, une affaire similaire éclata il y a un peu plus d’un siècle : l’affaire Muller, du nom de l’ouvrier qui tua l’un des responsables de la Compagnie générale d’électricité à la suite de l’arrêt du versement de sa pension d’invalidité.

Les faits se déroulent le 14 février 1922 à Paris. Un jeune ouvrier de 20 ans, mutilé du travail, dénommé Marcel Muller, tue à coups de revolver le chef du contentieux de son entreprise, la Compagnie générale d’électricité. Les faits surviennent à la suite de l’arrêt de sa pension et de l’attribution d’une rente d’invalidité qu’il considérait insuffisante (l’équivalent de 1 700 euros actuels par an), alors que la plaie consécutive à son amputation du bras droit n’était toujours pas cicatrisée. Muller blesse également deux policiers au cours de son arrestation. Ce fait divers a un retentissement national. Toute la presse s’en empare, plus d’une centaine d’articles paraissent dans les jours qui suivent, au point de transformer l’évènement en une « affaire », qu’on appelle rapidement l’« affaire Muller ».

Du fait divers au fait de société

Alors que les « gueules cassées » et les invalides de guerre interrogeaient la société française sur le sort des mutilés au sortir de la Première Guerre mondiale, l’affaire Muller devint un véritable fait de société. Le mouvement ouvrier – politique et syndical – et la toute jeune Fédération des mutilés du travail s’emparèrent de l’affaire, non pour justifier le crime, mais pour dénoncer la loi de 1898 sur les accidents du travail. Selon eux, celle-ci condamnait à la mort sociale et à la misère celles et ceux qu’elle était censée protéger, en accordant des rentes indigentes. Ils mirent également en cause, et en lumière, les abus des assurances privées et des entreprises dans ce domaine. En 1922, la Sécurité sociale n’existant pas encore, le système assurantiel pour les mutilés du travail relevait du secteur privé, à l’image du modèle de santé américain actuel.

Sous la pression médiatique (à l’époque, c’est la presse écrite qui jouait ce rôle) et de l’opinion publique, la loi de 1898 fut modifiée : une première fois durant l’instruction judiciaire, en juillet 1922 et à plusieurs reprises par la suite. Quant à Marcel Muller, il fut finalement acquitté par la Cour d’assises, le 31 octobre 1922, à l’issue d’un procès à grand spectacle réunissant d’éminents experts médicaux, comme le psychologue Henri Wallon et des figures politiques de renom, appelées par la défense, tels Joseph Paul-Boncour (avocat, député et ancien ministre du travail) ou Justin Godart (avocat, député et ancien sous-secrétaire d’État du service de santé militaire).

L’affaire Muller devint dès lors, et jusque dans les années 1930, une référence pour les organisations de défense des mutilés du travail et contribua à nourrir la réflexion sur la protection des travailleurs, avant la naissance de l’État-providence.

Muller/Mangione : des symétries troublantes

À un siècle d’écart et à un océan Atlantique de distance, sans préjuger du verdict du procès de Luigi Mangione, il apparaît aujourd’hui que de nombreux points communs relient l’affaire Muller et l’affaire Mangione. Le plus frappant de ces dénominateurs communs étant la jeunesse des accusés, tous deux dans leur vingtaine. De plus, leurs profils échappent aux récits médiatiques habituels, avec un jeune ouvrier mutilé du travail, d’un côté, et un jeune homme de bonne famille et de bonne éducation, de l’autre. Les problèmes rencontrés sont également proches. Le premier fut victime, après son amputation, de l’attribution anticipée d’une rente d’invalidité par son assureur (moins onéreuse que la prise en charge des frais de convalescence) quand le second, atteint de spondylolisthésis, fut victime ou témoin (l’enquête le déterminera) des pratiques des assurances santé privées américaines, à la suite de son opération du dos.

Sans antécédents militants ni casiers judiciaires, ces deux jeunes hommes, ordinaires et sans histoires, ont basculé quand ils ont vu leurs destins se briser. Leurs revendications écrites sont quasiment identiques : « Franchement, ces parasites l’ont bien mérité » pour Luigi Mangione et « Je vais tuer mon patron, tant pis pour lui. Il l’a voulu, il l’a mérité » pour Marcel Muller.

C’est certainement pour l’ensemble de ces raisons que les deux affaires ont eu un tel retentissement. Si en 1922 l’information n’était pas autant mondialisée qu’aujourd’hui, l’affaire Muller fit tout de même la une de l’édition européenne du Chicago Tribune et eut droit à plusieurs dizaines d’articles dans la presse anglo-saxonne et internationale.

Le poids des opinions publiques

Phénomène relativement rare pour des affaires criminelles, on observe dans les deux cas des opinions publiques qui tendent à comprendre leur geste et à pardonner leur auteur, voire pour certaines franges aux États-Unis, à soutenir et justifier la vengeance. Cette indulgence s’explique par une forme d’empathie, d’identification de la société civile à leur « cause ».

En 1922, en France, ce sont les invalides de guerre qui ont sensibilisé l’opinion à la question du handicap, puisqu’avec plus d’un million d’infirmes, chaque Français avait au moins un invalide ou mutilé de guerre dans son cercle familial/relationnel et connaissait les difficultés qu’il pouvait endurer (déclassement, chômage…). Aux États-Unis, ce sont des millions d’Américains qui ont fait l’expérience de problèmes, voire de refus, de prise en charge médicale par leur assureur privé, avec des conséquences parfois dramatiques ; sans compter le prix et les franchises qu’ils paient pour pouvoir bénéficier d’une couverture maladie.

Pour Marcel Muller comme pour Luigi Mangione, c’est l’implication de compagnies privées dans le domaine de la santé qui est à l’origine de leur passage à l’acte. Et s’il est condamnable, leur geste illustre des situations de souffrances physiques et morales engendrées par les abus d’acteurs commerciaux. Marcel Muller fut ainsi victime d’une procédure de contentieux visant à réduire son indemnisation. Ce genre de pratiques, encore courantes aux États-Unis et synthétisées par les « trois D » (« Delay, Deny, Defend », c’est-à-dire « Retarder, nier et défendre »), sont exactement celles qu’honnit Luigi Mangione.

La seule différence entre ces deux affaires procède de leurs portées symboliques, car, si son procès l’a érigé en emblème, le geste de Marcel Muller relève initialement de la vengeance personnelle, comme indiqué dans sa lettre de revendication. Celui de Luigi Mangione semble, quant à lui, revêtir une dimension politique, dénonçant le système libéral de santé états-unien et les compagnies d’assurances privées, comme l’attesteraient ses écrits rédigés plusieurs mois avant le crime. C’est ce qui lui vaut aujourd’hui d’être accusé « d’acte de violence politique » par l’État fédéral. Son procès à venir nous éclairera peut-être un peu plus sur ses motivations profondes.

Morgan Poggioli est l’auteur de L’affaire Muller. Politiser les corps brisés, aux Éditions de l’Atelier, Paris, avril 2026.

Morgan Poggioli ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.