21.05.2026 à 17:03

Face aux entreprises privées qui se ruent vers les étoiles, une gouvernance internationale de l’espace devient indispensable

Texte intégral (2245 mots)

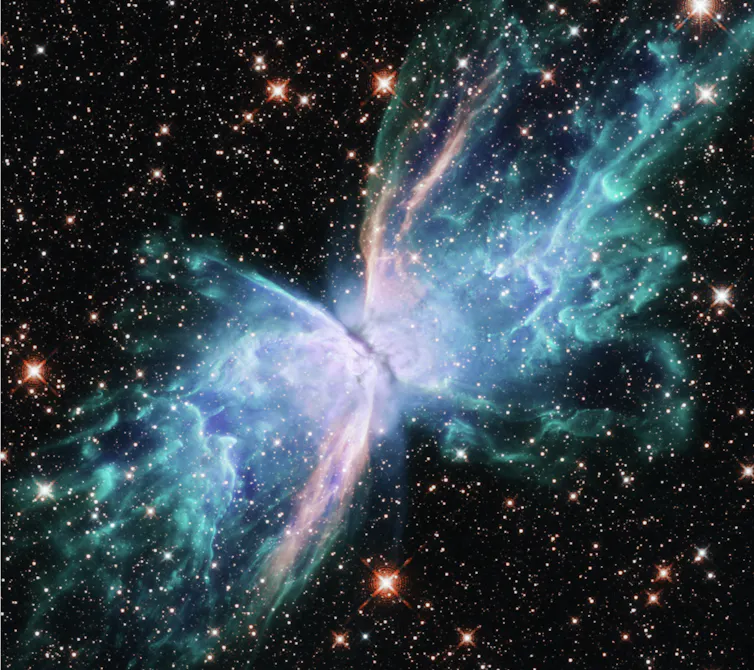

Il y a dix ans, l’orbite basse comptait 2 000 satellites actifs. Aujourd’hui, ils sont près de 20 000 et jusqu’à un million pourraient suivre. Une explosion du trafic spatial qui pousse les chercheurs à réclamer des règles internationales plus strictes.

Les académies des sciences des pays membres du G7 ont fait de la gouvernance internationale de l’espace un enjeu majeur en vue du sommet des dirigeants du G7, qui se tiendra du 15 au 17 juin à Évian, en France.

L’essor fulgurant des grandes constellations de satellites au cours de la dernière décennie ouvre la perspective d’un accès quasi universel à l’internet haut débit. Mais cette croissance s’accompagne de risques encore mal compris.

Parmi ces risques figurent la pollution du ciel nocturne, les perturbations de la recherche astronomique, l’augmentation du risque de collisions entre satellites ainsi que les dangers liés au retour sur Terre d’un grand nombre de satellites.

Notre compréhension de l’impact humain sur l’environnement spatial proche de la Terre en est aujourd’hui à un stade comparable à celui des connaissances sur le changement climatique dans les années 1990. Nous savons que l’intensification des activités humaines provoque d’importantes perturbations dans l’environnement spatial, mais nous ignorons encore si un point de bascule est sur le point d’être atteint.

Dans ce contexte, l’une des recommandations les plus importantes adressées aux États membres du G7 consiste à créer un groupe intergouvernemental sur la durabilité spatiale (IPSS).

Des impacts sur la chimie de l’atmosphère

La recherche et les connaissances sur les impacts des activités humaines dans l’espace en sont encore à un stade très précoce. Ainsi, nous ne savons pas vraiment à partir de quel moment certaines altitudes orbitales deviendront tellement encombrées de débris spatiaux qu’elles atteindront leur capacité opérationnelle maximale.

Les scientifiques ont également récemment constaté que l’augmentation du nombre de lancements de fusées à l’échelle mondiale — avec plus d’une fusée lancée chaque jour désormais — pourrait entraîner une remise en cause de la reconstitution de la couche d’ozone.

De la même manière, nous savons que les satellites qui se consument lors de leur rentrée dans l’atmosphère terrestre auront des effets importants sur la chimie de la haute atmosphère. Nous savons également que plusieurs de ces retours de satellites se produisent désormais chaque jour, mais les conséquences exactes de ce phénomène restent encore mal comprises.

Une gouvernance spatiale fragmentée

Plusieurs organismes scientifiques conseillent aujourd’hui les pouvoirs publics sur les différents enjeux liés à la durabilité de l’espace. Parmi eux figure le Comité de coordination interagences sur les débris spatiaux, chargé des questions liées à la pollution de l’environnement spatial par les débris.

Autre acteur important : le Centre pour la protection d’un ciel sombre et silencieux de l’Union astronomique internationale, qui coordonne les initiatives destinées à limiter l’impact des satellites sur l’astronomie optique et radio.

Mais il n’existe aujourd’hui aucun organisme unique capable de fournir aux gouvernements une expertise globale pour éclairer les décisions politiques et réglementaires. La situation rappelle celle de la recherche sur le changement climatique, lorsque le Groupe consultatif sur les gaz à effet de serre (AGGG), créé dans les années 1980, a progressivement laissé place au Groupe d’experts intergouvernemental sur l’évolution du climat (GIEC).

Nous avons aujourd’hui un besoin urgent d’un groupe intergouvernemental sur la durabilité spatiale (IPSS).

Il y a dix ans, l’orbite basse terrestre comptait près de 2 000 satellites actifs ; aujourd’hui, leur nombre approche les 20 000. Ces dernières années, des gouvernements et des entreprises ont annoncé des projets pouvant conduire au lancement de jusqu’à un million de satellites supplémentaires.

Définir des seuils mondiaux

Comment cet IPSS pourrait-il être structuré pour aborder la gouvernance spatiale d’une manière comparable à celle dont le GIEC a abordé le problème du changement climatique ?

L’un de ses premiers objectifs devrait être de définir des seuils mondiaux de durabilité. À l’image de la limite de 1,5 °C dans les sciences du climat, ce groupe devrait identifier les seuils au-delà desquels certaines altitudes orbitales atteignent leur capacité de charge.

Comme le GIEC, un IPSS devrait s’appuyer sur plusieurs groupes de travail chargés de fournir aux décideurs des synthèses scientifiques transparentes et accessibles. L’un d’eux devrait se consacrer aux sciences physiques de l’environnement orbital. Il s’agirait notamment d’étudier l’état de l’orbite basse terrestre en tant que ressource limitée : évolution des débris spatiaux et des risques de collision, effets de la météorologie spatiale, ou encore modélisation d’un trafic spatial soutenable à l’avenir.

Un autre groupe de travail devrait se concentrer sur les impacts environnementaux et sociétaux des grandes constellations de satellites. Il pourrait évaluer l’appauvrissement de la couche d’ozone stratosphérique causé par les émissions des lancements de fusées, les effets de l’augmentation des retours de satellites dans l’atmosphère, les modifications de la chimie atmosphérique ainsi que les risques accrus d’accidents pour les populations. Il aurait également pour mission de mesurer l’impact de ces constellations sur l’astronomie au sol.

Enfin, un groupe de travail consacré aux politiques publiques et aux mesures d’atténuation pourrait jeter les bases de normes internationales claires concernant la désorbitation des satellites en fin de mission, le retrait actif des débris spatiaux et de nouvelles exigences en matière de licences prenant en compte le risque « systémique » d’une constellation, plutôt que le risque posé par chaque satellite pris individuellement.

L’empreinte du trafic spatial

L’IPSS pourrait aussi être complété par un groupe de travail consacré à l’empreinte du trafic spatial. Inspiré de la Task Force du GIEC sur les inventaires nationaux de gaz à effet de serre, cet organisme aurait pour mission de développer des méthodologies standardisées permettant aux États de mesurer et déclarer leur « empreinte de trafic spatial » — c’est-à-dire la pression exercée par leurs objets spatiaux sur la sécurité et la durabilité de l’orbite basse terrestre.

À l’instar du rôle joué par le GIEC dans l’évaluation des modèles climatiques, l’IPSS devrait également fournir une expertise indépendante sur les affirmations concernant la désintégration contrôlée des satellites — autrement dit la manière dont les satellites sont retirés du service puis désorbités en toute sécurité. Cela impliquerait d’évaluer l’efficacité réelle des technologies de désorbitation, mais aussi notre capacité à suivre les satellites et à estimer précisément leur position.

En mettant en place dès aujourd’hui une approche internationale coordonnée, l’IPSS contribuerait à concilier les immenses promesses des activités commerciales spatiales avec les risques environnementaux qu’elles engendrent — de la même manière que le GIEC pour le climat terrestre face aux activités humaines.

Peter Brown a reçu des financements du Conseil de recherches en sciences naturelles et en génie du Canada, de la National Aeronautics and Space Administration (NASA) des États-Unis, de l’Agence spatiale européenne, de Ressources naturelles Canada et de Recherche et développement pour la défense Canada.

21.05.2026 à 15:45

« L’immigration est une composante centrale de la société française »

Texte intégral (3146 mots)

Quels sont les parcours des personnes immigrées et de leurs descendants en France ? Quelles discriminations ressenties ? Plus largement, quelle est la place de l’immigration dans la société française ? Pour répondre à quelques-unes de ces questions, l’Institut national d’études démographique (Ined) et l’Insee ont mené l’enquête « Trajectoires et Origines 2 »), inédite par son ampleur. Un ouvrage collectif issu de cette enquête menée en 2019-2021, à rebours de certaines idées reçues sur l’immigration, vient de sortir aux Éditions de l’Ined. Entretien avec Cris Beauchemin, qui a codirigé l'ouvrage.

The Conversation : Quels sont les objectifs de cette enquête « Trajectoires et Origines 2 » (TeO2) et quelle méthodologie avez-vous mise en place pour les atteindre ?

Cris Beauchemin : Le but était de dresser un tableau aussi complet que possible de la position des immigrés et de leurs descendants dans la société française. Notre principal instrument : la réalisation d’une nouvelle enquête avec l’Insee, qui renouvelle celle réalisée dix ans avant, TeO1, sur un nouvel échantillon. C’est une enquête unique par son ampleur, portant sur plus de 27 000 personnes, âgées de 18 à 59 ans, qui ont répondu aux enquêteurs de l’Insee lors d’entretiens durant souvent plus d’une heure.

La collecte, longue, a duré de juillet 2019 à janvier 2021. Cette enquête comporte deux particularités par rapport aux enquêtes classiques de statistique publique. La première est d’être multi-thématique – portant sur l’emploi, le logement, la famille, la santé, les discriminations, les pratiques culturelles, politiques, et religieuses, etc. ce qui fait sa grande richesse. La deuxième est que les immigrés et leurs descendants sont surreprésentés dans l’échantillon afin d’offrir des effectifs suffisants pour pouvoir faire des analyses en fonction des différentes origines.

Enfin, nouveauté de TeO2 par rapport à TeO1, cette enquête permet d’identifier et d’étudier la troisième génération, celle qui a au moins un grand-parent immigré. En raison de l’histoire de l’immigration, cette troisième génération est essentiellement composée de personnes d’origine européenne : nos enquêtés sont des adultes et leurs grands-parents immigrés sont nécessairement arrivés il y a plusieurs décennies, à une époque où la migration était essentiellement européenne.

Quelle contribution de l’immigration au peuplement de la France et quelle « photographie » TeO2 donne-t-elle des origines des Français ?

C. B. : Le principal résultat à retenir est que si l’on additionne les immigrés, les descendants de deuxième génération (ayant au moins un parent immigré) et la troisème génération (ayant au moins un grand-parent immigré), un tiers des Français a un lien direct avec l’immigration. Plus précisément, parmi les 18-59 ans, 13 % sont immigrés et, respectivement, 11 % et 10 % ont au moins un parent ou un grand-parent qui a immigré.

Si on ajoute les personnes en couple avec une personne immigrée ou un enfant d’immigré(s), 41 % des individus ont un lien familial fort à l’immigration, soit par ascendance, soit par alliance. L’immigration est donc une composante centrale de la société française. Elle s’y fond au fil des générations par le biais des unions. Parmi les enfants d’immigrés, un sur deux a un parent de la population majoritaire (c’est-à-dire ni immigré ni enfant d’immigré). Quant aux petits-enfants d’immigrés, 95 % ont au moins un grand-parent qui n’est pas immigré.

Dans une perspective historique, quelle évolution est observée dans la composition de l’immigration en France ?

C. B. : La part des immigrés dans la population a augmenté – ce sont les recensements qui nous renseignent sur le sujet –, notamment depuis le début des années 2000.

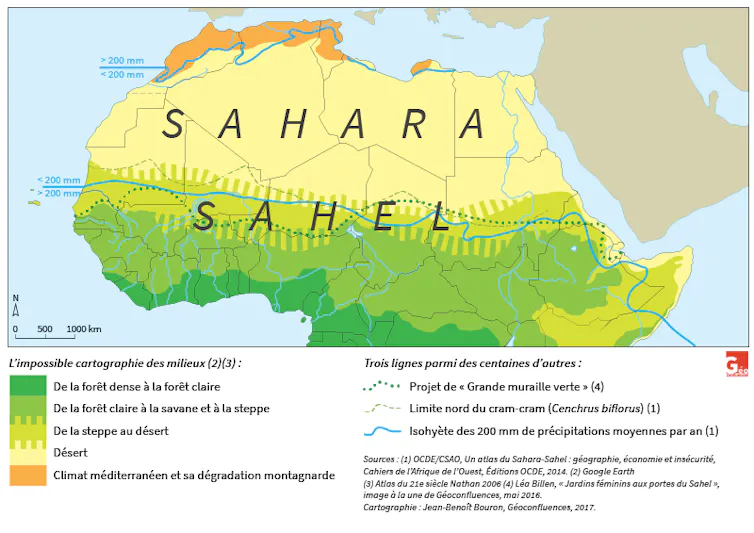

Mais ce qui a surtout évolué, c’est la composition de la population immigrée. L’immigration procède par « vagues », ce que montre très bien un graphique de notre premier chapitre (voir ci-contre).

Principalement européenne avant 1960, l’immigration s’est peu à peu diversifiée. Les « vagues » se succèdent : le haut de la « vague » d’arrivée des Belges se situe avant 1900, ils ont été suivis par les Italiens et les Polonais au milieu du XXᵉ siècle, puis par les Espagnols et les Portugais dans les années 1970. L’immigration non-européenne s’est développée seulement à partir des années 1960, d’abord avec les Algériens. Sont ensuite venus les Marocains, les Tunisiens, les Turcs, les Subsahariens et les Asiatiques, surtout depuis les années 2000.

L’inquiétude de certains discours actuels qui relaient l’idée que l’immigration non européenne suivrait une progression inédite dans l’histoire de l’immigration n’est pas fondée. Certes, le graphique montre bien que l’immigration en provenance d’Afrique subsaharienne est en augmentation, mais – alors que la courbe cumule les originaires de tout le continent – elle n’atteint pas le niveau des seuls Italiens au milieu du XXᵉ siècle.

Reste que, aujourd’hui, l’immigration est très diversifiée. Parmi les 18-59 ans, d’après les résultats de TeO2, les immigrés européens sont minoritaires (28 %). Le Maghreb représente un tiers des immigrés, les Subsahariens, environ 20 %, l’Asie, 16 %.

Que dit TeO2 des positions sociales et des pratiques culturelles des personnes immigrées et de leurs descendants ? Observe-t-on une égalisation progressive, une homogénéisation des positions sociales et des pratiques culturelles entre les descendants d’immigrés et ce que vous appelez la « population majoritaire » c’est-à-dire les personnes ni immigrées ni enfants d’au moins un immigré ?

C. B. : Le grand résultat de l’enquête est précisément qu’il y a un hiatus entre l’intégration socioéconomique et l’intégration socioculturelle. Alors que des difficultés d’accès à l’emploi notamment persistent d’une génération à l’autre, on observe une nette convergence vers la population majoritaire sur une grande variété d’indicateurs socioculturels, comme les pratiques linguistiques (le fait de parler le français à la maison avec ses enfants), les pratiques de fécondité ou les normes sociales (par exemple sur le travail des femmes ou la tolérance vis-à-vis de l’homosexualité ou de l’avortement).

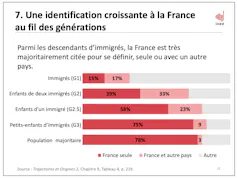

Ainsi, en génération deux et trois, on arrive à des positions qui sont très similaires à celles de la population majoritaire. On l’observe bien avec les réponses données à la question « En pensant à votre histoire, votre culture familiale et votre identité, de quelle(s) origine(s) vous considérez-vous ? ». Les secondes générations qui ne s’identifient pas à la France ne sont pas plus nombreuses que les personnes de la population majoritaire.

Vous évoquez une « identité à traits d’union », qu’entendez-vous par là ?

C. B. : C’est l’idée que les immigrés et que leurs enfants n’abandonnent pas leur bagage socioculturel, mais qu’ils le combinent à de nouvelles pratiques et de nouveaux sentiments d’appartenance qu’ils adoptent dans l’environnement français qui, lui-même, est divers. On retrouve cette « identité à traits d’union » dans le fait que les immigrés et leurs descendants s’identifient souvent à la fois à leur pays et à la France. C’est le cas de 17 % des immigrés (en plus des 15 % qui ne s’identifient qu’à la France) et de 33 % de leurs enfants (en plus des 39 % pour la France seule).

Et cette homogénéisation observée en matière de valeurs ne se retrouve donc pas au plan socioéconomique ?

C. B. : Les résultats sont nuancés. Ils sont positifs quand on compare les positions sociales des immigrés et de leurs enfants. Les mobilités sociales ascendantes sont plus fréquentes dans les familles immigrées que dans la population majoritaire, parce que les parents sont souvent de position sociale assez modeste.

Du point de vue de l’éducation, le tableau est aussi assez positif. Les personnes de la deuxième génération, dans leur ensemble, parviennent à des niveaux d’éducation très proches de la population majoritaire (la proportion des femmes ayant au moins un bac + 3 est de 26 % pour les majoritaires et de 27 % pour les filles d’immigrés), même s’il existe des inégalités selon l’origine. Selon le stéréotype bien connu, les Asiatiques, par exemple, performent et sont hyperdiplômés par rapport à la moyenne (48 % des femmes ont un au moins un bac + 3). Mais ce qu’on dit beaucoup moins et qui est nouveau par rapport à Teo1, c’est que les personnes de deuxième génération d’origine subsaharienne sont aussi plus souvent titulaires d’une licence ou équivalent que la population majoritaire. C’est davantage qu’en population majoritaire, aussi bien chez les femmes (32 % contre 26 %) que chez les hommes (27 % contre 23 %).

D’ailleurs, sur l’éducation, un autre élément que l’on retrouve dans l’enquête, qui va sans doute à l’encontre des idées reçues, est que les primo-arrivants sont beaucoup plus diplômés que par le passé. Pouvez-vous nous détailler ce résultat ?

C. B. : En effet. Parmi les immigrés arrivés avant 1989, seuls 29 % avaient atteint l’enseignement supérieur avant d’entrer en France. Pour ceux arrivés après 2009, la proportion est à 53 % ! Cela ne veut pas dire que tous les immigrés sont extrêmement diplômés : par rapport à la population majoritaire, ils sont à la fois plus fréquemment sans diplôme et aussi plus souvent plus diplômés. Typiquement, les hommes subsahariens de première génération sont plus souvent titulaires d’une licence ou équivalent que les hommes de la population majoritaire (35 % contre 23 %).

Et donc, pour revenir aux inégalités observées au plan socioéconomique ?

C. B. : Elles sont flagrantes sur le marché de l’emploi. Toutes choses égales par ailleurs, on observe un surchômage très important chez les minorités visibles, notamment les originaires du Maghreb et d’Afrique subsaharienne, aussi bien chez les hommes que chez les femmes. Par exemple, les immigrés d’origine maghrébine ont un risque de chômage augmenté de + 6,2 points de pourcentage par rapport aux hommes de la population majoritaire qui ont des profils comparables. Et l’écart est de +11,7 points pour les femmes. Chez les descendants, qui ont pourtant grandi en France, les écarts persistent. Et des pénalités salariales sont aussi observées. Ces écarts étaient déjà observés dans TeO1. La situation ne s’est pas améliorée.

Cela s’explique essentiellement par la persistances des discriminations. Le chapitre 11 montre qu’il y a une corrélation très forte entre les situations de désavantage sur le marché de l’emploi et les déclarations de discrimination des enquêtés. Cela corrobore les études fondées sur d’autres méthodes de mesure des discrimination, comme des testings (méthode utilisée pour détecter et prouver des discriminations, NDLR) par exemple, mis en place sur le marché de l’emploi ou sur le marché du logement.

Vos résultats montrent globalement une augmentation des discriminations. Comment l’expliquer ?

C. B. : L’ouvrage comporte un chapitre sur les expériences de discrimination et de racisme. Tous motifs confondus (origine, sexe, handicap et autres motifs officiels de discrimination qui peuvent justifier un recours auprès de la défenseure des droits), les discriminations ont en effet nettement progressé entre TeO1 et TeO2. C’est un résultat qui s’explique essentiellement par le surcroît de déclarations de sexisme dans un contexte post #MeToo.

Dans l’enquête figurent aussi des questions sur l’expérience du racisme. Il n’a pas augmenté parmi les minorités les plus visibles, parce qu’il a déjà atteint depuis longtemps des niveaux très élevés : dans TeO2, 36 % parmi les immigrés d’Afrique subsaharienne et 50 % parmi leurs descendants. Chez les ultramarins, la proportion est de 39 % en première génération, 47 % en deuxième génération.

Il y a une augmentation des déclarations de racisme et de discrimination entre la première et la deuxième génération. C’est un phénomène bien connu qu’on appelle le paradoxe de l’intégration. Les personnes de deuxième génération sont nées en France, ont été socialisées en France, sont allées à l’école en France ; elles ont en conséquence plus d’exigences à l’égard du modèle républicain que les premières générations et une plus grande sensibilité qui les conduit à déclarer des faits racistes ou discriminatoires quand elles les subissent.

Quelles pistes de recherche sont à explorer à la suite de l’enquête TeO2 ?

C. B. : La question majeure va de nouveau tourner autour du hiatus entre l’intégration socioculturelle et l’intégration socioéconomique. Idéalement, si on croit au modèle républicain, on voudrait ne plus relever d’inégalités et de discriminations selon l’origine ou l’apparence. La question pour TeO3 sera de déterminer si la société a progressé de ce point de vue-là ou bien si les pénalités socioéconomiques continuent à se transmettre d’une génération à l’autre.

Propos recueillis par Françoise Marmouyet.

L’enquête TeO2 a été rendue possible par le soutien financier de nombreuses institutions, outre l’Insee et l’Ined : le commissariat général à l’égalité des territoires (CGET), la CNAF, la Défenseure des droits, la Dilcrah, le département des statistiques, des études et de la documentation (DSED) du ministère de l’intérieur, le DEPS du ministère de la culture, la Dares du ministère du travail, l’Injep, le secrétariat d’État à l’égalité entre les femmes et les hommes, France Stratégie et Progedo.

Cris Beauchemin ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

21.05.2026 à 15:38

Fertiliser: the forgotten history linking the agricultural commodity and empire in wartime

Texte intégral (1507 mots)

Fertilisers are not just an agricultural input: they are a strategic resource hidden at the centre of geopolitical conflict. The US and Israel’s war on Iran and the related disruption of shipping through the Strait of Hormuz are sending shockwaves through the global farming system. A large share of the world’s traded chemical fertilisers normally passed through this strategic chokepoint, alongside key feedstocks needed to produce fertilisers elsewhere, such as gas, ammonia and sulphur.

The rise in fertiliser prices will push up food costs across the globe. This may seem like a recent vulnerability.

In reality, fertilisers have been entangled with war and imperialism for more than a century. As shown by my recent research, fertilisers were one of the factors contributing to shape colonial expansion, economic policy and even military strategy in the first half of the 20th Century.

How fertilisers became strategic

Modern conventional agriculture depends heavily on external inputs of three key nutrients:

- Nitrogen

- Phosphorus

- Potassium.

Already in the 19th century, the industrial revolution spreading across the Global North was pushing an increasing part of the workforce off the fields and into mines, factories, building sites and services. How to feed growing masses of people that were not producing their own food became a matter of great urgency. This created a race to secure fertiliser resources.

Since the 1840s, phosphorus and nitrogen-rich guano have been extracted from Peruvian islands for export to the Global North.

In the 1860s, Spain’s attempt to wrest such a treasure away from British hegemony resulted in the Chincha Islands War, a clear instance of intra-imperialist clash over natural resources. However, after half a century of relentless extraction, guano reserves were mostly depleted.

Nitrogen supplies were thus ensured by Chile’s nitrate mines, over which British interests encouraged the War of the Pacific (1879-1884) between Chile, Bolivia and Peru.

Yet, in the early 20th century, German chemist Fritz Haber – also remembered as the father of modern chemical warfare – demonstrated how to industrially fix nitrogen from thin air. Phosphorus, instead, had to be sourced through phosphate rock extraction.

The scramble for phosphate

Between the 19th century and the early 20th century, France gained control over major phosphate reserves through its colonial domination of Tunisia, Algeria and Morocco.

Italy, a latecomer to empire-building, feared being left behind. The Italian nationalist press promoted the idea that Libya contained enormous phosphate wealth. Politicians, industrialists and banks became enticed with the prospect of a “phosphate El Dorado”. This became part of the political campaign for the Italian invasion of Libya in 1911.

For decades, Italian governments and companies funded costly geological expeditions across the Libyan desert, pursuing Italy’s “phosphate mirage”. This is the context in which fascist general Rodolfo Graziani committed genocide in Cyrenaica to isolate the rebels led by Omar al-Mukhtar. Yet, again and again, the much sought-after phosphate discoveries proved disappointing.

In parallel, Italian companies gained direct access to phosphate extraction in Tunisia and Egypt, which were however under French and British control, respectively.

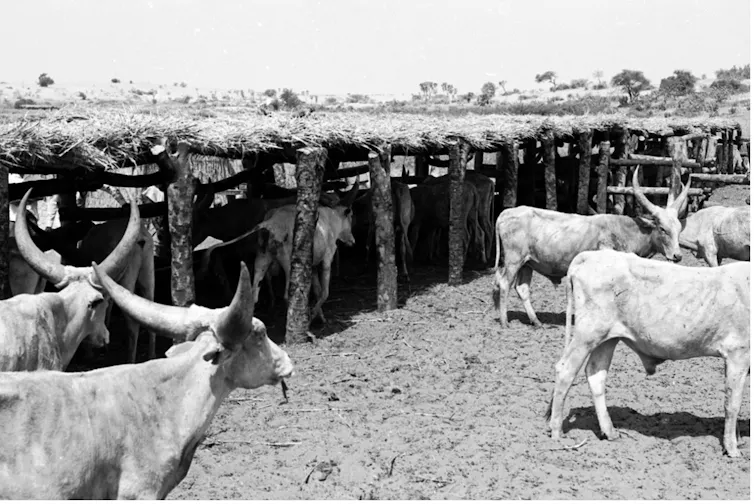

Phosphate provision also depended on highly exploitative colonial labour regimes. In the North African mines, European managers supervised indigenous workers employed in harsh conditions.

Archival records show explicitly racialised wage schemes in which Arab workers received significantly lower pay than Europeans.

Cheap phosphate helped lower food costs in Europe, but this system rested upon the super-exploitation of colonial labour and resources.

Fascism, agriculture and empire

Chemical fertilisers became even more important under Benito Mussolini, who had paved his way to power by doing the dirty job of repressing the peasant movement for agrarian reform that had followed WWI.

In 1925, the fascist regime launched the “Battle for Grain”, an ambitious campaign to increase Italian wheat production and reduce reliance on imports.

Italy’s chemical giant Montecatini massively expanded fertiliser production, while propaganda encouraged farmers to adopt high-input agriculture. Posters depicted heroic peasants producing gigantic wheat harvests in service of the nation.

This “fascist Green Revolution” succeeded in increasing wheat output, but it also deepened Italy’s need for imported phosphate. This created a contradiction at the heart of fascist “autarky”, or economic self-sufficiency.

Italy claimed to be freeing itself from foreign dependence while remaining structurally reliant on colonial mineral supply chains. This became increasingly dangerous as Europe again was pushed toward war.

As soon as Italy entered WWII, the British requisitioned its phosphate mines in Egypt. As the conflict disrupted Mediterranean trade routes, Italy remained cut off from Tunisian phosphate imports too. The fascist dream of economic autarky thus proved to also be a mirage. Fertiliser production collapsed, agricultural output fell sharply and food shortages worsened.

Economic hardship played no small role in the loss of fascist control on Italian peasants and workers, many of whom joined the Resistance against Nazi fascism.

Back to the future

Fertilisers may seem mundane compared with oil or weapons. Yet modern societies depend on them just as profoundly.

Behind modern agriculture lies a vast and hierarchically organised infrastructure of critical minerals, energy sources, extractive sites, shipping routes, and chemical industries.

The imperialist logic underlying the international division of labour that structures these global productive networks maintains striking similarities with the realities of a century ago, in the form of steep international inequalities. The inclination of far-right governments to throw the world into wars they are unable to master is just as familiar, with momentous consequences.

A weekly e-mail in English featuring expertise from scholars and researchers. It provides an introduction to the diversity of research coming out of the continent and considers some of the key issues facing European countries. Get the newsletter!

This research was funded by the European Union through the project LabEcoInt - Labour & Ecology in an International Perspective: Porto Marghera in the Phosphates Archipelago | HORIZON EUROPE CALL: HORIZON-MSCA-2022-PF-01 (MSCA Postdoctoral Fellowships 2022) G.A. n. 101103735. Views and opinions expressed are however those of the author only and do not necessarily reflect those of the European Union. Neither the European Union nor the granting authority can be held responsible for them. Granting authority: European Research Executive Agency.

21.05.2026 à 15:36

Le contreterrorisme selon Trump : une vision plus idéologique que sécuritaire

Texte intégral (2196 mots)

La stratégie antiterroriste 2026 des États-Unis qui vient d’être officialisée par l’administration Trump instrumentalise la lutte contre le terrorisme pour servir une vision idéologique. S’attaquant aux « extrémistes d’ultragauche », elle n’évoque pratiquement pas les mouvements d’extrême droite, qui commettent pourtant plus de crimes violents.

Les États-Unis publient régulièrement des stratégies nationales de contreterrorisme afin de définir les principales menaces et les priorités de l’administration en matière de sécurité. Ces documents existaient avant le 11 septembre 2001, mais ce jour-là a profondément transformé leur importance, la lutte antiterroriste devenant alors l’axe central de la sécurité nationale américaine.

La première National Strategy for Combating Terrorism de l’ère post 11-Septembre est publiée par l’administration Bush en 2003 dans le cadre de la « Global War on Terror ». Depuis, chaque administration a adapté ses priorités selon le contexte stratégique et les menaces perçues.

Ces stratégies ne sont pas juridiquement contraignantes, mais elles jouent un rôle important d’orientation politique et bureaucratique. Elles influencent les priorités des agences fédérales, les budgets, les doctrines de sécurité et les relations avec les alliés. Surtout, elles révèlent la perception que Washington se fait des principales menaces pesant sur les États-Unis et des réponses à y apporter.

Le document officiel publié par la Maison-Blanche mi-mai, intitulé « 2026 Counterterrorism Strategy », place désormais dans une même catégorie – celles des sources de menaces majeures pour les États-Unis – les cartels, les réseaux djihadistes et les « extrémistes violents d’ultragauche ». Le blocage de l’immigration, le renforcement du contrôle des frontières, la lutte contre « l’ennemi intérieur » et la défense du « mode de vie américain » y sont présentés comme des thèmes centraux du contreterrorisme.

Ce qui est absent du document est toutefois tout aussi révélateur. Derrière les menaces mises en avant se dessinent plusieurs angles morts majeurs, dans un contexte de politisation croissante des questions de sécurité nationale.

Quand le contreterrorisme devient politique

La Stratégie insiste fortement sur la supposée « instrumentalisation » des outils sécuritaires sous l’administration Biden et l’accuse à plusieurs reprises d’avoir employé les services de renseignement et de lutte antiterroriste pour s’en prendre aux Américains conservateurs, notamment en adoptant des mesures visant à protéger contre l’intervention de ceux-ci la tenue dans les écoles de réunions sur les questions de genre ou les restrictions sanitaires. Le document inscrit ainsi une partie des fractures politiques et culturelles américaines dans la problématique du contreterrorisme, obéissant à une logique explicitement politique et idéologique.

La stratégie reprend plusieurs thèmes centraux de l’idéologie « America First » et du mouvement MAGA. La frontière sud devient un front sécuritaire majeur. Les cartels mexicains et certains réseaux criminels vénézuéliens récemment désignés comme organisations terroristes, à l’instar du Tren de Aragua, sont présentés comme des acteurs capables de déstabiliser directement les États-Unis, tandis que l’immigration clandestine est régulièrement associée au terrorisme et au crime organisé.

Cette approche s’inscrit dans un discours plus large porté par plusieurs figures de l’administration Trump. Des propos du vice-président J. D. Vance à la conférence de Munich pour la sécurité en 2025 à la récente National Security Strategy, les références au déclin de l’Occident et à la nécessité de fermer les frontières et de procéder à une forme de « restauration civilisationnelle » occupent désormais une place croissante dans les priorités stratégiques américaines.

Mais cette focalisation sur certains risques, réels ou supposés, pose une question essentielle : y a-t-il des formes de terrorisme que cette stratégie choisit d’ignorer aujourd’hui, au risque d’affaiblir demain la capacité des États-Unis à anticiper, prévenir et contrer ces menaces ?

Les formes de terrorisme reléguées dans l’angle mort

Alors que la stratégie insiste fortement sur les « extrémistes violents d’ultragauche », elle accorde une place beaucoup plus marginale aux violences provenant de l’extrême droite, qu’elles soient le fait de suprémacistes blancs prenant pour cible des communautés jugées étrangères ou d’extrémistes déterminés à s’attaquer à des représentants du gouvernement.

Pourtant, voilà plusieurs années que les experts alertent sur la montée des formes de radicalisation liées aux milices armées, aux mouvances accélérationnistes ou aux réseaux complotistes violents.

Ces dernières années, de nombreuses attaques liées à ces milieux se sont produites aux États-Unis, si bien que les spécialistes considèrent désormais les mouvances d’extrême droite comme l’une des principales menaces terroristes intérieures du pays.

L’attaque contre une synagogue de Pittsburgh en 2018, motivée par des théories complotistes antisémites, ou encore la fusillade raciste de Buffalo en 2022, dont l’auteur s’était inspiré de contenus suprémacistes et de la théorie du « grand remplacement », constituent deux exemples très connus parmi de nombreuses violences liées à l’extrémisme d’extrême droite recensées ces dernières années aux États-Unis. Selon les données de l’Anti-Defamation League (ADL), la totalité des meurtres commis pour des motivations extrémistes recensés dans le pays en 2024 étaient liés à des mouvances d’extrême droite. Ajoutons que depuis des années durant, des agences fédérales américaines comme le FBI et le Department of Homeland Security (DHS) considéraient ces mouvances comme l’une des principales menaces terroristes intérieures du pays – une analyse que la nouvelle stratégie de contreterrorisme de l’administration Trump ignore absolument.

Il ne s’agit évidemment pas de nier la réalité des dangers évoqués dans la Stratégie. Mais la question centrale reste celle de la hiérarchie des menaces retenue par un document censé préparer les États-Unis aux formes de terrorisme les plus dangereuses de demain.

Cette hiérarchisation soulève également des questions dans le contexte actuel de tensions avec l’Iran et ses réseaux affiliés. Si la stratégie mentionne explicitement les proxies soutenus par Téhéran, les opérations hybrides ou encore certains projets d’attaques visant des Américains, des dissidents iraniens ou des Israéliens sur le sol américain, ces enjeux apparaissent néanmoins beaucoup moins structurants dans le document que d’autres priorités – et cela, malgré le contexte de confrontation ouverte avec l’Iran, les multiples arrestations liées à des projets d’attaques attribués à des réseaux pro-iraniens ces dernières années, ainsi que l’intensification des tensions régionales.

L’autre grand angle mort du document concerne la dimension numérique du terrorisme contemporain. Les groupes djihadistes, mais aussi les mouvances violentes d’extrême droite et d’extrême gauche, utilisent désormais les réseaux sociaux, les messageries chiffrées et des plates-formes comme Telegram, Discord ou 4chan pour diffuser propagande, récits de victimisation et pousser au passage à l’acte. L’attentat de Christchurch (Nouvelle-Zélande) en 2019 avait marqué un tournant majeur : le terroriste avait diffusé son manifeste en ligne avant de retransmettre l’attaque en direct sur Facebook, dans une logique de propagande virale et d’imitation. On a retrouvé plusieurs de ces mécanismes lors de la tuerie de Buffalo citée plus haut et, tout récemment, durant l’attaque contre une mosquée de San Diego en mai 2026, dont les auteurs ont eux aussi diffusé des contenus en ligne et fait référence à l’attaque de Christchurch (Nouvelle-Zélande) et à son auteur. Cette logique rappelle certaines méthodes utilisées auparavant par Al-Qaida ou l’État islamique, qui avaient largement utilisé les réseaux sociaux et les contenus viraux pour recruter et encourager des passages à l’acte isolés.

La Stratégie évoque bien les nouvelles technologies et l’intelligence artificielle, mais principalement sous l’angle des armes de destruction massive. Elle s’attarde beaucoup moins sur les écosystèmes numériques dans lesquels se construisent aujourd’hui certaines formes de radicalisation. Cette absence est d’autant plus notable que l’administration Trump a parallèlement réduit ou supprimé plusieurs structures fédérales chargées de surveiller les campagnes de désinformation et les ingérences étrangères, comme le Global Engagement Center du Département d’État ou certaines capacités de l’Agence de cybersécurité et de sécurité des infrastructures (CISA) liées aux menaces informationnelles.

Le risque est alors qu’en lisant de plus en plus le terrorisme à travers une grille idéologique, cette Stratégie finisse par sous-estimer des menaces pourtant déjà identifiées depuis des années par les propres agences sécuritaires américaines.

Quand le terrorisme devient une catégorie politique

Ce débat ne concerne pas uniquement les États-Unis. La France et les autres pays européens sont eux aussi confrontés à des formes de radicalisation de plus en plus hybrides, où terrorisme, propagande numérique et polarisation politique tendent à se confondre.

L’assassinat de Samuel Paty en 2020 illustre particulièrement cette évolution. Avant l’attentat, une campagne virale sur les réseaux sociaux avait contribué à désigner publiquement l’enseignant comme une cible, mêlant désinformation, mobilisation communautaire et haine en ligne. Le sujet reste profondément présent dans le débat public français, comme le montre encore la sortie récente du film l’Abandon, consacré aux derniers jours du professeur assassiné.

Mais le djihadisme n’est pas la seule menace à laquelle les démocraties européennes sont confrontées. La plupart d’entre elles font également face à la montée de mouvances d’extrême droite radicalisées, de réseaux complotistes violents et à des campagnes d’ingérence étrangères exploitant les fractures politiques et culturelles occidentales. Ignorer certaines violences d’ultragauche par réflexe politique constituerait une erreur similaire.

La difficulté, pour les pays démocratiques, reste donc toujours la même : comment protéger la société sans transformer progressivement le terrorisme en catégorie politique variable selon les gouvernements et les idéologies du moment ?

Une stratégie antiterroriste révèle toujours la manière dont un État définit ses priorités, mais aussi ses peurs. Le danger n’est pas seulement de sous-estimer certaines menaces émergentes. Il réside aussi dans la tentation de politiser durablement la définition même du terrorisme et de la sécurité nationale. Lorsqu’un État commence à lire les menaces avant tout à travers une grille idéologique, il devient progressivement moins capable d’identifier lucidement les dangers de demain, précisément au moment où ceux-ci évoluent plus vite que jamais.

Elizabeth Sheppard Sellam ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

21.05.2026 à 15:24

Comment les communautés d’arbres façonnent le fonctionnement souterrain des forêts européennes

Texte intégral (1751 mots)

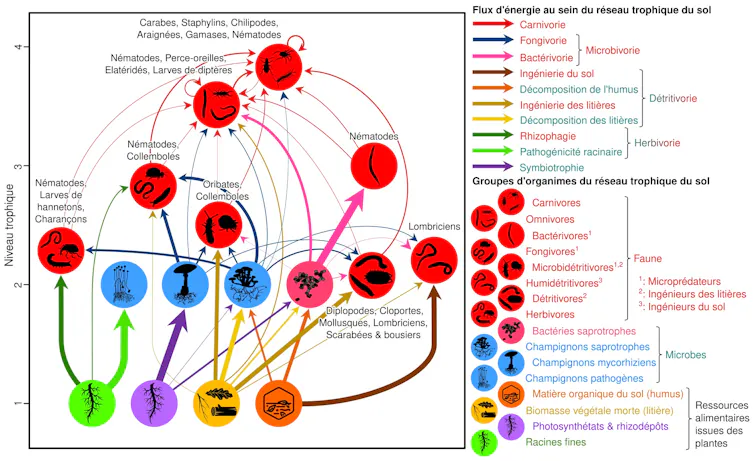

Les écosystèmes du monde entier évoluent rapidement sous la pression des changements globaux tels que le réchauffement du climat, les changements d’usage des terres ou les invasions biologiques, mais ce qui se passe sous terre reste encore mal compris. On sait, par exemple, que les plantes jouent un rôle central dans les « réseaux trophiques », ces ensembles d’interactions d’ordre alimentaire entre les êtres vivants d’un écosystème. Cependant, nous connaissons encore mal la manière dont les communautés végétales, les essences d’arbres d’une forêt par exemple, influencent la circulation de la matière et de l’énergie par les interactions trophiques entre organismes du sol, tels que les microbes (champignons et bactéries) et la faune détritivore, herbivore et carnivore.

Dans notre étude récente, publiée le 6 avril dans Nature, nous nous sommes penchés sur 64 forêts européennes, sur les espèces d’arbres qui s’y trouvent et sur le problème de savoir comment celles-ci influencent l’activité du réseau trophique du sol en matière de flux d’énergie au sein de celui-ci.

Nous avons découvert que les forêts dominées par des espèces d’arbres priorisant l’acquisition des ressources (eau, nutriments et lumière) et étant ainsi capables d’une croissance rapide, comme le charme commun (Carpinus betulus) ou le bouleau verruqueux (Betula pendula), présentent une activité du réseau trophique du sol plus élevée. Ces arbres fournissent, en effet, davantage de matière organique fraîche de bonne qualité nutritive et créent des microclimats plus chauds, stimulant le métabolisme des organismes du sol et accélérant des processus comme la décomposition des matières organiques et le recyclage des nutriments du sol.

À l’inverse, les forêts dominées par des espèces d’arbres priorisant la conservation des ressources, comme le pin sylvestre (Pinus sylvestris) ou l’épicéa commun (Picea abies), et dont la capacité de croissance est ainsi plus lente, présentaient une activité du réseau trophique du sol plus faible.

En d’autres termes, l’identité des espèces et leurs « traits fonctionnels » liés à leur stratégie d’allocation des ressources au sein d’une communauté d’arbres sont plus importants qu’on ne le pensait auparavant.

Étonnamment, le simple mélange de différentes espèces d’arbres n’a pas amélioré le fonctionnement du sol – et l’a même souvent légèrement réduit – malgré l’augmentation de la croissance aérienne des arbres induit par cette diversification. Ce décalage met en lumière un point essentiel : ce qui profite aux arbres en surface ne profite pas toujours au réseau trophique souterrain.

Pourquoi c’est important ?

Ces résultats ont des implications importantes pour la gestion forestière. Promouvoir la diversité des arbres à elle seule pourrait ne pas suffire à maintenir des sols sains, c’est-à-dire capables de fonctionner afin d’assurer la fourniture de multiples services bénéficiant à l’humanité. En revanche, sélectionner les espèces d’arbres en fonction de leurs traits fonctionnels, tels que leur activité métabolique ou leur capacité de croissance, pourrait s’avérer plus efficace pour préserver la vitalité des écosystèmes forestiers.

À l’avenir, le changement climatique devrait accroître la fréquence et l’intensité des sécheresses et ainsi favoriser des espèces d’arbres priorisant la conservation des ressources, car ils sont plus résistants à la mortalité par cavitation induite par le stress hydrique. Nos découvertes suggèrent que ce changement dans la composition en espèces des communautés d’arbres pourrait ralentir le fonctionnement du sol, avec des répercussions importantes pour le recyclage de la matière organique du sol, la disponibilité des nutriments et la régénération forestière. Globalement, l’étude souligne la nécessité de prendre en compte les dynamiques aériennes et souterraines dans la gestion des forêts face aux changements climatiques.

Quelles sont les suites ?

Cette recherche ouvre la voie à de multiples perspectives de recherche.

Il serait ainsi intéressant d’étudier de nouveau ces communautés d’arbres et le fonctionnement du réseau trophique du sol de ces forêts de manière répétée dans le temps, afin de suivre la dynamique temporelle conjointe des comportements aérien et souterrain en lien avec les changements globaux en cours. Ceci permettrait de mieux comprendre les liens de causalité en jeu.

Ce travail de recherche pose également des questions concernant l’importance relative pour la nutrition des organismes du sol de différentes sources d’aliments fournis à la base du réseau trophique par les plantes. Parmi celles-ci, on compte les litières, qui constituent l’apport dominant de matière végétale sous forme de feuilles, racines et tiges mortes nécessitant une décomposition pour s’en nourrir. On compte aussi les racines vivantes, qui peuvent être consommées directement par les herbivores ou les pathogènes mais apportent aussi au sol des matières organiques fraîches sous forme soluble directement accessible pour les organismes du sol par un phénomène appelé « rhizodéposition ».

Le projet SoilForEUROPE (ANR-16-EBI3-0009) est soutenu par l’Agence nationale de la recherche (ANR), qui finance en France la recherche sur projets. L’ANR a pour mission de soutenir et de promouvoir le développement de recherches fondamentales et finalisées dans toutes les disciplines, et de renforcer le dialogue entre science et société. Pour en savoir plus, consultez le site de l’ANR.

Ludovic Henneron a reçu des financements de l'ANR (Appel à projets générique 2024, projet Jeunes Chercheuses et Jeunes Chercheurs) pour le projet PLASTRAIT (Plasticité de la qualité des litières foliaires d'arbres : conséquences pour le recyclage de l'azote du sol et les interactions plantes-plantes).

Paul Kardol a reçu des financements de BiodivERsA COFUND call for research proposals, with the national funders Agence Nationale de la Recherche (ANR, France), the Belgian Science Policy Office (BELSPO, Belgium), Deutsche Forschungsgemeinschaft (DFG, Germany), the Research Foundation Flanders (FWO, Belgium), the Swedish Research Council (FORMAS, Sweden).

Stephan Hattenschwiler a reçu des financements de BiodivERsA COFUND call for research proposals, with the national funders Agence Nationale de la Recherche (ANR, France), the Belgian Science Policy Office (BELSPO, Belgium), Deutsche Forschungsgemeinschaft (DFG, Germany), the Research Foundation Flanders (FWO, Belgium), the Swedish Research Council (FORMAS, Sweden) et du programme exploratoire français (France 2030) FairCarboN (ANR-22-PEXF-0001).

David Wardle ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

21.05.2026 à 14:59

La concurrence dans l’intelligence générative n’est pas une guerre de marché classique

Texte intégral (2027 mots)

Depuis la médiatisation de ChatGPT, les annonces se sont multipliées concernant l’intelligence artificielle, chaque géant du numérique développant sa solution. En apparence, il s’agit d’une concurrence féroce entre des groupes rivaux. La réalité pourrait être bien plus nuancée. Les concurrents ne cherchent peut-être pas tant à dominer les autres qu’à devenir des briques indispensables aux succès de leurs concurrents.

De prime abord, la concurrence dans l’intelligence artificielle (IA) générative ressemble à une bataille économique classique : Google contre Meta, Meta contre Anthropic, OpenAI contre Google… Cette approche succincte a l’avantage de la simplicité, mais elle a également le défaut de masquer ce qui fait la singularité de ce secteur.

La concurrence sur ce marché ne prend pas seulement la forme d’une confrontation directe et la course à l’innovation. Elle passe aussi par la capacité à rendre les adversaires dépendants de soi.

Cœur de la concurrence

Pendant des années, du moins au cours de l’émergence de l’IA et des premières années de sa croissance, le cœur de la concurrence dans ce secteur a semblé évident. Sur ce marché – pour s’imposer – il fallait disposer du meilleur assistant IA, soit un programme informatique conçu pour comprendre les demandes humaines, les traiter et leur répondre, de manière plus ou moins naturelle. Mais cette lecture devient moins suffisante aujourd’hui.

Le Stanford AI Index 2025 indique que près de 90 % des modèles dits « courants » d’assistants IA de 2024 proviennent du secteur privé, contre 60 % en 2023, tandis que le milieu universitaire reste la principale source de recherche. Et surtout que les écarts de performance entre les meilleurs modèles se resserrent de manière progressive : l’écart entre le premier et le dixième est tombé de 11,9 % à 5,4 % en un an, tandis que les deux premiers ne sont plus séparés que par 0,7 point.

Autrement dit, lorsque les modèles deviennent techniquement plus proches, la seule supériorité du modèle devient moins discriminante. Dès lors, l’avantage concurrentiel tend à se déplacer : il va moins au seul producteur du modèle qu’à celui qui contrôle les actifs complémentaires (Adner, 2017, Teece, 1986).

À lire aussi : Derrière l’IA, un écosystème insoupçonné… dont l’Europe est (pour l’heure) trop absente

La stratégie judicieuse de Microsoft

C’est ce qui rend dans cet esprit la stratégie de Microsoft particulièrement judicieuse. Avec Azure, Microsoft ne propose pas seulement ses propres offres ou celles d’OpenAI, la plateforme met également à disposition des usagers les modèles d’Anthropic, de Cohere, de DeepSeek, de HuggingFace, de Mistral, de Meta ou de Nvidia. L’enjeu stratégique paraît clair : Microsoft peut gagner même si le modèle qui s’impose n’est pas exclusivement le sien. Son pouvoir tiendrait alors moins à la supériorité d’un modèle particulier qu’à sa position d’intermédiaire.

Amazon suit une logique comparable avec Amazon Bedrock, qui permet d’accéder aux modèles proposés par Anthropic, DeepSeek, Meta, Mistral, OpenAI, Qwen, Stability AI et d’autres entreprises. Là encore, le succès de la stratégie ne provient pas seulement de la possession d’un modèle, mais également de l’organisation de l’accès à plusieurs modèles concurrents. Dans un tel système, un acteur peut monétiser la rivalité de ses propres adversaires, c’est-à-dire utiliser l’affrontement entre ses concurrents comme opportunité pour générer des revenus. Le marché devient dans cette veine moins un marché de produits qu’un marché de points d’entrée.

Cette logique n’est pas entièrement inédite. Elle prolonge un mécanisme déjà observé dans d’autres industries de plateforme : les app stores, les marketplaces ou les écosystèmes logiciels.

Ce qui semble toutefois plus spécifique à l’IA générative tient au fait que la concurrence ne porte pas seulement sur le contrôle de l’accès aux modèles concurrents, mais aussi sur la maîtrise des actifs complémentaires qui permettent de convertir leurs performances techniques en solutions utilisables par les clients : infrastructures cloud, puissances de calcul, semi-conducteurs spécialisés, canaux de distribution, données propriétaires, interfaces d’intégration et écosystèmes logiciels.

Devenir indispensable, même pour ses adversaires

Anthropic offre dans cette perspective un bon exemple de cette concurrence inédite. D’un côté, l’entreprise se mesure frontalement à OpenAI et à Google sur les modèles d’assistants d’IA. De l’autre, elle s’appuie sur plusieurs couches technologiques qui ne lui appartiennent pas entièrement. LeMaGit rapportait, le 22 novembre 2024, que l’entreprise utilise des AWS Trainium, des TPU conçus par Google et des GPU Nvidia (« puces » spécialisées pour l’intelligence artificielle, conçues pour entraîner et faire fonctionner des modèles plus rapidement que des processeurs classiques) afin de développer et mettre en œuvre Claude (un assistant d’IA, similaire à ChatGPT, créé par l’entreprise Anthropic).

Cette dépendance à des infrastructures externes s’est précisée en octobre 2025, lorsque Anthropic a annoncé l’extension de son usage des technologies Google Cloud, comprenant jusqu’à un million de TPU. Dans le même temps, Anthropic a annoncé officiellement avoir signé avec Google et Broadcom un nouvel accord portant sur la production de « plusieurs gigawatts » de capacité de calculs (TPU) de nouvelle génération à partir de 2027.

Être concurrent, ici, ne signifie donc pas s’émanciper des autres, s’éloigner d’eux ; cela laisse entendre, le plus souvent, l’apprentissage de la répartition de ses dépendances.

Oligopoles et interdépendance

La relation entre Microsoft et OpenAI illustre une autre variante de cette logique. Dans leur déclaration commune du 27 février 2026, les deux firmes soulignent que leur partenariat a été conçu pour leur laisser « de l’espace [afin de]… poursuivre de nouvelles opportunités de manière indépendante », tout en continuant de collaborer. Cette phrase résume bien la structure du secteur : l’indépendance proclamée n’abolit pas l’interdépendance ; elle s’y superpose. Nous sommes ainsi loin de la quête de l’indépendance sur les marchés oligopolistiques, comme le soulignait naguère l’économiste Alain Cotta.

Dans l’IA générative, nous ne sommes pas non plus dans une coopétition au sens de Brandenburger et Nalebuff (1996), mais dans une dynamique concurrentielle dans laquelle une firme cherche à accroître sa puissance non seulement en surpassant ses rivales, mais en devenant également indispensable à leur fonctionnement. Il ne s’agit donc pas uniquement de préserver son autonomie face aux rivaux, mais de construire des positions telles que cette autonomie devient elle-même relative, parce que médiatisée par des actifs contrôlés par d’autres.

Demain n’est pas un autre jour

La dynamique concurrentielle relative à l’IA se distingue par un autre trait : elle est de plus en plus un affrontement de « préemption » (Ian McMillan, 1983). Les acteurs ne se battent pas seulement pour vendre aujourd’hui ; ils préparent déjà les conditions de leur puissance de demain.

Le quotidien économique belge l’Écho a révélé, il y a quelques jours, que Broadcom a signé avec Google un accord de long terme pour co-développer et fournir ses puces IA jusqu’en 2031. Quelques jours plus tard, Reuters indiquait que Meta avait renforcé son partenariat avec CoreWeave par un nouvel accord de 21 milliards de dollars (plus de 18 milliards d’euros), venant s’ajouter à un précédent contrat de 14,2 milliards (soit 12,2 milliards d’euros), le tout courant jusqu’en décembre 2032. L’enjeu est loin d’être anecdotique ; ces accords donnent accès à de la capacité cloud future et, pour Meta, aux futures « puces » Vera-Rubin de Nvidia via CoreWeave.

Nous saisissons alors, à partir de ces exemples, pourquoi la concurrence dans l’IA générative ne ressemble pas vraiment à une guerre de marché classique. Dans beaucoup de secteurs, la victoire reposerait sur l’évincement, temporaire ou définitif, du rival. Ici, elle consiste souvent à devenir l’infrastructure, l’intermédiaire ou le fournisseur dont l’adversaire ne peut pas aisément se passer. Le pouvoir se déplace, dans cette perspective, vers le contrôle des « points de passage » : l’accès aux utilisateurs, la capacité de calcul, l’hébergement, les plateformes d’intégration, les « puces ».

Et les régulateurs ?

Cette structure de marché explique parallèlement pourquoi les autorités de concurrence regardent désormais au-delà des seuls modèles économiques de chaque entreprise. Le 24 mars 2026, Reuters rapportait que Teresa Ribera, commissaire européenne à la concurrence, élargissait sa vigilance à l’ensemble de la « pile » IA : les modèles économiques proprement dits, les données d’entraînement (informations utilisées pour apprendre à un modèle de machine learning à faire des prédictions, à reconnaître des schémas ou à générer du contenu) et l’infrastructure cloud.

Ce déplacement du regard est somme toute logique. Si le pouvoir de marché réside désormais dans les dépendances organisées, il ne suffit plus alors de se contenter d’observer qui produit le meilleur assistant IA. Il faut nécessairement regarder qui contrôle les points de passage incontournables du secteur. La bonne question ne consiste peut-être plus à identifier celui qui gagnera à terme la course à l’IA. La question la plus juste serait : qui réussira à se rendre indispensable aux autres ?

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

21.05.2026 à 11:41

Pourquoi la profusion de cartes ne nous aide pas forcément à être mieux informés

Texte intégral (1983 mots)

C’est un des paradoxes de notre époque. Satellites, avions, drones et intelligences artificielles nous permettent de cartographier le monde avec une précision inédite. Pourtant, de nombreuses cartes d’un même endroit montrent des réalités différentes. Comment l’expliquer, et comment faire pour ne pas tomber dans du « map-washing » où chacun prendrait la carte qui l’arrange ?

Jamais nous n’avons autant cartographié la planète. Portés par l’essor des capteurs, des plateformes de calcul et de l’intelligence artificielle, nous disposons aujourd’hui d’une abondance de données qui modifie en profondeur notre manière d’observer la Terre.

Cette révolution s’appuie sur un outil central : la télédétection, qui consiste à observer la surface terrestre à distance grâce à des images acquises par des satellites, des avions ou des drones. Là où la cartographie était autrefois lente et localisée, il est désormais possible de suivre des territoires à l’échelle régionale voire mondiale à un rythme inédit.

Une révolution au service des grands enjeux environnementaux

Cette capacité à observer la Terre répond notamment à des enjeux environnementaux majeurs, largement inscrits dans les Objectifs de développement durable (ODD) des Nations unies, tels que la lutte contre le changement climatique, la préservation de la biodiversité ou la gestion durable des terres.

Disposer de cartes précises est essentiel pour suivre les changements, orienter les politiques publiques et renforcer la transparence des chaînes d’approvisionnement agricoles. Cette dynamique est aujourd’hui portée par une multiplication d’acteurs produisant et mobilisant des cartes : institutions publiques, organisations internationales, chercheurs, organisations non gouvernementales, mais aussi entreprises privées développant leurs propres services de suivi satellitaire.

Cette diversité s’inscrit notamment dans des dispositifs de régulation comme le règlement européen contre la déforestation et la dégradation des forêts, qui impose aux entreprises de démontrer que certaines matières premières ne contribuent pas à la déforestation. Sa mise en œuvre repose largement sur l’usage de cartes mobilisées à différentes étapes des chaînes d’approvisionnement.

Le cas des palmiers à huile : trop de cartes, pas assez de clarté

Dans ce contexte, le cas des plantations de palmier à huile en Indonésie est au centre des préoccupations liées à la conversion des forêts tropicales en monocultures agricoles. Premier producteur mondial depuis 2007, le pays fait face à des défis tels que la fragmentation des habitats, la diminution de la biodiversité et la dégradation des stocks de carbone forestier. L’expansion des plantations s’accompagne également de tensions socioéconomiques, notamment autour des droits fonciers des populations autochtones.

De nombreux produits cartographiques ont ainsi été développés afin de localiser les plantations et d’en suivre l’évolution, en mobilisant des données et des méthodes variées. Cette diversité offre une pluralité de regards sur un même objet d’étude, constituant une richesse scientifique.

Cependant, elle s’accompagne de résultats parfois difficilement comparables. Ainsi quatre cartes de plantations de palmiers à huile sur l’île de Sumatra ont donné quatre mesures différentes de l’étendue de ces plantations, avec une différence de parfois presque 2 millions d’hectares, soit plus que la superficie de la Bretagne.

Tableau comparatif des quatre cartes de plantations de palmiers à huile sur l’île de Sumatra

Par exemple, la précision des images utilisées ou la période d’observation peuvent varier, influençant les surfaces estimées. Des divergences dans la définition de ce que l’on cartographie peuvent également générer des résultats différents. Dans le cas des plantations de palmier à huile, une question apparemment simple se révèle en réalité complexe : qu’inclut-on exactement ?

Selon les approches, il peut s’agir uniquement de plantations industrielles ou bien comprendre également de petites exploitations paysannes. À cela s’ajoute la question de la temporalité : une plantation mature, immature ou une parcelle en transition ne seront pas toujours représentées de la même manière.

Pour les utilisateurs finaux (décideurs publics, ONG ou acteurs privés) cette diversité de méthodes et de définitions peut alors devenir difficile à interpréter. Face à cette profusion, on peut s’interroger : quelle information utiliser ? Et comment comparer des résultats fondés sur des hypothèses différentes ? En multipliant les représentations d’un même phénomène, l’information se complexifie, en particulier lorsque les incertitudes sont peu visibles.

Trop de cartes : comment y voir plus clair ?

Face à cette multiplication de cartes, plusieurs pistes émergent pour améliorer leur usage et leur comparabilité. L’enjeu n’est plus seulement de produire davantage d’informations, mais d’en renforcer la robustesse et la lisibilité.

La fusion d’information apparaît comme une approche clé. Plutôt que de considérer chaque carte comme une vérité indépendante, il est possible de les combiner, à la manière de plusieurs points de vue sur un même phénomène, afin d’obtenir une vision plus stable. C’est l’approche que nous proposons dans le cadre du projet ANR PALMEXPAND (ANR-20-CE03-0004), mené par une équipe interdisciplinaire (CNRS, Cirad, Inrae). Cette approche s’appuie sur la théorie de Dempster-Shafer, qui permet de croiser plusieurs sources en tenant compte de leurs accords, de leurs désaccords et de leurs incertitudes.

LA THÉORIE DE DEMPSTER-SHAFER

- La théorie de Dempster-Shafer est une approche mathématique probabiliste développée en sciences de l’information pour représenter et combiner des sources de données incertaines. Contrairement aux méthodes classiques qui cherchent à produire une seule estimation « optimale », elle permet de raisonner en termes de degrés de croyance plutôt que de vérité unique.

- Concrètement, chaque source d’information (par exemple, une carte issue d’imagerie satellitaire ou un jeu de données existant) ne fournit pas seulement une réponse binaire, mais une indication de confiance associée à différents scénarios possibles. La méthode permet ensuite de combiner ces sources en distinguant trois éléments : ce qui est confirmé par plusieurs sources, ce qui est en désaccord et ce qui reste incertain faute d’information suffisante.

- L’un des intérêts majeurs de cette approche est qu’elle ne force pas une décision immédiate lorsqu’il existe des contradictions entre données. Elle permet au contraire de conserver et de rendre visibles les zones d’ambiguïté, ce qui est particulièrement utile lorsque les sources sont nombreuses, hétérogènes ou partiellement incompatibles.

Appliquée à Sumatra, cette méthode améliore la précision des résultats tout en rendant visibles les zones de divergence entre les données. Elle met par exemple en évidence des zones agricoles où des cocotiers sont confondus avec des palmiers à huile, tandis que les grandes plantations industrielles sont mieux identifiées et font davantage consensus entre les différentes sources.

Par ailleurs, notre méthode fournit une information plus nuancée. Cette approche représente mieux l’incertitude, souvent invisible mais essentielle pour comprendre les limites des données et éviter une lecture trop déterministe. Plutôt que des cartes binaires (présence ou absence de plantations de palmiers à huile), il devient possible de proposer des représentations graduelles indiquant différents niveaux de confiance. Un seuil de confiance élevé se traduira par des surfaces détectées moins importantes mais avec une forte certitude, tandis qu’un seuil plus faible inclura davantage de zones, au prix d’une incertitude plus importante.

Les utilisateurs peuvent alors adapter ce seuil selon leurs besoins et produire des cartes cohérentes avec leurs objectifs, tout en restant conscients des marges d’incertitude. Par exemple, dans le cadre du suivi des plantations de palmiers à huile, une ONG pourra se concentrer sur les zones où le niveau de confiance est le plus élevé pour documenter des plantations de palmiers à huile effectivement présentes, tandis qu’une administration pourra intégrer des zones plus incertaines pour identifier des zones susceptibles d’être prochainement converties et orienter les contrôles sur le terrain.

De la révolution cartographique au « map-washing »

Réunir ainsi différents acteurs et la société civile pour produire des cartes plus lisibles est une façon de lutter contre ce que certains chercheurs ont appelé le « map-washing », soit un processus de diffusion d’informations spatiales ayant peu de valeur pour les utilisateurs, mais contribuant à construire ou orienter un récit particulier.

Si le chercheur en sciences sociales Rory Padfield et ses collègues ont conceptualisé cette dérive pour analyser des outils cartographiques servant à promouvoir une image de transparence environnementale dans l’industrie de l’huile de palme, cette notion peut être élargie à des situations où la multiplication de cartes et de données finit par complexifier leur interprétation et leur usage.

Le problème n’est pas seulement que les cartes puissent tromper : c’est aussi qu’elles deviennent difficiles à utiliser. Cette situation ouvre la voie à une forme d’instrumentalisation plus diffuse, non par manipulation directe des données, mais par sélection opportuniste de la carte la plus adaptée à un objectif donné.

Ainsi, le map-washing ne relève pas uniquement d’une stratégie délibérée de communication : il peut aussi émerger d’un excès d’information mal articulée.

Produire toujours plus de cartes ne garantit pas une meilleure connaissance. L’enjeu central devient alors de passer d’une logique de production à une logique d’usage : mieux définir les objets cartographiés, rendre visibles les incertitudes et développer des outils capables d’articuler différentes sources d’information.

Carl Bethuel a reçu des financements de la Région Bretagne et de l'Agence Nationale de la recherche à travers le projet ANR Palmexpand (ANR-20-CE03-0004)

21.05.2026 à 10:33

Le « verrouillage carbone », ou pourquoi les majors pétrolières comme Shell renoncent à leurs projets de décarbonation

Texte intégral (2150 mots)

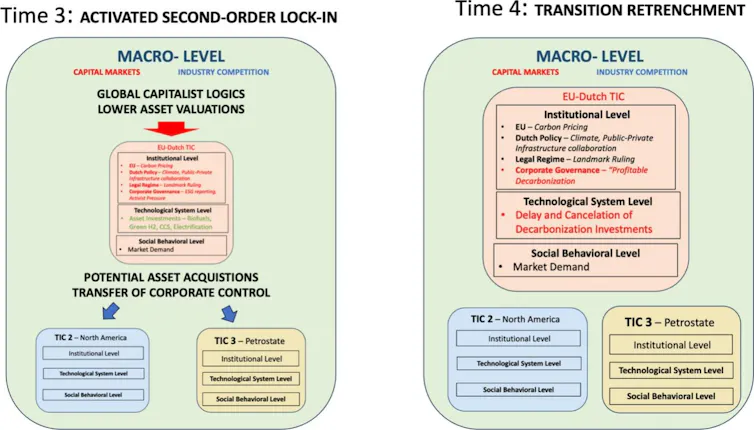

Les grands groupes pétroliers tels que Shell peuvent-ils réellement accomplir leur transition énergétique ? Derrière les difficultés, on retrouve la notion centrale de « verrouillage carbone ». Celui-ci est d’abord lié à la durée de vie des infrastructures pétrolières, mais un second type de verrou s’y superpose, lié aux attentes des marchés et des actionnaires.

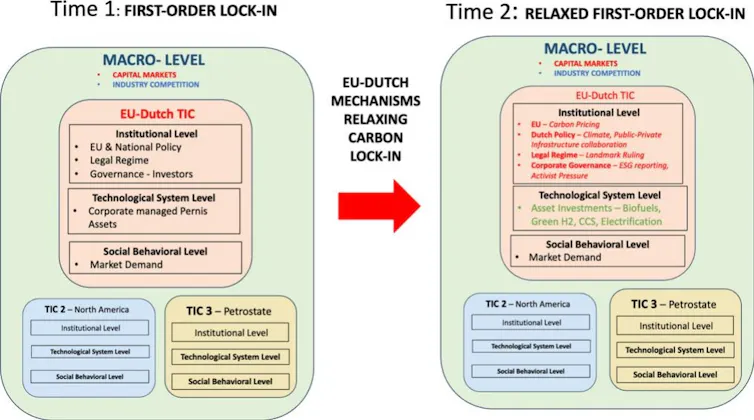

Pourquoi la transition énergétique progresse-t-elle si lentement, alors même que les technologies bas carbone existent, sont de moins en moins onéreuses et gagnent peu à peu des parts de marché ? Cette question d’actualité trouve une réponse dans les travaux fondateurs de Gregory C. Unruh, qui a introduit dès les années 2000 le concept de carbon lock-in, ou verrouillage carbone en français.

Selon lui, nos économies sont enfermées dans une trajectoire fossile, non pas du fait de l’absence d’alternatives, mais parce que les technologies, institutions et comportements permettant les conditions de cette trajectoire se renforcent mutuellement, créant une inertie systémique. Autrement dit, le carbon lock-in, c’est quand un système continue à fonctionner, non pas parce qu’il est optimal, mais parce qu’il est déjà en place.

Ce cadre théorique a depuis été enrichi par de nombreux travaux, notamment ceux de Steven J. Davis, qui montre comment les infrastructures existantes conditionnent les émissions futures et rendent toute bifurcation coûteuse et incertaine. Dans cette perspective, transformer le système énergétique ne consiste pas simplement à innover, mais à défaire un ensemble de dépendances accumulées dans le temps. Cette perspective prend une résonance particulière dans le cas de Shell, que nous avons analysée dans notre étude récente.

Au début des années 2020, l’entreprise fait face à une pression croissante. Régulations climatiques renforcées, attentes sociétales accrues, et décisions judiciaires inédites, notamment aux Pays-Bas. Ces éléments correspondent à ce que la littérature identifie comme des chocs exogènes, des situations externes capables de déstabiliser un système.

La transition de Shell se présente alors a priori comme conforme à la théorie, mais il apparaît rapidement qu’il existe un verrouillage carbone de second ordre, lié aux marchés et aux orientations stratégiques, en particulier les attentes des actionnaires. Explications.

À lire aussi : Aujourd’hui, le droit protège les combustibles fossiles : une première conférence internationale veut briser ce verrouillage

Shell : une transition qui se heurte à deux verrous

De 2015 à 2024, Shell engage des investissements significatifs dans des technologies bas carbone comme l’hydrogène, les biocarburants et le captage du carbone. C’est en particulier le cas pour sa raffinerie de Rotterdam (Pays-Bas), connue sous le nom de raffinerie Shell Pernis. À première vue, l’entreprise semble amorcer une sortie du carbon lock-in.

Shell semble commencer à franchir un cap. Les activités bas carbone gagnent en importance, la stratégie de l’entreprise évolue, et une réduction de la dépendance aux hydrocarbures paraît envisageable. Notre article montre que cette phase correspond à un désenclavement de premier ordre. Les contraintes technologiques et infrastructurelles, qui définissent le carbon lock-in, commencent alors à s’atténuer. C’est ici que, pour la première fois, les conditions matérielles d’une transition deviennent réellement plausibles.

Mais cette dynamique ne se stabilise pas. Très rapidement, une autre forme de contrainte émerge : celle des marchés financiers. Les attentes de rentabilité des investisseurs, les logiques de valorisation boursière et les modèles de gouvernance exercent une pression forte sur les choix stratégiques.

Du point de vue des investisseurs, les activités fossiles restent souvent les plus rentables à court terme. Les investissements bas carbone, plus incertains et plus longs à rentabiliser, peinent à rivaliser. Progressivement, la stratégie de Shell se rééquilibre. Les ambitions climatiques sont ajustées, et les activités traditionnelles retrouvent un rôle central.

Ce constat rappelle que le succès de la transition dépend pour beaucoup des organisations, des institutions et des pratiques existantes. Or, les nouvelles activités reposent ici sur les infrastructures, les compétences et les chaînes de valeur héritées du pétrole. Dans le cas présent, la transformation ne remplace pas le système existant, elle s’y superpose.

Cette observation confirme un point clé de notre recherche : les transitions industrielles sont rarement des ruptures, mais plutôt des reconfigurations progressives.

La véritable difficulté ? Sortir du second verrouillage carbone

C’est dans cette tension que réside la contribution principale de notre recherche. Nous montrons en effet que sortir du verrouillage carbone ne suffit pas. Même lorsque les contraintes technologiques s’affaiblissent, un nouveau verrouillage peut émerger, d’ordre financier et stratégique. Nous l’avons appelé « verrouillage carbone de second ordre » (second-order carbon lock-in).

Ce deuxième verrouillage ne repose plus sur seulement sur les infrastructures en place, mais également sur des logiques économiques telles que les attentes des actionnaires, les exigences de rentabilité et les structures de gouvernance. Autrement dit, même lorsque la transition devient techniquement possible, elle peut rester économiquement difficile.

Cette distinction entre les deux formes de verrouillage carbone suggère que les politiques climatiques ne peuvent pas se limiter à soutenir l’innovation ou à adapter les régulations qui s’appliquent aux infrastructures. Elles doivent aussi transformer les incitations économiques et financières qui orientent les décisions des entreprises. Sans cela, les efforts de transition risquent de rester partiels, instables, voire réversibles.

À lire aussi : Comment échapper à la malédiction de la rente fossile ?

Comment sortir du piège carbone… sans y retomber ?

L’histoire de Shell n’est pas une exception. Elle révèle une dynamique plus générale, celle d’une transition énergétique qui progresse, mais qui reste contrainte par les logiques profondes du système juridique et économique. Sortir du piège carbone ne consiste donc pas seulement à changer de technologie. Il faut aussi changer les règles du jeu.

Le cas de la raffinerie Shell Pernis met en évidence à la fois l’efficacité et les limites des interventions classiques de décarbonation. Les interventions de premier ordre visent d’abord à réduire les inerties internes aux complexes techno-institutionnels (c’est-à-dire les systèmes regroupant aussi bien des acteurs publics que privés qui participent à la diffusion des nouvelles normes technologiques). Elles sont essentielles pour amorcer la transition, mais demeurent insuffisantes lorsque les entreprises sont insérées dans des systèmes transnationaux, notamment les marchés financiers globaux et la concurrence internationale, qui peuvent réintroduire de nouvelles contraintes.

Ceci a deux conséquences très concrètes :

Pour les décideurs publics, cela implique de dépasser les cadres nationaux et d’articuler les politiques climatiques à l’évolution de la gouvernance financière. Une meilleure coordination avec des institutions, telles que la Banque centrale européenne (BCE), l’Autorité européenne des marchés financiers (AEMF) ou l’Organisation internationale des commissions de valeurs (IOSCO), apparaît nécessaire afin de limiter les désalignements entre objectifs climatiques et logiques de marché. Des instruments complémentaires, comme des cadres contractuels de long terme ou des protections contre certaines pressions financières, pourraient également soutenir les entreprises en transition.

Pour les entreprises, la transition ne saurait être réduite à un enjeu technologique ou réglementaire local. Et cela d’autant plus pour les firmes multinationales, qui opèrent dans plusieurs cadres nationaux à la fois et doivent gérer des attentes multiples et souvent divergentes, notamment de la part de leurs investisseurs. Les investissements de transition nécessitent des stratégies spécifiques, capables de valoriser leur rentabilité à long terme tout en limitant les pressions à court terme.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

21.05.2026 à 10:33

TotalEnergies face à l’administration Trump : quand l’abandon de l’éolien offshore devient une monnaie d’échange

Texte intégral (2460 mots)

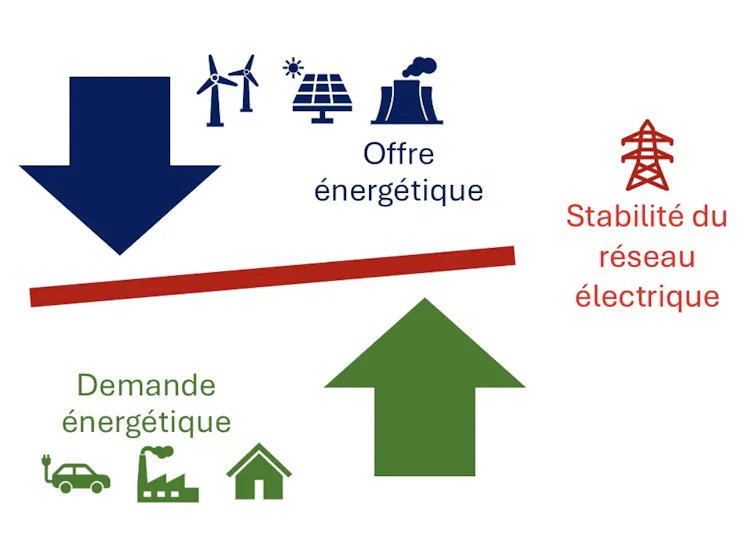

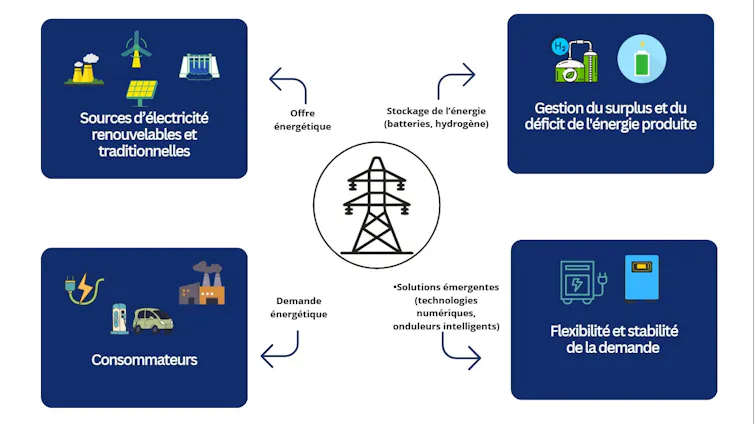

En mars 2026, le groupe TotalEnergies a déclaré renoncer à deux concessions d’éolien offshore sur la côte Est des États-Unis. En échange, l’administration Trump, ouvertement hostile au développement des énergies renouvelables, a promis des investissements de plus de 801 millions d’euros. Cet accord, qualifié de « gagnant-gagnant » par les deux parties, constitue un précédent juridique inédit. Il intervient au pire moment pour les États-Unis, qui doivent faire face à une augmentation massive de la demande d’électricité et fragilise la crédibilité des engagements ESG de la major pétrolière.

L’annonce est intervenue discrètement et l’actualité chargée des deux derniers mois aura eu tôt fait de la chasser des radars. Elle marque pourtant un précédent questionnable. Le 23 mars 2026, lors de la conférence CERAWeek à Houston (Texas), Patrick Pouyanné, PDG de TotalEnergies, a annoncé un accord d’environ 930 millions de dollars (plus de 801 millions d’euros) avec l’administration Trump.

Cet accord prévoit l’abandon par le groupe français de ses deux concessions d’éolien offshore sur la côte Est américaine, Carolina Long Bay et New York Bight, ainsi qu’un redéploiement des investissements vers les hydrocarbures, en particulier le gaz naturel liquéfié (GNL). Le dirigeant a qualifié cet accord de « gagnant-gagnant », une formule qui mérite d’être décortiquée.

Présenté comme une sortie pragmatique d’investissements devenus « politiquement hostiles », cet accord renvoie en réalité à des enjeux plus profonds. D’abord, parce qu’il constitue un précédent juridique inédit qui marque un recentrage stratégique aux implications significatives pour ce qui est des critères environnementaux, sociaux et de gouvernance (ESG). Ensuite, parce que l’accord envoie également un signal négatif aux marchés financiers, dans un contexte où la demande américaine d’électricité s’apprête à battre des records, notamment dans le contexte de la montée en puissance de l’intelligence artificielle.

En définitive, l’accord fragilise simultanément la crédibilité des engagements climatiques de l’entreprise et la sécurité juridique des investissements verts, tout en interrogeant la gouvernance de la transition énergétique.

Un deal énergétique à 930 millions de dollars

Les deux concessions abandonnées par TotalEnergies représentaient une capacité cumulée d’environ 4 gigawatts (GW), soit l’équivalent de quatre réacteurs nucléaires, ou encore de quoi alimenter près de 1,5 million de foyers en électricité décarbonée.

L’entreprise avait acquis ces droits au terme de procédures d’appel d’offres longues et coûteuses. Pour celles-ci, elle avait engagé des centaines de millions de dollars en études environnementales ainsi qu’en ingénierie préliminaire. Les deux projets avaient en outre déjà obtenu les autorisations fédérales nécessaires, ce qui les plaçait dans une phase avancée de développement.