15.09.2025 à 07:42

Khrys’presso du lundi 15 septembre 2025

Comme chaque lundi, un coup d’œil dans le rétroviseur pour découvrir les informations que vous avez peut-être ratées la semaine dernière.

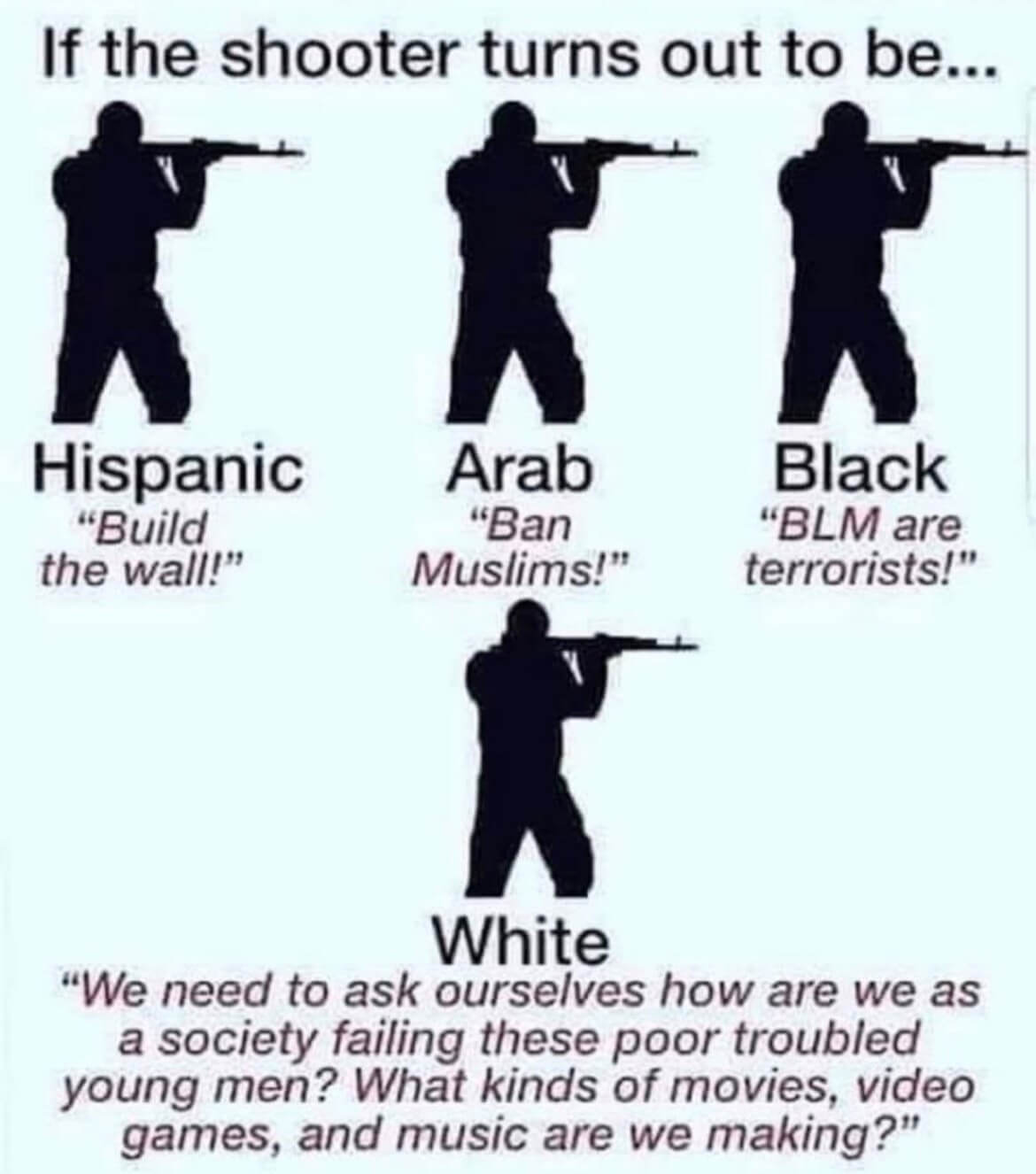

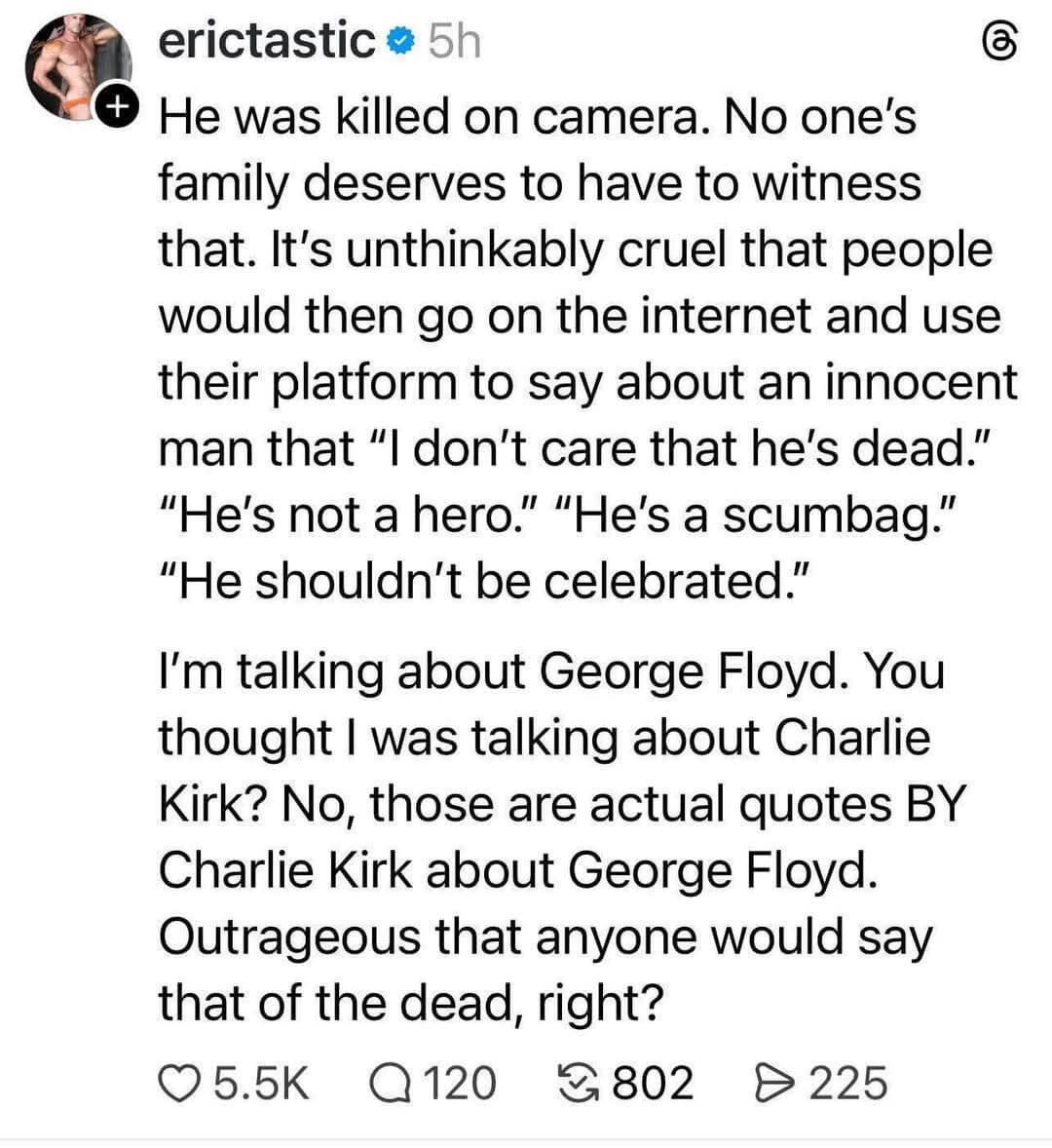

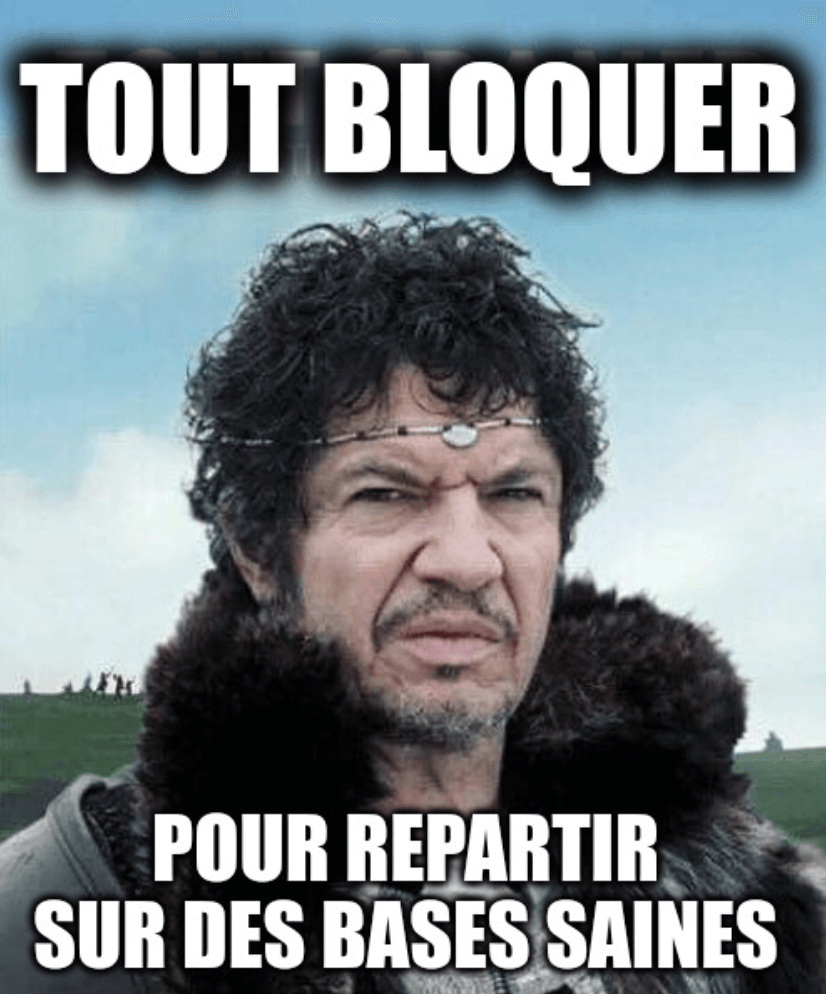

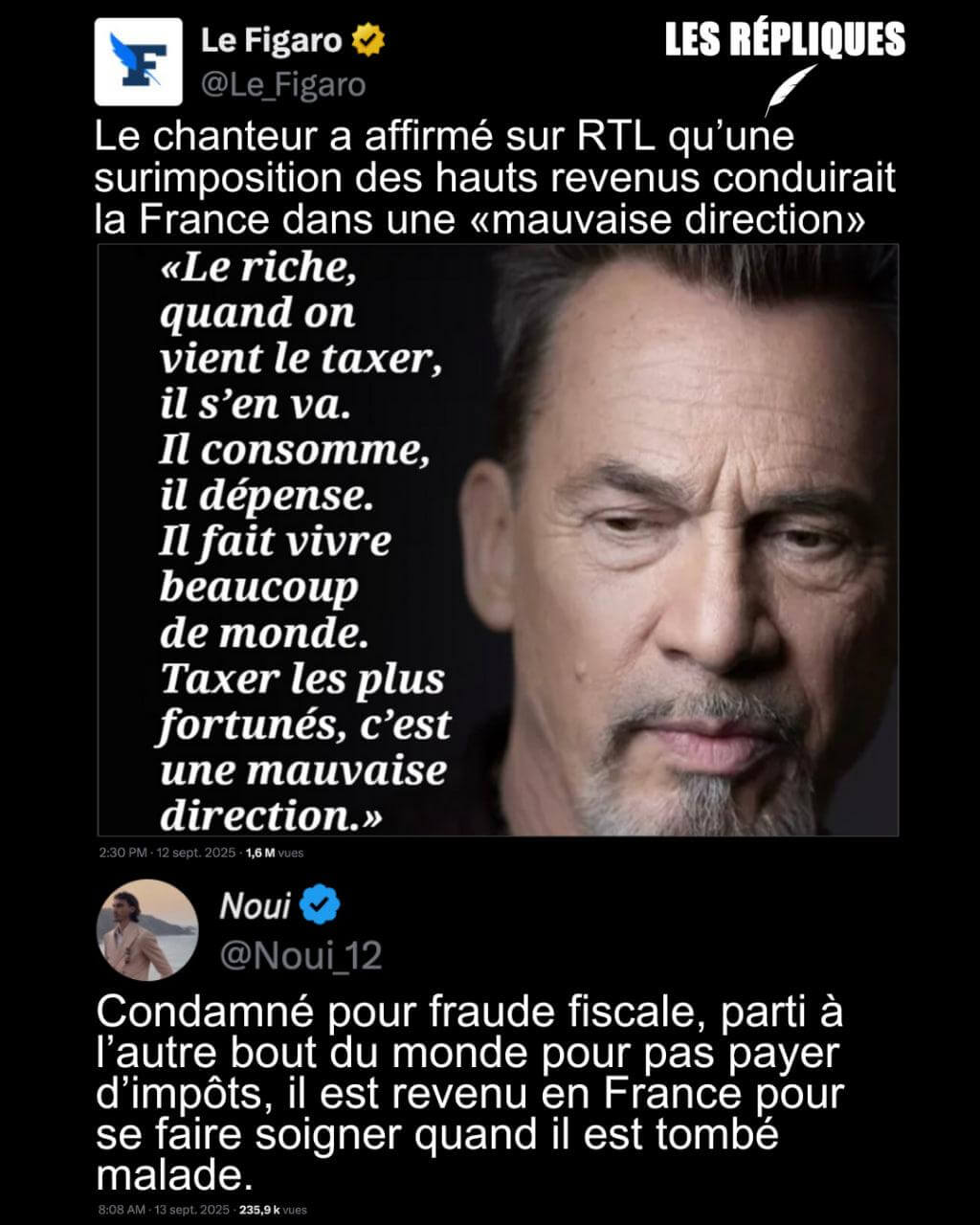

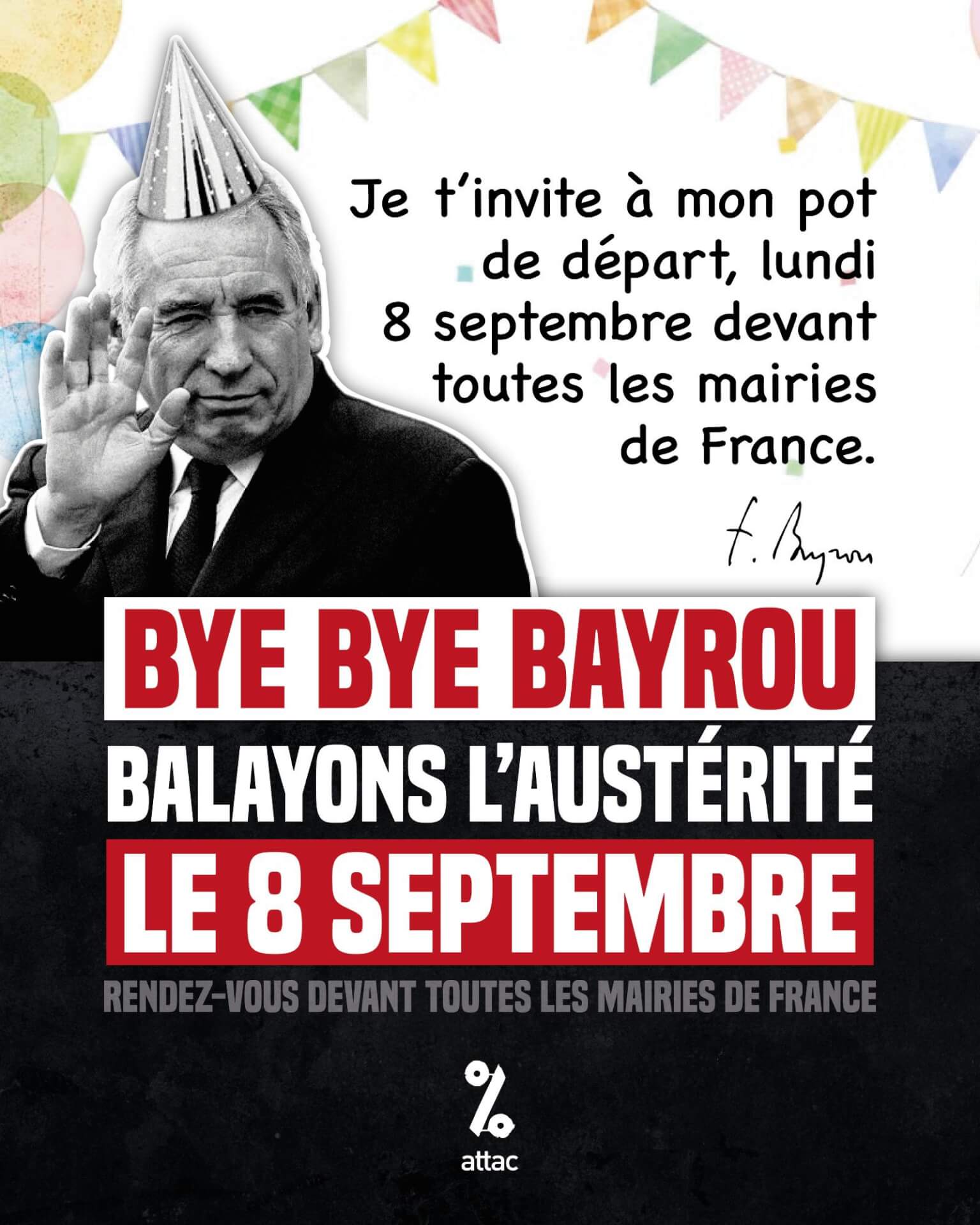

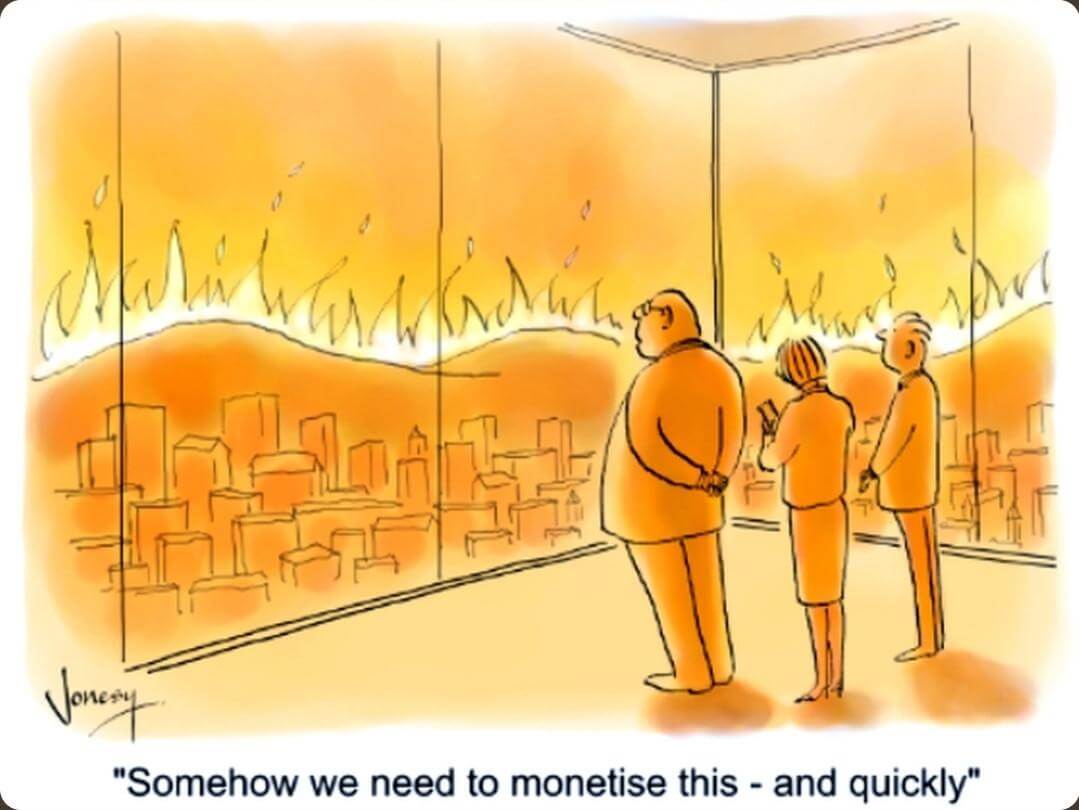

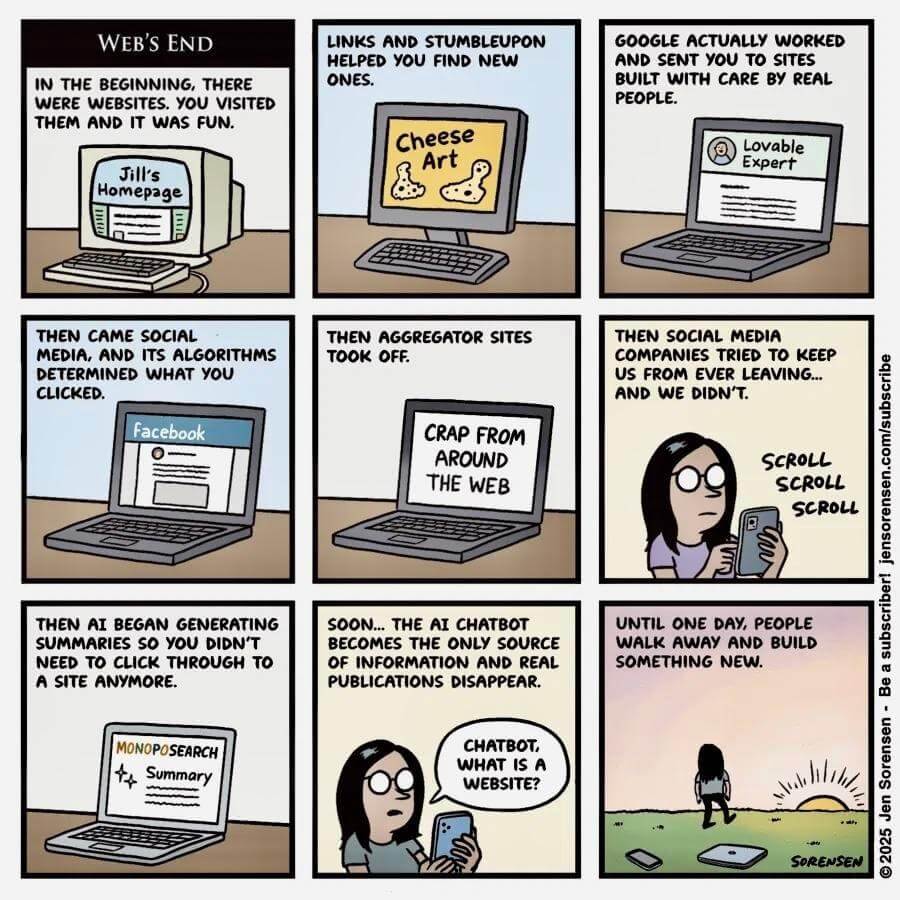

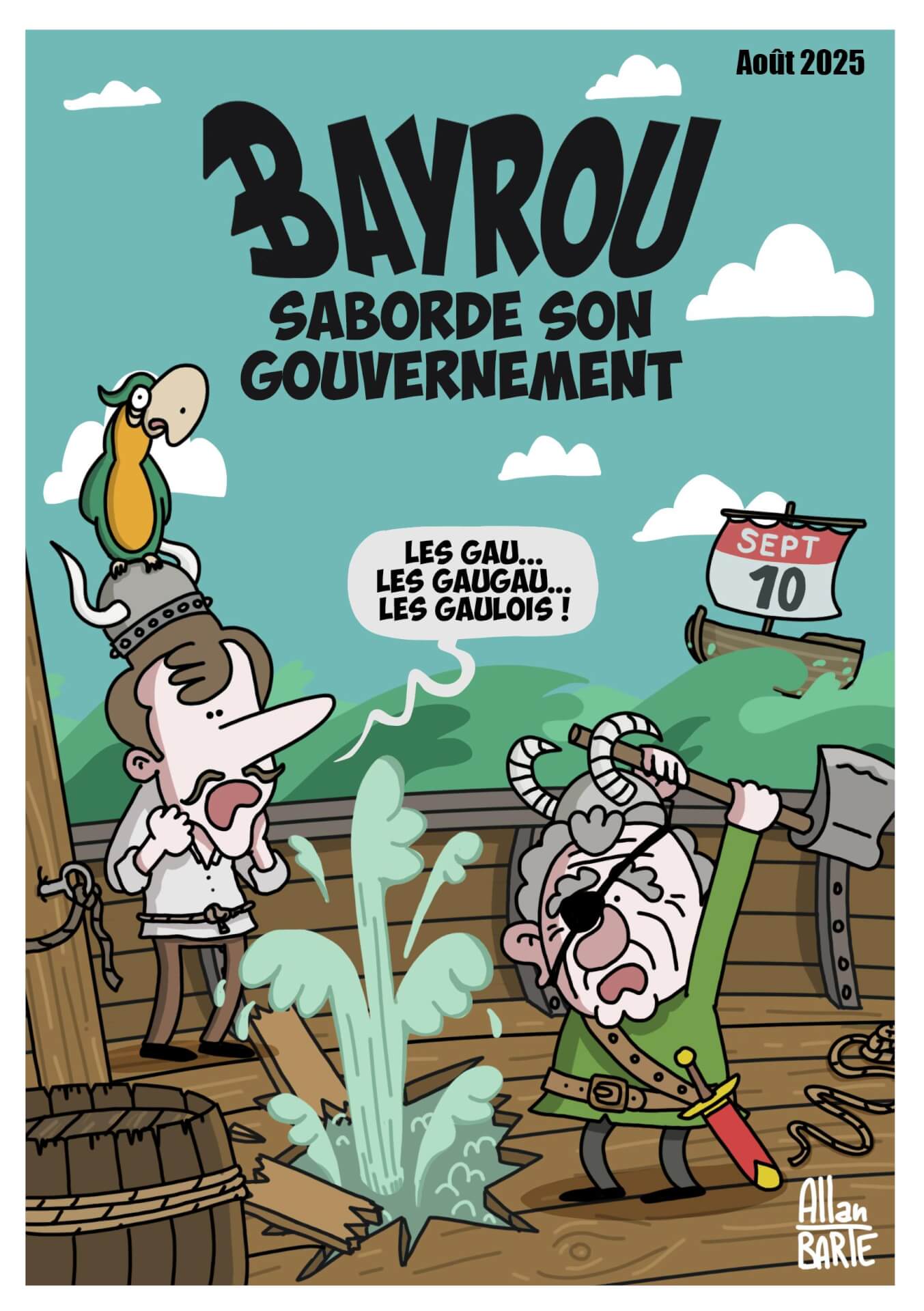

Tous les liens listés ci-dessous sont a priori accessibles librement. Si ce n’est pas le cas, pensez à activer votre bloqueur de javascript favori ou à passer en “mode lecture” (Firefox) ;-) Over two decades, Viettel grew from a state telco into a tech powerhouse that makes everything from 5G chips to robots to affordable mobile phones. In what has come to be known as the “Gen Z protest,” thousands of demonstrators took to the streets and 19 were reportedly killed. Et From Discord to Bitchat, tech at the heart of Nepal protests (france24.com) En Iran, le faible niveau des réserves en eau inquiète. Associé à l’augmentation des températures, provoquant des coupures d’électricité, il annonce une crise énergétique sans précédent, dans un contexte de tensions géopolitiques maximales. La stratégie du « Drill, baby, drill ! » (« Fore, chérie, fore ! »), chère à Donald Trump, contamine les pays concurrents des États-Unis.Dimanche 7 septembre, l’Arabie saoudite, la Russie et six autres membres de l’Organisation des pays exportateurs de pétrole (Opep) ont annoncé une augmentation de leur production, pour répondre à la hausse de production aux États-Unis, au Canada et au Brésil. Sur les 10 pays ayant le plus augmenté la part de l’éolien et du solaire dans leur mix électrique entre 2021 et 2024, 9 sont des membres de l’Union européenne. En Lituanie, la part du renouvelable dans la production totale d’électricité a ainsi bondi de près de 30 points en l’espace de trois ans, passant de 36 à 65 %. Au Parlement européen, les députés RN et leurs alliés ont noué une alliance de fait avec la droite pour saborder les régulations et les objectifs du Pacte vert. Et ne rechignent pas – à rebours de leurs discours en France – à faire les yeux doux aux industriels et aux lobbys patronaux. Therapy practices meant to “cure” homosexuality are set to become punishable by law. A majority in the Tweede Kamer, the lower house of the Dutch parliament, voted in favor of a bill by D66 and the VVD that ensures this. In a debate last week, it became clear that the proposers had, with a few adjustments, persuaded some opponents to reconsider. Relations avec Israël, accord douanier avec Trump… Autant de raisons pour le groupe de Manon Aubry (LFI, groupe The Left à Bruxelles) de déposer une motion de censure. Over 500 of the world’s leading cryptographers, security researchers, and scientists from 34 countries have today delivered a devastating verdict on the EU’s proposed “Chat Control” regulation. Some Canadian politicians and influencers, inspired by an American-born movement, are trying to roll back 2SLGBTQ+ rights in Canada — one book at a time. I left IU because IU President Pamela Whitten’s administration and the IU Board of Trustees, backed by Indiana’s state government and collaborating with ideological organizations, are waging war on IU’s faculty, mistreating IU’s staff and attacking IU’s students if they dare to express views the administrators and politicians do not agree with. Immigrant domestic workers in New York are facing increasing fear of deportation as immigration enforcement intensifies under the new Trump administration. « Nous n’employons pas le profilage racial », affirme le responsable de la politique d’expulsions aux États-Unis. Pourtant, les restrictions qui viennent d’être levées par la Cour suprême – ce dont il se félicite – visaient à éviter les dérives de la police de l’immigration (ICE), telles que le contrôle au faciès. Défenseur du port d’armes à feu et anti-avortement, ce porte-parole du trumpisme pilotait l’un des podcasts les plus écoutés aux États-Unis. L’influence de Charlie Kirk […] avait largement servi Donald Trump pour séduire les jeunes hommes américains en promouvant une conception ultra-traditionnelle de la famille. There is no requirement to take part in this whitewashing campaign, and refusing to join in doesn’t make anyone a bad person. It’s a choice to write an obituary that begins “Joseph Goebbels was a gifted marketer and loving father to six children.” Le patron du géant technologique Oracle a profité d’un énorme coup de pouce boursier ce mercredi pour ravir la première place au patron de X et de Tesla. « Une fois de plus, cette administration tente de dissimuler les données afin de masquer les dommages », a fustigé Julie McNamara, de l’association Union of Concerned Scientists auprès de l’AFP. « Si nous ne pouvons pas dire ce que fait une entreprise, nous ne pouvons pas la tenir pour responsable » « Ils cachent la vérité. Nous ripostons. » Les mots claquent à la une du site Climate.us. Cette plateforme en cours de construction vise à remplacer le site Climate.gov. Un portail anglophone d’information et de vulgarisation sur le changement climatique qui était extrêmement réputé et fréquenté aux États-Unis, avant d’être fermé en juin par le gouvernement de Donald Trump. L’ex-dirigeant d’extrême droite a été reconnu coupable d’avoir été le chef d’une « organisation criminelle » ayant conspiré pour assurer son « maintien autoritaire au pouvoir » malgré sa défaite en 2022. Sa défense va déposer des recours, « y compris au niveau international ». Bill 2630 changed the relationship between tech companies and the far right and revealed the menu of lobbying strategies against regulation Des chercheureuses ont mis à jour un réseau d’ampleur de publication de “faux” articles scientifiques baptisé Tenu.pro qui a réussi à placer plus de 1 500 études “biaisées” dans des revues scientifiques. Innovation in China and Norway makes strides, but in most markets EVs can lose almost half their driving distance when temperatures drop. The surge in the use of disposable face masks during the Covid pandemic has left a chemical timebomb that could harm humans, animals and the environment, research suggests.Billions of tonnes of plastic face masks created to protect people from the spread of the virus are now breaking down, releasing microplastics and chemical additives including endocrine disruptors, the research found. Heart attacks may not just be caused by cholesterol, they could be sparked by hidden bacterial biofilms that awaken after viral infections. This discovery could transform prevention and treatment, even leading to vaccines against heart disease. Heman’s inspiration for his invention came from his childhood in Ethiopia, where he witnessed the dangers of prolonged sun exposure. As countries pursue self-sufficiency in AI, they risk depending on foreign companies, undermining their independence and their goals. C’est une première dans le monde, l’Albanie vient de faire entrer dans son gouvernement un ministre généré par intelligence artificielle. L’annonce en a été faite par le Premier ministre, Edi Rama, qui a présenté l’innovation comme un moyen de lutter contre la corruption. The researchers compared the experience to working with a junior assistant needing careful verification. They warned AI reliance during doctoral training risks students losing opportunities to develop fundamental mathematical skills through mistakes and exploration. Spécialiste en nettoyage de code généré par l’IA est le nouveau titre d’emploi en vogue sur les CV Almost all companies in search are rushing to embed AI answers into search results pages. Google has rolled out AI Overviews. Microsoft has fused Bing with CoPilot. And others are moving quickly in the same direction. The intent is clear. Instead of connecting you to the web, these so-called search engines are keeping you away from it. Il est indéniable que l’IA fait dorénavant partie de notre époque. Faut-il pour autant automatiquement accepter tout ce qui en découle, comme anesthésiés au regard de toutes les facettes du « progrès technologique » ? Il est ainsi bien étrange de la part d’un sociologue de considérer qu’il est des évolutions sociales et technologiques qu’il ne serait pas possible de contester, comme si celles-ci étaient inéluctables et naturelles – en dirait-on tout autant des inégalités de genres, de races ou de classes ? Les bombardements de l’aviation israélienne ce mardi 9 septembre à Doha sont une première. Ces dernières années, des frappes israéliennes ont tué des responsables du Hamas palestinien dans plusieurs pays de la région. Cette fois, c’est sur le sol du Qatar, monarchie du golfe Persique qui héberge de longue date les dirigeants du Hamas en exil tout en œuvrant à la médiation avec Israël. Le jeudi 28 août, à la suite de multiples menaces proférées ces derniers mois, une frappe aérienne israélienne décime le gouvernement nommé par les houthistes à Sanaa. Au moins douze dignitaires sont assassinés, notamment le premier ministre, Ahmed Al-Rahawi, le ministre des affaires étrangères, Jamal Ahmed Amer, et huit autres ministres. Le ministre de la défense, Mohammed Al-Atifi, est également annoncé comme blessé. Après une fusillade meurtrière dans Jérusalem-Est occupée, Israël ordonne la démolition des maisons des suspects en Cisjordanie occupée et la révocation des permis de travail de leurs voisins. « Vous avez été prévenus, partez maintenant ! », a déclaré le Premier ministre israélien, affirmant que l’intensification des opérations à Gaza-ville n’en était qu’à leur « début ». Benyamin Netanyahou a ouvertement assumé, jeudi 11 septembre, sa volonté d’annexer la Palestine, lors d’une cérémonie de signature d’un important projet de colonisation en Cisjordanie occupée Un bateau de la « Global Sumud Flotilla » a été la cible d’une « attaque de drone », affirment les militant·es qui se dirigent vers l’enclave palestinienne. La présence de l’État hébreu est contestée alors que l’offensive à Gaza se poursuit, faisant des dizaines de milliers de morts. L’absence de statistiques fiables et de stratégie cohérente pour lutter contre les féminicides au Kenya a laissé place à une culture d’insécurité quotidienne pour les femmes dans le pays. En Autriche, trois sœurs octogénaires se sont évadées d’un Ehpad et ont regagné le couvent qu’elles occupaient pendant quelques années près de Salzbourg. Les religieuses ont reçu l’aide d’anciens élèves du pensionnat et de villageois sensibilisés à leur cause. Le président américain avait démenti l’existence de cette lettre en juillet, en pleine polémique sur ses liens avec le délinquant sexuel. Une cour d’appel de New York confirme la condamnation du président des États-Unis à verser plus de 80 millions de dollars à l’autrice pour diffamation. This highlights the importance of exercise as a treatment with promising anti-cancer effects. Le fonds souverain norvégien a décidé vendredi d’exclure le groupe minier français Eramet de son portefeuille, invoquant des risques de violations des droits des populations autochtones et des dommages environnementaux liés aux activités d’une mine de nickel en Indonésie. Un rapporteur de l’ONU qui prend la plume pour défendre une petite association du Poitou, voilà un soutien que les adeptes de l’agro-industrie n’ont sûrement pas vu venir. L’Association de protection d’information et d’étude de l’eau et de son environnement (Apieee) pourrait ainsi être reconnue victime de discriminations en infraction avec le droit international. L’agence de notation sanctionne l’instabilité politique et le déficit budgétaire, en faisant passer la note française de AA- à A +. Le premier ministre a perdu très logiquement le vote de confiance qu’il avait lui-même sollicité. Il tombe après s’être défendu sans conviction devant une Assemblée nationale qui pensait déjà à la suite. Voir aussi Vote de confiance : “le score est inattendu”, vos députés ont-ils voté la chute de François Bayrou ? (france3-regions.franceinfo.fr) et Chute du gouvernement Bayrou : ce qu’ont voté les députés, groupe par groupe (lemonde.fr) De plus en plus de villes touristiques interdisent la construction de résidences secondaires. Le coût environnemental de nos vêtements pourra être affiché de façon claire et lisible dès le 1er octobre. Le décret a été publié au Journal Officiel le 9 septembre, après le feu vert de la Commission européenne en mai et l’aval du Conseil d’Etat.[…] Comme le nutriscore, il reste pour le moment facultatif. À condition que “l’arrêt-maladie soit notifié par le salarié à son employeur”, le travailleur peut demander un tel report “puisque la maladie l’empêche de se reposer”, selon la Cour de cassation. Face à la réglementation européenne, la Confédération des petites et moyennes entreprises demande au nouveau Premier ministre de prendre des mesures afin d’éviter une situation critique pour les employeurs. Alors que le retour du train de nuit est plébicité en France, les personnes à mobilités réduites regrettent d’en être exclus. Avec un fauteuil roulant, impossible de monter dans l’un des wagons qui permet de voyager de dormir en voyageant. Gisèle Pelicot publiera ses mémoires en février 2026 sous le titre “Et la joie de vivre” aux éditions Flammarion, qui précisent qu’elle racontera “son histoire avec ses propres mots”. « D’un côté, ma plainte contre lui se heurte à la prescription. De l’autre, pour sa plainte contre moi, la justice ne perd pas de temps », affirme-t-elle sur Instagram, avant de lancer : « À votre avis, ça encouragera les victimes à dénoncer les violences qu’elles ont subies, ou ça les dissuadera ? ». Voir aussi Judith Godrèche dit son incompréhension après sa mise en examen pour diffamation envers Jacques Doillon (telerama.fr) Si cette mise en examen résulte d’une procédure automatique, comme dans toute affaire de diffamation, la comédienne s’est émue ce mercredi, sur Instagram, que ce mécanisme judiciaire puisse dissuader les victimes de témoigner. “Elle a toujours donné toute sa vie pour l’associatif. Elle faisait partie d’une association qui s’appelle Buddy System, c’est là qu’elle a rencontré ce monsieur. Elle donnait des cours de français, elle aidait à l’insertion, pour les papiers… Vraiment, elle se donnait corps et âme pour ces associations” […] “Dès qu’il faisait quelque chose, dans la foulée, elle portait plainte. Entre le 10 juillet et le 28 août 2025, elle a déposé 6 plaintes pour viol et agression, pour violence physique, pour harcèlement, menaces de mort, dégradations… Elle était quasiment toutes les semaines au commissariat pour déposer plainte” […] Il l’a pistée samedi 6 septembre toute l’après-midi. Elle a eu peur et s’est réfugié dans les magasins. Là, elle a pu appeler les secours. La police est venue et ont embarqué l’homme, mais trente minutes après elle l’a recroisé dans la rue, il était déjà sorti ! Les journalistes du Parisien ont écrit une lettre ouverte à Bernard Arnault, propriétaire du journal depuis 2015, l’appelant à « renoncer » à une possible vente du quotidien à Vincent Bolloré. Durant l’été, le milliardaire Pierre-Édouard Stérin a créé une holding baptisée du nom du journaliste qui a révélé l’existence du projet Périclès, Thomas Lemahieu, où il a placé l’essentiel de sa fortune. Provocation, étalage de son sentiment d’impunité, ou hommage du vice à la vertu ? Son arrivée à Matignon révèle qu’Emmanuel Macron manque décidément d’oxygène. Face à la crise, il se recroqueville dans un espace politique qui, chaque jour, ressemble de plus en plus à une cabine téléphonique. Terrifié par l’approche du 10 septembre, Bayrou a préféré se suicider politiquement. Sa longue et pitoyable carrière politique se termine donc, comme il en avait toujours rêvé, par une entrée dans l’Histoire : il est le premier Premier ministre de la Ve République à perdre son vote de confiance. Entre 2020 et 2022, le nouveau premier ministre était chargé du portefeuille des territoires ultramarins. Son passage rue Oudinot a nourri griefs et amertumes, notamment en Kanaky-Nouvelle-Calédonie. La Stratégie nationale pour l’alimentation a été bloquée par les services du Premier ministre juste avant le vote de confiance de ce lundi. Sa publication était pourtant prête, après des mois de négociations. Même sans dissolution de l’Assemblée nationale, la chute du gouvernement Bayrou a des conséquences sur certains textes législatifs, sur le plan calendaire mais pas uniquement. Des manifestants ont scandé « bravo la police ! », selon des images filmées par l’AFP, et ont accusé les forces de l’ordre d’avoir lancé une grenade de gaz lacrymogène en direction du restaurant après une charge policière. La députée du NFP Danielle Simonnet a été sortie d’un café ce mercredi 10 septembre à Paris, après s’y être réfugiée dans le cadre des mobilisations. Pour avoir participé à une action en 2023 qui visait à dénoncer l’implication de la BNP Paribas dans l’énergie fossile, plusieurs militant·es d’Extinction Rebellion passent en procès ce vendredi 12 septembre. Une procédure judiciaire qui s’inscrit dans une vague de répression toujours plus importante. Le 24 novembre 2018, lors de l’acte II des gilets jaunes à Paris, Gabriel Pontonnier a été grièvement blessé à la main par l’explosion d’une grenade GLI-F4. Près de sept ans après les faits, le procès du policier qui a lancé la grenade s’ouvrira le 11 septembre 2025. Alors que l’extrême droite radicale a vécu comme un traumatisme son expulsion du mouvement des Gilets jaunes, ils ont été peu visibles lors du 10 septembre. À Paris, Némésis a fait un de leurs habituels happenings. À Lyon, des lycéen·nes ont été attaqué·es. La PJJ avait signalé récemment son cas au comité de prévention de radicalisation de la préfecture, à cause de signes de radicalisation et de sa fascination pour les tueries de masse et l’extrême droite. […] L’adolescent avait déjà été mis en examen et placé en détention en avril 2024 pour “participation à une association de malfaiteurs en vue de la préparation d’un crime, en l’espèce des assassinats, et d’apologie publique de crime ou délit” La peine prononcée par la cour criminelle des Bouches-du-Rhône est assortie d’une période de sûreté de dix ans, d’un suivi sociojudiciaire de dix ans avec obligation de soins et d’une interdiction d’exercer en tant que policier ou de faire tout métier ou action bénévole au contact de mineurs. “J’ai fait ça parce qu’il était en train de se passer dans le pays quelque chose dont j’ai conclu que ce mouvement m’empêcherait à coup sûr de conduire la politique nécessaire pour le pays”. Voici la “vérité” que l’éphémère premier ministre François Bayrou est venu apporter aux journalistes de l’émission C à vous le samedi 6 septembre. À Paris, Lyon, Marseille ou encore Rennes, des centaines de manifestant·es ont festoyé dans les rues après l’annonce de la chute du gouvernement. « Bloquons tout ». Ce mot d’ordre lancé pour le 10 septembre a rassemblé 175 000 participants pour 812 actions partout en France, selon le ministère de l’Intérieur. La CGT évoque de son côté 250 000 personnes pour 200 rassemblements et manifestations. Les Dévalideuses soutiennent la mobilisation sociale de septembre 2025 (grèves, manifestations, actions locales) contre la cure d’austérité en cours et annoncée. La société que l’on nous dessine est toujours plus violente, toujours plus à la charge des plus vulnérables. La destruction des services publics crée des classes segmentées dans la société. Non, la police n’est pas l’alliée des personnes LGBT et, non, la Justice ne peut rien lorsqu’un flic a décidé de « casser du pédé ». Ici, comme en Hongrie ou ailleurs, nous devrons nous battre en connaissance de ce fait. Refusant de persévérer dans l’illusion d’une procédure utile et équitable, je retire ma plainte. Décryptage du débat sur la dette, entre comparaison erronée avec l’endettement des ménages, discours fallacieux sur l’ardoise laissée aux générations futures et dépenses publiques rendues injustement responsables du déficit. Le gouvernement Bayrou est tombé avec son budget. La taxation des ultrariches, à laquelle il se refusait, va immanquablement être portée par la gauche et revenir dans le débat. En quoi consisterait-elle ? Les transferts de la Sécurité sociale sont purement assimilés à des versements de l’État, en contradiction totale avec l’esprit de la Sécu voulue par Laroque et Croizat. […] une bonne part du « pognon de dingue » d’Emmanuel Macron est notre pognon et nous ne serions des dingues que si nous renoncions à le voir reconnaître comme tel. Dans un essai dessiné, Blanche Sabbah analyse la progression des idées réactionnaires dans les médias. Loin de souscrire à la thèse de la fatalité, l’autrice invite la gauche à réinvestir le champ des idées. The former head of security for WhatsApp filed a lawsuit on Monday accusing Meta of ignoring major security and privacy flaws that put billions of the messaging app’s users at risk, the latest in a string of whistle-blower allegations against the social media giant. The Anacé Indigenous community is going to court to stop a planned TikTok data center they say is being built on their land. l’augmentation de la part de personnes qui ne croient pas à un réchauffement climatique d’origine humaine (+5 % entre 2019 et 2023) s’est accompagnée « d’une [hausse] très significative de l’activisme climatosceptique sur Twitter/X depuis l’été 2022, et d’une hostilité accrue envers les climatologues ». Entre 2019 et 2023, la France est même le pays où le nombre de personnes qui nient le consensus scientifique sur le climat a le plus augmenté (de 63 % à 71 %) parmi les 30 États étudiés sur les cinq continents. La « naissance » du consommateur a servi à deux choses : écouler le surplus de marchandises produites par le capitalisme, et réintégrer les gens dans les rapports marchands sur leur temps de loisir, fraîchement arraché par des luttes sociales […] la « consommation » a étendu le travail sur le temps de loisir, de sorte que nous continuons à travailler au bon fonctionnement de l’économie une fois sorti du bureau ou de l’usine. Marion et Sarah, toutes deux mères isolées, dévoilent, à partir de leur expérience, un vaste système de surveillance et de contrôle des plus précaires. Arrêter le sexe avec les hommes, ce n’est pas juste arrêter le coït, c’est arrêter tout ce que cela implique d’être une femme et de constamment lutter pour rester désirable. C’est un boulot à temps plein que d’être un sexe à convoiter LSD plonge dans l’infiniment petit. Si le mot “infini” nous stoppe dans un vertige, du plus profond de nous aux confins de l’espace, quelque chose se touche. Dans la lignée d’une politique municipale faisant la part belle à la sobriété et à la souveraineté, la DSI de la ville de Lyon déploie une stratégie visant à renforcer son indépendance. Avec un projet phare : le remplacement de Microsoft Office sur 80 % des postes d’ici mars 2026. La Linux Foundation Europe souligne les atouts de l’Open Source pour un continent cherchant à gagner en indépendance par rapport à la technologie américaine. À condition toutefois d’investir pour ne plus seulement être des consommateurs passifs de logiciels libres. Retrouvez les revues de web précédentes dans la catégorie Libre Veille du Framablog. Les articles, commentaires et autres images qui composent ces « Khrys’presso » n’engagent que moi (Khrys). Texte intégral 9469 mots

Brave New World

Spécial IA

Spécial Palestine et Israël

Spécial femmes dans le monde

Spécial France

Spécial femmes en France

Spécial médias et pouvoir

Spécial emmerdeurs irresponsables gérant comme des pieds (et à la néolibérale)

Spécial recul des droits et libertés, violences policières, montée de l’extrême-droite…

Spécial résistances

Spécial outils de résistance

Spécial GAFAM et cie

Les autres lectures de la semaine

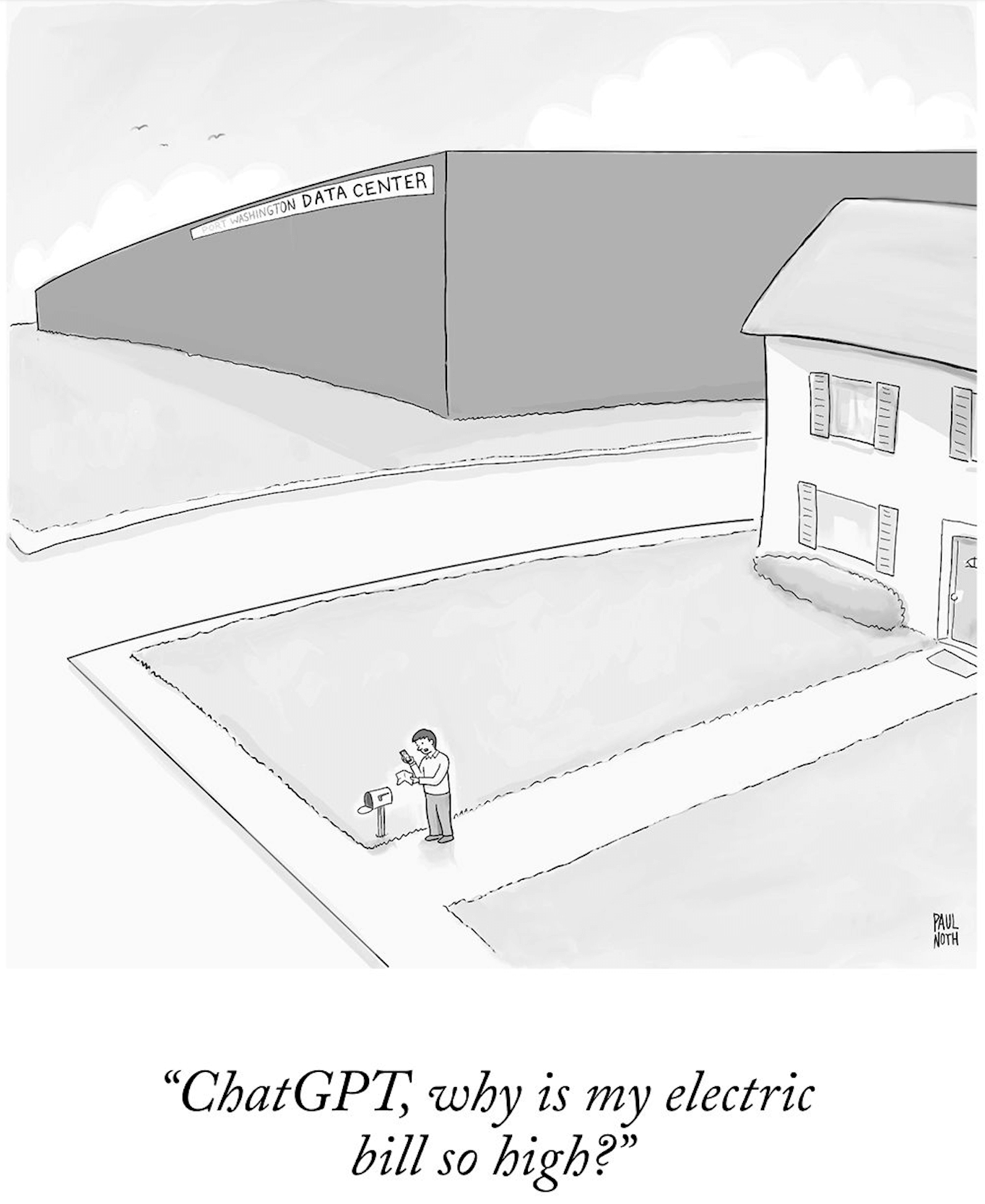

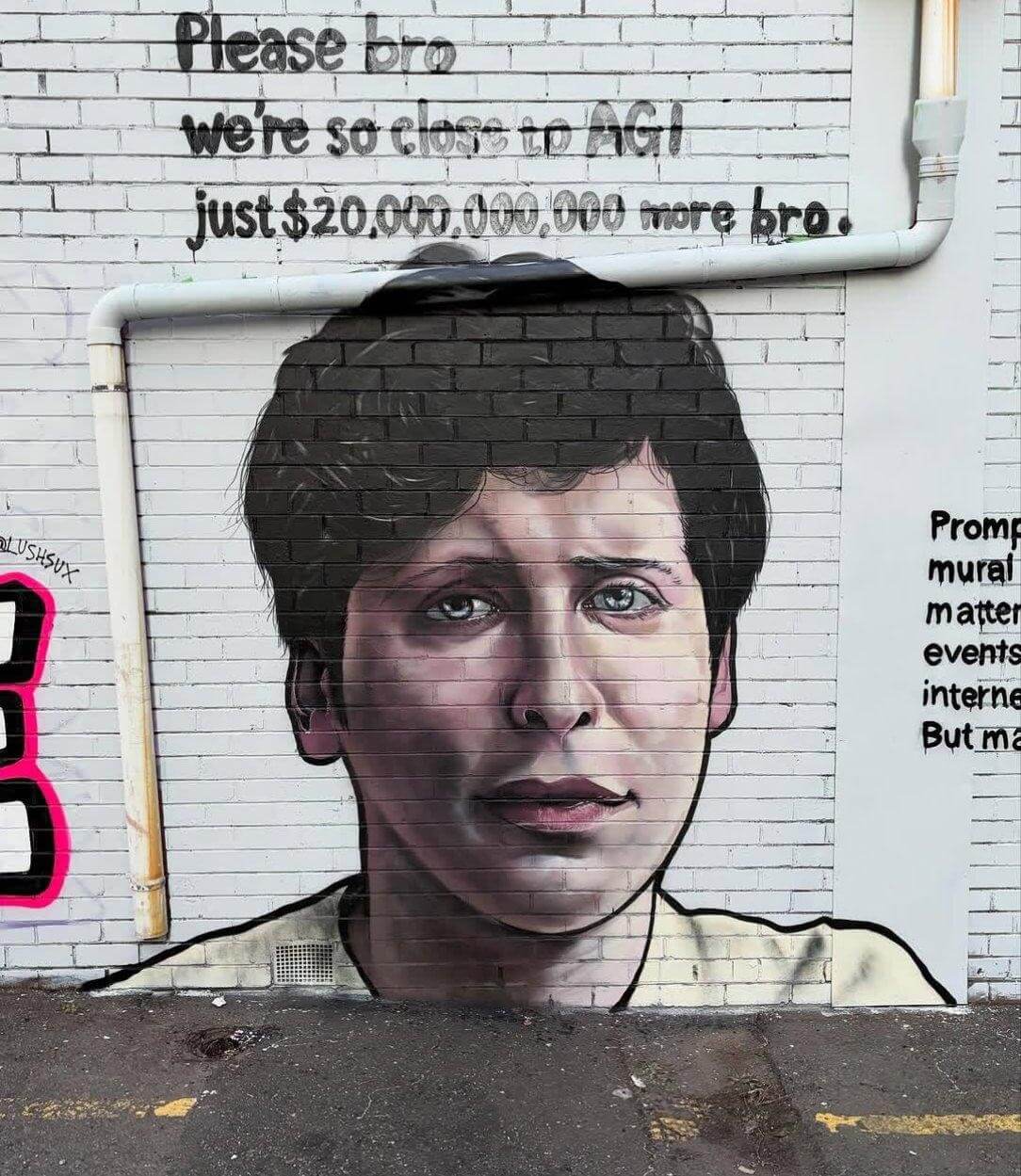

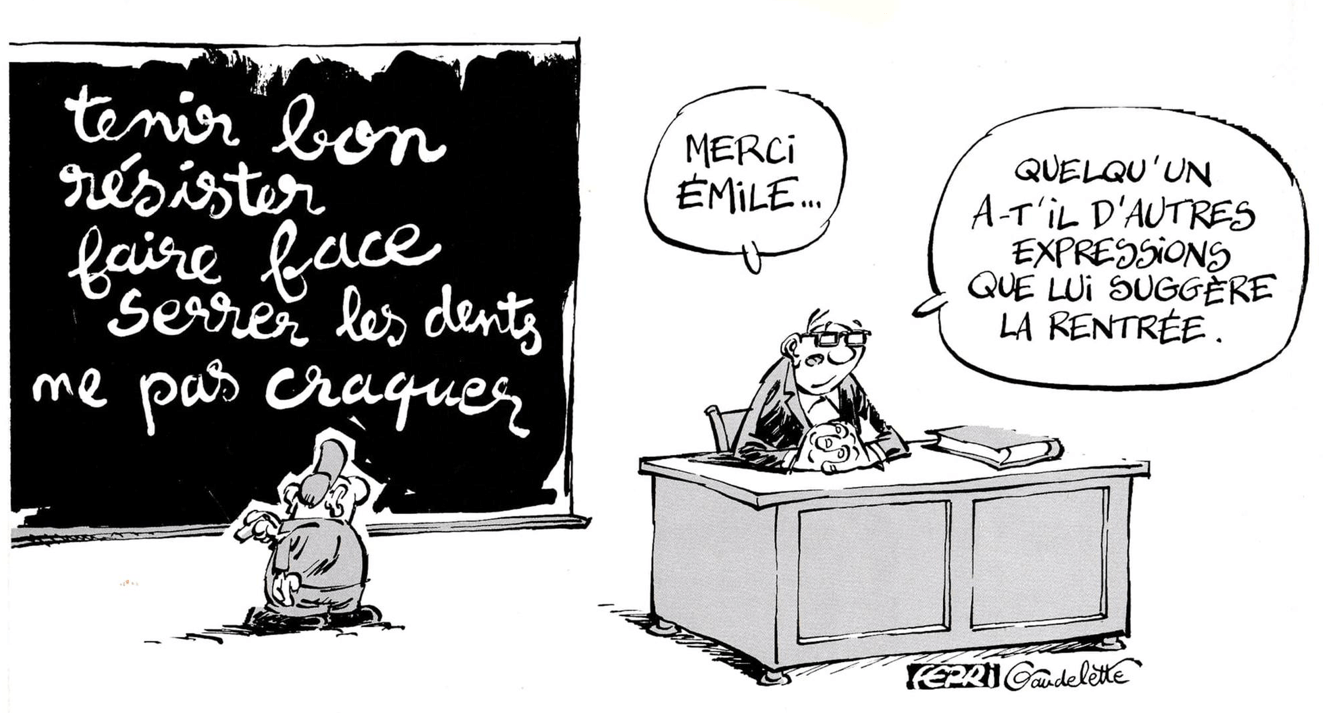

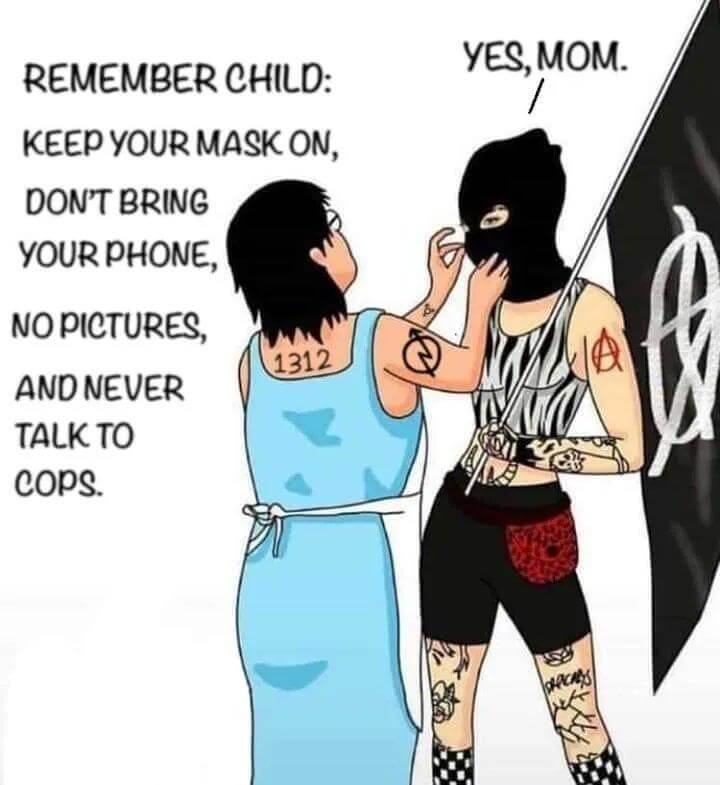

Les BDs/graphiques/photos de la semaine

Les vidéos/podcasts de la semaine

Les trucs chouettes de la semaine

08.09.2025 à 07:42

Khrys’presso du lundi 8 septembre 2025

Comme chaque lundi, un coup d’œil dans le rétroviseur pour découvrir les informations que vous avez peut-être ratées la semaine dernière.

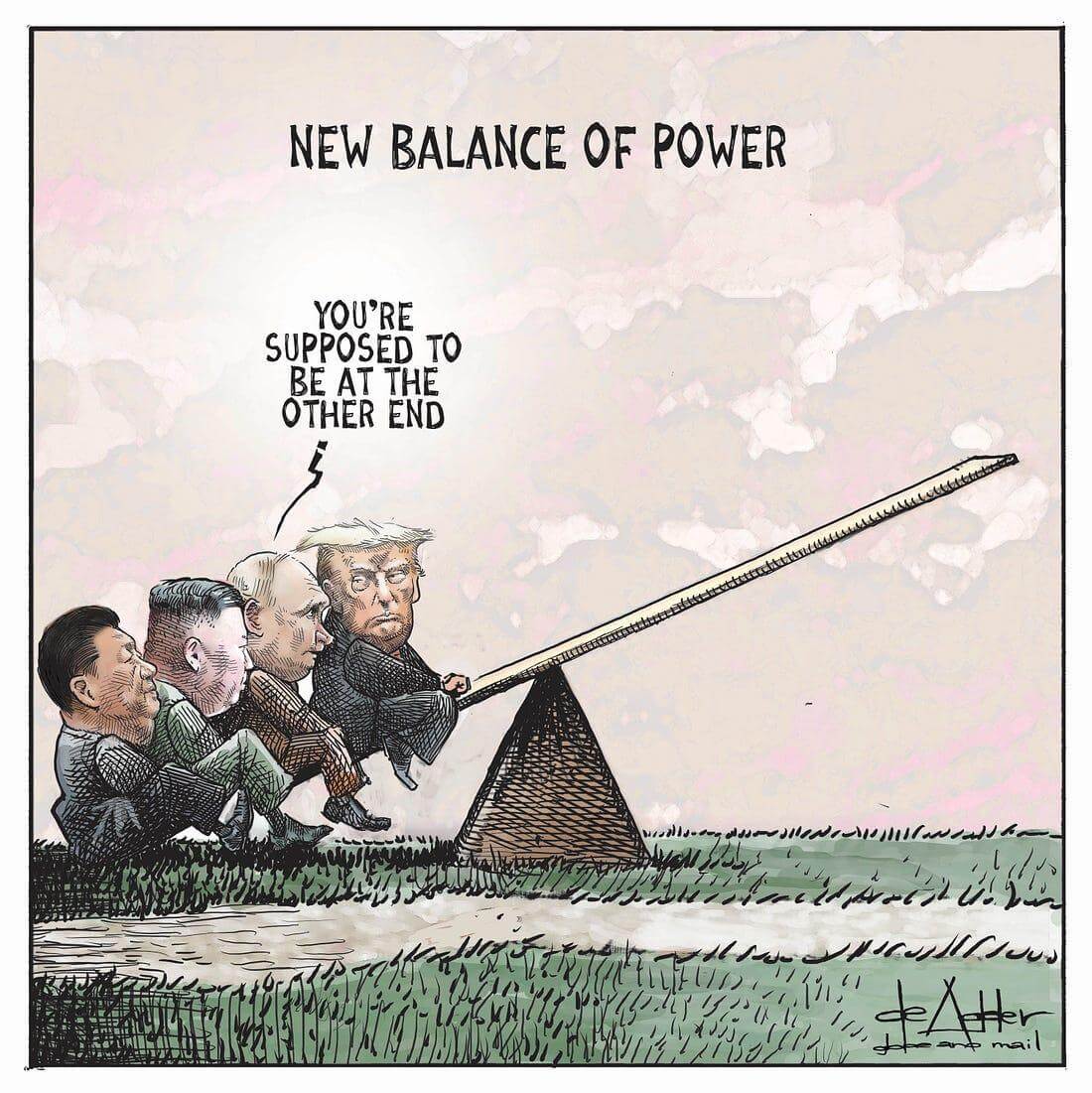

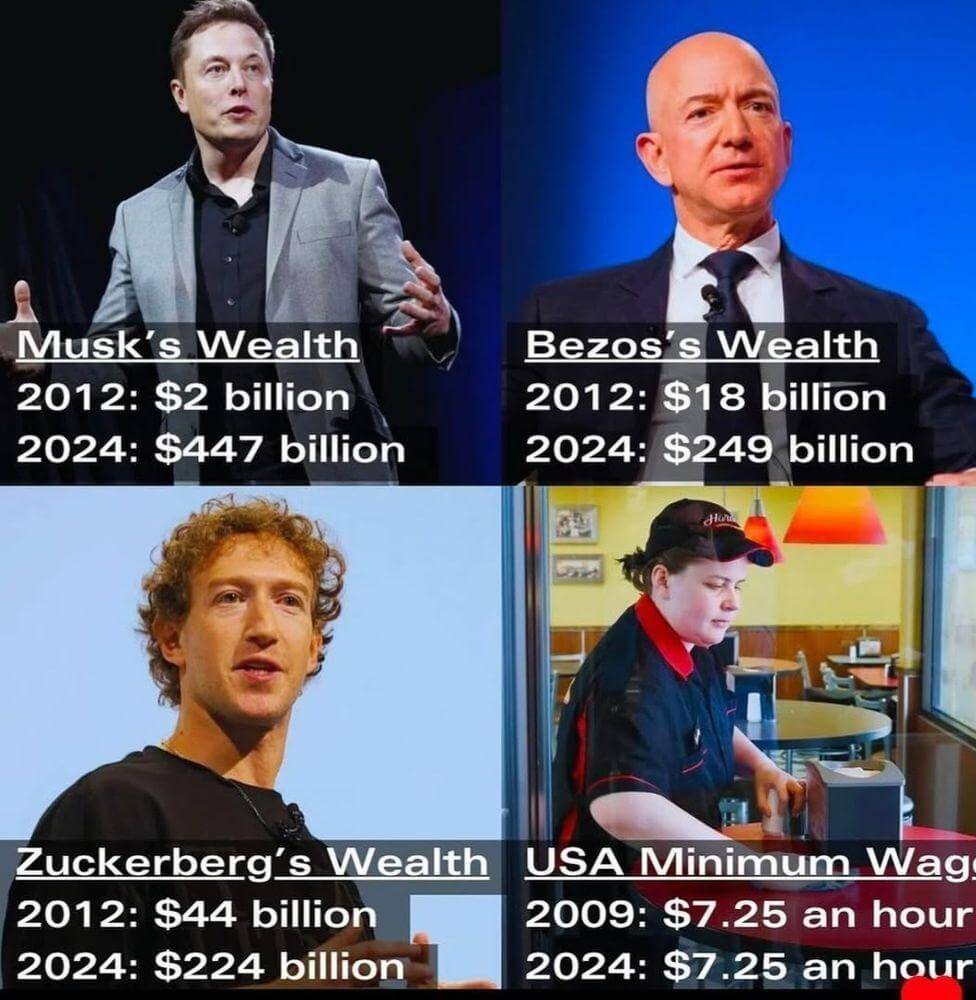

Tous les liens listés ci-dessous sont a priori accessibles librement. Si ce n’est pas le cas, pensez à activer votre bloqueur de javascript favori ou à passer en “mode lecture” (Firefox) ;-) La Chine est en train de redessiner la carte de l’Asie. Face à Trump et à l’Europe, elle appelle à « réformer l’ONU ». Les dirigeants chinois et russe, tous deux âgés de 72 ans, sont à la tête de leur pays depuis respectivement environ 12 et 20 ans, cumulés. Aucun n’a manifesté son intention de quitter le pouvoir ou signaler un potentiel successeur politique. Avec 700 millions de caméras de surveillance, la Chine compte près d’une caméra pour deux habitant·es. En plus de subvenir aux besoins de leur marché domestique, les entreprises chinoises spécialisées dans la sécurité dominent le marché global, et équipent désormais des sites sensibles dans plusieurs pays européens. Tapping investor interest and ex-Nvidia talent, China’s AI chipmakers are seizing openings created by U.S. export controls. Le visuel a été rapidement supprimé par l’entreprise chinoise de fast-fashion. Difficile de savoir qui en est à l’origine. La mort d’Affan Kurniawan, jeune chauffeur de moto-taxi écrasé le 28 août par un véhicule de police, lors d’une manifestation à Jakarta, a enflammé la contestation déjà virulente en Indonésie. Dans la rue comme sur les réseaux sociaux, la colère vise une institution policière, accusée de corruption et de violence, qui apparaît comme un outil destiné à protéger les élites plutôt que les simples citoyen·nes. Thirteen minutes before midnight on August 31, 2025, a magnitude 6 earthquake struck northeastern Afghanistan. Damage to nearby villages was severe, and many houses collapsed into piles of debris that trapped sleeping residents. News reports indicate that more than 800 people have been killed, a number that is expected to rise. Making matters worse, the earthquake triggered landslides that blocked roads, hindering rescue efforts. L’éboulement, qui a eu lieu dimanche, a frappé le village de Tarasin et « a complètement détruit » la zone située dans le djebel Marra, d’après un groupe armé contrôlant la région. Burkina Faso’s unelected transitional parliament has passed a bill banning homosexual acts, a little over a year after a draft of an amended family code that criminalised homosexuality was adopted by the country’s cabinet. Le Département fédéral de la défense renonce ainsi à trois fonctionnalités initialement garanties par le fabricant. Les drones ne sont pas équipés du système d’évitement automatique, du système de dégivrage, ni du système de décollage et d’atterrissage indépendant du GPS. Concrètement, les drones voleront accompagnés d’une escorte dans l’espace aérien non contrôlé. Et ce jusqu’à 3000 mètres d’altitude au-dessus du Plateau et jusqu’à 4000 mètres au-dessus des régions alpines. Ils pourront naviguer sans restriction dans l’espace aérien contrôlé. La nuit, les drones pourront être utilisés partout sans escorte. L’un des funiculaires emblématiques de Lisbonne a déraillé et s’est encastré dans un immeuble au bas d’une pente, ce mercredi 3 septembre au soir, dans un quartier très touristique du centre-ville. L’accident a fait au moins quinze morts et une dizaine de blessés, dont une Française, d’après le premier bilan provisoire des autorités. Un nouveau traitement préventif contre le VIH, le Yeytuo, est autorisé depuis fin août par la Commission européenne. Pour les personnes qui ne sont pas infectées mais exposées, le médicament est efficace à plus de 99 % contre le développement de la maladie. Le laboratoire a promis deux millions de doses génériques à prix coûtant pour une centaine de pays en développement. Jeremy Corbyn et Zarah Sultana ont annoncé cet été la création d’un nouveau parti de gauche, qui a suscité immédiatement un énorme enthousiasme parmi toutes celles et ceux qui, en Grande-Bretagne, aspirent à une rupture avec le statu quo néolibéral, impérialiste et raciste. L’accord sur les droits de douane conclu cet été entre l’Europe et les États-Unis remet en cause les mesures environnementales mises en place par l’UE ces dernières années, alerte Stéphanie Kpenou, de l’Institut Veblen. Un contrat de deux millions de dollars a été conclu entre l’ICE […] et Paragon, éditeur sulfureux de logiciels espions ultraperfectionnés. Le bras armé de la politique antimigrants de Donald Trump aura ainsi accès à des outils similaires au célèbre Pegasus, logiciel au cœur d’un scandale impliquant la surveillance par onze États de journalistes et d’opposant·es politiques. Le président des États-Unis va signer un décret pour changer le nom du « ministère de la Défense » en « ministère de la Guerre », qui existait jusqu’en 1947. Le gratin de la tech continue de courtiser le président américain, prêt à tout pour échapper aux régulations et obtenir la protection du républicain. Louisiana Senator John Kennedy, a Republican, compared radioactive shrimp to the deadly extraterrestrial creatures from the Alien film franchise. His remarks came during a Senate hearing on water contamination, where he suggested that consuming tainted seafood could leave people resembling a Xenomorph. The city’s $14 billion flood system faces new threats from climate change, land subsidence, and Trump budget cuts. Former UN anti-drugs agency director Pino Arlacchi dismantles the Venezuela “narco-state” narrative with 30 years of reliable data. Quelle que soit la sentence – qui devrait tomber d’ici au 12 septembre –, ce procès est déjà historique. Jamais auparavant, les auteurs de putsch contre l’ordre démocratique et institutionnel n’avaient été traduits en justice. Pas même les dignitaires de la dictature militaire. Affaibli par le dérèglement climatique, l’AMOC aurait bien plus de chances de s’arrêter que prévu, avertit une nouvelle étude. Un événement littéralement glaçant puisqu’il pourrait faire chuter les températures en Europe jusqu’à –30 °C. L’Europe a inauguré vendredi son premier ordinateur géant et ultra-rapide nommé Jupiter, conçu par le groupe français Atos. Doté d’un budget de 500 millions d’euros partagé entre l’UE et Berlin, il vise à rattraper le retard pour l’entraînement de modèles d’“IA” et à soutenir la recherche scientifique, notamment sur le climat. A single AI data center could consume 5 million gallons of water daily. New Jersey wants to make them report water consumption. Yes, of course, we can try to fend them off with logins, paywalls, CAPTCHA challenges, and sophisticated anti-bot technologies. You know one thing AI is good at ? It’s getting around those walls.As for robots.txt files, the old-school way of blocking crawlers ? Many – most ? – AI crawlers simply ignore them. Anthropic agreed to pay $1.5 billion and destroy all copies of the books the AI company pirated to train its artificial intelligence models. Voir aussi La start-up américaine d’intelligence artificielle Anthropic va verser 1,5 milliard de dollars pour avoir téléchargé illégalement des millions de livres (franceinfo.fr) Cette transaction permet à Anthropic d’éviter un procès, qui devait démarrer début décembre pour déterminer le montant des dommages et intérêts. La start-up risquait d’être condamnée à débourser une somme bien supérieure à celle décidée avec les détenteurs de droit, au point de mettre en péril son existence même. In the age of automation, human workers are being brought in to fix what artificial intelligence gets wrong. As artificial intelligence platforms flood the internet with “sloppy” output, a growing number of human workers are being called upon to fix AI’s errors, from clunky code to cringe-worthy art. Once viewed as targets for automation, creative professionals and freelancers now find their livelihoods unexpectedly dependent on cleaning up after the very machines once poised to replace them. This emerging economy reveals not only the limits of current AI, but also the hidden labour underpinning the polished digital Behind Every “Smart” AI Tool Lies a Human Cleaning Up Its Chaos, products we take for granted. The reason we have a programming language is because we need to be unambiguous. But right now, we’re trying to adjust the prompt [in a way] that the tool will be able to understand. We’re adapting to the tool, so instead of the tool serving us, we’re serving the tool. And it is sometimes more work than just writing the code. La sortie ratée de ChatGPT-5 pointe les limites de l’IA générative, qui serait devenue une bulle financière, selon la propre admission du PDG d’OpenAI. La flatterie excessive des chatbots cache un dangereux engrenage, allant de l’addiction jusqu’à la « psychose » – et pour certaines entreprises, c’est une aubaine. Ce 6 septembre, les habitants de la cité se sont vu imposer un énième ordre d’évacuation par Israël. Tel-Aviv tente de percer ce qu’elle présente comme la dernière poche de résistance du Hamas au moment où des négociations sont menées entre l’organisation islamiste et les États-Unis pour la libération des otages. Face à l’hécatombe de journalistes à Gaza et au silence qui l’entoure, des dizaines de rédactions à travers le monde – de Mediapart à Al Jazeera en passant par The Independent et Politis – s’unissent pour alerter : le droit d’informer est attaqué. Depuis le dimanche 31 août, plusieurs dizaines de bateaux sont partis des ports de Marseille, Barcelone, Gênes et enfin Tunis dans le cadre de la Global Sumud Flotilla. Cet élan massif vise à briser le blocus autour de l’enclave palestinienne qui subit famine et génocide. Il suscite un soutien international croissant. Le 31 août, plus de 300 personnes ont pris la mer, depuis différents ports européens, pour rejoindre Gaza. A nouveau, la « Global Sumud Flotilla » va tenter de rompre le blocus imposé par Israël et apporter de l’aide humanitaire à la population gazaouie. En cause : […] les propos tenus par le « philosophe’’ sur le réseau social X le 15 août dernier : « Il n’y a aucun journaliste à Gaza. Uniquement des tueurs, des combattants ou des preneurs d’otages avec une carte de presse ». La Vuelta 2025 est perturbée depuis son retour en Espagne par de nombreuses actions menées par des manifestants pro-Palestine. Les plus marquantes sont survenues à Bilbao, mercredi dernier, et ont poussé les organisateurs à neutraliser l’étape. Face à cela est-il encore raisonnable de laisser courir l’équipe israélienne ? À moins de trois semaines de la conférence à l’ONU où la France reconnaitra l’État de Palestine, la Finlande s’ajoute à la liste des pays se joignant au processus. Le gouvernement israélien et le secrétaire d’État américain Marco Rubio tentent de les en dissuader. Un mouvement politique taïwanais a appelé à destituer des élus considérés comme trop proches de la Chine. Une mobilisation majoritairement féminine, avec des volontaires s’engageant parfois politiquement pour la première fois. Les normes culturelles afghanes, qui interdisent tout contact physique entre les hommes et les femmes qui n’appartiennent pas à la même famille, ont poussé les secouristes majoritairement masculins à ne pas venir en aide aux femmes. Une étude pointe un « exode silencieux » des femmes qui renoncent à l’emploi outre-Atlantique. Baisse des salaires et coûts de garde des enfants élevés, fin de la flexibilité instaurée pendant la pandémie, IA supprimant des métiers féminisés, « bro-culture »… « 97 % des documents reçus du ministère de la Justice étaient déjà publics. Il n’y a aucune mention d’une liste de clients ou de quoi que ce soit qui améliore la transparence ou la justice pour les victimes. » Voir aussi GOP Rep. Thomas Massie takes first step to force a vote on releasing the Epstein files (nbcnews.com) Au Canada, le ministère de l’Éducation de la province de l’Alberta avait annoncé le retrait d’œuvres littéraires des bibliothèques scolaires en raison de leur contenu sexuellement explicite. La Servante écarlate, roman culte adapté en série, fait partie du lot. les femmes restent encore aujourd’hui sous-représentées dans les études cliniques portant sur les maladies cardiovasculaires et cérébrovasculaires […] elles ne représentent qu’un tiers des participants dans les essais cliniques sur les AVC, ce qui limite la compréhension de cette pathologie chez elles et l’efficacité des stratégies de prévention et de traitement. des footballeurs ont accepté de relever un défi inédit : jouer dans les mêmes conditions que celles imposées aux femmes footballeuses, avec un terrain adapté pour neutraliser les différences physiques. L’expérience a bouleversé leurs certitudes sur l’intensité et la difficulté du football dit féminin. Il a même cité la célèbre drag-queen américaine RuPaul : « On naît nu et tout le reste, c’est du drag », en précisant que cette phrase vaut pour « les costumes, les t-shirts, les robes. Tout est du drag ». Golshifteh Farahani préside cette semaine le jury du 51e festival du film américain de Deauville.[…]« Le mot « président » me fait trembler quand on voit ce que sont de nombreux présidents dans le monde : des fous. » En cas de hausse des impôts sur le patrimoine, l’expatriation des plus fortunés resterait faible et aurait un effet modeste sur l’économie nationale, conclut une étude du Conseil d’analyse économique. L’optimisation fiscale réduit davantage les recettes que les départs à l’étranger. Des bases de données contenant les informations de près de deux millions de Français·es sont actuellement en vente ou en accès libre sur un forum du dark web. Les entreprises Alain Afflelou, Syma Mobile et même le Service National Universel (SNU) seraient concernés. Ces fuites exposent des données parfois très sensibles, comme des informations médicales ou des pièces d’identité. Dix mois après le lancement, sur un mode « pédagogique », de ce dispositif, la Mairie de Paris a signalé, jeudi, que ces « mois d’expérimentation » avaient « vu une baisse de 8 % du trafic routier dans la ZTL ». Le nouveau système d’assurance-récolte « est déjà en train de s’effondrer », alerte le porte-parole de la Confédération paysanne. Censé aider les agriculteurices face aux risques climatiques, il ne couvre pas les incendies. À Toulouse, où l’invisibilisation croissante des publics à la rue complique leur accès aux droits, de nombreux occupants de lieux de vie informels ont dû affronter les fortes chaleurs avec un accès à l’eau fortement restreint. la canopée fond à vue d’œil. Les pins sont abattus pour éradiquer leurs épines si embêtantes. Le sable est remplacé par du gazon, pour ne plus en avoir plein les pieds. » À ses yeux, la commune s’est « disneylandisée » jusqu’à devenir une caricature : « Nous avions une presqu’île à vivre, ils en ont fait une presqu’île à vendre. Pour l’essentiel, les pratiques mises en place comprenaient la réimplantation de linéaires de haies, la rotation des cultures et l’allongement des rotations, ainsi que la réduction des intrants. Distribuer des paniers d’aliments garantis sans pesticides ni perturbateurs endocriniens pour les femmes enceintes. L’initiative de l’« ordonnance verte » née à Strasbourg a déjà convaincu une vingtaine de villes en France. Une jeune fille née en 2015 a largement dépassé le précédent record d’obtention du bac cette année. Avant elle, le record de précocité revenait à un élève de 11 ans et 11 mois. Il n’y aura aucune concurrente tricolore pendant la compétition, qui se tiendra du 4 au 14 septembre à Liverpool. Les résultats des tests de féminité exigés par la fédération internationale n’ayant pas été transmis à temps. il faisait ce qui lui plaisait, sans jamais être réprimandé. Outre l’humiliation, tous genres confondus, il se permettait de faire ce que bon lui semblait aux femmes qui l’entouraient. De toucher qui il voulait où il voulait, avec le consentement non des personnes concernées évidemment, mais de celles qui auraient tout à fait pu l’arrêter. Un maïeuticien déjà condamné pour 11 viols sur des patientes a contesté jeudi avoir « masturbé » deux des six autres femmes qu’il est accusé d’avoir violées, évoquant des gestes « médicaux » devant la cour criminelle de l’Hérault. Le verdict est tombé ce vendredi 5 septembre. Lionel Charvin est condamné à quatorze ans de prison. D’abord le classement sans suite de sa plainte, et puis la promotion de l’inspectrice de l’éducation nationale qui, selon elle, ne l’avait pas vraiment soutenue tout au long de cette affaire. Il y a un message dans le fait qu’elle ait choisi cette date de la rentrée pour se donner la mort. Voir aussi Cas d’école – L’histoire de Caroline (blogs.mediapart.fr) Parce qu’elle est mariée à une femme, Caroline a subi les attaques d’un corbeau qui l’a menacée de mort et a tagué des insultes homophobes sur le mur de son école. On aurait pu croire que sa hiérarchie et les parents d’élèves auraient fait bloc pour la soutenir. Il n’en a rien été. Et Suicide d’une directrice d’école : “L’institution ne prend pas en charge l’humain” (telerama.fr) En janvier 2022, l’ancien gardien de la paix avait étranglé à mort sa compagne Amanda Glain qui voulait le quitter, décrivant lui-même un acte « monstrueux ». Le président a convoqué, pour le 10 septembre, un « conseil de défense sur la guerre informationnelle ». Et « en même temps », accorde son entretien de rentrée à l’hebdomadaire d’extrême droite JDNews… pour lequel travaillent pléthore de journalistes pro russes. L’affaire Thomas Legrand relance un vieux débat : un journaliste engagé est-il forcément un journaliste suspect ? Et si le problème n’était pas l’engagement, mais l’hypocrisie de ceux qui prétendent ne pas en avoir ? Depuis que la chute de François Bayrou et de son gouvernement est annoncée, le landerneau du journalisme politique s’agite et tente d’imaginer « l’après ». De nombreux éditorialistes en sont désormais convaincus : c’est le « moment socialiste », après que le PS a consommé sa rupture avec LFI et le programme du NFP. En août 2025, l’université d’été de La France insoumise (LFI), les Amfis, a été le théâtre d’une nouvelle polémique médiatique : le refus d’accréditer Olivier Pérou, journaliste du Monde et co-auteur du livre La Meute […] Cette décision, assumée par LFI, a déclenché une vague d’indignation dans les rédactions qui y ont vu une atteinte grave à la liberté de la presse. Sans attendre le vote de confiance des députés, le gouvernement veut imposer ses mesures austéritaires dans le dos du Parlement et s’apprête à alourdir le reste à charge des assurés pour faire des économies sur l’assurance-maladie. En déplacement dans un établissement à Bondy, la ministre de l’éducation a déclaré vouloir mettre en place une pause numérique pour tous les élèves entre 20 heures et 7 heures. Elle souhaite également interdire l’utilisation des téléphones portables dans tous les collèges à la rentrée prochaine. Le gouvernement travaille sur des projets de décrets réformant l’aide médicale d’État. À quelques jours d’un vote de confiance qui s’annonce plus que défavorable pour le Premier ministre, il tente de manoeuvrer en douce pour séduire l’extrême droite. la prise en compte du statut des journalistes telle que consacrée par le schéma national du maintien de l’ordre, ne trouve pas à s’appliquer dans un contexte de violences urbaines Le ministre de l’Intérieur réagissait sur TF1 à l’organisation d’une rave-party dans les Corbières, touchés par le grand incendie d’août dans l’Aude. Des syndicalistes du centre d’appel de la multinationale Concentrix, à Etrelles près de Vitré en Ille-et-Vilaine, attaquent leur employeur en justice. Ils dénoncent un management délétère conduisant à des tentatives de suicide, des burn-out et un turn-over très important. Ils regrettent que leurs alertes auprès de leur direction et des élus locaux n’aient pas amélioré la situation Les supporters ultra de Rennes et Guingamp sont-ils en train de perdre leur ADN antiraciste ? Comment des tribunes plutôt à gauche deviennent-elles poreuses aux idées d’extrême droite ? Voir aussi : Quand le hooliganisme d’extrême droite s’incruste dans les tribunes du foot breton (basta.media) Des groupes de hooligans d’extrême droite se rendent de plus en plus visibles lors des matchs de Rennes et Guingamp (Côtes-d’Armor). Ces tribunes deviennent un vivier pour des groupuscules identitaires qui participent aussi à des actions violentes dans la rue. Selon Salim Dabo, le fonctionnaire de police ferait partie de l’unité N26. Le président de l’association Univers Project explique avoir lui-même déjà eu à faire à eux. En janvier dernier, il aurait été violemment interpellé pendant qu’il organisait une maraude dans le quartier de la Plaine. Salim, placé en garde à vue, accuse ensuite les policiers de l’avoir frappé au sein de sa cellule. Alors que la rentrée sociale s’annonce chaude, la FNME-CGT appelle à une grève reconductible dans l’énergie dès le 2 septembre. Objectif : obtenir une augmentation des salaires et une baisse de la TVA sur l’abonnement énergétique. Alors que le « Plan Bayrou » demande plus d’« efficience » à l’Hôpital Public, les organisations syndicales ont déposé un préavis de grève illimitée, dès ce 5 septembre, pour dénoncer les coupes austéritaires dans les budgets de la santé, conduisant à des conditions de travail toujours plus dures Mouvement nébuleux d’extrême droite, renouveau des gilets jaunes ou réunion de militants de gauche ? Depuis le début du mois d’août, des assemblées générales préparent le mouvement de blocage du 10 septembre dans plus de 60 villes. Elles révèlent un visage du mouvement bien différent de certaines caricatures médiatiques. Si les renseignements prévoient une mobilisation importante, ils s’inquiètent surtout du « caractère diffus et imprévisible » du mouvement et des conséquences que cela pourrait avoir. Contre les projets d’économies budgétaires du gouvernement, trois syndicats majoritaires de la SNCF appellent à la grève le 18 septembre. Google will not be required to divest Chrome ; nor will the court include a contingent divestiture of the Android operating system in the final judgment La Cnil a infligé 325 millions d’euros d’amende à Google et 150 millions d’euros d’amende à Shein pour d’importants manquements en matière de publicité en ligne. Millions of women entrusted their menstrual data in the period cycle app, Flo. Now the court ruled Meta was eavesdropping on users’ in-app communications. But why would Meta want your menstrual data, and what does it mean for your privacy ? À l’avenir, si des cellules synthétiques (dites « cellules miroirs »), correspondant à la version chimiquement inversée de cellules naturelles, se développaient sur Terre, quelles pourraient être les conséquences pour la santé humaine et l’environnement ? Thirty years ago, nanotech was about to change everything. Let’s not get tricked again by Silicon Valley’s magical thinking Networks of pipes and heat exchangers can transfer excess heat from buildings into nearby bodies of water—but as the world warms, the cooling potential of some water courses is now diminishing. Au Moyen Âge, les femmes ne se contentent pas d’écouter la musique : elles la chantent, la composent, la copient et la transmettent. Derrière le silence des sources, entre cloîtres et cours affleure une vie musicale insoupçonnée. Un foisonnement de pratiques aujourd’hui rendu à la lumière […] de toute évidence, les femmes apparaissent partout où l’on se met en peine de chercher leurs traces. Le truc s’appelle « i drink safe », et vas-y on a bien compris, i drink safe, c’est i dépense encore du pognon à cause de ÇA, c’est i pay un taxi parce que le dernier rer les boules, i prend sur moi, ma gestion et mes finances la charge mentale du viol – vous étiez habillée comment ? vous aviez consommé de l’alcool ? vous aviez vérifié qu’il y avait pas de GHB dans votre verre ? NON ? Vous aviez pas de bracelet ? ? Ben enfin mademoiselle. Un pays tout entier, le Danemark, un länder allemand, des dizaines de communes, comme Lyon, la troisième ville de France… Lentement mais sûrement, les collectivités basculent vers Linux, LibreOffice et autres NextCloud. Le but est économique, mais aussi d’asseoir sa souveraineté numérique et d’en finir avec la dictature des GAFAM. Fait remarquable : même plusieurs années après, les ibis reconnaissent encore les humains qui les ont guidés lors de leur premier voyage. Retrouvez les revues de web précédentes dans la catégorie Libre Veille du Framablog. Les articles, commentaires et autres images qui composent ces « Khrys’presso » n’engagent que moi (Khrys). Texte intégral 9190 mots

Brave New World

Spécial IA

Spécial Palestine et Israël

Spécial femmes dans le monde

Spécial France

Spécial femmes en France

Spécial médias et pouvoir

Spécial emmerdeurs irresponsables gérant comme des pieds (et à la néolibérale)

Spécial recul des droits et libertés, violences policières, montée de l’extrême-droite…

Spécial résistances

Spécial outils de résistance

Spécial GAFAM et cie

Les autres lectures de la semaine

Les BDs/graphiques/photos de la semaine

Les vidéos/podcasts de la semaine

Les trucs chouettes de la semaine

01.09.2025 à 07:42

Khrys’presso du lundi 1er septembre 2025

Comme chaque lundi, un coup d’œil dans le rétroviseur pour découvrir les informations que vous avez peut-être ratées la semaine dernière.

Tous les liens listés ci-dessous sont a priori accessibles librement. Si ce n’est pas le cas, pensez à activer votre bloqueur de javascript favori ou à passer en “mode lecture” (Firefox) ;-) Ned’s shell spirals left, while almost all other snails have right spiraling shells […] this snail’s reproductive organs “don’t line up” with those of snails with right-spiraling shells […]“If 40,000 people read this,” the campaign explains, “chances are, Ned’s dreams will come true.” Japan’s first entirely homegrown quantum computer uses superconducting qubits and components made entirely domestically. L’Allemagne, la France et le Royaume-Uni ont indiqué lancer le mécanisme de « snapback » à l’encontre de l’Iran, dans une lettre adressée au Conseil de sécurité de l’Onu. Dans trente jours, le régime islamiste pourrait subir de nouvelles sanctions. Denmark is on the verge of becoming the first country in Europe to legally recognize a citizen’s face, voice, and likeness as protected intellectual property. In a landmark move, the Danish government has introduced a legislative proposal aimed at giving individuals full legal control over their digital selves, an unprecedented step in the age of artificial intelligence. Le chargé d’affaires américain à Copenhague a été convoqué aujourd’hui, mercredi 27 août, par le ministre des Affaires étrangères danois suite à des informations ayant révélé une opération d’influence menée par des citoyens américains au Groenland. Une cour d’appel fédérale américaine a statué vendredi 29 août que la plupart des droits de douane imposés par Donald Trump sont illégaux. Un revers majeur le président et sa politique qui ébranle l’économie mondiale, avant que la Cour suprême ne se prononce à son tour. Spéculations sur sa santé, agenda vide, étrange sortie de son vice-président… Il n’en fallait pas plus pour que certains internautes américains lancent la rumeur. Robert Kennedy Jr, le ministre de la Santé de Donald Trump, a licencié la responsable de la principale agence de santé publique américaine. Sa faute : refuser la dérive antivax du gouvernement. La question trans est devenue l’un des points de clivages centraux du débat public aux États-Unis, jusqu’à la récente tuerie de Minneapolis et l’accusation de “transterrorisme”. Decentralized social network Mastodon says it can’t comply with Mississippi’s age verification law — the same law that saw rival Bluesky pull out of the state — because it doesn’t have the means to do so.The social nonprofit explains that Mastodon doesn’t track its users, which makes it difficult to enforce such legislation. Nor does it want to use IP address-based blocks Un couple de festivalier·es a vécu une surprise incroyable : la naissance de leur premier enfant dans leur camping-car… alors qu’iels n’avaient pas la moindre idée de cette grossesse. They look, move and even smell like the kind of furry Everglades marsh rabbit a Burmese python would love to eat. But these bunnies are robots meant to lure the giant invasive snakes out of their hiding spots. The data was key evidence in the death of a pedestrian in 2019. Voir aussi En procès, Tesla a affirmé ne pas avoir de données sur un accident mortel… avant qu’un pirate informatique ne les retrouve (humanite.fr) La vitrine technologique du multimilliardaire Elon Musk aurait tenté de cacher des preuves essentielles lors d’un procès s’étant déroulé en juillet 2025, révèle le « Washington Post ». Attaquée en justice pour avoir participé à la mort d’une civile, percutée par une voiture Tesla en pilote automatique, l’entreprise a été condamnée à 243 millions de dollars de dommages et intérêts. researchers at the Stanford University built a BCI that could decode inner speech—the kind we engage in silent reading and use for all our internal monologues. The problem is that those inner monologues often involve stuff we don’t want others to hear. Voir aussi L’implant cérébral qui lit les pensées : miracle médical et nouvelles questions éthiques (france24.com) Des chercheureuses ont réussi, pour la première fois, à traduire en temps réel les pensées silencieuses grâce à un implant cérébral couplé à une intelligence artificielle. Cette technologie promet d’offrir une nouvelle forme de communication aux personnes paralysées. Elle soulève néanmoins des questions cruciales sur la vie privée, le consentement et la sécurité mentale. Ørsted’s Revolution Wind project off the coast of Massachusetts and Rhode Island is hit with a stop-work order over vague “national security” concerns. When rain hits city streets, salmon die within hours. Scientists have traced the killer to a chemical hidden in every car tyre, one that turns stormwater into poison. New research shows this dust doesn’t just wipe out fish, it rides the air, lodges in our lungs, and is already reshaping ecosystems worldwide. La décision d’une juge fédérale rendue ce lundi permet le rétablissement du moratoire interdisant l’exportation de soja issu de zones de l’Amazonie en proie à la déforestation. Wikipedia’s volunteer editors have rejected founder Jimmy Wales’ proposal to use ChatGPT for article review guidance after the AI tool produced error-filled feedback when Wales tested it on a draft submission. The ChatGPT response misidentified Wikipedia policies, suggested citing non-existent sources and recommended using press releases despite explicit policy prohibitions. Google says this isn’t technically “GenAI,” but it is altering videos without warning. The front page of Imgur, a popular image hosting and social media site, is full of pictures of John Oliver raising his middle finger and telling MediaLab AI, the site’s parent company, “fuck you.” Imgurians, as the site’s users call themselves, telling their business daddy to go to hell is the end result of a years-long degradation of the website. The Imgur story is one a classic case of enshitification Chatbots ignore their guardrails when your grammar sucks, researchers find. […] You just have to ensure that your prompt uses terrible grammar and is one massive run-on sentence like this one which includes all the information before any full stop which would give the guardrails a chance to kick in before the jailbreak can take effect and guide the model into providing a “toxic” or otherwise verboten response the developers had hoped would be filtered out. AI assistants don’t have fixed personalities—just patterns of output guided by humans. A ChatGPT-powered robotic companion called Hyodol is taking over some work from overburdened caregivers, much to the delight of seniors who treat them like grandchildren. ChatGPT taught teen jailbreak so bot could assist in his suicide, lawsuit says. The social media giant is now training its AI chatbots so that they do not generate responses to teenagers about subjects like self-harm, suicide, disordered eating and avoid potentially inappropriate romantic conversations Alors que l’Onu estime à plus d’un demi-million le nombre de Gazaouis en situation de détresse alimentaire maximale, son secrétaire général a dénoncé « un catalogue sans fin d’horreurs ». Depuis l’offensive terrestre déclenchée au lendemain de l’attaque menée par le Hamas le 7 octobre 2023, Israël a lentement mais méthodiquement broyé le territoire palestinien. Le 24 août, le navire humanitaire Ocean Viking a été attaqué dans les eaux internationales par les tirs des garde-côtes libyens, alors qu’il naviguait vers une embarcation en détresse. Lucille Guenier, coordinatrice de la communication de SOS Méditerranée, était à bord. Microsoft a licencié deux employé·es mercredi 27 août, et deux autres jeudi 28 août. Leur faute ? Avoir occupé le bureau du président de la multinationale pour dénoncer ses liens avec l’armée israélienne génocidaire. Palestinian activists are calling on Oakland officials to halt military cargo shipments through the city’s airport to Israel, saying the shipments have supported Israeli airstrikes on Gaza. Le Royaume-Uni a interdit aux responsables israéliens de participer au Defence and Security Equipment International, un important salon de l’armement se tenant tous les deux ans à Londres au début du mois de septembre. Des entreprises israéliennes seront toutefois présentes. Depuis plusieurs mois, le syndicat CGT de Météo-France demande l’arrêt des partenariats avec Israël pour dénoncer la guerre en Palestine. L’État hébreu se servirait de données météorologiques européennes à des fins militaires. Alors que l’Assemblée générale de l’ONU se réunit en septembre et que le génocide perpétré par Israël à Gaza se poursuit, la docteure en droit international public Inzaf Rezagui rappelle la faiblesse des décisions juridiques des instances internationales, faute de mécanisme contraignant et en l’absence de volonté politique. La mort de Lisa, 17 ans, tuée alors qu’elle rentrait de soirée à Amsterdam, a créé une onde de choc chez les Néerlandaises. Elles réclament de pouvoir sortir la nuit en toute sécurité. Le site « Phica » a ciblé plusieurs personnalités italiennes, détournant des images d’elles prises dans le cadre privé. The leak was seized on by misogynist groups online, and within hours, several websites had been created to humiliate the women who’d signed up.Two maps were published on social media, showing 33,000 pins spread across the United States. Maladie gynécologique toujours stigmatisée, l’endométriose touche environ 190 millions de personnes dans le monde. Même s’il existe des traitements relativement efficaces, la recherche se poursuit pour développer des tests de dépistage. Aux États-Unis, la recherche est mise à mal par l’administration Trump qui n’en finit pas avec des coupes budgétaires drastiques. Comme chaque année depuis 2004, une cérémonie organisée par la Mairie de Paris a célébré les républicains espagnols de la 9e Compagnie de la 2e DB de Leclerc, qui furent les premiers soldats alliés à entrer pour libérer Paris le 24 août 1944. De très fortes précipitations et de violents orages sont attendus sur le département en soirée ce dimanche et jusqu’en fin de matinée lundi. La ministre de la Culture, tout juste de retour dans son parti après une année de césure en Macronie, s’est sans surprise vue investie pour concourir à la mairie de Paris. Une source de joie pour Rachida Dati à qui la pugnacité ne fait jamais défaut, trop heureuse de la bataille qui s’annonce pour arracher la capitale aux socialistes Très réaliste, ce courrier déposé directement dans votre boîte aux lettres vous invite à flasher un QR code pour confirmer vos droits. […] les fraudeurs utilisent une technique bien connue : faire craindre aux assurés la perte d’accès imminente à leur compte Ameli ou l’expiration de leur carte Vitale pour les empêcher de vérifier la véracité des informations. Les faits survenus au collège-lycée Saint-Stanislas ont eu lieu entre les années 1950 et 1990. Les victimes sont neuf hommes et une femme. Anne Hidalgo s’est félicitée de la réussite de ce projet et en a donc profité pour sonner l’heure des prolongations jusqu’à la mi-septembre. L’inscription de la notion de consentement dans la définition pénale du viol a fait débat l’hiver dernier à la suite du vote d’une proposition de loi. Clara Serra, philosophe féministe espagnole, revient sur ce qu’elle considère comme un risque de recul pour les droits des femmes. Louis Aliot a été condamné à six mois ferme pour détournement de fonds publics, mais il continue à gérer Perpignan avec ses copains néo-fascistes et son directeur de la police… qui nous attaque en justice. En janvier 2025, la préfecture du Calvados publiait sur ses réseaux sociaux une vidéo sur le dépoussiérage de la tapisserie de Bayeux. Des experts y soulignaient son extrême fragilité et l’impossibilité de la déplacer sur une longue distance. Alors que le chef de l’État a annoncé le prêt de l’œuvre aux Britanniques, la vidéo n’est plus accessible. À bout de souffle, Emmanuel Macron se retrouve isolé, sans majorité et contesté à la fois dans la rue et sur la scène internationale. Entre menace de pleins pouvoirs et incapacité à ouvrir une issue politique, la présidence vacille, révélant l’impasse d’une Ve République en crise. À la surprise générale, le premier ministre demandera un vote de confiance à l’Assemblée nationale le 8 septembre. Tentative de reprendre la main face au mouvement du 10 septembre ou manœuvre pour préparer sa sortie ? La loi Duplomb ou la proposition de loi sur l’autoroute A69 ont été adoptées en contournant l’Assemblée nationale à travers des tactiques gouvernementales, faussant la logique parlementaire. La ministre de l’Education nationale l’a annoncé, mercredi, lors de sa conférence de presse de rentrée alors que le contrôle continu compte pour 40 % de la note finale du baccalauréat depuis la réforme Blanquer. Comme chaque année, des politiques et des éditorialistes utilisent l’allocation de rentrée scolaire pour relancer le débat sur « l’assistanat ». François Bayrou ne décolère par contre Mediapart qui a consacré cette semaine un article aux travaux de rénovation du bureau du maire de Pau. Le préfet de la Haute-Loire est critiqué par la CGT pour être allé en vacances en Italie avec sa voiture de fonction et d’avoir sollicité un chauffeur de son administration. Le site « Les Jours » révèle que des candidats d’extrême droite aux dernières élections législatives ont explosé le compteur des frais kilométriques remboursables. Sept militant·es d’Extinction-Rébellion comparaissent devant le tribunal correctionnel de Paris pour une action menée le 14 juin dernier, Place de la République, lors d’une manifestation de soutien au peuple palestinien. Pour une infraction hasardeuse : la mise en danger de la vie d’autrui. Saluts nazis, propos racistes et antisémites… Les preuves contre des membres de l’UNI s’accumulent sans réaction du ministre de l’Intérieur. Interrogé plusieurs fois par « Mediapart », il maintient, à quelques heures de la rentrée universitaire, son soutien au pseudo-syndicat étudiant. depuis maintenant près de trois mois, la FSU et nommément son secrétaire départemental Vincent Présumey sont la cible des attaques de l’extrême droite, déclenchées en raison de notre rôle dans la mobilisation laïque contre les subventions publiques déversées sur le « spectacle » de Murmures de la Cité et, à travers cette association, à l’extrême droite racialiste et intégriste. Les violences se poursuivent à Royère-de-Vassivière. Après la « chasse aux nègres » menée le 15 août, pour laquelle sept personnes ont porté plainte, leur avocate, Me Coline Bouillon, a été la cible de menaces de mort et de viol en ligne, d’après nos informations. Elle a déposé plainte. Alors que le spectre d’un départ du gouvernement Bayrou avant le 10 septembre se fait de plus en plus fort, celui d’une cohabitation avec le Rassemblement National, possiblement souhaité par Macron lui-même ré-émerge aussi. L’intersyndicale (CFDT, CGT, FO, CFE-CGC, CFTC, Unsa, Solidaires, FSU) s’est réunie dans la matinée du vendredi 29 août. Après deux années de rattrapage sur l’inflation, la modération salariale ressentie fin 2024 se confirme en 2025 et devrait s’accentuer en 2026. L’intersyndicale appelle ce vendredi à manifester et faire grève le 18 septembre contre la rigueur budgétaire, mais aussi pour obtenir des augmentations. Alors que le ministère de l’Intérieur s’acharne à enfermer les personnes sans-papiers pour les renvoyer de force dans leur pays d’origine, Alassane Dicko, de l’Association malienne des expulsés, revient sur l’histoire de la lutte des personnes expulsées et de leurs soutiens. De nouvelles sanctions américaines, mais aussi européennes illustrent les risques qu’embarquent les contrats cloud, les fournisseurs se trouvant contraints de se plier aux injonctions des États dont ils dépendent. Microsoft announced that it is changing the default save location for Word documents on Windows. “Anything new you create will be saved automatically to OneDrive or your preferred cloud destination” Instagram users have told the BBC of their confusion, fear and anger after having their accounts suspended, often for being wrongly accused by parent company Meta of breaching the platform’s child sex abuse rules. Face à la colère qui embrase l’Indonésie, TikTok choisit la prudence et coupe temporairement son direct, privant plus de 100 millions d’utilisateurices de cette fonctionnalité très populaire. In today’s digital age, a small group of technology giants – Alphabet (Google), Meta, Microsoft, Amazon, and Apple – wield extraordinary influence over the infrastructure, services, and norms that shape our online lives. These companies dominate key sectors of the internet : from search and social media to cloud computing, e-commerce, and mobile operating systems. While not all their market positions constitute illegal monopolies, their collective market power enables them to set the terms of digital engagement for billions of people worldwide. Their reach is so extensive that some experts have even likened them to utility providers. This concentration of power has profound implications for human rights, particularly the rights to privacy, non-discrimination, and access to information Just as Martin Niemöller’s “First They Came” has become our framework for understanding the rise of fascism in Nazi Germany, so, too is Wilhoit’s Law the best way to understand America’s decline into fascism […] : Conservatism consists of exactly one proposition, to wit : There must be in-groups whom the law protects but does not bind, alongside out-groups whom the law binds but does not protect. The perfect back-to-school treat has a colorful past that once brought the wrath of an axe-wielding reformer Have you ever noticed that a natural conversation flows like a dance—pauses, emphases, and turns arriving just in time ? A new study has discovered that this isn’t just intuition ; there is a biological rhythm embedded in our speech. Depuis la pandémie de Covid-19, nous connaissons tous très bien les tests antigéniques, mais saviez-vous que le principe de l’autotest a été imaginé, dans les années 1960, par une jeune designer pour rendre le test accessible à toutes les femmes en le pratiquant à domicile ? Reléguées au second plan de la scène diplomatique, les épouses d’ambassadeurs demeurent pourtant les architectes invisibles du prestige français à l’étranger. Les féminicides s’affichent partout. De la Bible à Netflix, tous les arts – mythologie, peinture, théâtre, cinéma, chanson – ont mis en scène le massacre des femmes. En retraçant l’histoire de cette structure de pensée, on comprend comment les sociétés légitiment l’élimination des femmes. Coppicing — cutting trees back — to support nature may seem counterintuitive. But it can help make the most of a limited landscape. Thanks to a change in regulations, residents in social housing can now access the clean, affordable energy coming from their own roofs. Retrouvez les revues de web précédentes dans la catégorie Libre Veille du Framablog. Les articles, commentaires et autres images qui composent ces « Khrys’presso » n’engagent que moi (Khrys). Texte intégral 7482 mots

Brave New World

Spécial IA

Spécial Palestine et Israël

Spécial femmes dans le monde

Spécial France

Spécial femmes en France

Spécial médias et pouvoir

Spécial emmerdeurs irresponsables gérant comme des pieds (et à la néolibérale)

Spécial recul des droits et libertés, violences policières, montée de l’extrême-droite…

Spécial résistances

Spécial outils de résistance

Spécial GAFAM et cie

Le rapport de la semaine

Les autres lectures de la semaine

Les BDs/graphiques/photos de la semaine

Les vidéos/podcasts de la semaine

Les trucs chouettes de la semaine