ACCÈS LIBRE

06.10.2025 à 07:42

Khrys’presso du lundi 6 octobre 2025

Texte intégral (9608 mots)

Comme chaque lundi, un coup d’œil dans le rétroviseur pour découvrir les informations que vous avez peut-être ratées la semaine dernière.

Tous les liens listés ci-dessous sont a priori accessibles librement. Si ce n’est pas le cas, pensez à activer votre bloqueur de javascript favori ou à passer en “mode lecture” (Firefox) ;-)

Brave New World

- China’s most infamous ghost town is now training ground for driverless trucks (restofworld.org)

A Chinese city that failed to attract people has become a sandbox for machines.Ordos, a coal-rich northern Chinese city that never took off after prices crashed in 2012, has attracted more than a dozen autonomous vehicle companies seeking risk-free testing environments.

- Indonesia suspends TikTok registration over data sharing failures, ministry says (reuters.com)

- Afghanistan sees telecom shutdown as Taliban cut off internet (bbc.com)

The Taliban government in Afghanistan has imposed a nationwide shutdown of telecommunications, weeks after it began severing fibre-optic internet connections.The country is currently experiencing a “total internet blackout”, internet watchdog Netblocks reports.

Voir aussi Afghanistan : Internet, téléphonie, fibre… Tout s’éteint (blogs.mediapart.fr)

- Les Kurdes au cœur des tensions en Syrie (orientxxi.info)

En Syrie, les négociations continuent entre les nouvelles autorités syriennes et des responsables des Forces démocratiques syriennes (FDS) de l’autre. Les sujets sont nombreux : armée, contrôle des frontières, retour des déplacés, institutions, éducation, énergie, rôle des femmes. Mais l’écart entre les deux camps reste profond.

- Madagascar : au moins 22 morts, Rajoelina limoge son gouvernement sous la pression de la rue (zinfos974.com)

Alors que le Haut-Commissaire de l’ONU dénonce une répression meurtrière ayant fait au moins 22 morts, le président malgache a annoncé lundi la dissolution du gouvernement. Les manifestations se poursuivent à Antananarivo, où les jeunes réclament désormais sa démission.

Voir aussi Madagascar president dissolves government after youth-led deadly protests (aljazeera.com) et Madagascar : quand les coupures d’électricité déclenchent une crise sécuritaire amplifiée par les réseaux sociaux (theconversation.com)

- Gen Z protesters rally across Morocco demanding health, education reforms (aljazeera.com) – voir aussi Au Maroc, les jeunes du collectif Gen Z 212 manifestent depuis huit jours malgré la répression (huffingtonpost.fr)

Au huitième jour de manifestation, le collectif GenZ 212 continue de grandir. Les jeunes réclament une réforme de la santé et de l’éducation, et la démission du gouvernement.

- Nucléaire : la Russie accusée d’avoir débranché la centrale de Zaporijia (reporterre.net)

L’Ukraine accuse la Russie d’avoir déconnecté la centrale nucléaire de Zaporijjia du réseau électrique ukrainien depuis le 23 septembre. Cette manœuvre s’inscrirait dans un plan visant à « voler » l’installation en la rattachant au réseau russe, malgré les risques pour la sûreté nucléaire.

- Crèmes glacées contaminées au désinfectant interdit : un million d’euros d’amende pour ne pas avoir rappelé les produits (reporterre.net)

Le géant de l’agro-alimentaire Cargill écope d’une amende de 1 million d’euros. Il avait tardé à rappeler des additifs destinés à la fabrication de glaces. Or ceux-ci étaient contaminés à l’oxyde d’éthylène, interdit en Europe.

- Les data centers pourraient empêcher l’Europe d’atteindre ses objectifs climatiques (next.ink)

- Une enquête inédite décrit le boom de l’artificialisation des sols (reporterre.net)

L’équivalent de 24 terrains de football de terres naturelles disparaissent chaque heure en Europe. C’est ce que révèle Le Monde et ses partenaires, qui ont mené une analyse satellite pour dévoiler les causes et l’ampleur de l’artificialisation des sols.

- La Moldavie a voté pour l’Europe (basta.media)

Les élections législatives moldaves du 28 septembre se sont déroulées sous la menace de tentatives d’ingérence russe. Malgré tout, le pays a choisi la voie pro-européenne. Un signal pour tout le continent, en particulier l’est de l’Europe.

- Chat Control Is Back on the Menu in the EU. It Still Must Be Stopped (eff.org)

- UK : Police footage of protests can be held for decades (statewatch.org)

Police in London and across the UK regularly film protests, with multiple officers often deployed to do so. A response to a recent freedom of information request says that footage of “a public order event without targeted individuals” can be held “for a period of up to 6 years.” However, if it contains “intelligence” it can potentially be held for decades.

- Arnold Schwarzenegger contredit Trump et soutient l’initiative du Vatican contre le réchauffement climatique (fr.euronews.com)

- A Bullet Crashed the Internet in Texas (404media.co)

A stray bullet had hit a line of fiber optic cable and knocked tens of thousands of people offline.

- Pourquoi le shutdown aux États-Unis s’annonce plus inquiétant que les précédents (huffingtonpost.fr)

Le dernier – déjà sous Donald Trump – avait duré 35 jours, un record. Six ans plus tard, le contexte est bien plus sombre pour les fonctionnaires américains.

- Education Department employees surprised to find their email automatically changed to blame Democrats for shutdown (nbcnews.com)

Five furloughed employees told NBC News they had put up nonpartisan out-of-office messages, only to see they were changed — without their permission — to partisan ones.

- En un an, la fortune de la famille Trump a presque doublé (legrandcontinent.eu)

La fortune de la famille de Donald Trump a presque été multipliée par deux au cours de l’année passée : celle-ci atteint aujourd’hui plus de 7,7 milliards de dollars, contre 4,4 milliards en octobre 2024 — ce qui place la famille présidentielle parmi les 500 plus grandes fortunes du monde.

- L’inquiétant discours du chef du Pentagone qui veut virer les « woke » et les « gros » de l’armée (huffingtonpost.fr)

Dans un discours aux accents virilistes et belliqueux, Pete Hegseth a déclaré vouloir une armée concentrée sur ses capacités létales et non sur la diversité raciale ou de genre.

- ICE wants to build a 24/7 social media surveillance team (arstechnica.com)

ICE plans to hire contractors to scan platforms to target people for deportation.

- États-Unis : des personnes détenues disparaissent (politis.fr)

Selon le Miami Herald, 1 200 personnes détenues depuis juillet au centre de rétention Alligator Alcatraz ont disparu des bases de données de l’ICE, la police d’immigration américaine. Parmi elles, 800 ne figurent plus du tout dans les registres publics de l’ICE, et 450 apparaissent sans localisation. Des organisations comme l’Union américaine pour les libertés civiles dénoncent une « disparition administrative ». Ces personnes deviennent inaccessibles pour leurs familles et leurs avocats, et sont privées d’un droit effectif à un procès équitable.

- États-Unis : Donald Trump exhorte les généraux à combattre « l’ennemi de l’intérieur » (rfi.fr)

Dans un discours d’une rare violence politique, Donald Trump a appelé, mardi 30 septembre, les généraux et amiraux américains à se mobiliser contre « l’ennemi de l’intérieur », en attaquant les immigrés sans papiers, la presse et ses opposants.

Voir aussi US cities should be military training grounds, Trump tells generals (bbc.com)

US President Donald Trump has said he wants to use American cities as “training grounds” for the military. In an unusual address to hundreds of military leaders assembled from across the world, Trump described “civil disturbances” as the “enemy from within”. He added that the situation “won’t get out of control once you’re involved”.

- États-Unis : l’Église mormone conteste devant la Cour suprême la protection juridique des personnes transgenres (stophomophobie.com)

- Luttes queer contre l’offensive transphobe : retour sur la mobilisation à New York (contretemps.eu)

- MAGA can’t expand its base — and Christian music tells us why (salon.com)

- Jane Fonda relance un mouvement pour la liberté d’expression datant de la Guerre froide (france24.com)

Un appel à reformer le “Comité pour le Premier Amendement” a été lancé par Jane Fonda et signé par plusieurs stars d’Hollywood pour défendre la liberté d’expression aux États-Unis. Ce comité avait historiquement été créé pendant la Guerre froide, en opposition à la “chasse aux sorcières” lancée par le sénateur républicain Joseph McCarthy à l’encontre des sympathisants communistes.

- Peru’s Gen Z rallies against President Boluarte (aljazeera.com)

Spécial IA

- L’IA/IAG fait exploser l’empreinte environnementale du numérique (republik-it.fr)

The Shift Project vient de publier une étude sur l’impact environnemental du développement de l’intelligence artificielle, surtout générative.

Voir aussi La synthèse et [Le rapport final]https://theshiftproject.org/app/uploads/2025/09/RF-PIA-1.pdf) (theshiftproject.org)

- Lufthansa to cut 4,000 jobs as airline turns to AI to boost efficiency (cnbc.com)

- IA et travail : on ne sait pas qui sera remplacé, mais on sait que tous seront dégradés (danslesalgorithmes.net)

- Les êtres humains sont-ils des machines comme les autres ? (lundi.am)

Quand les sciences sociales font le service marketing de l’IA

- Intelligence artificielle : une bulle prête à éclater ? (radiofrance.fr)

Les investissements dans les entreprises de l’IA et leur valorisation s’envolent. Morgan Stanley prévoit que les dépenses mondiales dans cette technologie atteindront 3 000 milliards de dollars d’ici à 2029. Un emballement inquiétant alors que l’IA est loin aujourd’hui de tenir ses promesses.

- Pluralistic : The real (economic) AI apocalypse is nigh (pluralistic.net) I firmly believe the (economic)

AI apocalypse is coming. These companies are not profitable. They can’t be profitable. They keep the lights on by soaking up hundreds of billions of dollars in other people’s money and then lighting it on fire. Eventually those other people are going to want to see a return on their investment, and when they don’t get it, they will halt the flow of billions of dollars.

- What Would Happen If an AI Bubble Burst ? (news.slashdot.org)

- Fusion nucléaire : les systèmes d’IA changent déjà la donne (theconversation.com)

- IA et science : du pliage de protéines… à l’illusion de la connaissance (danslesalgorithmes.net)

L’IA est une méthode qui ne nécessite que des capitaux pour sa mise en œuvre et qui peut être réalisée à grande échelle, contrairement à la recherche empirique, centrée sur l’humain et fastidieuse, où l’ingéniosité et la chance (qui ne s’achètent pas si facilement) semblent prédominer. Mais investir dans l’IA est aussi un moyen efficace de maintenir le statu quo, tout en semblant le bouleverser

- AI has already run out of training data — but there’s more waiting to be unlocked, Goldman’s data chief says (businessinsider.com)

- OpenAI launches a social network (platformer.news)

On Tuesday, OpenAI introduced Sora, an iOS app that lets you create and share 10-second, AI-generated video clips in a feed. It was designed to look familiar, OpenAI employees said in a live broadcast on Tuesday morning, and indeed Sora closely resembles TikTok, Reels, and YouTube Shorts. […] What makes Sora different is what it calls the cameo : digitized versions of users’ faces and voices that the app can insert into prompts. When you onboard into Sora, the app asks you to create your cameo.

- Meta plans to sell targeted ads based on data in your AI chats (techcrunch.com)

Meta announced on Wednesday that data collected from user interactions with its AI products will soon be used to sell targeted ads across its social media platforms.

Voir aussi Meta won’t allow users to opt out of targeted ads based on AI chats (arstechnica.com)

US users stuck with AI ad targeting as EU users win more control over their feeds.

- Grokipedia : Elon Musk continue sa campagne de dénigrement contre Wikipédia (next.ink)

Le milliardaire a annoncé sur son réseau social X que son entreprise xAI était en train de construire une encyclopédie concurrente : Grokipedia.

- “Why Not Hire An American ?” — The Internet Is Calling Out The Trump Administration Over Their Latest Post (buzzfeed.com)

Yes, it appears the administration used AI to create their push to find Americans with skills.

- 18 % des médias et 33 % des sites tech les plus recommandés par Google sont générés par IA (next.ink)

De « Don’t be evil » à « Je danse le mIA »

- Spooked by AI, Bollywood stars drag Google into fight for ‘personality rights’ (reuters.com)

In India, Bollywood stars are asking judges to protect their voice and persona in the era of artificial intelligence. One famous couple’s biggest target is Google’s arm YouTube.

- L’arrivée de Tilly Norwood, l’actrice générée par IA, reste en travers de la gorge du monde du cinéma (huffingtonpost.fr)

- With a Friend like this, who needs enemies ? (theverge.com)

- College students used Meta’s smart glasses to dox people in real time (theverge.com)

The project, designed as a demo, shows how easily existing tech can be misused and highlights how to protect yourself.

- En Californie, un taxi autonome laisse la police comme deux ronds de flan (liberation.fr)

Des agents de la ville de San Bruno, dans la banlieue de San Francisco, ont été confrontés au vide juridique concernant les robotaxis quand ils ont voulu verbaliser un véhicule sans conducteur.

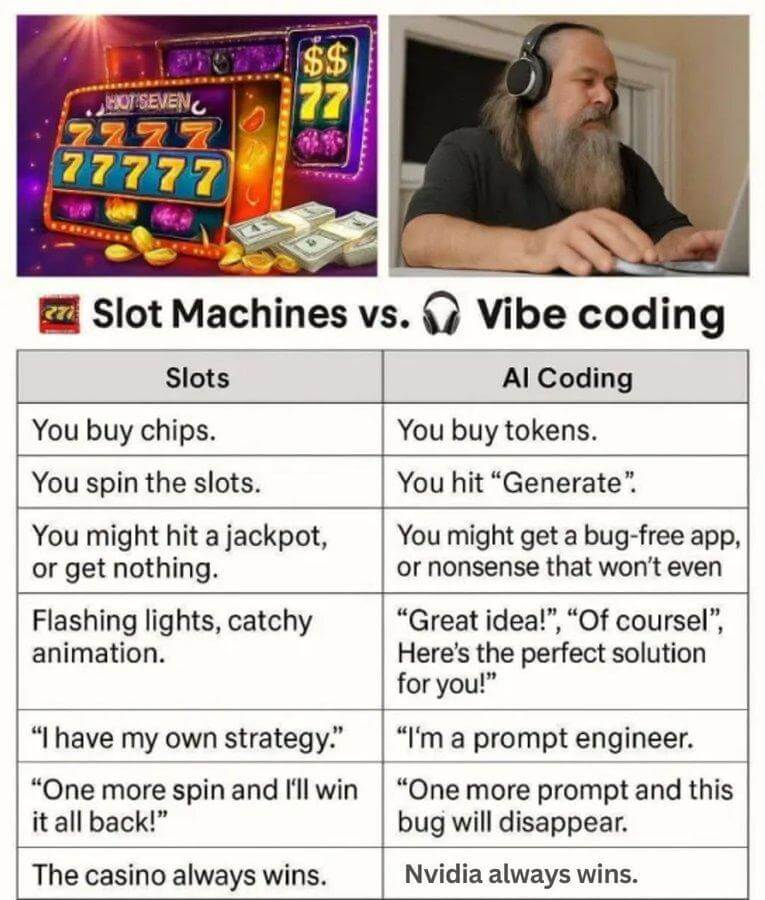

- Measuring the Impact of Early-2025 AI on Experienced Open-Source Developer Productivity (metr.org)

When developers are allowed to use AI tools, they take 19 % longer to complete issues—a significant slowdown that goes against developer beliefs and expert forecasts. This gap between perception and reality is striking : developers expected AI to speed them up by 24 %, and even after experiencing the slowdown, they still believed AI had sped them up by 20 %.

- Companies Are Being Torn Apart by AI “Workslop,” Stanford Research Finds (futurism.com)

One study from MIT found that a damning 95 percent of companies that gambled on integrating the tech saw no meaningful growth in revenue. Another study exploring one of its most hyped up applications, AI coding assistants, showed that programmers actually became slower when they depended on the AI tools. Meanwhile, a slew of reports tell an increasingly familiar tale of companies firing their workers to replace them with AI, only to scramble to rehire humans once they realize the tech isn’t all it was made out to be.

- AI Coding Is Massively Overhyped, Report Finds (futurism.com)

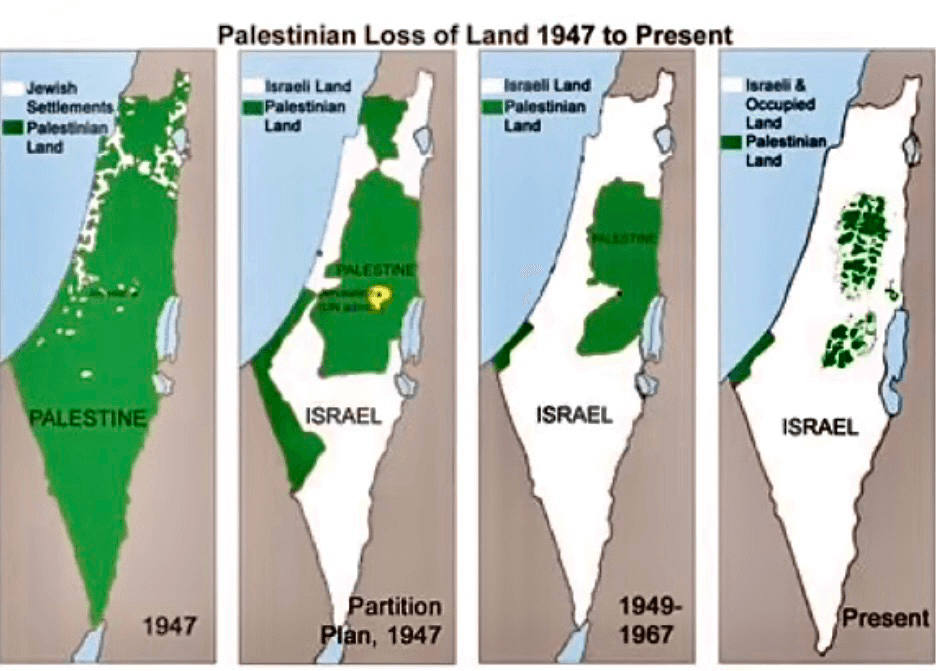

Spécial Palestine et Israël

- Que sait-on du rôle joué par Palantir à Gaza ? (legrandcontinent.eu)

Discrètement, en janvier 2024, l’entreprise de renseignement et d’analyse de données co-fondée par Peter Thiel, Palantir, a conclu un « partenariat stratégique » avec le ministère de la Défense israélien.Depuis octobre 2023, Tsahal a intégré les outils et logiciels de l’entreprise dans le cadre de son offensive menée dans la bande de Gaza.

- Gaza : le soutien d’António Guterres au plan ultra-colonial de Trump ou l’hypocrisie du droit international (revolutionpermanente.fr)

Dans un communiqué, le secrétaire général de l’ONU a annoncé soutenir le plan ultra-colonial de Trump. Un retournement de veste qui raye d’un trait les décisions de l’ONU critiques à l’égard d’Israël et qui témoigne de l’hypocrisie du droit international.

- Trump se félicite de la réponse du Hamas et met une pression inédite sur Israël (huffingtonpost.fr)

Pour la première fois, le président américain appelle Israël à « cesser immédiatement ses bombardements » sur Gaza.

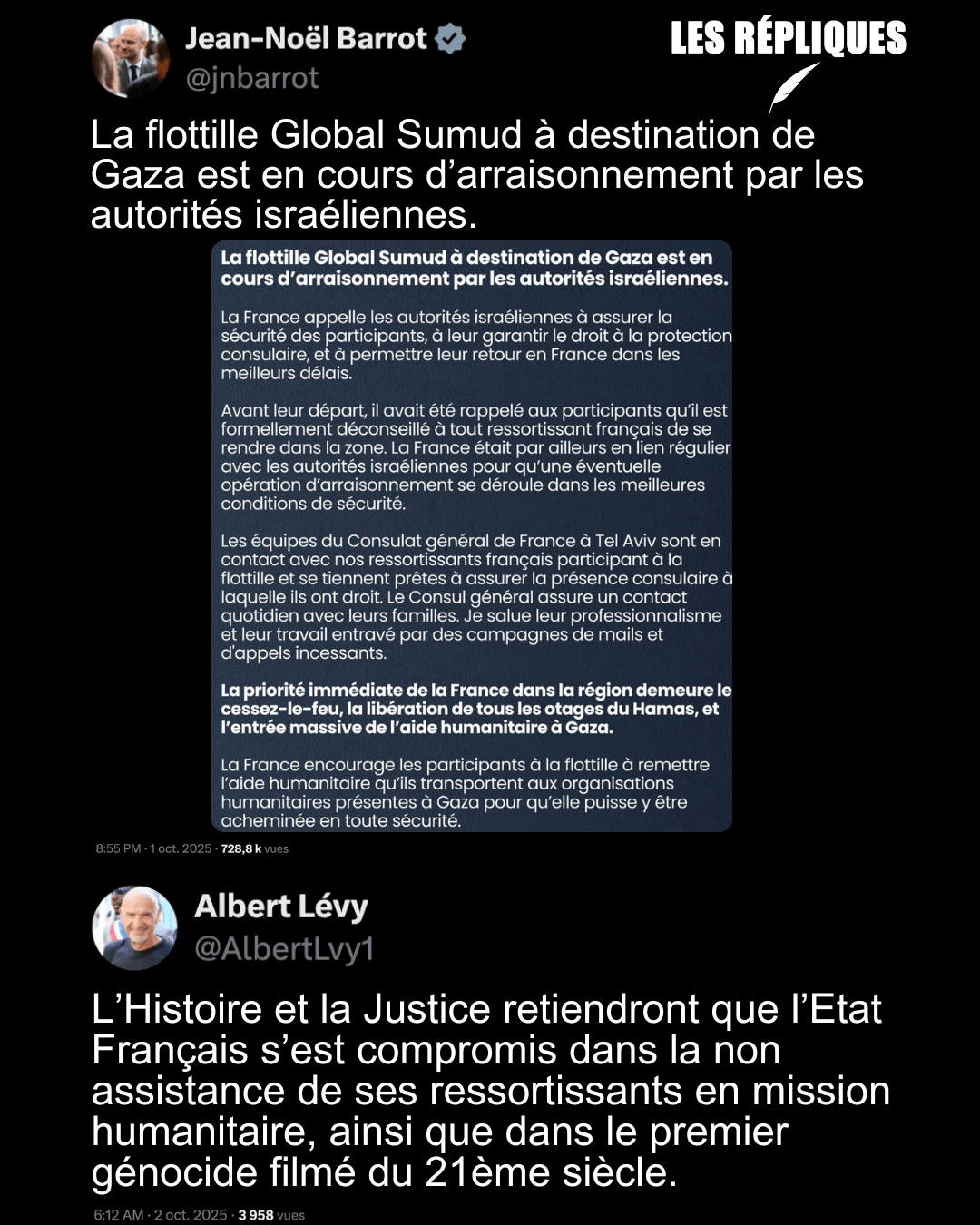

- La flottille pour Gaza déborde le blocus d’Israël (reporterre.net)

Israël a intercepté 39 des 45 navires de la flottille internationale en soutien à Gaza. Démarrée mardi 30 septembre au soir et toujours en cours ce jeudi, cette opération a été menée illégalement dans les eaux internationales, rappelle Le Monde. Tous les passagers arrêtés par les militaires israéliens vont être expulsés vers l’Europe, a annoncé l’État hébreu.

- Après l’interception de la flottille pour Gaza, des milliers de manifestants dans les rues en France (huffingtonpost.fr)

À Paris notamment, quelques milliers de personnes se sont retrouvées sur la Place de la République à l’appel de LFI avant d’être dispersées par les forces de l’ordre.

- « Flottille de la liberté » : les élus de La France insoumise retenus en Israël commencent une grève de la faim (huffingtonpost.fr)

Interceptés à bord de la Global Sumud Flottila, les parlementaires entendent alerter l’opinion mondiale des massacres en cours à Gaza.

- Greta Thunberg mistreated by Israeli forces in detention, activists say (aljazeera.com)

Turkish journalist and Gaza Sumud Flotilla participant Ersin Celik told local media outlets he witnessed Israeli forces “torture Greta Thunberg,” describing how she was “dragged on the ground” and “forced to kiss the Israeli flag.”

Voir aussi Second released flotilla activist confirms Israel beat Greta Thunberg (thecanary.co) The woman volunteer corroborated an earlier report that Greta Thunberg was physically beaten and forced to wear an an Israeli flag tied to her back while she was dragged along – then went on to describe the terrible prison conditions all the flotilla hostages were kept in, including being starved and forced to drink toilet water […] Arab volunteers were also brutally beaten […] Occupation soldiers ripped off our headscarves during our arrest and took them from us, and our non-veiled friends gave us their shirts to cover our heads.

- France. Huit mois de prison (avec sursis) pour un geste de solidarité avec Gaza (orientxxi.info)

« Israël assassin, France complice », « Gaza : 20 000 morts », « Nétanyahou devant la CPI ». Ce sont les phrases qu’inscrit Jean-François Daniau, fin 2023, sur le mur d’une friche industrielle, dans une rue très peu fréquentée de la ville de Sens, en Bourgogne.

- Gaza : MSF dénonce le meurtre d’un quatorzième membre de son personnel à la suite d’une attaque israélienne (msf.fr)

Spécial femmes dans le monde

- Au Moyen-Orient, la lente progression du leadership féminin dans le monde du travail (theconversation.com)

- Groenland : le Danemark demande pardon aux femmes inuites (politis.fr)

À partir des années 1960, le pays a mené une violente politique de limitation des naissances, obligeant des adolescentes inuites à se faire poser un stérilet, qui les a parfois rendues stériles. Selon un rapport, plus de 4 500 femmes étaient dans ce cas à la fin en 1970, soit une Groenlandaise en âge de procréer sur deux.

- “We’re in survival mode” : Women human rights defenders on digital repression and movement sustainability (apc.org)

RIP

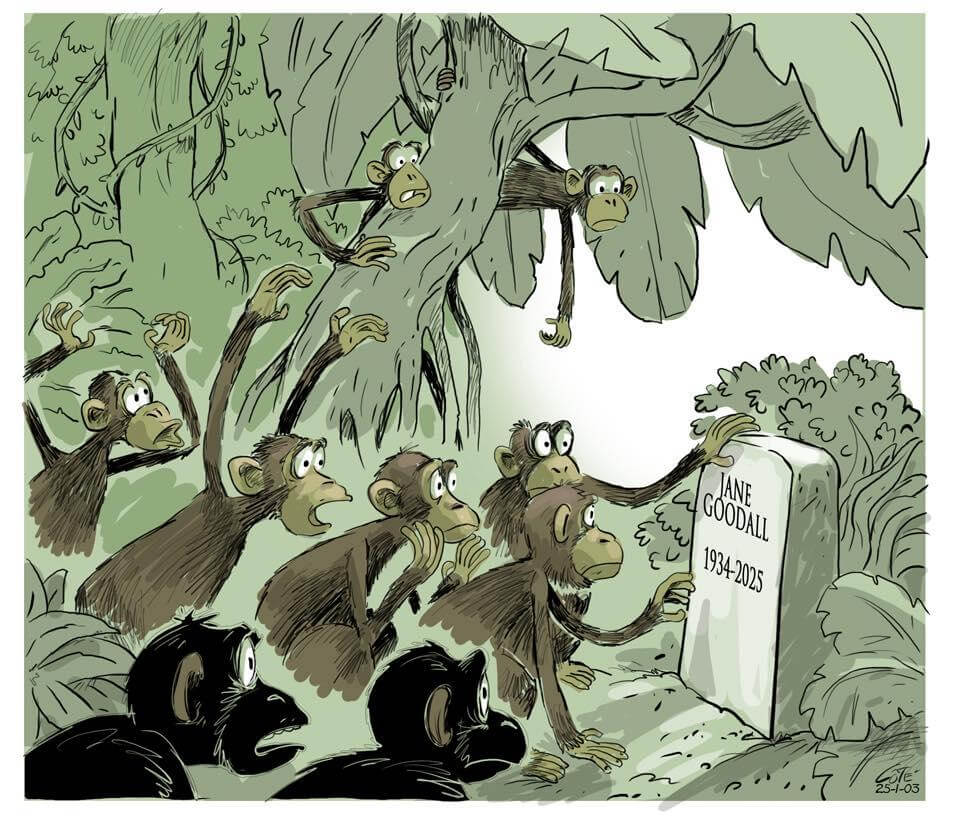

- La célèbre primatologue britannique Jane Goodall est morte à 91 ans (franceinfo.fr)

Elle est la première scientifique à avoir rapporté que les chimpanzés utilisaient des outils pour s’alimenter. […] En révélant qu’ils savent eux aussi fabriquer des outils et les manier, le chercheuse a révolutionné le regard que l’humanité porte sur sa place dans la nature.

- Jane Goodall, la discrète révolutionnaire dont les recherches sur les chimpanzés ont redéfini notre conception de l’humanité (theconversation.com)

Spécial France

- Face à Sébastien Lecornu, les gauches cherchent le chemin de la censure (politis.fr) – voir aussi Sébastien Lecornu visé par une triple motion de censure dès cette semaine ? Le scénario qui se profile (huffingtonpost.fr)

Le Premier ministre, qui prononcera son discours de politique générale mardi 7 octobre à 15h, devra sans doute faire face à plusieurs initiatives du PS, des Écologistes et de LFI.

- 2 % de taxe quand on accroît sa fortune de 6 % par an “ce n’est vraiment pas beaucoup” : le prix Nobel d’économie Joseph Stiglitz juge que la France doit faire “seule” la taxe Zucman (bfmtv.com)

- Nicolas Sarkozy visé par une plainte d’avocat·es pour « outrage » et « atteinte à l’autorité de la justice » (huffingtonpost.fr)

Les avocat·es estiment que par ses propos virulents sur son jugement, c’est bien Nicolas Sarkozy qui a nui à l’État de droit.

- La défense de Nicolas Sarkozy après sa condamnation mise à mal par un rapport du Sénat sur l’exécution des peines (huffingtonpost.fr)

Aucun des 75 professionnels interrogés au Sénat n’a trouvé à redire sur l’exécution provisoire, pourtant décrite comme une atteinte à l’État de droit par l’ancien président.

- L’enseigne chinoise Shein va ouvrir un magasin dans six villes de France, une première mondiale (huffingtonpost.fr)

L’OCDE avait noté au mois de septembre que l’activité de Shein n’était ni confirme au droit français, ni au droit européen. Que ce soit au sujet des droits humains, des salaires ou de l’impact sur l’environnement.

Voir aussi L’arrivée de Shein en France provoque la bronca du milieu de l’habillement (huffingtonpost.fr)

- « Un leurre climatique » : l’Académie des sciences alerte sur la géoingénierie (reporterre.net)

- Les chambres d’agriculture sont hostiles au bio, critique la Cour des comptes (reporterre.net)

Corruption, subventions indues, absence de soutien envers l’agriculture biologique. La Cour des comptes a publié le 1er octobre un rapport assez sévère concernant les dérives des chambres d’agriculture.

- Manger moins de viande ferait économiser des milliards d’euros de coûts de santé (reporterre.net)

Manger moins de viande rouge et moins de viande transformée (de type saucisse ou charcuterie) permettrait, en France, d’économiser jusqu’à 1,7 milliard d’euros de coûts de santé.

- Mégabassines : la justice déclare illégale l’autorisation de prélèvement d’eau à partir de 2026 (reporterre.net)

La justice coupe le robinet des mégabassines. Vendredi 26 septembre, la Cour administrative d’appel de Bordeaux a déclaré illégale l’autorisation pluriannuelle de prélèvement d’eau accordée par plusieurs préfets pour l’irrigation agricole dans le bassin versant du Marais poitevin.

Spécial femmes en France

- “Matrimoine” : quand des femmes réhabilitent les disparues de l’histoire (linfodurable.fr)

- Hausse spectaculaire des accidents de travail chez les femmes : il faut “adapter les équipements et la formation aux morphologies féminines” (france3-regions.franceinfo.fr)

On a longtemps pensé que les accidents du travail concernaient surtout les hommes. Mais aujourd’hui, les chiffres sont clairs. Depuis deux décennies, les accidents du travail chez les femmes ont connu une hausse spectaculaire : + 41,6 % entre 2001 et 2019, tandis que ceux des hommes ont diminué de près de 27 %

- Contraceptifs américains bloqués en Belgique : l’incinération des stocks en France “n’est plus d’actualité” (franceinfo.fr)

- La mode, ennemie des femmes ? (france24.com)

Sur les podiums, elles sont omniprésentes, mais en coulisses, les hommes qui dirigent les grandes maisons de couture sont beaucoup plus nombreux. Dans les dernières sélections de directeurs artistiques, seuls deux noms de femmes émergent contre une dizaine d’hommes – et bien peu de diversité.

- Le « violeur de Tinder », Salim Berrada, condamné en appel à la peine maximale de 20 ans de réclusion (huffingtonpost.fr)

L’ex-photographe marocain a été reconnu coupable d’avoir violé et agressé sexuellement 17 femmes rencontrées en ligne, entre 2014 et 2016.

- La France à nouveau condamnée par la Cour Européenne des droits de l’homme (CEDH) dans une affaire de viol sous couvert de BDSM (osezlefeminisme.fr)

- La Cour européenne relance l’affaire Darmanin (blast-info.fr)

Accusé de viol mais épargné par la justice française, le cas du ministre de la Justice (démissionnaire) est désormais étudié par la Cour européenne des droits de l’homme.

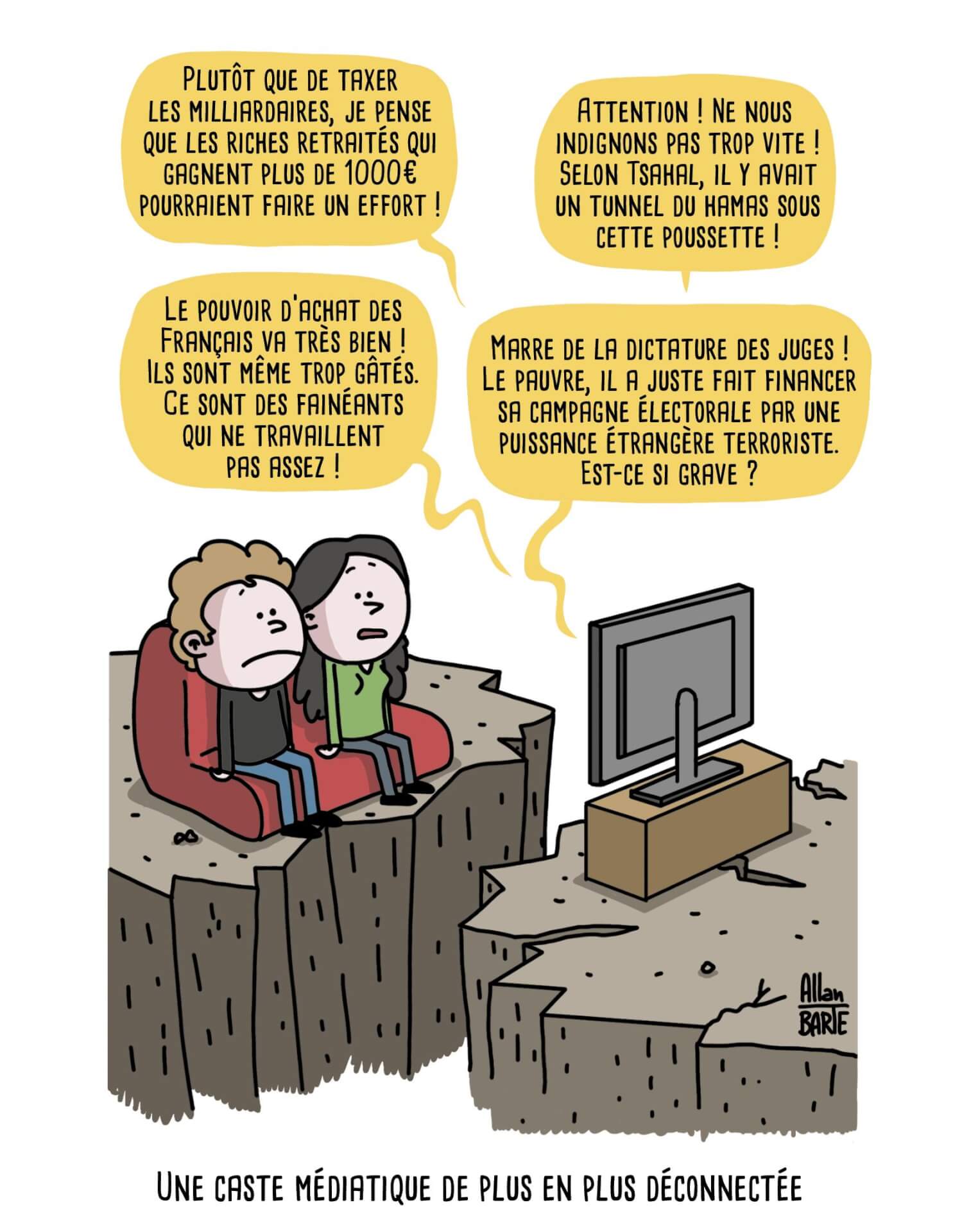

Spécial médias et pouvoir

- Taxer les milliardaires… et les déposséder des médias ! (tract) (acrimed.org)

- Plusieurs médias en ligne, dont Arrêt sur images et Rue89, s’associent pour lancer un abonnement commun (franceinfo.fr)

L’abonnement de 19,90 euros mensuels donne accès à la plateforme La Presse libre, qui regroupe huit médias, pour la plupart marqués à gauche.

- « Le Routard » tombe à son tour totalement dans l’escarcelle de Bolloré (huffingtonpost.fr)

Le groupe Hachette Livre vient d’annoncer son acquisition complète de la marque. Il éditait déjà le guide depuis les années 1970.

- CNews contre les médias publics : une mise à mort du journalisme ? (theconversation.com)

Le conflit entre les médias du groupe Bolloré et le service public de l’audiovisuel interroge les fondements mêmes du journalisme et d’une « information impartiale ».

- Selon la PDG de Radio France, les médias Bolloré veulent obtenir la “destruction” de l’audiovisuel public (telerama.fr)

Sibyle Veil s’inquiète de la “polarisation” grandissante du débat public en France, dans un entretien à “La Tribune Dimanche”. Elle sera auditionnée par le Sénat le 8 octobre.

Spécial emmerdeurs irresponsables gérant comme des pieds (et à la néolibérale)

- Gouvernement de Sébastien Lecornu : la liste des ministres annoncée avec beaucoup de pénibles (huffingtonpost.fr)

- La méthode Lecornu : une certaine idée du néant (politis.fr)

Mutique depuis sa prise de fonction, le premier ministre a finalement parlé dans Le Parisien pour ne rien dire. Et le locataire de Matignon a usé de toutes les contorsions langagières pour affirmer qu’il ne fera aucune « rupture » politique.

- « Faux diplôme » de Lecornu : une plainte déposée pour usurpation de titre (blast-info.fr)

- À la fois ministre démissionnaire des Armées et Premier ministre, Sébastien Lecornu se retrouve à double-signer des décrets. (huffingtonpost.fr)

- Communication bugétaire et enfumage, épisode N+1 (linkedin.com)

F. Bayrou avait prévu de “maîtriser les dépenses” c’est-à-dire de faire des économies. Il prévoyait de limiter la hausse à +5 Md€, soit 5 milliards de moins que ce dont a besoin notre système de santé.Vous commencez probablement à comprendre : une hausse de 5 Md€ ? C’est justement la proposition de S. Lecornu. C’est le même budget.Et toujours 5 milliards de moins que les besoins

- Matignon a annoncé la baisse de l’impôt sur le revenu pour les couples au smic… alors qu’ils ne le paient pas (leparisien.fr)

Spécial recul des droits et libertés, violences policières, montée de l’extrême-droite…

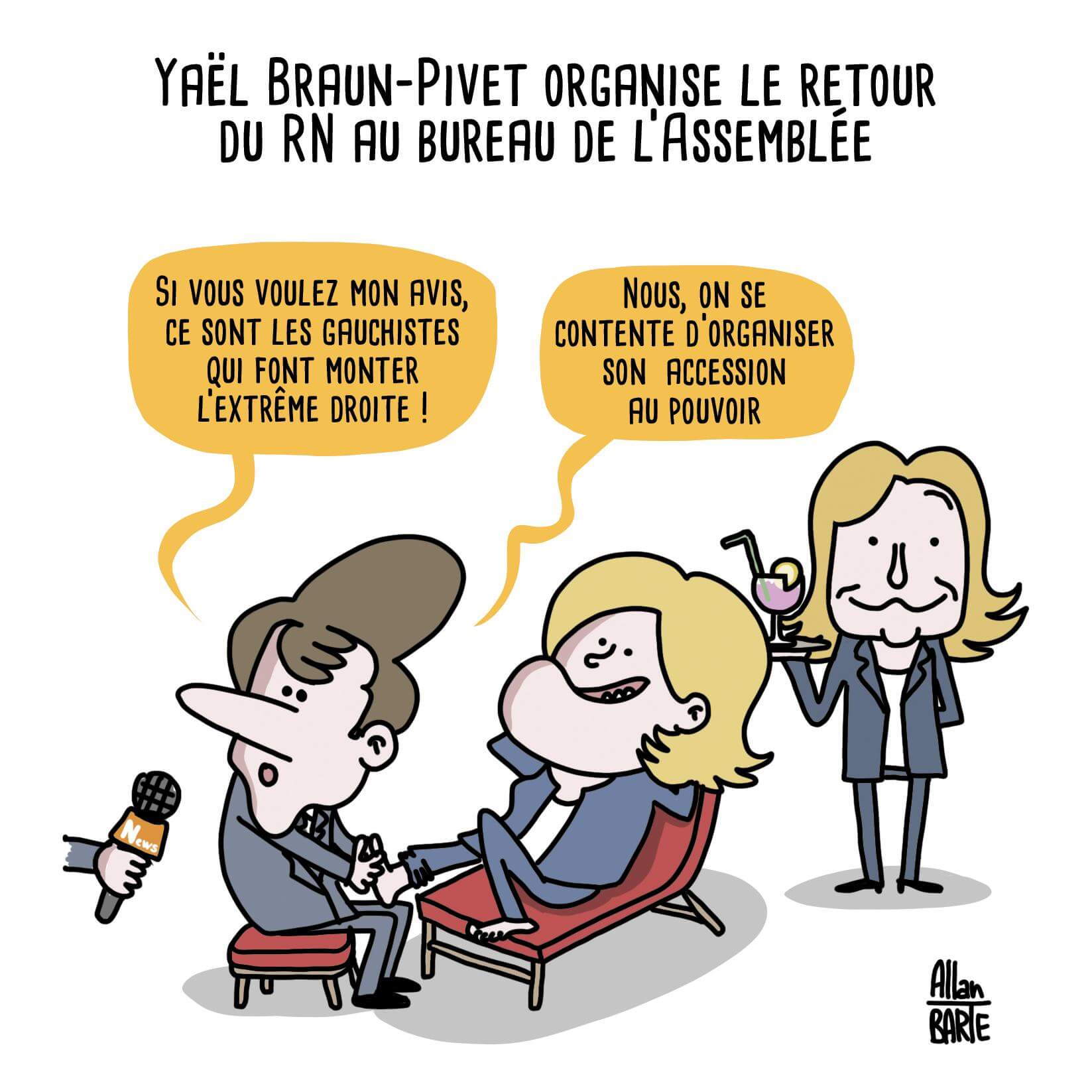

- À l’Assemblée, les macronistes préfèrent cohabiter avec l’extrême droite (politis.fr)

Pour l’élection du bureau de la Chambre basse, le bloc central a préféré dealer avec le Rassemblement national et lui offrir deux vice-présidences de l’Assemblée. Un accord qui pourrait placer encore une fois le premier ministre sous la surveillance de l’extrême droite.

- L’arrangement tacite RN-bloc central rebat les postes clé à l’Assemblée nationale au détriment de la gauche (huffingtonpost.fr)

Le socle commun a récupéré la tête de presque toutes les commissions grâce aux voix du RN. La gauche, qui perd deux commissions, est furieuse.

Voir aussi Entente entre extrême droite et bloc centriste : le désarroi de la gauche (reporterre.net)

- Politique fiscale : Le RN fait tomber le masque social (politis.fr)

- Face à Pierre-Édouard Stérin, le grand silence de la « French Tech » (multinationales.org)

Investisseur historique et respecté de la French Tech, Stérin finance via le Fonds du bien commun des associations traditionalistes et réactionnaires et vise désormais, avec le projet Périclès, la victoire électorale de l’extrême droite. Dans le milieu start-up, le sujet reste tabou. De Xavier Niel à Bpifrance, tout le monde continue à faire affaire avec le sulfureux milliardaire

- À Lyon, trois artistes de la Biennale de la danse victimes d’une violente agression raciste (liberation.fr)

- Près de Rouen, Mamadou Garanké, jeune boucher sous le coup d’une OQTF meurt en tentant de quitter la France (actu.fr)

Employé dans une boucherie de Darnétal (Seine-Maritime), Mamadou Garanké Diallo a trouvé la mort en tentant de quitter la France suite à la réception de son avis d’expulsion.

Voir aussi La mort d’un jeune boucher en fuyant une OQTF, provoque une vive émotion, Retailleau pointé du doigt (huffingtonpost.fr)

- La préfecture interdit les rassemblements festifs à caractère musical jusqu’au 1er janvier 2026 (alter1fo.com)

Un week-end, une semaine, deux semaines, puis un mois. La durée d’interdiction des rassemblements festifs à caractère musical sur l’ensemble du département d’Ille-et-vilaine n’a eu de cesse de s’allonger. Aujourd’hui, une nouvelle étape est franchie : c’est tout un trimestre qui est frappé d’interdiction.

- Hérault : Le préfet a-t-il vraiment interdit de manifester avec les syndicats ? Son arrêté suspendu par le tribunal (20minutes.fr)

Le préfet de l’Hérault avait tenté d’interdire la participation, à la manifestation de ce jeudi 2 octobre, à toute personne qui ne soit pas sympathisant de l’intersyndicale. Un arrêté suspendu par le tribunal administratif de Montpellier.

- Plus de cent personnes en garde à vue après le blocage de la société Eurolinks à Marseille (marsactu.fr)

une centaine de personnes ont été placées en garde à vue alors qu’elles étaient rassemblées devant l’entreprise d’armement Eurolinks, à Marseille, dans le cadre du mouvement social national contre la politique du gouvernement.

- Un animateur de radio canut arrêté chez lui et perquisitionné (radiocanut.org) – voir aussi Arrestation préventive d’un militant la veille du 10 septembre… Ou quand la police use de mensonges grossiers pour intimider le mouvement social (rebellyon.info)

- 2 octobre : à Nantes, la police s’est acharnée contre les lycéens de Nelson Mandela (revolutionpermanente.fr)

Le jeudi 2 octobre, les élèves du lycée Nelson Mandela à Nantes étaient mobilisés en organisant un blocus devant leur établissement. La réponse a été immédiate : une répression brutale des CRS.

- En Ardèche, la gendarmerie expulse les « écureuils » opposé·es à la déviation de Saint-Péray (reporterre.net)

- L’ombre coloniale (I) (prison-insider.com)

Les prisons débordent. Année après année, le nombre de personnes incarcérées ne cesse d’augmenter, signe d’un modèle punitif prédominant souvent présenté comme neutre. Cette hégémonie ne doit pourtant rien au hasard et tout à l’histoire coloniale. Les puissances impériales ont exporté, adapté et imposé l’enfermement carcéral dans les territoires qu’elles contrôlaient, souvent pour réprimer, discipliner et restructurer les sociétés colonisées.

Spécial résistances

- « Sauvons l’ExisTransInter ! », communiqué commun d’un collectif d’associations trans et intersexes (toutesdesfemmes.fr)

- Que reste-t-il du 10 septembre ? (lundi.am)

- Que devient « Bloquons tout » ? (rapportsdeforce.fr)

- Grève du 2 octobre : la mobilisation en nette baisse pour cette nouvelle journée de manifestations (huffingtonpost.fr)

La police comme les syndicats constatent une baisse de l’affluence dans les défilés, que ce soit à Paris, à Marseille, à Rennes ou encore à Lyon.

Spécial outils de résistance

- Whoisbn, une app pour découvrir la concentration éditoriale (whoisbn.net)

Explorez les liens capitalistiques du monde de l’édition : scannez le code-barres d’un livre pour vérifier qui possède son éditeur.

- Sécurité sociale de l’alimentation : un brin d’utopie et une louche de questions (politis.fr)

L’idée d’une Sécurité sociale de l’alimentation pour toute la population française ne cesse de faire des émules. Mais peut-elle réellement passer de l’expérimentation locale à l’échelle nationale ?

Spécial GAFAM et cie

- YouTube va payer 24,5 millions de dollars pour avoir suspendu Donald Trump en 2021 suite à l’assaut du Capitole par ses partisans (next.ink)

- Sur Android, F-Droid part en guerre contre la vérification d’identité des développeureuses (next.ink) – voir aussi F-Droid and Google’s Developer Registration Decree (f-droid.org)

For the past 15 years, F-Droid has provided a safe and secure haven for Android users around the world to find and install free and open source apps. […] The future of this elegant and proven system was put in jeopardy last month, when Google unilaterally decreed that Android developers everywhere in the world are going to be required to register centrally with Google.

- Data centres in space ? Jeff Bezos says it’s possible (reuters.com)

Jeff Bezos predicted on Friday gigawatt-scale data centres will be built in space within the next 10 to 20 years and that continuously available solar energy meant they would eventually outperform those based on Earth.

- Amazon’s Ring Plans to Scan Everyone’s Face at the Door (yro.slashdot.org)

Amazon will be adding facial recognition to its camera-equipped Ring doorbells for the first time in December, according to the Washington Post.

- Aux Pays-Bas, les algorithmes ne feront plus la loi sur Facebook ou Instagram (franceinfo.fr)

Meta doit proposer à ses utilisateurs aux Pays-Bas une option sans algorithme permettant aux utilisateurs de définir un fil d’actualité chronologique par défaut, a statué un tribunal d’Amsterdam jeudi.

Voir aussi DSA : la justice néerlandaise estime que Meta doit proposer des flux chronologiques (next.ink)

- Apple Takes Down ICE Tracking Apps in Response to Trump Pressure Campaign (nytimes.com)

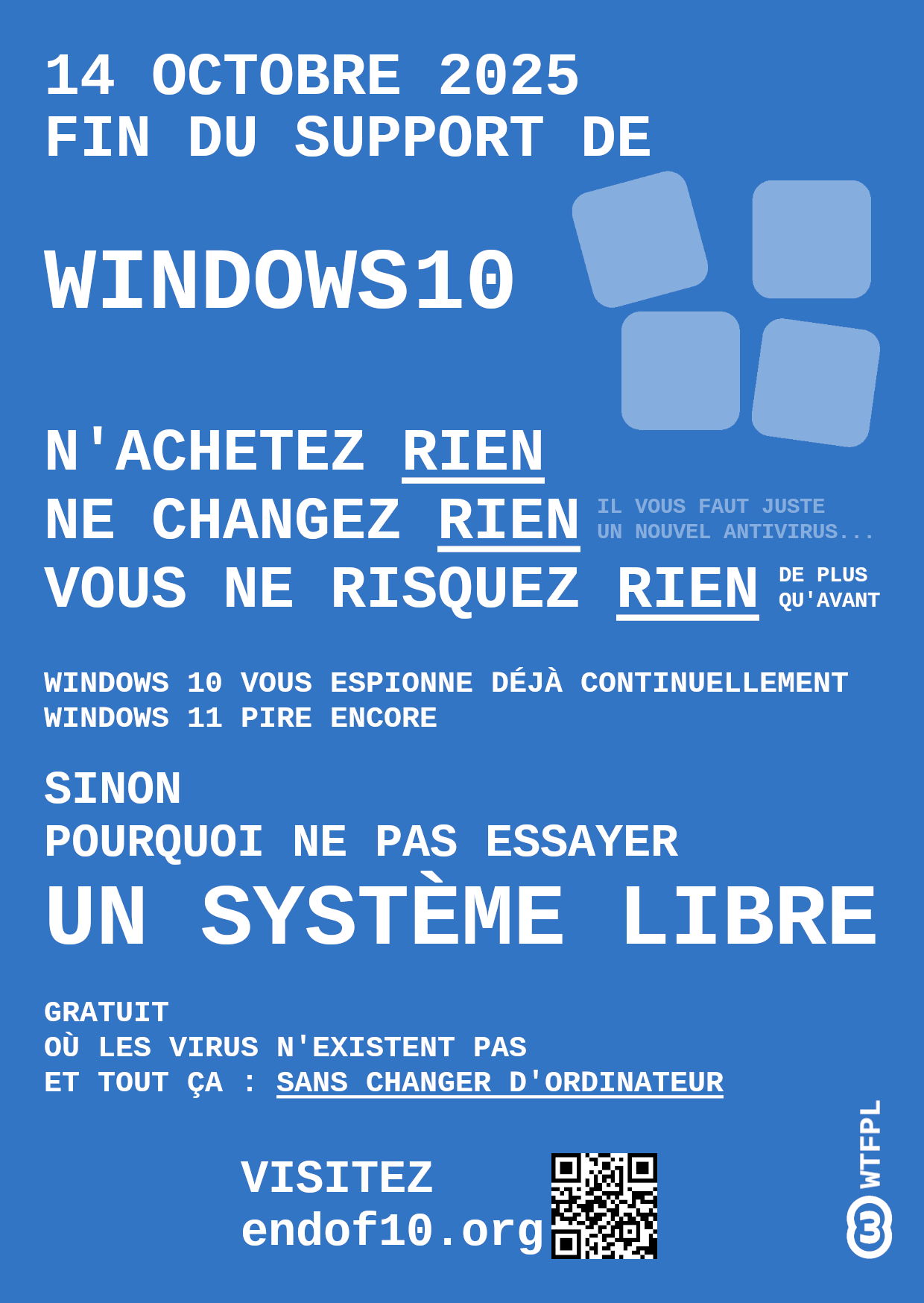

- Mise à jour de Windows : le pouvoir exorbitant de Microsoft (multinationales.org)

L’entreprise peut décider du jour au lendemain de faire envoyer au rebut des millions d’ordinateurs. Comme le rappelle encore L’Humanité, « en France, 22 % des ordinateurs sont menacés par cette obsolescence logicielle liée à la fin de Windows 10. Cela inclut ceux d’entreprises et d’infrastructures critiques : hôpitaux, écoles, mairies, bibliothèques et associations ». Cela vaut aussi pour la Police nationale. Beaucoup des collectivités et services publics concernés ont choisi de payer les sommes demandées par Microsoft pour ne pas s’exposer à des risques accrus de sécurité faute de mise à jour de leur système d’exploitation.

- Cantillon Lessons Guide Shift to Open-Source (news.opensuse.org)

The approaching end of Windows 10 is a clear chance for people and administrations to make smarter choices for their communities. For individuals, that means installing a Linux distribution instead of enriching distant shareholders. For governments, it means avoiding dependence on foreign corporations and preserving digital sovereignty by keeping control of critical infrastructure.

- Discord reconnait une fuite de données personnelles et de documents internes (next.ink)

Vous connaissez certainement la chanson qui commence par « la protection de la confidentialité et de la sécurité de nos utilisateurs est une priorité absolue », puis enchaine sur une fuite de vos données personnelles et/ou bancaires. C’est aujourd’hui au tour de Discord de nous jouer cette partition.

Les autres lectures de la semaine

- Eva Joly sur la condamnation de Sarkozy : « Ne cherchons pas à sauver l’illusion française de l’infaillibilité du pouvoir » (la-croix.com)

Il faut reformuler encore et encore : alors que des Françaises et des Français attendaient que le terroriste responsable de la mort de leurs proches soit arrêté et que justice soit faite, l’entourage de Nicolas Sarkozy est allé rencontrer cet homme pour lui faire offre de collaboration.

- La France insoumise est-elle anticapitaliste ? (blog.mondediplo.net)

- Spain Outage Was First of Its Kind, Worst in Decades (financialpost.com)

The blackout that left Spain in the dark last April was an unprecedented event and the most severe to hit European networks in the last two decades, a regional power grids group said.

- Écologie de guerre. Le grand alignement militariste de l’écologie libérale (contretemps.eu)

- Fungi Are Becoming Invaluable First Responders in Eco-Crises (reasonstobecheerful.world)

- How different mushrooms learned the same psychedelic trick (arstechnica.com)

Scientists may have additional tools to produce psilocybin to use for medical purposes.

- Remember : Kurt Vonnegut was 47 (joanwestenberg.com)

At forty-seven, Kurt Vonnegut published Slaughterhouse-Five. He had been a struggling writer, a car salesman, a PR man at General Electric, and a failed playwright. He had seen war firsthand, lived through firebombs, raised six children (four of them adopted after his sister’s death), and produced a shelf of novels that garnered little attention. Then suddenly, almost accidentally, he became one of the most important American voices of the twentieth century.

- Le nombre de prêtres gays est très élevé, car s’engager dans les ordres a longtemps été un refuge (telerama.fr)

- Ce que nous apprend l’histoire du féminisme au Québec (theconversation.com)

- Katherine Johnson : la mathématicienne qui a envoyé des astronautes dans l’espace (theconversation.com)

Si l’on a retenu les noms des premiers astronautes à faire quelques pas sur la Lune, ceux des femmes qui ont rendu possible cette prouesse sont longtemps restés dans l’oubli. Parmi elles, Katherine Johnson, qui faisait partie de ces « ordinateurs humains », de brillantes mathématiciennes dont le travail, peu reconnu à l’époque, fut pourtant essentiel pour calculer les trajectoires

Les BDs/graphiques/photos de la semaine

- Bonnette

- Gauchistes

- Normal

- Hôpital

- Sourd

- Bolchevik

- Taxe

- Justifiées

- Vu de l’étranger

- Relaxe

- Flotille

- Game

- Reminder

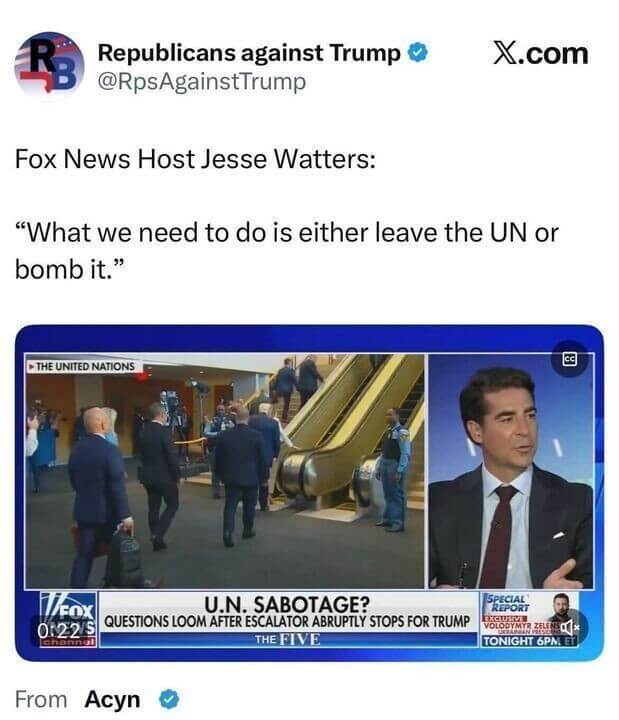

- Trump

- First Rule

- Wiokisme

- Goodall

- Mosquito

- FY

- Backdoor

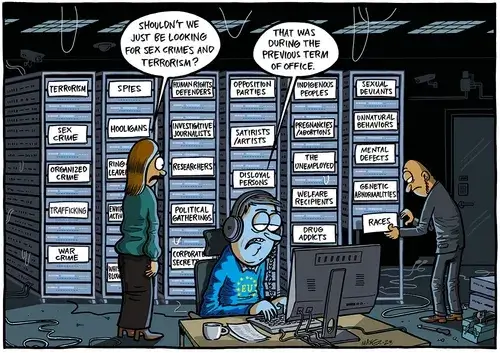

- Previous term

- IA

- Slot machines

- Upgrade

- Embrace

- Re-use

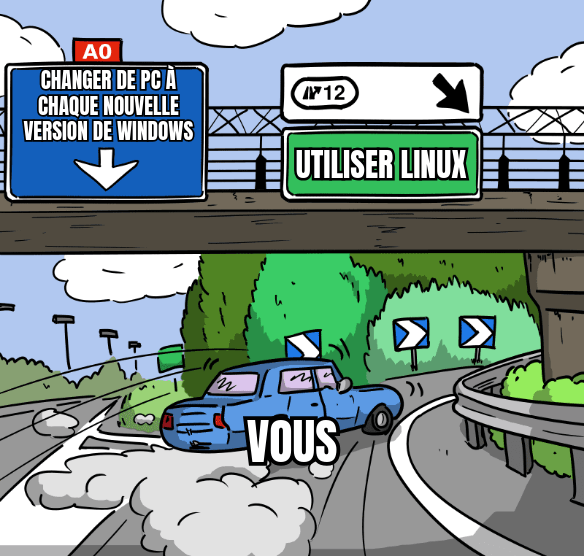

- Linux

- EndOf10

Les vidéos/podcasts de la semaine

- Affaire Darmanin : la vidéo qui jette le doute sur la probité de la procédure pour viol (blast-info.fr)

Enterrée par la cour de Cassation en 2024, l’enquête déclenchée par la plainte pour viol de Sophie Patterson contre Gérald Darmanin est examinée par la Cour européenne des droits de l’homme, saisie d’une requête qui étrille la procédure française. S’appuyant sur des documents inédits (dont une vidéo et un témoignage), Blast réouvre le dossier en retournant au commissariat du 1er district parisien en février 2018, pour une audition sous haute surveillance : alors que la plaignante est entendue dans une salle, l’avocat du ministre suspect est derrière la porte.

- Quelqu’un qui m’a dit… (Goguettes en trio mais à quatre) (indymotion.fr)

- Le boycott des produits israéliens a-t-il un impact ? (arte.tv)

Israël subit le boycott d’un nombre croissant d’entreprises et de chaînes de supermarchés qui ont temporairement retiré les produits israéliens de leur assortiment.

- Vidéo de dylls_viet sur Instagram expliquant ce qu’il se passe à Madagascar (tube.fdn.fr)

Les trucs chouettes de la semaine

- Open Printer, une imprimante open source simple et réparable (macg.co)

Un autre monde existe, ou tout du moins existera bientôt : Open Printer. Ce projet vise à simplifier le concept d’imprimante avec un modèle open source facile à utiliser et à réparer. Le projet a été partagé sur Crowd Supply, où on peut lire que l’accessoire se base sur un petit Raspberry Pi Zero W s’occupant de toute la partie calculs.

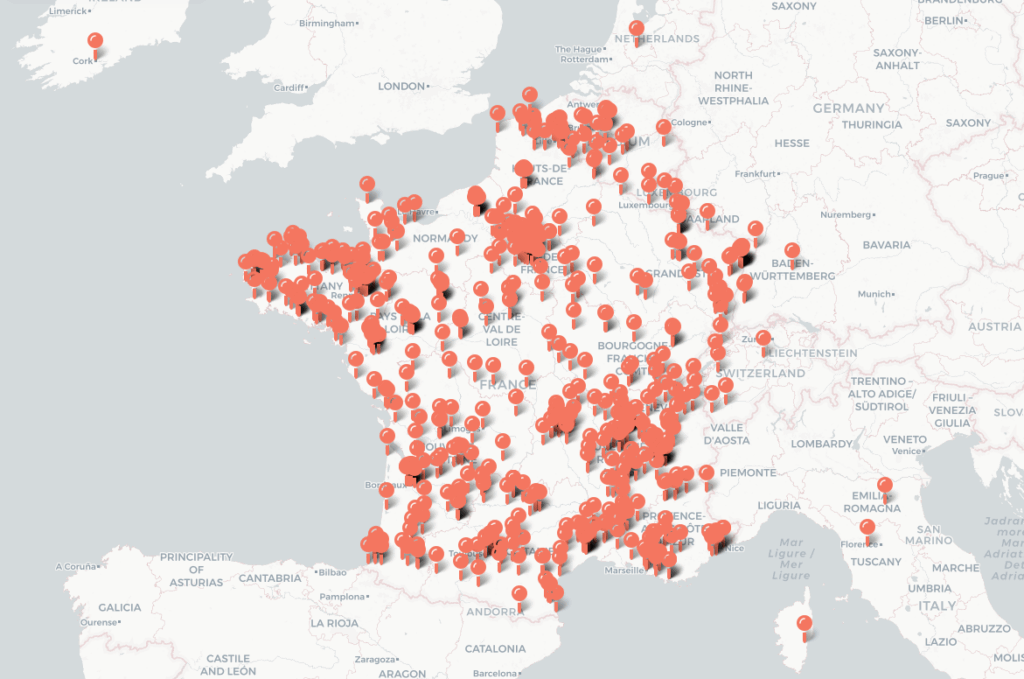

- Des parrains-marraines pour vous aider à migrer vers des distributions libres et jeter Windows par la fenêtre (aidelinux.gogocarto.fr)

- Une carte mondiale pour aider les personnes à jeter Windows par la fenêtre (endof10.org)

- Trouver un GULL (Groupe d’Utilisateurices de Logiciels Libres) près de chez vous (agendadulibre.org)

- Et rappelons qu’en parallèle des diverses campagnes “jetons Windows par la fenêtre” portées par les GULL, il y a aussi la campagne déMAILnagement pour vous aider à quitter gmail et consorts, portée par le collectif des CHATONS.

Retrouvez les revues de web précédentes dans la catégorie Libre Veille du Framablog.

Les articles, commentaires et autres images qui composent ces « Khrys’presso » n’engagent que moi (Khrys).

01.10.2025 à 13:00

Fin de Windows 10 : faisons le point

Texte intégral (4482 mots)

Vous avez peut-être entendu parler de la fin du support de Windows 10 sans forcément y prêter attention, ou vous vous demandez si ça vous concerne.

Faisons le point.

De quoi est-il question ?

Microsoft a annoncé la fin du support de Windows 10 pour le 14 octobre 2025. Le système ne recevra plus de mises à jour.

Microsoft pousse donc ses utilisateurs et utilisatrices à passer à la version supérieure, Windows 11.

Récemment, un « sursis » (appelons les choses par leur nom) d’un an a été annoncé, obtenu après pression populaire et valable uniquement pour les citoyennes et citoyens de l’Union Européenne (voir https://www.lemonde.fr/pixels/article/2025/09/26/fin-du-support-de-windows-10-microsoft-ouvre-la-possibilite-d-obtenir-une-prolongation-des-mises-a-jour_6643073_4408996.html)

Microsoft a communiqué sans entrain sur le sujet, comme le note l’association Halte à l’Obsolescence Programmée.

Cette année supplémentaire sera finalement gratuite aux dernières nouvelles, il était prévu qu’elle soit facturée $30 (environ 28€). Enfin, gratuit uniquement si vous créez votre compte sur les serveurs de Microsoft, leur laissant un accès total à vos données et votre matériel.

Mais quoi qu’il arrive, si vous avez un ordinateur un peu ancien (datant d’avant 2017), il ne pourra pas passer à Windows 11 et deviendra donc rapidement obsolète d’un point de vue logiciel. Voir : https://fr.wikipedia.org/wiki/Windows_11#Mise_%C3%A0_niveau_et_configuration_minimale_requise

Pour être tout-à-fait complet, il existe des solutions de contournement qui permettent d’installer Windows 11 sur un PC dépourvu de la fameuse puce de sécurité TPM 2.0 (installée sur les PC à partir de 2016). Mais elles mettent à mal la sécurité et même la stabilité du système. C’est dangereux.

Mais alors je fais quoi avec mon ordi ?

Ne vous découragez pas ! Continuez à lire ! Ce n’est pas une fatalité !

Est-ce que mon ordinateur va cesser de fonctionner ?

Votre ordinateur va continuer à fonctionner. Ses composantes matérielles sont toujours en bon état et conçues pour durer bien plus longtemps. Mais en l’absence de mises à jour, notamment de sécurité, le système Windows 10 va devenir vulnérable. Des virus et des personnes malhonnêtes vont pouvoir s’introduire dans la machine. Les risques sont réels, y compris dans le monde physique : surveillance de votre activité à des fins d’usurpation d’identité, chantage au verrouillage de l’ordinateur (rançongiciel), utilisation de votre boite mail pour envoyer des mails-pièges (phishing). Ce n’est pas de la science-fiction pour faire peur, c’est le quotidien des spécialistes en sécurité informatique.

Et si vous vous dites « pourquoi s’attaquerait-on à moi qui suis une personne anonyme dans la foule ? », sachez que les pirates ratissent tous azimuts, des milliers de fois par heure, toutes les cibles possibles.

Si votre ordinateur est exposé, ce n’est qu’une question de temps avant que les ennuis ne pointent leur nez.

Est-ce que je dois changer de PC ?

Si votre PC date d’avant 2017 et que vous souhaitez continuer à utiliser Windows, alors oui, il faut changer d’ordinateur. C’est-à-dire mettre au rebut un appareil qui fonctionne parfaitement et qui peut encore durer des années.

Du point de vue de l’environnement, c’est une catastrophe pure et simple. On estime à 240 millions le nombre d’ordinateurs qui vont partir à la casse (on vous a mis l’estimation basse, les chiffres changent selon les sources mais ils sont toujours énormes, une autre estimation parle de 400 millions). Or, il est démontré depuis longtemps que c’est la fabrication d’un appareil électronique qui pollue le plus dans son cycle de vie. Il est donc vertueux de conserver un appareil le plus longtemps possible si on veut minimiser son impact sur le monde.

Du point de vue du porte-monnaie, c’est aussi une très mauvaise nouvelle. Le prix des ordinateurs neufs, qui sont certes de plus en plus puissants, ne varie pas tant que ça dans le temps. C’est donc un gros investissement. Et surtout posez-vous la question : votre usage justifie-t-il d’avoir une machine ultra-puissante sur votre bureau ?

Sachez que le problème est le même pour les administrations, les associations, les entreprises. Cette histoire va coûter une fortune à la communauté toute entière, et donc à chacun et chacune d’entre nous par ricochet : votre mairie, votre école, votre employeur, les ministères, etc. Tout ça pour une décision prise aux États-Unis par une seule entreprise.

Mais pourquoi Microsoft fait ça ?

Microsoft est une entreprise capitaliste qui est là pour gagner de l’argent. Vous me direz : mon plombier aussi. Mais mon plombier ne m’oblige pas à acheter un nouveau logement parce que mon robinet est trop vieux.

Microsoft embarque sa technologie d’intelligence artificielle (Copilot) dans Windows 11. Il y a même des ordinateurs qui sont commercialisés sous le nom « Copilot+ ». Or, le développement de cette intelligence artificielle lui a coûté des fortunes, et va encore lui en coûter. Par exemple Microsoft s’est engagée à investir 25 milliards d’euros au Royaume-Uni lors de la visite de Trump.

Mais l’adoption est plus lente que prévu. Les gens ne savent pas trop quoi faire avec Copilot. À part des blagues et des comptes-rendus de réunion (on a une solution pour vous : essayez Lokas).

La Deutsche Bank a d’ailleurs publié le 27 septembre 2025 une analyse selon laquelle c’est toute l’économie des États-Unis qui est suspendue aux investissements dans l’intelligence artificielle.

Pour Microsoft, il s’agit de rentabiliser tout ça en augmentant le prix des licences (à l’achat Windows 11 coûtera plus cher que Windows 10, on parle de 145€ pour une licence « famille » contre 50€, trois fois plus). Quitte à forcer un peu la main de la clientèle, ben voyons.

À noter au passage : il a été prouvé que Windows 11 vous espionne dès son installation.

Est-ce qu’il y a une alternative au changement d’ordinateur ?

C’est le moment où jamais de tester autre chose.

Vous pouvez conserver votre ordinateur actuel et le passer sur un autre système qui a fait ses preuves : GNU Linux.

Une bonne façon, entre parenthèses (militantes), d’expliquer à Microsoft que son monde, on n’en veut pas.

C’est un choix qui se répand : la part des systèmes Linux à la maison ne fait qu’augmenter, même si elle est encore timide, rapport à la mainmise de Microsoft sur ce marché. Pensez que, bien que ce soit illégal, vous n’avez pas encore vraiment le choix du système quand vous achetez un ordinateur neuf, parce que Microsoft a signé des accords avec les constructeurs. Vous ouvrez le carton, Windows est déjà là. C’est de la vente liée, c’est interdit, mais on vous expliquera qu’un ordi vide, que vous devrez installer vous-même, ne se vendrait pas.

Cependant de plus en plus de fournisseurs de PC vous proposent des ordinateurs sans système pré-installé, ou vous laissent le choix.

Quant à la question qui nous préoccupe aujourd’hui : installer Linux sur un ordinateur que vous possédez déjà, c’est devenu très simple. Même, paradoxalement, presque plus simple que pour Windows, qui vous oblige à être connecté⋅e à Internet, à créer un compte Microsoft, etc.

Toutefois, ça peut sembler un défi insurmontable quand on est simple utilisateurice. Faites-vous aider.

Pensez à l’ennui que c’est de changer une ampoule sur votre voiture : il faut avoir des doigts de fée, travailler à tâtons, au risque de se couper, alors vous préférez demander à quelqu’un qui l’a déjà fait et c’est tout de suite plus simple. Si vous voulez vraiment apprendre comment faire, il sera toujours possible de chercher de la documentation dans un moment plus adapté. Mais l’idée, là, maintenant, c’est d’avoir de la lumière sur la voiture.

Envie de passer à Linux ? Faites-vous accompagner

D’abord c’est quoi, Linux ?

C’est un mot simplificateur. Linux est le nom du moteur qui se trouve au cœur du système. Les puristes vous reprendront en disant « GNU/Linux », mais la première partie, qui est tout aussi importante, est sortie du langage courant.

Pour schématiser à la grosse louche, c’est un système informatique issu du monde universitaire qui permet de faire tourner des ordinateurs gros comme petits (votre smartphone Android, votre box Internet, et le GPS de votre voiture tournent sur une version de Linux) et qui permet d’utiliser toute une galaxie de logiciels, la plupart du temps communautaires et gratuits. Cette définition est vraiment très simpliste, mais vous l’affinerez au fil du temps.

Quelle distribution choisir ?

Cette question n’est pas essentielle, mais il faut se la poser. En effet, les systèmes tournant avec un noyau Linux font partie, contrairement à ceux d’Apple et Microsoft plus monolithiques, d’une très vaste famille.

Une « distribution » est un ensemble constitué d’un système, d’un environnement de bureau, et de logiciels assemblés de façon à fonctionner harmonieusement. Certaines distributions sont destinées à des usages bien spécifiques ; certaines ont été pensées pour être faciles d’accès.

Un système GNU/Linux est installé avec des logiciels pour pouvoir travailler immédiatement. Licence CC By David Revoy

Les geeks passent leur temps à tester des distributions et à comparer leurs mérites et défauts. Tout le monde a son avis, tout le monde est prêt à le défendre. Vous vous y mettrez peut-être un de ces jours.

En définitive, les choses sont assez simples si vous débutez : choisissez des distributions orientées « grand public », de façon à trouver facilement de la documentation et de l’aide. N’allez pas vous embringuer dans des solutions exotiques qui vont vous donner du fil à retordre.

Citons par exemple Emmabuntüs, Ubuntu ou Fedora qui sont conçues pour vous faciliter leur adoption et pourvues d’une abondante documentation en français.

J’ai peur de ne rien comprendre à Linux

Est-ce que vous savez réellement comment fonctionne votre Windows actuel ? Ou votre smartphone ? Ou même votre box Internet ?

Dans un premier temps, vous n’aurez pas besoin de tout savoir sur Linux pour l’utiliser. Quelques explications suffiront. Vous apprendrez en marchant et vous ne saurez jamais tout, mais ça n’est pas grave. Personnellement je considère encore que l’embrayage est un truc magique, je n’y comprends rien. Mais je démarre quand même au feu vert.

La plupart des geeks, lassés de passer leurs congés de fin d’année ou leurs soirées à dépanner les appareils Windows familiaux, ont migré tout le monde sous Linux. Et devinez quoi ? Nous recevons beaucoup moins de sollicitations qu’avant !

Ça fonctionne aussi bien que Windows ?

Si vous posez cette question à une personne qui utilise Linux, la réponse sera probablement « ça fonctionne mieux », avec le sourire légèrement condescendant de circonstance.

Les systèmes Linux ont d’énormes avantages : ils sont conçus pour être à la fois connectés et étanches, parce que leurs origines sont là. La plupart des ordinateurs qui font tourner Internet sont sous Linux, il a donc fallu faire en sorte que la sécurité et l’interopérabilité soient au rendez-vous. Les distributions destinées à nos appareils personnels sont des déclinaisons de systèmes conçus pour préserver leur intégrité face aux attaques, à une augmentation de la charge de travail, aux pannes, aux coupures du réseau.

En gros, faire tourner Linux sur votre PC, c’est comme si vous demandiez à la directrice d’un hypermarché de gérer la supérette du coin. Elle va parfaitement faire le job, voire s’ennuyer un peu.

Attention tout de même (ben oui, il y a un bémol) si vous sortez des sentiers battus de la bureautique familiale et que vous utilisez des applications professionnelles ou spécialisées. Vérifiez qu’il existe un équivalent sous Linux, ce qui est très probable, mais attendez-vous à devoir apprendre de nouvelles habitudes. Il s’agira d’un équivalent, d’une alternative, pas de la même application. Donc si une activité essentielle pour vous se trouve dans votre ordinateur en dehors de la consultation d’Internet, de vos mails, des réseaux sociaux, en bref des usages les plus classiques, notez bien que ça va vous demander un effort plus ou moins grand, comme pour n’importe quel changement.

Passer de Windows à Linux, c’est un peu comme déménager : on ne prend plus les mêmes routes pour rentrer chez soi, les clés ne fonctionnent pas pareil, la boulangerie est différente, il faut mémoriser le nouveau code de l’immeuble, mais au final on dort toujours dans son lit et on est capable de se faire des nouilles dans la nouvelle cuisine.

Même une passion assez répandue comme la photographie va vous demander un peu de boulot : les applications de traitement de photos (DarkTable, Gimp, RawTherapee) sont puissantes et efficaces sous Linux, mais elles demandent à être apprivoisées. Pourquoi ne pas les essayer dès aujourd’hui ? Elles existent aussi sous Windows ! Quel nombre d’heures avez-vous passé sur LightRoom et Photoshop avant de savoir vous en servir ?

Combien ça coûte ?

Nous avons une bonne nouvelle pour vous : la plupart des distributions Linux sont entièrement gratuites. Ça ne veut pas dire qu’il ne faut rien donner en échange. Vous pourrez contribuer à l’effort collectif en versant votre écot à une association, à l’équipe qui assure la maintenance de votre logiciel favori, ou encore en donnant un coup de main à votre tour dans votre entourage.

J’ai VRAIMENT un vieux PC ; est-ce qu’il y a une version de Linux pour moi ?

Il existe des distributions Linux « légères » qui peuvent faire tourner du vieux matériel. Pour vous expliquer, toujours en schématisant un peu, le socle reste le même (notamment « le noyau », développé il y a 34 ans par M. Linus Torvalds, ce qui vous explique pourquoi on l’appelle comme ça) mais on met des applications moins gourmandes et un environnement de bureau plus économe. On sacrifie à l’élégance pour donner du souffle au PC. Les icônes sont moins jolies et il n’y a pas d’effets graphiques époustouflants, mais ça fonctionne. Cet article est écrit sur un engin qui a plus de 15 ans et qui est mon ordinateur principal.

Autre atout : la structure compartimentée du système le rend plus robuste ; on peut par exemple se passer complètement d’un antivirus (qui sont devenus, pour être tout-à-fait honnête, moins gourmands qu’autrefois).

Il est aussi possible de donner un coup de fouet à une vieille machine en lui greffant de la mémoire supplémentaire et un disque dur moderne (SSD), ce qui revient bien moins cher que d’en racheter un (environ 200 euros). Mais la version 11 de Windows nécessite un composant matériel que vous ne pourrez pas ajouter dans votre vieux PC.

C’est fait exprès. C’est pour en vendre.

Comment me faire aider ?

En effet, se lancer dans son coin reste délicat, même si c’est faisable. Il y a des tutoriels partout sur Internet.

L’April, l’association pour la promotion et la défense du Logiciel Libre (dont Framasoft est membre) a lancé ce premier octobre 2025 (et pour un an) l’opération Adieu Windows, bonjour le Libre ! Retrouvez tous les événements organisés par des Groupes d’Utilisateurices de Logiciels Libres (GULL) sur le site https://adieuwindows.april.org ou sur l’Agenda du Libre.

Install-parties , permanences, rendez-vous numériques, points infos ou repair cafés, il y a forcément un évènement qui sera organisé près de chez vous. Venez avec votre ordi, des bénévoles vous aideront à installer une distribution libre (n’oubliez pas de sauvegarder vos données avant, par exemple en achetant un disque dur externe pour quelques dizaines d’euros).

Aide Linux est une initiative constituée de bénévoles qui interviennent à titre individuel. Retrouvez les sur https://aidelinux.gogocarto.fr/map#/

En conclusion

C’est le moment. C’est le moment de sauter le pas, de faire un bras d’honneur à Microsoft et de passer à un système élégant, libre et respectueux, tout en conservant votre matériel.

Votre ordinateur gardera ses possibilités d’évolution, sans chantage, sans coût supplémentaire, pendant des années.

Il ne vous espionnera pas, et vous en aurez la maîtrise.

Il ne vous fourguera pas de la publicité toutes les cinq minutes. Voire, bien réglé, il vous en protégera.

N’attendez pas d’être au pied du mur l’an prochain.

C’est le moment de reprendre votre liberté !

Pour aller plus loin

Page officielle de Microsoft : https://support.microsoft.com/fr-fr/windows/windows-10-support-prend-fin-le-14-octobre-2025-2ca8b313-1946-43d3-b55c-2b95b107f281

La pétition :

https://www.halteobsolescence.org/non-taxe-windows-coalition-22-organisations-maintien-mises-a-jour-de-securite-windows-10/

Reportage « l’œil du 20H » : https://youtu.be/76T8oubek-c?si=NYCcDMHfrHJx9_R3

Admirez la virtuosité des journalistes pour éviter de parler de Linux.

Un site dédié à la fin de Windows 10 : https://endof10.org/fr/

Report de la fin du support : https://www.presse-citron.net/microsoft-windows-10-sursis-un-an/

Article récent de Next : https://next.ink/201908/fin-de-windows-10-que-faire/

Distributions :

Le problème pour les institutions :

https://www.lesnumeriques.com/appli-logiciel/une-gabegie-de-ressources-pour-le-public-l-environnement-et-les-finances-publiques-une-petition-s-erige-contre-la-fin-de-vie-programmee-de-windows-10-n242395.html

Et la solution : https://www.cio-online.com/actualites/lire-jean-marie-seguret-dsi-de-lyon–se-soustraire-de-microsoft-impose-un-travail-de-fond-16527.html

Les systèmes basés sur Linux sont désormais à la portée de tout le monde :

https://abilian.com/fr/news/2-millions-utilisateurs-linux-france/

https://cnll.fr/news/linux-en-france-2-millions-utilisateurs/

Merci à David Revoy qui a réalisé les dessins illustrant cet article. Même mon fond d’écran est un dessin de David.

29.09.2025 à 20:00

Chat Control, ça s’en va… et ça revient

Texte intégral (4424 mots)

La directive dite Chat Control, actuellement discutée au niveau européen, pourrait bouleverser en profondeur nos usages numériques quotidiens. Présentée comme une mesure pour lutter contre la pédocriminalité en ligne, elle obligerait les services de messagerie et de communication à analyser systématiquement tous les messages, photos et vidéos échangés par les utilisateurs, y compris les conversations privées chiffrées. En clair, cela reviendrait à instaurer une surveillance de masse automatique, sans distinction entre suspects et citoyens ordinaires. Si ses objectifs affichés paraissent légitimes, les moyens proposés posent de graves questions de respect de la vie privée, d’efficacité réelle, et de compatibilité avec les droits fondamentaux. Cet article revient sur les principaux enjeux et dérives possibles de Chat Control, afin d’éclairer un débat qui, au-delà de la technique, concerne la liberté de chacun à communiquer sans être épié.

Dans La baleine et le réacteur, Langdon Winner montre (chap. 8) que les politiques encadrant les technologies se réduisent souvent à une analyse des risques. On compare risques et bénéfices, sans considérer que le risque est souvent perçu de manière subjective — peur légitime ou courage — et comporte toujours une part irrationnelle, même si, dans l’histoire, on a multiplié des instruments efficaces de mesure du risque. Winner souligne que fonder une décision politique sur la mesure du risque oblige les opposants à prouver que le bénéfice ne vaut pas le préjudice, lequel devient alors une conséquence acceptable plutôt qu’un problème en soi.

C’est cette manière d’envisager les choses qui prévaut depuis mai 2022 lorsque la Commission Européenne a présenté un projet de Règlement (COM(2022) 209) dans le cadre de sa stratégie relative à « un Internet plus sûr pour les enfants ». Porté par la DG Home, le projet s’inscrit dans un programme général de prévention des abus sexuels sur mineurs (Child Sexual Abuse Regulation, CSAR). Le projet CSAR est surnommé Chat Control par ses détracteurs, insistant par là sur les conséquences hautement préjudiciables du projet sur les droits fondamentaux. Tout se passe néanmoins comme si le débat ne se limitait qu’à un compromis rendu obligatoire au nom des droits de l’enfance entre politique sécuritaire et liberté de communiquer.

Comme vous le verrez plus bas, le projet est toujours sur la table des négociations et il faut cette fois encore se mobiliser (avant le 14 octobre prochain !)

Pourquoi est-ce la Commission Européenne et non le Parlement qui a proposé ce projet de régulation ? Il appartient à la Commission de traduire dans les décisions la volonté politique de l’UE. L’exposé des motifs présente donc les arguments non pas sous l’aspect politique mais sous l’aspect de l’expression d’un besoin constaté :

- les abus sexuels sur mineurs en ligne seraient en forte augmentation,

- les outils actuels seraient insuffisants pour détecter et supprimer les contenus pédocriminels,

- il faudrait un cadre juridique harmonisé dans l’UE pour obliger les plateformes à détecter ces contenus,

- en tant qu’organe exécutif, la Commission agit dans le cadre de ses mandats, notamment l’article 114 et l’article 83 du Traité sur le fonctionnement de l’Union Européenne, et propose donc un projet de régulation.

Dès l’instant que la Commission Européenne propose un dispositif de lutte contre la pédocriminalité, le débat est biaisé car il ne s’agit plus de discuter des effets probables du dispositif en matière d’éthique, d’équité, ou même de politique : le sujet est posé, il lui faut une solution technique. Toute controverse implique d’abord de se départir de l’accusation implicite de vouloir remettre en cause la protection de l’enfance. C’est au nom de l’article 24 des Droits fondamentaux de l’UE (droits de l’enfant), qui font écho avec la Charte des Nations Unies, que le principe fondamental du projet de régulation est posé. Mais ce faisant, on peut toutefois s’interroger : peut-on ériger un droit fondamental au dessus des autres ? Le principe de l’égalité des droits fondamentaux semble le contredire, mais dans certains cas, la situation peut être déclarée temporaire. C’est dans cette brèche que s’engouffrent la plupart des problématiques touchant à la surveillance électronique : par exemple, quel équilibre trouver entre le droit à la liberté d’expression et la protection de la vie privée ? vieux problème, n’est-ce pas ?

Dans une telle situation, le préjudice est à la mesure du risque : d’un côté le risque d’une croissance de la pédocriminalité, de l’autre la confidentialité des communications. Par son projet de régulation, la Commission ne prétend pas résoudre un dilemme, elle prétend d’emblée vouloir trouver une solution technique qui puisse satisfaire la tension entre risque et préjudice. La conséquence est la négation du système économique, social et politique dans lequel s’inscrit ce solutionnisme.

Pourquoi Framasoft en parle ?

En tant qu’association d’éducation populaire, voilà des années que nous promouvons les solutions alternatives, respectueuses de données personnelles des utilisateurs et permettant à chacun d’exercer son droit à la communication privée. C’est pour cela que nous avons à multiples reprises plébiscité les solutions… les moins pire. L’utilisation de Signal, par exemple risque d’être très largement empêchée en cas de compromis fonctionnel du CSAR entre les pays européens. La présidente de Signal, Meredith Whittaker, s’est clairement prononcé pour un retrait de l’application du marché européen si tel était le cas.

D’autres solutions existent et on peut en trouver une petite liste dans ce billet. Néanmoins, alors que voilà déjà deux ans que nous avions relayé la mobilisation à l’encontre de Chat Control, force est de constater une très forte insistance de certains élus européens et des institutions elles-mêmes à l’encontre du chiffrement et du droit à la communication privée.

Notre responsabilité ne consiste pas seulement à promouvoir des logiciels libres mais aussi de prévenir les utilisateurs des effets potentiellement sacrificiels auxquels ils s’exposent. Dans un monde où l’utilisation de technologies de chiffrement n’est plus associée à la vie privée et à l’hygiène numérique mais à un comportement potentiellement suspect, nous sommes en devoir de les alerter et de participer à la mobilisation.

- La Quadrature du Net se mobilise depuis longtemps sur cette question.

- Les Chatons se sont groupés contre Chat Control

- French Data Network prévenait déjà au mois d’août

- Une pétition existe sur change.org

- Un site recense la position de nos élus sur le CSAR

- On peut aussi se mobiliser plus activement en contactant les députés

Client-side scanning

Le texte de la proposition CSAR ne mentionne pas explicitement les techniques censées être utilisées dans le cadre de la surveillance des communications interpersonnelles. Il laisse cependant des portes ouvertes en ces termes (texte initial) :

(…) le processus de détection est, de manière générale, le plus intrusif pour les utilisateurs (…), vu qu’il nécessite l’examen automatique du texte des communications interpersonnelles. Il importe, à cet égard, de tenir compte du fait qu’un tel examen est souvent la seule manière de détecter de tels abus et que la technologie utilisée ne « comprend » pas le contenu des communications, mais y recherche plutôt des schémas connus, définis à l’avance, qui indiquent la possibilité d’un pédopiégeage.

L’analyse automatisée des messages privés est par nature incompatible avec le chiffrement de bout en bout. Mais la Commission ne peut pas affirmer explicitement que le chiffrement de nos communications présente en soi un danger pédocriminel, en particulier parce que le chiffrement des communications est nécessaire dans bien des cas d’usage : pensez par exemple lorsque vous communiquez avec votre banque. La seule conclusion qui s’impose, et qui fait primer la logique sur l’éthique (et même l’économie), c’est que l’analyse doit être faite avant chiffrement, donc sur le dispositif lui-même, votre smartphone, votre ordinateur, avec l’application utilisée. Charge aux fournisseurs de se débrouiller pour mettre en place un dispositif de contrôle automatique, c’est-à-dire ouvrir une porte (une backdoor) pour scanner ce que vous faites. Imaginez par exemple être épié par dessus votre épaule lorsque vous écrivez une lettre : personne ne vous empêche de la mettre sous enveloppe et la poster, par contre un tiers aura analysé, et donc lu, ce que vous avez écrit.

C’est ce qu’on appelle le client-side scanning (CSS). L’annexe 9 (pages 284 sq) de l’étude d’impact de la proposition de régulation porte sur la question du difficile équilibre entre le droit à la communication privée (le chiffrement des communication) et la détection de contenus pédocriminels. La solution qui semble la meilleure à retenir en l’état consiste à réaliser un scan et une analyse de correspondance directement sur le dispositif lui-même ou sur un serveur distant avant l’envoi du contenu au destinataire (voir p. 309 et p. 310).

On peut noter hélas que cette annexe technique est rédigée un peu à la va-vite. Par exemple, la question de l’évaluation des risques de faux positifs liés aux contenus pédocriminels sont réduits à des chiffres épars notamment fournis par des dispositifs qui, eux, ont tout intérêt rassurer. Par exemple PhotoADN, fourni par Microsoft, qui estime à 1/50 milliards le nombre de faux positifs (voir note p. 281 : comment est-évalué ? avec de l’IA ?). Par ailleurs, servant la soupe à l’approche comparative des dispositifs envisagés, on peut noter le lobbying assez intense de la « fondation » Thorn qui s’est positionné pour promouvoir son dispositif de surveillance auprès des fonctionnaires européens, ce qui fut assez commenté et documenté dès 2022.

En réalité, tout le projet s’expose à des contradictions assez évidentes avec les dispositions mêmes de l’Union Européenne :

- L’article 7 de la Charte des droits fondamentaux de l’UE qui garantit le respect de la vie privée et des communications : « Toute personne a droit au respect de sa vie privée et familiale, de son domicile et de sa correspondance ».

- Le principe de proportionnalité : les mesures proposées sont disproportionnées par rapport à l’objectif poursuivi et généralise le caractère potentiellement criminel de toute activité de communication privée. Tout le monde serait un pédocriminel en puissance.

- Malgré l’exhaustivité de l’étude d’impact, le projet ne prévoit pas de mécanismes clairs pour éviter les abus ou limiter l’usage du CSS à la seule lutte contre la pédocriminalité sur Internet.

Du côté de la société civile, on note depuis 2022 la multiplication des analyses techniques démontrant que le CSS est une mauvaise solution. Comme le rappelle l’Internet Society, l’analyse côté client :

- est à la source d’une augmentation de la surface d’attaque des dispositifs exposant ainsi les individus à un risque accru de criminalité profitant de ces vulnérabilités,

- pose un ensemble de défis quasiment insurmontables : la puissance de traitement pour pouvoir analyser tous les contenus en temps réel, la maintenance des bases de données, le contrôle de ces bases de données (qui a accès ? qui contrôle ?),

- expose à des détournements à d’autres fin que la lutte contre la pédocriminalité : la surveillance de masse à des fins répressives.

Depuis 2022, les prise de position se multiplient à l’avenant. En 2023, le Contrôleur européen de la protection des données lui-même dans un communiqué concluant un séminaire spécialement consacré, qualifie le projet CSAR comme une tentative inadaptée, inefficace, et potentiellement nuisible. Un an plus tard, Netzpolitik rapporte encore :

Depuis des années, des légions d’experts en informatique et chercheurs en sécurité, des juristes, des experts en protection des données, des organisations numériques, des entreprises technologiques, des fournisseurs de messagerie, des représentants des Nations Unies, des experts en protection de l’enfance, des gardiens des normes Internet, des scientifiques et toutes sortes d’experts ont tiré la sonnette d’alarme dans le monde entier : Chat Control est dangereux. Il s’agit d’une nouvelle forme de surveillance de masse. Elle affaiblira la sécurité informatique de chacun d’entre nous. Elle introduirait une infrastructure de surveillance sur les applications et les terminaux au-delà de l’UE, que les États autoritaires utiliseraient à leur avantage.

Les arguments sont controversés mais attention aux fachos

Considérant que l’expertise ne lui était guère favorable, la Commission Européenne a beaucoup communiqué pour promouvoir son projet. Le député européen Patrick Breyer (Verts/Alliance Libre, membre du Parti Pirate) a réalisé un long dossier sur Chat Control dans lequel il démonte plusieurs arguments fallacieux utilisés par la Commission (voir en anglais et en français). Il ici inutile de les répéter, le dossier étant sur ce point assez complet.

En revanche, la saga de la Commission fut émaillée de plusieurs épisodes pour le moins affligeants. Par exemple, cette affaire de pantouflage de deux agents d’Europol chez Thorn, la multiplication de réunions à rythme soutenu pour passer le projet en force, les eurodéputés eux-mêmes qui ne veulent pas de surveillance de masse, etc.

Un épisode de cette saga mérite toutefois de s’y attarder un peu. Celui de l’affaire de microciblage illégal employé par la Commission pour communiquer auprès du public des Pays Bas afin de faire tourner l’opinion en sa faveur. Ce qui est intéressant, dans cette histoire, c’est que ce microciblage visait à exclure des groupes dont les opinions sont plus ou moins proches de l’extrême droite. La raison est à la fois trouble et double. En premier lieu parce que la rapporteuse initiale du projet, la suédoise Ylva Johansson est à l’aile gauche du parti social-démocrate suédois. Un échec de ses multiples prises de parole verrait sa position pro-européenne battre de l’aile, une position qui, encore récemment, mise énormément sur la recherche de compromis entre les pays européens, en particulier en faveur d’une politique migratoire accueillante. En second lieu, il faut prendre en compte que Chat Control est aussi bien décrié par les élus européens d’extrême droite qui y voient un double avantage : d’une part démontrer que l’UE remet en cause les principes souverainistes auxquels ils adhèrent et d’autre part leur permet à peu de frais de se positionner en défenseurs des libertés. Pour les élus français on peut voir par exemple la lettre écrite par Virginie Joron et Tom Vandendriessche sur X ou cette Question à la Commission par Mathilde Androët. Bien sûr, il s’agit d’une question d’affichage et de posture, mais voir nos principes fondamentaux défendus par une engeance pareille me fait vraiment froid dans le dos (remarquons toutefois que ce genre de position est à géométrie variable, puisque les illibéraux fascisants comme Viktor Orban sont plutôt favorables à des logiciels espions comme Pegasus, plus discrets sans doute…).

Les compromis ont bon dos

En fait, si l’on regarde bien la chronologie de la proposition de Règlement, les multiples réunions de compromissions se soldant ou non par des accords, elle suit une route parfaitement rectiligne jusqu’à aujourd’hui. Devant les désaccords, les présidences tournantes du Conseil n’ont jamais cessé de remettre le projet sur la table, montrant ainsi que plusieurs pays le soutiennent activement et que le texte risque de devenir un sujet particulièrement clivant.

Il se trouvait néanmoins qu’en juin 2024 on pouvait croire la situation définitivement bloquée. En effet, alors que la Belgique avait tenté de remettre un proposition de compromis qui relançait le débat sur le client-side scanning, plusieurs pays ont annoncé leur refus de principe ou leur abstention. Comme le projet n’avait alors aucune possibilité de trouver un accord qualifié, le Conseil l’avait donc supprimé de l’ordre du jour. Venait ensuite la présidence de la Hongrie et son gouvernement particulièrement pro-surveillance, qui relança… heureusement encore un échec, appuyé notamment en août 2024, par une lettre ouverte de plus de 300 chercheurs européens montrant que « les solutions techno-centrées basées sur la surveillance ne sont pas une bonne option pour lutter contre la propagation des contenus pédocriminels ». Entre-temps l’Autriche s’est abstenue, et la Pologne a proposé une refonte assez radicale, fidèle à sa position selon laquelle le projet CSAR est bien trop intrusif (elle privilégiait la détection volontaire sur le mode de la prévention (les fournisseurs signalent d’eux-mêmes les contenus illicite). D’autre pays encore s’étant positionnés à l’encontre, les compromis sont restés hasardeux.

Sauf que… le 1er juillet 2025, le Danemark a pris la tête du Conseil de l’Union européenne et a relancé un projet de compromis. Les négociations seraient censées aboutir à une validation du texte le 14 octobre 2025. Une étude assez complète du texte du compromis danois peut-être trouvée sur edri.org. On retrouve le retour de la détection obligatoire (et de masse) cette fois automatisée par IA, le client-side scanning avec un consentement plus ou moins rendu obligatoire ( !), la classification de tous les systèmes de messagerie chiffrés comme étant à haut risque (donc aucune exception), un système de vérification d’âge (dont on connaît déjà les limites, ne serait-ce qu’en termes de faisabilité et de fiabilité et qui exclurait d’emblée les enfants de la possibilité d’utiliser du chiffrement).

Avec un peu d’optimisme, Edri.org note toutefois :

Étant donné que bon nombre de ces éléments sont précisément à l’origine de l’opposition de longue date de la minorité de blocage (les 11 États membres qui empêchent l’adoption du règlement CSA au Conseil), il est évident que les Danois courent à un nouvel échec. Leur tentative ressemble davantage à un exercice de relations publiques qu’à une véritable volonté de faire avancer les choses…

À l’heure de la rédaction de cet article, bien que quelques médias secondaires affirment que la France s’est enfin positionnée et serait favorable à une mouture du projet proposé par le Danemark, aucune position officielle du gouvernement Français n’est parue… Mais… récemment encore, en mars 2025, le gouvernement de Bruno Retailleau était prêt à beaucoup de concessions avec les libertés pour surveiller les communications à l’encontre du chiffrement. Cela fait suite à de nombreuses tentatives de limitation du droit des correspondances dans l’histoire récente de la France. Ainsi, il fut nullement étonnant de voir les représentants du gouvernement français dans le groupe de travail sur l’application de la loi du 12 octobre 2025 (version diffusée par la représentation allemande ; ce groupe de travail vise à préparer et coordonner les décisions politiques liées à la coopération policière européenne) tenir la position favorable suivante :