27.04.2026 à 07:42

Khrys’presso du lundi 27 avril 2026

Texte intégral (8383 mots)

Comme chaque lundi, un coup d’œil dans le rétroviseur pour découvrir les informations que vous avez peut-être ratées la semaine dernière.

Tous les liens listés ci-dessous sont a priori accessibles librement. Si ce n’est pas le cas, pensez à activer votre bloqueur de javascript favori ou à passer en “mode lecture” (Firefox) ;-)

Brave New World

- In Australia, platforms skirt age laws, but the problem isn’t age assurance tech (biometricupdate.com)

- Most Australian teens admit the social media ban isn’t working as they try to sidestep age verification blocks with face masks and their parents’ IDs (fortune.com)

- Asia’s clean power transition accelerates fall in global fossil-fuel use (asia.nikkei.com)

- La Chine instrumentalise la crise énergétique pour faire pression sur les Philippines (legrandcontinent.eu)

- India will not force smartphone makers to preinstall Aadhaar app (biometricupdate.com)

Following pushback from smartphone manufacturers such as Apple and Samsung, the Indian government has abandoned its plans to pre-install the Aadhaar biometric authentication app on all new mobile devices sold in India.

- Across Africa, farmers are adopting regenerative agricultural practices that support food sovereignty amid global instability (resilience.org)

- At least 5 dead in Burundi from a mystery illness (cidrap.umn.edu)

An outbreak of a mystery illness in Burundi, a landlocked country located in Africa’s Great Lakes Region, has killed at least five people and sickened 35 others since March 30—a case-fatality rate of 14 %.

- En Russie, Internet est en train de disparaître (legrandcontinent.eu)

- Norway plans to ban social media use by children under 16 (reuters.com)

- La politique anti-LGBT+ de la Hongrie est bel et bien contraire au droit européen (huffingtonpost.fr)

La Hongrie a « violé le droit de l’Union » en « stigmatisant et marginalisant » les personnes LGBT+, a tranché la Cour de justice de l’Union européenne.

- Suisse : Vasectomie en hausse chez les jeunes (lecourrier.ch)

- La ville belge de Namur rompt son jumelage avec Menton, passée à l’extrême droite (huffingtonpost.fr)

La capitale de la Wallonie a décidé, le 21 avril dernier, de mettre fin à son jumelage de 70 ans avec la ville de Menton dans les Alpes-Maritimes. En cause : l’élection un mois plus tôt à la mairie d’Alexandra Masson, la candidate du Rassemblement national.

- Le WWF appelle les Grecs à manger des espèces invasives pour protéger la faune marine (huffingtonpost.fr)

Face à la prolifération d’espèces marines non indigènes, l’ONG recommande de modifier les habitudes de consommation pour soutenir les pêcheurs et préserver les écosystèmes locaux.

- Construire des digues ou déplacer le patrimoine ? Quatre scénarios pour sauver Venise (reporterre.net)

- Prendre le train en Europe : un casse-tête qui favorise l’avion (reporterre.net)

- Derrière la vague de dérégulation, des institutions européennes de plus en plus soumises aux industriels (multinationales.org)

- À Bruxelles, une succession de reculs pour la santé, les droits et la transparence (multinationales.org)

- Europe—not US—first to authorize Moderna’s combo mRNA flu-COVID vaccine (arstechnica.com)

Amid RFK Jr.’s anti-vaccine agenda, Moderna withdrew its FDA application last year.

- La politique antiaméricaine et pro-migrants de Pedro Sánchez : « Le socialiste espagnol se positionne en leader de la gauche occidentale ». (nouvelobs.com)

- « En Espagne, la démocratie se défend par la mémoire » : le gouvernement espagnol décide la dissolution de la fondation Franco (humanite.fr)

Lors de l’anniversaire de la Deuxième République espagnole, le 14 avril dernier, le gouvernement espagnol a franchi la dernière étape menant à la dissolution de la fondation Franco, 50 ans après sa création.

- Des militant·es de Greenpeace installent des éoliennes dans le golf de Trump en Écosse (huffingtonpost.fr)

Les activistes écologistes se sont rendu·es sur le complexe de golf de Donald Trump à Turnberry, en Écosse, pour faire quelques ajustements sur son green.

- UK government says 100 countries have spyware that can hack people’s phones (techcrunch.com)

More than half of the world’s governments have access to commercial spyware that can break into computers and phones to steal sensitive information, according to U.K. intelligence.

- « Se préparer à une éventuelle guerre » : face aux menaces des États-Unis, Cuba organise sa défense (humanite.fr)

- Expecting driverless taxis to respect bike lanes “too high a bar” – because customers want to be dropped off in them, autonomous vehicle firm Waymo tells cyclists (road.cc)

- Zoom has partnered with World, Sam Altman’s iris-scanning identity company (previously known as Worldcoin), to add real-time human verification inside meetings. (digitaltrends.com)

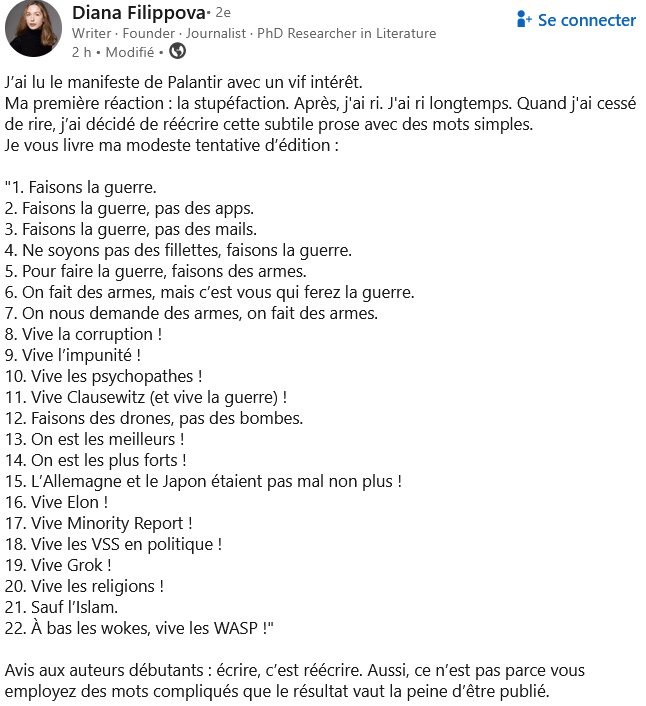

- Palantir posted a manifesto that reads like the ramblings of a comic book villain (engadget.com)

In case you haven’t gotten around to reading Palantir CEO Alex Karp and Nicholas W. Zamiska’s 2025 book, The Technological Republic, (because why would you do that to yourself ?), the company best known for supplying AI-driven defense and surveillance software to the likes of the US Army, ICE and NYPD shared a 1,000-word X post this weekend covering its main points.

- Palantir employees are talking about company’s “descent into fascism” (arstechnica.com)

- Smart glasses and the new DHS surveillance budget (biometricupdate.com)

The Department of Homeland Security’s […] budget justification lays out an expansive biometric and identity tech agenda that stretches from airport checkpoints to ports of entry to immigration enforcement operations, with one of the most striking items buried in the Science and Technology Directorate’s research portfolio : a plan to develop operational prototypes of smart glasses for immigration enforcement agents.

- Trump fires all 24 members of the U.S. National Science Foundation’s governing body (science.org)

- Les États-Unis de Donald Trump rétablissent la peine de mort par peloton d’exécution (huffingtonpost.fr)

Le ministère américain de la Justice veut faciliter le recours à la peine capitale dans les dossiers fédéraux, en allant au-delà de la seule injection létale.

- Prosecutors sought death penalty for Luigi Mangione but not white supremacist behind 2019 Texas Walmart shooting (snopes.com)

A pair of authentic news headlines accurately stated that the U.S. Department of Justice directed prosecutors to seek the death penalty for UnitedHealthcare CEO shooting suspect Luigi Mangione, whereas prosecutors offered a gunman who killed 23 in a racist attack at a Texas Walmart a plea deal to avoid the same sentence.

- Donald Trump évacué du dîner des correspondants à la Maison Blanche après l’irruption d’un homme armé (huffingtonpost.fr)

- Les États-Unis sont devenus une puissance créancière inversée (legrandcontinent.eu)

Privée de son instrument tarifaire, l’administration Trump improvise, et révèle ainsi que sa vision économique est fondée sur une illusion : celle de pouvoir simultanément taxer, attirer les capitaux, relocaliser l’industrie et préserver la domination du dollar sans en payer le prix.

- Maryland becomes first state to pass bill banning ‘surveillance pricing’ (denver7.com)

The practice refers to companies using a shopper’s personal data, such as browsing history, location, or purchasing behavior, to tailor prices to individual customers.

- Maine Passes Millionaires’ Tax and Pushes Back on Federal Changes (itep.org)

- New Gas-Powered Data Centers Could Emit More Greenhouse Gases Than Entire Nations (wired.com)

- Maine Governor Vetoes Data Center Moratorium Bill (yro.slashdot.org)

Maine Gov. Janet Mills vetoed a bill that would have imposed the nation’s first statewide moratorium on new data centers, saying she supported the idea in principle but would not block a major redevelopment project tied to jobs and local investment.

- Community Votes to Deny Water to Nuclear Weapons Data Center (404media.co)

Ypsilanti Township in Michigan is attempting to cut off the flow of water to a planned data center that would power a new generation of nuclear weapons research. On Wednesday, the Township’s Board of Trustees voted to institute a 365 day moratorium on the delivery of water to hyperscale data centers so the township can study the impact of the building’s massive water needs.

Spécial IA

- On a tenté de tuer Sam Altman, et ce n’est que le début : le mouvement anti-IA prend de l’ampleur (ladn.eu)

Attaque contre le domicile de Sam Altman, lutte contre l’implantation de data centers et incitation à ne plus l’utiliser au travail : un peu partout dans le monde, un vent de révolte se lève contre l’IA.

- Le revenu universel élevé, la pilule des gourous de la Tech pour mieux faire passer l’IA (france24.com)

Elon Musk a assuré vendredi que le revenu universel représentait probablement la meilleure solution face à la destruction annoncée d’emplois provoquée par l’IA. Le multimilliardaire pro-Trump rejoint ainsi d’autres gourous de la Tech qui soutiennent cette mesure phare afin de réduire le rôle de l’État.

- L’entreprise chinoise DeepSeek annonce un nouveau modèle d’intelligence artificielle (france24.com)

Un an après avoir secoué le monde de l’intelligence artificielle (IA) en dévoilant un agent conversationnel bien plus économique que ses concurrents américains, le chinois DeepSeek a lancé vendredi un nouveau modèle d’IA plus performant et basé sur l’open source.

- Qu’est-ce que Objection.AI ? La nouvelle plateforme financée par Peter Thiel qui accélère le contrôle de la presse aux États-Unis (legrandcontinent.eu)

- Deezer : L’IA génère près de la moitié des titres mis en ligne chaque jour sur la plateforme musicale (20minutes.fr)

La plateforme assure toutefois les retirer de ses recommandations et en démonétiser certains

- Meta will train AI agents by tracking employees’ mouse, keyboard use (arstechnica.com)

- Pour financer l’IA, Meta va licencier 8 000 personnes, Microsoft lance un plan de départs volontaires (france24.com)

Meta, la maison mère de Facebook et Instagram, a annoncé jeudi le licenciement d’environ 10 % de ses effectifs, soit 8 000 salariés, afin de compenser ses investissements massifs dans l’intelligence artificielle (IA). De son côté, Microsoft a fait part d’un plan de départs volontaires qui pourrait concerner jusqu’à 7 % des équipes, soit environ 8 750 personnes.

- Sacrifice your job for the glorious AI future (disconnect.blog)

How tech CEOs use the threat of job loss to distract from how AI is really used against workers

- Anthropic’s Mythos AI model sparks fears of turbocharged hacking (arstechnica.com)

Cyberdefenses could be exposed faster than fixes could be deployed.

- Anthropic secretly installs spyware when you install Claude Desktop (thatprivacyguy.com)

- Forking Vim to avoid LLM-generated code (lwn.net)

- Florida probes ChatGPT role in mass shooting. OpenAI says bot “not responsible.” (arstechnica.com)

- L’utilisation de l’intelligence artificielle dans la guerre en Iran : que dit le droit international ? (theconversation.com)

Spécial guerre(s) au Moyen-Orient

- Iran claims US exploited networking equipment backdoors during strikes — says devices from Cisco and others failed despite blackout in attack that ‘indicates deep sabotage’ (tomshardware.com)

- Donald Trump prolonge le cessez-le-feu en Iran indéfiniment, mais… (huffingtonpost.fr)

Nouveau revirement du président américain, lui qui avait encore jugé en début de semaine « hautement improbable » une prolongation du cessez-le-feu.

- Israël et les États-Unis mènent une guerre contre le développement de l’Iran (contretemps.eu)

Des universités aux centres de recherche médicale, Israël et les États-Unis détruisent systématiquement l’infrastructure civile, économique, culturelle et scientifique de l’Iran. Tout en prétendant ne s’en prendre qu’aux dirigeants, ils ciblent en réalité l’ensemble du peuple iranien et ses réalisations.

- Guerre en Iran : 30 millions de personnes menacées de pauvreté, l’ONU alerte sur une crise mondiale (humanite.fr)

Le blocage du détroit d’Ormuz menace de mettre en péril la sécurité alimentaire de millions de personnes. « L’interruption du trafic maritime provoque une crise humanitaire et économique de grande ampleur », a alerté l’ONU jeudi 23 avril.

- « C’est comme à Gaza » : Israël veut rendre le Sud-Liban invivable (reporterre.net)

- Report Details Israeli Use of Sexual Violence to Force Palestinians From West Bank Homes (commondreams.org)

“Sexual violence is not incidental to this crisis. It is one of the mechanisms driving people from their land”

- Statement by UNICEF on the killing of two water truck drivers in the Gaza Strip (unicef.org)

UNICEF is outraged by the killing of two drivers of trucks contracted by UNICEF to provide clean water to families in the Gaza Strip.

- Massive Attack, Macklemore et plus d’un millier d’artistes appellent au boycott de l’Eurovision 2026 (huffingtonpost.fr)

Avant son 70e anniversaire, le concours est visé par le plus important mouvement de boycott de son histoire du fait de la participation d’Israël.

- L’Espagne exhorte l’UE à mettre fin à l’accord d’association avec Israël (fr.euronews.com)

L’Espagne et l’Irlande ont été les premières à demander une révision de l’accord en 2024, en raison des inquiétudes suscitées par les tactiques employées lors de la guerre à Gaza, menée en réponse aux attaques du Hamas contre Israël en octobre 2023.

- Exportations d’armes vers Israël : le parquet français saisi d’une plainte (assawra.blogspot.com)

Une plainte pour « complicité de crime de guerre » et « complicité de crimes contre l’humanité » a été déposée ce lundi, par l’Union juive française pour la paix (UJFP) auprès du parquet national antiterroriste (PNAT). Objectif : faire la lumière sur les exportations militaires françaises vers Israël, notamment via l’aéroport Roissy Charles de Gaulle. Contrairement aux affirmations du gouvernement français, les exportations d’armes n’ont jamais cessé, en dépit de la politique génocidaire du gouvernement israélien.

- La guerre en Iran n’épargne pas les préservatifs, touchés eux aussi par la flambée des prix (huffingtonpost.fr)

Le géant malaisien Karex, qui fournit des marques comme Durex, a annoncé que le conflit au Moyen-Orient allait faire augmenter les prix de ses produits.

Spécial femmes dans le monde

- Gaza : plus de 38 000 femmes et filles tuées entre octobre 2023 et décembre 2025 (news.un.org)

- « Le changement climatique est sexiste » : des femmes du Sud global interpellent les États avant le G7 Environnement (reporterre.net)

Spécial anniversaire de Tchernobyl

- Tchernobyl, anatomie d’une catastrophe (arte.tv – disponible jusqu’au 05/06/2026)

- « Nous travaillons gratuitement comme liquidateur·ices nucléaires » (terrestres.org)

La vente de produits radioactifs ne relève pas d’une logique de confinement, mais de prolifération. Et elle est organisée par de nombreux acteurs qui expédient les myrtilles, airelles et champignons cueillis dans les forêts de Tchernobyl aux consommateur·ices partout dans le monde.

- L’utopie nucléaire des villes atomiques de la guerre froide (terrestres.org)

- Non, Tchernobyl n’est pas devenu une réserve naturelle (theconversation.com)

Spécial France

- Enquête sur les dérives de X : Elon Musk ne s’est pas présenté devant la justice française (france24.com)

Le milliardaire Elon Musk devait être entendu lundi en audition libre par le parquet de Paris dans le cadre de l’enquête “sur les éventuelles violations par la plateforme X de la législation française”, notamment les deepfakes sexuels. Le propriétaire de X ne s’est finalement pas présenté devant la justice mais les investigations se poursuivent.

- « Un dévoiement du travail parlementaire » : comment une commission d’enquête sert de tremplin à la désinformation scientifique (reporterre.net)

- le code secret à quatre chiffres des cartes bancaires c’est bientôt fini, on vous explique le nouveau système biométrique (lindependant.fr)

La carte bancaire biométrique remplace peu à peu le code à quatre chiffres. En France, BNP Paribas, Crédit Agricole et Société Générale déploient déjà ces cartes à empreinte digitale, jugées plus sûres et confidentielles.

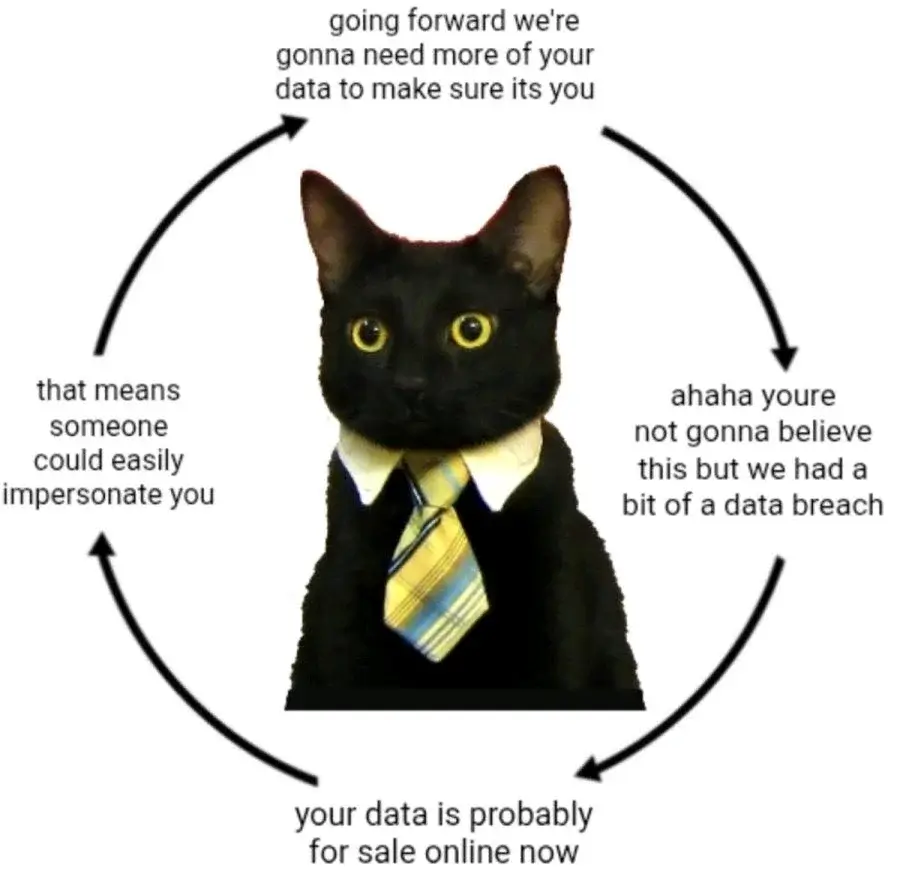

- L’ANTS, qui gère les cartes d’identité et passeports, visée par une attaque informatique, des données potentiellement divulguées (lemonde.fr)

Nom, prénom, adresse électronique et date de naissance d’usagers sont concernés par les fuites

- Scaleway devient l’hébergeur du Health Data Hub (lemondeinformatique.fr)

À la suite de l’appel d’offres lancé en février dernier, Scaleway a été retenu pour héberger les données du Health Data Hub. Ces dernières étaient depuis l’origine stockées sur le cloud Microsoft Azure, un choix contesté au nom de la souveraineté. La migration vers les infrastructures de la filiale d’Iliad est attendue à la fin 2026 ou au début 2027.

- Le long du littoral marseillais, une industrie numérique qui transforme la ville sans ses habitant·es (synthmedia.fr)

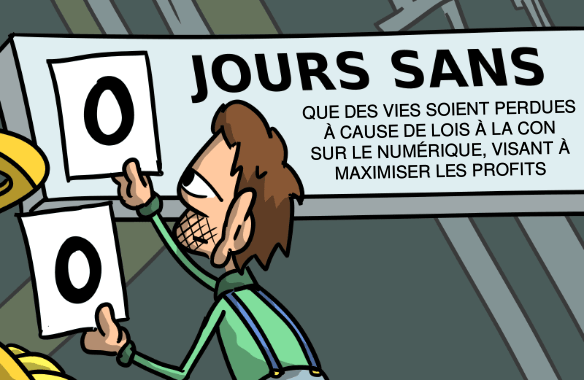

- Stage d’observation : à 15 ans, Calvin est mort au travail à Bagnols-sur-Cèze (altermidi.org)

- Stage obligatoire : silence, on meurt (humanite.fr)

Arnaud et Sandra Darthenay, parents d’Axel décédé à 16 ans lors de son stage de seconde en entreprise, et Anthony Smith, inspecteur du travail et député européen LFI, dénoncent la mise en danger des jeunes à l’occasion des stages obligatoires de troisième et de seconde en entreprise. Ils exigent leur interdiction.

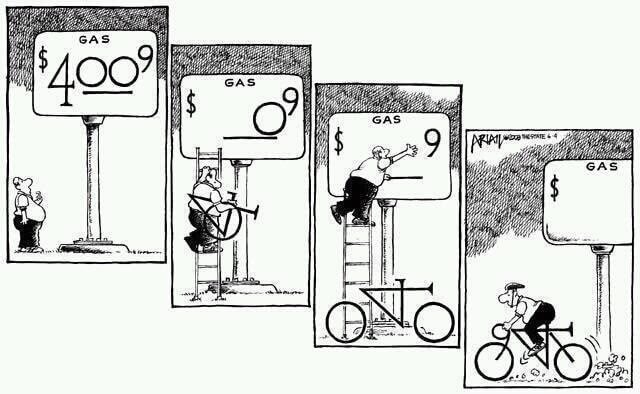

- Hausse des prix du carburant : les usager·es délaissent la voiture et adoptent bus gratuits, vélos et covoiturage pour leurs déplacements quotidiens (france3-regions.franceinfo.fr)

- Déchets radioactifs dans le Massif Central : autour de l’ancienne mine d’uranium des Bois Noirs, un risque inacceptable (lemediatv.fr)

- Cadmium : les flocons d’avoine fortement contaminés, selon une analyse (reporterre.net)

Spécial femmes en France

- Cadmium : les femmes sont davantage impactées (lesnouvellesnews.fr)

En moyenne, les femmes présentent 0,68 microgramme de cadmium par gramme de Cd de créatinine dans les urines, contre 0,47 chez les hommes […] Le taux de fer dans le corps baisse drastiquement dans le corps des femmes à plusieurs moments de leur vie, pendant leurs menstruations ou la grossesse. Or, lorsque la quantité de fer est trop faible dans l’organisme, le cadmium prend sa place.

- Contre la précarité menstruelle, des protections bientôt remboursées mais… (lesnouvellesnews.fr)

le dispositif s’appliquera sur les produits commercialisés dans les pharmacies. Si 60 % des frais sont remboursés, les 40 % restants devraient ensuite être comblés par les complémentaires santé. Or, 5 % des moins de 26 ans ne sont pas couvert·es par une mutuelle […] À cela s’ajoute un scandale sanitaire : les PFAS, les polluants éternels.

- 8 mars férié : la fausse bonne idée de la CGT (problematik-media.com)

- Lesbiennes au travail : sortir de l’invisibilité (theconversation.com)

- Anne Bourrassé : « Dans les musées nationaux, on compte 6 % d’artistes femmes » (lesnouvellesnews.fr)

Lors de la foire d’art contemporain Art Paris, un collectif a révélé le manque criant de parité dans le milieu de l’art. Résultat d’une longue invisibilisation des artistes femmes et de captation du pouvoir par un boys’ club.

- Parité dans la finance ? Les hommes tiennent toujours les cordons de la bourse (lesnouvellesnews.fr)

Selon le Gender Balance Index 2026 publié par l’OMFIF, la présence des femmes dans les postes de direction du secteur financier continue d’augmenter. Mais très lentement. Et sans remettre en cause l’essentiel : les hommes restent largement majoritaires aux postes où se prennent les décisions et où se concentrent le pouvoir et les revenus.

- Discriminations, bizutages, abus de pouvoir : les signalements de violences dans le sport bondissent de 64 % (humanite.fr)

Le bilan 2025 de la cellule Signal-Sports a été dévoilé, ce jeudi 23 avril, par le ministère des Sports. Les signalements ont augmenté de 64 % par rapport à l’année précédente et les victimes sont majoritairement des mineur·es et des femmes.

- Dans le monde agricole, le tabou des violences sexuelles (reporterre.net)

- Trois policiers soupçonnés de violences et de viol au commissariat de Sarcelles placés en garde à vue (huffingtonpost.fr)

Un homme a dénoncé des violences et un viol commis pendant sa garde à vue au commissariat de Sarcelles. Une enquête est menée par l’IGPN.

Spécial médias et pouvoir

- Quand la guerre au Proche-Orient est racontée dans la langue de ceux qui la mènent (acrimed.org)

- Transformer les médias, une urgence démocratique ! (acrimed.org)

- À Auray, on coupe le son à l’émission radio de Guillaume Meurice (ouest-france.fr)

Spécial emmerdeurs irresponsables gérant comme des pieds (et à la néolibérale)

- G7 omits climate change from Paris talks to avoid US clash, France says (france24.com)

A meeting of the G7 nations on the environment begins in Paris on Thursday, but climate change has been left off the agenda to avoid a dispute with the United States, France’s ecology minister Monique Barbut said, citing efforts to preserve unity and focus on less contentious issues during the two-day talks.

- Sur l’immigration, Bruno Retailleau et Jordan Bardella visent l’Espagne sans retenue (ni cohérence) (huffingtonpost.fr)

Le lancement du plan de régularisation massive du gouvernement de Pedro Sanchez provoque des réactions outrées – et disproportionnées – de la droite de l’échiquier politique en France.

- Avec ce déplacement XXL, Macron veut faire taire les critiques en « immobilisme » à un an de son départ (huffingtonpost.fr)

Le président de la République passe la journée dans l’Allier, où il tiendra son Conseil des ministres. Au programme : des « obsessions présidentielles » et une volonté d’exister encore sur le plan national.

- Nouveau « choc de simplification » d’Emmanuel Macron : « L’environnement est sacrifié pour aller plus vite » (reporterre.net)

- Airbus, BNP, Sanofi, Zara… Monique Barbut, ministre de l’écologie, est actionnaire de dizaines de grandes entreprises (vert.eco)

- Le gouvernement veut réautoriser la location des passoires thermiques (reporterre.net)

- PFAS dans les boues d’épandage : Disclose et Reporterre dévoilent le plan du gouvernement pour lutter contre la contamination (disclose.ngo)

- Prix des carburants : le RN veut baisser les taxes mais refuse de taxer les superprofits (basta.media)

Face à la hausse du prix des carburants, le RN propose de baisser les taxes, mais pas de taxer les superprofits des entreprises pétrolières. Et rejette la transition énergétique, alors que notre dépendance aux fossiles coûte de plus en plus cher.

- Ne les appelez plus Ehpad mais Maisons France Autonomie (information.tv5monde.com)

Ne les appelez plus Ehpad : quatre ans après le scandale Orpea, le gouvernement a annoncé samedi son intention de renommer les établissements d’hébergement pour personnes âgées dépendantes en Maisons France Autonomie. Ces établissements doivent être “des lieux où on a envie de vivre et de travailler” et Maisons France Autonomie est “un label qu’on va travailler d’ici septembre”, a indiqué la ministre déléguée chargée de l’Autonomie et des Personnes handicapées, Camille Galliard-Minier

- Pourquoi il nous faut davantage d’arrêts maladie (frustrationmagazine.fr)

Puisque se pencher sur les causes de notre mauvais état de santé au travail impliquerait la mise en cause des managers, des patrons, des hauts fonctionnaires et porter atteinte à la bonne santé des actionnaires, le gouvernement a trouvé un responsable à stigmatiser – le malade. C’est pourquoi le ministre du Travail envisage une batterie de mesures visant à fliquer, contrôler, culpabiliser et, à la fin, forcer les salariés à retourner, même malade, sur leur poste de travail.

Spécial recul des droits et libertés, violences policières, montée de l’extrême-droite…

- 210 jours en CRA, internement psychiatrique… La macronie prépare une nouvelle loi sécuritaire et xénophobe (revolutionpermanente.fr)

L’assemblée nationale examine cette semaine la proposition de loi d’un député macroniste contenant un florilège d’attaques liberticides sous couvert de « prévention des attentats » : extension de la rétention administrative, renforcement de l’injonction de soin psychiatrique, mais aussi des attaques contre les personnes trans.

- Présence de Frontex lors d’une opération d’expulsion à Grande-Synthe (blogs.mediapart.fr)

Le 26 mars, pour la première fois lors d’une opération d’expulsion, Human Rights Observers a constaté la présence d’agents de Frontex, l’agence européenne de garde-frontières et de garde-côtes, à l’origine de nombreuses violations de droits humains fondamentaux.

- Insultes racistes, saluts nazis : à Caen, le “banquet normand” financé par Pierre-Edouard Stérin dégénère (ici.fr)

- Medef : la tentation brune (politis.fr)

Le déjeuner entre le Medef et Jordan Bardella n’a rien d’une surprise : à l’heure des crises, une fraction croissante des élites économiques paraît prête à s’accommoder, voire à s’appuyer, sur des forces autoritaires.

- « Extrêmement inquiétant », Amnesty alerte sur le climat politique « virulent » en France à un an de la présidentielle (huffingtonpost.fr)

Dans son rapport annuel, l’ONG dénonce la banalisation d’attaques contre l’État de droit et met en garde contre un affaiblissement des droits humains.

- Un homme tire à la carabine sur un enfant en proférant des insultes racistes : « Il a cru qu’il allait mourir » (leprogres.fr)

Choc dans la commune d’Espaly-Saint-Marcel. Dimanche 19 avril, un homme âgé de 65 ans a poursuivi des enfants armé d’une carabine à plomb. Il aurait tiré sur l’un d’eux, tout en proférant des insultes racistes. Il a été interpellé et placé en garde à vue. Il fait l’objet d’une convocation par officier de police judiciaire pour des faits de violences avec arme.

Voir aussi L’homme soupçonné d’avoir tiré sur un enfant à la carabine est sorti de garde à vue (leprogres.fr)

« Personne ne nous a prévenus qu’il allait sortir, indique la tante de l’une des victimes, en colère. Il est revenu et il a hurlé sur les enfants, il nous a de nouveau insultés. »

« À plusieurs reprises, des policiers ont refusé de prendre des plaintes »« Personne ne doit subir ces violences-là […] Nous devons dénoncer collectivement la libération de la parole raciste attisée par l’extrême droite. »

- La gare de Luméville, haut lieu de la lutte contre Cigéo, encerclée par les gendarmes (reporterre.net)

- “Votre enfant a été reconnu lors d’une manifestation” : des lycéens marseillais dénoncés par un inspecteur d’académie (laprovence.com)

- Prise de parole face à Yaël Braun-Pivet : une étudiante en conseil de discipline (humanite.fr)

Lors d’une conférence en présence de Yaël Braun-Pivet […] Léa […] a pris la parole pour dénoncer la minute de silence à propos de Quentin Deranque, et a appelé à en faire une pour les victimes de violences policières, d’extrême droite et les Palestiniens victimes du génocide en cours à Gaza. Depuis, le directeur lui a annoncé qu’elle allait passer en conseil de discipline.

Spécial résistances

- Violences létales de la police : Des familles de victimes réunies contre la loi « permis de tuer » (basta.media)

- Austère autonomie : plus de 200 philosophes contre la destruction de l’Université (blogs.mediapart.fr)

- Résister à une mine de lithium dans l’Allier (revuesilence.net)

- À La Hague, la lutte contre l’accaparement des terres par le nucléaire (journal-labreche.fr)

En plus de la construction de six réacteurs de type EPR2, la relance du nucléaire français voulue par Emmanuel Macron prévoit également de prolonger la durée de vie et d’agrandir l’usine de traitement des combustibles irradiés, à La Hague (Manche). Des voix dénoncent la fuite en avant d’une industrie qui prétend recycler ses déchets dans un projet « Aval du futur » jugé écocidaire et dispendieux.

- Réautorisation d’un pesticide interdit depuis 2024 : deux ONG saisissent la justice (reporterre.net)

Encore une nouvelle dérogation pour épandre un pesticide. Celle-ci concerne le Movento, un insecticide du groupe Bayer, utilisé notamment sur les vergers (cerisiers, pêchers, abricotiers, pommiers). Or, la substance active du produit, le spirotétramate, est interdite en Europe depuis 2024.

- Arrêtons de manger du pétrole (politis.fr)

De cette « crise énergétique », ne faisons pas une énième occasion de relancer l’industrialisation de l’agriculture. Il s’agit de mettre en lumière l’immense dépendance de l’agriculture aux engrais fossiles. Et de la faire bifurquer.

Spécial outils de résistance

- À la recherche de l’impôt perdu. Le séparatisme fiscal des ultrariches (france.attac.org)

Cette note d’Attac et de l’observatoire de la justice fiscale revient sur les évolutions de la fiscalité en faveur des plus riches, les idées reçues et faux débats sur ce sujet, et montre qu’il est possible et nécessaire de mieux imposer les plus riches pour financer l’action publique, réduire les inégalités et relever les urgences sociales et écologiques.

- Ravages des pesticides : des citoyen·nes lancent un outil innovant qui rassemble 2 000 études (reporterre.net)

Vous êtes à court d’arguments scientifiques pour dénoncer les pesticides ? Une nouvelle bibliothèque digitale participative vous vient en aide.

Spécial MAGAM et cie

- The GAFAM Empire (gafam.theglassroom.org)

An exploration of acquisitions by big tech companies

- Geek Tragedy. Look upon their works and despair (motherjones.com)

- Google will invest as much as $40 billion in Anthropic (arstechnica.com)

The investment follows Amazon’s $5 billion initial investment in Anthropic a few days ago ; the Amazon deal also leaves the door open to further investment based on performance. Both investments value Anthropic at $350 billion.

- Clicking “reject cookies” might not actually do anything (techspot.com)

Google, Microsoft, and Meta largely ignore cookie opt-outs, independent audit says

- EFF to State AGs : Investigate Google’s Broken Promise to Users Targeted by the Government (eff.org)

Google’s Failure to Warn Users About Law Enforcement Demands for Data Is Deceptive

- Commission designates WhatsApp as Very Large Online Platform under the Digital Services Act (digital-strategy.ec.europa.eu)

- “Il faudra un abonnement mensuel” : WhatsApp bientôt payant pour l’utiliser à 100 % (presse-citron.net)

- Après quinze ans à la tête d’Apple, Tim Cook passe la main à John Ternus son patron de l’ingénierie (huffingtonpost.fr)

Le dirigeant de 65 ans quittera ses fonctions à l’automne après près de quinze ans à la tête du groupe, mais restera impliqué dans sa gouvernance.

- Apple stops weirdly storing data that let cops spy on Signal chats (arstechnica.com)

Previously, Signal president Meredith Whittaker had posted on Bluesky to remind users that they can update Signal settings to “Show ‘No Name or Content’” in push notifications and avoid privacy concerns. Some users agreed that enabling message previews on any kind of device—not just Apple’s—seemed unwise in light of 404 Media’s reporting.

- ‘This craving to go viral is tiresome’ : the artists sick of the pressure to promote on social media (theguardian.com)

how are creative people feeling about having to meet the demands of Silicon Valley algorithms ? “It’s a hideous situation,” says comedian Stewart Lee, who so far has managed a successful career without using social media. “We’re at a real crossroads. The worst people on earth control the means of communication.”

Les autres lectures de la semaine

- Marcel Muller, Luigi Mangione : destins croisés de deux assassins de patrons (theconversation.com)

- L’État de droit : un mythe ? Entretien avec Elsa Marcel (frustrationmagazine.fr)

- Consentement ou résignation : pourquoi ça ne pète pas ? (frustrationmagazine.fr)

- Des manchots de l’Antarctique à l’explicabilité en IA. Bienvenue en prétopologie ! (theconversation.com)

- Jean-Marc Jancovici, l’ingénieur-roi, ses disciples et ses principes (revue21.fr)

- Eau, biosignature et éclair : ce que nous a appris le rover Perseverance après cinq ans sur Mars (theconversation.com)

- How Medieval Cathedrals Were Built Without Science, or Even Mathematics (openculture.com)

- Le sourire et le fusil : fabrique coloniale du tirailleur sénégalais (histoirescrepues.fr)

Derrière la figure familière du tirailleur se cache une construction coloniale qui neutralise la diversité des trajectoires africaines.

- Les femmes, les oubliées de la science sur l’accouchement et l’allaitement (theconversation.com)

- Les protéines animales sont le privilège des hommes depuis 10 000 ans en Europe (humanite.fr)

En analysant les ossements de milliers de squelettes, 10 000 ans d’inégalités alimentaires sont révélés. Les hommes apparaissent plus souvent du côté des régimes les plus riches en protéines animales, les femmes du côté des apports les plus restreints.

- Try the Oldest Known Recipe For Toothpaste : From Ancient Egypt, Circa the 4th Century BC (openculture.com)

Les BDs/graphiques/photos de la semaine

Les vidéos/podcasts de la semaine

- Chasse aux précaires dans le Finistère (radiofrance.fr)

- Primaire de la gauche, service publics, lutte LGBTQ+… Lucie Castets face à l’Huma (humanite.fr)

- Johann Chapoutot sur la production de l’irresponsabilité et la banalité du mal (tube.fdn.fr)

- Baisse des audiences de CNews : que peut-on en conclure ? Décryptage avec Acrimed (humanite.fr)

- Emmanuel Barré sur radio Nova à propos des ex toxiques candidats à la présidentielle (tube.fdn.fr)

- Pourquoi il faut en finir avec CNews (et l’Arcom) (video.blast-info.fr)

- « Toutes des folles » (binge.audio)

Si le poncif de « l’ex folle » est aussi bien installé c’est parce qu’il prolonge l’un des poncifs les plus tenaces du patriarcat : l’idée que les femmes seraient, par nature, instables ou hystériques. Mais ce mythe est surtout un outil de pouvoir qui permet aux hommes de pratiquer le gaslighting : cette manipulation psychologique visant à faire douter une femme de ses propres perceptions et de la réalité des violences qu’elle subit… pour mieux la garder sous emprise.

Les trucs chouettes de la semaine

- « Que tout le monde hérite d’un bien commun » : un nouveau modèle de coopérative de logement pour acheter sans spéculer (basta.media)

Ni locataires ni propriétaires, les membres d’une jeune coopérative lyonnaise veulent constituer un parc collectif de logements pour les sortir de la logique spéculative. Ils ne font pas construire mais achètent des appartements existants.

- À Paris, un hôpital forme des hommes trans aux injections de testostérone (revueladeferlante.fr)

L’hôpital Pierre-Rouquès-Les Bluets (Paris, 12e) a inauguré, le 25 mars 2026, un accueil consacré à la primo-prescription de testostérone pour les personnes transmasculines. […] Actuellement accessible une fois par mois aux personnes transmasculines majeures, la consultation des Bluets pourrait prochainement s’ouvrir aux personnes transféminines.

Retrouvez les revues de web précédentes dans la catégorie Libre Veille du Framablog.

Les articles, commentaires et autres images qui composent ces « Khrys’presso » n’engagent que moi (Khrys).

20.04.2026 à 07:42

Khrys’presso du lundi 20 avril 2026

Texte intégral (9767 mots)

Comme chaque lundi, un coup d’œil dans le rétroviseur pour découvrir les informations que vous avez peut-être ratées la semaine dernière.

Tous les liens listés ci-dessous sont a priori accessibles librement. Si ce n’est pas le cas, pensez à activer votre bloqueur de javascript favori ou à passer en “mode lecture” (Firefox) ;-)

Brave New World

- Critical Atlantic current significantly more likely to collapse than thought (theguardian.com)

Scientists say finding is ‘very concerning’ as collapse would be catastrophic for Europe, Africa and the Americas[…]Amoc slowdown in 2100 may be even greater than in the new, pessimistic assessment. This is because the computer models do not include the meltwater from the Greenland ice cap that is also freshening the ocean waters

- Antarctic fur seals now endangered as climate change reduces krill for pups (news.mongabay.com)

- Les minerais critiques, essentiels à la transition énergétique, sont au cœur d’une nouvelle ruée minière (theconversation.com)

Les bases d’une gouvernance mondiale pour les minerais critiques, essentiels à la transition énergétique, se heurtent à une course stratégique entre grandes puissances et pays producteurs, où la sécurisation des chaînes d’approvisionnement prime sur l’écologie, la justice sociale et les droits des communautés locales.

- « Cruellement chaudes » : au Japon, un nouveau terme inventé pour les journées à plus de 40°C (reporterre.net)

Le 17 avril, l’Agence météorologique japonaise a annoncé la création d’un nouveau terme, « kokusho-bi », traduit par « journée cruellement chaude » […] Cette nouvelle catégorie vient compléter une nomenclature existante qui distingue déjà les seuils de 25 °C (« journée d’été »), 30 °C (« journée de plein été ») et 35 °C (« journée de chaleur extrême »).

- Au semi-marathon de Pékin, un robot bat le record du monde d’un humain (huffingtonpost.fr)

Un robot a couru à presque 25km/h lors d’une course qui s’est déroulée en Chine. C’est trois fois plus vite qu’en 2025.

- China’s Parallel Web Behind the Wall (vale.rocks)

The internet known within China is a very different internet to the one known by the world at large. It is censored, regulated and structured quite differently. It is controlled and managed, rather than organic and sprawling. From the outside looking in, it feels like an entirely different beast, and to begin to understand it, you must first understand the conditions that formed it.

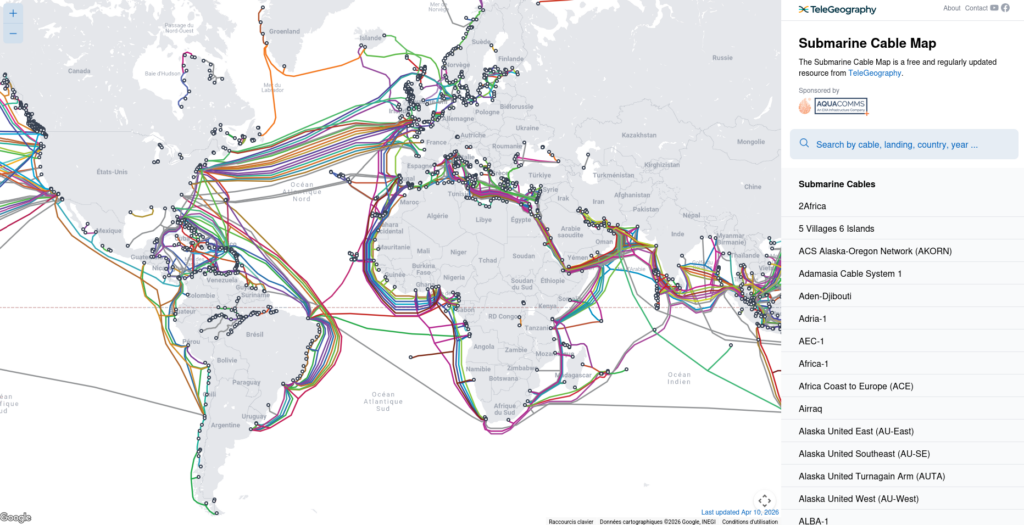

- New undersea cable cutter risks Internet’s backbone (arstechnica.com)

A Chinese ship has tested a new device capable of slicing through submarine data cables thousands of meters beneath the ocean surface. That demonstration may exacerbate security concerns over a spate of suspected sabotage incidents targeting undersea communications and power cables from the Baltic Sea to the Pacific Ocean.

- Guerre civile au Soudan. Trois ans d’impasse – Le mépris du droit international dans un silence (presque) total (afriquexxi.info)

Le 15 avril 2023 éclatait le conflit entre l’armée soudanaise et les paramilitaires des Forces de soutien rapide. Divisé, le pays compte aujourd’hui le plus de déplacés au monde, et la situation des droits humains s’avère catastrophique, alors que la communauté internationale continue de se taire.

- ArcelorMittal : le charbon qui arrive à Dunkerque provoque des ravages au Mozambique (disclose.ngo)

Derrière les promesses d’acier vert, le premier pollueur de France carbure toujours au charbon. En août 2025, l’usine d’ArcelorMittal à Dunkerque a reçu plusieurs milliers de tonnes du combustible en provenance de Moatize, une mine ultra toxique au Mozambique.

- Est de la RD Congo. Une paix bon marché et des médias muselés (afriquexxi.info)

Les troupes rwandaises se sont retirées de manière ostentatoire de l’est de la RD Congo, alors que le président Paul Kagame niait leur présence. Une situation qui ne rassure guère la population, prise entre les forces congolaises et le groupe rebelle AFC/M23, déjà accusé d’exactions, notamment contre des journalistes.

- Orbán, Poutine, Trump : trois défaites d’un coup (politis.fr)

- Comprendre la victoire de Péter Magyar contre Viktor Orbán : 5 points sur la géographie politique d’une défaite historique (legrandcontinent.eu)

- Les médias minimisent la responsabilité des automobilistes dans les accidents avec des cyclistes, selon une étude (rts.ch)

Une étude de l’Université de Lausanne révèle que les médias romands minimisent la responsabilité des automobilistes lors de collisions avec des cyclistes. Les chercheurs ont analysé plus de 200 articles publiés entre 2020 et 2024, mettant en lumière des formulations qui tendent à déresponsabiliser les conducteurs.

- Switzerland’s Goldilocks fiber (pluralistic.net)

- Douze observations sur le référendum italien et la victoire du Non (contretemps.eu)

Giorgia Meloni a récemment perdu son référendum visant à soumettre le système judiciaire au pouvoir politique. On ne peut comprendre cette défaite inattendue sans mettre l’accent sur les mobilisations populaires qui se sont développées ces dernières années, en particulier du côté de la jeunesse en solidarité avec les Palestinien·nes, qui ont fait de ce référendum une véritable bataille politique.

- Sans-papiers : l’Espagne lance la régularisation d’un demi-million de personnes étrangères (humanite.fr)

Dans une lettre aux Espagnols publiée mardi 14 avril sur le réseau social X, le premier ministre Pedro Sanchez a annoncé l’adoption dans la journée par le Conseil des ministres d’« un décret royal qui lance le processus de régularisation extraordinaire de personnes en situation irrégulière ». La procédure doit être accessible en ligne dès le 16 avril et s’achever en juin, a précisé la porte-parole du gouvernement.

- Les systèmes de sécurité nationale des trois quarts des pays européens « semblent reposer sur des technologies américaines », selon un rapport (lemonde.fr)

Une analyse du groupe de réflexion Future of Technology Institute souligne les risques que fait peser pour l’Europe la dépendance numérique aux Etats-Unis, et notamment à son cloud.

- Can the ‘Attention Liberation Movement’ Foment a Rebellion Against Screens ? (mobile.slashdot.org)

- Brussels launched an age checking app. Hackers say it takes 2 minutes to break it. (politico.eu)

Cyber experts say they have found holes in Brussels’ age verification app, despite claims by the EU executive that it is “technically ready.”

- Double-Check Your Travel Reservations. Booking.com Hit by Data Breach (pcmag.com)

The site warns that hackers accessed data, including booking details, names, emails addresses, and phone numbers associated with the booking.

- NASA restarts work to support Europe’s uncrewed trip to Mars after years of setbacks (engadget.com)

The Rosalind Franklin rover could finally have a ride to the red planet so it can look for signs of ancient life.

- ‘I was kicked out of bar because of my wheelchair’ (bbc.co.uk)

An 18-year-old woman who was escorted out of a nightclub after she was told her wheelchair was a safety risk has described the ordeal as “embarrassing and infuriating”.

- Video of woman collapsing in ER waiting room played at Ontario inquest into her sepsis death (cbc.ca)

Whether bias or discrimination played a role in Winterstein’s care, in many areas of the medical system, has been a focus during witness questioning […] Indigenous patients who use drugs likely face layers of “bias” and “stigma” in the health-care system.

- Française de 85 ans arrêtée par l’ICE : son beau-fils soupçonné de l’avoir dénoncée pour récupérer l’héritage (slate.fr)

Quelques mois après la mort de son mari américain, Marie-Thérèse Ross-Mahé a été placée en détention par les services de l’immigration des États-Unis. Une juge soupçonne l’un de ses beaux-fils d’avoir pesé dans l’affaire.

Voir aussi ‘Maman is finally free !’ : French widow, 86, flies home after ICE detention ordeal (theguardian.com)

- Caitlyn Jenner Asks Trump for Help After Impact of Trans Passport Policy (newsweek.com)

A Republican, she has often found herself at odds with trans advocates and is not considered a vocal advocate for trans rights. She has stood against many issues affecting the LGBTQ+ community, including speaking out against trans athletes and voicing opposition to gender-affirming care for minors.

- Trump deletes post depicting him as Jesus-like figure after backlash (bbc.co.uk)

- Trump participe à un « marathon » biblique, une semaine à peine après ses saillies sur le pape Léon XIV (huffingtonpost.fr)

Le président américain prend part à l’initiative « America Reads The Bible », dans le cadre de laquelle il a lu un passage considéré comme une « référence » par la droite chrétienne.

- What is the 25th Amendment and could it be used to remove Trump from office ? (theconversation.com)

- Le maire de New-York a demandé l’aide de l’économiste français Gabriel Zucman pour mener à bien son projet de taxer les ultra-riches dans une ville marquée par “l’exode” des classes populaires (bfmtv.com)

- 100+ Journalists Applaud the Internet Archive’s Role In Preserving the Public Record (fightforthefuture.org)

Over 100 journalists including Rachel Maddow, Cory Doctorow, and Ellen Nakashima have signed a letter to the Internet Archive celebrating the Wayback Machine as a crucial resource for their work.

- « Un bruit constant » : plongée à Ashburn, la ville des data centers qui peut faire disjoncter internet (reporterre.net)

À Ashburn, la capitale des data centers aux États-Unis qui concentre 70 % du trafic internet, les centres de données ont été construits juste en face des maisons. Ses habitant·es en paient le prix fort, entre nuisances sonores et pollutions.

- Maine set to become first state with data center ban (cnbc.com)

Maine is poised to become the first state to pass a temporary ban on data center construction after a measure was approved by both chambers of the state legislature. Similar bills have been introduced in more than a dozen other states, as well numerous localities. Maine’s bill could face a veto from the governor, who was unable to get exemptions added into the bill.

- Virginia’s New Data Center Electricity Rate Class (americanactionforum.org)

Virginia’s State Corporation Commission (SCC) has approved a new electricity rate for large-scale customers, notably artificial intelligence (AI) data centers ; starting in January 2027, affected customers must pay for at least 85 percent of contracted distribution and transmission demand and 60 percent of generation demand.

- SpaceX Bought 18 % of All U.S. Cybertrucks Sold in Q4 2025, Data Shows (gadgetreview.com)

- La guerre nucléaire est-elle désormais possible ? Les réponses de David Holloway (legrandcontinent.eu)

Spécial IA

- Microsoft and Stellantis want to use AI to “help” car owners (arstechnica.com)

Stellantis, the global car company that owns brands from Alfa Romeo to Vauxhall (including Chrysler, Dodge, Jeep, and Ram), has begun a five-year partnership with Microsoft. The tech company will use its expertise to help the automaker improve its digital services, beef up its cybersecurity, and enhance its engineering capabilities. And yes, it will do that with the hype-iest of tech trends, AI.

- Gemini can now create personalized AI images by digging around in Google Photos (arstechnica.com)

- Voice actors fight to save their livelihoods and local cultures from Hollywood’s AI push (restofworld.org)

Voice AI tools are quickly replacing voice-over and dubbing artists, raising concerns not only about jobs but also loss of cultural relevance in non-English-speaking nations.

- AI’s New Training Data : Your Old Work Slacks And Emails (forbes.com)

Defunct startups are being liquidated for their Slack archives, Jira tickets, and email threads—operational exhaust that AI labs now treat as premium training data.

- Boston Dynamics and Google DeepMind Teach Spot to Reason (spectrum.ieee.org)

The addition of Gemini Robotics brings embodied AI reasoning to inspection robots

- ‘Too powerful for the public’ : inside Anthropic’s bid to win the AI publicity war (theguardian.com)

The firm says it withheld an AI model on cybersecurity grounds but sceptics say this was hype to lure investment

- US Government Now Wants Anthropic’s ‘Mythos’, Preparing for AI Cybersecurity Threats (yro.slashdot.org)

- OpenAI récupère le prénom de Rosalind Franklin pour son modèle spécialisé en biologie (next.ink)

Avec GPT‑Rosalind, OpenAI veut encore affirmer que ses outils peuvent être utiles aux chercheurs mais surtout aux industries pharmaceutiques et biomédicales. L’entreprise de Sam Altman utilise aussi le prénom d’une chercheuse, Rosalind Franklin, dont le travail a été pillé par ses confrères qui ont eu le prix Nobel qu’elle n’a pas obtenu.

- It’s a Fucking Mainframe (viewyonder.com)

LLMs aren’t a new computing paradigm. They’re a return to centralized computing — terminals, batch jobs, security, sandboxing, chargeback — wrapped in APIs and better fonts. A 1990’s sysprog’s guide to the pattern everyone else missed. […] We replaced a system that failed loudly and precisely with a system that fails silently and confidently.

- Le PDG de Nvidia, Jensen Huang, adresse un message aux ingénieurs de l’entreprise : si vous n’utilisez pas largement les outils d’IA, vous n’êtes pas productifs (developpez.com)

« Imaginons que vous ayez un ingénieur logiciel ou un chercheur en IA, et que vous le payiez 500 000 dollars par an. À la fin de l’année, je vais lui demander combien il a dépensé en jetons. Et [si] cette personne répond 5 000 dollars, je vais piquer une crise. Si cet ingénieur payé 500 000 dollars n’a pas consommé au moins 250 000 dollars de jetons, je vais être profondément inquiet. »

- Cols blancs sous pression : quand l’IA sert d’alibi au grand dégraissage (synthmedia.fr)

- Meta spins up AI version of Mark Zuckerberg to engage with employees (arstechnica.com)

- Microsoft exec suggests AI agents will need to buy software licenses, just like employees (businessinsider.com)

- Mozilla launches Thunderbolt AI client with focus on self-hosted infrastructure (arstechnica.com)

Thunderbolt acts as what Mozilla calls a “sovereign AI client” on top of that underlying infrastructure. The combo promises to let users easily plug into any ACP-compatible agent or OpenAI-compatible API (including Claude, Codex, OpenClaw, DeepSeek, and OpenCode).

- Linux lays down the law on AI-generated code, says yes to Copilot, no to AI slop, and humans take the fall for mistakes — after months of fierce debate, Torvalds and maintainers come to an agreement (tomshardware.com)

- Testing suggests Google’s AI Overviews tell millions of lies per hour (arstechnica.com) – voir aussi Analysis Finds That Google’s AI Overviews Are Providing Misinformation at a Scale Possibly Unprecedented in the History of Human Civilization (futurism.com)

Google’s own tests paint a no less damning picture, the reporting notes. In an internal analysis of Gemini 3, it found that the AI model produced incorrect information 28 percent of the time.

- Comment les IA génératives modèlent nos émotions et façonnent nos sociétés ? (synthmedia.fr)

- AI is about to make the global e-waste crisis much worse (restofworld.org)

As demand for AI hardware surges, much of the resulting waste will end up in non-Western countries.

- « C’est une aberration » : pour les besoins de l’IA, les data centers veulent tourner au gaz fossile (reporterre.net)

- Intelligence artificielle : quels sont les apports concrets de la régulation européenne ? (theconversation.com)

- Pourquoi la génération Z est-elle de plus en plus méfiante envers l’IA ? (legrandcontinent.eu)

- Don’t ask AI, ask a peer (apc.org)

For this series, we developed basic questions, in the same way that one might ask AI, but to be answered by authors and illustrators from different countries and with different backgrounds, each taking a distinct path. Instead of pre-programmed responses generated by opaque algorithms designed to please users and hold their attention, here you will find different perspectives and thought-provoking ideas to spark conversations.

- Small Missouri town ousts half its city council after $6 billion AI data center approval — petition calls for mayor’s removal as frustration (and violence) over AI data centers mounts (tomshardware.com)

- In its push to become Big Tech’s data center hub, India is overlooking local resistance (restofworld.org)

Google and Microsoft’s multibillion-dollar projects under construction in India are facing backlash from farmers, while the government offers huge tax relief to foreign companies setting up data centers.

- Sam Altman’s home targeted in second attack ; two suspects arrested (sfstandard.com)

Early Sunday morning, a car stopped and its occupant appears to have fired a gun at the Russian Hill home of OpenAI’s CEO, according to police.

- Why the AI backlash has turned violent (bloodinthemachine.com)

Spécial clashs / logiciels plus ou moins libres

- You cannot use the GNU (A)GPL to take software freedom away (fsf.org)

- Les points sur les /e/ (lagabarre.info)

le convertisseur d’audio en texte d’/e/OS repose sur la transmission de l’audio à OpenAI

Spécial guerre(s) au Moyen-Orient

- L’IA, les Lego et le rap : les nouvelles armes de l’Iran face à Trump et Nétanyahou (theconversation.com)

- Trump’s Attack on Iran Has Pushed China on to a Perilous Tightrope (thewire.in)

- L’Iran annonce la réouverture du détroit d’Ormuz (legrandcontinent.eu)

- Deux navires commerciaux visés par des tirs, le détroit d’Ormuz de nouveau fermé par Téhéran (legrandcontinent.eu)

- L’Iran a tiré sur un pétrolier dans le détroit d’Ormuz, quelques heures après avoir annoncé le refermer (huffingtonpost.fr)

- Pénurie de kérosène : les avions bientôt menacés ? (france24.com)

- Les compagnies pétrolières engrangent 81,4 millions d’euros de superprofits par jour (lareleveetlapeste.fr)

À l’échelle du mois de mars 2026, cela équivaut à environ 2,5 milliards d’euros supplémentaires par rapport aux mois précédents.

- ‘They Profit, We Pay’ : Coalition Says End Mideast Wars, Tax Fossil Fuel Giants (commondreams.org)

Governments gathering for International Monetary Fund and World Bank meetings “have a clear responsibility,” said a 350.org leader. “End this illegal war, stop the flow of destruction, and make the profiteers pay.”

- La crise d’Ormuz accélère la transition énergétique (legrandcontinent.eu)

- « La guerre renforce la cohésion du régime iranien, et sa répression » (terrestres.org)

- Au Sud Liban, Israël poursuit les destructions et le dépeuplement (contretemps.eu)

- Italy suspends defence agreement with Israel (bbc.co.uk)

- De Barcelone à Gaza, briser le blocus pour le futur de l’humanité (altermidi.org)

- « L’animal l’a attaqué à plusieurs reprises » : Marwan Barghouti « en danger immédiat » suite à une escalade des tortures menées par Israël (humanite.fr)

Le prisonnier politique palestinien Marwan Barghouti est victime d’un « schéma clair d’escalade des abus : violence, négligence médicale et traitement qui le met en danger immédiat », alerte son avocat Ben Marmarelli, dans une lettre publiée mercredi 15 avril. En moins d’un mois, la figure incontestée de la résistance palestinienne a été tabassée à trois reprises et agressée par un chien lâché par ses geôliers israéliens.

Spécial femmes dans le monde

- Korea decriminalized abortion 7 years ago. For many women, it remains a dangerous choice. (hani.co.kr)

- Ces femmes européennes contraintes d’avorter dans un autre pays (rembobine.info)

Plus de 5 000 femmes résidant en Europe sont contraintes de traverser chaque année les frontières de leur pays pour accéder à l’IVG, révèle l’enquête européenne « Exporting Abortion ».

- Isolate, Inebriate, Intimidate, Repeat : High Rates of Sexual Force Against Women Are Reported When Young Men Given Anonymous Surveys (journals.sagepub.com)

- « Ce qu’il nous reste, ce sont les miettes » : quand le pétrole appauvrit les femmes (reporterre.net)

Spécial France

- Le cimentier français Lafarge reconnu coupable de financement de terrorisme en Syrie, prison ferme pour plusieurs anciens dirigeants (franceinfo.fr)

La justice reprochait à l’entreprise d’avoir versé plusieurs millions d’euros à des groupes jihadistes, dont l’organisation Etat islamique, afin qu’ils permettent à une usine de fonctionner en pleine guerre civile.

- Au procès libyen, Guéant contre-attaque et fragilise la défense de Sarkozy (huffingtonpost.fr)

- Cécile Kohler et Jacques Paris accueillis à l’Assemblée, une grande émotion pour tous les ex-otages en Iran (huffingtonpost.fr)

Benjamin Brière, Louis Arnaud et Olivier Grondeau, visiblement émus, étaient à leurs côtés pour retirer symboliquement leurs portraits des grilles du palais Bourbon.

- Une réponse “inacceptable” : la Direction générale des Finances publiques regrette la gestion du cas de Benjamin Brière, ex-otage français détenu en Iran (franceinfo.fr)

La Direction générale des finances publiques (DGFip) fait son mea-culpa, dimanche 12 avril, après la publication du témoignage de l’ex-otage français en Iran Benjamin Brière, qui raconte que le service des impôts lui a reproché de ne pas avoir effectué déclaré ses revenus pendant qu’il était prisonnier en Iran. […] Le Français expliquait […] qu’à son retour en France en 2023, après trois ans de détention, il avait été “radié de partout. Je n’existais plus aux yeux de la Sécurité sociale et de France Travail. J’ai dû me battre pour tout réactiver, à commencer par les impôts.”

- Affaire Rachida Dati : les locaux d’Engie perquisitionnés pour « corruption », « trafic d’influence » et « détournement de fonds publics » (humanite.fr)

- Le Sénat adopte le projet de réforme de la justice criminelle porté par Gérald Darmanin (lemonde.fr)

- Ruptures conventionnelles : nouveau revers pour le gouvernement à l’Assemblée nationale (humanite.fr)

Via un amendement communiste adopté à 77 voix contre 32, les députés ont rejeté, dans la soirée de jeudi 16 avril, un projet de loi transposant un accord conclu entre patronat et certains syndicats (CFDT, CFTC et FO) pour réduire la durée d’indemnisation de l’assurance chômage en cas de rupture conventionnelle. Alors que la gauche était davantage mobilisée, l’exécutif a fait savoir qu’il convoquerait une deuxième lecture sur le texte.

- Comment les « fonds vautours » saignent l’industrie française (blast-info.fr)

Les entreprises souffrent, peinent à résister à la concurrence internationale, accumulent les fragilités. Des fonds d’investissement ont flairé la proie. Ils se présentent en sauveurs, rachètent les sociétés en difficulté, les pressent jusqu’à l’os, en extraient le maximum — puis passent à autre chose, laissant derrière eux des coquilles vides et des emplois détruits. L’État, lui, regarde. Parfois il participe.

- « Airbnb, c’est fini » : Amende record à Paris pour cet immeuble de meublés touristiques illégaux proposés sur la plateforme (huffingtonpost.fr)

Dans le 9e arrondissement, cet immeuble avait été entièrement transformé fin 2023 en onze meublés de tourisme, loués sur la plateforme Airbnb.

- Nouveau piratage au ministère de l’Éducation nationale, les données des élèves volées par les hackers (clubic.com)

C’est un gros coup dur pour l’Éducation nationale, qui confirme ce mardi soir avoir été victime d’une nouvelle cyberattaque, qui expose les données d’élèves liées à ÉduConnect.

- Pour l’Anssi, la France n’est pas « à la hauteur » des cyberattaques à son encontre (01net.com)

La France est le pays le plus piraté du monde, mais Vincent Strubel, directeur général de l’Anssi, continue de minimiser la gravité de la situation. Il reconnaît néanmoins, à demi-mots, que « personne n’est réellement à la hauteur » pour lutter contre l’explosion des fuites de données.

- “Ils ont grignoté la fibre”, à Buxerolles des rats privent des centaines de personnes d’Internet (francebleu.fr)

Les rongeurs sont attirés par l’amidon qui protège la fibre.

- Infertilité, malformations fœtales, thyroïde… L’Anses alerte sur le lithium, une « substance extrêmement préoccupante » (reporterre.net)

- LVMH et L’Oréal dépensent des millions pour retarder l’interdiction de vente de leurs produits cancérogènes (reporterre.net)

- Des analyses ADN révèlent que la culture de la vigne existait déjà en France il y a 2 600 ans (humanite.fr)

L’analyse génétique de pépins anciens menée par une équipe scientifique internationale a montré que la culture de la vigne a débuté en France vers 600 avant J.-C. et que le célèbre pinot noir existait déjà au XVe siècle.

- #MeTooGarçons : trois documentaires essentiels pour entendre la parole des victimes (telerama.fr)

Comme l’intense récit de Frédéric Pommier dans “Derrière les arbres”, des hommes ont osé briser le silence qui entoure les abus sexuels subis dans l’enfance.

- « La justice doit sortir de ce temps limité » : une proposition de loi pour lever la prescription pour tous les crimes commis sur les enfants (humanite.fr)

Spécial femmes en France

- Les pionnières du rugby féminin obtiennent enfin le coq français sur leur maillot (lesnouvellesnews.fr)

Il aura fallu attendre 44 ans. Lors du premier Tournoi des Six Nations féminin en 1982, le coq, emblème sportif français, était absent des maillots de l’équipe de France féminine de rugby.

- Le site internet Coco a rouvert sous une nouvelle adresse URL et sous le nom de Cocoland. Cette plateforme de tchat était notamment au cœur du retentissant procès des viols de Mazan. (huffingtonpost.fr)

- Ce post de Virginie Grimaldi sur l’exhibition sexuelle d’un homme libère la parole de centaines de femmes (huffingtonpost.fr)

Dans un long post Instagram, Virginie Grimaldi raconte avoir porté plainte après avoir surpris, à la piscine, le comportement sexuel d’un homme à quelques mètres de ses enfants.

- Jean Imbert évincé du restaurant du Plaza Athénée après des accusations de violences conjugales (huffingtonpost.fr)

- Quatre nouvelles femmes accusent Patrick Bruel de violences sexuelles (telerama.fr)

“Elle” relaie les témoignages de quatre femmes, qui racontent des agressions sexuelles et, pour l’une, un viol, survenus entre 2000 et 2015. Selon le magazine, deux ont porté plainte. Le chanteur réfute ces accusations.

- Coupable d’agressions sexuelles sur Adèle Haenel, Christophe Ruggia voit sa peine alourdie en appel (huffingtonpost.fr)

Le réalisateur qui avait fait appel après le procès en première instance, voit sa peine être alourdie à cinq ans de prison dont deux ferme sous bracelet électronique.

- Viol : l’archaïsme judiciaire (politis.fr)

Il y a des jours on se dit que les choses avancent. Et d’autres où « l’archaïsme » revient avec toute sa brutalité. « Archaïsme », c’est le mot qu’a choisi Daphné, qui préfère un nom d’emprunt, pour qualifier le choix de la cour d’appel de Paris de ne pas qualifier de « viol », mais d’« agression sexuelle », les milliers de cunnilingus qui lui ont été imposés entre ses 8 et 14 ans par son responsable légal.

RIP

- Nathalie Baye, une grande actrice en douze rôles, parmi tant d’autres (telerama.fr) – voir aussi Nathalie Baye vue par Noémie Lvovsky : “Elle avait un désir de vie et de joie qui l’emportait sur tout” (telerama.fr)

- Maladie à corps de Lewy : quelle est cette maladie neurocognitive fréquente, mais peu connue, qui a emporté Nathalie Baye ? (theconversation.com)

Cette maladie neurocognitive […] est fréquente, puisqu’en France, elle affecte environ 250 000 personnes, ce qui en fait la deuxième maladie neurodégénérative la plus répandue, derrière la maladie d’Alzheimer, et la place au même rang que la maladie de Parkinson.

- Décès de l’actrice Nadia Farès (humanite.fr)

L’actrice Nadia est morte vendredi soir à l’âge de 57 ans, des suites d’un incident survenu dans une piscine il y a une semaine.

Spécial médias et pouvoir

- « 100 % Politique » sur CNews : une fake news toutes les quatre minutes (blast-info.fr)

La chaîne d’extrême droite CNews est non seulement une machine à produire des outrances racistes mais aussi une usine de fabrication et de diffusion de fake news. Pour tenter d’objectiver, au moins partiellement, ce dernier phénomène, quoi de plus efficace que de prendre un programme, presque au hasard, et de compter, tout simplement, les fake news énoncées à l’antenne ? Une tâche à laquelle Blast s’est consacré, avec cet éloquent résultat : plus de 20 fake news en 1h30 d’émission « 100 % Politique » le 23 mars, soit environ une toutes les quatre minutes.

- Grasset : la fascisation à l’ouvrage (politis.fr)

En plaçant sous ses ordres la maison d’édition, Bolloré poursuit son offensive idéologique sans réelle résistance.

- Dans le “JDD”, Vincent Bolloré lance une violente contre-offensive contre ce qu’il nomme la “petite caste” de l’édition (telerama.fr)

Dans une prise de parole rarissime, le milliardaire tente de décrédibiliser les éditeurs et auteurs qui s’élèvent contre lui depuis l’éviction d’Olivier Nora de la tête de Grasset.

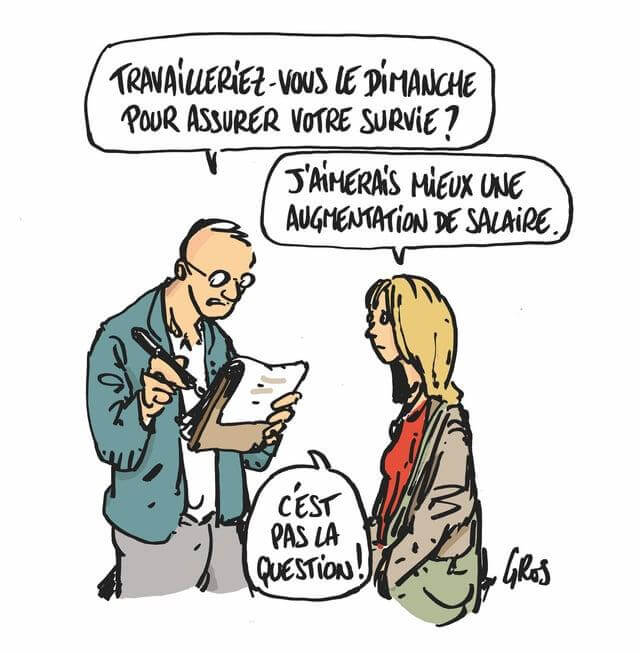

- 1er mai : les éditorialistes veulent « libérer le travail » (acrimed.org)

C’est ce que les journalistes appellent « un marronnier ». Comme (presque) chaque année, une proposition de loi visant à autoriser le travail le 1er mai a été mise sur la table ; et comme (presque) chaque année, une grande partie de la presse a soutenu l’idée.

- Rima Hassan et « la drogue » (2) : désinformation de Franc-Tireur et LCI (acrimed.org)

Spécial emmerdeurs irresponsables gérant comme des pieds (et à la néolibérale)

- Loi « simplification » : 8 mesures qui détricotent nos droits sociaux et environnementaux (basta.media)

Le Sénat vote aujourd’hui le projet de loi « simplification de la vie économique des entreprises ». La suppression des ZFE a été au centre des débats. Mais d’autres mesures portent aussi atteinte au droit du travail et au droit environnemental.

- À défaut d’une loi pour le grand âge, le plan (au rabais) du gouvernement (huffingtonpost.fr)

En 2018, Emmanuel Macron promettait une « loi Grand âge ». À un an de la fin de son deuxième mandat, la promesse est en route pour les oubliettes.

- Reculade et pugilat : anatomie du crash de Renaissance sur le travail le 1er mai (huffingtonpost.fr)

La reculade du gouvernement sur le travail du 1er mai a provoqué de vives protestations au sein du « bloc central ». C’est un échec personnel pour Gabriel Attal.

- Matignon retarde la mise en place d’une taxe sur les PFAS et fait économiser des millions d’euros à l’industrie chimique (radiofrance.fr) – voir aussi Victoire pour les industriels : la taxe sur les PFAS repoussée de 6 mois (reporterre.net)

- Comment les grands exploitants détournent un statut censé protéger les petits paysans (reporterre.net)

Le fermage, un statut sécurisant l’accès au foncier agricole, fête ses 80 ans, mais ses failles sont exploitées par les grands exploitants. De quoi perturber l’accès fondamental à des terres, premier enjeu pour l’installation agricole.

Spécial recul des droits et libertés, violences policières, montée de l’extrême-droite…

- Loi Yadan : tout comprendre à ce texte « dramatique pour tous les mouvements sociaux » (basta.media)

- L’internationale réactionnaire et ses relais en France (multinationales.org)

Think tanks étatsuniens, organisations financées par la Hongrie ou la Russie, instituts libertariens… Enquêtes sur les réseaux de l’extrême droite internationale qui influencent discrètement le débat politique et médiatique français.

- Réseaux Orbán et MAGA : les liaisons dangereuses de l’Observatoire de l’immigration et de la démographie (multinationales.org)

Interlocuteur privilégié des médias Bolloré, financé par Pierre-Édouard Stérin, le directeur du très controversé Observatoire de l’immigration et de la démographie (OID) propage ses idées anti-immigration dans tout le spectre politique et médiatique français. Il reste beaucoup plus discret sur ses liens étroits avec l’extrême droite américaine, l’administration Trump et les réseaux de Viktor Orbán en Hongrie.

- « Nous sommes face à un racisme de compétition, où l’enjeu va être de ramener les gens “à leur place” » (bondyblog.fr)

Bally Bagayoko, Aly Diouara ou encore Mélissa Youssouf : ces noms illustrent une évolution récente de la vie politique locale. Si les dernières élections municipales ont marqué une progression de la représentativité, elles ont aussi déclenché une vague de réactions racistes.

- « À chacun une balle » : le média d’extrême droite « Frontières » jugé pour divulgation de données personnelles d’avocats menacés de mort (humanite.fr)

- « Tu tires dans le tas » : le député LFI Thomas Portes saisit la justice après un documentaire sur le RN (huffingtonpost.fr)

Un documentaire diffusé sur France 5 montre un militant RN tenir des propos violents d’appel au meurtre contre des élus de La France insoumise.

- Rima Hassan dénonce des « manquements » des policiers lors de sa garde à vue et saisit la Défenseure des droits (lemonde.fr)

Spécial résistances

- Porto Alegre 2026 : une convergence antifasciste et anti-impérialiste ! (contretemps.eu)

- Après le licenciement “inacceptable” du PDG de Grasset, 115 auteurices vont quitter la maison d’édition (france24.com)

Un total de 115 auteurices, dont des poids lourds de la littérature comme Virginie Despentes et Sorj Chalandon, annoncent dans une lettre rendue publique mercredi quitter Grasset en opposition au licenciement de son PDG, Olivier Nora. Iels fustigent “une atteinte inacceptable à l’indépendance éditoriale” et le mépris de Vincent Bolloré

Voir aussi Séisme chez Grasset : plus de 300 auteurices demandent une « clause de conscience » (huffingtonpost.fr)

Leïla Slimani, Virginie Despentes et Emmanuel Carrère figurent parmi les signataires de ce texte, pour qui « il est temps de poser une limite ».

- Lignes fermées, trains de nuit abandonnés : les « sans trains » à l’assaut du Sénat (reporterre.net)

Lignes fermées, trains de nuit délaissés… À Paris, des « sans trains » ont interpellé les sénateurs et exprimé leur colère quant à l’avenir du rail dans le pays, alors qu’une loi jugée « insuffisante » entre en débat le 15 avril.

- Il dessinait des ronds sur les arbres pour empêcher leur coupe : le « peintre de Fontainebleau » fait plier l’ONF au tribunal (vert.eco)

Serge Geoffre a été poursuivi par l’Office national des forêts pour avoir recouvert des marques de peinture apposées sur les arbres à abattre. Loin d’être isolée, son action s’inscrit dans la généalogie d’une lutte, vieille de deux siècles, contre l’exploitation de la forêt de Fontainebleau. Elle pourrait faire jurisprudence. […] La méthode des forces de l’ordre, avant son procès, a pu interpeller. Le 24 avril 2025, après avoir été convoqué au commissariat de Nemours, Serge G. est placé en garde à vue et interrogé par sept officiers. Quelles sont ses motivations ? Est-il le chef d’un commando ? Avec le stress, sa tension monte haut, trop haut, direction l’hôpital, les soignant·es succèdent aux matons, une perfusion, et un procès près d’un an plus tard.

Spécial outils de résistance

- Violations des droits de l’homme par Israël : exigeons la suspension totale de l’accord d’association UE-Israël (eci.ec.europa.eu)

Soutenir

- Appel à dons : Contretemps a besoin de vous ! (contretemps.eu)

Spécial MAGAM et cie

- Liban, Palestine : comment les GAFAM manipulent les cartes (bonpote.com)

Apple aurait-il “effacé” des villages du sud du Liban sur ses cartes ? Alors que l’armée israélienne progresse dans cette région, faisant des centaines de morts, le géant du numérique est sous le feu des critiques, de nombreux internautes l’accusant de complicité avec Tsahal.

- Google, Microsoft, Meta All Tracking You Even When You Opt Out, According to an Independent Audit (404media.co)

- Facebook and Instagram Tighten Censorship Rules for Saying “Antifa” (theintercept.com)

Meta’s new rules let it ban users or suppress comments that include the word “antifa” alongside “content-level threat signals.”

- Your Kindle’s not obsolete, it just needs a jailbreak – and I’ll show you how it’s done (zdnet.com)

You can transform your old Kindle – even a bricked device – into the ultimate open-source reader. Here’s how.

Les autres lectures de la semaine

- Privacy is Also Protecting the Data of Others (privacyguides.org)

If you care about privacy rights, you must also care for the data of the people around you. To make privacy work, we need to develop a culture that normalizes caring for everyone’s data, not just our own. Privacy cannot solely be a personal responsibility, data privacy is team work.

- Austerity creates fascism (pluralistic.net)

I’m worried about AI psychosis. Specifically, I’m worried about the psychosis that makes our “capital allocators” spend $1.4T on the money-losingest technology in the history of the human race, in pursuit of a bizarre fantasy that if we teach the word-guessing program enough words, it will take all the jobs.

- Crise du pétrole : les banlieues américaines contre le reste du monde (nouvelobs.com)

Derrière la nécessité pour les Etats-Unis d’être abreuvés en essence, il y a un modèle urbain et la dépendance qu’il suppose à la voiture. […] Les tensions actuelles autour du pétrole du Moyen-Orient ne sont pas seulement géopolitiques.

- Tchernobyl : le nuage a-t-il vraiment évité la France ? Les cartes météo relancent le débat (meteo-paris.com)

le nuage radioactif a effectivement atteint notre pays dès le 30 avril au soir, avant de s’étendre rapidement à la quasi totalité du pays dès le lendemain, grâce à ce flux à dominante continentale.Le nuage s’est ensuite rapidement évacué dès le lendemain soir avec la bascule du flux au sud-ouest, persistant toutefois plus longuement (jusqu’au 4 mai) sur le sud-est du pays.

- La grossesse modifie le cerveau – et nous commençons tout juste à comprendre comment et pourquoi (theconversation.com)

- Neanderthal infants were enormous compared with modern humans (newscientist.com)

A detailed analysis of the best-preserved Neanderthal infant skeleton ever found suggests that our ancient relatives grew much faster as young children

- Why Fructose Behaves Less Like a Calorie and More Like a Hormone (scienceblog.com)

A molecule telling the body to prepare for a famine that never arrives.

- Comment les reines bourdons peuvent‑elles survivre plusieurs jours sous l’eau ? (theconversation.com)

- Sperm whales’ communication closely parallels human language, study finds (theguardian.com)

Analysis shows whales’ coda vocalizations are ‘highly complex’ and remarkably similar to our own

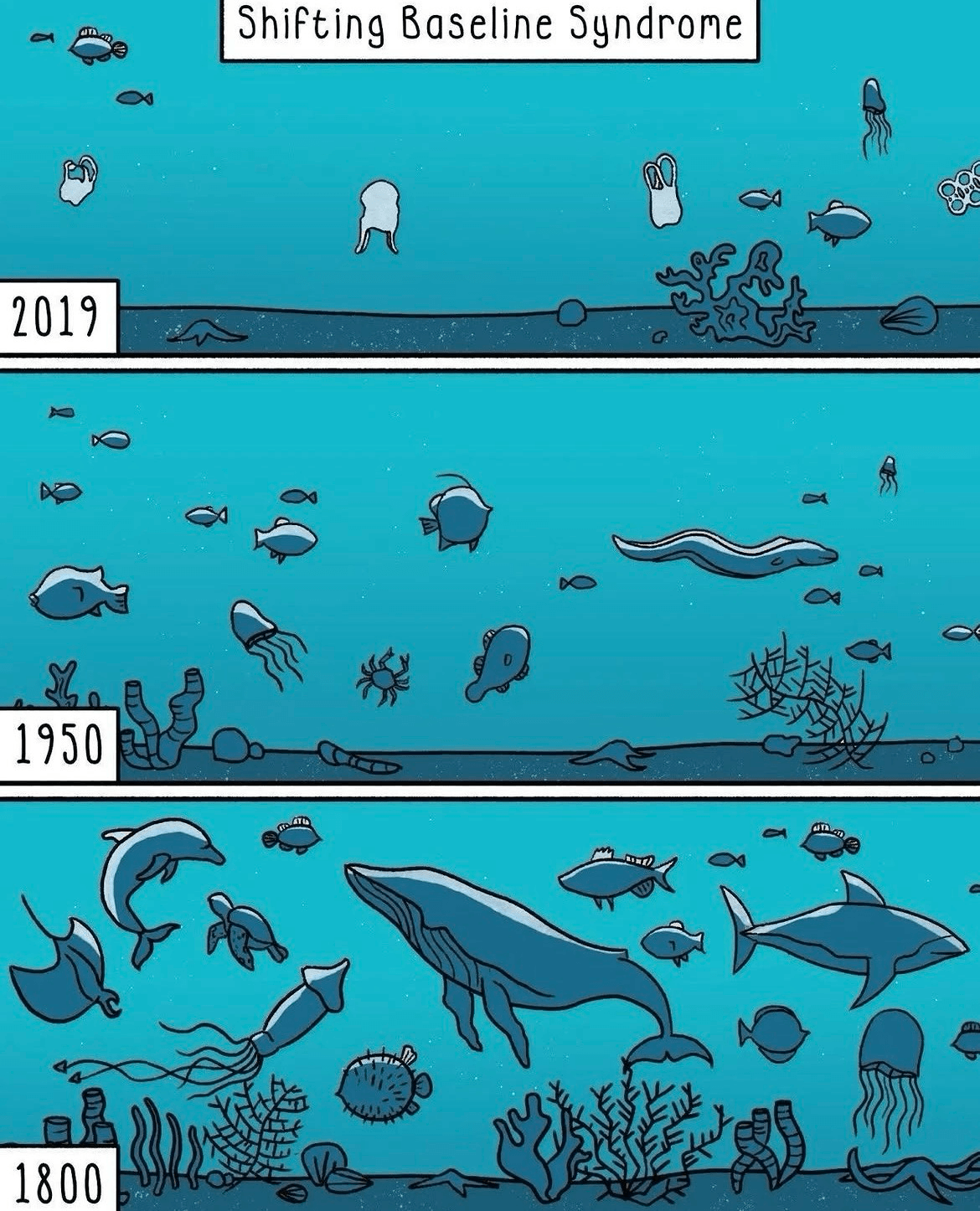

- La mer et les océans, symboles de la crise climatique et de l’inaction politique (basta.media)

Les BDs/graphiques/photos de la semaine

- Shifting Baseline Syndrome

- Question

- Mémoire

- Mode

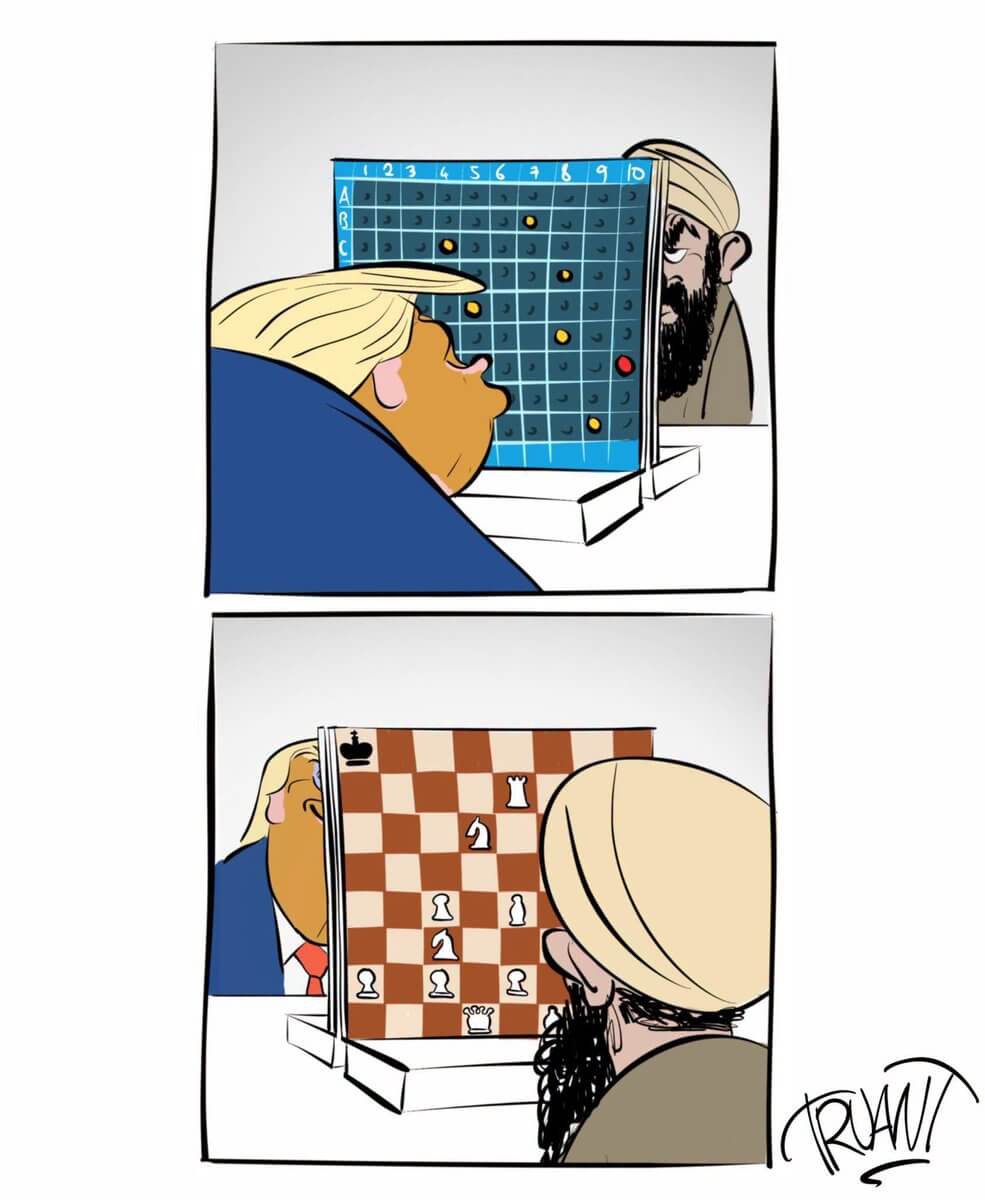

- Partie

- Schrödinger

- Confession

- Basically

- Classes

- Common

- Retour

- Cat

Les vidéos/podcasts de la semaine

- Chez Meta, l’IA en taille Patron (radiofrance.fr)

Mark Zuckerberg développe un jumeau numérique en intelligence artificielle capable d’interagir avec ses employés, incarnant une vision d’un travail permanent et ultra-connecté. Après l’échec du métavers, Meta investit massivement dans l’IA, tout en réduisant ses effectifs.

- Data Center : Deux fermières du Kentucky refusent une offre d’achat à 26 millions de dollars (radiofrance.fr)

Deux fermières du Kentucky refusent 26 millions de dollars pour vendre leurs terres à une entreprise d’IA voulant y construire un data center.

- Dématérialisation, algorithmes, IA : comment ils durcissent notre rapport à l’État (3 épisodes) (radiofrance.fr)

- Pas d’antenne 5G, pas d’internet : communiquer sous les radars avec les réseaux mesh (tube.fdn.fr)

- Un noir est élu à Saint-Denis – Les Goguettes (en trio mais à quatre) (indymotion.fr)

- « Sans mon bras, j’aurais été défiguré » : Flavel, victime de violences policières à Noisiel, témoigne (humanite.fr)

- Darmanin veut faire juger les viols en un jour (indymotion.fr)

- Louis Boyard : « Je ne reconnais pas la France » (tube.fdn.fr)

- Chroniques d’un antifascisme ordinaire (humanite.fr)

Autrice de « L’antifascisme, l’affaire de toutes et de tous », Juliette Rousseau, a réalisé une série de six portraits de femmes et d’hommes qui, au quotidien, font reculer le fascisme et le racisme et font vivre la solidarité.

Les trucs chouettes de la semaine

- “Sécurix et Bureautix, voici à quoi ressemble vraiment le Linux qui va remplacer Windows en France” (clubic.com)

- The People’s Permacomputer Project (permacomputer.solarpunk.au)

- Solar panels are creating an unexpected effect by forming rainfall clouds and thriving oases in the middle of the desert (ecoportal.net)

- Culottes et coupes menstruelles seront remboursées dès septembre (reporterre.net)

- Des scientifiques parviennent à neutraliser en laboratoire la cause génétique de la trisomie 21 (slate.fr)

Grâce à une combinaison de CRISPR et d’un mécanisme naturel, des chercheureuses ont réussi à désactiver le chromosome surnuméraire responsable du syndrome dans des cellules humaines.

- ‘Rediscovered’ species in Papua spotlight importance of Indigenous knowledge (news.mongabay.com)

Retrouvez les revues de web précédentes dans la catégorie Libre Veille du Framablog.

Les articles, commentaires et autres images qui composent ces « Khrys’presso » n’engagent que moi (Khrys).

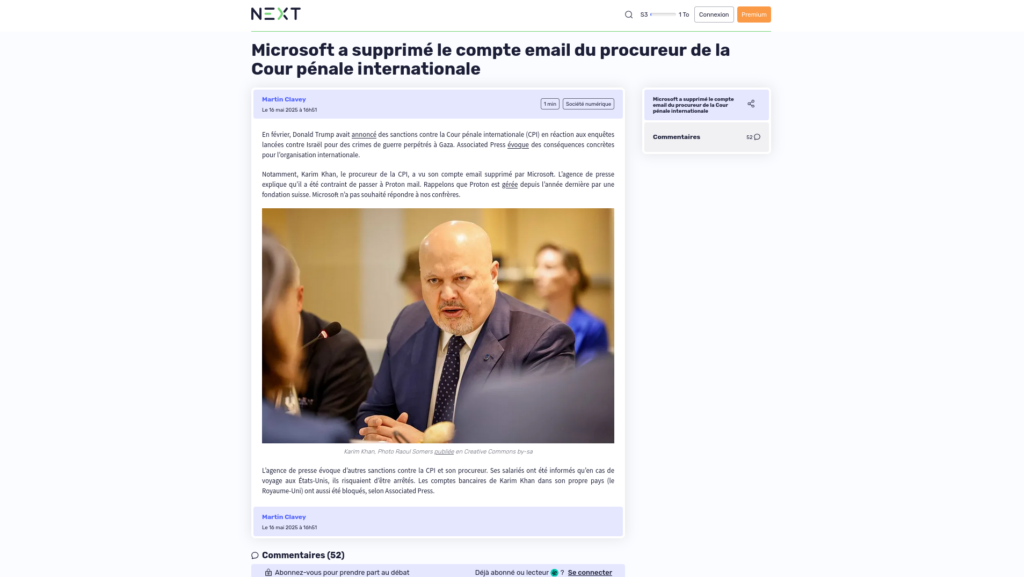

16.04.2026 à 20:59

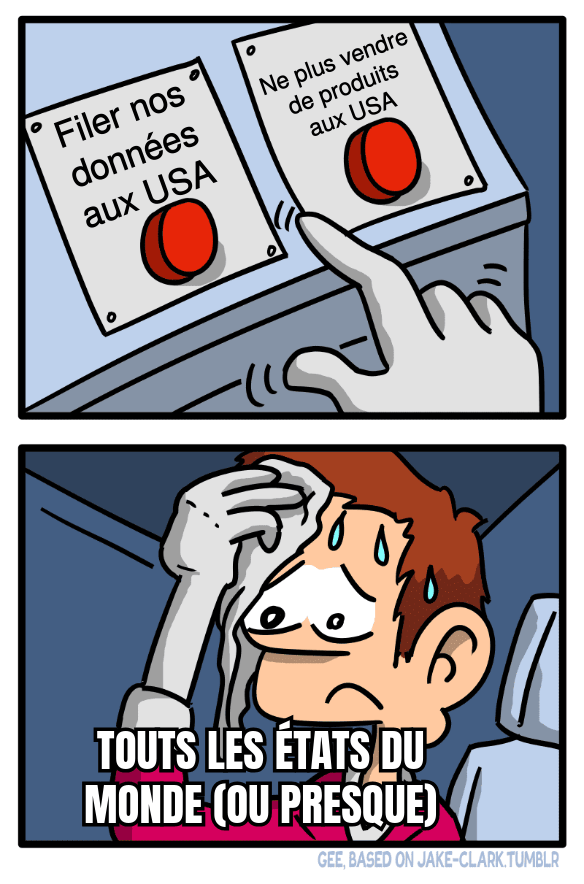

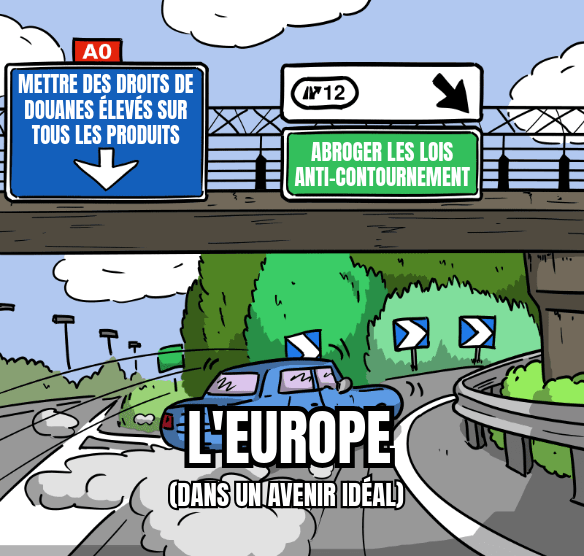

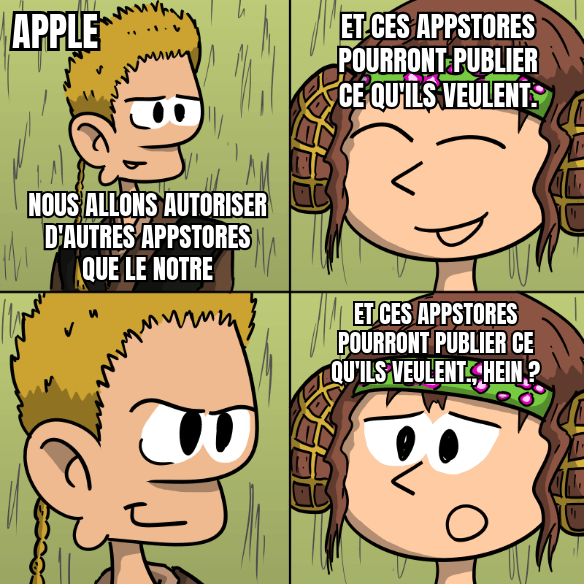

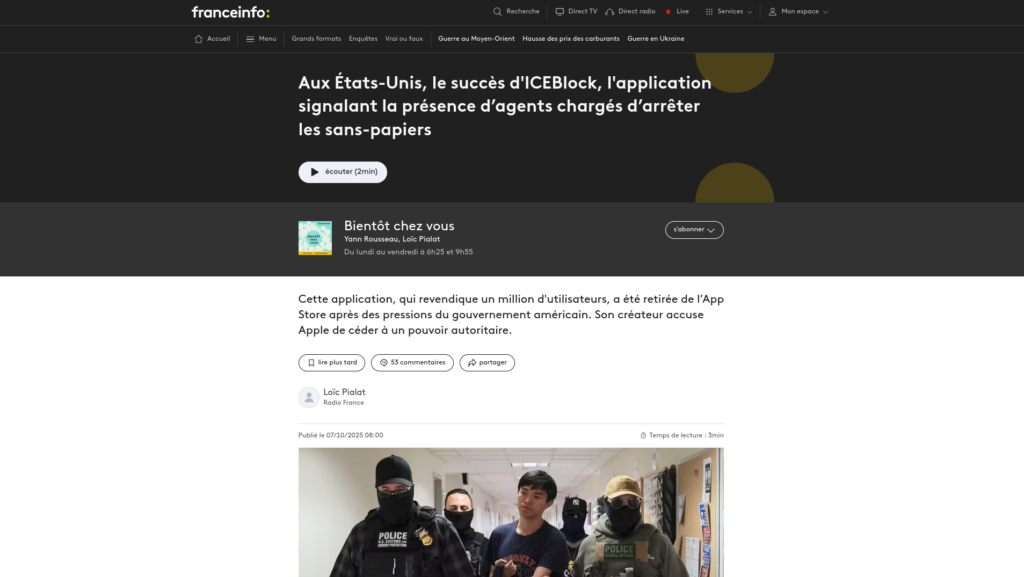

L’internet post-étasunien

Texte intégral (13631 mots)