ACCÈS LIBRE UNE Politique International Environnement Technologies Culture

27.10.2024 à 11:09

« Allez-vous acheter moins de bouteilles en plastique ? » Une simple question peut changer nos comportements

Bing Bai, Doctorant en Marketing à l'Université de Montpellier - Attaché d'enseignement à l'EDHEC Business School, Université de Montpellier

Laurie Balbo, Professeure Associée en Marketing _ Directrice des Programmes MSc Marketing et MSc Digital Marketing & Data Analytics, Grenoble École de Management (GEM)

Marie-Christine Lichtlé, Professeur des Universités, Université de Montpellier

Texte intégral (1872 mots)

Envisagez-vous d’acheter moins de bouteilles d’eau en plastique à l’avenir ? Peut-être pas, mais maintenant que la question vous a été posée, vous allez forcément y penser. Cet effet psychologique pourrait être utilisé pour inciter à diminuer à la consommation de plastique.

Avec un taux de croissance de 73 % au cours de la dernière décennie, le marché de l’eau en bouteille est l’un de ceux qui connaissent la plus forte augmentation au niveau mondial. Malheureusement, cette consommation a des conséquences environnementales néfastes : augmentation des déchets plastiques, émissions de gaz à effet de serre liées à la production, le transport et la distribution des bouteilles ou encore surexploitation des ressources en eau pour produire de l’eau en bouteille. Ces impacts ne font qu’aggraver la crise écologique actuelle. Face à cette situation, la réduction de notre dépendance à l’eau embouteillée émerge comme un enjeu environnemental crucial.

En 2020, une étude de Futerra et OnePulse révèle que 80 % des sondés se disent prêts à changer leurs habitudes pour lutter contre le changement climatique et 50 % d’entre eux envisagent de limiter leur usage de plastique. Cependant, peu de recherches ont été dédiées aux stratégies de communication qui permettraient de diminuer la consommation d’eau en bouteille.

Les autoprophéties : une question pour favoriser le changement

Nos recherches explorent l’impact de ce que nous appelons les autoprophéties sur la réduction de l’achat d’eau en bouteille plastique aux États-Unis, en nous appuyant sur un échantillon de 269 personnes. Les autoprophéties désignent un phénomène psychologique selon lequel le simple fait de poser des questions aux individus sur leurs comportements futurs (par exemple : « Allez-vous recycler vos emballages ? ») peut accroître la probabilité qu’ils adoptent ces comportements. Notre étude analyse ce processus et examine comment des facteurs individuels peuvent en moduler les effets.

Des chercheurs ont montré que l’on peut expliquer les effets des autoprophéties grâce à la théorie de la dissonance cognitive. Lorsqu’une personne est invitée à prédire son comportement futur, elle peut prendre conscience d’un écart entre ses croyances normatives (ce qu’elle considère comme socialement désirable ou acceptable) et ses comportements. Cette incohérence suscite une dissonance, c’est-à-dire une contradiction, qui motive souvent les individus à modifier leurs actions pour mieux les aligner avec leurs valeurs.

Ressentir à l’avance la culpabilité d’une action contraire à nos valeurs

Dans notre étude, nous montrons le mécanisme émotionnel par lequel la demande d’autoprophétie influence les comportements pro-environnementaux, par l’intermédiaire de la culpabilité anticipée. Dans son ouvrage intitulé Une théorie de la dissonance cognitive, le psychosociologue américain Leon Festinger décrit la dissonance comme un état caractérisé par un inconfort psychologique, provoquant ainsi une aversion et une motivation à changer de comportement. Toutefois, il ne précise pas explicitement la nature de cet inconfort. Des théoriciens ultérieurs de la dissonance ont identifié la culpabilité comme une émotion provoquée par la dissonance dans certaines situations.

Nous avons exploré cette idée en nous concentrant spécifiquement sur la culpabilité, en formulant l’hypothèse que les individus anticipent ce sentiment lorsqu’ils envisagent de ne pas adopter un comportement écologique. C’est notamment le cas lorsque ce comportement est en accord avec leurs croyances normatives (c’est-à-dire les attentes sociales ou culturelles auxquelles se conformer dans certaines situations). Ainsi, cette anticipation de la culpabilité conduit à répondre à des demandes de comportements alignés sur des valeurs écologiques, pour éviter ce sentiment négatif.

Pour tester cette hypothèse, nous avons mesuré la culpabilité chez des participants exposés à une publicité contenant une question de prédiction dont le but était de réduire leurs achats d’eau en bouteille plastique. Ces participants ressentaient à l’avance davantage de culpabilité que ceux du groupe de contrôle, exposés à une publicité sans question de prédiction. Cette culpabilité anticipée réduit, à son tour, leur intention d’acheter de l’eau en bouteille.

Des effets qui varient selon les individus

Nous avons exploré deux facteurs pouvant influencer l’efficacité de la technique des autoprophéties : les croyances normatives et les motivations qui poussent les personnes à s’engager dans une action.

Des recherches antérieures ont souligné l’importance des croyances normatives. Les individus fortement attachés à leurs croyances sont plus enclins à prédire qu’ils adopteront des comportements en accord avec celles-ci et à les mettre réellement en place. Nous avons examiné comment différents types de normes influencent les intentions. En effet, certaines normes sont descriptives (ce que la majorité des gens font), d’autres sont injonctives (ce que nous pensons qu’il est attendu de nous) et enfin certaines sont personnelles (nos propres standards moraux internes).

Les résultats montrent que ces trois types de normes influencent directement le sentiment de culpabilité anticipée. Les participants pensent que la plupart des gens achètent moins de bouteilles, qu’il est socialement attendu de le faire, et que cela correspond à leurs convictions personnelles. Plus ces normes sont fortes, plus la culpabilité anticipée en cas de non-conformité augmente. Cependant, nous n’avons observé aucune interaction entre les normes et la question de prédiction. Cela suggère qu’une question de prédiction ne rend pas les croyances normatives plus saillantes au moment de la prédiction, et qu’elles ne guident donc pas les participants dans leur prise de décision.

Par ailleurs, nous avons étudié la motivation d’approche, c’est-à-dire le désir de s’engager dans des actions qui procurent des expériences positives ou des récompenses. Ainsi, nous pouvons mesurer un score dit de BAS (pour behavioral approach system, ou système d’approche comportementale) : les individus avec les plus forts scores ont plus tendance à essayer de remplir leurs objectifs, qu’ils soient concrets (par exemple atteindre ou saisir un objet), ou plus abstraits (par exemple l’altruisme ou la productivité). Ces individus fournissent des efforts accrus pour atteindre les buts qui leur procurent du plaisir, réduisant ainsi l’écart entre les objectifs qu’ils se sont fixés et ce qu’ils font en réalité.

Les plus enclins à la dissonance sont ceux qui remplissent le moins leurs objectifs

Contrairement à notre hypothèse, les individus qui ont une faible sensibilité aux récompenses et à la recherche d’expériences positives ressentent davantage de culpabilité que ceux avec un fort score. Notre interprétation est que bien que les individus qui ont un score faible à ce test soient moins motivés à agir pour atteindre leurs objectifs, ils prennent d’autant plus conscience de l’écart entre leurs comportements actuels et leurs normes personnelles lorsqu’on leur pose une question à ce propos. Cette conscience accrue de l’inadéquation entre leurs actions et leurs normes, même en l’absence d’une forte motivation, génère un sentiment de culpabilité anticipée plus fort. Par conséquent, bien qu’ils aient moins d’impulsion à agir, cette anticipation de la culpabilité accroît leur intention de réduire leur consommation de bouteilles en plastique.

À l’inverse, les individus avec un score élevé semblent intrinsèquement disposés à aligner leurs actions avec leurs normes, ce qui réduit leur dissonance cognitive. Ils semblent agir de manière proactive pour combler l’écart entre leurs comportements et leurs objectifs, diminuant ainsi la culpabilité anticipée.

Utiliser les autoprophéties dans les campagnes environnementales

Les résultats de notre étude ouvrent des perspectives pour les campagnes de sensibilisation environnementale. Les agences gouvernementales et les ONG peuvent aisément intégrer des questions de prédiction dans leurs communications pour favoriser des comportements écologiques.

Contrairement à de précédents résultats, nos résultats n’ont pas mis en évidence l’effet des croyances normatives sur l’efficacité des autoprophéties. Si un tel effet avait été observé, nous aurions constaté que plus les participants adhéraient à des croyances normatives fortes, plus leur comportement aurait été influencé par l’autoprédiction, en particulier en adaptant leurs actions pour correspondre à ces normes. Toutefois, la littérature montre que les normes personnelles influencent la façon dont les individus forment leurs intentions et adoptent des comportements écologiques. Nous recommandons donc d’avoir recours aux normes personnelles dans les campagnes utilisant des autoprophéties, par exemple en créant des messages qui mettent en avant la nécessité d’actions pro-environnementales et les conséquences de l’inaction.

Il convient également de noter que cette étude se concentre sur les intentions comportementales. Des recherches antérieures ont cependant montré les effets des autoprophéties sur les comportements réels (et non anticipés) et répétés dans le temps. Par exemple, certaines études ont documenté des améliorations dans le recyclage sur des périodes de quatre semaines après le protocole, ou encore une augmentation de la fréquentation des clubs de sport sur des périodes allant jusqu’à six mois après la prédiction. Ces différents résultats nous permettent de constater qu’une simple question, en exploitant un levier émotionnel, peut réellement inciter le public à changer ses pratiques.

Bing Bai a reçu des financements de la chaire Marketing responsable et bien-être de l'Université de Montpellier.

Laurie Balbo et Marie-Christine Lichtlé ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur poste universitaire.

24.10.2024 à 15:07

IA, cryptomonnaies et vie privée : les positions de Harris et Trump sur la régulation du numérique

Anjana Susarla, Professor of Information Systems, Michigan State University

Texte intégral (2756 mots)

En cette « année électorale » 2024, où vote la moitié de la planète, la présidentielle américaine est cruciale pour l’avenir des nouvelles technologies. En particulier, nombre des géants du numérique sont américains.

Ainsi, le ou la prochain président américain aura une influence sur les lois qui chercheront, ou pas, à équilibrer les contributions des systèmes d’intelligence artificielle, à protéger la vie privée des citoyens, ou à ajuster les situations de monopoles commerciaux. Quels sont les bilans des deux candidats sur ces sujets ?

Il n’est pas surprenant que la réglementation des technologies soit un thème important de la campagne présidentielle américaine de 2024.

Les technologies numériques – des algorithmes des médias sociaux aux systèmes d’intelligence artificielle basés sur des grands modèles de langage – ont profondément affecté la société ces dix dernières années. Ces changements se sont étalés sur les administrations Trump et Biden-Harris et ont suscité une forte demande auprès du gouvernement fédéral pour qu’il réglemente les technologies et les puissantes entreprises qui les manient.

Je suis chercheuse en systèmes d’information et en IA et j’ai examiné le bilan des deux candidats à l’élection présidentielle américaine de ce 5 novembre en matière de réglementation des technologies.

Voici les principales différences.

Des algorithmes préjudiciables

Les outils d’intelligence artificielle étant désormais très répandus, les gouvernements du monde entier doivent aborder la difficile question de la régulation de ces technologies aux multiples facettes.

À lire aussi : L’échiquier mondial de l’IA : entre régulations et soft power

Les candidats à la présidentielle américaine proposent des visions différentes de la politique américaine en matière d’intelligence artificielle. Une des différences notables tient à la reconnaissance des risques liés à l’utilisation généralisée de l’IA.

En effet, l’IA affecte tous les pans de la société de façons qui passent parfois inaperçues mais peuvent avoir des conséquences importantes. Ainsi, les biais dans les algorithmes utilisés pour les prêts et les décisions d’embauche pourraient finir par renforcer un cercle vicieux de discrimination. Par exemple, un étudiant qui ne peut pas obtenir de prêt pour l’université aurait moins de chances d’obtenir l’éducation nécessaire pour sortir de la pauvreté.

À lire aussi : Emploi, sécurité, justice : d’où viennent les « biais » des IA et peut-on les éviter ?

Lors du sommet sur la sécurité de l’IA (AI Safety Summit) qui s’est tenu au Royaume-Uni en novembre 2023, Kamala Harris a évoqué les promesses de l’IA, mais aussi les dangers que représentent les biais algorithmiques, les « deepfakes » et les arrestations abusives.

Joe Biden a signé un décret sur l’IA le 30 octobre 2023, qui reconnaît que les systèmes d’IA peuvent présenter des risques inacceptables d’atteinte aux droits civils et humains et au bien-être des individus. Parallèlement, des agences fédérales telles que la Federal Trade Commission ont pris des mesures d’applications de lois existantes pour protéger les utilisateurs contre les préjudices algorithmiques.

En revanche, l’administration Trump n’a pas pris position publiquement sur la limitation de ces mêmes risques algorithmiques, et Donald Trump a déclaré qu’il voulait abroger le décret sur l’IA du président Biden. Toutefois, il a récemment évoqué lors d’interviews les dangers liés à des technologies telles que les deepfakes, ainsi que les défis posés par les systèmes d’IA en termes de sécurité, suggérant une volonté de s’attaquer aux risques croissants liés à l’IA.

Normes et standards technologiques

L’administration Trump a signé le décret sur l’initiative américaine en matière d’IA (American AI Initiative) le 11 février 2019. Ce décret promet de doubler les investissements dans la recherche sur l’IA et établit la première série d’instituts nationaux américains de recherche sur l’IA. Le décret comprend également un plan pour standardiser et établir des normes techniques pour l’IA et établit des orientations pour l’utilisation de l’IA par le gouvernement fédéral.

Le 3 décembre 2020, M. Trump a également signé un décret promouvant l’utilisation d’une IA digne de confiance au sein du gouvernement fédéral.

L’administration Biden-Harris a tenté d’aller plus loin. Harris a convoqué les dirigeants de Google, de Microsoft et d’autres entreprises technologiques à la Maison Blanche le 4 mai 2023, pour prendre une série d’engagements volontaires afin de protéger les droits des individus.

De plus, le décret de l’administration Biden contient une initiative importante visant à sonder la vulnérabilité de modèles d’IA de très grande taille et à usage général entraînés sur des quantités massives de données : le but est de déterminer les risques que des modèles comme ChatGPT d’OpenAi ou DALL-E se fassent pirater par des hackers.

Droit de la concurrence

L’application de la législation antitrust – qui restreint ou conditionne les fusions et acquisitions d’entreprises pour limiter les monopoles – est un autre moyen pour le gouvernement fédéral de réglementer l’industrie technologique.

En termes de droit de la concurrence, l’administration Trump a tenté de bloquer l’acquisition de Time Warner par AT&T – mais la fusion a finalement été autorisée par un juge fédéral après que la FTC, sous l’égide de l’administration Trump, a intenté une action en justice pour bloquer l’opération. L’administration Trump a également intenté une action antitrust contre Google en raison de sa position dominante dans le domaine de la recherche sur Internet.

Côté démocrate, le 9 juillet 2021, Joe Biden a signé un décret visant à faire appliquer les lois antitrust découlant des effets anticoncurrentiels des plates-formes Internet dominantes. Le décret vise également l’acquisition de concurrents naissants, l’agrégation de données, la concurrence déloyale sur les marchés de l’attention et la surveillance des utilisateurs. L’administration Biden-Harris a engagé des procédures antitrust contre Apple et Google. Les lignes directrices sur les fusions en 2023 de l’administration Biden-Harris ont défini des règles pour déterminer quand les fusions peuvent être considérées comme anticoncurrentielles.

Ainsi, bien que les deux administrations aient engagé des procédures antitrust, la pression de l’administration Biden semble plus forte en termes d’impact sur la réorganisation potentielle ou même l’orchestration d’un démantèlement d’entreprises dominantes telles que Google.

Crypto-monnaies

Les candidats ont des approches différentes de la réglementation des crypto-monnaies.

Vers la fin de du mandat de l’administration Trump, ce dernier a tweeté en faveur d’une réglementation des crypto-monnaies et le réseau fédéral Financial Crimes Enforcement Network a proposé une réglementation qui aurait obligé les sociétés financières à collecter l’identité de tout portefeuille de crypto-monnaie auquel un utilisateur a envoyé des fonds. Cette réglementation n’a pas été promulguée.

Depuis, Trump a modifié sa position sur les crypto-monnaies. Il a critiqué les lois américaines existantes et appelé les États-Unis à devenir une superpuissance du bitcoin. La campagne de Trump est la première campagne présidentielle à accepter des paiements en crypto-monnaies.

À lire aussi : Donald Trump, défenseur des cryptomonnaies aux États-Unis

L’administration Biden-Harris, en revanche, a défini des restrictions réglementaires sur les crypto-monnaies avec la Securities and Exchange Commission, ce qui a donné lieu à une série de mesures d’application. La Maison Blanche a opposé son veto à la loi sur l’innovation financière et la technologie pour le XXIe siècle (Financial Innovation and Technology for the 21st Century Act) qui visait à clarifier la comptabilité des crypto-monnaies, un projet de loi favorisé par le secteur des crypto-monnaies.

Confidentialité des données et vie privée

Le décret sur l’IA de Joe Biden invite le Congrès à adopter une législation sur la protection de la vie privée, mais ne fournit pas de cadre législatif à cet effet.

L’initiative américaine sur l’IA de la Maison Blanche de Trump ne mentionne la protection de la vie privée qu’en termes généraux, appelant les technologies d’IA à respecter « les libertés civiles, la vie privée et les valeurs américaines ». Le décret ne mentionne pas la manière dont les protections existantes de la vie privée seront mises en œuvre.

Aux États-Unis, plusieurs États ont tenté d’adopter une législation portant sur certains aspects de la confidentialité des données : à l’heure actuelle, il existe une mosaïque d’initiatives au niveau des États et une absence de législation globale sur la confidentialité des données au niveau fédéral.

La rareté de ces mesures fédérales visant à protéger les données et la vie privée indique clairement que, si les deux candidats à l’élection présidentielle américaine s’attaquent bien à certains des défis posés par l’évolution de l’IA et des technologies numériques plus généralement, il reste encore beaucoup à faire pour réguler ces secteurs dans l’intérêt du public.

Globalement, les efforts de l’administration Biden pour réguler les technologies et la concurrence afférente semblent alignés sur l’objectif de maîtriser les entreprises technologiques et de protéger les consommateurs. Il s’agit également de réimaginer les protections monopolistiques pour le XXIe siècle. Il semble que ce soit là la principale différence entre les deux administrations.

Anjana Susarla a reçu des financements du National Institute of Health.

23.10.2024 à 16:35

Vers une évaluation de la recherche plus ouverte et équitable : la déclaration de Barcelone

Olivier Pourret, Enseignant-chercheur en géochimie et responsable intégrité scientifique et science ouverte, UniLaSalle

Lonni Besançon, Assistant Professor in Data Visualization, Linköping University

Texte intégral (2197 mots)

La Déclaration de Barcelone marque un tournant dans la manière dont sont produites, partagées et utilisées les informations relatives au pilotage de la recherche scientifique. Elle a été signée par douze institutions françaises.

Des crises telles que les pandémies et les changements climatiques, ainsi que des avancées technologiques comme l’automatisation et le big data, posent des défis importants au XXIe siècle. Pour y faire face, il est essentiel que la science soit accessible à tous. Il est crucial que les citoyens aient le même accès à l’information que les chercheurs, et que les scientifiques disposent de référentiels de connaissances interconnectés et de haute qualité pour faire progresser notre compréhension du monde et démocratiser le savoir.

Pour atteindre cet objectif, il est nécessaire de revoir et de réformer les méthodes d’évaluation de la recherche. Actuellement, les critères d’évaluation favorisent souvent les publications dans des revues prestigieuses, ce qui peut limiter l’accessibilité et l’impact des recherches, surtout pour les scientifiques des pays moins favorisés. Il est nécessaire de privilégier des systèmes d’évaluation qui tiennent compte de la valeur intrinsèque de la recherche et de son impact réel sur la société, indépendamment du lieu ou de la langue de publication, afin de soutenir une science plus inclusive, équitable et ouverte.

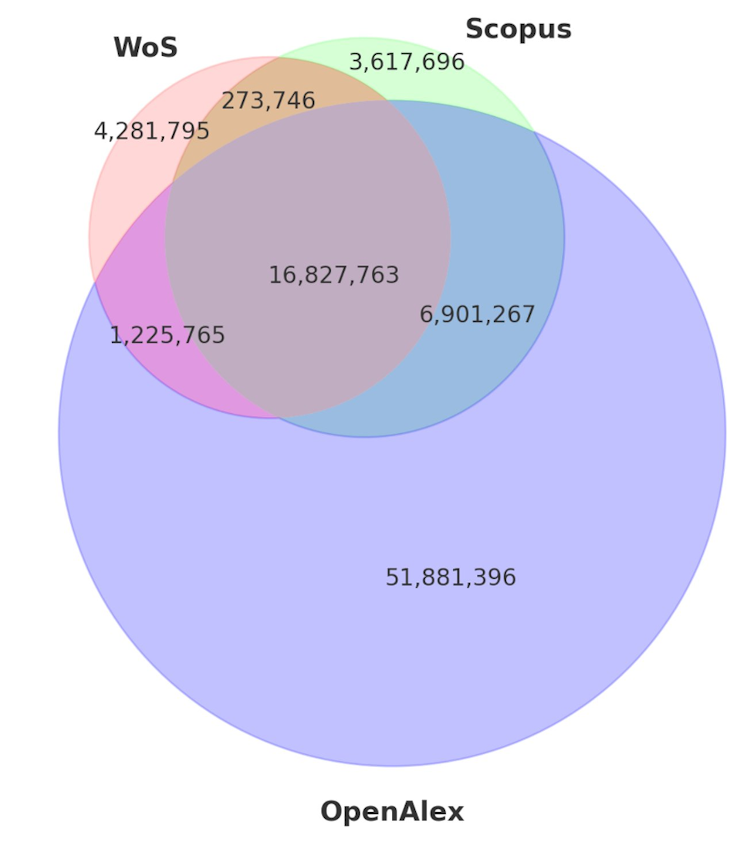

Actuellement, les évaluations reposent souvent sur des données inaccessibles et des indicateurs opaques (facteur d’impact des journaux, nombre de citations…), ce qui nuit à la qualité et à l’équité des décisions concernant les carrières des chercheurs et le financement des projets. En adoptant des systèmes d’évaluation qui privilégient l’accès libre aux données et la reproductibilité des analyses, nous pouvons garantir que les évaluations soient basées sur des preuves complètes et transparentes. Cela permettra de corriger les erreurs et biais potentiellement présents dans les bases de données propriétaires sur abonnement (comme Web of Science ou Scopus), d’améliorer la confiance dans les résultats de la recherche et de renforcer l’efficacité globale du système de recherche scientifique.

Plus d’ouverture sur la conduite des recherches

Les presque 100 signataires de la Déclaration de Barcelone, dont douze institutions universitaires ou de recherche françaises, sur l’information ouverte des données de la recherche s’engagent à transformer la manière dont l’information sur la recherche est produite et utilisée, en prônant une nouvelle norme d’ouverture des informations sur la conduite et la communication de la recherche.

Actuellement, de nombreuses décisions stratégiques dans le domaine de la recherche reposent sur des informations non accessibles au public (nombre de citations), souvent enfermées dans des infrastructures propriétaires. Web of Science et Scopus sont deux composants essentiels de l’écosystème de recherche actuel, fournissant la base des classements universitaires mondiaux ainsi que de la recherche bibliométrique. Cependant, les deux plates-formes seraient structurellement biaisées et ne considèrent pas une partie de la recherche produite dans des pays non occidentaux, la recherche en langues autres que l’anglais et la recherche dans les domaines des arts, des sciences humaines et sociales.

Les indicateurs et analyses issus de ces informations manquent de transparence et de reproductibilité, affectant les décisions relatives aux carrières des chercheurs et aux orientations des organismes de recherche, lorsqu’elles ne sont pas directement manipulées. Aussi les indicateurs se focalisent principalement sur des mesures telles que le nombre de citations des articles et le facteur d’impact des journaux (un indicateur qui estime indirectement la visibilité d’une revue scientifique. Pour une année donnée, le FI d’une revue est égal à la moyenne des nombres de citations des articles de cette revue publiés durant les deux années précédentes) dont on sait qu’elles sont souvent manipulables par plusieurs acteurs du système de recherche (de certains auteurs à certains éditeurs), tout en faisant l’impasse sur d’autres indicateurs bien plus importants pour la conduite d’une recherche éthique et reproductible.

Des indicateurs possibles sont, par exemple, la disponibilité des données produite par un essai clinique, le protocole d’étude complet, le code d’analyse des données, ou la présence d’un accord éthique (ainsi que son numéro et ses modalités d’acceptation), malheureusement souvent problématiques ou questionnables.

Les informations de recherche, ou métadonnées, englobent les détails relatifs à la mise en œuvre et à la communication de la recherche, incluant les données bibliographiques (titres, résumés, auteurs, affiliations, lieux de publication), les métadonnées sur les logiciels et instruments de recherche, les informations sur le financement et les contributeurs. Elles se trouvent dans des bases de données bibliographiques, des archives de logiciels, des entrepôts de données et des systèmes d’information de recherche. Les informations de recherche ouvertes sont des métadonnées accessibles librement et sans restrictions de réutilisation, suivant idéalement les principes FAIR (trouvable, accessible, interopérable et reproductible). Cela implique des protocoles standardisés, l’utilisation de licences Creative Commons CC0, et des infrastructures transparentes avec des normes ouvertes. Les métadonnées jouent un rôle crucial dans l’évaluation des chercheurs et des institutions et la définition des priorités des organisations. Cependant, de nombreuses données restent enfermées dans des infrastructures propriétaires, souvent biaisées géographiquement et linguistiquement. Assurer l’ouverture des informations de recherche permet à toutes les parties prenantes d’accéder pleinement aux données, enrichissant ainsi la prise de décision, l’évaluation scientifique, et la correction de la littérature scientifique lorsque c’est nécessaire.

Par exemple, un chercheur en biologie publie un article, et ses métadonnées incluent le titre, les auteurs, leur affiliation universitaire, et le résumé. Ces données sont accessibles librement dans des bases comme PubMed, facilitant la recherche pour d’autres scientifiques. Un deuxième exemple, les détails d’une subvention octroyée par une institution comme le National Institutes of Health (NIH) sont rendus publics. Cela inclut le montant, la durée, et l’objectif du financement, permettant une transparence et une collaboration accrue au sein de la communauté scientifique.

Les engagements et objectifs de la déclaration de Barcelone

Les organisations signataires (12 en France) se sont engagées à :

Favoriser l’ouverture des informations de recherche : les informations utilisées pour évaluer les chercheurs, les institutions ou pour prendre des décisions stratégiques seront ouvertes par défaut, sauf si cela n’est pas approprié. Cela concerne aussi les informations sur les activités et résultats de recherche.

Travailler avec des systèmes qui soutiennent cette ouverture : les plates-formes de publication et de gestion des informations de recherche doivent rendre ces données librement accessibles via des infrastructures ouvertes, en utilisant des standards existants quand ils sont disponibles (e.g., Crossref).

Soutenir les infrastructures ouvertes : les signataires aideront à maintenir et financer les systèmes qui facilitent l’ouverture des informations de recherche, tout en veillant à une bonne gouvernance et à leur durabilité.

Promouvoir la collaboration pour accélérer cette transition : Il est important de partager les expériences et de coordonner les actions pour passer des systèmes fermés à des systèmes ouverts.

Ainsi, le ministère de l’Enseignement supérieur et de la Recherche a mis en place en France un partenariat pluriannuel avec OpenAlex en décembre dernier. Sorbonne Université s’est désabonnée de l’outil propriétaire et sur abonnement « Web of Science » et projette de s’appuyer désormais sur des bases bibliographiques libres telles que OpenAlex pour analyser la production de sa recherche. La déclaration a également été signée par des organismes de financement (par exemple la fondation Bill & Melinda Gates ou l’Agence Nationale de la Recherche).

La Déclaration de Barcelone s’aligne avec les conclusions du Conseil de l’Union européenne de 2021, ou de l’Unesco qui recommandent l’accès libre aux données et bases de données bibliographiques utilisées pour évaluer la recherche. Elle est aussi en accord avec la loi française de 2016 pour une République numérique, qui promeut l’ouverture par défaut des données administratives. De plus, la déclaration respecte les principes de la CoARA (Coalition for Advancing Research Assessment), qui préconisent l’indépendance et la transparence des données nécessaires à l’évaluation de la recherche.

Ces engagements visent à garantir que les politiques scientifiques soient basées sur des preuves transparentes et des données accessibles et vérifiables, soutenant ainsi le mouvement mondial en faveur de la science ouverte.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

22.10.2024 à 16:59

À quoi ressemble le bord de l’univers ?

Sara Webb, Lecturer, Centre for Astrophysics and Supercomputing, Swinburne University of Technology

Texte intégral (872 mots)

L’univers a-t-il une fin ou un bord ? Les scientifiques ne peuvent pas trancher cette fascinante question mais ont des idées, des théories et des mesures pour discuter.

Cette question sur les limites de l’univers fait partie des interrogations que les humains continueront, sans doute, à se poser jusqu’à la fin des temps.

Nous ne sommes pas sûrs, mais nous pouvons essayer d’imaginer ce que pourrait être la limite de l’univers, s’il y en a une.

Remonter le temps

Avant de commencer, nous devons remonter dans le temps. Le ciel nocturne a semblé avoir toujours eu la même apparence au cours de l’histoire de l’humanité. Il a été si stable que les humains du monde entier se sont inspirés des motifs qu’ils voyaient dans les étoiles pour s’orienter et explorer.

À nos yeux, le ciel semble infini. Avec l’invention des télescopes, il y a environ 400 ans, nous avons pu voir plus loin que nos yeux ne l’avaient jamais fait. Nous avons continué à découvrir de nouvelles choses dans le ciel et trouvé davantage d’étoiles, puis avons commencé à remarquer qu’il y avait beaucoup de nuages cosmiques à l’aspect étrange.

Les astronomes leur ont donné le nom de « nébuleuse », de mots latin signifiant « brume » ou « nuage ». Il y a moins de 100 ans, nous avons confirmé pour la première fois que ces nuages cosmiques ou nébuleuses étaient en fait des galaxies. Elles ressemblent à la Voie lactée, la galaxie dans laquelle se trouve notre planète, mais elles sont très éloignées.

Ce qui est étonnant, c’est que dans toutes les directions où nous regardons dans l’univers, nous voyons de plus en plus de galaxies. Sur cette image du télescope spatial James Webb, qui observe une partie du ciel équivalente à la zone que recouvre un grain de sable quand on le tient à bout de bras, on peut voir des milliers de galaxies.

Il est difficile d’imaginer qu’il existe une limite où tout cela s’arrête.

Le bord de l’univers

Cependant, il existe techniquement une limite à notre univers. Nous l’appelons l’univers « observable ». En effet, nous ne savons pas si notre univers est infini, c’est-à-dire s’il se poursuit à l’infini.

Malheureusement, nous ne le saurons peut-être jamais à cause d’un élément gênant : la vitesse de la lumière.

Nous ne pouvons voir que la lumière qui a eu le temps de voyager jusqu’à nous. La lumière se déplace à la vitesse exacte de 299 792 458 mètres par seconde. Même à cette vitesse, il lui faut beaucoup de temps pour traverser notre univers. Les scientifiques estiment que la taille de l’univers est d’au moins 96 milliards d’années-lumière, et probablement encore plus grande.

Que verrions-nous s’il y avait un bord ?

Si nous voyagions jusqu’à l’extrême limite de l’univers que nous pensons exister, qu’y aurait-il en réalité ?

De nombreux autres scientifiques (dont je fais partie) pensent qu’il y aurait simplement… plus d’univers !

Chaque semaine, nos scientifiques répondent à vos questions.

N’hésitez pas à nous écrire pour poser la vôtre et nous trouverons la meilleure personne pour vous répondre.

Et bien sûr, les questions bêtes, ça n’existe pas !

Comme je l’ai dit, il existe une théorie selon laquelle notre univers n’a pas de limite et pourrait continuer indéfiniment.

Mais il existe aussi d’autres théories. Si notre univers a une limite et que vous la franchissez, vous pourriez vous retrouver dans un univers complètement différent. (Pour l’instant, il vaut mieux garder cela pour la science-fiction).

Même s’il n’y a pas de réponse directe à cette question, ce sont précisément des questions comme celles-ci qui nous aident à continuer à explorer et à découvrir l’univers, et qui nous permettent de comprendre la place que nous y occupons.

Sara Webb ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

21.10.2024 à 16:56

Patrimoine : algues, bactéries, champignons à l’assaut des vieilles pierres

Patrick Di Martino, Professeur des Universités de Microbiologie, CY Cergy Paris Université

Texte intégral (2514 mots)

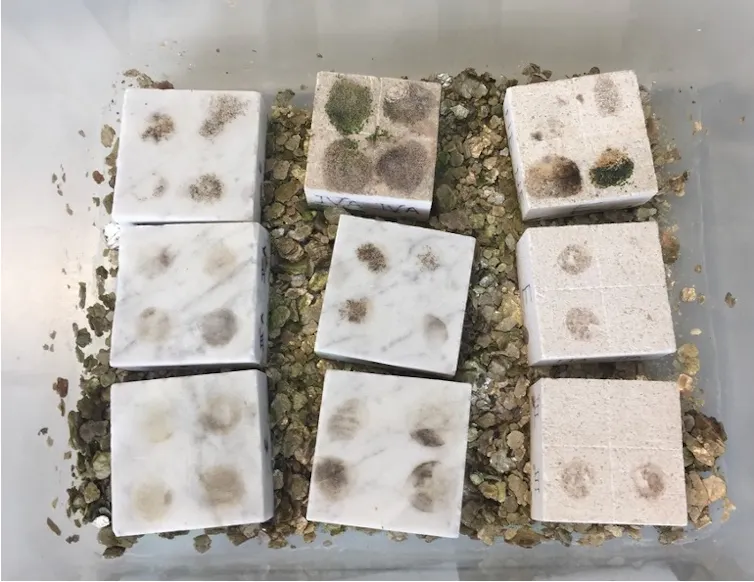

Algues, bactéries, champignons… les microbes partent à l’attaque des vieilles pierres, dont certaines sont des monuments historiques. En comprenant mieux leurs modes d’action, on peut limiter les dégats – par exemple en utilisant des bactéries pour nettoyer les graffiti ou en testant des huiles essentielles sur le Colisée, à Rome.

Dans la grotte ornée de Lascaux, le surtourisme a entraîné le développement massif de champignons noirs Ochroconis lascauxensis à cause de la condensation d’eau sur les parois, des élévations de température, de la concentration en CO2 et en matière organique. La présence massive d’humains dans une grotte restée fermée des milliers d’années a modifié l’équilibre des communautés microbiennes et favorisé la prolifération de certains microorganismes… ce qui a nécessité sa fermeture au public.

Aujourd’hui, grâce à une meilleure maîtrise du climat dans la grotte, et à la limitation de l’accès à un nombre restreint de conservateurs et de scientifiques, la grotte va mieux mais la situation reste fragile. La création du fac-similé Lascaux IV permet à un large public de visiter une représentation de l’intégralité de la grotte originale.

Verdissement d’une toiture par développement de microalgues, de cyanobactéries ou de mousses ; jaunissement de parois de grottes ornées à cause de bactéries ; pourrissement des charpentes et boiseries dont se nourrissent les champignons lignivores et certaines moisissures ; perte de matière par des lichens ou des « biofilms » microbiens à la surface de la pierre… la « biodégradation » peut se définir par tout changement indésirable des propriétés d’un bien culturel causée par l’activité d’organismes vivants.

Si ces effets sont nombreux et familiers, c’est parce que les microorganismes sont partout, sous tous les climats, sur toutes les surfaces. Ils sont véhiculés par l’eau, par l’air, par les animaux, par l’homme. Ils ne sont pas tous néfastes, bien au contraire – les décomposeurs jouent ainsi un rôle central dans le recyclage de la matière organique.

La recherche sur la biodégradation a un rôle essentiel pour améliorer la préservation des biens culturels des attaques biologiques. Elle est très active en Europe, certainement parce que notre continent recèle un patrimoine culturel exceptionnel. La recherche se focalise notamment sur une meilleure compréhension des mécanismes de biodégradation.

La stratégie est de comprendre pour mieux prévenir, mieux diagnostiquer et mieux traiter.

Mieux prévenir

La maîtrise des conditions environnementales (température, hygrométrie, lumière, qualité de l’air, dépoussiérage) est un élément clé de la conservation préventive du patrimoine culturel dans les musées.

En particulier, la prévention de la biodégradation passe par la limitation de l’apport en eau et en nutriments nécessaires au développement des microorganismes ; ainsi que par la limitation de l’apport en lumière, source d’énergie des « phototrophes », en limitant l’éclairage artificiel.

L’installation d’un toit permet de protéger un site extérieur des intempéries et de la lumière. C’est le cas du site de la Polledrara di Cecanibbio au nord-ouest de Rome qui comporte les ossements fossilisés de plus de 20 000 vertébrés, enfouis dans des sédiments volcanoclastiques des volcans de Sabatino il y a plus de 300 000 ans.

Mieux diagnostiquer

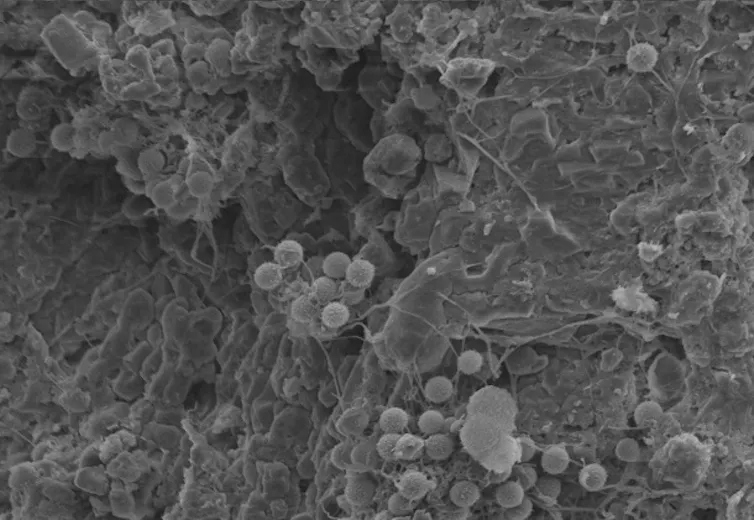

Les développements technologiques en imagerie permettent d’étudier les interactions entre microorganismes et surfaces, ainsi que la dégradation des matériaux, notamment la microscopie électronique à balayage, que l’on peut coupler à l’analyse élémentaire ou à la spectroscopie Raman pour obtenir la composition chimique, et la microscopie confocale à balayage laser.

Avec la métagénomique (analyse bio-informatique des séquences d’ADN issues de prélèvements environnementaux), les chercheurs dévoilent la biodiversité des microorganismes associés à la biodégradation.

Avec la métabolomique (analyse de l’ensemble des petites molécules issues de l’activité du vivant), ils déterminent les voies enzymatiques et les molécules mises en œuvre dans les processus de biodégradation.

Ces technologies permettent de répondre à différentes questions : quels sont les microorganismes présents ? Lesquels sont néfastes ? Comment interagissent-ils entre eux et avec les matériaux ? Quelles sont les activités microbiennes impliquées dans la biodégradation ? Quels sont les mécanismes de la biodégradation ?

Mieux traiter : des bactéries contre les graffitis

La recherche sur la biodégradation des biens culturels s’oriente également vers les biotraitements.

La porosité de la pierre des monuments historiques permet des mouvements d’eau dans les pores, qui véhiculent des sels dissous. Ces sels de sulfates ou de nitrates pourront recristalliser et induire la formation d’efflorescences ou de croutes en surface ainsi qu’un détachement de matière.

Les bactéries Desulfovibrio desulfuricans et Pseudomonas stutzeri qui dégradent les sulfates ou les nitrates peuvent être utilisées pour « bionettoyer » ce type de croute.

La bactérie Rhodococcus erythropolis ou la levure Candida parapsilosis peuvent être utilisées pour dégrader et bionettoyer les graffiti.

À l’inverse de ces nettoyages, un ajout de matière par bio-renforcement de la pierre calcaire peut être réalisé à l’aide de bactéries qui favorisent la précipitation de carbonate de calcium comme Bacillus cereus et Myxococcus xanthus.

Des enzymes microbiennes (plutôt que des microorganismes vivants) peuvent aussi être utilisées, comme des lipases pour enlever des patines noires ou des couches de peinture recouvrant des œuvres originales, ou des protéases pour enlever des colles animales.

Des antimicrobiens naturels sont testés en remplacement des ammoniums quaternaires et de l’eau de Javel, deux biocides artificiels largement utilisés pour traiter le noircissement et le verdissement de la pierre.

De nombreuses plantes contiennent des molécules bioactives aux propriétés antibactériennes, antifongiques ou insecticides, qui sont extraites et concentrées dans les huiles essentielles. Elles peuvent être appliquées en spray, sous forme de gel déposé sur un objet ou apportées par des nanoparticules pour contrôler leur libération et optimiser les doses appliquées et la durée d’efficacité du traitement. Bien que basés sur des principes actifs végétaux, il faut s’assurer que ces biotraitements n’ont pas d’effet indésirable sur les matériaux des biens culturels et ne sont pas toxiques pour l’homme aux doses d’usage.

La recherche sur la biodégradation apporte des outils aux différentes étapes de la préservation du patrimoine, de la conservation préventive à la conservation curative jusqu’à la restauration. Et parfois, après avoir établi un diagnostic, le meilleur choix est de n’appliquer aucun traitement, en veillant à préserver le bien culturel en l’état pour le transmettre aux générations futures.

Patrick Di Martino est membre de l'International Biodeterioration and Biodegradation Society (IBBS). Les travaux à l'abbaye de Chaalis et à la grotte du Sorcier mentionnés dans l'article ont été soutenus financièrement par la Fondation des Sciences du Patrimoine et CY Cergy Paris Université. Les photographies des travaux au Colisée ont été réalisées lors d'une mobilité financée par le programme Erasmus +.

20.10.2024 à 10:38

La brise de mer, ou pourquoi le climat est plus doux dans les régions côtières

Patrick Augustin, Ingénieur de recherche, Université Littoral Côte d'Opale

Texte intégral (1728 mots)

Le phénomène d’équilibre thermique, qui explique pourquoi notre café refroidit dans sa tasse, se produit aussi à l’échelle de la planète. Avec des conséquences notables sur le climat : c’est notamment lui qui est à l’origine de la « brise de mer », vent marin relativement froid et humide caractéristique du climat des régions littorales.

Vous avez certainement déjà constaté que lorsque vous ne buvez pas votre café chaud, au bout d’un certain temps, il se refroidit. Inversement, un yaourt froid sorti du réfrigérateur et laissé sur la table se réchauffe au fil du temps.

Ce phénomène est appelé « l’équilibre thermique » : le café, plus chaud que l’air ambiant, va transférer sa chaleur vers l’air environnant. Au fil du temps, le café refroidit jusqu’à ce que sa température s’égalise à celle de l’environnement. De la même manière, le yaourt, plus froid que l’air ambiant, va absorber la chaleur de l’air et se réchauffer, pour atteindre la température ambiante. Ainsi, qu’il s’agisse du café qui refroidit ou du yaourt qui se réchauffe, l’équilibre thermique qui se produit dans la nature fait tendre les températures vers une température uniforme, sans effort de notre part.

Ce phénomène se produit également à plus grande échelle, et il n’est pas sans conséquence : l’équilibre thermique entre la terre et les mers ou les océans est un processus clé dans la régulation du climat global. Voici ce que nous en savons.

Un déséquilibre thermique entre terre et mer/océans

L’eau a une capacité thermique beaucoup plus élevée que la terre. Cela signifie que les mers/océans absorbent et libèrent la chaleur plus lentement que les surfaces terrestres. Ainsi, l’eau se réchauffe et se refroidit beaucoup plus lentement que la terre.

Dans ces conditions, un déséquilibre thermique peut se former entre ces deux systèmes. Cette différence de capacité thermique joue un rôle crucial dans la circulation atmosphérique, la formation des vents et les variations climatiques à court et à long terme.

En effet, les variations de température sur la terre sont rapides et importantes, entraînant, par exemple, des étés chauds et des hivers froids dans les zones continentales. La mer/océan agit comme des régulateurs thermiques, en emmagasinant la chaleur durant l’été et en la restituant durant l’hiver, ce qui contribue à adoucir les climats côtiers.

La conséquence de l’existence d’un déséquilibre thermique entre la terre et la mer/océan est aussi perceptible dans le cycle diurne, durant lequel ces deux systèmes réagissent différemment sous l’effet du rayonnement solaire. Durant la journée, les surfaces des terres se réchauffent plus rapidement que les surfaces marines. Ainsi, au voisinage des zones côtières, l’air réchauffé en contact du sol monte (sous l’effet de la poussée d’Archimède), accompagné d’une diminution de la pression atmosphérique.

Au-dessus de la mer, le réchauffement de l’air en contact de la surface de la mer/océan étant plus lent, l’air est plus dense et la pression est plus grande. Cette différence de pression entre l’air au-dessus des terres et au-dessus de la mer/océan engendre le déplacement de l’air froid et humide provenant de la mer et se dirigeant vers les terres (figure 1). Ce mécanisme correspond à un phénomène météorologique local appelé brise de mer.

Ce vent marin relativement plus froid et humide (plus dense), s’écoule horizontalement vers l’intérieur des terres pour remplacer l’air plus chaud et sec (moins dense), qui s’élève au-dessus de la surface des terres. La zone d’interface entre l’air marin (situé à l’avant du courant de brise) et l’air au-dessus des terres, est appelée front de brise de mer. Le passage du front est souvent marqué par des changements brusques de température, d’humidité, de direction et vitesse de vent. Ce contraste thermique et dynamique peut d’ailleurs favoriser, sous certaines conditions, la formation de nuages.

En effet, lorsque l’air chaud des terres rencontre l’air marin au niveau du front de brise, une zone de convergence se forme favorisant une poussée vers le haut des deux masses d’air appelé courant ascendant. Cette ascension de l’air chaud et humide entraîne la condensation de la vapeur d’eau, formant des nuages, généralement de type cumulus. Ces nuages se forment souvent le long du front de brise de mer, où les deux masses d’air se rencontrent.

Dans certaines situations, lorsque la différence de température entre la terre et la mer est particulièrement marquée, l’air chaud peut s’élever rapidement, formant non seulement des nuages cumulus, mais aussi des cumulo-nimbus, pouvant conduire à des averses ou des orages locaux en fin de journée.

Vers un équilibre thermique

Ce mouvement d’air frais contribue à rééquilibrer les températures en rafraîchissant les zones terrestres chauffées, tout en réduisant la différence thermique entre la surface de la terre et la mer. En apportant de l’air plus frais, la brise de mer adoucit les températures terrestres, surtout pendant les périodes de chaleur intense, et rétablit ainsi un certain équilibre thermique. La brise de mer joue donc un rôle crucial dans l’amélioration du confort thermique. Elle atténue la sensation de chaleur excessive pour les habitants, améliorant ainsi leur bien-être.

Dans certaines situations, la brise de mer peut se renforcer à mesure que la différence de température entre la terre et la mer augmente, ce qui peut entraîner un vent plus fort près des côtes. Elle peut avoir un impact significatif sur la production d’énergie éolienne, particulièrement dans les régions côtières, surtout si les vents terrestres sont faibles. En effet, ce phénomène météorologique peut générer des vents réguliers et prévisibles permettant une production plus efficace et prévisible, réduisant ainsi la variabilité de la production d’énergie éolienne. Ces vents sont souvent plus forts en fin de matinée et dans l’après-midi, ce qui en fait une source d’énergie précieuse pour les éoliennes situées près des côtes.

Par ailleurs, elle peut aussi influencer la concentration et la distribution des polluants atmosphériques puisqu’elle peut disperser les polluants. En effet, elle peut participer au renouvellement de l’air au-dessus des terres, en remplaçant l’air stagnant plus ou moins pollué par un air provenant de la mer. Cependant, dans certaines zones côtières où la pollution industrielle/automobile est importante, la brise de mer peut transporter la pollution des zones côtières vers l’intérieur des terres. Dans certaines conditions, elle peut contribuer à la formation d’une couche limite emprisonnant l’air pollué près du sol, ce qui limite la dispersion verticale des polluants et peut aggraver la qualité de l’air localement.

L’équilibre thermique entre ces deux systèmes est un mécanisme fondamental qui régule le climat. Cet équilibre est donc essentiel à la stabilité des écosystèmes et des sociétés humaines. Il nécessite une attention particulière pour maintenir les régulations naturelles face aux pressions croissantes liées au changement climatique global.

Cet article est publié dans le cadre de la Fête de la science (qui a lieu du 4 au 14 octobre 2024), et dont The Conversation France est partenaire. Cette nouvelle édition porte sur la thématique « océan de savoirs ». Retrouvez tous les événements de votre région sur le site Fetedelascience.fr.

Patrick Augustin ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

20.10.2024 à 10:31

Comment je suis descendue à 3 600 mètres de profondeur pour étudier de fascinantes crevettes

Marie-Anne Cambon, Chercheur en écologie microbienne et symbioses sécialisées dans les grands fonds, Ifremer

Texte intégral (2748 mots)

Plongez à près de 4 000 mètres de profondeur à bord d’un sous-marin scientifique pour découvrir et ressentir un monde obscur révélant une biodiversité folle.

Longtemps considérés comme désertiques, froids et obscures, les grands fonds marins, à plus de 500 mètres de profondeur, où la lumière du Soleil ne pénètre plus, peuvent se révéler être de véritables oasis de vie, à proximité d’émissions de fluides ressemblant à des geysers, qui sortent des entrailles de la croûte océanique, formant alors de grandes cheminées : les sources hydrothermales.

Ces sources hydrothermales que l’on trouve par exemple le long des dorsales médio-océaniques qui lézardent la croûte océanique en profondeur, n’ont été observées pour la première fois qu’en 1977, par des géologues décidés à en découdre avec la tectonique des plaques. Par grande profondeur, dans le noir obscur et donc sans lumière pour assurer la photosynthèse à la base de la vie sur Terre, les géologues ont été très surpris d’observer des vers géants, des crevettes ou des crabes. En effet dans ces milieux, la vie est possible non par grâce à la photosynthèse basée sur l’énergie lumineuse, mais grâce à la chimiosynthèse microbienne, qui utilise l’énergique chimique disponible dans les fluides émis par les sources hydrothermales (sulfure, hydrogène, fer, méthane…) afin de construire les briques de la vie : sucres, protéines, lipides. La vie s’est donc adaptée.D’où vient-elle ? La question reste grande ouverte !

2500 crevettes par mètre carré

C’est au milieu de l’Atlantique qu’une petite crevette de 5 cm du nom de Rimicaris exoculata, a été découverte en 1986 en plein milieu de l’Atlantique.

Elle vit en agrégats très denses et mobiles le long des parois des fumeurs, on en compte jusque 2 500 par mètre carré ! Cette crevette a très vite attiré le regard des biologistes avec sa grosse tête hypertrophiée, une peu comme des bajoues de hamster après un bon repas. Ne parlons pas de son comportement : elle semble manger des cailloux ! Quelques photographies de sa carapace plus tard, on découvrait un dense tapis de bactéries qui la colonisait.

C’est ainsi que nous nous sommes rencontrées en 2001, au cours de discussion avec un chercheur qui terminait sa carrière et moi, microbiologiste, passionnée de géologie et de volcan, qui commençait. Comment cette crevette, avec de telles densités pouvait-elle vivre et se développer ainsi dans des milieux extrêmes, toxiques (sulfures, méthane, hydrogène, métaux lourds…), et que mangeait-elle ? Il n’en fallait pas plus pour aiguiser ma curiosité : Il fallait aller voir de plus près son mode de vie… Mais pour cela il faut y aller : 3600 mètres de profondeur sous la mer pour la rencontrer.

Le nautile, un sous-marin scientifique

C’est ainsi que j’ai commencé à me former pour utiliser un sous-marin, aussi précieux que rare. Il n’y en a même pas une dizaine dans le monde, Le Nautile, qui peut nous emmener vers les grands fonds marins jusqu’à 6000 m de profondeur.

Quelques tests médicaux d’aptitude et un test en caisson hyperbare plus tard, j’embarque sur une campagne scientifique et plonge pour la première fois en 1999. Depuis j’ai eu l’extrême privilège de plonger 17 fois, en mission d’essais avec les technologues qui développent l’engin, ou en mission scientifique. Intriguée et avec le goût de comprendre j’ai alors fait l’exercice de devenir co-pilote scientifique !

Une campagne à la mer, c’est une aventure humaine, d’explorateur moderne, et la volonté d’en savoir plus et de comprendre comment la vie se développe, s’adapte, colonise les grands fonds marins, loin du regard des humains, cachée par des milliers de mètres d’eau salée. C’est là que je travaille à mi-chemin entre les Canaries et les Antilles, pendant 45 jours. La campagne BICOSE3 fin 2023 nous a ainsi emmenés pendant 46 jours sur site avec le navire baptisé le « Pourquoi pas ? » et le Nautile pour 27 plongées, une par jour.

Une préparation minutieuse

Et pas question d’oublier quelque chose avant de partir… on reste en mer à bord du navire au milieu de l’Atlantique au-dessus des sites, alors la préparation est longue et minutieuse.

Chaque caisse, container, outil est préparé avec tout le matériel de laboratoire pour travailler à bord. L’équipe scientifique est composée de 31 personnes, dont un cinéaste, 9 opérateurs du sous-marin et les 35 marins du navire. Les trois équipes travaillent de concert pour apporter un maximum de résultats, le chef de mission doit organiser les journées de plongée et les nuits d’opérations tels des dragages ou des carottages.

Chaque plongée est unique, préparée sur plusieurs jours à l’avance. Les pilotes et les scientifiques échangeant les demandes et les possibles. Les « non » succèdent aux « peut-être », les négociations vont bon train puis le plan de plongée est établi entre le pilote et la cheffe de mission.

La veille de la plongée, le scientifique révise alors son plan de plongée, tout est cadencé. On a 6 heures sur le fond, il ne faut pas perdre de temps à se demander ce que l’on doit faire, on doit être actif et indiquer au pilote le travail, les mesures, les prélèvements.

Demain je plonge par 3600 m de fond pour aller voir ma crevette !

La soirée arrive, repas léger, couchée tôt. La plongée à venir tourne dans la tête, les cartes, les actions, les expériences à faire pour toute l’équipe, chaque plongée est résolument pluridisciplinaire.

Levée 6h30, petit repas très léger puis la check liste commence. Tout est contrôlé chaque matin, les opérateurs testent tout sur le sous-marin, la puissance, la propulsion, l’informatique, les lumières, les bras, caméras, radio… 6 heures de travail sur le fond, environ 3h de descente et de remontée, soit 9h dans l’engin.

8h30 nous sommes prêts, on se change avec une combinaison ignifugée et nous voilà devant l’entrée de la sphère sur la mezzanine. Le co-pilote descend et j’entre, puis le pilote se met en place, assis sur le dessus du sous-marin. Le sous-marin recule sur le pont, on entend les chaînes qui permettent de reculer avec la crémaillère.

Je m’installe, allongée le nez au hublot sur la droite du sous-marin. J’installe le PC de contrôle des analyseurs de chimie, les cartes, carnet et crayon attaché avec sa ficelle, je prépare ma polaire, chaussettes et bonnet car la sphère va vite se refroidir au cours de la descente. Nous sommes sur le point de mise à l’eau, le pilote entre et ferme la trappe de la sphère et s’installe sur le côté gauche du sous-marin, allongé, le co-pilote est lui assis derrière nous.

« Portique à la mer » et nous voilà basculés au-dessus de l’Océan, puis nous descendons et nous touchons l’eau. Le tablier arrière du navire est devant mes yeux, l’eau est claire et les poissons passent, puis on s’éloigne petit à petit.

Les plongeurs font les dernières vérifications, tout est OK nous pouvons prendre la plongée. C’est parti pour 1h30 de descente environ, on s’assoit et on repasse rapidement la plongée et les actions à faire, contact avec la surface toutes les 30 minutes.

L’extérieur d’un bleu lumineux s’assombrit peu à peu, 200m, ça devient gris, 300m, puis noir très vite avant 500m. Le silence s’impose, le calme, la descente continue, 800m, 1000m, 1500m… On mange un repas préparé par la cuisine ce matin. Puis les pings de détection du fond se font entendre au sondeur, on se met en position : bonnet en place, tête appuyée au bord du hublot froid, polaire et chaussettes.

Et c’est parti pour 6h sur le fond. Les lumières sont allumées, et on observe devant nous. Le co-pilote assure la navigation et nous nous dirigeons vers la cheminée à étudier et ses crevettes. De petites taches blanches attirent l’œil, ce sont des galathées (des crustacés qui ont de grandes pinces devant et l’abdomen replié sous le ventre) et anémones, preuve que nous ne sommes pas loin du site. Puis on commence à voir le relief, les cheminées sont devant nous avec leur panache noir tourbillonnant faisant penser à une nuée ardente.

Des bactéries qui nourrissent les crevettes

Et là des milliers de crevettes nagent entre l’eau de mer froide mais oxygénée leur permettant de respirer, et les fluides enrichis en minéraux et autres composés chimiques permettant de faire fonctionner la chimiosynthèse nutritive. En effet cette crevette héberge dans la carapace de la tête des milliers de bactéries de plusieurs espèces qui la nourrissent directement par la tête ! Elle a toujours un système digestif qui semble fonctionnel mais dont on ne connaît pas encore bien le rôle.

C’est un émerveillement de voir le comportement de ces animaux, parfaitement adaptés à ces conditions de vie extrêmes. Les grands fonds sont très colorés, rouges, noirs, gris, blancs, jaunes, orange, même pailletés avec les particules de sulfures. Les animaux pullulent, pas seulement les crevettes mais aussi des anémones, des crabes, des poissons, des moules parfois : une véritable oasis de vie. Nous tournons autour du site pour trouver une zone où travailler, il faut se poser et être stable 15 minutes pour les mesures de chimie. On se pose, un savant mélange de propulsion et d’appuis sur la cheminée. Nous commençons de mesures de chimie, finement au centimètre près autour des agrégats de crevettes, afin de caractériser les conditions de vie.

Tout à coup le sous-marin bouge, soulevé par une volute de panache. On se déplace et on trouve une autre zone plus calme. Nouvelle mesure de chimie. Nous prélevons de l’eau dans les poches. On ouvre le panier pour attraper une boite appelée PBT (petites boites isothermes), je demande des échantillons de roches que le sous-marin manipule grâce à la dextérité du pilote.

La boite est rangée, le panier refermé. Nous faisons de la vidéo avec le co-pilote, 4K aujourd’hui, afin de partager nos découvertes ! Puis il faut attraper l’aspirateur à faune pour prélever différents échantillons de crevettes, les adultes à grosse tête, plutôt blanches, les juvéniles rouges presque fluo, afin de mieux comprendre leurs capacités d’adaptation et le fonctionnement de leurs symbioses avec les bactéries.

Une myriade de crevettes passe devant mon hublot, ça grouille littéralement. On s’avance doucement, on recule, on se penche un peu pour attraper un dernier échantillon.

Le temps passe vite, nous partons sur le deuxième site pour prélever des fluides à haute température. Le site est devant nous, il faut se positionner en douceur. Sortie de la sonde de température, 322 °C, 351 °C, 375 °C, 388 °C, le fluide à la base est clair. La sonde est rangée, il faut ouvrir le panier et prendre la seringue titane, la mettre en position sur la sortie de fluide, tout en maintenant le Nautile en place, le pilote est très concentré. Je dois surveiller la purge et demander le déclenchement de prélèvement dès qu’elle est claire. Tout se passe en quelques secondes, il ne faut pas bouger pour ne pas diluer le précieux fluide avec de l’eau de mer.

La bouteille est remise dans le panier après 35 minutes de bataille avec les éléments, puis nous descendons à la base de la cheminée faire de la vidéo et des mesures de chimie sur les habitats. Les 6h défilent, le responsable de surface nous indique que nous devons amorcer la remontée… Trop court, on voudrait rester, tant de choses merveilleuses sous les yeux. On est humble devant cette nature majestueuse, ces écosystèmes qui semblent loin de nous et pourtant si proches qu’on voudrait tendre la main pour les toucher. Cette extraordinaire capacité de la vie à coloniser tous les biotopes, même les plus improbables vus d’un œil humain !

Nous voilà en surface, ballotés par la houle, les plongeurs sont autour de nous et nous rattachent. On est hissés hors de l’eau, puis basculés sur le pont, posés sur le charriot. C’est fini pour cette plongée. Les scientifiques courent devant le sous-marin pour récupérer les précieux échantillons et partent vite dans les laboratoires. On peut alors sortir de la sphère, et c’est le debrief avec les collègues. Quelle journée !

Cet article a été publié à l’occasion des 40 ans de l’Ifremer où vous pourrez assister à un ciné-débat autour du film « Abysses, la conquête des fonds marins » le 24 octobre à La Seyne-sur-Mer.

Marie-Anne Cambon ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

20.10.2024 à 10:30

Walk or run in the rain? A physics-based approached to staying dry (or at least getting less wet)

Jacques Treiner, Physicien théoricien, Université Paris Cité

Texte intégral (1007 mots)

We’ve all been there – caught outside without an umbrella as the sky opens up. Whether it’s a light drizzle or a heavy downpour, instinct tells us that running will minimise how wet we get. But is that really true? Let’s take a scientific look at this common dilemma.

You’re out and about, and it starts to rain – and naturally you’ve forgotten your umbrella. Instinctively, you lean forward and quicken your pace. We all tend to believe that moving faster means we’ll spend less time getting wet, even if it means getting hit with more rain as we move forward.

But is this instinct actually correct? Can we build a simple model to find out if speeding up really reduces how wet we’ll get? More specifically, does the amount of water that hits you depend on your speed? And is there an ideal speed that minimises the total water you encounter on your way from point A to point B?

Let’s break it down while keeping the scenario simple. Imagine rain falling evenly and vertically. We can divide your body into two surfaces: those that are vertical (your front and back) and those that are horizontal (your head and shoulders).

When moving forward in the rain, vertical surfaces such as a person’s body will be hit by more raindrops as speed increases. From the walker’s perspective, the drops appear to fall at an angle, with a horizontal velocity equal to their own walking speed.

While walking faster means encountering more drops per second, it also reduces the time spent in the rain. As a result, the two effects balance each other out: more drops per unit of time, but less time in the rain overall.

When the walker is stationary, rain only falls on horizontal surfaces – the top of the head and shoulders. As the walker begins to move, she or he receives raindrops that would have fallen in front, while missing the drops that now fall behind. This creates a balance, and ultimately, the amount of rain received on horizontal surfaces remains unchanged, regardless of the walking speed.

However, since walking faster reduces the total time spent in the rain, the overall amount of water collected on horizontal surfaces will be less.

All in all, it’s a good idea to pick up the pace when walking in the rain

For those who enjoy a mathematical approach, here’s a breakdown:

Let ρ represent the number of drops per unit volume, and let a denote their vertical velocity. We’ll denote Sh as the horizontal surface area of the individual (e.g., the head and shoulders) and Sv as the vertical surface area (e.g., the body).

When you’re standing still, the rain only falls on the horizontal surface, Sh. This is the amount of water you’ll receive on these areas.

Even if the rain falls vertically, from the perspective of a walker moving at speed v, it appears to fall obliquely, with the angle of the drops’ trajectory depending on your speed.

During a time period T, a raindrop travels a distance of aT. Therefore, all raindrops within a shorter distance will reach the surface: these are the drops inside a cylinder with a base of Sh and a height of aT, which gives:

ρ.Sh.a.T.

As we have seen, as we move forward, the drops appear to be animated by an oblique velocity that results from the composition of velocity a and velocity v. The number of drops reaching Sh remains unchanged, since velocity v is horizontal and therefore parallel to Sh. However, the number of drops reaching surface Sv – which was previously zero when the walker was stationary – has now increased. This is equal to the number of drops contained within a horizontal cylinder with a base area of Sv and a length of v.T. This length represents the horizontal distance the drops travel during this time interval.

In total, the walker receives a number of drops given by the expression:

ρ.(Sh.a + Sv.v). T

Now we need to take into account the time interval during which the walker is exposed to the rain. If you’re covering a distance d at constant speed v, the time you spend walking is d/v. Plugging this into the equation, the total amount of water you encounter is:

ρ.(Sh.a + Sv.v). d/v = ρ.(Sh.a/v + Sv). d

This equation gives us two key insights:

The faster you move, the less water hits our head and shoulders.

The water hitting the vertical part of your body stays the same regardless of speed, because the shorter time spent in the rain is offset by encountering more raindrops per second.

To sum it all up: it’s a good idea to lean forward and move quickly when you’re caught in the rain. But careful: leaning forward increases Sh. To really stay drier, you’ll need to increase your speed enough to compensate for this.

Jacques Treiner ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

17.10.2024 à 15:21

Des accélérateurs de particules au cœur des orages

Sébastien CELESTIN, Professeur des Universités en Physique, Université d’Orléans

Texte intégral (2533 mots)

Les nuages d’orage restent très mystérieux. Les éclairs en sont une manifestation visible, mais ils émettent aussi des rayons X très énergétiques, que l’œil humain ne décèle pas. Deux nouvelles publications remuent la communauté scientifique : ces phénomènes sont plus fréquents et plus variés qu’on le pensait, et ils sont peut-être liés au déclenchement des éclairs.

Deux articles scientifiques publiés dans la revue Nature le 2 octobre 2024 rapportent la détection d’intenses flux de photons de haute énergie (rayons X et au-delà) au-dessus d’orages tropicaux.

À bord d’un avion ER-2 de la NASA (dérivé de l’avion-espion U-2 conçu pendant la guerre froide), volant à 20 kilomètres d’altitude au-dessus des cœurs convectifs de systèmes orageux, de très nombreux événements de haute énergie ont été détectés par la mission ALOFT coordonnée par l’Université de Bergen en Norvège.

La découverte de la production de rayonnement de haute énergie par les nuages d’orage dans les années 1980 et 1990 a révolutionné notre compréhension des orages et de leurs interactions avec l’environnement spatial proche. Jusqu’à présent, seuls deux types de phénomènes étaient observés. Non seulement les nouvelles études détaillent un nouveau type de flashs de haute énergie, elles montrent aussi que ces phénomènes sont beaucoup plus fréquents que nous le pensions jusqu’à présent.

Ces mesures sont enthousiasmantes pour la communauté scientifique, notamment parce qu’elles donnent de nouveaux indices sur ce qui déclenche les éclairs lors des orages – une question qui résiste aux chercheurs depuis des décennies !

Mais il s’agit aussi d’évaluer le risque radiatif des passagers à bord d’avions traversant des nuages d’orages. L’exposition aux rayonnements ionisants peut en effet augmenter les risques de cancer.

D’où viennent les phénomènes de haute énergie lors des orages ?

Il existe plusieurs types de rayonnements de haute énergie provoqués par les orages.

Les « lueurs gamma » sont des augmentations du flux de photons énergétiques relativement longues (de quelques secondes à plusieurs minutes) et étendues (de l’ordre de quelques kilomètres). Dans de nombreux cas, ces lueurs gamma s’éteignent soudainement en corrélation avec le déclenchement d’éclairs. Lorsqu’ils se déclenchent, les éclairs neutralisent en effet les charges responsables des champs forts soutenant l’accélération des particules chargées.

Les premières détections ont été effectuées par avion dans les années 80, puis par des ballons-sondes traversant les orages verticalement dans les années 90. En 2015, des mesures in situ – au sein même des nuages d’orage – sont réalisées à l’aide d’un jet Gulfstream V. On a aussi détecté ces lueurs gamma depuis le sol, depuis des stations de haute altitude ou depuis le niveau de la mer au Japon, où les orages d’hiver ont des altitudes extrêmement basses (quelques centaines de mètres au-dessus du sol).

À la différence des lueurs gamma, les flashs gamma terrestres (TGF) durent moins d’une milliseconde et leurs énergies montrent qu’ils sont produits par d’intenses accélérations d’électrons.

Les TGF peuvent être produits par des orages de toutes tailles, allant de petits orages isolés aux systèmes convectifs de méso-échelle (taille supérieure à 100 km). Les TGF sont associés à la phase initiale de propagation des éclairs intra-nuage positifs (transportant de la charge négative vers le haut) – même si la chronologie exacte entre décharges précurseurs, éclairs, sous-événements radio, et production de TGF est complexe et encore mal comprise. Les sources des TGF sont généralement situées entre 10 et 15 kilomètres d’altitude.

Ils sont généralement observés depuis l’espace par des instruments conçus pour l’astrophysique des hautes énergies, tels que les sursauts gamma. Ces flashs gamma sont couramment observés par des satellites en orbite basse et à bord de la Station Spatiale Internationale.

Les orages sont des accélérateurs de particules encore plus efficaces que ce que l’on croyait

La nouvelle campagne ALOFT bouleverse nos connaissances sur ces événements. En effet, alors que seules quelques « lueurs gamma » et quelques rares TGF étaient attendus par les scientifiques, les équipes d’ALOFT rapportent l’observation de plus de 500 lueurs gamma et plus de 90 TGFs.

Concernant les TGF, on comprend maintenant que les estimations obtenues à partir des mesures satellites étaient faussées car ces derniers n’observent que la « partie émergée de l’iceberg », puisque pour la grande majorité, les TGF observés par ALOFT sont trop peu brillants pour être détectables depuis l’espace.

Une telle explication semble naturelle dans le cadre de certaines théories actuelles de production de TGF par les éclairs. Avec des collègues, nous avons en effet construit un modèle montrant que les éclairs pouvaient produire des TGF avec des flux dépendant de leurs potentiels électriques. Pour le prouver, il faudrait également envisager la possibilité que les faisceaux d’électrons produisant les TGF ne soient pas tous orientés vers le haut, ce que les équipes d’ALOFT n’ont malheureusement pas pu faire pour l’instant.

Le nombre inattendu de lueurs gamma semble quant à lui être une spécificité des orages tropicaux pour lesquels aucune observation de haute altitude n’avait encore été réalisée. Cette interprétation devra être confirmée avec de nouvelles mesures aux latitudes moyennes et dans la région intertropicale.

Scintillations gamma : un nouveau phénomène de haute énergie dans les orages

Une des deux nouvelles publications présente également un nouveau type d’événement gamma, que les auteurs nomment flickering gamma-ray flashes ou FGF, qu’on pourrait traduire par « scintillations gamma ». D’après ces auteurs, ces événements représentent un chaînon manquant entre lueurs gamma et TGF. Ils sont en effet moins brillants et de durées plus longues que les TGF, mais plus brillants et plus courts que les lueurs gamma.

Il est intéressant de noter que des événements avec la même dynamique ont été détectés par la mission spatiale Compton Gamma Ray Observatory (NASA) et référencés comme de simples TGF de formes atypiques. Ces scintillations gamma sont encore assez mystérieuses car, contrairement aux TGF, elles ne semblent être accompagnées d’aucun signal optique ou électromagnétique, ce qui suggère l’absence d’éclairs ou plus généralement de décharges atmosphériques sous-jacentes. Il est ainsi possible que ces événements soient produits par des mécanismes d’amplification de particules relativistes déjà théorisées pour les TGF.

En outre, des décharges précurseurs d’éclairs sont détectées peu après certains événements de scintillations gamma, ce qui tend à montrer que ces derniers ont un rôle dans le déclenchement des éclairs, une question qui reste ouverte malgré les nombreux efforts de recherche sur le sujet.

Risques d’expositions à de fortes doses radiatives

Les TGF sont extrêmement intenses. Le grand nombre d’électrons à la source nécessaire pour produire de tels flux, combiné à l’altitude des sources, qui est proche de celle des altitudes de vols commerciaux, a amené un groupe de chercheurs à évaluer la dose efficace reçue par des passagers à bord d’avions en cas d’irradiation dans la source du TGF. Avec l’aide de collègues de l’Institut de Radioprotection et de Sûreté Nucléaire (IRSN) et d’Air France, nous avons effectivement estimé que les doses reçues peuvent excéder 1 Sv, laquelle dose présente un danger immédiat pour la santé et un risque de fatalité.

Cependant, en cartographiant la probabilité d’occurrence des TGF observés par le satellite Fermi, nous avons aussi montré qu’il est probable qu’aucun vol commercial n’ait été touché par un TGF dans toute l’histoire du trafic aérien mondial.

Néanmoins, ces résultats sont remis en question par les nouvelles publications du projet ALOFT.

Prochaines générations de détecteurs

À la suite de ce succès, il est probable que de nouvelles campagnes ALOFT voient le jour.

Des campagnes de mesures par ballons stratosphériques dont j’ai la responsabilité scientifique sont aussi en cours de préparation dans le cadre de projets soutenus par l’agence spatiale française (CNES) afin de réaliser des mesures in situ (projet OREO) ainsi que dans le cadre du projet de développement instrumental STRATELEC (coordonné par Eric Defer, LAERO) pour la mission Stratéole-2 (resp. scientifique : Albert Hertzog, LMD) avec des ballons super-pressurisés volant à 20 kilomètres d’altitude pendant plusieurs mois dans la zone intertropicale (prochaine campagne prévue fin 2026).

Des détecteurs de particules dédiés ont été développés et les résultats récents d’ALOFT sont très utiles pour le bon dimensionnement des instruments. Ces mesures ballon, qui permettent une observation de la dynamique intrinsèque des événements depuis une position relativement statique, viendront encore enrichir nos connaissances sur ces accélérateurs de particules naturels qui existent au sein des systèmes orageux.

Les travaux de recherche de Sébastien CELESTIN ont reçu des financements du CNES et de l'Institut Universitaire de France (IUF).

- GÉNÉRALISTES

- Ballast

- Fakir

- Interstices

- Lava

- La revue des médias

- Le Grand Continent

- Le Monde Diplomatique

- Le Nouvel Obs

- Lundi Matin

- Mouais

- Multitudes

- Politis

- Regards

- Smolny

- Socialter

- The Conversation

- UPMagazine

- Usbek & Rica

- Le Zéphyr

- CULTURE / IDÉES 1/2

- Accattone

- Contretemps

- A Contretemps

- Alter-éditions

- CQFD

- Comptoir (Le)

- Déferlante (La)

- Esprit

- Frustration

- IDÉES 2/2

- L'Intimiste

- Jef Klak

- Lignes de Crêtes

- NonFiction

- Nouveaux Cahiers du Socialisme

- Période

- Philo Mag

- Terrestres

- Vie des Idées

- Villa Albertine

- THINK-TANKS

- Fondation Copernic

- Institut La Boétie

- Institut Rousseau

- TECH

- Dans les algorithmes

- Goodtech.info

- Quadrature du Net

- INTERNATIONAL

- Alencontre

- Alterinfos

- CETRI

- ESSF

- Inprecor

- Journal des Alternatives

- Guitinews

- MULTILINGUES

- Kedistan

- Quatrième Internationale

- Viewpoint Magazine

- +972 mag

- PODCASTS

- Arrêt sur Images

- Le Diplo

- LSD

- Thinkerview

- Pas des sites de confiance

- Contre-Attaque

- Korii

- Positivr

- Regain

- Slate

- Ulyces