21.10.2025 à 15:02

Pourquoi les limaces sont si difficiles à contrôler dans les champs et les jardins

Texte intégral (1764 mots)

Véritable cauchemar du jardinier ou de l’agriculteur, les limaces sont aussi très mystérieuses. Pour aider à minimiser les ravages qu’elles provoquent, des scientifiques ont étudié leurs déplacements.

Presque tous ceux qui ont un jardin savent à quel point les limaces peuvent être nuisibles. Elles demeurent aussi l’un des ravageurs les plus destructeurs pour certaines cultures. Des études montrent ainsi que les rendements de céréales comme le blé, sont considérablement réduits par leur présence. Sur 46 parcelles de céréales à paille, étudiées en Bourgogne-Franche-Comté en 2024, la moitié présentait des signes de ravages provoqués par les limaces à la fin de l’automne.

Mais des recherches récentes sur les déplacements des limaces pourraient aider les agriculteurs à mettre en place des stratégies de prévention contre ces nuisibles qui leur coûtent cher.

Au Royaume-Uni, un rapport publié en 2014 par l’Agriculture and Horticulture Development Board estimait ainsi que les limaces généraient des dépenses allant jusqu’à 100 millions de livres sterling par an, en l’absence de mesures de contrôle efficaces. En France les achats de produits antilimaces ont explosé de 320 % entre 2023 et 2024 pour atteindre 21 millions d’euros, du fait de conditions météorologiques de plus en plus clémentes pour les limaces.

Du côté du consommateur, les limaces agissent également aussi comme un repoussoir : on aime en général pas trop en trouver une dans sa salade.

Gagner sa vie en cultivant des aliments est déjà laborieux en raison de la pénurie de main-d’œuvre, de la hausse des coûts, du changement climatique et d’autres défis. Les fléaux provoqués par les limaces s’ajoutent à tout cela, car il reste difficile de mettre au point des solutions abordables et fiables pour lutter contre ces nuisibles.

Il existe certes des pesticides, mais plusieurs aspects du comportement des limaces font que leur efficacité est aléatoire. Par exemple, la plupart des produits ne ciblent que les limaces actives à la surface ou très près de celle-ci. Or, une grande partie de leur population se trouve à différentes profondeurs dans le sol. En effet, elles se déplacent dans le sol en fonction des conditions météorologiques, des caractéristiques du sol et de plusieurs autres facteurs.

Lorsque les conditions météorologiques sont difficiles, elles peuvent devenir moins actives, rester plus profondément enfouies dans le sol, se cacher dans des endroits dissimulés ou difficiles d’accès, sous des pierres ou dans une végétation dense telle que des touffes d’herbe. Cela donne la fausse impression qu’elles ont disparu, alors qu’elles peuvent réapparaître rapidement et en nombre dès que le temps s’améliore.

Certains pesticides chimiques tels que le métaldéhyde sont également à utiliser avec grande précautions et soumis à une réglementation très stricte en raison de leurs effets néfastes sur l’environnement, en particulier sur les rivières et les lacs.

Plusieurs animaux peuvent eux faire office d’agents de biocontrôle. Certains nématodes, semblent par exemple efficaces, mais les agriculteurs les jugent trop coûteux pour être commercialement viables. Les nématodes sont des créatures microscopiques également connues sous le nom de vers ronds, et certaines espèces peuvent effectivement infecter et tuer des mollusques tels que les limaces. Ils constituent toutefois une bonne option pour les jardiniers, qui ont généralement besoin d’en appliquer beaucoup moins car ils ont un espace plus petit à protéger.

Suivi des groupes de limaces

Pour les agriculteurs, une piste de solution alternative apparaît dans des recherches montrant que la répartition des limaces dans un champ cultivable est inégale. Des études sur les limaces dans les principales cultures, notamment le blé et le colza, ainsi que dans les cultures de couverture et les champs laissés en jachère, ont déjà remarqué qu’on retrouve un grand nombre de limaces dans certaines zones qui étaient collées à d’autres secteurs où les limaces étaient en revanche peu nombreuses. Notre article de 2020 a confirmé cela dans tous les champs cultivés que nous avons étudiés.

De fait, la répartition spatiale des animaux dans leur environnement naturel est rarement uniforme. On pourrait s’attendre à ce que les animaux se rassemblent dans les zones où la densité alimentaire est plus élevée. Mais dans de nombreux cas, les animaux forment des « parcelles » même dans des environnements où les ressources alimentaires sont réparties de manière uniforme. Les chercheurs ne savent pas exactement pourquoi.

Si l’on parvient à prédire les zones à forte densité de limaces, les agriculteurs pourraient dès lors concentrer les pesticides et les nématodes dans ces zones, ce qui serait plus abordable et meilleur pour l’environnement. Une autre étude réalisée en 2020 a montré que cela pourrait aider les agriculteurs à réduire leur utilisation de pesticides d’environ 50 %.

Cependant, cela n’est possible que si l’emplacement des zones à forte densité de limaces ne change pas beaucoup. Jusqu’à récemment, les informations sur la formation et la pérennité des zones de limaces étaient rares. Notre étude de 2022 a toutefois révélé que des zones stables de concentration de limaces apparaissaient dans toutes les cultures que nous avons étudiées. Ces parcelles se formaient toujours aux mêmes endroits tout au long de la saison de croissance des végétaux et cultures.

Dans le cadre d’un précédent projet de recherche, nous avons équipé des limaces de balises radio afin de suivre leurs déplacements dans les champs. Cette étude a révélé que les limaces présentaient un comportement collectif, ce qui signifie qu’elles circulent différemment lorsqu’elles se déplacent en groupe. Les changements sont subtils. Leur vitesse moyenne et le zigzaguement de base de leurs trajectoires ne changent pas beaucoup. Cependant, en y regardant de plus près, on constate qu’elles effectuent des virages plus serrés et que chaque limace développe une légère préférence dans le sens de ses virages. Elles ont également tendance à se reposer davantage lorsqu’elles sont ensemble.

Nous avons utilisé les données des balises radio pour créer un modèle numérique des populations de limaces que nous avons étudiées. Cela nous a permis d’examiner des facteurs qui seraient difficiles, voire impossibles, à étudier sur le terrain.

Que vous aimiez ou détestiez les limaces, nous devons les comprendre afin d’aider les agriculteurs à produire notre alimentation à tous.

Keith Walters bénéficie actuellement d'un financement de recherche de la part d'Innovate UK. Par le passé, il a reçu des subventions de recherche du gouvernement britannique, de conseils de recherche, d'organismes de prélèvement industriels et de diverses autres sources.

Natalia Petrovskaya et Sergei Petrovskii ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur poste universitaire.

20.10.2025 à 16:21

Le tilapia, un poisson dont le succès pose question, des Caraïbes au Pacifique

Texte intégral (2078 mots)

Entre promesse de résilience alimentaire et menaces écologiques silencieuses, le tilapia cristallise aujourd’hui les grands enjeux du développement de l’élevage de poissons dans les territoires insulaires. En Haïti par exemple, où il s’est largement développé, le tilapia est présenté comme une solution prometteuse pour renforcer la sécurité alimentaire. Toutefois, cette expansion, souvent promue sans garde-fous écologiques solides, soulève de vives préoccupations environnementales, notamment autour de la gestion de l’eau douce et des risques liés à la diffusion incontrôlée du tilapia dans les milieux naturels.

C’est un poisson que l’on retrouve aujourd’hui sur des îles du monde entier. On l’appelle tilapia, mais derrière ce nom vernaculaire se trouve en réalité un ensemble de cichlidés, des poissons tropicaux d’eau douce, principalement des genres Oreochromis, Tilapia et Sarotherodon, indigènes d’Afrique et du sud-ouest de l’Asie. L’élevage du tilapia est aujourd’hui pratiqué dans plus de 135 pays, de la Chine et de l’Indonésie, dans le Pacifique, au Brésil, au Mexique et à Haïti. Cet engouement s’explique par sa capacité à croître rapidement (atteignant 400 ou 500 grammes en cinq à huit mois en étang), à se nourrir de ressources variées et à s’adapter à des milieux divers, autant d’atouts qui facilitent son élevage par rapport à bien d’autres espèces de poissons d’eau douce.

Importé d’Afrique dans les années 1950, le tilapia (Oreochromis mossambicus) a été largement diffusé à travers Haïti, notamment à partir des années 1980, avec l’appui de l'Organisation pour l’alimentation et l’agriculture (FAO) et du ministère de l’agriculture, des ressources naturelles et du développement rural, au point de devenir l’un des poissons d’élevage les plus utilisés dans les projets d’aquaculture rurale.

Aujourd’hui, Haïti dispose ainsi de plusieurs initiatives aquacoles d’envergure variable, allant des stations expérimentales aux exploitations privées commerciales comme Taïno Aqua Ferme sur le lac Azuéi. Toutefois, malgré ces efforts, la pisciculture demeure marginale : moins de 4 % des agriculteurs haïtiens y sont engagés, et la consommation annuelle de poisson (4,5 kg/an) reste inférieure à la moyenne caribéenne.

Parmi les freins récurrents figurent l’accès irrégulier aux jeunes poissons et aux aliments (coûts, importations), les contraintes d’eau et d’énergie, l’accompagnement technique limité, l’insécurité et des chaînes du froid et d’écoulement insuffisantes, soit autant d’obstacles qui fragilisent les modèles économiques des petites exploitations.

Malgré ce bilan pour le moins mitigé, certains, à l’instar de l’ancien ministre de l’agriculture Patrix Sévère, ont continué de nourrir l’ambition « de voir tous les plans d’eau du pays peuplés de tilapia ». En voulant « passer de la parole aux actes », l’actuel ministre de l’agriculture Vernet Joseph promettait en août 2024 d’introduire dans quatre plans d’eau du pays (le lac de Péligre, l’étang Bois Neuf, le lac Azuei et l’étang de Miragoâne), trois millions de jeunes tilapias ».

L’opération, selon lui, devait permettre, en deux mois, la production « de 25 tonnes de poissons ». Aujourd’hui, cependant, le projet est suspendu à la suite d’un avis consultatif initial de Caribaea Initiative (organisation consacrée à la recherche et la conservation de la biodiversité caribéenne) soulignant les risques écologiques, notamment pour les espèces de poissons endémiques de l’étang de Miragroâne. Aucune décision officielle n’a encore été actée quant à la poursuite ou non du projet, lequel resterait également conditionné à la mobilisation de financements, « selon un cadre du ministère de l’agriculture ».

Des expériences contrastées en contexte insulaire : l’exemple de Santo (Vanuatu)

À plus de 13 000 kilomètres de là, dans le sud de l’île de Santo au Vanuatu (archipel du Pacifique Sud), une expérience parallèle fortuite permet cependant de tirer des leçons précieuses. En avril 2020, le cyclone Harold a frappé de plein fouet cette île volcanique, provoquant le débordement de nombreux bassins piscicoles artisanaux. Des milliers de tilapias se sont ainsi échappés et ont colonisé les cours d’eau naturels, entraînant une transformation brutale des écosystèmes aquatiques. Les résultats préliminaires des enquêtes menées dans le cadre d’une thèse, conduite au sein du projet « Climat du Pacifique Sud, savoirs locaux et stratégies d’adaptation » (Clipssa), auprès d’une centaine d’usagers de cinq cours d’eau de l’île, révèlent que 87 % des personnes interrogées déclarent avoir constaté une diminution, voire une disparition, de nombreuses espèces de poissons et de crustacés autochtones depuis l’introduction involontaire du tilapia.

« Il y avait des crevettes, des poissons noirs [black fish], des anguilles […]. Maintenant, il n’y a presque plus que du tilapia », témoigne ainsi une habitante du sud-ouest de l’île.

« On ne pêche plus comme avant. Le tilapia est partout, il mange les œufs des autres poissons et tous ceux qu’ils trouvent », ajoute un pêcheur sur la côte est de l’île.

Les études menées par des chercheurs chinois et thaïlandais rapportent que l’introduction de deux espèces de tilapia dans leurs pays respectifs a également entraîné une réduction significative de la biodiversité des poissons natifs. Ces résultats sont corroborés par les données du Global Invasive Species Database, qui soulignent que le tilapia figure parmi les 100 espèces envahissantes les plus problématiques au monde.

Toutefois, il convient de nuancer ce constat. Une introduction maîtrisée de tilapia dans un écosystème ne conduit pas systématiquement à des effets négatifs. Les recherches du biologiste kenyan Edwine Yongo au sujet de la Chine et de Daykin Harohau aux îles Salomon montrent que, dans certaines conditions, l’élevage de cette espèce peut contribuer au contrôle des algues nuisibles, grâce à son régime alimentaire et à ses activités de fouissage des sédiments. Ce processus contrôlé peut ainsi améliorer la qualité de l’eau, tout en soutenant la sécurité alimentaire locale, notamment dans les contextes insulaires ou ruraux.

En somme, c’est donc moins l’espèce en elle-même que les modalités de son introduction et de son suivi qui déterminent si elle devient un facteur de dégradation écologique ou, au contraire, un levier de régulation et de sécurité alimentaire.

Quelles leçons pour Haïti ?

L’expérience de Vanuatu, tout comme les travaux menés en Chine et aux îles Salomon, offre ainsi à Haïti une précieuse grille de lecture pour penser l’avenir de l’élevage du tilapia sur son territoire. Si ce poisson peut devenir un levier de sécurité alimentaire, sa prolifération incontrôlée pourrait également menacer les écosystèmes aquatiques déjà fragiles et nuire à la biodiversité locale. Introduire massivement un poisson « pour nourrir la population locale » sans tenir compte de ces équilibres pourrait donc s’avérer contre-productif, en concurrençant les espèces locales, en perturbant les chaînes alimentaires et, in fine, en fragilisant les moyens d’existence de nombreux ménages. Son introduction dans le lac Miragoâne en Haïti pourrait par exemple entraîner un désastre écologique et conduire à l’extinction de tout un groupe d’espèces de petits poissons du genre Limia, endémiques de ce plan d’eau et que l’on ne trouve donc nulle part ailleurs en Haïti ou dans le monde.

Des exemples d’élevages circulaires ou multitrophiques, c’est-à-dire associant plusieurs niveaux de la chaîne alimentaire (poissons, mollusques filtreurs, algues) afin de recycler les nutriments, menés en Chine, au Sénégal ou d’autres types de projets pilotes en Haïti (comme Taïno Aqua Ferme, Caribean Harvest), montrent qu’il est possible de développer une aquaculture durable, à condition de :

maîtriser l’élevage en bassins clos ou cages flottantes sécurisées, de préférence dans des lacs artificiels, afin d’éviter tout risque pour les grands lacs naturels comme le lac Miragoâne, qui abrite une communauté de poissons endémiques ;

recourir à des espèces adaptées. Le rapport rédigé par Gilles, Celestin et Belot (2021) à la demande de l’Institut de recherche pour le développement (IRD) propose un modèle plus durable, adapté aux spécificités haïtiennes : l’élevage du tilapia ouest-africain Sarotherodon melanotheron, une espèce qui se nourrit surtout de débris organiques et d’algues en décomposition et qui tolère de fortes variations de salinité ;

valoriser les sous-produits agricoles (son de riz de l’Artibonite, pelures de banane-plantain, tourteaux d’arachide, drêche de sorgho séchée) et limiter la dépendance à des aliments importés ;

renforcer la formation technique des éleveurs pour garantir le bon fonctionnement des systèmes d’élevage ;

protéger les installations d’élevage contre les évènements météorologiques et climatiques extrêmes.

Poisson miracle pour certains, espèce à risque pour d’autres, le tilapia incarne à lui seul les dilemmes du développement aquacole en Haïti. Tirer les leçons des expériences internationales, notamment celles de Santo au Vanuatu, c’est comprendre qu’une expansion sans garde-fous écologiques pourrait transformer une solution alimentaire en problème écologique. L’avenir de la pisciculture haïtienne ne se jouerait pas seulement dans les bassins : il dépendra aussi de choix politiques éclairés, de modèles durables, et d’une écoute attentive des écosystèmes comme des communautés locales.

Samson Jean Marie ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

18.10.2025 à 10:27

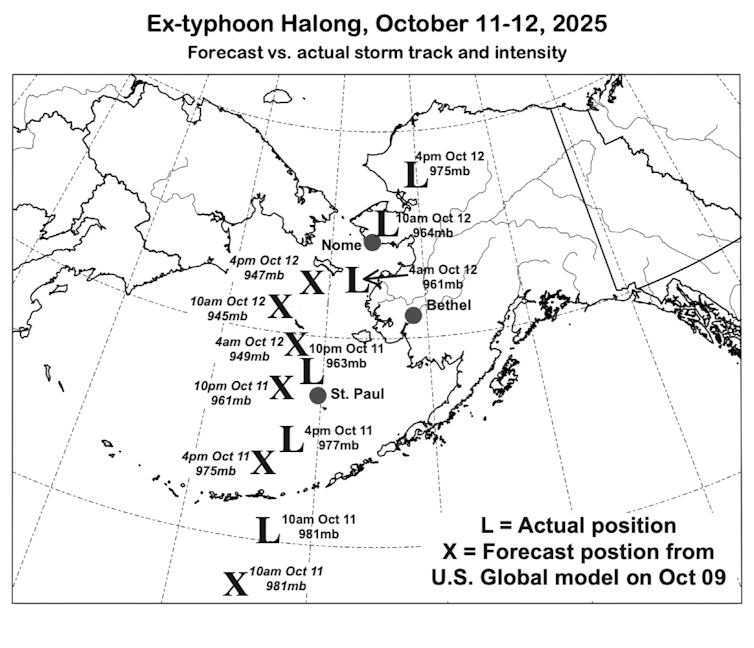

Tempête record en Alaska : comment le passage de l’ex-typhon Halong a pris tout le monde de court

Texte intégral (2567 mots)

Avec la montée des eaux, le dégel du pergélisol et des prévisions tardives, la catastrophe provoquée par le passage de Halong met en lumière les défis d'adaptation à venir pour les communautés isolées d’Alaska.

Les vestiges d’un puissant typhon ont déferlé le 12 octobre 2025 sur le delta du Yukon-Kuskokwim, dans l’ouest de l’Alaska aux États-Unis, soulevant une onde de tempête qui a inondé des villages jusqu’à près de 100 kilomètres à l’intérieur des terres. Selon les autorités, les eaux ont arraché des maisons à leurs fondations et en ont emporté certaines avec leurs occupants. Plus de cinquante personnes ont dû être secourues à Kipnuk et Kwigillingok, des centaines d’habitants ont été déplacés dans la région et au moins une personne a perdu la vie.

Le typhon Halong était un phénomène inhabituel, sans doute alimenté par les températures de surface de l’océan Pacifique, proches de records cet automne. Son passage à cette période de l’année rendra la reconstruction encore plus difficile pour les communautés durement touchées, comme l’explique le météorologue Rick Thoman, de l’Université d’Alaska à Fairbanks.

Les catastrophes en Alaska rural ne ressemblent à aucune autre aux États-Unis, précise-t-il. Alors que les habitants de la côte Est, frappés le même week-end par une tempête ayant inondé le New Jersey et d’autres États, ont pu se rendre dans un magasin de bricolage pour acheter du matériel ou réserver une chambre d’hôtel en cas d’inondation, rien de tout cela n’existe dans les villages autochtones isolés d’Alaska.

Qu’est-ce qui rendait cette tempête inhabituelle ?

Halong était un ex-typhon, semblable à Merbok en 2022, lorsqu’il a atteint le delta. Une semaine plus tôt, il s’agissait encore d’un puissant typhon à l’est du Japon. Le jet stream l’a ensuite entraîné vers le nord-est, un phénomène assez courant, et les modèles météorologiques avaient plutôt bien prévu sa trajectoire jusqu’à la mer de Béring.

Mais à l’approche de l’Alaska, tout a déraillé.

Les prévisions des modèles ont changé, indiquant une tempête se déplaçant plus rapidement, et Halong a suivi une trajectoire très inhabituelle, passant entre l’île Saint-Laurent et la côte du delta du Yukon-Kuskokwim.

Contrairement à Merbok, dont les modèles mondiaux avaient très bien anticipé la trajectoire, celle de Halong — ainsi que son intensité finale — n’étaient pas claires avant que la tempête ne soit à moins de 36 heures des eaux territoriales de l’Alaska. C’était bien trop tard pour organiser des évacuations dans de nombreuses localités.

La perte des données du programme de ballons météorologiques, suspendu en 2025, a-t-elle affecté les prévisions ?

C’est une question qui fera l’objet de recherches futures, mais voici ce que l’on sait avec certitude : il n’y a eu aucune observation en altitude par ballon météorologique à l’île Saint-Paul, dans la mer de Béring, depuis la fin du mois d’août, ni à Kotzebue depuis février. À Bethel et Cold Bay, les lancements sont limités à un par jour au lieu de deux. À Nome, aucun ballon n’a été envoyé pendant deux jours entiers alors que la tempête se dirigeait vers la mer de Béring.

Est-ce que cela a faussé les prévisions ? On ne le sait pas, faute de données, mais il semble probable que cela ait eu un effet sur la performance des modèles.

Pourquoi la région du delta est-elle si vulnérable face à une tempête comme Halong ?

Le terrain, dans cette partie ouest de l’Alaska, est très plat, ce qui permet à de fortes tempêtes de faire pénétrer l’océan dans le delta, où l’eau se répand largement.

La plupart des terres se trouvent très près du niveau de la mer, parfois à moins de trois mètres au-dessus de la ligne de marée haute. Le dégel du pergélisol, l’affaissement du sol et la montée du niveau de la mer accentuent encore le risque. Pour de nombreuses personnes, il n’existe littéralement aucun endroit où se réfugier. Même Bethel, la plus grande ville de la région, située à une centaine de kilomètres en amont sur la rivière Kuskokwim, a connu des inondations provoquées par Halong.

Ce sont des communautés très isolées, sans routes menant aux villes. On ne peut y accéder que par bateau ou par avion. Aujourd’hui, de nombreuses personnes s’y retrouvent sans logement, alors que l’hiver approche.

Ces villages sont également de petite taille. Ils ne disposent ni de logements supplémentaires ni des ressources nécessaires pour se relever rapidement. La région se remettait déjà d’importantes inondations survenues à l’été 2024. La tribu de Kipnuk a pu obtenir une aide fédérale pour catastrophe naturelle, mais celle-ci n’a été approuvée qu’au début de janvier 2025.

À quoi ces communautés sont-elles confrontées pour la reconstruction ?

Les habitants vont devoir prendre des décisions très difficiles. Faut-il quitter la communauté pour l’hiver et espérer reconstruire l’été prochain ?

Il y a sans doute très peu de logements disponibles dans la région, d’autant que les inondations ont été étendues et qu’il existe déjà une pénurie de logements. Les personnes déplacées doivent-elles se rendre à Anchorage ? La vie en ville y est coûteuse. Il n’existe pas de solution simple.

La reconstruction dans des endroits comme Kipnuk est logiquement complexe. On ne peut pas simplement décrocher son téléphone et appeler un entrepreneur local. Presque tous les matériaux doivent être acheminés par barge – du contreplaqué aux clous en passant par les fenêtres – et cela ne se fera pas en hiver. Impossible de transporter quoi que ce soit par camion : il n’y a pas de routes. Les avions ne peuvent transporter que de petites quantités, car les pistes sont courtes et non adaptées aux avions cargo.

La Garde nationale pourrait peut-être aider à acheminer des fournitures par avion. Mais il faut encore disposer de personnes capables d’assurer la construction et les réparations. Tout devient cent fois plus compliqué lorsqu’il s’agit de bâtir dans des communautés isolées. Même si une aide nationale ou fédérale est approuvée, la plupart des maisons ne pourraient être reconstruites qu’à l’été prochain.

Le changement climatique joue-t-il un rôle dans ce type de tempêtes ?

Ce sera une autre question à explorer dans de futures recherches, mais la température de surface de la mer dans la majeure partie du Pacifique Nord, que le typhon Halong a traversée avant d’atteindre les îles Aléoutiennes, était bien plus élevée que la normale. Les eaux chaudes alimentent les tempêtes.

Halong a également entraîné avec lui une masse d’air très chaud vers le nord. À l’est de sa trajectoire, le 11 octobre, Unalaska a enregistré 20 °C, un record absolu pour un mois d’octobre à cet endroit.

Rick Thoman a pris sa retraite du service météorologique national (National Weather Service) de la région Alaska en 2018.

16.10.2025 à 15:48

La rivière qui cache la forêt ? L’importance de protéger les ripisylves, précieuses face aux changements globaux

Texte intégral (3535 mots)

On parle ainsi de ripisylves pour décrire la flore qui peuple les rives et de forêts alluviales pour parler des forêts qui jouxtent les cours d’eau (et qui sont souvent des « forêts inondables »). Riches d’une biodiversité précieuse, les ripisylves rendent un grand nombre de services écosystémiques. Tout du moins, lorsque les pressions exercées par les activités humaines ne les ont pas dégradées…

Comment mieux gérer ces milieux fragiles et pourtant protecteurs, notamment face au changement climatique ? Une question à laquelle répond l’ouvrage paru en octobre 2025 aux éditions Quae, librement accessible en ligne. Dans le texte ci-dessous, ses coordinateurs scientifiques expliquent pourquoi et comment protéger ces bijoux méconnus de biodiversité.

Parlez de rivières, de fleuves, de ruisseaux… les images qui viennent à l’esprit sont presque systématiquement des images avec de l’eau, ou au contraire de chenaux à sec.

Pourtant, les cours d’eau ne sont pas que des tuyaux qui transportent de l’eau, ce sont aussi des forêts. En conditions naturelles, une végétation particulière pousse en effet sur leurs berges, à laquelle on donne plusieurs noms : ripisylve, forêt alluviale, boisement riverain, cordon riparien, forêt-galerie, etc.

Ces forêts méritent d’être mieux connues : elles représentent en effet un atout important pour la gestion durable des territoires dans le contexte des changements globaux (changement climatique, déclin de la biodiversité, etc.) que nous vivons.

À lire aussi : « Méandres ou la rivière inventée » : comment refaire monde avec les rivières ?

Une forêt pas comme les autres

Quel que soit le nom que l’on donne à ces forêts, cette végétation est particulière, car elle est connectée au cours d’eau.

Lors des inondations par exemple, de l’eau passe du chenal vers la forêt, et avec elle aussi des sédiments, des graines, des nutriments, etc. Il en résulte des conditions écologiques différentes du paysage alentour. Par exemple, la végétation a accès à davantage d’eau et pousse plus vite.

Mais elle doit également s’adapter à la présence de l’eau. Celle-ci peut engorger le substrat pendant plusieurs semaines, et les crues qui peuvent éroder les sédiments – et, par la même occasion, arracher le substrat sur lequel elle pousse.

Les forêts de bord de cours d’eau sont donc des écosystèmes uniques : ni complètement aquatiques ni complètement terrestres, composés d’une végétation particulière avec des espèces adaptées comme les saules, les aulnes, les peupliers, etc.

Non seulement elles abritent des espèces spécifiques, ce qui augmente la biodiversité à l’échelle régionale, mais elles en accueillent aussi une grande quantité sur des surfaces relativement petites. En effet, les conditions sont localement très variables (de très humides à très sèches), ce qui crée des mosaïques d’habitats.

Des observations réalisées sur une trentaine de sites couvrant seulement 7,2km2 le long de l’Adour (dans le sud-ouest de la France, ndlr) recensent ainsi près de 1 500 espèces végétales pour ce seul cours d’eau. Cela représente environ 15 % de la flore vasculaire – un groupe de plantes qui recoupe les angiospermes (ou, plantes à fleurs), les gymnospermes, les monilophytes et les lycophytes – de France métropolitaine, alors que la surface couverte ne représente que 0,0013 % du territoire français.

Le cours d’eau influence donc la végétation des rives, mais les forêts des bords de cours d’eau influencent aussi grandement le fonctionnement de ce dernier en retour.

De multiples services rendus à la société

Les forêts alluviales et les ripisylves ne sont pas seulement des viviers de biodiversité : elles fournissent également des services écosystémiques précieux pour nos sociétés.

Elles participent ainsi aux stratégies d’atténuation face au changement climatique, en stockant du carbone en grande quantité. Du fait des conditions humides, leur croissance et leur biomasse sont parfois aussi importantes que celles des forêts tropicales. En été, elles limitent la hausse de la température de l’eau des petites rivières jusqu’à 5 °C, ce qui est précieux pour la faune aquatique. En outre, elles piègent des sédiments, des nutriments et des substances qui dégradent la qualité physico-chimique des cours d’eau.

Dans certaines conditions, elles contribuent par ailleurs à ralentir la propagation et à réduire l’ampleur des ondes de crues entre l’amont et l’aval des bassins versants.

Au-delà de leur biodiversité végétale propre, elles fournissent des ressources alimentaires, des habitats et des corridors de déplacement à de nombreuses espèces aquatiques, semi-aquatiques et terrestres, telles que les poissons, le castor, les chauves-souris, etc. Elles participent, enfin, à former un paysage agréable, apprécié des différents usagers des cours d’eau (promeneurs, pêcheurs, cyclistes, etc.).

Ces forêts ne sont toutefois pas miraculeuses. La qualité de l’eau dépend également d’autres éléments, comme les pressions sur la biodiversité qui s’exercent dans le bassin versant.

Si la présence de ces forêts est un réel atout, elle n’est pas un blanc-seing qui permettrait de faire l’impasse sur les effets de certaines activités humaines, comme l’artificialisation des sols, l’agriculture intensive, les rejets de stations d’épuration ou le relargage de plastiques, sur la qualité des cours d’eau. Historiquement, les cours d’eau et leurs abords ont en effet souvent concentré ces impacts délétères.

Un joyau sous pression

À l’échelle de l’Europe, on estime que seuls 30 % des zones riveraines de cours d’eau sont encore boisées, alors qu’elles pourraient l’être à plus de 95 %.

Ce chiffre cache toutefois une très grande variabilité entre pays : ce taux peut atteindre une moyenne de 50 % en Scandinavie et descendre à 10 % en Angleterre et en Irlande. Dans certaines régions de moyenne montagne ou de déprise rurale, les superficies augmentent, mais à l’échelle continentale, ces milieux continuent de régresser. Entre 2012 et 2018, 9 000 hectares ont disparu chaque année, en Europe. Près de 50 % de ces étendues ont été réaffectées en surfaces bâties, 25 % en parcelles cultivées et 25 % en praires.

Lorsqu’ils existent, ces boisements subissent en outre d’autres pressions : perte de caractère humide du fait des prélèvements en eau et du changement climatique, présence d’espèces exotiques envahissantes, propagation de maladies touchant les arbres comme le phytophthora ou la chalarose, mauvaises pratiques d’entretien, etc.

Résultat : ils sont parmi les habitats semi-naturels européens dans le plus mauvais état de conservation, puisque seulement 5 % sont considérés comme dans un état favorable. Or, il a été démontré que le faible boisement des berges et leur dégradation limitent drastiquement leur qualité écologique et leur capacité à rendre les services écosystémiques mentionnés plus haut.

Dépasser la volonté de « faire propre »

Reconnaître toute la valeur des forêts des bords de cours d’eau doit amener à définir comme objectifs prioritaires des politiques environnementales trois grandes stratégies :

- conserver l’existant,

- restaurer ce qui est dégradé,

- et améliorer les pratiques quotidiennes de gestion.

Mais il ne suffit pas d’énoncer ces grands principes. Leur mise en œuvre concrète et à large échelle peut s’avérer complexe du fait de la coexistence d’enjeux multiples, qui relèvent de plusieurs échelles spatiales et impliquent de nombreux acteurs : inondations, biodiversité, quantité et qualité de l’eau, usages divers, espèces envahissantes, obstacles à l’écoulement, etc.

Heureusement, des solutions existent : plan pluriannuel de gestion, diagnostic et gestion sectorisés, techniques de génie végétal, méthodes et indicateurs de suivi adaptés, outils de conception des actions de restauration ou des mesures de conservation, etc.

Beaucoup reste à faire : la gestion des forêts alluviales et des ripisylves s’appuie parfois plus sur l’habitude ou sur la volonté de « faire propre » que sur l’évaluation factuelle des enjeux. Elle doit aussi être considérée comme suffisamment prioritaire pour que des moyens humains et financiers suffisants lui soient consacrés et que les bonnes pratiques soient plus largement partagées.

Mais c’est une logique payante pour relever les enjeux environnementaux contemporains, notamment en matière de moyens financiers et humains, car ces forêts apportent de nombreux bénéfices alors même qu’elles occupent une superficie réduite et qu’elles ont été très dégradées. À l’interface entre l’eau et la terre, les ripisylves et les forêts alluviales souffrent d’une faible visibilité, aussi bien dans les politiques environnementales que dans le grand public, ce qui constitue un frein à leur prise en compte. Il s’agit donc de travailler à faire (re)connaître leurs valeurs, leurs fonctions et leurs spécificités.

Simon Dufour a reçu des financements des programmes européens COST Action CA 16208 et Horizon 2020.

Richard Chevalier est ingénieur retraité de l’INRAE (UR EFNO), il continue à utiliser cette affiliation pour des valorisations concernant ses activités de recherche antérieures. Il exerce de l’expertise, du conseil, de l’appui technique et de l’enseignement en phytoécologie dans le cadre de son auto-entreprise CHEPHYTEC. Il exerce aussi du conseil et de l’appui technique bénévoles en phytoécologie pour des associations naturalistes : Conservatoire d'espaces naturels Centre-Val de Loire (CEN CVL), Loiret Nature Environnement (LNE) et Cultur’AuxBarres (MLC Nogent-sur-Vernisson)

Marc Villar a reçu des financements principalement du Ministère de l’Agriculture (MASA) et de la Région Centre-Val de Loire pour ses recherches sur le programme national de conservation des ressources génétiques du Peuplier noir.

16.10.2025 à 10:24

Pourquoi les labels « bio » ne se valent pas d’un pays à l’autre

Texte intégral (3062 mots)

Le « bio » : une étiquette clairement identifiable et souvent rassurante. Pourtant, les réalités derrière ce label mondial divergent. Alors que les normes en Europe sont plutôt strictes, elles sont bien plus souples en Amérique du Nord. Dans les pays émergents, ce sont les contrôles qui sont inégaux. Autant d’éléments à même d’affecter la confiance accordée au bio par les consommateurs. Comment s’y retrouver ? L’idéal serait d’harmoniser les règles d’un pays à l’autre. Petit tour d’horizon.

Le « bio » est un label mondial qui peut s’appliquer à des produits venus d’Europe, de Chine ou d’Amérique du Sud. Il n’a pourtant rien d’universel. Derrière l’étiquette rassurante, on ne retrouvera pas les mêmes normes en fonction des pays de production.

Par exemple, alors que l’Europe impose des règles plutôt strictes, les États-Unis se montrent beaucoup plus souples. Dans certains pays émergents, comme le Brésil, ce sont les contrôles qui sont souvent moins sévères. Nous vous proposons ici un bref tour d’horizon, qui vous permettra, nous l’espérons, de mieux orienter vos choix de consommation.

À lire aussi : Une agriculture 100% bio en France est-elle possible ?

L’absence de pesticides derrière le succès du bio français

En France, la consommation de produits biologiques a connu une croissance fulgurante. En 2023, après vingt années de progression continue, ce marché a été multiplié par 13 par rapport à son niveau initial.

Cette tendance s’explique par le fait que les consommateurs perçoivent le bio comme un produit plus naturel, notamment en raison de l’absence de traitements pesticides autorisés. La production bio doit respecter un cahier des charges plus attentif à l’environnement, ce qui favorise la confiance des consommateurs dans un contexte de plus en plus marqué par la défiance alimentaire.

Ce label demeure toutefois une construction réglementaire qui dépend fortement du contexte national. Cette dynamique positive se heurte aujourd’hui à des évolutions législatives à même de la fragiliser. La loi Duplomb, adoptée le 8 juillet 2025, illustre combien les choix politiques peuvent ébranler la confiance accordée à l’agriculture en réintroduisant la question des pesticides au cœur du débat. Cette loi propose en effet des dérogations à l’interdiction d’utiliser des produits phytopharmaceutiques contenant des néonicotinoïdes.

Même si elle loi ne concerne pas directement les producteurs biologiques, elle risque d’avoir des effets indirects sur le secteur. En réintroduisant des dérogations à l’usage de substances controversées, elle ravive la défiance du public envers l’agriculture conventionnelle. Dans ce contexte, les filières bio pourraient apparaître comme une valeur refuge pour les consommateurs, renforçant leur rôle de repère de confiance dans un paysage agricole fragilisé.

Dans l’Union européenne, un label bio garanti sans OGM

L’Union européenne (UE) a établi une réglementation stricte pour l’agriculture biologique dès 1991. Au-delà de la question des pesticides, qui se pose, comme on l’a vu plus haut, plus intensément en France, celle des organismes génétiquement modifiés (OGM) offre également une clé de lecture intéressante à l’échelle européenne.

En effet, le label bio européen interdit totalement le recours à OGM dans les produits labélisés bio, à toutes les étapes de sa chaîne de production. Cela signifie qu’il est interdit d’utiliser des semences OGM pour les cultures bio, pas d’alimentation animale issue des OGM pour l’élevage bio et pas d’ingrédients issus des OGM pour les produits transformés bio.

En outre, le cahier des charges européen du bio impose des pratiques agricoles strictes en limitant le recours aux intrants de synthèse. Ceci inclut les engrais azotés, les pesticides, les herbicides et les fongicides de synthèse. Seuls certains intrants naturels ou minéraux sont autorisés, à l’instar du fumier, compost et engrais verts. Ceci reflète la philosophie du bio, basée sur la prévention des maladies et des déséquilibres agronomiques, par le maintien de la fertilité des sols, la biodiversité et les équilibres écologiques.

En France, le label français AB s’appuie ainsi sur le règlement européen, tout en ajoutant quelques exigences propres, comme un contrôle plus rigoureux de la traçabilité et du lien au sol.

Si les deux labels restent alignés sur les grands principes, le bio français se distingue par une mise en œuvre généralement plus stricte, héritée d’une longue tradition d’agriculture biologique militante.

Le bio en Europe se heurte aussi à un certain nombre d’enjeux actuels, notamment agronomiques. Il s’agit par exemple du besoin de renforcer la recherche sur les alternatives aux pesticides et autres intrants de synthèse, comme le biocontrôle, une sélection variétale adaptée et la gestion écologique des sols.

Enfin, force est de constater que l’UE a fait du bio un pilier de sa stratégie « de la ferme à la table » (« From Farm to Fork »). Celle-ci a pour objectif d’atteindre 25 % de la surface agricole utile (SAU) européenne en bio d’ici 2030.

Afin de garantir la fiabilité du label, l’UE a mis en place un système de contrôle centralisé et harmonisé de supervision des chaînes de valeur alimentaires. Celles-ci englobent les producteurs, les transformateurs, jusqu’aux distributeurs. Ces contrôles reposent sur des règles précises définies par le règlement européen 2018/848.

De son côté, le consommateur retrouvera les différents labels de certification bio, tels que le label européen EU Organic, le label national AB en France ou encore le Bio-Siegel en Allemagne. Même si tous ces labels reposent sur la même base réglementaire européenne, leurs modalités d’application (par exemple, le type de suivi) peuvent varier légèrement d’un pays à un autre. Chaque pays peut en outre y ajouter des exigences supplémentaires. Par exemple, la France impose une fréquence de contrôle plus élevée, tandis que l’Allemagne insiste sur la transparence des filières.

Une labélisation plus souple en Amérique du Nord

En Amérique du Nord, l’approche du bio est plus souple que celle de l’Union européenne. Aux États-Unis, le label USDA Organic, créé en 2002, définit les standards nationaux de la production biologique. Il se caractérise par une certaine souplesse par rapport aux standards européens, notamment en ce qui concerne l’usage des intrants, puisque certains produits chimiques d’origine synthétique sont tolérés s’ils sont jugés nécessaires et sans alternatives viables. Ceux-ci incluent, par exemple, certains désinfectants pour bâtiments d’élevage et traitements antiparasitaires dans la conduite de l’élevage.

Le Canada, de son côté, a mis en place sa réglementation nationale des produits biologiques – le Canada Organic Regime – plus tardivement que les États-Unis. Ce système est équivalent à celui des États-Unis, dans la mesure où un accord bilatéral de reconnaissance mutuelle permet la vente des produits bio canadiens aux États-Unis et vice versa.

Les deux systèmes présentent ainsi de nombreuses similitudes, notamment en ce qui concerne la liste des substances autorisées et leur flexibilité d’usage. Cependant, ils divergent du modèle européen sur plusieurs points.

Tout d’abord, alors que l’UE applique une tolérance quasi nulle vis-à-vis des OGM, les États-Unis et le Canada tolèrent, de façon implicite, la présence accidentelle de traces d’OGM dans les produits bio. En effet, selon le règlement de l’USDA Organic, l’utilisation volontaire d’OGM est strictement interdite, mais une contamination involontaire n’entraîne pas automatiquement la perte de la certification si elle est jugée indépendante du producteur. Le Canada adopte une position légèrement plus stricte, imposant des contrôles renforcés et une tolérance plus faible.

Cette différence a suscité des controverses au moment de l’accord de reconnaissance mutuelle, certains consommateurs et producteurs canadiens craignant de voir arriver sur leur marché des produits bio américains jugés moins exigeants sur la question des OGM. Celles-ci concernaient également les conditions d’élevage. En effet, alors qu’en Europe les densités animales sont strictement limitées et que les sorties en plein air sont très encadrées, en Amérique du Nord, certains systèmes de production biologique peuvent être beaucoup plus intensifs, menant à de véritables fermes industrielles biologiques, ce qui entraîne une perte de proximité avec l’idéal originel du bio.

Enfin, un autre contraste concerne les productions hors sol. Aux États-Unis, les fermes hydroponiques – qui cultivent les plantes hors sol – peuvent être certifiées USDA Organic, à condition que les intrants utilisés figurent sur la liste autorisée. En revanche, en Europe, l’hydroponie est exclue car elle ne respecte pas le lien au sol, considéré au cœur de la philosophie agroécologique.

À lire aussi : « Les mots de la science » : A comme agroécologie

Dans les pays émergents, du bio mais selon quels critères ?

Dans les pays émergents, la question du bio se pose différemment. En effet, celle-ci dépend fortement des dispositifs et des critères mis en place par ces pays pour en garantir la crédibilité. À titre d’exemple, en Inde, au Brésil ou en Chine, les labels bio nationaux sont assez récents (la plupart ont été mis en place entre 2000 et 2010) et moins contraignants que leurs équivalents européens.

Alors que, dans l’UE, les contrôles sont effectués par des organismes certificateurs tiers accrédités et indépendants, au Brésil, les producteurs peuvent être certifiés via un système participatif de garantie (SPG), qui repose sur l’auto-évaluation collective des agriculteurs. En conséquence, ces labels peinent à construire une véritable confiance auprès des consommateurs.

Par ailleurs, dans de nombreux cas, les certifications biologiques sont avant tout conçues pour répondre aux standards des marchés internationaux afin de faciliter l’exportation vers l’UE ou l’Amérique du Nord, plutôt que pour structurer un marché intérieur. C’est, par exemple, le cas en Inde.

Cette situation laisse souvent les consommateurs locaux avec une offre limitée et parfois peu fiable. Dans ce contexte, les organismes privés de certification internationaux, comme Ecocert, Control Union ou BioInspecta occupent une place croissante. Ils améliorent la reconnaissance de ces produits, mais renforcent une forme de dépendance vis-à-vis de standards extérieurs, ce qui soulève des enjeux de souveraineté alimentaire mais aussi de justice sociale dans ces pays.

Le bio, un label global… mais éclaté

L’absence de reconnaissance universelle mutuelle entre les différents systèmes de certification biologique engendre de la confusion chez les consommateurs. Il crée également de fortes contraintes pour les producteurs.

En pratique, un agriculteur qui souhaiterait exporter une partie de sa production doit souvent obtenir plusieurs certifications distinctes. Par exemple, un producteur mexicain doit ainsi être certifié à la fois USDA Organic pour accéder au marché américain et EU Organic pour pénétrer le marché européen.

Cette multiplication des démarches alourdit les coûts et la complexité administrative pour les producteurs, tout en renforçant les inégalités d’accès aux marchés internationaux.

Du côté des consommateurs, l’usage généralisé du terme « bio » peut donner l’illusion d’une norme universelle, alors qu’il recouvre en réalité des cahiers des charges très différents selon les pays. Cette situation entretient une certaine ambiguïté et peut induire en erreur, en masquant les disparités de pratiques agricoles et de niveaux d’exigence derrière un label apparemment commun.

Comment s’y retrouver en tant que consommateur ?

Pour s’y retrouver dans la jungle du « bio », il faut donc aller au-delà du simple logo affiché sur l’emballage et s’informer sur la provenance réelle du produit et sur le cahier des charges du label précis qui le certifie.

Il est aussi essentiel de garder à l’esprit que bio ne signifie pas automatiquement « local » ni « petit producteur ». Certains produits certifiés biologiques proviennent de filières industrielles mondialisées.

Enfin, le consommateur peut jouer un rôle actif de « citoyen alimentaire », pour encourager davantage de transparence et de traçabilité, s’il favorise les circuits de distribution qui donnent accès à une information claire et détaillée sur l’origine et les modes de production. Il soutient alors une alimentation plus démocratique et responsable. C’est précisément cette implication citoyenne dans le système alimentaire qui peut favoriser l’essor d’une culture de l’alimentation locale et durable, fondée sur la confiance, l’attachement au territoire et la coopération entre producteurs et consommateurs.

Pour que le bio livre son plein potentiel en termes de transformation agroécologique des systèmes alimentaires mondiaux, peut-être faudrait-il, demain, envisager une harmonisation internationale du bio. C’est à cette condition qu’on pourra en faire un véritable langage commun pour les consommateurs, qui signifie réellement la même chose d’un pays à l’autre.

Marie Asma Ben-Othmen ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.