02.06.2026 à 16:38

Contre les oppressions subies par les femmes, décoloniser le féminisme

Texte intégral (2577 mots)

Dans Décoloniser l’universalisme, une éthique du féminisme transnationale, aux éditions Éliott, la philosophe états-unienne Serene J. Khader (Graduate School and University Center of the City University of New York) dénonce une forme de « féminisme missionnaire » occidental qui entend « sauver » les femmes des Sud en imposant un modèle unique et idéalisé. Or, analyse-t-elle, il est possible de défendre des valeurs féministes universelles prenant en compte la pluralité des conditions féminines à travers le monde, sans imposer un modèle culturel occidental.

Son ouvrage est traduit pour le public français par la philosophe française Manon Garcia (Université Goethe de Francfort), qui en signe également la préface. Nous vous proposons des extraits de cette préface, suivis de bonnes feuilles du livre de Serene J. Khader.

Extrait de la préface de Manon Garcia

Ce livre entend démontrer de manière implacable que le féminisme peut et doit être universaliste et, ce faisant, clarifier ce qu’est l’universalisme au point de le redéfinir. Pour autant, cette technicité ne doit pas masquer l’essentiel : ce livre contribue de manière extrêmement importante à des débats centraux du féminisme, de la philosophie et du monde politique contemporain. Il dissout une bonne fois pour toutes la prétendue alternative entre universalisme et relativisme moral : seule une mécompréhension de ce qu’est l’universalisme peut laisser croire que nous n’aurions le choix qu’entre un universalisme qui masquerait forcément des ambitions impérialistes et un anti-impérialisme forcément relativiste et complaisant face à des pratiques culturelles qui perpétuent l’oppression sexiste. […]

On peut légitimement se demander pourquoi un lectorat français aurait besoin de lire des analyses de Serene Khader : après tout, les féministes francophones n’ont pas attendu ce livre pour s’interroger sur l’universalisme, et l’importation de la littérature féministe notamment américaine en France peut parfois avoir l’air d’une démarche impérialiste elle-même, qui nous ferait croire que bell hooks et Angela Davis valent nécessairement mieux qu’Awa Thiam, Françoise Vergès ou Fatima Mernissi.

Abstraction de l’universalisme à la française

Il y a sans nul doute un problème dans la réception française des écrits décoloniaux français et francophones : les sœurs Nardal et Aimé Césaire se sont depuis longtemps inquiétés de l’abstraction néfaste de l’universalisme à la française, Frantz Fanon a mis en évidence le lien entre l’entreprise coloniale et la volonté de dévoilement des femmes, Awa Thiam demande, depuis 1978, que l’on donne la parole aux femmes noires, Fatima Mernissi s’est intéressée dès le début des années 1980 à l’intersection des oppressions de genre, de classe et de race dans la vie des paysannes et a établi un parallèle entre l’injonction à la minceur des femmes occidentales et l’injonction au port du voile dans les pays du Maghreb et certains des textes centraux du féminisme islamique ont été écrits en français.

À lire aussi : Paulette Nardal, pionnière méconnue de la négritude

De manière plus récente et plus strictement philosophique, les travaux de Naïma Hamrouni sur le sujet féministe, ceux de Soumaya Mestiri et de Nadia Yala Kisukidi sur la nécessité de décoloniser le féminisme et la philosophie, ceux d’Elsa Dorlin sur le rôle conjoint du sexisme et du racisme dans la construction moderne de la nation et ceux de Hourya Benthouami et Nadia Yala Kisudiki spécifiquement sur la question de l’universalisme à la française montrent le rôle que peut jouer la philosophie dans la mise en évidence de l’impérialisme et dans l’élaboration d’outils pour le combattre.

Bâtir un pont

Mais il me semble que le travail de Serene Khader importe et gagne à être connu d’abord parce qu’il permet de bâtir un pont entre, d’un côté, les débats en philosophie contemporaine de tendance analytique sur les tensions entre multiculturalisme et féminisme (et notamment les textes de Susan M. Okin et Uma Narayan, ndlr), les débats politiques actuels sur la possibilité d’une diplomatie féministe (l’idée de diplomatie féministe a été proposée par la Suède en 2014 et a depuis été adoptée par plusieurs pays européens, notamment la France et l’Allemagne, ndlt), sur le fémonationalisme, sur le communautarisme, sur l’intersectionnalité et, plus généralement, sur la tension supposée entre appartenance culturelle et participation politique.

Bonnes feuilles de l’ouvrage de Serene J. Khader

Certes, le féminisme implique que les rapports de genre oppressifs sont inacceptables, mais rien n’autorise à présumer qu’il n’existerait qu’une seule conception du genre compatible avec la justice de genre, ou capable de la soutenir. L’idée qu’une société juste du point de vue du genre devrait nécessairement adopter la compréhension occidentale des rôles de genre peut, par conséquent, obscurcir le sens du pouvoir des « autres » femmes et les raisons pour lesquelles elles investissent certains rôles féminins.

L’idéalisation des formes culturelles occidentales

La discussion que Joan Scott (dans la Politique du voile, ndlr) consacre à la façon dont la France appréhende le hijab fournit un exemple frappant de la manière dont l’idéalisation de protocoles occidentaux en matière de genre peut conduire à surestimer, avec une désinvolture inquiétante, l’assujettissement des « autres » femmes. (L’ouvrage se concentre notamment sur les débats autour de la loi du 15 mars 2004 interdisant le port ostensible de signes religieux dans l’enceinte scolaire, plus communément appelée « loi sur le voile », ndlr)

Scott soutient que le désir, en France, d’interdire le port du voile musulman à l’école procède de l’hypothèse, chez les Français·es non musulman·es, que leurs rapports de genre sont déjà égalitaires, et qu’ils le sont d’une manière singulière. L’un des ressorts de l’indignation face au hijab est l’idée que ce serait une tragédie que de jeunes femmes « cachent leurs beaux visages ». (Bien entendu, le hijab ne couvre pas le visage – c’est un indice supplémentaire du geste culturaliste consistant à laisser les pratiques réputées les plus oppressives tenir lieu, par métonymie, de la culture tout entière, ndlt).

Selon Scott, cela révèle que ce que les Français·es jugent préoccupant était « le refus des filles de se conformer à ce qui était tenu pour les protocoles “normaux” d’interaction avec les membres du sexe opposé ». L’idée sous-jacente est que la « libération sexuelle » est un préalable de l’égalité des sexes, et que pour que cette libération sexuelle existe, il faut que les femmes apparaissent comme prêtes à avoir des relations sexuelles avec des inconnus ou au moins à être évaluées sexuellement par ces derniers.

Or, l’une des fonctions du hijab est précisément d’affirmer que la sexualité n’a sa place que dans des sphères d’intimité. Comme le note Scott, certaines féministes musulmanes affirment d’ailleurs que le fait de ne pas avoir à être sexualisées dans l’espace public est une source d’empouvoirement.

Nul besoin de trancher la question de savoir si le hijab est empouvoirant en France pour voir ce que l’idéalisation française rend impensable. Si Scott a raison, la conception française dominante ne peut reconnaître comme égalitaires que des conceptions des rapports de genre qui incitent les femmes à accepter des interactions sexualisées avec des inconnus. Or, il est difficile de soutenir qu’un tel type d’interaction est nécessaire pour être entendue politiquement ou pour accéder à l’éducation ; si une telle exigence s’avérait nécessaire mais ne pesait que sur les femmes, elle serait à l’évidence sexiste.

On pourrait objecter qu’attendre des femmes, unilatéralement, qu’elles désérotisent les relations dans la sphère publique est sexiste, indépendamment même de la participation à la vie publique. Mais beaucoup de femmes musulmanes qui défendent le port du voile ne considèrent pas pour autant que l’autorégulation sexuelle ou la modestie vestimentaire sont la seule responsabilité des femmes (Cf. Al-Khatahtbeh et coll., 2014).

Du point de vue français, en revanche, toute manière de gérer la sexualité qui ne se conforme pas aux protocoles « français » de disponibilité sexuelle et de fréquentation amoureuse apparaît comme hostile à l’égalité des sexes. Rejeter un protocole occidental de marquage du genre revient alors, purement et simplement, à accepter la subordination des femmes. La possibilité même de réinterpréter les rôles de genre musulmans, comme celle de soumettre à la critique les normes des Français·es non musulman·es, se trouve ainsi exclue.[…]

De la compatibilité entre rôles traditionnels et féminismes

Dans des conditions non idéales, la question décisive est de savoir si la capacité des femmes à façonner les conditions de leur action augmente, et si elle augmente d’une manière qui rend moins probable que le pouvoir s’exerce sur elles. La participation à nombre d’institutions associées, en Occident, à la sphère publique territorialisée (le marché ou la ville, par exemple) ne correspond pas nécessairement à un gain de pouvoir dans la décision sociale. C’est particulièrement vrai lorsque ces institutions ne sont pas, en fait, le lieu où se concentre le pouvoir social effectif.

C’est, me semble-t-il, ce qui se trouve au cœur des critiques formulées, en Afrique subsaharienne, à l’encontre de l’idéalisation d’une sphère publique territorialisée : si le village est un lieu où l’on peut infléchir la décision collective et que la ville ne l’est pas, ou si la capacité de produire de la nourriture constitue, dans la négociation, un atout plus décisif que la possession d’argent liquide, alors des stratégies consistant à réhabiliter des rôles traditionnels et à refuser des options qui les contredisent, peuvent être compatibles avec les objectifs féministes. (Cf. Monique Deveaux, 2016 sur la manière dont la reconnaissance de modes informels de participation politique peut accroître le pouvoir des femmes dans la décision sociale, dans des contextes d’autorité politique traditionnelle. Pour des analyses de formes importantes de pouvoir de décision sociale exercées au travers d’institutions susceptibles d’échapper aux Occidentales et aux Occidentaux, on pourra aussi consulter la littérature sur les_ panchayats _en Asie du Sud, ndlt).

Prenons encore l’exemple de l’interdiction du port du voile musulman et des défenses du voile par les féministes islamiques : il est possible que la capacité d’influer sur la vie sociale et la disponibilité sexuelle dans l’espace public soient relativement indépendantes. Je ne cherche évidemment ni à dire que le pouvoir qui se situe en dehors de la sphère publique territorialisée, ou qui rejette certains de ses attributs, est toujours plus important qu’il n’y paraît, ni à fournir une image d’Épinal de la « vie traditionnelle ».

Mais je veux montrer qu’un idéal, culturellement sous-déterminé, de participation à la prise de décision sociale conduit les féministes à se demander comment le pouvoir fonctionne réellement, dans différents domaines, au sein d’un contexte donné, au lieu de laisser des engagements missionnaires préalables fixer la réponse à l’avance.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

01.06.2026 à 17:39

Violences sexuelles : Comment croire les victimes d’hommes intégrés, appréciés ou séduisants ?

Texte intégral (2027 mots)

L’acteur et chanteur Patrick Bruel est accusé de violences sexuelles par une trentaine de femmes, et une douzaine de plaintes ont été déposées. Que se passe-t-il lorsque les mis en cause sont des hommes socialement intégrés ne correspondant pas à l’image stéréotypée du « violeur »? Face à un homme respecté ou apprécié, le soupçon peut spontanément se reporter sur la victime, analyse la chercheuse Alexane Guérin. Une situation qui n’est pas sans rapport avec le fait que 90 % des femmes agressées ne portent pas plainte.

Depuis presque une décennie, le mouvement #MeToo a révélé la lutte qui se joue autour de la crédibilité des femmes lorsqu’elles dénoncent des violences sexuelles. Face aux dénonciations publiques, les réactions prennent souvent la forme de formules devenues familières : « La présomption d’innocence doit prévaloir », « Laissons la justice faire son travail », « Tant qu’il n’y a pas eu de condamnation, on ne peut pas savoir. » Fréquemment mobilisées lorsqu’un homme est accusé publiquement de violences sexuelles, ces réactions traduisent l’idée qu’il existerait une instance neutre capable de départager objectivement les récits. Le tribunal apparaît alors comme le lieu privilégié de cette vérité attendue.

Pourtant, les analyses du traitement judiciaire des viols montrent combien ces dossiers mettent à l’épreuve le régime classique de la preuve. À cet égard un chiffre est particulièrement parlant : 94 % des plaintes pour viol sont classées sans suite. En effet, l’immense majorité des violences sexuelles sont commises dans l’intimité, par des hommes connus des victimes, sans recours à la violence physique. Dans ces situations de « viol ordinaire », les preuves matérielles permettant d’établir les faits sont rares. Face à deux récits qui s’opposent, seule la parole peut souvent faire preuve.

Or, nous ne recevons ni n’interprétons ces témoignages de manière neutre. Derrière l’impression d’un « parole contre parole » se déploie toute une économie de la crédibilité qui organise ce qui paraît plausible et intelligible, et ce qui ne l’est pas. Comme l’ont montré les théories féministes, certains récits bénéficient d’une confiance préalable tandis que d’autres sont immédiatement fragilisés par le soupçon. Longtemps considérées comme objets de connaissances plutôt que comme des sujets capables d’en produire, les femmes doivent ainsi se livrer à une bataille épistémique pour rendre audibles leurs expériences.

La crédibilité n’est donc pas distribuée de manière égale : elle circule selon des hiérarchies sociales, symboliques, culturelles et affectives qui façonnent notre perception de ce qu’est un « vrai viol », une « vraie victime » ou un « vrai violeur ». Les transformations apportées par le mouvement #MeToo coexistent avec des stéréotypes persistants : certaines femmes demeurent spontanément suspectes, tandis que certains hommes restent difficilement concevables comme auteurs de violences sexuelles.

Dès lors, les controverses suscitées par certaines accusations ne révèlent pas seulement les défis du judiciaire à établir la vérité. Elles mettent également au jour un enjeu de justice plus profond, qui se joue aussi et avant tout en dehors des tribunaux : comment une société distribue-t-elle la crédibilité lorsqu’elle est confrontée à des récits concurrents de violences sexuelles ? Quelle justice imaginer dans ces conditions d’inégalité structurantes ?

Les victimes de viol face au déficit de crédibilité

La reconnaissance du statut de victime repose sur des conditions sociales étroites : il n’est accordé que si la personne concernée a adopté un certain comportement avant, pendant et après le viol. Cet éthos de « victime idéale » rend suspect tout écart à la norme dominante, et génère ainsi un déficit de crédibilité structurel.

Prenons un exemple : une femme affirme avoir été violée par un homme qui lui plaisait, rencontré lors d’un rendez-vous. Après cette première nuit, ils se revoient quelques jours plus tard pour boire un verre. Plusieurs semaines après, ils recouchent ensemble. Elle parle des faits des années plus tard.

Face à un tel scénario, le soupçon surgit immédiatement sous la forme de questions qui semblent relever du « bon sens » : pourquoi aurait-elle revu l’homme qui l’a violée ? Pourquoi avoir de nouveau un rapport sexuel avec lui ? Pourquoi avoir attendu si longtemps avant d’en parler ?

Dans ces situations, puisque le moment du viol lui-même ne peut être observé, ce sont les comportements avant et après les faits qui deviennent l’objet principal de l’évaluation morale et sociale. Le problème est que ces questions contiennent leur propre réponse implicite. Puisque ce comportement paraît incompréhensible, des explications stéréotypées vont fournir une réponse efficace : cette femme ment, elle cherche de l’attention, elle cherche à se venger et veut nuire à la réputation de cet homme.

Pourtant, si l’on se place du point de vue de la personne concernée, une autre intelligibilité apparaît : cette femme savait que cette nuit-là avait été problématique, mais elle n’avait pas immédiatement les ressources pour qualifier ce qu’elle avait vécu comme un viol. Le fait d’avoir été contrainte par un homme qui lui plaisait, avec qui elle avait désiré partager une intimité, lui semblait incompatible avec l’idée même de viol. Nommer ce qui lui est arrivé a alors pris plusieurs années.

Les interprétations erronées de son comportement donnent alors lieu à des « injustices de témoignage » : cette femme n’est pas considérée comme crédible en raison de stéréotypes préjudiciables. Plus encore, elles affectent directement la possibilité même de parler : parce qu’elles anticipent le soupçon, de nombreuses victimes préfèrent se taire, retardent leur révélation ou minimisent la violence subie. Or, ce silence devient ensuite lui-même un motif de suspicion : avoir « trop attendu » semble confirmer l’idée que le récit manquerait de crédibilité. L’économie inégale de la crédibilité tend ainsi à se reproduire elle-même.

Les excès de crédibilité dont bénéficient certains hommes

Mais ce déficit de crédibilité accordé aux victimes doit être pensé à l’aune des excès de crédibilité dont bénéficient certains hommes accusés de violences sexuelles. Dans notre exemple, l’homme affirme quant à lui que tous les rapports étaient consentis. C’est un homme socialement intégré, apprécié, séduisant. Autrement dit, il ne correspond en rien à l’image stéréotypée du « violeur » : il n’est ni un inconnu surgissant dans une ruelle sombre, ni un prédateur monstrueux.

Or les représentations dominantes du viol continuent de reposer sur la figure du délinquant sexuel : un homme déviant et marginal, animé par une intention criminelle identifiable. Si ces stéréotypes persistent, c’est parce qu’un obstacle causal résiste : pourquoi un homme qui plaît aux femmes aurait-il besoin de violer ?

Cette question repose pourtant sur une compréhension erronée du viol : elle suppose qu’un viol est causé par un « besoin » sexuel. Autrement dit, que seuls les hommes qui se trouvent dans une certaine « misère sexuelle » ou frustration éprouveraient le « besoin » de violer. Or, le viol est avant tout un rapport de pouvoir : un homme prend le pouvoir en imposant un rapport sexuel à une femme. Dans une société patriarcale où les rapports de genre sont structurés par la domination, les hommes disposent d’une position de force dans l’intimité.

Tant que la figure du « violeur » s’imposera comme une identité stigmatisée, notre économie de la crédibilité continuera d’être inégalitaire.

Vers une justice de témoignage

Face à ces inégalités structurelles de crédibilité, une question se pose : comment penser une justice donnant véritablement crédit aux témoignages des victimes dans les situations de viol ordinaire ?

Les théories féministes invitent d’abord à considérer les victimes comme détentrices de « savoirs expérientiels » : des connaissances produites depuis leur propre vécu, qui permettent de rendre intelligibles des expériences que les catégories dominantes ou institutionnelles peinent à saisir. Les récits des victimes permettent, par exemple, de comprendre pourquoi certaines femmes poursuivent une relation avec l’homme qui les a violées, mettent plusieurs années à qualifier les faits ou modifient leur version par peur du soupçon. En ce sens, ces savoirs expérientiels fournissent de nouvelles ressources d’interprétation capables de contrebalancer les mythes et stéréotypes sur le viol, sur les victimes et sur les violeurs.

Il est donc nécessaire de prendre en compte les récits de violences sexuelles dans une autre logique que celle de la recherche de preuve matérielle, inhérente au système pénal.

Certaines pratiques de justice réparatrice cherchent précisément à construire des lieux qui se décentrent du paradigme probatoire : des espaces où les professionnel·les adoptent une posture d’écoute attentive, non jugeante et non directive. Contrairement à la procédure pénale, cette approche laisse les personnes concernées être les expertes de leur vécu, et explorer leurs attentes de justice. Cette écoute et cette reconnaissance peuvent être considérées en elles-mêmes comme réparatrices par les victimes. Les démarches peuvent être proposées en complément d’une procédure pénale ou indépendamment d’elle, sans s’y substituer.

Dans un contexte où plus de 90 % des victimes ne portent pas plainte, rendre accessibles des espaces de justice qui placent au centre l’écoute des personnes concernées constitue un enjeu majeur. Car la justice ne se joue pas uniquement dans les tribunaux : elle se joue aussi dans la manière dont une société accueille, interprète et reconnaît les récits de violences sexuelles.

Alexane Guérin est l’autrice de Viol ordinaire. Révéler un crime de l’intimité, Éditions du Seuil, 2026.

Alexane Guérin est co-directrice de l'association La Valise.

01.06.2026 à 10:44

Les salariés après 45 ans n’auraient plus de potentiel ? Pourquoi un plafond de verre freine encore la carrière des seniors

Texte intégral (1609 mots)

On connaît tous le plafond de verre qui empêche les femmes de progresser dans les entreprises. Un obstacle similaire existe pour les travailleurs plus âgés : le silver ceiling. Ce plafond fait référence aux barrières invisibles qui entravent injustement la mobilité ascendante des travailleurs plus âgés dans les entreprises.

Dans les années à venir, la France va devoir gérer un nombre croissant de travailleurs plus âgés. Les projections sur la population active montrent que le taux d’activité des travailleurs âgés de 55 à 64 ans devrait grimper à 68,9 % d’ici 2032 (contre 60,4 % en 2024), en partie à cause des discussions et débats sur la réforme des retraites.

Sans surprise, la gestion de carrière des travailleurs plus âgés est devenue une priorité pour le gouvernement français.

Notre étude souligne que ces travailleurs plus âgés risquent de se heurter à ce qu’on appelle le silver ceiling, ou plafond d’argent, une métaphore utilisée pour décrire le plafond qui bloque leur avancement dans les entreprises.

Ce plafond d’argent touche déjà les employés à partir de 45 ans. Or, à cet âge, la plupart des travailleurs ont encore près de 20 ans de carrière devant eux.

Moins de promotion

De nombreuses entreprises dans des secteurs comme la finance et le conseil déclarent suivre le principe de la méritocratie dans leurs décisions en matière de personnel et ressources humaines. Elles cherchent à distribuer des avantages et récompenses telles que des augmentations de salaire et des promotions en fonction des efforts, des compétences et des performances des employés.

Les chercheurs s’intéressent généralement aux différences dans les évaluations de performance pour expliquer les barrières structurelles auxquelles se heurtent les travailleurs plus âgés, les femmes et les minorités ethniques dans leur carrière. Souvent, les performances ne permettent pas d’expliquer (entièrement) pourquoi ces groupes ont systématiquement moins d’opportunités de carrière dans les organisations.

Nos données recueillies auprès de 842 personnes travaillant dans une grande organisation financière ont montré que, malgré des performances égales ou même supérieures, les travailleurs plus âgés avaient toujours moins de chances d’être promus l’année suivante.

Piège du potentiel

Pour repérer les futurs leaders, les grandes entreprises utilisent souvent des outils comme la « matrice à neuf cases » qui évalue les performances et le potentiel des travailleurs sur deux axes. Sur le premier, les managers évaluent les performances des travailleurs dans leur rôle actuel au cours de l’année écoulée ; sur l’autre axe, ils évaluent le potentiel des travailleurs à réussir dans des rôles de plus haut niveau, généralement sur une période future de un à cinq ans.

La différence de perspective temporelle (passé vs futur) est essentielle pour comprendre pourquoi les évaluations du potentiel créent un plafond de verre pour les travailleurs plus âgés, plus encore que les évaluations de performance. Contrairement à la performance, qui se base sur des activités concrètes passées, le potentiel est une prédiction de l’avenir qui est intrinsèquement incertain. Pour évaluer le potentiel, les managers doivent prendre des décisions avec des informations incomplètes.

Comment les stéréotypes s’installent

La théorie psychologique explique que, face à l’incertitude, le cerveau humain utilise des « heuristiques ». Il s’agit de raccourcis mentaux qui aident les gens à prendre des décisions rapides. Dans le contexte des évaluations du potentiel, l’âge sert de raccourci aux managers, ce qui permet aux stéréotypes liés à l’âge dans le monde du travail de s’installer.

À lire aussi : Les seniors au travail ne sont pas ceux que vous croyez. Et c’est aussi pour cela que la guerre des générations n’existe pas

Les managers associent souvent implicitement les jeunes travailleurs à des traits de caractère potentiels tels que l’ambition professionnelle et la capacité d’adaptation. À l’inverse, ils risquent de se fier à des stéréotypes négatifs liés à l’âge présentant (à tort) les travailleurs plus âgés comme moins ambitieux, moins disposés à s’adapter et à apprendre, et plus résistants au changement.

Nos expériences menées auprès de 627 travailleurs confirment ce biais. Lorsqu’on leur a présenté deux travailleurs identiques, l’un âgé de 28 ans et l’autre de 48 ans, les managers qui avaient des stéréotypes négatifs liés à l’âge ont systématiquement attribué des notes de potentiel plus faibles au travailleur de 48 ans. Cela s’est produit même si les performances et les traits liés au potentiel étaient les mêmes pour les deux travailleurs.

Effet boule de neige

Les notes de potentiel biaisées ont un effet boule de neige sur les systèmes de ressources humaines (RH). Lorsque les travailleurs plus âgés sont injustement étiquetés comme ayant un faible potentiel, ils risquent non seulement de se voir refuser l’accès à des promotions, mais aussi à d’autres opportunités de carrière telles que les programmes de développement des talents.

Ne pas reconnaître le potentiel des travailleurs plus âgés est une erreur stratégique. La main-d’œuvre vieillit partout dans le monde et beaucoup d’entreprises sont actuellement confrontées à une pénurie critique de talents. En écartant les travailleurs plus âgés des décisions relatives à leur carrière, les entreprises réduisent non seulement leur propre réserve de talents, mais risquent aussi de perdre l’engagement de leur personnel le plus expérimenté.

De plus, elles cèdent un avantage stratégique à leurs concurrents qui, eux, reconnaissent le potentiel inexploité des travailleurs plus âgés.

Comment briser ce plafond ?

Les préjugés à l’égard des travailleurs plus âgés dans les décisions de carrière ne sont pas inévitables. Nos recherches suggèrent que les entreprises peuvent libérer le potentiel des travailleurs plus âgés en apportant des changements à leurs systèmes d’évaluation.

Ce plafond a disparu dans nos expériences lorsque nous avons rendu les managers responsables de leurs évaluations. Lorsqu’ils ont su qu’ils devaient préciser comment ils évaluaient le potentiel des travailleurs, ils sont passés d’une réflexion heuristique (stéréotypée) à un traitement plus délibéré et systématique.

Sur la base de nos recherches, nous recommandons quatre pratiques pour briser ce plafond :

Intégrer la responsabilité

Demander aux managers de fournir des justifications (écrites) pour les évaluations de potentiel. Par exemple, leur demander d’expliquer exactement quelles informations ils ont utilisées pour juger le potentiel des travailleurs, comment celles-ci ont été pondérées et pourquoi.

Définir « le potentiel »

Éviter les définitions vagues du potentiel, et préciser le poste et l’horizon temporel que les managers doivent prendre en compte dans les évaluations. Par exemple, l’accent est-il mis sur les postes de direction, les postes techniques plus élevés ou les postes axés sur l’innovation stratégique ? Et le potentiel est-il évalué pour occuper un tel poste l’année suivante ou seulement dans les cinq ans ?

Utiliser des indicateurs concrets du potentiel

Au lieu d’utiliser un seul score (par exemple, comme dans la matrice à neuf cases), concentrez-vous sur la mesure des comportements observables. Par exemple, demandez aux managers d’évaluer la manière dont les employés réagissent aux nouveaux défis ou dont ils tirent les leçons de leurs échecs.

Surveiller les données

Vérifiez si les évaluations du potentiel diffèrent systématiquement selon les groupes d’âge afin de détecter les biais cachés.

En suivant ces recommandations, les organisations peuvent s’assurer que le potentiel n’est plus déterminé par l’âge et qu’il inclut toutes les générations.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

31.05.2026 à 12:13

À la tête du Conseil d’État, Marc Guillaume saura-t-il protéger nos droits et libertés ?

Texte intégral (1933 mots)

Avant son départ de l’Élysée, Emmanuel Macron place aux plus hauts sommets de l’État ses fidèles soutiens. Parmi eux, Marc Guillaume, ancien préfet de Paris, parfois critiqué pour avoir mis en place des actions restrictives à l'encontre des libertés publiques, vient d’être nommé vice-président du Conseil d’État. Or ce poste est crucial dans l’architecture de notre État de droit, rappellent la juriste Stéphanie Hennette-Vauchez et le politiste Antoine Vauchez.

C’est là un des attributs les plus décisifs de notre régime hyperprésidentialiste que de donner au chef de l’État le pouvoir de nomination de tous les sommets militaires, administratifs, juridictionnels et politiques de l’État.

Parmi celles récemment prononcées ou proposées, au sein de cette longue liste, à la présidence du Conseil constitutionnel (Richard Ferrand) et de la Cour des comptes (Amélie de Montchalin) ou au poste de gouverneur de la Banque de France (Emmanuel Moulin), on serait tenté de distinguer celle du vice-président du Conseil d’État (qui dirige cette institution puisqu’il n’existe pas de président), qui vient d’échoir à Marc Guillaume, jusqu’ici préfet de Paris.

Étonnamment, de toutes ces nominations, c’est celle qui semble avoir le moins frappé les esprits : la presse et les commentaires politiques louent sans ciller un « serviteur de l’État et du droit » hors pair, qui aurait à de multiples reprises démontré ses capacités de « gouvernant » – depuis la mise en place de la réforme de la question prioritaire de constitutionnalité (QPC) à sa contribution à la réussite de la cérémonie d’ouverture des Jeux olympiques (impressionnant jusque dans sa capacité à calculer la vitesse de croisière des péniches naviguant sur la Seine pour le défilé) !

Un poste au carrefour de toutes les politiques publiques

Or, tout indique que la position de vice-président du Conseil d’État n’est comparable à aucune autre. Elle se situe au carrefour de toutes les politiques publiques – là où se joue l’équilibre toujours précaire entre efficacité de l’action administrative et gouvernementale et respect – voire, garantie – de nos droits et libertés individuels et collectifs.

Cette position en ce lieu géométrique si sensible pour notre État de droit, le vice-président du Conseil d’État la tient d’abord du fait que c’est lui qui préside l’Assemblée du contentieux du Conseil d’État, la formation de jugement la plus solennelle de cette cour suprême de l’ordre administratif, celle-là même où se décident les plus « grands arrêts », ceux qui donnent le la des principales orientations de la jurisprudence du Palais-Royal.

Mais, bien au-delà des grandes orientations de la justice administrative, cette centralité de la fonction vice-présidentielle se lit aussi dans le rôle clé du Conseil d’État comme conseil du gouvernement. À ce titre, son rôle est de rappeler l’action gouvernementale et administrative au respect de la légalité, des engagements européens et internationaux et de la Constitution, au moyen des avis nombreux qu’il rend lorsqu’il est (obligatoirement) saisi de tous les projets de lois et de nombreux décrets.

À cela, s’ajoute une fonction d’orientation qui tient au fait que, par son rapport annuel comme par des études et des rapports thématiques, il produit « le grand récit de l’État » où l’institution, sous l’autorité de son vice-président, analyse ou appelle de ses vœux les grandes mutations de l’action publique, ses points cardinaux, ses nouveaux horizons et raisons d’être.

Reste une dernière clé, essentielle : le pouvoir de nomination du vice-président, appelé à disséminer les membres du Conseil d’État aux quatre coins de l’État.

On pense d’abord aux autorités administratives et qui, comme l’Arcom, la Cnil, le ou la défenseure des droits où sont toujours désignés, pour siéger dans les conseils et collèges, par le vice-président, des membres du Conseil d’État, et qui ont directement la garde du pluralisme, de nos données privées, ou du respect des droits fondamentaux.

On pense aussi aux nominations, nombreuses, dans tout cet espace d’autorités qui ont pour mission essentielle de « raisonner la raison d’État » : la Commission d’accès aux documents administratifs, la Commission nationale de contrôle des techniques de renseignement, la Commission du secret de la défense nationale, le référent national sur le traitement de données à caractère personnel…

On pense enfin à ces instances garantes du bon fonctionnement de notre démocratie, qu’il s’agisse de la probité de nos élus et des hauts fonctionnaires (Haute autorité pour la transparence de la vie publique, Agence française anticorruption) ou de la sincérité et de l’égalité des chances électorales (Commission des campagnes de campagne, Commission des sondages). Autant d’institutions et de commissions qui sont à l’origine de notre capacité à être et à demeurer une démocratie libérale (droits des usagers face à l’État, droits et libertés, sincérité des processus démocratiques).

Le caractère sensible de la position de vice-président du Conseil d’État se situe donc au point névralgique de l’État où se joue l’efficacité de toute l’action publique tout autant que la solidité et le niveau de protection de nos droits et des libertés.

Marc Guillaume, un parcours qui ressemble à celui de ses prédécesseurs

On pourra dire que le parcours du vice-président choisi par Emmanuel Macron ne dépareille en rien de ses prédécesseurs. Comme eux, il n’a en définitive qu’une très courte expérience de juge administratif de trois courtes années. Comme eux, il est avant tout un légiste d’État doté d’une solide expérience de la production de normes et de la sécurisation par le droit de la « force de gouverner ». Comme eux, il a épousé les grands moments de la vie administrative et politique de l’État au fil des deux décennies qui ont précédé sa nomination.

Pendant ses six années comme préfet de Paris, Marc Guillaume a ainsi assuré le suivi des Jeux olympiques et paralympiques de 2024, placés sous le signe du déploiement sans précédent des technologies de surveillance et des restrictions inédites à la liberté de circulation et au droit de manifester (loi du 13 mai 2023). Comme secrétaire général du gouvernement, entre 2015 et 2020, il aura accompagné la mise en œuvre de l’état d’urgence antiterroriste et la loi de sécurité intérieure et de lutte contre le terrorisme du 30 octobre 2017, prenant ainsi sa part à une dilatation inédite des pouvoirs de police administrative. Il aurait également soutenu l’hypothèse de la constitutionnalisation de la déchéance de nationalité qui a largement déstabilisé la présidence Hollande.

Au-delà de cette culture d’État à laquelle Marc Guillaume a été étroitement associé, il y a aussi un certain rapport à l’exercice du pouvoir d’un homme du sérail dont les comportements sont apparus problématiques. On mentionnera notamment la répétition de propos misogynes et sexistes dans ses fonctions de secrétaire général, qui a été pointée en 2018 par l’ensemble des conseillères de l’Élysée dans un courrier au secrétaire général de l’Élysée.

D’autres choix étaient-ils possibles ?

L’histoire longue des hommes ayant été nommés au poste de vice-président du Conseil d’État révèle que l’expérience de l’État compte parmi les critères essentiels de nomination. Mais cette expérience est plurielle, et celle de Marc Guillaume ne saurait être tenue pour la seule possible ou disponible. Le corps des conseillers d’État (environ 300 membres) est riche et divers ; et nombre d’entre eux ont ajouté à leur expérience de juge administratif suprême celle, souvent répétée, de diverses fonctions dans l’État.

À cet égard, il est possible de soulever la question des parcours alternatifs. On pense notamment à l’expérience de cet « État des droits » (Défenseur des droits, Commission information et libertés, etc.) chargé de faire vivre et de garantir l’effectivité des droits individuels et collectifs et d’une manière générale la qualité de notre État de droit.

Par ailleurs, il aurait certainement été possible de nommer une femme alors que la fonction de vice-président du Conseil d’État n’a jamais été confiée à une femme. Or, parmi les membres du Conseil d’État, plusieurs femmes pouvaient légitimement prétendre – en matière d’avancement dans la carrière, d’expérience et de responsabilités exercées – à une telle nomination.

En somme, ce n’est pas faire injure aux compétences de Marc Guillaume que de relever que son parcours est marqué par une capacité à faire marcher droit l’État plutôt que de jouer les contre-pouvoirs par un programme fort de garantie de nos droits et libertés ; ou encore d’incarner les nouveaux modèles d’exemplarité désormais attendus aux sommets de l’État.

Dans un contexte où nos droits et libertés sont particulièrement fragilisés, et alors même que se profile le risque d’une présidence Rassemblement national dont tout indique qu’elle s’appuiera à plein et amplifiera les pouvoirs de direction d’un exécutif déjà hypertrophié, on peut s’interroger sur les garanties et les risques que comporte le choix à ce point hypersensible de notre État de droit d’un conseiller d’État plus pétri de culture de gouvernement que de culture des droits.

La version longue de cet article est disponible sur le blog de Stéphanie Hennette-Vauchez et Antoine Vauchez.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

29.05.2026 à 11:18

Quels premiers ministres ont banalisé les idées d’extrême droite ?

Texte intégral (3388 mots)

La normalisation des idées d’extrême droite passe aussi par des partis considérés comme plus modérés. C’est ce que montre une enquête sur les déclarations de politique générale des premiers ministres depuis 1959. L’un des résultats les plus marquants est le rôle des chefs de gouvernements « centristes » (notamment Édouard Philippe, Jean Castex et Gabriel Attal) dans la diffusion des idées d’extrême droite.

« Victoire idéologique » : en janvier 2024, Marine Le Pen n’a pas hésité à qualifier ainsi la loi « Pour contrôler l’immigration, améliorer l’intégration », adoptée par le gouvernement Attal. Une année plus tard, François Bayrou, figure centriste de la majorité, s’inquiétait publiquement d’une « submersion » migratoire. Ces éléments de langage illustrent un phénomène plus large : les idées d’extrême droite, autrefois marginales, semblent avoir trouvé leur place dans les discours et les pratiques de responsables politiques qui ne lui sont pas traditionnellement affiliés.

Comment en est-on arrivé là ? Que révèle cette évolution sur la transformation du débat politique en France ?

Une méthode inédite : l’analyse automatisée des discours de politique générale

Pour répondre à cette question, nous avons analysé l’ensemble des déclarations de politique générale prononcées depuis 1959, soit trente discours au total. Ces textes, souvent longs et programmatiques, constituent un matériau unique : ils condensent les priorités du gouvernement lors de son entrée en fonction et fixent le cap politique devant l’Assemblée nationale. Autrement dit, ils offrent une photographie formelle et régulière de l’idéologie au sommet de l’État.

Afin de mesurer la présence d’idées d’extrême droite, nous avons construit un indicateur, le score idéologique d’extrême droite (Sied). Basé sur sept grandes dimensions que l’ont retrouve dans la plupart des définitions de l’extrême droite – nationalisme, anti-immigration, anti-démocratie, anti-progrès, autoritarisme, traditionalisme et anti-égalitarisme –, il permet de repérer, à l’aide d’outils de traitement automatique du langage, la part de ces idées dans chaque discours.

Des années 1970 à aujourd’hui : une progression continue

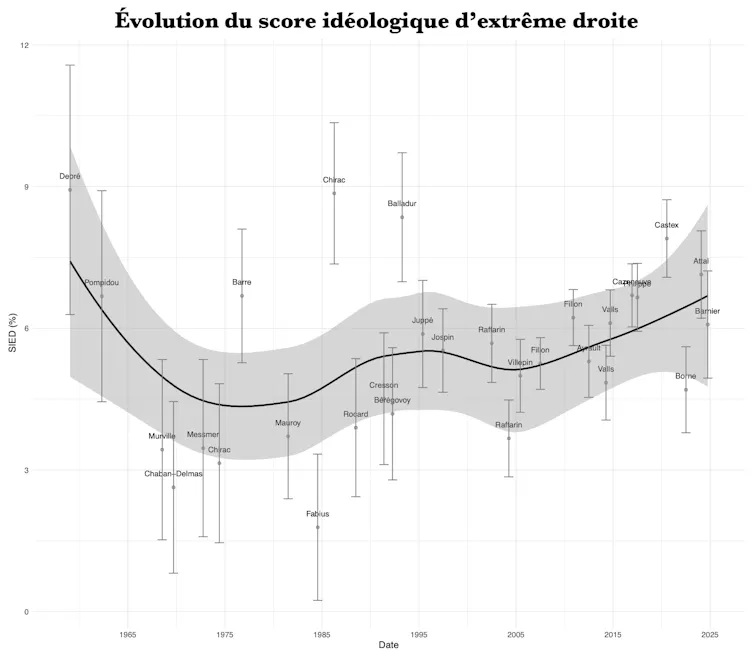

Les résultats sont sans équivoque : la part d’idées d’extrême droite dans les déclarations de politique générale progresse de manière continue depuis le milieu des années 1970, selon une dynamique de long terme qui dépasse largement les alternances partisanes (voir graphique). Après des niveaux élevés au début de la Vᵉ République – notamment sous Michel Debré et Georges Pompidou, dans le contexte de la guerre d’indépendance algérienne –, la courbe connaît un net reflux au cours des années 1970.

À partir de cette période, la tendance s’inverse durablement. Le score idéologique d’extrême droite augmente progressivement dans les années 1980 et 1990, marque un palier relatif au tournant des années 2000, puis repart nettement à la hausse à partir des années 2010. Les discours les plus récents atteignent ainsi des niveaux comparables à ceux observés dans les moments les plus conflictuels du début des années 1960, mais dans un contexte institutionnel bien plus stable que celui du début du régime.

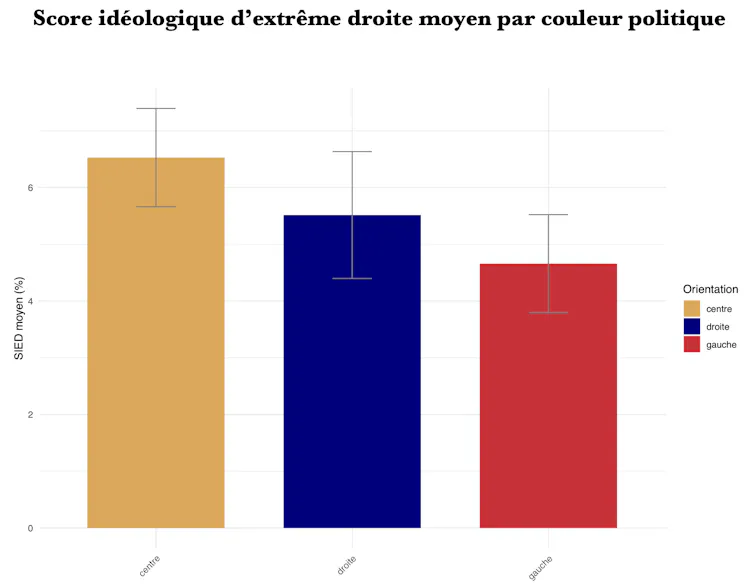

Notre étude montre que les idées d’extrême droite ne circulent pas seulement dans les partis qui s’en revendiquent. Des premiers ministres de droite, du centre et même de gauche ont, à des degrés divers, repris des expressions ou des cadrages caractéristiques de ce registre idéologique.

Ce phénomène n’a rien d’étonnant. Comme le rappelle le politologue américain Cas Mudde, l’extrême droite ne crée pas ex nihilo : elle radicalise des idées déjà présentes dans la société – l’attachement à la nation, la valorisation de l’ordre ou la méfiance envers l’égalité. La notion de nation en offre un bon exemple : elle peut être comprise de manière ouverte, comme un projet politique commun ou, au contraire, comme une communauté fermée, définie par la naissance ou la supposée appartenance raciale.

En valorisant ces interprétations exclusives, les premiers ministres ont, depuis les années 1970, contribué à estomper la frontière entre discours d’extrême droite et langage institutionnel. Le constat est d’autant plus frappant que les déclarations de politique générale – ces discours solennels où un chef de gouvernement présente son programme devant l’Assemblée nationale – sont réputées consensuelles, destinées à rassembler une majorité. Or, même dans ce cadre codifié, le lexique s’est déplacé : des termes autrefois impensables s’y sont imposés, élargissant peu à peu les limites du dicible.

Comprendre ces résultats avec la métapolitique

Traditionnellement, les chercheurs expliquent la diffusion des thèmes d’extrême droite par la cooptation électorale : des partis reprennent ponctuellement certains éléments du programme de leurs adversaires pour séduire leur électorat. Nicolas Sarkozy, par exemple, avait multiplié les références à l’« identité nationale », en 2007 et en 2012.

Mais nos résultats montrent que cette logique ne suffit pas. Même à des périodes où cette stratégie n’était pas payante électoralement, on observe une hausse du score idéologique d’extrême droite dans les discours de premiers ministres issus du centre ou de la gauche. Autrement dit, la diffusion ne résulte pas seulement d’un calcul stratégique : elle traduit un déplacement durable du langage politique.

C’est ici que le concept de « métapolitique » prend tout son sens.

Cette idée a été développée à l’extrême droite par la Nouvelle Droite, un courant intellectuel né en 1969 autour du think tank Groupement de recherche et d’études pour la civilisation européenne (Grece) qui avait pour ambition de réhabiliter une pensée réactionnaire voire fasciste à l’échelle européenne, après la Seconde Guerre mondiale. Pour cela, la métapolitique repose sur une idée simple : avant de prendre le pouvoir, il faut transformer la société et, pour cela, il faut réinventer les mots, les symboles et les cadres de pensée qui la structurent.

Autrement dit, il s’agit de façonner le sens commun pour le rendre plus perméable à ses idées plutôt que de convaincre directement sur la base d’un programme politique clairement identifiable. Une stratégie revendiquée par certains membres éminents de l’extrême droite française comme Marion Maréchal.

La notion de « fenêtre d’Overton » peut aider à comprendre un principe sous-jacent à la métapolitique. Une idée auparavant impensable peut devenir politiquement légitime si elle est régulièrement évoquée, débattue ou reformulée dans des termes plus neutres. Chaque fois qu’un responsable politique – même modéré – mobilise une rhétorique sécuritaire, anti-immigration ou anti-égalitaire, il contribue, volontairement ou non, à élargir cette fenêtre : ce qui paraissait extrême hier devient aujourd’hui une opinion ordinaire.

En modifiant les cadres symboliques et les associations de sens, des responsables politiques qui ne sont pas affiliés à l’extrême droite ont contribué – bon gré mal gré – à un processus métapolitique favorable à la diffusion de ses idées. Ce faisant, ils ont contribué à les faire entrer dans le langage du pouvoir, jusqu’à les rendre familières au-delà des acteurs qui s’en revendiquent traditionnellement.

Depuis 2017, la façon dont l’exécutif parle d’immigration, notamment en reprenant, encore plus que ne le fait Marine Le Pen, la métaphore du flux prêt à déborder en est un bon exemple.

Le centre : acteur clef de la diffusion des idées d’extrême droite

L’un des résultats les plus marquants de notre étude est le rôle du centre politique dans la diffusion des idées d’extrême droite. Les premiers ministres qui s’en réclament – et qui se présentent souvent comme des figures de modération – ont paradoxalement contribué à accélérer ce glissement vers l’extrémisme.

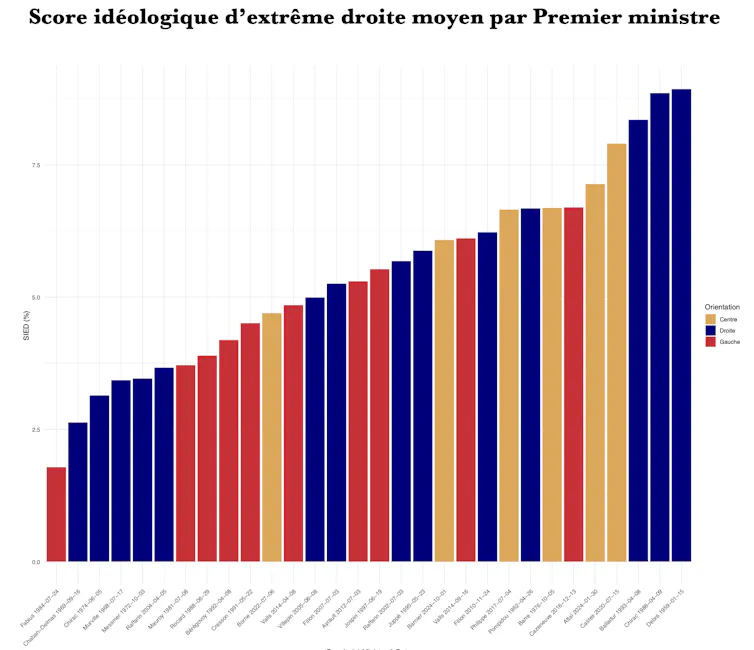

Si certains premiers ministres de droite (comme Michel Debré, Jacques Chirac ou Édouard Balladur) atteignent ponctuellement des score idéologique d’extrême droite (Sied) particulièrement élevés, d’autres sont plus bas (Jacques Chaban-Delmas, Maurice Couve de Murville ou Jean-Pierre Raffarin). La droite se caractérise ainsi par une dispersion interne sur le Sied qui laisse entrevoir l’intervention d’autres facteurs contextuels dans la mobilisation des idées d’extrême droite. Par exemple, la nomination de Jacques Chaban-Delmas est marquée par la volonté d’une ouverture aux sociaux-démocrates de Georges Pompidou. Cela se reflète par la très commentée « nouvelle société » dans le discours de Chaban-Delmas qui dénonce un pays de « castes » et des inégalités excessives.

À l’inverse, les premiers ministres issus du centre présentent des niveaux de Sied durablement élevés et relativement homogènes, en particulier dans la période récente (Édouard Philippe, Jean Castex et Gabriel Attal). L’écart maximal observé au sein du centre – entre Élisabeth Borne et Jean Castex – ne dépasse pas 3 points sur l’échelle du Sied, alors qu’il dépasse 8 points entre Jacques Chaban-Delmas et Michel Debré, les deux premiers ministres de droite aux scores les plus opposés.

Cette configuration se retrouve dans la distribution des scores : parmi les cinq premiers ministres affichant les Sied les plus élevés, on compte trois personnalités de droite et deux du centre, tandis que les cinq scores les plus faibles regroupent une personnalité de gauche et quatre de droite. Le centre occupe ainsi de manière plus constante le haut du spectre : à l’exception d’Élisabeth Borne, l’ensemble des premiers ministres centristes se situent au-dessus de la médiane, ce qui en fait un vecteur plus régulier de normalisation de ce registre idéologique.

Dans leurs déclarations de politique générale, plusieurs premiers ministres centristes mobilisent un lexique technocratique et sécuritaire convergeant.

Édouard Philippe évoque ainsi la « pression migratoire » et les « tensions » qu’elle ferait peser sur la cohésion nationale, dans une logique de gestion administrative des flux. Jean Castex appelle pour sa part à « rétablir l’autorité de l’État » face à une « coalition d’ennemis de la République » mêlant terrorisme, séparatisme et extrémisme. Gabriel Attal, enfin, recourt à de multiples reprises à la métaphore du « réarmement » – de l’État, de l’école ou des politiques publiques – inscrivant l’action gouvernementale dans un registre martial.

Pris ensemble, ces cadrages contribuent à installer durablement dans le langage du pouvoir des représentations historiquement associées à l’extrême droite, sous des formes euphémisées.

Normaliser l’extrême droite en se présentant comme seule voix de la raison

En cherchant à incarner la raison et le compromis, le centre a souvent repris les thèmes de l’extrême droite pour mieux les encadrer ou les « rationaliser ». Mais cette stratégie produit l’effet inverse : elle légitime ces thèmes en les inscrivant dans le langage gouvernemental.

En se définissant comme le pôle de la modération, le centre adopte une posture d’arbitre plutôt que de compétiteur dans le jeu démocratique. Or, tout en jouissant d’une position de force lorsqu’il est au pouvoir, le centre tend à renvoyer dos à dos l’extrême droite et la gauche. C’est une formule doublement gagnante pour l’extrême droite qui se voit normaliser (en devenant un extrême parmi d’autres) tandis que l’un de ses principaux adversaires se trouve diabolisé, la gauche étant désormais présentée comme extrémiste.

Cette dynamique ne se limite pas à des calculs électoraux ponctuels. Elle s’inscrit dans une transformation structurelle. Comme l’expliquent les économistes Julia Cagé et Thomas Piketty, l’expansion du centre, en affaiblissant les partis de gauche et de droite traditionnels, a contribué à polariser le champ politique. En se présentant comme « au-dessus des clivages » tout en mettant en œuvre des politiques largement alignées sur l’agenda de la droite (voire en reprenant certains de ses cadrages) le centre opère un déplacement du référentiel politique. Ce processus contribue à rendre discutables puis acceptables des thèmes et des diagnostics initialement portés par l’extrême droite.

Comme le rappelle l’historien Johann Chapoutot, cette tension entre libéralisme économique et réaction n’est pas nouvelle. Dans son dernier essai, il montre comment les élites libérales de la République de Weimar ont cru pouvoir canaliser les forces autoritaires en les intégrant au jeu institutionnel – avant d’en être les premières victimes. Le parallèle historique souligne la fragilité d’un centre qui, en voulant instrumentaliser l’extrême droite, finit parfois par lui ouvrir la voie.

Tristan Boursier a reçu des financements du Fonds de recherche du Québec (FRQ) et du Centre de recherche interdisciplinaire sur la diversité et la démocratie (CRIDAQ)

Antoine Lemor a reçu des financements du Fonds de recherche du Québec (FRQ).