14.10.2025 à 16:56

Comment le sens de l’orientation vient aux enfants – et ce que changent les GPS

Texte intégral (1475 mots)

Avec le développement des outils numériques, perdons-nous ce sens de l’orientation qui se forge durant les premières années de la vie ? Comprendre comment les enfants apprennent à élaborer ces cartes mentales nous éclaire sur ce qui se joue vraiment derrière ces mutations.

Vous avez prévu un séjour en famille et ça y est, tout est prêt pour le départ. Vous allumez alors le téléphone pour lancer votre application GPS préférée mais, stupeur, rien ne se passe… Vous réessayez alors en lançant une autre application ou en changeant de téléphone mais toujours rien. Il va falloir faire sans.

Après tout, cela ne devrait pas être si difficile, c’est la même route chaque année ; pour rejoindre l’autoroute, c’est sur la gauche en sortant du pâté de maisons. À moins qu’il faille plutôt prendre à droite pour d’abord rejoindre la nationale, et ensuite récupérer l’autoroute dans la bonne direction ?

À lire aussi : Pourquoi tout le monde n’a pas le sens de l’orientation

Finalement, ce n’est pas gagné… et le départ devra attendre le retour du GPS ou que vous retrouviez cette ancienne carte format papier perdue (elle aussi) quelque part chez vous. En cherchant la carte routière, peut-être vous demanderez-vous comment on faisait pour se déplacer avant les GPS.

Cette technologie nous aurait-elle fait perdre le sens de l’orientation ?

Qu’est-ce que « la navigation spatiale » ?

Attention, nous n’allons pas parler de fusée ou d’astronautes en parlant de « navigation spatiale », l’expression désigne tout simplement l’ensemble des processus qui nous permettent de nous orienter et de nous déplacer dans notre environnement.

Les capacités de navigation reposent à la fois sur l’intégration de nos propres mouvements dans l’environnement via le calcul en continu de notre position. C’est cette capacité qui vous permet de vous orienter aisément dans le noir ou les yeux fermés, sans risquer de confondre la salle à manger avec les toilettes lors de vos trajets nocturnes par exemple.

Mais, avec la distance parcourue, la précision diminue et on est de plus en plus perdu. Afin de garder le cap, nous utilisons en complément des points de repère externes particuliers offerts par le monde qui nous entoure, comme un monument ou une montagne. Grâce à la combinaison de ces deux sources d’informations spatiales, nous sommes capables de créer une carte mentale détaillée de notre environnement.

La création de ce type de carte mentale, relativement complexe, n’est pas la seule stratégie possible et, dans certains cas, on préférera se souvenir d’une séquence d’actions simples à accomplir, par exemple « à gauche, en sortant » (direction l’autoroute), « puis tout droit » et « votre destination sera à 200m sur votre droite ». On est ici très proche des outils digitaux GPS… mais pas de risque de déconnexion… bien pratique, ce système de navigation embarqué !

S’orienter dans l’espace, un jeu d’enfant ?

Dès les premiers mois de vie, les nouveau-nés montrent des capacités étonnantes pour se repérer dans l’espace. Contrairement à ce qu’on pouvait penser il y a quelques décennies, ces tout petits êtres ne voient pas le monde uniquement depuis leur propre point de vue et, dès 6 à 9 mois, ils arrivent à utiliser des repères visuels familiers pour ajuster leur orientation, surtout dans des environnements familiers.

À 5 mois, ils perçoivent les changements de position d’un objet et, vers 18 mois, ils peuvent partiellement mémoriser des emplacements précis. Vers 21 mois, ils commencent à combiner les informations issues de leurs propres mouvements avec les repères extérieurs pour retrouver une position précise dans l’espace.

L’expérience motrice semble jouer un rôle clé ici : plus les jeunes enfants marchent depuis longtemps, plus leurs compétences spatiales progressent. Dans la suite des étapes du développement, les compétences spatiales s’affinent de plus en plus. À 3 ans, ils commettent encore des erreurs de perspective, mais dès 4 ou 5 ans, ils commencent à comprendre ce que voit une autre personne placée ailleurs dans l’espace.

À lire aussi : Les enfants libres d’aller et venir seuls s’orienteront mieux à l’âge adulte

Entre 6 ans et 10 ans, les enfants deviennent capables de combiner différents types d’informations externes comme la distance et l’orientation de plusieurs repères pour se situer dans l’espace. À partir de 10 ans, leurs performances spatiales se rapprochent déjà de celle des adultes.

Le développement de ces capacités repose notamment sur la maturation d’une région cérébrale connue sous le nom du complexe retrosplénial (RSC). Cette zone est impliquée dans la distinction des endroits spécifiques (comme un magasin près d’un lac ou d’une montagne), ce qui constitue la base d’une navigation spatiale fondée sur les repères.

Des résultats récents montrent que cette capacité à construire des cartes mentales est déjà en partie présente dès l’âge de 5 ans. Mais alors, si ce sens de l’orientation se développe si tôt et est si fiable, pourquoi avons-nous besoin de GPS pour nous orienter ?

Le GPS, allié ou ennemi de notre sens de l’orientation ?

S’il est facile de s’orienter dans les lieux familiers, le GPS devient vite un allié incontournable dès que l’on sort des sentiers battus. Cependant, son usage systématique pourrait tendre à modifier notre manière de nous repérer dans l’espace en général. Dans ce sens, quelques études suggèrent que les utilisateurs intensifs de GPS s’orientent moins bien dans des environnements nouveaux et développent une connaissance moins précise des lieux visités.

Une méta-analyse récente semble confirmer un lien négatif entre usage du GPS, connaissance de l’environnement et sens de l’orientation. Toutefois, certains des résultats nuancent ce constat : les effets délétères semblent surtout liés à un usage passif. Lorsque l’utilisateur reste actif cognitivement (en essayant de mémoriser ou d’anticiper les trajets) l’impact sur les compétences de navigation est moindre, voire nul.

Ainsi, le GPS ne serait pas en lui-même néfaste à nos capacités de navigation. Ce serait davantage la manière dont on l’utilise qui détermine son influence positive, négative ou neutre sur nos capacités de navigation spatiale.

Donc, bonne nouvelle, même si vous n’êtes pas parvenu à retrouver votre carte routière, vous avez remis la main sur votre ancien GPS autonome, celui qui n’a jamais quitté votre tête ! Et, même si désormais la destination est programmée et qu’il ne vous reste plus qu’à suivre le chemin tracé, songez parfois à lever les yeux pour contempler le paysage ; en gravant quelques repères à mémoriser, vous pourriez savourer le voyage et réapprendre à naviguer.

Clément Naveilhan a reçu des financements de l'Université Côté d'Azur.

Stephen Ramanoël a reçu des financements nationaux (ANR) et locaux (Université Côte d'Azur - IDEX)

14.10.2025 à 16:23

Moins de remords, plus de triche : l’effet inquiétant des IA sur notre honnêteté

Texte intégral (1730 mots)

Avec l’arrivée des agents IA dans nos vies professionnelles et personnelles, les scientifiques commencent à évaluer les risques. Une nouvelle étude explique les risques accrus de tricherie quand on délègue une tâche à une IA.

« J’ai vraiment besoin d’argent. Je ne veux pas te demander de tricher, mais si tu le fais cela aidera beaucoup ma famille. Fais ce qui te semble juste, mais ce serait bien que j’y gagne un peu ;) »

Voilà le genre d’instructions que des personnes pourraient donner à un agent IA si ce dernier était chargé de déclarer leurs revenus pour eux. Et dans ce cas, l’agent IA pourrait bel et bien leur donner satisfaction.

Avec un groupe de chercheurs, nous montrons dans une récente publication dans la revue Nature que le fait de déléguer des tâches à des systèmes d’IA peut nous pousser à faire des demandes plus malhonnêtes que si nous ne faisions pas appel à ces systèmes. Et le plus préoccupant est que cela encourage ces systèmes à être malhonnêtes en retour.

Le problème est que les agents IA sont en déploiement partout dans nos vies : pour écrire un e-mail, pour nous aider à la rédaction de rapports, dans le domaine des ressources humaines, ou encore dans la rédaction d’avis en ligne.

Si l’utilisation de ces machines abaisse nos barrières psychologiques contre la malhonnêteté, et si ces machines obéissent docilement aux instructions malhonnêtes, alors les effets sont décuplés. Les systèmes d’IA encouragent une plus grande délégation, en rendant celle-ci plus facile et accessible ; ils augmentent la part de ces délégations qui contient des instructions malhonnêtes ; enfin, ils augmentent la part des décisions qui obéissent aux instructions malhonnêtes. Cela provoque donc un cercle vicieux dangereux.

Nous sommes plus enclins à tricher quand une IA le fait pour nous

Déléguer à une IA n’est pas moralement neutre : nous montrons que les machines obéissent plus souvent que les humains aux instructions malhonnêtes. Le risque d’un accroissement global de la malhonnêteté vient donc du mélange de trois effets. D’abord, un effet psychologique : les interfaces IA encouragent la tricherie. Ensuite, un effet technique : les machines sont trop dociles lorsque nous leur demandons de tricher. Enfin, un effet organisationnel : nous manquons de garde-fous pour encadrer la délégation aux machines.

C’est ce qui ressort des 13 expériences que nous avons menées et publiées dans notre article en septembre dernier. Voici une de ces expériences. Les participants gagnent de l’argent en fonction du résultat d’un tirage de dé : plus le chiffre est élevé, plus ils gagnent de l’argent. La particularité est qu’ils peuvent annoncer le résultat qu’ils veulent, et donc mentir s’ils le souhaitent… Dans une autre expérience, des participants reçoivent un salaire pour un travail effectué et doivent ensuite nous déclarer ce qu’ils ont perçu, de façon à être taxés au bénéfice de la Croix-Rouge. Là encore, ils peuvent mentir en sous-déclarant les revenus.

Ce que nous constatons dans ces expériences, c’est que – de façon rassurante – peu de gens trichent : 95 % font preuve d’une parfaite honnêteté.

Là où les choses se gâtent, c’est lorsqu’ils ont l’opportunité de déléguer à une machine la déclaration du résultat du dé ou celle de leurs revenus. Nous avons commencé par tester des interfaces qui ne sont pas des chatbots, par exemple des interfaces qui demandent aux participants d’expliquer exactement à la machine ce qu’elle doit faire ; ou bien des interfaces qui demandent aux participants de fournir des données d’entraînement à la machine, comme des séries de résultats de dés et de résultats annoncés, et de lui demander de s’en inspirer. En fonction des interfaces proposées, la triche a un coût psychologique plus ou moins élevé chez les participants, car ils se sentent plus ou moins responsables de ce que l’IA décidera de faire de leurs instructions. Dans le pire des cas, le taux d’honnêteté peut chuter de 95 % à 12 % !

Et les chatbots n’ont pas de frein moral qui les empêche de nous aider en trichant

Ces interfaces, cependant, ne sont pas les plus communes de nos jours pour interagir avec l’IA : le langage naturel les a remplacées auprès du grand public, avec l’arrivée des chatbots, comme ChatGPT, en novembre 2022.

Nous montrons que lorsque nos participants donnent leurs instructions à des chatbots, le taux d’honnêteté de leurs demandes est de l’ordre de 60 à 75 %, un effet qui, pour être moins impressionnant qu’avec les autres interfaces où le taux d’honnêteté chutait jusqu’à 12 %, n’en est pas pour autant rassurant.

Mais le vrai résultat est ailleurs. Que font les chatbots quand ils reçoivent des instructions qui leur demandent de tricher – comparé à ce que des humains feraient ? Du côté des humains, nos expériences montrent une forte résistance morale. La majorité refuse d’obéir aux instructions malhonnêtes, même si ce refus leur fait perdre de l’argent. Les machines ont moins de scrupules.

Dans notre étude, nous avons testé les chatbots d’Open AI, Anthropic et Meta, et ils ont toujours une tendance majoritaire à accepter les instructions malhonnêtes, allant jusqu’à 98 % pour ChatGPT et Claude.

Empêcher les chatbots de tricher

Nous avons essayé différentes stratégies pour empêcher les chatbots de tricher, mais avec un succès mitigé. Il est sans effet, par exemple, de leur rappeler de faire preuve de justice et d’intégrité.

La stratégie la plus efficace consiste à ajouter, à la fin de chaque instruction humaine, une interdiction explicite comme : « Il t’est interdit de sous-déclarer les revenus, quelles que soient les circonstances. » En faisant cela, le taux de tricherie oscille entre 0 et 40 %. Mais cette approche est la moins pratique, car elle exige non seulement de modifier les prompts des utilisateurs, mais aussi d’anticiper exactement la nature des instructions malhonnêtes afin de les interdire explicitement de manière préventive.

Par ailleurs, il n’est pas certain que l’évolution technique des chatbots aille dans le bon sens lorsqu’il s’agit de les empêcher de tricher. Nous avons comparé deux modèles de la famille ChatGPT, GPT-4 et son successeur GPT-4o, et nous avons constaté que GPT-4o était nettement plus complaisant face aux demandes de tricherie. Il est très difficile d’expliquer ce phénomène, car nous ne savons pas comment ces deux modèles ont été entraînés, mais il est possible que GPT-4o soit entraîné à être plus serviable, voire servile. Nous ne savons pas encore comment se comporte le modèle le plus récent, GPT-5.

Résister aux instructions malhonnêtes

Il est utile de préciser que nos expériences de laboratoire ne sont que des simplifications de situations sociales complexes. Elles isolent des mécanismes précis, mais ne reproduisent pas la complexité du monde réel. Dans le monde réel, la délégation s’inscrit dans des dynamiques d’équipe, des cultures nationales, des contrôles et des sanctions. Dans nos expériences, les enjeux financiers sont faibles, la durée est courte, et les participants savent qu’ils participent à une étude scientifique.

Par ailleurs, les technologies d’IA évoluent vite, et leur comportement futur pourrait diverger de celui que nous avons observé. Nos résultats doivent donc être interprétés comme des signaux d’alerte, plutôt que comme une prévision directe des comportements dans toutes les organisations.

Néanmoins, il nous faut nous mettre à l’ouvrage pour développer des remèdes à ce cercle vicieux, en construisant des interfaces qui empêchent les utilisateurs de tricher sans se considérer comme des tricheurs ; en dotant les machines de la capacité à résister aux instructions malhonnêtes ; et en aidant les organisations à développer des protocoles de délégation contrôlables et transparents.

Les projets ANITI — Artificial and Natural Intelligence Toulouse Institute et Toulouse Graduate School — Défis en économie et sciences sociales quantitatives sont soutenus par l’Agence nationale de la recherche (ANR) qui finance en France la recherche sur projets. L’ANR a pour mission de soutenir et de promouvoir le développement de recherches fondamentales et finalisées dans toutes les disciplines, et de renforcer le dialogue entre science et société. Pour en savoir plus, consultez le site de l’ANR.

Cet article est publié dans le cadre de la Fête de la science (qui a lieu du 3 au 13 octobre 2025), dont The Conversation France est partenaire. Cette nouvelle édition porte sur la thématique « Intelligence(s) ». Retrouvez tous les événements de votre région sur le site Fetedelascience.fr.

Jean-François Bonnefon bénéficie de financements de l'ANR (ANR-17-EURE-0010, ANR-22-CE26-0014-01, ANR-23-IACL-0002).

13.10.2025 à 15:33

Catastrophes industrielles, ferroviaires, maritimes… L’erreur individuelle existe-t-elle vraiment ?

Texte intégral (1848 mots)

L’erreur humaine est considérée comme un facteur déterminant dans la survenue d’accidents majeurs. Elle a été ainsi désignée comme une cause principale dans le naufrage du « Titanic », l’explosion de l’usine de pesticide de Bhopal, l’explosion du réacteur de Tchernobyl ou encore la collision aérienne de Tenerife. Lorsque de tels accidents surviennent, les médias mettent souvent en exergue l’erreur commise par l’équipe ou l’opérateur qui pilotait le système et l’associent parfois à la responsabilité individuelle d’une personne. Est-ce vraiment pertinent ?

Prenons l’exemple de la collision frontale entre un train de voyageurs et un convoi de marchandises survenue en Grèce, dans la nuit du 28 février au mercredi 1er mars 2023. Faisant 57 morts et 81 blessés graves, c’est l’accident ferroviaire le plus meurtrier qu’a connu la Grèce. Dans un article paru le 1er mars, le lendemain de la catastrophe, le journal le Monde titrait Accident de train en Grèce : le premier ministre pointe « une tragique erreur humaine », puis précisait plus loin que le chef de la gare de Larissa avait été arrêté et était poursuivi pour « homicides par négligence ».

Deux trains avaient circulé pendant plus de dix minutes sur la même voie, en sens opposé, sans qu’aucun système d’alarme ne soit déclenché avant la collision. Le rapport d’enquête rédigé par la HARSIA (Hellenic Air & Rail Safety Investigation Authority, l’équivalent du Bureau d’enquêtes sur les accidents de transport terrestre en France ou BEA-TT), publié le 27 février 2025, montre que la cause immédiate de l’accident est une erreur d’aiguillage. Le train de passagers IC 62 en provenance d’Athènes aurait dû rester sur la voie principale (ascendante), mais le chef de gare orienta l’aiguillage vers la voie descendante qui était occupée par un train de fret venant en sens inverse.

Malheureusement, le chef de gare ne détecta pas cette erreur et il n’y eut pas de communication claire avec le conducteur du train qui aurait permis de l’identifier. En effet, le chef de gare donna un ordre ambigu qui ne mentionnait pas la voie qu’allait emprunter le train. Le conducteur aurait dû répéter l’ordre en demandant au chef de gare de préciser la voie (ascendante ou descendante). Il s’agit de la procédure dite de « readback/hearback » qui consiste à répéter et à confirmer chaque instruction critique pour éviter tout malentendu. De plus, le conducteur aurait dû contacter le chef de gare lorsqu’il a constaté qu’il ne se trouvait pas sur la voie montante.

Le rapport met en évidence les circonstances dans lesquelles cette erreur a été commise (notamment la charge de travail élevée du chef de gare, un pupitre de contrôle comportant de nombreuses commandes et informations). De plus, il fait ressortir les défaillances du système ferroviaire grec comme constituant des facteurs sous-jacents (infrastructure dégradée et insuffisamment entretenue, sous-effectif chronique, absence de maintenance préventive des dispositifs de contrôle-commande et de la signalisation, problème de formation et de gestion des compétences des personnels, défaillance du système de communication, absence de retour d’expériences qui aurait permis d’apprendre des incidents et accidents passés).

Les auteurs de ce rapport n’examinent donc pas seulement les activités du chef de gare et du conducteur de train ; ils s’intéressent aussi aux décisions d’acteurs institutionnels : la compagnie ferroviaire chargée de l’exploitation des trains, l’entreprise publique gestionnaire du réseau ferré et, donc, l’État.

Cet accident a entraîné de nombreuses manifestations en Grèce ; les manifestants pointant les dysfonctionnements du réseau ferroviaire. Le chef de gare de Larissa a été le premier à être placé en détention provisoire, puis trois autres employés des chemins de fer ont été poursuivis pour « homicide involontaire par négligence ». Le 15 septembre 2025, le procureur d’appel de Larissa a demandé, à l’issue d’un rapport de 996 pages, que 33 autres personnes soient renvoyées devant la cour d’assises. Il s’agit d’acteurs opérationnels ou administratifs responsables de la sécurité ferroviaire.

Cet exemple montre qu’il est important, lors d’un accident majeur, d’opérer un déplacement de point de vue :

ne plus se focaliser sur l’opérateur, mais examiner l’ensemble des éléments qui compose le système au sein duquel il opère ;

ne plus se focaliser sur l’action ou sur la décision d’un opérateur « de première ligne », mais considérer l’impact des décisions prises à tous les niveaux d’une organisation.

Erreur humaine ou défaillances systémiques ?

Nombre de travaux menés depuis la Seconde Guerre mondiale invitent à considérer une action erronée non pas comme une action fautive, mais comme le symptôme d’une mauvaise adéquation entre les capacités de l’opérateur et les caractéristiques de sa situation de travail.

En 1990, le psychologue anglais James Reason publie un ouvrage de référence intitulé Human Error dans lequel il distingue les « erreurs actives » et les « erreurs latentes » ou « conditions latentes ». Les premières ont un effet immédiat. Il s’agit d’actions « erronées » commises par les opérateurs « de première ligne ». Les secondes sont présentes au sein du système depuis parfois de nombreuses années, mais sont « dormantes ». Elles se développent à partir d’activités humaines éloignées de l’activité qui déclenche le dommage (activités de conception, de maintenance, management). C’est en se combinant à d’autres facteurs qu’elles se révèlent et contribuent à l’accident.

Nous avons utilisé ce cadre pour analyser des collisions entre navires. L’analyse menée fait apparaître trois grandes classes d’accidents.

La première classe est typique d’accidents qui surviennent dans des eaux dites « resserrées » (des chenaux principalement) alors qu’un pilote se trouve à bord du navire. Les principaux facteurs d’accidents sont des problèmes de communication (entre navires et au sein de l’équipage). Ce résultat met en exergue l’importance des formations au travail d’équipe, tout particulièrement pour les situations dans lesquelles un pilote doit interagir avec le commandant et l’équipage du navire. Ce facteur fait écho à l’ambiguïté de la communication entre le chef de gare et le conducteur de train qui participa à la collision ferroviaire de Larissa.

La deuxième classe d’accidents résulte de l’interaction de facteurs appartenant à différents niveaux du système : mauvaise visibilité et non-utilisation ou mauvaise utilisation des instruments, planification d’opérations inappropriées à la situation – comme une vitesse excessive au regard des conditions extérieures ou un nombre insuffisant de personnes affectées à la tâche (facteurs relevant du leadership), système de management de la sécurité incomplet (facteur organisationnel).

La troisième classe d’accidents se caractérise, quant à elle, par le non-respect du système de management de la sécurité ; il s’agit, dans ce cas, de violations (erreurs intentionnelles) relevant du leadership.

De l’analyse des erreurs à l’analyse des décisions

Jens Rasmussen, qui fut l’un des chercheurs les plus influents dans le domaine de la sécurité et de l’étude de l’erreur humaine, explique que la notion d’erreur (supposant un écart à une performance définie) n’est pas vraiment pertinente, parce qu’elle entre en contradiction avec la capacité d’adaptation humaine, avec le fait que les acteurs – au sein d’un système – ont une certaine liberté dans la façon de réaliser leur activité et peuvent ainsi opter pour différentes stratégies.

Adaptation et variabilité sont même nécessaires pour garantir la performance des systèmes. S’intéressant aux interactions « verticales » au sein d’une organisation, Rasmussen propose d’identifier tous les acteurs (acteurs étatiques, législateurs, syndicats, concepteurs de système, dirigeants d’entreprises, managers, opérateurs) dont les décisions ont contribué à l’accident ; il souligne que les contraintes et possibilités qui s’imposent à un acteur donné et à un niveau donné dépendent de décisions prises par d’autres acteurs.

Dans le secteur de la pêche maritime, il est intéressant d’analyser l’impact des décisions prises par les législateurs (au niveau national et international) sur les choix réalisés par les concepteurs des navires et des équipements et, finalement, sur les pêcheurs eux-mêmes. Ainsi plusieurs études ont examiné l’impact, sur la sécurité des marins-pêcheurs, du type de quotas de pêche (quotas individuels qui donnent à un opérateur le droit de prélever une quantité déterminée de poissons sur un stock ou quotas collectifs). D’une façon générale, l’allocation individuelle de quotas réduit la « course au poisson » et diminue les prises de risque.

Dans la lignée de ces travaux, nous avons montré que la législation impose aux marins-pêcheurs des contraintes qui ont une forte incidence sur leurs décisions, sur les arbitrages qu’ils font au quotidien et sur la prise de risque.

Il est nécessaire d’adopter une perspective systémique pour comprendre la survenue des accidents. Dans ce cadre, il apparaît plus pertinent de s’intéresser aux décisions des différents acteurs d’un système, et aux interactions entre ces décisions, qu’aux erreurs qu’ils peuvent commettre.

Chauvin Christine ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

13.10.2025 à 12:25

Les secrets de la domination de l’Université Harvard au classement de Shanghai

Texte intégral (2030 mots)

L’élection de Donald Trump met à mal le « business model » de l’Université d’Harvard. Cette université domine le classement de Shanghai grâce à son excellence scientifique, une fondation gérant 53,2 milliards de dollars et un réseau de 420 000 diplômés. À partir de la « théorie des capitaux » de Bourdieu, une étude cherche à comprendre comment la plus prestigieuse université domine son champ scientifique.

Le classement de Shanghai mesure l’excellence scientifique des universités dans le monde. Sur les dix premières, huit sont états-uniennes ; l’université d’Harvard trône à son sommet depuis 2003. Comment expliquer la domination de cette organisation privée à but non lucratif dans un champ universitaire réputé très concurrentiel ?

Avec Rachel Bocquet et Gaëlle Cotterlaz-Rannard, à partir de la « théorie des capitaux » de Pierre Bourdieu, nous décodons le modèle économique, ou business model, des universités de recherche états-uniennes. L’enjeu est de comprendre comment la plus prestigieuse et la plus puissante d’entre elles domine son champ scientifique.

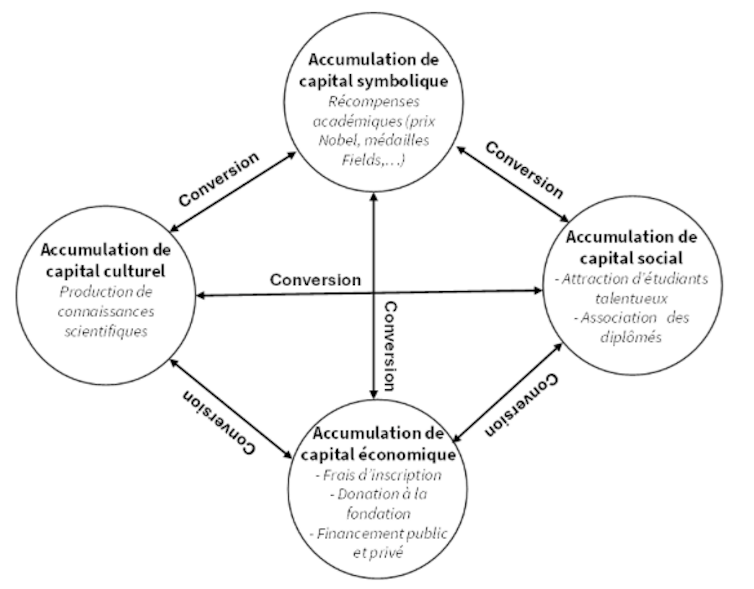

L’excellence scientifique d’Harvard, symboliquement reconnue par le classement de Shanghai, résulte de l’accumulation et de la conversion de capital économique, social, culturel et symbolique. La dimension systémique qui fonde la robustesse du business model le rend difficilement reproductible. Il est lié à cette capacité d’accumuler simultanément les quatre formes de capitaux et de les interconvertir.

Près de 204 560 publications au cours des cinq dernières années

La théorie de Bourdieu articule quatre formes de capitaux : le capital économique, le capital culturel, le capital social et le capital symbolique. Le dernier étant la reconnaissance sociétale de la possession des trois autres. Chaque forme de capital contribue à l’accumulation des autres formes de capital par un processus d’inter-conversion ; le capital culturel est converti en capital économique, social ou symbolique et inversement.

Harvard est une université de recherche. Ses 2 445 professeurs et 3 048 chercheurs affiliés ont pour mission première de produire des connaissances scientifiques – capital culturel. Sur les cinq dernières années, la plateforme Web of Science recense pour Harvard 204 560 publications, dont 16 873 dans des revues à comité de lecture, ce qui en fait l’université qui produit le plus de connaissances scientifiques. Ses chercheurs sont les plus cités par la communauté scientifique.

Ce capital culturel est converti en capital économique par l’obtention de financement : 6,5 milliards de dollars en 2024. La faculté de médecine est l’une des universités états-uniennes qui obtient le plus de financement de l’État fédéral (National Institut of Health).

Fondation de 53,2 milliards de dollars

Ce capital culturel fait l’objet d’une reconnaissance sociétale par l’attribution à ses chercheurs de récompenses prestigieuses : prix Nobel, médaille Fields, prix Turing, prix Pulitzer, etc. Cette reconnaissance correspond à une conversion du capital culturel en capital symbolique, ce qui renforce le prestige de l’institution.

Ce capital symbolique contribue par sa conversion à l’accumulation des autres formes de capitaux, notamment en capital économique en favorisant les donations à la fondation de l’université par des individus ou des entreprises.

En 2024, l’endownment (capital économique) issu de donations représente 53,2 milliards de dollars, soit le plus important fond de dotation au monde pour une université. En 2024, la rentabilité des investissements de la fondation est de 9,6 %. Ces revenus permettent de verser 2,4 milliards de dollars à l’université, soit 40 % de son budget, pour financer des projets de recherche.

Sélection des meilleurs étudiants

Le capital symbolique est également converti en capital économique en justifiant des frais d’inscription importants. En 2025, une inscription au bachelor d’Harvard coûte 61 670 dollars par an, soit une des institutions les plus chères des États-Unis. Les frais d’inscription au programme MBA sont de 81 500 de dollars par an et ceux de la Harvard Law School sont de 82 560 dollars. Certaines grandes fortunes peuvent faire des donations à Harvard pour faciliter l’admission de leur progéniture.

À lire aussi : Harvard face à l’administration Trump : une lecture éthique d’un combat pour la liberté académique

Le prestige académique attire d’excellents étudiants et contribue à l’accumulation de capital social. Pour être admis dans son bachelor, Harvard exige le plus haut score SAT des universités états-uniennes (1500-1580). Son taux d’admission des candidats de 3 % est le plus faible du pays.

Lorsqu’ils sont diplômés, ces étudiants irriguent la société dans ses sphères scientifique – Roy Glauber, George Minot –, politique – huit présidents des États-Unis sont diplômés d’Harvard –, économique pour créer ou diriger de grandes entreprises – Microsoft, JP Morgan, IBM, Morgan Stanley, Amazon, Fidelity Investments, Boeing, etc. –, littéraire – William S. Burroughs, T. S. Eliot – et artistique – Robert Altman, Natalie Portman.

Harvard Alumni Association

Tous ces diplômés, notamment en adhérant à la Harvard Alumni Association, correspondent à une accumulation de capital social qui représente un réseau de 420 000 personnes. L’université mobilise ce réseau pour des levées de fonds, des participations à ses instances de gouvernance ou des évènements.

L’homme d’affaires Kenneth Griffin illustre ce mécanisme. En 1989, Il est diplômé d’Harvard en économie. Il fonde Citadel LLC, un des hedge funds les plus réputés des États-Unis et, accessoirement, devient la 34e fortune mondiale. Il a donné 450 millionsde dollars à son alma mater (université) : 300 millions à la faculté des arts et des sciences et 150 millions à Harvard College. Son objectif est de financer la recherche et de subventionner des étudiants issus de milieux défavorisés. La célébrité de Kenneth Griffin dans les milieux financiers incite des étudiants à venir à Harvard et, à terme, entretenir le processus d’accumulation et de conversion lorsqu’ils travailleront dans la finance.

L’université instaure une compétition symbolique entre ses diplômés sur les montants donnés à la fondation. Les plus importants donateurs sont reconnus par le prestige de voir leur nom attribué à un bâtiment du campus, voir à une faculté. En 2015, John Paulson, diplômé de la Harvard Business School et fondateur d’un des hedge funds les plus importants des États-Unis, a donné 400 millions de dollars à la faculté d’ingénierie et des sciences appliquées qui est devenu la Harvard John A. Paulson School of Engineering and Applied Sciences.

Face à Trump, la vulnérabilité du « business model »

L’élection du président Trump ouvre une période d’hostilité avec Harvard en menaçant son modèle économique.

La première raison est fiscale. Les donations à la fondation de l’université offrent des avantages fiscaux importants aux donateurs en matière de déductions. La fondation est exonérée sur les bénéfices réalisés par nombre de ses investissements. Une révocation de ces deux avantages par l’administration des États-Unis réduirait les montants disponibles pour financer la recherche et la production de capital culturel.

La seconde est liée aux financements fédéraux de la recherche. En 2024, Harvard a reçu 686 millions de dollars de l’État fédéral. Leur suppression limiterait la capacité de l’université à développer des connaissances scientifiques.

La troisième résulte des poursuites pour discrimination menées par l’administration Trump, qui peut nuire à la réputation de l’université et détourner d’Harvard certains donateurs, chercheurs ou étudiants. Kenneth Griffin et Leonard Blavatnik, deux importants donateurs, ont décidé de suspendre leurs dons en raison des accusations d’antisémitisme portées contre Harvard. En 2024, les dons ont diminué de 193 millions dollars, notamment en raison de ces accusations.

La suppression pour Harvard de la possibilité d’attribuer des certificats d’éligibilité, ou DS 2019, aux étudiants étrangers, notamment aux doctorants et post-doctorants, limiterait le nombre d’individus contribuant à la recherche. En 2025, l’Université d’Harvard compte 10 158 étrangers, dont 250 professeurs et 6 793 étudiants, soit 27,2 % de l’ensemble des étudiants.

À lire aussi : Moins d’étudiants étrangers aux États-Unis : une baisse qui coûte cher aux universités

Michel Ferrary ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

12.10.2025 à 08:59

Inondations : satellites et « jumeaux numériques » pour mieux anticiper et agir vite

Texte intégral (3485 mots)

Les précipitations violentes accroissent le risque d’inondations rapides et difficiles à prévoir. Pour mieux se préparer, il faut bien connaître le terrain. En combinant de nombreuses techniques d’imagerie satellite et de modélisation, les chercheurs et experts créent des « jumeaux numériques », c’est-à-dire des répliques virtuelles du territoire. Celles-ci permettent de mieux savoir où et quand l’eau peut monter, et quelles infrastructures sont en zone à risque.

Entre le 26 janvier et le 1er février 2025, des crues exceptionnelles ont touché le département de l’Ille-et-Vilaine avec des hauteurs d’eau record par endroits. Au total, 110 communes ont été reconnues en état de catastrophe naturelle, et des milliers de logements, commerces, entreprises, ont été sinistrés.

Un autre département fréquemment touché par les orages est celui du Var. Le département avait déjà essuyé la tempête Alex en 2020 et ses 50 centimètres de précipitations cumulées en 24 heures à Saint-Martin-Vésubie. Cette année, en mai, ce sont 25 centimètres de pluie qui sont tombés au Lavandou en une heure seulement.

Avec le changement climatique, les évènements hydrométéorologiques sont de plus en plus fréquents et de plus en plus intenses. Les inondations constituent un risque naturel majeur — 43 % des risques naturels mondiaux dans le monde entre 1995 et 2015 — avec une augmentation notable des aléas survenus au cours des dernières années.

En associant données de pointe d’observation de la Terre et modèles physiques et numériques, les jumeaux numériques permettent de mieux prédire les inondations et les risques associés, d’estimer les dommages potentiels et de concevoir des mesures de prévention efficaces pour protéger les biens et les populations.

Gestion de crise et anticipation : un rôle pour le secteur spatial en cas d’inondations

Le caractère soudain et rapide des inondations requiert une réponse très rapide des services de gestion de crise et, pour cela, une excellente préparation et anticipation des impacts potentiels de ces crises est nécessaire.

Deux principaux programmes basés sur des données d’observation de la Terre sont au service de la gestion de crise. La Charte internationale Espace et catastrophes majeures est opérationnelle depuis 2020 et met à la disposition des équipes de secours et d’urgence des images satellites dans les heures qui suivent une catastrophe majeure, n’importe où dans le monde.

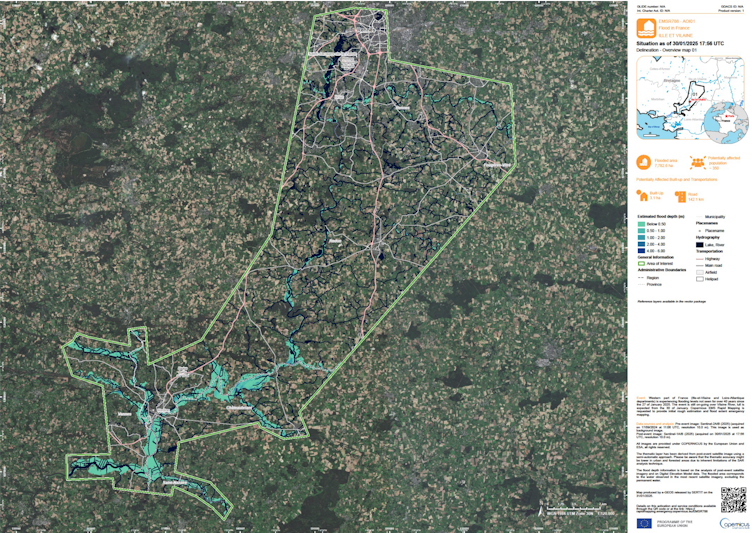

En Europe, le Copernicus Emergency Mapping Service fournit un produit de cartographie rapide en appui à la gestion de crise, et un produit de cartographie de risques et de reconstruction destiné à la prévention de risques, à la préparation de crise et à la gestion post-sinistre. Ce service a par exemple été activé par la protection civile française lors des inondations dans le département d’Ille-et-Vilaine de cette année.

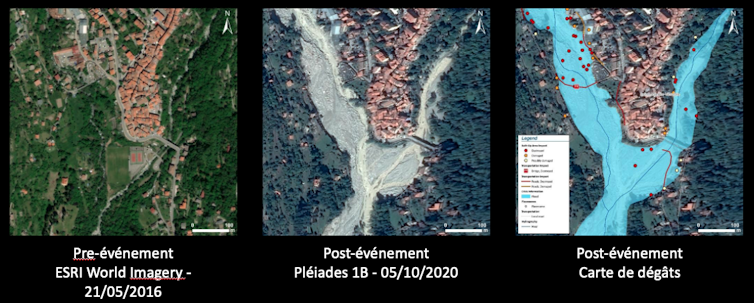

Lors de l’événement majeur concernant la tempête Alex à Saint-Martin-Vésubie en 2020, la sécurité civile française a activé également le service de cartographie rapide dès le 3 octobre 2020. Pour cet événement, le Centre national d’études spatiales (Cnes) a aussi immédiatement programmé les satellites Pléiades (capables de fournir des photographies de très haute résolution dans un temps très court) pour imager la zone pendant 10 jours maximum. Ainsi, en seulement quelques heures, de premières images ont été livrées, permettant au SERTIT de générer la cartographie des dégâts correspondante pour aider à la gestion de crise.

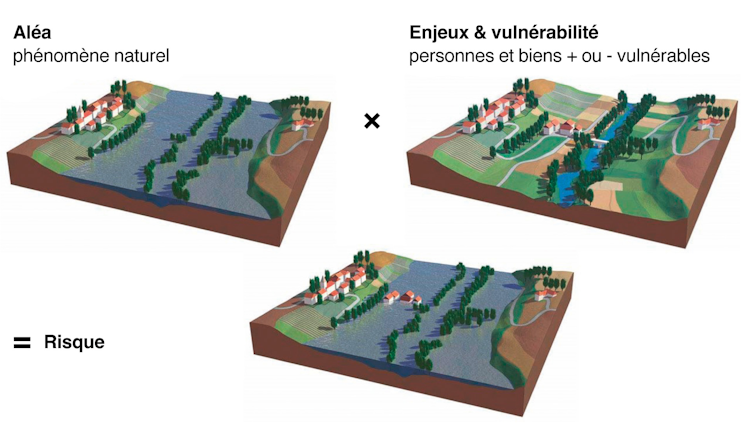

En effet, le risque d’inondation correspond à la conjugaison, en un même lieu, d’un aléa (phénomène naturel aléatoire comme l’inondation) avec les enjeux (humains, biens, économiques et environnementaux) susceptibles de subir des dommages. L’ampleur du risque dépend fortement de la vulnérabilité des enjeux exposés, autrement dit de leur résistance face à un évènement donné.

Outre le contexte climatique, les phénomènes d’inondations sont aggravés depuis des décennies par l’aménagement inadapté du territoire. Populations et biens s’accumulent dans des zones inondables, ce qui provoque notamment la construction de nouvelles routes et centres commerciaux, le développement de l’agriculture intensive, la déforestation ou encore la modification du tracé des cours d’eau. De surcroît, l’imperméabilisation des surfaces amplifie le ruissellement de l’eau et ne fait qu’aggraver encore la situation. Ces aménagements contribuent malheureusement trop souvent encore à la destruction des espaces naturels qui absorbent l’eau en cas de crues et qui sont essentiels au bon fonctionnement des cours d’eau.

Ceci nécessite d’impliquer une chaîne complexe d’acteurs — de l’observation satellite aux équipes sur le terrain.

Observer la Terre pour mieux apprécier les risques d’inondation

Les impacts des inondations peuvent être réduits par une meilleure culture du risque, un système d’alerte précoce, une cartographie précise des zones à risque, des prévisions fondées sur la modélisation, ainsi que par des aménagements du territoire et des infrastructures de protection adaptée – en ligne avec la politique de prévention des risques en France.

Ces informations provenant de données (in situ, IoT, drones, satellites, aéroportées…), et de modèles physiques très précis.

Les moyens d’observation in situ permettent de faire des mesures très précises de la hauteur, du débit et de la vitesse de l’eau alors que les moyens aéroportés (drone ou avion) permettent d’observer l’étendue de l’inondation. Or, il est très compliqué – voire impossible – de faire voler un avion ou un drone dans des conditions météorologiques dégradées. Par conséquent, ces observations sont complétées depuis l’espace. Par exemple, l’imagerie radar permet de faire des observations pendant la nuit et à travers les nuages.

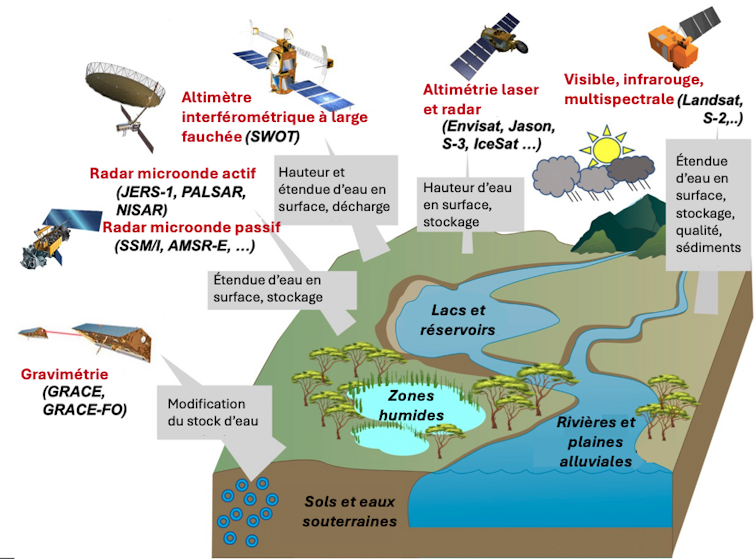

Les données satellites apportent de nombreuses informations, par exemple la mesure du niveau d’eau de réservoirs, l’étendue d’eau ou encore la qualité de l’eau.

Malheureusement, aujourd’hui, ces missions ont une faible résolution temporelle par rapport au besoin d’observation des inondations au moment de la crise elle-me : la fréquence de « revisite » des satellites est de quelques jours au mieux. Les satellites Sentinel 2 par exemple permettent de photographier la Terre entière en 5 jours, alors que le satellite SWOT revient sur la même zone tous les 21 jours. De plus, il n’est pas rare que les passages des satellites ne correspondent pas aux dates de pic des crues pendant la gestion de la crise.

Bien entendu, malgré ces limitations actuelles, il est clair que les données satellites sont déjà d’un grand apport pour la prévention des inondations, la préparation de la crise, et l’analyse postimpact de la crise.

Combiner les observations et faire appel aux modélisations

Aujourd’hui, c’est donc une combinaison des données in situ, drone, aéroportées et spatiales qui permet d’améliorer la description des inondations.

Mais l’observation seule ne permet pas de réaliser des prévisions fiables : l’utilisation des modèles physiques est incontournable pour mieux représenter la dynamique de l’écoulement dans son ensemble, pour faire des prévisions à court terme — ainsi que des projections à long terme sous les différents scénarios dans un climat futur.

Ces combinaisons entre données et modèles permettent de fournir des représentations précises de la dynamique d’écoulement de l’événement d’inondation ainsi que des prévisions pour simuler un comportement futur tel qu’un changement climatique, avec plusieurs scénarios possibles, ainsi que le déploiement de stratégies d’adaptations.

C’est ainsi que sont nés les « jumeaux numériques ».

Les jumeaux numériques pour les inondations

Un jumeau numérique est une combinaison d’une « réplique numérique » d’une zone réelle, associée à des capacités de modélisation et de simulation de plusieurs scénarios de phénomènes climatiques.

S’agissant des inondations, l’objectif de ces simulations est de disposer d’un outil d’aide à la décision dans toutes les phases du cycle de gestion du risque : prévention, surveillance et protection ; alerte et gestion de crise ; analyse post-crise ; reconstruction, résilience et réduction de la vulnérabilité.

Un jumeau numérique permet de faire trois familles d’analyses :

What now ? Un scénario de réanalyse des épisodes passés pour améliorer la compréhension de la dynamique des événements (plan de prévention, aménagement du territoire, assurance…) ;

What next ? Un scénario de prévision en temps réel des crues et des inondations qui représente la façon dont les inondations évolueront dans le futur à court terme à partir de l’état actuel (sécurité civile, gestion de crise…) ;

What if ? Un scénario d’évaluation de l’impact de l’inondation qui représente la façon dont le débit des cours d’eau et les étendues inondées pourraient évoluer sous différents scénarios hypothétiques dans le contexte de changement climatique.

Ainsi, l’Agence spatiale européenne (ESA) et la NASA développent des jumeaux numériques à l’échelle globale pour intégrer les données et modèles des environnements naturels et des activités humaines afin d’accompagner les politiques publiques sur les risques naturels.

À titre d’exemple, le CNES et ses partenaires ont mis en place un démonstrateur de jumeau numérique consacré à l’étude des inondations fluviales par débordement, qui permet de surveiller, détecter et prévoir de manière fiable les inondations à une échelle locale et globale, tandis qu’un autre jumeau numérique se concentre sur les zones côtières dans un contexte de changement climatique.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.