01.11.2025 à 15:19

Au Royaume-Uni, l'influence cachée des militaires derrière le nouvel engouement pour les petits réacteurs nucléaires

Texte intégral (2172 mots)

Outre-Manche, les petits réacteurs modulaires sont présentés comme une solution énergétique, mais servent d'abord les besoins stratégiques des armées. En subventionnant le nucléaire civil, citoyens et consommateurs financent indirectement la puissance militaire.

La récente visite de Donald Trump au Royaume-Uni a donné lieu à un «partenariat historique» sur l'énergie nucléaire. Londres et Washington ont annoncé leur intention de construire 20 petits réacteurs modulaires et de développer également la technologie des microréacteurs – et ce alors qu'aucune de ces installations n'a encore été construite commercialement nulle part dans le monde.

Le premier ministre britannique, Keir Starmer, a promis que ces projets inaugureraient un «âge d'or» du nucléaire qui permettrait aussi de «faire baisser les factures». Pourtant, l'histoire de l'énergie nucléaire est faite de décennies de surenchère, de coûts faramineux et de retards à répétition. Partout dans le monde, les tendances vont dans la mauvaise direction.

Alors pourquoi un tel regain d'enthousiasme pour le nucléaire ? Les véritables raisons tiennent moins à la sécurité énergétique ou au changement climatique – et bien davantage à la puissance militaire.

À première vue, l'argument semble évident. Les partisans du nucléaire présentent les petits réacteurs modulaires, ou SMR, comme indispensables pour réduire les émissions et répondre à une demande croissante d'électricité, alimentée par les voitures et les centres de données. Les grandes centrales nucléaires étant désormais devenues trop coûteuses, les réacteurs de taille réduite sont promus comme une alternative enthousiasmante.

Mais aujourd'hui, même les analyses les plus optimistes de l'industrie reconnaissent que le nucléaire – y compris les SMR – a peu de chances de rivaliser avec les énergies renouvelables. Une étude publiée plus tôt cette année dans le New Civil Engineer concluait que les SMR sont «la source d'électricité la plus coûteuse par kilowatt produit, comparée au gaz naturel, au nucléaire traditionnel et aux renouvelables».

Des évaluations indépendantes – notamment celle de l'ex-pro-nucléaire Royal Society – montrent que des systèmes 100 % renouvelables surpassent tout système incluant du nucléaire en termes de coût, de flexibilité et de sécurité. Cela contribue à expliquer pourquoi des analyses statistiques mondiales révèlent que l'énergie nucléaire n'est généralement pas associée à une réduction des émissions de carbone, contrairement aux renouvelables.

En partie, l'enthousiasme pour les SMR s'explique par le fait que les voix institutionnelles les plus audibles ont souvent un mandat ou des intérêts pronucléaires : il s'agit de l'industrie elle-même et de ses fournisseurs, des agences nucléaires et des gouvernements dotés de programmes militaires nucléaires bien ancrés. Pour ces acteurs, la seule question est de savoir quels types de réacteurs développer, et à quelle vitesse. Ils ne se demandent pas s'il faut construire des réacteurs en premier lieu : la nécessité est considérée comme une évidence.

Au moins, les grandes centrales nucléaires ont bénéficié d'économies d'échelle et de décennies d'optimisation technologique. Beaucoup de conceptions de SMR ne sont encore que des «réacteurs PowerPoint», existant uniquement sous forme de diapositives et d'études de faisabilité. Les affirmations selon lesquelles ces projets non réalisés «coûteront moins cher» relèvent au mieux de la spéculation.

Les marchés financiers le savent. Si les investisseurs considèrent la frénésie autour des SMR comme une occasion de profiter de milliards de subventions publiques, leurs propres analyses se montrent nettement moins enthousiastes quant à la technologie elle-même.

Alors pourquoi, dès lors, un tel intérêt pour le nucléaire en général et pour les réacteurs de petite taille en particulier ? Il est évident que quelque chose d'autre se joue derrière cette mise en avant.

Le lien caché

Le facteur négligé est la dépendance des programmes militaires vis-à-vis des industries nucléaires civiles. Le maintien d'une marine nucléaire ou d'un arsenal nucléaire exige un accès constant à des technologies de réacteurs génériques, à une main-d'œuvre hautement qualifiée et à des matériaux spécifiques. Sans industrie nucléaire civile, les capacités militaires nucléaires deviennent beaucoup plus difficiles et coûteuses à entretenir.

Les sous-marins nucléaires occupent une place particulièrement centrale, car ils nécessiteraient très probablement l'existence d'industries nationales de réacteurs et de leurs chaînes d'approvisionnement même en l'absence d'un programme nucléaire civil. Déjà difficilement abordables pris individuellement, les sous-marins nucléaires deviennent encore plus coûteux si l'on prend en compte l'ensemble de cette «base industrielle sous-marine».

Rolls-Royce constitue un maillon essentiel de cette chaîne : l'entreprise construit déjà les réacteurs des sous-marins britanniques et doit produire les SMR civils récemment annoncés. Elle déclarait d'ailleurs ouvertement en 2017 qu'un programme de SMR civils permettrait de «décharger le ministère de la Défense du fardeau que représente le développement et le maintien des compétences et des capacités».

Ici, comme le soulignait Nuclear Intelligence Weekly en 2020, le programme de SMR de Rolls-Royce entretient une importante «symbiose avec les besoins militaires du Royaume-Uni». C'est cette dépendance qui permet aux coûts militaires (selon les termes d'un ancien dirigeant du constructeur de sous-marins BAE Systems) d'être «masqués» derrière des programmes civils.

En finançant les projets nucléaires civils, les contribuables et les consommateurs prennent en charge les usages militaires de l'énergie nucléaire par le biais de subventions et de factures plus élevées – sans que ces dépenses supplémentaires apparaissent dans les budgets de la défense.

Lorsque le gouvernement britannique nous a financés pour évaluer l'ampleur de ce transfert, nous l'avons estimé à environ 5 milliards de livres par an rien qu'au Royaume-Uni. Ces coûts échappent à la vue du public, car ils sont absorbés par les recettes provenant de factures d'électricité plus élevées et par les budgets d'agences gouvernementales supposément civiles.

Il ne s'agit pas d'un complot, mais plutôt d'une sorte de champ gravitationnel politique. Dès lors que les gouvernements considèrent l'arme nucléaire comme un marqueur de statut mondial, les financements et le soutien politique s'auto-entretiennent. Il en résulte une étrange forme de circularité : l'énergie nucléaire est justifiée par des arguments de sécurité énergétique et de coûts qui ne tiennent pas la route, mais elle est en réalité maintenue pour des raisons stratégiques qui demeurent inavouées.

Un schéma mondial

Le Royaume-Uni n'a rien d'exceptionnel, même si d'autres puissances nucléaires se montrent beaucoup plus franches. Le secrétaire américain à l'énergie, Chris Wright, a ainsi décrit l'accord nucléaire entre les États-Unis et le Royaume-Uni comme essentiel pour «sécuriser les chaînes d'approvisionnement nucléaires à travers l'Atlantique». Chaque année, environ 25 milliards de dollars (18,7 milliards de livres) transitent ainsi du nucléaire civil vers le nucléaire militaire aux États-Unis.

La Russie et la Chine sont elles aussi assez transparentes sur leurs liens indissociables entre civil et militaire. Le président français Emmanuel Macron l'a dit sans détour : «Sans nucléaire civil, pas de nucléaire militaire ; sans nucléaire militaire, pas de nucléaire civil».

Dans ces pays, les capacités nucléaires militaires sont perçues comme un moyen de rester à la «table des grands». Mettre fin à leur programme civil menacerait non seulement l'emploi et l'approvisionnement énergétique, mais aussi leur statut de grande puissance.

La prochaine frontière

Au-delà des sous-marins, le développement des «microréacteurs» ouvre de nouveaux usages militaires pour l'énergie nucléaire. Les microréacteurs sont encore plus petits et plus expérimentaux que les SMR. Bien qu'ils puissent tirer des profits en exploitant les budgets d'achats militaires, ils n'ont aucun sens d'un point de vue commercial pour l'énergie. Cependant, les microréacteurs sont considérés comme essentiels dans les plans américains pour l'alimentation sur le champ de bataille, les infrastructures spatiales et de nouvelles armes à haute puissance énergétique. Préparez-vous à les voir occuper une place croissante dans les débats «civils» – précisément parce qu'ils servent des objectifs militaires.

Quel que soit le regard porté sur ces évolutions militaires, il n'a aucun sens de prétendre qu'elles n'ont aucun lien avec le secteur nucléaire civil. Les véritables moteurs du récent accord nucléaire entre les États-Unis et le Royaume-Uni résident dans la projection de puissance militaire, et non dans la production civile d'électricité. Pourtant, cet aspect demeure absent de la plupart des débats sur la politique énergétique.

Il s'agit pourtant d'un enjeu démocratique essentiel : il faut de la transparence sur ce qui se joue réellement.

Phil Johnstone est professeur invité à l’Université de Tartu, chercheur postdoctoral à l’Université d’Utrecht et chercheur associé à l’Université du Sussex. Il est membre bénévole du Sussex Energy Group et du Nuclear Consultation Group, parrain du Nuclear Information Service, et siège au comité consultatif du Medact Nuclear Weapons group. Avec Andy Stirling, il a auparavant reçu des financements du Foreign, Commonwealth and Development Office (FCDO) du Royaume-Uni pour des recherches qui sous-tendent certaines des analyses présentées dans ce blog.

Andy Stirling est professeur émérite à l’Université du Sussex. Parmi ses nombreuses fonctions passées de conseil auprès de gouvernements et d’organisations intergouvernementales, il siège actuellement au sous-comité de sociologie du Research Excellence Framework 2029 du Royaume-Uni et au Conseil de recherche de l’Institut canadien de recherches avancées. Il est membre bénévole du Sussex Energy Group et du Nuclear Consultation Group, parrain du Nuclear Information Service et du Nuclear Education Trust, ainsi qu’administrateur de Greenpeace UK. Il a exercé en 2022-2023 comme expert-conseil pour l’évaluation officielle par le gouvernement britannique du programme d’innovation nucléaire du DESNZ et, avec Phil Johnstone, a reçu des financements du Foreign, Commonwealth and Development Office (FCDO) du Royaume-Uni pour des recherches qui sous-tendent certaines des analyses présentées dans ce blog.

01.11.2025 à 15:18

Pourquoi le missile nucléaire russe Bourevestnik change les règles du jeu militaire

Texte intégral (1936 mots)

Le président russe Vladimir Poutine, vêtu d’un uniforme militaire, a annoncé le 26 octobre 2025 que la Russie avait testé avec succès un missile à propulsion nucléaire. Si cette information est avérée, une telle arme pourrait conférer à la Russie une capacité militaire unique, aux répercussions politiques plus larges.

Le missile, appelé Bourevestnik, aurait été testé avec succès au-dessus de l'océan Arctique après des années de développement et plusieurs vols d'essai initiaux, dont l'un a entraîné la mort de cinq scientifiques nucléaires.

Je suis ingénieur et j’étudie les systèmes de défense. Voici comment ces armes fonctionnent, les avantages qu'elles présentent par rapport aux systèmes de missiles conventionnels, et leur potentiel à perturber la stabilité stratégique mondiale.

Missiles à propulsion conventionnelle

Les missiles sont utilisés par les forces armées du monde entier depuis des siècles et se déclinent en une grande variété de modèles, caractérisés par leur mission, leur portée et leur vitesse. Ils servent à endommager et détruire une large gamme de cibles, notamment des installations terrestres comme des bases, des centres de commandement et des infrastructures enterrées en profondeur ; des navires ; des aéronefs ; et potentiellement des engins spatiaux. Ces armes sont lancées depuis le sol par l’armée de terre, depuis la mer par des bâtiments de la marine, et depuis les airs par des chasseurs et des bombardiers.

Les missiles peuvent être tactiques, avec des portées relativement courtes de moins de 800 km, ou stratégiques, avec des portées de plusieurs milliers de kilomètres. On distingue trois grandes catégories de missiles : balistiques, de croisière et hypersoniques.

Les missiles balistiques sont propulsés par des moteurs fusées. Après l’extinction de la poussée, le missile décrit un arc prévisible qui l’emmène hors de l’atmosphère, dans l’espace, puis de nouveau dans l’atmosphère en direction de sa cible.

Les missiles de croisière disposent d’un moteur additionnel qui s’allume après l’extinction de la fusée, permettant au missile de parcourir des trajectoires programmées, typiquement à basse altitude. Ces moteurs fonctionnent grâce à un mélange chimique ou à un carburant solide.

Les missiles hypersoniques volent à des vitesses supérieures à celle du son, mais pas aussi rapides que les missiles balistiques intercontinentaux (ICBM). Ils sont lancés par de plus petites fusées qui les maintiennent dans les couches supérieures de l’atmosphère. Le planeur hypersonique est propulsé jusqu’à une altitude élevée puis glisse vers sa cible en manœuvrant en cours de route. Le missile de croisière hypersonique, lui, est propulsé jusqu’à une vitesse hypersonique, puis utilise un moteur à air appelé scramjet pour maintenir cette vitesse.

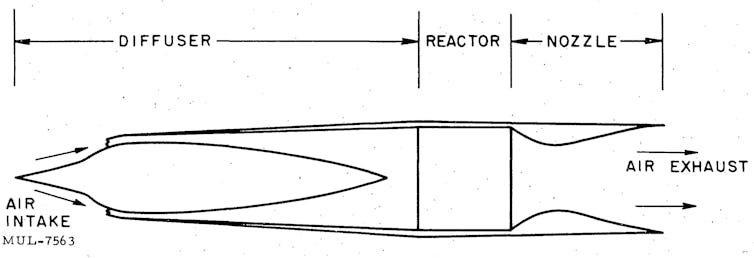

Comment fonctionnent les missiles à propulsion nucléaire

Les missiles à propulsion nucléaire sont une variante de missile de croisière. Les conceptions reposent généralement sur une forme de scramjet. Un système nucléaire thermique utilise la fission du combustible nucléaire pour ajouter de l’énergie à un flux d’air qui est ensuite accéléré dans une tuyère pour générer de la poussée. De cette manière, la fission du matériau nucléaire remplace la combustion chimique des moteurs de croisière traditionnels.

La densité d’énergie — la quantité d’énergie libérée par unité de masse de combustible — fournie par la fission nucléaire est des millions de fois supérieure à celle des propergols chimiques. Cette caractéristique signifie qu’une quantité relativement faible de combustible fissile peut propulser un missile pendant des périodes bien plus longues que ne le permettent les propergols chimiques.

Les États-Unis ont étudié le développement d’un missile à propulsion nucléaire dans les années 1960. Le programme, Project Pluto, a été abandonné en raison des progrès rapides réalisés à la même époque sur les ICBM, ainsi que des inquiétudes liées à la contamination environnementale associée aux systèmes nucléaires.

Avantages du vol à propulsion nucléaire

L’avantage principal des missiles à propulsion nucléaire réside dans l’énergie supplémentaire qu’ils génèrent, leur permettant de voler plus loin, plus longtemps, plus vite et plus bas dans l’atmosphère, tout en exécutant une large gamme de manœuvres. Pour ces raisons, ils représentent un défi considérable pour les meilleurs systèmes de défense antimissile.

L’armée russe affirme que le missile Bourevestnik a parcouru 8 700 miles à basse altitude sur une période de 15 heures. À titre de comparaison, un vol commercial entre San Francisco et Boston couvre 2 700 miles en six heures. Bien que le Bourevestnik ne vole pas particulièrement vite pour un missile, il est probablement manœuvrable, ce qui le rend difficile à intercepter.

Contraintes liées à l’utilisation de l’énergie nucléaire

L’immense quantité d’énergie libérée par la fission constitue le principal défi technique du développement de ces missiles. Ces niveaux d’énergie très élevés exigent des matériaux capables de résister à des températures atteignant plusieurs milliers de degrés Celsius, afin d’empêcher le missile de se détruire lui-même.

Sur le plan de la sécurité, la technologie nucléaire a trouvé des applications très limitées dans l’espace en raison des risques de contamination radioactive en cas d’incident, comme un lancement raté. Les mêmes inquiétudes s’appliquent à une arme à propulsion nucléaire.

De plus, de tels systèmes doivent pouvoir rester sûrs pendant de longues années avant leur utilisation. Une attaque ennemie contre une installation de stockage contenant des armes à propulsion nucléaire pourrait entraîner une fuite radioactive massive.

Le Bourevestnik russe et la stabilité mondiale

Le nouveau missile russe Bourevestnik est en développement depuis plus de vingt ans. Bien que peu de détails techniques soient connus, les responsables russes affirment qu’il peut manœuvrer afin de contourner les systèmes antimissiles et de défense aérienne.

Les armes nucléaires ont constitué la base de la dissuasion mutuelle entre l’Union soviétique et les États-Unis pendant la guerre froide. Les deux camps comprenaient qu’une première frappe de l’un entraînerait une riposte tout aussi dévastatrice de l’autre. La peur d’une destruction totale maintenait ainsi un équilibre pacifique.

Plusieurs évolutions menacent l’équilibre actuel des forces : l’amélioration des systèmes de défense antimissile, comme le Golden Dome prévu par les États-Unis, et les progrès réalisés dans les missiles hautement manœuvrables. Les systèmes de défense antimissile pourraient bloquer une frappe nucléaire, tandis que les missiles manœuvrant à basse altitude pourraient atteindre leur cible sans avertissement.

Ainsi, si une grande partie des réactions à l’annonce par la Russie de son nouveau missile à propulsion nucléaire s’est concentrée sur la difficulté de s’en défendre, la préoccupation majeure réside sans doute dans son potentiel à bouleverser complètement la stabilité stratégique mondiale.

Iain Boyd a reçu des financements du département américain de la Défense.

01.11.2025 à 10:04

Ce que la taille de votre signature révèle vraiment de vous

Texte intégral (1674 mots)

Et si la taille de votre signature trahissait votre personnalité ? Loin d’être anodines, ces quelques lettres griffonnées à la hâte sur un chèque ou sous un contrat permettent de mieux comprendre le pouvoir, l’estime de soi et les dérives narcissiques.

Depuis des années, la signature de Donald Trump – large, anguleuse et spectaculaire – attire l’attention du public. On a récemment découvert qu’elle figurait dans un livre offert à Jeffrey Epstein pour son cinquantième anniversaire, mais elle s’inscrit surtout dans la longue tradition d’autocélébration tapageuse de l’ancien président. « J’adore ma signature, vraiment », a-t-il déclaré, le 30 septembre 2025, devant des responsables militaires. « Tout le monde adore ma signature. »

Cette signature présente pour moi un intérêt particulier, en raison de ma fascination de longue date – et de mes recherches occasionnelles – sur le lien entre la taille des signatures et les traits de personnalité. Chercheur en psychologie sociale m’étant fait une spécialité des élites américaines, j’ai réalisé une découverte empirique involontaire il y a plus de cinquante ans, alors que j’étais encore étudiant. Le lien que j’avais observé à l’époque – et que de nombreuses recherches sont venues confirmer depuis – est que la taille d’une signature est liée au statut social et à la perception de soi.

Taille de la signature et estime de soi

En 1967, lors de ma dernière année d’université, je travaillais à la bibliothèque de psychologie de l’Université Wesleyan (Connecticut) dans le cadre d’un emploi étudiant. Quatre soirs par semaine, ma mission consistait à enregistrer les prêts et à ranger les livres rendus.

Quand les étudiants ou les professeurs empruntaient un livre, ils devaient inscrire leur nom sur une fiche orange, sans lignes, glissée à l’intérieur de l’ouvrage. À un moment, j’ai remarqué un schéma récurrent : les professeurs prenaient beaucoup de place pour signer, leurs lettres occupant presque toute la carte. Les étudiants, eux, écrivaient en petit, laissant largement de la place pour les lecteurs suivants. J’ai alors décidé d’étudier cette observation de façon plus systématique.

J’ai rassemblé au moins dix signatures pour chaque membre du corps enseignant, ainsi qu’un échantillon comparable de signatures d’étudiants dont les noms comptaient le même nombre de lettres. Après avoir mesuré la surface occupée – en multipliant la hauteur par la largeur de la zone utilisée –, j’ai constaté que huit professeurs sur neuf utilisaient nettement plus d’espace pour signer leur nom.

Afin de tester l’effet de l’âge autant que celui du statut, j’ai mené une autre étude : j’ai comparé les signatures de personnes occupant un emploi manuel – agents d’entretien, jardiniers, personnel technique de l’université – avec celles d’un groupe de professeurs et d’un groupe d’étudiants, toujours en égalisant le nombre de lettres et en utilisant cette fois des cartes vierges de 3 pouces sur 5 (7,6 cm sur 12,7 cm.). Le premier groupe prenait plus de place que les étudiants, mais moins que les enseignants. J’en ai conclu que l’âge jouait un rôle, mais aussi le statut social.

Quand j’ai raconté mes résultats au psychologue Karl Scheibe, mon professeur préféré, il m’a proposé de mesurer les signatures figurant dans ses propres livres – celles qu’il apposait depuis plus de dix ans, depuis sa première année d’université.

Comme on peut le voir sur le graphique, la taille de ses signatures a globalement augmenté au fil du temps. Elles ont connu un net bond entre sa troisième et sa dernière année d’études, ont légèrement diminué lorsqu’il est entré en doctorat, puis ont de nouveau grandi lorsqu’il a achevé sa thèse et rejoint le corps enseignant de Wesleyan.

J’ai ensuite mené plusieurs autres études et publié quelques articles, concluant que la taille de la signature était liée à l’estime de soi ainsi qu’à une mesure de ce que j’ai appelé la « conscience du statut ». J’ai constaté que ce schéma se vérifiait dans divers contextes, y compris en Iran, où l’écriture se lit pourtant de droite à gauche.

Le lien avec le narcissisme

Même si mes recherches ultérieures ont donné lieu à un livre sur les PDG des entreprises du classement Fortune 500, il ne m’était jamais venu à l’esprit d’étudier leurs signatures. Quarante ans plus tard, d’autres chercheurs y ont pensé. En mai 2013, j’ai reçu un appel de la rédaction du Harvard Business Review à propos de mes travaux sur la taille des signatures. Le magazine prévoyait de publier une interview de Nick Seybert, professeur associé de comptabilité à l’université du Maryland, sur le lien possible entre la taille des signatures et le narcissisme chez les PDG.

Seybert m’avait expliqué que ses recherches n’avaient pas permis d’établir de lien direct entre les deux, mais l’idée d’une possible corrélation qu’il avançait a tout de même éveillé ma curiosité. J’ai donc décidé de la tester auprès d’un échantillon de mes étudiants. Je leur ai demandé de signer une carte vierge comme s’ils rédigeaient un chèque, puis je leur ai fait passer un questionnaire de 16 questions couramment utilisé pour mesurer le narcissisme.

Et, surprise : Seybert avait raison de supposer un lien. Il existait bien une corrélation positive significative entre la taille de la signature et le narcissisme. Mon échantillon était certes modeste, mais ce résultat a incité Seybert à reproduire l’expérience auprès de deux autres groupes d’étudiants – et il a obtenu la même corrélation positive significative.

D’autres chercheurs ont rapidement commencé à utiliser la taille de la signature pour évaluer le narcissisme chez les PDG. En 2020, l’intérêt croissant pour le sujet a conduit le Journal of Management à publier un article qui recensait la taille de la signature parmi cinq indicateurs possibles du narcissisme chez les dirigeants d’entreprise.

Un champ de recherche en expansion

Aujourd’hui, près de six ans plus tard, les chercheurs utilisent la taille de la signature pour étudier le narcissisme chez les PDG et d’autres cadres dirigeants, comme les directeurs financiers. Ce lien a été observé non seulement aux États-Unis, mais aussi au Royaume-Uni, en Allemagne, en Uruguay, en Iran, en Afrique du Sud et en Chine.

Par ailleurs, certains chercheurs se sont penchés sur l’effet que produisent, sur les observateurs, des signatures plus grandes ou plus petites. Par exemple, dans un article récent du Journal of Philanthropy, des chercheurs canadiens ont rendu compte de trois expériences faisant varier systématiquement la taille de la signature d’une personne sollicitant des dons, afin d’évaluer si cela influençait le montant des contributions. Et c’était bien le cas : dans l’une de leurs études, ils ont montré qu’agrandir la signature de l’expéditeur générait plus du double de recettes.

Le retour inattendu des recherches utilisant la taille de la signature pour évaluer le narcissisme m’amène à plusieurs conclusions. D’abord, cette mesure de certains aspects de la personnalité s’avère bien plus solide que je ne l’aurais imaginé, lorsque je n’étais qu’un étudiant curieux travaillant dans une bibliothèque universitaire en 1967.

En réalité, la taille de la signature n’est pas seulement un indicateur de statut ou d’estime de soi, comme je l’avais conclu à l’époque. Elle constitue aussi, comme le suggèrent les études récentes, un signe de tendances narcissiques – du type de celles que nombre d’observateurs prêtent à la signature ample et spectaculaire de Donald Trump. Nul ne peut dire quelle direction prendra cette recherche à l’avenir – pas même celui qui, il y a tant d’années, avait simplement remarqué quelque chose d’intrigant dans la taille des signatures.

Richie Zweigenhaft ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

01.11.2025 à 10:03

La grande histoire de la Sécurité sociale de 1945 à nos jours

Texte intégral (2846 mots)

Créée en 1945, la Sécurité sociale répondait à un objectif ambitieux : mettre les Français à l’abri du besoin et instaurer un ordre social nouveau. Fruit d’un compromis entre l’État et le mouvement ouvrier, cette institution a profondément façonné la solidarité sociale en France. Retour sur l’histoire d’un système révolutionnaire, aujourd’hui confronté à des défis de gouvernance et de légitimité.

Cet article est publié en partenariat avec Mermoz, la revue du Cercle des économistes dont le dont le numéro 8 a pour thème « Notre modèle social, un chef-d’œuvre en péril »..

La Sécurité sociale fête ses quatre-vingts ans. Née en 1945, dans un pays où tout est à reconstruire, cette institution sociale affiche alors l’ambition de créer un « ordre social nouveau ». La Sécurité sociale vise à mettre l’ensemble de la population « à l’abri du besoin » et à la libérer de « la peur du lendemain ».

À la Libération, la solidarité en armes exprimée dans la Résistance devait, en quelque sorte, se transcrire dans une solidarité sociale. Cette idée caractérise le compromis institutionnel à l’origine de la Sécurité sociale, entre un État social émancipateur et un mouvement ouvrier puissant et organisé. Dans les décennies suivantes, la démocratie sociale originelle disparaît progressivement, d’abord au profit d’un paritarisme plus favorable au patronat, puis dans le sens d’une gouvernance reprise en main par l’État.

Une longue histoire

Commençons par rappeler que tout ne s’est pas créé en 1945. Le plan français de sécurité sociale est le fruit d’un processus qui s’inscrit dans le temps long, et l’on peut en faire remonter les origines philosophiques à la Révolution française, un moment important de « laïcisation de la charité religieuse » qui avait cours depuis le Moyen Âge et sous l’Ancien Régime. La Déclaration des droits de l’homme et du citoyen de 1793 pose ainsi pour la première fois le principe selon lequel « les secours publics sont une dette sacrée » de la nation. Après la chute des robespierristes, qui portaient cette aspiration, les expérimentations en matière de secours publics disparaissent.

Commence alors un XIXe siècle marqué par le refus de l’État d’intervenir directement dans les affaires économiques et sociales, mais aussi par le retour de la charité assistancielle. En parallèle, deux traditions se développent en matière de protection sociale : d’une part, une conception républicaine, qui revendique une solidarité nationale, et d’autre part, une tradition ouvrière, qui repose sur l’entraide collective au sein des caisses de secours mutuels et qui est attachée à une gestion par les travailleurs eux-mêmes. La fin du siècle est quant à elle marquée par le développement d’une philosophie, le solidarisme, inspirée de l’œuvre de Léon Bourgeois. Ce courant de pensée postule que la société doit être organisée autour de la solidarité nationale. Il inspire la « nébuleuse réformatrice » à l’origine de l’État social, à travers les premières lois sur les accidents du travail en 1898, sur les retraites ouvrières et paysannes en 1910 ou encore sur les assurances sociales en 1928-1930.

Mais ces anciennes législations sont imparfaites, car elles ne couvrent que les salariés les plus pauvres, elles dispensent des prestations jugées insuffisantes et on y adhère selon le principe de la « liberté d’affiliation ». Cela signifie que le système compte une multiplicité de caisses, d’origine patronale, mutualiste, confessionnelle, syndicale ou départementale, dont l’efficacité est inégale. Compte tenu de ce bilan critique, le programme du Conseil national de la résistance (CNR), adopté dans la clandestinité le 15 mars 1944, entend réformer cette ancienne législation, à travers « un plan complet de sécurité sociale ». Le Gouvernement provisoire de la République française va donc s’y atteler, une fois le territoire national libéré.

Une réforme révolutionnaire

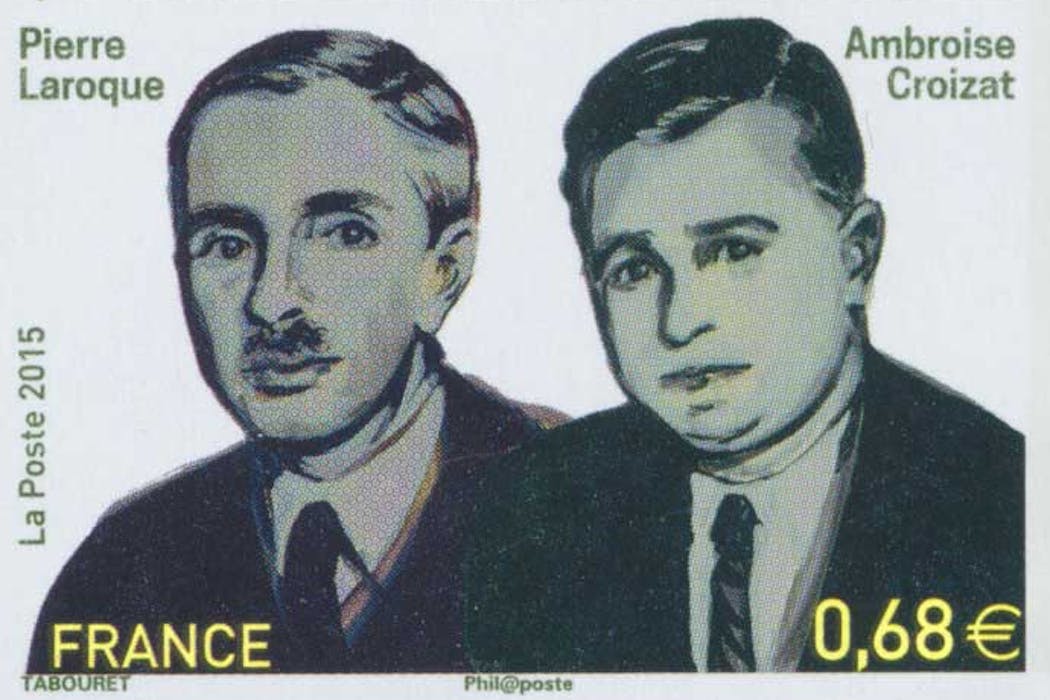

Ce contexte a permis la réalisation d’une « réforme révolutionnaire ». La Sécurité sociale repose sur des mesures prises par le pouvoir politique : elle s’est construite à partir d’ordonnances, comme celles du 4 et du 19 octobre 1945 portant création de la Sécurité sociale, sur des lois, comme celle du 22 mai 1946 portant généralisation de la Sécurité sociale, ou encore sur de nombreux décrets. En revanche, elle n’en est pas moins révolutionnaire par sa portée, par son ambition, celle de créer un « ordre social nouveau », pour reprendre une expression du haut fonctionnaire Pierre Laroque, elle-même déjà présente chez Jean Jaurès. Le 23 mars 1945, Laroque proclame :

« C’est une révolution qu’il faut faire et c’est une révolution que nous ferons ! »

À lire aussi : Mesurer le non-recours pour éviter de dépenser « un pognon de dingue »

Si le rôle de l’institution est incarné par Pierre Laroque, premier directeur de la Sécurité sociale, celui du mouvement ouvrier l’est par Ambroise Croizat. Ancien ouvrier dès l’âge de treize ans, dirigeant de la Fédération des métaux de la Confédération générale du travail (CGT) et député communiste sous le Front populaire, Ambroise Croizat devient président de la commission du travail et des affaires sociales de l’Assemblée consultative provisoire à la Libération, puis ministre du travail et de la sécurité sociale, du 21 novembre 1945 au 4 mai 1947.

Avec Pierre Laroque, ils mettent en œuvre le régime général de la Sécurité sociale, qui repose sur quatre principes fondamentaux. Tout d’abord, il doit s’agir d’un régime universel : l’ensemble de la population, de la naissance à la mort, doit bénéficier de la Sécurité sociale. De plus, le millier de caisses qui existaient du temps des assurances sociales est remplacé par un système obligatoire reposant sur une seule caisse primaire par département, une caisse régionale et une caisse nationale, prenant en charge l’ensemble des risques sociaux.

Le financement par la cotisation sociale constitue le troisième principe. Renvoyant à la formule « de chacun selon ses moyens à chacun selon ses besoins », ce mode de financement par répartition permet au budget de la Sécurité sociale d’être autonome et donc de ne pas dépendre des arbitrages budgétaires de l’État. Enfin, le quatrième principe, sans doute le plus original, renvoie à la démocratie sociale : les caisses de la Sécurité sociale sont gérées « par les intéressés eux-mêmes ».

Des oppositions diverses

De nombreuses oppositions vont tenter de retarder, voire d’empêcher, cette réalisation. Dans les milieux patronaux d’abord, hostiles vis-à-vis de la cotisation patronale, de la caisse unique et de la gestion des caisses par les travailleurs. La Mutualité et les assurances privées craignent de perdre le rôle qu’elles avaient dans les anciennes assurances sociales. Les médecins libéraux ont peur d’être « fonctionnarisés » et de perdre leur liberté d’exercice, tandis que les cadres n’ont pas envie d’être associés au même régime que les salariés. Face à ces obstacles, Croizat et Laroque font preuve de pragmatisme, en donnant partiellement satisfaction à la Mutualité, ou encore aux cadres, avec la création d’un régime complémentaire, l’Agirc. Les artisans, commerçants, professions libérales et agriculteurs obtiennent la mise en place de régimes particuliers.

Entre 1945-1967, la gestion des caisses de la Sécurité sociale est donc organisée selon le principe de la démocratie sociale, en reconnaissant un pouvoir syndical fort. En effet, les conseils d’administration des caisses sont composés à 75 % par des représentants des salariés et à 25 % par ceux du patronat. Ces administrateurs sont d’abord désignés selon le principe de la représentativité syndicale. Le syndicat chrétien de la CFTC refuse alors de participer à la mise en œuvre du régime général car il perd la gestion de ses anciennes caisses confessionnelles, mais aussi parce qu’il craint de subir l’hégémonie de la CGT. Les militants cégétistes disposent de fait d’un quasi-monopole dans la mise en œuvre du régime général sur le terrain.

La Sécurité sociale à la française n’est donc pas un système étatique. Sur le plan juridique, les caisses primaires et régionales sont de droit privé, tandis que la caisse nationale est un établissement public à caractère administratif. L’État, à travers le ministère du travail et de la sécurité sociale – et la direction de la Sécurité sociale qui en dépend –, voit son pouvoir limité à certaines prérogatives, qui restent importantes : en plus du pouvoir normatif, qui s’exprime par la fixation du taux de cotisation et du montant des prestations, l’État dispose aussi d’une fonction de contrôle sur l’activité des caisses.

Une gestion ouvrière fragilisée

Au cours de l’année 1947, le changement de contexte politique a des conséquences directes sur la Sécurité sociale. Le 24 avril 1947, des « élections sociales » sont instaurées pour renforcer sa dimension démocratique et donnent lieu à une véritable campagne politique. La CGT obtient environ 60 % des voix, la CFTC 26 % et la Mutualité 10 %. Le 4 mai, les communistes sont exclus du gouvernement. L’entrée dans la logique de la guerre froide fragilise la gestion ouvrière de la Sécurité sociale, en particulier à la suite de la scission syndicale entre la CGT et Force ouvrière.

En 1958, l’instauration de la Ve République permet à l’État d’intervenir plus directement. Les ordonnances Debré instaurent la nomination des directeurs de caisses par l’exécutif, et non plus leur élection par les conseils d’administration. En 1960, les pouvoirs des directeurs augmentent, au détriment de ceux des conseils d’administration. Au cours de la même année, le corps de l’Inspection générale de la Sécurité sociale est créé, de même que le Centre d’études supérieures de la Sécurité sociale – devenue l’EN3S en 2004 –, participant à la professionnalisation du personnel des caisses.

À partir de 1967, la démocratie sociale disparaît, au profit d’un nouveau principe, le paritarisme. Instauré par les ordonnances Jeanneney, le paritarisme repose en théorie sur un partage du pouvoir entre partenaires sociaux, à parts égales entre syndicats de salariés et patrons. Dans les faits, ce nouveau mode de gestion renforce le pouvoir du patronat, qui joue de la division syndicale. De même, les élections sociales sont supprimées, et la caisse unique est divisée en quatre branches autonomes, chacune présidée par un haut fonctionnaire.

Tout se passe comme si le compromis de 1945 entre l’État social et les syndicats ouvriers s’était renversé au profit d’une nouvelle alliance entre la « technocratie » et le patronat. En tout cas, l’ensemble de ces mesures répond aux revendications du Conseil national du patronat français (CNPF).

La crise de l’État-providence

Les années 1980-1990 voient s’imposer un autre discours, celui sur la « crise de l’État-providence ». Un État réformateur, avec à sa tête le socialiste François Mitterrand depuis 1981, réalise certes la promesse d’une retraite à 60 ans et celle de restaurer les élections sociales. Mais l’affaiblissement des syndicats et le « tournant de la rigueur » de 1983 consacrent l’objectif de réduction des dépenses publiques, partagé par tous les gouvernements successifs.

L’instauration de la contribution sociale généralisée (CSG) en 1990-1991 participe quant à elle de la fiscalisation du financement de la Sécurité sociale, au détriment de la cotisation sociale, ce qui justifie politiquement une intervention accrue de l’État.

Une parlementarisation de la gestion de la Sécurité sociale se développe ainsi entre 1996 et 2004. Le rôle du Parlement et l’influence des directives européennes en matière budgétaire et réglementaire se traduisent par plusieurs mesures prises en 1996 : l’instauration par ordonnances d’une loi de financement de la Sécurité sociale votée chaque année, la suppression définitive des élections sociales et la création de deux outils de gouvernance budgétaire, l’objectif national des dépenses de l’Assurance maladie (Ondam) et la Caisse d’amortissement de la dette sociale (Cades). En 2000, c’est au tour du Conseil d’orientation des retraites (COR) d’être créé.

Néomanagement et logique comptable

Enfin, depuis 2004, s’est imposée une gouvernance managériale, fortement inspirée du « nouveau management public ». Cette évolution est symbolisée par la réforme de l’assurance-maladie et celle de l’hôpital public, avec l’instauration de la tarification à l’activité (T2A). Les différentes branches sont désormais gérées par des directeurs généraux aux pouvoirs élargis, tandis que des Conventions d’objectifs et de gestion (COG) sont contractées tous les quatre ans entre l’État et les branches, puis déclinées au niveau des caisses.

Une logique comptable de définition d’objectifs et d’évaluation des résultats s’impose donc devant l’exigence de répondre à des besoins et de garantir l’accès aux droits des bénéficiaires. Cette gouvernance managériale parvient parfois à mener des réformes impopulaires, comme la réforme des retraites de 2023 passée via l’usage de l’article 49.3 de la Constitution et le détournement d’un PLFSS rectificatif. Néanmoins, se pose dès lors la question du consentement populaire à ce mode de gestion, qui fragilise une institution centrale du pacte social républicain.

Les commémorations du 80e anniversaire de la Sécurité sociale ont ainsi été propices à la remise en cause d’une gouvernance, dénoncée comme étant antidémocratique, y compris parfois au sein même des élites de l’État social. Certains appellent à renouer avec les ambitions portées, en son temps, par Pierre Laroque, leur illustre prédécesseur, notamment en termes de démocratie sociale.

Cet article est publié en partenariat avec Mermoz, la revue du Cercle des économistes dont le numéro 8 a pour objet « Notre modèle social, un chef-d’œuvre en péril ». Vous pourrez y lire d’autres contributions.

Le titre et les intertitres sont de la rédaction de The Conversation France.

Léo Rosell ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

01.11.2025 à 10:02

Comment s’explique l’éternel retour du roller ?

Texte intégral (2242 mots)

Accessoires de spectacle dès le XVIIᵉ siècle, les patins à roulettes ont vu le jour en Europe, dans l’ombre du patinage sur glace. Aux grandes modes aristocratiques et mondaines à l’aube du XXᵉ siècle, ont succédé de multiples périodes d’engouements, aux formes et aux modalités renouvelées. Pourtant, le roller n’est jamais parvenu véritablement à s’installer en France comme « fait culturel ».

La pandémie de Covid-19 et les confinements ont déclenché un regain d’intérêt pour le roller. Entre 2020 et 2022, les ventes de patins ont bondi de 300 % aux États-Unis et ont suivi les mêmes tendances en France. À travers des influenceuses, telles qu’Ana Coto ou Oumi Janta, la génération TikTok a réinvesti les rues et les places. Les marques n’ont pas tardé à relancer des modèles au look à la fois vintage et modernisé.

Cet engouement récent ne surgit cependant pas du néant. Il s’inscrit dans une longue histoire de modes successives du patinage à roulettes en France et dans le monde. C’est en les reconvoquant, en questionnant le rôles des acteurs et leurs représentations que l’on peut mieux saisir pourquoi le roller peine encore à s’imposer comme un fait culturel durable et fonctionne donc par effraction, par mode.

Une première vague : la « rinkomanie » de 1876

La première grande mode du patinage à roulettes remonte aux alentours de 1876. La vogue du skating, incarnée par les patins à essieux de James Leonard Plimpton, traverse l’Atlantique et atteint l’Europe. Henry Mouhot dépeint cet engouement sans précédent dans son ouvrage la Rinkomanie (1875).

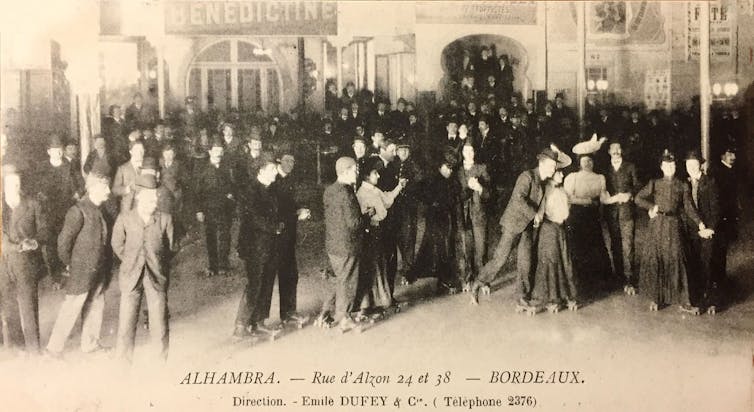

En France, près de 70 patinoires à roulettes, les skating-rinks, ouvrent leurs portes en l’espace de trois ans. Majoritairement fréquentés par l’aristocratie, la haute bourgeoisie et « l’élite voyageuse », ils deviennent des lieux incontournables de sociabilité urbaine et cosmopolite.

Le patinage à roulettes est alors considéré comme une alternative au patinage sur glace dont il reproduit les attitudes et les techniques corporelles. A contrario de son aïeul sur lames, il permet de pratiquer toute l’année.

Pourtant, malgré les aspirations hygiénistes, l’anglomanie et le caractère de nouveauté, la mode décroît rapidement sous l’influence de plusieurs facteurs : un matériel innovant mais largement perfectible demandant une maîtrise technique importante, la fragilité des entreprises commerciales, la mauvaise fréquentation des rinks, l’absence d’institutionnalisation ou encore la concurrence d’autres pratiques, telles que la vélocipédie.

1910 : de la pratique loisir mondaine à la « sportivisation »

Une série d’innovations technologiques notables, tels que les roulements à billes, combinée à des conditions d’accès plus strictes aux patinoires, contribuent à relancer l’intérêt pour le patinage à roulettes à la veille de la Première Guerre mondiale. Sam Nieswizski (1991) avance que l’imminence du conflit a incité la bourgeoisie au divertissement. Près de 130 skating-rinks sortent de terre entre 1903 et 1914, à Paris et en province. Ils sont édifiés particulièrement sur la Côte Atlantique et dans les lieux de villégiature du tourisme britannique.

À l’instar du ping-pong, loisir mondain et élégant, le patinage à roulettes fonde ses premiers clubs de hockey sur patin à roulettes, de course et de figures. La « sportivisation » du patinage à roulettes en tant que « processus global de transformation des exercices physiques et des pratiques ludiques anciennes en sport moderne » a débuté à la fin du XIXe siècle. La Fédération des patineurs à roulettes de France voit le jour en 1910.

Dans le même temps, la pratique populaire et enfantine en extérieur se développe, non sans susciter la répression policière. À Paris, la préfecture tente de contenir le déferlement des patineurs sur la voie publique en prenant un arrêté qui interdit la pratique aux alentours du jardin du Luxembourg. Elle déclenche de vives réactions de journaux, comme le Matin ou l’Humanité, qui se mobilisent pour défendre la pratique populaire face à la conception bourgeoise du patinage en skating-rink.

La mode de 1910 s’avère pourtant structurante : elle amorce la popularisation et la sportivisation de la pratique qui se prolongent dans l’entre-deux-guerres avec la création de la fédération internationale et avec les premiers championnats d’Europe et du monde. Le déclenchement du conflit et les résistances institutionnelles pourraient pour partie expliquer qu’il n’ait pas existé en France une période d’ancrage culturel aussi profonde que celle observée durant la Roller Skate Craze américaine des années 1920-1950.

Des résurgences cycliques au cours du XXᵉ siècle

L’entre-deux-guerres voit l’émergence du roller-catch : l’ancêtre professionnel de l’actuel roller derby investit le Vélodrome d’hiver en 1939. Plus spectacle que sport, la pratique est rejetée par la fédération internationale, mue par les valeurs de l’amateurisme. Elle renaîtra sous une forme modernisée et féministe au début des années 2000.

Durant les années 1950 et jusqu’aux années 1980, clubs et compétitions se développent dans la confidentialité. En parallèle, la production à faible coût de patins à roulettes réglables en longueur favorise la pratique enfantine.

À la fin des années 1970, l’avènement des roues en uréthane rend la glisse plus confortable, fluide et ouvre de nouvelles perspectives techniques. Les roller-skates au look de chaussure sport d’un seul tenant accompagnent la vague roller-disco. Des films comme La Boum ou Subway montrent alors deux représentations antinomiques mais coexistantes du patinage à roulettes. À partir de 1981, les milliers de patineurs de Paris sur roulettes investissent dans les rues de la capitale, à tel point que les piétons demandent leur interdiction. Taxés de marginaux, ils préfigurent la conquête de la ville des années 1990-2000.

À l’aube du XXIe siècle, des marques emblématiques, comme Rollerblade, sont à l’initiative du boom du roller « inline » et rajeunissent l’image surannée du patin à essieux. Le roller devient cool, branché, écologique. Il s’inscrit dans la lignée des sports californiens et s’envisage même en tant que mode de transport : des grèves londoniennes de 1924 aux grèves de 1995, il n’y a qu’une poussée.

Il acquiert une dimension plus respectable, malgré les représentations négatives de sa dimension agressive (roller acrobatique et freestyle de rue) qui demeure incomprise, au même titre que le skateboard. Les autorités oscillent entre acceptation et répression dans un discours ambivalent. En Belgique, le roller trouve sa place dans le Code de la route, alors qu’en France, les préconisations du Livre blanc du Centre d’études sur les réseaux, les transports, l’urbanisme et les constructions publiques (Certu) restent lettre morte.

En 2010, le film Bliss/Whip it ! marque le renouveau du roller derby. Durant quelques années, les journaux scrutent avec intérêt la réappropriation de cette pratique par les femmes. Le patin à essieux y connaît une nouvelle jeunesse tout comme entre 2016 et 2018 poussé par le marketing mondial de Disney qui promeut la série adolescente Soy Luna.

Quatre ans plus tard, la même génération de pratiquantes se libère du confinement en réanimant la roller-dance, prolongement modernisé d’une roller-disco restée dans l’imaginaire collectif.

Pourquoi ces cycles se répètent-ils ?

Ainsi, lors de chaque mode, le patinage à roulettes repart avec force. À l’instar des vogues vestimentaires et dans une logique d’imitation/distinction, les pratiquants et pratiquantes se réapproprient les signes du passé pour mieux les détourner et affirmer leur singularité.

L’analyse historique et sociologique permet de dégager plusieurs ressorts d’émergence et d’alimentation des modes liés aux différents acteurs en lice dans le champ activités physiques et sportives : les innovations technologiques poussées par les fabricants (roulements, roues uréthane) et les distributeurs, le marketing et la communication (Soy Luna), les médias et les influenceurs (confinement), les aspirations des pratiquants, les techniques corporelles, des lieux de pratique adaptés ou encore l’influence des institutions étatiques et fédérales. Des facteurs inhibiteurs viennent toutefois perturber ces vogues et limiter leur ancrage sociétal durable, en particulier lorsque les objectifs des acteurs divergent.

Ainsi, l’histoire des modes du patinage à roulettes en France nous enseigne que l’enthousiasme ne suffit pas à en produire. Il faut un écosystème actif aux intérêts convergents : fabricants, médias, infrastructures, institutions. En d’autres termes : ce n’est pas seulement parce qu’on roule que l’on devient un fait culturel.

Je suis webmaster du site associatif rollerenligne.com.