29.05.2026 à 11:18

Quels premiers ministres ont banalisé les idées d’extrême droite ?

Texte intégral (3388 mots)

La normalisation des idées d’extrême droite passe aussi par des partis considérés comme plus modérés. C’est ce que montre une enquête sur les déclarations de politique générale des premiers ministres depuis 1959. L’un des résultats les plus marquants est le rôle des chefs de gouvernements « centristes » (notamment Édouard Philippe, Jean Castex et Gabriel Attal) dans la diffusion des idées d’extrême droite.

« Victoire idéologique » : en janvier 2024, Marine Le Pen n’a pas hésité à qualifier ainsi la loi « Pour contrôler l’immigration, améliorer l’intégration », adoptée par le gouvernement Attal. Une année plus tard, François Bayrou, figure centriste de la majorité, s’inquiétait publiquement d’une « submersion » migratoire. Ces éléments de langage illustrent un phénomène plus large : les idées d’extrême droite, autrefois marginales, semblent avoir trouvé leur place dans les discours et les pratiques de responsables politiques qui ne lui sont pas traditionnellement affiliés.

Comment en est-on arrivé là ? Que révèle cette évolution sur la transformation du débat politique en France ?

Une méthode inédite : l’analyse automatisée des discours de politique générale

Pour répondre à cette question, nous avons analysé l’ensemble des déclarations de politique générale prononcées depuis 1959, soit trente discours au total. Ces textes, souvent longs et programmatiques, constituent un matériau unique : ils condensent les priorités du gouvernement lors de son entrée en fonction et fixent le cap politique devant l’Assemblée nationale. Autrement dit, ils offrent une photographie formelle et régulière de l’idéologie au sommet de l’État.

Afin de mesurer la présence d’idées d’extrême droite, nous avons construit un indicateur, le score idéologique d’extrême droite (Sied). Basé sur sept grandes dimensions que l’ont retrouve dans la plupart des définitions de l’extrême droite – nationalisme, anti-immigration, anti-démocratie, anti-progrès, autoritarisme, traditionalisme et anti-égalitarisme –, il permet de repérer, à l’aide d’outils de traitement automatique du langage, la part de ces idées dans chaque discours.

Des années 1970 à aujourd’hui : une progression continue

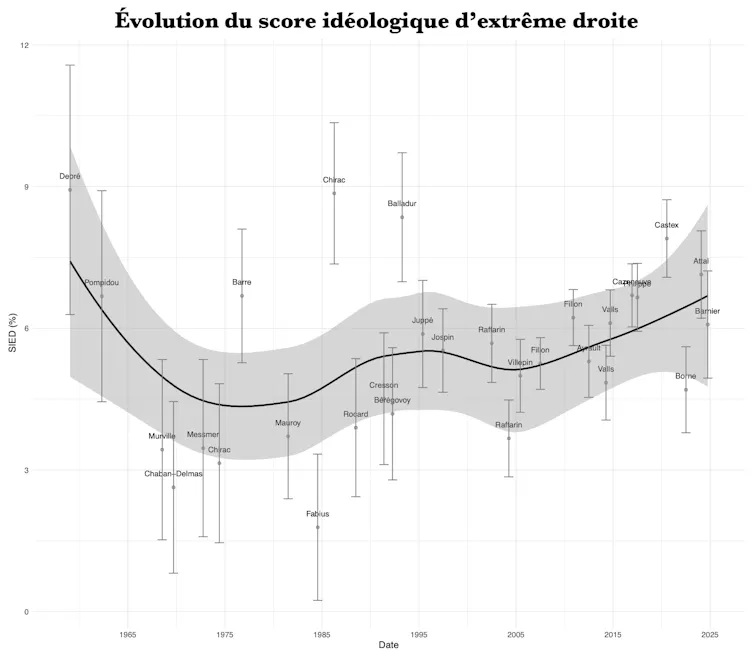

Les résultats sont sans équivoque : la part d’idées d’extrême droite dans les déclarations de politique générale progresse de manière continue depuis le milieu des années 1970, selon une dynamique de long terme qui dépasse largement les alternances partisanes (voir graphique). Après des niveaux élevés au début de la Vᵉ République – notamment sous Michel Debré et Georges Pompidou, dans le contexte de la guerre d’indépendance algérienne –, la courbe connaît un net reflux au cours des années 1970.

À partir de cette période, la tendance s’inverse durablement. Le score idéologique d’extrême droite augmente progressivement dans les années 1980 et 1990, marque un palier relatif au tournant des années 2000, puis repart nettement à la hausse à partir des années 2010. Les discours les plus récents atteignent ainsi des niveaux comparables à ceux observés dans les moments les plus conflictuels du début des années 1960, mais dans un contexte institutionnel bien plus stable que celui du début du régime.

Notre étude montre que les idées d’extrême droite ne circulent pas seulement dans les partis qui s’en revendiquent. Des premiers ministres de droite, du centre et même de gauche ont, à des degrés divers, repris des expressions ou des cadrages caractéristiques de ce registre idéologique.

Ce phénomène n’a rien d’étonnant. Comme le rappelle le politologue américain Cas Mudde, l’extrême droite ne crée pas ex nihilo : elle radicalise des idées déjà présentes dans la société – l’attachement à la nation, la valorisation de l’ordre ou la méfiance envers l’égalité. La notion de nation en offre un bon exemple : elle peut être comprise de manière ouverte, comme un projet politique commun ou, au contraire, comme une communauté fermée, définie par la naissance ou la supposée appartenance raciale.

En valorisant ces interprétations exclusives, les premiers ministres ont, depuis les années 1970, contribué à estomper la frontière entre discours d’extrême droite et langage institutionnel. Le constat est d’autant plus frappant que les déclarations de politique générale – ces discours solennels où un chef de gouvernement présente son programme devant l’Assemblée nationale – sont réputées consensuelles, destinées à rassembler une majorité. Or, même dans ce cadre codifié, le lexique s’est déplacé : des termes autrefois impensables s’y sont imposés, élargissant peu à peu les limites du dicible.

Comprendre ces résultats avec la métapolitique

Traditionnellement, les chercheurs expliquent la diffusion des thèmes d’extrême droite par la cooptation électorale : des partis reprennent ponctuellement certains éléments du programme de leurs adversaires pour séduire leur électorat. Nicolas Sarkozy, par exemple, avait multiplié les références à l’« identité nationale », en 2007 et en 2012.

Mais nos résultats montrent que cette logique ne suffit pas. Même à des périodes où cette stratégie n’était pas payante électoralement, on observe une hausse du score idéologique d’extrême droite dans les discours de premiers ministres issus du centre ou de la gauche. Autrement dit, la diffusion ne résulte pas seulement d’un calcul stratégique : elle traduit un déplacement durable du langage politique.

C’est ici que le concept de « métapolitique » prend tout son sens.

Cette idée a été développée à l’extrême droite par la Nouvelle Droite, un courant intellectuel né en 1969 autour du think tank Groupement de recherche et d’études pour la civilisation européenne (Grece) qui avait pour ambition de réhabiliter une pensée réactionnaire voire fasciste à l’échelle européenne, après la Seconde Guerre mondiale. Pour cela, la métapolitique repose sur une idée simple : avant de prendre le pouvoir, il faut transformer la société et, pour cela, il faut réinventer les mots, les symboles et les cadres de pensée qui la structurent.

Autrement dit, il s’agit de façonner le sens commun pour le rendre plus perméable à ses idées plutôt que de convaincre directement sur la base d’un programme politique clairement identifiable. Une stratégie revendiquée par certains membres éminents de l’extrême droite française comme Marion Maréchal.

La notion de « fenêtre d’Overton » peut aider à comprendre un principe sous-jacent à la métapolitique. Une idée auparavant impensable peut devenir politiquement légitime si elle est régulièrement évoquée, débattue ou reformulée dans des termes plus neutres. Chaque fois qu’un responsable politique – même modéré – mobilise une rhétorique sécuritaire, anti-immigration ou anti-égalitaire, il contribue, volontairement ou non, à élargir cette fenêtre : ce qui paraissait extrême hier devient aujourd’hui une opinion ordinaire.

En modifiant les cadres symboliques et les associations de sens, des responsables politiques qui ne sont pas affiliés à l’extrême droite ont contribué – bon gré mal gré – à un processus métapolitique favorable à la diffusion de ses idées. Ce faisant, ils ont contribué à les faire entrer dans le langage du pouvoir, jusqu’à les rendre familières au-delà des acteurs qui s’en revendiquent traditionnellement.

Depuis 2017, la façon dont l’exécutif parle d’immigration, notamment en reprenant, encore plus que ne le fait Marine Le Pen, la métaphore du flux prêt à déborder en est un bon exemple.

Le centre : acteur clef de la diffusion des idées d’extrême droite

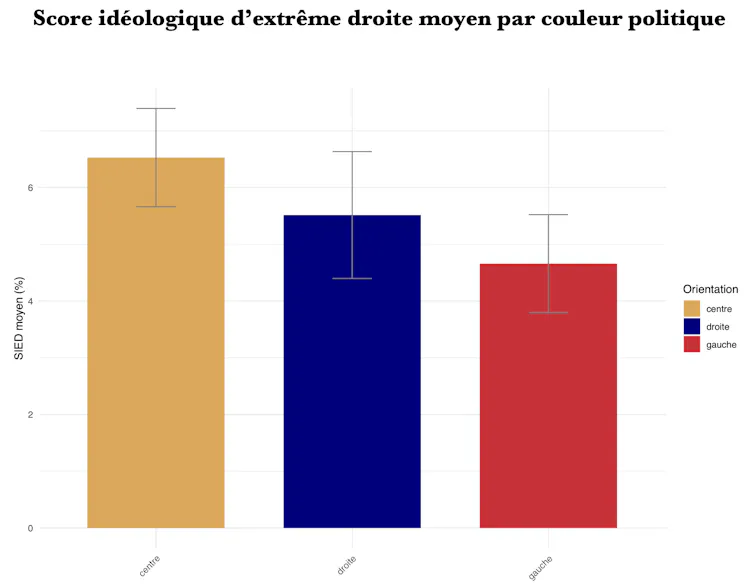

L’un des résultats les plus marquants de notre étude est le rôle du centre politique dans la diffusion des idées d’extrême droite. Les premiers ministres qui s’en réclament – et qui se présentent souvent comme des figures de modération – ont paradoxalement contribué à accélérer ce glissement vers l’extrémisme.

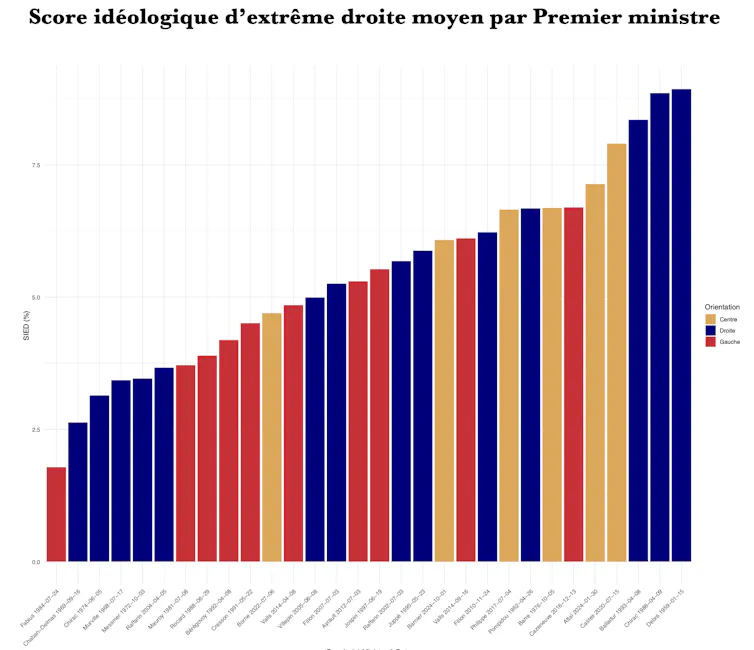

Si certains premiers ministres de droite (comme Michel Debré, Jacques Chirac ou Édouard Balladur) atteignent ponctuellement des score idéologique d’extrême droite (Sied) particulièrement élevés, d’autres sont plus bas (Jacques Chaban-Delmas, Maurice Couve de Murville ou Jean-Pierre Raffarin). La droite se caractérise ainsi par une dispersion interne sur le Sied qui laisse entrevoir l’intervention d’autres facteurs contextuels dans la mobilisation des idées d’extrême droite. Par exemple, la nomination de Jacques Chaban-Delmas est marquée par la volonté d’une ouverture aux sociaux-démocrates de Georges Pompidou. Cela se reflète par la très commentée « nouvelle société » dans le discours de Chaban-Delmas qui dénonce un pays de « castes » et des inégalités excessives.

À l’inverse, les premiers ministres issus du centre présentent des niveaux de Sied durablement élevés et relativement homogènes, en particulier dans la période récente (Édouard Philippe, Jean Castex et Gabriel Attal). L’écart maximal observé au sein du centre – entre Élisabeth Borne et Jean Castex – ne dépasse pas 3 points sur l’échelle du Sied, alors qu’il dépasse 8 points entre Jacques Chaban-Delmas et Michel Debré, les deux premiers ministres de droite aux scores les plus opposés.

Cette configuration se retrouve dans la distribution des scores : parmi les cinq premiers ministres affichant les Sied les plus élevés, on compte trois personnalités de droite et deux du centre, tandis que les cinq scores les plus faibles regroupent une personnalité de gauche et quatre de droite. Le centre occupe ainsi de manière plus constante le haut du spectre : à l’exception d’Élisabeth Borne, l’ensemble des premiers ministres centristes se situent au-dessus de la médiane, ce qui en fait un vecteur plus régulier de normalisation de ce registre idéologique.

Dans leurs déclarations de politique générale, plusieurs premiers ministres centristes mobilisent un lexique technocratique et sécuritaire convergeant.

Édouard Philippe évoque ainsi la « pression migratoire » et les « tensions » qu’elle ferait peser sur la cohésion nationale, dans une logique de gestion administrative des flux. Jean Castex appelle pour sa part à « rétablir l’autorité de l’État » face à une « coalition d’ennemis de la République » mêlant terrorisme, séparatisme et extrémisme. Gabriel Attal, enfin, recourt à de multiples reprises à la métaphore du « réarmement » – de l’État, de l’école ou des politiques publiques – inscrivant l’action gouvernementale dans un registre martial.

Pris ensemble, ces cadrages contribuent à installer durablement dans le langage du pouvoir des représentations historiquement associées à l’extrême droite, sous des formes euphémisées.

Normaliser l’extrême droite en se présentant comme seule voix de la raison

En cherchant à incarner la raison et le compromis, le centre a souvent repris les thèmes de l’extrême droite pour mieux les encadrer ou les « rationaliser ». Mais cette stratégie produit l’effet inverse : elle légitime ces thèmes en les inscrivant dans le langage gouvernemental.

En se définissant comme le pôle de la modération, le centre adopte une posture d’arbitre plutôt que de compétiteur dans le jeu démocratique. Or, tout en jouissant d’une position de force lorsqu’il est au pouvoir, le centre tend à renvoyer dos à dos l’extrême droite et la gauche. C’est une formule doublement gagnante pour l’extrême droite qui se voit normaliser (en devenant un extrême parmi d’autres) tandis que l’un de ses principaux adversaires se trouve diabolisé, la gauche étant désormais présentée comme extrémiste.

Cette dynamique ne se limite pas à des calculs électoraux ponctuels. Elle s’inscrit dans une transformation structurelle. Comme l’expliquent les économistes Julia Cagé et Thomas Piketty, l’expansion du centre, en affaiblissant les partis de gauche et de droite traditionnels, a contribué à polariser le champ politique. En se présentant comme « au-dessus des clivages » tout en mettant en œuvre des politiques largement alignées sur l’agenda de la droite (voire en reprenant certains de ses cadrages) le centre opère un déplacement du référentiel politique. Ce processus contribue à rendre discutables puis acceptables des thèmes et des diagnostics initialement portés par l’extrême droite.

Comme le rappelle l’historien Johann Chapoutot, cette tension entre libéralisme économique et réaction n’est pas nouvelle. Dans son dernier essai, il montre comment les élites libérales de la République de Weimar ont cru pouvoir canaliser les forces autoritaires en les intégrant au jeu institutionnel – avant d’en être les premières victimes. Le parallèle historique souligne la fragilité d’un centre qui, en voulant instrumentaliser l’extrême droite, finit parfois par lui ouvrir la voie.

Tristan Boursier a reçu des financements du Fonds de recherche du Québec (FRQ) et du Centre de recherche interdisciplinaire sur la diversité et la démocratie (CRIDAQ)

Antoine Lemor a reçu des financements du Fonds de recherche du Québec (FRQ).

28.05.2026 à 16:01

Enquête sur la laïcité dans les quartiers multiculturels de l’Est parisien

Texte intégral (1808 mots)

Dans le débat public, la laïcité est souvent considérée comme un principe univoque, voire comme une ligne de partage. Mais quel est l’usage de cette notion dans la pratique quotidienne des habitants des quartiers multiculturels de l’Est de la capitale et des associations qui les accompagnent ?

Depuis le début des années 2000, le débat public français a vu s’imposer une lecture restrictive de la laïcité, souvent mobilisée pour tenir à distance certaines pratiques culturelles ou religieuses, jugées incompatibles avec l’espace républicain. Dans ce contexte, des acteurs politiques présentent la loi de 1905 non comme un cadre garantissant la coexistence pacifique entre les acteurs de la société civile, mais comme un principe permettant de distinguer les citoyens supposés pleinement intégrés de ceux qui le seraient moins.

Mais ces représentations rendent-elles compte des pratiques observées sur le terrain ? Comment les valeurs républicaines et le principe de laïcité sont-ils compris, mobilisés et traduits dans les pratiques ?

Notre enquête, menée dans l’Est parisien, montre qu’ils font l’objet d’interprétations situées, entendues comme des formes de compréhension construites dans un contexte social et culturel spécifique, étroitement liées aux trajectoires des habitants, aux projets associatifs et aux configurations locales.

Plusieurs niveaux de normes s’entrecroisent

L’enquête met en évidence une grande diversité d’appropriations locales des valeurs républicaines dans les Xᵉ, XIᵉ, XIXᵉ et XXᵉ arrondissements de Paris.

Cette diversité s’explique par l’inscription simultanée des individus, souvent accompagnés par une association locale, dans plusieurs cadres normatifs en interaction : un cadre national et public, un cadre territorial et associatif, et un cadre individuel ou communautaire.

Le cadre national renvoie aux valeurs républicaines et au principe de laïcité, interprétés par les acteurs et actrices politiques. Le cadre territorial correspond aux valeurs qui façonnent l’identité, l’histoire, et les projets des associations implantées localement, qu’elles soient nationales, régionales ou de quartier. Le cadre individuel ou communautaire rassemble des valeurs culturelles, religieuses ou politiques propres aux personnes. L’articulation de ces différents cadres éclaire la manière dont s’opère le passage entre projets de vie, engagements associatifs et participation citoyenne. Selon les situations, ils se renforcent, s’ignorent, ou entrent en tension. Les valeurs républicaines – « Liberté, Égalité, Fraternité » – ouvrent donc une pluralité de sens et de projets au sein de l’espace républicain.

Par ailleurs, ces valeurs sont au fondement d’un système social et politique de vie parfois très éloigné des univers culturels dans lesquels ont été socialisées les communautés chinoises, afghanes, turques, maghrébines ou africaines présentes dans l’Est parisien. Cela ne signifie pas pour autant une incompatibilité structurelle entre ces systèmes de valeurs. En revanche, ignorer leur hétérogénéité empêche de comprendre les ajustements réels opérés sur le terrain, et les passages qui se construisent entre différents systèmes politiques.

L’association Chinois de France Français de Chine souligne ainsi que les premières générations chinoises arrivées à Belleville ont été marquées par la révolution culturelle en Chine (1966-1976), notamment par des pratiques d’autocritique publique et de dénonciation intrafamiliale. Cette expérience contribuerait à expliquer une méfiance durable envers le système politique français. À l’inverse, les jeunes générations scolarisées en France peuvent plus facilement articuler les cadres politiques français et chinois : leur double socialisation favorise une ouverture à la fois aux valeurs familiales et à celles de l’école républicaine.

Liberté, égalité ou fraternité ?

L’enquête montre que les associations de l’Est parisien orientent leur action autour d’une valeur républicaine dominante.

Les associations représentant des communautés migrantes mettent d’abord l’accent sur la liberté pour faire entendre leur voix et sortir leurs publics des marges de la société française. Elles cherchent aussi à favoriser une autonomie à l’égard des pressions exercées depuis les pays d’origine.

Le drapeau afghan est ainsi apparu lors de la manifestation place de la République après les attentats contre Charlie Hebdo. Selon un membre de l’association Français langue d’accueil :

« La participation des exilés afghans à cette manifestation était le signe qu’ils cherchaient à préserver une liberté qu’ils ne trouvaient pas dans leur pays d’origine. La France représentait pour eux un espace où ils ne risquaient plus de mourir par hasard comme c’était le cas auparavant. »

Les associations hospitalières ou chrétiennes, de leur côté, accordent une plus grande importance à l’égalité. Leur objectif est de créer des espaces d’accueil inconditionnel dans lesquels les publics marginalisés peuvent être reconnus et traités comme les autres. C’est en faisant le constat critique d’un manque d’hospitalité en France qu’elles cherchent à y remédier. Pour le Centre d’accueil et de médiation relationnelle éducative et sociale (Camres), il n’existe pas, en ce sens, de personnes moins respectables ou moins citoyennes que d’autres.

Enfin, les centres sociaux et certaines associations plus étroitement liées aux dispositifs publics, comme La 20ᵉ chaise ou Belleville citoyenne, valorisent surtout la fraternité comme principe organisateur de la mixité sociale, en luttant contre les logiques de cloisonnement entre communautés et classes sociales.

Laïcité : des modèles importés, adaptés et parfois mis en tension

Les habitants rencontrés font aussi référence à plusieurs modèles de séparation du politique et du religieux, expérimentés dans leur pays d’origine. Les migrants tunisiens, par exemple, sont porteurs de deux références laïques, française et tunisienne. Selon un membre de l’Association des Tunisiens en France,

« Si l’État tunisien était neutre comme en France, c’est-à-dire extérieur aux espaces confessionnels, les acteurs politiques islamistes auraient la possibilité de venir battre l’État sur le terrain du religieux. Le fait que l’islam soit la religion de l’État en Tunisie pousse les islamistes à confondre l’islam et l’État pour s’en démarquer, ce qui permet en retour à l’État tunisien de mieux prévenir les prises de pouvoir par le religieux. »

Il n’est donc pas pertinent d’interpréter la laïcité française à partir du modèle tunisien, ni l’inverse, au risque de dénaturer l’une et l’autre. Les migrants tunisiens décrivent plutôt une situation de double référence, sans chercher à les confondre. Ces deux modèles ont néanmoins en commun de tenir à distance les ambitions politiques d’acteurs religieux souhaitant imposer leurs croyances particulières à l’ensemble des citoyens.

Les associations représentant dans l’Est parisien les originaires de Turquie, comme l’ACORT ou Espace universel, mettent quant à elles en avant la possibilité de faire coexister des systèmes culturels différents. Elles refusent ainsi l’opposition binaire entre tradition et modernité, entre attachement aux valeurs communautaires (turques, arméniennes ou kurdes) et attachement aux valeurs de la République.

Vers une approche interculturelle de la République

L’ensemble des entretiens fait apparaître non une vision unique de la République, mais une pluralité de compréhensions. Autrement dit, la République n’est pas seulement un cadre normatif ; elle est aussi l’expression d’une expérience locale et de situations vécues : accès aux droits, relations avec les administrations, reconnaissance symbolique, traitement égal ou inégal des publics. L’enquête montre ainsi que la République vécue est plurielle sans être fragmentée : loin d’être diluée par la diversité des interprétations, elle devient opératoire grâce à elles.

Les acteurs associatifs ne contestent pas le cadre républicain ; ils le traduisent pour le rendre praticable. Dans cette perspective, la laïcité n’apparaît pas comme une frontière mais comme un outil d’organisation de la coexistence.

Une enquête menée dans une autre ville que Paris ne ferait apparaître ni un simple prolongement de ce qui a été observé dans l’Est parisien, ni des résultats radicalement différents, mais une autre appropriation des valeurs républicaines, liée à la volonté située de les inscrire dans des projets de vie individuels, communautaires et associatifs.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

28.05.2026 à 15:54

L’image dite de « Jésus » de Trump était-elle un blasphème ?

Texte intégral (1949 mots)

L’image, générée par IA, de Donald Trump représenté en Jésus a été largement critiquée comme étant « blasphématoire ». Mais qu’est-ce que le blasphème dans le christianisme, l’islam et le judaïsme ? Comment l’envisager dans une perspective laïque ?

Le 13 avril 2026, Donald Trump a publié une image générée par IA le montrant vêtu d’une tunique blanche, posant une main lumineuse sur un homme malade ou décédé dans un lit d’hôpital, comme pour le guérir ou le ressusciter. L’image, publiée sur sa plateforme Truth Social, a été largement interprétée comme une mise en scène de lui-même en figure messianique de Jésus.

Le lendemain matin, il a supprimé la publication. « Je pensais que c’était moi en médecin », a-t-il expliqué aux journalistes, selon le magazine Time. Jésus ? « Seules les fake news pouvaient inventer ça. »

Mais la publication a été largement perçue comme blasphématoire – y compris par le groupe catholique conservateur CatholicVote.org.

« Je ne sais pas si le président pensait être drôle ou s’il est sous l’influence de quelque substance, ni quelle explication il pourrait avoir pour ce blasphème OUTRAGEANT », a déclaré Megan Basham, une écrivaine chrétienne protestante conservatrice influente, sur X.

« Mais il doit retirer cela immédiatement et demander pardon au peuple américain, puis à Dieu. »

« J’ai été très reconnaissant de voir combien de chrétiens conservateurs ont immédiatement dénoncé l’image blasphématoire Jésus/Trump », a déclaré le pasteur Doug Wilson, qui a récemment dirigé un service de prière au Pentagone et fondé le réseau d’églises auquel appartient le secrétaire à la Guerre Pete Hegseth.

Qu’est-ce que le blasphème ?

Dans la tradition chrétienne, le blasphème a historiquement été une notion instable et changeante. Mais, en termes simples, il désigne des paroles, des pensées ou des actes qui manifestent du mépris envers Dieu ou les choses sacrées – ou qui s’en moquent.

La conception du blasphème dans le judaïsme et le christianisme provient de l’injonction de l’Ancien Testament de ne pas outrager Dieu. Dans l’Ancien Testament, il était considéré comme un crime passible de mort : « Celui qui blasphème le nom du Seigneur sera mis à mort ; toute l’assemblée lapidera le blasphémateur. »

Le Nouveau Testament a élargi cette notion pour inclure le rejet de Jésus. Progressivement, maudire, réprimander, défier, ridiculiser, rejeter ou nier Jésus est devenu considéré comme blasphématoire.

Plus précisément, se faire passer pour Jésus ou revendiquer des pouvoirs qui n’appartiennent qu’à lui était considéré comme blasphématoire au Moyen Âge. Les Christ qui apparaissaient étaient traités sévèrement, comme des hérétiques dangereux. C’est dans ce cadre que la présentation de Trump comme Jésus serait sans aucun doute considérée comme blasphématoire.

De manière plus générale, tout propos ou acte offensant pour les croyants pouvait être interprété comme blasphématoire. Les catholiques à l’époque de la Réforme au XVIe siècle avaient tendance à qualifier ceux qui les offensaient d’hérétiques.

Les protestants préféraient généralement le terme « blasphème » pour désigner tout ce qu’ils n’appréciaient pas ou avec quoi ils étaient en désaccord. Par exemple, le théologien du XVIᵉ siècle Martin Luther – figure majeure de la Réforme protestante – a condamné comme blasphématoires non seulement les catholiques, mais aussi les juifs et les musulmans.

Le blasphème : péché ou crime

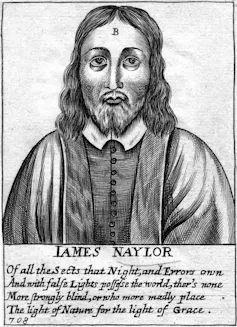

À partir du XVIIᵉ siècle, le blasphème est devenu moins une offense contre Dieu qu’une offense contre la société. Dans les sociétés instables de l’Europe moderne naissante, il était perçu comme socialement et politiquement subversif, et poursuivi comme tel. Le quaker James Naylor fut emprisonné en 1656 pour avoir rejoué l’entrée de Jésus à Jérusalem le dimanche des Rameaux.

Au début du XVIIᵉ siècle, le blasphème a traversé l’Atlantique vers les États-Unis. Le premier Code juridique de la Virginie prévoyait la peine de mort pour le blasphème contre la Trinité.

Malgré le premier amendement de la Constitution américaine, qui protège la liberté d’expression, des lois contre le blasphème ont été régulièrement adoptées. La Cour suprême des États-Unis n’a jugé qu’après la Seconde Guerre mondiale que les lois contre le blasphème portaient atteinte à la liberté d’expression. Plusieurs États conservent encore des dispositions relatives au blasphème dans leur législation.

L’Acte sur le blasphème de 1697 en Angleterre, qui criminalisait le déni de la Sainte Trinité, de la vérité du christianisme ou de l’autorité divine de la Bible, a été étendu aux colonies d’Australie et de Nouvelle-Zélande.

Le blasphème n’est plus une infraction au regard du droit fédéral australien, bien que les lois qui l’encadrent varient selon les États : il figure encore dans le code pénal de plusieurs d’entre eux. En Nouvelle-Zélande, le code pénal traite du « libelle blasphématoire » dans la catégorie des « crimes contre la religion, la morale et le bien public ».

Existe-t-il un blasphème en islam ?

Dans l’islam, il n’existe pas d’équivalent exact au terme « blasphème ». Cependant, l’idée de « parole d’infidélité » est analogue. En pratique, cela revient à se moquer de Dieu, du prophète ou de la tradition islamique en général.

Ainsi, lorsque Trump a déclaré de manière moqueuse « Louange à Allah » dans une publication récente, il s’est rendu coupable de blasphème aux yeux des musulmans. Le commentateur conservateur Dinesh D’Souza a comparé cela au récit de l’Ancien Testament dans lequel le prophète Élie se moque des prophètes de Baal (Premier Livre des Rois, 18).

Le groupe de défense musulman Council on American-Islamic Relations a qualifié cela de « troublant » et « offensant pour les musulmans ».

Les lois contre le blasphème sont activement appliquées dans de nombreux États islamiques contemporains.

Le blasphème a-t-il de l’importance ?

Il n’est pas blasphématoire d’exprimer ou de publier des opinions hostiles au christianisme, au judaïsme ou à l’islam – ni, d’ailleurs, à toute religion. Ce qui importe, ce n’est pas tant le contenu de la critique que la manière dont elle est formulée.

Nous ne devrions nous inquiéter que lorsque la critique devient une forme de « discours de haine religieuse ». La question à se poser porte sur l’intention. Dans une société laïque, lorsque nous identifions une intention malveillante, nous pouvons envisager le « blasphème » comme une question de morale publique plutôt que de théologie.

Alors, qu’en est-il de la publication de Donald Trump ? Est-ce important ?

Si l’on considère que le « blasphème » inclut la moquerie de la religion, il ne fait guère de doute que les moqueries de Trump à l’égard de l’islam peuvent être qualifiées de blasphématoires. Si l’on estime que sa publication supprimée sur Truth Social visait à suggérer qu’il est Jésus – ou, d’une certaine manière, une figure divine –, alors les chrétiens sont en droit de la considérer comme blasphématoire.

Cela dit, d’un point de vue laïque, il s’agit davantage d’une forme de folie égocentrique que de discours de haine – cela n’en reste pas moins malvenu de la part d’un président des États-Unis.

Philip C. Almond ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.