27.04.2026 à 15:54

L’oxygène, cette molécule paradoxale, base de la vie et poison mortel : comment les microorganismes y font face

Texte intégral (2293 mots)

Les humains ainsi que bon nombre d’espèces vivantes ont besoin d’oxygène pour vivre. Pourtant cette molécule est chimiquement dangereuse, elle provoque ce que l’on appelle le « stress oxydant » (une altération des constituants de nos cellules comme les protéines ou l’ADN). Il faut donc pouvoir l’utiliser, mais également s’en protéger. Une nouvelle étude éclaire ces processus chez des microalgues.

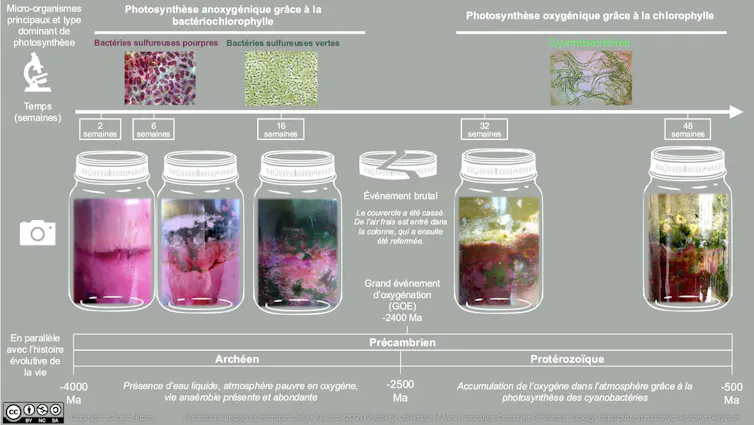

La relation entre la vie et l’oxygène est loin d’être simple. Pour la comprendre, il faut remonter aux origines de la vie sur Terre, à l’époque archéenne (entre -4 milliards et -2,5 milliards d’années). Les océans existaient déjà, mais l’atmosphère contenait très peu, voire pas du tout, d’oxygène libre.

Certaines bactéries réalisaient déjà une photosynthèse dite anoxygénique qui, contrairement à celle des plantes et des algues actuelles, ne libère pas d’oxygène mais produit des composés soufrés.

Il y a environ 2,4 milliards d’années survient un tournant majeur : la Grande Oxygénation. L’oxygène commence à s’accumuler dans l’atmosphère grâce à l’activité de bactéries photosynthétiques (les cyanobactéries) capables de réaliser la photosynthèse oxygénique, le même processus que celui utilisé aujourd’hui par les plantes et les algues.

Cette accumulation d’oxygène transforme profondément la biosphère. Pour la première fois, une molécule extrêmement réactive est produite en grande quantité par des organismes vivants. L’oxygène peut oxyder et endommager les structures cellulaires des organismes qui n’y sont pas adaptés. La vie se trouve alors confrontée à un paradoxe : devoir composer avec une molécule qu’elle produit elle-même mais qui représente un danger pour la majorité des formes de vie existantes.

Cette transition provoque une crise biologique majeure. De nombreuses espèces anaérobies sont repoussées vers des milieux pauvres en oxygène, comme les sédiments ou les profondeurs marines. Parallèlement, certaines lignées développent des mécanismes capables de neutraliser l’oxygène, puis de l’utiliser comme source d’énergie. La respiration oxygénique, bien plus efficace que les métabolismes anaérobies, permet ainsi l’émergence de formes de vie plus complexes.

Le paradoxe de l’oxygène

Bien que souvent associé à la vie, l’oxygène demeure chimiquement dangereux et peut provoquer ce que l’on appelle le stress oxydant. En effet, le dioxygène peut générer des espèces réactives de l’oxygène (ERO) – superoxyde, peroxyde d’hydrogène ou radical hydroxyle – capables d’endommager protéines, lipides et ADN.

Tous les organismes aérobies (y compris les humains) possèdent donc des systèmes enzymatiques permettant de neutraliser ces molécules : superoxyde dismutases, catalases ou peroxydases. Sans ces mécanismes de défense, l’oxygène serait rapidement létal. La vie moderne repose ainsi sur un équilibre délicat : utiliser l’oxygène pour produire de l’énergie tout en limitant ses effets toxiques.

Longtemps considérées uniquement comme des sous-produits nocifs impliqués dans le vieillissement ou certaines maladies, les ERO sont aujourd’hui reconnues comme des molécules de signalisation participant à la régulation de nombreux processus cellulaires (prolifération cellulaire ou régulation de certains gènes par exemple). Leur rôle exact reste cependant encore largement inexploré.

Le stress oxydant dans les environnements naturels

Le stress oxydant ne concerne pas seulement les organismes humains : il affecte l’ensemble du vivant. Il apparaît lorsque la production d’ERO dépasse les capacités de défense de la cellule. Ce phénomène est particulièrement marqué dans des environnements soumis à de fortes variations de conditions physiques ou chimiques.

Ces milieux extrêmes comme la mer morte, le désert du Sahara ou certains déserts d’altitude recevant un fort rayonnement solaire, possèdent des conditions très salées, très sèches ou fortement irradiées, mais abritent pourtant une biodiversité étonnante. Des organismes spécialisés, appelés extrêmophiles, y prospèrent grâce à des adaptations physiologiques remarquables. La notion d’environnement extrême dépend donc toujours de l’organisme considéré.

Même des milieux plus familiers peuvent imposer des contraintes importantes. Nos zones côtières, par exemple, connaissent des fluctuations rapides de lumière. L’intensité lumineuse y varie fortement au cours de la journée, ce qui influence directement l’activité photosynthétique.

Les organismes photosynthétiques sont particulièrement exposés à ce problème, car la capture d’énergie lumineuse favorise la formation d’espèces réactives de l’oxygène. Ainsi, si la lumière est indispensable à la photosynthèse, un excès d’énergie lumineuse peut perturber l’équilibre cellulaire et favoriser la formation d’ERO. Les organismes doivent donc exploiter la lumière tout en se protégeant de ses effets potentiellement toxiques.

Les adaptations des microalgues aux variations journalières de lumière

Les diatomées, microalgues très abondantes dans les sédiments marins, ont développé plusieurs stratégies pour faire face à ces variations lumineuses. Des pigments protecteurs, notamment les xanthophylles, limitent la formation de radicaux libres. Les cellules peuvent également modifier l’organisation de leur appareil photosynthétique afin d’optimiser la capture de lumière tout en réduisant les dommages.

Ces microalgues possèdent aussi des photorécepteurs capables de détecter les variations lumineuses et de déclencher des réponses physiologiques rapides, comme l’activation de mécanismes de photoprotection ou l’expression de certains gènes.

L’une de leurs adaptations les plus remarquables est leur migration verticale dans le sédiment. Lorsque la lumière est modérée, les diatomées remontent vers la surface afin de maximiser la photosynthèse. Lorsque l’intensité devient trop forte, elles s’enfoncent légèrement dans le sédiment, comme pour se mettre à l’ombre. Ces déplacements sont synchronisés par une horloge circadienne interne qui permet d’anticiper les cycles jour-nuit.

ERO et diatomées : un dialogue plus complexe qu’on ne le croyait

Des travaux récents suggèrent que les espèces réactives de l’oxygène pourraient jouer un rôle plus actif qu’on ne le pensait. Au-delà de leur caractère potentiellement toxique, elles pourraient agir comme signaux déclenchant certaines réponses comportementales.

Notre dernière étude montre que les ERO participent notamment au contrôle de la migration verticale des diatomées, alors que l’on pensait jusqu’à présent que ces migrations servaient principalement à limiter leur production et leur accumulation au niveau cellulaire.

Deux mécanismes semblent donc se combiner : la migration permet de réduire l’exposition à des conditions génératrices d’ERO, mais ces mêmes molécules pourraient également agir comme signaux déclenchant la réponse lorsque leur concentration dépasse un certain seuil.

Ce système fonctionnerait ainsi comme un véritable dispositif de surveillance interne. Les variations du stress oxydant reflètent rapidement les changements de l’environnement et permettent aux cellules d’ajuster leurs réponses physiologiques et comportementales.

Les diatomées étant très diversifiées et largement distribuées à l’échelle globale, il est probable que ces capacités de détection, de traitement de l’information et de mise en place de réponses varient selon les espèces et le contexte environnemental. Cette diversité confère aux diatomées une forte capacité d’adaptation, jouant un rôle essentiel dans leur survie.

Ce travail montre, à travers un exemple frappant, que le vivant n’a pas seulement appris à se défendre contre l’oxygène et ses dérivés toxiques : il a aussi appris à les utiliser. Des déchets métaboliques oxygénés, autrefois considérés comme uniquement dangereux pour les cellules, peuvent devenir de véritables outils biologiques.

Cela rappelle que le rôle des ERO reste complexe et encore largement méconnu. Loin d’être de simples agents de stress, elles apparaissent aujourd’hui comme des molécules ambivalentes : des messagers subtils intégrés à des mécanismes fins de communication, d’adaptation cellulaire et de perception de l’environnement, notamment chez les diatomées.

Et comme souvent en sciences, ces découvertes ouvrent surtout de nouvelles questions… qui restent encore à explorer.

Nous remercions l’école doctorale DIVONA, la station marine de Concarneau (Finistère) et le laboratoire BOREA.

Alexandre Desparmet a reçu des financements de l'institut de l'Océan de l'Alliance Sorbonne Université.

Cédric Hubas a reçu des financements de l'institut de l'Océan de l'Alliance Sorbonne Université.

26.04.2026 à 09:15

Ce que les créatures des abysses voient dans le noir

Texte intégral (1701 mots)

Dans l’ouvrage Secrets de l’océan profond, tout juste publié aux éditions Quae, Juliette Ravaux, maîtresse de conférences à Sorbonne Université en biologie animale, et Sébastien Duperron, professeur au Muséum national d’histoire naturelle et spécialiste d’écologie microbienne, nous font découvrir des espèces animales mystérieuses et des ressources mal connues de l’océan profond. Leur but est de mieux comprendre ce bien commun, pour mieux le préserver. Dans cet extrait, ces spécialistes nous donnent à voir ce que perçoivent les curieuses espèces vivant dans les abysses, qu’ils ont tous deux pu observer lors de leurs plongées à bord du Nautile, sous-marin de la flotte scientifique à la fois unique… et exigu.

La vie dans l’océan profond s’accompagne d’un panel de contraintes environnementales, parmi lesquelles l’absence de lumière solaire et la rareté de la nourriture. À elles seules, ces deux conditions affectent des fonctions essentielles des organismes telles que l’orientation dans leur environnement à la recherche de nourriture ou de partenaires, mais aussi le métabolisme, la croissance et la reproduction. En conséquence, les espèces des profondeurs possèdent une vaste diversité d’adaptations dont certaines sont présentées ici, mais dont beaucoup restent encore à découvrir !

Descendons sur la dorsale de l’océan Atlantique, à plus de 2 000 mètres de fond, au plus près des fumeurs noirs qui crachent un fluide brûlant. Là, sur les parois des cheminées hydrothermales, des crevettes se rassemblent par milliers en nuées grouillantes. Ce sont des crevettes aveugles, Rimicaris exoculata, une espèce emblématique de ces environnements atlantiques. Les adultes ne possèdent pas les yeux pédonculés typiques des crevettes, ce qui leur vaut ce surnom. Et pourtant, elles possèdent bien des yeux, difficilement reconnaissables car ils sont très modifiés : ce sont des plaques rosées en forme de V qui se situent sur leur dos. Ces plaques ne leur permettent pas de voir leur environnement sous forme d’une image comme le font nos yeux.

Mais elles sont très sensibles à la lumière et détectent des sources lumineuses de très faible intensité, invisibles pour l’œil humain. Elles sont constituées d’une couche très épaisse de cellules photoréceptrices, sous laquelle se trouve une couche réfléchissante de cellules blanches qui renvoie la lumière vers les photorécepteurs, augmentant ainsi la quantité de lumière perçue.

Grâce à ces capteurs hypersensibles, les crevettes Rimicaris sont donc spécialisées dans la détection de lumière ténue. Reste encore à déterminer quels signaux lumineux elles perçoivent dans leur environnement parmi les sources potentielles, comme celle émise par le fluide hydrothermal sous forme de rayonnement thermique.

Les animaux bioluminescents, ou pourquoi il ne fait pas totalement noir dans les abysses

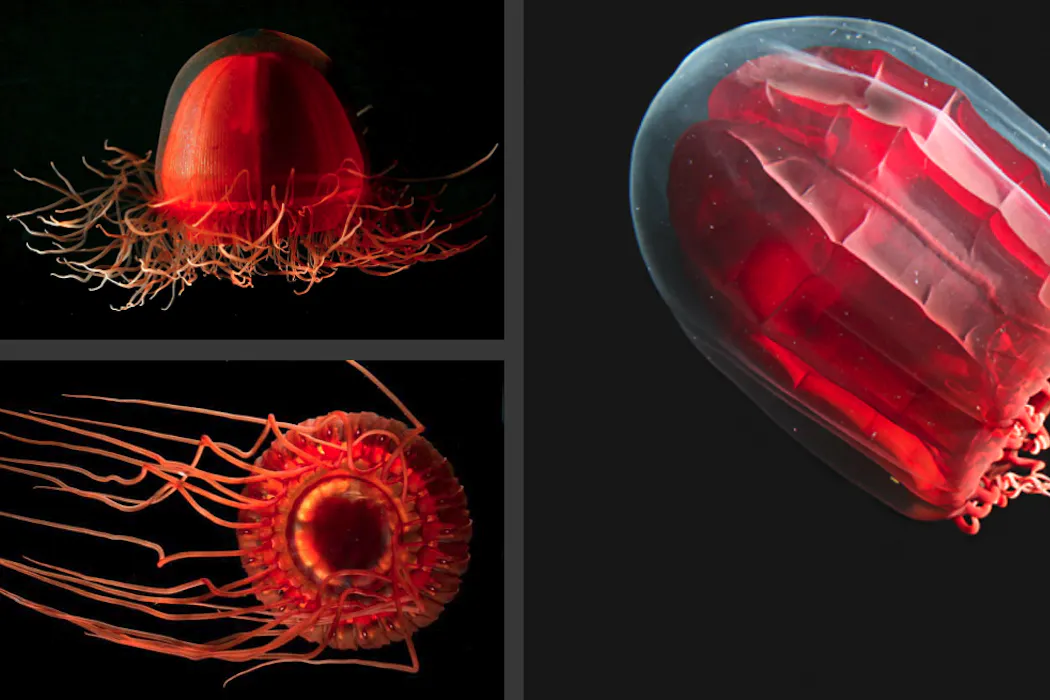

À l’instar de Rimicaris, les espèces abyssales évoluent dans des environnements obscurs dépourvus de lumière solaire. Il existe cependant une autre source lumineuse majeure : la bioluminescence. Plus faible que la lumière solaire, elle n’est apparente que la nuit dans les eaux de surface, mais elle est nettement visible en profondeur grâce au contraste avec le fond noir. Cette lumière émise par les organismes révèle la présence de partenaires, de prédateurs, de sources de nourriture, et peut aussi servir de défense, de leurre ou de camouflage. Dans la zone crépusculaire, diverses espèces arborent ainsi un ventre bioluminescent qui les rend moins visibles aux prédateurs et aux proies situés en dessous. Cette contre-illumination leur permet en effet de se fondre dans la faible luminosité provenant de la surface.

Au-delà de 1 000 mètres, la bioluminescence constitue la principale, sinon la seule, source de lumière. Elle apparaît de façon intermittente sous forme d’éclairs lumineux, le plus souvent de couleur bleue ou verte, qui durent quelques dixièmes de secondes à quelques secondes. Des observations menées au large de New York dans les années 1950 rapportent des fréquences de signaux bioluminescents allant jusqu’à 94 éclairs par minute dans le champ de vision du photomètre pour des profondeurs au-delà de 1 000 mètres. Dans les années 2000, un inventaire de la faune au large de la côte californienne, de la surface jusqu’à 3 900 mètres de profondeur, a révélé que plus de trois quarts des individus de la colonne d’eau émettent de la lumière. Les océans crépitent d’un feu d’artifice silencieux et le paysage lumineux des profondeurs se présente comme un fond noir piqueté d’étincelles bleutées.

Les yeux adaptés aux paysages obscurs

Dans ces paysages obscurs, les animaux sont-ils aveugles ? Les yeux des poissons téléostéens peuplant les profondeurs sont souvent décrits comme étant « régressés » ou « dégénérés ». Pourtant, ces yeux existent bel et bien et les poissons des profondeurs ne sont généralement pas aveugles, bien au contraire. Les yeux des poissons bathypélagiques présentent une grande variété de morphologies : ils sont parfois clairement régressé avec une rétine absente ou défectueuse, comme chez les « poissons-baleines » du genre Cetomimus, ou au contraire très grands et développés, comme ceux de l’alépocéphale à bec (Alepocephalus rostratus).

Dans l’ensemble, à quelques exceptions près, les yeux des espèces bathypélagiques ont toutefois tendance à être plus petits (par rapport à la taille du corps) que ceux de leurs cousins de la zone mésopélagique. Ils sont néanmoins parfaitement fonctionnels et particulièrement efficaces pour détecter des éclairs de bioluminescence ponctuels, grâce à deux caractéristiques notables : une large pupille et une rétine riche en photorécepteurs très sensibles à la lumière. Le record est actuellement détenu par la dirette argentée, une espèce abyssale qui possède un nombre exceptionnel de pigments responsables de la détection de faible luminosité, les rhodopsines. Alors que l’humain ne possède qu’un seul exemplaire de rhodopsine, la dirette en possède 38 ! Chacune de ces rhodopsines serait capable de détecter une couleur dans la gamme des bleus et des verts. Cet exceptionnel répertoire de pigments permet donc à la dirette de distinguer davantage de nuances de lumière bleue et de lumière verte que l’être humain, ce qui s’avère très utile pour identifier différentes sources de bioluminescence, et ainsi distinguer les prédateurs et les proies.

Comme la dirette, la majorité des poissons des grands fonds possède une vision limitée aux longueurs d’onde bleues et vertes. Ils ne peuvent percevoir les autres couleurs, et sont de ce fait daltoniens ! Les poissons bathypélagiques seraient en théorie capables de voir un flash bioluminescent à une distance pouvant aller jusqu’à 100 mètres dans une eau limpide. Cependant, cette distance est en réalité inatteignable pour la plupart des poissons pélagiques, qui n’ont pas l’énergie suffisante pour nager jusqu’à une source lumineuse à une telle distance en un laps de temps court. Ainsi, même si les poissons des profondeurs peuvent voir des éclairs lointains, ils ne réagissent probablement qu’à ceux produits à une distance plus proche.

Tout comme les poissons bathypélagiques, les crustacés de ces profondeurs présentent une grande variété de morphologie des yeux. Là encore, on retrouve des exemples d’yeux particulièrement sensibles à la lumière et adaptés à la détection de la bioluminescence. Le record revient probablement aux grands yeux de l’ostracode Gigantocypris muelleri, qui possèdent des réflecteurs qui ressemblent à des phares de voiture et des photorécepteurs géants qui lui confèrent une sensibilité à la lumière impressionnante. Il est ainsi capable de distinguer les silhouettes de proies et de prédateurs qui se profilent contre la faible lumière descendant dans la colonne d’eau au-dessus de lui, et il peut déjouer le camouflage en contre-illumination des espèces bioluminescentes de la zone crépusculaire. S’il est capable de détecter efficacement la bioluminescence, ce crustacé ne peut en revanche voir avec précision l’organisme qui la produit, car ses yeux possèdent une faible résolution, ce qui fait qu’il voit flou !

Dans les grands fonds, on trouve donc des espèces dont la vision s’est adaptée pour percevoir de très faibles intensités lumineuses, et dans un répertoire de couleurs spécialisé, plutôt que pour produire une image nette et détaillée de leur environnement.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

23.04.2026 à 16:14

Des manchots de l’Antarctique à l’explicabilité en IA. Bienvenue en prétopologie !

Texte intégral (2155 mots)

La plupart des algorithmes performants actuels – notamment l’apprentissage profond (deep learning) et ses réseaux de neurones – fonctionnent comme des boîtes noires. On sait qu’ils donnent de bons résultats, mais impossible de comprendre leur logique interne. Ceci pose problème pour de nombreux domaines d’application (médecine, justice…), ce qui incite les régulateurs à exiger des systèmes « explicables ». Plusieurs pistes vers l’explicabilité existent. Zoom sur la « prétopologie ».

Imaginons un patient dont les résultats sanguins montrent un taux d’hémoglobine de 12,5 grammes par décilitres de sang. Un algorithme de détection précoce du cancer analyse ces chiffres, mais aussi ses antécédents familiaux (présents ou absents), son statut de fumeur (oui ou non), son niveau d’activité physique (faible, moyen, élevé). L’algorithme le classe dans un groupe à risque modéré. Mais quand son médecin lui demande pourquoi, le système ne peut pas répondre : c’est une boîte noire.

Et c’est évidemment un problème pour le patient, le médecin, l’assurance maladie, etc. C’est pour cela que l’AI Act européen, adopté en mars 2024, impose des obligations strictes aux organisations et entreprises opérant en Europe. D’ici 2026-2027, tous les systèmes d’IA dits à haut risque devront être « transparents » et « explicables », c’est-à-dire dont un humain puisse comprendre la logique. Les sanctions pourront atteindre 35 millions d’euros ou 7 % du chiffre d’affaires annuel mondial, car les domaines concernés peuvent avoir des effets importants.

Par exemple, en ressources humaines, les logiciels de tri de CV qui analysent à la fois des niveaux de diplômes, des années d’expérience et des compétences techniques doivent pouvoir justifier pourquoi un candidat est retenu et un autre écarté. Dans l’industrie énergétique, les systèmes de maintenance prédictive qui combinent données de capteurs (température, vibrations), historique de maintenance et type d’équipement doivent expliquer pourquoi une éolienne ou un autre équipement est signalé comme « à risque de panne ».

Pour contrer l’« effet boite noire » des systèmes d’IA actuels, nous proposons une méthode issue d’une discipline méconnue du grand public, la « pré-topologie », qui permet de rendre explicables les raisonnements faits sur des données mixtes (le taux d’hémoglobine est un chiffre tandis que la présence ou non d’antécédents familiaux ne se chiffre pas).

Qu’est-ce que la prétopologie ?

- La prétopologie, c’est l’art de dessiner des « zones d’influence » autour de chaque personne ou objet dans un réseau – comme les cercles d’amis sur les réseaux sociaux, où l’influence n’est pas forcément réciproque.

- Pour décrire une zone complexe, elle utilise une recette appelée forme normale disjonctive, qui assemble des blocs de base, puis calcule automatiquement tout ce qui « adhère » à cet assemblage, c'est-à-dire tout ce qui gravite naturellement autour de lui.

Les limites des méthodes actuelles pour rendre les systèmes d’IA « explicables »

Le clustering hiérarchique est aujourd’hui la méthode de référence pour regrouper automatiquement des observations similaires et donc pour rendre les données plus interprétables : en organisant les observations en une hiérarchie de groupes emboîtés (un dendrogramme), il permet à un expert de naviguer entre niveaux de granularité, d’identifier des profils types et d’expliquer pourquoi deux individus sont regroupés ensemble, sans avoir à ouvrir la “boîte noire” d’un modèle prédictif.

Son fonctionnement est simple et transparent. On mesure d’abord la distance entre chaque paire d’observations. Ensuite, on regroupe progressivement les observations les plus proches. Enfin, on obtient un arbre (appelé dendrogramme) qu’on peut couper à différents niveaux pour former des groupes.

Prenons l’exemple des manchots de l’archipel Palmer en Antarctique. Si on mesure la longueur de leur bec et leur masse corporelle, le clustering hiérarchique identifie automatiquement trois groupes qui correspondent aux trois espèces biologiques présentes : Adélie, Jugulaire et Papou. L’atout majeur est sa transparence : on visualise l’arbre, on suit les regroupements successifs, on comprend facilement comment les groupes se sont formés, la hauteur d’embranchement donne une idée de la « différence » entre deux groupes.

Le défi survient quand on mélange chiffres et catégories. Mesurer une distance entre deux chiffres est facile : si un patient a une glycémie de 5,5 millimoles par litres (une unité de concentration) et un autre de 6,2 millimoles par litres, la différence est de 0,7. Mais comment mesurer la distance entre deux « catégories » que l’on ne peut pas chiffrer, comme une réponse oui ou non (fumeur ou non-fumeur), ou encore la couleur d’un tissu biologique ?

Par exemple, dans notre exemple de détection précoce du cancer, si le patient A présente une concentration d’hémoglobine de 12,5 grammes par décilitres (chiffre), des antécédents familiaux (catégorie « oui ») et ne fume pas (catégorie « non ») ; tandis que le patient B présente une concentration d’hémoglobine de 13,1 grammes par décilitres, pas d’antécédents et fume… comment dire si ces deux patients sont « proches » ou « éloignés », en termes de risques ?

Les solutions existantes, comme le k-means, HDBSCAN et DIANA ont toutes des limites. Transformer les catégories en chiffres artificiels (« oui » = 1, « non » = 0) est arbitraire et fait perdre du sens. Plus précisément, ceci signifie que l’on introduit une relation d’ordre et une distance qui n’existent pas : coder « chat » = 1, « chien » = 2, « oiseau » = 3 suggère implicitement que chien est « entre » chat et oiseau, ou que la distance chat-chien est égale à chien-oiseau, ce qui peut biaiser tous les calculs de similarité en aval.

Ignorer les catégories pour ne garder que les chiffres, comme dans les méthodes citées précédemment, fait perdre des informations cruciales comme les antécédents familiaux. Les méthodes statistiques plus complexes sont souvent opaques ou nécessitent des hypothèses fortes sur la structure des données. C’est le cas de la distance de Gower ou de l’analyse des facteurs latents – le genre de structure qui peut se cacher derrière les grands modèles de langage (LLM).

C’est précisément dans la définition de ces voisinages – comment mesurer qu’un patient « ressemble » à un groupe malgré des données hétérogènes – que la prétopologie offre un cadre naturel : elle permet de construire des zones d’influence flexibles, sans imposer de distance artificielle ni d’hypothèses sur la structure des données.

Une solution en développement : mesurer la similarité autrement

Pour cela, au lieu de chercher à mesurer des distances, nous proposons de changer de perspective en définissant des « voisinages », construits via des formes normales disjonctives, ou DNF. Derrière ce nom se cachent des règles logiques simples du type : « Un patient appartient au voisinage d’un groupe si (il est diabétique ET âgé de plus de 60 ans) OU (il a des antécédents familiaux ET est hypertendu) ». Chaque condition entre parenthèses est un bloc ; le voisinage est l’union de ces blocs. Pas de chiffres, pas de distance : seulement des combinaisons de caractéristiques, comme des règles de décision lisibles.

Une fois les voisinages définis, on calcule pour chaque groupe l’ensemble de tous les patients qui lui « adhèrent » – c’est-à-dire qui tombent dans au moins un de ces blocs DNF. Ce calcul d’adhérence est itératif : à chaque étape, des patients rejoignent ou quittent un groupe, jusqu’à stabilisation. Le résultat est analogue à un dendrogramme : on obtient une hiérarchie de regroupements successifs, du plus local (blocs fins, peu de patients) au plus global (grands groupes stables), sans avoir jamais posé de distance artificielle entre catégories et chiffres.

Une analogie aide à comprendre. Sur une carte géographique, on mesure la distance entre Paris et Lyon en kilomètres. Mais on peut aussi dire que Dijon est voisine de Lyon parce qu’elles partagent des caractéristiques : région similaire, climat comparable, économie proche. Cette notion de « voisinage » par caractéristiques communes ne nécessite pas de calculer une distance précise.

Notre algorithme en accès libre pour des études pilotes

C’est le principe de base de PretopoMD, notre algorithme qui classe automatiquement des données mixtes (chiffres et catégories) tout en rendant explicite sa logique de regroupement. Pour les chiffres, deux valeurs sont voisines si elles tombent dans la même fenêtre : toutes les glycémies entre 5 et 7 mmol/L sont voisines. Pour les catégories, deux observations sont voisines si elles partagent la même modalité : deux patients sont voisins s’ils sont tous deux fumeurs, ou si tous deux ont des antécédents familiaux.

PretopoMD est d’ores et déjà disponible en accès libre pour permettre à des équipes en santé, RH ou maintenance de l’utiliser pour des études pilotes. À moyen terme, nous espérons que cette approche puisse aider les organisations européennes à répondre aux exigences de l’AI Act en proposant des classifications explicables par construction.

L’avantage clé est la traçabilité. Pour notre exemple médical, on peut dire :

« Les patients A et C sont dans le même groupe parce qu’ils partagent une glycémie dans la fenêtre 5-7 millimoles par litres (étape 1), tous deux ont des antécédents familiaux (étape 1), et tous deux ont un IMC entre 25-30 (étape 2). Le patient B les rejoint à l’étape 3 via un IMC similaire, malgré l’absence d’antécédents. »

Cette explication pas-à-pas répond directement aux exigences de l’AI Act. De plus, la structure hiérarchique est préservée, on peut identifier grands groupes et sous-groupes pertinents.

Néanmoins, notre algorithme possède des limites, puisqu’il faut choisir la taille des fenêtres et les seuils de similarité, faisant actuellement appel à un expert métier. Nous travaillons sur des méthodes pour automatiser ces choix.

Ainsi, la question reste ouverte : jusqu’où peut-on pousser la performance tout en conservant l’explicabilité ? Dans des domaines sensibles comme la santé ou le droit, ce compromis est-il acceptable ? Notre travail montre qu’on peut au moins explorer cette voie.

Guillaume Guérard ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.