23.02.2026 à 17:09

Une nouvelle technique permet (enfin) de révéler les fonds marins côtiers du monde entier

Texte intégral (1680 mots)

Bien connaître les fonds marins est crucial dans de nombreux domaines. Or, jusqu’à présent on ne savait en cartographier qu’une très faible proportion. Une nouvelle méthode permet, en utilisant des satellites, de mesurer les caractéristiques des vagues afin d’estimer la profondeur et donc de mieux connaître les fonds marins à l’échelle des côtes du monde entier.

Nous connaissons bien les cartes topographiques des zones terrestres, avec leurs plaines, vallées, canyons et sommets. La topographie sous-marine est beaucoup moins connue, car elle est difficile à voir et à mesurer. Pourtant, lors du dernier âge glaciaire, lorsque le niveau de la mer se situait 120 mètres plus bas et qu’il était possible de traverser la Manche à pied, ces zones étaient apparentes. Dans le passé, la Méditerranée se serait également asséchée par évaporation, coupant le lien avec l’océan Atlantique à Gibraltar et révélant aux habitants de la Terre de l’époque ses fonds marins. Malheureusement, pour les explorer au sec, il faudrait que les fonds marins se découvrent, mais les prévisions actuelles de changement climatique, liées aux activités anthropiques, indiquent plutôt une hausse du niveau de la mer de l’ordre du mètre pour le XXIe siècle.

Cartographier ces fonds marins est un véritable enjeu actuel pour de multiples aspects : navigation, développement des énergies marines renouvelables (éoliennes, câbles sous-marins), mais aussi sécurité civile et risques de submersion/érosion. Ces mesures sont réalisées au moyen de navires océanographiques équipés de sondes (poids au bout d’un fil, puis échosondeurs), ce qui est coûteux et dangereux notamment lorsqu’il s’agit de s’approcher des petits fonds, en présence de vagues et de courants.

Des fonds encore largement méconnus

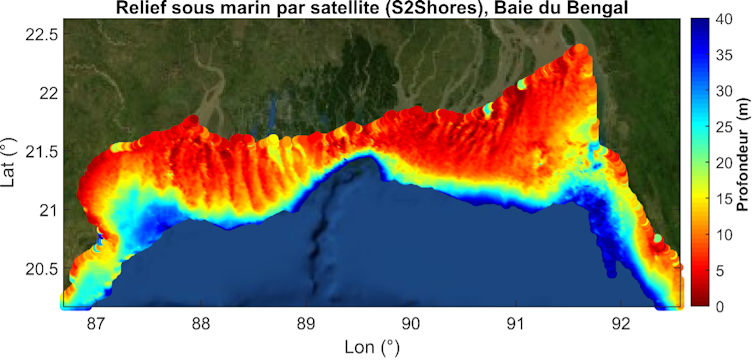

En France, c’est le Service hydrographique et océanographique de la Marine (Shom) qui est chargé de la cartographie des fonds marins pour le compte de l’État. Avec près de 11 millions de km2, la France possède la deuxième plus grande zone maritime au monde et le Shom ne peut mesurer qu’environ 1 % de cette surface. Au niveau mondial, seulement environ la moitié des zones côtières ont été mesurées, souvent une seule fois, et ces informations datent souvent de plusieurs décennies. Or, ces fonds peuvent évoluer sous l’action de mouvements tectoniques, de déplacements sédimentaires dus aux vagues et aux courants, aux rivières et aux estuaires, ainsi qu’aux dunes et bancs de sable sous-marins, aux chenaux de navigation, etc. Une réactualisation régulière est donc primordiale. Aujourd’hui, les missions de satellites d’observation de la Terre sont de plus en plus nombreuses, fréquentes et précises, offrant des capacités d’observation inégalées et en constante progression. C’est dans ce contexte que nous avons cherché à développer, avec le programme S2Shores (Satellites to Shores), une approche permettant d’utiliser cette nouvelle opportunité pour cartographier l’ensemble des fonds marins côtiers à l’échelle mondiale par satellite.

Dans un environnement côtier très dynamique, il est essentiel pour la sécurité de la navigation de disposer d’un état actualisé des fonds marins. Cela permet également d’améliorer la précision des modèles de vagues, de marée et de courants, dont les performances dépendent principalement de la connaissance de l’état des fonds marins. Face à l’augmentation des risques de submersion et d’érosion côtières liée au changement climatique, il est essentiel de pouvoir anticiper et prévenir ces phénomènes dans le cadre d’événements extrêmes. Cela permet également de réaliser des bilans sédimentaires en quantifiant les stocks de sable. Dans les pays du Sud, qui ne bénéficient pas de moyens traditionnels coûteux de cartographie des fonds marins, les promesses offertes par ces nouvelles techniques satellitaires, ainsi que les attentes, sont grandes.

Comment fonctionne cette nouvelle méthodologie ?

Les méthodes satellitaires existantes pour estimer les fonds marins sont principalement basées sur l’observation directe du fond : on mesure ce que l’on voit. Cette approche est efficace dans les eaux claires et transparentes, comme dans les atolls, mais elle est moins performante dans les eaux turbides et troubles, comme autour des panaches de rivières, dans les zones sableuses ou vaseuses. En moyenne, on considère que la profondeur atteignable est d’environ 15 mètres. Une calibration avec des mesures sur place, dites in situ, est la plupart du temps nécessaire.

L’approche que nous avons développée est fondée sur une méthode inverse : on mesure les vagues dont les caractéristiques géométriques (longueur d’onde, c’est-à-dire la distance entre deux crêtes) et cinématiques (vitesse) sont modulées par les fonds marins en zone côtière afin d’estimer la profondeur. Cette méthode permet d’étendre le champ d’application des méthodes spatiales aux eaux turbides et plus profondes, jusqu’aux plateaux continentaux, à des profondeurs de plus de 50 mètres, soit une augmentation potentielle de +58 % ou 3,1 millions de km2 par rapport aux méthodes basées sur la couleur de l’eau avec une moyenne mondiale grossière de visibilité des fonds de 15 mètres.

En pratique, nous utilisons les images optiques des satellites de la mission Sentinel-2 de l’Agence spatiale européenne, qui offrent une réactualisation régulière, de l’ordre de cinq à dix jours selon les zones, avec une résolution de 10 mètres. Sentinel-2 dispose de plusieurs bandes de couleur, dont le rouge et le vert, que nous utilisons ici. Ces bandes ne sont pas acquises exactement au même moment. C’est ce décalage d’environ 1 seconde entre ces deux bandes que nous exploitons pour détecter la propagation des vagues, de l’ordre de 1 à 10 mètres par seconde. Tout cela est possible avec un satellite qui passe à environ 700 km d’altitude et 7 km par seconde.

Établir cet atlas global des fonds marins des zones côtières est également une prouesse en termes de traitement de masse de plus d’un million d’images sur le supercalculateur TREX du Cnes, où sont également stockées toutes ces images pour un temps d’accès minimum.

Une chaîne de traitement a été réalisée dans le cadre du programme S2Shores afin d’optimiser ces traitements de manière automatisée.

Nous continuons à faire progresser le cœur du code d’estimation des fonds marins et incorporons différentes missions, comme la récente C03D développée conjointement par le Cnes et Airbus Defence and Space. Après cette démonstration globale à basse résolution (1 km), ces codes sont ouverts et libres d’utilisation pour répondre à des besoins spécifiques, comme des projets d’aménagement, par exemple, ou dans le cadre de jumeaux numériques pour réaliser des scénarios d’inondation ou d’érosion côtière, lorsqu’ils sont combinés à un modèle numérique.

Rafael Almar a reçu des financements de l'Agence Nationale de la Recherche (ANR) à travers le projet GLOBCOASTS (ANR-22-ASTR-0013)

Erwin Bergsma a reçu des financements du CNES.

Sophie Loyer a reçu des financements de l'Agence Nationale de la Recherche (ANR) à travers le projet GLOBCOASTS (ANR-22-ASTR-0013)

23.02.2026 à 11:37

L’IA est conçue pour terminer le travail, pas pour le commencer

Texte intégral (1354 mots)

L’IA ne remplace pas la collaboration humaine. C’est un outil qui repose sur le bon timing. Utilisée trop tôt, elle court-circuite la réflexion. Utilisée au bon moment, elle fait gagner du temps. Alors où l’IA est-elle la plus utile dans un projet, de la phase de lancement à la phase de suivi ?

Certains et certaines d’entre nous sont passés par là. Il est 16 h un mardi. Le tableau blanc est couvert de gribouillis, mais la « grande idée » ne vient pas. Le silence règne dans la pièce. L’énergie s’est évaporée dans l’air. Puis, quelqu’un ouvre son ordinateur portable et tape un prompt dans ChatGPT.

L’écran se remplit instantanément de points et de mots. La tension retombe. L’équipe approuve d’un signe de tête : on dirait une stratégie. On dirait un plan d’action. On dirait un progrès.

Mais ce n’est pas le cas.

Une expérience menée par le Boston Consulting Group révèle que cette sensation de soulagement est un piège : les performances de 750 consultants utilisant l’IA ont été inférieures de 23 % à celles de leurs collègues qui n’utilisaient pas l’IA.

Ce n’est pas un cas isolé. Cette expérience est symptomatique d’une incompréhension plus large sur la manière d’utiliser l’intelligence artificielle au bon moment.

C’est pourquoi dans une étude récente impliquant 107 consultants d’une entreprise du classement états-unien Fortune 500, nous avons suivi les performances des équipes utilisant l’IA lors d’un hackathon. Ces dernières devaient élaborer un plan de projet (objectifs, étapes, ressources et délais du projet) pour le lancement d’une nouvelle solution numérique.

Les résultats remettent en question l’idée selon laquelle « il vaut mieux trop que pas assez ». Nous avons constaté que l’IA générative offre une valeur ajoutée pendant la phase d’exécution d’un projet. Cependant, durant la phase critique de lancement, elle offre une valeur négligeable, voire parfois négative.

Le piège de la « moyenne »

Pourquoi un outil fondé sur la somme des connaissances humaines échoue-t-il dès le départ ? La réponse est simple : l’IA excelle dans les schémas préétablis, mais elle est mauvaise pour naviguer dans le flou, ou ce que les sciences de gestion nomment l’ambiguïté.

Lancer un projet nécessite une « pensée divergente ». Vous devez explorer des idées folles et contradictoires pour trouver une proposition de valeur unique.

Nos données montrent que l’IA générative nuit aux performances dans cette phase précise. Cette idée correspond au « principe de pertinence » dans la recherche en management. Comme les grands modèles linguistiques en IA sont des moteurs probabilistes, ils ne peuvent logiquement traduire une discussion spontanée. Le « mot suivant » rédigée par une IA est tiré d’une moyenne statistique des mots probables liés au mot précédent, au lieu d’un mot précis et idoine.

À lire aussi : Pourquoi l’IA oblige les entreprises à repenser la valeur du travail

Si ces algorithmes permettent d’éviter les idées « désastreuses », ils tuent les idées « farfelues ». L’IA rehausse le niveau de qualité minimum d’un projet en nivelant par le bas le niveau de qualité maximum. Vous obtenez un concept soigné, robuste, mais tout à fait moyen.

Moteur du « comment »

Une fois que les humains ont défini le « pourquoi » et le « quoi », l’IA devient le moteur du « comment ».

Comme nous le soulignons dans notre recherche, l’utilisation de l’IA se révèle davantage pertinente pendant les phases de planification et d’exécution. La « planification » consiste à transformer les objectifs en calendriers. L’« exécution » consiste à rédiger les livrables, tels que le code ou les textes marketing.

Deux mécanismes sont à l’origine de cette augmentation des performances lors de ces deux phases précises :

Traducteur des expertises

Des recherches suggèrent que l’IA agit comme un traducteur dans une équipe, notamment pour les experts. Par exemple, elle aide un spécialiste du marketing à rédiger un dossier technique ou un développeur à rédiger un communiqué de presse. Par ricochet, l’IA réduit les coûts de coordination.

Tâches fastidieuses

L’IA se charge des tâches fastidieuses telles que la rédaction de codes standardisés ou de diapositives. Dès lors, les humains peuvent se consacrer à des tâches à forte valeur ajoutée.

Signalement du « patron numérique »

La dernière phase, celle du suivi, recèle un danger caché.

Les outils modernes d’IA peuvent analyser les échanges de courriels, afin de détecter les risques humains autour d’un projet, comme une baisse de moral ou un stress avant qu’une échéance ne soit dépassée.

À lire aussi : Et si votre prochain collègue était un agent IA ?

Une étude sur le marketing d’influence nous met en garde : lorsque les employés se sentent surveillés par des algorithmes, l’authenticité disparaît. Ils commencent à « manipuler les indicateurs », en travaillant pour satisfaire l’IA plutôt que pour atteindre l’objectif.

Si l’IA devient un « patron numérique », la sécurité psychologique s’érode. Les équipes cessent de signaler honnêtement les risques d’un projet pour éviter d’être eux-mêmes signalées par l’IA.

Une stratégie en fonction des étapes

Les dirigeants doivent cesser de considérer l’IA générative comme une solution universelle. Ils doivent plutôt adopter une stratégie en fonction des étapes d’un projet.

Au cours de la phase de lancement

Établissez des « zones réservées aux humains ». Obligez les équipes à définir le problème sans algorithmes.

Au cours de la phase d’exécution

Utilisez l’IA pour faire se comprendre les équipes, notamment les experts, et accélérer les tâches fastidieuses et ingrates.

Au cours de la phase de suivi

Utilisez l’IA pour donner de la visibilité à l’équipe, non pour l’espionner.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

22.02.2026 à 08:17

What is ‘Edge AI’? What does it do and what can be gained from this alternative to cloud computing?

Texte intégral (1949 mots)

“Edge computing”, which was initially developed to make big data processing faster and more secure, has now been combined with AI to offer a cloud-free solution. Everyday connected appliances from dishwashers to cars or smartphones are examples of how this real-time data processing technology operates by letting machine learning models run directly on built-in sensors, cameras, or embedded systems.

Homes, offices, farms, hospitals and transportation systems are increasingly embedded with sensors, creating significant opportunities to enhance public safety and quality of life.

Indeed, connected devices, also called the Internet of Things (IoT), include temperature and air quality sensors to improve indoor comfort, wearable sensors to monitor patient health, LiDAR and radar to support traffic management, and cameras or smoke detectors to enable rapid-fire detection and emergency response.

These devices generate vast volumes of data that can be used to ‘learn’ patterns from their operating environment and improve application performance through AI-driven insights.

For example, connectivity data from wi-fi access points or Bluetooth beacons deployed in large buildings can be analysed using AI algorithms to identify occupancy and movement patterns across different periods of the year and event types, depending on the building type (e.g. office, hospital, or university). These patterns can then be leveraged for multiple purposes such as HVAC optimisation, evacuation planning, and more.

Combining the Internet of things and artificial intelligence comes with technical challenges

Artificial Intelligence of Things (AIoT) combines AI with IoT infrastructure to enable intelligent decision-making, automation, and optimisation across interconnected systems. AIoT systems rely on large-scale, real-world data to enhance accuracy and robustness of their predictions.

To support inference (that is, insights from collected IoT data) and decision-making, IoT data must be effectively collected, processed, and managed. For example, occupancy data can be processed to infer peak usage times in a building or predict future energy needs. This is typically achieved by leveraging cloud-based platforms like Amazon Web Services, Google Cloud Platform, etc. which host computationally intensive AI models – including the recently introduced Foundation Models.

What are Foundation Models?

- Foundation Models are a type of Machine Learning model trained on broad data and designed to be adaptable to various downstream tasks. They encompass, but are not limited to, Large Language Models (LLMs), which primarily process textual data, but can also operate on other modalities, such as images, audio, video, and time series data.

- In generative AI, Foundation Models serve as the base for generating content such as text, images, audio, or code.

- Unlike conventional AI systems that rely heavily on task-specific datasets and extensive preprocessing, FMs introduce zero-shot and few-shot capabilities, allowing them to adapt to new tasks and domains with minimal customisation.

- Although FMs are still in the early stages, they have the potential to unlock immense value for businesses across sectors. Therefore, the rise of FMs marks a paradigm shift in applied artificial intelligence.

The limits of cloud computing on IoT data

While hosting heavyweight AI or FM-based systems on cloud platforms offers the advantage of abundant computational resources, it also introduces several limitations. In particular, transmitting large volumes of IoT data to the cloud can significantly increase response times for AIoT applications, often with delays ranging from hundreds of milliseconds to several seconds, depending on network conditions and data volume.

Moreover, offloading data – particularly sensitive or confidential information – to the cloud raises privacy concerns and limits opportunities for local processing near data sources and end users.

For example, in a smart home, data from smart meters or lighting controls can reveal occupancy patterns or enable indoor localisation (for example, detecting that Helen is usually in the kitchen at 8:30 a.m. preparing breakfast). Such insights are best derived close to the data source to minimise delays from edge-to-cloud communication and reduce exposure of private information on third-party cloud platforms.

À lire aussi : Cloud-based computing: routes toward secure storage and affordable computation

What is edge computing and edge AI?

To reduce latency and enhance data privacy, Edge computing is a good option as it provides computational resources (i.e. devices with memory and processing capabilities) closer to IoT devices and end users, typically within the same building, on local gateways, or at nearby micro data centres.

However, these edge resources are significantly more limited in processing power, memory, and storage compared to centralised cloud platforms, which pose challenges for deploying complex AI models.

To address this, the emerging field of Edge AI – particularly active in Europe – investigates methods for efficiently running AI workloads at the edge.

One such method is Split Computing, which partitions deep learning models across multiple edge nodes within the same space (a building, for instance), or even across different neighbourhoods or cities. Deploying these models in distributed environments is non-trivial and requires sophisticated techniques. The complexity increases further with the integration of Foundation Models, making the design and execution of split computing strategies even more challenging.

What does it change in terms of energy consumption, privacy, and speed?

Edge computing significantly improves response times by processing data closer to end users, eliminating the need to transmit information to distant cloud data centres. Beyond performance, edge computing also enhances privacy, especially with the advent of Edge AI techniques.

For instance, Federated Learning enables Machine Learning model training directly on local Edge (or possibly novel IoT) devices with processing capabilities, ensuring that raw data remain on-device while only model updates are transmitted to Edge or cloud platforms for aggregation and final training.

Privacy is further preserved during inference: once trained, AI models can be deployed at the Edge, allowing data to be processed locally without exposure to cloud infrastructure.

This is particularly valuable for industries and SMEs aiming to leverage Large Language Models within their own infrastructure. Large Language Models can be used to answer queries related to system capabilities, monitoring, or task prediction where data confidentiality is essential. For example, queries can be related to the operational status of industrial machinery such as predicting maintenance needs based on sensor data where protecting sensitive or usage data is essential.

In such cases, keeping both queries and responses internal to the organisation safeguards sensitive information and aligns with privacy and compliance requirements.

How does it work?

Unlike mature cloud platforms, such as Amazon Web Services and Google Cloud, there are currently no well-established platforms to support large-scale deployment of applications and services at the Edge.

However, telecom providers are beginning to leverage existing local resources at antenna sites to offer compute capabilities closer to end users. Managing these Edge resources remains challenging due to their variability and heterogeneity – often involving many low-capacity servers and devices.

In my view, maintenance complexity is a key barrier to deploying Edge AI services. At the same time, advances in Edge AI present promising opportunities to enhance the utilisation and management of these distributed resources.

Allocating resources across the IoT-Edge-Cloud continuum for safe and efficient AIoT applications

To enable trustworthy and efficient deployment of AIoT systems in smart spaces such as homes, offices, industries, and hospitals; our research group, in collaboration with partners across Europe, is developing an AI-driven framework within the Horizon Europe project PANDORA.

PANDORA provides AI models as a Service (AIaaS) tailored to end-user requirements (e.g. latency, accuracy, energy consumption). These models can be trained either at design time or at runtime using data collected from IoT devices deployed in smart spaces. In addition, PANDORA offers Computing resources as a Service (CaaS) across the IoT–Edge–Cloud continuum to support AI model deployment. The framework manages the complete AI model lifecycle, ensuring continuous, robust, and intent-driven operation of AIoT applications for end users.

At runtime, AIoT applications are dynamically deployed across the IoT–Edge–Cloud continuum, guided by performance metrics such as energy efficiency, latency, and computational capacity. CaaS intelligently allocates workloads to resources at the most suitable layer (IoT-Edge-Cloud), maximising resource utilisation. Models are selected based on domain-specific intent requirements (e.g. minimising energy consumption or reducing inference time) and continuously monitored and updated to maintain optimal performance.

A weekly e-mail in English featuring expertise from scholars and researchers. It provides an introduction to the diversity of research coming out of the continent and considers some of the key issues facing European countries. Get the newsletter!

This work has received funding from the European Union’s Horizon Europe research and innovation actions under grant agreement No. 101135775 (PANDORA) with a total budget of approximately €9 million and brings together 25 partners from multiple European countries, including IISC and UOFT from India and Canada.