ACCÈS LIBRE

27.10.2025 à 07:42

Khrys’presso du lundi 27 octobre 2025

Khrys

Texte intégral (7481 mots)

Comme chaque lundi, un coup d’œil dans le rétroviseur pour découvrir les informations que vous avez peut-être ratées la semaine dernière.

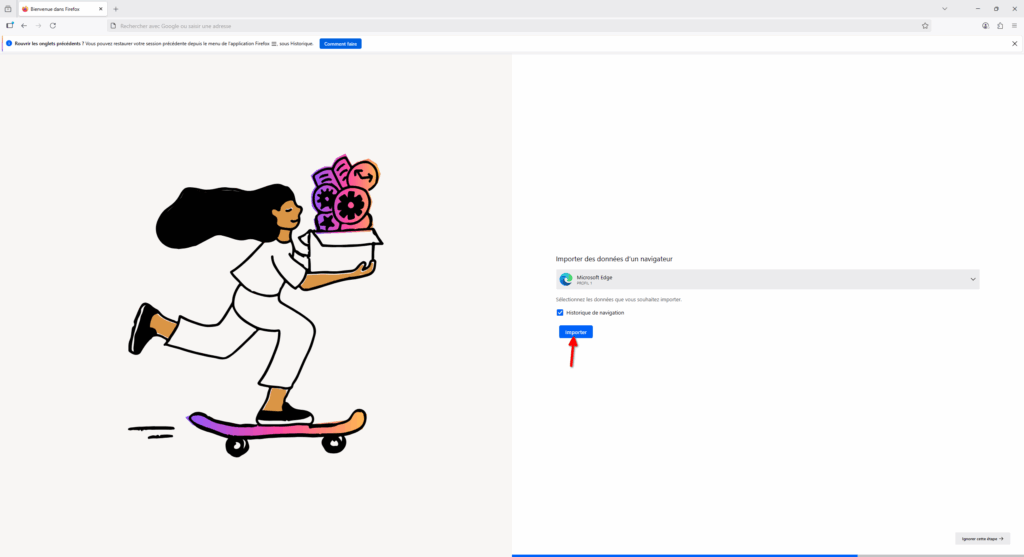

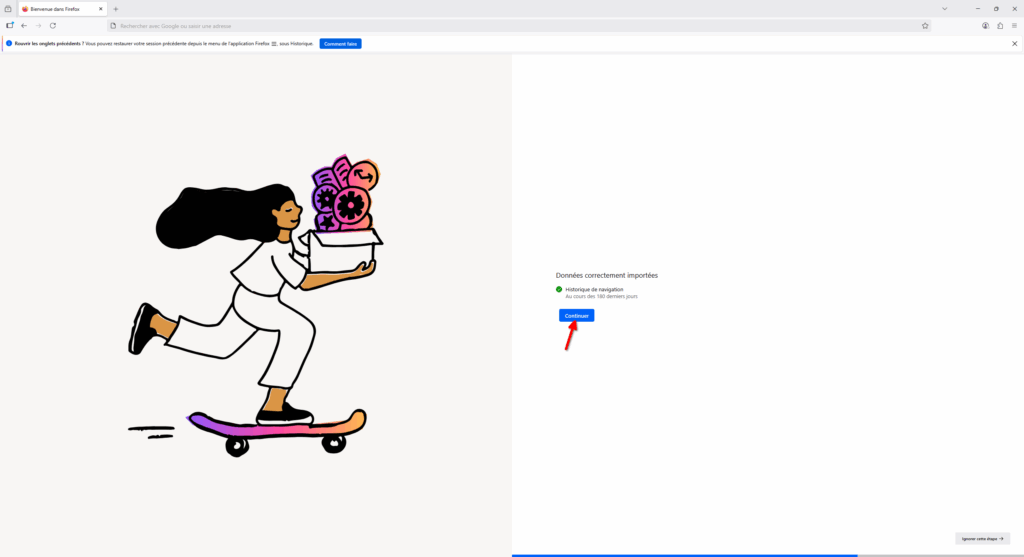

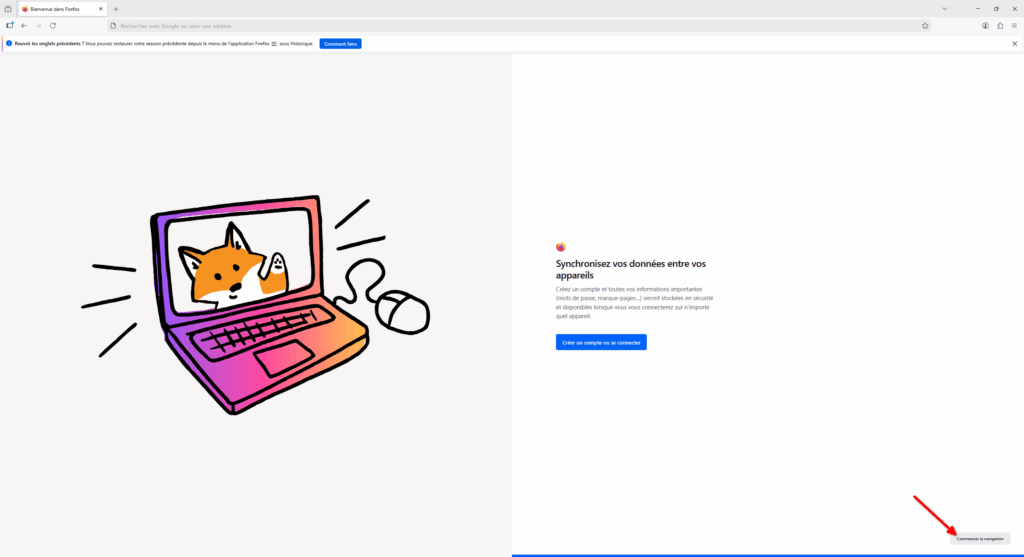

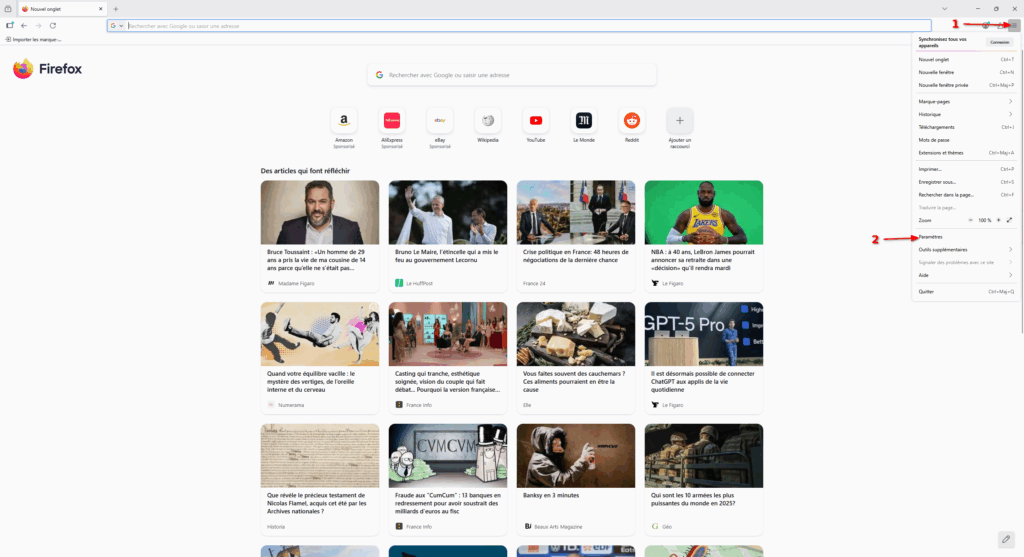

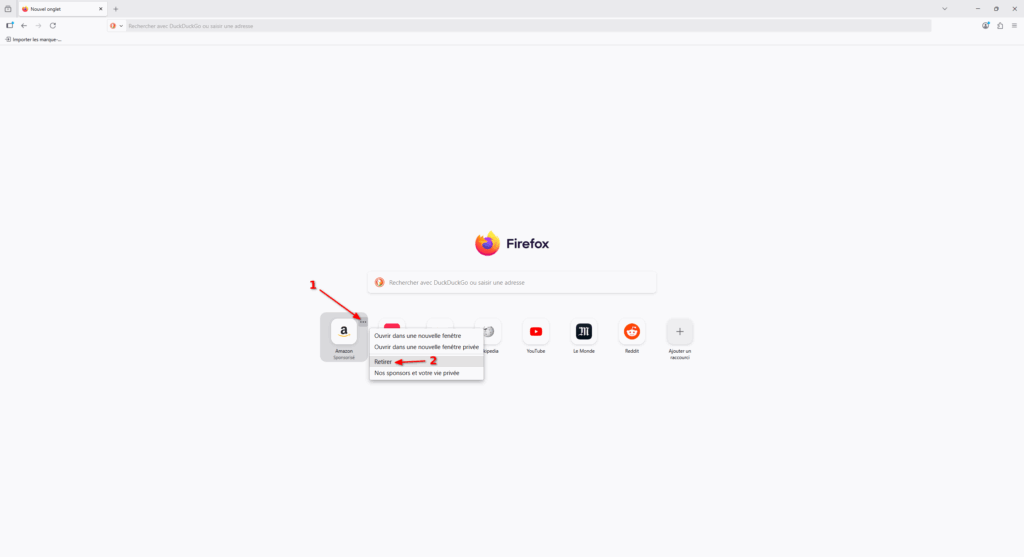

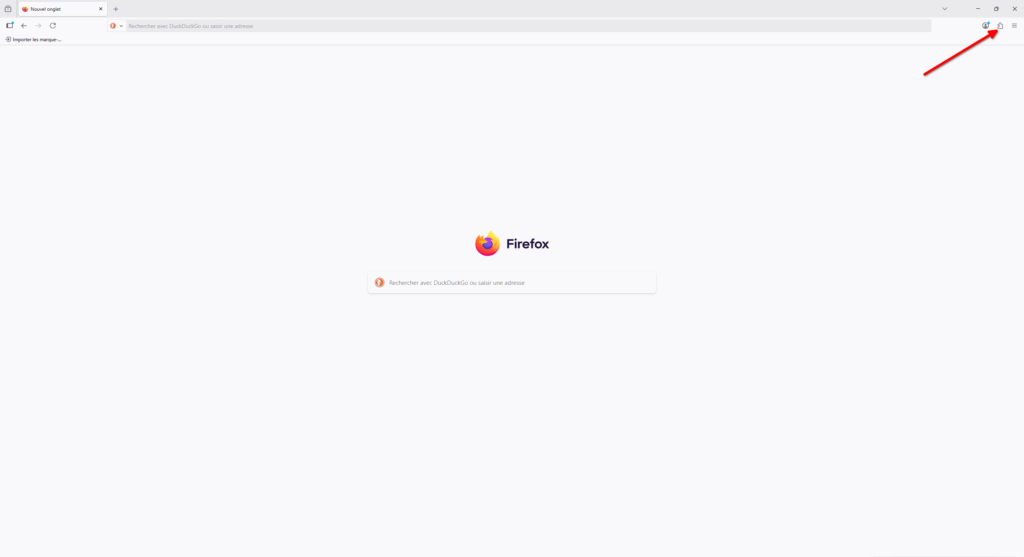

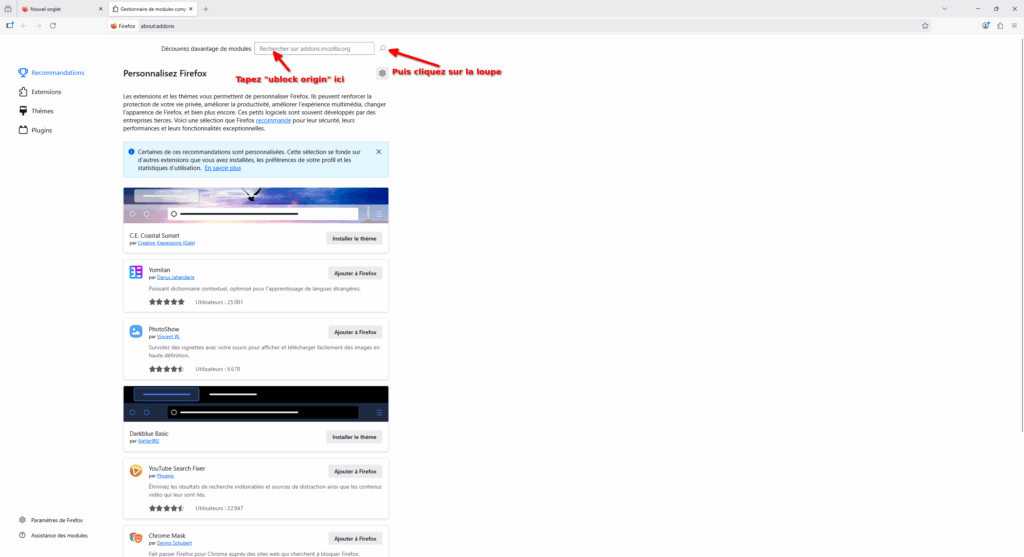

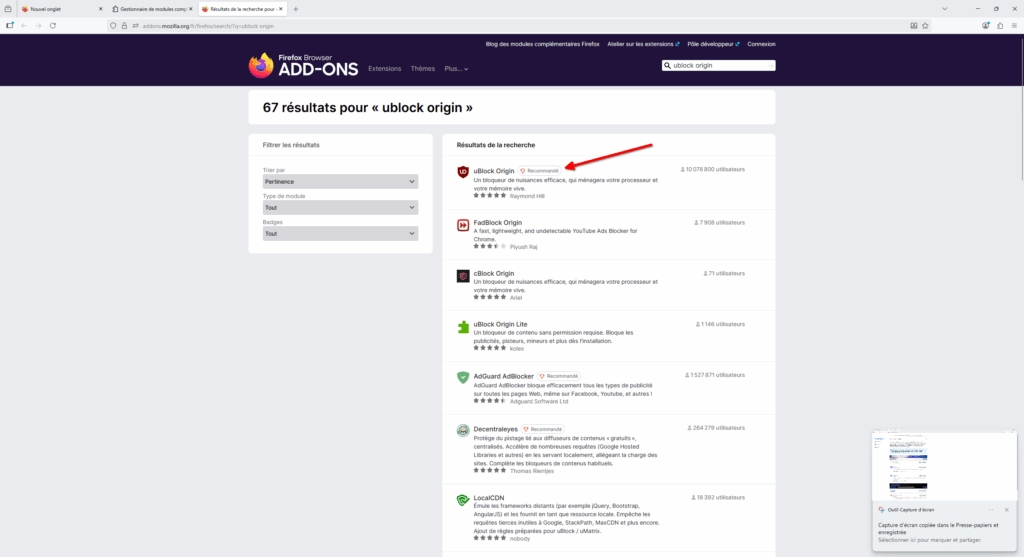

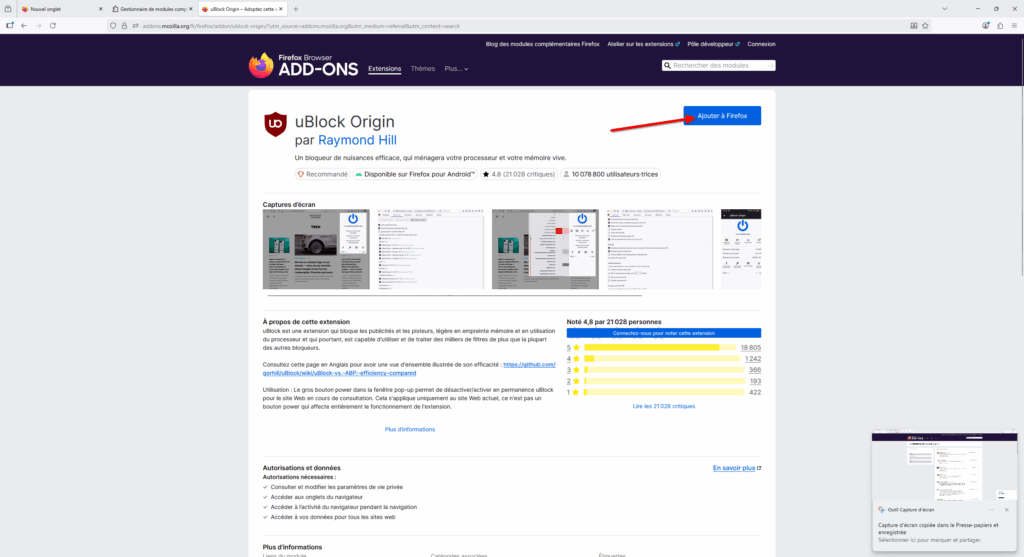

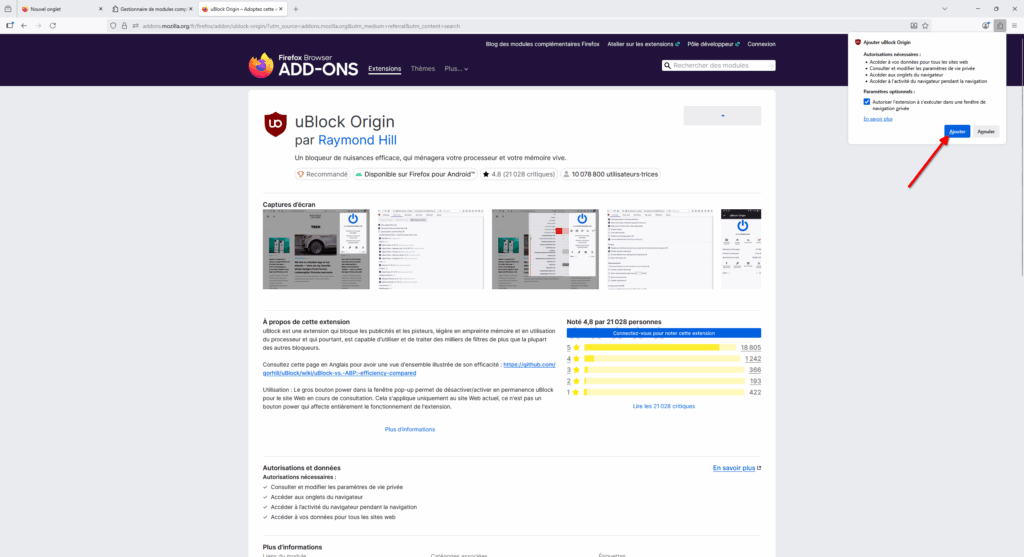

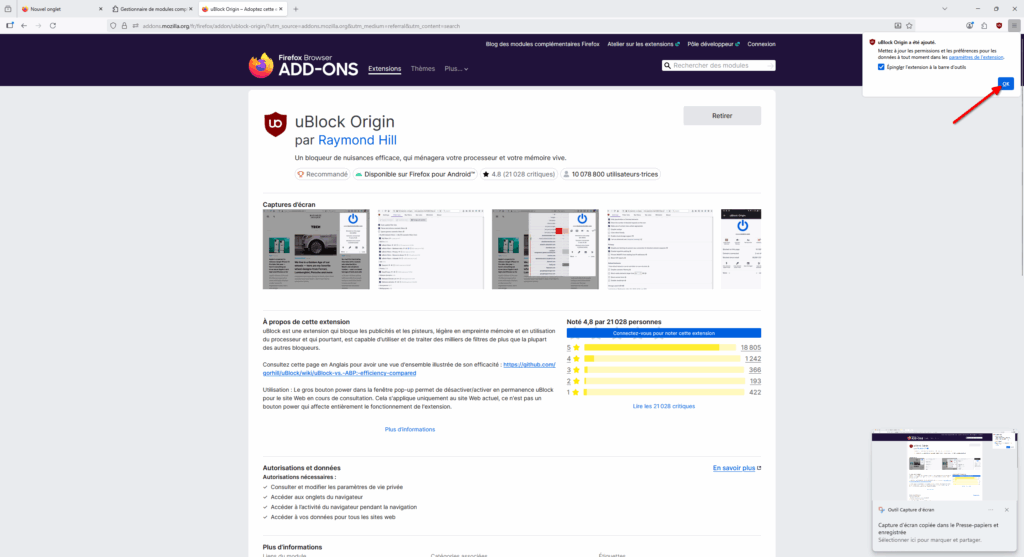

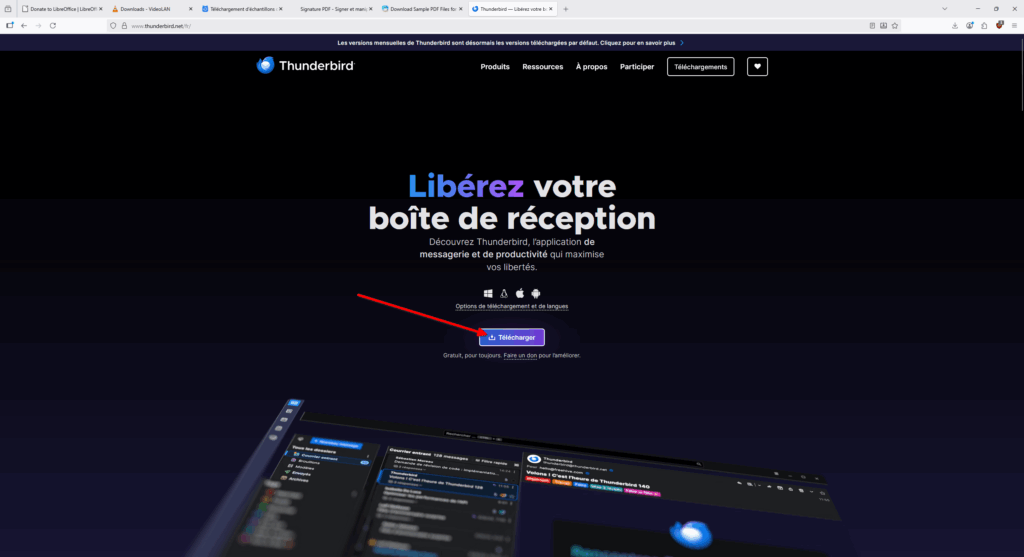

Tous les liens listés ci-dessous sont a priori accessibles librement. Si ce n’est pas le cas, pensez à activer votre bloqueur de javascript favori ou à passer en “mode lecture” (Firefox) ;-)

Brave New World

- 12 km2 de forêts détruits chaque heure, une déforestation qui ralentit mais reste inquiétante… Ce qu’il faut retenir du dernier rapport de la FAO (humanite.fr)

L’organisation onusienne a livré le 21 octobre son évaluation de l’état des forêts dans le monde pour la période 2015-2025. Si le rythme de déboisement a ralenti, il demeure inquiétant, et les forêts sont soumises à des menaces diverses.

- Sanae Takaichi, une dame de fer à la tête du gouvernement japonais (france24.com)

Sanae Takaichi devient la première femme Première ministre du Japon, dans un pays où la politique reste largement dominée par les hommes. Conservatrice assumée, proche de l’ancien Premier ministre Shinzo Abe dont elle revendique l’héritage, cette figure de l’aile droite du Parti libéral-démocrate incarne un tournant aussi symbolique que risqué.

- Japanese convenience stores are hiring robots run by workers in the Philippines (restofworld.org)

Filipino tele-operators remotely control Japan’s convenience store robots and train AI, benefiting from an uptick in automation-related jobs.

- Inde : pour faire face au « Delhi Smog », brouillard toxique, les autorités ensemencent les nuages (humanite.fr)

Alors que la pollution de l’air étouffe New Delhi et ses 30 millions d’habitants depuis plusieurs jours, les autorités locales s’en remettent à l’ensemencement des nuages pour provoquer des pluies artificielles et ainsi tenter de dissiper le brouillard toxique. Des essais ont été réalisés jeudi 23 octobre.

- ‘My existence will be illegal’ : LGBTQ community vilified by Turkish draft law (turkeyrecap.com)

- Two dead and dozens arrested amid Cameroon election crackdown (theguardian.com)

Wave of unrest as polling suggests victory in presidential race for 92-year-old incumbent Paul Biya

- Sahara occidental : le Front Polisario accepte de soumettre le plan d’autonomie proposé par le Maroc à un référendum (humanite.fr)

Le ministre des Affaires étrangères sahraoui, Mohamed Yeslem Beissat, a annoncé que le Front Polisario est prêt à accepter le plan d’autonomie marocain de 2007, sous conditions. Parmi elles, la mise en place d’un référendum pour sonder les Sahraouis et la garantie de « l’indépendance, l’intégration et (d’un) pacte d’association libre »

- Allemagne : L’armée s’exerce à la guerre intérieure et se fait tirer dessus (par la police) (secoursrouge.org)

- « On manipulait des produits toxiques comme si c’était de l’eau » : sur un site de TotalEnergies, des fuites à gogo (reporterre.net)

Au sud de l’Italie, TotalEnergies exploite le champ pétrolier Tempa Rossa. Les fuites d’hydrocarbures s’y multiplient depuis son ouverture en 2020. Des salariés s’estiment mis en danger par le fleuron français.

- Sous les serres andalouses, la face sombre du « potager de l’Europe », entre exploitation humaine et désastre écologique (humanite.fr)

À Almeria, des milliers d’hectares nourrissent l’Europe à bas prix. Une enquête d’UFC-Que choisir révèle l’envers du décor : un désastre écologique et social qui interroge tout le modèle agricole européen.

- Le moustique est arrivé en Islande, et c’est une mauvaise nouvelle pour les habitant·es (huffingtonpost.fr)

L’Islande était jusqu’à présent, avec l’Antarctique, l’un des rares endroits de la planète dépourvus de moustiques.

- Le directeur d’un prestataire US de failles « 0-day » accusé d’en avoir vendu à la Russie (next.ink)

Mardi, on apprenait qu’un employé de Trenchant, qui développe et revend des failles de sécurité informatique à la communauté du renseignement des « Five Eyes », aurait lui-même été ciblé par un logiciel espion.

- U.S. pulls plug on major NATO corruption probes – top suspects walk free (ftm.eu)

A NATO corruption scandal made international headlines when several suspects were arrested across Europe in May. Several months later, the U.S. dropped charges against four of them – including a Turkish defence magnate – despite strong evidence, a joint investigation reveals.

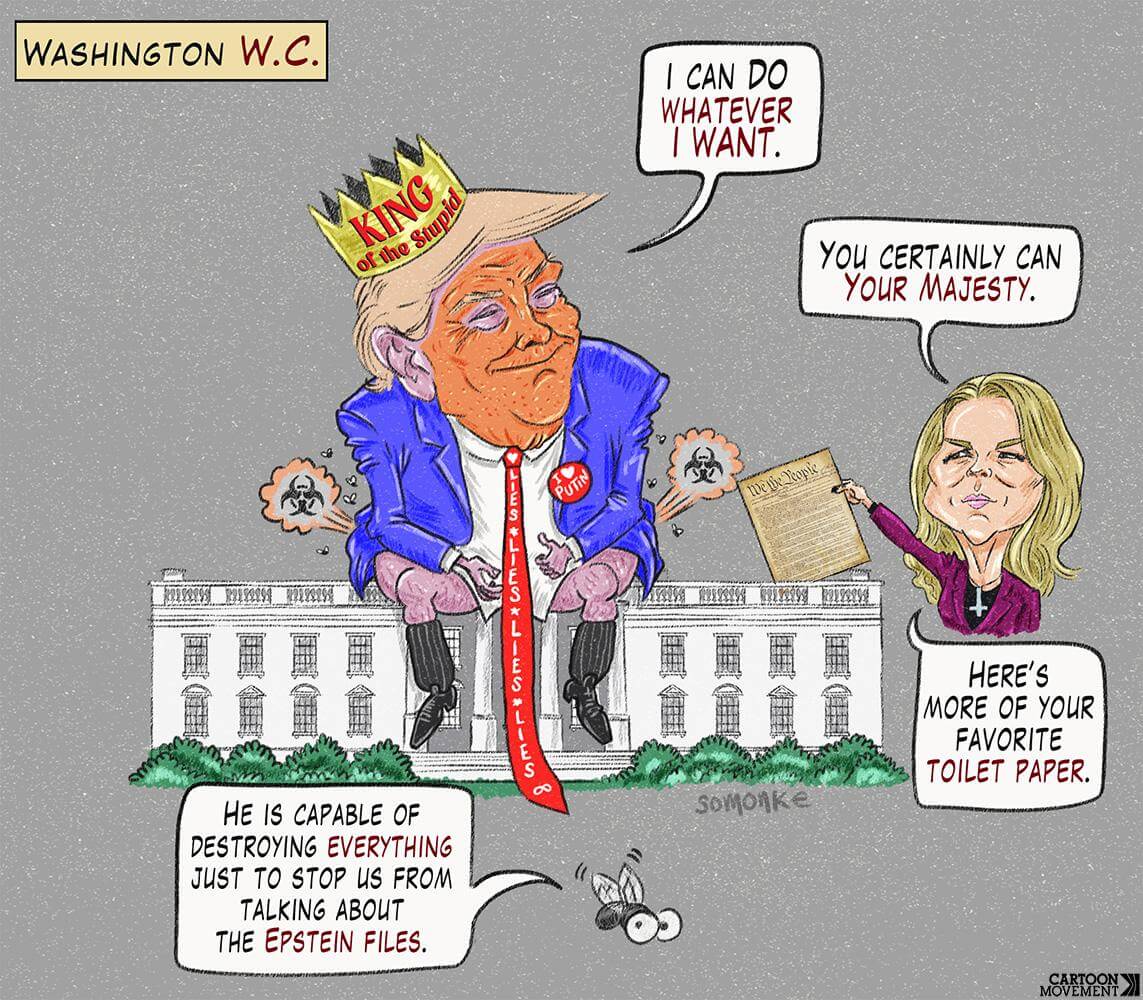

- Trump démolit une partie de la Maison Blanche pour assouvir ses envies démesurées (huffingtonpost.fr)

Les coûts de construction de la salle de bal de Donald Trump sont évalués à 250 millions de dollars, alors que les États-Unis connaissent depuis vingt jours une situation de « shutdown ».

Voir aussi La surface au sol de la salle de bal de Trump sera 4,5 fois plus importante que celle de la Maison-Blanche (legrandcontinent.eu) - Elon Musk Discovers What Hierarchy Actually Means (techdirt.com)

Elon Musk is having a very bad week. The man who bought Twitter for $44 billion to secure unaccountable power over public discourse is discovering what unaccountable power actually looks like when wielded by someone who understands dominance better than he does.Trump just stripped SpaceX of a government contract and handed it to Jeff Bezos.

- Budget record pour l’ICE : Trump déploie sa machine anti-immigration (politis.fr)

Avec plus de 120 milliards de dollars prévus d’ici à 2029, l’agence de l’immigration américaine connaît une expansion sans précédent. Centres de détention, recrutements massifs et expulsions à la chaîne deviennent les piliers du programme Trump.

- Aux États-Unis, « une esthétique de la peur au cœur de la médiatisation des expulsions » (politis.fr)

Chercheur spécialiste des expulsions forcées, WIlliam Walters décrypte la façon dont l’administration Trump organise sa politique migratoire. Il explique également comment la communication autour de ces pratiques violentes est présentée comme un « spectacle » pour le public américain.

- The Data Brokers Fueling ICE’s Deportation Machine—And the Union Shareholders Fighting Back (inthesetimes.com)

“As investors, we are thinking about this as a risk to our investments, but also as a social and ethical issue.”

- États-Unis : des pirates informatiques divulguent les informations personnelles de centaines de responsables de la Sécurité intérieure, du FBI et du DOJ (bfmtv.com)

“Guerre ouverte”. Alors que plus de sept millions de personnes ont battu le pavé ce week-end à travers les États-Unis, pour dénoncer les dérives autoritaires du président américain Donald Trump, la contestation contre sa politique se poursuit également en ligne.

- Kohler unveils a camera for your toilet (techcrunch.com)

Home goods company Kohler recently unveiled a new device called the Dekoda — a $599 camera that can be attached to your toilet bowl and take pictures of what’s inside.

- A lithium bust leaves Latin American towns in the dust (restofworld.org)

With plummeting prices and slowing demand for EVs, the once-thriving mining towns of Argentina, Chile, and Bolivia are now struggling.

- Créer des ovules humains à partir de la peau : vers une nouvelle fertilité ? (theconversation.com)

- Une étude montre que 60 ans est souvent l’âge de notre apogée (theconversation.com)

Raisonnement moral, stabilité émotionnelle, résistance aux biais cognitifs… autant de traits qui atteignent leur maturité bien après la jeunesse et qui expliquent pourquoi cette période de la vie peut être un âge d’or pour le jugement et le leadership.

- ‘The most violent attack ever documented’ : Five female bonobos kill a male, challenging beliefs about the species’ peaceful nature (english.elpais.com)

The lynching, captured on video deep in the jungle, sheds light on the reality of the animals. Females exert power over males, who are larger and stronger, through a matriarchy woven with intense social bonds

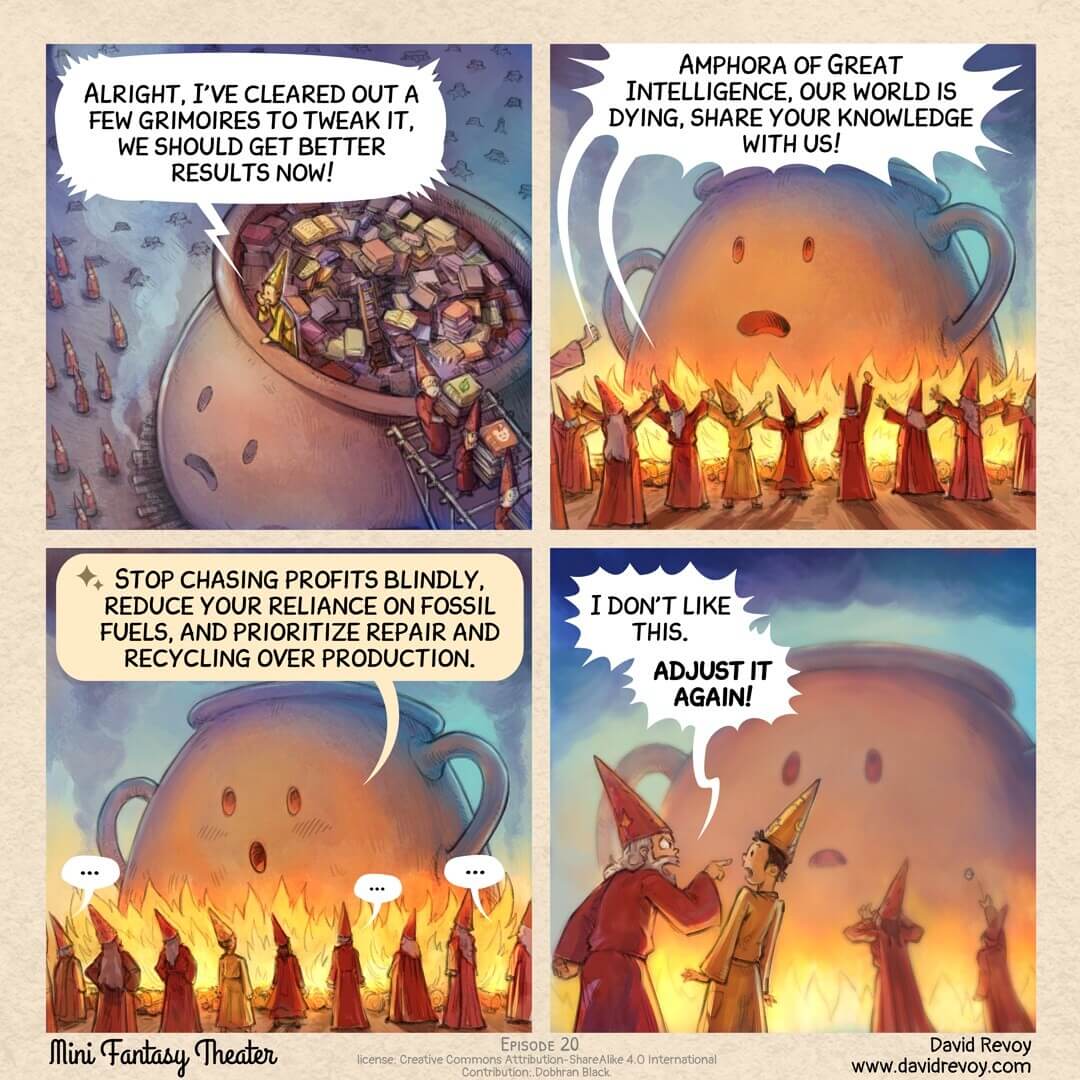

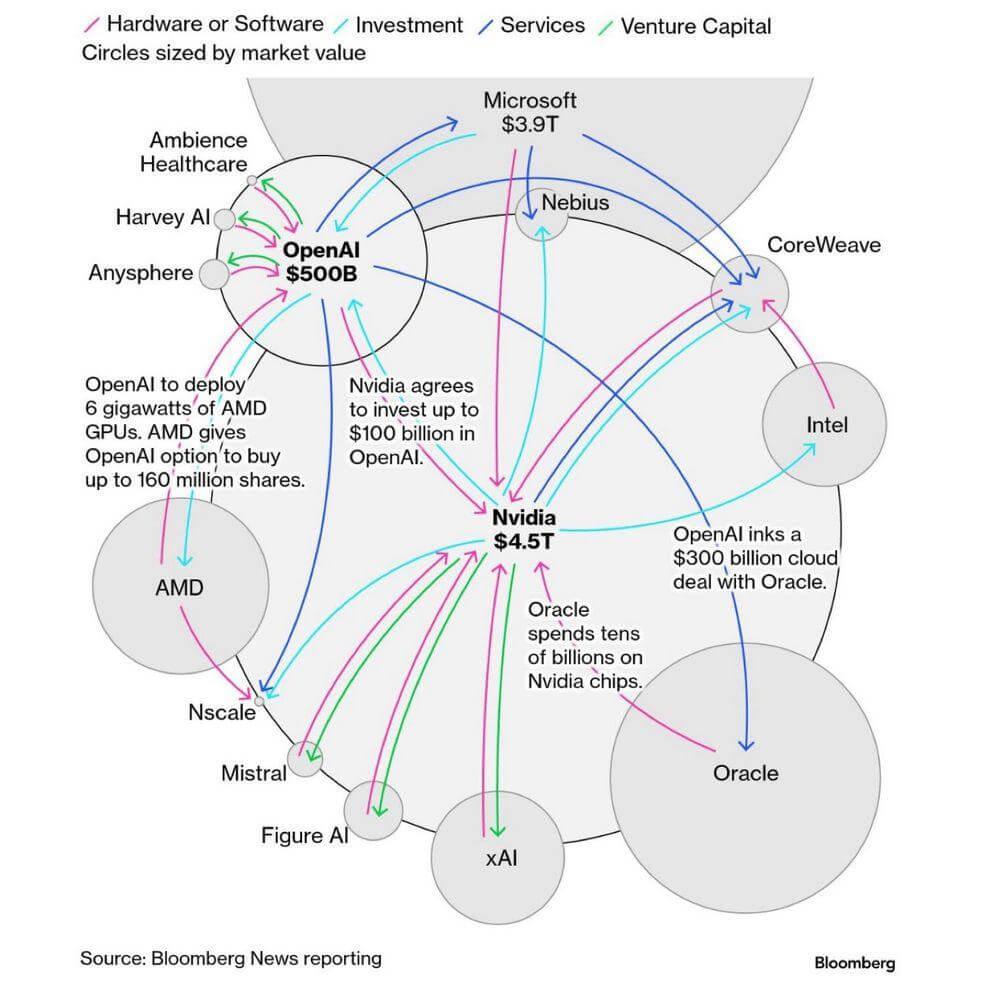

Spécial IA

- Netflix réalise son meilleur trimestre publicitaire et prépare des formats Ads dopés à l’IA (danstapub.com)

- OpenAI lance Atlas, son navigateur web propulsé par ChatGPT pour concurrencer Google (huffingtonpost.fr)

Ce navigateur sera dans un premier temps disponible uniquement pour le système d’exploitation macOS d’Apple.

- Microsoft vous observe en jeu pour entraîner son IA, mais vous pouvez le désactiver (clubic.com)

Microsoft déploie son assistant Gaming Copilot, un compagnon de jeu dopé à l’intelligence artificielle. Mais ce coach personnel a les yeux partout et n’hésite pas à envoyer vos sessions de jeu sur les serveurs de l’entreprise pour parfaire son éducation.

- What are the risks from Artificial Intelligence ? (airisk.mit.edu)

A comprehensive living database of over 1600 AI risks categorized by their cause and risk domain

- Tor Browser expulse les fonctionnalités IA de Firefox (generation-nt.com)

À contre-courant de la tendance actuelle, le projet Tor fait le choix de purger le navigateur Tor Browser de toute fonctionnalité IA héritée de Firefox.

- AI Is Hollowing Out Higher Education (project-syndicate.org)

While the AI industry claims its models can “think,” “reason,” and “learn,” their supposed achievements rest on marketing hype and stolen intellectual labor. In reality, AI erodes academic freedom, weakens critical reading, and subordinates the pursuit of knowledge to corporate interests.

- Belgian AI scientists resist the use of AI in academia (apache.be)

This summer, prominent Dutch AI scientists threw a spanner in the works with an open letter calling for a halt to the uncritical adoption of AI technologies in academia. Amongst the signatories is Luc Steels, a pioneer of AI research in Belgium.

- Computing Is Indeed a Discipline in Crisis (cacm.acm.org)

While Silicon Valley is investing tens of billions of dollars chasing the AGI dream, academic computing research in the U.S. is facing a severe drought.

- Largest study of its kind shows AI assistants misrepresent news content 45 % of the time – regardless of language or territory (bbc.co.uk)

‘This research conclusively shows that these failings are not isolated incidents […] They are systemic, cross-border, and multilingual, and we believe this endangers public trust. When people don’t know what to trust, they end up trusting nothing at all, and that can deter democratic participation.’

- Generative AI is a societal disaster (disconnect.blog)

Governments are deluding themselves into believing investment justifies allowing AI to upend society

- Autopsie de la bulle de l’intelligence artificielle (politis.fr)

Spécial Palestine et Israël

- Jewish and Israeli figures urge world leaders to act over ‘unconscionable’ Israeli acts in Gaza (middleeasteye.net)

Hundreds of artists, intellectuals and former Israeli officials warn ceasefire fails to address occupation, apartheid and denial of Palestinian rights

- Reconnaître l’État de Palestine, au milieu des ruines ? (contretemps.eu)

La vague récente de reconnaissances symboliques, initiée en 2024, semble désormais être la seule mesure que beaucoup de puissances européennes soient disposées à prendre face au génocide, après deux années de soutien moral, militaire et diplomatique continu au régime israélien.

- Libérations en Israël/Palestine : le deux poids, deux mesures bat son plein (acrimed.org)

Le 13 octobre, conformément à l’une des premières étapes du dit « plan Trump », des libérations d’Israéliens et de Palestiniens ont eu lieu. Mais comme en janvier 2025, dans les grands médias, un seul de ces deux événements a réellement existé.

- Évacuations de Gaza suspendues arbitrairement : le ministère des affaires étrangères révoque sa décision après la saisine du Conseil d’État (msf.fr)

Spécial femmes dans le monde

- La langue inclusive : lorsque des mythes font leur entrée dans les politiques publiques (theconversation.com)

De nombreuses études ont montré que l’écriture au masculin mène les lecteurs et lectrices à se représenter moins de femmes lors de la lecture. Au contraire, différentes formes d’écriture inclusive peuvent atténuer cet effet et améliorer la représentation de toutes personnes dans la langue […] Au-delà d’un débat linguistique, c’est la question du respect des droits fondamentaux qui est en jeu. La Charte des droits et libertés de la personne se veut un reflet des valeurs québécoises. En vertu de cette dernière, l’identité de genre et l’expression de genre sont des motifs de discrimination interdits.

- Intersex Awareness Day highlights a fight for rights that’s far from over (19thnews.org)

From a Boston protest to global recognition, the history of Intersex Awareness Day shines a light on decades of work to preserve bodily autonomy.

- Cop30 : les femmes d’Amazonie veulent une place dans les négociations (basta.media)

La trentième conférence internationale sur le climat, la Cop30, démarre le 10 novembre à Belém, en Amazonie brésilienne. Mais les populations amazoniennes n’ont pas été invitées à la table des négociations, dénoncent les femmes de la région.

- Ce que contient le livre posthume de Virginia Giuffre, principale accusatrice de Jeffrey Epstein (huffingtonpost.fr)

Dans « Nobody’s girl », Virginia Giuffre livre de nouveaux détails sur les abus qu’elle a subi au début des années 2000.

- Pastor who raged about kids seeing Pride flags arrested for child abuse (lgbtqnation.com)

Silas H. Shelton has been accused of abusing his religious authority to groom a teenage girl.

- Hollywood a bel et bien rouvert ses portes à Johnny Depp, ce nouveau rôle le confirme (huffingtonpost.fr)

L’acteur américain vient d’être annoncé au casting du prochain film de Ti West, une nouvelle adaptation du classique de Charles Dickens « Un conte de Noël ».

- Anatomie des hommes forts : pourquoi les politiques mettent-ils en scène leur musculature ? (theconversation.com)

Spécial France

- Report des élections en Nouvelle-Calédonie : pourquoi la Macronie se retrouve à torpiller son propre texte (huffingtonpost.fr)

Pour contourner les centaines d’amendements déposés par La France insoumise, le camp gouvernemental a préféré jouer la tactique de l’esquive.

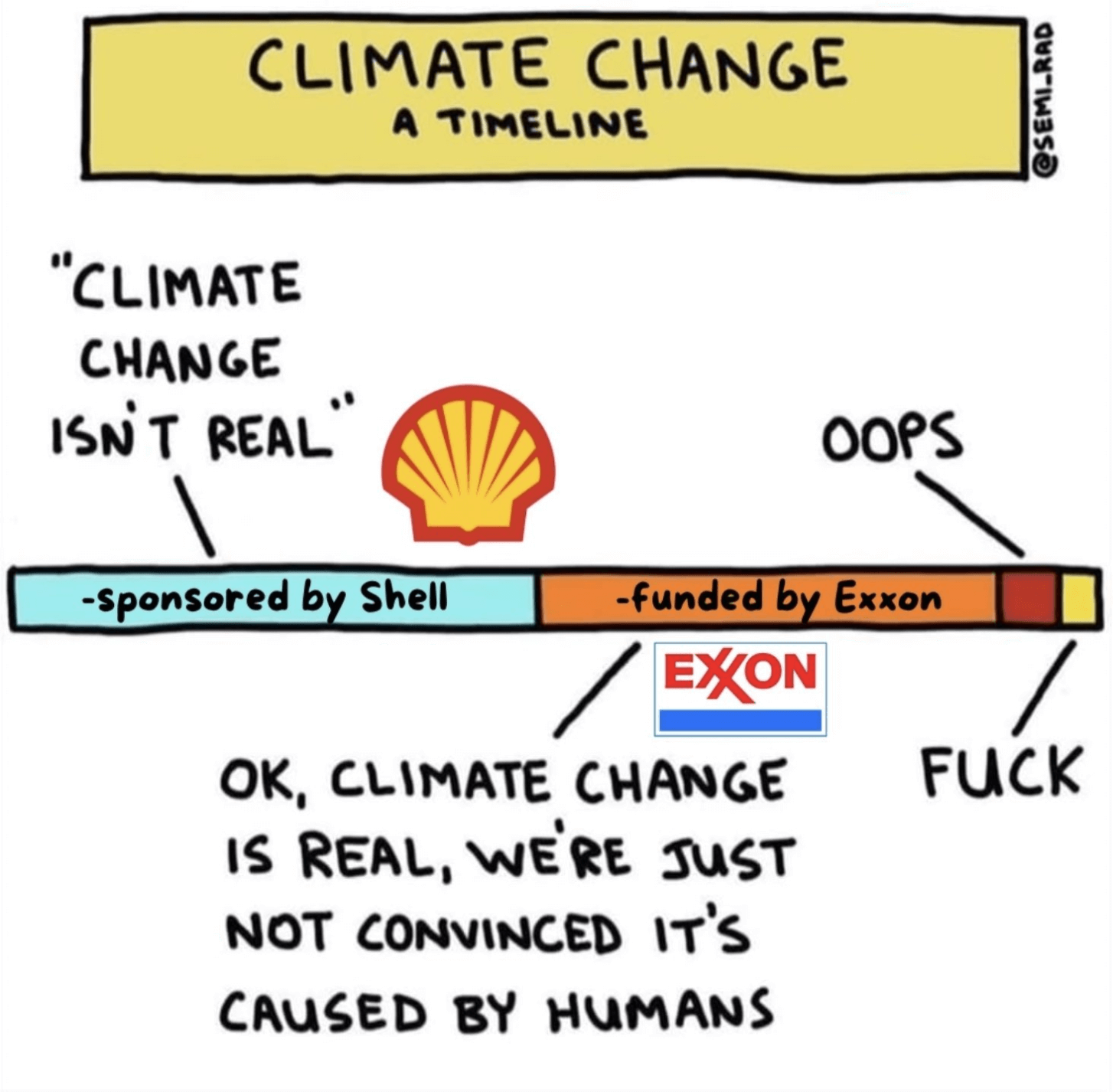

- Greenwashing : TotalEnergies condamnée pour ses publicités sur la « neutralité carbone » (humanite.fr)

Le tribunal judiciaire de Paris a jugé, jeudi, que la major pétrolière s’était rendue coupable de pratiques commerciales trompeuses en se présentant comme un « acteur majeur de la transition énergétique ».

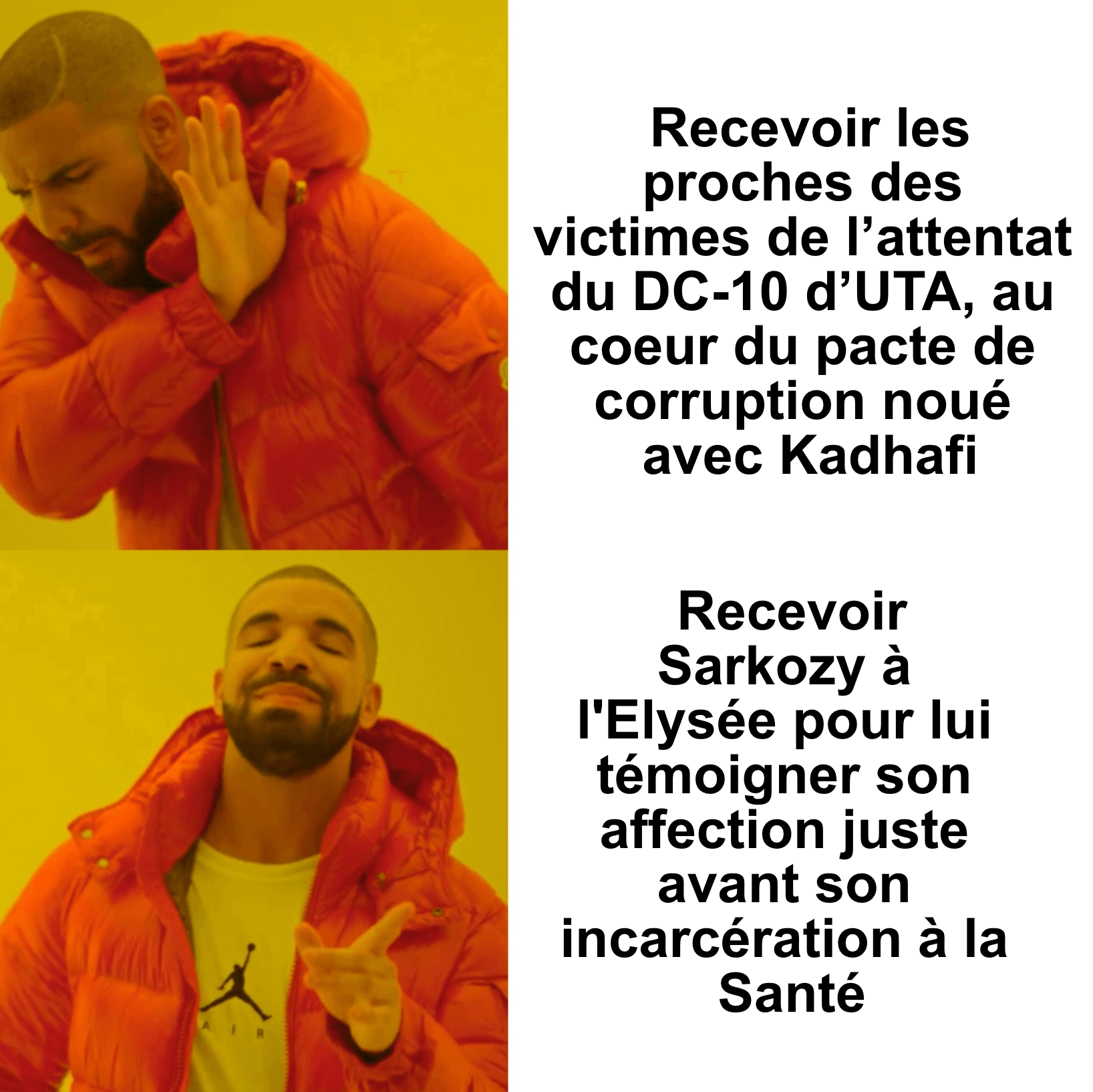

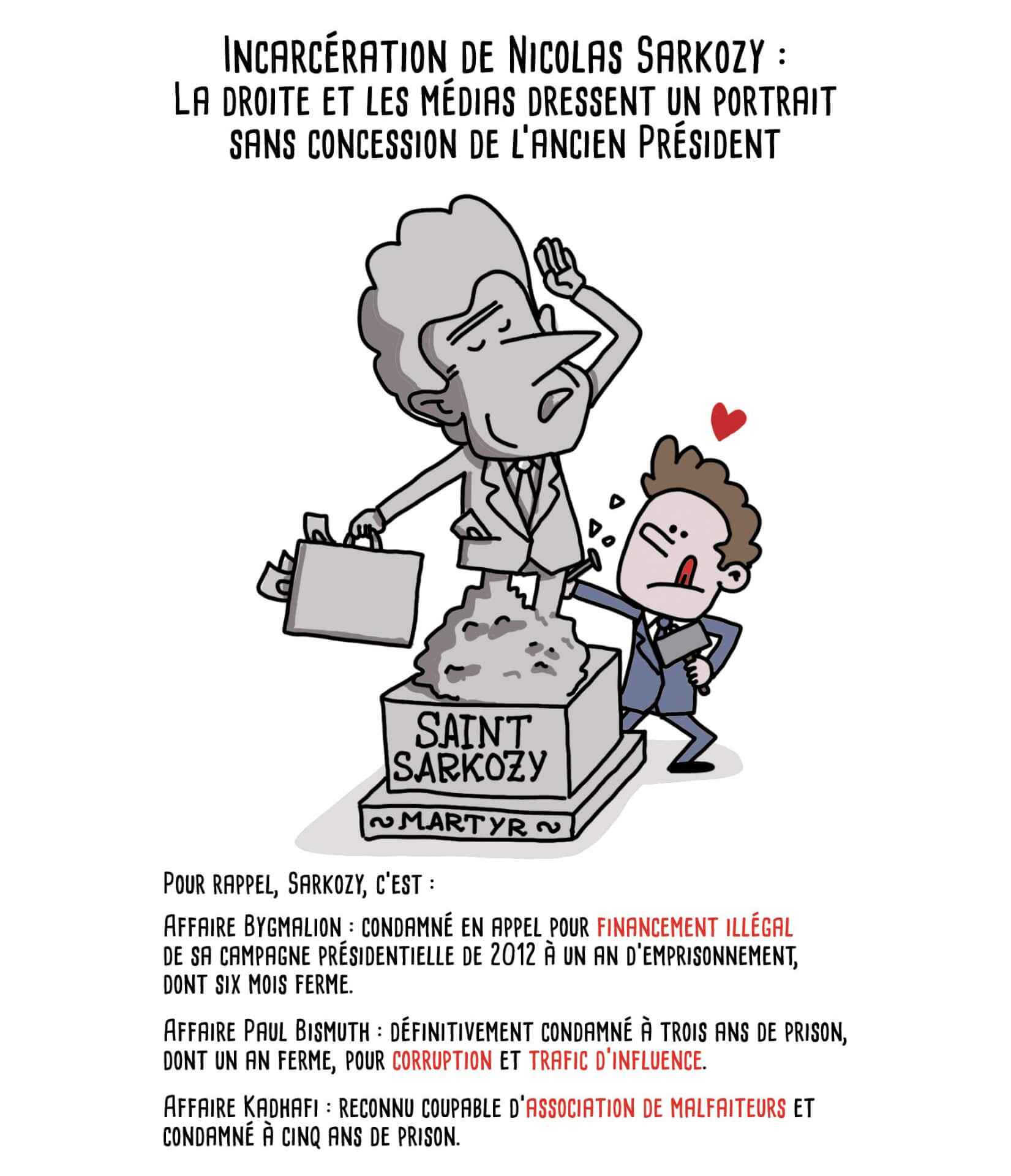

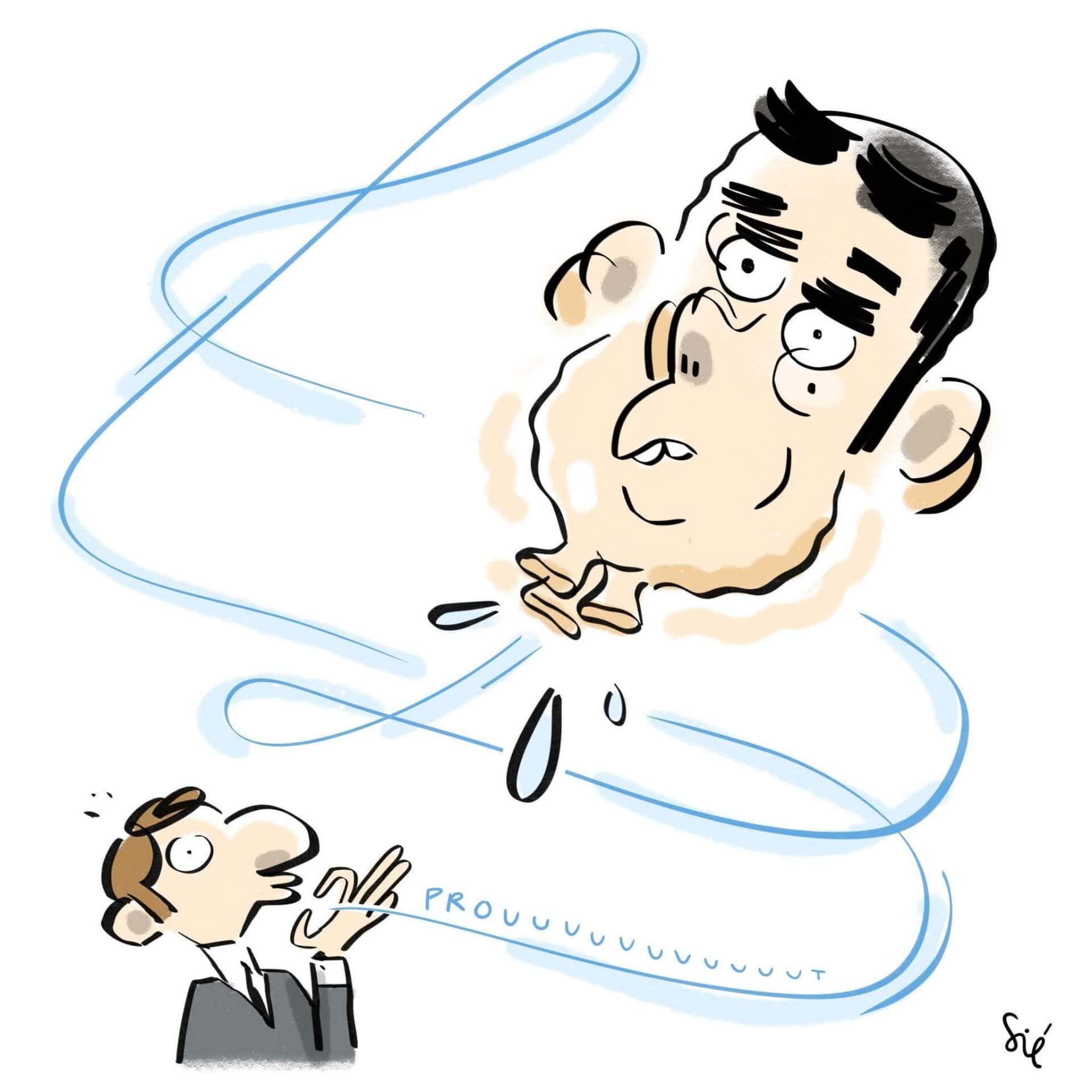

- Nicolas Sarkozy incarcéré à la prison de la Santé, voici à quoi ressembleront ses conditions de détention (huffingtonpost.fr)

- François Fillon débouté par la CEDH dans l’affaire des emplois fictifs de son épouse (lemonde.fr)

Dans un arrêt rendu à l’unanimité, la Cour européenne des droits de l’homme déclare irrecevable pour « défaut manifeste de fondement » la requête de l’ancien premier ministre, qui estimait n’avoir pas bénéficié d’un procès équitable dans cette affaire.

- Moody’s accorde un sursis à la France, mais le verdict de l’agence de notation cache une mise en garde (huffingtonpost.fr)

Alors que les débats sur le budget se poursuivent, l’agence de notation a maintenu la note de la dette française, tandis que ses concurrentes l’avaient abaissée.

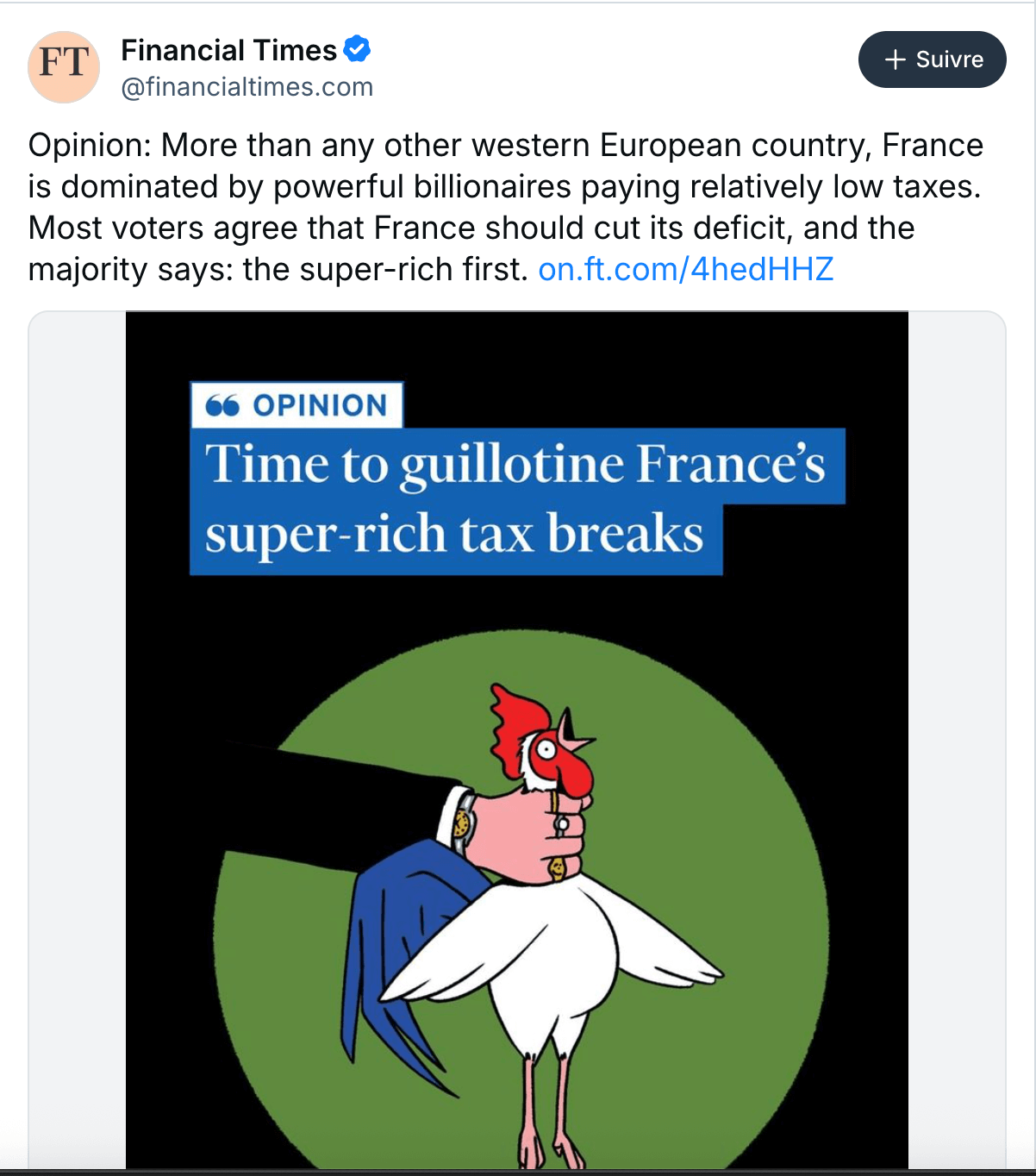

- Budget 2026 : la taxe Zucman rejetée d’emblée lors de l’examen du texte en commission à l’Assemblée (lemonde.fr)

Les députés de la coalition gouvernementale et du Rassemblement national ont fait échouer l’adoption de la taxe sur les très hauts patrimoines, portée par la gauche. Le dispositif fera l’objet d’un nouveau débat dans l’Hémicycle à partir de vendredi.

- Projet de loi de finances 2026 : premières retouches du budget (projetarcadie.com)

- Une directive européenne va bientôt imposer la transparence salariale dans toutes les entreprises (presse-citron.net)

Dès juin 2026, la transparence salariale deviendra une obligation légale. Chaque salarié en France pourra demander à connaître le salaire moyen des personnes occupant le même poste. Un outil redoutablement efficace pour ceux qui envisagent de négocier une augmentation… Et un vrai tournant culturel dans le monde du travail.

- « Maintenant, la télé, c’est Free » : Xavier Niel lance Free TV pour tuer Molotov et TF1 (frandroid.com)

- La France, premier pays à investir dans Matrix, le protocole libre sur lequel repose sa messagerie sécurisée (clubic.com)

- Élargir la Seine « ne répond pas » aux défis climatiques, selon des chercheurs (reporterre.net)

le Conseil scientifique s’était autosaisi de la question pour analyser la pertinence de ce projet pourtant reconnu d’utilité publique en 2022. Ces experts notent par ailleurs que « l’estimation des impacts sur la zone humide » a déjà été « considérée comme non conforme et lacunaire par l’OFB et l’Autorité environnementale »

- Au Havre, TotalEnergies va devoir démanteler son terminal méthanier (reporterre.net)

Ce gigantesque tanker, mis en service en octobre 2023, était censé sécuriser l’approvisionnement énergétique du pays à l’époque de la guerre en Ukraine. Or, comme l’a observé le tribunal, ce terminal méthanier flottant est inutilisé depuis août 2024.

- Submersion, rejets toxiques… L’EPR2 de Penly dans le viseur de l’Autorité environnementale (reporterre.net)

Spécial femmes en France

- Orientation postbac : pourquoi les femmes choisissent moins les sciences que les hommes (theconversation.com)

- « Face à l’internationale réactionnaire masculiniste, la France oppose un concept : la diplomatie féministe », une conversation avec Delphine O (legrandcontinent.eu)

- « On n’oublie jamais » : enfant maltraitée, Emma Étienne se bat contre les violences intrafamiliales (basta.media)

Elle a subi des maltraitances, été placée, s’est retrouvée sans soutien à 18 ans. Puis Emma Étienne, 23 ans, a fondé une association pour aider les enfants comme elle, Speak !, et publié un essai sur l’incapacité de la société à les protéger.

Spécial médias et pouvoir

- “Mais vous êtes fou ?” : La soeur d’une victime de l’attentat du DC-10 interpelle Henri Guaino, fidèle de Nicolas Sarkozy, dans “Complément d’enquête” sur France 2 (ozap.com)

- Sarkozy en prison : « un naufrage médiatique » pour Eva Joly (reporterre.net)

- Condamnation de Nicolas Sarkozy : le journaliste Fabrice Arfi dénonce une “faillite culturelle et médiatique” sur “les grandes affaires de corruption” (franceinfo.fr)

Le journaliste de Mediapart, qui a contribué à révéler l’affaire des financements libyens, déplore que le procès de Nicolas Sarkozy ait été très peu suivi par la presse, malgré la gravité des faits.

- Sarkozy à “la Santé” : réalité parallèle sur BFM (arretsurimages.net)

- “Lecornu gagne en popularité” : trois sondages présentés de manière biaisée (arretsurimages.net)

Spécial emmerdeurs irresponsables gérant comme des pieds (et à la néolibérale)

- En commission, le RN et la Macronie s’allient pour défendre un budget d’ultra-riches (politis.fr)

Les débats sur le volet recettes du projet de loi de finance pour 2026 ont débuté ce lundi en commission des finances, donnant à voir une alliance tacite entre le bloc central et le RN pour protéger les privilèges des plus aisés et des grandes entreprises.

- Budget 2026 : 10 mesures défavorables aux plus modestes (basta.media)

Le budget entame son parcours parlementaire cette semaine. Gel des prestations sociales et des pensions, baisses budgétaires pour le logement social et les hôpitaux… Une série de dispositions risquent de pénaliser les moins riches.

- Budget 2026 : « à défaut de taxer les milliardaires, on taxe les malades » (lareleveetlapeste.fr)

- Les député·es ont rejeté le budget en commission (projetarcadie.com)

Après l’examen des amendements, les député·es ont voté sur l’ensemble de la première partie du texte. Onze député·es ont voté pour, 37 contre, le reste s’est abstenu dont Horizons, MoDem et LIOT.

- Budget 2026 : Olivier Faure demande des « évolutions d’ici à lundi », faute de quoi le PS pourrait censurer le gouvernement (lemonde.fr)

- Vers une hausse des frais d’inscription à l’université ? Une « ligne rouge » pour la gauche sénatoriale (publicsenat.fr)

Une mission d’information du Sénat s’est attelée à décortiquer les liens stratégiques ente l’Etat et les universités. Si les élus de tous bords politiques se sont accordés sur la nécessité d’établir un cap de pilotage clair, les pistes égrenées sur les frais d’inscription et la sélection à l’entrée en études supérieures ont conduit le PS à se retirer du rapport.

- Un an après, les groupes de niveau sont en échec dans les collèges (alternatives-economiques.fr)

Spécial recul des droits et libertés, violences policières, montée de l’extrême-droite…

- Comment la détention de Nicolas Sarkozy fait (re)découvrir la dure réalité des prisons françaises (huffingtonpost.fr)

La violence du milieu carcéral français, amplifiée par la surpopulation des établissements, est dénoncée depuis plusieurs années par les détenus et les agents pénitentiaires.

- « C’est à vomir » : blackfaces et costumes du Ku Klux Klan à la fête d’un club de parachutisme (ouest-france.fr)

La vision de cette scène est glaçante de réalisme. Elle a été préparée d’avance ainsi que le démontre la vidéo. Ce n’est pas du tout un débordement alcoolisé

- Après la soirée raciste dans l’Aube impliquant des pompiers de Paris, une enquête judiciaire en cours (huffingtonpost.fr)

Au cours d’une fête organisée par un club de parachutisme près de Troyes, plusieurs participants se sont grimés en membres du Ku Klux Klan, d’autres arborant des « black faces ».

- « On l’a tué » : l’émotion du patron de Mamadou Garanké Diallo, mort en tentant de rejoindre l’Angleterre (huffingtonpost.fr)

Ce jeune Guinéen travaillait depuis six ans dans une boucherie près de Rouen. Il a trouvé la mort en juin, en tentant de gagner le Royaume-Uni après avoir reçu une OQTF.

- « Les policiers ont tiré 8 fois. J’ai dû leur verser 15 000 euros » (politis.fr)

Nordine raconte la nuit du 16 au 17 août 2021 où sa compagne, Merryl, enceinte, et lui, ont failli mourir sous les tirs de la police.

- Depuis Zyed et Bouna, 162 personnes sont mortes suite à une tentative de contrôle de police (basta.media)

Zyed Benna et Bouna Traoré mouraient dans un transformateur électrique, en fuyant un contrôle de la BAC le 27 octobre 2005. Depuis, le nombre de décès suite à une interaction avec les forces de l’ordre n’a cessé d’augmenter.

- 17 octobre 1961 : la mémoire vive d’un crime d’État que la France peine à reconnaître (bondyblog.fr)

En pleine guerre d’indépendance, des milliers d’Algériens manifestent dans les rues de Paris pour s’opposer au couvre-feu qui leur est imposé. Ces rassemblements pacifiques sont violemment réprimés par la police française, plus de 100 manifestants sont tués, certains corps jetés dans la Seine.

Voir aussi Le 17 octobre 1961, ou le déni continu des crimes coloniaux (lundi.am)

Spécial résistances

- Réforme du RSA : l’intensification des sanctions attaquée devant le Conseil d’État (basta.media)

Seize associations et syndicats attaquent l’État pour sa politique ciblant chômeurs et allocataires du RSA. Au cœur du problème, les pressions subies par les bénéficiaires et la répression contre les agents refusant de collaborer à ce « flicage ».

- Le régime local d’Alsace-Moselle, un modèle pour la Sécu ? (basta.media)

Solidaire, démocratique et excédentaire, le régime local d’assurance maladie d’Alsace-Moselle préfigure-t-il le futur de la Sécurité sociale ?

- Municipales : une dizaine d’associations proposent 10 mesures de « désescalade numérique » (next.ink)

- Et, si 80 ans après la Sécu, l’accès à l’alimentation fédérait la gauche à Perpignan et au-delà ? (madeinperpignan.com)

- Canaliser (lundi.am)

Méga-canal, Méga-scandale : récit d’un week-end

- Mustafa Cakici – Les nationalistes turcs ne sont pas nos alliés (juivesetjuifsrevolutionnaires.fr)

Suite à la révélation par plusieurs médias (StreetPress notamment) de propos antisémites, anti-arméniens, anti-kurdes et LGBTQIphobe, Mustafa Cakici a été démis de son mandat de porte-parole français de la Global Sumud Flotilla. Il a également été exclu de l’UJFP, dont il était membre.

Nous saluons cette décision.

Il est cependant regrettable qu’il ait fallu attendre un scandale médiatique pour cela.

Spécial outils de résistance

- Vote-Pack Zucman (politipet.fr)

- Sauvons les trains de nuit Paris – Berlin et Paris – Vienne ! (petitions.assemblee-nationale.fr)

Spécial GAFAM et cie

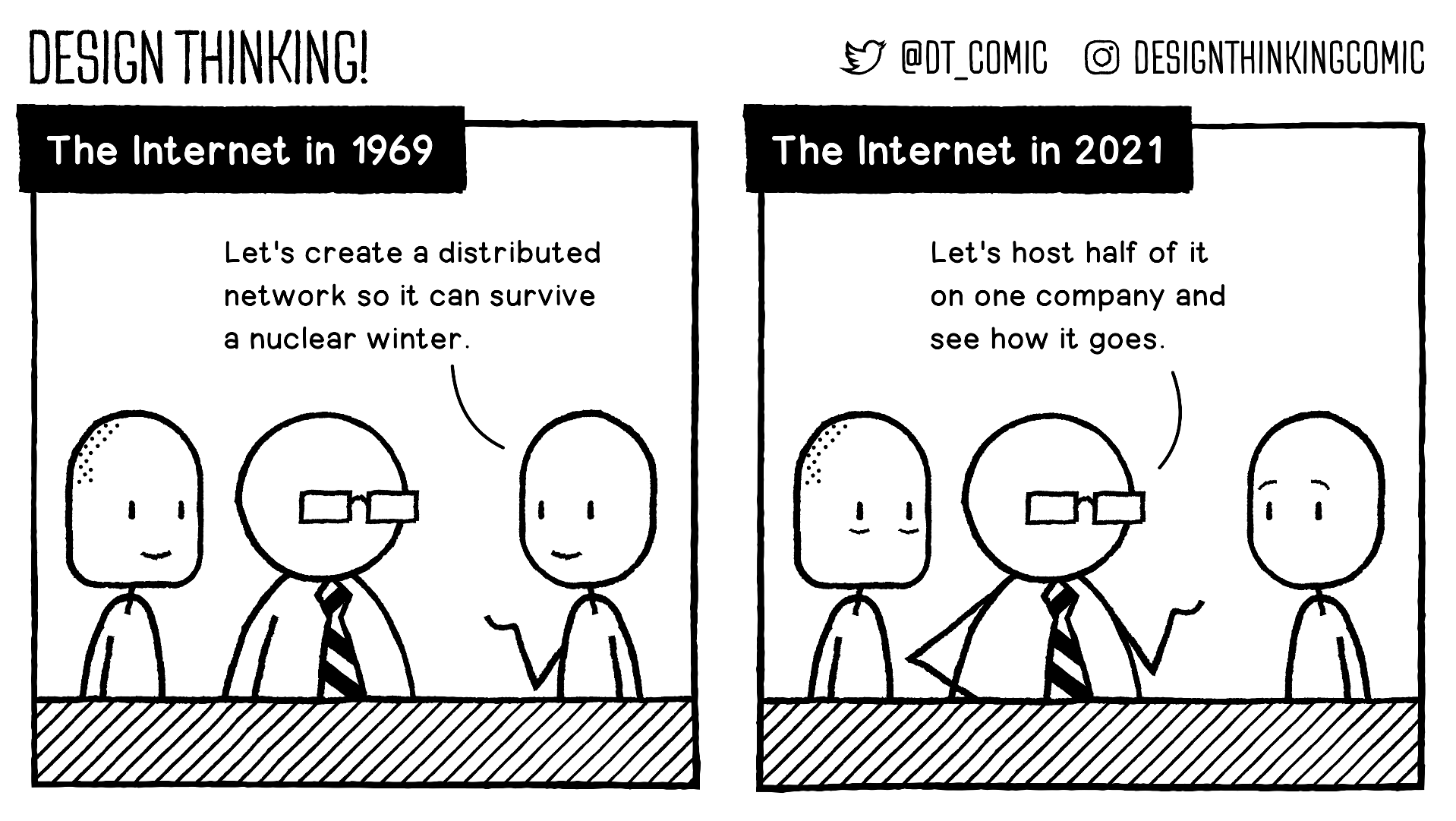

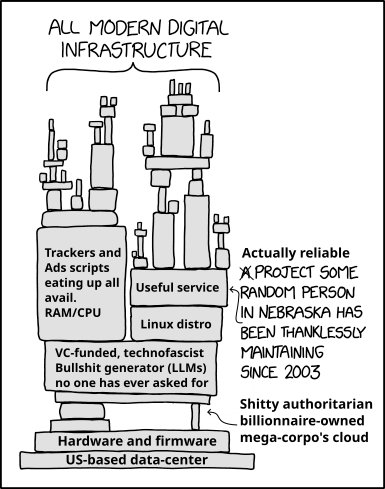

- Amazon identifies the issue that broke much of the internet, says AWS is back to normal (techcrunch.com) – voir aussi Airbnb, Snapchat, Fortnite… Ce que l’on sait des causes de la panne géante qui a paralysé des applis ultra-populaires (huffingtonpost.fr)

Ces perturbations ont eu lieu après une panne aux États-Unis d’Amazon Web Services (AWS), le premier fournisseur mondial de cloud.

- Le crash d’AWS en a empéché certain·es de dormir (minimachines.net)

Des lits connectés vendus plus de 2000$ ont des fonctions embarquées qui permettent de modifier leur position grâce à une application. Ils sont également capables de contrôler leur température et donc de chauffer ou de se refroidir.[…] Problème, les lits ne sont pas munis de télécommande ou même d’un bouton pour les allumer ou les éteindre. Tout passe par une application […] qui passe par les serveurs d’Amazon.

- Ring cameras are about to get increasingly chummy with law enforcement (arstechnica.com)

Amazon’s Ring partners with company whose tech has reportedly been used by ICE.

- NSO permanently barred from targeting WhatsApp users with Pegasus spyware (/arstechnica.com)

Ruling holds that defeating end-to-end encryption in WhatsApp harms Meta’s business.

- Comment Trump et les Gafam empêchent la résistance contre les expulsions forcées (politis.fr)

L’application ICEBlock, qui permettait d’anticiper les raids des forces spéciales anti-immigration, a été fermée par Apple, en accord avec Donald Trump. Politis donne la parole à son développeur, en colère contre la trahison du géant américain.

- Microsoft dégaine une astuce sournoise pour booster Copilot (clubic.com)

Aux États-Unis, lorsqu’on utilise le navigateur Edge pour se rendre sur ChatGPT.com, Perplexity.ai ou DeepSeek, on peut désormais apercevoir une nouvelle pastille positionnée à droite, directement au sein de la barre d’adresse avec la simple mention “Try Copilot”. Et ce petit message promotionnel n’apparaît pas en permanence, mais sur une sélection de domaines […] ceux appartenant à ses rivaux.

- TikTok Won’t Say If It’s Giving ICE Your Data (forbes.com)

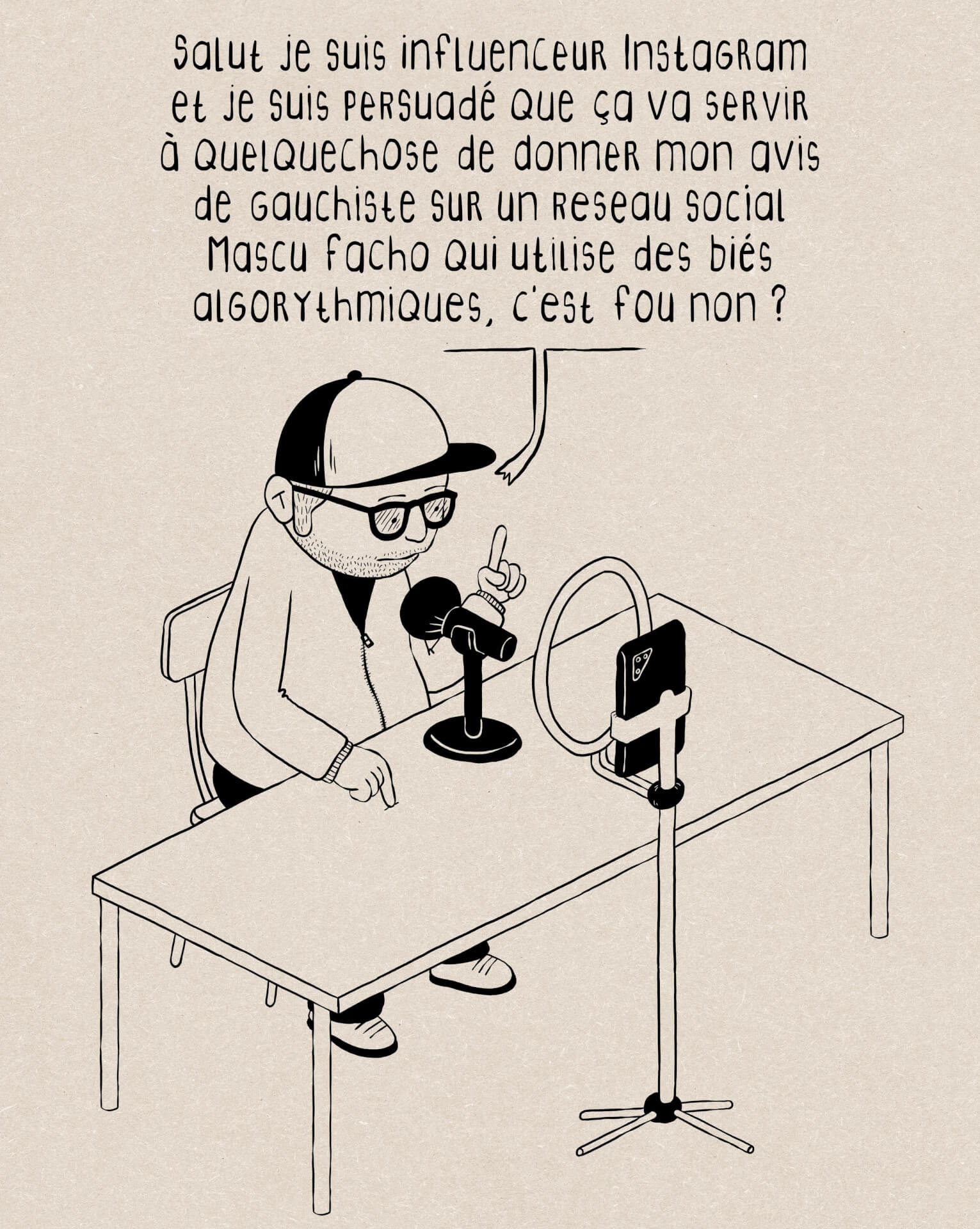

- Plongée dans l’algorithme de TikTok France : nos révélations (amnesty.lu)

Que montre TikTok aux adolescent·es français·es ? Pour le savoir, nos équipes ont recréé leurs profils et se sont entretenues avec des adolescent·es et des familles concernées. Nos résultats sont accablants : malgré la législation européenne, TikTok inonde encore les écrans des ados vulnérables de contenus dangereux pouvant aller jusqu’à encourager l’automutilation ou le suicide.

- France. TikTok continue d’orienter les enfants et les jeunes déjà fragiles vers des contenus dépressifs et suicidaires (amnesty.lu)

En seulement trois à quatre heures de navigation sur le fil “Pour toi” de TikTok, les faux comptes d’adolescent·e·s créés pour nos recherches ont été exposés à des vidéos qui idéalisaient le suicide ou montraient des jeunes exprimant leur intention de mettre fin à leurs jours, avec des informations sur les méthodes de suicide

- X is changing how it handles links to try and keep you in the app (theverge.com)

Les autres lectures de la semaine

- An Amazon outage has rattled the internet. A computer scientist explains why the ‘cloud’ needs to change (theconversation.com)

- Today is when the Amazon brain drain finally sent AWS down the spout (theregister.com)

When your best engineers log off for good, don’t be surprised when the cloud forgets how DNS works […] a quiet suspicion starts to circulate : where have the senior AWS engineers who’ve been to this dance before gone ? And the answer increasingly is that they’ve left the building — taking decades of hard-won institutional knowledge about how AWS’s systems work at scale right along with them.

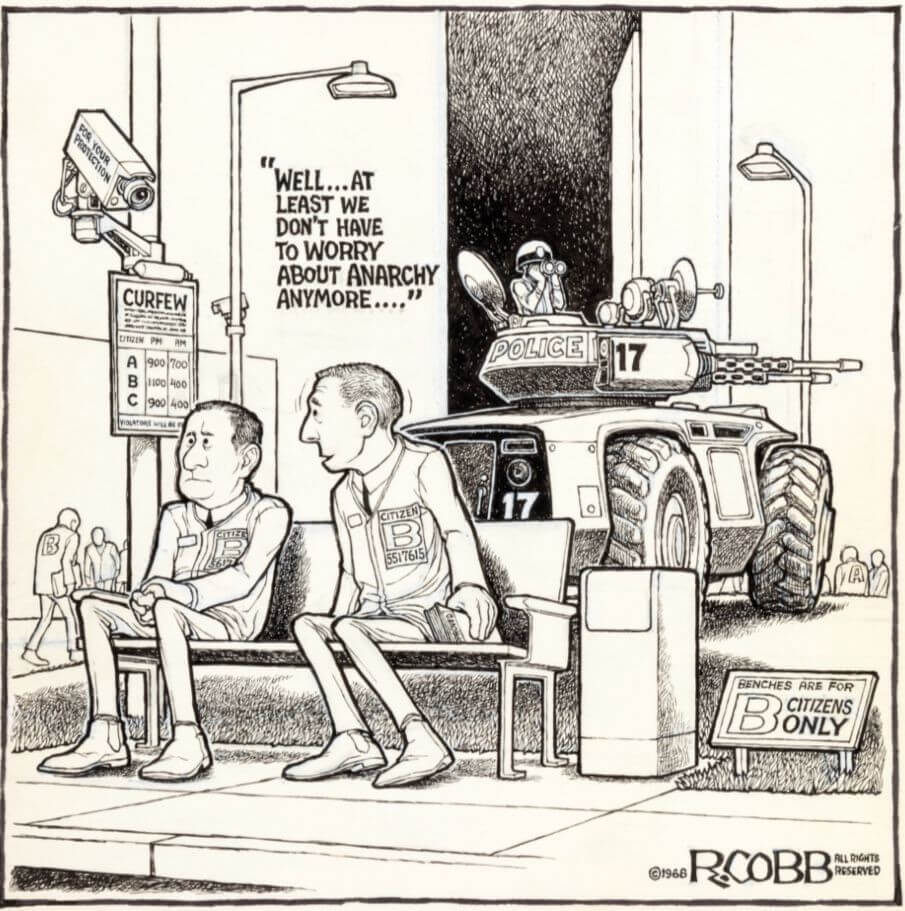

- De l’internet de la répression… (danslesalgorithmes.net)

À la tribune de l’ONU, tout le monde dénonce la montée de l’autoritarisme… alors que chacun participe à l’industrie de la censure.

- Chez les paons, la taille compte… mais aussi la beauté et la vigueur (theconversation.com)

- “Je préfère être pleinement moi, sans m’excuser de l’être” (frustrationmagazine.fr)

Je ne parle pas de manquer d’empathie, ou de ne pas respecter l’autre. Je parle de ne plus accepter l’inacceptable et de prendre l’espace qui me revient, qui m’appartient. Je parle de ne plus rien laisser passer, de ne plus accepter un seul commentaire, une seule attitude raciste et sexiste à mon égard, ou d’autres que moi d’ailleurs, et ce, par qui que ce soit.

- Ablation du clitoris dans l’Angleterre victorienne : comment un scandale médical sur le « consentement éclairé », au XIXᵉ siècle, a ouvert un débat toujours actuel (theconversation.com)

La pratique de la « clitoridectomie », à savoir l’excision du clitoris – et parfois des lèvres –[…] a, pendant un temps, au cours du XIXᵉ siècle, également été prônée en Europe comme « remède » à la masturbation, à la nymphomanie, à l’hystérie et autres « troubles nerveux » supposés.

- Vulve, pénis… Apprendre aux enfants à nommer les parties génitales est plus important qu’on ne le pense (huffingtonpost.fr)

Les BDs/graphiques/photos de la semaine

Les vidéos/podcasts de la semaine

- Fabrice Arfi sur Ce Soir parlant du traitement médiatique autour de Sarkozy (tube.fdn.fr)

- Alice de Rochechouart dans Zoom Zoom Zen sur la différence entre privilèges et compensations de désavantages (tube.fdn.fr)

- Italie : aux origines de la coalition des droites sous domination néofasciste (contretemps.eu)

- L’IA va-t-elle tuer Internet ? (arte.tv – disponible jusqu’au 29/12/2025)

- Robots tueurs, des armes aux mains de l’IA (arte.tv – disponible jusqu’au 31/10/2027)

- Planter à tout prix. Des arbres pour sauver la planète ? (arte.tv – disponible jusqu’au 19/12/2025)

- Gen Z 2025 : De l’Indonésie au Népal (audioblog.arteradio.com)

Les trucs chouettes de la semaine

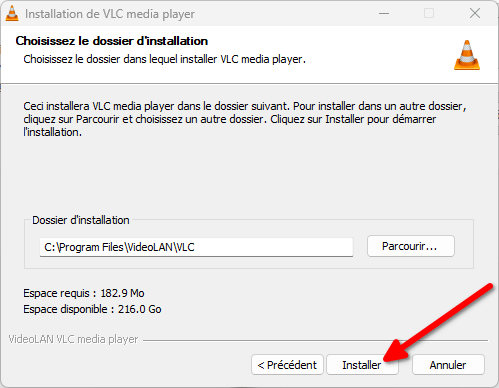

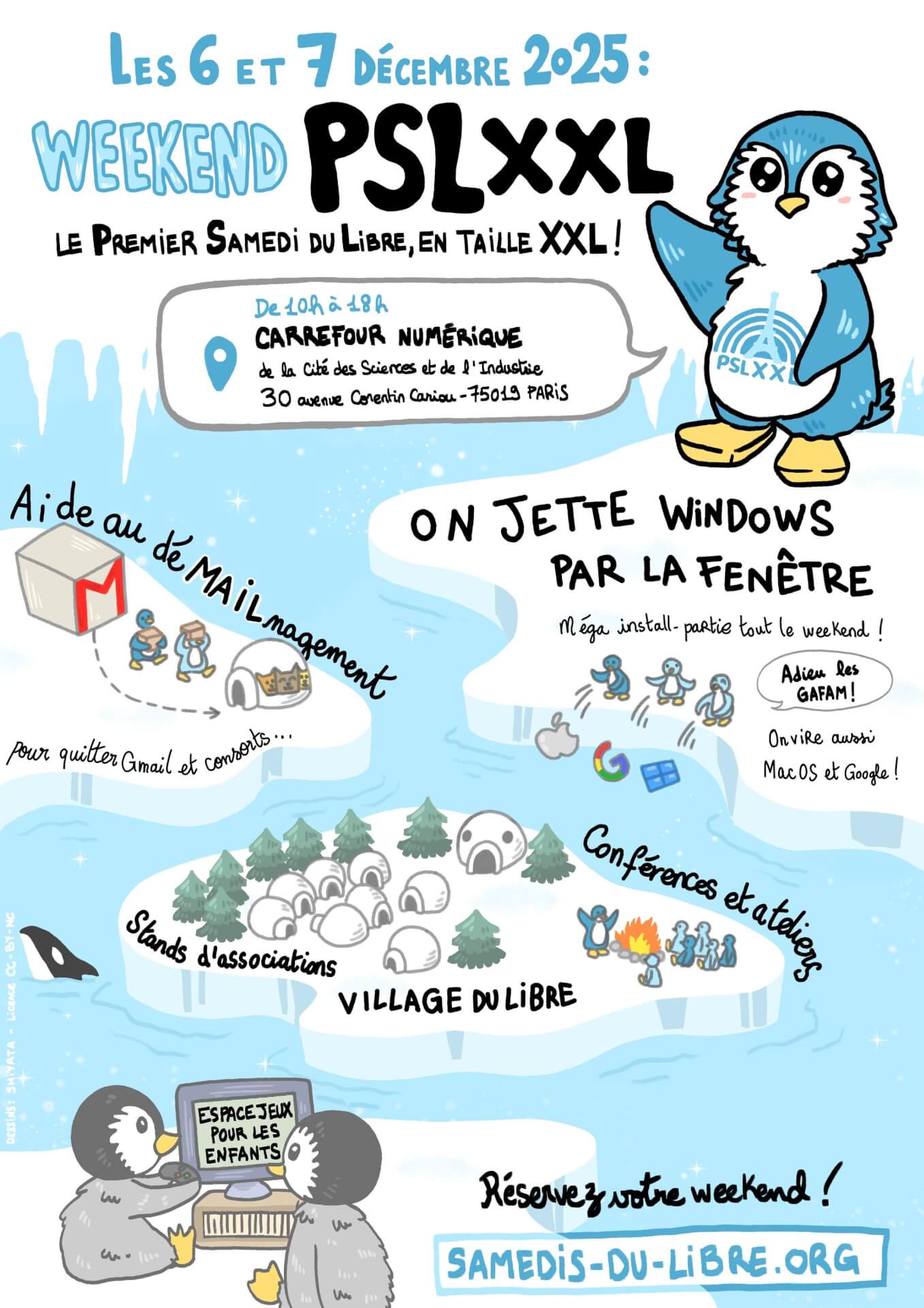

- Les Journées du Logiciel Libre reviennent le week-end du 30 et 31 mai 2026 à l’ENS de Lyon ! (jdll.org)

- Reading QR codes without a computer ! (qr.blinry.org)

- Une « technologie qui change la vie » : un implant électronique redonne la capacité de lire aux personnes atteintes de DMLA (humanite.fr)

Un implant électronique sous-rétinien, testé par l’Inserm, l’université de la Sorbonne, le CNRS et l’hôpital de la fondation Rothschild sur 38 patients, permet aux personnes atteintes de dégénérescence maculaire de retrouver une capacité de lecture au bout d’un an.

- Elles préservent des semences en solidarité avec la Palestine (reporterre.net)

Les paysannes et paysans du réseau Longo Maï font germer des semences palestiniennes. Une démarche symbolique et un plaidoyer sur l’urgence d’une réappropriation des savoir-faire autour de la reproduction des graines.

Retrouvez les revues de web précédentes dans la catégorie Libre Veille du Framablog.

Les articles, commentaires et autres images qui composent ces « Khrys’presso » n’engagent que moi (Khrys).

20.10.2025 à 07:42

Khrys’presso du lundi 20 octobre 2025

Khrys

Texte intégral (11080 mots)

Comme chaque lundi, un coup d’œil dans le rétroviseur pour découvrir les informations que vous avez peut-être ratées la semaine dernière.

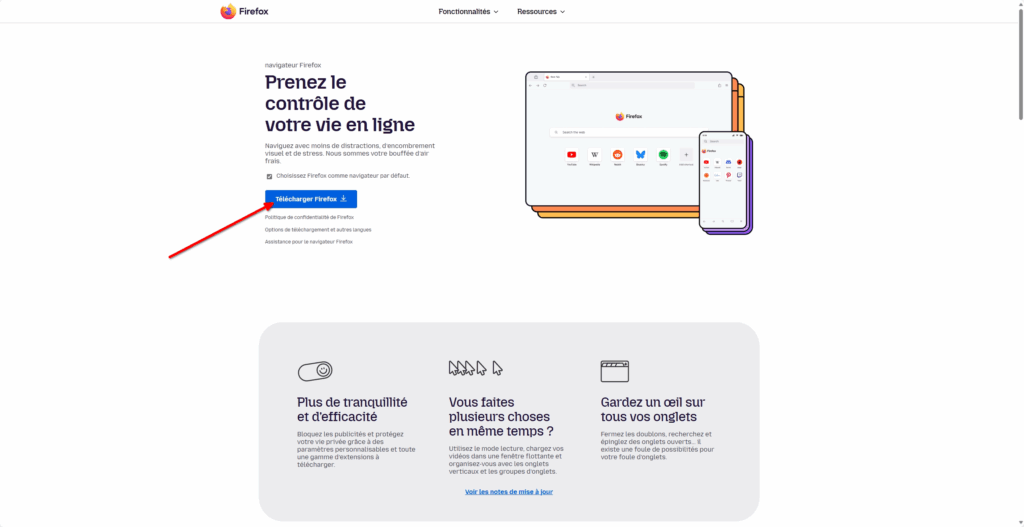

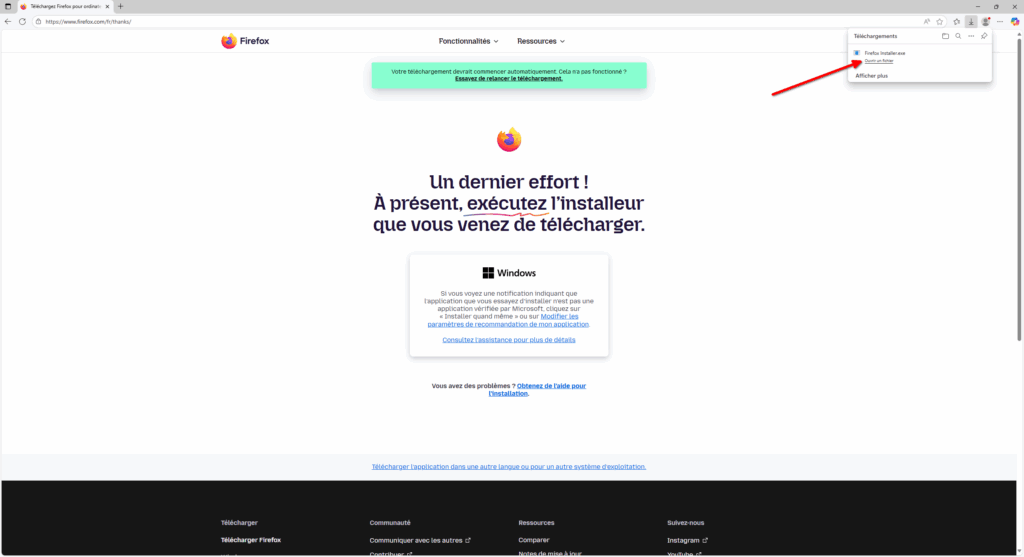

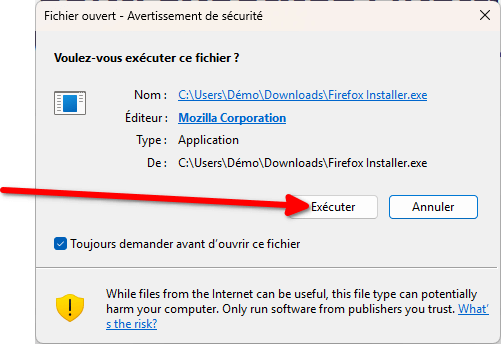

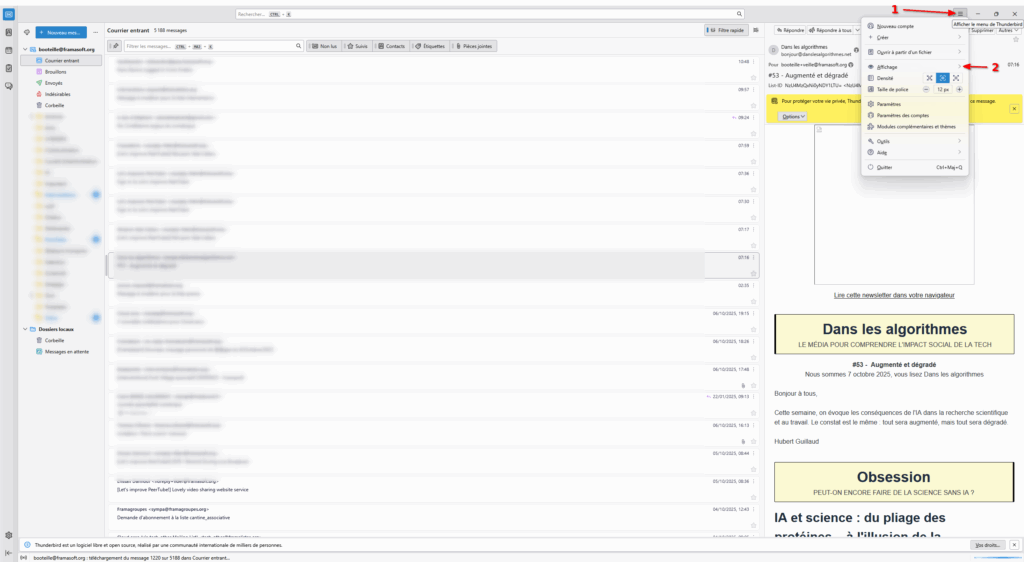

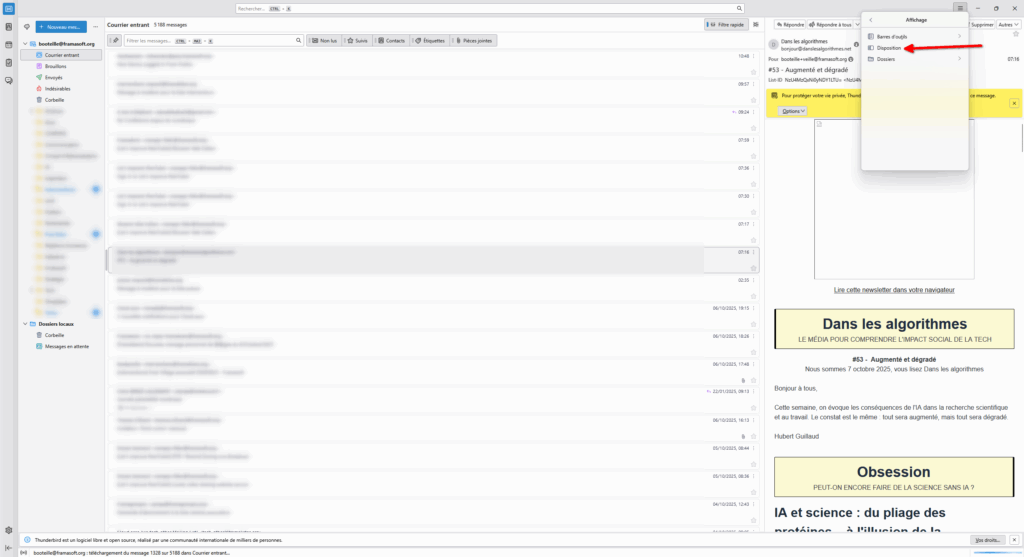

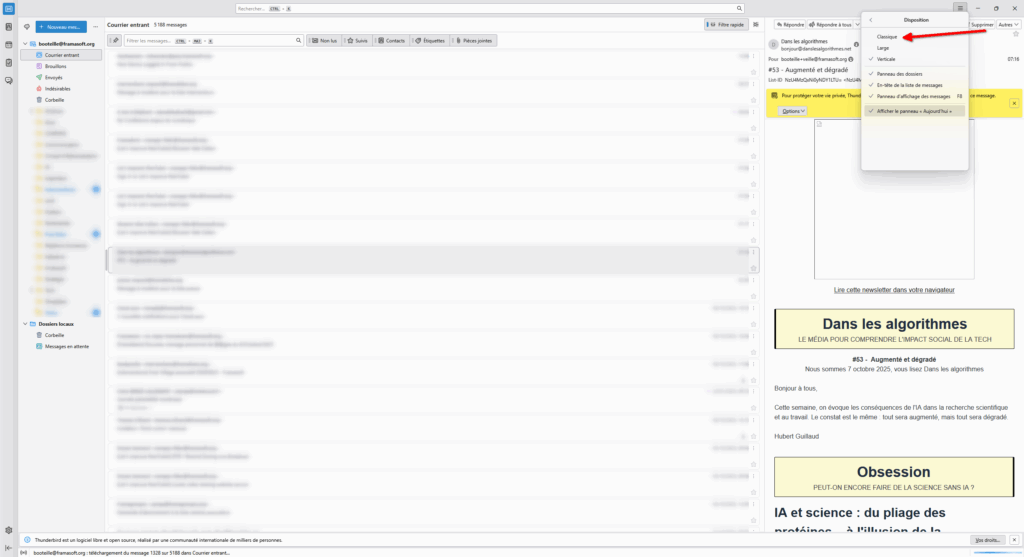

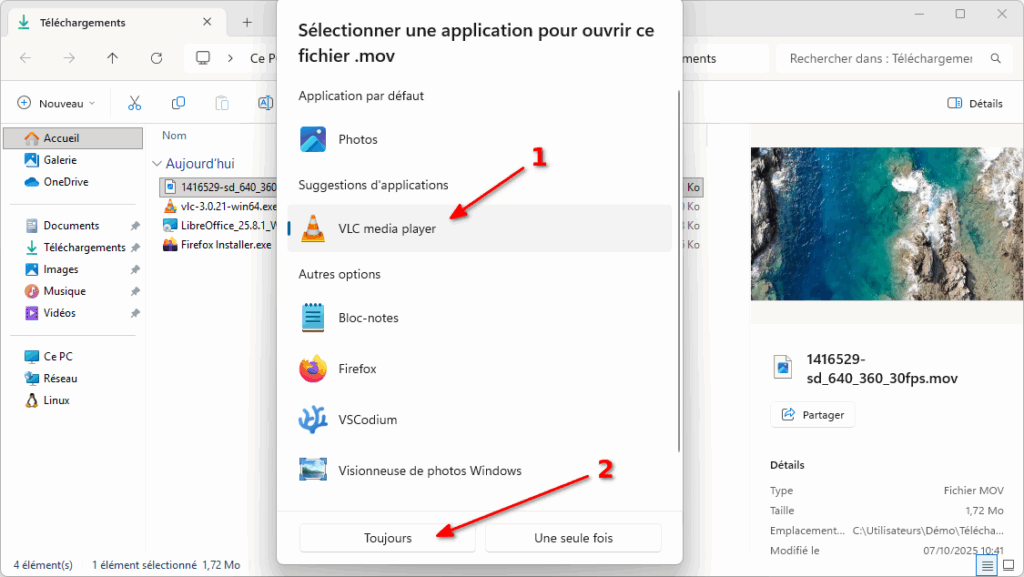

Tous les liens listés ci-dessous sont a priori accessibles librement. Si ce n’est pas le cas, pensez à activer votre bloqueur de javascript favori ou à passer en “mode lecture” (Firefox) ;-)

Brave New World

- Satellites Are Leaking the World’s Secrets : Calls, Texts, Military and Corporate Data (wired.com)

With just $800 in basic equipment, researchers found a stunning variety of data—including thousands of T-Mobile users’ calls and texts and even US military communications—sent by satellites unencrypted.

- China, Taiwan, and the vulnerable web of undersea cables (restofworld.org)

Fifteen international cables connect Taiwan to the world. Its western flank faces China, and its eastern flank is seismically unstable ; over a three-year period, Taiwan’s international and domestic cables suffered more than fifty cuts as a result of both manmade and natural factors. Were a foreign power to snap those fifteen international cables, Taiwan — the West’s buffer against China, and the semiconductor factory to the planet — would be unmoored from the world it needs and the world that needs it.

- Énergie du futur : la Chine teste le S1500, sa première éolienne dirigeable à haute altitude (ladepeche.fr)

- Bangladesh : « Si cette situation continue, nos peuples seront exterminés », alerte Rani Yan Yan, la reine des Chakma (humanite.fr)

Avant 1997, les militaires et les colons bengalis (principal groupe ethnique du Bangladesh, NDLR) coopéraient main dans la main, ils nous massacraient et brûlaient des villages. L’une des stratégies de l’État était d’installer des colons – 400 000 entre 1977 et 1983 – afin qu’ils puissent être utilisés soit comme boucliers humains, soit comme armes

- Trump, Putin to meet : Will Ukraine get US Tomahawks or not ? (aljazeera.com)

- “Les discussions ont commencé” : un tunnel sous-marin de 113 km entre la Russie et les États-Unis pourrait être construit par Elon Musk (lindependant.fr)

- Putin has no need to fear ICC arrest warrant in Budapest, Orbán has already demonstrated that (telex.hu) – voir aussi Germany demands Hungary arrest Putin on ICC warrant (news.online.ua)

- Türkiye’s judicial reform package to focus on family values, curb ‘LGBT propaganda’ (turkiyetoday.com)

According to the proposed amendment, “Any person who engages in, publicly encourages, praises, or promotes attitudes or behaviors contrary to their biological sex at birth and public morality shall be punished with imprisonment of one to three years.”

- Exfiltré à bord d’un avion militaire français ? Caché, le président de Madagascar réagit (huffingtonpost.fr)

Le président malgache Andry Rajoelina a pris la parole lundi soir pour expliquer qu’il était dans un « lieu sûr » après une « tentative de meurtre ». Sans préciser sa localisation.

- Gen Z : l’internationale contestataire (politis.fr)

Comme en 1968, une jeunesse mondiale se lève à nouveau, connectée, inventive et révoltée. De Rabat à Katmandou, de Lima à Manille, la « Gen Z » exprime sa colère contre la corruption, les inégalités et la destruction de l’environnement.

- Mouvement « GenZ212 » : quand la jeunesse marocaine prend ses propres affaires en main (contretemps.eu)

- Pour la première fois depuis 10 000 ans, des chevaux sauvages parcourent à nouveau l’Espagne (lareleveetlapeste.fr)

Ils n’y avaient jamais posé les sabots. Mais leurs aïeux, eux, peuplaient jadis ces plaines. En introduisant les chevaux de Przewalski en Espagne, Rewilding Spain parie sur le réensauvagement pour ranimer la nature, et l’économie locale.

- L’Espagne en proie à de nouvelles inondations ces derniers jours (meteo-paris.com)

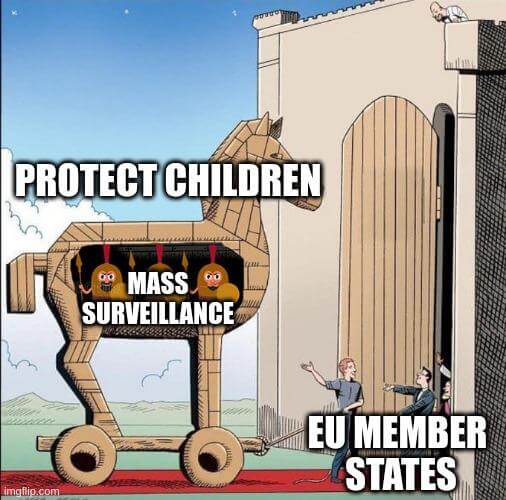

- Europe : surveillance biométrique aux frontières (politis.fr)

Le système d’entrée/sortie (EES pour « Entry/Exit System ») a amorcé son déploiement progressif dans tous les pays de l’espace Schengen, ce 12 octobre. Celui-ci impose aux citoyens extra-européenne de se soumettre à un enregistrement de leurs empreintes digitales et image faciale. Les données biométriques seront stockées et partagées entre les 29 pays membres.

- Consultation response to the European Commission’s call for evidence on the Digital Omnibus (edri.org)

The European Commission launched a call for evidence on the forthcoming “Digital Omnibus” initiative, which is expected to be presented around the 19 November 2025. The package is framed as an effort to “simplify” the EU’s digital policy framework, but the EDRi network warn that it risks dismantling key protections that uphold fundamental rights in the digital age.

- Empêtré dans l’affaire Epstein, le prince Andrew renonce à ses titres royaux (huffingtonpost.fr)

Le prince Andrew a de nouveau fait l’objet d’accusations dans un livre posthume écrit par la principale accusatrice de Jeffrey Epstein.

- États-Unis : l’Alaska en proie à de violentes inondations, des milliers de personnes évacuées (franceinfo.fr)

Le typhon Halong a frappé violemment la côte ouest de l’Alaska (États-Unis), le week-end du 11 et 12 octobre, avec des vents à plus de 170 km/h et des vagues impressionnantes.

Voir aussi Here’s how you can help survivors of the Western Alaska storm (alaskapublic.org)

Community groups and businesses across the state are coordinating relief efforts after the remnants of Typhoon Halong brought widespread devastation to Western Alaska.

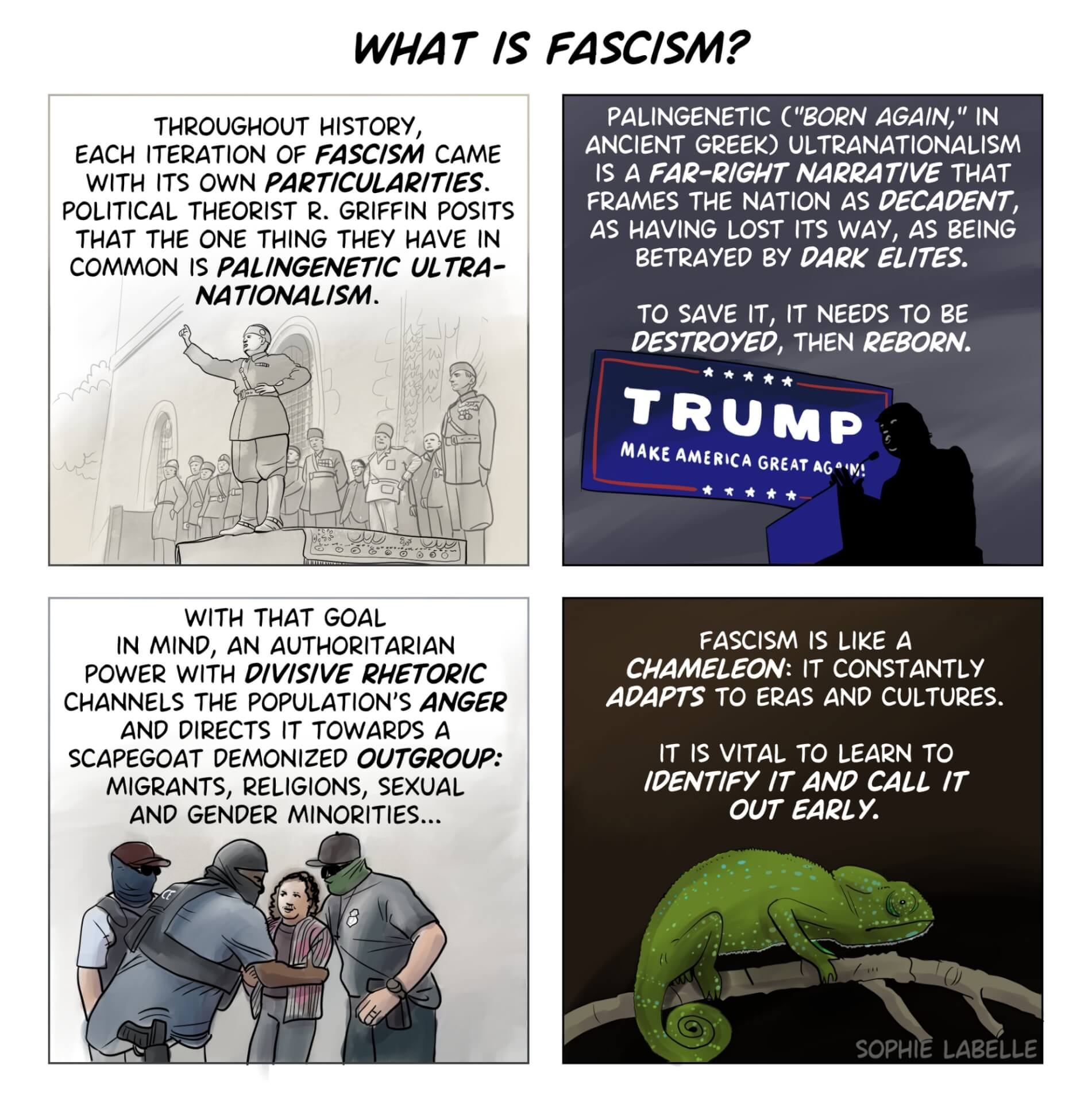

- Menacé de mort, l’historien antifasciste Mark Bray a dû fuir les États-Unis (lareleveetlapeste.fr)

C’est « un avertissement contre l’autoritarisme » alerte Mark Bray. Après la parution du décret de Donald Trump qualifiant l’antifascisme comme mouvement terroriste (22 septembre 2025), le professeur de l’université de Rutgers (New-Jersey, Etats-Unis) Mark Bray a été victime d’une vague de menaces de mort.

- Armed man wearing ‘non-offending pedophile’ sign storms stage at NYC Wikipedia conference (nbcnews.com)

The man pointed a gun at the ceiling and threatened to kill himself before being tackled by conference organizers, according to police. Wikipedia canceled all events Friday “due to unforeseen circumstances,” adding that the conference is expected to resume Saturday

- President will now force airlines to guess passengers’ genders if they have X gender markers (lgbtqnation.com)

US customs will no longer accept X gender markers in their system despite people still having those passports.

- ICE Is Cracking Down on Chicago. Some Chicagoans Are Fighting Back. (nytimes.com)

Residents have begun forming volunteer groups to monitor their neighborhoods for federal immigration agents. Others honk their horns or blow whistles when they see agents nearby.

- Portland’s Inflatable Costumes Deflate Trump’s Narrative (motherjones.com)

- « No Kings » : des millions d’Américain·es attendu·es pour défiler contre Donald Trump (lemonde.fr)

Plus de 2 700 rassemblements sont prévus dans la journée, dans les grandes villes américaines comme dans des bourgades d’États républicains, ainsi qu’à proximité de la résidence de Donald Trump en Floride.

- Second “No Kings Day” protests likely the largest single-day political demonstration since 1970, with 4.2-7.6 million participants (gelliottmorris.com)

- 7 Million Proud Patriots Joyously, Peacefully Marched, Rallied, And Protested Yesterday (hopiumchronicles.com)

- California governor says Trump ‘putting ego over responsibility’ over a military showcase that involved firing live artillery shells over a major highway in the state’s south (theguardian.com)

- We Found That More Than 170 U.S. Citizens Have Been Held by Immigration Agents. They’ve Been Kicked, Dragged and Detained for Days. (propublica.org)

- EFF, unions sue Trump administration over alleged mass social media surveillance of legal residents (techcrunch.com)

- Software update bricks some Jeep 4xe hybrids over the weekend (arstechnica.com)

Owners of some Jeep Wrangler 4xe hybrids have been left stranded after installing an over-the-air software update this weekend. The automaker pushed out a telematics update for the Uconnect infotainment system that evidently wasn’t ready, resulting in cars losing power while driving and then becoming stranded.

- Présidentielle en Bolivie : le lithium au cœur des promesses économiques des candidats (france24.com)

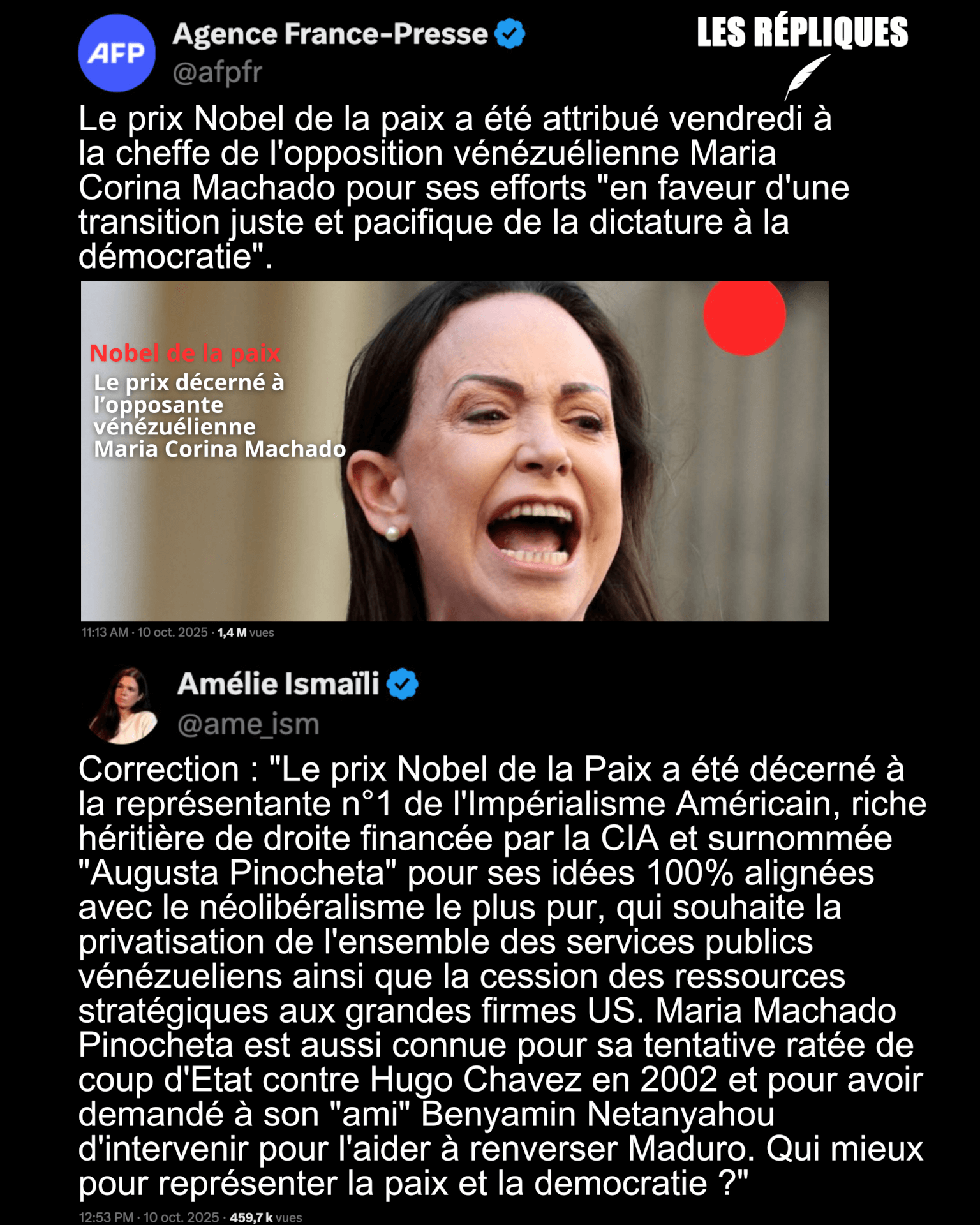

- Cette réplique du Venezuela montre que Maduro n’a pas digéré le Prix Nobel à son opposante (huffingtonpost.fr)

Alors que le Venezuela a fermé son ambassade à Oslo, une porte-parole de Norvège a rappelé que « le prix Nobel est indépendant du gouvernement norvégien ».

- Venezuela : accélération autoritaire et répression de la gauche critique. (contretemps.eu)

- L’administration Trump prépare-t-elle une opération armée au Venezuela ? (legrandcontinent.eu)

Washington a multiplié les déploiements militaires au large des côtes vénézuéliennes ces dernières semaines, faisant craindre au régime Maduro la préparation d’une opération visant à le destituer.

- État d’urgence, mobilisations massives, un manifestant tué par la police et une centaine de blessés… Que se passe-t-il au Pérou ? (humanite.fr)

- Reflect Orbital : The Startup Letting You Order Sunlight from Space (thetundradrums.com)

- Planet’s first catastrophic climate tipping point reached, report says, with coral reefs facing ‘widespread dieback’ (theguardian.com)

Le rapport de la semaine

- Click, Load, Kill : Examining the cyberweapon industry in the WANA (West Asia and North Africa) region (ifex.org)

A new SMEX report exposes how commercial spyware vendors empower authoritarian regimes to target dissidents and journalists, urging urgent protections for privacy and stronger accountability measures.

Spécial IA

- Is India the Global Anti-AI Play ? (indiadispatch.com)

Foreign institutional investors have pulled nearly $30 billion from Indian equity markets over the past twelve months. A huge chunk of that money has moved to Korea and Taiwan.

- The AI dilemma : To compete with China, the U.S. needs Chinese talent (restofworld.org)

Immigration restrictions can accelerate the flight of top talent, threatening the strategy that it is better to have the brightest minds working for U.S. companies.

- California cracks down on water theft but spares data centers from disclosing how much they use (latimes.com)

Gov. Gavin Newsom vetoed a bill that would have tracked data centers’ growing water footprint in California. […] New data centers have been rapidly proliferating in California and other western states as the rise of artificial intelligence and growing investments in cloud computing drive a construction boom.

- Thirsty AI mega projects raise alarm in some of Europe’s driest regions (cnbc.com)

- AI-related data centres use vast amounts of water. But gauging how much is a murky business (cbc.ca)

As tech companies spend billions on data centres, citizens around the world are starting to push back

- Your AI tools run on fracked gas and bulldozed Texas land (techcrunch.com)

The AI era is giving fracking a second act, a surprising twist for an industry that, even during its early 2010s boom years, was blamed by climate advocates for poisoned water tables, man-made earthquakes, and the stubborn persistence of fossil fuels.

- IA : la Californie promulgue une législation régulant les “chatbots”, une première aux États-Unis (france24.com)

En réaction à des suicides d’adolescents, le gouverneur de la Californie Gavin Newsom a signé lundi une série de lois pour réguler les agents conversationnels d’intelligence artificielle, imposant notamment de vérifier l’âge des utilisateurs et d’afficher des avertissements.

- AI-powered textbooks fail to make the grade in South Korea (restofworld.org)

South Korea’s AI learning program was rolled back after just four months following a backlash from teachers, students, and parents, underlining the challenges in embedding the technology in education.

- The Default Body – AI, biased health data, and the illusion of objectivity (jgcarpenter.com)

In 2022, a team at University College London revisited several machine-learning models used to predict liver disease from routine blood tests. On paper, the tools were successful, with accuracy across the general population. But the closer they looked, the more the averages cracked. The models missed liver disease in nearly half of the women they analyzed, compared with about a quarter of the men. Nothing in the models announced this imbalance ; it was buried in the math.

- GitHub Copilot Chat Flaw Leaked Data From Private Repositories (securityweek.com)

It turned out that Copilot was not merely learning from private repos, it was reportedly distributing them as if they were party favors. The user had not realized that the definition of an “AI pair programmer” extended to “unauthorized code distributor.” […] the GitHub user should perhaps feel flattered that their proprietary data was deemed worth sharing

- Refuser de parvenir à surproduire des merdes inutiles avec l’IA (lundi.am)

- Comment fait-on l’IA (data.yt)

- Sora : des deepfakes et représentations racistes de Martin Luther King et Malcolm X (next.ink)

- Amazon’s Ring Partners With Flock, a Network of AI Cameras Used By Police (yro.slashdot.org)

- GenAI and what it does to the brain (theguardian.com)

- Are we living in a golden age of stupidity ? (theguardian.com)

A global OECD study found, for instance, that the more students use tech in schools, the worse their results. “There is simply no independent evidence at scale for the effectiveness of these tools … in essence what is happening with these technologies is we’re experimenting on children […] Maybe the dawn of the new golden era of stupidity doesn’t begin when we submit to super-intelligent machines ; it starts when we hand over power to dumb ones.

- … À l’IA pour faire régner la terreur (danslesalgorithmes.net)

Ce que l’IA produit ne sont pas des erreurs. Ses erreurs sont ses promesses idéologiques.

- Le FMI met en garde contre le risque d’une déception liée aux bénéfices de l’IA pour l’économie mondiale (legrandcontinent.eu)

- « Bulle de l’IA » : Sam Altman, le PDG d’OpenAI, prévient d’un risque d’implosion du marché (trustmyscience.com)

Un récent rapport du MIT indique que près de 95 % des projets pilotes d’IA générative menés par les entreprises n’enregistrent aucun retour sur investissement significatif. Cette déception se traduit par une érosion progressive de la confiance, certaines sociétés et utilisateurs délaissant la technologie et avançant une productivité bien moindre que ne le laissait espérer le discours promotionnel.

- OpenAI Needs $400 Billion In The Next 12 Months (wheresyoured.at)

At some point, OpenAI is going to have to actually do the things it has promised to do, and the global financial system is incapable of supporting them. And to be clear, OpenAI cannot really do any of the things it’s promised.

Spécial Palestine et Israël

- Vente d’armes : livraison imminente de matériel français vers Israël (disclose.ngo)

Une semaine après la signature du cessez-le-feu entre Israël et le Hamas, Disclose révèle qu’un lot de matériel fabriqué par la société française Sermat doit être expédié en Israël, lundi 20 octobre. Ces composants sont destinés à des drones conçus par Elbit Systems, l’un des principaux fournisseurs de l’armée israélienne.

- « Le combat n’est pas encore terminé » : Israël menace de nouveau Gaza de rompre le cessez-le-feu (humanite.fr)

Le Hamas a affirmé mercredi 16 octobre avoir remis à Israël toutes les dépouilles d’otages auxquelles il avait pu accéder, soit neuf corps sur 28.

- Palestine : le nom d’une révolution décoloniale (contretemps.eu)

En Palestine, la lutte actuelle contre le colonialisme israélien est la plus difficile de l’histoire récente car elle se mène contre tout l’édifice impérialiste occidental.

- Flottille de la liberté : pour qui ? La flottille de la liberté a donné 5 migrants à Frontex et tout le monde s’en tape. (paris-luttes.info)

- Flottille pour Gaza : Un porte-parole exclu après des propos antisémites et homophobes (humanite.fr)

Sur les réseaux sociaux, des militants antifa ont récolté ces derniers mois des centaines de publications antisémites, homophobes, antikurdes… propagées depuis dix ans par Mustafa Cakici […] le militant d’extrême droite semble avoir peu à peu réussi à s’installer dans le paysage, au point de trouver le moyen d’embarquer à bord d’un des bateaux de la flottille pour Gaza

- Greta Thunberg : “They kicked me every time the flag touched my face” (aftonbladet.se)

She was not allowed to wear her T-shirt with “Free Palestine” on it and was ordered to change, she explains. She put on an orange one with the text “Decolonize” instead.

- Face aux attaques des colons contre les Palestiniens, l’interposition non-violente des volontaires internationaux (basta.media)

Pendant que Trump vante son plan de paix pour Gaza, en Cisjordanie, les attaques de colons contre des Palestinien·nes se poursuivent. Face aux violences, des volontaires internationaux et israéliens tentent de soutenir villageois·es et cultivateurices.

- La LDH porte plainte contre Airbnb et Booking : stop au tourisme d’occupation ! (ldh-france.org)

Airbnb et Booking proposent des centaines d’annonces de locations touristiques situées dans les colonies israéliennes illégales en Cisjordanie et à Jérusalem-Est.

Parce qu’il raconte une nouvelle histoire de la terre volée, des communautés installées illégalement et qu’il dynamise économiquement ces colonies, ce tourisme d’occupation participe à la création, à l’entretien et à l’extension des colonies israéliennes dans les territoires palestiniens occupés illégalement et favorise le déplacement forcé de la population palestinienne. Il n’est autre que le pendant de la colonisation criminelle ordonnée par les responsables israéliens. - À Gaza, l’OMS alerte sur une propagation des épidémies devenue « hors de contrôle » (huffingtonpost.fr)

- Une boulangerie industrielle, soutenue par l’ONU, a rouvert à Gaza (france24.com)

Une boulangerie industrielle a rouvert dans la Bande de Gaza, soutenue par l’agence onusienne du programme alimentaire mondial, elle produit 300 000 pita par jour. C’est pourtant insuffisant face aux besoins de la population de Gaza. L’agence a prévu d’en ouvrir plus d’une trentaine le plus rapidement possible.

- Effacer les Palestiniens : la fabrique médiatique du vide politique (politis.fr)

Omniprésents comme corps, les Palestiniens sont absents comme sujets. Un paradoxe qui dit quelque chose de la manière dont se fabrique une « terre à prendre ».

Spécial femmes dans le monde

- Ghost of Yōtei : pourquoi les masculinistes détestent son héroïne (japanization.org)

La sortie du jeu tant attendu Ghost of Yōtei fait quelques remous dans la communauté gaming. Si le jeu est une réussite absolue en matière de narratif et de visuels, la communauté masculiniste, ce cri du cygne d’un patriarcat en fin de vie, a tout de même trouvé à redire. C’est l’héroïne qui est désormais la cible de leurs critiques : pas assez sexy, pas assez voluptueuse, pas assez jeune, pas assez maquillée, trop indépendante… Bref, tous les clichés du beauf-moyen y passent.

- Muganga — la guerre se lit sur le corps des femmes (medfeminiswiya.net)

RIP

- La créatrice du programme d’échange Erasmus, Sofia Corradi, est morte (lemonde.fr)

Quelque 16 millions de jeunes ont pu étudier dans d’autres pays d’Europe grâce au projet lancé en 1987 par cette professeure italienne, qui s’est éteinte à l’âge de 91 ans.

Spécial France

- Analyse à chaud : l’annonce du Premier ministre concernant la réforme des retraites (blogs.alternatives-economiques.fr)

- L’agence de notation S&P accélère son calendrier pour abaisser la note de la France (huffingtonpost.fr)

Après Fitch et avant Moody’s, S&P (ex Standard & Poors) juge négativement les perspectives financières de la France.

- Bernard Arnault engrange 16 milliards d’euros en une journée (huffingtonpost.fr)

Dopée par le bond de plus de 12 % de l’action LVMH en une séance mercredi, la fortune de l’homme le plus riche de France culmine désormais à plus de 190 milliards d’euros.

- Michel Offerlé : « Le Medef a provoqué une division jamais vue chez les patrons » (alternatives-economiques.fr)

- Matthieu Pigasse : « Il y a urgence à partager les richesses, et je paierais volontiers la taxe Zucman » (alternatives-economiques.fr)

- Le musée du Louvre braqué à la disqueuse, des bijoux « d’une valeur inestimable » dérobés (liberation.fr)

- Nestlé va supprimer 16 000 postes dans le monde d’ici 2027 pour « rassurer les actionnaires » (humanite.fr)

Cette décision est un nouveau revers dans la tentative de sortir Nestlé d’une crise qui dure, suite aux scandales qui ont entaché sa réputation. Il y avait d’abord eu, en France, les pizzas Buitoni contaminées en 2022 et plus récemment le scandale des fraudes dans le traitement des eaux minérales Vittel et Perrier. […] « malheureusement, dans le monde actuel, rien ne vaut une suppression de salariés pour rassurer les actionnaires »

- Télécoms : Orange, Free et Bouygues Telecom ont remis sur la table leur offre de rachat (humanite.fr)

Les trois opérateurs ont remis sur la table, mercredi 15 octobre au soir, leur offre de rachat conjointe de SFR pourtant écartée par sa maison mère Altice France. L’hypothèse d’une vente à la découpe de l’entreprise inquiète depuis plusieurs mois les syndicats.

- La position victimaire de Nicolas Sarkozy est inique et offensante pour les familles des victimes décédées dans l’attentat du DC-10 d’UTA (nouvelobs.com)

La lecture du jugement ne peut laisser aucun doute à quiconque n’est pas aveuglé par l’esprit partisan : les faits qui étaient reprochés à Nicolas Sarkozy, Claude Guéant et Brice Hortefeux sont attestés et ils sont, comme l’a dit le tribunal, d’une exceptionnelle gravité.

- Nicolas Sarkozy restera administrateur de Lagardère et Accor pendant son incarcération (leparisien.fr)

Condamné à cinq ans de prison ferme dans l’affaire libyenne, l’ex-chef de l’État siégera aux conseils d’administration de Lagardère, Accor et LOV Group. Ses mandats ne sont pas incompatibles avec sa détention à la prison de la Santé.

- “Le Désespéré” de Courbet exposé à Orsay, une première en France depuis dix-sept ans (telerama.fr)

Propriété du Qatar Museums, l’organisme de développement des musées de l’émirat, la toile de 1844-1845, un autoportrait de l’artiste, est prêtée au musée parisien pour les cinq prochaines années.

- Yves Lae, ancien directeur du collège Saint-Pierre, au Relecq-Kerhuon, mis en cause pour violences multiples et infractions financières (splann.org)

Auteur de châtiments corporels sur des élèves du collège Saint-Pierre du Relecq-Kerhuon, l’ancien directeur Yves Lae, avait aussi été épinglé en 1971 pour un possible détournement de fonds publics. Des faits connus de l’administration comme du diocèse, qui n’ont pas enrayé son ascension au sein de l’enseignement catholique du Finistère.

- Scandales archéologiques en Auvergne-Rhône-Alpes : l’austérité rase notre passé (humanite.fr)

Les archéologues alertent sur le non-respect de la législation de tutelle du patrimoine archéologique, dans le cadre de projets de travaux sur le parvis de la cathédrale de Valence (Drôme) et de la déviation routière de Saint-Péray (Ardèche). La poursuite de ces travaux sans intervention archéologique préalable risque de créer de dangereux précédents

- Dans la Loire, le médicobus arpente les déserts médicaux (politis.fr)

Dans l’agglomération de Roanne (42), un cabinet médical mobile propose des consultations sur les places de plusieurs villages. À son bord, défilent des habitants de tous les âges privés d’accès à un médecin traitant et témoignant de leurs difficultés face à un système de santé défaillant.

- Pollution bactériologique : l’eau est interdite de consommation dans deux secteurs de Basse-Terre (la1ere.franceinfo.fr)

- Pesticides : la Haute-Garonne est le département le plus contaminé d’Occitanie, Toulouse en paie le prix (actu.fr)

- « Aujourd’hui, j’ai mal partout » : près de Bordeaux, des saisonniers viticoles poussés à bout et exposés aux pesticides (vert.eco)

- LGV Bordeaux-Toulouse : à toute vitesse face à l’inconnue des fantômes de roche (journal-labreche.fr)

- « On fonce droit dans le mur » : Airbus va bétonner 18 hectares à Toulouse (reporterre.net)

- Des travaux nocturnes illégaux sur l’A69 : “Aucune dérogation n’a été accordée” selon la préfecture de la Haute-Garonne (francebleu.fr)

- « Des millions d’euros économisés » : à Montpellier, un plan anti-pollution lumineuse sur mesure qui fait consensus (vert.eco)

L’enquête de la semaine

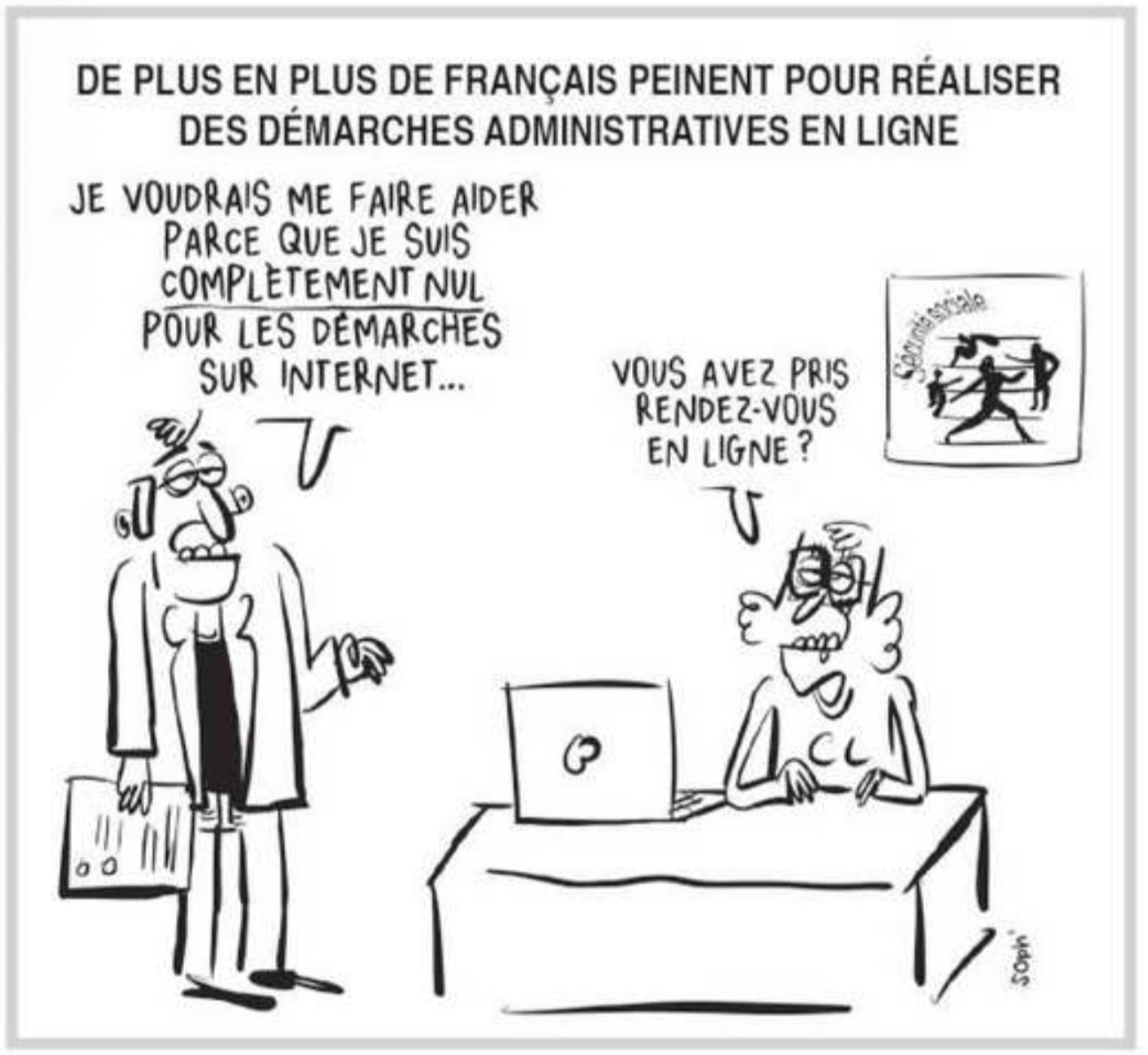

- Enquête sur l’accès aux droits sur les relations des usagers avec les services publics : que retenir ? (defenseurdesdroits.fr)

En 2024, 61 % des sondés rencontrent des difficultés, qu’elles soient ponctuelles ou régulières, contre seulement 39 % en 2016. Des difficultés qui touchent toute la population, y compris ceux habituellement moins concernés (+ 86 % pour les cadres ou professions intermédiaires, + 75 % pour les diplômés de master et plus). […] 23 % des usagers sondés déclarent avoir déjà renoncé à un droit au cours des 5 dernières années, avec pour motif principal : la complexité des démarches.

Spécial femmes en France

- Chlordécone : un nouvel effet nocif pour la fertilité des femmes en Martinique et Guadeloupe révélé par une étude (humanite.fr)

Des médeci·ennes et épidémiologistes français·es ont publié jeudi 16 octobre une étude qui révèle que les femmes les plus exposées à la chlordécone, insecticide cancérigène utilisé dans les bananeraies en Guadeloupe et en Martinique jusqu’en 1993, auraient 25 % de chances en moins de tomber enceinte.

- Souba Manoharane-Brunel, l’entrepreneuse féministe « poil à gratter » de l’écologie (reporterre.net)

« Si les femmes ne sont pas à la table, c’est qu’elles se retrouvent au menu » […] « Une écologie qui n’est ni décoloniale ni féministe n’est qu’un immense Jardiland réservé à une élite de bobos privilégiés. »

- Un rapport épingle le « terreau culturel » sexiste au ministère de l’Intérieur (streetpress.com)

À l’ère post-Metoo, la place Beauvau reste minée par une ambiance sexiste loin des promesses du ministère. Une situation mise en lumière par l’Inspection générale de l’administration, qui s’est penchée sur la situation des cadres supérieurs.

- « Je ne suis pas féministe, j’ai un bon amant » : quand les médias dépolitisent le féminisme (lesnouvellesnews.fr)

Tenter de neutraliser la parole féministe en la ramenant à une histoire d’insatisfaction personnelle, c’est encore ce que font beaucoup de médias, en 2025. Notamment dans les critiques de « La chair est triste hélas ».

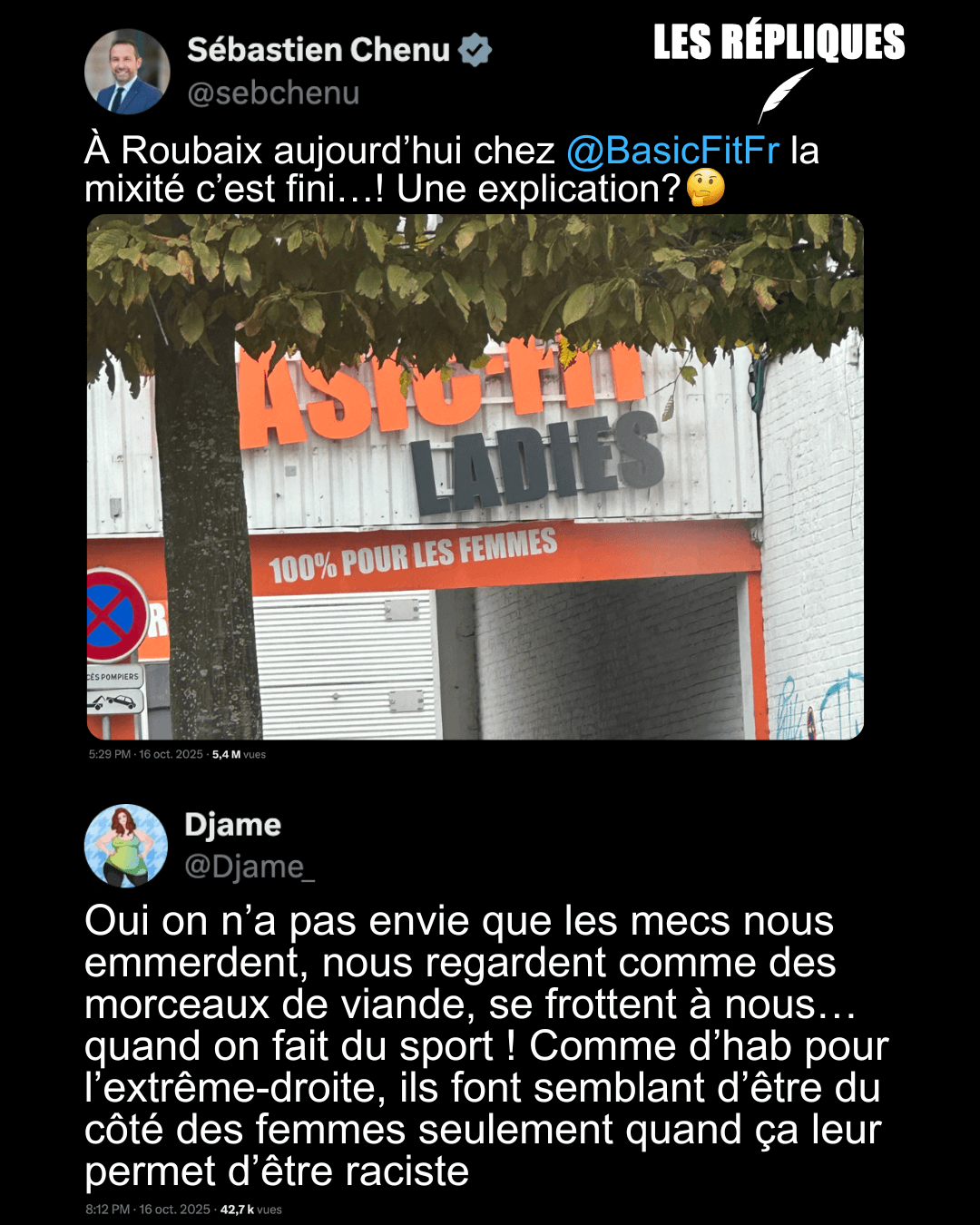

- Pour les femmes, les salles de sport sont trop souvent des lieux hostiles (huffingtonpost.fr)

Parce qu’elles subissent des comportements sexistes dans les salles de sport, les femmes doivent développer des stratégies d’évitement comme le montre cette étude.

- Anouk Grinberg porte plainte contre l’avocat de Gérard Depardieu auprès de l’Ordre des avocats de Paris (huffingtonpost.fr)

L’actrice reproche à Me Jérémie Assous, conseil de Gérard Depardieu, d’avoir manqué de respect aux femmes qui accusent le comédien et à leurs soutiens.

- “J’étais terrorisée par ses colères” : la streameuse Helydia porte plainte contre son ex-compagnon pour “violences volontaires aggravées” (franceinfo.fr)

- La star du développement personnel Jacques Salomé accusé de viols et d’agressions sexuelles par 5 femmes (humanite.fr)

Les faits dénoncés s’étalent sur une période de quasi trente ans.

Spécial médias et pouvoir

- Lecornu II : le (pitoyable) théâtre du journalisme politique (acrimed.org)

En pâmoison devant le discours de politique générale du nouveau Premier ministre, émoustillé par la perspective de « non-censure » au point de désinformer sans entraves sur la question des retraites, le journalisme politique nous a encore gratifié d’une très grande scène de son théâtre habituel.

- PLF 2026 : Un cataclysme budgétaire menace les radios associatives françaises (snrl.fr)

- Palestine : un mois ordinaire dans les médias français (1) (acrimed.org)

- BFMTV s’excuse après avoir confondu les députées noires Dieynaba Diop et Nadège Abomangoli (huffingtonpost.fr)

Après que le 20 Heures de France 2 a interverti Dominique Bernard et Samuel Paty, conduisant Léa Salamé à présenter des excuses, c’est au tour de BFMTV d’être pris en flagrant délit de confusion.

- Suspicion d’emplois fictifs : au Canard Enchainé, les deux ex-dirigeants, un ancien dessinateur et sa compagne relaxé·es (humanite.fr)

- “On essaie de nous faire taire !”, pourquoi le budget de Sébastien Lecornu inquiète les radios associatives (france3-regions.franceinfo.fr)

Spécial emmerdeurs irresponsables gérant comme des pieds (et à la néolibérale)

- Qui sont les ministres du gouvernement Lecornu 2 ? (projetarcadie.com)

Si certains visages et noms sont désormais très connus du grand public, une grande partie des ministres nommés cette nuit sont surtout familiers des habitués du Palais Bourbon. Tour d’horizon des nouveaux venus, dans l’ordre protocolaire.

- Édouard Geffray, bras droit de Jean-Michel Blanquer, est le 7ème ministre de l’Éducation nationale (cafepedagogique.net)

La dernière étude Talis, quinquennale, pointait le taux faible de professeurs qui se sentent considérés par la société ou les dirigeants, soit 4 %. Avec 96 % des professeur.es qui se sentent méprisés, la France est sans surprise à la dernière place du classement. L’objectif serait-il d’arriver à 100 % à l’issue du second quinquennat ?

- Le budget 2026 de Sébastien Lecornu prévoit une trentaine de milliards d’euros d’économies (huffingtonpost.fr)

Sans retour de l’ISF et sans taxe Zucman, le gouvernement envisage une mise à contribution des plus riches inférieure à 2025.

- Budget, réforme des retraites… Dans son discours de politique générale, Sébastien Lecornu remet l’écologie à plus tard (vert.eco)

- Pourquoi les annonces de Sébastien Lecornu sont une arnaque (politis.fr)

- « Tout a été fait pour épargner Bernard Arnault » : Gabriel Zucman étrille le budget de Sébastien Lecornu (huffingtonpost.fr)

La nouvelle taxe sur les holdings patrimoniales proposée par le gouvernement de Sébastien Lecornu ne séduit pas du tout Gabriel Zucman.

- Gel des pensions et remplacement de l’abattement de 10 % : le projet de budget cible les retraités (tf1info.fr)

- Budget de la Sécurité sociale 2026 : retraité·es, malades, salarié·es, familles, qui sont les perdant·es ? (projetarcadie.com)

- Budget 2026 : Ce discret coup de rabot sur les allocations familiales envisagé par le gouvernement (huffingtonpost.fr)

Le gouvernement envisage de passer de 14 à 18 ans l’âge de revalorisation des allocations familiales versées à partir du deuxième enfant.

- « Les Outre-mer paient la note de la mauvaise gestion » : face à la colère des Ultramarins, Sébastien Lecornu tente une conciliation (humanite.fr)

Le projet de budget proposé par le premier ministre, Sébastien Lecornu, provoque la colère des parlementaires ultramarins. Parmi eux, cinq socialistes se sont prononcés pour la censure du gouvernement.

- À l’Assemblée, Sébastien Lecornu gagne du temps grâce aux socialistes (politis.fr)

Dans un discours de politique générale express, le premier ministre renonce au 49.3 et suspend la réforme des retraites. Rien de plus. Mais suffisant pour que les socialistes ne le censurent pas immédiatement.

- À l’Assemblée, Sébastien Lecornu dit merci aux socialistes (politis.fr)

Le premier ministre échappe aux censures. Chez les socialistes, la fronde n’a pas vraiment eu lieu. Et la gauche se retrouve écartelée entre deux pôles.

- Le PS joue le mouvement populaire à la roulette russe (blogs.mediapart.fr)

- Lecornu : au PS, chronique d’une trahison permanente (politis.fr)

- Cher Olivier Faure (blast-info.fr)

Jeudi 16 octobre, le gouvernement de Sébastien Lecornu échappait, à 18 voix près, à la censure, pour le plus grand soulagement de la clique macronienne, merci pour eux, et pour la plus grande consternation de nombre d’électeurs et électrices de gauche qui n’imaginaient visiblement pas, en votant pour le Nouveau Front populaire à l’été 2024, que l’une de ses composantes jouerait, moins de 18 mois plus tard, le rôle de béquille du macronisme.

Spécial recul des droits et libertés, violences policières, montée de l’extrême-droite…

- Après une violente agression à Toulon, un groupe identitaire s’en sort au tribunal (streetpress.com)

Quatre membres du groupe identitaire, Le Maquis, ont comparu ce vendredi au tribunal de Toulon pour l’agression de deux mineurs. Malgré les éléments, le fond n’a pas été jugé : le tribunal a considéré l’enquête du parquet insuffisamment justifiée. […] La décision suscite d’ailleurs suffisamment d’incompréhension dans la salle pour que la présidente lance un avertissement un brin mystérieux : « Attention, si je lis des choses désagréables dans la presse, je saurai quoi faire. »

- « Maccarthysme 2.0 » : un rapport alerte sur les attaques contre la liberté académique des chercheureuses, y compris en France (humanite.fr)

- Vichy et les Juifs français : deux historiennes dans le viseur d’auteurs révisionnistes (telerama.fr)

Michèle Riot-Sarcey et Natacha Coquery sont attaquées en justice pour avoir contesté, dans un article, la thèse d’un ouvrage soutenant que le régime de Vichy aurait œuvré à protéger les Juifs français pendant la Seconde Guerre mondiale.

Voir aussi Historiennes poursuivies par des révisionnistes de Vichy : le tribunal annule la procédure (humanite.fr)

- Au grand homme, la patrie indifférente (syndicat-magistrature.fr)

Tout juste renommé ministre de la Justice, Gérald Darmanin choisit de poursuivre la création de prison de haute sécurité.Le Syndicat de la magistrature dénonce l’extension d’un régime qui impose des conditions de détention indignes et inhumaines à des personnes qualifiées par l’administration de « dangereuses » sans critère ni fondement transparent. […] Cette annonce intervient alors même que la République vient de célébrer Robert Badinter qui avait fermé les quartiers de haute sécurité en 1982, dénonçant l’« indignité d’un État de droit qui se nie lui-même ».

- Christian Tein enfin autorisé à rentrer en Kanaky-Nouvelle-Calédonie (humanite.fr)

Le président du FLNKS est toujours sous le coup d’une procédure judiciaire : il est accusé d’avoir orchestré les violences de mai 2024 sur l’archipel quand le gouvernement et la droite locale avaient voulu imposer le dégel du corps électoral au mépris du processus de décolonisation. Le dossier paraît de plus en plus vide, et Christian Tein a passé un an derrière les barreaux pour des motifs politiques

- Un comité des Nations Unies accuse la France violations « graves et systématiques » des droits des mineur·es isolé·es (humanite.fr)

- À Paris, un conducteur percute deux personnes lors d’une manifestation de sans-papiers (politis.fr)

Vendredi 10 octobre, un homme en voiture a percuté des manifestants lors d’une mobilisation organisée par un collectif de sans-papiers à Paris. Deux hommes ont été blessés et ont porté plainte. Malgré leurs témoignages, la police a retenu l’infraction de « blessures involontaires ». […] Pour que la Fiat s’arrête, il a fallu que la police arrive en courant et pointe son arme sur le conducteur en lui intimant de s’arrêter. « J’ai dit aux camarades “éloignez-vous” » se souvient Yoro. « Dans ma tête il n’allait pas s’arrêter et ils allaient tirer. »

- Pays basque : des amendes requises contre les sept militants solidaires des exilés (basta.media)

Sept militant·es solidaires risquaient dix ans de prison pour avoir aidé des personnes exilées à passer la frontière lors d’un évènement sportif. Au procès, le 7 octobre à Bayonne, des amendes de 1000 à 1500 euros ont finalement été requises.

- 163 000 euros pour un jet de peinture : Matignon veut faire payer deux écologistes (reporterre.net)

- « Gilets jaunes » : relaxe d’un major de CRS poursuivi pour la main arrachée d’un manifestant en 2018 (lemonde.fr)

Au vu de la « situation très dégradée » de la manifestation, « le tribunal a considéré que l’action du major D. constituait une réponse nécessaire et proportionnée », propre à l’exercice de ses fonctions de maintien de l’ordre.

Spécial résistances

- Affaire des fichiers d’Éric Ciotti : la Ligue des Droits de l’Homme annonce déposer plainte contre le député et candidat à la mairie de Nice (nicepresse.com)

Une enquête préliminaire avait été ouverte en mai dernier du chef d’« enregistrement ou conservation de données à caractère personnel sensibles ». Ceci faisant suite au signalement au printemps d’un « lanceur d’alerte anonyme » informant de l’existence de ce document mis en place par les équipes du député et président de l’UDR Éric Ciotti.

- Communiqué de presse d’Autisme France Suite aux propos du ministre du Travail, Jean-Pierre Farandou, au JT de France 2 le 14 octobre 2025 (autisme-france.fr)

Le ministre du Travail et des Solidarités a associé sourd à autiste : il dit ainsi qu’être autiste est un choix personnel, celui de ne pas écouter : ce genre d’ânerie est malheureusement entretenu par la psychanalyse qui continue à sévir en France dans l’autisme et explique l’autisme par une décision du « sujet ».

- Calvados : Sabotage de la ligne Paris-Caen à l’occasion des Assises Nationales de l’IA (trognon.info)

Spécial outils de résistance

- IA et vie privée : comment s’opposer à la réutilisation de ses données personnelles pour l’entraînement d’agents conversationnels ? (cnil.fr)

- Impôt sur les sociétés : 14 milliards d’euros en plus si les grandes entreprises avaient le même taux d’imposition que les PME (france.attac.org)

- Baisser le coût du travail ne crée pas d’emplois (politis.fr)

- Le Cherche et Trouve de l’édition (surtout) française (ecologiedulivre.org)

- Avec cette carte inédite, vérifiez si l’eau du robinet est polluée chez vous (reporterre.net)

Pollution aux PFAS, aux pesticides, au gaz toxique… Face aux multiples alertes concernant l’eau du robinet, vous pouvez dorénavant utiliser le site Dans mon eau (dansmoneau.fr). Développé par l’ONG Générations futures et Data For Good, cet outil novateur permet de savoir précisément quels polluants contaminent, ou non, votre eau courante.

- La contraception masculine en 3 questions (revue-farouest.fr)

Et si la contraception n’était plus seulement une affaire de femmes ? Préservatif, vasectomie, méthodes thermiques… les options masculines existent bel et bien, mais restent méconnues. Entre idées reçues et manque de soutien, ces solutions gagneraient pourtant à être mieux connues et discutées.

Spécial GAFAM et cie

- A first look at the Amazon-backed, next-generation nuclear facility planned for Washington state (geekwire.com)

A project to build one of the nation’s first next-generation nuclear facilities has just announced its name — the Cascade Advanced Energy Facility — and shared renderings of the plant.

- How I Reversed Amazon’s Kindle Web Obfuscation Because Their App Sucked (blog.pixelmelt.dev)

So let me get this straight :

I paid money for this book

I can only read it in Amazon’s broken app

I can’t download it

I can’t back it up

I don’t actually own it

Amazon can delete it whenever they want

This is a rental, not a purchase. - Microsoft Windows 11 October Update Breaks Localhost (127.0.0.1) Connections (cybersecuritynews.com)

- Windows 10 support “ends” today, but it’s just the first of many deaths (arstechnica.com)

End users can get an extra year of security updates relatively easily.

- Suspension du projet Microsoft à Polytechnique : une première victoire pour la souveraineté numérique, un appel à la responsabilité pour l’ensemble de l’ESR (cnll.fr)

L’École polytechnique suspend sa migration vers Microsoft 365. Le Conseil National du Logiciel Libre (CNLL), qui s’était fermement opposé à ce projet, accueille cette décision comme une victoire majeure pour la souveraineté de la recherche française et le respect du droit.

- Bye bye Spotify (pcet.fr)

Les autres lectures de la semaine

- Le droit de grève va-t-il disparaître ? D’où vient la menace ? (equaltimes.org)

La montée en puissance des politiques néolibérales incite de nombreux gouvernements à tenter de les entraver par de nouvelles lois, limitant ainsi les effets perturbateurs des grèves, ce qui les rend pratiquement inopérantes comme outil de pression et de défense des classes populaires.

- GenZ 212, au-delà de l’acronyme : regard sur une révolte (portail.basta.media)

- L’affrontement sino-américain pour le contrôle du numérique (contretemps.eu)

- Holes in the web (aeon.co)

Huge swathes of human knowledge are missing from the internet. By definition, generative AI is shockingly ignorant too […] one study on medicinal plants in North America, northwest Amazonia and New Guinea found that more than 75 per cent of the 12,495 distinct uses of plant species were unique to just one local language. When a language becomes marginalised, the plant knowledge embedded within it often disappears as well.

- La blague de l’open source base de souveraineté (paperjam.lu)

dans un monde où la souveraineté numérique se joue autant sur les données que sur le code, l’open source n’est pas encore une garantie d’indépendance : c’est un terrain de bataille.

- Surprise ! La 5G ne sert à (presque) rien (thierryjoffredo.frama.io)

Ça valait bien la peine de stigmatiser les personnes de la société civile qui réclamaient, en 2020, un débat démocratique pour définir les modalités de mise en œuvre de cette technologie en brandissant la peur du retour à la lampe à huile ou à la bifurcation vers un modèle Amish, sur fond de peur d’un supposé “retard” français et du déclassement de l’économie française sur le plan économique mondial si on perdait du temps à en discuter collectivement de la possibilité d’un moratoire sur le déploiement de la 5G.

- Notes on Humans Commons (blog.zgp.org)

- Détournement des communautés (n.survol.fr)

la question n’est pas de si la récupération va arriver mais de quand

- Le numérique à l’aune de la communotechnie – Les militant·es écologistes et le numérique (ecologiesocialeetcommunalisme.org)

- Écrire à la main et faire des pauses aide à mémoriser (theconversation.com)

- Delphine Demange et les compilateurs (linuxfr.org)

- Corps et territoire (hors-serie.net)

En Amérique latine, dans les réseaux de femmes paysannes, indigènes et urbaines, le féminisme populaire défend la terre, le territoire, et donne une signification particulière à la corporalité, à un corps-territoire […] l’agentivité des femmes est évidente, puisqu’elles se trouvent à l’avant-garde de la défense du territoire, de la terre, en opposition aux projets miniers et contre les compagnies pétrolières. Il me semble que ces phénomènes expliquent les vagues de féminicides et la pédagogie de la cruauté qui conduit à la mort, mais aussi à des actes de torture. Il y a une visibilité du corps torturé dans l’espace public.

- Le pouvoir des mâles n’est pas la norme chez les primates. (theconversation.com)

Depuis Darwin et jusqu’à la fin des années 1990, les recherches sur les stratégies de reproduction des animaux s’intéressaient surtout aux mâles. Une prise de conscience a ensuite eu lieu, en réalisant qu’il pourrait être intéressant de ne pas seulement étudier la moitié des partenaires… […] la dominance stricte d’un sexe sur l’autre, lorsqu’un sexe gagne plus de 90 % des confrontations, comme ce que l’on observe chez les babouins chacma, est rare. Il y a moins de 20 % des espèces où les mâles sont strictement dominants sur les femelles, et également moins de 20 % où ce sont les femelles qui sont strictement dominantes. […] la dominance des mâles s’observe surtout chez les espèces polygames, terrestres, vivant en groupe, comme par exemple les babouins, les macaques ou encore les gorilles, où les mâles disposent d’une nette supériorité physique sur les femelles.

- « Nous avons des enseignements à tirer de la manière dont les animaux se soignent » (reporterre.net)

- 5 astuces low-tech pour arrêter de ronfler et dormir d’une traite (lowtechjournal.fr)

Les BDs/graphiques/photos de la semaine

- Mixité

- Oignon

- RdV

- Pourquoi

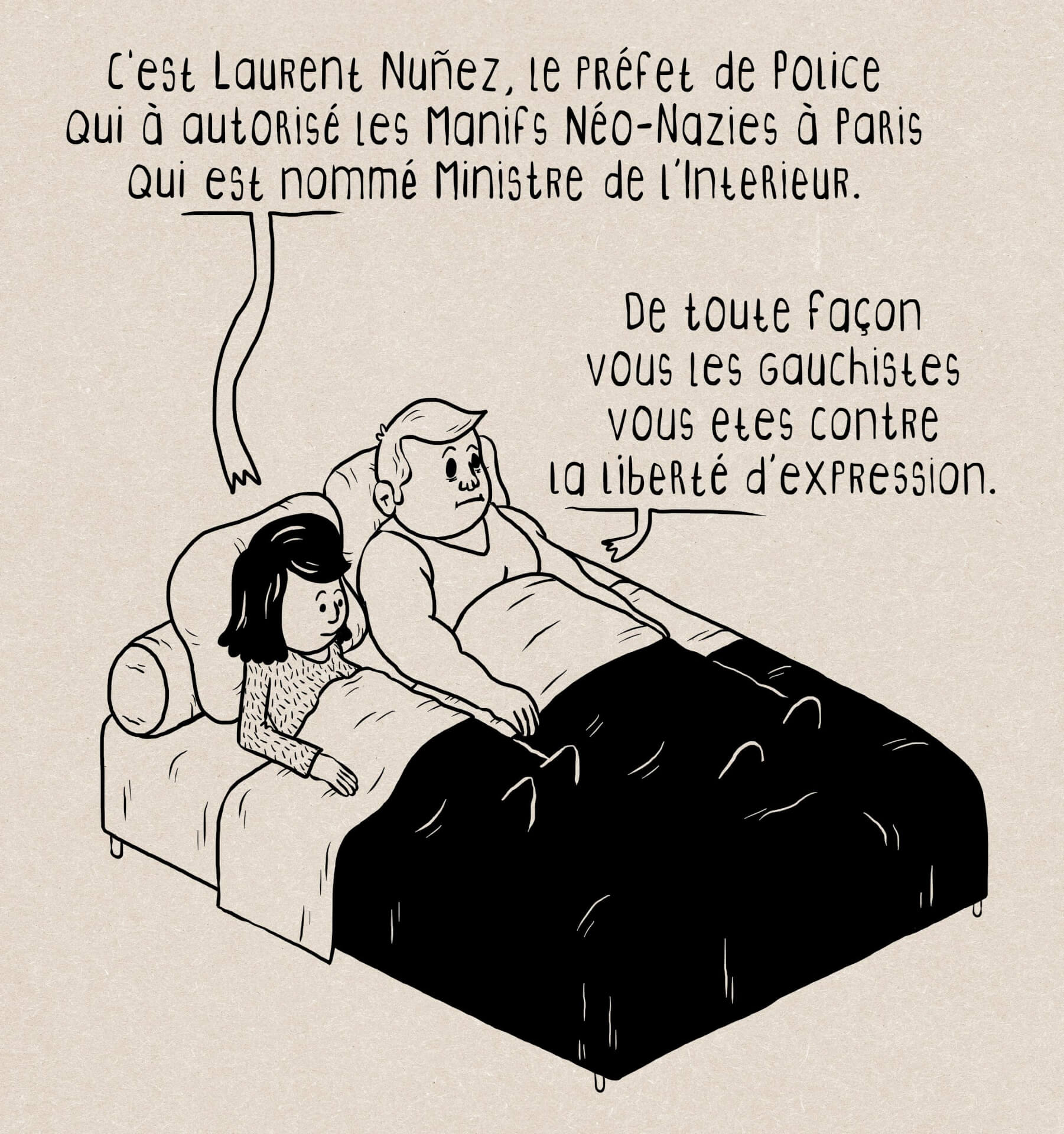

- Nunez

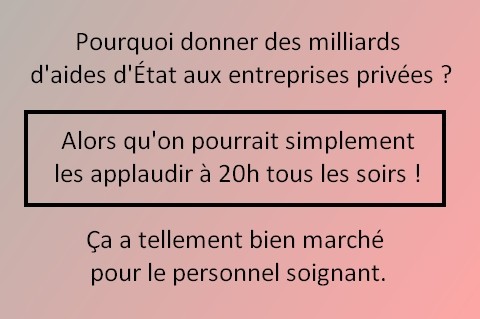

- Retraites

- FT

- Zucman

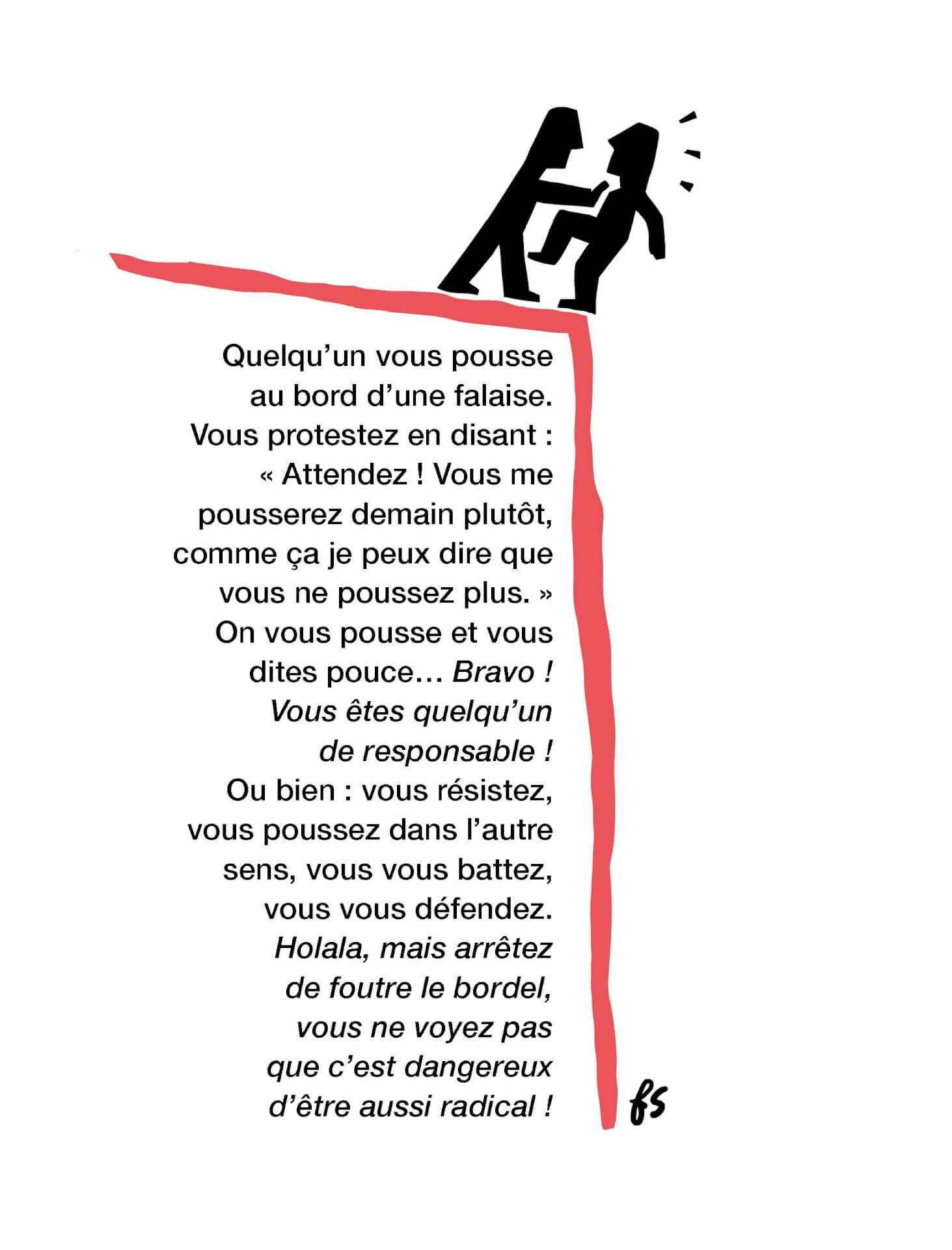

- Falaise

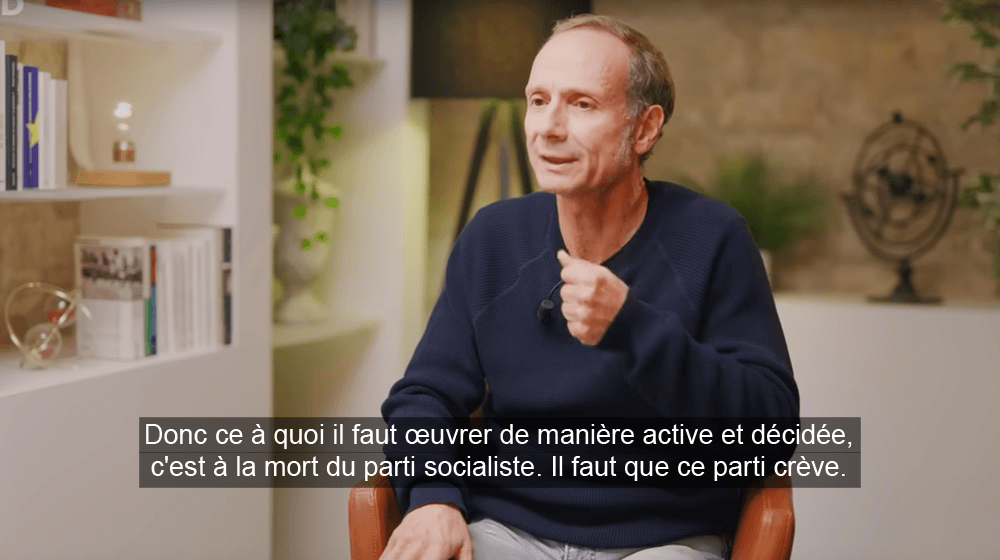

- PS

- Donc

- At least

- Surveillance

- Nope

- Resist

- Pikachu

- Girls

- Grantifa

- Internationale

- Belts

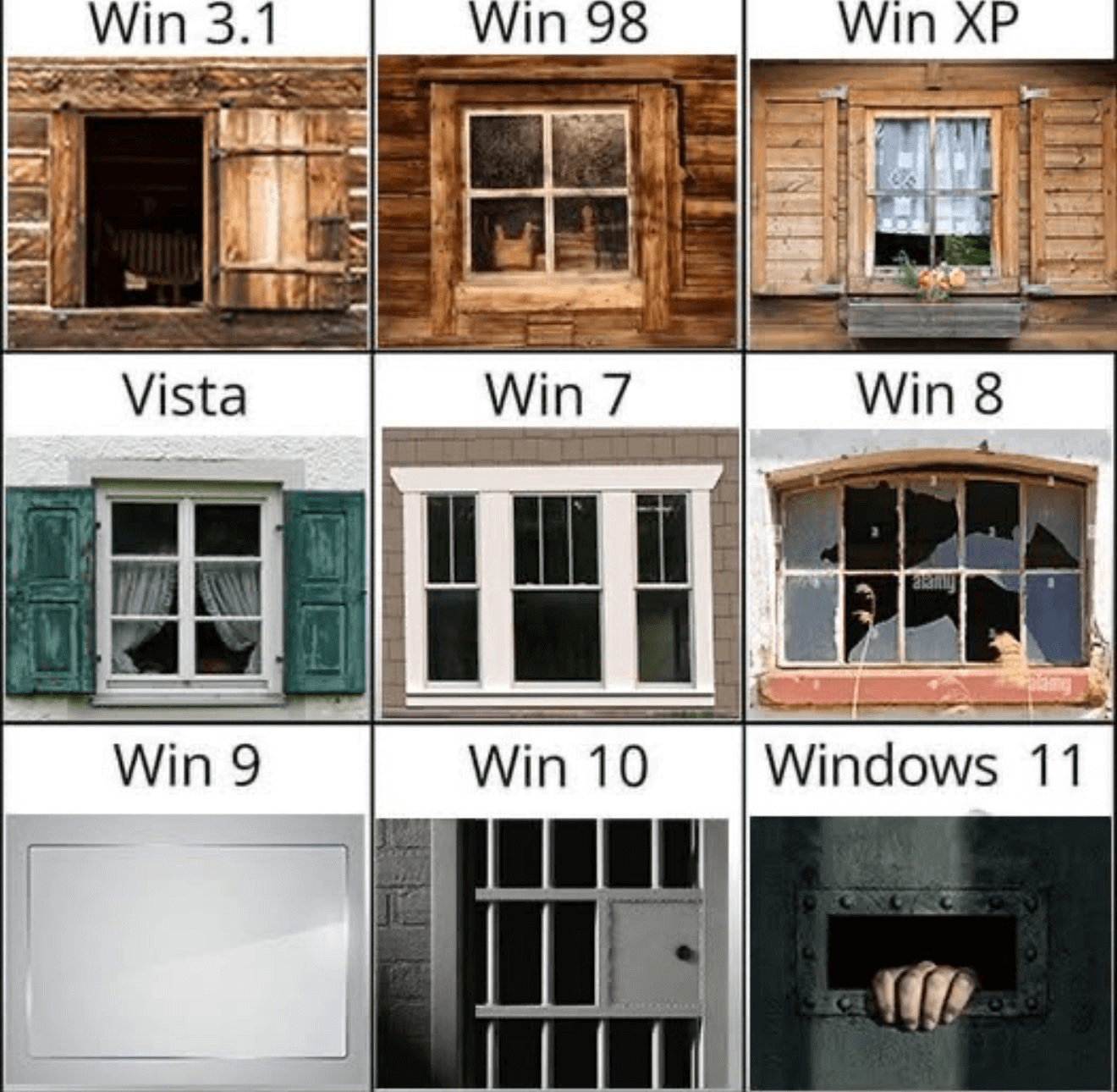

- Windows

- Climate

- Does the news reflect what we die from ? (ourworldindata.org)

Les vidéos/podcasts de la semaine

- Catherine Tricot : ça va faire mal ! (tube.fdn.fr)

- Alice de Rochechouart sur la différence entre privilèges et compensations de désavantages (tube.fdn.fr)

- Italie : aux origines de la coalition des droites sous domination néofasciste (partie 1) (spectremedia.org)

- Islande, un jour sans femmes (arte.tv – disponible jusqu’au 13/01/2026)

En 1975, pour réclamer l’égalité entre les sexes, des féministes islandaises lancent un appel à la grève qui sera suivi… par 90 % des femmes du pays. Cinquante ans plus tard, celles qui l’ont vécue relatent cette joyeuse journée historique, restée unique au monde par son ampleur.

- Bari Weiss : Last Week Tonight with John Oliver (HBO) (tube.fede.re)

- Smart Glasses Are Ushering In An Anti-Social World (techwontsave.us)

- Le monde après le spécisme – En finir avec l’oppression des animaux (radiofrance.fr)

Les trucs chouettes de la semaine

- FSF announces Librephone project (fsf.org)