03.05.2026 à 16:15

Aux obsèques aussi, la musique a un prix

Jordy Bony, Docteur et Professeur en droit à l'EM Lyon, EM Lyon Business School

Annika Romano, Professor of practice, Droit du numérique, propriété intellectuelle et contrats internationaux, EM Lyon Business School

Texte intégral (2361 mots)

Si, intuitivement, nous pensons les cérémonies funéraires comme des moments qui ne concernent que le cercle des proches et relèvent de l’intimité, le droit considère que la diffusion de musique dans ce cadre doit donner lieu à la rétribution des droits d’auteur. Une question juridique complexe qui s’impose dans un moment de grande vulnérabilité et qui mérite d’être mieux comprise.

Entre hommage personnalisé et cadre réglementaire une décision rendue le 31 janvier 2024 par le tribunal judiciaire de Paris invite à reconsidérer les pratiques du secteur funéraire en jugeant que la diffusion de musique lors des cérémonies funéraires constitue un acte de communication au public au sens du Code de la propriété intellectuelle, ce qui entraîne la rémunération des auteurs par l’intermédiaire de la Societé des auteurs, compositeurs et éditeurs de musique (Sacem).

Cette évolution soulève toutefois plusieurs questions quant à la conciliation entre le respect des droits d’auteur et le caractère sensible et intime des funérailles.

C’est l’occasion de revenir sur les fondements juridiques du droit d’auteur, du cas particulier des cérémonies funéraires et sur les questions que tout cela pose pour l’avenir juridique de ce secteur.

Fondements juridiques du droit d’auteur

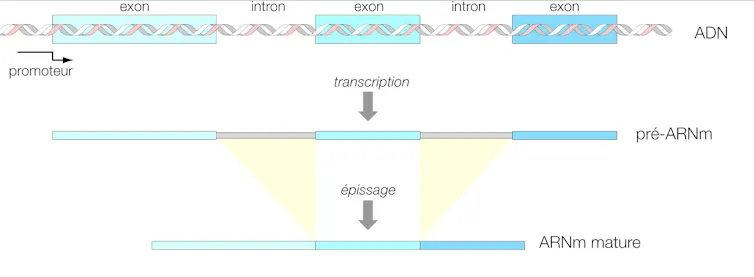

Le droit d’auteur regroupe les droits dont dispose un auteur sur ses œuvres de l’esprit, c’est-à-dire des créations originales, telles que les œuvres littéraires, plastiques, photographiques, logicielles ou musicales. En matière musicale, les droits d’auteur protègent à la fois le compositeur et le parolier, c’est-à-dire l’auteur du texte.

Afin d’être protégées, toutefois, ces œuvres de l’esprit doivent présenter un caractère « original ». Autrement dit, l’œuvre doit porter l’empreinte de la personnalité de son auteur ou refléter un apport intellectuel ou un effort créatif. La jurisprudence a progressivement permis de définir plus clairement cet élément de l’originalité. En particulier, dans l’arrêt Painer du 1ᵉʳ décembre 2011, la Cour de justice de l’Union européenne renforce la reconnaissance de la personnalité créative de l’auteur, en affirmant que l’originalité d’une œuvre est définie comme le reflet de sa personnalité qui se manifeste à travers des choix libres et créatifs.

De surcroît, l’originalité d’une œuvre musicale possède des éléments qui lui sont propres, notamment sa nature. Selon la Cour de cassation, en effet, l’originalité de l’œuvre musicale s’apprécie à l’écoute de l’ensemble de l’œuvre, au regard de ses éléments constitutifs que sont la mélodie, l’harmonie et le rythme.

De manière plus générale, le droit d’auteur repose sur un ensemble de principes, clairement énoncés dans le Code de la propriété intellectuelle, qui définissent le cadre de protection des œuvres artistiques et littéraires, dont les œuvres musicales, les enregistrements et les reproductions Notamment, l’article L. 111-1 consacre le droit exclusif de l’auteur du seul fait de la création, la protection de l’œuvre ne nécessite aucune formalité. Par conséquent, aucun dépôt constitutif n’est, en théorie, nécessaire afin d’acquérir ce droit exclusif sur sa musique.

Malgré ce principe, en cas de litige sur la paternité, l’auteur devra être en mesure de donner la preuve de la date de création de l’œuvre. À cette fin, il pourra déposer une enveloppe Soleau auprès de l’Institut national de la propriété industrielle (Inpi) afin d’horodater la création ou déposer l’œuvre chez un notaire, un huissier de justice ou faire appel à une société d’auteurs.

Ce droit exclusif de l’auteur, qui est en théorie opposable à tous, compte des attributs d’ordre patrimonial, à savoir les droits sur l’exploitation de l’œuvre, mais aussi des droits moraux, notamment le droit à la paternité de l’œuvre, à sa divulgation et son respect.

Si le droit moral est perpétuel et incessible, les droits patrimoniaux ont une durée limitée à la vie de l’auteur et durent soixante-dix ans après sa mort. Parmi ces droits patrimoniaux figure le droit de représentation et de communication au public des œuvres musicales, défini aux articles L. 122-1 et L. 122-2 du Code de la propriété intellectuelle.

Ces dispositions imposent notamment que toute diffusion d’une œuvre en dehors du cercle strictement privé, entendu comme un groupe composé d’un nombre restreint de proches, fasse l’objet d’une autorisation préalable et surtout d’une rémunération de l’auteur. C’est là que le bât blesse en ce qui concerne les cérémonies funéraires. Ne sont-elles pas organisées dans le cadre privé, avec un groupe restreint de proches ?

Le cas particulier des cérémonies funéraires

C’est ici que le sujet devient délicat. En apparence, les funérailles relèvent de l’intime : elles réunissent famille, proches et quelques connaissances dans un moment de recueillement. Beaucoup seraient donc tentés de voir dans la diffusion d’une chanson un acte relevant naturellement du cadre privé. Pourtant, en droit d’auteur, cette intuition ne suffit pas. Le Code de la propriété intellectuelle cité ci-dessus ne vise pas toute situation simplement « privée » au sens courant, mais uniquement les représentations privées et gratuites effectuées exclusivement dans un cercle de famille. Cette exception est d’interprétation stricte.

C’est précisément sur ce point qu’est intervenue la décision rendue par le tribunal judiciaire de Paris, le 31 janvier 2024. Saisi d’un litige opposant notamment la Sacem à des fédérations du secteur funéraire, le tribunal a jugé que la diffusion de musique lors des cérémonies d’obsèques constituait bien « une communication au public ». Il a donc écarté l’argument selon lequel ces diffusions relèveraient automatiquement du cercle de famille. Autrement dit, le caractère solennel, émotionnel ou même familial d’une cérémonie funéraire ne suffit pas, à lui seul, à la faire échapper au droit d’auteur.

Cela peut sembler assez logique : la qualification de « communication au public » repose sur des critères objectifs, tenant notamment à la nature de la diffusion et au cercle des personnes qui y ont accès. Or, le caractère solennel, émotionnel ou même familial d’une cérémonie funéraire n’a pas, en lui-même, pour effet de soustraire cette diffusion au droit d’auteur.

D’un point de vue très pragmatique, la solution peut toutefois sembler contre-intuitive. Dans le langage courant, les obsèques sont souvent perçues comme un événement privé. Mais le droit raisonne autrement. Ce qui compte, ce n’est pas seulement l’intimité ressentie par les participants, mais aussi le cadre dans lequel la musique est diffusée. Lorsqu’une œuvre musicale est intégrée à une cérémonie organisée par un opérateur funéraire, dans le cadre d’une prestation de services, avec des moyens techniques de diffusion mis à disposition de plusieurs personnes, les juges peuvent y voir un acte de communication au public. La cérémonie demeure un moment personnel pour les proches, sans pour autant relever nécessairement, au sens juridique, du cercle de famille.

Il faut d’ailleurs souligner un point important : la question ne revient pas à demander si une famille endeuillée devra elle-même régler des droits d’auteur pour chaque morceau choisi. En pratique, le débat concerne surtout les opérateurs funéraires, c’est-à-dire les professionnels qui organisent la cérémonie et assurent la diffusion de musique dans le cadre de leur activité. C’est à ce niveau que s’organise la relation avec la Sacem et que se pose la question de la rémunération des auteurs. Cette précision compte, car elle montre que la controverse vise moins les familles que l’encadrement juridique d’une prestation professionnelle intégrant des œuvres protégées. Dernier élément rassurant : cela ne change quasiment rien sur la facture. En effet, la redevance coûte entre 1,6 et 3 euros par cérémonie aux opérateurs.

Reste que la solution suscite un malaise compréhensible. Les funérailles ne sont ni un spectacle ni un simple service marchand comme un autre. La musique y joue souvent un rôle symbolique fort : elle accompagne le deuil, rappelle la personnalité du défunt et participe à la singularité de l’hommage. C’est pourquoi la soumission de ces diffusions au droit d’auteur peut apparaître, pour certains, comme une intrusion de la logique patrimoniale dans un moment de grande vulnérabilité humaine.

À l’inverse, on peut aussi soutenir qu’il n’existe pas, en principe, de raison de priver les auteurs de rémunération au seul motif que leurs œuvres sont utilisées dans un contexte funéraire. Le véritable enjeu est donc moins d’opposer brutalement les familles aux titulaires de droits que de trouver un équilibre entre la dignité des cérémonies et le respect des règles de propriété intellectuelle.

Quoi qu’il en soit, tout cela a donné naissance à la signature d’un compromis sectoriel en 2025 entre la Sacem et les opérateurs du funéraires. Cet accord a permis d’abaisser les coûts et de simplifier les modalités déclaratives pour les professionnels. Sur le plan pratique, il constitue donc une réponse utile. Il ne tranche toutefois pas, à lui seul, la question de fond. La réduction des tarifs et l’organisation administrative du dispositif n’effacent ni le débat sur la qualification juridique des cérémonies, ni l’inconfort symbolique que suscite l’application du droit d’auteur à un moment de deuil.

Le compromis apaise la pratique, sans nécessairement clore la réflexion, laquelle peut d’ailleurs s’étendre au-delà du seul secteur funéraire.

Repenser les rapports entre pratiques funéraires et catégories juridiques établies

Dès lors, plusieurs questions peuvent être posées pour mieux envisager l’avenir et anticiper les litiges.

D’abord, la notion de « cercle de famille » est-elle encore adaptée aux rituels contemporains du deuil ? Le contentieux relatif à la musique diffusée lors des obsèques révèle peut-être les limites de cette notion juridique ancienne. En refusant d’assimiler automatiquement les cérémonies funéraires à cette exception, le tribunal judiciaire de Paris a rappelé que le droit d’auteur retient une conception étroite de la représentation privée. Mais cette rigueur interroge : les formes contemporaines du deuil, souvent plus ouvertes, plus personnalisées et parfois organisées par des opérateurs funéraires, entrent-elles encore dans les catégories classiques du droit de la propriété intellectuelle ?

Plus largement, cela revient à se demander jusqu’où la cérémonie funéraire peut être assimilée à une prestation de services comme une autre. Le raisonnement des juges repose en partie sur le fait que la diffusion musicale s’insère dans une prestation organisée par un professionnel. Cette logique est juridiquement cohérente, mais elle soulève une question plus large : la cérémonie funéraire doit-elle être analysée comme une simple prestation de services comportant un fond musical ou comme un rituel social et humain si particulier qu’il appelle un traitement distinct ? En d’autres termes, la qualification juridique actuelle rend peut-être compte du fonctionnement économique du secteur, sans épouser pleinement la singularité sociale des obsèques. Le compromis sectoriel de 2025 précité, par exemple, ne permet pas de répondre à cette question.

Pour finir, cette affaire montre combien certaines catégories du droit peuvent paraître contre-intuitives au grand public. Dans le langage courant, les funérailles sont perçues comme un moment intime ; en droit d’auteur, cela ne suffit pas à relever du cercle de famille. L’écart entre ces deux perceptions explique une grande part de l’émotion suscitée par le sujet. Peut-être faut-il donc, au-delà du débat de fond, mieux expliquer la logique du droit positif : non pour éteindre la critique, mais pour permettre qu’elle se formule sur des bases plus précises et mieux comprises.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

03.05.2026 à 16:15

« Pourquoi l’attitude psychanalytique me sert de boussole dans ce monde chaotique »

Nicola Redhouse, Lecturer, Publishing and Editing, The University of Melbourne

Texte intégral (3033 mots)

Face à un monde instable et violent, il est tentant de se raccrocher à des certitudes et à des logiques d’opposition binaires et partisanes. L’essayiste Nicola Redhouse s’inspire du psychanalyste Wilfred Bion (1897-1979), selon qui être en prise avec la réalité implique de supporter l’incertitude. En un sens positif, cette incertitude permet de déployer une ouverture d’esprit et une curiosité salutaire.

Lorsque j’enseignais l’écriture de nouvelles, je citais souvent Meg Wolitzer : « Vous vous retrouverez dans un endroit que vous ne connaissiez pas. Un endroit où vous ne pensiez pas aller. »

Le principe, disais-je à mes étudiants, c’est de rendre le lecteur curieux. C’était il y a dix ans. Depuis, la curiosité semble passée de mode.

L’IA encourage des réponses rapides, souvent fragiles, plutôt que des enquêtes patientes et nuancées (alors qu’en ce moment, une culture du mensonge à la Maison Blanche – comme lorsque Donald Trump a affirmé qu’un changement de régime avait eu lieu en Iran – exigerait un travail de vérification rigoureux). L’IA favorise aussi des formes de divertissement brèves et superficielles, dans un monde où 36 % des 18–24 ans s’informent via TikTok.

Aujourd’hui, le monde paraît particulièrement instable. De nouveaux conflits en Iran et au Liban s’ajoutent à ceux d’Ukraine et de Gaza – où un cessez-le-feu tient, pour l’instant. Trump se dispute avec le pape. Le seul point lumineux : la défaite de l’autocrate Viktor Orban en Hongrie. Tout cela sur fond d’accélération de la catastrophe climatique.

Dans ces conditions, il n’est pas étonnant que nous cherchions de la certitude. Mais c’est peut-être son contraire – la curiosité – dont nous avons besoin. Elle pourrait rouvrir un peu les possibles, nous permettre de nous intéresser à ce que ressent l’autre, à la manière dont il souffre, ou même à ce qui pourrait nous faire rire ensemble.

Ma vision du monde a été profondément marquée par le psychanalyste du XXe siècle Wilfred Bion et par ce que l’on appelle « l’attitude psychanalytique » : une curiosité ouverte, disponible, dépourvue de précipitation. Les idées de Bion offrent, me semble-t-il, une manière de rencontrer le monde – et peut-être d’en atténuer les formes actuelles de fondamentalisme.

L’attitude psychanalytique

Avec le temps, je me suis moins intéressée aux réponses qu’à comprendre ce qui nous amène à nous questionner – à tâtonner à l’aveugle. À essayer d’imaginer ce que cela ferait d’être hors de mon propre corps, ou dans la tête de quelqu’un d’autre. « La curiosité est l’opposé du fanatisme ; elle nous conduit à nous interroger : “Existe-t-il d’autres vérités ?” », écrit le psychothérapeute Mannie Sher.

Pour Wilfred Bion, la possibilité même de penser – et d’être en prise avec la réalité – dépend de notre capacité à supporter l’incertitude. Sans cela, la pensée bascule facilement dans la peur, la colère, ou des fantasmes d’anéantissement.

Bion comprenait qu’adopter une posture de savoir préalable empêchait la possibilité d’une compréhension véritable. Son travail s’appuyait sur ce que le poète John Keats considérait comme essentielle à toute grande pensée – la « capacité négative » qu’il définit comme « la faculté chez un homme de savoir exister au sein des incertitudes, des mystères, des doutes, sans vouloir d’irritante façon rejoindre à tout prix le terrain des faits et de la raison ».

La théorie de Bion prend sa source dans la relation mère-bébé. La mère ou la personne qui s’occupe de l’enfant adopte une forme d’écoute et d’attention et supporte de ne pas comprendre ce que veut le bébé. Elle peut contenir la rage ou la déception du nourrisson par le langage et par des gestes apaisants – comme gazouiller ou bercer – jusqu’à comprendre ce qu’il exprime en répondant à ses besoins.

« L’attitude psychanalytique » est devenue la pierre angulaire d’un travail fécond pour ceux qui s’inspirent de la pensée de Bion. Le psychothérapeute Robert Snell la décrit comme « une orientation émotionnelle… un engagement, fondé sur le respect, à maintenir une posture radicalement ouverte d’esprit ».

Confronter des vérités complexes

Le partisanisme, l’indignation et les divisions profondes caractérisent de plus en plus notre culture politique et idéologique.

Le conflit à Gaza est devenu un point de cristallisation. Prendre position – ou être perçu comme appartenant à un camp – comporte désormais des risques réels.

« Le conflit entre Israël et Gaza est la question la plus polarisante du XXIe siècle », déclarait un participant à un sondage de 2024.

Sur les réseaux sociaux, la vitesse de circulation des informations fausses ou incendiaires, combinée à la brièveté imposée, renforce cette polarisation. Il en résulte une forme de certitude assénée qui empêche d’entendre d’autres vérités – celles, vécues et émotionnelles, d’individus ou de communautés qui ne sont pas les nôtres.

Ces vérités, souvent hors de nos algorithmes, demandent que nous baissions un peu nos défenses et que nous écoutions vraiment – pour être touchés.

Ces dernières années, cela m’est arrivé. Je suis juive, et j’ai été bouleversée de voir combien, après le 7 octobre, certains ont nié ou minimisé les attaques du Hamas. Mais j’ai aussi commencé à me demander ce que je ne savais pas – ou ce que j’avais évité de comprendre. Je n’avais été formée qu’à certaines parties de l’histoire d’Israël. Je suis devenue curieuse.

Cela a ouvert ma pensée à des expériences auxquelles je ne m’étais pas assez confrontée : j’ai écouté des témoignages palestiniens, lu des récits historiques palestiniens, regardé des images de Gaza – en m’efforçant de le faire sans le poids de ce que je croyais déjà savoir. J’en ai été profondément bouleversée.

Je conservais le sentiment d’horreur et de chagrin face aux événements du 7-Octobre ainsi que le souvenir de mes propres expériences récentes d’antisémitisme.

La compréhension à laquelle je suis parvenue était d’ordre émotionnel. Elle est contenue dans les mots d’un survivant de la Shoah manifestant en Israël : « Je ne pense pas que nous puissions nous souvenir de notre souffrance sans reconnaître celle de Gaza… Elle occupe la même place dans mon cœur. »

Nous ne pouvons parvenir à ce type de connaissance que si nous pouvons, comme l’écrit Sher, « faire notre deuil sans accusation […] rester liés sans sombrer dans l’idéologie […] préserver la capacité de penser au milieu du bruit de la certitude ».

Ces vérités peuvent être désordonnées : des récits où les coupables sont aussi des victimes, ou l’inverse ; où des individus ordinaires commettent des actes terribles au nom de la bureaucratie ; où des sociétés entières, sous l’emprise d’un pouvoir ou d’un système brutal, agissent mal – ou n’agissent pas du tout. Elles peuvent même impliquer notre responsabilité.

Se détourner de ces vérités ne fait que renforcer les oppositions simples – ce « nous » contre « eux » – dans lesquelles peuvent s’enraciner des horreurs comme les génocides, les pogroms ou les nettoyages ethniques.

Attention, algorithmes et « faits alternatifs »

« Les intérêts qui sont les nôtres, l’attention que nous développons à certaines choses semblent être les meilleurs moyens d’accéder aux vies que nous désirons », écrit le psychanalyste Adam Phillips.

Toute forme d’attention autre que fragmentée est devenue un luxe. Tout semble accéléré, y compris le processus de recueil des informations et de formation de nos opinions.

Une analyse de 35 millions de publications Facebook a montré que 75 % des liens partagés n’avaient même pas été lus par ceux qui les publiaient. Une étude de grande échelle sur Twitter (désormais X) a montré que la position idéologique d’un utilisateur dans un débat prédit ses positions dans d’autres. Nous tirons des vérités de discours de ceux avec qui nous sommes déjà d’accord.

L’« autre camp » propose souvent une autre vérité. L’écart se creuse.

Qu’est-ce qui est encore réel, pourraient demander les plus jeunes, à une époque où l’on peine à distinguer une chanson humaine d’une chanson générée par une IA ; où les arnaques se multiplient ; où les sites satiriques désorientent plus qu’ils ne font rire.

Sur les réseaux sociaux, où nous passons plus de temps que jamais, les contraintes d’espace et d’immédiateté façonnent la manière dont nous formulons nos pensées, en favorisant des conclusions tranchées.

Nous savons déjà – et nous pensons en savoir assez. Des histoires entières sont réduites à des slogans. Des traumas personnels réduits à 30 caractères. J’aime, je ris, j’adore, je compatis, je m’indigne. Un seul clic.

Ce type de savoir ne peut pas accueillir le réel.

Une incertitude féconde

Cela laisse aussi peu de place à une position de non-savoir – ce que j’appelle une « incertitude générative ». Une position qui peut ouvrir à un déplacement, à un changement. Un point de départ plutôt qu’une fin.

Il y a des années, après une table ronde, une femme s’est approchée de moi pour me dire qu’elle n’achèterait pas mon livre. « Il a l’air de poser beaucoup de questions, et moi je veux des réponses. » À l’époque, cela m’avait amusée. Aujourd’hui, beaucoup moins.

Avec sa logique de repérage de motifs, l’IA propose précisément ce type de savoir fermé – sans place pour l’incertitude. Elle peut être utile pour traiter certaines données, par exemple en identifiant des maladies rares. Mais elle commet des erreurs dès qu’il s’agit de contexte, donnant parfois des conseils dangereux, notamment sur les troubles alimentaires ou la dépression.

Les réponses automatisées répondent à notre désir de savoir sans passer par le travail de recherche – un processus qui demande du temps, de la réflexion, parfois une lecture étendue. C’est pour cette raison que la philosophe Gillian Rose a critiqué la tendance à écrire « en tant que » – « en tant que femme », « en tant que juive » – comme si l’identité pouvait tenir lieu de savoir.

« Ma trajectoire ne suit aucune logique de ce type », écrit-elle. « Si je savais qui ou ce que je suis, je n’écrirais pas. » Comme tant d’autres, elle écrit pour le découvrir.

Accueillir la confusion

En dehors du cabinet de psychanalyse, nous pourrions mobiliser cette « attitude psychanalytique » pour transformer l’indignation brutale qui domine tant de prises de parole en ligne en une curiosité tournée vers nous-mêmes – afin de mieux comprendre nos propres désirs et préjugés. « Nous devrions accueillir la confusion comme un état d’esprit souhaitable », écrit le psychanalyste Stephen Seligman.

Il ne s’agit pas de renoncer à la vérité. Nous devons nous baser sur les témoignages, les archives, les faits afin de poser un jugement « discipliné et sobre » selon les mots de Raimond Gaita.

Le savoir auquel j’aspire naît de cette double exigence : une ouverture réelle et une fidélité aux faits.

Nous devons aussi être capables de supporter l’ambivalence du réel, sans céder à ce que le philosophe Paul Katsafanas appelle une « politique du ressentiment ».

La peur ou la haine qui nous rendent si sûrs de la faute de l’autre doivent être tempérées par une capacité à s’intéresser à l’autre.

La curiosité, alliée à la colère, peut produire ce que la philosophe Martha Nussbaum appelle une « colère de transition » – une colère tournée vers la réparation plutôt que la vengeance.

Les leçons de la littérature

L’une de mes nouvelles préférées est « The Lottery », de Shirley Jackson, récit troublant d’un village où l’on procède à une lapidation rituelle. Le choc – comprendre que le tirage au sort désigne celui qui sera mis à mort – est vertigineux.

Lors de sa publication dans le New Yorker en 1948, le texte a suscité incompréhension et protestations. Beaucoup de lecteurs pensaient qu’un tel village existait réellement.

Aujourd’hui, cette histoire de violence collective ressemble presque à un reportage. Mais la forme littéraire qui me semble la plus à même de nous aider aujourd’hui est le poème.

Le psychanalyste et poète David Shaddock écrit que l’imagination poétique, comme le travail analytique, ouvre un espace de vérité psychique : Un « champ qui s’ouvre lorsque le réel est reconnu ». Nous sommes touchés – et cette capacité à être touchés nous ancre dans le réel.

La poésie peut désarmer nos certitudes et créer un espace où quelque chose de nouveau peut advenir. Un espace d’imagination où nous cessons d’être sûrs – pour redevenir curieux.

Dr Mannie Sher est un parent de l'auteur

03.05.2026 à 08:40

Pourquoi les États-Uniens se serrent la ceinture mais peuvent dépenser près de 20 euros pour un smoothie

Yuanyuan (Gina) Cui, Assistant Professor of Marketing, Coastal Carolina University

Patrick van Esch, Associate Professor of Marketing, Coastal Carolina University

Texte intégral (2395 mots)

Derrière le succès des smoothies de luxe, une mécanique psychologique : en période d’incertitude, les consommateurs se tournent vers de petits achats premium pour reprendre le contrôle.

Face à la crise du pouvoir d’achat, les Américains renoncent aux dîners au restaurant, repoussent l’achat d’une voiture et traquent les bonnes affaires en supermarché. Sur fond d’inquiétudes liées aux droits de douane et, plus largement, au coût de la vie, la confiance des consommateurs est tombée à des niveaux inédits depuis plus de dix ans, selon The Conference Board, un cercle de réflexion économique. À ce stade, ce sont les consommateurs les plus aisés qui portent l’essentiel des dépenses dans l’économie américaine.

Comment expliquer, dès lors, le succès spectaculaire des smoothies à 22 dollars (soit environ 19 euros) commercialisés là-bas par la chaîne spécialisée dans l’alimentation « healthy » Erewhon ?

Cette chaîne d’épiceries de Los Angeles qui vend ces préparations sophistiquées se porte si bien qu’elle a ouvert trois nouveaux magasins en 2025 – sa plus forte expansion depuis 2011. Elle générerait entre 1 500 et 2 100 euros de chiffre d’affaires par mètre carré, soit jusqu’à cinq fois plus qu’un supermarché américain classique.

Et il ne s’agit pas de simples smoothies : on y trouve des ingrédients comme du gel d’algues marines haut de gamme, des champignons adaptogènes ou encore des peptides de collagène. Souvent, ces boissons portent même le nom d’une célébrité.

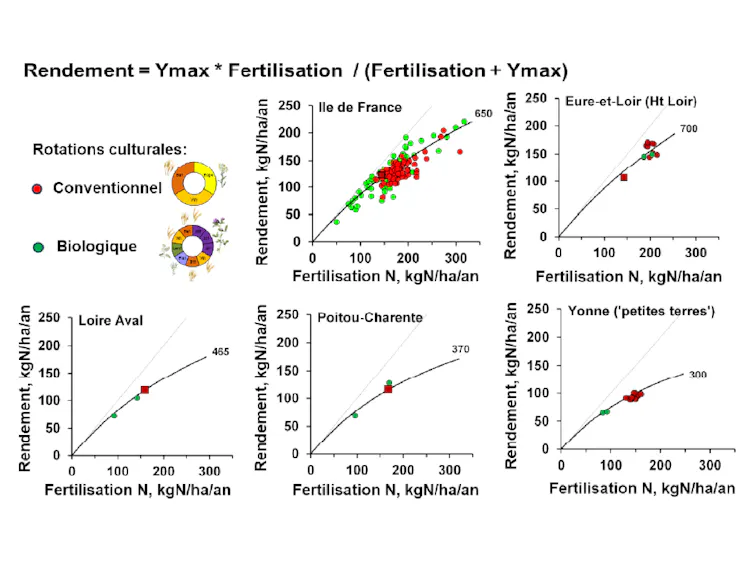

Tout cela s’inscrit dans l’essor plus large du marché américain des produits alimentaires de spécialité, qui a dépassé les 187 milliards d’euros – soit une hausse de près de 150 % en dix ans, selon la Specialty Food Association. Une progression bien supérieure à celle des ventes globales de produits alimentaires aux États-Unis, qui n’ont augmenté que d’environ 47 % sur la même période.

Des données indépendantes du cabinet d’études Circana confirment cette tendance : malgré l’inflation, qui pousse de nombreux consommateurs à se tourner vers des marques de distributeur, les produits premium et de spécialité résistent et ont même continué à gagner des parts de marché en valeur jusqu’en 2025. Sur TikTok, les créateurs qui filmaient autrefois leurs achats de sacs de luxe publient désormais des plateaux de conserves de poisson à 12 dollars. Quant aux tablettes de chocolat artisanal vendues entre 8 et 12 dollars, elles sont désormais présentées, sans ironie, comme du « self-care ».

Si les consommateurs sont aussi anxieux, pourquoi continuent-ils à se faire plaisir ? En réalité, il n’y a pas de contradiction : il s’agit de deux expressions d’une même réaction psychologique.

Lorsque les individus ont le sentiment de perdre le contrôle de leur vie, ils se tournent vers des achats modestes mais coûteux qui permettent d’afficher certaines valeurs. C’est la véritable raison pour laquelle les produits alimentaires premium sont en plein essor tandis que certaines marques de luxe traditionnelles peinent, expliquent des spécialistes de la psychologie du consommateur.

Nous sommes professeurs en comportement du consommateur et marketing et nous étudions la manière dont les individus prennent leurs décisions d’achat en période d’incertitude économique ainsi que l’écart entre ce qu’ils ressentent et la façon dont ils dépensent réellement. Nos travaux mettent en évidence un constat récurrent : lorsque les gens ont le sentiment de perdre la main sur les grandes dimensions de leur vie, ils cherchent à reprendre le contrôle sur les petites.

Un détour par la trousse de maquillage

Les économistes ont déjà observé ce phénomène.

En 2001, Leonard Lauder, président d’Estée Lauder, a forgé l’expression « indice du rouge à lèvres » après avoir constaté que les ventes de rouges à lèvres avaient augmenté de 11 % à la suite des attentats du 11 septembre 2001. Lorsque les produits de luxe deviennent inaccessibles, les consommateurs se tournent vers des substituts plus modestes. Un rouge à lèvres à 60 dollars (plus de 51 euros) reste cher pour un produit cosmétique, mais comparé au sac Hermès qu’il remplace symboliquement, il donne l’impression d’être une bonne affaire.

Hier comme aujourd’hui, les individus cherchent à reprendre prise là où ils le peuvent. Les psychologues de la consommation parlent de « consommation compensatoire » : acheter pour reprendre le contrôle lorsque la vie semble nous échapper.

Même si les ventes de produits de beauté ralentissent actuellement, cette impulsion n’a pas disparu. Elle a simplement trouvé de nouveaux terrains d’expression tels que l’alimentation.

À bien des égards, la nourriture est un support idéal pour cette forme de compensation. Elle est d’abord sensorielle : on la goûte, on la sent, on la savoure. Elle est aussi émotionnelle, chargée d’associations liées au réconfort, au soin et au foyer. Et elle est visible : à l’ère des réseaux sociaux, ce que l’on mange est devenu aussi exposé que ce que l’on porte. Les produits alimentaires premium ne se consomment pas seulement – ils se filment, se publient, se mettent en scène.

Surtout, ils restent relativement accessibles. Dix-neuf euros peuvent sembler un prix absurde pour une boisson, mais c’est peu comparé à une retraite bien-être à plus de 300 euros.

Se faire plaisir, avec un supplément de vertu

C’est ce qui distingue la situation actuelle de l’indice du rouge à lèvres de Lauder. Cet exemple relevait avant tout du plaisir : les consommateurs cherchaient une forme de consolation dans de petits achats indulgents. Aujourd’hui, les produits alimentaires premium ajoutent une dimension supplémentaire : ils sont perçus comme vertueux.

Un smoothie d’Erewhon n’est pas seulement une gourmandise. Il est bio, enrichi en superaliments et aligné avec une logique de bien-être. De la même manière, une bouteille d’huile d’olive monocépage à 17 euros n’est pas qu’une matière grasse pour cuisiner ; c’est un engagement en faveur du savoir-faire et de la santé. Quant aux conserves de poisson premium, elles ne sont plus un produit de dépannage : ce sont des protéines issues de la pêche sauvage, durable, présentées dans des emballages suffisamment soignés pour être exposés.

Cette mise en scène de la vertu accomplit le travail psychologique le plus important au moment de l’achat : elle transforme une faiblesse en investissement sur soi.

On ne dépense pas de manière excessive en période difficile ; on fait quelque chose pour sa santé. On n’est pas frivole ; on soutient de petits producteurs. Les recherches montrent que les consommateurs ont besoin de raisons pour justifier des achats coups de cœur, surtout en période d’anxiété financière – et les produits alimentaires premium sont particulièrement efficaces, car cette justification est intégrée au produit lui-même.

Le label bio, le récit de durabilité, le cadrage autour du bien-être : tout concourt à dissiper la culpabilité avant même qu’elle n’apparaisse.

Consommé en cuisine… et sur les réseaux

Il y a une raison à l’accélération de cette tendance. Beaucoup d’achats alimentaires premium sont consommés deux fois – une première fois physiquement, une seconde fois numériquement. L’achat d’un smoothie chez Erewhon ne concerne pas seulement la boisson ; il tient aussi au contenu qu’elle permet de produire. Le plateau de conserves de poisson est dressé pour Instagram avant même que quelqu’un n’y goûte.

Les réseaux sociaux ne se contentent pas d’amplifier la tendance ; ils la complètent. En publiant une photo ou une vidéo de ce smoothie, on affiche son attachement au bien-être, à la qualité et à une forme d’intentionnalité. À un moment où exhiber un sac de créateur peut paraître déplacé, l’alimentation offre une couverture idéale. C’est la démonstration de statut la plus acceptable qui soit. Rien d’étonnant, dès lors, à ce qu’une vidéo YouTube d’un « haul », ces vidéos où quelqu’un montre tout ce qu’il a acheté en une séance de shopping, réalisée chez Erewhon par la créatrice culinaire @KarissaEats ait dépassé les 14 millions de vues.

Tout cela soulève une question légitime : la montée de l’ « économie en K » suffit-elle à expliquer ce boom ? Pour de nombreux économistes, les ménages à revenus faibles et intermédiaires réduisent leurs dépenses, pris en étau par le coût de la santé, du logement ou encore de l’éducation. À l’inverse, les consommateurs les plus aisés compensent largement, en continuant à dépenser et à tirer la croissance du produit intérieur brut.

Dans ce contexte, les produits alimentaires premium prospèrent parce qu’ils restent accessibles pour ceux qui vont bien financièrement, tandis que les autres se serrent la ceinture. C’est en partie vrai. Mais cette explication ne suffit pas à rendre compte d’un autre déplacement : pourquoi les consommateurs aisés délaissent certaines dépenses ostentatoires, comme les sacs de créateurs, au profit de courses alimentaires haut de gamme.

C’est pourquoi cette analyse centrée sur la « vertu » est si déterminante. Si la question était uniquement celle du pouvoir d’achat, le luxe traditionnel serait lui aussi en plein essor. Or, ce n’est pas le cas.

En témoigne LVMH, le groupe derrière Louis Vuitton et Dior, dont la division Mode a vu ses profits reculer de 13 % en 2025.

Même les consommateurs disposant de revenus confortables ont besoin d’une forme de permission psychologique pour dépenser en période d’incertitude. Le phénomène des produits alimentaires premium tient donc moins à la question de savoir qui peut se permettre de dépenser qu’à celle de comprendre pourquoi l’alimentation est devenue le terrain privilégié de ces dépenses.

Et lorsqu’un smoothie devient un symbole de statut, cela dit quelque chose de plus large sur la sécurité économique. Les prix alimentaires ont augmenté de près de 30 % depuis 2019, contre 23 % pour l’ensemble des prix à la consommation, selon le Bureau of Labor Statistics. Pour une famille au budget serré, 19 euros, ce n’est pas un smoothie : c’est un dîner.

Le besoin de contrôle, le désir d’identité, le réconfort qu’apporte une forme de légitimation morale – ces mécanismes sont universels. Une mère célibataire cumulant deux emplois ressent le même besoin de reprendre la main que l’influenceuse qui filme ses courses. Simplement, les achats capables de répondre à ces besoins sont de plus en plus contraints par les prix. La justification ne fonctionne que si l’on peut se permettre ce genre de dépense.

Ce qu’il y a vraiment dans le panier

La prochaine fois que vous êtes au supermarché et que vous tendez la main vers un produit un peu plus cher que nécessaire, marquez une pause – non pour le reposer, mais pour réfléchir à ce que vous êtes réellement en train de chercher.

Il y a de fortes chances que ce ne soit pas vraiment le produit en lui-même. C’est le sentiment de choisir quelque chose, dans un moment où tout semble échapper au contrôle. Un smoothie à 19 euros n’est jamais seulement un smoothie. C’est ce que l’on va chercher quand on a besoin de se donner la permission d’aller bien.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

03.05.2026 à 08:39

L’IA sait tout produire… mais pas encore juger : pourquoi nous devenons des opérateurs de l’abondance

Bruno Deffains, Professeur de Sciences Économique, Membre honoraire de l'Institut Universitaire de France, Université Paris-Panthéon-Assas

Texte intégral (1967 mots)

Et si on ne posait pas la bonne question quand on s’inquiète de l’impact des intelligences artificielles sur l’emploi ? Au-delà des emplois potentiellement détruits ou créés, que restera-t-il, et que doit-il rester, à l’humain ? Loin de remplacer tous les cols blancs, les IA vont modifier le rôle dévolu à chacun, ce qui devrait mobiliser l’enseignement pour apprendre aux plus jeunes à devenir des opérateurs d’abondance.

Le 10 mars 2026, le PDG de Nvidia Jensen Huang publiait un essai déclarant que l’IA crée plus d’emplois qu’elle n’en détruit. Quelques jours plus tôt, les économistes d’Anthropic publiaient des données empiriques racontant une histoire bien plus nuancée. Entre ces deux lectures, une question demeure entière : dans un monde où la machine produit instantanément, abondamment, et souvent convenablement, qu’est-ce que l’humain doit impérativement conserver comme capacité propre ?

Il y a quelque chose de troublant dans le débat actuel sur l’intelligence artificielle et le travail. Ce n’est pas qu’il soit faux, c’est qu’il pose systématiquement la mauvaise question. On se demande si l’IA va détruire des emplois, si les cols blancs sont les nouvelles victimes du progrès technique, s’ils vont connaître à leur tour « une sorte de désindustrialisation ». Ce débat est légitime.

Mais il écarte une interrogation autrement plus profonde qui consiste à s’interroger sur ce que doit conserver l’humain comme capacité propre dans un monde où la machine produit instantanément, abondamment, et souvent convenablement ? Pour répondre à cette question, le concept d’opérateur de l’abondance apporte un éclairage à maints égards pertinent.

À lire aussi : L'IA générative ne détruira pas votre emploi mais elle va changer profondément votre métier

L’abondance n’est pas la valeur

Jensen Huang utilise une formule a priori séduisante selon laquelle l’IA génère des réponses en temps réel, contextualisées et d’une plausibilité souvent confondante. En quelques secondes, elle produit un projet de conclusions judiciaires, une synthèse bibliographique, une analyse de risques, un plan de cours. C’est techniquement exact. Mais cette exactitude masque une ambiguïté fondamentale : produire ne signifie pas valoir.

La vraie question n’est pas « Est-ce que ce contenu est bon ? », mais pour qui est-il bon ? Dans quel contexte ? Avec quelles conséquences si l’on se trompe ? Et à cette question, le modèle ne répond pas, parce qu’elle exige une forme de connaissance que le philosophe Michael Polanyi qualifiait de tacite dans ses travaux sur les fondements du savoir scientifique « We can know more than we can tell », y écrit-il), un savoir qui vit dans la mémoire des situations, dans l’expérience accumulée des erreurs, dans la lecture des rapports de force d’une organisation, dans la sensibilité aux attentes implicites d’une juridiction ou d’un comité. Ce savoir-là ne se met pas dans un prompt, parce qu’il n’est pas de l’ordre de ce qui peut être intégralement formulé, et qu’il résiste, par nature, à toute tentative de formalisation complète.

Miroir amplificateur

C’est ici que les données empiriques publiées en janvier 2026 par les économistes d’Anthropic fournissent un éclairage décisif. Parmi les millions d’interactions analysées avec Claude, 52 % relèvent de modes augmentatifs. Autrement dit, l’humain itère, ajuste, réoriente. Il ne délègue pas, il collabore. Et surtout, les auteurs constatent une corrélation quasi parfaite entre la sophistication de la question posée et la qualité de la réponse obtenue.

Le modèle est un miroir amplificateur, il ne produit de valeur cognitive que dans la mesure où celui qui l’interroge est capable de formuler ce qu’il cherche. L’abondance que génère l’IA n’est donc pas une ressource libre d’accès. Elle est conditionnée par la compétence de celui qui la sollicite. Ce n’est pas une loi technique, c’est une loi cognitive.

L’opérateur de l’abondance

Il conviendrait d’appeler « opérateur de l’abondance » la figure professionnelle que l’économie de l’IA requiert, et que nos systèmes de formation ne produisent pas encore. Ce n’est ni le programmeur de modèles ni l’utilisateur passif. C’est quelqu’un qui sait formuler un problème en termes exploitables par un modèle, évaluer la pertinence et la fiabilité d’un output, injecter le contexte que la machine ne peut pas avoir et assumer la responsabilité d’une décision fondée en partie sur des suggestions qu’il n’a pas lui-même générées.

Cette compétence n’est pas technique au sens étroit. Elle est profondément intellectuelle. Elle suppose d’avoir été formée à la pensée critique, à l’argumentation, à l’identification des biais. Elle suppose d’avoir fait l’expérience de se tromper et d’avoir appris à détecter pourquoi. En un mot, elle suppose d’avoir été exposé à la difficulté des tâches que l’on délègue désormais, avant de les déléguer.

Le risque silencieux de la délégation aveugle

C’est là que le rapport publié le 5 mars 2026 par les économistes d’Anthropic Maxim Massenkoff et Peter McCrory introduit une distinction cruciale, à savoir la différence entre l’exposition théorique à l’IA, ce que le modèle pourrait techniquement faire dans un métier, et l’exposition observée, ce qu’il fait effectivement. La première dépasse 90 % dans les professions juridiques, financières et managériales. La seconde est bien inférieure, pour des raisons légales, organisationnelles, institutionnelles. Mais l’écart se réduit.

Et le signe avant-coureur le plus inquiétant n’est pas le chômage. C’est le ralentissement du recrutement des jeunes diplômés (22-25 ans) dans les professions les plus exposées. Les entreprises n’embauchent plus autant de juniors pour des tâches que l’IA fait désormais plus vite et moins cher. Ce n’est pas que l’IA supprime des postes, elle contracte plutôt les flux d’entrée dans les professions qualifiées, privant une génération de ce que l’économiste Kenneth Arrow appelait le learning by doing, ce processus lent et irremplaçable par lequel on devient capable de superviser ce qu’on n’a pas encore tout à fait compris.

La déqualification cognitive, c’est précisément cela. Non pas perdre son emploi, mais perdre progressivement la capacité de superviser ce qu’on délègue. On délègue la rédaction sans avoir appris à rédiger. On valide des outputs sans avoir développé la compétence critique qui permettrait de détecter ce que l’IA fait mal, ses angles morts, sa tendance à produire du plausible, là où il faudrait du vrai. Cette « délégation aveugle » n’est pas une fatalité technologique. Elle est le produit d’une augmentation passive, une délégation sans réinvestissement dans des compétences de niveau supérieur.

Quand la boucle se ferme sans nous

Ce raisonnement prend encore plus de force avec l’IA agentique, cette nouvelle génération de systèmes qui n’attendent pas une validation humaine à chaque étape, mais agissent. Ils naviguent, rédigent, exécutent du code, orchestrent d’autres agents, prennent des décisions intermédiaires dans des chaînes d’action qui s’étalent sur des heures sans intervention humaine. Jensen Huang l’a annoncé au GTC 2026 en déclarant que dans dix ans, chaque employé humain travaillera aux côtés de cent agents IA. Le chiffre est peut-être exagéré mais la direction ne l’est pas.

Avec l’IA générative, la boucle revenait toujours à l’humain. Il évaluait un output et décidait. Avec l’IA agentique, cette boucle peut se fermer en interne. L’opérateur de l’abondance doit alors devenir ce qu’on pourrait appeler un « architecte d’objectifs » ; non plus « est-ce que ce texte est bon ? » mais « cet agent a-t-il bien compris ce que je voulais, et ses cinquante actions intermédiaires étaient-elles toutes légitimes ? »

Or, les données Anthropic montrent que le taux de succès des modèles décroît significativement à mesure que la complexité de la tâche augmente, précisément là où les agents déploient le plus d’autonomie. La surveillance humaine est donc la plus nécessaire là où elle est la plus difficile à exercer. Et elle est impossible pour qui n’a jamais eu à faire ce qu’il supervise.

Urgence d’une politique de formation

La thèse de Jensen Huang n’est pas fausse, elle est incomplète. Oui, le déploiement de l’IA génère de l’emploi dans les secteurs de l’infrastructure physique. Mais, comme les réseaux électriques du début du XXe siècle, une infrastructure ne s’irrigue pas équitablement par la seule vertu du marché. Et surtout, elle ne dit rien des effets sur les trajectoires d’apprentissage des professions intellectuelles.

Ce que les données suggèrent avec force, c’est l’urgence d’une politique de formation aux compétences d’exploitation de l’IA, non pas apprendre à coder des modèles, mais apprendre à penser avec eux, à les interroger, à en critiquer les outputs, à maintenir vivante la compétence que l’on délègue. Former des opérateurs de l’abondance. Cette tâche revient en premier lieu aux institutions d’enseignement supérieur, et elle est urgente, parce que la contraction des flux d’entrée des jeunes dans les métiers exposés laisse peu de temps avant que l’apprentissage ne soit structurellement impossible.

Car ce que l’IA ne peut pas faire à notre place, c’est précisément décider que tel output vaut quelque chose, dans ce contexte, pour cette personne, avec ces enjeux. Ce jugement n’est pas une technique. C’est une forme de responsabilité et elle reste irréductiblement humaine.

Bruno Deffains ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

03.05.2026 à 08:39

Étudiants étrangers : des outils d’intelligence artificielle pour réduire la barrière de la langue ?

Vincent Berry, Professeur, Université de Montpellier

Chouki Tibermacine, Professeur des universités en sciences du logiciel, Université Bretagne Sud (UBS)

Chrysta Pelissier, Maîtresse de conférences en sciences du langage et sciences de l'Education, Université de Montpellier

Éric Anglaret, Professeur en physique des matériaux, directeur délégué aux relations internationales Polytech Montpellier, Université de Montpellier

Vanessa Vigano, Ingenieure pedagogique, Université de Montpellier

Texte intégral (2016 mots)

Dans l’enseignement supérieur, le parcours des étudiants étrangers reste marqué par un défi central : comprendre, suivre et participer dans une langue qu’ils ne maîtrisent pas pleinement. Les avancées récentes de l’intelligence artificielle en traduction et en interprétation ouvrent des perspectives, tout en soulevant des enjeux sensibles de protection des données. Une piste se dessine alors : développer des outils alternatifs, directement hébergés par les établissements eux-mêmes. Des chercheurs de l’Université de Montpellier ont développé un tel prototype.

L’enseignement supérieur français a attiré près de 450 000 étudiants étrangers en 2024-2025, plaçant la France au 7e rang mondial. Ils représentent près de 15 % des effectifs étudiants dans les universités françaises.

La mobilité étudiante est en constante augmentation. En Europe, il y a eu plus de mobilités organisées en dix ans qu’au cours des vingt-sept années précédentes, la demande en 2025 étant en hausse de 9 % par rapport à 2024. Cette accélération est corrélée à l’augmentation des accords bilatéraux entre pays et un élargissement d’Erasmus+, le programme support européen aux mobilités internationales.

Au niveau mondial, les pays les plus attractifs sont sans surprise les pays anglophones, notamment les États-Unis, le Royaume-Uni et l’Australie, l’anglais étant de mise dans les échanges internationaux. Mais pour ceux qui choisissent la France et le français, dans quelle aventure s’engagent-ils ?

Les difficultés rencontrées par les étudiants étrangers

Pour ces étudiants, la barrière linguistique complique l’assimilation des connaissances techniques, freine la participation active en classe et l’immersion dans la vie étudiante, et cela malgré les enseignements de français langue étrangère (FLE). La complexité de la langue française augmente ce défi, même pour les étudiants étrangers francophones peu exposés au français académique.

L’Union européenne est consciente de ce frein à la mobilité et encourage ses États à fournir un soutien universitaire et extra-universitaire.

Nous avons mené en 2024 et 2025 une enquête auprès d’une partie des 9 000 étudiants étrangers qu’accueille chaque année l’Université de Montpellier. Elle révèle des besoins d’aide clairs :

pendant les cours et les conférences, pour comprendre les enseignants à l’oral et avoir la transcription du contenu afin de mieux appréhender leur formation ;

après les cours, dans une visée de mémorisation, de révision et de vérification du contenu des cours.

Les récents progrès de l’intelligence artificielle (IA) permettent de répondre à une partie de ces besoins.

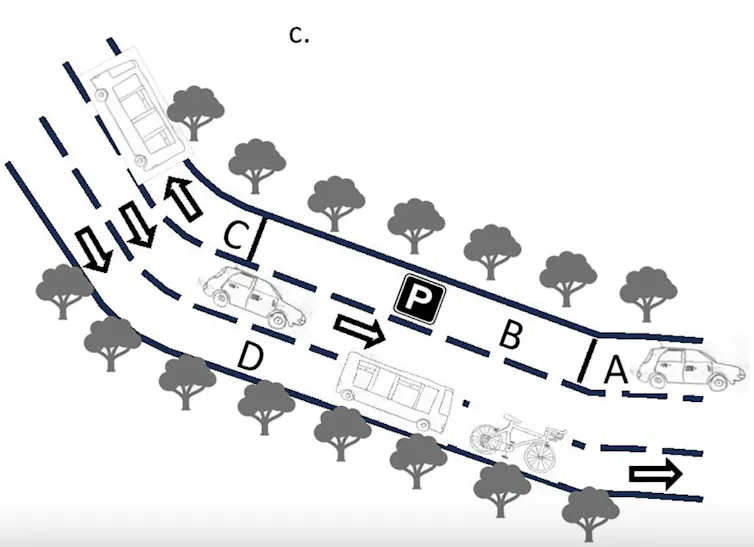

Une analyse comparative des solutions de traduction simultanée basées sur l’IA a été menée selon trois critères principaux : la capacité de reconnaissance automatique de la langue parlée (permettant une adaptation dynamique lorsque l’intervenant change de langue ou lorsqu’une question est posée dans une autre langue), la facilité d’usage (minimisant les contraintes d’installation et de configuration pour les étudiants et les enseignants), et la qualité de la traduction produite. Cette analyse fait émerger deux types de solutions : des outils commerciaux accessibles par le cloud et des outils open source pouvant être installés en local sur serveurs propres.

Les outils commerciaux : efficaces, mais chers et risqués en termes de propriété intellectuelle

Du côté des outils commerciaux, notre veille technologique indique que l’outil le plus adapté aux besoins identifiés est eventCat. Un tel outil fournit un service clés en main, engendrant peu de contraintes informatiques et audiovisuelles pour être déployé. Cet outil a été testé en 2024 puis 2025 lors d’une conférence médicale partagée entre deux universités. Les intervenants avaient des profils linguistiques variés : chercheurs disposant d’un haut niveau d’anglais, médecins habitués à s’exprimer en français et représentants de patients possédant une connaissance limitée de l’anglais. Le public était constitué d’étudiants français et néerlandais, ces derniers maîtrisant bien l’anglais mais ne comprenant pas le français.

L’outil a permis aux intervenants de s’exprimer dans leur langue de prédilection, tandis que les étudiants anglophones suivaient via une traduction simultanée sur un lien dédié. Les retours des intervenants ont été très positifs. Afficher les traductions sur un grand écran installé à côté des intervenants plutôt que sur les smartphones ou ordinateurs portables des étudiants a permis de réduire leur charge cognitive, ceux-ci devant déjà simultanément suivre le discours oral et lire la transcription. La qualité de la traduction s’est avérée globalement satisfaisante, les acronymes du domaine et les accents des intervenants posant toutefois des soucis. Ceci souligne la nécessité d’une adaptation contextuelle plus fine pour des contenus hautement spécialisés.

Les inconvénients d’une telle solution sont un coût annuel de plusieurs dizaines de milliers d’euros par formation et une incertitude concernant les données. Par exemple, à la date de rédaction de cet article, la politique RGPD de l’outil identifié est de ne pas stocker plus de sept jours les flux audios reçus et leurs transcriptions et de ne pas utiliser ces données pour entraîner ses modèles IA, ce qui exposerait ces données aux attaques par prompts malicieux.

Cependant, la société opérant ce service est localisée aux États-Unis, elle est donc soumise au Cloud Act, l’obligeant à communiquer les données qu’elle stocke en cas d’injonction d’une autorité administrative de son pays. Les préoccupations sur la protection des données sont revenues à plusieurs reprises dans nos échanges avec les enseignants et également avec les étudiants, lors de notre enquête. Rappelons que les enseignants et les enseignants-chercheurs de l’enseignement supérieur sont titulaires des droits d’auteur sur les cours qu’ils proposent, c’est donc leur propriété intellectuelle qui peut être exposée par un outil de transcription et traduction automatique.

Un prototype d’outil en open source pour protéger les données

Il est donc préférable que les équipes pédagogiques disposent de solutions alternatives hébergées au sein de leur établissement. Le logiciel open source est dans ce cadre la voie naturelle, malheureusement en 2025, aucune solution de ce type n’existait encore pour répondre aux besoins exprimés par les étudiants étrangers dans nos analyses.

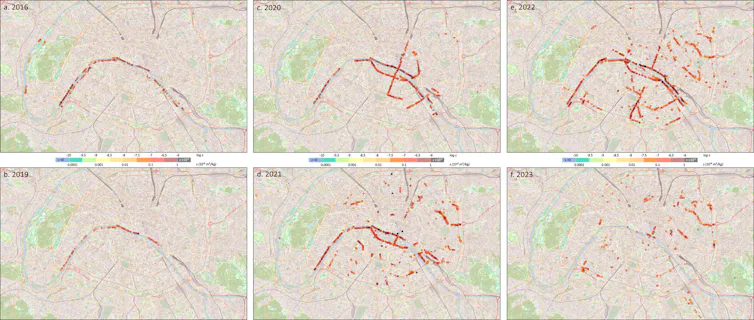

Nous avons donc élaboré les bases d’un tel outil et proposé un premier prototype. Celui-ci effectue déjà en local la traduction d’un contenu textuel, par un modèle d’IA libre pouvant s’exécuter sur un serveur classique. En revanche, la transcription des flux audio repose encore sur des services IA proposés par plusieurs acteurs du cloud (les modèles les plus efficaces pour cette étape sont soit plus lourds soit tout simplement propriétaires), bien que n’étant pas liés à un fournisseur particulier. Ce prototype bénéficie de la technologie RAG (génération augmentée par récupération) pour s’adapter à un vocabulaire technique et a pu être utilisé dans des cours de 20 à 30 étudiants. Les étudiants indiquent un fort intérêt pour ce type d’outils qu’ils utilisent aussi pour des discussions de socialisation.

Toutefois, ils notent tous des difficultés dans des cours techniques en français faisant appel à de nombreux anglicismes. Ces défauts restent à corriger mais la prochaine étape majeure consiste à effectuer la transcription de l’audio en texte de façon locale, sans recourir à un service cloud. En l’état actuel des modèles, ceci nécessite l’usage de processeurs spécifiques (GPU), représentant un effort d’équipement de l’ordre de plusieurs milliers d’euros par site. C’est le coût à payer pour la préservation des données.

L’apprentissage de la langue du pays d’accueil constitue un objectif central des mobilités internationales. Les outils numériques évoqués ci-dessus facilitent cet apprentissage et la réussite académique des étudiants étrangers, mais ne se substituent pas pour autant aux enseignements de FLE. Les outils IA favorisent l’acquisition de savoirs disciplinaires et, dans une certaine mesure, l’acculturation des étudiants étrangers. Mais ils ne sont pas suffisants pour une intégration réussie. Sur ce plan, ce que le pays d’origine met en place pour préparer la mobilité reste prépondérant.

Vincent Berry a reçu un financement de l'Université Montpellier (CNUMF).

Chouki Tibermacine est membre de l'ACM (Association of Computing Machinery). Il a reçu plusieurs financements publiques pour ses travaux de recherche : ANR, DGA, Région Bretagne.

Chrysta Pelissier, Vanessa Vigano et Éric Anglaret ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur poste universitaire.

03.05.2026 à 08:38

Pourquoi la première rencontre entre Washington et Téhéran a échoué : comprendre la psychologie des négociations

Marwan Sinaceur, Professor of Organizational Behavior, ESSEC

Texte intégral (2078 mots)

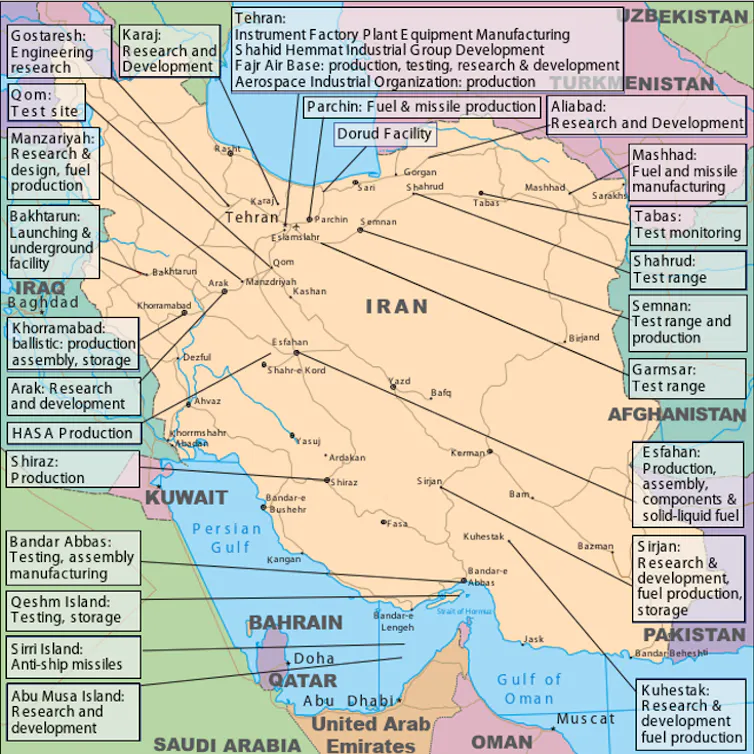

Les recherches en sciences comportementales permettent de mettre en évidence les erreurs commises par l’administration Trump lors de la première session de négociations avec l’Iran, tenue à Islamabad les 11 et 12 avril.

Les négociations entre les États-Unis et l’Iran piétinent. La deuxième rencontre de négociation prévue entre les belligérants n’a finalement pas eu lieu. Le président Trump vient d’annuler l’envoi d’une délégation au Pakistan, tandis que l’Iran semble poser des pré-conditions préalables à toute reprise des discussions. Dans ce contexte incertain, il semble utile de revenir à la première rencontre entre Washington et Téhéran, tenue les 11 et 12 avril 2026 au Pakistan, et de comprendre pourquoi elle a échoué.

Pour expliquer l’échec de cette première session de négociations, le vice-président américain J. D Vance, qui y avait pris part en personne, a affirmé que les États-Unis avaient proposé à l’Iran « leur meilleure et dernière offre » concernant la question du nucléaire. Cette offre ayant été rejetée, il avait mis fin aux pourparlers d’Islamabad et, avec l’ensemble de la délégation américaine, brusquement quitté la capitale pakistanaise après à peine un jour de négociations.

Cette déclaration sur la « meilleure et dernière offre » illustre une méconnaissance profonde de la dynamique et de la psychologie des négociations. Elle en serait risible, si les enjeux n’en étaient pas aussi importants pour la paix dans le monde et l’économie mondiale.

Faire une offre tôt est contre-productif pour régler un conflit

Mettre une offre sur la table dès le début des négociations est tout à fait contre-productif pour régler un conflit. La recherche empirique sur les négociations montre en effet que le timing des offres est crucial : faire une offre trop tôt réduit l’échange d’informations entre les négociateurs et accentue la dimension compétitive de la négociation. Il en résulte souvent une guerre de positions : les négociateurs se crispent et ne cherchent plus qu’à défendre leur position plutôt qu’à comprendre les motivations de la partie adverse. Au contraire, faire une offre tard dans la négociation permet à chacun de comprendre les intérêts, les besoins et les craintes (parfois inexprimées ouvertement) des parties en présence. Lorsque l’offre est faite tardivement, les négociateurs ont plus le loisir d’échanger des informations et d’explorer des solutions créatives avant de rentrer dans le marchandage compétitif. Or l’efficacité en négociation repose de manière cruciale sur la capacité à rechercher des informations sur la partie adverse et de lui poser des questions, plutôt que de simplement énoncer des demandes.

Même lorsque les deux parties sont disposées à faire des compromis, l’exploration des intérêts sous-jacents, la discussion des questions épineuses, la révélation des informations sensibles et l’élaboration de solutions mutuellement acceptables prennent du temps. De fait, la recherche a montré que discuter de plusieurs offres simultanées est plus efficace que proposer une offre unilatérale.

Contrairement à ce qu’a prétendu Vance, la première offre est rarement la meilleure si l’on souhaite réellement parvenir à un accord et résoudre un conflit. Les négociateurs sont en effet souvent influencés par des biais cognitifs dans la manière dont ils perçoivent la partie adverse, ce qui les conduit à commettre de nombreuses erreurs lorsqu’ils interprètent les informations dont ils disposent à son sujet ou tentent de comprendre ses intérêts et ses préférences. C’est d’autant plus le cas lorsque le conflit ne met pas seulement en jeu des intérêts pragmatiques, mais aussi des valeurs sacralisées. Dans ce cas, offrir des concessions symboliques (la reconnaissance symbolique de certaines prétentions de l’autre partie) est efficace pour amener l’autre à concéder quelque chose en retour. Dans ce cas précis, la présidence Trump semble par exemple nettement sous-estimer l’enjeu de fierté nationale et de reconnaissance symbolique que revêt pour l’Iran la question de l’enrichissement de l’uranium.

Tout est question de « timing »

En outre, mettre une offre sur la table au début de la négociation signifie faire une offre à un moment où l’autre partie n’est pas encore prête à faire des concessions. En effet, les gens sont plus enclins à faire des concessions à la fin qu’au début des négociations. Pour deux raisons.

Au départ, la confiance est absente. Elle met du temps à se construire et, dans les premières phrases, chaque partie tend à interpréter les comportements de l’autre avec méfiance. Ainsi, il n’est pas rare que les gens rejettent une offre qui vient de l’autre partie… simplement parce qu’elle provient de la partie adverse : ils l’évaluent alors en fonction de son origine plutôt que de ses mérites intrinsèques. Ce phénomène, caractéristique des négociations et nommé la « réaction de dévaluation » : nous jugeons que l’offre de l’autre partie doit être déterminée par ses intérêts, et nous percevons nos intérêts comme étant forcément antagonistes (perception de jeu à somme nulle).

D’autre part, le coût psychologique d’une sortie de la négociation évolue avec le temps. Au début, se retirer et aboutir à une impasse est relativement peu coûteux : l’investissement en temps et en effort reste limité. En revanche, en fin de négociation, une rupture devient bien plus difficile à accepter. C’est une application d’un biais bien connu, l’escalade de l’engagement (ou escalation of commitment) : plus on investit du temps dans une action, plus on a envie qu’elle réussisse. Et inversement.

De fait, les tactiques qui visent à faire céder l’autre sont plus efficaces à la fin qu’au début des négociations. Exprimer une menace ou se mettre en colère est plus efficace tard que tôt, car au début de la négociation, ces tactiques véhiculent une intention expressément négative, tandis qu’à la fin elles sont perçues comme étant plus acceptables — puisqu’à ce moment, la relation humaine est déjà construite.

Ces résultats de recherches empiriques corroborent les théories qui font de la négociation un jeu à plusieurs phases : discussions ouvertes d’abord ; marchandage à la fin. Commencer par des tactiques agressives ruine les chances de trouver des solutions coopératives. La capacité à rester cognitivement ouvert tout le long de l’interaction et à ne pas acter les choses trop tôt est déterminante. C’est pour cela que la patience est une qualité clé dans les négociations.

Analyser les signes d’amateurisme

Ces recherches empiriques sur la négociation sont, faut-il le préciser, publiées très majoritairement dans les revues académiques américaines de sciences comportementales. Elles sont bien connues aux États-Unis.

La proclamation de J. D. Vance sur la « meilleure et dernière offre » avancée d’entrée de jeu par Washington a donc dénoté un amateurisme certain. Et cela d’autant plus que les négociations entre les États-Unis et l’Iran sont d’une grande complexité et englobent de multiples variables : réouverture du détroit d’Ormuz, contrôle du programme nucléaire, armements balistiques, accès au nucléaire civil, levée des sanctions, garanties que la guerre ne reprenne pas, etc.

Vouloir parvenir à un accord sur des sujets aussi difficiles en aussi peu de temps révèle une inexpérience ahurissante des négociations. Les négociations qui ont abouti à l’accord sur le nucléaire iranien sous la présidence Obama avaient pris 20 mois ; celles du vice-président Vance ont pris 21 heures.

Les experts, comme Federica Mogherini qui fut en charge des négociations avec l’Iran pour la partie européenne, pointent d’ailleurs la méconnaissance ou l’incompréhension des aspects techniques de la négociation de la part de l’équipe américaine.

L’échec des négociations entre Américains et Iraniens lors de leur première rencontre au Pakistan n’a donc rien eu de surprenant. Il est complètement en ligne avec les recherches empiriques sur la psychologie des négociations. Soit dit en passant, cette même erreur explique l’échec des négociations de Camp David entre Israéliens et Palestiniens en 2000 — avec les conséquences funestes que l’on sait. Comme le rapporte Robert Malley, alors conseiller de Bill Clinton pour le Moyen-Orient, une offre avait été mise sur la table beaucoup trop tôt, à un moment où « ni les Israéliens ni les Palestiniens ne s’étaient préparés à complètement comprendre les peurs et les besoins de l’autre partie ».

Négocier, ce n’est pas imposer des conditions unilatérales à la partie adverse. Ce n’est pas non plus faire en sorte que l’autre accepte une reddition sans condition. Cette démarche peut fonctionner dans des négociations qui concernent une seule variable compétitive (le prix), ou lorsque l’on est en position de force, comme lorsqu’on est un riche propriétaire immobilier à New York. Mais elle s’avère inefficace dans des négociations qui concernent plusieurs variables et nécessitent un cheminement à tâtons vers des solutions mutuellement acceptables, ou lorsque le rapport de forces est incertain.

Pour paraphraser une phrase d’un autre président américain, Dwight Eisenhower : la négociation est « l’art de faire faire à quelqu’un quelque chose que vous voulez voir fait, parce qu’il a envie de le faire ».

À tous points de vue, ce qui s’est passé entre Américains et Iraniens lors de leur première rencontre au Pakistan ne ressemble pas à de la négociation.

Marwan Sinaceur a reçu des financements de ESSEC Research Center, Fondation ESSEC, Fondation INSEAD, Stanford University.

02.05.2026 à 09:58

Qu’est-ce qu’une « lingua franca » ? Brève histoire, des croisades à nos jours

Alexandra Aikhenvald, Professor and Australian Laureate Fellow, Jawun Research Institute, CQUniversity Australia

Texte intégral (1897 mots)

Pourquoi certaines langues s’imposent-elles comme outils universels avant de décliner ? De l’Antiquité à l’ère numérique, les lingua francas suivent les routes du pouvoir et des échanges.

Lorsque les Croisés débarquent sur les rivages orientaux de la Méditerranée à la fin du XIe siècle, ils doivent communiquer entre eux, mais aussi avec les marchands et les populations locales.

Beaucoup parlent alors différentes langues romanes : l’italien (notamment celui des puissantes cités-États de Venise et de Gênes), le provençal, le français ou encore leur ancêtre commun, le latin.

La plupart des Occidentaux présents en Europe du Sud sont français, en particulier originaires de la zone comprise entre Marseille et Gênes, d’où partent navires et marchands vers le Moyen-Orient. Ces Occidentaux sont désignés collectivement par les Arabes et les Grecs sous le nom de « Francs ».

Autour de la quatrième croisade (1202–1204), voire un peu plus tôt, une langue composite émerge progressivement en Méditerranée orientale, avant de se diffuser vers l’ouest. Cette langue commune, utilisée par les « Francs » et par ceux qui commercent et combattent avec eux, est aussi appelée sabir, italien bâtard ou espagnol bâtard. Mais c’est sans doute sous le nom de lingua franca que vous la connaissez le mieux : littéralement, la « langue des Francs ».

Cette langue franque est un mélange d’italien, de français et d’espagnol simplifiés, enrichi de quelques apports arabes et turcs. Elle est utilisée sur les rivages méditerranéens du Moyen-Orient jusqu’à la fin du XIXe siècle, avant de tomber en désuétude.

Écrit en minuscules, lingua franca désigne aujourd’hui toute langue servant de moyen de communication entre des personnes qui n’en partagent pas d’autre.

Une tradition ancienne

Les lingua francas remontent à l’Antiquité. Le sanskrit a ainsi servi de langue véhiculaire dans une grande partie de l’Asie du Sud-Est et de l’Asie centrale au cours du premier millénaire de notre ère, notamment par le biais des échanges commerciaux et de la diffusion religieuse.

Autour de la Méditerranée, le grec joue ce rôle d’environ 300 avant J.-C. à 500 après J.-C. : il est utilisé dans le commerce, la littérature, l’enseignement et dans la propagation du christianisme primitif.

Entre le IIe et le IVe siècles, le latin standard supplante le grec comme lingua franca de l’Église catholique en expansion. Il s’impose alors comme langue paneuropéenne de la religion, de la culture et du savoir, et le demeure jusqu’au XIXe siècle.

À partir du XVIIe siècle, l’arabe s’impose comme une _lingua franc_a dans l’ensemble du monde islamique, reliant des communautés d’Afrique et d’Asie.

Au même siècle, avec l’essor de la France comme puissance économique, le français remplace progressivement le latin dans de nombreux domaines et devient la première lingua franca « mondiale » en politique, diplomatie, commerce et éducation. Langue des cours royales, il est utilisé par les savants, les aristocrates, les marchands et les diplomates pour communiquer et écrire entre eux. Le français demeure la principale langue des relations internationales jusqu’à la fin de la Seconde Guerre mondiale.

Après les années 1940, en partie sous l’effet de l’influence croissante des États-Unis, l’anglais s’impose comme la principale lingua franca à l’échelle mondiale.

Fabriquer une nouvelle langue

Avec l’expansion coloniale des puissances impériales et de leurs langues — espagnol, anglais, français, portugais, allemand et néerlandais — à partir du XVe siècle environ, le terme lingua franca en vient à être utilisé comme un nom commun.

Tout au long de la colonisation européenne, des personnes issues de groupes linguistiques différents sont contraintes de travailler ensemble comme esclaves ou engagés sous contrat. Elles communiquent entre elles, ainsi qu’avec leurs maîtres, au moyen d’une langue simplifiée, utilisée pour des besoins limités : des ordres simples, des questions, des énoncés basiques mêlant les éléments dont chacun dispose. Ce type de moyen de communication improvisé est appelé pidgin (qui viendrait du mot anglais « business »).

Les pidgins peuvent servir de lingua franca. Lorsque leurs locuteurs commencent à se marier entre eux, un pidgin peut devenir la seule langue parlée par la génération suivante. Il se développe alors en une langue à part entière — un créole — utilisée dans tous les contextes.

Des créoles comme le tok pisin en Papouasie-Nouvelle-Guinée, le sranan au Suriname, le kristang en Malaisie ou encore le créole haïtien en Haïti servent aujourd’hui de lingua franca dans ces pays.

Une langue globale peut aussi être créée de toutes pièces.

La fin du XIXe siècle voit fleurir les projets de langues universelles. La plus célèbre est l’espéranto, « langue de l’espoir », créé par Ludwik Zamenhof en 1887 comme « langue internationale », c’est-à-dire une lingua franca générale. L’espéranto compte encore aujourd’hui quelques milliers de locuteurs natifs et bien davantage d’adeptes, mais son usage tend progressivement à reculer.

La « lingua franca » mondiale aujourd’hui

Les lingua francas apparaissent lorsqu’elles deviennent nécessaires, puis déclinent lorsqu’elles sont remplacées par d’autres. L’allemand a ainsi cessé d’en être une avec la perte des colonies après la Première Guerre mondiale. Le portugais reste une lingua franca au Brésil, et l’espagnol dans d’autres pays d’Amérique du Sud.

Quant au français, son empreinte mondiale perdure : à l'étranger, on envoie encore une lettre par avion ou poste restante.

Mais il y a un grand gagnant, loin devant les autres. L’anglais est désormais devenu la langue mondiale, s’étendant bien au-delà des locuteurs natifs et des anciennes colonies des puissances anglophones. Il est la langue de la diplomatie internationale, du monde académique et, surtout, des avancées technologiques, des réseaux sociaux et de l’intelligence artificielle.

La diffusion rapide de l’anglais menace-t-elle de faire disparaître les autres langues, qu’il s’agisse de langues minoritaires ou d’autres lingua francas, et plus largement la diversité linguistique à l’échelle mondiale ? La question reste ouverte. L’importance croissante du mandarin comme principale lingua franca en Chine, de l’arabe à travers l’Afrique et le Moyen-Orient, ainsi que la résilience des locuteurs à faire vivre leurs langues – et, avec elles, leurs cultures et leurs histoires – pourraient bien contenir l’hégémonie de l’anglais.

Alexandra Aikhenvald ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

02.05.2026 à 09:32

Dans les bas rapiécés de l’homme le plus riche des États-Unis, le travail oublié des femmes américaines

Emily J. Whitted, Ph.D. Candidate in Early American History, UMass Amherst

Texte intégral (1170 mots)

Rapiécer, gérer, entretenir : dans le foyer de l’un des hommes les plus riches d’Amérique, des femmes ont contribué, sans reconnaissance, à une prospérité qui leur échappait.

À sa mort en 1831, Stephen Girard – marchand, banquier et philanthrope de Philadelphie – était l’homme le plus riche des États-Unis. Dans son testament, il légua à la ville de Philadelphie (Pennsylvanie, Nord-Est des États-Unis) un don exceptionnel d’environ 6 millions de dollars, soit près de 194 millions d’euros aujourd’hui.

Girard demanda notamment qu’une partie de cette somme soit utilisée pour fonder un internat destiné aux garçons blancs pauvres et orphelins. Aujourd’hui, cet établissement, qui accueille des élèves du primaire au lycée, est connu sous le nom de Girard College et admet des élèves issus de milieux défavorisés, sans distinction de race ni de genre. L’institution a hérité des biens matériels de Girard, parmi lesquels du mobilier, des papiers personnels et des vêtements – dont une paire de bas de soie abondamment rapiécés.

Leur conservation peut surprendre : pourquoi l’homme le plus riche des États-Unis portait-il des vêtements raccommodés ? En tant qu’historienne du textile, spécialisée dans le travail du raccommodage dans l’Amérique des débuts, j’ai étudié les points utilisés pour réparer les bas de Girard, ainsi que ses riches archives.

Croisées, ces sources historiques m’ont permis de mettre au jour de nouveaux éléments sur la valeur des textiles dans l’Amérique d’alors, mais aussi sur le rôle des femmes – notamment celles qui travaillaient dans la maison du riche marchand – dans l’essor économique du pays.

Ce que nous disent ces bas

Les textiles étaient utilisés au quotidien par la quasi-totalité des Américains de l’époque coloniale et des débuts de la République et constituaient alors bien souvent les biens les plus précieux que l’on pouvait posséder.

Malgré la mécanisation à grande échelle, ils coûtaient cher en raison du prix des matières premières et du travail qualifié nécessaire à la fabrication des étoffes ; ils étaient en outre fréquemment importés. À la fin du XVIIIe et au début du XIXe siècle, les États-Unis voyaient émerger une industrie textile nationale, mais de nombreux Américains continuaient d’importer des tissus depuis l’étranger, notamment de Grande-Bretagne, de France et d’Inde. Les factures du foyer de Girard montrent qu’il achetait régulièrement une grande partie de ses vêtements – y compris ses bas de soie – en France.

La forte valeur des textiles à cette époque explique que même les foyers les plus aisés jetaient rarement les vêtements abîmés. On les réparait plutôt, à l’aide d’aiguilles et de fil. Si certains hommes pratiquaient aussi le raccommodage, l’immense majorité de ces travaux était réalisée par des femmes.

Les raccommodeuses : Sally, Polly et Hannah

Au sein du foyer de Girard, au moins trois femmes se chargeaient de repriser ses bas de soie et ses autres vêtements.

Bien que Girard ait été marié, son épouse Mary fut internée pour troubles mentaux à l’hôpital de Pennsylvanie en 1790, et le couple n’eut pas d’enfants. En l’absence de Mary, Girard eut plusieurs maîtresses qui faisaient office de gouvernantes : Sally Bickham, une femme quaker que Girard décrit dans une lettre comme une « tayloress », c’est-à-dire couturière, et Polly Kenton, blanchisseuse. Dans le cadre de leur travail, elles géraient les affaires domestiques et les achats de Girard, assurant le bon fonctionnement de son quotidien.

Par ailleurs, une femme noire nommée Hannah Brown, originaire de Saint-Domingue, ancienne colonie française correspondant aujourd’hui à Haïti, fut réduite en esclavage au sein du foyer de Girard pendant plus de quarante ans. Et ce, alors même que la loi d’abolition progressive adoptée en Pennsylvanie en 1780 aurait dû lui garantir la liberté dans les six mois suivant son arrivée aux États-Unis. L’abolition progressive n'y fut appliquée que de manière inégale, permettant à des propriétaires d’esclaves comme Girard d’en contourner les effets. Le testament du marchand accorda finalement la liberté à Hannah Brown.

Toutes trois travaillaient au service de Girard : elles reprisaient ses bas, géraient les tâches quotidiennes du foyer et veillaient à l’entretien de la maison. Les trois techniques de raccommodage visibles sur ses bas – comme le reprisage à la suisse, le reprisage tissé ou encore le renforcement des talons – constituent autant de traces matérielles de leur travail, aux côtés des archives écrites telles que les factures domestiques, les lettres et les reçus.

Aux premiers temps des États-Unis, de nombreuses femmes, libres ou réduites en esclavage, accomplissaient un travail domestique non rémunéré. Pourtant, ce travail a été une force essentielle de la croissance économique nationale au début du XIXe siècle. Partout dans le pays, des hommes comme Girard ont encouragé et tiré profit de l’industrialisation et de l’expansion des activités commerciales ; mais c’est le travail domestique non rémunéré des femmes qui a rendu possibles leur participation et leurs profits.

Si les habitants de Philadelphie ne voient aujourd’hui leurs noms ni sur les grandes artères ni sur les bâtiments de la ville, les efforts conjugués de Sally, Polly et Hannah — dissimulés dans les chaussures de Girard et éclipsés par l’ampleur de son héritage historique à Philadelphie — ont été essentiels à sa réussite économique.

Emily J. Whitted a reçu des financements de The Library Company of Philadelphia.

02.05.2026 à 08:55

L’abandon d’une stratégie vieille de 250 ans… Ce que change la fin de l’obligation vaccinale dans l’armée américaine