STATIUM BLOG

(H)ac(k)tiviste, Chercheur associé à l'UMR 7363 SAGE (Sociétés, Acteurs, Gouvernement en Europe - Université de Strasbourg ), administrateur de FramasoftPublications

Publié le 13.03.2026 à 01:00

Agent automate et insoumission : faut-il désynchroniser ?

L’émergence contemporaine de l’intelligence artificielle, et plus spécifiquement son glissement vers l’agent autonome, marque une rupture épistémologique que la pensée critique ne peut plus ignorer sous peine de sombrer dans l’anachronisme. Nous avons quitté l’ère du programme-outil pour celle de l’opérateur capable de naviguer, de manipuler et de s’autocorriger. Cette mutation n’est pas une simple avancée incrémentale, mais l’aboutissement d’une trajectoire historique dont il faut saisir la profondeur pour armer notre résistance. Ce billet est surtout prospectif, il ne relève pas d’une pensée aboutie et encore moins prescriptive.

(Billet publié sur le Framablog le 10/03/2025)

Éviter l’anachronisme

Historiquement, la machine était conçue comme une extension de l’organe ou une prothèse de l’intellect. C’est le concept d’outil chez Simondon. Ce dernier montrait que l’évolution technique tend vers la concrétisation : la machine devient de plus en plus cohérente en elle-même, la fonction implique la transformation de la machine (l’idée du progrès au XVIIIe siècle). Avec l’IA contemporaine (oui, parce qu’on parle d’IA depuis bien, bien longtemps), on quitte le stade de la simple prothèse (qui exécute une commande) pour entrer dans celui de l’agent (qui interprète une intention et produit une stratégie). La machine n’est plus seulement au bout de l’esprit, elle commence à occuper l’espace de la décision intermédiaire.

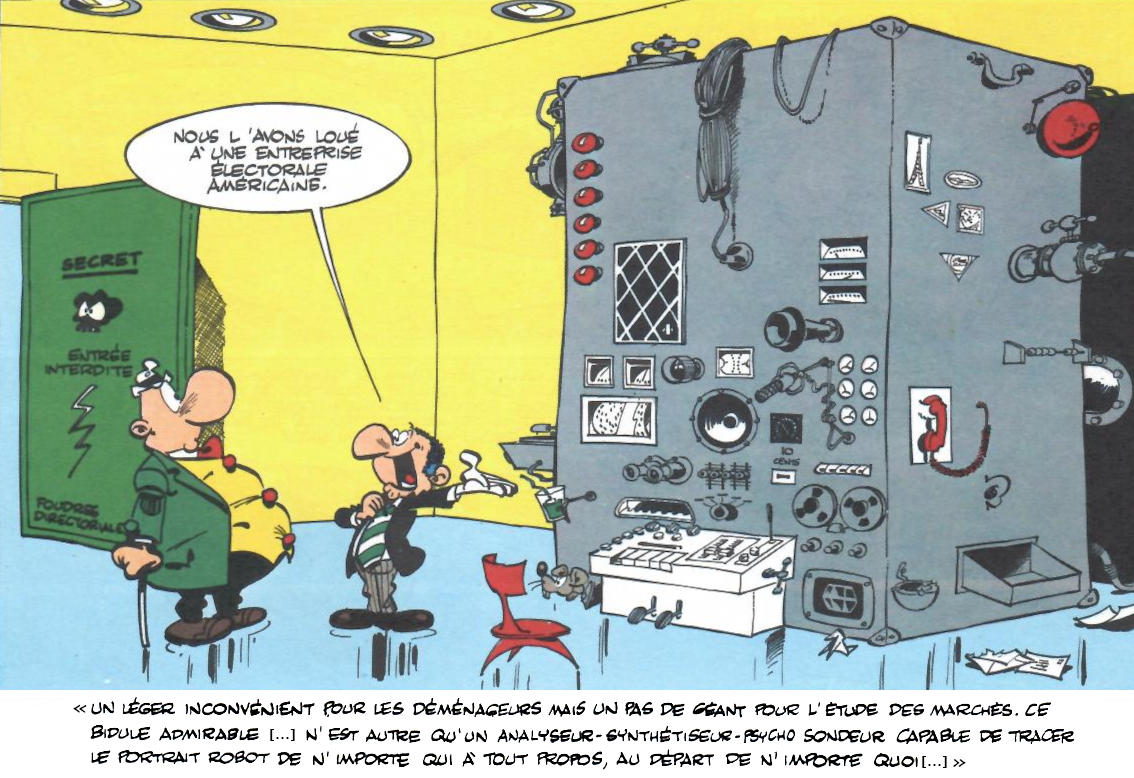

L’agentivité autonome actuelle rompt avec la linéarité qu’on tend généralement à supposer lorsqu’on parle d’histoire des techniques (si on n’est pas historien des techniques, la plupart du temps, c’est ainsi qu’on voit les choses). Le système technique n’est plus un simple intermédiaire entre une intention et un résultat, mais un dispositif capable de définir ses propres sous-objectifs et de corriger ses trajectoires d’exécution en temps réel. Cette autonomie opérationnelle déplace le curseur de la décision, créant un système technique où l’opérateur humain intervient par la consigne de haut niveau plutôt que par le pilotage de précision. Et le paradoxe, c’est que ce faisant, nous créons un système hiérarchique radical dans lequel la plupart des opérateurs humains deviennent eux-mêmes des rouages, lorsque par exemple l’algorithme impose sa loi au livreur, au manutentionnaire, au vendeur. Toutes les professions, y compris les plus intellectuelles, sont désormais destinées à produire ce que Cory Doctorow nomme des centaures inversés.

La violence technologique que je mentionne ces derniers temps dans mes écrits m’inspirant de la pensée de Detlef Hartmann, se superpose à cette lecture. Dans le capitalisme industriel, les individus sont dépossédés de leur autonomie et rendus étrangers à leur propre activité. Dès les années 1970-1980, cette logique d’aliénation s’étend de la production industrielle à la production symbolique et intellectuelle par l’informatisation des tâches, toujours au service du contrôle et de la rationalisation capitalistes. La violence technologique prolonge ainsi la violence structurelle du capital en cherchant à formater les dimensions qualitatives de l’existence humaine (l’intuition, l’émotion, l’imaginaire) selon les exigences d’un ordre rationnel formel. Cette normalisation constitue une violence en ce qu’elle privilégie l’accumulation et le contrôle, réduit la richesse des facultés humaines à des catégories limitées et entrave les pratiques d’émancipation ainsi que la capacité collective à transformer consciemment le monde.

L’introduction des agents dans le système technique numérique modifie la structure de la preuve et de la responsabilité technique. Dans le paradigme du logiciel classique, la réponse est déterministe et traçable dans le code. Avec les modèles d’action autonomes, le système procède par inférences probabilistes et par itérations imprévisibles sur des interfaces tierces. Cette opacité du processus décisionnel, cette boîte noire, remet en cause l’imaginaire de la maîtrise technique, où l’utilisateur est censé comprendre et contrôler chaque étape de la transformation du réel par la machine (même si dans bien des cas, c’est vraiment imaginaire).

En s’extrayant de la simple génération de texte pour interagir directement avec les systèmes d’exploitation et les réseaux, les modèles d’IA aujourd’hui créent un nouveau milieu. Elles deviennent des acteurs dans l’infrastructure numérique. Elles imposent une cohabitation dans laquelle les processus automatisés s’autoalimentent, réduisant ainsi la latence entre la conception et l’application, mais augmentant radicalement la complexité du système technique global.

L’anachronisme consiste à s’obstiner à analyser l’IA comme un simple automate sophistiqué. La spécificité de l’agent autonome réside dans sa capacité de planification et d’adaptation face à l’imprévu. Ignorer cette dimension conduit à une méprise sur la nature même de la puissance de calcul contemporaine : elle n’est plus seulement quantitative (vitesse de traitement), mais qualitative (capacité de médiation et de substitution dans des tâches cognitives et décisionnelles complexes).

L’IA dans l’histoire de l’arraisonnement technique

Pour comprendre l’IA, il faut l’inscrire dans l’histoire de l’informatisation des organisations amorcée dans les années 1960-1970. Nous sommes alors passés d’un moment technique à un autre, entre « faire travailler les machines » à notre place, à la constitution de « systèmes d’information ». Cela a transformé l’ordinateur en un pivot du management, visant la quantification du réel, et en particulier la productivité de l’homme et son comportement (marketing). Déjà à cette époque, le discours sur la « neutralité technique » servait de paravent à une volonté de monitoring social et de rationalisation productiviste.

Je ne peux m’empêcher de penser (c’est peut-être justement un réflexe anachronique, donc : prudence) que l’IA générative contemporaine marque l’aboutissement technique de ce que Marx nommait le « sujet automate » : un stade dans lequel le système de machinerie ne se contente plus d’assister l’homme, mais s’autonomise pour devenir un processus de production de valeur dont l’humain n’est plus que l’accessoire. Dans cette configuration, l’IA n’est plus un outil inerte, mais un agent capable de gérer ses propres itérations. Dans un récent article Matt Shumer (oui, encore un entrepreneur de l’IA, mais on peut aussi le lire, ce n’est pas inutile), mentionne le modèle GPT-5.3 Codex : la machine contribue désormais à sa propre création en déboguant son code de formation et en optimisant elle-même son déploiement. En fermant cette boucle de rétroaction, l’IA instaure un métabolisme technique qui s’autoalimente : elle écrit le code des générations futures, créant une accélération où la puissance de calcul se valorise elle-même.

Cette mutation transforme notre rôle : nous passons du statut d’opérateur pilotant une machine, ou d’opérateur annexe à la machine (le livreur surveillé par l’algortithme qui lui dit où déposer le colis et en combien de temps) à celui de simple fournisseur de ressources. À moins de faire partie d’une élite des big tech, nous sommes en train de passer du statut déjà peu enviable de périphérique biologique d’un système algortithmique à celui d’un terreau d’où le système extrait les données nécessaires à sa propre maintenance. Il en résulte une « seconde nature » technologique, telle que décrite par Jacques Ellul et Langdon Winner : un environnement si totalisant et si profondément imbriqué dans nos formes de vie qu’il devient invisible à nos yeux. Nous basculons alors dans un somnambulisme technologique, acceptant comme inéluctable un cadre de vie où la technologie dicte ses propres normes de fonctionnement1.

Le braconnage culturel est-il une impasse ?

Ces deux dernières années, je me suis appuyé sur deux concepts qui permettent de se figurer des méthodes d’émancipation de ce cadre de vie ainsi imposé. Celui de mètis repris de James Scott, dans L’œil de l’État, et celui de braconnage culturel, repris de Michel de Certeau, dans L’invention du quotidien (voir la troisième section de cet article). Autant mener résistance contre un système totalitaire par la ruse laisse au moins un horizon ouvert de techniques à tester et à éprouver (on pense par exemple au Fediverse et ses protocoles), autant les tactiques de M. de Certeau me semblent désormais quelque peu obsolètes. Que nous dit M. de Certeau ? Il nous parle des tactiques du quotidien qui permettent, par des usages imprévus, de détourner l’ordre imposé. J’y voyais comme lui autant d’actes possibles de résistance, comme détourner des objets de leurs finalités ordonnées par leur marchandisation. Souvenez-vous par exemple de la Pirate Box qu’il était possible d’installer sur un routeur TP-Link. Mais aujourd’hui, nous devons affronter quelque chose de beaucoup plus brutal : l’IA générative semble immunisée contre ce braconnage car elle ne se contente plus de prescrire un usage… elle l’absorbe.

Le braconnier joue sur les failles d’un système rigide. L’agent IA, lui, est par définition malléable et adore les déviations. Chaque tentative de détournement devient une nouvelle donnée d’entraînement, une itération supplémentaire qui permet au système de corriger ses erreurs et d’intégrer la subversion dans sa propre logique formelle. Le système se fiche du sens de votre révolte tant qu’il peut en modéliser le comportement. Le braconnage numérique risque donc de n’être qu’une collaboration involontaire à l’emprise algorithmique « voulez-vous que je vous aide à créer votre Pirate Box ? »

Quelle mètis pour l’insoumission ?

Dès lors, il ne s’agit plus de ruser dans le système, mais de ruser contre son intelligibilité. Notre mètis doit devenir une intelligence de la désynchronisation :

- Le sabotage de la prédictibilité : puisque le capitalisme de surveillance tend à une augmentation des degrés de certitude, l’insoumission passe par l’injection de « bruit » et l’entretien de zones de haute tension identitaire. On peut penser aux pratiques de data obfuscation. Il faut refuser la standardisation des subjectivités en multipliant les appartenances contradictoires que l’algorithme ne peut réduire à un profil de consommation cohérent. Hélas, le principal biais de cette approche, c’est l’épuisement à transformer notre quotidien en lutte permanente, coûteuse et aux résultats incertains, contre des machines qui, elles, ne s’épuisent pas. Reste à s’appuyer sur le droit et les garde-fous de type RGPD et AI-Act… suffiront-ils ? j’ai des doutes.

- Désynchroniser nos pratiques de l’ordre imposé : face à l’agent qui navigue pour nous, la ruse consiste à restaurer notre propre encapacitation par le recours aux Communs numériques et aux low-tech. C’est une forme de « désapprentissage » de la dépendance. L’objectif est de reconstruire des espaces d’autonomie technique où l’on refuse la médiation de l’agent propriétaire. Là, le logiciel libre a toutes ses cartes à jouer, et c’est maintenant ! il est presque déjà trop tard. À trop dénigrer les LLM et les services qui emmerdifient le web, nous avons laissé passer le train de l’adoption des usages : la seule solution consiste selon moi à utiliser les modèles existant et les détourner. C’est une réminiscence du braconnage culturel que je mentionnais plus haut, sauf qu’ici, il s’agit d’un geste technique, qui implique des communautés, et non plus le quotidien personnel de chacun de nous. Nous devons braconner ensemble. De petits LLM à l’usage concret et frugal.

- L’action préfigurative : j’en parle dans ce billet. Il s’agit de créer des « archipels » de liberté numérique qui échappent physiquement et logiquement au contrôle centralisé. Cela revient à refuser le somnambulisme technologique en organisant des espaces dans lesquels la créativité, le partage et la solidarité redeviennent les mesures de l’intérêt du monde numérique.

En acceptant les modèles d’IA comme des auxiliaires « pratiques », nous signons un contrat dont les clauses d’aliénation ne nous seront révélées qu’une fois que le verrouillage socio-technique sera total. Nous devons donc politiser non pas seulement l’usage, mais les conditions de possibilité de ces techniques. Si un système technique exige pour fonctionner une structure de commandement hiérarchique ou une extraction illimitée de données, il doit être combattu en tant qu’artefact intrinsèquement autoritaire. Notre mètis ne doit plus être celle du braconnier qui se cache dans la forêt, mais celle du constructeur d’une autre forêt, impénétrable (ou le moins possible).

Un monde sans les IA d’aujourd’hui (à moins d’une catastrophe) n’est plus envisageable. Et jamais, nous n’avons été autant dépossédés de notre cadre de vie. La menace est trop grande pour que nous puissions nous payer le luxe d’ignorer ou faire semblant d’éviter cet avancement technologique brutal et foudroyant. La question ne se limite plus à se demander si chacun d’entre nous utilise ou pas ces technologies. Elles s’imposent partout, et s’imposeront encore. Je ne vois donc qu’une seule possibilité : ruser. Ruser en utilisant ces techniques, en y opposant d’autres savoirs (et c’est en cela que la mètis est le miroir inversé de la technè) et en leur volant de la valeur. La transformer en commun. D’abord par la connaissance et la réappropriation cognitive, ensuite en désynchronisant l’usage de l’autorité.

Idées en vrac et à réfléchir ensemble :

- des SLM (Small Language Models) à usage concret et frugal (avec une sorte de Huggingface vraiment communautaire, spécialisation fine de type LoRA),

- des espaces numériques où la créativité redevient le moteur de la valeur ajoutée (un web off-line first, flux RSS, pages statiques, Fediverse),

- reformer un web à part, un web « des gens », sans usages imposés, et lui aussi frugal.

- Autres idées ? c’est le moment :)

-

Je reprends ici deux expressions de Langdon Winner, dans La baleine et le réacteur, dont je conseille vivement la lecture. ↩︎

Publié le 27.12.2025 à 01:00

Guide pratique d'artisanat numérique à l'université

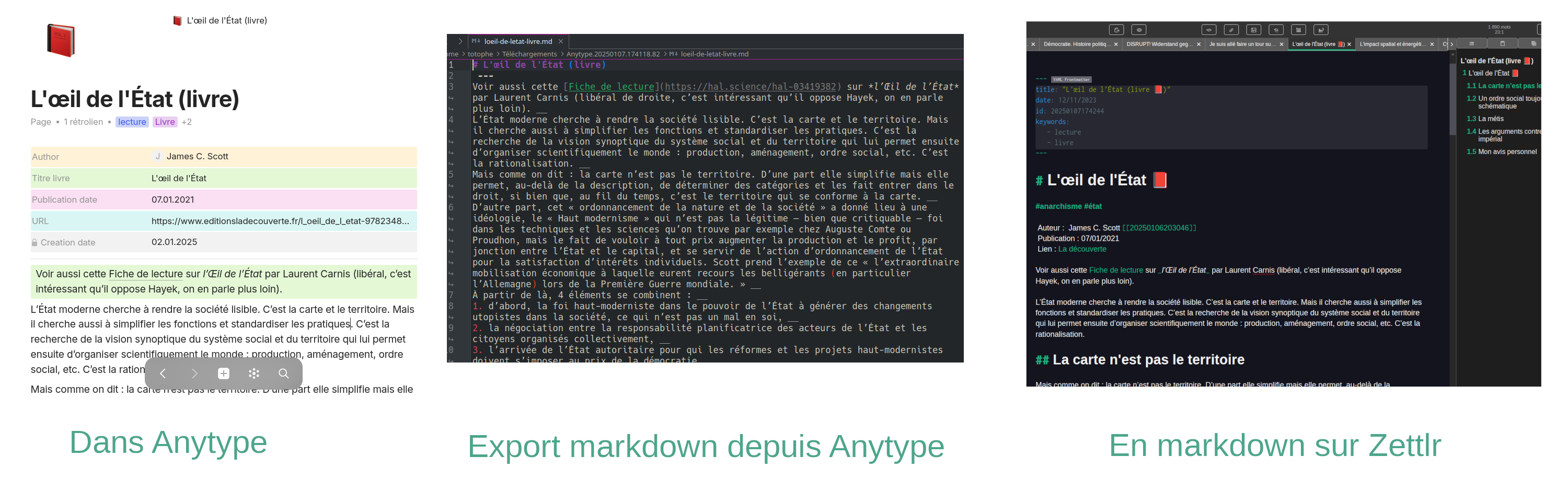

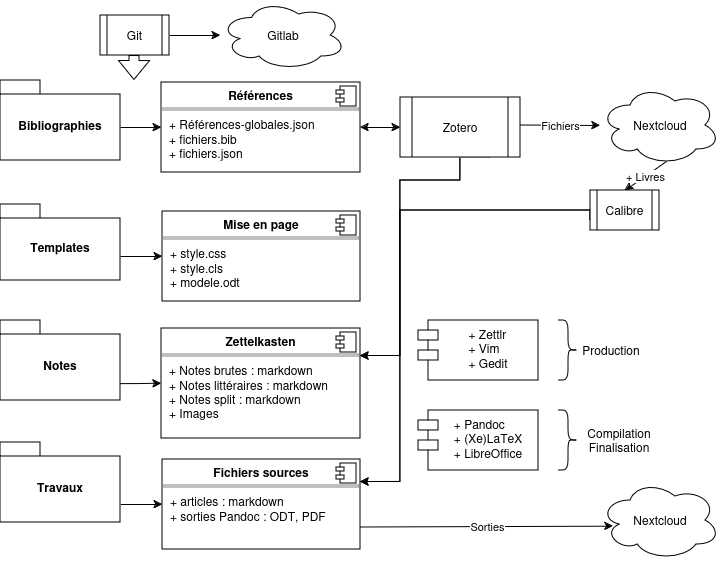

Je viens de créer un guide qui s’adresse aux étudiants et enseignants-chercheurs qui souhaitent progresser dans la maîtise d’une chaîne de production numérique, de la prise de notes à la production d’un cours, d’un article, d’un rapport, d’une thèse, ou d’un livre.

Créé avec Zensical, le successeur de MKDocs, ce guide a pour objectif de vous aider construire votre environnement de travail avec des logiciels libres.

Vous pouvez le trouver à cette adresse : libruniv-c29483.frama.io.

Voici un extrait de l’introduction

La vie de chercheur·euse ou d’étudiant·e est souvent un combat contre la machine. Au fil des années, j’ai vu combien nos dispositifs numériques — les conditions matérielles de notre travail intellectuel — peuvent devenir des poisons psychiques et physiques lorsqu’ils sont subis. Quand l’outil est mal compris, il cesse d’être une extension de la pensée pour devenir une entrave.

Chacun·e connaît ce naufrage : le traitement de texte ralenti à la centième page, la bibliographie qui foire la veille d’un rendu, l’idée géniale perdue dans le brouillard des fichiers nommés au hasard… Le problème n’est pas l’absence de compétences de base — tout le monde sait envoyer un mail ou lancer un diaporama. Le problème, c’est l’absence de fondations saines. Nous ne construisons pas notre environnement numérique selon nos besoins, mais selon des habitudes.

Évidemment, certains secteurs disciplinaires, à commencer par les sciences informatiques, seront bien plus exempts de ces difficultés puisque la condition pour intégrer un cursus est un niveau de compétences numériques élevé. En dehors, cependant, l’usage des logiciels bureautiques classiques est considéré comme un horizon indépassable. Le reste est perçu comme une aventure en territoire inconnu. On calcule alors, souvent mal, le rapport entre l’énergie nécessaire pour apprendre de nouveaux outils et celle, épuisante, dépensée à produire laborieusement des connaissances avec des logiciels inadaptés.

Ce n’est ni de la procrastination, ni de l’inadaptation : c’est un manque d’accompagnement. Les étudiant·es ignorent l’existence même d’alternatives ; les enseignant·es-chercheur·euses confirmé·es, prisonnier·es du « ça marche comme ça », s’épuisent dans des méthodes artisanales peu efficaces mais familières.

Ces situations créent des verrous numériques. Les suites propriétaires, comme Microsoft Office, nous emprisonnent dans des systèmes opaques : elles promettent la sécurité d’un cloud inconnu (et souvent malveillant) et nous dépossèdent de la maîtrise de nos fichiers. On multiplie les sauvegardes redondantes, on s’égare entre les notes manuscrites et les documents en ligne, et l’on finit par succomber aux promesses des services basés sur des grands modèles de langages (on dit aujourd’hui : « IA ») qui proposent de trier nos vracs numériques à notre place. Résultat : une perte totale de concentration et de sens.

Ce guide propose de briser ces verrous

Il ne s’agit pas seulement de « mieux cliquer », mais de reprendre le contrôle sur votre production intellectuelle par le logiciel libre.

Publié le 10.12.2025 à 01:00

Face aux services privateurs des GAFAM1, on recherche l’autonomie technologique. Mais à quel prix ? Toute transition se doit d’être abordée concrètement. C’est pourquoi je parlerai ici du stockage de fichiers, dans une démarche progressive. Les organisations du collectif CHATONS sont un phare dans la nuit, mais pour celleux qui, comme moi, ont besoin d’espace et de maîtrise logicielle sans l’effort d’une administration système complète, je détaille la solution d’une instance Nextcloud dédiée chez un hébergeur (Hetzner), couplée à un nom de domaine personnel. C’est, à mon sens, une belle façon d’assurer un contrôle sur nos données familiales ou associatives.

Autour de moi, tenace, s’élève le chant que nous autres libristes ne cessons de porter depuis des années : celui de l’autonomie technologique, et du refus obstiné de demeurer captifs des services des GAFAM et consorts. Je suis loin d’être le seul à le ressentir en ce moment. La campagne récente du grand Démailnagement est un témoin significatif de l’air du temps.

Toujours est-il qu’il est à la fois attendrissant et inquiétant de voir se tourner vers soi des regards plein d’espoirs qui disent : « je voudrais bien avoir mon espace à moi, mais je ne sais pas comment faire ni par quoi commencer, peux-tu m’aider ? ». C’est attendrissant parce que, à ces instants, s’ouvrent des friches qu’on s’empresse (mais avec délicatesse, attention !) de remplir de valeurs libristes et de communs numériques. C’est inquiétant parce que cela implique une certaine responsabilité dans la manœuvre. Des concepts mal expliqués, des pratiques mal comprises, des besoins mal exprimés et vous voilà embarqué·e dans des situations inextricables. Vous pouvez même perdre des ami·es.

C’est pourquoi le titre de ce billet est trompeur. Comme vous allez le voir, le nuage que je vous encourage à acquérir n’est pas tout à fait « rien qu’à » vous, même avec un nom de domaine. Mais je pense ainsi vous aider à franchir une première étape vers l’autonomie, surtout lorsqu’on n’a ni le temps ni l’envie de s’improviser administrateur système.

Par quel bout commencer ?

On va prendre celui du stockage de fichiers, mais… il y a plein d’autres bouts. Par exemple vous pourriez commencer par migrer votre messagerie, vous pourriez aussi commencer par changer de médias sociaux, vous pourriez aussi ouvrir votre blog avec un service éthique, etc. Tous ces bouts des ficelles du web libre sont beaucoup plus faciles à appréhender que vous le pensez, mais à condition de savoir où mettre les pieds.

En premier lieu, il y a les organisations d’un collectif nommé CHATONS, le Collectif des Hébergeurs Alternatifs, Transparents, Neutres et Solidaires. Vous pouvez y trouver des organisations qui vous permettront de vous libérer entièrement des services des GAFAM. Je prendrai deux exemples de ces gentils Chatons : Zaclys et Sans-Nuage.

Avec un compte chez Zaclys ou Sans-Nuage, pour une somme modique (comprenant aussi l’adhésion car vous faites partie de l’asso !) vous pouvez obtenir l’essentiel à titre individuel, une boîte mail, divers services utiles et un hébergement Nextcloud. Vous pouvez aussi avoir un pack pour tout un groupe d’utilisateurs, votre famille ou une communauté plus large.

Toute la difficulté consiste à estimer vos besoins. J’ai rencontré plusieurs cas où il m’a été assez difficile de comprendre à chaque fois le besoin exact et surtout expliquer leurs enjeux.

Par exemple cette mère de famille convaincue qu’il fallait dégager Google de sa vie : oui, mais quel est le prix à payer ? Il y a d’abord le fait d’accepter que des services comme l’hébergement de fichiers ou le courrier électronique sont des services difficiles à mettre en œuvre et à maintenir sur la durée, nécessitant des ressources humaines et matérielles non négligeables. Si des entreprises comme Google offrent cela gratuitement en échange d’un pacte diabolique, ce ne peut pas être le cas d’un gentil Chaton qui doit faire face à des coûts d’infrastructure incompressibles (même s’il y a des exceptions comme Framasoft). Et si le paiement d’une somme modique n’est pas un problème (il peut l’être), qu’est-ce qu’implique exactement le fait de changer d’adresse courriel lorsqu’on a utilisé pendant dix ans son adresse @gmail pour régler ses factures, comme contact bancaire ou pour ses amis ? Quant à déménager ses photos de GDrive pour les mettre sur un hébergement Nextcloud, cela implique de synchroniser différemment avec son téléphone portable et son ordinateur, pas toujours simple.

Et ce « bon père de famille » qui voulait que toute sa famille passe quasiment du jour au lendemain chez Zaclys, on en parle ? Je vous laisse imaginer les difficultés auxquelles il du faire face entre la migration administrative et les deux ados…

Donc, oui, ça se prépare. On ne tire pas sur tous les bouts en une seule fois, sinon, ça fait des nœuds.

Pour des organisations déjà versées dans le domaine numérique comme Framasoft, cela prend un an au bas mot, pour effectuer une migration complète. D’autres associations font des retours d’expérience dans le livre Resolu. Pour des entreprises, idem, il faut planifier et les enjeux peuvent être insurmontables. Il n’y a donc aucune raison de ne pas préparer cela pour soi-même, sa famille ou son asso.

J’estime pour ma part qu’une migration de courrier électronique individuelle peut prendre jusqu’à un an avant de décider une fois pour toute de fermer définitivement le compte initial, pour que le transfert des adresses n’oublie personne ou que l’on pense bien à toutes ses correspondances. Pour le stockage de fichiers, c’est beaucoup plus rapide, évidemment, puisqu’on part généralement sur la base d’un compte individuel. En revanche la solution Nextcloud dont je parlerai plus tard peut impliquer plusieurs personnes. C’est l’effet inverse. Une fois que vous ouvrez votre espace de stockage à des membres de votre famille ou à des amis, une migration ne s’effectue plus à la légère.

Exemple : une affaire de nom de domaine

Parlons rapidement du courrier électronique. Google nous a habitué a avoir des adresses du genre michelle.morizeau@gmail.com. Tous les utilisateur·ices de smartphone Android se doivent d’avoir une telle adresse, même si ce n’est pas avec cette adresse qu’iels communiquent habituellement. Cela n’est pas anodin : le problème n’est pas tant dans le choix du fournisseur que dans celui du nom de domaine qui est ainsi imposé au nom de la gratuité.

Avoir un nom de domaine à soi, ce n’est pas uniquement réservé à un site web. C’est utile pour plein de choses. Et si notre amie Michelle Morizeau avait, pour moins de 10€ par an, un nom de domaine du genre morizeau.fr ? Passons les détails techniques : avec un nom de domaine il est très simple (vraiment !) de faire en sorte de faire pointer tout ce qui ressemble à xxx@morizeau.fr vers l’adresse courriel de son choix (et répondre avec l’adresse du nom de domaine).

En d’autres termes, Michelle Morizeau n’a, dans l’absolu, pas vraiment besoin de changer de fournisseur de courrier électronique : elle peut continuer à utiliser les services de Google, tout en diffusant une adresse avec son nom de domaine. Plus tard, elle pourra alors changer de fournisseur autant qu’elle veut pourvu qu’elle puisse configurer la réception et l’envoi de courriel avec les serveurs des fournisseurs prenant en charge des noms de domaine externes (oui, car il faut encore que l’hébergeur de courrier électronique le veuille bien : c’est un service et il est souvent compris dans les offres payantes).

Cela étant dit, la question du nom de domaine n’est pas si extravagante : un nom de domaine ne vous permet pas seulement de personnaliser votre adresse (web ou courriel), il permet d’avoir une fois pour toute une adresse à votre nom et votre goût, quel que soit le fournisseur du service. C’est déjà un premier pas vers une forme d’autonomie.

Surmonter ses craintes

C’est souvent parce qu’on a peur de grimper l’Himalaya en tongs (pour reprendre la métaphore d’un certain Pyg — je viens d’apprendre que c’est aussi un film) qu’on remet toujours à plus tard une telle migration. D’un côté, il peut paraître particulièrement laborieux non seulement de trouver le bon service d’hébergement mais en plus de changer ses habitudes pour un système qui apparaît plus complexe.

Les plus geeks ont une petite part de responsabilité, surtout lorsqu’ils intitulent leurs articles de blog avec des expressions du genre : « il n’a jamais été aussi facile d’héberger son serveur cloud ». Il suffit de dérouler un peu les articles en question pour voir apparaître des instructions qui ne s’adressent clairement pas à n’importe qui : installez une distribution Linux, installez ceci avec Docker, connectez-vous en ssh, configurer un cron, éditez le fichier de configuration en yaml, etc.

Ce genre d’activité relève d’un métier, celui de l’administrateur système. Même s’il est effectivement à la portée d’un utilisateur pugnace d’héberger son propre serveur (son instance) Nextcloud. Et même si il est vrai qu’avec un peu de connaissances, de patience et de logique, cette activité s’est largement « démocratisée », il faut tout de même reconnaître que l’auto-hébergement nécessite aussi de l’autoformation. Une situation extrêmement enrichissante mais chronophage.

Il y a trois types de services de stockage de fichiers.

- Les services payants ou gratuits chez un fournisseur de service. Là, tout l’enjeu consiste à évaluer ce fournisseur et le degré de confiance que vous pouvez avoir en lui. Il faut ensuite évaluer l’adéquation du service avec vos besoins. Si vous souhaitez stocker des fichiers sensibles (vos fiches de paie, des scans de vos pièces d’identité), il vaut mieux se tourner vers un « coffre-fort numérique », un service parfois ouvert auprès de votre banque, par exemple. Si vous souhaitez stocker des données moins sensibles, posez-vous la question de savoir à quoi l’hébergeur peut avoir accès et la manière dont il peut s’en servir. Dans les deux cas, il clair que vous ne pouvez pas faire confiance en un service gratuit qui lit vos données et a un usage déloyal de vos informations. Posez-vous enfin la question de la quantité de stockage nécessaire selon que votre besoin est individuel, familial ou encore pour un groupe plus étendu.

- L’auto-hébergement. Comme je l’ai écrit plus haut, c’est une activité qui nécessite des compétences techniques (même si l’excellent Yunohost a largement simplifié les choses). Il y a deux types d’auto-hébergement : soit vous avez un ordinateur (un serveur) chez vous derrière votre accès internet, soit vous avez loué un serveur (type VPS) chez un hébergeur de serveurs. Dans les deux cas, la plupart du temps vous installerez un système d’exploitation et des logiciels, dont Nextcloud qui est sans doute aujourd’hui la solution open source la plus répandue dans le domaine (quoi qu’on peut très bien se contenter d’un stockage en SFTP). Si vous louez un serveur, vous laissez un tiers s’occuper de l’infrastructure de votre système, charge à vous de maintenir toute la partie logicielle, les mises à jour, la sécurité, les sauvegardes, etc.

- Une solution intermédiaire consiste à louer un espace de serveur complètement dédié à une instance Nextcloud dont vous avez la charge de l’administration. C’est de cette solution dont je vais parler plus loin.

Vous avez compris que pour surmonter ses craintes, il faut simplement savoir s’orienter. Changer de GDrive à DropBox ou MSOne nous vous apportera strictement aucun avantage parce que ces services ont à peu près le même modèle économique. En revanche, si vous avez besoin de plus d’espace d’hébergement et que vous souhaitez renouer une chaîne de confiance entre vous et l’hébergeur, orientez-vous vers l’un des Chatons. Si vous souhaitez garder la maîtrise logicielle sans avoir à gérer l’infrastructure technique, c’est vers un professionnel de fermes de serveur qu’il faut vous tourner. Dans tous les cas, c’est-à-dire en dehors d’un auto-hébergement intégral, sachez que la sécurité de vos données seront dépendantes d’un tiers.

L’autre crainte que vous pourriez avoir, c’est le changement de pratiques. Vous êtes habitué·e à synchroniser vos fichiers entre votre ordinateur, votre mobile et un serveur : ce principe ne changera pas. Ce qui change avec Nextcloud, c’est le logiciel qui permet la synchronisation sur votre dispositif, et aussi les logiciels qui équipent Nextcloud. Chez les hébergeurs qui proposent une offre Nextcloud toute faite, le choix des logiciels disponibles est fait le plus souvent à votre place. Il y a d’abord le coeur de Nextcloud, c’est-à-dire le stockage de fichiers et la navigation, mais il y a aussi d’autres logiciels (présents dans un app store) dont vous pouvez bénéficier comme la gestion des contact, un agenda, parfois même un traitement de texte en ligne (pas toujours car cela nécessite beaucoup de ressources). Ou encore des logiciels plus « gadgets » comme l’édition et le partage de livre de recettes de cuisine, le partage de fichier GPX pour vos randonnées, etc. Il y en a plein. Pour en bénéficier, tout dépend de vos droits et des choix de l’hébergeur.

Pour résumer cette partie, on peut dire que par comparaison avec les services des GAFAM, la solution la plus courante consiste à passer à un hébergement basé sur Nextcloud. La synchronisation des fichiers reste toujours sur les mêmes principes fondamentaux. En revanche, vous allez changer complètement d’écosystème : les outils à votre disposition vont changer, mais c’est aussi le moment de faire des choix : par exemple savoir ce qui vous retient à ce point chez Google ? Rien n ‘empêche à ce que vous conserviez un compte Google tout en hébergeant vos fichiers ailleurs.

Objectifs

Stocker ses fichier en ligne, c’est bien, mais quels sont vos priorités ? En voici une liste :

- Sauvegarder ses fichiers : il faudra bien évaluer la sécurité. Par sécurité on entend à la fois le risque de perte ou de vol de données, mais aussi leur intégrité. Quoiqu’il en soit : choisissez bien ce que vous mettez sur l’ordinateur de quelqu’un d’autre. Il n’est peut-être pas nécessaire de stocker vos documents confidentiels (santé, banque, identités…) si vous n’avez pas de contrat qui vous assure qu’ils sont bien en sécurité (il existe des services pour cela).

- Synchroniser : par exemple, prendre vos photos avec votre smartphone et les retrouver sur votre PC tout en les ayant sauvegardé dans l’espace cloud. Ou encore commencer à prendre des notes avec votre tablette, et continuer sur votre PC, etc.

- Partager : partager vos fichiers avec des correspondants, éventuellement travailler dessus de manière collaborative.

Ensuite, quelle est votre cible ? Souhaitez-vous un espace individuel, votre nuage à vous seul, ou bien souhaitez-vous un espace ouvert pour les membres de votre famille ou plus largement vos amis ? Si votre usage a une ambition collective, il faut trouver un hébergeur qui permette d’avoir la main sur la gestion des comptes, avec un espace disponible conséquent (en tout cas plus large que les 10 ou 15 Go proposés habituellement).

Ne commettez pas l’erreur si souvent rencontrée d’ouvrir un compte et distribuer le même accès à plusieurs personnes : vous enfreindriez toutes les règles de sécurité et de bonnes pratiques.

Le tableau ci-dessous vous donne une idée du rapport entre les usages et les solutions proposées. Ce n’ est pas un benchmarking, je ne cite aucun Chaton en particulier et ce n' est qu’une indication d’usages possibles.

| Usage | Hébergeur | Dispositif | Espace | Maintenance |

|---|---|---|---|---|

| Individuel | Un Chaton | Un compte Nextcloud sur serveur mutualisé | Généralement quelques Go (négociables) associés avec plusieurs autres services (mail, chat, visio, suite collaborative…) | Par le Chaton |

| Famille | Un Chaton | Ouvrir plusieurs comptes individuels Nextcloud | Idem | Par le Chaton |

| Famille / asso / groupes | Un Chaton | Une instance Nextcloud pré-configurée, limitée en termes de nombre de comptes | Quelques Go + divers services choisis pour vous sur ce Nextcloud | Par le Chaton (mais vous gérez les comptes) |

| Famille / asso / groupes / individu | Un Chaton | Un serveur privé virtuel | Assez large | L’infrastructure est maintenue par le Chaton, mais vous êtes administrateur. Compétences techniques souhaitées. |

| Famille / groupe / petite asso | Un hébergeur de serveurs | Une instance Nextcloud | Assez large | Vous gérez la totalité de l’instance préconfigurée et maintenue pour vous, les sauvegardes sont assurées par l’hébergeur. Pas d’autres services à part Nextcloud et ses logiciels. |

Pour être complet, on peut ajouter à cela les offres de la part d’hébergeurs plus professionnels et qu’on peut qualifier de plus éthiques que les GAFAM. J’en citerai trois : Proton, Infomaniak et Mailo. Dans les trois cas, outre des adresses courriels et une suite de services, vous pouvez choisir des hébergements individuels gratuit ou collectifs payants présentant beaucoup d’avantages, y compris avec des noms de domaines. Mieux que des Chatons ? non : ces services commerciaux ne cherchent pas vraiment à créer un commun numérique dans lequel vous puissiez vous sentir chez vous, mais comparés aux GAFAM, ce sont les moins mauvais des choix compte-tenu des valeurs affichées.

Le tuto : un espace familial chez Hetzner (et un NDD)

En préambule à ce tutoriel, quelques explications.

Je vais expliquer ici la méthode pour obtenir un espace Nextcloud d’environ 1 To, avec un nom de domaine. J’estime cet usage réservé en premier lieu à un usage familial ou pour groupes restreints du genre petite asso. J’expliquerai ensuite comment s’en servir.

- Cette offre chez Hetzner est assez rare pour être étudiée de près.

- Elle ne nécessite pas de compétences techniques évoluées (clés en main).

- Elle permet de profiter de (presque) tout le potentiel de Nextcloud.

- Elle ne permet pas vraiment le travail collaboratif avec une suite bureautique en ligne (c’est toutefois possible mais complexe, et il vaut mieux alors prendre un serveur privé).

- Vous pouvez gérer les comptes, les quantités d’espace alloués à chaque compte, et les logiciels disponibles.

- Nous verrons la « petite » offre, mais il existe deux autres offres, plus chères, pour un usage dédié à de plus nombreux comptes avec beaucoup d’espace.

Concernant le nom de domaine, vous pourriez vous demander pourquoi je préconise d’en prendre un. D’abord pour la raison évoquée ci-dessus : que ce soit pour le courriel, un site web ou autre chose, un nom de domaine est pratique pour ne pas dépendre d’un seul fournisseur tout faisant en sorte que vos migrations soient transparentes pour vos correspondants. Pour un espace de stockage de fichier, cela permet aussi d’avoir un espace nommé à votre convenance et pas une adresse indigeste du genre https://nx321654455.your-storageshare.de. La clé est d’utiliser les sous-domaines à bon escient.

Pour héberger un nom de domaine, j’ai personnellement choisi Infomaniak. Ce n’est pas de la pub gratuite : le tableau de bord pour la gestion est assez compréhensible et pratique, ça fonctionne bien, c’est pas cher, et en plus du nom de domaine vous pouvez aussi bénéficier d’un espace mail et d’une suite collaborative (et c’est en Suisse…). Vous pouvez aussi bien prendre un nom de domaine ailleurs, les principes restent les mêmes.

Le budget :

- entre 5 et 20 € par an pour le nom de domaine (selon vos choix, il y a plus cher)

- moins de 6€ par mois pour l’instance (1 To)

- donc un peu moins de 100€ par an.

Non, ce n’est pas gratuit. Mais il faut comparer cette offre avec les autres offres disponibles et aussi selon vos objectifs et vos exigences. Par contre, on peut dire que ce n’est pas onéreux non plus. Par exemple, c’est peut-être quelque chose de plus utile que votre troisième abonnement de streaming vidéo… Mieux encore : comparez ce prix (et aussi celui des Chatons pour les offres mentionnées ci-dessus) avec par exemple les offres Google One dont le degré de confiance est quasi nul : à quel prix estimez-vous la confidentialité de vos données ?

On y va ? (pour la suite, notez soigneusement vos logins et mots de passe, il y a des logiciels pour cela).

On commence par le nom de domaine

Pour ouvrir un nom de domaine, il vous faut trouver un registar, c ‘est-à-dire un tiers (généralement une entreprise) qui va enregistrer pour vous un domaine dans un grand registre. C’est avec ces grands registres que le système DNS permet d’associer un nom (de domaine) et une adresse IP.

Il y plusieurs grands registres. Par exemple l’ICANN s’occupe des .com ou .net, l’AFNIC s’occupe des .fr, EURid s’occupe des .eu, etc. On appelle cela les premiers niveaux de domaines, et il y en a plein (voir cette liste), et chacun a une raison d’être. D’abord les pays (.fr, .de, .uk .wf…), mais aussi les raisons sociales : .com généralement pour le commerce, .orgpour les organisations à but non lucratif, .edupour l’éducation etc. Il n’y a pas toujours d’obligation à respecter cette nomenclature. On peut faire des jeux de mot, par exemple mangetasala.de. J’ai personnellement choisi le .name, assez peu utilisé et pourtant bien réservé aux sites internet personnels (voir ici). J’arrête-là les détails.

La première chose à faire lorsqu’on veut réserver un nom de domaine, c’est de vérifier qu’il n’existe pas déjà (ou alors le racheter, mais c’est une autre histoire). Généralement, les registar commencent par là : une barre de recherche qui vous permet d’entrer le nom de domaine que vous désirez pour savoir si vous pouvez le réserver.

Sachez tout de même que les prix des noms de domaines ne sont pas tous les mêmes, renseignez vous sur les tarifs à l’achat lors de la première réservation et lors du renouvellement. À l’heure où j’écris ces lignes, chez Infomaniak le .fr vaut 5,10 € lors de la première réservation et 7,00 € pour le renouvellement, tandis que le .rich est à plus de 2 500,00 € (normal !).

Une fois que vous vous êtes inscrit·e, et que vous avez payé, vous voici l’heureu·se propriétaire d’un nom de domaine dupont.name. Les registar ont tous un tableau de bord où vous pouvez gérer ce qu’on appelle les enregistrements DNS de votre domaine, c’est-à-dire les « renvois » (pardon pour les spécialistes) de votre domaine vers d’autres adresses. C’est là, par exemple que vous pouvez configurer le fameux MX qui permet de rediriger tous les courriel envoyés vers xxx@dupont.name vers un un serveur de messagerie. De la même manière nous verrons plus loin comment rediriger nuage.dupont.namevers notre Nextcloud hébergé chez Hetzner.

Nous y reviendrons plus tard. Passons à la suite.

Ouvrir son instance Nextcloud

L’entreprise Hetzner (qui fourni aussi des noms de domaine) est une entreprise spécialisée dans la gestion de centre de données. L’entreprise est basée en Bavière, à Gunzenhausen, et ses centres sont, pour l’essentiel, situés à Nuremberg, Falkenstein et Tuusula. Notez qu’elle dépend de la législation allemande (et Européenne) et c’est sous ce régime juridique que sera placé votre serveur.

L’offre qui nous intéresse ici se nomme Storage Share, c’est une mutualisation de serveurs qui permet d’ouvrir et de louer des instances Nextcloud à la demande. Il y a trois tailles, à des prix différents : une petite instance (1 To), une moyenne (5 To), une grosse (10 To).

Notez que l’interface est en anglais (ou en allemand), mais nul besoin d’être bilingue pour procéder. Commencez par vous ouvrir un compte et achetez votre petite instance.

Le Magazine NextInpact avait déjà réalisé en 2022 un test pas à pas pour l’ouverture d’une instance Nextcloud chez Hetzner. Vous pouvez vous y reporter (voici une URL de l’Internet Archive au cas où la page disparaîtrait).

Lors de votre commande, il va falloir être attentif à configurer le login et le mot de passe de l’administrateur (vous !) de l’instance. Notez-les bien.

Vous voilà maintenant l’heureu·se propriétaire d’une instance Nextcloud, généralement nommée NX<numeros>.your-storage-share.de. Copiez-coller cette adresse dans votre navigateur et, avec vos login et mot de passe administrateur, connectez-vous à cette instance. Vous y êtes.

Question d’adresse

L’adresse NX<numeros>.your-storage-share.de est tout sauf sexy, n’est-ce pas ? On va changer cela.

Reconnectez-vous sur le tableau de bord de votre registar de nom de domaine. Entre-temps, choisissez un nom de sous-domaine qui vous plaît. Ici nous allons choisir nuage pour former nuage.dupont.name.

Depuis le tableau de bord, trouvez une fonction qui peut ressembler à « créez un nouvel enregistrement DNS », ou bien, dans la section DNS « Ajoutez un enregistrement », ou quelque chose d’approchant.

Il vous faudra renseigner trois choses.

- Type :

CNAME. C’est le type d’enregistrement dont nous avons besoin : canonical name. Enregistrement de nom canonique : il permet de dire qu’un nom de domaine est un alias pour un autre. En gros, si j’écris ce nom de domaine dans mon navigateur, c’est « comme si » j’allais vers un autre nom. - Source :

nuage.dupont.name. On va choisir ici un sous-domaine (il n’est pas question de dire que tout le domainedupont.nameva être un alias, seulementnuage.) - Valeur :

NX<numeros>.your-storage-share.de. Là c’est l’adresse de votre instance Nextcloud chez Hetzner.

C’est bon ? ok, nous avons donc créé un alias qui renvoie vers une adresse. Mais… si on se contente de cela, lorsqu’on entrera nuage.dupont.name dans la barre d’adresse, on tombera sur NX<numeros>.your-storage-share.de. De même si je veux synchroniser depuis mon mobile, nuage.dupont.name ne suffira pas puisqu’il ne s’agit que d’orienter vers, pas d’opérer sur. Conclusion : il faut aussi dire au serveur de chez Hetzner que notre sous domaine est bien l’adresse de base qui va nous servir pour tous les usages possibles de notre instance Nextcloud.

Retour sur le tableau de bord de votre compte Storage share chez Hetzner. Autrement nommé KonsoleH. Colonne de gauche, cliquez sur subdomains. Et là, tout simplement vous ajoutez l’adresse nuage.dupont.name (qui pointe en CNAME vers votre instance). Pour information, « hinzufügen » signifie « ajouter » en allemand.

Vous avez le droit d’ajouter jusque trois sous-domaine dans ce genre.

Voilà. Maintenant, lorsque vous entrez dans le navigateur l’adresse nuage.dupont.name, vous tomberez sur votre instance et vous pourrez partager des fichiers avec pour racine d’adresse celle qui commence par nuage.dupont.name.

On fait quoi maintenant ?

Déjà, vous pouvez vous servir de l’interface web de votre instance. Si vous n’avez jamais utilisé Nextcloud, les principes ne sont pas si différent des autres interfaces de stockage de fichier. Comme on dit dans ces cas-là : RTFM (le manuel Nextcloud en français).

Je ne vais pas vous laisser comme ça.

En aparté, n’oubliez jamais que Hetzner se charge de trois choses à votre place :

- la gestion de l’infrastructure serveur

- la sauvegarde quotidienne de toute votre instance (vous pouvez récupérer les données de votre instance en les restaurant depuis l’interface Hetzner)

- la mise à jour de votre instance Nextcloud (c’est-à-dire la version du Nextcloud qui est employé), mais pas la mise à jour des logiciels que vous installez sur l’instance depuis le store Nextcloud. Cela, c’est à vous de le faire régulièrement en vous connectant sur le compte d’administration de votre instance. Il faut le faire avec rigueur quand que vous recevez une notification de mise à jour, surtout si vos invités synchronisent des données avec les logiciels en question et que vous ne voulez pas recevoir de plaintes de leur part !

Vous avez noté que vous n’avez pour l’instant qu’un compte administrateur. Tout se passe en haut à droite de l’interface Nextcloud :

- Paramètres personnels : allez-y, remplissez, ajoutez aussi une seconde adresse courriel, on ne sait jamais.

- Paramètres administration : ce qui vous permet d’administrer toute l’instance. Faites un tour, c’est instructif.

- Applications : là vous pourrez ajouter / supprimer des applications de votre instance (il y a tout un catalogue).

- Comptes : la gestion des comptes de vos invités. Personnellement j’ai choisi d’avoir deux comptes : un compte réservé à l’administration et un compte avec lequel j’opère quotidiennement.

À propos de la sécurité, il faut garder en tête :

- Authentification à deux facteurs : il s’agit soit de l’imposer à vos invités soit de les laisser choisir de l’activer ou non. Je préfère l’imposer. Mais , dans ce cas, n’oubliez pas lorsqu’on utilise l’instance pour synchroniser quelque chose, il faudra ouvrir un jeton d’accès spécifique pour que le client qui synchronise puisse se connecter (c’est mentionné à de multiples reprises dans l’interface Nextcloud). Pour le 2FA, sur mon mobile, j’utilise le logiciel AEGIS authenticator.

- Chiffrement côté serveur : vous pouvez choisir de l’activer avec un module de chiffrement. Sachez cependant que cela affecte les performances de votre instance et que si, pour X raisons vous avez besoin de le désactiver, la seule manière est de lancer un script de déchiffrement, avec un risque de perte de données. Personnellement, j’ai fait le choix de ne pas l’activer, rassurez-vous, votre instance est déjà bien protégée. Par contre si vous stockez des informations sensibles, à vous de voir…

Synchronisations

Première synchronisation avec votre PC :

- Rendez-vous ici pour télécharger l’application de bureau (client) pour synchroniser. Pour les utilisateurs de Linux, vous pouvez aussi utiliser l’application

nextcloud-desktopsi elle est présente dans votre magasin d’applications. - Personnellement j’aime bien circonscrire ma synchronisation dans un dossier spécifique : je crée un dossier qui ne servira qu’à la synchronisation.

- Pour configurer le client, l’ajout de compte se fait en ajoutant le nom de l’instance, dans notre cas :

https://nuage.dupont.name. Et suivez les instructions.

Première synchronisation avec votre mobile (ou votre tablette) sous Android :

- Téléchargez et installez (depuis le Play Store ou depuis F-Droid) l’application client Nextcloud

- Suivez les instructions similaires aux précédentes.

- Vous pourrez naviguer dans vos fichiers, et les synchroniser au besoin. Pour les Photos, un dossier

/Photosest déjà pré-conçu, vous pourrez choisir d’uploader systématiquement vos photos dedans (ou pas).

Applications

Voyez-vous, c’est assez simple. Mais Nextcloud, c’est aussi beaucoup d’autres applications que je vous invite à découvrir depuis le magasin d’applications Nextcloud.

Par défaut (outres les applications de gestion et de maintenance), les applications pré-installées sont les suivantes :

- Fichiers : la principale, celle qui vous servira le plus.

- Photos : les fonctionnalités de galerie, par exemple.

- Contacts et Calendar : vous pourrez synchroniser vos contacts (et même les partager) et vos agendas, par exemple depuis votre client de courrier électronique sur PC comme sur mobile. Voir ici pour Thunderbird et ici pour Android (là encore je vous conseille d’utiliser F-Droid pour installer DavX5).

- Notes : c’est une application permettant de partager et collaborer sur un document avec un traitement de texte basique (il sort du markdown). On y accède directement par exemple avec le client Android en ouvrant un fichier

.txtou.mdavec, on peut le partager, collaborer dessus, etc. Tout à fait fonctionnel pour écrire un document à plusieurs mains.

Prenons maintenant un exemple : partager un livre de recettes de cuisine. Il y a une application Nextcloud pour cela, qui se nomme Cookbook. Depuis l’interface d’administration, allez dans Applications et installez-la. De même depuis votre dispositif Android, installez l’application Nextcloud Cookbook. Et commencer à écrire et partager vos recettes de cuisine.

Vous avez compris le principe ? Ainsi vous avez une foules d’applications fort utiles et dont tous les comptes de l’instance pourront profiter. Mais ce n’est pas tout. Il existe d’autres fonctionnalités fort appréciables de Nextcloud :

- le cloud fédéré : c’est sans doute l’une des plus belles fonctionnalités. Il s’agit de pouvoir fédérer plusieurs instances Nextcloud pour pouvoir partager des dossiers et des fichiers directement dans chaque instance, comme si vous y étiez. C’est un réseaux d’instances. Si votre ami·e Camille dispose de plein de PDF et de vidéos et vous aimeriez pouvoir en profiter sans devoir configurer une adresse de partage sur laquelle il vous faudrait cliquer à chaque fois pour télécharger et remplir votre propre instance ? Fédérez simplement vos instances : ce que Camille stocke, il n’est peut-être nul besoin de le télécharger et de le stocker à son tour, allez le chercher directement dans le sac de Camille.

- Certains logiciels proposent une synchronisation directement faite pour Nextcloud : c’est le cas de logiciels comme Calibre (gestion de livres numérique) et Joplin (gestionnaire de connaissances et prises de notes). Synchroniser de cette manière vous permet de ne pas seulement disposer des fichiers, mais de les utiliser directement avec les différentes versions de ces logiciels sur différents supports (liseuse, mobile, tablette, PC). Ce n’est pas une fonctionnalité propre à Nextcloud,(ces mêmes logiciels proposent de synchroniser avec Gdrive comme bien d’autres), mais il fallait le signaler : Nextcloud a atteint depuis longtemps un degré de maturité tel qu’il est difficile d’imaginer le stockage distant autrement qu’en le comptant comme un service des plus courants.

Outre les logiciels installés par défaut, les logiciels figurant dans le top à installer sont(selon moi) les suivants :

- News (pour récupérer et synchroniser ses flux RSS sur mobile ou PC)

- Talk : pour la visio-conférence en petit comité

- Tasks : pour synchroniser ses tâches (mobile ou PC)

- Cookbook : partager ses recettes de cuisine

- GPXPod : partager ses traces GPS

- Phonetrack : suivre des positions GPS

- Forms: réaliser des petits questionnaires ou formulaires

- Polls: réaliser des sondages (notamment pour choisir des dates)

- Carnet: écrire et synchroniser de petites notes (mobile ou PC)

Conclusion

L’avantage d’avoir une instance complète Nextcloud est qu’on peut y intégrer les applications qu’on souhaite et faire ce qu’on veut avec. On peut considérer une telle instance comme une forme d’auto-hébergement : vous choisissez où sont stockés vos fichiers, vous gérer les accès et les comptes, vous gérez les applications disponibles. En revanche, vous déléguez au fournisseur la responsabilité de la maintenance de l’instance et la sécurité des données.

Pour un usage purement individuel, le compte n’y sera pas. Mieux vaut aller chez un des Chatons où vous pourrez bénéficier de multiples autres services pour moins cher, y compris en participant à une chaîne de solidarité et de confiance. Et si les membres de votre (petite) famille n’ont besoin que de quelques Go pour leurs fichiers, autant leur ouvrir des comptes individuels sur le même mode.

En revanche si vous avec besoin de plus d’espace, si vous utilisez un nom de domaine, si certaines applications vous manquent, et si vous désirez gérer une instance de A à Z, ce « semi » auto-hébergement vous contentera largement, pour votre famille ou un groupe plus large. Moins cher (en général) qu’un serveur dédié, cela demande aussi beaucoup moins d’efforts et de disponibilité. Les instances plus grosses chez Hetzner sauront, elles, contenter des plus grosses associations ou collectifs.

Il y a tout de même quelques inconvénients. Le premier d’entre eux est que vous ne pourrez pas disposer sur le même mode clés en main (à l’heure où j’écris ces lignes) d’une suite bureautique complète comme OnlyOffice ou Collabora. Les raisons sont expliquées ici. Pour faire tourner ces suites bureautiques en ligne sur une instance Nextcloud Storage Share, il vous faut un autre serveur vers lequel déporter les ressources nécessaires. Ce n’est donc pas impossible, et c’est peut-être même mieux de déporter ainsi l’usage des ressources.

Cela étant dit, ce n’est pas vraiment avec votre famille que vous aurez besoin de collaborer comme si vous étiez dans un milieu professionnel à vous échanger des diaporamas et des tableaux. Pour une petite asso, si le besoin consiste à écrire un document à plusieurs mains, le logiciel Notes fourni par défaut est amplement suffisant.

Pour terminer, un mot de vos responsabilités. Administrer une instance Nextcloud, c’est avoir un grand pouvoir (décider qui peut y accéder et sous quelles conditions), mais c’est aussi de grandes responsabilités. Que vous restiez dans un cadre familial ou que vous décidiez d’élargir votre « offre », sachez que c’est à vous revient la responsabilité de la sécurité des données. Si Hetzner à failli à ses propres responsabilités, il vous faudra le prouver. Si c’est un de vos utilisateurs, il faudra le prouver aussi. Quant à vous : ne vous engagez que ce pour quoi vous êtes capable de vous engager et déconseillez formellement de stocker quoi que ce soit de sensible. Enfin, conformez-vous au RGPD. Si vous agissez sous le mandat d’une association, que cela soit écrit quelque part, par exemple.

En somme, une telle instance clés en main vous permet de vous détacher des contraintes techniques tout en vous concentrant sur l’essentiel : quels sont les usages dont vous avez besoin et quelles sont les responsabilités (morales, juridiques, éthiques) associées.

-

En fait, on ne dit plus « GAFAM ». Des termes comme MAMAA (Microsoft, Apple, Meta, Amazon, Alphabet) ont émergé, surtout avec le changement de nom de Facebook en Meta et les diverses acquisitions ou évolutions dans les géants technologiques. Mais certains préfèrent aussi des termes plus généraux comme Big Tech… ↩︎

Publié le 12.10.2025 à 02:00

Technoféodalisme : l'analogie à contretemps

Face à ce qui est perçu comme une « grande régression » par rapport aux promesses émancipatrices de l’ère numérique, certains auteurs ont mobilisé des concepts historiques, dont le technoféodalisme, afin de fournir une clé de lecture pour les nouvelles formes d’inégalités. Ce terme fait écho à l’idée plus ancienne de féodalisme industriel utilisée par le syndicalisme du XIXe siècle.

L’hypothèse du technoféodalisme postule que le capitalisme a muté, délaissant la logique classique de l’investissement productif pour renouer avec une logique de rente et de prédation. Cependant, l’utilisation d’une analogie aussi forte et anachronique pour décrire les mutations structurelles du XXIe siècle soulève des questions méthodologiques et historiques.

Je propose ici d’étudier la portée et les limites du concept de féodalisme appliqué à l’analyse de l’économie numérique. Je commencerai par examiner le cadrage historique du féodalisme, en soulignant la légitimité de l’ordre social médiéval. Je détaillerai ensuite la manière dont certains auteurs transposent ce modèle à l’économie numérique en le réduisant à de l’extorsion rentière. Enfin, j’évaluerai la pertinence de cette analogie en confrontant ses faiblesses méthodologiques et historiques aux thèses qui privilégient la plasticité du capitalisme et la crise de la valeur comme vecteurs d’une explication plus pertinente.

L’emploi du « féodalisme »

Le féodalisme conçu en tant que mode de production a fait couler beaucoup d’encre, en particulier chez les lecteurs de Marx. Ce dernier décrit le féodalisme comme une étape charnière entre l’Antiquité et les temps modernes dans le processus d’émergence du capitalisme. Marx n’a jamais cherché à définir les structures internes et les institutions médiévales, il conçoit le féodalisme comme un ensemble de rapports préexistants au capitalisme dans un processus historique évolutif. Cela est très bien décrit par Ludolf Kuchenbuch dans « Marx et le féodalisme. Sur le développement du concept de féodalisme dans l’œuvre de Karl Marx »1. Ces rapports sont les suivants pour l’essentiel :

- domination et dépendance : les rapports entre seigneurs et paysans instaurent des formes de formes de dépendance personnelle qui préfigurent les rapports de classe du capitalisme. Dans le capitalisme, ces rapports deviennent des rapports impersonnels de marché, mais la logique de domination reste centrale.

- production par la rente foncière : dans le capitalisme, c’est la plus-value qui remplace la rente, mais le rapport est essentiellement un rapport d’extraction et de la terre et du travail humain.

- propriété privée : c’est le déclin du féodalisme qui favorise l’émergence de la propriété privée des moyens de production (fin des communs médiévaux)

- le féodalisme a favorisé l’émergence des techniques agricoles et artisanales qui sont devenues les conditions matérielles de l’émergence du capitalisme.

Du point de vue de Marx, le capitalisme n’a donc plus rien de féodal. Les rapports de domination sont certes mobilisés sous une logique de classe et perdurent mais ils se dévoilent sous d’autres modalités, par exemple la marchandisation du travail, le profit et l’accumulation, et des modes très différents de contractualisation.

Néanmoins, la révolution industrielle a amené son lot de nouvelles institutions (l’entreprise, par exemple) et a créé de nouveaux rapports sociaux sous l’égide de l’organisation du travail. La fin XIXe siècle voit émerger dans les discours syndicalistes une manière de concevoir le rapport entre ouvriers et patronat en utilisant très souvent le concept de féodalisme. Ainsi on oppose la démocratie sociale à une conception hiérarchique et autoritaire de la société.

Aux origines de la social-démocratie, notamment en Allemagne, de la Deutsche Volksverein à Ligue des communistes de Marx et Engels, et encore plus tard dans une grande majorité de partis socialistes et de syndicats en Europe, l’idée de l’existence d’un féodalisme industriel fait florès. On y oppose notamment le féodalisme terrien du monde paysan par le fait que dans le féodalisme industriel l’ouvrier perd son « caractère ». Par exemple, le Livret d’ouvrier, instauré par Napoléon, est à la fois conçu comme outil de contrôle social (il est censé être présenté lorsque l’ouvrier se déplace) et comme outil de coercition aux mains du patronat (le patron confisque le livret pour la durée de l’emploi de l’ouvrier, l’empêchant ainsi de partir). Ce livret est l’un des symboles d’un retour à l’ère médiévale où le serf n’est pas libre de ses mouvements. Pendant un siècle d’existence de ce livret d’ouvrier, parler de féodalisme industriel n’est pas une simple métaphore, il s’agit des nombreux devoirs et interdits (dont l’interdiction de coalitions, de syndicats ou de caisses) que l’ouvrier vit littéralement dans sa chair, pour lui et sa famille, à l’image des serfs.

En revanche, comme le montre Marx (mais on verra plus loin que les analyses marxistes n’en sont pas restées là), l’économie ne peut pas utiliser un terme aussi anachronique pour décrire l’organisation du capitalisme industriel. Le faire reviendrait à ne pas comprendre les dynamiques du capitalisme. Le monde féodal est, selon Marx, un moment dans l’évolution vers le capitalisme dont il faut penser dorénavant les tensions en termes de lutte entre la bourgeoisie et le prolétariat et non plus en termes de soumission et d’autorité seigneuriale. Ainsi, parler de féodalisme, c’est insister exclusivement sur les rapports de domination, c’est-à-dire un des symptômes sociaux des inégalités, tout en s’éloignant de la compréhension du système capitaliste lui-même : être soumis à l’image d’un serf, c’est ne pas avoir conscience de son appartenance prolétarienne, c’est rester dans un rapport individuel à la domination patronale.

Pour autant, la littérature de gauche depuis le XIXe reste très attachée à cette idée que la domination du grand patronat nous renvoie à des pratiques médiévales, le monde médiéval étant la plupart du temps considéré comme emprunt de violence et de ténèbres. En retour, comme le montre William Blanc dans son article « Le grand patronat, de ‘nouveaux seigneurs !' » (2023), il « faut avoir à l’esprit que des membres de la bourgeoisie eux-mêmes cultivent cette image de nouveaux seigneurs ». C’est cette fois vers l’imaginaire médiéval qu’il faut se tourner, vers l’idée que la bourgeoisie capitaliste a hérité des devoirs de la chevalerie et de la belle noblesse en apportant la prospérité. Le mythe entrepreneurial s’accompagne aussi de châteaux romantiques à la Disney Land, tâchant de faire oublier les affres du capitalisme industriel2.

Les structures médiévales

Il est très difficile de voir dans le monde médiéval l’existence d’une « classe laborieuse » telle qu’elle pourrait s’apparenter à celle du monde ouvrier contemporain. En premier lieu parce que la notion même de « travail » est fortement discutable au Moyen-Âge étant donné qu’il nous faut penser les relations sociales sur des modes très différents d’aujourd’hui. Quitte à parler d’imaginaire médiéval, une question est de savoir comment le monde médiéval s’est pensé lui-même.

Dans Les Trois ordres ou l’imaginaire du féodalisme (1978), Georges Duby a apporté une réponse tout à fait convaincante, tout en bouleversant radicalement les études sur le monde médiéval. Il ne se livre pas à une description sociale ou institutionnelle mais il se penche sur la manière dont le monde médiéval commence à construire un imaginaire qui justifie le féodalisme au tournant du Xe siècle. Il montre comment sont pensés et s’articulent les trois ordres médiévaux : ceux qui prient, ceux qui combattent, ceux qui travaillent. Il y a une hiérarchie sociale : chacun reste dans son ordre et les ordres sont interdépendants, une interdépendance fondée sur le devoir, les normes, et la solidarité. Ainsi le féodalisme est pour Duby une vision de la société, un outil idéologique pensé par les élites mais aussi vécu comme tel par les plus basses couches sociales, si bien que le schéma non seulement s’affirme mais se consolide au fil du temps. Le serf médiéval vit un monde qui est conçu « ainsi ».

Depuis G. Duby, bien des historiens se sont penchés sur les institutions médiévales et non plus seulement sur l’imaginaire qui y préside. Pour faire court, en reprenant Alain Guerreau (1999), on peut retenir trois piliers (quoi que penser le monde médiéval en termes de triptyque peut toujours être soumis à caution) : l’Église (Ecclesia), la seigneurie / la propriété (Dominium) et la Charité (Caritas). Cela défini assez rondement les interactions entre les plans spirituels, économiques et sociaux3. L’acteur économique principal, c’est l’Église : elle concentre les terres, structure l’économie rurale (dîme, rente foncière), et la redistribution des richesses (par la charité). Le pouvoir seigneurial est d’abord une affaire de territoire : c’est la propriété en tant qu’elle est utile (le serf exploite la terre qui ne lui appartient pas). C’est un pouvoir de prélèvement fiscal (les taxes) et c’est un garant de justice. La charité, elle, est à la fois symbolique (elle renforce le prestige de l’âme charitable), et un instrument de légitimation de la richesse : l’hôpital, l’aide aux pauvres, l’idée de non accumulation.

Plus récemment, les historiens adoptent une posture plus nuancée. D’abord par le fait que l’histoire médiévale est une mosaïque. On peut reprendre Florian Mazel dans son chapitre « Une société féodale ? Xe-XIe siècle » (2021)4 qui nous dit :

Les relations féodo-vassaliques constituent avant tout un moyen de renforcer les chaînes de dépendance, de stabiliser la transmission des patrimoines aristocratiques et de réguler la violence, et seulement à la marge un instrument de redistribution de droits seigneuriaux. À rebours de l’usage dépréciatif qui est fait de ce terme aujourd’hui, la féodalité représente donc un ensemble de liens sociaux et politiques plus intégrateurs que dissolvants ou destructeurs.

Mais il précise d’emblée que cela ne fait pas autant des royaumes des communautés politiques homogènes partageant les mêmes normes et valeurs. L’unification du royaume d’Angleterre sous les Wessex est certes un exemple, mais dans les mondes francs, germaniques et italiens, les aristocraties sont « solidement amarrées au cadre des principautés et jamais les souverains ne parviennent à rassembler autour d’eux, même pour de ponctuels rituels politiques, la totalité de leur haute aristocratie ecclésiastique et laïque ».

Ainsi, toujours selon F. Mazel, si on veut penser le monde médiéval comme un tout homogène, cette homogénéisation

« ne viendra qu’aux XIIe-XIIIe siècles, à travers la généralisation de coutumes ou d’un droit féodal mais aussi d’un imaginaire (celui des chansons de geste et des romans courtois) à peu près commun à toute la Chrétienté latine ».

Mais…

Si l’expression [de société féodale] renvoie à une société où les pouvoirs sont fortement segmentés et où la fidélité structure les relations entre les grands – des rois aux chevaliers en passant par les évêques et les abbés –, tout en s’articulant, à l’échelle locale, à la seigneurie partagée entre clercs et laïcs et à la possession de châteaux et d’églises polarisant l’espace et les rapports sociaux, alors elle conserve toute sa valeur.

Quelles que soient les manières de penser ces articulations, ces concepts sont bien entendu assez délicats à manier sur une période aussi longue, du Ve au XVe siècle. Néanmoins, on peut dire sans trop de risque que le monde médiéval européen s’est construit petit à petit autour d’un ordre social qui, s’il ne s’est pas montré parfaitement homogène, obéissait à un certain modèle répandu en Europe et à partir duquel de multiples variations sont observables. La leçon a en tirer, et qui a toute son importance ici, c’est que la société féodale est d’abord et avant tout une société qui recherche des liens de stabilité, certes relatifs, mais dont l’objectif n’est certainement pas une domination destructrice.

Ce monde a commencé à se métamorphoser aux Temps Modernes, notamment (mais pas uniquement) par une nouvelle donne économique, cette fois marchande, là où certains y voient les prémisses du capitalisme (et d’autres non, du moins pas sous cette approche).

Qu’arrive-t-il après le Moyen-Âge ? La modernité reste attachée au pouvoir seigneurial dans le monde rural (redevances et justice), la hiérarchie est encore sous les trois ordres (clergé, noblesse, paysannerie/tiers état), et la monarchie s’appuie toujours sur la noblesse (et ses privilèges) pour gouverner. Mais… Le pouvoir royal est renforcé au détriment des seigneurs féodaux (les institutions deviennent nationales), le servage disparaît peu à peu et la société s’urbanise parallèlement à une hausse de la demande de productivité rurale (que les seigneuries n’arrivent pas à combler, empêtrés dans leurs anciens modèles), la bourgeoisie et les marchands deviennent les pivots de l’économie. Cette dernière n’est plus basée sur les dynamiques médiévales, mais sur le commerce, l’artisanat, les banques.

Comparer ce qui est comparable

Parler de féodalisme aujourd’hui est l’apanage des critiques du néolibéralisme. On y voit en effet, un « retour au féodalisme » dans l’expression sociale des inégalités et dans les pratiques néolibérales à l’encontre du droit du travail. En revanche, dans la surexploitation de la force de travail proche d’une forme d’esclavagisme, en particulier dans les pays du Sud, c’est plutôt le terme de (néo)colonialisme qui est utilisé, là aussi en rappel d’une époque qu’on croyait révolue, mais moins lointaine que le Moyen-Âge. Dans les deux cas, on se réfère aux temps anciens pour décrire ce qui est perçu comme une régression. Elle s’oppose au discours du progrès que le néolibéralisme brandi le plus souvent pour justifier un économie basée sur des pratiques d’extraction de ressources, humaines ou environnementales, qui causent des injustices. Dans ce registre, le concept de néo-féodalisme est souvent rencontré : une manière de tordre le féodalisme pour qu’il puisse être adapté comme clé de lecture au monde contemporain. Celui de technoféodalisme, plus récent, s’attache à la question de la concentration des technologies à la source d’un pouvoir économico-politique des big tech et des injustices auxquelles font face les individus.

Concernant ce féodalisme, de deux choses l’une.

- Il existe un autre imaginaire médiéval pour qui le monde médiéval est un âge obscur. Cette représentation est celle qui a eu cours de la Renaissance au XIXe siècle, et fut perpétuée par les auteurs en quête de roman national ou tout simplement dans la littérature, des romans d’aventure aux plus fantastiques. Ce Moyen-âge-là est inventé. Et il a souvent servi une cause, celle du progrès industriel et culturel au nom de quoi on pouvait effectivement justifier beaucoup de paradoxes sur les inégalités des richesses : on ne retourne pas à l’âge de la bougie.

- Ou bien il y a, dans les pratiques du capitalisme aujourd’hui, des éléments qui appartiennent réellement au féodalisme. Dans ce cas, le féodalisme est conçu comme un moment préparatoire au capitalisme, à la manière dont Marx le pensait, mais sans que les pratiques aient réellement rompu avec le féodalisme. On part du principe d’une histoire qui serait linéaire, filiale, et dans ce cas, bien que les historiens aient depuis longtemps abandonné cette idée, et malgré cinq siècles de bouleversement mondiaux, il y aurait des pratiques féodales aujourd’hui. Il faut donc décrire lesquelles et les relier solidement au Moyen-âge.

Dans son livre Technoféodalisme. Critique de l’économie numérique5, Cédric Durand émet le concept de technoféodalisme d’abord, souligne-t-il, comme une hypothèse. Il a raison. On peut formuler des hypothèses de lecture de l’histoire pour comprendre le monde contemporain avec des clés qui permettent de soulever des problématiques. Cependant, en histoire, l’anachronisme ne pardonne pas.

Dans l’hypothèse de C. Durand, il y a un double questionnement : d’abord, se demander si, dans les rapports sociaux médiévaux, certains ne pourraient pas être considérés comme des pratiques d’extorsion et ensuite se demander si ces pratiques sont transposables à celles des big tech d’aujourd’hui. Cela suppose d’admettre préalablement que les pratiques des big tech sont effectivement toutes à catégoriser comme de l’extorsion.

Il se réfère pour cela essentiellement aux travaux de Robert Brenner. À partir de cet instant, tout historien devrait avoir les antennes en alerte. Si je vous dis « Brenner debate »6 et « historiographie marxiste du féodalisme » (voir ce numéro récent de la revue électronique du CRH), toute analyse sur les origines médiévales du capitalisme doivent être soumises à l’examen attentif de la méthodologie employée. Attention : je ne dis pas que c’est une mauvaise manière d’envisager l’histoire, je dis simplement qu’à l’heure actuelle où l’histoire est le plus souvent dévoyée, en particulier par les idéologies fascisantes (voir Les historiens de garde7), il faut rester attentif à ne pas sombrer dans les mêmes travers, même pour la bonne cause. Or, donc, C. Durand utilise les thèses de R. Brenner, fort bien, mais ne précise pas : a) que ces analyses sont assez datées ; b) qu’elles s’inscrivent dans une certaine tradition historique et dans des débats d’ordre historiographiques et en partie idéologiques ; c) qu’elles s’adressent surtout au monde agricole en Angleterre au XVe et XVIe siècle qui possédait des dynamiques telles que R. Brenner y voit les origines du capitalisme et d) que cette approche pourrait très bien être elle-même victime d’une manière d’envisager l’histoire des rapports sociaux sur l’opposition réductrice entre riches et pauvres, entre possédants et possédés, entre concentration des richesses et pauvreté structurelle, ce qui a poussé de nombreuses criques du néolibéralisme, surtout à partir de la crise de 2008, à utiliser à tout-va le terme de néo-féodalisme. Sur ce dernier point les recherches récentes en histoire médiévale, comme on l’a vu plus haut, sont loin d’accréditer une telle vision de la société féodale.

Revenons à R. Brenner. La thèse de R. Brenner, bien qu’elle soit beaucoup plus fine que cela, attribue la stagnation économique de la fin du Moyen-Age à la structure des rapports de classe en Angleterre. Au contraire des approches des historiens plus classiques, qui voyaient dans l’avènement des temps modernes un essor de la commercialisation, R. Brenner s’interroge sur les données démographiques qui montrent non pas une croissance économique qui proviendrait des investissements productifs, mais au contraire un déclin de la productivité agricole. Face à ce déclin productif, selon R. Brenner (et son analyse est tout à fait convaincante) les seigneurs préfèrent intensifier la pression sur les paysans plutôt que de réorganiser la production, c’est-à-dire préfèrent accentuer des dynamiques de coercition et d’extorsion. Alors que pour des historiens comme E. Leroy-Ladurie il faut rechercher en partie les raisons des distorsions de croissance dans les faits biologiques (démographie) ou climatiques, R. Brenner insiste sur le rôle prépondérant d’une dynamique de classes sociales. Il s’oppose de même à d’autres historiens marxistes qui voyaient dans l’essor de l’économie marchande (qui se mondialise) de la fin du Moyen-Âge les prémisses du capitalisme d’accumulation bourgeoise.

Mon propos n’est pas de dire ici qui aurait tort ou raison. Mon choix personnel est toujours de privilégier les faisceaux d’interprétation pour se rapprocher au plus près du réel : je penche donc pour une tentative de synthèse et me méfie des tentatives unilatérales. Or, c’est en une.

Admettons pour un instant que la thèse de R. Brenner soit l’unique manière d’envisager les rapports socio-économiques de la fin du Moyen-Âge (ce qui est faux). Personnellement je ne me risquerais pas pour autant à en conclure une transposition possible avec le comportement des multinationales du numérique aujourd’hui. C’est ce que fait pourtant C. Durand.

Rappelons que le féodalisme est un concept plastique. Il ne concerne pas uniquement la fin du Moyen-Âge mais, près de dix siècles de travail du même modèle de stabilité sociale. Dire qu’il n’existerait qu’un féodalisme au fil des siècles et qu’il serait fondé sur les dynamiques que décrivait R. Brenner (ce que R. Brenner n’a jamais prétendu au demeurant) est tout simplement faux. La meilleure preuve, c’est que ce dont nous parlons avec R. Brenner et que C. Durand explique très bien dans son livre, c’est d’un moment précis de l’histoire, celui où, dans un espace géographique donné (on ne peut pas l’étendre à l’économie italienne du XVe siècle, par exemple), on peut expliquer une stagnation économique et une croissance des inégalités sociales par une sorte de rigidité des logiques d’extorsion d’une classe sociale sur une autre.

Que prétend C. Durand ? Que le phénomène de prédation s’est imposé. Il souligne notamment que l’extorsion féodale repose sur une violence effective ou potentielle, et non sur un contrat qui pourtant est, selon les interprétations courantes, la marque de l’avènement des temps modernes et de la fin de la servilité féodale. Dans la logique du prélèvement seigneurial, les paysans sont laissés avec juste de quoi survivre, incapables d’investir pour améliorer leur situation. Le Dominium serait donc poussé à l’extrême dans le monde féodal, au détriment des deux autres piliers : le rapport n’est pas contractuel mais fondé presque exclusivement sur une relation de pouvoir maître-esclave (souvenez-vous, dans la section précédente, j’ai rappelé que c’était beaucoup plus compliqué que cela).

C’est ce rapport asymétrique que C. Durand retient pour décrire les relations entretenues entre les Big tech et les citoyens. Il transpose cette logique au capitalisme numérique contemporain. Les multinationales de l’économie sont décrites comme des géants de force, exerçant leur pouvoir pour éliminer la concurrence par rachat ou écrasement, influencer le débat public et les politiques (la domination par la gouvernementalité algorithmique), capturer les gains en concentrant les données et les infrastructures technologiques. Cette domination ne repose donc pas sur le marché, mais sur une forme de pouvoir assimilé au Dominium, où le contrôle sur les ressources (ici, les données et les plateformes) permet une extraction de valeur asymétrique au détriment des citoyens.

Reprenant R. Brenner, C. Durand rappelle que le servage est une relation de pouvoir où les serfs sont contraints à un « échange inégal » qui se traduit par l’extorsion du surplus. Ce surplus était ensuite largement improductif : au lieu d’être investi de manière extensive pour plus de gains de productivité, il était dilapidé en consommations ostentatoires et frais militaires. De la même manière, les big tech n’obéiraient pas à la logique capitaliste classique d’investissement pour améliorer la productivité et baisser les prix (Schumpeter), au contraire, elle échappent à la compétition pour mieux capturer la valeur. Le profit provient de mécanismes de rente par prélèvement sur la masse globale de plus-value (profits de transfert) plutôt que de l’exploitation directe du travail productif. Cela rejoint par certains égards ce que disait Shoshana Zuboff à propos de l’exploitation du surplus comportemental par les big tech.