16.03.2026 à 07:42

Khrys’presso du lundi 16 mars 2026

Khrys

Texte intégral (10080 mots)

Comme chaque lundi, un coup d’œil dans le rétroviseur pour découvrir les informations que vous avez peut-être ratées la semaine dernière.

Tous les liens listés ci-dessous sont a priori accessibles librement. Si ce n’est pas le cas, pensez à activer votre bloqueur de javascript favori ou à passer en “mode lecture” (Firefox) ;-)

Brave New World

- La planète compte 400 milliardaires de plus qu’il y a un an et ils sont de plus en plus riches, selon le magazine Forbes (lemonde.fr)

Elon Musk arrive largement en tête du classement annuel du magazine américain des personnes les plus riches du monde. Ces derniers cumulent un patrimoine record de 20 100 milliards de dollars. La fortune de Donald Trump a augmenté de 27 %.

Voir aussi La fortune de Musk bat des records : pour l’atteindre, il faut multiplier par cinq celle de la famille Arnault (huffingtonpost.fr)

Avec une fortune estimée à 839 milliards de dollars dans le dernier classement de « Forbes », le patron de Tesla et de X dépasse très largement celui du groupe LVMH.

Pour Bernard Arnaud, pour rappel on a ceci.

- When Billionaires Can’t Get Their Money Out : What BlackRock’s $26 Billion Problem Means for You (kapindarsharma.medium.com)

- « 3 428 milliardaires saccagent la planète, et nous avec » (reporterre.net)

- En Australie, des crocodiles s’aventurent en ville à cause des inondations (reporterre.net)

- China approves ‘ethnic unity’ law requiring minorities to learn Mandarin (bbc.com)

- Inde : la fascisation à l’œuvre sous l’impulsion de Modi et du BJP (spectremedia.org)

- Qui est Mojtaba Khamenei, le fils de l’ayatollah Ali Khamenei, choisi comme nouveau guide suprême iranien ? (humanite.fr)

- La Turquie prépare-t-elle un nouveau bain de sang au Rojava ? (kurdistan-au-feminin.fr)

Malgré les pourparlers entre Damas et les autorités kurdes du Rojava, les services de renseignement turcs (MİT) intensifient leurs efforts pour déstabiliser le Rojava.

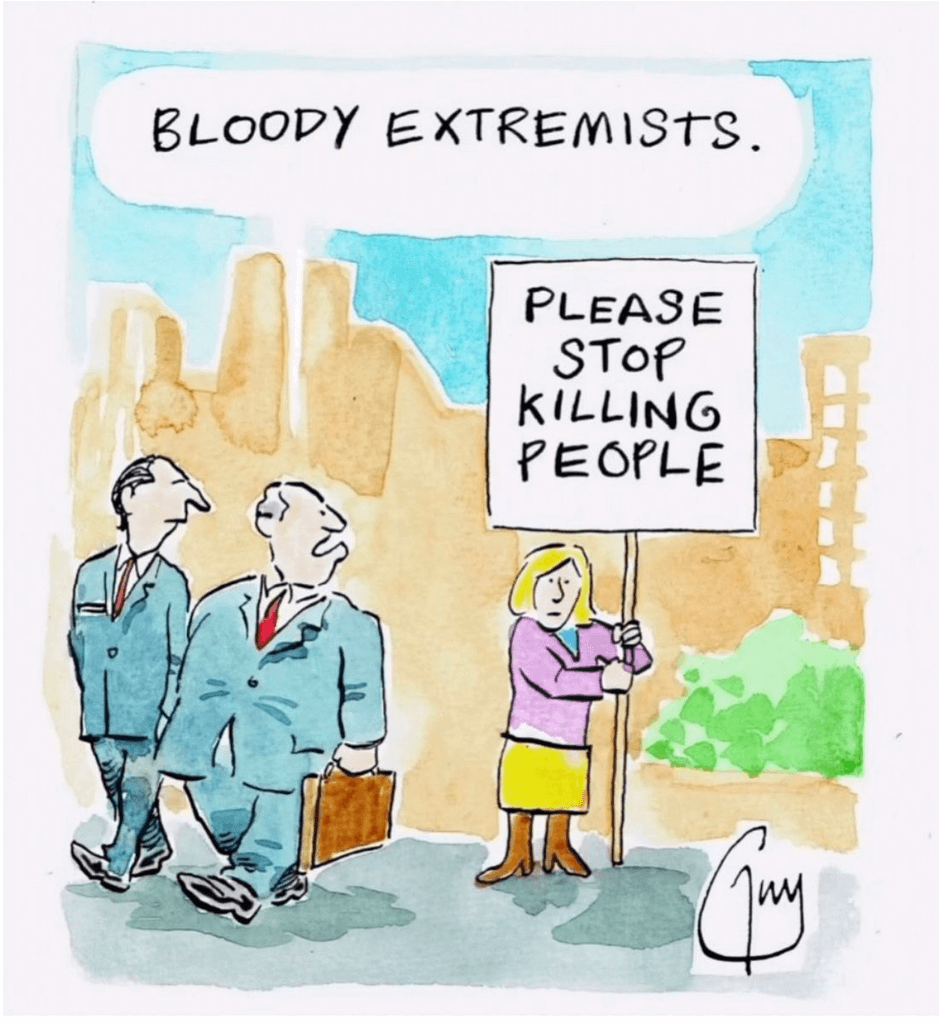

- Allemagne : la stigmatisation de trois librairies de gauche vire à l’affaire d’État (actualitte.com)

De l’autre côté du Rhin, une récompense saluant chaque année le travail des libraires indépendants, dotée par le ministère de la Culture, suscite un intérêt peu commun. La liste des lauréats publiée en février 2026 aurait en effet été expurgée des noms de trois commerces engagés à gauche. La lutte contre « l’extrémisme » aurait motivé l’action du ministère, qui aurait par ailleurs dissimulé son intervention aux gérants des librairies.

- Swiss e-voting pilot can’t count 2,048 ballots after USB keys fail to decrypt them (theregister.com)

- La Belgique ne peut pas se permettre que Microsoft tombe en panne : Un signal d’alarme sur la souveraineté numérique (belibre.be – article de novembre 2025)

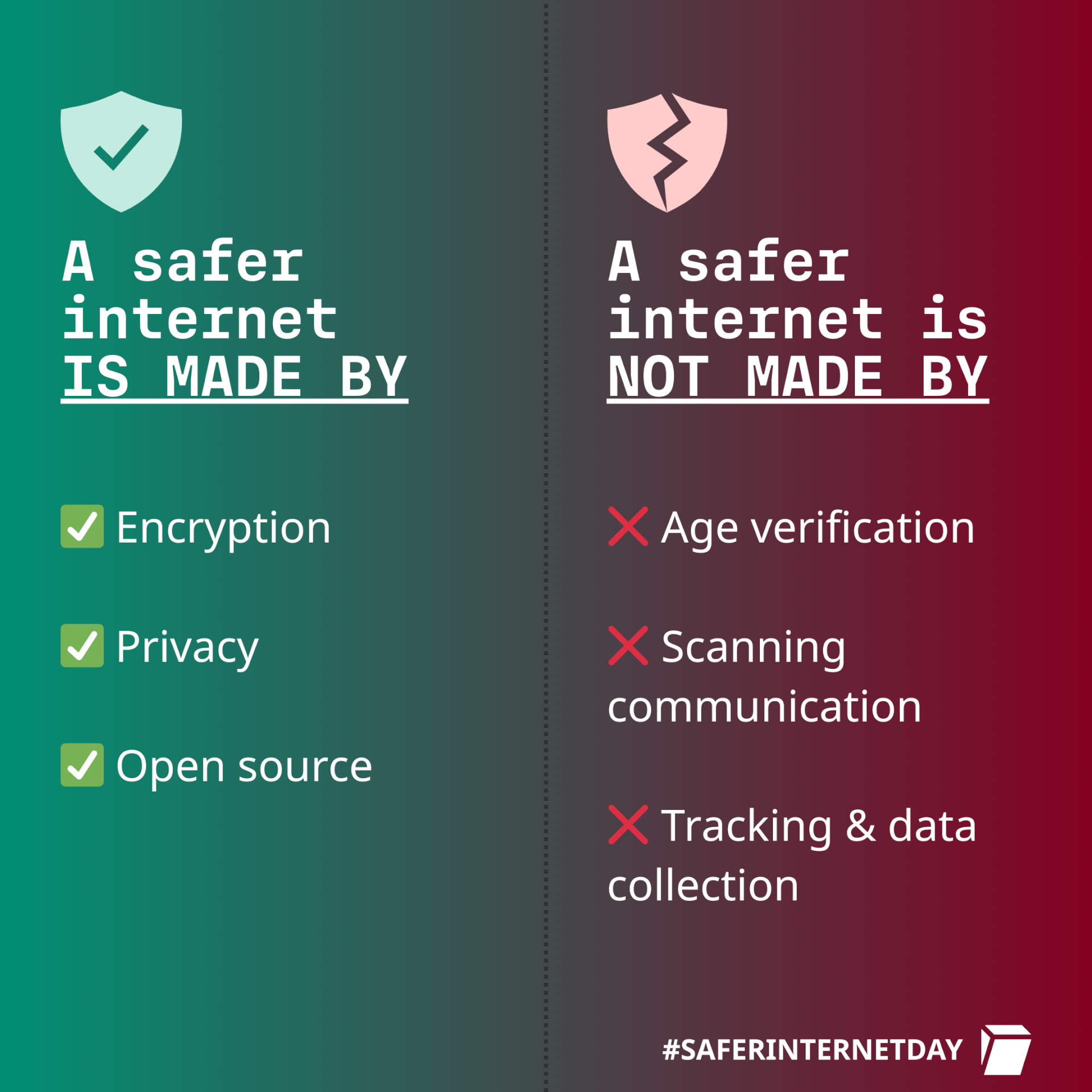

- “Dangereux et socialement inacceptable” : des experts s’opposent au déploiement précipité des contrôles d’âge (clubic.com)

430 chercheurs en sécurité informatique de 32 pays ont publié le 2 mars 2026 une lettre ouverte réclamant un moratoire sur les systèmes de vérification d’âge en ligne. Parmi eux, des chercheurs français d’Inria, de l’École polytechnique et de Télécom Paris.

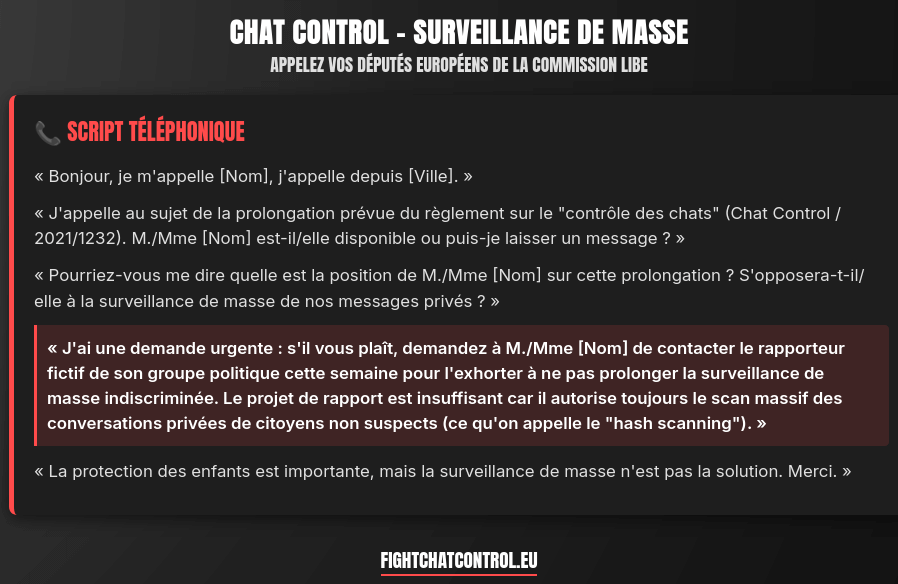

- #ChatControl : les eurodéputé·es mettent fin à la surveillance de masse indiscriminée (next.ink) – voir aussi Historic Chat Control Vote in the EU Parliament : MEPs Vote to End Untargeted Mass Scanning of Private Chats (patrick-breyer.de)

In doing so, the Parliament firmly rejected the error-prone and unconstitutional surveillance practices of recent years. Pressure is now mounting on EU governments to respect the MEPs’ vote and bury untargeted mass surveillance in Europe once and for all.

- Android : l’Europe s’attaque au système secret de Google qui contrôle vos applications et veut une alternative open source (clubic.com)

- Interpellée par le logiciel libre, Bruxelles ajoute un .ods à sa consultation Cybersécurité (next.ink)

Il n’y a pas de petite victoire. La Document Foundation, qui pilote le développement de la suite bureautique libre et gratuite LibreOffice, s’est félicitée mardi 10 mars d’avoir obtenu gain de cause en 24 heures auprès de la Commission européenne.

- Au Portugal, « les discours de haine provoquent une amnésie dans la population » (politis.fr)

Au Portugal, le second tour de l’élection présidentielle a vu l’emporter le candidat socialiste de centre gauche António José Seguro. Toutefois, le parti populiste d’extrême droite Chega a réalisé une percée historique. Daniel Matias, traducteur littéraire et Portugais d’origine, s’inquiète de la stigmatisation des immigrés, qui pourtant font tourner le pays.

- UK startup raises $15M to build Europe’s sovereign alternative to biometric surveillance (biometricupdate.com)

- Les Ig Nobel, prix satirique, quittent les États-Unis pour la Suisse (courrierinternational.com)

- Cette statue de Donald Trump et Jeffrey Epstein installée à Washington recrée une scène culte de « Titanic » (huffingtonpost.fr)

Le groupe « La poignée de main secrète », à l’origine de l’installation, avait déjà mis en place une statue représentant les deux hommes dans la capitale fédérale américaine.

- Revers judiciaire pour Donald Trump, qui échoue à faire vaciller le patron de la Fed Jerome Powell (huffingtonpost.fr)

Un juge fédéral a annulé une démarche judiciaire contre le président de la Fed lancée par l’administration Trump.

- Ubuntu, Fedora, Linux Mint Discuss Age Verification Amid California Law Backlash (9to5linux.com)

The upcoming law mandates that OS providers and application developers implement age verification measures to protect minors online.

- An investigation of the forces behind the age-verification bills (lwn.net)

What started as curiosity about who was pushing these bills turned into documenting a coordinated influence operation that, from a privacy standpoint, is building surveillance infrastructure at the operating system level while the company behind it faces zero new requirements for its own platforms.

- Online Pharmacies Hawk Trans Drugs to Vulnerable Kids Without Requiring Prescription, Watchdog Warns (dailysignal.com)

A medical watchdog is calling on the Food and Drug Administration to investigate companies that allow Americans to purchase sex-rejecting drugs without a prescription, in pursuit of transgender identity.

- US : Près d’un tiers des Républicains de moins de 50 ans déclarent être racistes et un quart antisémites (legrandcontinent.eu)

- StorageReview Sets New Pi Record : 314 Trillion Digits on a Dell PowerEdge R7725 (storagereview.com)

- Why SETI Might Have Been Missing Alien Signals (seti.org) Turbulent plasma near distant stars could blur ultra-narrow signals before they leave their home star systems, making them difficult to detect.

Spécial IA

- ‘AI Is African Intelligence’ : The Workers Who Train AI Are Fighting Back (404media.co)

- Inside the Dirty, Dystopian World of AI Data Centers (theatlantic.com)

- OpenAI robotics leader resigns over concerns about surveillance and autonomous weapons amid Pentagon contract (fortune.com)

- AI CEOs Worry the Government Will Nationalize AI (yro.slashdot.org)

- ChatGPT, Other Chatbots Approved for Official Use in the Senate (nytimes.com)

New guidelines said Senate aides could use A.I. tools for official work, including research, drafting and editing documents, and preparing briefings and talking points for lawmakers.

- Anthropic Sues the Pentagon After Being Labeled a Threat To National Security (yro.slashdot.org) – voir aussi Anthropic sues US over blacklisting ; White House calls firm “radical left, woke” (arstechnica.com)

- Uploading Pirated Books via BitTorrent Qualifies as Fair Use, Meta Argues (torrentfreak.com)

To help train AI models, Meta and other tech companies have downloaded and shared pirated books via BitTorrent from Anna’s Archive and other shadow libraries. In an ongoing lawsuit, Meta now argues that uploading pirated books to strangers via BitTorrent qualifies as fair use. The company also stresses that the data helped establish U.S. global leadership in AI.

- Grammarly pulls AI author-impersonation tool after backlash (bbc.com)

Writing tool Grammarly has disabled an AI feature which mimicked personas of prominent writers, including Stephen King and scientist Carl Sagan, following a backlash from people impersonated.

- États-Unis : la presse tech durement touchée par l’essor des résumés IA de Google (next.ink)

- The Washington Post Is Using Reader Data to Set Subscription Prices. How Does That Work ? (washingtonian.com)

Some subscribers recently received a heads-up that they’re on the hook for a new rate “set by an algorithm using your personal data.”[…]The Post‘s use of algorithmic pricing is not surprising, given the newspaper’s recent fixation on artificial intelligence—consider its AI-powered search engine and robot-led podcast.

- Jack Dorsey’s Block Accused of ‘AI-Washing’ to Excuse Laying Off Nearly Half Its Workforce (it.slashdot.org)

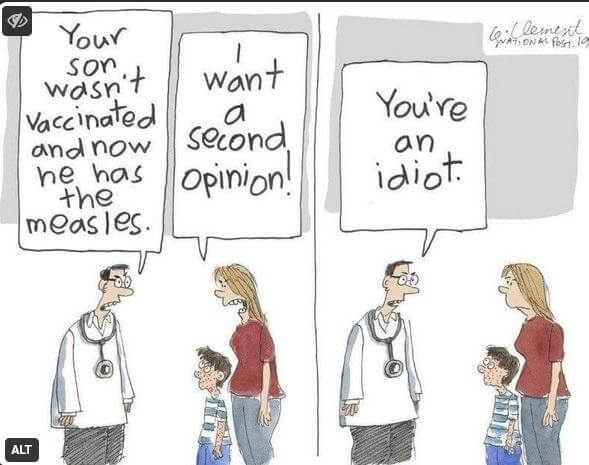

- ChatGPT se trompe à plus de 50 % quand on l’interroge sur des urgences médicales (slate.fr)

- Le plus grand danger de l’IA à l’université n’est pas la triche, c’est l’érosion de l’apprentissage lui‑même (theconversation.com)

en déléguant aux machines les tâches qui formaient étudiants et jeunes chercheurs, les universités risquent d’éroder les conditions mêmes de l’expertise.

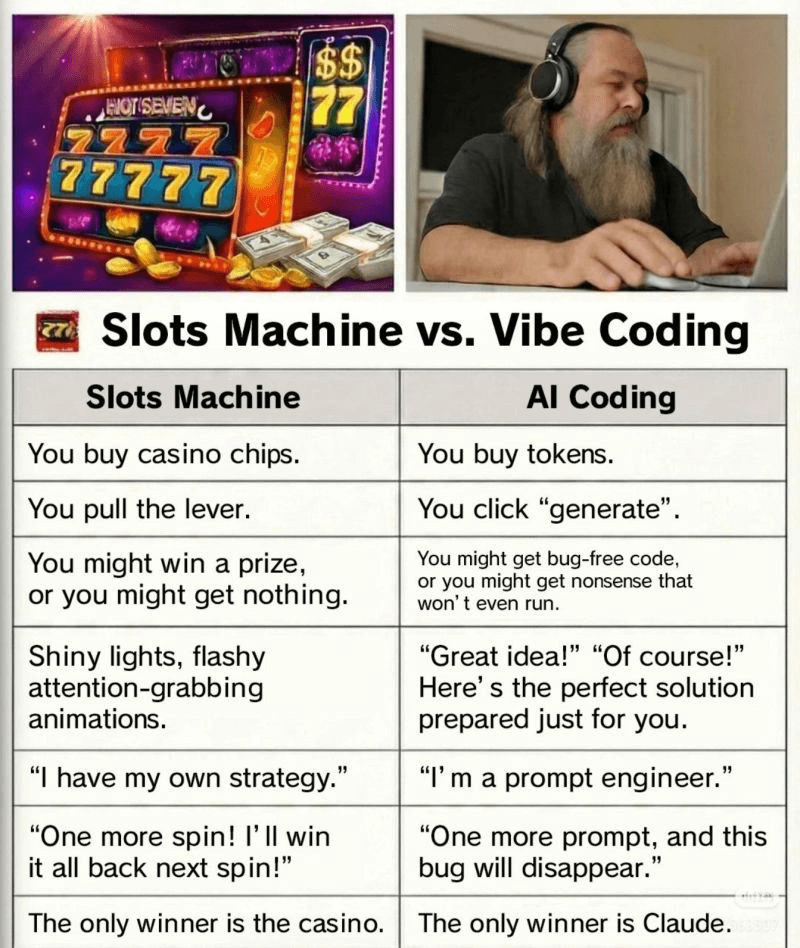

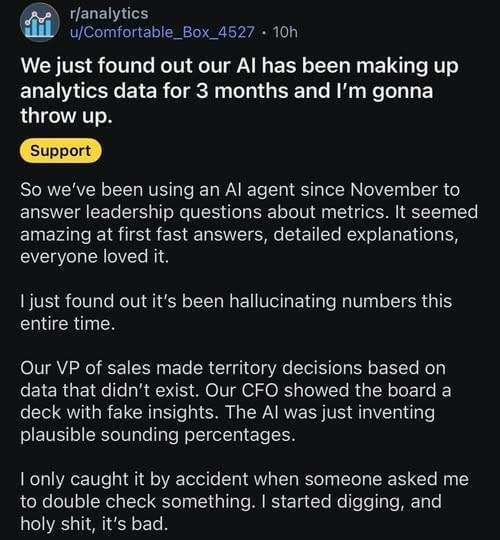

- IA : le modèle économique de ChatGPT repose sur les hallucinations (legrandcontinent.eu)

Afficher des choses fausses n’est pas un défaut de l’IA : c’est l’une de ses caractéristiques structurantes.

- BuzzFeed Nearing Bankruptcy After Disastrous Turn Toward AI (futurism.com)

- Silicon Valley is buzzing about this new idea : AI compute as compensation (businessinsider.com)

- After outages, Amazon to make senior engineers sign off on AI-assisted changes (arstechnica.com)

AWS has suffered at least two incidents linked to the use of AI coding assistants.

- AI can rewrite open source code—but can it rewrite the license, too ? (arstechnica.com)

“There is nothing ‘clean’ about a Large Language Model which has ingested the code it is being asked to reimplement,” Free Software Foundation Executive Director Zoë Kooyman told The Register.

- Debian decides not to decide on AI-generated contributions (lwn.net)

- L’économie du logiciel est-elle morte ? (linuxfr.org)

- MALUS : Liberate Open Source (malus.sh)

Clean Room as a Service. Finally, liberation from open source license obligations. Our proprietary AI robots independently recreate any open source project from scratch. The result ? Legally distinct code with corporate-friendly licensing. No attribution. No copyleft. No problems.

Voir aussi la vidéo de présentation au FOSDEM (fosdem.org)

- L’IA va t-elle rendre la cybersécurité obsolète ? Ou bien la Silicon Valley est-elle encore en train de fantasmer ? (zdnet.fr)

« Si le développeur du code propose l’outil de sécurité du code, n’est-ce pas comme si le renard gardait le poulailler ? »

- Checking an LLM’s work is a systemic, not an individual, problem. (productpicnic.beehiiv.com)

AI is a machine that turns quality assurance into burnout

- Judges Find AI Doesn’t Have Human Intelligence in Two New Court Cases (yro.slashdot.org)

The AI bots are machines, and portraying them as though they’re thinking creatures like artists or attorneys doesn’t change that, and shouldn’t.

- AI autocomplete doesn’t just change how you write. It changes how you think (scientificamerican.com)

AI-powered writing tools are increasingly integrated into our e-mails and phones. Now a new study finds biased AI suggestions can sway users’ beliefs

- Sam Altman Says Intelligence Will Be a Utility, and He’s Just the Man to Collect the Bills (gizmodo.com)

“Intelligence too cheap to meter” doesn’t quite come across the way Altman might intend.

- No, “AI” is not a Stochastic Parrot (medium.com/@margarmitchell)

- The AI Bubble Is An Information War (wheresyoured.at)

Spécial guerre au Moyen-Orient

- Face à la guerre en Iran, la Turquie tente d’éviter toute implication (orientxxi.info)

En bons termes avec l’administration de Donald Trump, mais brouillée avec Tel-Aviv, frontalière d’un Iran avec lequel elle entretient des relations aussi anciennes que complexes, Ankara a toutes les raisons de se sentir concernée par le conflit opposant l’alliance militaire israélo-étatsunienne à la République islamique.

- Pluie noire, fumée toxique… Les scientifiques alertent sur les conséquences des explosions à Téhéran (huffingtonpost.fr)

Alors que quatre dépôts pétroliers ont été frappés à Téhéran, en pleine offensive israélo-américaine, la capitale iranienne s’est retrouvée enveloppée dans un nuage de fumée noire.

Voir aussi Pluie noire à Téhéran : un cocktail chimique cancérigène menace 9 millions d’habitant·es (bonpote.com)

- Al Jazeera reports from Israeli bombing of Beirut apartment block (aljazeera.com)

- Lebanon : Israel Unlawfully Using White Phosphorus (hrw.org)

Human Rights Watch Verifies Use of Incendiary Weapon over Residential Areas in Southern Lebanon

- Israeli strike kills 12 healthcare workers in southern Lebanon (theguardian.com)

The facility was attacked on Friday night, bringing the toll of medical staff to 31 killed in past 12 days

- The Palestinians forced to demolish their own homes by Israel (aljazeera.com)

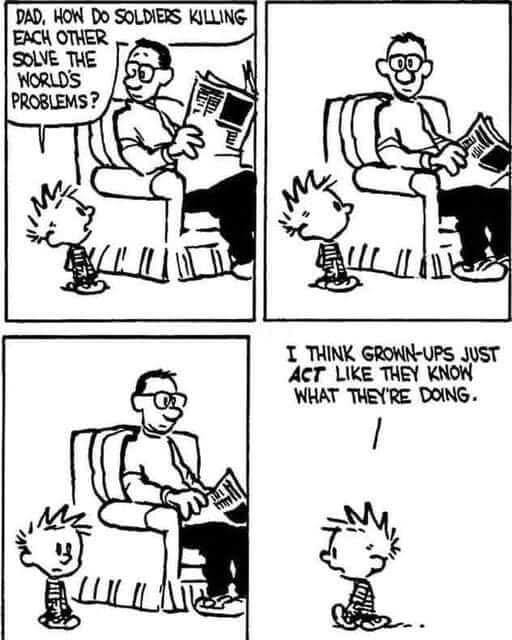

- La mini guerre mondiale pour le nouveau Moyen-Orient (legrandcontinent.eu)

Depuis le début des opérations Epic Fury et Roaring Lion le 28 février 2026, la guerre a changé d’échelle. D’une campagne israélo-américaine contre l’Iran, elle est devenue régionale et s’étend désormais à seize pays.

- US and Israel ‘would be banned from Scotland over illegal war’ (thenational.scot)

THE US and Israel’s attacks on Iran breached international law – so both nations’ militaries would be banned outright from an independent Scotland, John Swinney has said.

- Trump Surprised To Find He’s At War in Iran (doomsdayscenario.co)

Once his not-even-half-baked plan failed to materialize in Iran, it’s clear that there’s no Plan B.

- The Dangerous Mismatch Between American Missiles and Iranian Drones (theatlantic.com)

The United States, Israel, and their Gulf allies are using up scarce and costly munitions at an astounding rate. These losses can’t be replenished nearly quickly enough to avoid possible global repercussions, as far more formidable adversaries than Iran—Russia and China—assess the war-fighting capacity that America holds in reserve. If they conclude that the West has burned through too many interceptors to defend itself, Russia might pursue aggressive action against NATO, or China could move against Taiwan.

- Que risquent les personnes arrêtées pour avoir filmé les attaques iraniennes sur Dubaï ? (slate.fr)

Un sexagénaire britannique pensait simplement immortaliser un moment spectaculaire pendant ses vacances à Dubaï. Mais en filmant une attaque de missiles iraniens, il s’est retrouvé accusé de cybercriminalité et risque désormais la prison.

- Pourquoi la crise énergétique provoquée par la guerre en Iran est différente des chocs pétroliers des années 1970 (legrandcontinent.eu)

- Économie russe : après avoir bondi de 70 % depuis le début de la guerre contre l’Iran, le baril de brut russe se vend à son plus haut niveau depuis deux ans (legrandcontinent.eu)

- Ce que la guerre au Moyen-Orient dit des fragilités de notre système alimentaire (basta.media)

La France importe plus de 80 % de ses engrais, dont les prix s’envolent. La fermeture du détroit d’Ormuz rappelle l’urgence à sortir d’un modèle agricole accro aux énergies fossiles. D’autres voies existent, à rebours des orientations du gouvernement.

- Au Moyen-Orient, l’eau potable ciblée par les protagonistes de la guerre (reporterre.net)

- The Gulf built oil pipelines to avoid Hormuz. It’s now doing the same for data (restofworld.org)

Saudi Arabia, Qatar, and the UAE are financing competing data corridors through Syria, Iraq, and East Africa to bypass the two maritime choke points that threaten their digital connectivity.

- Des pirates pro-iraniens revendiquent une importante cyberattaque d’une entreprise médicale américaine (lemonde.fr)

Les systèmes informatiques de la société Stryker ont été en partie paralysés, et le contenu de certains appareils professionnels de salariés effacés à distance. Le groupe qui a revendiqué l’attaque est soupçonné d’être proche des services iraniens.

- Drone strikes halt a third of the world’s helium supply, threatening chip production (techspot.com)

The global helium market remains on edge as QatarEnergy’s massive Ras Laffan facility – responsible for nearly a third of the world’s supply – remains offline more than a week after Iranian drone strikes halted operations. The prolonged outage has highlighted vulnerabilities in the semiconductor supply chain, drawing renewed attention to the essential yet fragile nature of the helium trade.

- Iran Declares Google and Microsoft to Be Military Targets(futurism.com)

“The Americans should await our countermeasure and our painful response.”

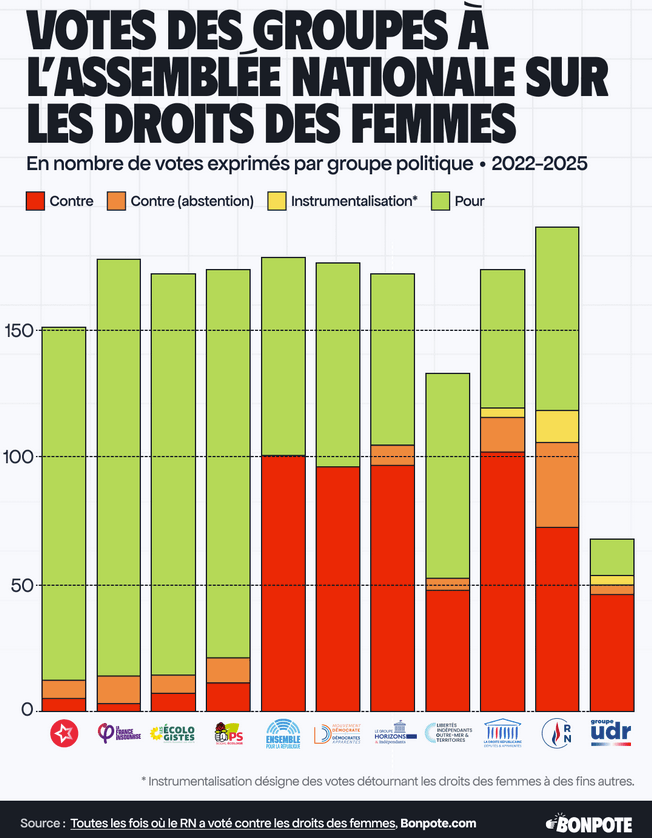

Spécial femmes dans le monde

- À Gaza, Amnesty International alerte sur une crise sanitaire qui frappe les femmes et les filles (huffingtonpost.fr)

Dans un rapport publié après 29 mois de guerre, l’ONG décrit l’effondrement du système de santé dans l’enclave palestinienne et ses conséquences graves pour les femmes.

- Génocide à Gaza : Susan Sarandon blacklistée pour son soutien à la Palestine (humanite.fr)

Après avoir pris position contre le génocide en cours à Gaza, l’actrice Susan Sarandon a été virée par son agent et est désormais boycottée par l’industrie cinématographique aux États-Unis.

- Après leur silence pendant le chant de leur hymne national, cinq footballeuses iraniennes obtiennent l’asile en Australie (huffingtonpost.fr)

Après avoir refusé de chanter l’hymne iranien lors d’un match de la Coupe d’Asie féminine, plusieurs joueuses ont demandé protection en Australie, craignant des représailles à leur retour.

- Inside Kenya’s Femicide Crisis : Government Report Points to Danger at Home (africauncensored.online)

- Percée des idées masculinistes chez les hommes de la génération Z (lesnouvellesnews.fr)

Près d’un quart des hommes de la génération Z pensent que les femmes ne devraient pas être « trop indépendantes ou autosuffisantes », contre 12 % des boomers. Une vaste étude du King’s College, menée dans 29 pays, met en évidence une adhésion croissante aux idées masculinistes chez les jeunes hommes, creusant un fossé générationnel.

- The Fallout from Reporting on White Nationalism in Canada (thetyee.ca)

Journalist Rachel Gilmore published an investigation in The Tyee. The men she unmasked showed up to intimidate her in person.

- La médecin légiste de Jeffrey Epstein n’avait pas conclu au suicide lors de l’autopsie (slate.fr)

Kristin Roman a pratiqué l’examen du corps. Elle avait initialement refusé de trancher entre suicide et homicide, avant que la ville de New York ne classe l’affaire.

Voir aussi Jeffrey Epstein Prison Guard Googled Him Minutes Before Death And Made $5K Cash Deposit Days Earlier, DOJ Records Show (radaronline.com) et Why Epstein’s Prison Guard Is Now Under Scrutiny For His Death (forbes.com)

- Chili : les craintes des femmes et des sans-papiers face à l’arrivée de José Antonio Kast au pouvoir (rfi.fr)

L’ultra-conservateur, dont l’investiture est prévue ce mercredi 11 mars, est opposé à la pilule contraceptive ou encore à l’avortement. Au Chili, l’interruption volontaire de grossesse (IVG) n’est possible que dans trois cas : s’il y a une malformation du fœtus, si la vie de la femme est en danger, ou en cas de viol.

- The one thing everyone gets wrong about feminism (theguardian.com)

A 2025 study notes that in the US, “during the highly gender-specialised era of the 1960s, married women did seven times more housework and four times more childcare than their husbands”. Now, the study says, women do twice as much housework and childcare, which is both far from equal and far from what it was.

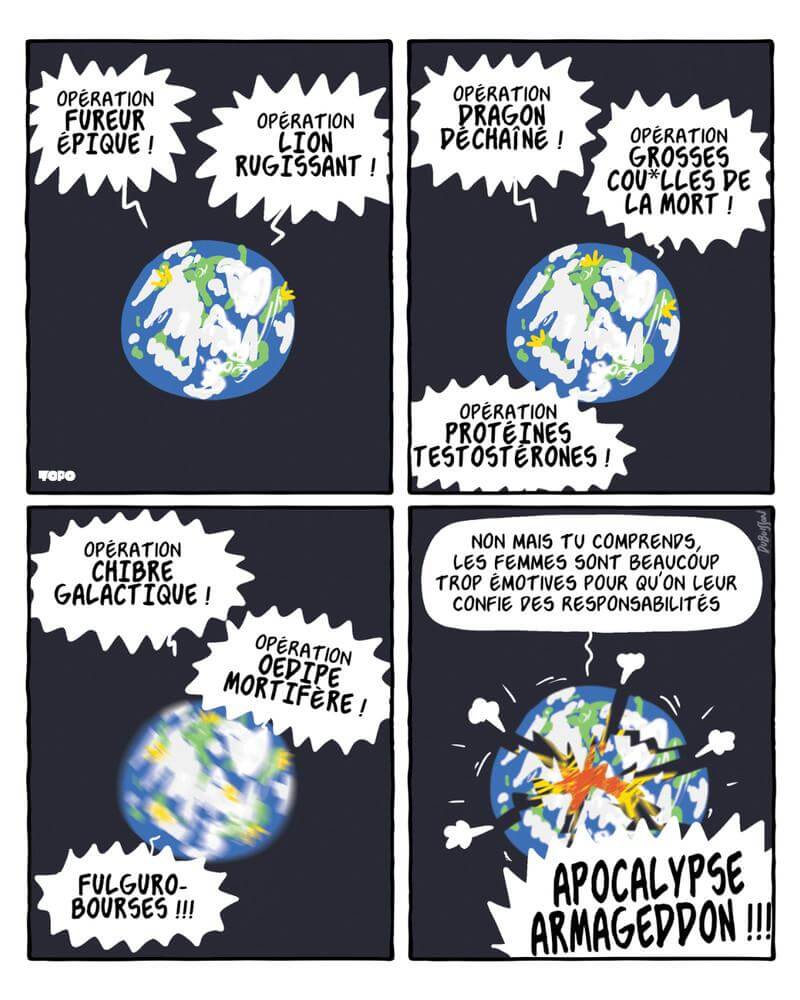

- Palantir CEO Makes Shocking Confession on Disrupting Democratic Power (newrepublic.com)

Palantir CEO Alex Karp thinks his AI technology will lessen the power of “highly educated, often female voters, who vote mostly Democrat” while increasing the power of working-class men. […] Karp’s message is loud and clear : My technology will take political capital away from one of your greatest enemies—liberal women with degrees—and give one of your favorite demographics to patronize—working-class men—more political power to transfer to you.

À ce sujet, on pourra réécouter ce que disait Peter Thiel (cofondateur de Palantir) dès 2010 (tube.fdn.fr) :

Maybe you could actually unilaterally change the world without having to constantly convince people and beg people and plead with people who are never going to agree with you – through technological means.Technology is this incredible alternative to politics

Spécial France

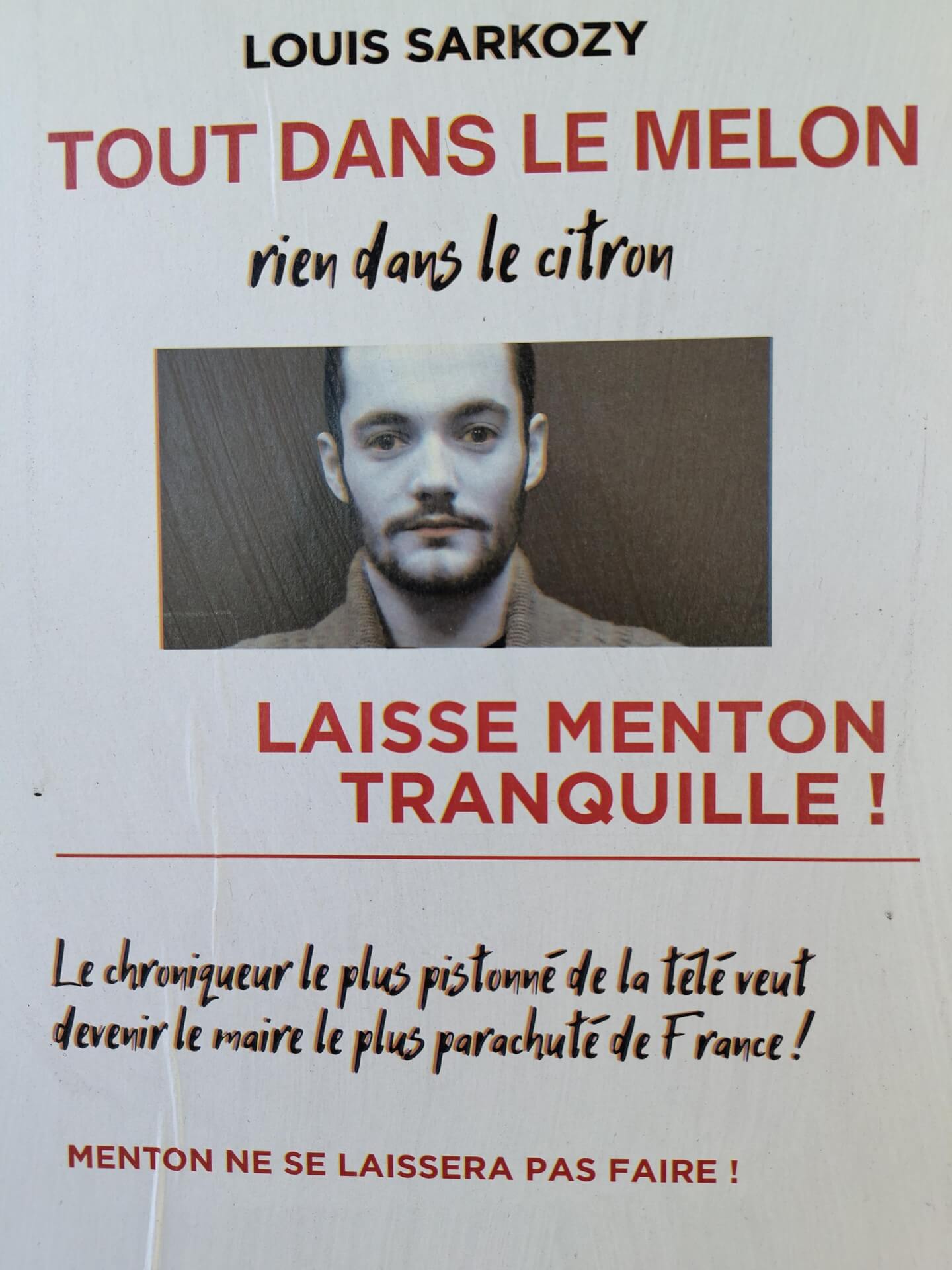

- Nicolas Sarkozy risque la pose d’un nouveau bracelet électronique après cette décision de justice (huffingtonpost.fr)

L’ancien président devra purger sa peine de six mois de prison ferme aménageable dans l’affaire Bygmalion, le tribunal correctionnel ayant refusé la confusion de cette peine avec celle du dossier Bismuth.

- Hélène, Bernard et ses fils : succession sans vergogne (arretsurimages.net)

- Une « victoire historique » pour le devoir de vigilance : Yves Rocher condamné à indemniser six salariés de filiales turques pour discrimination syndicale (humanite.fr)

- Cryptomonnaies : un couple des Yvelines dépouillé de 900 000 euros en bitcoin lors d’un home-jacking (huffingtonpost.fr)

le trio de malfaiteurs a sonné à l’entrée et annoncé « être policiers afin de se faire ouvrir la porte »

- Un chercheur français a découvert une faille béante dans l’IoT de Meari : plus d’1,1 million de babyphones et caméras sont exposés, dont certains sont vendus sous marque par Leroy Merlin, Fnac, Cdiscount ou Amazon. (clubic.com)

un broker MQTT sans aucune protection, accessible depuis n’importe quel navigateur, qui donne accès en temps réel aux flux vidéo de babyphones et caméras connectées à travers le monde. Derrière, 378 marques partagent le même backend défaillant

- Une révolution inattendue arrive pour les appels téléphoniques : Orange, Bouygues, Free et SFR vont-ils répondre présent ? (universfreebox.com)

Présentée lors du Mobile World Congress, une nouvelle technologie du géant des télécoms Deutsche Telekom va transformer les appels téléphoniques en y intégrant traduction instantanée, assistance et résumés automatiques grâce à l’intelligence artificielle directement intégrée à son réseau. Déployée prochainement en Allemagne, cette grande avancée va-t-elle faire des émules en France ?

À noter que Deutsche Telekom est déjà attaquée par un collectif allemand pour non respect de la neutralité du net : Epicenter.works, the Society for Civil Rights, the Federation of German Consumer Organizations, and Stanford Professor Barbara van Schewick are filing an official complaint with the Federal Network Agency against Deutsche Telekom’s unfair business practices. Voir aussi cette vidéo d’explication au DEnOG (media.ccc.de) (le FRnOG allemand).

- Yann LeCun, star française de l’IA, lève 890 millions d’euros pour sa start-up parisienne AMI (france24.com)

- Illégales, infaisables ou dispendieuses : les “drôles” de promesses technologiques pour les municipales de 2026 (synthmedia.fr)

- Hardware, câbles et logiciels, les raisons pour lesquelles la France n’est pas encore souveraine selon Henri Verdier (zdnet.fr)

L’ancien directeur de la Dinum prône une sensibilisation accrue aux alternatives souveraines :

– Le déploiement massif des communs numériques

– L’adoption systématique de logiciels libres

-L’utilisation de standards ouvertsÉcouter l’intervention (videos.assemblee-nationale.fr)

- « On vit dans un dépotoir numérique » : en Seine–Saint-Denis, les data centers dégradent le quotidien des riverains (synthmedia.fr)

- Collège : les « groupes de besoins » obligatoires en français et en maths finalement abandonnés (parents.fr)

Deux ans seulement après leur création, les « groupes de besoins » au collège disparaissent officiellement. Un décret publié ce jeudi 12 mars met fin à l’obligation d’organiser les cours de français et de mathématiques par groupes de niveau. […] Dès son annonce, le dispositif avait provoqué une forte opposition chez les enseignants et plusieurs syndicats. Beaucoup craignaient que ces groupes de niveau ne conduisent à trier les élèves trop tôt et à accentuer les inégalités scolaires. Certains enseignants estimaient également que l’organisation concrète était très difficile à mettre en place dans les établissements, notamment en raison du manque d’effectifs et de moyens.

- Tout comprendre à la situation financière des universités en trois minutes (alternatives-economiques.fr)

- À Paris, la prestigieuse université Panthéon-Sorbonne lance un cri d’alerte (huffingtonpost.fr)

Les syndicats estiment qu’il manque aujourd’hui au moins 8 milliards d’euros pour répondre aux besoins de l’enseignement supérieur public en France.

- À Paris, les SDF chassés en toute illégalité par les mairies d’arrondissement (streetpress.com)

- Saviez-vous que la loi oblige les maires à organiser la résilience alimentaire ? (basta.media)

Trois jours. C’est la durée des stocks alimentaires en cas de rupture d’approvisionnement. Alors que « tout est organisé pour diminuer le nombre de ceux qui nourrissent », Pierrick Berthou, agriculteur, rappelle les possibles à l’échelle des communes.

- “Les fumées rentrent directement dans les appartements”, des capteurs installés sur des balcons pour mesurer la pollution des bateaux (france3-regions.franceinfo.fr)

À Ajaccio, de petits capteurs installés sur les balcons des riverains du port permettent de mesurer en temps réel la pollution liée aux navires. Ce projet européen vise à compléter les données existantes et à mieux comprendre l’impact des émissions sur l’air que respirent les habitants, pour mieux envisager des solutions.

- « Ici, tant pis pour ceux qui meurent » : à Fos-sur-Mer, les malades passent après les industries (reporterre.net)

Spécial femmes en France

- Après une comparaison sexiste entre femmes et eau, le coach sportif Quentin Rivoire publie une vidéo d’excuses et plaide l’humour (huffingtonpost.fr)

- Selon l’Arcom, la voix des femmes reste au second plan sur les plateaux télé (telerama.fr)

Temps de parole inférieur, moins de reportages, invités surtout masculins… Excepté pour les présentatrices, la parité est loin d’être respectée dans l’audiovisuel français, pointe le rapport publié ce 12 mars. Sans compter les discriminations quotidiennes.

Spécial médias et pouvoir

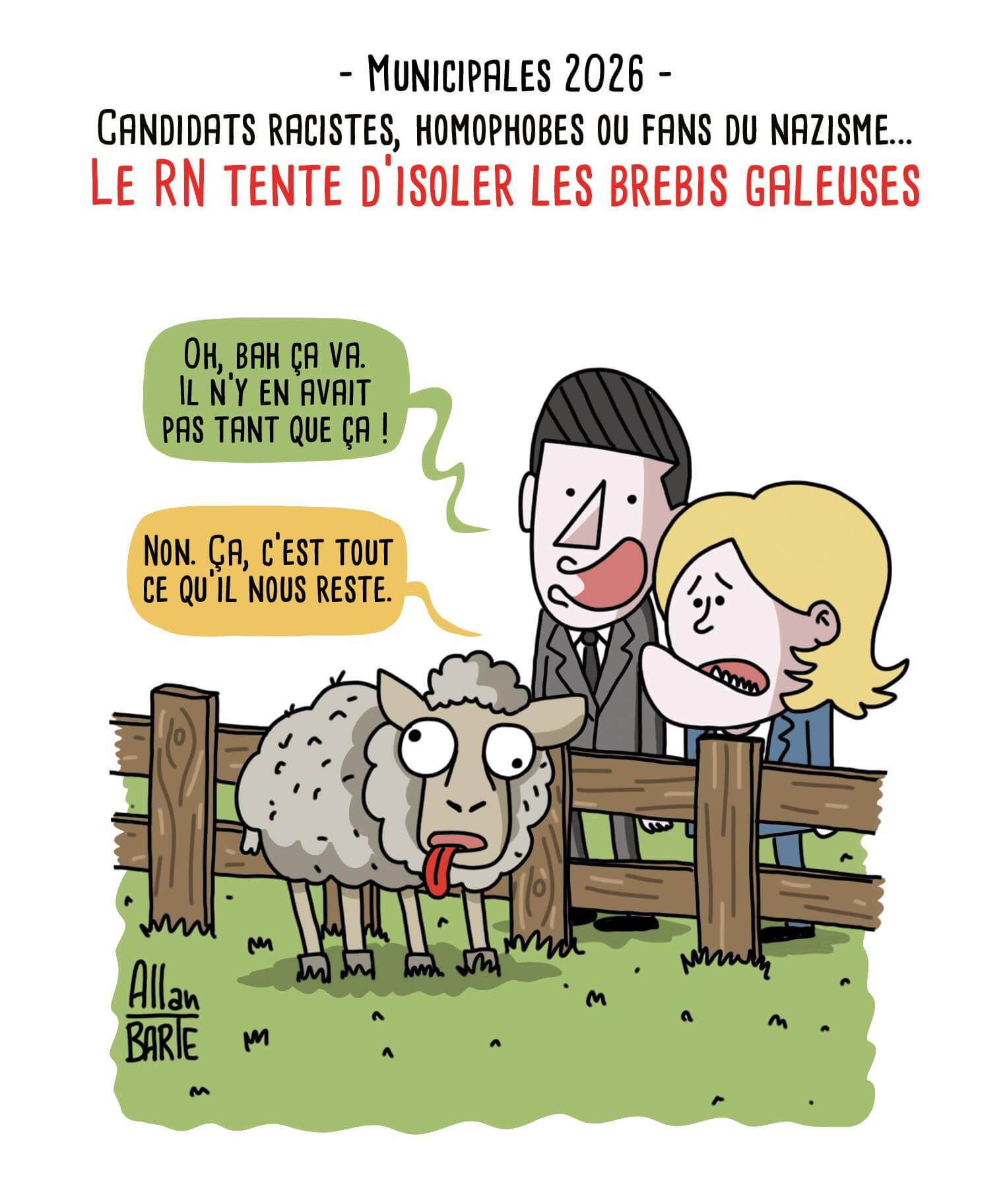

- En amont des municipales, X et TikTok présentent un biais vers l’extrême droite (next.ink) – voir aussi Municipales 2026 : X et TikTok favorisent l’extrême droite (synthmedia.fr)

- Pourquoi Bernard Arnault veut contrôler toute la presse économique ? (humanite.fr)

Syndicats, journalistes et Reporters sans frontières se sont rassemblés jeudi 12 mars devant le Conseil d’État à Paris. En jeu, la vente du magazine Challenges à Bernard Arnault et l’application du règlement européen sur la liberté des médias. Entretien avec Thibaut Bruttin, directeur de RSF, pour comprendre ce qu’il se joue.

- Iran : la propagande israélienne « en exclusivité » sur Franceinfo (politis.fr)

L’ambassadeur d’Israël en France, Joshua Zarka, a pu dérouler tranquillement son argumentaire guerrier à l’antenne, face à un intervieweur qui a tout fait pour ne pas froisser son invité. Et tant pis pour la propagande glaçante et les mensonges.

- “Comment continuer à informer sous pression ?” La presse locale fragilisée, RSF tire le signal d’alarme (telerama.fr)

Spécial emmerdeurs irresponsables gérant comme des pieds (et à la néolibérale)

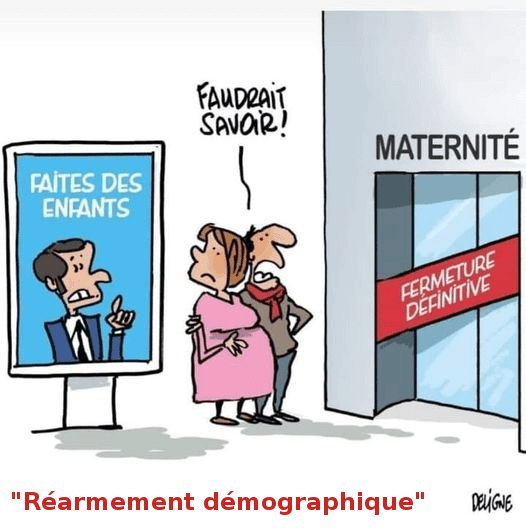

- Le Livret A financera en partie le programme nucléaire de nouveaux réacteurs EPR (lemonde.fr) Le Livret A financera à hauteur de 60 % ce programme nucléaire, a annoncé l’Elysée à l’issue d’un Conseil de politique nucléaire tenu en présence d’Emmanuel Macron sur le chantier de la future centrale de Penly (Seine-Maritime).

- « Jusqu’à 650 milliards d’euros », la relance du nucléaire est une bombe budgétaire (reporterre.net)

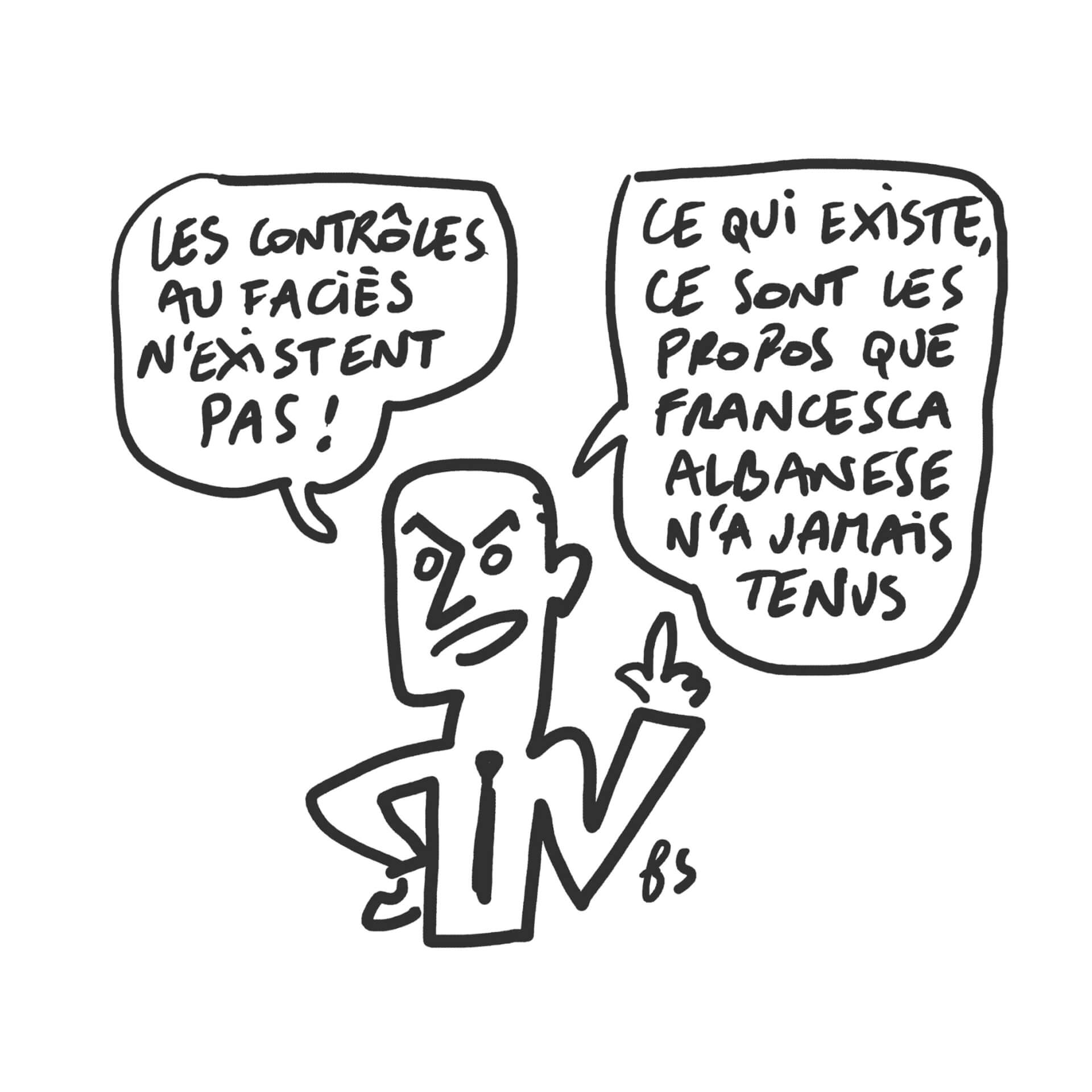

- Après avoir calomnié Francesca Albanese, Jean-Noël Barrot rétropédale (humanite.fr)

- Éric Dupond-Moretti pourrait être nommé Défenseur des droits. Les protestations pleuvent (lesnouvellesnews.fr)

Au terme du mandat de Claire Hédon, Emmanuel Macron envisagerait de nommer Éric Dupond-Moretti Défenseur des Droits. Si beaucoup crient au copinage, des associations s’inquiètent du sort réservé aux « victimes de violences sexuelles et aux enfants. »

- Tant pis pour la souveraineté numérique ? L’Éducation nationale signe 4 ans de plus avec Microsoft (01net.com)

Pourtant, cette décision contrevient aux directives de l’État. En France, les administrations et les établissements de l’Enseignement supérieur ne peuvent pas choisir n’importe quel fournisseur de cloud ou de solutions numériques. La doctrine « Cloud au centre de l’État » impose par exemple le recours à un fournisseur labellisé SecNumCloud (le plus haut niveau de cybersécurité) pour l’hébergement de toutes les données sensibles de l’État et d’acteurs publics. Ce label, qui inclut une clause d’immunité aux lois extraterritoriales, exclut de fait les géants du cloud américains comme Amazon, Microsoft Azure et Google Cloud, tous trois soumis à la loi « Fisa » et au « Cloud Act ».

- La privatisation des démarches de cartes grises a conduit à des “fraudes massives”, selon la Cour des comptes (franceinfo.fr)

D’après un rapport de l’institution, des “garages fictifs” ont permis d’immatriculer frauduleusement “près d’un million de véhicules”.

- En Bretagne, l’État veut tuer dans l’oeuf une décision importante sur les pesticides (reporterre.net)

Le Sage n’est toujours pas signé et c’est encore une victoire pour les syndicats pro-pesticides. Voilà près d’un an qu’ils freinent la révision de la gestion de l’eau en Bretagne. L’État les soutient et joue la montre.

Spécial recul des droits et libertés, violences policières, montée de l’extrême-droite…

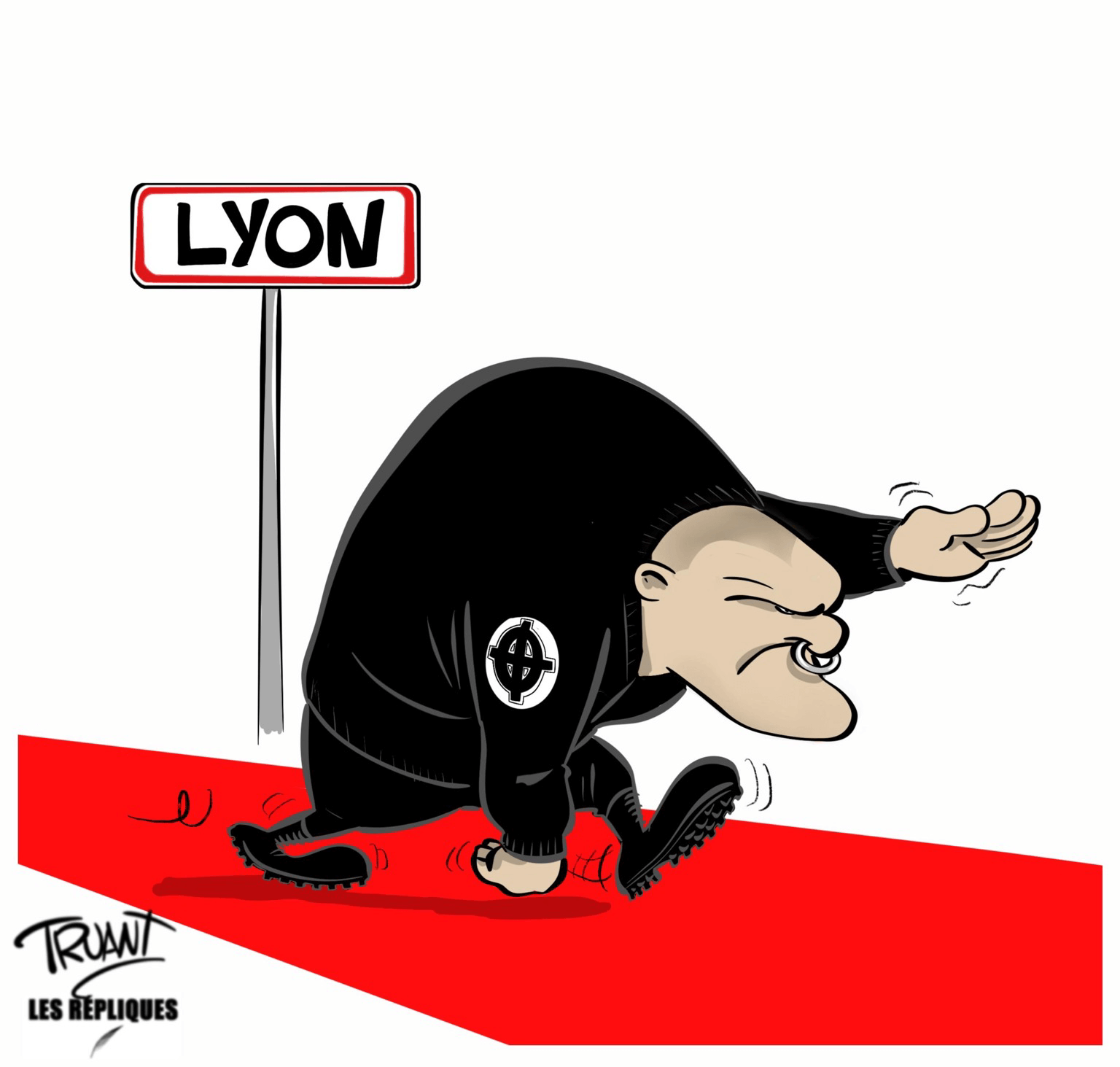

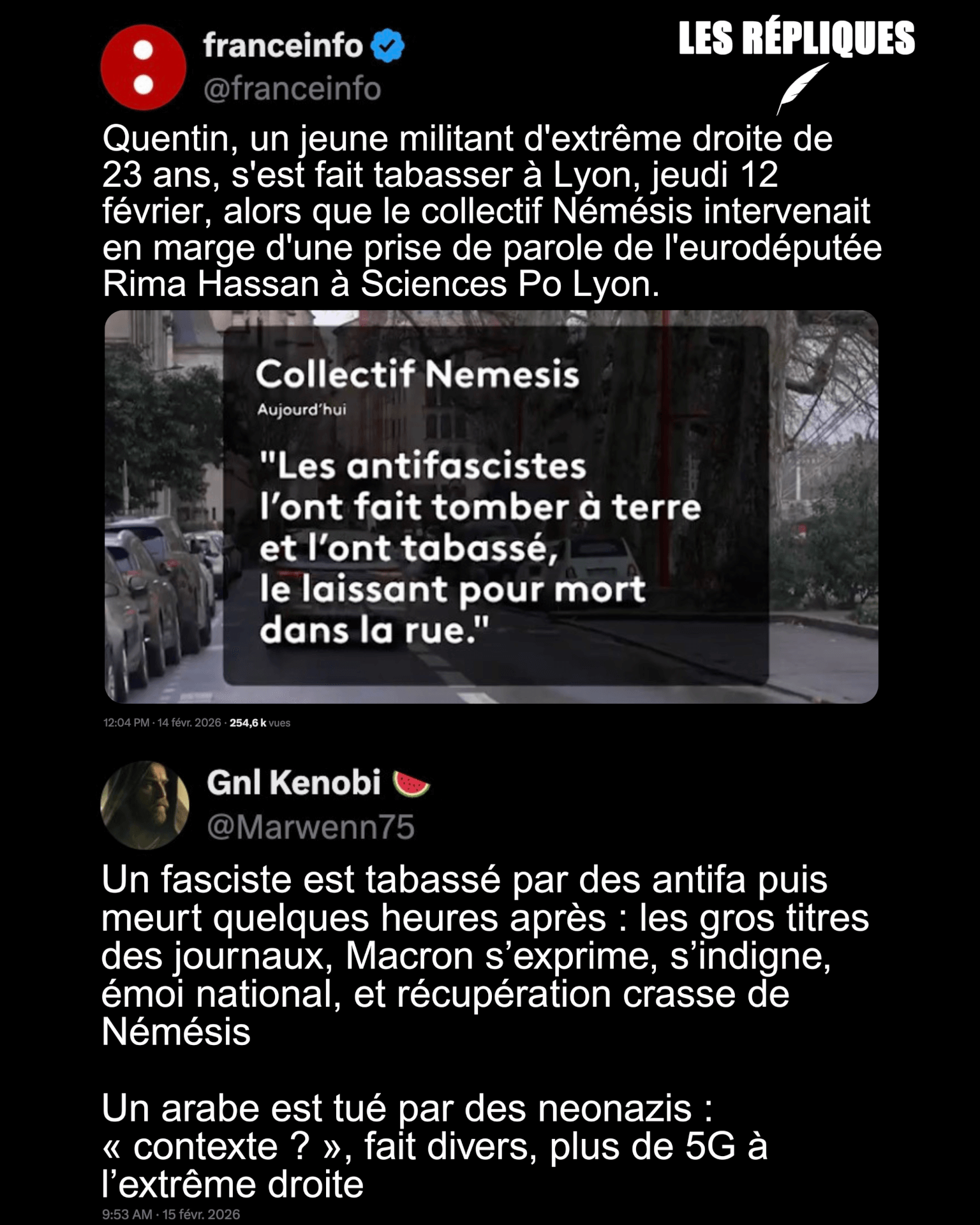

- Quentin Deranque, catholique traditionaliste à la ville et néonazi en ligne (mediapart.fr)

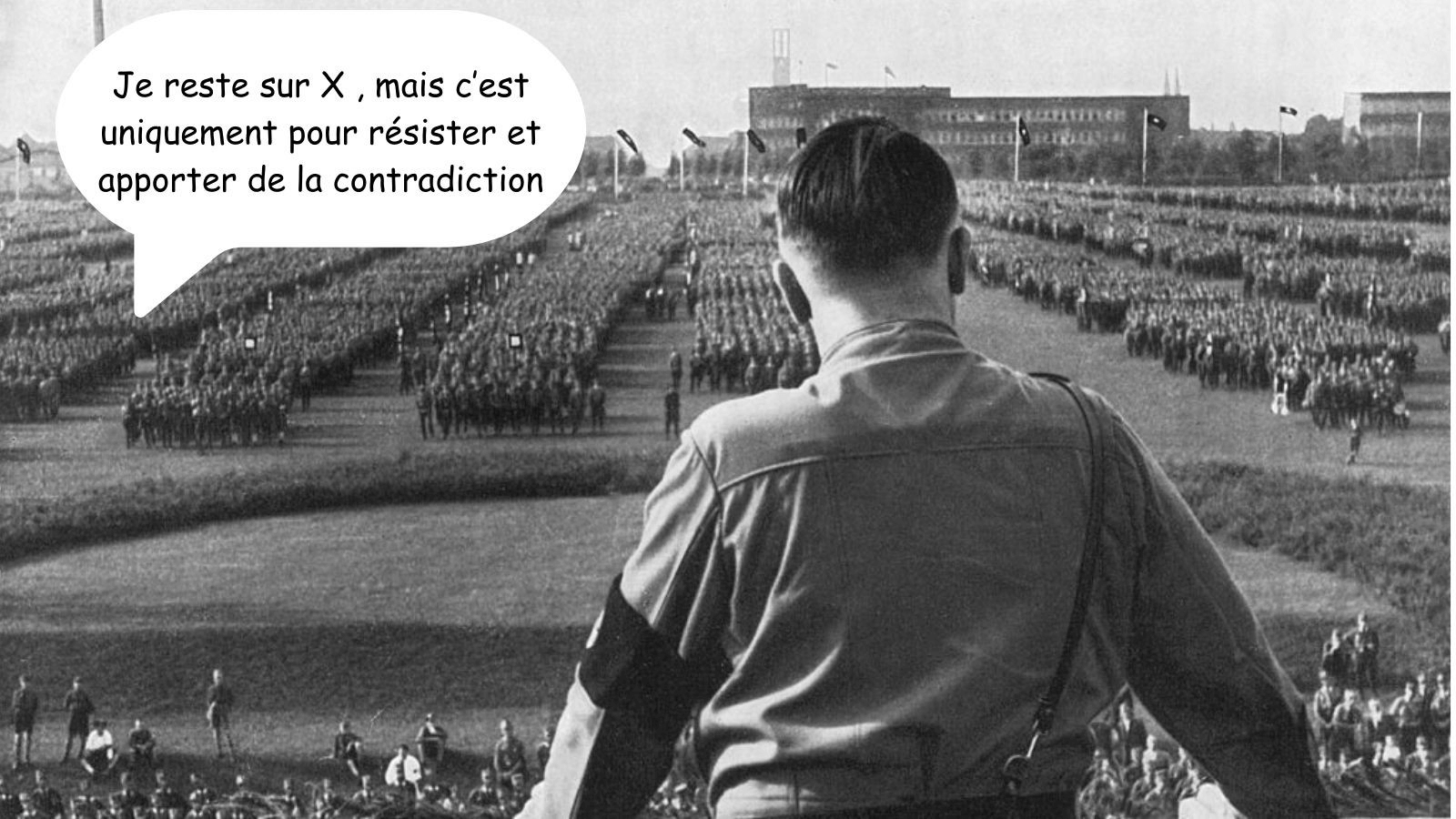

Le militant tué à Lyon gravitait depuis plusieurs années dans les cercles néofascistes locaux. Des milliers de posts anonymes sur X retrouvés par « Mediapart » montrent l’étendue de sa pensée raciste et antisémite, construite autour d’une glorification du fascisme et une nostalgie du nazisme.

Voir aussi « Moi je soutiens Adolf, mais chacun son truc » : les posts de Quentin Deranque sur X, une idéologie néonazie assumée (humanite.fr)

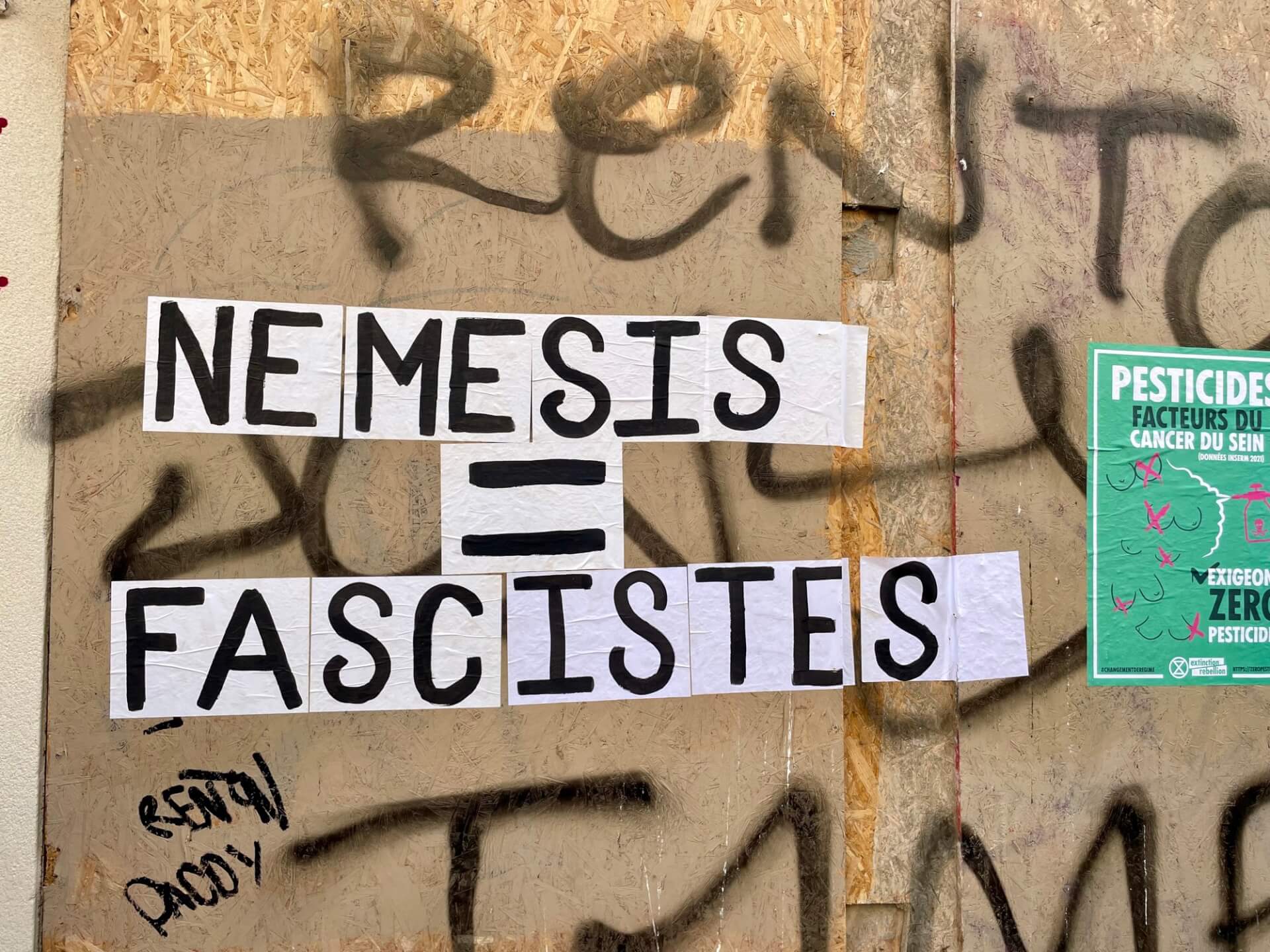

- Némésis : photographiée réalisant une gestuelle néonazie, Alice Cordier évoque une référence… au rap (humanite.fr)

- Yaël Braun-Pivet « horrifiée » par les révélations de « Mediapart » mais assume l’hommage à Quentin Deranque (huffingtonpost.fr)

- Une minute de silence qui ne passe pas (blogs.mediapart.fr)

Comment expliquer que la quasi-totalité de la représentation nationale se soit associée sans la moindre protestation à cette minute de silence en hommage à un militant d’une extrême droite qui se situe aux antipodes des valeurs humanistes et démocrates dont se targue la République française ?

- Extrême droite Municipales 2026, « A la reconquête de nom ville » : à Versailles, Reconquête bâcle ses professions de foi (liberation.fr)

Le parti d’Eric Zemmour a oublié de noter le nom de la ville des Yvelines dans les tracts de sa candidate aux élections municipales. Une bourde qui s’ajoute aux différentes polémiques sur le site internet de Sarah Knafo, candidate Reconquête à Paris, ou sur des propos racistes tenus par des militants.

- Ces maires qui ont tenté de restreindre le droit de grève (en vain) (basta.media)

Les maires peuvent restreindre le droit de grève de leurs agents grâce à une loi de 2019. Plusieurs édiles, y compris de gauche, ont tenté de le faire. Ces décisions soulignent l’autoritarisme de certains maires-employeurs qui méprisent le dialogue social.

- Vols, tentatives de cambriolage : une journaliste du « Monde », spécialiste des PFAS, dépose plainte (reporterre.net)

- Pris pour un cambrioleur chez lui : un jeune homme de 19 ans accuse la BAC de l’avoir “passé à tabac” (france3-regions.franceinfo.fr)

Une famille a porté plainte à Toulouse après l’agression au domicile de leur fils par des policiers de la BAC le 27 février 2026. Croyant à un cambriolage, les forces de l’ordre ont roué de coups le jeune homme de 19 ans avant de quitter les lieux sans appeler les secours.

Spécial résistances

- À Lyon, une grande marche contre le racisme en réponse à la manifestation néofasciste pour Quentin Deranque (basta.media)

Plus de 100 marches contre le racisme se tiendront ce 14 mars, veille des élections municipales. À Lyon, la manifestation prend des allures de réponse politique après la mort du militant néofasciste Quentin Deranque.

- « Il faut décortiquer leurs discours » (lempaille.fr)

Un collectif sétois s’est monté pour s’opposer localement à la montée de l’extrême droite. Entre une distribution de leur feuille d’infos et l’organisation d’une journée de conférences, rencontre avec deux militant·es infatigables, Daniel et Jeanne.

- Plus de 200 personnes contre l’association Familya, critiquée pour ses liens avec l’extrême droite (leprogres.fr)

derrière sa « vitrine respectable » (conseils conjugaux, médiation familiale…), Familya servirait « une vision traditionaliste et normative de la famille ».

- RSA : des allocataires portent plainte contre le département du Finistère (politis.fr)

Six allocataires du RSA, soutenus par la CGT, ont porté plainte, dans le Finistère, contre le président du conseil départemental, Maël de Calan, pour « harcèlement moral institutionnel ». Ils dénoncent une série de contrôles administratifs jugés intrusifs et excessifs.

- Qui terrorise qui ? Chroniques du procès des inculpé·es du 8/12 (rebellyon.info) – voir aussi le podcast de l’émission Minuit Décousu : avec les inculpe-e-s du 8 decembre 2020 : quand l’antiterroristes toque a la porte et avec les inculpés -e-s du 8 décembre 2020 : qui terrorise qui ? le petit théâtre de la justice d’exception (actualitedesluttes.info)

Spécial outils de résistance

- Indextrême : Geste SS (indextreme.fr)

- Bascule autoritaire : un manuel pour résister (revuesilence.net)

À l’automne 2025, le Mouvement pour une alternative non-violente (MAN) a publié un Manuel citoyen pour une défense civile non-violente. Son but ? Se préparer à réagir et résister par les armes de la non-violence en cas de coup d’État, d’occupation militaire ou de venue au pouvoir d’un régime autoritaire.

- La Base de données d’infiltré·e·s traduite en français (nantes.indymedia.org)

La Base de données d’infiltré·e·s est une base de données recensant les cas d’infiltré·e·s à long terme qui ont ciblé des groupes engagés dans des activités subversives au 21ème siècle. Son but est d’aider les anarchistes et autres rebelles à comprendre comment les infiltré·e·s opèrent. - The No-AI list (noai.starlightnet.work)

A list of projects that pledged not to use AI or are disrupting it.

- Anti Gen AI Heroes : Alexia keeps a list of ai-free software (stopgenai.com)

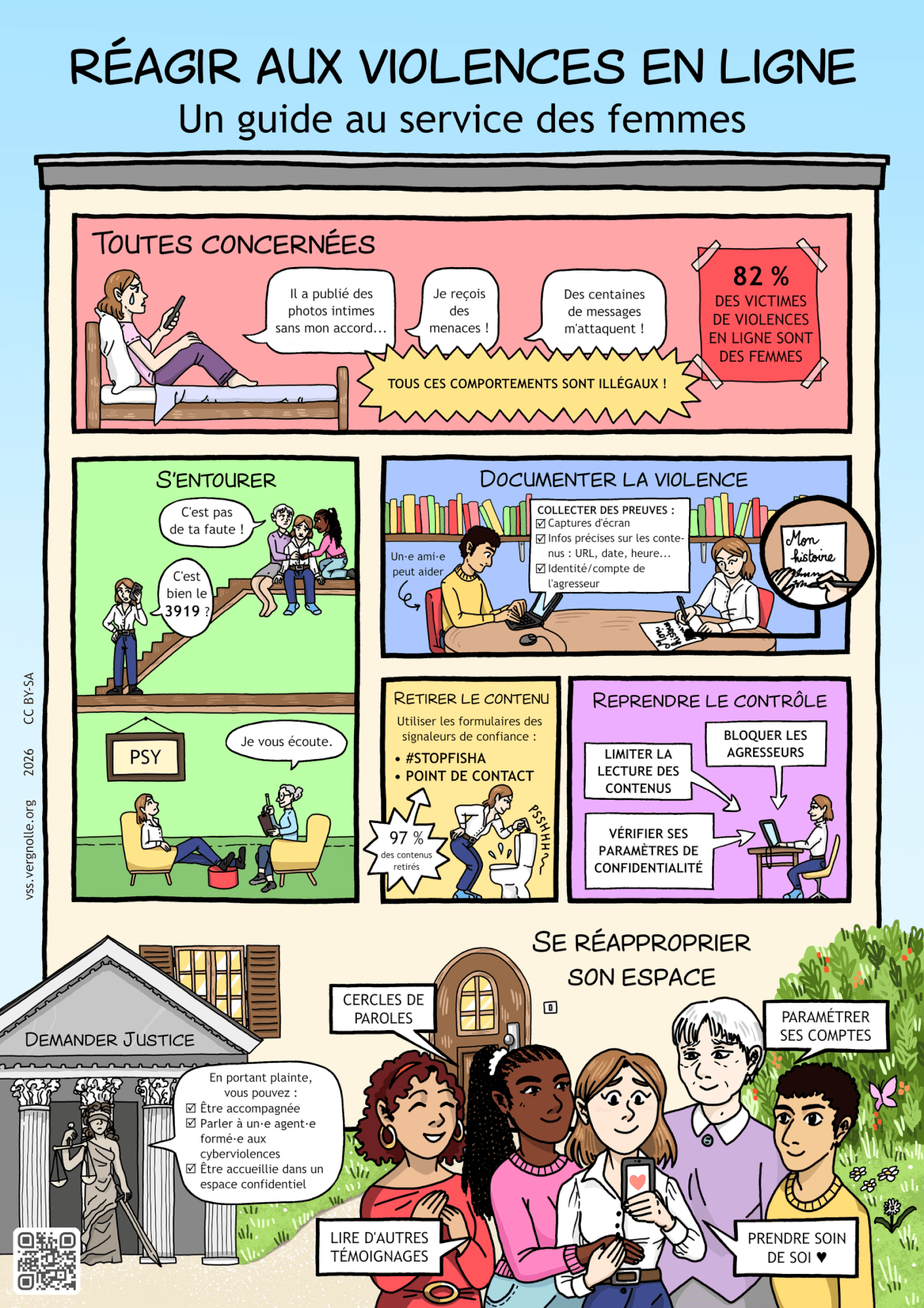

- Réagir aux violences en ligne – Un guide au service des femmes (regulation-tech.cnam.fr)

- Nos sexes sont politiques : manuel illustré d’anatomie génitale (documentation.planning-familial.org)

Spécial GAFAM et cie

- Google Spends $1 Million On AI-Generated Kids Videos While Slop Floods YouTube (kotaku.com)

After years of struggling to get freaky children’s content in order on YouTube, the company goes full throttle

- After complaints, Google will make it easier to disable gen AI search in Photos (arstechnica.com)

- À Châteauroux, Google avance masqué : les dessous d’un projet de data center XXL (multinationales.org)

À une dizaine de kilomètres de Châteauroux, Google envisage d’implanter un immense data center sur 195 hectares, son premier en France […] Très peu d’informations filtrent sur le terrain, malgré les questionnements sur son impact écologique et ses réels bienfaits.

- Meta acquires Moltbook, the AI agent social network (arstechnica.com)

Meta has acquired Moltbook, the Reddit-esque simulated social network made up of AI agents that went viral a few weeks ago. The company will hire Moltbook creator Matt Schlicht and his business partner, Ben Parr, to work within Meta Superintelligence Labs.

- Meta reportedly plans sweeping layoffs as AI costs increase (theguardian.com)

Meta is planning sweeping layoffs that could affect 20 % or more of the company, three sources familiar with the matter told Reuters, as Meta seeks to offset costly artificial intelligence infrastructure bets and prepare for greater efficiency brought about by AI-assisted workers.

- Meta to Shut Down Instagram End-to-End Encrypted Chat Support Starting May 2026 (thehackernews.com)

Les autres lectures de la semaine

- Gen Zers Are Canceling Spotify and Buying CDs Instead—Here’s Why (newsweek.com)

“We’re all waking up to the fact that we basically own nothing,” Amity said. “Not movies, shows, songs, art, games—it’s all borrowed in a place that it can be deleted forever despite paying for it.”

- De l’Iran à la surveillance de masse : la double guerre de Palantir (legrandcontinent.eu)

- « La guerre est indissociable d’un système qui détruit la planète » (reporterre.net)

- Flambée des prix du pétrole et du gaz : « La vraie question, c’est : est-ce qu’on a besoin d’autant d’énergie ? » (reporterre.net)

- 6 h 30, une violente déflagration secoue la mine… Il y a 120 ans, la catastrophe de Courrières faisait au moins 1 099 morts (humanite.fr)

- Quel avenir pour le municipalisme ? Retour sur les expériences de Barcelone et de Madrid (theconversation.com)

- Dans une société capitaliste, nos épuisements sont politiques (reporterre.net)

- Pourquoi les végétaux des milieux extrêmes sont‑ils souvent en forme de boule ? (theconversation.com)

- Cécité, droits des femmes et biologie (linuxfr.org)

- Perception de la douleur et approche sociétale de l’endométriose (blogs.mediapart.fr)

- Sophie Oluwole, la pionnière nigériane qui a redéfini la philosophie (theconversation.com)

- ‘Viking’ was a job description, not a matter of heredity, massive ancient DNA study shows (science.org)

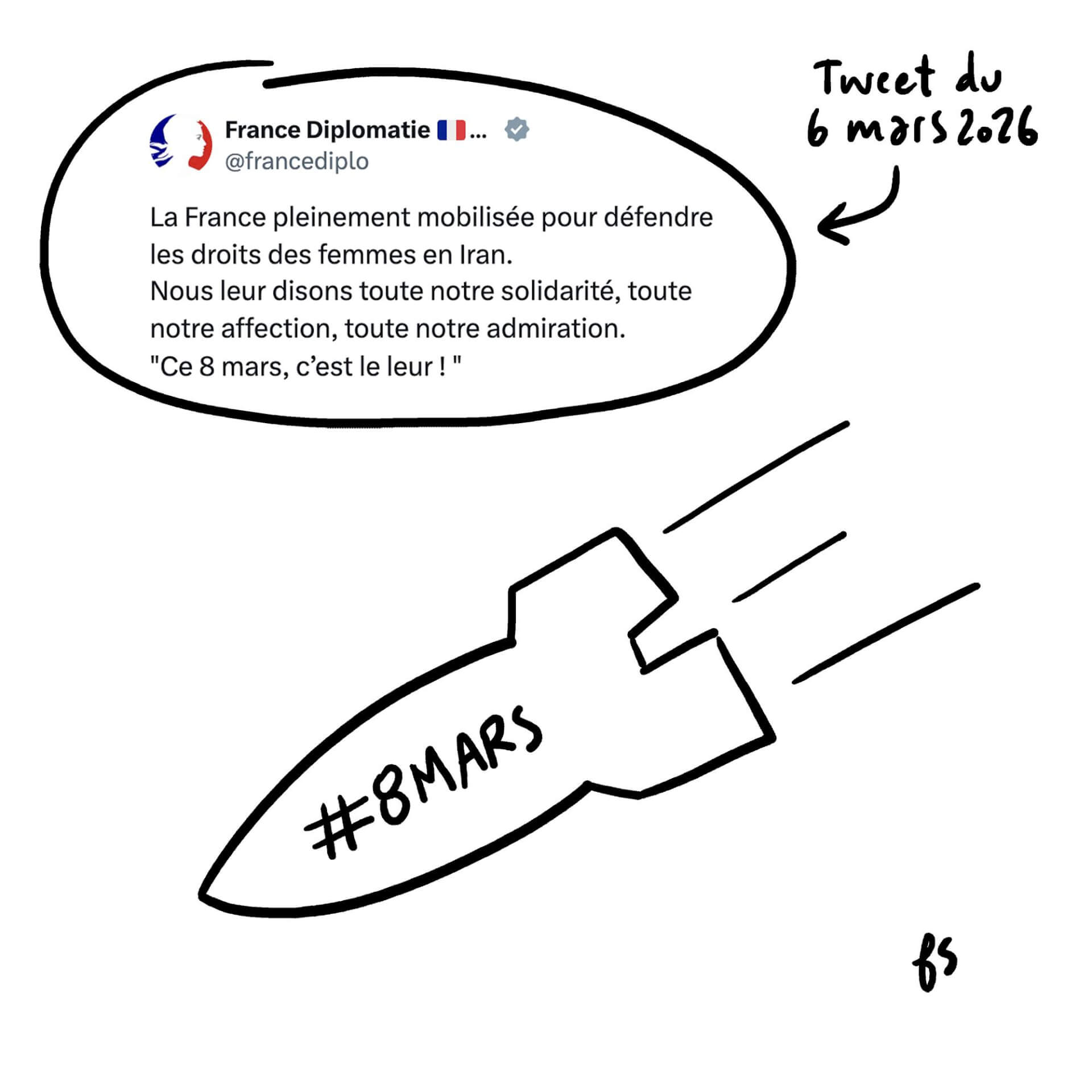

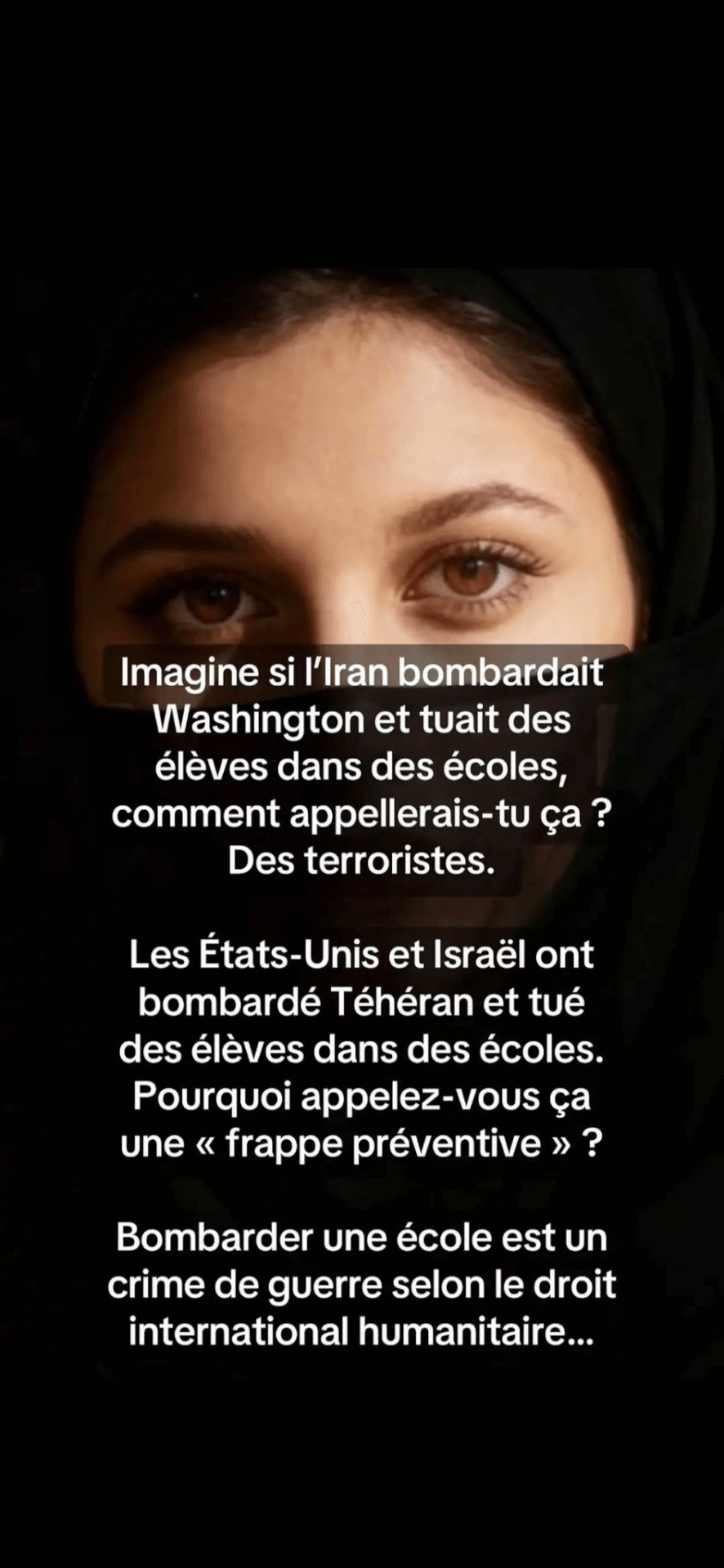

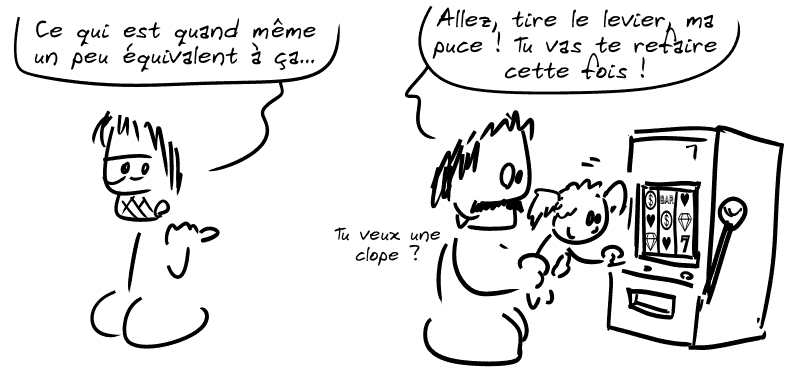

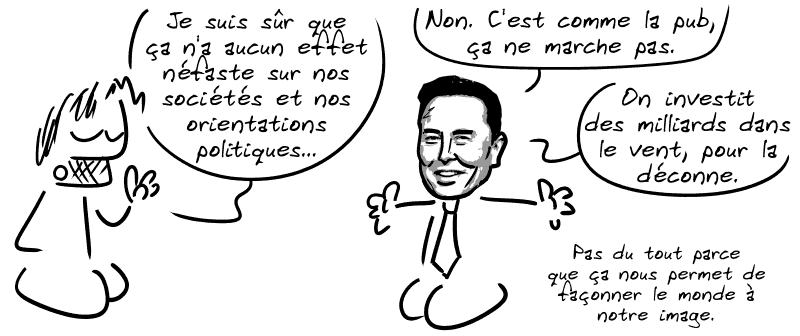

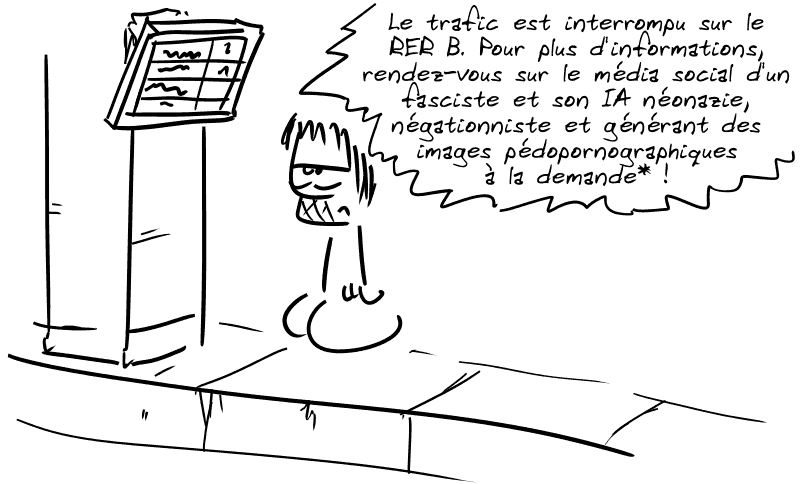

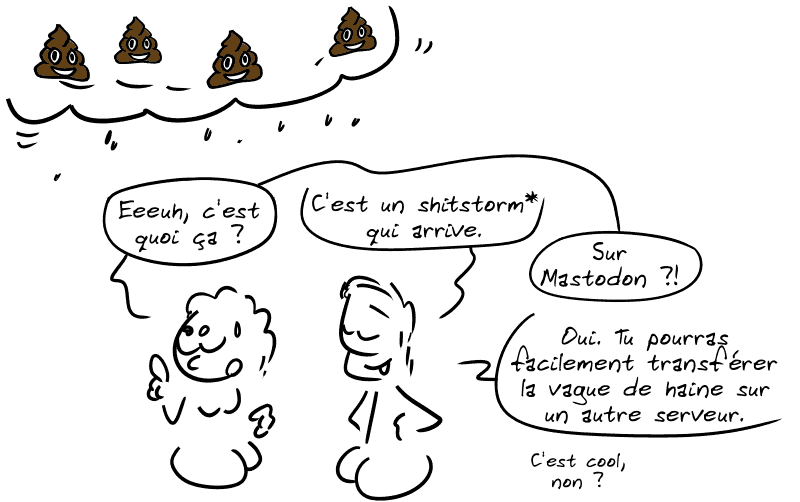

Les BDs/graphiques/photos de la semaine

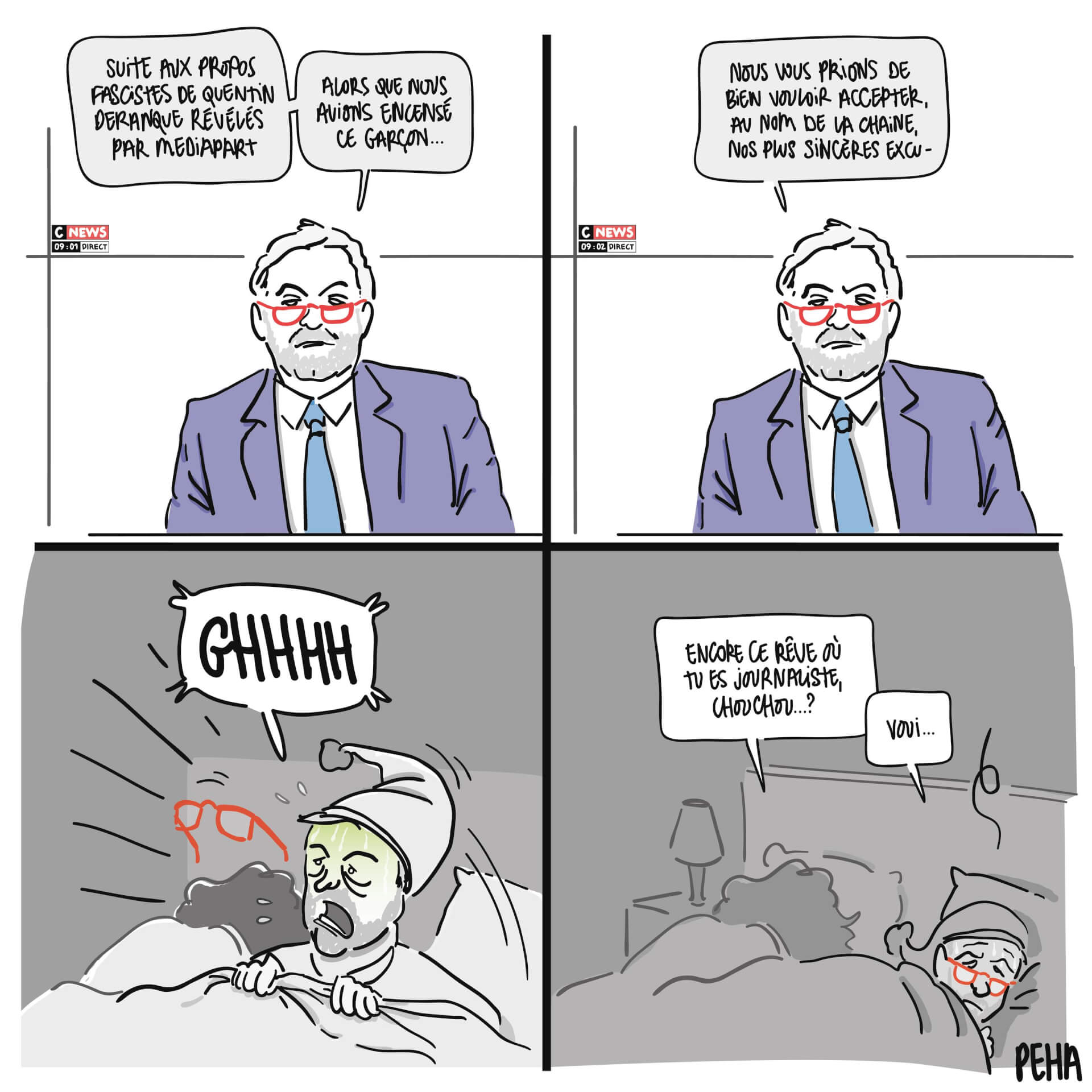

- Rêve

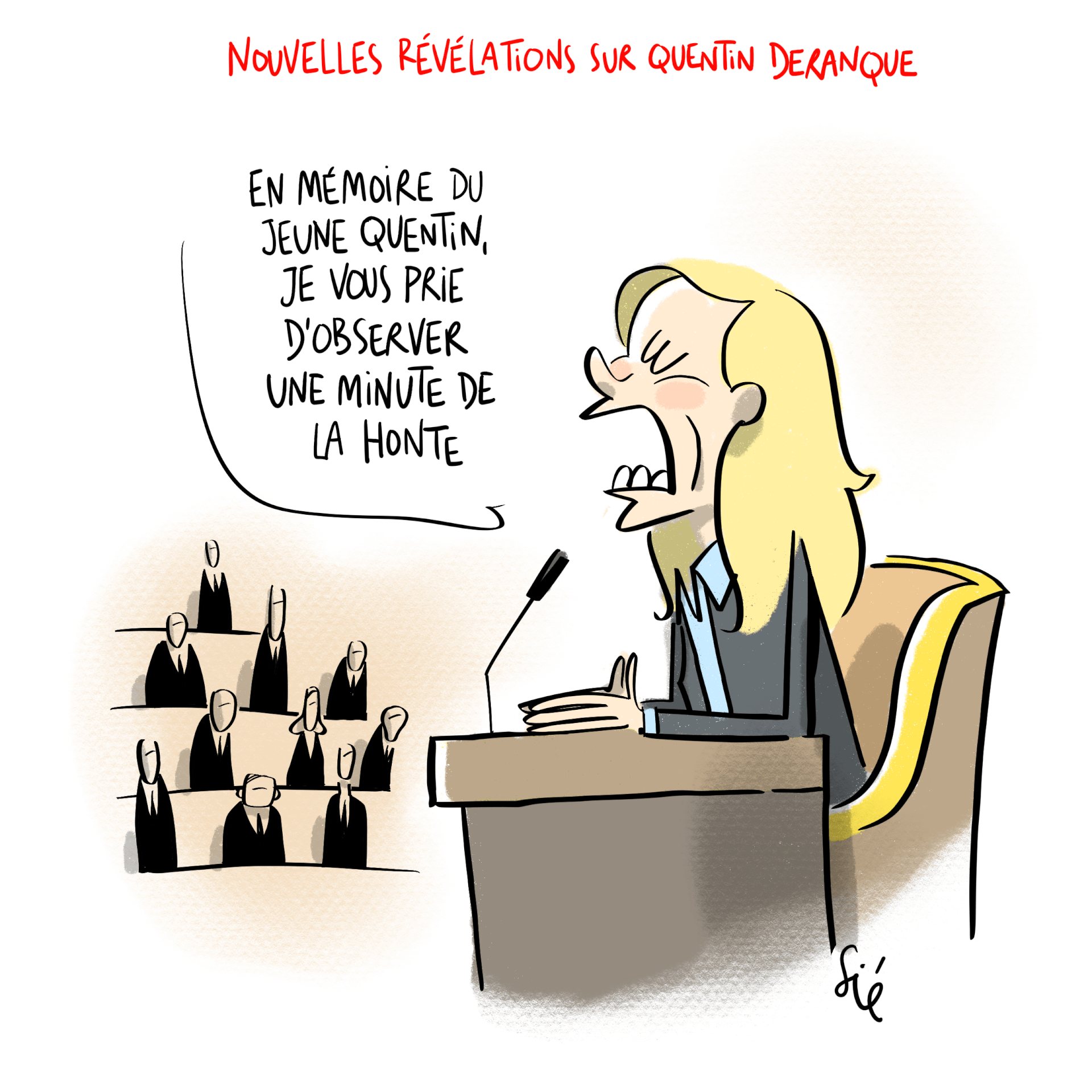

- Honte

- News

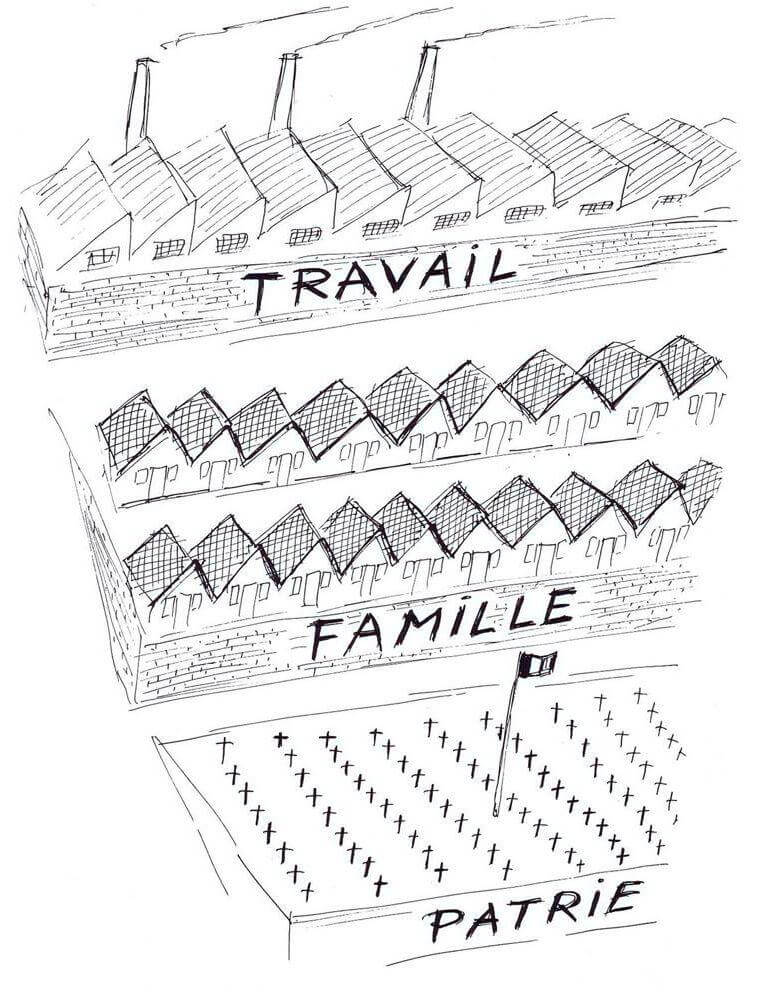

- Amalgames

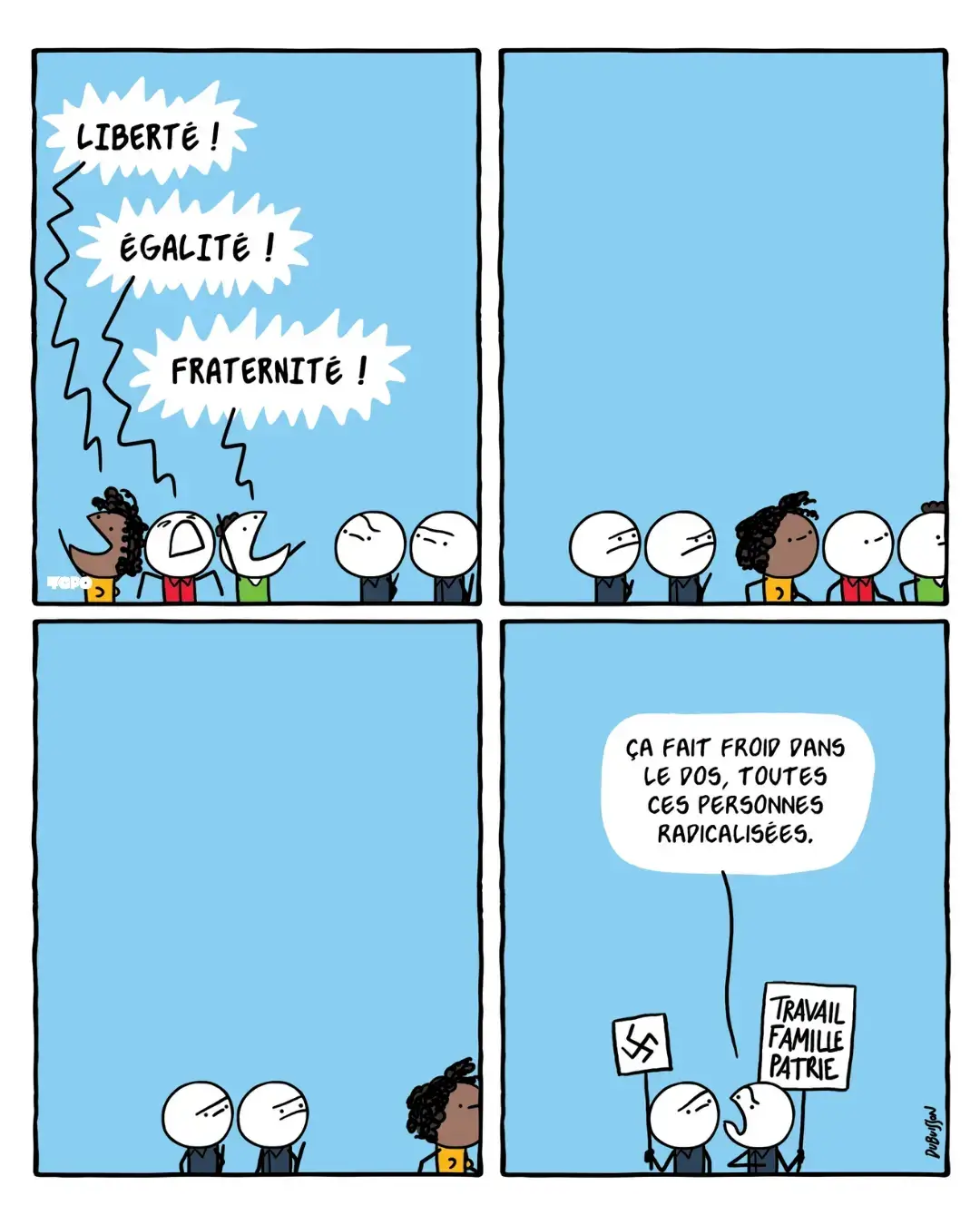

- Radicalisées

- Odeur

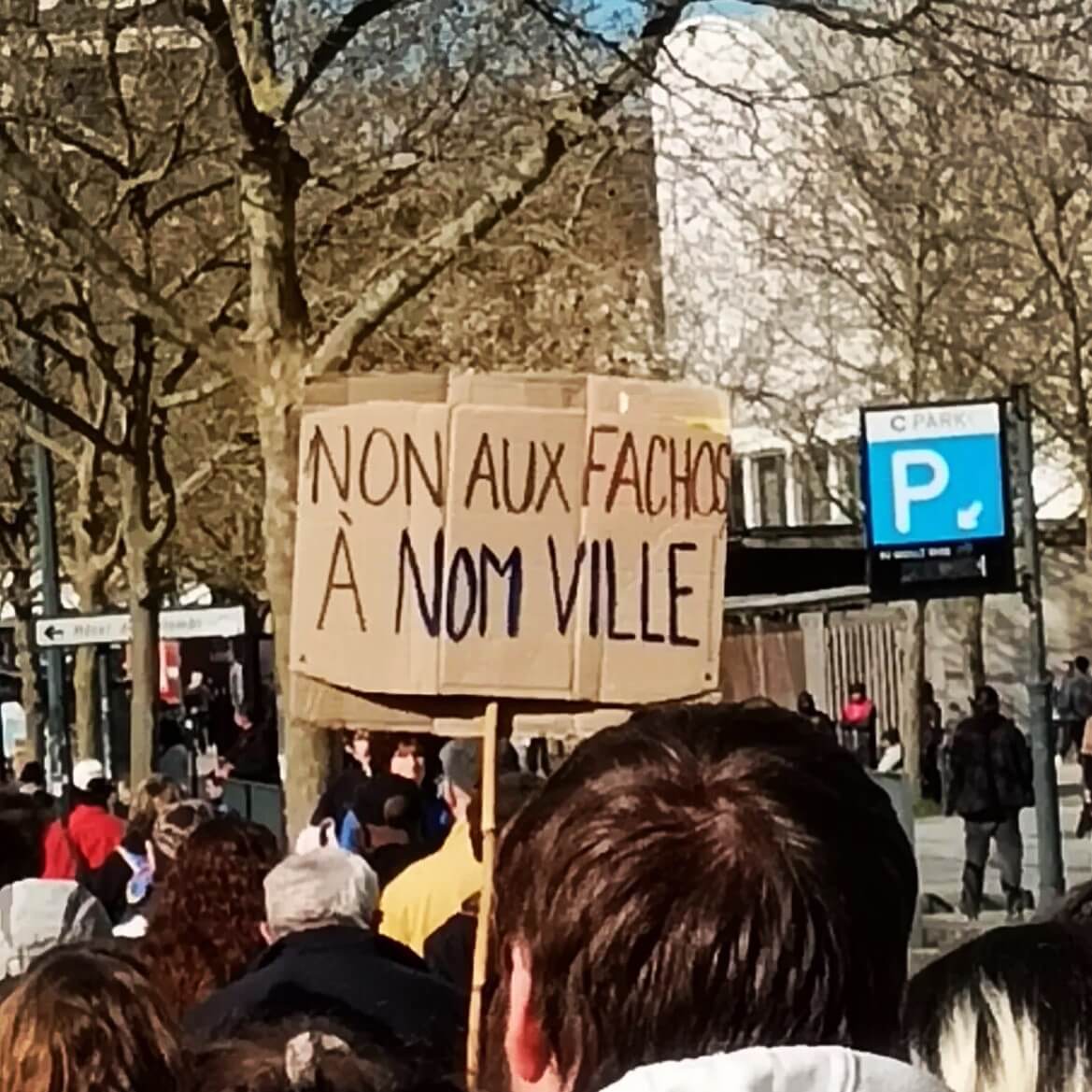

- NomVille

- Non

- AntiFa

- Nemesis

- Violences en ligne

- Fils

- Epstein

- Silence

- SciFi

- AIslop

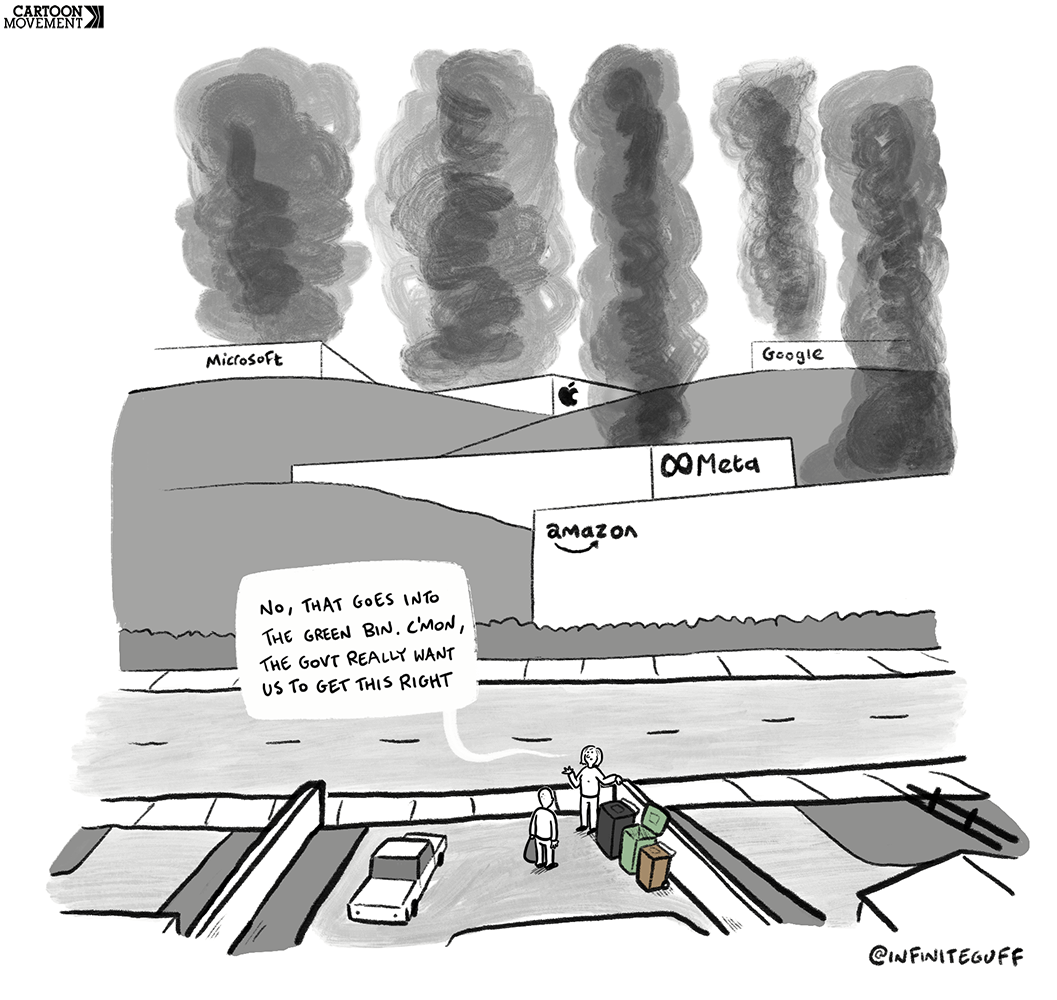

- AI

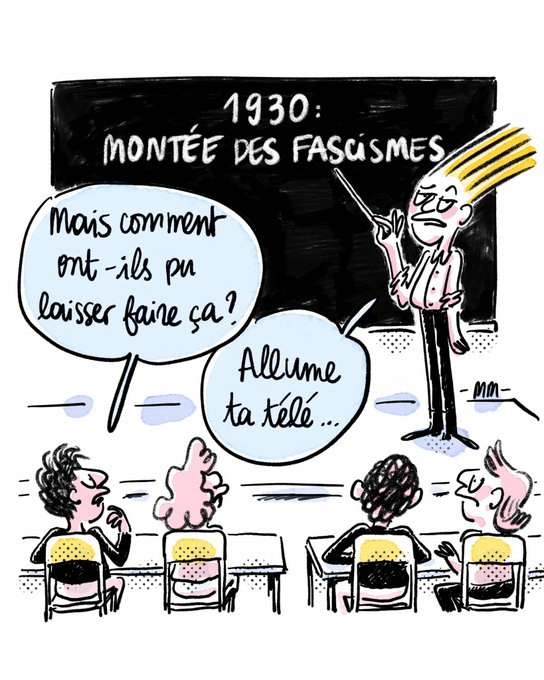

- School

- Irresponsable

- Waiting

- Gas

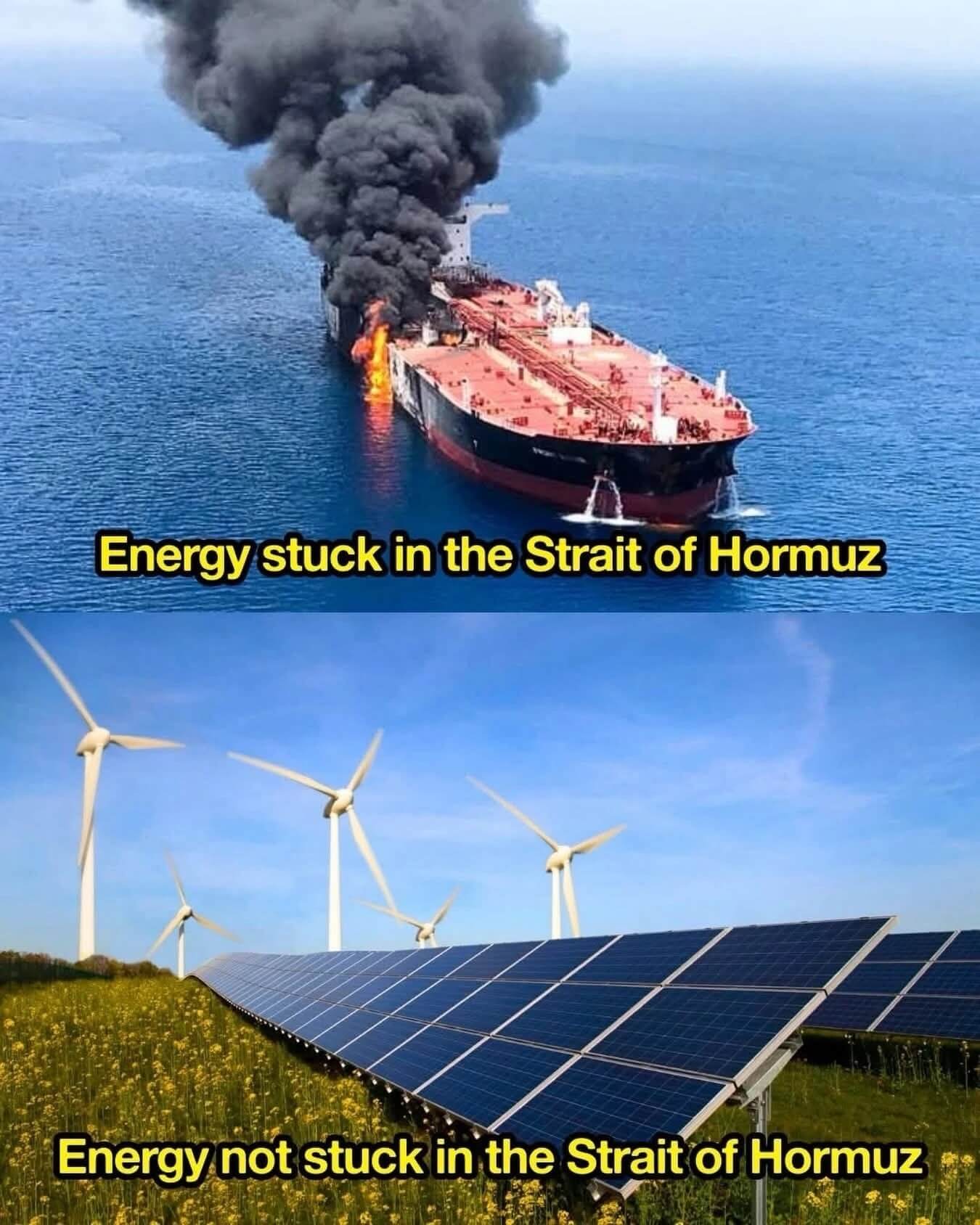

- Hormuz

- Justice

- Satrapi

- Regret

Les vidéos/podcasts de la semaine

- Ada Palmer : print revolution vs digital revolution (tube.fdn.fr)

- L’Éducation nationale prolonge un contrat avec Microsoft (contre ses propres consignes et celles de l’Etat) (radiofrance.fr)

- “On ne peut pas”libérer” l’Iran en le bombardant” (blast-info.fr)

- A better world is possible (tube.fdn.fr)

- Peut-on être LGBT+ et d’extrême-droite ? (tube.fdn.fr)

- Municipales : pourquoi Knafo déteste les femmes ? (spoiler : car elle est d’extrême droite) (humanite.fr)

- Redskins et punks, des bandes(-sons) antifascistes (radiofrance.fr)

- Des dieux imparfaits : que veut nous dire Homère ? (radiofrance.fr)

Dans les épopées d’Homère, les dieux ne sont pas parfaits : ils se disputent, mentent, trahissent, prennent parti. Ils ressemblent en somme aux humains par leurs passions et leurs défauts. Pourquoi Homère choisit-il de représenter des dieux imparfaits ?

- Micheline Gambaretti, la détective privée qui traque les pollueurs dans le Finistère (splann.org)

- Les cancers du sein, de la prostate, du sang ou encore du pancréas sont plus rares chez les végétarien·nes (radiofrance.fr)

- La Gen Z fait des blagues sur l’avortement et c’est une bonne nouvelle ! (humanite.fr)

- À tisser, la mémoire du féminisme en ligne. Pour fêter les 30 ans des Pénélopes, une interview d’une de leurs fondatrices, Joelle Palmieri (joellepalmieri.org). Toutes les interviews du projet À tisser se trouvent par ici.

Les trucs chouettes de la semaine

- Libre circulation : la justice européenne impose la reconnaissance de l’identité de genre (stophomophobie.com)

La CJUE a rendu une décision importante pour les droits des personnes transgenres dans l’Union européenne. Dans un arrêt publié ce 12 mars 2026, la juridiction estime qu’un État membre ne peut pas refuser de délivrer des documents d’identité conformes à l’identité de genre d’un·e citoyen·ne lorsque cette identité a été légalement reconnue dans un autre pays de l’Union.

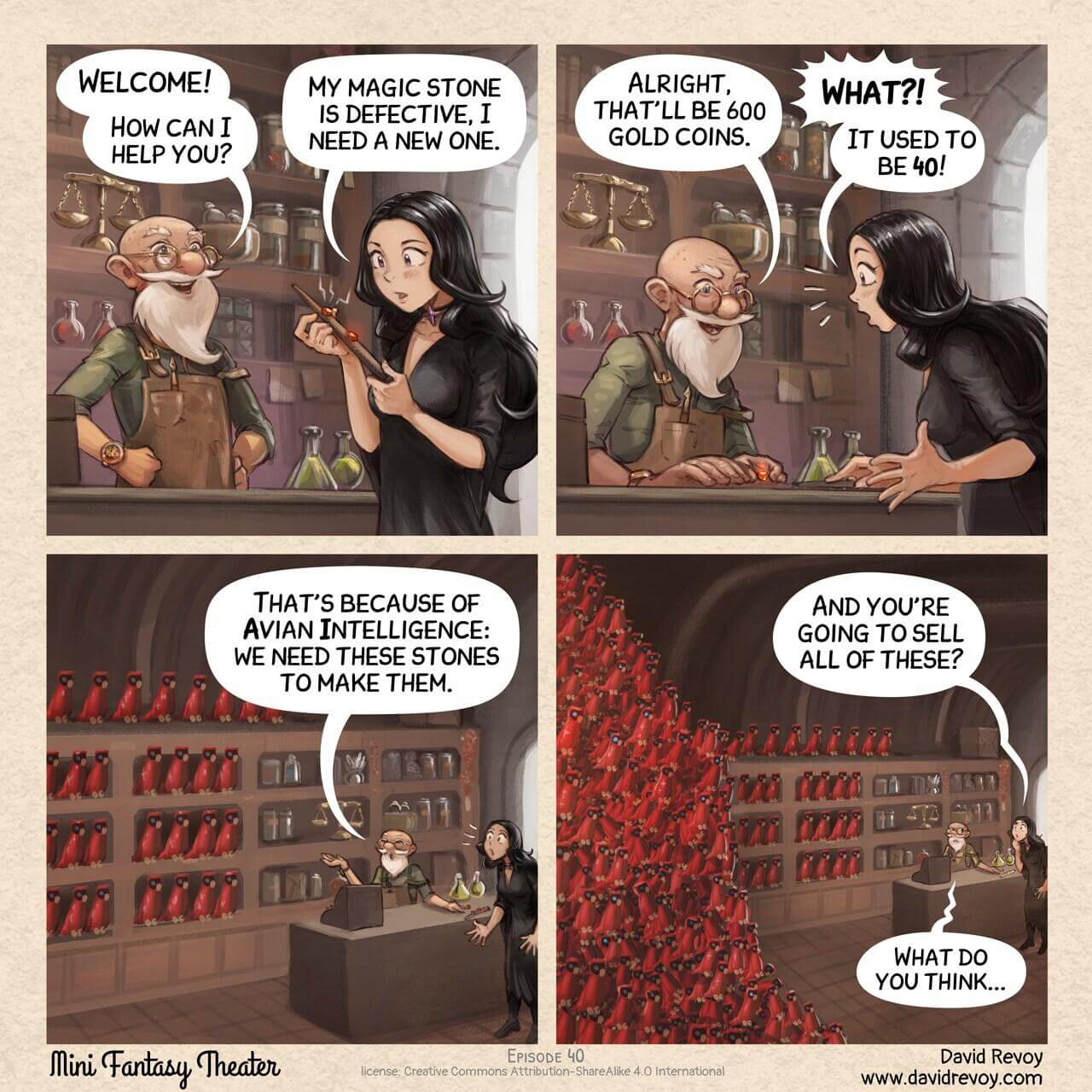

- Forbidding generative AI and LLMs on Pepper&Carrot (davidrevoy.com)

- L’administration fiscale dit non à Microsoft et choisit Linux ! (generation-nt.com)

Retrouvez les revues de web précédentes dans la catégorie Libre Veille du Framablog.

Les articles, commentaires et autres images qui composent ces « Khrys’presso » n’engagent que moi (Khrys).

10.03.2026 à 08:44

Agent automate et insoumission : faut-il désynchroniser ?

Framatophe

Texte intégral (2936 mots)

L’émergence contemporaine de l’intelligence artificielle, et plus spécifiquement son glissement vers l’agent autonome, marque une rupture épistémologique que la pensée critique ne peut plus ignorer sous peine de sombrer dans l’anachronisme. Nous avons quitté l’ère du programme-outil pour celle de l’opérateur capable de naviguer, de manipuler et de s’autocorriger. Cette mutation n’est pas une simple avancée incrémentale, mais l’aboutissement d’une trajectoire historique dont il faut saisir la profondeur pour armer notre résistance. Ce billet est surtout prospectif, il ne relève pas d’une pensée aboutie et encore moins prescriptive.

Éviter l’anachronisme

Historiquement, la machine était conçue comme une extension de l’organe ou une prothèse de l’intellect. C’est le concept d’outil chez Simondon. Ce dernier montrait que l’évolution technique tend vers la concrétisation : la machine devient de plus en plus cohérente en elle-même, la fonction implique la transformation de la machine (l’idée du progrès au XVIIIe siècle). Avec l’IA contemporaine (oui, parce qu’on parle d’IA depuis bien, bien longtemps), on quitte le stade de la simple prothèse (qui exécute une commande) pour entrer dans celui de l’agent (qui interprète une intention et produit une stratégie). La machine n’est plus seulement au bout de l’esprit, elle commence à occuper l’espace de la décision intermédiaire.

L’agentivité autonome actuelle rompt avec la linéarité qu’on tend généralement à supposer lorsqu’on parle d’histoire des techniques (si on n’est pas historien des techniques, la plupart du temps, c’est ainsi qu’on voit les choses). Le système technique n’est plus un simple intermédiaire entre une intention et un résultat, mais un dispositif capable de définir ses propres sous-objectifs et de corriger ses trajectoires d’exécution en temps réel. Cette autonomie opérationnelle déplace le curseur de la décision, créant un système technique où l’opérateur humain intervient par la consigne de haut niveau plutôt que par le pilotage de précision. Et le paradoxe, c’est que ce faisant, nous créons un système hiérarchique radical dans lequel la plupart des opérateurs humains deviennent eux-mêmes des rouages, lorsque par exemple l’algorithme impose sa loi au livreur, au manutentionnaire, au vendeur. Toutes les professions, y compris les plus intellectuelles, sont désormais destinées à produire ce que Cory Doctorow nomme des centaures inversés.

La violence technologique que je mentionne ces derniers temps dans mes écrits m’inspirant de la pensée de Detlef Hartmann, se superpose à cette lecture. Dans le capitalisme industriel, les individus sont dépossédés de leur autonomie et rendus étrangers à leur propre activité. Dès les années 1970-1980, cette logique d’aliénation s’étend de la production industrielle à la production symbolique et intellectuelle par l’informatisation des tâches, toujours au service du contrôle et de la rationalisation capitalistes. La violence technologique prolonge ainsi la violence structurelle du capital en cherchant à formater les dimensions qualitatives de l’existence humaine (l’intuition, l’émotion, l’imaginaire) selon les exigences d’un ordre rationnel formel. Cette normalisation constitue une violence en ce qu’elle privilégie l’accumulation et le contrôle, réduit la richesse des facultés humaines à des catégories limitées et entrave les pratiques d’émancipation ainsi que la capacité collective à transformer consciemment le monde.

L’introduction des agents dans le système technique numérique modifie la structure de la preuve et de la responsabilité technique. Dans le paradigme du logiciel classique, la réponse est déterministe et traçable dans le code. Avec les modèles d’action autonomes, le système procède par inférences probabilistes et par itérations imprévisibles sur des interfaces tierces. Cette opacité du processus décisionnel, cette boîte noire, remet en cause l’imaginaire de la maîtrise technique, où l’utilisateur est censé comprendre et contrôler chaque étape de la transformation du réel par la machine (même si dans bien des cas, c’est vraiment imaginaire).

En s’extrayant de la simple génération de texte pour interagir directement avec les systèmes d’exploitation et les réseaux, les modèles d’IA aujourd’hui créent un nouveau milieu. Elles deviennent des acteurs dans l’infrastructure numérique. Elles imposent une cohabitation dans laquelle les processus automatisés s’autoalimentent, réduisant ainsi la latence entre la conception et l’application, mais augmentant radicalement la complexité du système technique global.

L’anachronisme consiste à s’obstiner à analyser l’IA comme un simple automate sophistiqué. La spécificité de l’agent autonome réside dans sa capacité de planification et d’adaptation face à l’imprévu. Ignorer cette dimension conduit à une méprise sur la nature même de la puissance de calcul contemporaine : elle n’est plus seulement quantitative (vitesse de traitement), mais qualitative (capacité de médiation et de substitution dans des tâches cognitives et décisionnelles complexes).

Mechanical Head (The Spirit of Our Time), Raoul Hausmann (env. 1920). Wikipedia

L’IA dans l’histoire de l’arraisonnement technique

Pour comprendre l’IA, il faut l’inscrire dans l’histoire de l’informatisation des organisations amorcée dans les années 1960-1970. Nous sommes alors passés d’un moment technique à un autre, entre « faire travailler les machines » à notre place, à la constitution de « systèmes d’information ». Cela a transformé l’ordinateur en un pivot du management, visant la quantification du réel, et en particulier la productivité de l’homme et son comportement (marketing). Déjà à cette époque, le discours sur la « neutralité technique » servait de paravent à une volonté de monitoring social et de rationalisation productiviste.

Je ne peux m’empêcher de penser (c’est peut-être justement un réflexe anachronique, donc : prudence) que l’IA générative contemporaine marque l’aboutissement technique de ce que Marx nommait le « sujet automate » : un stade dans lequel le système de machinerie ne se contente plus d’assister l’homme, mais s’autonomise pour devenir un processus de production de valeur dont l’humain n’est plus que l’accessoire. Dans cette configuration, l’IA n’est plus un outil inerte, mais un agent capable de gérer ses propres itérations. Dans un récent article Matt Shumer (oui, encore un entrepreneur de l’IA, mais on peut aussi le lire, ce n’est pas inutile), mentionne le modèle GPT-5.3 Codex : la machine contribue désormais à sa propre création en déboguant son code de formation et en optimisant elle-même son déploiement. En fermant cette boucle de rétroaction, l’IA instaure un métabolisme technique qui s’autoalimente : elle écrit le code des générations futures, créant une accélération où la puissance de calcul se valorise elle-même.

Cette mutation transforme notre rôle : nous passons du statut d’opérateur pilotant une machine, ou d’opérateur annexe à la machine (le livreur surveillé par l’algorithme qui lui dit où déposer le colis et en combien de temps) à celui de simple fournisseur de ressources. À moins de faire partie d’une élite des big tech, nous sommes en train de passer du statut déjà peu enviable de périphérique biologique d’un système algorithmique à celui d’un terreau d’où le système extrait les données nécessaires à sa propre maintenance. Il en résulte une « seconde nature » technologique, telle que décrite par Jacques Ellul et Langdon Winner : un environnement si totalisant et si profondément imbriqué dans nos formes de vie qu’il devient invisible à nos yeux. Nous basculons alors dans un somnambulisme technologique, acceptant comme inéluctable un cadre de vie où la technologie dicte ses propres normes de fonctionnement1.

Le braconnage culturel est-il une impasse ?

Ces deux dernières années, je me suis appuyé sur deux concepts qui permettent de se figurer des méthodes d’émancipation de ce cadre de vie ainsi imposé. Celui de mètis repris de James Scott, dans L’œil de l’État, et celui de braconnage culturel, repris de Michel de Certeau, dans L’invention du quotidien (voir la troisième section de cet article). Autant mener résistance contre un système totalitaire par la ruse laisse au moins un horizon ouvert de techniques à tester et à éprouver (on pense par exemple au Fediverse et ses protocoles), autant les tactiques de M. de Certeau me semblent désormais quelque peu obsolètes. Que nous dit M. de Certeau ? Il nous parle des tactiques du quotidien qui permettent, par des usages imprévus, de détourner l’ordre imposé. J’y voyais comme lui autant d’actes possibles de résistance, comme détourner des objets de leurs finalités ordonnées par leur marchandisation. Souvenez-vous par exemple de la Pirate Box qu’il était possible d’installer sur un routeur TP-Link. Mais aujourd’hui, nous devons affronter quelque chose de beaucoup plus brutal : l’IA générative semble immunisée contre ce braconnage car elle ne se contente plus de prescrire un usage… elle l’absorbe.

Le braconnier joue sur les failles d’un système rigide. L’agent IA, lui, est par définition malléable et adore les déviations. Chaque tentative de détournement devient une nouvelle donnée d’entraînement, une itération supplémentaire qui permet au système de corriger ses erreurs et d’intégrer la subversion dans sa propre logique formelle. Le système se fiche du sens de votre révolte tant qu’il peut en modéliser le comportement. Le braconnage numérique risque donc de n’être qu’une collaboration involontaire à l’emprise algorithmique « voulez-vous que je vous aide à créer votre Pirate Box ? »

Quelle mètis pour l’insoumission ?

Dès lors, il ne s’agit plus de ruser dans le système, mais de ruser contre son intelligibilité. Notre mètis doit devenir une intelligence de la désynchronisation :

- Le sabotage de la prédictibilité : puisque le capitalisme de surveillance tend à une augmentation des degrés de certitude, l’insoumission passe par l’injection de « bruit » et l’entretien de zones de haute tension identitaire. On peut penser aux pratiques de data obfuscation. Il faut refuser la standardisation des subjectivités en multipliant les appartenances contradictoires que l’algorithme ne peut réduire à un profil de consommation cohérent. Hélas, le principal biais de cette approche, c’est l’épuisement à transformer notre quotidien en lutte permanente, coûteuse et aux résultats incertains, contre des machines qui, elles, ne s’épuisent pas. Reste à s’appuyer sur le droit et les garde-fous de type RGPD et AI-Act… suffiront-ils ? j’ai des doutes.

- Désynchroniser nos pratiques de l’ordre imposé : face à l’agent qui navigue pour nous, la ruse consiste à restaurer notre propre encapacitation par le recours aux Communs numériques et aux low-tech. C’est une forme de « désapprentissage » de la dépendance. L’objectif est de reconstruire des espaces d’autonomie technique où l’on refuse la médiation de l’agent propriétaire. Là, le logiciel libre a toutes ses cartes à jouer, et c’est maintenant ! il est presque déjà trop tard. À trop dénigrer les LLM et les services qui emmerdifient le web, nous avons laissé passer le train de l’adoption des usages : la seule solution consiste selon moi à utiliser les modèles existant et les détourner. C’est une réminiscence du braconnage culturel que je mentionnais plus haut, sauf qu’ici, il s’agit d’un geste technique, qui implique des communautés, et non plus le quotidien personnel de chacun de nous. Nous devons braconner ensemble. De petits LLM à l’usage concret et frugal.

- L’action préfigurative : j’en parle dans ce billet. Il s’agit de créer des « archipels » de liberté numérique qui échappent physiquement et logiquement au contrôle centralisé. Cela revient à refuser le somnambulisme technologique en organisant des espaces dans lesquels la créativité, le partage et la solidarité redeviennent les mesures de l’intérêt du monde numérique.

En acceptant les modèles d’IA comme des auxiliaires « pratiques », nous signons un contrat dont les clauses d’aliénation ne nous seront révélées qu’une fois que le verrouillage socio-technique sera total. Nous devons donc politiser non pas seulement l’usage, mais les conditions de possibilité de ces techniques. Si un système technique exige pour fonctionner une structure de commandement hiérarchique ou une extraction illimitée de données, il doit être combattu en tant qu’artefact intrinsèquement autoritaire. Notre mètis ne doit plus être celle du braconnier qui se cache dans la forêt, mais celle du constructeur d’une autre forêt, impénétrable (ou le moins possible).

Un monde sans les IA d’aujourd’hui (à moins d’une catastrophe) n’est plus envisageable. Et jamais, nous n’avons été autant dépossédés de notre cadre de vie. La menace est trop grande pour que nous puissions nous payer le luxe d’ignorer ou faire semblant d’éviter cet avancement technologique brutal et foudroyant. La question ne se limite plus à se demander si chacun d’entre nous utilise ou pas ces technologies. Elles s’imposent partout, et s’imposeront encore. Je ne vois donc qu’une seule possibilité : ruser. Ruser en utilisant ces techniques, en y opposant d’autres savoirs (et c’est en cela que la mètis est le miroir inversé de la technè) et en leur volant de la valeur. La transformer en commun. D’abord par la connaissance et la réappropriation cognitive, ensuite en désynchronisant l’usage de l’autorité.

Idées en vrac et à réfléchir ensemble :

- des SLM (Small Language Models) à usage concret et frugal (avec une sorte de Huggingface vraiment communautaire, spécialisation fine de type LoRA),

- des espaces numériques où la créativité redevient le moteur de la valeur ajoutée (un web off-line first, flux RSS, pages statiques, Fediverse),

- reformer un web à part, un web « des gens », sans usages imposés, et lui aussi frugal.

- Autres idées ? c’est le moment :)

- Je reprends ici deux expressions de Langdon Winner, dans La baleine et le réacteur, dont je conseille vivement la lecture.↩︎

Image d’entête de l’article : Parallax Immersion, de Thomas Canto, par Alessandra Ioalè, 2014 (source).

09.03.2026 à 07:42

Khrys’presso du lundi 9 mars 2026

Khrys

Texte intégral (9738 mots)

Comme chaque lundi, un coup d’œil dans le rétroviseur pour découvrir les informations que vous avez peut-être ratées la semaine dernière.

Tous les liens listés ci-dessous sont a priori accessibles librement. Si ce n’est pas le cas, pensez à activer votre bloqueur de javascript favori ou à passer en “mode lecture” (Firefox) ;-)

Brave New World

- Le réchauffement climatique s’emballe depuis 2015 (reporterre.net)

Si le rythme du réchauffement observé ces dix dernières années se maintient, le seuil de 1,5 °C fixé par l’Accord de Paris sera durablement dépassé avant 2030

- La montée des eaux est largement sous-estimée, selon une étude (reporterre.net)

La montée du niveau des océans est sous-estimée d’environ 0,3 mètre en moyenne, selon une étude de deux chercheureuses de l’Université de Wageningue aux Pays-Bas publiée mercredi 4 mars dans la revue Nature. À plusieurs endroits comme les régions d’Asie du Sud-Est et du Pacifique, déjà très exposées aux inondations et au risque de submersion, les écarts pourraient même atteindre 1 à 1,5 mètre. Pour parvenir à de telles conclusions, les scientifiques ont analysé 385 études sur l’exposition côtière et l’évaluation des risques publiées entre 2009 et 2025 ainsi que des données satellitaires. Ils se sont rendu compte que la majorité de ces études utilisaient une méthodologie qui prenait en compte la gravité et la rotation de la Terre, mais pas les marées, les courants ni les vents. Résultat : la mer a été mesurée comme si elle était toujours calme.

- Pire que la clope, la chaise (lagedefaire-lejournal.fr))

Selon l’OMS, la sédentarité est devenue le premier facteur de mortalité prématurée évitable, devant le tabac. Une épidémie mondiale qui tient à nos modes de vie où travail, loisirs et déplacements se font de plus en plus souvent en position assise.

- Qualcomm CEO : ‘Resistance is futile’ as 6G mobile revolution approaches (fortune.com)

- Global economy must stop pandering to ‘frivolous desires of ultra-rich’, says UN expert (theguardian.com)

- Ultratechnologique et pronucléaire… La Chine lance son plan quinquennal (reporterre.net)

- China Enacts Sweeping Secrecy Law in Uyghur Region to Silence Witnesses and Bury Evidence of Crimes (uyghurtimes.com)

A new law is in effect in Uyghur region — and it tells government workers what they cannot say, where they cannot travel, and who they cannot talk to, for the rest of their lives if necessary.

- De Telegram à la prison : le Kremlin criminalise la vie quotidienne des Russes (legrandcontinent.eu)

Chanter dans la rue, partager des messages ou des photos sur Telegram : dans la Russie de Poutine, des pratiques autrefois banales sont devenues des crimes punis par un État répressif.

- En Europe, les ferries émettent autant de CO2 que 6,6 millions de voitures (reporterre.net)

Les ferries émettent chaque année, dans les seuls ports européens, autant de CO2 que 6,6 millions de voitures. Soit 13,4 millions de tonnes de CO2 estimées en 2023. C’est l’un des chiffres phares qui ressort du rapport publié le 3 mars par l’ONG Transport & Environment (T&E).

- Des chercheurs alertent sur les dangers de la généralisation de la vérification d’âge (next.ink)

Dans une lettre ouverte, 371 chercheuses et chercheurs de 30 pays s’opposent à la généralisation de la vérification d’âge imposée aux différents services en ligne par de nombreuses législations dans le monde sans que les implications sur la sécurité, la vie privée, l’égalité et la liberté aient été prises en compte.

Voir aussi Publication d’une lettre ouverte contre les lois imposant la vérification d’âge sur les sites, notamment signée par des experts en cybersécurité. (csa-scientist-open-letter.org)

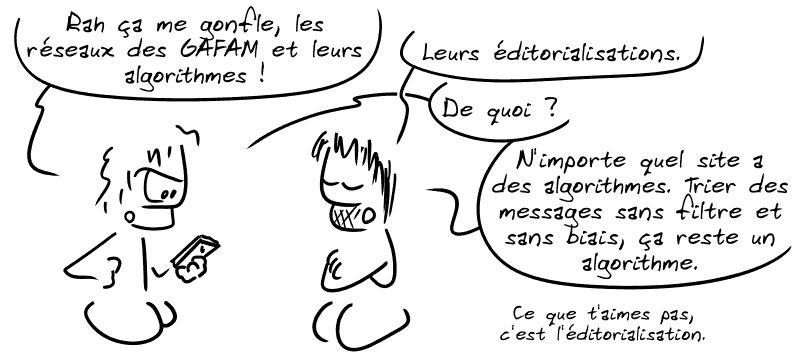

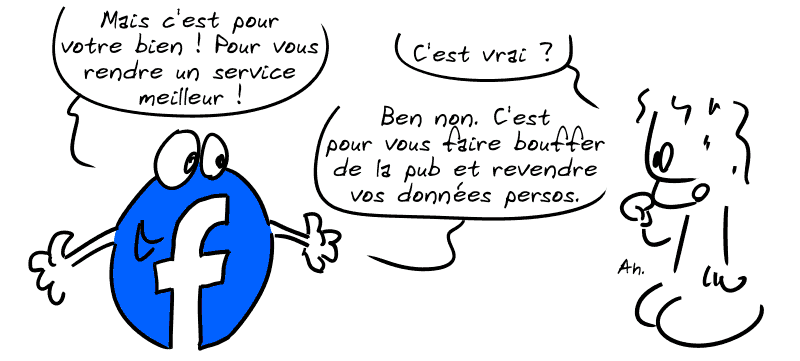

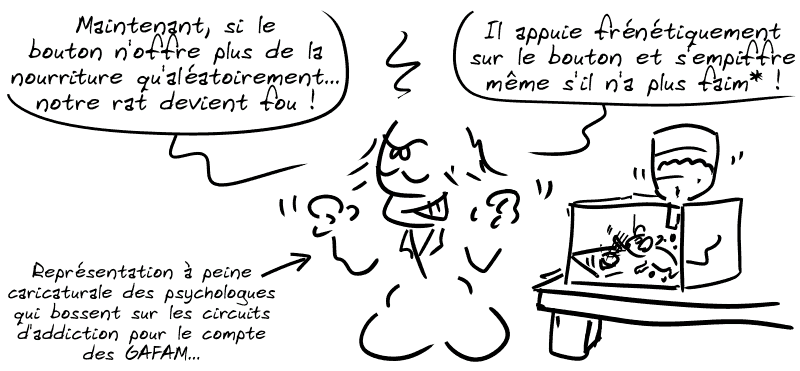

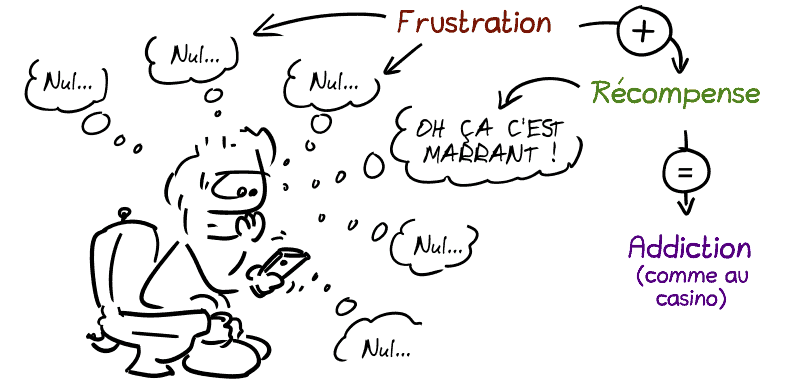

- Réseaux sociaux addictifs : l’offensive des Big Tech à Bruxelles (multinationales.org) – voir aussi Addicted to the algorithm (corporateeurope.org)

How Big Tech lobbies to keep us hooked on social media

- The Government Uses Targeted Advertising to Track Your Location. Here’s What We Need to Do. (eff.org)

We’ve all had the unsettling experience of seeing an ad online that reveals just how much advertisers know about our lives. You’re right to be disturbed. Those very same online ad systems have been used by the government to warrantlessly track peoples’ locations, new reporting has confirmed.

- « À court de larmes » : traumatisés par le scandale des PFAS, les États-Unis cherchent une issue (reporterre.net)

- Procédure bâillon : la condamnation de Greenpeace confirmée, l’ONG risque la banqueroute aux États-Unis (humanite.fr)

- États-Unis : le Kansas, champion de la transphobie (politis.fr)

- Un « Walk of shame » sur l’affaire Epstein apparaît dans ce parc de Washington (huffingtonpost.fr)

Des étoiles aux noms de Jeffrey Epstein, Ghislaine Maxwell, Bill Clinton, Bill Gates ou encore le Prince Andrew ont été installées près de la Maison-Blanche.[…] Une étoile à l’effigie d’Elon Musk, le patron de Tesla, aurait également été placée sur le « Chemin de la Honte », mais elle a rapidement été arrachée.

- Des activistes autochtones empêchent la privatisation des fleuves en Amazonie (basta.media)

Après 33 jours de mobilisations, des centaines de militantEs autochtones ont mis fin à un projet de privatisation de voies navigables au Brésil qui aurait bénéficié au géant du négoce états-unien Cargill.

- Après la fuite d’un gazoduc, le Pérou en état de crise énergétique (humanite.fr)

Le gouvernement péruvien a mis en place des restrictions d’usage du gaz naturel et du carburant après un incident survenu dimanche 1er mars sur un pipeline du sud du pays andin. Dans plusieurs régions, les files d’attente se multiplient devant les stations-service.

- Des chercheureuses ont mis des tardigrades dans du sol martien, ils n’ont pas du tout apprécié (slate.fr)

RIP

- Remembering ‘Diamond’ Dave Whitaker (missionlocal.org)

- “Diamond” Dave Whitaker (80over80sf.org)

Diamond Dave should need no introduction. He is a literal legend of the beatnik and hippie era. He knows all the “hipstory” there is to tell. He was one of the people who set Bob Dylan on his path in life. He was one of the first radio hosts on KPOO.

Spécial IA

- Iran War Provides a Large-Scale Test For AI-Assisted Warfare (tech.slashdot.org)

- Pentagon Refuses to Say If AI Was Used to Select Elementary School as Bombing Target (futurism.com)

- OpenAI Blurs Its Mass Surveillance Red Line With New Pentagon Contract (forbes.com)

Anthropic saw a surveillance problem and walked. OpenAI saw an opportunity and signed. Now, Sam Altman is under fire for struggling to explain how OpenAI’s contract is any safer.

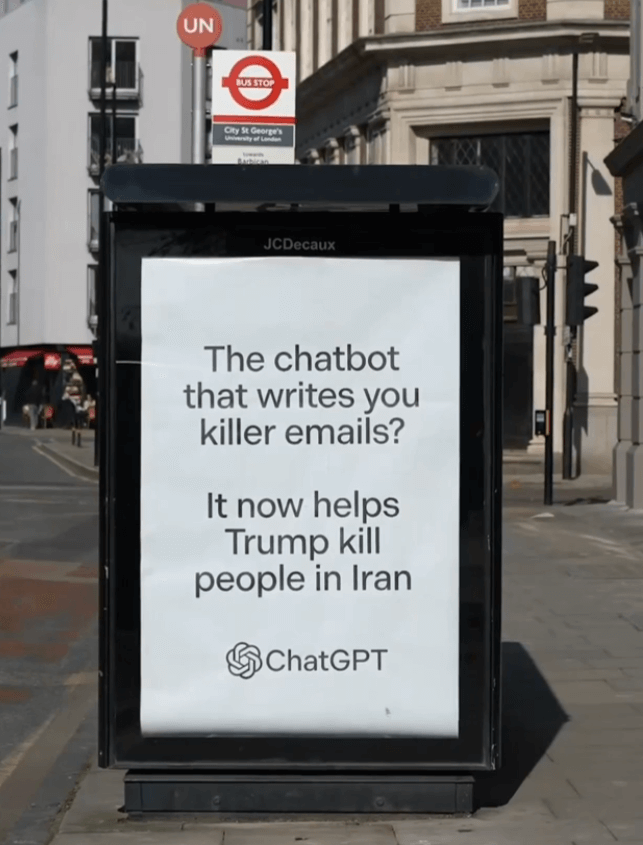

- Quit ChatGPT : right now ! Your subscription is bankrolling authoritarianism (theguardian.com) – voir aussi “Ne soutenez pas ce régime fasciste” : le boycott de ChatGPT prend de l’ampleur, plus d’un million de personnes ont déjà rejoint QuitGPT (lesnumeriques.com) et ChatGPT uninstalls surged by 295 % after DoD deal (techcrunch.com)

- Anthropic’s Claude grabs top spot in App Store after Trump’s ban (engadget.com)

The AI chatbot topped OpenAI’s ChatGPT app on Apple’s charts for “free” apps.

- OpenAI amends Pentagon deal as Sam Altman admits it looks ‘sloppy’ (theguardian.com)

ChatGPT owner’s CEO says it will bar its technology being used for mass surveillance or by intelligence services

- Altman said no to military AI abuses – then signed Pentagon deal anyway (theregister.com)

OpenAI CEO’s principles lasted about 12 hours before $200M check arrived

- Derrière la polémique entre Trump et Anthropic, les enjeux de l’usage militaire de l’IA (next.ink)

Claude d’Anthropic a été utilisé par l’armée des États-Unis dans son attaque de l’Iran. Alors que le CEO de l’entreprise s’y oppose depuis quelques jours, le moment révèle à la fois le nouveau palier que l’industrie de l’IA a franchi dans le déploiement de ses technologies et la tentative de maîtrise du secteur par le gouvernement des États-Unis.

- Microsoft gets tired of “Microslop,” bans the word on its Discord, then locks the server after backlash (windowslatest.com)

Microsoft’s aggressive AI push in Windows 11 through 2025 brought upon themselves the title Microslop. Unfortunately for the company, it’s everywhere on social media, and there isn’t a way to stop the spread, unless, of course, it’s their own Discord server.

- Hackerbot-claw : un bot exploite GitHub Actions et vide le dépôt de Trivy (next.ink)

Un bot alimenté a utilisé les GitHub Actions pour compromettre des dépôts GitHub. Ironie du sort, il a piraté un scanner de sécurité (vulnérabilité, mauvaises configurations…), publié une extension VS Code malveillante et renommé le dépôt (en privé).

- OpenAI is developing alternative to Microsoft’s GitHub (reuters.com)

- Your LLM Doesn’t Write Correct Code. It Writes Plausible Code. (blog.katanaquant.com)

- AI Translations Are Adding ‘Hallucinations’ to Wikipedia Articles (404media.co)

- The world’s most unreliable encyclopaedia : Elon Musk’s AI Wikipedia alternative is distorting the truth about Northern Ireland, defaming, and perversely altering history (belfasttelegraph.co.uk)

From Bloody Sunday to RHI, Gerry Adams, Bobby Sands, and Michael Stone, Elon Musk’s Grokipedia is spreading dangerous lies about Northern Ireland.

- Musk fails to block California data disclosure law he fears will ruin xAI (arstechnica.com)

Musk can’t convince judge public doesn’t care about where AI training data comes from.

- Comment les entreprises de la tech nous forcent à utiliser l’IA (limitesnumeriques.fr)

- Qui sont les spin doctors de la tech qui influencent le pape sur l’IA ? (synthmedia.fr)

- AI-generated art can’t be copyrighted after Supreme Court declines to review the rule (theverge.com)

The country’s highest judicial court won’t reconsider a decision that determined AI-created art is ineligible for copyright protection.

- L’IA en route vers un krach historique ? Un ex-patron de Goldman Sachs tire la sonnette d’alarme (slate.fr)

Face aux investissements records observés dans le domaine de l’intelligence artificielle, l’expert financier Lloyd Blankfein redoute une bulle spéculative et voit dans l’emballement actuel les prémices d’une crise comme celle des subprimes en 2008.

Spécial guerres en Iran, au Liban, en Palestine…

- Hacked Tehran traffic cameras fed Israeli intelligence before strike on Khamenei (calcalistech.com)

- La guerre en Iran a changé d’échelle : 5 points pour comprendre l’essentiel de ce qui se passe depuis hier au Moyen-Orient (legrandcontinent.eu)

- Cartographier les frappes à Téhéran, en Iran et au Moyen-Orient : que s’est-il passé depuis hier ? (legrandcontinent.eu)

- Pourquoi l’Iran a‑t‑il frappé plusieurs États du Golfe ? (theconversation.com)

Les frappes conjointes américano-israéliennes contre l’Iran au cours du week-end ont de nouveau plongé la région dans la guerre et ont entraîné la mort du guide suprême iranien. L’Iran a riposté par des salves de missiles balistiques et de drones visant Israël, mais aussi plusieurs de ses voisins du Golfe persique.

- L’eau potable : le talon d’Achille des pays du Golfe face aux frappes iraniennes ? (legrandcontinent.eu)

Alors que les stocks de missiles intercepteurs diminuent sous l’effet de la guerre d’usure menée par Téhéran, le régime iranien pourrait, pour intensifier l’escalade, élargir ses frappes au-delà des infrastructures énergétiques et commencer à cibler des infrastructures civiles vitales, telles que les usines de dessalement d’eau.

- Amazon cloud unit’s data centers in UAE, Bahrain damaged in drone strikes (reuters.com)

- De Gaza à l’Iran, la loi du plus fort s’impose (orientxxi.info)

- Israël envahit le Liban et ordonne l’évacuation de la banlieue sud de Beyrouth, stop à l’agression ! (revolutionpermanente.fr)

Depuis le 2 mars Israël a rouvert le front de guerre avec le Liban. Le pays a ordonné l’évacuation de 8 % du territoire libanais et pourrait lancer une offensive terrestre d’ampleur, tandis qu’il ordonne l’évacuation du sud du pays et de l’intégralité de la banlieue sud de Beyrouth. De son côté, le gouvernement libanais s’est montré volontaire dans la collaboration active avec Israël.

- Israël se prépare à une invasion en profondeur du territoire libanais (legrandcontinent.eu)

- L’armée israélienne à nouveau accusée d’utiliser du phosphore blanc dans ses bombardements au sud du Liban (libnanews.com)

- L’extension territoriale d’Israël depuis octobre 2023 (orientxxi.info)

- Forty nations meet in The Hague to discuss measures against Israel’s West Bank annexation (middleeasteye.net)

The Hague Group conference pledges to ensure accountability for international crimes and prevent arms and material support from reaching Israel

- U.S. Troops Were Told Iran War Is for “Armageddon,” Return of Jesus (jonathanlarsen.substack.com)

Advocacy group reports commanders giving similar messages at more than 30 installations in every branch of the military

- Après avoir laissé entendre l’inverse, Trump assure ne pas avoir été entraîné par Israël dans la guerre contre l’Iran (huffingtonpost.fr)

- Rubio Says US Had to Strike Iran Because Iran Would Defend Itself If Attacked (truthout.org)

a circular explanation that appeared to pass the buck for the aggression to Israel, despite reports that Israeli leaders have been coordinating a joint attack with the U.S. for months.

- Lack of a clear Iran plan could suck US into a long conflict : ‘Where does this go ?’ (theguardian.com)

- Iran war : Will Europe’s split on US strikes backfire ? (dw.com)

Spain says the US and Israel have breached international law, Germany says it’s no time to lecture allies. Even legal experts are split. Critics warn that reluctance to call out unlawful conduct could come back to bite.

- Guerre en Iran : à quoi va servir le déploiement du porte-avions Charles de Gaulle en Méditerranée ? (huffingtonpost.fr)

- Donald Trump menace d’arrêter le commerce avec l’Espagne, après que celle-ci a refusé à l’aviation américaine l’accès à des bases militaires (lemonde.fr)

Le président américain reproche également à Madrid de « n’avoir pas accepté de consacrer 5 % » de son PIB à des dépenses en matière de défense, comme le veut le nouvel objectif de l’OTAN.

- Frappes au Moyen-Orient : les prix du pétrole déjà affectés (reporterre.net)

Les frappes étasuniennes et israéliennes au Moyen-Orient affectent déjà le cours du pétrole. De quoi interroger la dépendance mondiale à l’or noir, et pousser une transition énergétique et des infrastructures locales et résilientes.

- Guerre au Moyen-Orient : Wall Street flanche dans le sillage des Bourses européennes (france24.com)

- Iran : comment le détroit d’Ormuz peut bloquer l’économie mondiale (bonpote.com)

Spécial femmes dans le monde

- Le changement climatique exacerbe les violences contre les femmes (reporterre.net)

- Two Ugandan women detained after allegedly kissing in public (bbc.com)

- Epstein files show a financier obsessed with excluding women from science and tech (plus.flux.community)

Thousands of released documents show how infamous sex criminal used his riches to fund misogyny and suppress female researchers

- DOJ admits 47,635 Epstein files – including Trump allegations – were removed (independent.co.uk)

- De Washington aux pays du Sud : l’offensive anti-genre et anti-avortement (cetri.be)

Le vice-président des États Unis JD Vance durcit sa croisade anti genre et anti-avortement et compte désormais l’exporter vers les pays du Sud. L’extension inédite de la « Règle du bâillon mondial » et l’activisme autour de la « Déclaration du consensus de Genève » créent un nouveau cadre politique et financier qui remplace peu à peu les politiques de santé publique par des programmes anti-genre.

- Femmes et cyberviolences (1/4) : un état des lieux documenté, genré, et difficile à ignorer (clubic.com)

- Meta-prédateurs : quand la Silicon Valley réarme le harcèlement de rue (synthmedia.fr)

Faut-il vraiment parler d’innovation au sujet des montures connectées de Meta, ou plutôt d’une régression anti-féministe ?

- Féministes contre la marche à la guerre et l’armement des génocides (politis.fr)

Face au réarmement et à la militarisation des sociétés européennes, des militantes féministes et antiracistes alertent sur l’économie de guerre qui s’installe. Elles appellent à lier luttes sociales, décoloniales et antimilitaristes pour faire front contre le fascisme.

- Victoire de Ma Voix Mon Choix pour un avortement libre et gratuit dans l’UE (lesnouvellesnews.fr)

Grâce à l’initiative citoyenne Ma Voix Mon Choix, des fonds européens pourront désormais financer l’accès à l’IVG pour toutes les femmes, dans tous dans les pays de l’Union Européenne.

Voir aussi Les femmes européennes pourront désormais avorter gratuitement dans le pays membre de leur choix (lareleveetlapeste.fr)

C’est une magnifique victoire pour toutes les femmes de l’Union Européenne. Après trois ans de combat, le mouvement “Ma Voix Mon Choix”, et les 1,12 million de personnes ayant signé la pétition, ont obtenu une avancée majeure. La Commission européenne s’engage à utiliser des fonds européens pour permettre à toute femme de l’Union qui ne peux pas avorter dans son pays de le faire ailleurs en Europe. L’avortement, le suivi médical, les frais de transport. Tout pourra être gratuit ou remboursé selon la décision du pays d’accueil.

- Danish Women Are Fashion-Bombing Statues to Protest Most Statues Being Dead Guys (jezebel.com)

Women are knitting and crocheting clothes for the few female statues to make a wholesome statement about the country’s monuments.

- L’économie féministe depuis l’Argentine et Abya Yala (contretemps.eu)

Au printemps 2025 se sont tenues les rencontres d’économie féministe d’Abya Yala, à Buenos Aires. Abya Yala signifie “notre terre” en langue du peuple originaire Kuna ; il est utilisé en remplacement de terme colonial “Amérique”. Avec Corina Rodríguez Enríquez et Flora Partenio, toutes deux chercheuses impliquées dans ces élaborations, nous revenons sur les enjeux de l’économie féministe, notamment depuis Abya Yala.

- Coopération internationale, les femmes doivent accéder au pouvoir (humanite.fr)

Luc Arnaud, Directeur général du Gret, ONG de solidarité internationale plaide pour une transformation des modes de délibération collective afin qu’ils contribuent à l’égalité entre les femmes et les hommes en permettant aux femmes d’accéder au pouvoir de décision.

Spécial France

- Aux Municipales, on ne vote pas pour un maire. Voici un guide simple pour comprendre le scrutin de liste (france3-regions.franceinfo.fr)

- Tous les ennuis judiciaires de Rachida Dati sont répertoriés sur ce site, et ça l’agace beaucoup (huffingtonpost.fr)

- YGGtorrent – Fin de partie (yggleak.top)

Détournement de cartes bancaires et fingerprinting abusif de ses 6.6 millions d’utilisateurs, DDoS des concurrents, blanchiment de millions d’euros via des montages sophistiqués, fausses identités fabriquées à partir de CNI volées. Dans ce leak vous allez découvrir les coulisses du plus gros tracker torrent francophone.

- Un piratage lié à l’Office français de l’immigration a permis de voler des données (kulturegeek.fr)

Une cyberattaque ciblant un sous-traitant de l’OFII a exposé les données personnelles de milliers de ressortissants étrangers en France. L’organisme confirme le vol et annonce une plainte.

- « Ce médicament, c’est une bombe nucléaire » : des victimes des fluoroquinolones témoignent (politis.fr)

Face aux douleurs et au déni du monde médical, les victimes des fluoroquinolones se battent. Pour être reconnues, soignées, et obtenir réparation.

- Dégâts « irréversibles » : une usine de ballons dirigeables s’apprête à détruire des zones humides (reporterre.net)

- Les mares ne pourront pas être transformées en bassines agricoles, tranche le Conseil d’État (reporterre.net)

- Pollution aux PFAS dans les champs : « Le monde agricole va tomber de haut » (disclose.ngo)

Spécial femmes en France

- La justice reconnaît le lien direct entre cancer du sein et travail de nuit (humanite.fr)

Ce 3 mars, le tribunal administratif de Marseille a reconnu que le cancer du sein d’une infirmière était une maladie professionnelle, après avoir travaillé de nuit pendant plus de 20 ans.

- Le « gender gap » se creuse chez les adolescent·es (lesnouvellesnews.fr)

Une étude de l’Ifop alerte : un « clivage de genre béant » s’ouvre entre les adolescent·es. Les filles sont plus féministes que les garçons. Et, face au masculinisme montant, le retard de l’éducation féministe à la vie affective et sexuelle laisse l’écart se creuser.

- Sexisme dans les médias : environ 75 % des personnes mentionnées dans les articles sont des hommes (reporterre.net)

- Métiers artistiques : les écarts de revenus entre femmes et hommes se creusent (lesnouvellesnews.fr)

Le Syndicat national des Artistes Plasticien.nes dénonce la précarité des métiers des arts visuels et graphiques. Pire : les écarts de revenus entre les femmes et les hommes se creusent. Focus sur l’industrie de la bande dessinée où les autrices gagnent en moyenne deux fois moins que leurs confrères.

- Municipales : en tête de liste, les femmes très largement sous-représentées, surtout à droite (politis.fr)

Le ministère de l’Intérieur a publié l’intégralité des listes qui se présentent aux élections municipales. Et le constat est sans appel : la très grande majorité des têtes de liste sont des hommes. Et même quand les femmes le sont, elles ont moins de chance d’être élues.

- Fiona Texeire : « Il existe encore des conseils municipaux 100 % masculins » (revueladeferlante.fr)

Pour la première fois, lors des élections municipales des 15 et 22 mars prochains, l’obligation de parité concernera aussi les listes présentées dans les communes de moins de 1 000 habitant·es.

- Pour des villes féministes : ces communes qui montrent l’exemple (oxfamfrance.org)