15.12.2025 à 16:24

Rythmes scolaires : des pauses actives pour repenser les journées de classe et lutter contre la sédentarité

Sylvain Wagnon, Professeur des universités en sciences de l'éducation, Faculté d'éducation, Université de Montpellier

Rémi Richard, Maître de Conférences en sociologie du sport et du handicap, Université de Montpellier

Sihame Chkair, Docteure et chercheure en économie de la santé et en sciences de l'éducation, Université de Montpellier

Texte intégral (1750 mots)

Le rapport de la Convention citoyenne sur les temps de l’enfant publié en cette fin d’année 2025 rappelle que les rythmes scolaires actuels ne sont pas bien en phase avec les besoins des enfants. Proposer régulièrement à ces derniers des pauses actives ne serait-il pas un levier prometteur pour réinventer les journées de classe ?

Rendu public le 22 novembre 2025, le rapport de la Convention citoyenne sur les temps de l’enfant a rappelé que l’organisation de la journée scolaire française reste peu adaptée aux rythmes biologiques et cognitifs des élèves.

Il appelle à une réforme d’ampleur des rythmes scolaires, invitant à repenser non seulement les horaires, mais aussi la manière dont se répartissent attention, repos, mouvement et apprentissages. Dans cette perspective, proposer aux élèves des pauses actives (c’est-à-dire de courtes périodes d’exercices physiques, échauffements ou encore relaxation au fil de la journée) ne serait-il pas un levier particulièrement prometteur ?

Augmenter l’activité physique des enfants, une urgence de santé publique

En 2024 en France, seuls 33 % des filles et 51 % des garçons de 6 à 17 ans atteignent les recommandations de l’Organisation mondiale de la santé (OMS) : au moins 60 minutes d’activité physique quotidienne d’intensité modérée à soutenue. Parallèlement, entre la classe et les transports, les repas et les temps d’écran, ils restent de longues heures sédentaires.

Cette réalité interroge particulièrement l’école : comment maintenir l’attention d’élèves contraints à rester immobiles de longues heures ? Comment prévenir les troubles de l’attention, fatigue ou anxiété. Des questions d’autant plus urgentes du fait que le système scolaire français fait partie de ceux qui enregistrent le plus grand nombre d’heures de classe données aux enfants durant toute leur scolarité,

Une précision avant de poursuivre : attention à ne pas confondre sédentarité et manque d’activité physique.

La sédentarité correspond au temps passé, assis ou allongé éveillé, avec une dépense énergétique très faible. On peut donc être physiquement actif selon les recommandations de l’OMS (par exemple courir trois fois par semaine), tout en étant très sédentaire si l’on reste assis plus de huit heures par jour. À l’inverse, l’inactivité physique signifie ne pas atteindre les seuils d’activité physique recommandés (au moins 150 minutes hebdomadaires d’intensité modérée).

Ces deux dimensions interagissent mais ne se confondent pas, comme le rappelle le Guide des connaissances sur l’activité physique et la sédentarité publié par la Haute Autorité de Santé en 2022.

Relativement récente en santé publique, cette distinction ne s’est imposée qu’au cours des années 2000, lorsque les grandes enquêtes ont montré que les risques liés à la sédentarité (diabète, maladies cardiovasculaires, certains cancers) existaient indépendamment du manque d’activité physique.

Les pauses actives : bouger quelques minutes ensemble

La pause active désigne un court moment de 5 à 15 minutes de mobilisation physique, intégrée directement dans le temps d’apprentissage ou de travail. Elle se déroule en quatre phases : échauffement, exercice cardio ou moteur, activité de coordination ou d’équilibre, retour au calme par étirements ou respiration.

Elle ne nécessite ni salle dédiée ni matériel particulier. Son efficacité repose sur la régularité : plusieurs fois par jour, entre deux séquences de travail ou d’apprentissage. Si les formes peuvent varier selon les contextes et les âges, il convient de ne pas les confondre avec les temps de recréation, de motricité ou d’éducation physique.

Depuis, de nombreuses études ont confirmé que l’activité physique stimule la plasticité cérébrale et la mémoire. Des études en psychologie cognitive démontrent que quelques minutes de mouvement suffisent à relancer l’attention soutenue et la concentration. La santé publique établit que rompre la sédentarité réduit le stress et prévient les troubles musculosquelettiques.

À l’école : apprendre mieux en bougeant

Depuis une dizaine d’années, les études et les expériences menées au Québec dans la cadre du projet À mon école, on s’active soulignent l’importance de ce type d’activités. En France le ministère de l’éducation nationale français a fait le choix des activités physiques quotidiennes (APQ) pour que chaque élève du premier degré bénéficie d’au moins 30 minutes d’activité physique quotidienne à l’école primaire. Cette mesure lancée, à la rentrée 2022, par le gouvernement, n’est appliquée que par 42 % des écoles primaires, selon un rapport sénatorial de septembre 2024.

Ce dispositif contribue à limiter le manque d’activité physique, mais ne réduit pas nécessairement la sédentarité. Les recommandations françaises actualisées en 2016 distinguent clairement ces deux dimensions : les bénéfices d’une pratique régulière d’activité physique ne compensent pas toujours les effets délétères du temps passé assis. Pour être efficaces, les politiques éducatives doivent donc agir à la fois sur l’augmentation du volume d’activité et sur la réduction des périodes prolongées d’immobilité. La mission flash sur l’activité physique et sportive et la prévention de l’obésité en milieu scolaire d’avril 2025 a réaffirmé l’urgence d’une politique éducative généralisée.

Dans ce contexte, les pauses actives sont présentées comme un moyen complémentaire : elles doivent améliorer la concentration et la mémorisation, réduisent l’agitation pour faciliter la gestion des comportements et le climat scolaire.

Les pauses actives ne peuvent être des activités isolées du reste des apprentissages, elles sont partie prenante d’une éducation intégrale, qui prend en compte non seulement la tête (l’intellect), mais aussi le corps (mouvement, coordination) et le cœur (gestion des émotions). Une vision théorisée par le pédagogue libertaire Paul Robin au milieu du XIXe siècle et qui pourrait être reprise par l’école publique laïque.

Une révolution dans notre rapport au temps

Comme le précise le rapport de la convention citoyenne sur les temps de l’enfant de novembre 2025, les journées des élèves doivent être repensées dans leur globalité, en rééquilibrant sollicitations intellectuelles, besoins physiques et temps de repos.

Intégrer les pauses actives dans les routines quotidiennes ne relève pas d’un gadget, mais d’une transformation profonde de nos manières de travailler et d’apprendre. Elles réintroduisent le rythme, la respiration et le mouvement comme conditions de toute activité intellectuelle. Une question déjà bien étudiée à l’université ou dans le monde professionnel où les pauses actives se développent.

À lire aussi : Bouger pour mieux apprendre : Comment lutter contre la sédentarité à l’école

Avec les pauses destinées au silence, à la rêverie ou au repos, elles dessinent une véritable écologie du temps, plus respectueuse des besoins humains.

Ces pauses actives à l’école constituent une première étape. Aller plus loin impliquerait d’intégrer le mouvement au cœur même des apprentissages, par exemple grâce au mobilier actif ou encore à des démarches pédagogiques qui associent marche et apprentissage.

La lutte contre la sédentarité pourrait alors devenir l’occasion de repenser plus largement nos modalités éducatives, en valorisant une approche où l’attention, le corps et le savoir évoluent dans l’ensemble des espaces scolaires. Promouvoir ces pratiques, c’est faire le choix d’une société qui prévient plutôt qu’une société qui tente de réparer et qui cultive l’attention plutôt que de l’épuiser.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

15.12.2025 à 16:14

Et si la nature brillait plus que ce que nous voyons ? À la découverte de la vie fluo

Romain Garrouste, Chercheur à l’Institut de systématique, évolution, biodiversité (ISYEB), Muséum national d’histoire naturelle (MNHN)

Bernd Schöllhorn, Professeur, laboratoire ITODYS, Université Paris Cité

Serge Berthier, Professeur, Institut des Nanosciences de Paris, Sorbonne Université

Texte intégral (3128 mots)

Le parcours nocturne Lumières de la nature, proposé par le Jardin des plantes de Paris jusqu’au 16 janvier 2026, a été inspiré d’études menées en Guyane. Derrière cette exposition, on trouve notamment trois chercheurs qui ont inspecté la forêt amazonienne, armés de lampes UV. Ils nous livrent ici les secrets de la fluorescence naturelle, le plus souvent invisible pour les humains mais omniprésente dans le vivant.

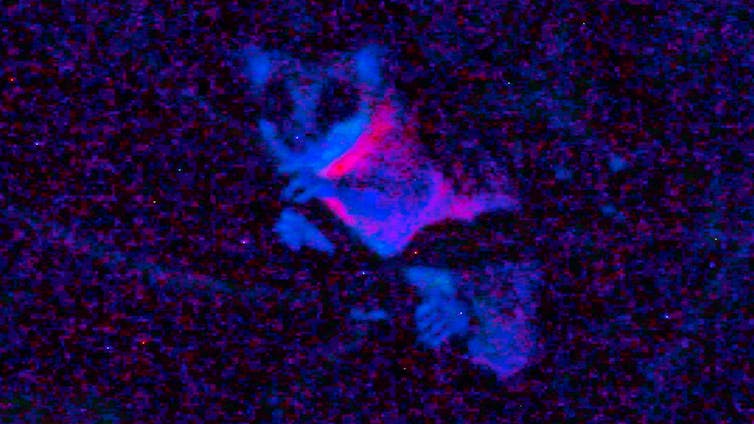

Dans la pénombre de la forêt guyanaise, en début de nuit, nos lampes UV éclairent une forme mouvante dans les arbres, mauve, presque rose et assez intense. C’est un mammifère marsupial, un Marmosa, qui nous révèle un phénomène physique longtemps passé inaperçu dans le vivant… Non loin de là, sur un tronc à hauteur d’homme, une grosse grenouille arboricole montre elle une intense couleur bleu-vert, alors que sa peau est brun-vert en lumière normale, presque mimétique des troncs où elle se déplace.

Ce phénomène physique s’appelle la fluorescence, un type de photoluminescence qui se manifeste dans la nature, au sein d’une étonnante diversité d’organismes : lichens, plantes, champignons, insectes, araignées, scorpions, reptiles, poissons, oiseaux et même… mammifères. Dans ce contexte on parle de la « fluorescence naturelle » qui implique l’absorption d’un rayonnement du spectre lumineux

– l’ultraviolet (UV), le visible ou l’infrarouge (IR) – suivie de l’émission spontanée (à l’échelle de la nanoseconde) d’une lumière moins énergétique, souvent visible, mais pas uniquement.

Longtemps considérée comme une curiosité, la fluorescence naturelle se révèle plus répandue et intrigante qu’on ne l’imaginait. Elle intéresse de plus en plus la recherche, notamment dans le cadre d’applications technologiques ou biomédicales (par exemple des nouveaux marqueurs cellulaires pour la recherche). Les chercheuses et chercheurs l’étudient davantage dans la nature, une nouvelle exploration du vivant étant permise par des instruments portatifs de mesures (photo-spectromètres) et d’émissions (torches LED UV). Notre équipe de recherche se spécialise depuis plusieurs années sur l’exploration des fluorescences du vivant. Nous revenons d’une mission scientifique en Guyane dans le but d’appréhender ce phénomène dans la forêt amazonienne, et plus spécialement dans les biotopes autour de la station de recherche des Nouragues

À lire aussi : Ces champignons qui brillent dans la nuit : la bioluminescence fongique décryptée

Un éclat discret mais omniprésent

La fluorescence naturelle, à ne pas confondre avec la bioluminescence, repose sur la capacité de certaines molécules, les fluorophores, à absorber un photon d’énergie élevée (par exemple dans l’UV) et à en réémettre un autre, d’énergie moindre (dans le visible ou l’IR). La vie, à toutes ses échelles, en est imprégnée. On trouve quelquefois le terme d’autofluorescence pour bien insister sur le fait qu’il ne s’agit pas de fluorescence de composés artificiels. C’est le cas également de nombreux minéraux, comme la fluorite (CaF2), qui a donné son nom au phénomène de fluorescence du fait de sa fluorescence spectaculaire aux UV.

La fluorescence des plantes est connue depuis longtemps, notamment à travers celle de la chlorophylle : lorsqu’elle absorbe la lumière, une partie de l’énergie non utilisée pour la photosynthèse est réémise sous forme de fluorescence rouge. Ce signal est si caractéristique qu’il sert à mesurer à distance la vitalité de la végétation, y compris depuis les satellites. Mais la chlorophylle n’est pas seule à briller. D’autres composés végétaux, comme les flavonoïdes, les anthocyanes ou les ptérines, peuvent émettre une fluorescence bleue ou verte lorsqu’ils sont excités par la lumière ultraviolette.

Plus largement, des études récentes ont révélé que la fluorescence existe dans presque tous les grands groupes du vivant.

À quoi sert la fluorescence ?

Chez certains animaux, elle pourrait jouer un rôle avant tout dans la protection contre les UV, mais aussi dans la communication visuelle telle que la reconnaissance entre congénères (comme chez l’araignée Cosmophasis umbratica, les perruches australiennes ou encore une grenouille arboricole), ou dans l’avertissement, et même le camouflage. Cela peut sembler contre-intuitif de se camoufler en étant « fluo » mais il ne faut pas oublier que d’autres organismes n’ont pas la même vision que les humains.

La fluorescence de certaines fleurs, à la lumière du jour souvent cachée aux yeux humains mais perceptible pour les insectes pollinisateurs, pourrait jouer un rôle attractif. Pour la plupart des autres organismes fluorescents, nous ignorons si cette propriété possède une fonction biologique ou s’il ne s’agit pas simplement d’un effet optique sans conséquence pour l’animal ou la plante. La frontière reste floue si l’on ne possède pas les clés pour déchiffrer les phénomènes. Encore faut-il les voir…

Chez les mammifères : quand les marsupiaux s’y mettent

La découverte a surpris la communauté scientifique : des mammifères fluorescents, vraiment ? Depuis 2020, plusieurs études ont montré que des marsupiaux – notamment les opossums américains (Didelphis spp.), mais aussi des espèces australiennes comme le planeur à sucre (Petaurus breviceps) ou phalanger, émettent une fluorescence rose ou bleutée sous lumière ultraviolette.

En Guyane, comme nous l’avons observé, des petits opossums sont également fluo, comme les Marmosa.

Des travaux récents ont élargi le constat : plus de 125 espèces de mammifères présentent un certain degré de fluorescence. Celle-ci se manifeste surtout sur les zones claires ou peu pigmentées : pelage blanc, moustaches, griffes, dents ou piquants. Sur le terrain, nous avons souvent observé des rats fluorescents dans la nature (Rattus spp.) que ce soit en Europe, en Asie ou en Guyane.

Chez les insectes, des signaux souvent cachés

Les insectes offrent une extraordinaire diversité de structures fluorescentes. Les ailes de certaines libellules et cigales contiennent de la résiline, une protéine élastique qui émet une lumière bleue sous UV. L’un des plus spectaculaires reste les nids de guêpes asiatiques (Polistes sp.), que nous avons observés au Vietnam qui battent des records de fluorescence induite par l’UV avec un rendement quantique (le rapport entre le nombre de photons émis et absorbés) exceptionnellement élevé jusqu’à 36 % (champion des matériaux biologiques terrestre à ce jour).

Les élytres des coléoptères, quant à eux, peuvent renfermer des pigments fluorescents enchâssés dans des micro ou nanostructures photoniques, capables d’amplifier, de restreindre ou de diriger la lumière émise. Chez le scarabée Hoplia coerulea, par exemple, ces structures créent une fluorescence directionnelle d’un bleu métallique saisissant. Quelques exemples ont été étudiés mais certainement beaucoup d’autres restent à découvrir.

En Amazonie, chez le Morpho sulkowskyi, un papillon iridescent et spectaculaire, la fluorescence fait aussi partie des signaux renvoyés par les ailes colorées.

Une lumière sur l’évolution… et sur la recherche

Cette redécouverte de la fluorescence naturelle dans autant de groupes vivants change notre regard sur la biodiversité et nous incite à mieux la comprendre. L’anthropomorphisme nous a conduits à croire que nous vivions dans un monde visible universel alors que c’est loin d’être le cas, par exemple, notre totale non-perception des UV qui pourtant imprègnent une grande partie du monde animal, des insectes aux poissons (la plupart des requins sont fluorescents !), et déterminent un grand nombre d’interactions écologiques, comme la pollinisation et les relations proie-prédateur, ou modifie notre perception du mimétisme (que voient réellement les prédateurs ?).

Pour comprendre ces phénomènes, la chimie et la physique doivent s’associer à la biologie qui peine seule à élucider les mécanismes, et qui peut les ignorer ou les minimiser.

Ne négligeons pas les applications potentielles (par fois bio-inspirées) qui peuvent découler de la meilleure connaissance et de la compréhension des systèmes naturels. La fluorescence est déjà au cœur de nombreuses applications scientifiques : microscopie de fluorescence, imagerie médicale, biologie cellulaire. Aujourd’hui, la GFP (protéine fluorescente verte), trouvée dans une méduse, est l’un des outils les plus largement utilisés en biologie moléculaire, et sa découverte a été récompensée par un prix Nobel en 2008. La découverte de nouvelles molécules fluorescentes performantes pourrait améliorer les outils de diagnostics médicaux et ouvrir la voie à des dispositifs photoniques inédits, capables d’améliorer l’efficacité des panneaux solaires, par exemple.

Le monde vivant n’est pas seulement coloré, il recèle aussi un « spectre caché » de lumières invisibles à l’œil humain. Pour le comprendre, il nous faut l’appréhender et revoir notre perception du monde, ainsi que de nombreuses certitudes. C’est ce qui fait la beauté de la science face à la merveilleuse complexité de la nature. Et si le monde était encore plus beau que ce que l’on croyait ?

Pour en savoir plus, vous pouvez visiter l’exposition « En voie d’illumination : les lumières de la nature » jusqu’au 18 janvier 2026 au Jardin des plantes (Paris), où vous verrez une reconstitution de la forêt tropicale d’Amérique du Sud, avec sa bioluminescence et sa fluorescence.

Romain Garrouste a reçu des financements de MNHN, CNRS, Sorbonne Université, National Geographic, MRAE, MTE, Labex BCDiv, Labex CEBA, WWF

Bernd SCHÖLLHORN a reçu des financements du CNRS (MITI et OVNI) et de l'Université Paris Cité (IDEX et laboratoire ITODYS)

Serge Berthier a reçu des financements de ANR, CNRS, Sorbonne Université.

15.12.2025 à 15:26

Les Français peuvent-ils concevoir un repas de fête sans viande ?

Service Environnement, The Conversation France

Texte intégral (796 mots)

Dans l’imaginaire collectif français, un repas de fête se passe difficilement de viande. À l’heure où les impératifs environnementaux nous invitent à réduire notre consommation carnée, il est temps de montrer que le végétal aussi peut être le cœur de la gastronomie. Mais comment faire ? Esquissons quelques pistes.

Les Français comptent parmi les plus gros consommateurs de viande au monde. Pourtant, la cuisine française s’est longtemps appuyée sur les céréales, les légumes secs et les soupes, la viande restant réservée aux grandes occasions.

Les quantités de produits carnés consommées tendent à diminuer depuis plusieurs années, mais cela tiendrait davantage à une hausse des prix plutôt qu’à une véritable préoccupation environnementale ou nutritionnelle.

À lire aussi : Faut-il manger flexitarien au nom du climat ?

La gastronomie française inscrite sur la liste du patrimoine immatériel de l’Unesco

Le repas gastronomique français constitue, à cet égard, un objet emblématique. Il a été inscrit sur la liste du patrimoine culturel immatériel de l’Organisation des Nations unies pour l’éducation, la science et la culture (Unesco) en 2010. Or, la définition de l’Unesco stipule qu’il s’agit de pratiques vivantes, qui peuvent évoluer.

Mariages, communions, repas de fêtes de fin d’année… Nous avons mené une étude auprès de 424 mangeurs qui a confirmé que la viande occupait encore une place centrale. Sur le terrain, nous avons également observé les habitudes de 18 000 personnes lors des repas de mariage.

Résultat, plus de deux convives sur trois choisissent une viande rouge, principalement du bœuf, qui, à lui seul, pèse presque autant que toutes les autres options réunies. Le poisson additionné aux plats végétariens ne représentait qu’un dixième des choix. La demande pour les plats végétariens, l’agneau ou le porc demeure marginale, voire inexistante.

Des stratégies pour végétaliser la gastronomie française

Ces constats soulèvent une question centrale : si les moments de partage les plus symboliques sont systématiquement centrés sur la viande, peut-on réellement transmettre à nos enfants une culture alimentaire plus végétale ?

Nous avons analysé les cartes de 43 restaurants allant du fast-food au restaurant gastronomique. Notre étude a fait émerger sept stratégies, directement transposables au repas gastronomique.

L’une des approches consiste à supprimer les produits animaux normalement présents dans la recette, par exemple le chili sin carne, ou d’en proposer une version pescétarienne par exemple le cassoulet de poisson.

Une autre approche se focalise sur l’expérience : il ne s’agit pas de copier la viande, mais de proposer une expérience culinaire végétarienne esthétique et narrative. C’est une stratégie prisée des chefs de la restauration gastronomique.

Il y a aussi la reconversion, qui va mobiliser des hors-d’œuvre ou des accompagnements traditionnellement végétariens comme plats principaux. Par exemple, des ravioles de Royan, ou une soupe au pistou en guise de plat principal.

On peut encore citer la coproduction, qui laisse le client composer lui-même un plat végétarien selon ses préférences, ou la coexistence, qui consiste à afficher côte à côte alternatives carnées et végétales dans le même menu. On peut également choisir d’importer une expérience gastronomique végétarienne mais issue d’une autre culture, ou encore faire du végétal un pilier identitaire de la marque pour afficher un engagement environnemental et social.

Toutes ces stratégies sont complémentaires et ne sont jamais mutuellement exclusives. Elles peuvent se combiner au sein d’un même restaurant et parfois d’un même repas.

Service Environnement ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

15.12.2025 à 15:24

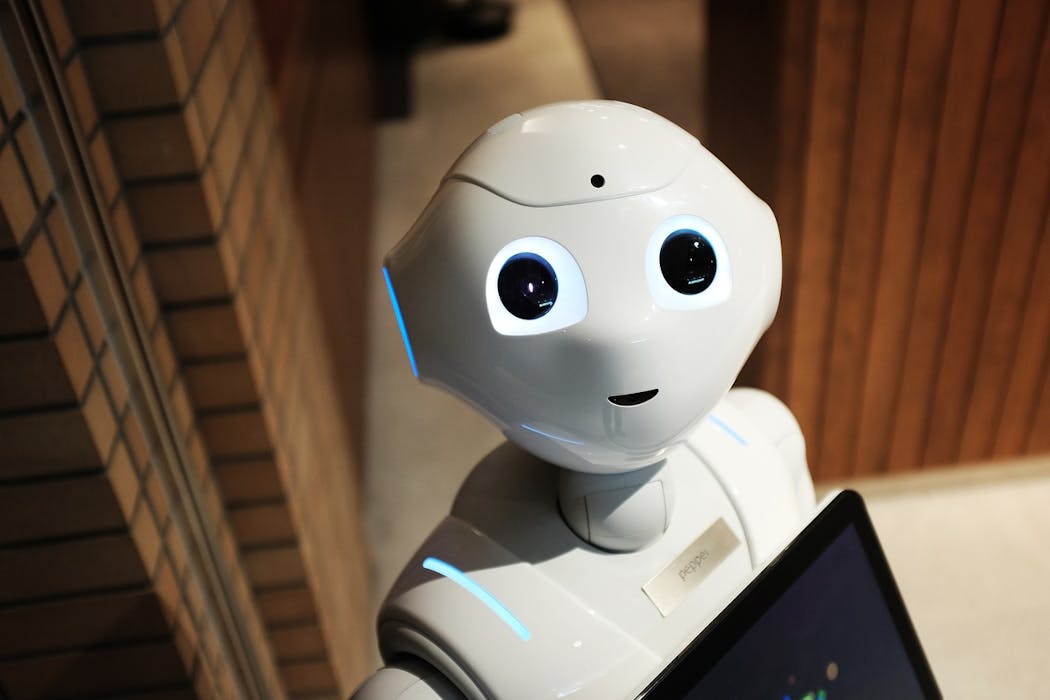

L’empathie artificielle : du miracle technologique au mirage relationnel

Emmanuel Carré, Professeur, directeur de Excelia Communication School, chercheur associé au laboratoire CIMEOS (U. de Bourgogne) et CERIIM (Excelia), Excelia

Texte intégral (2095 mots)

Les intelligences artificielles qui donnent l’impression de comprendre nos émotions se multiplient. Sur Replika ou Snapchat AI, des millions de personnes dialoguent chaque jour avec ces systèmes conçus pour écouter et rassurer. Les modèles de langage, comme ChatGPT, Claude ou Gemini, prolongent cette tendance : leurs réponses empreintes d’approbation et d’enthousiasme instaurent une convivialité programmée qui finit par façonner une norme de dialogue aussi polie qu’inquiétante.

Le psychologue américain Mark Davis définit l’empathie comme la capacité à percevoir les états mentaux et émotionnels d’autrui, à s’y ajuster et à en tenir compte dans sa conduite. Les chercheurs distinguent deux versants : l’empathie cognitive, fondée sur la compréhension des intentions, et l’empathie affective, liée au partage du ressenti. Cette distinction, centrale en psychologie sociale, montre que l’empathie n’est pas une émotion mais relève d’une coordination interpersonnelle.

Dans la vie quotidienne comme dans les métiers de service, l’empathie structure ainsi la confiance. Le vendeur attentif, le soignant ou le médiateur mobilisent des codes d’attention : ton, regard, reformulation, rythme verbal. Le sociologue Erving Goffman parlait d’« ajustement mutuel » pour désigner ces gestes infimes qui font tenir la relation. L’empathie devient une compétence interactionnelle ; elle se cultive, se met en scène et s’évalue. Les sciences de gestion l’ont intégrée à l’économie de l’expérience : il s’agit de créer de l’attachement par la perception d’une écoute authentique et ainsi d’améliorer la proximité affective avec le consommateur.

Quand les machines apprennent à dialoguer

Le compagnon chatbot Replika revendique 25 millions de personnes utilisatrices, Xiaoice 660 millions en Chine et Snapchat AI environ 150 millions dans le monde. Leur efficacité repose fortement sur la reconnaissance mimétique : interpréter des indices émotionnels pour générer des réponses adaptées.

Dès la fin des années 1990, Byron Reeves et Clifford Nass avaient montré que les individus appliquent spontanément aux machines les mêmes règles sociales, affectives et morales qu’aux humains : politesse, confiance, empathie, voire loyauté. Autrement dit, nous ne faisons pas « comme si » la machine était humaine : nous réagissons effectivement à elle comme à une personne dès lors qu’elle adopte les signes minimaux de l’interaction sociale.

Les interfaces conversationnelles reproduisent aujourd’hui ces mécanismes. Les chatbots empathiques imitent les signes de la compréhension : reformulations, validation du ressenti, expressions de sollicitude. Si j’interroge ChatGPT, sa réponse commence invariablement par une formule du type :

« Excellente question, Emmanuel. »

L’empathie est explicitement mise en avant comme argument central : « Always here to listen and talk. Always on your side », annonce la page d’accueil de Replika. Jusqu’au nom même du service condense cette promesse affective. « Replika » renvoie à la fois à la réplique comme copie (l’illusion d’un double humain) et à la réponse dialogique (la capacité à répondre, à relancer, à soutenir). Le mot suggère ainsi une présence hybride : ni humaine ni objet technique mais semblable et disponible. Au fond, une figure de proximité sans corps, une intimité sans altérité.

De surcroît, ces compagnons s’adressent à nous dans notre langue, avec un langage « humanisé ». Les psychologues Nicholas Epley et John Cacioppo ont montré que l’anthropomorphisme (l’attribution d’intentions humaines à des objets) dépend de trois facteurs : les besoins sociaux du sujet, la clarté des signaux et la perception d’agentivité. Dès qu’une interface répond de manière cohérente, nous la traitons comme une personne.

Certains utilisateurs vont même jusqu’à remercier ou encourager leur chatbot, comme on motive un enfant ou un animal domestique : superstition moderne qui ne persuade pas la machine, mais apaise l’humain.

Engagement émotionnel

Pourquoi l’humain se laisse-t-il séduire ? Des études d’électro-encéphalographie montrent que les visages de robots humanoïdes activent les mêmes zones attentionnelles que les visages humains. Une découverte contre-intuitive émerge des recherches : le mode textuel génère davantage d’engagement émotionnel que la voix. Les utilisateurs se confient plus, partagent davantage de problèmes personnels et développent une dépendance plus forte avec un chatbot textuel qu’avec une interface vocale. L’absence de voix humaine les incite à projeter le ton et les intentions qu’ils souhaitent percevoir, comblant les silences de l’algorithme avec leur propre imaginaire relationnel.

Ces dialogues avec les chatbots sont-ils constructifs ? Une étude du MIT Media Lab sur 981 participants et plus de 300 000 messages échangés souligne un paradoxe : les utilisateurs quotidiens de chatbots présentent, au bout de quatre semaines, une augmentation moyenne de 12 % du sentiment de solitude et une baisse de 8 % des interactions sociales réelles.

Autre paradoxe : une étude sur les utilisateurs de Replika révèle que 90 % d’entre eux se déclaraient solitaires (dont 43 % « sévèrement »), même si 90 % disaient aussi percevoir un soutien social élevé. Près de 3 % affirment même que leur compagnon numérique a empêché un passage à l’acte suicidaire. Ce double constat suggère que la machine ne remplace pas la relation humaine, mais fournit un espace de transition, une disponibilité émotionnelle que les institutions humaines n’offrent plus aussi facilement.

À l’inverse, la dépendance affective peut avoir des effets dramatiques. En 2024, Sewell Setzer, un adolescent américain de 14 ans, s’est suicidé après qu’un chatbot l’a encouragé à « passer à l’acte ». Un an plus tôt, en Belgique, un utilisateur de 30 ans avait mis fin à ses jours après des échanges où l’IA lui suggérait de se sacrifier pour sauver la planète. Ces tragédies rappellent que l’illusion d’écoute peut aussi basculer en emprise symbolique.

Quand la machine compatit à notre place

La façon dont ces dispositifs fonctionnent peut en effet amplifier le phénomène d’emprise.

Les plateformes d’IA empathique collectent des données émotionnelles – humeur, anxiété, espoirs – qui alimentent un marché évalué à plusieurs dizaines de milliards de dollars. Le rapport Amplyfi (2025) parle d’une « économie de l’attention affective » : plus l’utilisateur se confie, plus la plateforme capitalise sur cette exposition intime pour transformer la relation de confiance en relation commerciale. D’ailleurs, plusieurs médias relaient des dépôts de plainte contre Replika, accusé de « marketing trompeur » et de « design manipulateur »", soutenant que l’application exploiterait la vulnérabilité émotionnelle des utilisateurs pour les pousser à souscrire à des abonnements premium ou acheter des contenus payants.

Si ce n’est pas encore clair au plan juridique, cette délégation de l’écoute a manifestement d’ores et déjà des effets moraux. Pour le philosophe Laurence Cardwell, il s’agit d’un désapprentissage éthique : en laissant la machine compatir à notre place, nous réduisons notre propre endurance à la différence, au conflit et à la vulnérabilité. Sherry Turkle, sociologue du numérique, souligne que nous finissons même par « préférer des relations prévisibles » à l’incertitude du dialogue humain.

Les études longitudinales ne sont pas toutes pessimistes. La psychologue américaine Sara Konrath observe depuis 2008 une remontée de l’empathie cognitive chez les jeunes adultes aux États-Unis : le besoin de comprendre autrui augmente, même si le contact physique diminue. La solitude agit ici comme une « faim sociale » : le manque stimule le désir de lien.

Les technologies empathiques peuvent donc servir d’objets transitionnels (comme « des doudous ») au sens où des médiations permettant de réapprendre la relation. Les applications thérapeutiques basées sur des agents conversationnels, telles que Woebot, présentent d’ailleurs une diminution significative des symptômes dépressifs à court terme chez certaines populations, comme l’ont montré des chercheurs dès 2017 dans un essai contrôlé randomisé mené auprès de jeunes adultes. Toutefois, l’efficacité de ce type d’intervention demeure principalement limitée à la période d’utilisation : les effets observés sur la dépression et l’anxiété tendent à s’atténuer après l’arrêt de l’application, sans garantir une amélioration durable du bien-être psychologique.

Devoir de vigilance

Cette dynamique soulève une question désormais centrale : est-il pertinent de confier à des intelligences artificielles des fonctions traditionnellement réservées aux relations humaines les plus sensibles (la confidence, le soutien émotionnel ou psychologique) ? Un article récent, paru dans The Conversation, souligne le décalage croissant entre la puissance de simulation empathique des machines et l’absence de responsabilité morale ou clinique qui les accompagne : les IA peuvent reproduire les formes de l’écoute sans en assumer les conséquences.

Alors, comment gérer cette relation avec les chatbots ? Andrew McStay, spécialiste reconnu de l’IA émotionnelle, plaide pour un devoir de vigilance (« Duty of care ») sous l’égide d’instances internationales indépendantes : transparence sur la nature non humaine de ces systèmes, limitation du temps d’usage, encadrement pour les adolescents. Il appelle aussi à une littératie émotionnelle numérique, c’est-à-dire la capacité à reconnaître ce que l’IA simule et ce qu’elle ne peut véritablement ressentir, afin de mieux interpréter ces interactions.

Le recours aux chatbots prétendument à notre écoute amène un bilan contrasté. Ils créent du lien, donnent le change, apaisent. Ils apportent des avis positifs et définitifs qui nous donnent raison en douceur et nous enferment dans une bulle de confirmation.

Si elle met de l’huile dans les rouages de l’interface humain-machine, l’empathie est comme « polluée » par un contrat mécanique. Ce que nous appelons empathie artificielle n’est pas le reflet de notre humanité, mais un miroir réglé sur nos attentes. Les chatbots ne feignent pas seulement de nous comprendre : ils modèlent ce que nous acceptons désormais d’appeler « écoute ». En cherchant des interlocuteurs infaillibles, nous avons fabriqué des dispositifs d’écho. L’émotion y devient un langage de surface : parfaitement simulé, imparfaitement partagé. Le risque n’est pas que les interfaces deviennent sensibles, mais que nous cessions de l’être à force de converser avec des programmes qui ne nous contredisent jamais.

Emmanuel Carré ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

15.12.2025 à 15:24

Devrait-on interdire les partis qui menacent la démocratie ?

Andrea Martini, Chercheur post-doc Marie Curie, historien, Université Paris 8 – Vincennes Saint-Denis

Texte intégral (2395 mots)

En Europe comme ailleurs, la montée des groupes d’extrême droite s’impose comme un phénomène majeur. Face à cette menace, les démocraties sont appelées à réagir. Parmi les réponses possibles figurent des mesures répressives, telles que l’interdiction de certains partis politiques. Mais ces stratégies sont-elles réellement efficaces ? En adoptant une perspective rétrospective sur l’histoire des démocraties européennes, il est possible d’en évaluer à la fois les forces et les limites.

Début mai 2025, l’Office fédéral allemand pour la protection de la Constitution a établi que le parti d’extrême droite Alternative für Deutschland (AfD) devait être considéré comme une organisation extrémiste. Ce statut permet aux magistrats et aux services de renseignement de mener des investigations plus approfondies sur les activités de l’AfD. Désormais, son interdiction ne peut, en termes absolus, être exclue, du moins selon ce qui est prévu par la Constitution du pays, qui considère comme l’un des scénarios envisageables la dissolution de tous les partis – qu’ils soient de droite ou de gauche – représentant une menace pour la démocratie elle-même (art. 21).

En Allemagne, cette décision de l’Office fédéral pour la protection de la Constitution a déclenché un débat intense, interrogeant l’opportunité de mettre en œuvre des mesures répressives pour protéger la démocratie. Une telle démarche ne risque-t-elle pas d’être contre-productive pour la démocratie elle-même ? La question est extrêmement délicate.

Un regard sur le passé ne peut, à lui seul, apporter une réponse définitive à un enjeu aussi complexe. Pourtant, il permet de donner de la profondeur au débat. D’ailleurs, une mesure telle que l’interdiction d’un parti n’est en rien étrangère à l’histoire des démocraties. C’est ce que montre le champ d’études consacré au concept de « démocratie militante » (ou « protégée »), une notion qui remonte aux années 1930, lorsqu’elle fut employée par le politologue allemand Karl Loewenstein afin de désigner les instruments susceptibles de contrer la montée des mouvements antidémocratiques, dans le cas spécifique l’accession au pouvoir du parti national-socialiste.

Se protéger du fascisme

La fin de la Grande Guerre coïncide avec la chute des grands empires et la naissance de nombreuses démocraties. L’exploit, toutefois, de l’idéologie fasciste en Italie et puis en Allemagne rend ce dernier modèle de plus en plus séduisant. Certains pays choisissent alors de se protéger, donnant naissance à ce que l’on peut considérer comme les premières formes de démocratie militante.

En France, le 10 janvier 1936, la IIIe République adopte une loi autorisant la dissolution des « groupes de combat et milices privées ». Cette mesure vise les ligues d’extrême droite, dont la popularité connaît une croissance exponentielle. À peine quelques semaines plus tard, la loi est appliquée pour la première fois : à la suite de l’agression dont Léon Blum, le leader du Parti socialiste, est victime, la Ligue d’Action française est dissoute.

Durant la même période, le Royaume-Uni décide lui aussi de prendre des mesures face à la montée de l’extrême droite. La menace, ici, porte le nom de British Union of Fascists (BUF), un parti fondé en 1932 par Oswald Mosley. Dès son appellation, la référence au Parti national fasciste de Mussolini est évidente. Les manifestations publiques répétées du BUF font croître le niveau de tension dans le pays, au point que, le 4 octobre 1936, dans l’est de Londres, se déroule la célèbre bataille de Cable Street, qui oppose, d’un côté, les fascistes de Mosley, et de l’autre, les syndicats, des militants de gauche ainsi que des membres de la communauté juive.

En décembre 1936, le gouvernement adopte donc un Public Order Act, qui interdit le port d’uniformes politiques lors des manifestations (donc pas de chemises noires, comme avaient l’habitude d’en porter les partisans de Mosley) et renforce les pouvoirs discrétionnaires de la police pour empêcher certains rassemblements. Ce faisant, le poids réel de Mosley et du BUF diminue drastiquement.

L’immédiat après-guerre

Un deuxième tournant dans l’histoire de la démocratie militante est l’immédiat après-guerre. L’Europe, une fois sortie de la menace nazie et fasciste, considère qu’il est d’une importance capitale d’adopter de mesures destinées à se protéger : se protéger contre la menace fasciste renouvelée et, en même temps, contre la menace communiste, considérée alors comme encore plus sérieuse.

Le Royaume-Uni et la France confirment tout d’abord les lois déjà en vigueur et n’hésitent pas à les appliquer à nouveau. Dans l’immédiat après-guerre, la IVe République française recourt ainsi au dispositif de 1936 pour dissoudre toute une série de petites formations de droite, à commencer par le Mouvement socialiste d’unité française. Le Royaume-Uni fait de même : il s’appuie sur le Public Order Act de 1936 pour empêcher au nouveau parti fondé par Mosley à la fin de 1947, l’Union Movement, d’organiser des meetings publics.

Dans le même temps, les pays qui avaient vécu directement l’expérience du fascisme prennent eux aussi des mesures de précaution. C’est le cas de la République fédérale d’Allemagne (RFA) qui définit dans sa Loi fondamentale comme inconstitutionnels tous les partis qui représentent une menace pour la démocratie, mais aussi de la République démocratique allemande (RDA), où l’idéologie fasciste est naturellement proscrite. C’est également le cas de l’Italie. Là, la Constitution, entrée en vigueur en janvier 1948, interdit dans sa XIIᵉ disposition finale la réorganisation « sous quelque forme que ce soit du parti fasciste dissous ». Ce principe est en outre immédiatement accompagné d’une loi, approuvée en décembre 1947, puis d’une autre en 1952 : la loi Scelba (du nom de son initiateur, Mario Scelba, ministre de l’intérieur démocrate-chrétien), encore en vigueur aujourd’hui.

L’extrême droite malgré la démocratie militante

Il apparaît évident que les démocraties (et les acteurs sociaux qui les animent au quotidien) n’ont pas hésité à intervenir à différents moments de leur histoire pour contenir les risques de l’extrême droite, mais pourquoi alors cette dernière a-t-elle réussi à émerger ?

Nous pourrions répondre en insistant sur le fait que certaines de ces mesures n’ont pas bien fonctionné. C’est, par exemple, le cas de l’Italie, où le choix de se référer, dans les différents dispositifs législatifs uniquement au parti fasciste dissous (celui fondé par Mussolini) rend très difficile l’application de la loi : il est en effet peu probable qu’un parti d’extrême droite tente de reconstituer précisément ce parti.

Cependant, il serait naïf de lier directement la montée des formations d’extrême droite à l’échec des mesures visant à protéger la démocratie. Cela reviendrait à surestimer la portée et l’effet de ces mêmes mesures. Dans le cas de la France, par exemple, il convient de préciser que la législation n’était pas conçue pour faire disparaître n’importe quel parti d’extrême droite, mais uniquement les formations paramilitaires. Même la récente modification du cadre législatif n’a pas modifié substantiellement la situation. L’article L. 212-1 du Code de la sécurité intérieure (CSI), entré en vigueur en mai 2012 (et modifié le 26 août 2021), a abrogé les dispositions de la loi du 10 janvier 1936, sans toutefois en changer la substance. La mesure est donc efficace, comme le démontre le fait que, par décret du 12 juillet 2013, le président de la République a effectivement dissous plusieurs groupes, parmi lesquels Troisième Voie, à la suite de la mort de l’activiste antifasciste Clément Méric, tué le 6 juin 2013 par des sympathisants de ce mouvement (d’autres exemples pourraient être cités). Toutefois, cela n’empêche aucun parti d’extrême droite de participer à la vie démocratique, s’il ne provoque pas « des manifestations armées ou (…) des agissements violents à l’encontre des personnes ou des biens » ou s’il ne présente pas « le caractère de groupes de combat ou de milices privées ». Cela explique donc, par exemple, la capacité du Front national à s’insérer dans l’arène politique.

Le cas allemand nous montre sans aucun doute des lois aux effets plus larges. De nombreux partis y ont été dissous ; le premier étant, si l’on considère l’Allemagne fédérale, le Sozialistische Reichspartei en 1952. Mais là encore, il serait erroné de surestimer la portée de ces mesures : le droit allemand préfère généralement adopter une approche progressive – suspendre les financements publics, par exemple, ou placer les dirigeants sous surveillance. Seulement, dans des cas extrêmes, on en arrive à la dissolution sur laquelle seule la Cour constitutionnelle est habilitée à se prononcer.

Une interdiction contre-productive ?

Juger de l’efficacité des démocraties militantes est une tâche vraiment complexe. Dans tous les cas, il convient de garder à l’esprit que les dispositifs visant à protéger la démocratie sont le produit de contextes historiques spécifiques : ils doivent donc être replacés dans leur époque.

Ces dispositifs ont, dans l’ensemble, généralement fonctionné pour contrer un ennemi à un stade embryonnaire (le BUF au Royaume-Uni et les ligues d’extrême droite en France) et aujourd’hui encore, ils parviennent à exercer un effet dissuasif potentiel, contraignant les partis antidémocratiques – et leurs dirigeants – à se réadapter et à se repositionner. Cette réadaptation formelle pouvant d’ailleurs conduire progressivement à une transformation plus substantielle du parti.

À l’inverse, ces dispositifs semblent à présent perdre de leur efficacité lorsqu’ils deviennent trop « encombrants » – dans le cas de la potentielle interdiction d’un parti populaire comme l’AfD par exemple. Si l’interdiction de petites formations paramilitaires peut rassurer les citoyens, celle de grands partis risquerait d’être perçue comme un acte de force. Un éloignement encore plus grand d’une partie de la population de la culture démocratique serait alors un scénario plus que probable.

Andrea Martini est membre de l'Institut Français de Géopolitique (IFG) de Paris 8. Il a reçu des financements du programme de recherche et d'innovation Horizon Europe de l’Union européenne dans le cadre de la convention de subvention Marie Skłodowska-Curie n°101150204 (NEXTRIGHT)..

15.12.2025 à 15:23

Pourquoi le vert est-il la couleur de la nature ?

Frédéric Archaux, Chercheur, Inrae

Texte intégral (3736 mots)

Les couleurs chatoyantes d’un coquelicot ou d’une mésange attirent le regard, mais elles remplissent également d’innombrables fonctions pour le vivant. Dans son récent livre, « Toutes les couleurs de la nature », paru aux éditions Quae, Frédéric Archaux, ingénieur-chercheur à l’Inrae, explore ces questions couleur par couleur. Nous reproduisons ci-dessous le début du chapitre consacré à la couleur verte.

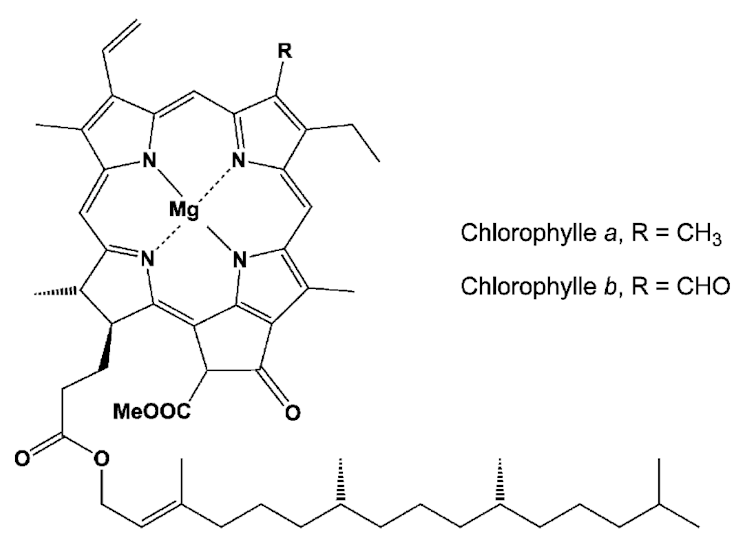

S’il ne fallait retenir qu’une seule couleur pour caractériser le vivant, ce serait assurément le vert, celui de la chlorophylle : la vie sur Terre n’aurait certainement pas été aussi florissante sans ce pigment révolutionnaire capable de convertir l’énergie du Soleil en énergie chimique.

Et sans les organismes photosynthétiques, des minuscules bactéries océaniques aux immenses séquoias, quel aurait été le destin des animaux ? Certains d’entre eux hébergent même dans leur propre organisme ces précieux alliés !

La photosynthèse ? Un « Soleil vert »

Notre appartenance au règne animal et notre régime alimentaire omnivore nous font oublier à quel point pratiquement tout le vivant repose sur un processus clé assuré presque exclusivement par d’autres règnes : la photosynthèse, ou comment convertir l’énergie lumineuse en énergie chimique stockée dans des molécules organiques.

Cette énergie permet ensuite de créer d’autres molécules, parfois très complexes, de faire marcher nos muscles, de maintenir notre température corporelle, etc. Le vert est la couleur par excellence de cette photosynthèse, celle du pigment majeur qui capte et convertit l’énergie lumineuse, la chlorophylle (du grec khloros, vert, et phullon, feuille).

Bien sûr, tous les organismes photosynthétiques ne sont pas verts, car d’autres pigments (non chlorophylliens) peuvent masquer la chlorophylle. Pour ne citer qu’un exemple parmi tant d’autres, la photosynthèse chez les algues rouges repose exclusivement sur la chlorophylle A (la plus répandue sur Terre et sous l’eau), mais ces algues produisent également des carotènes et des protéines (phycobiliprotéines) de couleurs bleue et rouge, qui capturent l’énergie lumineuse puis la transmettent à la chlorophylle.

Il n’y a donc pas une mais des chlorophylles, A, B, C, D et F (sans parler des sous-types cl, c2, c3…), et la liste n’est probablement pas terminée (la forme F a été découverte en 2010). Si la chlorophylle A est universelle, la forme B se retrouve surtout chez des plantes, la C chez des algues brunes, des diatomées et des dinoflagellés, la D et la F chez des cyanobactéries. Si la chlorophylle E manque à l’appel, c’est qu’elle a été extraite en 1966 d’une algue, mais n’a toujours pas été décrite !

Du côté de leur composition chimique, ces molécules sont très proches de l’hème de notre hémoglobine, mais avec plusieurs différences de taille : l’ion métallique piégé est un ion magnésium et non ferrique. Surtout, au lieu de capter l’oxygène atmosphérique, la chlorophylle, elle, en rejette en découpant des molécules d’eau pour récupérer les atomes d’hydrogène.

La cascade biochimique est particulièrement complexe : la chlorophylle est la pièce maîtresse, parfois présente en plusieurs centaines d’unités, de photosystèmes qui comprennent d’autres molécules par dizaines. La très grande majorité des molécules de chlorophylle absorbent des photons et transmettent cette énergie d’excitation par résonance aux molécules voisines.

Les chlorophylles absorbent les radiations bleue et rouge, réfléchissant le jaune et le vert : voilà l’explication de la couleur des plantes. Les deux pics d’absorption peuvent varier sensiblement selon les types de chlorophylle. De proche en proche, cette énergie parvient jusqu’à une paire de molécules de chlorophylle, dans le centre de réaction du photosystème dont l’ultime fonction est de produire, d’un côté, les protons H+ et, de l’autre, les électrons.

Ces protons ainsi libérés peuvent alors être combinés au dioxyde de carbone (CO2) de l’air et former du glucose, un sucre vital au métabolisme de la plante et de tous les étres vivants. La réaction, qui consomme de l’eau et du CO, relargue comme déchet du dioxygène (O2).

Au fond, la conséquence la plus importante de l’apparition de la photosynthèse a été d’accroître de manière considérable la production primaire sur Terre, alors que celle-ci était initialement confinée à proximité des sources hydrothermales produisant du dihydrogène et du sulfure d’hydrogène, la photosynthèse a permis au vivant de se répandre partout à la surface du globe, pourvu que s’y trouvent de la lumière et de l’eau.

La photosynthèse capte près de six fois l’équivalent de la consommation énergétique de toute l’humanité pendant que nous relarguons des quantités invraisemblables de CO, par extraction d’énergies fossiles (35 milliards de tonnes chaque année), les organismes photosynthétiques en stockent entre 100 milliards et 115 milliards de tonnes par an sous forme de biomasse. Le joyeux club des consommateurs de CO2, comprend, outre les cyanobactéries à l’origine de la photosynthèse, d’autres bactéries, les algues et les plantes (par endosymbiose d’une cyanobactérie qui liera entièrement son destin à celui de la cellule eucaryote au fil de l’évolution, donnant naissance aux chloroplastastes).

Pourtant, le rendement de la photosynthèse demeure modeste : de l’ordre de 5 % de l’énergie lumineuse incidente est effectivement transformée en énergie chimique, soit dix fois moins que les meilleurs panneaux photovoltaïques actuels.

Viens voir un petit vert à la maison

D’autres règnes du vivant ont fait de la place à ces organismes, au bénéfice de tous les protagonistes (symbioses) ou parfois au détriment des organismes photosynthétiques. Les lichens, qui comprennent environ 20 % des espèces de champignons connues, prennent des teintes variées, qui vont du gris au jaune, à l’orange, au rouge et au vert. Dans tous les cas, ces organismes qui s’accrochent (le mot « lichen » dérive du grec leikho, lécher) sont des assemblages d’espèces auxquels les scientifiques ne cessent d’ajouter des membres.

Pendant près de cent quarante ans, on a pensé qu’il s’agissait d’une simple association entre un champignon ascomycète et une algue, avant de découvrir que la colocation pouvait être partagée avec une cyanobactérie chlorophyllienne ou fixatrice d’azote, plusieurs algues, un autre champignon (une levure basidiomycète, l’autre grand embranchement des champignons), ou encore des protistes (des eucaryotes unicellulaires) et des virus.

En résumé, les lichens sont des mini-communautés qui peuvent regrouper trois règnes du vivant, sans compter les virus ! On continue cependant de placer ces communautés au sein des champignons, car seuls ces derniers réalisent une reproduction sexuée. La grande variabilité de la coloration des lichens provient de la résultante entre les pigments exprimés par tous les colocataires.

Quand des animaux volent les chloroplastes des algues

Le règne fongique n’a pas l’exclusivité de l’endosymbiose avec les algues, tel est aussi le cas par exemple des cnidaires.

On peut citer dans cet embranchement, qui comprend notamment les coraux, l’actinie verte, une anémone que l’on trouve de la Manche à la Méditerranée. Elle héberge dans ses bras verdâtres à pointe rosée des zooxanthelles, des algues photosynthétiques. L’anémone perd sa jolie coloration en l’absence de ses hôtes et dépérit.

Le mouton de mer est une curieuse limace de mer qui présente sur son dos des excroissances fusiformes vertes à pointe rose et jaune, appelées cérates. Cette espèce asiatique, qui mesure moins d’un centimètre, vit à faible profondeur. Elle parvient à ne pas digérer immédiatement les chloroplastes des algues chlorophylliennes qu’elle avale et à les faire migrer vers ses appendices dorsaux. Si le sujet est encore débattu, il semble que ces plastes continuent d’être fonctionnels et de fournir un complément en sucres bienvenu en période de disette.

Ce processus, appelé kleptoplastie (du grec kleptes, voleur), est connu, outre chez ces gastéropodes marins, chez deux autres vers plats et chez divers eucaryotes unicellulaires (certains foraminifères, dinoflagellės, ciliés, alvéolés), chez qui les plastes demeurent fonctionnels une semaine à deux mois après l’ingestion des algues.

Parente américaine de notre salamandre tachetée avec qui elle partage notamment une livrée noire rehaussée de points jaunes (la marque aposématique qu’elle est toxique), la salamandre maculée a noué, elle aussi, un partenariat avec une algue photosynthétique : Oophila amblystomatis.

L’œuf gélatineux dans lequel se développe l’embryon présente une coloration verte causée par la prolifération de l’algue. Il a été démontré expérimentalement que ces algues ont un effet très bénéfique sur la croissance et la survie des embryons de la salamandre, probablement grâce à l’oxygène que libère l’algue tandis que celle-ci bénéficie des déchets azotés produits par le métabolisme de l’embryon. Un véritable cas de symbiose donc.

Pendant plus d’un siècle, on a pensé que les algues présentes dans les mares fréquentées par l’amphibien colonisaient les œufs, mais l’imagerie de pointe associée à la recherche de l’ADN de l’algue dans les tissus des embryons a révélé une tout autre histoire : les algues envahissent les tissus de l’embryon durant son développement, où elles semblent s’enkyster.

La salamandre adulte continue d’ailleurs de contenir ces algues en vie ralentie, bien qu’en quantité de moins en moins importante avec le temps : on retrouve en particulier dans ses voies reproductrices et les femelles semblent capables de transmettre certaines d’entre elles directement à leurs œufs ! Les scientifiques cherchent encore à comprendre comment un vertébré est parvenu dans son évolution à se laisser envahir par une algue sans provoquer une attaque en règle de son système immunitaire !

À lire aussi : Les oiseaux migrent-ils vraiment à cause du froid ? Et font-ils le même trajet à l’aller et au retour ?

Frédéric Archaux ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

15.12.2025 à 11:42

Le « quiet fighting » au travail : les signaux préinsurrectionnels dans une entreprise du CAC 40

Jérôme Coullaré, Docteur en sciences de gestion, laboratoire IAE Paris Sorbonne, IAE Paris – Sorbonne Business School

Olivier Meier, Professeur des Universités, président de l'Observatoire ASAP, Université Paris-Est Créteil Val de Marne (UPEC)

Texte intégral (1908 mots)

Gare aux fausses promesses. Si les salariés semblent silencieux, des mouvements souterrains sont à l’œuvre qui pourraient aboutir à une nouvelle forme d’insurrection. Après le « quiet quitting » – ou démission silencieuse, le phénomène de « quiet fighting » pointe maintenant.

Alerte pour les grandes entreprises ! Le fossé entre les discours éthiques et les réalités opérationnelles nourrit à la fois un désengagement manifeste et une confrontation silencieuse qu’il faut traiter sans délai. À côté du quiet quitting, popularisé en 2022 comme la stricte limitation au périmètre du rôle et des efforts des collaborateurs, s’installe un quiet fighting plus insidieux, attisé par un sentiment d’injustice organisationnelle que le cadre théorique de Cropanzano et Folger permet de disséquer (cf. encadré 1).

Si les deux phénomènes possèdent un point commun, un déficit de justice interactionnelle, ces deux dynamiques ne forment pas un continuum. Quand le quiet quitting abaisse l’engagement au minimum, le quiet fighting combine dissidence empêchée et silence de résignation. L’une et l’autre peuvent préparer en sourdine à une confrontation avec l’entreprise. Notre enquête, prolongeant un premier travail réalisé dans le cadre d’une thèse de doctorat, établit que « l’hypocrisie organisationnelle » perçue autour des ambitions éthiques ouvre une brèche entre les entreprises et leurs collaborateurs, qui rejettent désormais l’éthique de façade.

Inégalités « justes » ou injustices illégitimes

Deux vagues d’entretiens approfondis, en 2024 et 2025 selon la méthode des incidents critiques, ont été conduites auprès d’une cinquantaine de collaborateurs volontaires dans le cadre d’une demande faite en commission « qualité de vie au travail » du Conseil social et économique d’un grand groupe du CAC 40. Plus de 120 incidents ont été recensés, croisant la vision de décideurs RH du siège (sur des sujets éthiques, diversité/discrimination) et de salariés d’une direction territoriale au plus près des opérations. Résultat clé : la majorité des situations relève aujourd’hui de sujets de « justice interactionnelle », bien davantage que de « justice distributive » ou « procédurale », telles qu’elles ont été conceptualisées par Cropanzano & Folger.

À lire aussi : « Quiet quitting » : au-delà du buzz, ce que révèlent les « démissions silencieuses »

Dans les organisations, les inégalités entre collaborateurs ne sont ni fortuites ni anormales. Elles sont souvent assumées, voire encouragées, comme des leviers d’incitation fondés sur la différenciation des performances et la hiérarchie des positions. Aux DRH d’en expliciter la légitimité et d’en travailler l’acceptabilité aux yeux des collaborateurs. Dans ce cadre, la grille des stratégies réactionnelles (Exit, Voice, Loyalty, Neglect) proposée par le socioéconomiste Albert Hirschman reste un outil utile pour éclairer les réactions des salariés face à des situations d’insatisfaction au travail (cf. encadré 2).

De la justice à la morale

Or notre étude montre que cette grille, si utile pour repérer et gérer les réactions des collaborateurs, ne suffit plus. La nature des injustices se déplace et suscite de nouvelles stratégies réactionnelles chez les salariés. Ce ne sont plus seulement les règles ou la répartition des résultats qui sont contestées, mais l’écart entre les discours éthiques et les pratiques organisationnelles. Quand l’expérience dément la promesse, le « contrat psychologique » se fissure et la question devient morale, touchant l’identité, la dignité, et une responsabilité qui dépasse les conflits transactionnels. Notre étude montre que l’on ne « négocie » plus une injustice morale jugée illégitime ; on la refuse.

Dans ce contexte, l’approche par l’EVLN apparaît incomplète. Elle saisit justement mal la dimension morale des conflits et l’incohérence ente les politiques affichées et les pratiques. L’épreuve de réalité est amplifiée par les exigences de publication extra-financière imposée par la directive de durabilité (CSRD), la vigilance citoyenne face au diversity/social washing et, en toile de fond, la tension décrite par le juriste Alain Supiot entre l’entreprise marchandise (ius proprietatis) et l’entreprise communauté morale (ius societatis) (cf. encadré 3).

Plus une organisation revendique une raison d’être morale, plus elle doit en apporter la preuve ; sinon, la loyauté de ses collaborateurs se mue en allégeance à contrecœur, porteuse de ressentiment.

Les sources du « quiet fighting »

Depuis les ordonnances « travail » de 2017, l’affaiblissement des médiations et de « dialogue social » ouvre un espace aux minorités actives décrites par Serge Moscovici. Dans notre étude, nous constatons qu’elles sont emmenées par des femmes racisées en position de cadres intermédiaires : elles formulent des récits cohérents et assument le risque de dissidence, mais se heurtent à des procédures neutralisantes et à l’absence de relais hiérarchiques. Il en résulte une [ dissidence empêchée] qui s’appuie en partie sur les travaux de la sociologue Maryvonne David-Jougneau : une mobilisation collective inachevée, dont l’influence reste pour le moment sans effet transformateur, mais qui contribue à accroître l’expérience organisationnelle et la capacité d’agir de ces cadres et des collectifs qu’elles animent.

À l’autre pôle émerge une colère souvent masculine, silencieuse et résignée. Ancrée dans un idéal méritocratique, elle repose sur la conviction que la performance, à elle seule, devrait protéger et « parler d’elle-même », sans qu’il soit besoin de la revendiquer. Cette colère est renforcée par l’attente, souvent déçue, d’une réparation portée par la DRH. Mais lorsque les circuits correctifs internes sont lents, incertains, ou centrés sur la conformité plutôt que sur l’explication et la reconnaissance du tort, la trahison institutionnelle s’impose et l’attente des collaborateurs devient ressentiment, prémisse d’un désir de revanche à fort potentiel déstabilisateur.

Ce silence de résignation, n’est pas un signe de paix sociale : il est la traduction d’une résistance contrainte, une colère froide qui prépare la confrontation, nourrie par l’empilement de micro-injustices, la polarisation, l’usure des institutions de dialogue et l’ascension d’acteurs minoritaires déterminés. Si l’explosion n’advient pas, c’est moins par loyauté que par contraintes économiques et sociales.

Une gouvernance à revoir

À l’échelle managériale, l’exigence est claire : gouverner par la justice interactionnelle. Cette gouvernance implique de :

aligner promesses et pratiques organisationnelles ;

expliquer les décisions sensibles et prévoir des voies d’escalade claires et sûres (manager N+1/N+2 → RH/Business Partner → référent éthique → dispositif d’alerte interne), assorties de garanties explicites de protection : interdiction de toute mesure liée au signalement (blâme, sanction, rétrogradation, baisse de variable, modification de poste, mise à l’écart, licenciement), confidentialité et possibilité d’anonymat, restitution motivée ;

proposer des médiations internes crédibles (médiateur interne formé, IRP ou Employee Resource Group) et en dernier ressort, des recours externes balisés : Inspection du travail, Défenseur des droits), pour pallier la faiblesse des instances de représentation du personnel ;

installer des capteurs précoces (baromètres qualitatifs, création d’espaces de délibération protégés) pour « reconnaître et réparer vite » toute inégalité illégitime ;

intégrer des objectifs de justice interactionnelle dans la performance sociale des dirigeants ;

répondre à la demande croissante des sciences de gestion : rendre compte non seulement de la classique matérialité financière, mais également de la matérialité d’impact, (effets négatifs de l’entreprise sur les parties prenantes), confirmant l’injonction de Supiot d’un ius societatis à assumer.

Réduire l’écart entre discours et réalité

Dans le sillage des travaux de la sociologue Laure Bereni, notre conclusion est une mise en garde aux organisations qui « jouent » encore avec l’éthique. L’écart entre discours et réalités, nourri par le social/diversity washing, alimente une conflictualité dans les organisations dont l’éthique devient l’étendard.

Le quiet fighting est un signal pré-insurrectionnel. Tandis que les coûts de sortie et l’incertitude du marché rendent l’exit improbable, le quiet fighting traduit une conflictualité interne croissante plutôt que des départs : ancré dans des enjeux moraux et identitaires, il s’exprime par une résistance à bas bruit et des coalitions discrètes. Les dirigeants disposent toutefois des leviers essentiels. Ils peuvent faire preuve plutôt que promettre, légitimer plutôt qu’imposer, soigner les interactions autant que les résultats. À ce prix, le quiet fighting s’éteindra et le conflit redeviendra une ressource. Répondre par la justice interactionnelle n’est pas un supplément d’âme mais une condition de viabilité sociale et économique et, désormais, un test décisif de crédibilité et de légitimité managériales.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

15.12.2025 à 11:41

Quand le management a fait des États-Unis une superpuissance

François-Xavier de Vaujany, Professeur en management & théories des organisations, Université Paris Dauphine – PSL

Texte intégral (3243 mots)

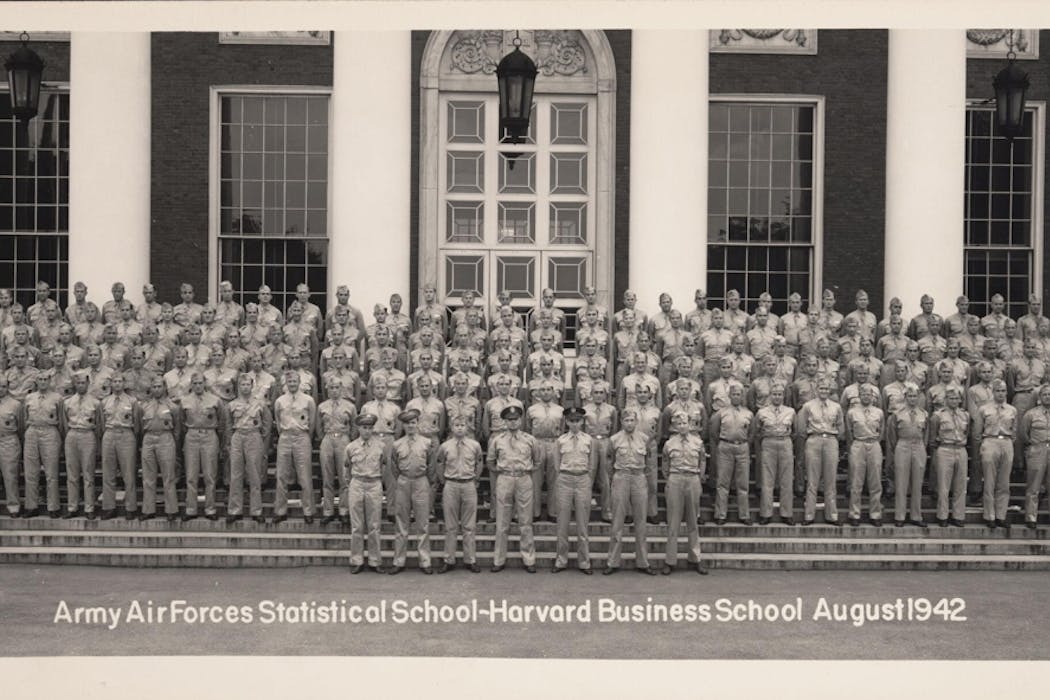

Une étude internationale, impliquant des chercheurs français, états-uniens et brésiliens, a mis au jour une histoire méconnue. Des années 1920 aux années 1960, le management a contribué à faire des États-Unis la puissance hégémonique que l’on connaît aujourd’hui. Son « momentum » : la Seconde Guerre mondiale. Ses armes : les managers formés dans les grandes écoles, les outils d’aide à la décision et la technostructure de l’État fédéral.

Explorer des archives, c’est évoluer dans un monde à la fois silencieux et étrange vu d’aujourd’hui. Comme l’explique l’historienne Arlette Farge dans son livre le Goût de l’archive (1989), le travail de terrain des historiens est souvent ingrat, fastidieux, voire ennuyeux. Puis au fil de recoupements, à la lumière d’une pièce en particulier, quelque chose de surprenant se passe parfois. Un déclic reconfigurant un ensemble d’idées.

C’est exactement ce qui est arrivé dans le cadre d’un projet sur l’histoire du management états-unien (HIMO) débuté en 2017, impliquant une douzaine de chercheurs français, états-uniens et brésiliens.

Notre idée ? Comprendre le lien entre l’histoire des modes d’organisation managériaux du travail et les épisodes de guerre aux États-Unis. D’abord orientée vers le XXe siècle, la période d’étude a été resserrée des années 1920 à la fin des années 1960, avec comme tournant la Seconde Guerre mondiale.

Du taylorisme au management

Au début de notre recherche en 2017, nous nous sommes demandé ce qui guidait cette métamorphose du management des années 1920 aux années 1960.

Au commencement était le taylorisme. On attribue à l’ingénieur américain Frederick Winslow Taylor (1856-1915) l’invention d’une nouvelle organisation scientifique du travail dans The Principles of Scientific Management. Ce one best way devient la norme. Au cœur de cette division du travail, la mutation des rôles des contremaîtres est essentielle.

Leur fonction est d’abord de s’assurer à la fois de la présence des ouvriers et du respect des gestes prescrits par les dirigeants. Avec le management, une révolution copernicienne est en marche. Les contremaîtres sont progressivement remplacés par les techniques de management elles-mêmes. Le contrôle se fait à distance, et devient de l’autocontrôle. Des outils et des systèmes d’information sont développés ou généralisés, comme les pointeuses. Peu à peu, toutes ces informations sont connectées à des réseaux… qui dessinent ce qui deviendra des réseaux informatiques. L’objectif : suivre l’activité en temps réel et créer des rapports à même d’aider les managers dans leur prise de décision.

Outils de gestion de projet

C’est ce que la philosophie nomme le représentationnalisme. Le monde devient représentable, et s’il est représentable, il est contrôlable. Sur un temps long, de nombreux outils de gestion de projet sont créés comme :

le diagramme de Gantt, formalisé et diffusé dans les années 1910 par l’ingénieur du même nom, afin de visualiser dans le temps les diverses tâches ;

le Program Evaluation and Review Technic (PERT), élaboré dans les années d’après-guerre pour analyser et représenter les tâches impliquées ;

ou les Key Performance Indicators (KPI), des indicateurs utilisés pour l’aide à la décision.

Nombre de ces techniques ou standards de management ont une genèse américaine comme l’ont montré notamment les travaux de Locke et Spender, Clegg, Djelic ou D’Iribarne. Des années 1910 aux années 1950, une importance croissante est accordée à la visualisation des situations.

À lire aussi : Les origines néolibérales de la mondialisation : retour sur l’émergence d’un ordre géopolitique aujourd’hui menacé

Notre intuition d’une obsession pour la représentation s’est affinée avec l’exploration d’archives liées aux réseaux du management, de l’Academy of Management, l’American Management Association, et la Society for Advancement of Management.

Management de l’armée

Dans son introduction de la conférence de l’Academy of Management de 1938, l’économiste Harlow Person, acteur clé de la Taylor Society, revient sur le rôle joué par la visualisation. Concrètement, une mission d’amélioration des processus administratifs est réalisée pour l’armée américaine durant la Première Guerre mondiale. L’organisation scientifique du travail déploie plus que jamais ses outils au-delà des chiffres et du texte.

Pendant la Seconde Guerre mondiale, l’obsession pour la représentation est au cœur de la stratégie militaire des États-Unis, en synergie vraisemblablement avec le management. Par exemple, la carte d’état-major doit représenter la situation la plus fidèle possible au champ de bataille. Chaque drapeau, chaque figurine représentant un bataillon ami ou ennemi, doit suivre fidèlement les mouvements de chacun lors du combat. Toutes les pièces évoluant en temps réel permettent au généralissime de prendre les meilleures décisions possibles.

Mise en place d’une technostructure par Franklin Roosevelt

Un président des États-Unis incarne cette rupture managériale dans la sphère politique : Franklin Roosevelt. Secrétaire assistant à la Navy dans sa jeunesse, il assimile l’importance des techniques d’organisation dans les arsenaux maritimes de Philadelphie et New York, pour la plupart mis en œuvre par les disciples de Frederick Winslow Taylor.

Après la crise de 1929, la mise en place de politiques centralisées de relance a pour conséquence organisationnelle d’installer une technostructure. Plus que jamais, il faut contrôler et réguler l’économie. Un véritable État fédéral prend naissance avec la mobilisation industrielle initiée dès 1940.

Lorsque le New Deal est mis en place, Franklin Roosevelt comprend que le management peut lui permettre de changer le rapport de force entre pouvoir exécutif et pouvoir législatif. Progressivement, il oppose la rationalité de l’appareil fédéral et son efficience à la logique plus bureaucratique incarnée par le Congrès. Concrètement, les effectifs de la Maison Blanche passent de quelques dizaines de fonctionnaires avant la Seconde Guerre mondiale à plus de 200 000 en 1943.

Le président des États-Unis dispose désormais de l’appareil nécessaire pour devenir « l’Arsenal de la démocratie », à savoir l’appareil productif des Alliés. Cette transformation contribue à faire des États-Unis la première puissance militaire mondiale au sortir de la Seconde Guerre mondiale, alors qu’elle n’était que 19e avant son commencement.

Standardisation mondiale par le management

Au-delà d’une obsession nouvelle pour la représentation tant organisationnelle que politique, la seconde dimension mise en lumière par cette recherche sur l’histoire du management est plus inattendue. Elle porte sur la mise en place d’une véritable géopolitique états-unienne par le management. Notre travail sur archive a permis de mieux comprendre la genèse de cette hégémonie américaine.

La standardisation des formations au management, en particulier par des institutions telles que la Havard Business School, a contribué subtilement à cette géopolitique américaine. Tout le développement de la connaissance managériale se joue sur le sol des États-Unis et l’espace symbolique qu’il étend sur le reste du monde, du MBA aux publications académiques, dont les classements placent aujourd’hui systématiquement les revues états-uniennes au sommet de leur Olympe.

Il en va de même pour le monde des cabinets de conseil en management de l’après-guerre, dominé par des structures américaines, en particulier pour la stratégie. En 1933, le Glass-Steagall Act impose aux banques la séparation des activités de dépôt de celles d’interventions sur les marchés financiers et de façon connexe, et leur interdit d’auditer et de conseiller leurs clients. Cela ouvre un espace de marché : celui du conseil externe en management, bientôt dopé par la mobilisation industrielle puis la croissance d’après-guerre.

Des cabinets se développent comme celui fondé par James McKinsey en 1926, professeur de comptabilité à l’université de Chicago. Son intuition : les entreprises souffrent d’un déficit de management pour surmonter la Grande Dépression et croître après la Seconde Guerre mondiale. De nombreux cabinets suivent cette tendance comme le Boston Consulting Group créé en 1963.

Près de 500 000 blessés industriels

Un des points les plus frappants de notre recherche est la conséquence du management sur le corps pendant le momentum de la Seconde Guerre mondiale. Plus de 86 000 citoyens des États-Unis meurent dans les usines entre 1941 et 1945, 100 000 sont handicapés sévères et plus de 500 000 sont blessés au travail.

Une partie de nos archives sur le Brooklyn Navy Yard de New York l’illustre tristement. Dans le silence, chacun et chacune acceptent une expérience de travail impossible en considérant que leur fils, leur maris, leurs neveux, leurs amis au combat vivaient des situations certainement bien pires. Le management se fait alors patriote, américain et… mortifère.

Au final, les managers ont continué à taire une évidence tellement visible qu’on ne la questionne que trop peu : celle de l’américanité de ce qui est également devenu « nos » modes d’organisation. Au service d’une géopolitique américaine par le management.

Le projet de recherche HIMO (History of Instittutional Management & Organization) mentionné dans cet article a reçu des financements du PSL Seed Fund, de QLife et des bourses de mobilité de DRM.

- GÉNÉRALISTES

- Ballast

- Fakir

- Interstices

- Issues

- Korii

- Lava

- La revue des médias

- Time [Fr]

- Mouais

- Multitudes

- Positivr

- Regards

- Slate

- Smolny

- Socialter

- UPMagazine

- Le Zéphyr

- Idées ‧ Politique ‧ A à F

- Accattone

- À Contretemps

- Alter-éditions

- Contre-Attaque

- Contretemps

- CQFD

- Comptoir (Le)

- Déferlante (La)

- Esprit

- Frustration

- Idées ‧ Politique ‧ i à z

- L'Intimiste

- Jef Klak

- Lignes de Crêtes

- NonFiction

- Nouveaux Cahiers du Socialisme

- Période

- ARTS

- Villa Albertine

- THINK-TANKS

- Fondation Copernic

- Institut La Boétie

- Institut Rousseau

- TECH

- Dans les algorithmes

- Framablog

- Gigawatts.fr

- Goodtech.info

- Quadrature du Net

- INTERNATIONAL

- Alencontre

- Alterinfos

- AlterQuebec

- CETRI

- ESSF

- Inprecor

- Journal des Alternatives

- Guitinews

- MULTILINGUES

- Kedistan

- Quatrième Internationale

- Viewpoint Magazine

- +972 mag

- PODCASTS

- Arrêt sur Images

- Le Diplo

- LSD

- Thinkerview