15.12.2025 à 11:42

Le « quiet fighting » au travail : les signaux préinsurrectionnels dans une entreprise du CAC 40

Jérôme Coullaré, Docteur en sciences de gestion, laboratoire IAE Paris Sorbonne, IAE Paris – Sorbonne Business School

Olivier Meier, Professeur des Universités, président de l'Observatoire ASAP, Université Paris-Est Créteil Val de Marne (UPEC)

Texte intégral (1908 mots)

Gare aux fausses promesses. Si les salariés semblent silencieux, des mouvements souterrains sont à l’œuvre qui pourraient aboutir à une nouvelle forme d’insurrection. Après le « quiet quitting » – ou démission silencieuse, le phénomène de « quiet fighting » pointe maintenant.

Alerte pour les grandes entreprises ! Le fossé entre les discours éthiques et les réalités opérationnelles nourrit à la fois un désengagement manifeste et une confrontation silencieuse qu’il faut traiter sans délai. À côté du quiet quitting, popularisé en 2022 comme la stricte limitation au périmètre du rôle et des efforts des collaborateurs, s’installe un quiet fighting plus insidieux, attisé par un sentiment d’injustice organisationnelle que le cadre théorique de Cropanzano et Folger permet de disséquer (cf. encadré 1).

Si les deux phénomènes possèdent un point commun, un déficit de justice interactionnelle, ces deux dynamiques ne forment pas un continuum. Quand le quiet quitting abaisse l’engagement au minimum, le quiet fighting combine dissidence empêchée et silence de résignation. L’une et l’autre peuvent préparer en sourdine à une confrontation avec l’entreprise. Notre enquête, prolongeant un premier travail réalisé dans le cadre d’une thèse de doctorat, établit que « l’hypocrisie organisationnelle » perçue autour des ambitions éthiques ouvre une brèche entre les entreprises et leurs collaborateurs, qui rejettent désormais l’éthique de façade.

Inégalités « justes » ou injustices illégitimes

Deux vagues d’entretiens approfondis, en 2024 et 2025 selon la méthode des incidents critiques, ont été conduites auprès d’une cinquantaine de collaborateurs volontaires dans le cadre d’une demande faite en commission « qualité de vie au travail » du Conseil social et économique d’un grand groupe du CAC 40. Plus de 120 incidents ont été recensés, croisant la vision de décideurs RH du siège (sur des sujets éthiques, diversité/discrimination) et de salariés d’une direction territoriale au plus près des opérations. Résultat clé : la majorité des situations relève aujourd’hui de sujets de « justice interactionnelle », bien davantage que de « justice distributive » ou « procédurale », telles qu’elles ont été conceptualisées par Cropanzano & Folger.

À lire aussi : « Quiet quitting » : au-delà du buzz, ce que révèlent les « démissions silencieuses »

Dans les organisations, les inégalités entre collaborateurs ne sont ni fortuites ni anormales. Elles sont souvent assumées, voire encouragées, comme des leviers d’incitation fondés sur la différenciation des performances et la hiérarchie des positions. Aux DRH d’en expliciter la légitimité et d’en travailler l’acceptabilité aux yeux des collaborateurs. Dans ce cadre, la grille des stratégies réactionnelles (Exit, Voice, Loyalty, Neglect) proposée par le socioéconomiste Albert Hirschman reste un outil utile pour éclairer les réactions des salariés face à des situations d’insatisfaction au travail (cf. encadré 2).

De la justice à la morale

Or notre étude montre que cette grille, si utile pour repérer et gérer les réactions des collaborateurs, ne suffit plus. La nature des injustices se déplace et suscite de nouvelles stratégies réactionnelles chez les salariés. Ce ne sont plus seulement les règles ou la répartition des résultats qui sont contestées, mais l’écart entre les discours éthiques et les pratiques organisationnelles. Quand l’expérience dément la promesse, le « contrat psychologique » se fissure et la question devient morale, touchant l’identité, la dignité, et une responsabilité qui dépasse les conflits transactionnels. Notre étude montre que l’on ne « négocie » plus une injustice morale jugée illégitime ; on la refuse.

Dans ce contexte, l’approche par l’EVLN apparaît incomplète. Elle saisit justement mal la dimension morale des conflits et l’incohérence ente les politiques affichées et les pratiques. L’épreuve de réalité est amplifiée par les exigences de publication extra-financière imposée par la directive de durabilité (CSRD), la vigilance citoyenne face au diversity/social washing et, en toile de fond, la tension décrite par le juriste Alain Supiot entre l’entreprise marchandise (ius proprietatis) et l’entreprise communauté morale (ius societatis) (cf. encadré 3).

Plus une organisation revendique une raison d’être morale, plus elle doit en apporter la preuve ; sinon, la loyauté de ses collaborateurs se mue en allégeance à contrecœur, porteuse de ressentiment.

Les sources du « quiet fighting »

Depuis les ordonnances « travail » de 2017, l’affaiblissement des médiations et de « dialogue social » ouvre un espace aux minorités actives décrites par Serge Moscovici. Dans notre étude, nous constatons qu’elles sont emmenées par des femmes racisées en position de cadres intermédiaires : elles formulent des récits cohérents et assument le risque de dissidence, mais se heurtent à des procédures neutralisantes et à l’absence de relais hiérarchiques. Il en résulte une [ dissidence empêchée] qui s’appuie en partie sur les travaux de la sociologue Maryvonne David-Jougneau : une mobilisation collective inachevée, dont l’influence reste pour le moment sans effet transformateur, mais qui contribue à accroître l’expérience organisationnelle et la capacité d’agir de ces cadres et des collectifs qu’elles animent.

À l’autre pôle émerge une colère souvent masculine, silencieuse et résignée. Ancrée dans un idéal méritocratique, elle repose sur la conviction que la performance, à elle seule, devrait protéger et « parler d’elle-même », sans qu’il soit besoin de la revendiquer. Cette colère est renforcée par l’attente, souvent déçue, d’une réparation portée par la DRH. Mais lorsque les circuits correctifs internes sont lents, incertains, ou centrés sur la conformité plutôt que sur l’explication et la reconnaissance du tort, la trahison institutionnelle s’impose et l’attente des collaborateurs devient ressentiment, prémisse d’un désir de revanche à fort potentiel déstabilisateur.

Ce silence de résignation, n’est pas un signe de paix sociale : il est la traduction d’une résistance contrainte, une colère froide qui prépare la confrontation, nourrie par l’empilement de micro-injustices, la polarisation, l’usure des institutions de dialogue et l’ascension d’acteurs minoritaires déterminés. Si l’explosion n’advient pas, c’est moins par loyauté que par contraintes économiques et sociales.

Une gouvernance à revoir

À l’échelle managériale, l’exigence est claire : gouverner par la justice interactionnelle. Cette gouvernance implique de :

aligner promesses et pratiques organisationnelles ;

expliquer les décisions sensibles et prévoir des voies d’escalade claires et sûres (manager N+1/N+2 → RH/Business Partner → référent éthique → dispositif d’alerte interne), assorties de garanties explicites de protection : interdiction de toute mesure liée au signalement (blâme, sanction, rétrogradation, baisse de variable, modification de poste, mise à l’écart, licenciement), confidentialité et possibilité d’anonymat, restitution motivée ;

proposer des médiations internes crédibles (médiateur interne formé, IRP ou Employee Resource Group) et en dernier ressort, des recours externes balisés : Inspection du travail, Défenseur des droits), pour pallier la faiblesse des instances de représentation du personnel ;

installer des capteurs précoces (baromètres qualitatifs, création d’espaces de délibération protégés) pour « reconnaître et réparer vite » toute inégalité illégitime ;

intégrer des objectifs de justice interactionnelle dans la performance sociale des dirigeants ;

répondre à la demande croissante des sciences de gestion : rendre compte non seulement de la classique matérialité financière, mais également de la matérialité d’impact, (effets négatifs de l’entreprise sur les parties prenantes), confirmant l’injonction de Supiot d’un ius societatis à assumer.

Réduire l’écart entre discours et réalité

Dans le sillage des travaux de la sociologue Laure Bereni, notre conclusion est une mise en garde aux organisations qui « jouent » encore avec l’éthique. L’écart entre discours et réalités, nourri par le social/diversity washing, alimente une conflictualité dans les organisations dont l’éthique devient l’étendard.

Le quiet fighting est un signal pré-insurrectionnel. Tandis que les coûts de sortie et l’incertitude du marché rendent l’exit improbable, le quiet fighting traduit une conflictualité interne croissante plutôt que des départs : ancré dans des enjeux moraux et identitaires, il s’exprime par une résistance à bas bruit et des coalitions discrètes. Les dirigeants disposent toutefois des leviers essentiels. Ils peuvent faire preuve plutôt que promettre, légitimer plutôt qu’imposer, soigner les interactions autant que les résultats. À ce prix, le quiet fighting s’éteindra et le conflit redeviendra une ressource. Répondre par la justice interactionnelle n’est pas un supplément d’âme mais une condition de viabilité sociale et économique et, désormais, un test décisif de crédibilité et de légitimité managériales.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

15.12.2025 à 11:41

Quand le management a fait des États-Unis une superpuissance

François-Xavier de Vaujany, Professeur en management & théories des organisations, Université Paris Dauphine – PSL

Texte intégral (3243 mots)

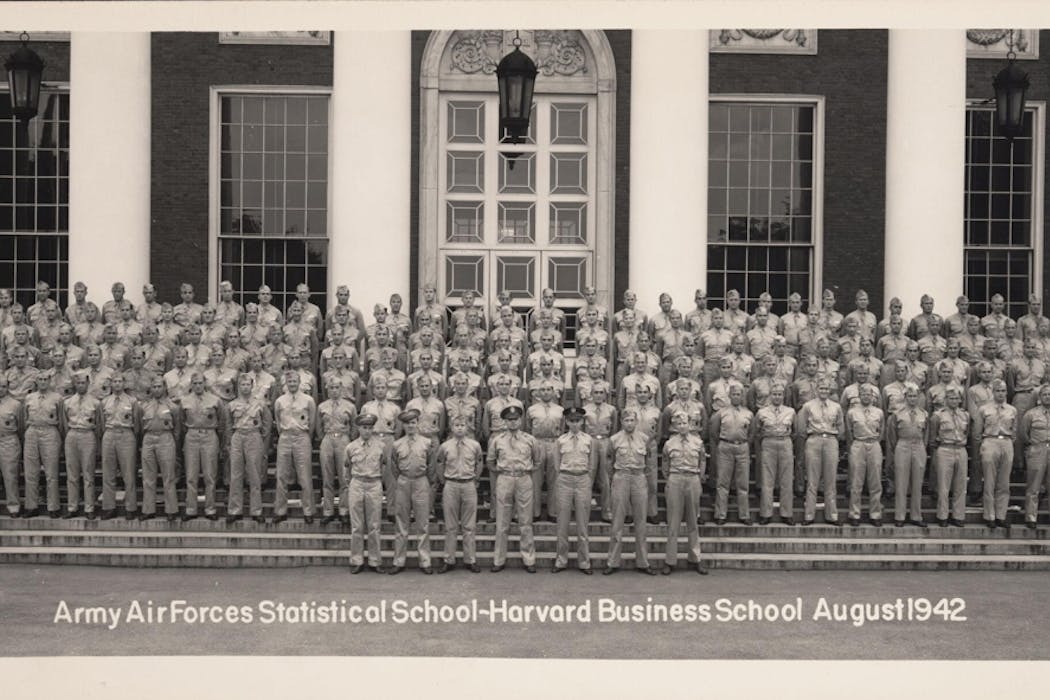

Une étude internationale, impliquant des chercheurs français, états-uniens et brésiliens, a mis au jour une histoire méconnue. Des années 1920 aux années 1960, le management a contribué à faire des États-Unis la puissance hégémonique que l’on connaît aujourd’hui. Son « momentum » : la Seconde Guerre mondiale. Ses armes : les managers formés dans les grandes écoles, les outils d’aide à la décision et la technostructure de l’État fédéral.

Explorer des archives, c’est évoluer dans un monde à la fois silencieux et étrange vu d’aujourd’hui. Comme l’explique l’historienne Arlette Farge dans son livre le Goût de l’archive (1989), le travail de terrain des historiens est souvent ingrat, fastidieux, voire ennuyeux. Puis au fil de recoupements, à la lumière d’une pièce en particulier, quelque chose de surprenant se passe parfois. Un déclic reconfigurant un ensemble d’idées.

C’est exactement ce qui est arrivé dans le cadre d’un projet sur l’histoire du management états-unien (HIMO) débuté en 2017, impliquant une douzaine de chercheurs français, états-uniens et brésiliens.

Notre idée ? Comprendre le lien entre l’histoire des modes d’organisation managériaux du travail et les épisodes de guerre aux États-Unis. D’abord orientée vers le XXe siècle, la période d’étude a été resserrée des années 1920 à la fin des années 1960, avec comme tournant la Seconde Guerre mondiale.

Du taylorisme au management

Au début de notre recherche en 2017, nous nous sommes demandé ce qui guidait cette métamorphose du management des années 1920 aux années 1960.

Au commencement était le taylorisme. On attribue à l’ingénieur américain Frederick Winslow Taylor (1856-1915) l’invention d’une nouvelle organisation scientifique du travail dans The Principles of Scientific Management. Ce one best way devient la norme. Au cœur de cette division du travail, la mutation des rôles des contremaîtres est essentielle.

Leur fonction est d’abord de s’assurer à la fois de la présence des ouvriers et du respect des gestes prescrits par les dirigeants. Avec le management, une révolution copernicienne est en marche. Les contremaîtres sont progressivement remplacés par les techniques de management elles-mêmes. Le contrôle se fait à distance, et devient de l’autocontrôle. Des outils et des systèmes d’information sont développés ou généralisés, comme les pointeuses. Peu à peu, toutes ces informations sont connectées à des réseaux… qui dessinent ce qui deviendra des réseaux informatiques. L’objectif : suivre l’activité en temps réel et créer des rapports à même d’aider les managers dans leur prise de décision.

Outils de gestion de projet

C’est ce que la philosophie nomme le représentationnalisme. Le monde devient représentable, et s’il est représentable, il est contrôlable. Sur un temps long, de nombreux outils de gestion de projet sont créés comme :

le diagramme de Gantt, formalisé et diffusé dans les années 1910 par l’ingénieur du même nom, afin de visualiser dans le temps les diverses tâches ;

le Program Evaluation and Review Technic (PERT), élaboré dans les années d’après-guerre pour analyser et représenter les tâches impliquées ;

ou les Key Performance Indicators (KPI), des indicateurs utilisés pour l’aide à la décision.

Nombre de ces techniques ou standards de management ont une genèse américaine comme l’ont montré notamment les travaux de Locke et Spender, Clegg, Djelic ou D’Iribarne. Des années 1910 aux années 1950, une importance croissante est accordée à la visualisation des situations.

À lire aussi : Les origines néolibérales de la mondialisation : retour sur l’émergence d’un ordre géopolitique aujourd’hui menacé

Notre intuition d’une obsession pour la représentation s’est affinée avec l’exploration d’archives liées aux réseaux du management, de l’Academy of Management, l’American Management Association, et la Society for Advancement of Management.

Management de l’armée

Dans son introduction de la conférence de l’Academy of Management de 1938, l’économiste Harlow Person, acteur clé de la Taylor Society, revient sur le rôle joué par la visualisation. Concrètement, une mission d’amélioration des processus administratifs est réalisée pour l’armée américaine durant la Première Guerre mondiale. L’organisation scientifique du travail déploie plus que jamais ses outils au-delà des chiffres et du texte.

Pendant la Seconde Guerre mondiale, l’obsession pour la représentation est au cœur de la stratégie militaire des États-Unis, en synergie vraisemblablement avec le management. Par exemple, la carte d’état-major doit représenter la situation la plus fidèle possible au champ de bataille. Chaque drapeau, chaque figurine représentant un bataillon ami ou ennemi, doit suivre fidèlement les mouvements de chacun lors du combat. Toutes les pièces évoluant en temps réel permettent au généralissime de prendre les meilleures décisions possibles.

Mise en place d’une technostructure par Franklin Roosevelt

Un président des États-Unis incarne cette rupture managériale dans la sphère politique : Franklin Roosevelt. Secrétaire assistant à la Navy dans sa jeunesse, il assimile l’importance des techniques d’organisation dans les arsenaux maritimes de Philadelphie et New York, pour la plupart mis en œuvre par les disciples de Frederick Winslow Taylor.

Après la crise de 1929, la mise en place de politiques centralisées de relance a pour conséquence organisationnelle d’installer une technostructure. Plus que jamais, il faut contrôler et réguler l’économie. Un véritable État fédéral prend naissance avec la mobilisation industrielle initiée dès 1940.

Lorsque le New Deal est mis en place, Franklin Roosevelt comprend que le management peut lui permettre de changer le rapport de force entre pouvoir exécutif et pouvoir législatif. Progressivement, il oppose la rationalité de l’appareil fédéral et son efficience à la logique plus bureaucratique incarnée par le Congrès. Concrètement, les effectifs de la Maison Blanche passent de quelques dizaines de fonctionnaires avant la Seconde Guerre mondiale à plus de 200 000 en 1943.

Le président des États-Unis dispose désormais de l’appareil nécessaire pour devenir « l’Arsenal de la démocratie », à savoir l’appareil productif des Alliés. Cette transformation contribue à faire des États-Unis la première puissance militaire mondiale au sortir de la Seconde Guerre mondiale, alors qu’elle n’était que 19e avant son commencement.

Standardisation mondiale par le management

Au-delà d’une obsession nouvelle pour la représentation tant organisationnelle que politique, la seconde dimension mise en lumière par cette recherche sur l’histoire du management est plus inattendue. Elle porte sur la mise en place d’une véritable géopolitique états-unienne par le management. Notre travail sur archive a permis de mieux comprendre la genèse de cette hégémonie américaine.

La standardisation des formations au management, en particulier par des institutions telles que la Havard Business School, a contribué subtilement à cette géopolitique américaine. Tout le développement de la connaissance managériale se joue sur le sol des États-Unis et l’espace symbolique qu’il étend sur le reste du monde, du MBA aux publications académiques, dont les classements placent aujourd’hui systématiquement les revues états-uniennes au sommet de leur Olympe.

Il en va de même pour le monde des cabinets de conseil en management de l’après-guerre, dominé par des structures américaines, en particulier pour la stratégie. En 1933, le Glass-Steagall Act impose aux banques la séparation des activités de dépôt de celles d’interventions sur les marchés financiers et de façon connexe, et leur interdit d’auditer et de conseiller leurs clients. Cela ouvre un espace de marché : celui du conseil externe en management, bientôt dopé par la mobilisation industrielle puis la croissance d’après-guerre.

Des cabinets se développent comme celui fondé par James McKinsey en 1926, professeur de comptabilité à l’université de Chicago. Son intuition : les entreprises souffrent d’un déficit de management pour surmonter la Grande Dépression et croître après la Seconde Guerre mondiale. De nombreux cabinets suivent cette tendance comme le Boston Consulting Group créé en 1963.

Près de 500 000 blessés industriels

Un des points les plus frappants de notre recherche est la conséquence du management sur le corps pendant le momentum de la Seconde Guerre mondiale. Plus de 86 000 citoyens des États-Unis meurent dans les usines entre 1941 et 1945, 100 000 sont handicapés sévères et plus de 500 000 sont blessés au travail.

Une partie de nos archives sur le Brooklyn Navy Yard de New York l’illustre tristement. Dans le silence, chacun et chacune acceptent une expérience de travail impossible en considérant que leur fils, leur maris, leurs neveux, leurs amis au combat vivaient des situations certainement bien pires. Le management se fait alors patriote, américain et… mortifère.

Au final, les managers ont continué à taire une évidence tellement visible qu’on ne la questionne que trop peu : celle de l’américanité de ce qui est également devenu « nos » modes d’organisation. Au service d’une géopolitique américaine par le management.

Le projet de recherche HIMO (History of Instittutional Management & Organization) mentionné dans cet article a reçu des financements du PSL Seed Fund, de QLife et des bourses de mobilité de DRM.

- GÉNÉRALISTES

- Ballast

- Fakir

- Interstices

- Issues

- Korii

- Lava

- La revue des médias

- Time [Fr]

- Mouais

- Multitudes

- Positivr

- Regards

- Slate

- Smolny

- Socialter

- UPMagazine

- Le Zéphyr

- Idées ‧ Politique ‧ A à F

- Accattone

- À Contretemps

- Alter-éditions

- Contre-Attaque

- Contretemps

- CQFD

- Comptoir (Le)

- Déferlante (La)

- Esprit

- Frustration

- Idées ‧ Politique ‧ i à z

- L'Intimiste

- Jef Klak

- Lignes de Crêtes

- NonFiction

- Nouveaux Cahiers du Socialisme

- Période

- ARTS

- Villa Albertine

- THINK-TANKS

- Fondation Copernic

- Institut La Boétie

- Institut Rousseau

- TECH

- Dans les algorithmes

- Framablog

- Gigawatts.fr

- Goodtech.info

- Quadrature du Net

- INTERNATIONAL

- Alencontre

- Alterinfos

- AlterQuebec

- CETRI

- ESSF

- Inprecor

- Journal des Alternatives

- Guitinews

- MULTILINGUES

- Kedistan

- Quatrième Internationale

- Viewpoint Magazine

- +972 mag

- PODCASTS

- Arrêt sur Images

- Le Diplo

- LSD

- Thinkerview