01.09.2025 à 08:42

TFTT #18 – Être de l’IA, ou ne pas être de l’IA : telle est la question [Interview Label4.AI] 🗣

Thomas Beaufils

Ce mois-ci dans Tales from the Tech, nous allons à nouveau discuter d'intelligence artificielle générative, mais d'une manière différente, et avec un invité de (water)marque.

Vous ne comprenez pas encore la boutade ? C'est normal

Texte intégral (9284 mots)

![TFTT #18 – Être de l’IA, ou ne pas être de l’IA : telle est la question [Interview Label4.AI] 🗣](https://storage.ghost.io/c/d5/3c/d53ce34f-1cb4-4a4e-b39e-440a2b231fe9/content/images/2025/08/last-action-hero-photo-last-action-hero-1002644.jpg)

Ce mois-ci dans Tales from the Tech, nous allons à nouveau discuter d'intelligence artificielle générative, mais d'une manière différente, et avec un invité de (water)marque.

Vous ne comprenez pas encore la boutade ? C'est normal 😇

Cet invité va nous aider à répondre à une question :

Avec l'avènement de l'IA générative, on assiste à ce que certain.e.s appellent le "pourrissement d'internet", une ère en ligne où il devient difficile de distinguer ce qui est vrai de ce qui est faux. Alors : des méthodes existent-elles pour parvenir à maintenir cette distinction ?

Cet invité, c'est Nicolas Bodin Guittard, l'un des co-fondateurs de Label4AI, et on va se parler de ce que fait son entreprise, de pourquoi "tatouer" les contenus générés par l'IA est important... et de souveraineté numérique, aussi.

On vous a fait suivre cette newsletter ? Pensez à vous inscrire via le bouton !

Vous pouvez également soutenir mon travail à hauteur de 1, 3 ou 5€ / mois, ou bien faire un don ponctuel 🙏

De retour à l'ère de la rumeur ?

Avec la victoire du Brexit en juin 2016 puis l'arrivée au pouvoir de Trump pour la première fois en janvier 2017, nous découvrions l'ère de la post-vérité. Nous entrions dans une période formidable où dire la vérité n'était plus important, c'était dire ce que les gens veulent entendre qui comptait, et surtout le dire plus fort que le voisin.

Avec l'avènement de l'intelligence artificielle générative quelques années plus tard, et la frénésie qui entoure cette technologie depuis, il ne faut pas s'étonner de voir le second mandat de Trump marquer un rapprochement inédit entre le camp du président d'extrême droite états-unien et les grandes entreprises de la tech, principalement états-uniennes elles-aussi.

Ces dernières sont prêtes à tout pour voir le traffic augmenter sur leurs plateformes, peu importe la nature des messages et des contenus qui y sont partagés, peu importe que cela mette en danger les individus et les organisations.

Nous sommes donc dans l’ère du doute permanent, en ligne : tout ce que vous lisez, tout ce que vous voyez sur internet peut être faux, puisque produit par des machines sans qu'on connaisse bien les intentions des auteurs derrière, ou la fiabilité desdites machines, entre hallucinations et omissions.

![TFTT #18 – Être de l’IA, ou ne pas être de l’IA : telle est la question [Interview Label4.AI] 🗣](https://storage.ghost.io/c/d5/3c/d53ce34f-1cb4-4a4e-b39e-440a2b231fe9/content/images/2025/08/1755765109621.jpeg)

Qui croire alors, de qui se méfier ?

Alors que le "monde moderne" et "l'ère de l'information" devait nous apporter une meilleure compréhension commune du monde et donc rapprocher les peuples et les individus, la fatigue informationnelle poussée par des outils de production à la chaîne de contenus synthétiques pourrait parvenir à déliter ce qu'il nous restait au moins en commun : le réel.

Serions-nous donc de retour à l'ère de la rumeur, quand les dragons sur les cartes marines passaient pour réels ?

Pas encore.

Mais dans ce contexte, il est plus primordial que jamais de savoir ce qui a été généré par une IA, ou ce qui a été réalisé par la "main" de l'humain.

![TFTT #18 – Être de l’IA, ou ne pas être de l’IA : telle est la question [Interview Label4.AI] 🗣](https://storage.ghost.io/c/d5/3c/d53ce34f-1cb4-4a4e-b39e-440a2b231fe9/content/images/2025/08/Patagon.jpg)

"Être de l’IA ou ne pas être de l’IA, telle est la question."

Voilà comment je résumerais en une phrase référencée la mission primordiale que s'est fixé Nicolas Bodin Guittard avec son projet Label4AI, spécialisé dans la traçabilité des contenus générés par IA. Il en est le CEO, comme on dit dans le monde des startups. Le Directeur Général, en somme.

Dans un monde où, on l'a vu, il devient de plus en plus difficile de distinguer le vrai du faux, développer des outils qui permettent de savoir ce qui a été généré par l'IA ou pas devient une question de vie ou de mort... pour nos démocraties de manière globale, comme pour toute entreprise ou organisation. Sans parler de notre santé mentale individuelle et collective.

⚠ Avertissement important : à la différence du premier entretien que j'avais réalisé avec Will Alpine, Nicolas et moi nous connaissons bien. Nous nous sommes rencontrés chez Shadow, l'entreprise de cloud computing rachetée en 2021 par Octave Klaba avec de grandes ambitions autour des enjeux de souveraineté numérique. Il en était le directeur juridique, j'en étais le directeur de la communication.

Même si nos visions de l'IA, notamment générative, diffèrent sur certains points, nous partageons le même constat d'un besoin d'encadrer et de légiférer sur le sujet. C'est cette constatation commune qui a mené à l'entretien que vous allez lire aujourd'hui.

Un entretien au cours duquel j'ai appris beaucoup de choses, et mieux compris le fonctionnement même des IA génératives. J'espère qu'il en sera de même pour vous.

Bonne lecture 🤗

![TFTT #18 – Être de l’IA, ou ne pas être de l’IA : telle est la question [Interview Label4.AI] 🗣](https://storage.ghost.io/c/d5/3c/d53ce34f-1cb4-4a4e-b39e-440a2b231fe9/content/images/2025/08/L-interview.jpg)

Salut Nicolas, merci beaucoup de répondre à mes questions pour Tales from the Tech. Tu es le co-fondateur de Label4AI, une entreprise dont le boulot est marquer et détecter les contenus générés par l’IA. Comment toi, tu définirais la mission de ce projet ?

Nicolas Bodin Guittard : Je commencerais par les bases : l’IA générative, c’est quoi ? Ce sont des contenus qui ressemblent à la réalité, produits de façon « cheap », en masse, par potentiellement n'importe qui. Cette production, elle perturbe tous les processus qui sont en place dans les entreprises et les organisations. Nous, on veut apporter une solution technologique qui permet de maintenir l'équilibre pour que ces structures puissent garder le contrôle, dans un contexte où l’IA générative vient tout bousculer.

Concrètement cela veut dire quoi ? Cela veut dire taguer le contenu "synthétique" dès sa naissance – ce qu’on appelle le watermark – et donner les outils pour détecter ce "tatouage numérique" dès qu'on y est confronté. On retrouve cette dualité en permanence. Taguer et détecter les contenus pour connaître leur vraie nature, pour éviter toute confusion entre ce qui est généré par l’IA, et ce qui ne l’est pas.

C’est une précision importante : nous ne sommes pas du tout « contre l'IA ». Au contraire, je trouve que c'est une technologie très intéressante ; modulo les aspects écologiques qui te sont chers et auxquels je suis également sensible. En revanche, c'est une techno qui, compte tenu de ses paramètres, est aussi un eldorado pour les fraudeurs et les gens malhonnêtes.

![TFTT #18 – Être de l’IA, ou ne pas être de l’IA : telle est la question [Interview Label4.AI] 🗣](https://storage.ghost.io/c/d5/3c/d53ce34f-1cb4-4a4e-b39e-440a2b231fe9/content/images/2025/08/Nicolas-1.png)

Je te demanderai après de rentrer dans le détail technique de ce watermark, parce que c’est la clé de tout ici... Mais avant ça, tu peux m’expliquer comment tu en es arrivé à ce projet ?

NBG : Je viens du monde du droit. J’ai eu un parcours juridique classique, et j'ai fait mes armes dans des cabinet d'avocats, avec de rejoindre de grosses boites, notamment TF1. J'ai ensuite embrayé assez rapidement sur les startups, à partir de 2015, avec un angle tech net, et toujours avec la notion de souveraineté [numérique] en toile de fond. Cette dernière dimension, je l’ai retrouvé au départ un peu par hasard, puis par conviction. C’est ce qui m’a amené chez Shadow et Qwant [N.d.A. : entreprises où nous nous sommes donc rencontrés, les deux ayant été regroupées dans une même structure suite aux rachats successifs d’Octave Klaba].

J'ai ensuite rencontré un groupe de chercheurs rennais qui avait un projet ambitieux autour de la détection des contenus IA, avec des profils techniques très solides. Le sujet m'intéressait déjà beaucoup, et ils avaient besoin de quelqu’un pour apporter la dimension juridique au projet et structurer l’activité. On est maintenant six co-fondateurs, avec des profils très "deep tech", la plupart sont des doctorants/PhD en informatique appliquée, avec entre 15 et 20 ans de métier.

C’est là que la complémentarité intervient : comme avec Label4AI on est entre la tech et le réglementaire, ça se complète très bien, puisqu’Anthony [Level, le CSO de l'entreprise] et moi sommes les deux personnes "non-tech" de l’équipe. Lui sur la partie affaires publiques, moi sur la partie juridique. Cela nous permet d’avoir une très bonne compréhension des réglementations autour de l'IA, notamment de l’AI Act. Compréhension du contexte, des impacts que cette réglementation peut avoir, de la traçabilité que ça demande, etc.

Nous sommes aussi très liés à la recherche [N.d.A. : notamment avec l'INRIA et le CNRS en France ou l’Université de Naples en Italie], ce qui se traduit par beaucoup d’échanges avec des facs et laboratoires de recherche. On souhaite participer à l'application industrielle des travaux académiques, ce qui représente souvent une étape difficile : passer du laboratoire à la "vraie vie".

Tu l’as esquissé ici, ton projet est par définition complexe et technique. Comment tu arriverais à expliquer comment marche ce "watermarking", cet tatouage numérique que tu évoquais ?

NBG : Je vais commencer par une précision clé : le "watermarking", c'est une fonctionnalité, ce n'est pas une technologie. Et c’est une fonctionnalité qui date : elle existe sous différentes natures depuis plus de 30 ans. Ce qui diffère ici, c’est notre façon de l’appliquer au contenu généré par IA. Le watermarking, c'est un principe selon lequel un élément invisible est inséré dans un contenu, ce qui permet sa traçabilité ultérieure. On vient incruster dans le contenu, très en profondeur et de manière invisible, sa carte d'identité, infalsifiable. Comme le filigrane des billets de banque, en quelque sorte.

Disons, pour simplifier, qu’il existe aujourd’hui 3 types de watermarking, en fonction des formats les plus communs de contenus générés par IA :

Primo, il y a l'image : on modifie l'image au niveau des pixels. On pose un "masque" sur l’image, spécifique à ses éléments saillants. Quand c’est bien fait, c’est complètement invisible ; quand c’est mal fait, ça peut modifier des éléments comme la colorimétrie de l’image… Ensuite, avec le détecteur approprié, on peut déterminer que c'est bien l'image à laquelle on fait référence, ou bien vérifier sa provenance, selon les critères du "tag".

Après son invisibilité, un autre point clé d’un watermark c’est sa robustesse : quelques soient les modifications et les "attaques" faites à l’image, on doit pouvoir retrouver le tag. Dans notre cas, même si quelqu’un vient prendre en photo l’image watermarké sur ton écran d’ordinateur avec un autre appareil, par exemple, et bien le tag restera fonctionnel. Idem en cas de compression, ou de réencodage de l'image. De ce point de vue, c'est la méthode la plus robuste.

Deuxio, sur l’audio. Il y a plusieurs manières de watermarker un fichier audio, mais la meilleure façon de le faire selon nous (et en simplifiant le concept) c’est de jouer sur les fréquences inaudibles, pour ajouter au contenu généré une marque que seul un algorithme spécialisé pourra "entendre".

Enfin pour le texte, c’est le plus complexe : comme un LLM [N.d.A. : Large Language Model, grand modèle de language en français, dont l'exemple le plus connu est bien sûr ChatGPT] est un modèle statistique, on vient tester les pourcentages de probabilité. Pour simplifier : un LLM génère du texte mot par mot, chaque mot étant ce qu'on appelle un "token". Chaque mot se voit attribué un score de probabilité, basé sur la probabilité qu'il soit généré ensuite. Par exemple, dans la phrase "mes animaux de compagnie préférés sont les chats et...", le mot "chien" aura un score de probabilité plus élevé que le mot "voiture". Là, on vient ajuster ces scores de probabilité pour générer un watermark invisible en choisissant le mot que le LLM aurait choisi en deuxième, et qui n'affecte pas le sens et la qualité du résultat.

Ce qui est sûr, c’est que seul le watermark permet une détection fiable de ce type de contenus. Soyons clairs : les systèmes de détection de textes générés disponibles facilement en ligne pour savoir si un texte est généré ou non ne sont pas fiables ! Ça peut fonctionner en trouvant des "patterns", mais il y a un énorme problème de faux positifs.

![TFTT #18 – Être de l’IA, ou ne pas être de l’IA : telle est la question [Interview Label4.AI] 🗣](https://storage.ghost.io/c/d5/3c/d53ce34f-1cb4-4a4e-b39e-440a2b231fe9/content/images/2025/08/ZeroGPT.png)

Il existe d’autres méthodes que le watermarking pour "marquer" les contenus générés par IA comme tel. Peux-tu m’en dire plus, et m’expliquer pourquoi vous, vous avez opté pour le watermarking ?

NBG : Il y a en effet d’autres méthodes de "tag" pour identifier les contenus qui sont générés avec de l’IA. Celle dont on parle le plus, c’est la "metadata", ou métadonnée. Tu ajoutes simplement dans les données du fichier, quelle que soit sa nature, que ledit fichier est créé via un outil d’IA générative, et lequel. Basta.

Il y a aussi la méthode du "fingerprinting", qui demande à ce que tous les contenus générés par IA aient une "empreinte digitale" distincte, disponible dans une énorme base de donnée. Une espèce de Shazam, pour résumer grossièrement. Il y a enfin des méthodes qui se basent sur une utilisation de la blockchain.

Chacune de ces méthodes doit être évaluée selon quatre critères : efficacité, interopérabilité, robustesse et accessibilité.

Le truc, c’est que selon nous, aucune méthode n'est aussi fiable que le watermarking. Pour revenir aux métadonnées, l'un des modèles le plus connu est le C2PA, porté notamment par Adobe. Il est intéressant, mais n'est clairement pas le plus robuste, et doit être envisagé avec d'autres solutions en parallèle. Quelqu'un a par exemple réussi à faire dire aux metadatas que la fameuse photo du Pape en doudoune était une photo officielle du Vatican ! Ça, ce n’est pas possible avec le watermark.

![TFTT #18 – Être de l’IA, ou ne pas être de l’IA : telle est la question [Interview Label4.AI] 🗣](https://storage.ghost.io/c/d5/3c/d53ce34f-1cb4-4a4e-b39e-440a2b231fe9/content/images/2025/08/C2PA.png)

Du côté étatique, c'est également la méthode du watermarking qui est généralement suggérée, parce que c'est celle qui propose le meilleur compromis entre robustesse, sécurité et facilité de déploiement.

Parce que si le watermarking, comme toute méthode de tag, génère des faux positifs… il le fait beaucoup moins que les autres : environ 1 pour 1 milliard, pour notre propre méthode de watermarking. C'est rien. D'autres techniques, pourtant avancées, produisent un faux positif pour 1 000, au mieux. C'est donc beaucoup moins fiable, et utiliser à grande échelle, cela va générer beaucoup d'erreurs.

Notre vocation, ce n’est pas de rendre les "deep fake" impossibles, parce qu’aucune méthode n’est fiable à 100%. Mais à l’heure actuelle, le watermarking est la méthode la plus fiable, la plus dure à "craquer", compte tenu des paramètres qu'on doit mettre en œuvre.

Maintenant, ce watermarking, il faut qu’il soit bien fait. On a un concurrent, que je ne citerai pas, qui a proposé sa propre méthode de watermark. Ils ont sorti leur modèle, et honnêtement : on l'a craqué en dix minutes. C'est hyper dangereux. Il vaut mieux pas de watermark, qu’un watermark de mauvaise qualité qui offre l'illusion de la sécurité. Sinon, après, on peut imaginer un hacker qui sait imiter la technique de watermarking d’une entreprise et fait passer un faux document pour un vrai… Là, ça peut aller très vite. Ça participerait à saper la confiance du public dans la notion de watermarking.

Surtout, pour conclure, je dirais qu'aucune méthode de tag seule n'est magique. Mais pour nous, le socle le plus sûr reste donc le watermark.

Je fais une parenthèse, mais, à propos d'impact environnemental : parmi toutes les méthodes, le tatouage est la plus intéressante, parce que ce n’est que quelques pixels à superposer sur le fichier. Comme il va falloir monter à l'échelle pour imposer un modèle, on va se parler d’énormes quantités de tatouages numériques à apposer. Donc, si à chaque fois que tu génères quelques chose, tu dois apposer un tag, il faut avoir la chose le plus légère possible. C’est le cas avec le watermark. À l'inverse, les métadonnées, par exemple, alourdissent considérablement chaque fichier généré.

L’orientation de Label4AI est uniquement professionnelle à ce stade. Il y a une vision à moyen, long terme pour aller aussi vers le grand public ?

NBG : Bien sûr, puisqu'à la fin, c'est le public qui compte. Mais c'est un peu le paradoxe de notre entreprise et de notre marché : on a besoin des entreprises pour protéger les consommateurs.

Je m’explique : que tout un chacun ait la capacité à marquer les contenus comme générés par IA ne va pas régler le problème. On s'en fout un peu que quelqu’un puisse utiliser un détecteur pour déterminer si les petits lapins sont vrais ou faux. Ce qu'il faut, à grande échelle et de façon systémique, c’est que les entreprises se saisissent du sujet. L’enjeu, c’est qu’il faut pouvoir lutter contre des campagnes massives de fraude qui déferlent sur les entreprises et leurs clients, qu’ils soient professionnels ou particuliers.

Il faut rappeler qu’à partir de 2026, le tag des contenus générés par IA sera obligatoire pour toutes les entreprises présentes en Europe, comme le stipule l'article 50 de l'AI Act, tandis que la Chine le recommande aussi, et l'Inde ne devrait plus tarder. C’était le cas aux États-Unis il n’y a pas si longtemps, mais Trump 2 est arrivé… ce qui n'empêche pas la Californie d'avancer sur le sujet. Bref : c’est donc par là qu’il faut prendre le truc.

Donc pour revenir à ta question initiale : on s’adresse à des entreprises, mais le but in fine, c’est d’afficher à tous les utilisateurs quels contenus ont été générés ou modifiés à l’aide de l’intelligence artificielle.

![TFTT #18 – Être de l’IA, ou ne pas être de l’IA : telle est la question [Interview Label4.AI] 🗣](https://storage.ghost.io/c/d5/3c/d53ce34f-1cb4-4a4e-b39e-440a2b231fe9/content/images/2025/08/Lapins.png)

Tu as beaucoup parlé de la fraude, mais y’a-t-il d’autres domaines d’application qui vont être importants pour vous ?

NBG : Honnêtement, le cœur de notre activité cela va être de détecter la fraude, ou d'assainir l’écosystème pour prévenir cette fraude. Aujourd’hui, il est clair que toutes les entreprises qui proposent de l’IA générative devraient marquer leur contenu.

Or, certains comme Google et Meta le font pour des raisons avant tout pratiques, c'est-à-dire ne pas ré-entraîner leur propre système sur des choses déjà générés [N.d.A. : une des raisons du ralentissement des progrès des LLM]... même si les raisons éthiques arrivent, poussées par la réglementation. Il y a tout de même des variantes : une vidéo générée par Veo3 sera estampillée comme synthétique sur Youtube, mais pas sur Facebook et Instagram.

Par ailleurs, quand tu as des entreprises, comme ElevenLabs, qui permettent de faire de la reproduction vocale à partir de quelques secondes d'échantillon, il y a une obligation morale et éthique majeure à la mise en place d’un système qui permette de déterminer si on est face à du contenu synthétique ou non.

Si on élargit à d’autres sujets qui peuvent parler à tout le monde, il y a d’ailleurs eu cette enquête sur la présence de contenus générés par IA sur des plateformes comme Vinted [N.d.A. : d’abord révélé par l’influenceur écolo Johan Reboul], même si on est moins sur de la fraude que de la tromperie. La question de la traçabilité, elle est aussi importante à ce niveau-là.

![TFTT #18 – Être de l’IA, ou ne pas être de l’IA : telle est la question [Interview Label4.AI] 🗣](https://storage.ghost.io/c/d5/3c/d53ce34f-1cb4-4a4e-b39e-440a2b231fe9/content/images/2025/08/Vinted.png)

De toute manière, si on regarde les choses à échéance plus longue, il n'y aura pas de vision binaire des choses. Du synthétique, il y en a déjà partout en ligne, alors imaginez dans 10 ans. L'idée ça va donc être de taguer ces contenus synthétiques pour savoir à quel niveau, à quel degré, le contenu que vous avez en face de vous a été généré.

Philosophiquement, ça posera d'ailleurs des questions assez passionnantes : à partir de quel "pourcentage" de contenu généré par une IA on considèrera qu'un document est généré par un humain, ou bien seulement par une IA ?

Il y a un autre exemple qui m’intéresse, celui de la musique. Spotify, on le sait, va à fond sur l'IA. À l’inverse, les français de Deezer essaye de tracker tout ça, et en parle ouvertement. Ce qu'ils utilisent comme outil, c'est quelque chose qui se rapproche de ce que vous faites ?

NBG : C'est une excellente question. Je les ai croisés, Deezer, il y a quelques semaines lors d’un événement. On devait se parler, on s'est loupé, on doit se revoir à la rentrée. En gros, ce qu'ils proposent, c'est proche de ce qu’on fait, même si je m'interroge encore sur certains points.

Quoi qu'il en soit la démarche est louable, et leurs annonces en ce sens sont vraiment pertinentes. Si des gens ont envie d'écouter de la musique générée par IA, grand bien leur fasse, mais l'important c'est de bien savoir quand tu écoutes cette musique qu'elle est générée par une IA. Là est le coeur du problème, encore une fois.

Jusqu’ici, on a plutôt parlé des entreprises qui hébergent du contenu pouvant être généré par IA. Mais parlons de l’éléphant dans la pièce : les boîtes qui elles permettent la génération desdits contenus, comme OpenAI avec ChatGPT.

Celles-ci, on l’a dit, vont bientôt être obligées de taguer ces contenus pour qu’ils soient identifiés comme générés IA. Comment allez-vous faire pour proposer une offre pertinente si aucun des acteurs n’utilisent la même méthode de tag ?

NBG : Et bien ce n’est pas évident de répondre à ta question, car rien n’est décidé. Nous rencontrons la Commission Européenne à ce sujet à la rentrée, et la grande question qui doit être tranchée c’est : quelle méthode, parmi celles que l’on a déjà évoqué tout à l’heure, va permettre de le faire ?

La question que tu poses, c’est celle de l'interopérabilité, et cela va demander des compromis. La métadonnée, on l’a dit, ce n'est pas robuste, mais c'est plus facile de faire de l'interopérabilité parce que tu as juste à lire la métadonnée de chaque fichier, c’est facilement accessible. Pour le cas du watermark, il faudra mettre en place un "meta détecteur" qui permettra de détecter tous les différents type de marques.

Du côté du "finger printing", on l'a vu, il faudrait une gigantesque base de données de tout ce qui est produit par des IA génératives, ce qui me semble franchement inenvisageable, aussi bien techniquement que du point de vue de la consommation. Pour ce qui est de la blockchain enfin, idem : ce serait une catastrophe d'un point de vue écologique, et ça parait de toute façon trop compliqué pour l'adapter aux volumes de production des IA génératives, aujourd'hui et encore plus demain.

Il faut être clair : l'Europe joue gros, elle ne peut pas préconiser un système trop faible, comme choisir une traçabilité unique via les métadonnées, car ce serait en contradiction directe avec le texte même de l'AI Act, qui exige que la méthode soit robuste et efficace. Ce serait inefficient en pratique et ne participerait pas du tout à la lutte contre la désinformation, qui est bien la volonté politique première dernière le fameux article 50 de l'AI Act.

![TFTT #18 – Être de l’IA, ou ne pas être de l’IA : telle est la question [Interview Label4.AI] 🗣](https://storage.ghost.io/c/d5/3c/d53ce34f-1cb4-4a4e-b39e-440a2b231fe9/content/images/2025/08/EU_AI_Act_Coverpage_wide.jpg)

Il y a un sujet dont nous n’avons pas encore parlé, et qui nous tient pourtant tous les deux à cœur : la souveraineté numérique. En quoi Label4AI s’inscrit dans cette dynamique, et pourquoi c'est important ?

NBG : Je dirais qu’il y a trois aspects. Au niveau des capitaux, déjà : on est financé uniquement par des fonds européens. Toutes les boites qu'on approche, tous les financeurs potentiels avec qui on discute sont européens.

Deuxièmement, les infrastructures sur lesquelles on se repose sont des infrastructures 100% européennes. C'est du OVH aujourd’hui.

Troisièmement, même au niveau des outils qu'on utilise en interne, on évite les américains. Repository, mail ou même outils collaboratifs… on utilise Proton, on utilise Mattermost [N.d.A. : équivalent de Slack certes créé aux USA mais dans un format libre auto-hébergeable]. C’est une vraie conviction, d’éviter cette dépendance aux outils propriétaires américains.

Mais j’irai plus loin : le fait qu'on soit européens est vraiment revendiqué du point de vue de notre ADN, de nos valeur, de notre compréhension de la réglementation, des enjeux éthiques… ce qui fait qu’on doit pouvoir toucher un marché que les acteurs américains ne pourront pas aller chercher. On est dans un domaine où l’on doit être de vrais tiers de confiance. Compte tenu de l'actualité des GAFAM, qui accepterait de confier les clés du camion de l'authentification et de la détection des contenus générés par IA et de la détection des contenus à des boîtes comme Microsoft ou Meta ?

Il en va, au fond, de l'indépendance stratégique de l'Europe : doit-elle être dépendante d'acteurs extra-européens pour pouvoir distinguer le vrai du faux? Ce serait se mettre entre les mains d'acteurs politiques qui, on le voit bien avec l'actualité récente, pourraient en jouer pour manipuler l'Europe et donc ses citoyens. Cela nous semble inenvisageable, et ce serait d'autant plus dommage que nous avons la capacité scientifique de produire des alternatives européennes.

On a bien des concurrents américains [Get Real et Reality Defender, principalement]. Mais on n’est pas là pour dire, comme souvent dans le numérique malheureusement aujourd’hui : "c'est moins bien, mais c'est souverain". Non : technologiquement, c’est aussi solide, voire encore davantage... et en plus c'est souverain ! On propose un vrai système de valeur, qui est lié à nos rapprochements avec la recherche, à notre rigueur scientifique.

L’IA générative est beaucoup utilisée pour la fraude, et c’est aussi parce que c’est un outil très facilement accessible, à très bas coût… tu penses que cet état de fait va être conservé ?

NBG : Je ne sais pas pourquoi les gens sont surpris, ou plutôt j'espère qu'ils ne le seront pas. C'est comme d'habitude avec les outils de ce type : on ouvre d’abord les vannes à fond, et puis après, il y aura de la pub, et puis les prix vont augmenter, etc. Les dernières fonctionnalités de ChatGPT commencent déjà à être payantes, et des publicités commencent à apparaître. Les valorisations boursières qui ont été atteintes, ce n'est pas avec des abonnements à 20€ par mois, même à l’échelle du monde, que ça va être rentabilisé, il ne faut pas être dupe.

Tu parles des valorisations des acteurs de l’IA. On pense aux chiffres délirants qui entourent OpenAI, notamment. La bulle de l’IA, tu y crois ?

NBG : Oui, c'est certain, elle va craquer, cette bulle. Plein de boites vont s’effondrer parce que leur business ne repose sur rien. Que l’IA soit une techno ultra prometteuse, moi je n’ai aucun doute là-dessus. D'un point de vue puissance et d'un point de vue capacité, c'est formidable. Par contre, on a mis la charrue avant les bœufs en disant que ça permet de tout faire. La promesse que ce soit massivement adopté pour des choses réellement utiles et qui rapportent massivement, à ce stade c’est moins évident.

D'ailleurs, on voit là aussi pas mal de cas de fraudes, de fausses boîtes basées sur rien, comme Builder.ai.

Pour conclure, j’aimerais que l’on parle de ta vision de l’IA de manière générale, notamment sur l’IA générative et les LLM (Large Language Model).

NBG : Personnellement, je pense qu’il n'y aura pas de marche arrière, parce que même si les LLM n'existeront peut-être plus en "standalone" [N.d.A : utilisé en tant qu'outil indépendant, comme dans le cas de ChatGPT aujourd’hui] ils seront intégrés dans l'agentique ou dans la plupart des outils bureautiques. Et c'est la stratégie : Microsoft, par exemple, utilise l’IA pour faire levier sur ses produits traditionnels et créer une dépendance supplémentaire.

Le problème avec ces outils, c’est que les gens les utilisent pour tout et n'importe quoi parce que des entreprises les poussent partout, alors qu’ils sont très performants pour des tâches bien spécifiques et identifiées.

C’est ce qui fait qu’à ce stade cela créé autant de problèmes que ça n'apporte de solutions. Voire plus de problèmes que de solutions… Là, c’est comme au début du Web3, avec beaucoup d’énergumènes qui se servent de l'IA pour se faire du business facilement. Je veux dire, mon feed LinkedIn est devenu terriblement chiant. C’est 80% de ChatGPT avec le même ton, les mêmes formations bidons…

Il n’empêche qu’avec cette technologie, on a passé un cap dans la façon de travailler et dans la façon d'utiliser l'informatique de manière générale. C'est le changement technologique le plus radical que j'ai eu l'occasion de voir de ma vie. En termes d'utilisation et de vitesse d'intégration de ces outils, je n’ai jamais vu ça ; même le smartphone, ça a été plus lent.

C’est parce que je crois qu’il n’y a pas de retour en arrière possible que je préfère poser cette question : comment peut-on prendre nos précautions ?

Un grand merci à Nicolas pour ses réponses et cet échange passionnant. J'ai appris beaucoup sur les méthodes qui peuvent permettre de "tracker" et traquer les contenus générés par l'IA, et dieu sait que je pense que cela sera capital pour la suite.

Si je suis moins enthousiaste que Nicolas sur les capacités des LLM, il est indéniable que ces outils ont déjà un impact majeur sur nos vies, un impact qui va s'accentuer.

Et cela même si la bulle "pète", même si leur développement ralentit. Il faut donc se prévenir contre les dérives d'entreprises comme OpenAI, grâce à la régulation européenne, et grâce à des projets comme Label4AI.

J'ai en tout cas hâte de connaître la suite des avancées sur ce sujet, et ce que vous avez pensé de cette interview !

Après ce grand entretien, on enchaîne avec quelques news tech qui m'ont marqué cet été.

![TFTT #18 – Être de l’IA, ou ne pas être de l’IA : telle est la question [Interview Label4.AI] 🗣](https://storage.ghost.io/c/d5/3c/d53ce34f-1cb4-4a4e-b39e-440a2b231fe9/content/images/2025/08/En-Bref.jpg)

L'été a été riche en plus ou moins bonnes nouvelles sur le front de la tech, et loin de moi l'idée de vous faire le résumé complet des événements. Mais j'ai tout de même été marqué par quelques annonces et actualités clés, dont voici un résumé succinct :

- EVIL META : Pas de vacances pour les dingueries autour de l'IA générative. Ces dernières semaines, on aura vu Open AI étaler une nouvelle fois son absence totale d'éthique et de contrôle sur son outil majeur (maintenant dans une V5 🤷♂️), avec la terrible histoire du suicide assisté par ChatGPT d'un jeune américain. Article difficile ⚠

Mais il faut aussi parler de ce qui s'est passé du côté de Meta : pour l'entreprise maléfique par excellence, il n'y a pas de problème à ce que ses IA génératives (poussée partout sur Whatsapp, Instagram ou Facebook, pour rappel) "engagent une conversation romantique ou sensuelle avec un enfant".

C'est ce qu'a révélé un excellent article de Reuters, dont la lecture n'est pas toujours facile, et que j'ai analysé et résumé en français dans ce post.

Une news qui a précipité ma décision de quitter les applis Meta d'ici 2026, sur le plan personnel au moins. Si vous connaissez des alternatives que vous aimez, n'hésitez pas à me les partager en commentaire.

![TFTT #18 – Être de l’IA, ou ne pas être de l’IA : telle est la question [Interview Label4.AI] 🗣](https://storage.ghost.io/c/d5/3c/d53ce34f-1cb4-4a4e-b39e-440a2b231fe9/content/images/2025/08/meta-zuckerberg-ai.jpg)

- ALTERNATIVES : À propos d'alternatives à la tech US : l'idée de construire un guide complet pour s'extirper des monopoles tech états-uniens me trotte dans la tête depuis longtemps. Depuis plus d'un an, et encore davantage depuis la réélection de Trump et l'allégeance des Big Tech.

Mais quand d'autres le font extrêmement bien, il faut savoir rendre à César ! Alors je vous partage le super guide construit par Paris Marx dans le cadre de son excellente newsletter en provenance du Canada (en anglais) 🇨🇦

J'y ai ajouté quelques outils français et européens de qualité, ainsi que ma propre suite de services souverains du quotidien, dans ce post.

![TFTT #18 – Être de l’IA, ou ne pas être de l’IA : telle est la question [Interview Label4.AI] 🗣](https://storage.ghost.io/c/d5/3c/d53ce34f-1cb4-4a4e-b39e-440a2b231fe9/content/images/2025/08/fc13303f-7ff5-4ba8-861b-4dbfc452ce29_2400x1350.jpg)

- EVIL MICROSOFT ? Nous en avions parler dans le numéro 16 de TFTT : les liens de Microsoft avec une armée génocidaire ont continué à faire parler, et ont fait réagir comme jamais auparavant. C'est encore une fois The Guardian qui a révélé l'affaire, dont le timing coincide avec une manifestation jamais vue auparavant : des employés ont lancé un sit-in au sein du siège social de Microsoft à Redmond... ce qui a conduit a des arrestations par la police.

La pression interne comme externe ne faiblit en tout cas pas. Je vous en parle dans ce post.

Vous me direz, tout ça est assez cohérent quand on sait que le plan de l'administration Trump pour Gaza est de "relocaliser volontairement" les Palestiniens, d'établir un contrôle US de la zone, et la transformer en "étincelant resort de tourisme et en pôle dédié aux technologies de pointe", d'après cet article du Washington Post.

Même dans un film un tel plan paraitrait fou. Mais voici la réalité dans laquelle nous vivons, donc.

![TFTT #18 – Être de l’IA, ou ne pas être de l’IA : telle est la question [Interview Label4.AI] 🗣](https://storage.ghost.io/c/d5/3c/d53ce34f-1cb4-4a4e-b39e-440a2b231fe9/content/images/2025/08/MS-Gaza.png)

- IMPACT : un dernier sujet en guise de conclusion, pour évoquer un dernier des cavaliers de l'apocalypse, Google. L'entreprise a lâché des infos sur l’impact environnemental de son IA générative Gemini, mais ce ne sont évidemment pas les plus pertinentes...

Surtout : "laisser Google définir le narratif sur les coûts environnementaux de l'"IA", c'est comme laisser les fabricants de tabac définir le narratif sur les effets du tabagisme passif".

Voici un excellent article de Next.ink sur le sujet, et quelque chose me dit qu'on va reparler du sujet dans notre prochain numéro...

![TFTT #18 – Être de l’IA, ou ne pas être de l’IA : telle est la question [Interview Label4.AI] 🗣](https://storage.ghost.io/c/d5/3c/d53ce34f-1cb4-4a4e-b39e-440a2b231fe9/content/images/2025/08/Conso-elec-eau1.webp)

Voilà, c'est tout pour cette rentrée, et c'est déjà pas mal !

On se retrouve bientôt en septembre pour un 19ème numéro de Tales From The Tech.

D'ici là, n'hésitez pas à partager le format autour de vous, cela me ferait très plaisir. Et à me faire part de vos retours.

Vous pouvez le faire en commentant l'article sur tftt.ghost.io, ou directement via mes différents réseaux.

Vous souhaitez soutenir TFTT ? Consultez vos abonnements sur la plateforme ou faites un don ponctuel 🙏

Merci à toutes et tous,

Thomas ✊

PS : Tales from the Tech est garanti sans IA générative, pas sans fautes

11.07.2025 à 08:10

TFTT #17 – Un été en terre sauvage ? 🏖

Thomas Beaufils

Ce mois-ci dans Tales from the Tech, j'ai organisé les choses un peu différemment face à la quantité de news qui justifiaient selon moi un papier. On abordera donc dans ce numéro 17 :

- La futilité des autocritiques du techno-capitalisme

- Les derni&

Texte intégral (8849 mots)

Ce mois-ci dans Tales from the Tech, j'ai organisé les choses un peu différemment face à la quantité de news qui justifiaient selon moi un papier. On abordera donc dans ce numéro 17 :

- La futilité des autocritiques du techno-capitalisme

- Les dernières news glaçantes en provenance de la division gaming de Microsoft

- Mon incompréhension face à l'adoption de l'IA générative dans certains secteurs

- Un rappel que, non, la tech n'est jamais un outil "neutre"

- Et pour finir sur une note estivale, une reco toute en douceur

PS : la campagne de financement de Lowreka sur Ulule s'est terminée hier à minuit et a été un succès (attendez… est-elle vraiment terminée ?!). Merci aux lecteurs et lectrices de TFTT qui ont soutenu la démarche. Vous savez qui vous êtes 🫵 🥰

Je vous souhaite une bonne lecture et un bel été à toutes et tous, avec peut-être un peu moins d'IA, un peu moins d'écrans, et beaucoup de nature 🌞

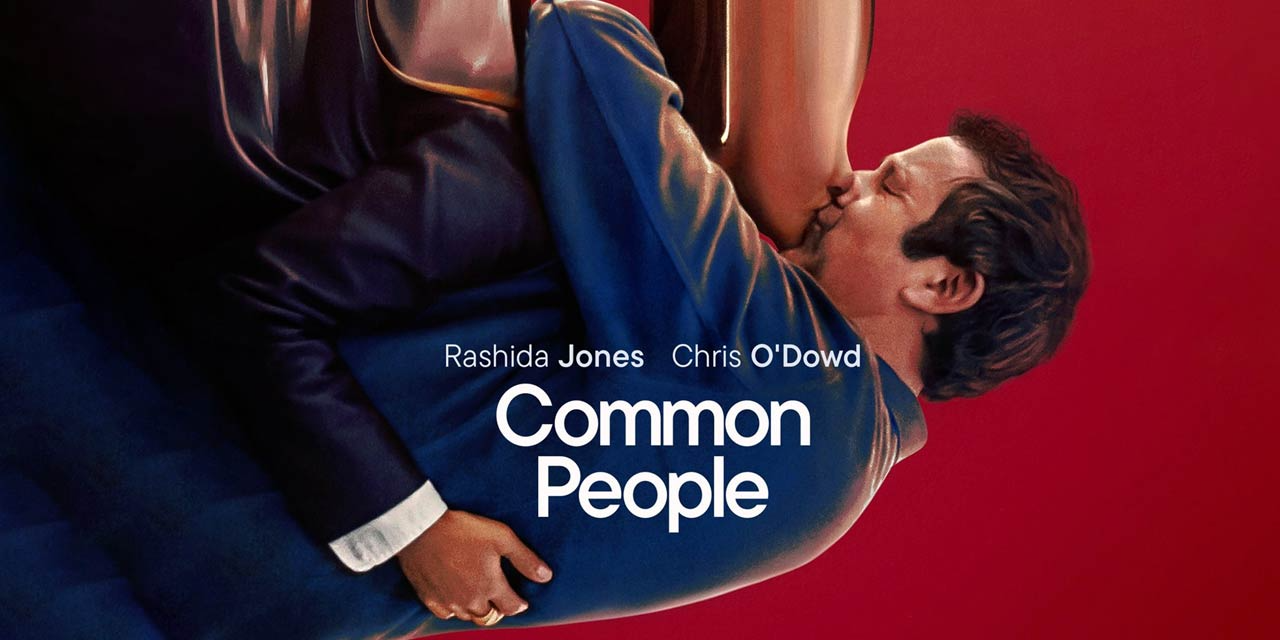

Black Mirror, la célèbre série d'anticipation déprimante à dessein était de retour au printemps pour une saison 7 (déjà ?!). Si les premières saisons, made in England et Channel 4 étaient intéressantes et globalement de qualité, on peut dire sans trop se mouiller que c'est moins le cas depuis le déménagement du machin aux US sous l'égide de Netflix, en 2016 avec la saison 3, et surtout depuis la saison 4.

Cette saison 7 se compose cette fois de 6 épisodes, traitant comme à l'accoutumée de sujets différents mais toujours autour d'une thématique commune : notre rapport à la technologie, et son impact sur nos vies présentes et futures.

Black Mirror est devenu avec le temps quelque chose de différent de la science-fiction traditionnelle : on est davantage en face d'une espèce de "folklore scientifique", une lame de fond qui nous permet à toutes et tous de dire, confronté.e.s à une innovation qui nous semble indubitablement dangereuse : "Wow, on se croirait dans un épisode de Black Mirror".

Je n'ai pas vu tous les épisodes de cette saison 7, dont le niveau a l'air de rester médiocre, comme la précédente. Mais j'ai vu l'épisode qui a sans doute le plus fait parler de lui : "Common People". Des gens ordinaires.

Vous êtes prévenu.e.s : ça spoile sévère sur les prochains paragraphes !

Cet épisode nous raconte l'histoire d'un couple américain lambda, un ouvrier et une prof qui vivent dans un petit pavillon. Ce n'est pas Byzance, mais on fait aller, et si ne on vit pas dans l’opulence, on vit dans le bonheur. Jusqu'au jour où l'un des deux personnages tombe irrémédiablement dans le coma, suite à une opération pour lui retirer une tumeur du cerveau.

Irrémédiablement ? Ça c'était avant Rivermind ! Une entreprise qui vous propose, au moyen d'un abonnement et en vous connectant à une sorte de "5G pour cerveaux", de remplacer la partie inopérante dudit cerveau, et donc de sortir l'être aimé du coma !

On ne va pas se mentir : même si l'idée de base est intéressante, on voit le truc arriver à 15 000 bornes, et c'est tout sauf subtil. Vont s'enchaîner des péripéties qui reflètent les problèmes que nous connaissons bien pour avoir toutes et tous été abonné.e.s à des services :

- augmentation régulière des prix

- nouvelles offres d'abonnement "augmentées" alors que les offres de bases deviennent moins intéressantes

- nouvelles contraintes imposées par l'opérateur

- ajout de publicité vocales ou vidéos selon les formats, etc.

*fin du spoil*

Bref : l'épisode critique de manière extrême (parce qu'elle touche à l'intime, au niveau physique, biologique) le modèle même et les dérives d'une plateforme comme… Netflix !

Quelle audace, pourrait-on se dire. Mais allez-vous vous désabonner de vos services d'abonnement dès la fin de l'épisode ? Que nenni.

Ce que fait cet épisode, comme Black Mirror en général, comme une vaste majorité des imaginaires produits par la SF "de plateforme", c'est rendre la tech inévitable.

Aussi déprimante soit-elle, la tech s'impose comme la seule option pour notre futur, le seul avenir qui nous reste.

Le secteur fait ainsi son mea culpa, il admet l'existence de ces dérives, il conscientise en public qu'il ne faut pas aller trop loin... ne vous inquiétez pas, on a des garde-fous !

Mais, au fond, ce pseudo mea culpa ne sert qu'à détourner notre attention vers des choses qui n'arriveront pas, alors que la dystopie se met déjà en place de manière beaucoup plus subtile.

Les Dents du Maire

Les exemples de ce genre, il y en a des dizaines, et cela ne date pas d'hier. Ça a commencé avec Les Dents de La Mer, déjà, dont le vrai méchant est le maire prêt à tout pour maintenir l'activité économique de sa ville, et pas le requin.

Les Dents du Maire ? C'est ce que raconte en tout cas un docu très sympa dispo actuellement sur Arte, anecdote sur Fidel Castro à la clé.

Ce qui n'a pas empêché "Jaws" de devenir le premier exemple de "blockbuster de l'été", une pratique qui va transformer l'industrie du cinéma pour toujours, et surement pas pour le meilleur. Je suis fan du premier Jurassic Park, mais il faut voir ce qu'est devenu la "franchise".

Pour revenir à Netflix, on peut aussi évoquer le succès coréen Squid Game. Sa critique du capitalisme, là encore sans grande subtilité, est poussée à son paroxysme puisque la mort y apparaît comme bien plus claire que dans la réalité (où le capitalisme tue aussi, mais bien plus sournoisement).

L'ironie étant patente quand Netflix annonce lancer un show de télé-réalité inspiré de la série… c'est tellement un non-sens que ça en devient hilarant.

Honte toute bue

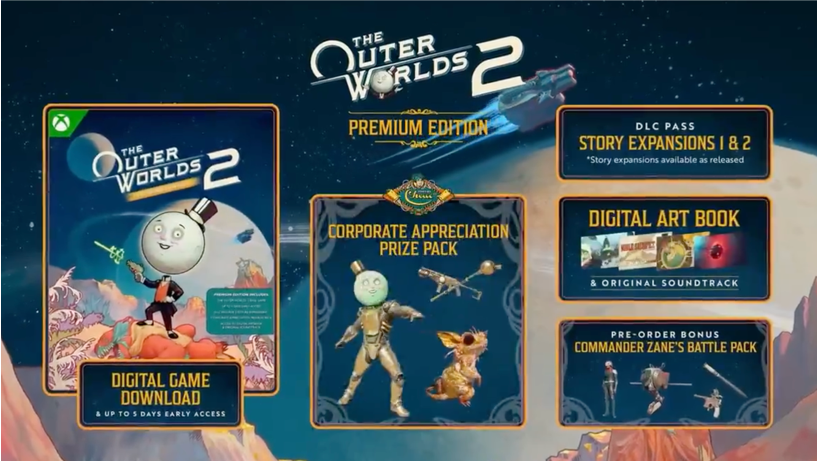

Finissons sur un autre exemple récent, d'un ridicule évident : le cas "The Outer Worlds". Cette série de jeux vidéo, dont le second épisode doit sortir dans quelques mois, est développé par Obsidian Entertainment. Un studio iconique du jeu de rôle à l'américaine, créé par des sommités comme Chris Avelone et aujourd'hui mené par des figures progressistes de l'industrie comme Josh Sawyer.

The Outer Worlds est un de jeu de science-fiction loufoque critiquant très ouvertement un capitalisme devenu spatial, des planètes entières et tout leur écosystème propre étant la propriété de corporations. Toute la communication récente du titre est d'ailleurs axée sur ce point : "une aventure sur le capitalisme, créée par le capitalisme.”

Car Obsidian a été racheté par nul autre que… Microsoft ! C'était en 2018, un petit hors-d'œuvre avant de croquer Bethesda puis Activision.

Par extension, est-ce toujours si drôle de se moquer des travers du capitalisme quand on est soi-même une composante de l'une des entreprises les plus emblématiques d'un techno-capitalisme en plein déraillement idéologique ?

Ce serait peut-être rigolo si Microsoft n'était pas en train de virer des gens par pelletées (oui, on va en reparler un peu plus bas dans cette newsletter), si l'entreprise n'était pas en train de fourrer de l'IA partout y compris dans ses jeux, si l'entreprise ne venait pas d'annoncer l'augmentation du prix desdits jeux, dont The Outer Worlds 2, à 80$ (quand le premier épisode ne coutait que 60$), etc, etc.

Vraiment, les blagues à base de "on est conscients de rapporter de l'argent à cette sale boite qu'est Microsoft, mais regardez comme on reste hyper edgy malgré ça !!!"…

Ça fait encore marrer des gens, ce genre de vannes ? Moi je trouve ça d'une morgue absolue.

Bref : les critiques du capitalisme en provenance du capitalisme ne servent qu’une chose, le capitalisme. En le rendant plus acceptable, parce qu'acceptant la critique (quand elle est contrôlée).

Bullshit.

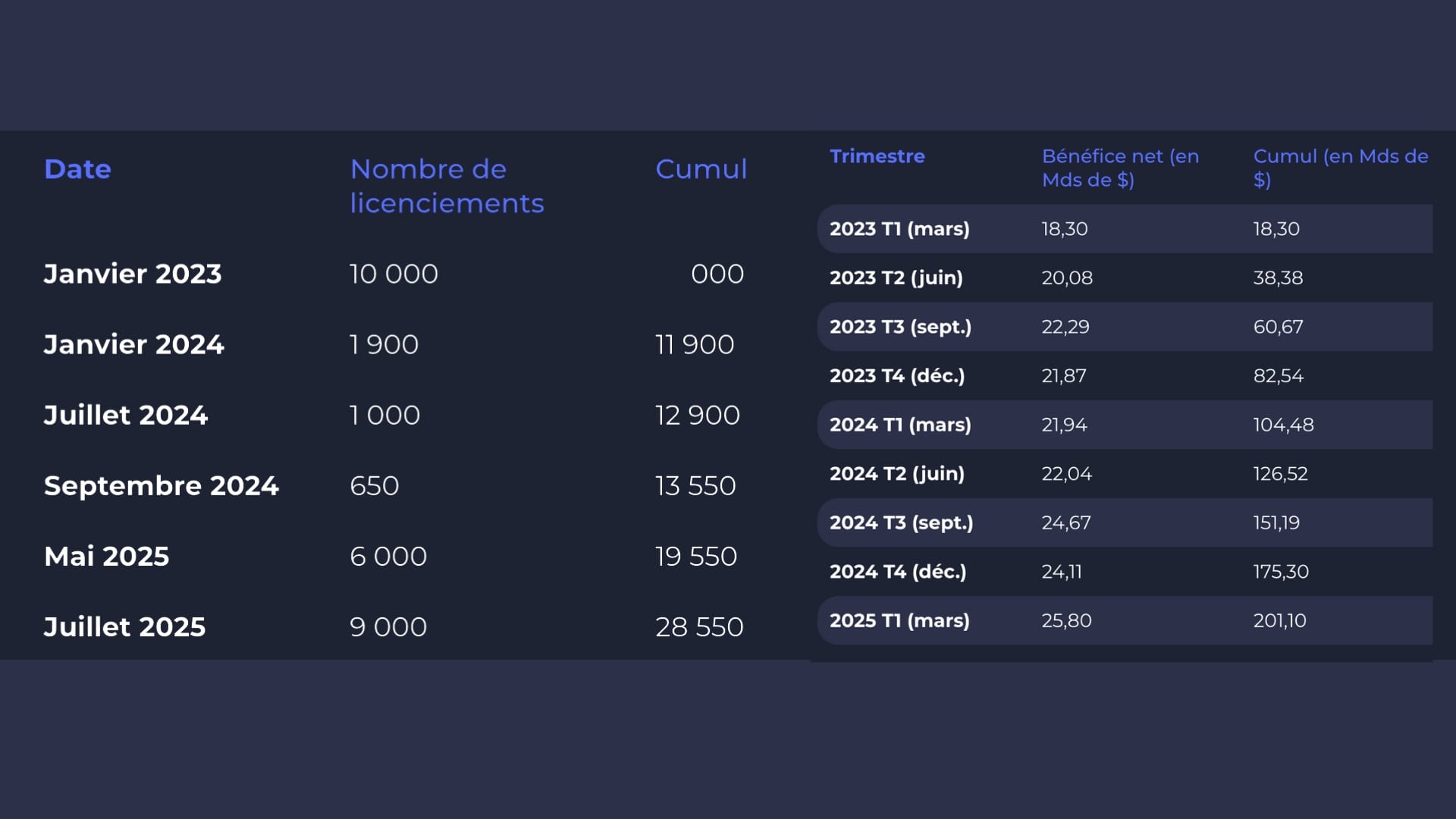

Microsoft en 2 ans : 200 milliards de bénéfices, 28 000 personnes sur le carreau.

Alors, oui, je sais. J'ai déjà parlé longuement de Microsoft dans le dernier numéro de TFTT… Je vous assure que je ne fais pourtant pas une fixette gratuite sur mon ancien employeur, même s'il est évident que toutes les histoires qui touchent à ses activités, notamment gaming, ont un poids émotionnel un peu différent pour moi.

Non, vraiment, si je vous parle encore de Microsoft (après les numéros 1, 4, 14 et 16), c'est que l'entreprise est littéralement en train de tout faire pour devenir la boîte la plus détestée de l'histoire de l'industrie du jeu vidéo. Et cela alors que cette industrie compte déjà Electronic Arts dans ses rangs ; chapeau les artistes !

L'entreprise a ainsi annoncé le 2 juillet pas moins de 9000 nouveaux licenciements, soit 4% de ses effectifs, une coupe drastique qui fait suite à plus de 6000 licenciements au mois de mai dernier, et nous amène à un total hallucinant de 28 550 licenciements en 2 ans et demi, soit entre 10 et 15% de ses effectifs totaux…

…un chiffre qui reste théorique tant la gestion des RH est opaque chez Microsoft, de par son habitude de recourir au portage salarial, et autres pirouettes destinées à payer moins d'impôts.

La raison de ces vagues de licenciements ? Une chose est sûre : ce n'est pas parce que la boite va mal. En tout cas, pas financièrement : 200 milliards de dollars de bénéfices sur la même période de janvier 2023 à aujourd'hui, et une réussite insolente en bourse, surfant sur la hype incontrôlable autour de l'IA générative, lié à ses investissements auprès d'OpenAI notamment.

C'est principalement, une nouvelle fois, la section gaming de Microsoft qui est touchée, comme c'était déjà le cas en janvier 2024 : 1 900 personnes avaient alors été licenciées, soit près de 10% des effectifs axés sur le jeu vidéo à l'époque. La raison invoquée : supprimer les "redondances" soi-disant créées par les rachats successifs de Bethesda en 2020 pour 7,5 milliards de $, puis surtout d'Activision Blizzard pour la bagatelle de 69 milliards de $, plus grosse acquisition de l'histoire de l'entreprise, et de loin.

Microsoft avait-elle pourtant promis aux différents organes garantissant la concurrence, aux États-Unis comme ailleurs, de ne pas licencier suite à ces acquisitions massives ? Bien sûr. Il n'avait donc fallu attendre que 3 mois à l'époque pour comprendre que c'était un mensonge.

Des "redondances" d'ailleurs inexistantes pour la plupart, comme l'exemple français de Bethesda le montre bien (je l'évoquais en mai 2024). Rappelons aussi que Microsoft/Xbox vient d'annoncer en catimini la fermeture de toutes ses activités dédiées aux réseaux sociaux en Europe, pour tout gérer désormais avec une agence sans doute bien plus bon marché, basée en Afrique du Sud.

Une information sortie ici, mais que je suis en mesure de confirmer pour le marché français via mes propres contacts. Hâte de voir la tronche des posts réseaux sociaux français désormais. Je sens qu'on va avoir le droit à de nouvelles pépites de traduction made in Microsoft.

Cette fois, au moins, le géant de Seattle n'essaye pas de nous mentir : il est assez clair que la seule justification de ces licenciements et de ces coupes diverses est de financer les investissements en IA (notamment générative) de l'entreprise.

Et l'occasion, peut-être, de gérer les activités concernées à grand renfort d'agents IA ? Venant d'une boîte menée par un freak comme Satya Nadella et qui a dans ses rangs des tarés comme ce producteur, cela ne serait pas surprenant, mais rien n'a encore été confirmé en ce sens.

Les conséquences concrètes de ces licenciements sont multiples :

- The Initiative, le pseudo "studio AAAA" qui avait signé des dizaines de noms ronflants de l'industrie et travaillait sur un remake assez excitant de Perfect Dark depuis des années, a purement et simplement été fermé. Le jeu montré il y a peu a été annulé. Andouillette AAAAA.

- Everwild, l'arlésienne du studio culte Rare est annulé, et son équipe licenciée. Phil Spencer, boss de Microsoft Gaming, disait encore il y a quelques mois que c'était un jeu qu'il aimait particulièrement. Philou, l'homme qui transforme tout ce qu'il aime en 💩

- Zenimax Online Studios est également été touché, et son projet Blackbird, en développement depuis 7 ans et pourtant encensé par le top management de Microsoft Gaming quelques mois plus tôt, a lui aussi été annulé

- Les effectifs de Turn10 (Forza Motorposts) sont divisés par deux

- Des équipes chez les acquisitions Raven (Activision) et King sont aussi concernées par les coupes

- Des studios externes, jusqu'ici soutenus par Microsoft, sont aussi concernés (et a peu près aussi surpris que nous) comme par exemple chez les Romero mari et femme ; le couple avait pourtant rencontré les équipes Microsoft le jour avant l'annonce… mais n'a pas été prévenu du retrait des investissements. Classe.

- En revanche, pas de mauvaises nouvelles pour le seul studio français concerné, et accessoirement mon chouchou, Arkane Lyon. On peut peut-être remercier le droit du travail français… mais pour encore combien de temps ?

Les entreprises, me direz-vous, n'ont pas de cœur. Microsoft particulièrement.

Ce n'est pas une surprise, elle qui maintient à tout prix un contrat avec une armée génocidaire par simple amour du pognon, rappelons-le (une information confirmée depuis par un rapport de Francesca Albanese, rapporteuse spéciale de l'organisation sur les Territoires Palestiniens occupés, citant expressément Microsoft).

Mais même en jouant le robot et mettant de côté l'aspect humain… aucune de ces décisions n'a stratégiquement de sens.

Tant d'investissements, tant de recrutements, tant de travail pour améliorer l'image d'une marque en déperdition (stratégie dont j'ai été un maillon actif pour la France entre 2019 et 2022), tant de discours positifs finalement absolument creux…

Quel manque de vision. Et pourtant, plutôt que de virer Phil Spencer (ce qui serait la seule décision logique après tant d'atermoiements), on vire des employé.e.s par milliers.

Vous me direz, c'est la même boite qui avait recruté des milliers de personnes pendant la période Covid sans anticiper, logiquement, que l'activité gaming et "remote" allait redescendre à des niveaux normaux une fois les confinements successifs terminés.

C'est aussi la même boite qui avait fait de la réduction de son impact carbone un sujet capital en 2020, sans être capable d'anticiper correctement que son engagement sur le développement de l'IA générative allait tout exploser du point de vue de cet impact.

De tristes et dangereux peintres.

Mais que voulez-vous, la bourse préfère se repaitre de licenciements à répétition et de quelques "abracadabrIA", plutôt que valoriser des choix stratégiques payants.

De la pure magie noire.

Notons toutefois que ce manque de vision pourrait totalement se retourner contre les huiles de Microsoft : si le vent devait tourner sur le front de l'IA (ce qui arrivera selon moi tôt ou tard) ou si la relation avec OpenAI devait pourrir, l'entreprise pourrait bien se mordre les doigts très très fort.

Perso, je sortirai alors le pop-corn, comme devant le duel Musk-Trump 🍿

Ce changement de stratégie, si on peut appeler ça ainsi, s'accompagne en tout cas d'un changement complet de culture d'entreprise. Et si l'entreprise va très bien financièrement, on l'a dit, il n'en est peut-être pas de même pour ce qui est du moral des troupes, comme le chronique cet excellent article de Cassim Montilla pour Frandroid, qui reflète tout à fait mon expérience au sein de la filiale française.

D'y découvrir l'obligation faite aux employés d'utiliser Copilot, l'outil de bureautique IA hyper intrusif de Microsoft, ce qui recoupe parfaitement tout ce qu'on vient de se dire.

Ces terribles vagues de licenciements ne seraient donc peut-être que la partie émergée de l'iceberg, contre lequel le vaisseau amiral Microsoft pourrait bien se cracher sous peu.

Too big to fail, Microsoft ? Peut-être, mais comptez sur moi pour jouer du violon en cas de naufrage 🌊

Comme si l'éco-anxiété ne suffisait pas, voilà que je ressens de plus en plus fortement une forme diffuse mais réelle "d'IA anxiété."

Je n'en PEUX PLUS d'entendre parler d'IA à toutes les sauces, dans tous les domaines, et la vaste majorité du temps pour ne rien dire.

Et il y a certains domaines où je tolère encore moins de voir l'IA générative utilisée. Je précise bien "générative", parce que c'est surtout de cela dont je parle ici, et dont tout le monde parle de toute manière.

Ainsi, Je ne comprends pas quand je vois des militants écologistes ou des "entrepreneurs à impact" utiliser ouvertement ChatGPT pour leurs posts et leurs actions, alors que l'impact (!) environnemental de l'outil est très bien documenté.

Qu'ils sont nombreux ces entrepreneurs "responsables" à se pavaner à longueur de posts LinkedIn sur leurs processus de travail "boostés à l'IA" ! Qu'elles sont nombreuses, ces petites boîtes, ces assos et ONG, et parfois même ces médias "écolos" qui utilisent des visuels générés par IA 🥲

Les médias, justement : je ne comprends pas quand je vois des journalistes illustrer leurs posts et articles avec des images générées par l'IA au mépris des droits d'auteur, alors que la presse est en train de se faire dépecer par les mêmes procédés, par les mêmes entreprises. Note : remplacez "journalistes" par "graphistes" ou "artistes" dans le point ci-dessus, et ça marchera à peu près pareil.

Encore cette semaine, j'ai vu un post sur les tomates en tant qu'exemple des dérives de l'agro-industrie, avec un très laid visuel généré par IA pour illustrer le propos. Mais pourquoi ? Pourquoi ne pas illustrer ce post avec n'importe quelle photo de…. tomate ? Ça ne manque tout de même pas sur internet, y compris dans les banques d'images gratuites, bon dieu 🍅

Pire exemple découvert hier : un mec aux Nations Unies s'est dit que créer des réfugiés générés par IA serait une bonne idée ?! SÉRIEUSEMENT ?

Je suis fatigué.

Que les anciens "Web3 enthusiasts" deviennent des "AI enthusiasts" au bout de 3 prompts et demi sans rien y piger, en mélangeant au passage ce que représente l'IA au global de la simple IA générative, soit…

D'ailleurs, que l'IA au sens large en tant que domaine technique puisse avoir des intérêts pour la transition écologique, d'un point de vue scientifique notamment, je ne le nie pas non plus, même s'il faudra calculer dans le détail les externalités positives et négatives.

Mais qu'autant de représentants de secteurs qui devraient être rebutés par tout ce que représente l'IA générative s'y mettent sans se poser de question, voilà qui me laisse pantois. Et montre encore une fois l'énorme besoin d'éducation sur ces sujets.

Là, certains me sortiront les arguments habituels : "toi t'es écolo, et t'écris ça comment, sur un bout de bois ?".

Non j'écris ça sur un Mac, je partage ce contenu via une newsletter et des réseaux sociaux. Ai-je le choix vu mon activité ? Non.

Mais j'ai fait le choix de ne jamais utiliser l'IA pour générer du texte ou des images, alors même que je bosse dans la communication, alors même que j'ai exercé mon activité dans le domaine de la tech.

Et je vous assure que tout va bien.

Qu'on ne me la fasse pas à l'envers : nous avons le choix.

Nous faisions sans l'IA générative il y a 1 ou 2 ans pour la grande majorité d'entre nous.

Explorons les contre-arguments habituels :

- "Oui mais j'ai pas le temps". On a toujours le temps. Si pour faire votre activité vous avez "besoin" de ChatGPT, c'est qu'il y a une c*uille quelque part : dans votre bande passante, dans votre staffing, ou dans la vision que vous avez de votre job. Et ça, ce serait en partant du principe que l'IA générative rende les humains et les entreprises plus efficaces, ce qui reste à prouver à ce stade, quelque soit le domaine.

- "Oui mais si je ne l'utilise pas, je rate le coche". Ah, la fameuse course à l'armement, qui mène notre belle planète vers de beaux horizons. Nous sommes encore bloqué.e.s sur cette idée de performance à tout prix pour réaliser des activités bien souvent vides de sens, alors même qu'il est clair qu'il va nous falloir ralentir, n'en déplaisent aux néo-populistes à la Charles Consigny.

Alors en skippant l'IA vous allez rater le coche de quoi ? Rater ce coche-là comme vous avez raté celui du metavers ou des NFT ?

Bon, évidemment, tout ça n'est que peu valide si c'est votre boss qui vous impose l'utilisation de l'IA au chausse-pied (coucou Microsoft Copilot), et vu le contexte il va m'être difficile de simplement vous dire de changer de boulot… Mais si vous en avez la possibilité, faites-le, franchement.

La pertinence de l'IA générative dans les activités pros existent après tout surtout dans la tête des patrons et des investisseurs.

- "L'IA est déjà là, alors autant l'embrasser en développant une vision plus éthique". Ce dernier point me touche forcément un peu plus. Nombreux sont en effet celles et ceux qui pensent que, comme de toute manière l'IA est déjà là, la question qui se pose n'est pas celle de la pertinence ou de l'utilité de ChatGPT, mais plutôt de comment se sortir du quasi-monopole d’OpenAI.

Et bien je trouve ça très mignon, mais pardonnez mon pessimisme : bon courage pour développer une IA générative éthique face à des mastodontes pareils et sans moyens. Si l'UE ne régule pas, ce qui n'a pas l'air d'être sa vision à ce stade, rien de tout cela n'arrivera. Plug baby plug, hein Manu.

L'avantage, c'est que comme nous l'avons déjà évoqué à plusieurs reprises dans TFTT, toute cette hype et ses conséquences pourraient ne plus durer si longtemps que ça. Allez, faisons une petite liste à la Prévert :

- OpenAI, la maison mère de ChatGPT, n'est toujours pas rentable, malgré les piquouses étatiques du Pentagone & co, ce qui oblige Altman, son CEO, à aller faire du gringue aux Saoudiens. Alors ChatGPT en roue libre, mais jusqu'à quand ?

- On ne sait toujours pas comment on va nourrir l'IA générative en électricité de l'aveu même d'Altman, donc rebelote sur le questionnement : roue libre, jusqu'à quand ?

- Ce même Altman disait aussi il y a peu : "[l'IA générative] ne devrait pas être une technologie à laquelle on fait autant confiance" car elle hallucine… ben alors, pourquoi vous vous lui feriez-vous confiance dans le cadre de vos activités professionnelles ? 🤔

- D'ailleurs, une bonne partie des entreprises qui vendent leurs services comme étant des "Agents IA" raconteraient en fait totalement des craques, alors attention à la chute.

- Et puis comme le notait un article de Wired récemment, le backlash contre l'IA est également en train de devenir réel et puissant, donc revenir à un travail sans IA générative pourrait bien être the next cool thing ;)

Voilà, je ne comprends pas pourquoi certaines personnes utilisent l'IA générative contre toute logique. Je ne comprends pas la hype autour de cette technologie. Je ne nie pas que l'IA générative a déjà changé nos vies et nos habitudes, et il en restera forcément quelque chose, de bon ou (probablement plutôt) de mauvais.

Mais je ne crois pas que l'IA générative dans sa forme actuelle a de l'avenir. Alors je ne vais pas lâcher l'affaire, et je ne perds surtout pas espoir de voir le truc se retourner.

Continuons à emmerder les "IA enthusiasts", ils n'ont pas encore gagné.

Nous parlions juste au-dessus du besoin d'éducation pour faire face à l'arrivée de l'IA générative, même dans des secteurs où son utilisation devrait mener à une levée de bouclier généralisée.

Et bien le problème est que, face à la mauvaise foi la plus pure, l'éducation ne suffit pas.

Il en est ainsi, depuis quelques semaines, de nombreux débats autour de l'utilisation des écrans, des réseaux sociaux et de l'IA par les plus jeunes générations.

Le débat a été relancé à la mi-juin. D'abord par Emmanuel Macron, qui a annoncé sur France 2 vouloir "interdire les réseaux sociaux aux moins de 15 ans", sans donner beaucoup de détails et en réaction (en bon politique) à un fait divers sordide.

Avant que Catherine Vautrin, la Ministre de la Santé, ne relance en annonçant vouloir interdire "l'exposition aux écrans des enfants de moins de 3 ans", dans le JDD. C'est vrai qu'annoncer son envie d'interdire des trucs, ça colle assez bien à un journal d'extrême droite.

Comme à chaque prise de parole de ce type, on assiste d'un côté à des soutiens très prononcés d'habituels rétrogrades, et en miroir à des réactions outrées de psychologues spécialistes (ou pas) du numérique.

Mon point ici, honnêtement, ne va pas être de donner les bons et les mauvais points à chacune des positions. J'ai des convictions, mais je ne pense pas connaitre le sujet assez en profondeur pour trancher de manière claire.

Cependant, il y a un point sur lequel je ne supporte plus de lire des âneries, d'un côté comme de l'autre du débat : la tech ne serait qu'un outil, c'est l'usage que l'on en fait qui compterait vraiment.

Vraiment ?! On peut encore dire ce genre de connerie en 2025 sans que la terre entière vous tombe dessus à bras raccourcis ?

Non, la tech n'est pas un outil comme les autres.

Un smartphone n'est pas un marteau. L'IA n'est pas une fourchette.

Dire que la tech est comme n'importe quel outil, qu'après tout avec un marteau on peut aussi bien enfoncer un clou que tuer quelqu'un, que toute la différence ne serait que l'usage qu'on en fait et l'éducation qu'il y a derrière…

Cette idée est au mieux un raccourci très maladroit, au pire de la bêtise profonde.

Pourquoi ?

Parce que, vous le savez pertinemment si vous lisez cette newsletter, tous ces objets et ces services issus du monde de la tech sont fabriqués avec une arrière-pensée : devenir "indispensable" à votre quotidien, être présent à vos côtés le plus souvent possible pour créer, ni plus ni moins, une forme d'addiction.

Je n'ai pas besoin de vous le démontrer du côté du smartphone ou des écrans de manière générale, par exemple. Chacun sait, moi le premier, comme nous vivons désormais avec presque constamment un écran vissé devant les yeux, comme perpétuellement collé au fond de nos paumes. Une espèce d'augmentation cyberpunk, sans le côté cryptico-cool.

Mais sachez qu'il en sera de même avec ChatGPT. Qu'il en est de même avec de nombreuses mécaniques de jeux vidéo comme celle développées par Fortnite, ou bien par les offres de streaming à la Netflix, nous en avons déjà parlé ici.

Alors voir des psychologues spécialisé.e.s dans le rapport des enfants au numérique dire que "la tech est un outil, il faut savoir bien l'utiliser" – cela en semblant pleinement ignorer les mécaniques prédatrices mises en place par les grands groupes de la tech (souvent avec l'aide d'autres psychologues grassement payé.e.s) – voilà qui ne manque pas de m'énerver très rouge 😡

Un exemple qui fait l'actualité : peut-on vraiment dire que la tech est neutre quand la vaste majorité des figures étatiques et des entreprises continue d'utiliser Twitter comme si de rien n'était, alors que dans le même temps la plateforme met volontairement en avant des contenus fascistes, et pousse même son propre outil d'IA générative (Grok) qui balance des dingueries littéralement nazies toutes les 3 secondes ?

Un peu de sérieux.

Je ne vais pas m'éterniser sur le sujet. D'autres en ont parlé ailleurs et bien mieux, alors rendons à César : si cette problématique vous intéresse, je vous conseille ce super article de Louis Derrac, ou cet autre encore, plus récent. Louis est un compère techno-critique aux analyses toujours extrêmement bien placées.

Voici la conclusion de ce premier article :

« Il faut de l'éducation, de l'éducation, et encore de l'éducation. Mais pas n'importe quelle éducation. Certainement pas une éducation limitée aux risques et aux « bons usages » du numérique. Il faut, je pense, se donner les moyens d'une éducation techno-critique, émancipatrice, politique. Une éducation qui autorise à développer de nouveaux imaginaires, notamment ceux d'un numérique acceptable, et l'horizon d'alternatives numériques. Et s'il faut interdire, puisque certain⋅e⋅s ne jurent que par ça, interdisons la publicité, les dark pattern, les monopoles, la lucrativité abusive, ou encore la captation de données personnelles. »

Voilà qui rappellera quelque chose aux défenseurs de l'environnement :

Si l'écologie sans lutte des classes, c'est du jardinage… et bien l'éducation à la tech sans visée techno-critique, c'est Adibou. Basta.

Terminons cette 17ème édition de Tales from the Tech par une touche de douceur, si vous le voulez bien. Ça ne fera de mal à personne.

"Alba : un été en terre sauvage" est un petit jeu qui se termine en une poignée d'heures, une balade paisible sur une petite île espagnole où il va s'agir de nettoyer les plages, sauver des animaux, remplir un "pokédex" avec les oiseaux du coin... et lutter contre un projet d’hôtel de luxe qui va détruire une réserve naturelle ! S'il n'est pas vraiment punk, il est pleinement bio, je l'ai donc calé dans ma liste de jeux biopunk.

C'est très mignon, et par extension très cucul, mais c'est un vrai moment de détente et un super moyen d'évoquer les dangers de la pollution et du surtourisme avec un enfant. Bémol quand même : le jeu se lance sur un vol en avion... les imaginaires du tourisme vont encore devoir évoluer un poil.

Pour y jouer, vous pouvez vous le procurer sur la plateforme européenne Gog.com pour 15€ (il est aussi à 20 balles sur Switch), ou bien gratuitement si vous avez un compte Apple : le jeu est jouable sur Mac, smartphone ou tablette et est présent dans l'offre Apple Arcade, que vous pouvez prendre pour 1 mois gratuitement.

En revanche : pensez à vous désabonner avant la fin de cette "période d'essai", ça m'embêterait que vous donniez de l'argent à Tim Cook à cause de moi ;)

Voilà, c'est tout pour ce mois de juillet, et c'est déjà pas mal !

On se retrouve en août pour un 18ème numéro de Tales From The Tech qui devrait revenir à un format plus traditionnel… ou pas ?

D'ici là, n'hésitez pas à partager le format autour de vous, cela me ferait très plaisir. Et à me faire part de vos retours.

Vous pouvez le faire en commentant l'article sur tftt.ghost.io, ou directement via mes différents réseaux.

Vous souhaitez soutenir TFTT ? Consultez vos abonnements sur la plateforme ou faites un don ponctuel 🙏

Merci à toutes et tous,

Thomas ✊

PS : Tales from the Tech est garanti sans IA générative, pas sans fautes

06.06.2025 à 09:02

TFTT #16 – Trump-Musk, Microsoft-IDF : les liaisons fangeuses 💔

Thomas Beaufils

Ce mois-ci dans Tales from the Tech, vous retrouverez un numéro 16 plus court qu'à l'accoutumée, et livré en retard… quelle honte !

Pourquoi ce format plus court, et ce délai ? Et bien parce que j'ai pris

Texte intégral (4075 mots)

Ce mois-ci dans Tales from the Tech, vous retrouverez un numéro 16 plus court qu'à l'accoutumée, et livré en retard… quelle honte !

Pourquoi ce format plus court, et ce délai ? Et bien parce que j'ai pris beaucoup de temps ces dernières semaines pour soutenir un autre projet, dont j'ai déjà parlé plusieurs fois ici. Une initiative inspirée par la démarche low-tech nommée Lowreka, et pour lequel nous avons lancé ces derniers jours une campagne de financement participatif, importante pour la suite du projet.

Si le sujet des low-tech et de l'impact environnemental (de la tech et du reste) vous intéresse, n'hésitez pas à soutenir notre campagne ! Même quelques euros, ça peut faire la diff. En cliquant sur ce lien, vous aurez de plus l'honneur de me voir faire le pitre en vidéo, Pomme™ à la main 🍎

Merci 1000 fois 🙏

Je pensais Microsoft la moins pire des GAFAM. L'histoire la retiendra peut-être comme la pire des 5.

Si vous lisez TFTT depuis ces débuts, vous le savez : depuis mon départ de Microsoft, je n'hésite pas à critiquer mon ancien employeur. Le verbe haut, mais la critique juste, je pense. Ma connaissance des arcanes de la boîte me donne, je crois, une certaine légitimité sur le sujet.

Jusqu'à il n'y a pas si longtemps, je le disais sans mentir : je pensais que Microsoft, aussi dangereuse soit l'entreprise de par ses multiples monopoles, restait plus recommandable que Google, Amazon, Apple ou bien sûr Meta.

Malgré l'oubli délibéré de ses objectifs environnementaux ou de vastes vagues de licenciements en contradiction totale avec la forme économique insolente de l'entreprise, la donne n'avait pas encore totalement changé pour moi. Gates puis Nadella ne sont pas tout à fait Zuckerberg ou Jobs. Récemment encore, l'actuel CEO de Microsoft ne prenait pas la pose avec Trump, comme Sundar Pichai (Google) ou Jeff Bezos.

Pourtant, depuis le mois de mars, une sinistre petite musique se diffuse entre les pins de Redmond, ville toute entière dédiée au siège de Microsoft, placée à quelques encablures de Seattle, sur la côte du Pacifique Nord des US.

C'est ce que raconte un article du Guardian, dont je vous traduis un extrait ici :

"Pour la deuxième fois en un mois, des employés de Microsoft ont interrompu des cadres de l'entreprise s'exprimant lors d'un événement célébrant le 50e anniversaire de l'entreprise, le 4 avril. […]

Mustafa Suleyman, "AI executive", a ainsi été interrompu par les employés Ibtihal Aboussad et Vaniya Agrawal. Les deux ont été licenciées dans les jours qui ont suivi. Le président de Microsoft, Brad Smith, et l'ancien DG Steve Ballmer ont eux été conspués au Great Hall de Seattle le 20 mars, par un employé actuel, ainsi qu'un ancien employé.

La manifestation de mars a été précédée d'un rassemblement à l'extérieur, auquel ont également participé des employés, actuels et anciens, du géant de la tech. Les manifestants ont projeté sur le mur de la salle un signe lumineux où l'on pouvait lire : "Microsoft powers genocide".

« Microsoft alimente le génocide ». Microsoft permet le génocide, même, en fait. Car c'est bien de cela qu'il s'agit : Microsoft, en toute discrétion, est devenu le partenaire tech numéro 1 de l'IDF (Israel Defense Forces), c'est à dire l'armée israélienne. Microsoft fournit toute sa puissance technologique pour faciliter la destruction de Gaza.

C'est ce qu'avait révélé en janvier le Guardian, déjà, dans un autre article qui n'a sans doute pas assez fait parler de lui :

« Des documents fuités mettent en lumière la façon dont Israël a intégré le géant US de la tech dans son effort de guerre pour répondre à sa demande croissante d'outils cloud et IA."

Voilà : le supposé good guy (ou le "moins bad guy" disons) de la tech US est le partenaire numéro uno d'une armée génocidaire.

Et alors que les appels à isoler Israël sur la scène internationale se multiplient, alors que l'appellation de génocide fait (enfin),de plus en plus son chemin dans l'opinion publique, il est difficile de comprendre comment Microsoft peut continuer à faire la sourde oreille.

Faire pire que la sourde oreille, d'ailleurs. Alors que les pressions internes et externes s'intensifient, l'entreprise a réalisé deux actions ces dernières semaines :

- D'abord, partager un communiqué précisant que les technologies Microsoft, si elles sont bien utilisées par l'armée israélienne, ne le sont pas pour "blesser des personnes à Gaza". Un aveu qui n'a en soit aucun sens. Avant d'admettre que l'entreprise n'a pas vraiment "d'insights" sur la façon dont sont utilisées ses technologies…

- Cela, avant de bloquer purement et simplement tous les mails contenant les mots "Gaza", "génocide" et "Palestine" envoyés par ses employés américains… Une décision parfaitement trumpiste.

Vaste fumisterie.

Je finirai cet édito par une question : quand, dans 30 ans de cela, nous regarderons en arrière sur tous les méfaits accomplis par la tech depuis le début du siècle, qu'est ce qui marquera le plus les esprits ? Cambridge Analytica ? Les manipulations de Musk via Twitter ? L'impact environnemental délirant des GAFAM ?

Sans doute un peu de tout ça. Mais le rôle de participant effectif à un génocide – car c'est par ce mot que l'histoire caractérisera la "guerre" qu'Israël mène à Gaza, quelle qu'en soit les exactions à la source – aura sans aucun doute sa place sur le podium des horreurs.

👉 Si on espère que l'idylle entre Microsoft et l'IDF va rapidement tourner court, il y a une d'idylle qui a sacrément pris du plomb dans l'aile : enfin, le torchon brûle entre Elon Musk et Donald Trump. Et c'est très réjouissant à regarder.

Bon déjà, le mot idylle est peut-être un peu fort : il y a toujours eu des bisbilles entre les deux cinglés, leurs égos combinés dépassant la surface au sol du bureau Ovale. On l'évoquait dès janvier dans TFTT.

Le niveau de violence des invectives depuis hier est cela dit assez impressionnant et sans doute inattendu, après le pot de départ très chelou mais relativement chaleureux de Musk il y a une semaine à peine.

Le lavage de linge sale a commencé avec les critiques véhémentes de Musk sur le "Big Beautiful Bill" de Trump, estimant que le texte allait mener à "la banqueroute de l'Amérique".

Trump s'est ensuite estimé "déçu" devant un chancelier allemand médusé, comme le raconte Le Monde, avant de sortir l'artillerie plus lourde, en critiquant à la fois le "travail" de Musk au DOGE et en le menaçant très clairement :

"La façon la plus simple d’économiser de l’argent dans notre budget, des milliards et des milliards de dollars, est de mettre un terme aux subventions et aux contrats gouvernementaux d’Elon. J’ai toujours été surpris que Biden ne l’ait pas fait ! »

Résultat des courses : Tesla a perdu 14% en bourse hier, alors que l'entreprise va déjà mal. Sans parler des répercutions potentielles sur Space X, dont les fusées explosent les unes après les autres.

Pendant ce temps, l'idéologue fasciste Steve Bannon ressortait des tiroirs une vielle histoire qui pourrait coûter à Musk sa citoyenneté américaine.

Musk a répliqué sans attendre. Après avoir tweeté que sans lui Trump "aurait perdu l'élection", le voilà qui agite un beau contre-feu :

"Il est temps de lâcher une grosse bombe : Donald Trump figure dans les dossiers Epstein. C’est la raison réelle pour laquelle ils n’ont pas encore été rendus publics. Bonne journée, DJT !"

Laissons-les donc se rouler dans la fange devant nos yeux ébahis, que voulez-vous que je vous dise. Et redonnez-moi du pop-corn, tiens 🍿

👉 Un ouvrage vient de sortir en librairie outre-Atlantique, et fait bruisser le monde de la tech d'échos assez plaisants (de mon point de vue). C'est de "Empire of AI" dont on parle, un livre sur Open AI et son patron Sam Altman, publié par la journaliste Karen Hao, ancienne du Wall Street Journal. Et Altman et son "Empire" naissant y sont sacrément égratignés.

Tôt dans le livre, Hao cite un extrait d'un post de blog publié par Altman en 2013 :

"Les fondateurs qui ont le plus de succès ne cherchent pas à créer des entreprises. Ils ont pour mission de créer quelque chose plus proche d'une religion, et il s'avère, à un moment, que créer une entreprise est le moyen le plus simple d'y parvenir."

La côte Ouest américaine, berceau des plus grandes boîtes de la tech de la Californie à Seattle, n'est pourtant pas une terre portée sur la religion, même si le mysticisme y a bien sa place, on l'a vu par le passé sur TFTT.

Pourtant Altman, lui, se voit visiblement bien en Jésus de l'IA.

👉 Religion et IA toujours : Léon XIV, le nouveau pape, a choisi ce nom en référence à… l'IA ?

Et oui, c'est ce qu'il a expliqué le 10 mai : "le pape Léon XIII a abordé la question sociale dans le contexte de la première grande révolution industrielle. […] De mon côté, je fais face à une autre révolution industrielle et aux développements de l'intelligence artificielle, qui posent de nouveaux défis pour la défense de la dignité humaine, de la justice et du travail."

L'IA, opium du peuple en doudounes sans manches.

👉 Pendant ce temps, Zuckerberg continue à nager dans ses délires de mec chelou. Fin avril, il est intervenu dans un podcast pour y dire ceci : "l’Américain moyen n’a que 3 amis alors qu’il en voudrait 15".

Un tel constat pourrait être adressé logiquement par la sociologie ou la psychologie, mais pas quand on est un tech-bro comme Marc. Non, Marc, lui, a la solution toute prête : vous créer des amis artificiels ! « C'est bados, Marc », conclue élégamment le média Futurism.

Alors, l'IA : Dieu ou Humain ? Ni l'un, ni l'autre mon capitaine.

👉 Quittons les délires métaphysiques pour revenir à des prises de bec bien humaines. Un article très intéressant d'Usbek & Rica évoque cette semaine "Anti-Tech Résistance", collectif techno-critique radical qui s'était fait connaître notamment en faisant irruption dans un des contre-sommet de l'IA (en réponse au dit sommet de l'IA voulu par Macron en février dernier). Un "contre-contre-contre sommet de l'IA" comme le surnomme Irénée Régnauld, en somme.

L'existence de ce mouvement prouve en tout cas qu'au sein même de la mouvance techno-critique, que j'assume représenter également avec une certaine radicalité, il y a des divergences fortes. C'est sans doute la preuve de la vivacité de la chose.

Dans le cas d'ATR, cependant, il y a des trucs qui ne sentent pas bon, avec des prises de parole qui flirtent avec l'eugénisme (comme les pires techno-enthousiastes d'ailleurs) et des dérives réactionnaires. On gardera un œil dessus.

👉 Une news qu'Anti Tech Résistance n'aurait sans doute pas couverte : saviez-vous que plusieurs nominés du Pulitzer de cette année avaient utilisé l'IA ? Mais pas de la façon que vous imaginez… On y retrouve pêlemêle :

- Une enquête du Washington Post sur Gaza, où l'IA a été utilisée pour analyser des images prises par satellite et ainsi réfuter le récit de l'armée israélienne qui tentait de se dégager de toute responsabilité dans les assassinats de nombreux journalistes.

- Un article du Wall Street Journal a analysé, grâce à l'IA, l'évolution du ton des plus de 40 000 tweets de Musk. Ceux-ci sont ainsi passés de contenus purement business à des diatribes politiques d'extrême droite, comme chacun le pressentait. Le processus est désormais plus clair.