13.04.2026 à 09:54

Apple : le mythe fête ses 50 ans

Christophe @PoliticoboyTX

Texte intégral (8630 mots)

Ce weekend de Pâques, la firme californienne fêtait ses 50 ans. L’occasion d’interroger le mythe entourant la multinationale, tout comme son rôle dans la révolution numérique. La presse française disposait d’un boulevard. Elle a pourtant réussi à se vautrer. Parmi les innombrables articles consacrés au sujet, aucun n’interroge le récit marketing d’Apple. Le Monde nous ressert la soupe mal réchauffée de la rencontre entre Steve Jobs et Wozniak accouchant du tristement célèbre mythe du garage, quand d’autres se bornent à énumérer les “innovations” sans s’arrêter sur les nombreux scandales et échecs commerciaux. Beaucoup tordent les faits en faveur d’Apple, aucun ne s’intéresse aux conditions de production ni aux structures historiques dans lesquelles s’inscrit son succès.

Comme le décrit très bien notre camarade Gregoire Barbey, journaliste au Temps, cette couverture médiatique révèle une triste réalité. Cinquante ans après les débuts d’Apple, en dépit des nombreux travaux critiques disponibles, la presse reste incapable de prendre la moindre distance avec son objet ou de politiser un sujet éminemment… politique.

L’occasion de corriger le tir semblait trop belle, malgré la relation complexe que j’entretiens avec Apple.

Fan d’Apple un jour, fan d’Apple toujours ?

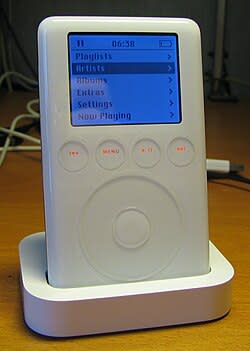

Pour être honnête, rien ne me disposait à critiquer la Pomme, que j’ai croquée avec gourmandise pendant de nombreuses années. Encore aujourd’hui, j’écris sur un MacBook, mon téléphone est un increvable iPhone X de 2018 et j’ai toujours mon iPod 5Gb et sa molette quelque part dans un placard.

À ma décharge, j’ai grandi avec la marque. Le premier ordinateur familial était un Macintosh “classic” noir et blanc, prêté par une amie de mes parents pour trois mois. Mon père découvrait l’informatique, les gains de temps offerts par les tableurs et le traitement de texte. MacOs était plus intuitif que DOS et plus stable que Windows 3.1. Conquis, il acquit une machine identique sur le marché de l’occasion via un groupe de passionnés. Tous les premiers mardis du mois, il rejoignait ce “Club Mac” où des CSP+ s’échangeaient conseils et programmes par boites de disquettes entières, discrètement passées sous le manteau.

Cela présentait quelques avantages. Mes amis jouaient encore aux Legos quand je m’immergeais dans Prince of Persia, Shadow Gate et Dark Castle. J’ai grandi avec SimCity 2000, les parties en réseau local de Warcraft 2 et les massacres de nazis permis par Wolfwostein 3D. Pendant que certains découvraient le minitel, je chargeais des photos du futur Stade de France avec un modem internet 8kbit/s, caractérisé pour son bruit infernal et son aptitude à faire exploser les factures téléphoniques.

Mais prêter allégeance à la Pomme avait un prix. Le PC a rapidement largué le Mac. Si je me moquais de leurs problèmes de virus et de plantage fréquents, mes amis ripaient des CD en 48x quand notre pauvre lecteur externe restait bloqué sur du 4x. Notre premier graveur, un mange-disque imposé par Steve Jobs par esthétisme, fonctionnait 16 fois moins rapidement que ceux des PC d’entrée de gamme. Au Lycée, ça téléchargeait les derniers blockbusters en peer to peer sur emule et Kazaa pendant que je luttais pour trouver le moindre album de musique sur la version Mac compatible de Napster. Je me vois encore attendre anxieusement la tournée du facteur venu livrer le mensuel “SVM Mac” pour feuilleter frénétiquement la rubrique “jeux” avant de constater que le dernier titre en vogue sur PC ne serait pas adapté.

Les raisons de ce déficit de logiciels et de composants provenaient directement du modèle commercial d’Apple. De nombreux éditeurs de programmes ne s’embêtaient pas à les adapter pour Mac, compte tenu des parts de marché déclinantes, tandis que l’architecture de l’OS était structurellement incompatible avec les puces Intel. Le résultat de l’obsession de contrôle de Steve Jobs.

Les membres de la communauté Mac se vivaient comme des rebelles, des iconoclastes et des résistants opposés au grand méchant Gates. Ce qui permettait à Apple de nous vendre à prix d’or des machines plus ergonomiques, mais moins puissantes. Les petits budgets devaient s’équiper sur le marché de l’occasion, là où mes camarades de lycée profitaient du PC dernier cri de leurs parents, acheté à un prix similaire chez un assembleur.

L’aspect communauté figurait au cœur de la stratégie de la Pomme, entretenue par les keynotes annuelles, grands-messes où Steve Jobs prêchait la bonne parole. Aucun revirement n’était trop gros pour les fans. Le rapprochement avec Microsoft, longtemps présenté comme le diable personnifié ? Applaudissement. L’abandon des processeurs Motorola (G3, G4, G5) censés surclasser les puces Intel, au profit de ces dernières ? Tout passait comme une simple mise à jour d’iTunes. Steve finirait par triompher, et nous avec. L’iPod serait notre cheval de Troie. 10 000 chansons dans la poche, de quoi faire le DJ dans n’importe quelle soirée. Puis vinrent l’iPad et l’iPhone. D’un seul coup, Apple n’était plus seulement un culte, mais le sommet du cool. Le triomphe du Hipster sur le Geek. De l’artiste sur l’expert-comptable. De l’élitisme et du luxe sur le low cost.

Nous avions survécu pendant des années à l’ignoble PC en pensant différemment. Think different ! L’important était l’ergonomie offerte par l’univers Apple, véritable cocon où l’utilisateur captif est maintenu à l’abri des bugs et virus inhérents aux produits Microsoft. Au prix d’une rupture avec l’esprit hacker et la bidouille qui animaient Steve Wozniak.

Ceux qui entrevoient désormais le cynisme du marketing d’Apple et les problèmes liés à l’obsession de contrôle de Steve Jobs restent souvent, par habitude, adeptes de la marque avec laquelle ils ont grandi. Prisonniers de l’écosystème, peu enclin à le critiquer. Est-ce une des raisons expliquant la couverture médiatique en forme de publicité qui accompagne la Pomme depuis des années ? Où faut-il se demander dans quelle vision politique s’inscrit ce récit ?

Steve Jobs et le mythe de l’entrepreneur

Le mythe fondateur d’Apple est inséparable de celui de son parton emblématique, dont le décès fut salué comme la mort d’un génie visionnaire élevé au rang de figure quasi christique.

Il suffit pourtant de relire l’hagiographie autorisée de Jobs pour discerner, entre les lignes, la véritable histoire d’Apple et de son cofondateur.

La firme est née de la rencontre entre trois hommes. Steve Wozniak, ingénieur chez HP, doté d’un talent exceptionnel, largement considéré comme un des pères de l’ordinateur personnel. Mike Markkula, financier visionnaire, ex-cadre de chez Fairchild Semiconductor et Intel. Et Steve Jobs, hippie crasseux dénué de véritable talent en électronique, mais indéniablement doué pour exploiter ses amis et raconter des histoires. À commencer par celle de son propre génie.

Wozniak a mis au point les deux premières machines commercialisées par Apple (l’Apple 1 et l’Apple 2), Mike Markkula a financé la start-up, écrit le business plan, obtenu la première ligne de crédit chez Bank of America et ouvert les vannes de ses réseaux de capital-risqueurs pour démarrer la production. Le principal apport de Jobs fut de convaincre Wozniak de ne pas distribuer gratuitement les plans de sa création à son club de hackers, le célèbre Homebrew Comptuer Club de Stanford.

Comme le détaille très bien l’universitaire Anthony Galluzo dans “Le mythe de l’entrepreneur”, on peut expliquer la naissance d’Apple par la mobilisation des réseaux financiers et la création d’une stratégie d’entreprise permise par Markkula, lui qui avait abordé les deux Steve en leur transmettant sa conviction qu’ils se trouvaient au début d’une révolution technologique. Où par l’écosystème qui a permis à Wozniak de concevoir l’Apple 2. “Woz” a grandi au cœur de la Silicon Valley, fait ses armes chez HP, où il restait tard le soir bosser sur des projets personnels en utilisant les ressources de l’entreprise. Une démarche enrichie par sa fréquentation assidue du Homebrew , où la crème des geeks et ingénieurs se réunissait au début des années 70.

Jobs avait tenté de vendre une licence de production de l’Apple 2 avant l’arrivée de Markkula. Incapable d’accoucher d’un business plan, sa première contribution à Apple fut l’exploitation de ses proches pour assembler une centaine de kits d’Apple 1 dans le célèbre garage de ses parents. Mais le succès initial de la start-up, qui vendait moins d’ordinateurs que d’autres concurrents comme Commodore, tient également d’un coup de chance méconnu.

À la fin des années 1970, un développeur met au point un tableur de calcul, Visicalc, conçu pour fonctionner avec l’architecture logicielle de l’Apple 2. Prisé par de nombreux cadres et entreprises, le programme justifie à lui seul l’acquisition de l’ordinateur, dont les versions successives constitueront une véritable vache à lait pour Apple jusqu’à la fin des années 1980.

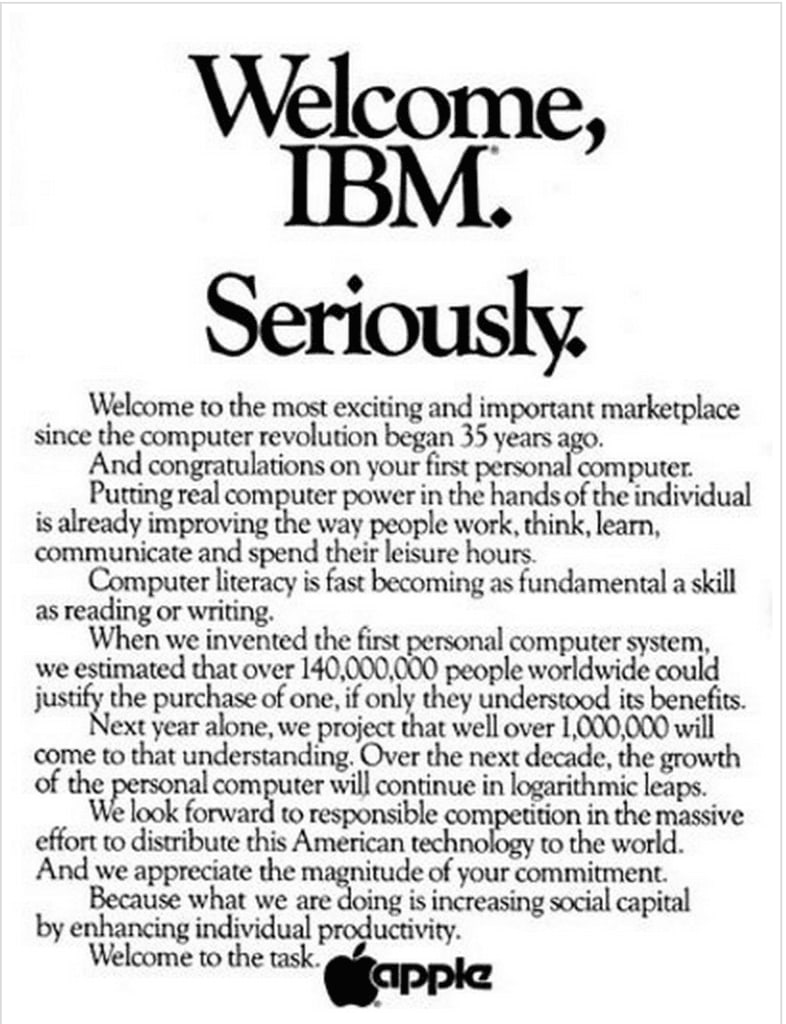

Ce flux de revenus va permettre d’absorber les pertes financières induites par l’impétueux Steve Jobs, qui saborde l’Apple 3 en imposant une absence de ventilateur, avant de dynamiter le projet LISA au profit de son petit bébé, le Macintosh. L’œuvre de Jobs souffre des choix esthétiques de ce dernier : l’absence de ventilateur (encore) provoque des problèmes de surchauffe. Et le budget marketing faramineux compte parmi les raisons qui conduisent Apple à sous-dimensionner la puissance des composants. Le Mac de 1984, premier ordinateur personnel doté d’une interface graphique, est trop cher et pas assez puissant. Le perfectionnisme de Jobs a retardé sa sortie et fait exploser ses couts de production. C’est un échec commercial et financier qui finira par conduire le conseil d’administration d’Apple à se séparer de son second cofondateur (Wozniak ayant quitté le navire avant, suite à un accident d’avion). Car au-delà des choix techniques problématiques, Jobs avait dépensé des fortunes en publicité pour se moquer ouvertement de l’arrivée du géant IBM sur le marché de l’ordinateur personnel.

“Ils étaient les seuls à ne pas se rendre compte de la tornade qui s’apprêtait à les emporter” note Walter Isaacson. En effet, si IBM allait jouer, avant Microsoft, le rôle du méchant capitaliste dans le narratif d’Apple, le géant de la bureautique va surtout introduire une nouvelle manière de produire des ordinateurs. “Big Blue” se contente d’assembler des composants tout en sous-traitant le système d’exploitation (OS) à Microsoft. Exit le modèle verticalement intégré d’Apple, qui sera incapable de faire face en matière de prix, d’offre logicielle et de puissance du hardware.

Le retour triomphal de Jobs au poste de PDG par intérim, douze années après son éviction, ne va pas l’exempter d’autres flops. Steve développe personnellement deux ordinateurs haut de gamme similaires qui ne se vendront pas (le Next, racheté par Apple, puis le PowerMac Cube). Face au piratage de musique, il imposera le modèle de téléchargement payant de l’iTunesMusicStore contre celui du streaming, arguant que “les gens veulent posséder les objets qu’ils utilisent”.

Steve Jobs reste un patron redoutable en affaire et doté d’un sens aigu du design. Mais le succès d’Apple doit également beaucoup à ses employés, trop souvent oubliés. Le concept du Macintosh provient d’un simple ingénieur, qui avait été jusqu’à souffler le nom de l’ordinateur à Jobs. Et c’est à Jon Ive, le responsable du design, que l’on doit le look des plus grands succès d’Apple post 2000.

Le génie de Jobs, nous expliquent ses biographes, s’accompagnait de quelques traits de caractère peu reluisants. L’entrepreneur a refusé de reconnaitre sa fille, allant jusqu’à accuser sa mère de “trainée” pour éviter de payer une pension. Il s’est servi de Wozniak pour conserver son emploi chez Atari, tout en lui cachant la prime qu’il avait reçue pour les projets effectués par son ami en son nom. Il se garait sur les places handicapées et collectionnait les excès de vitesse, convaincu que “les règles ne s’appliquaient pas à lui”. Il tyrannisait ses employés, piquait des colères trumpiennes contre des serveurs de restaurant, humiliait ses ingénieurs et leurs “idées de merde” qu’il s’attribuait ensuite. La quasi-totalité de l’équipe de développement du Macintosh démissionna, en burn-out, à la fin du projet. Véritable pervers narcissique, il prit un malin plaisir à priver un de ses amis et tout premier employé de la moindre stock-option lors de l’introduction en bourse. Au point que d’autres employés choqués partagèrent leurs propres parts avec l’ancien ami. Parmi ses plus fidèles alliés, il comptait le milliardaire transhumaniste Larry Ellison, patron qui défend depuis deux décennies une société de contrôle absolue à la 1984 de G. Orwel, tout en finançant l’armée israélienne et (désormais) l’administration Trump.

Le véritable génie de Jobs tient dans sa banale capacité à exploiter autrui. Comme je l’écrivais dans ma “brève histoire de la Silicon Valley” :

“Enfin, Jobs comme Gates ont permis à la Silicon Valley de tourner la page du keynésianisme financé par les dépenses militaires et étatiques, pour entrer dans l’ère néolibérale et la consommation numérique de masse. Si Xerox a ouvert ses portes à Apple, c’est parce qu’elle comptait sur la start-up pour commercialiser son Alto, une chose qu’elle n’avait pas les capacités organisationnelles de faire elle-même.”

C’est dans ce contexte socio-économique qu’il faut comprendre l’ascension d’Apple. Pendant que Bill Gates tuait le logiciel libre et l’esprit hacker avec Microsoft, Jobs et Apple tuaient le modèle industriel reposant sur une production locale et syndiquée, pour organiser le “juste à temps” depuis des sous-traitants bientôt délocalisés en Asie. Le tout en rapatriant les profits dans des paradis fiscaux, plutôt que d’agir face aux scandales liés aux vagues de suicides touchant les usines Foxcon assemblant l’iPhone.

Les conditions de quasi-esclavage des sweatshops de Nike avaient provoqué de nombreux appels au boycott. Apple n’a souffert aucun backlash de ce genre, malgré l’installation de filets de sécurité anti-suicide dans ses propres usines. Est-ce parce qu’il est question de révolution technologique susceptible de “changer le monde” ?

Apple et le mythe de l’innovation

Apple aurait inventé l’ordinateur personnel, la souris, l’interface graphique, le baladeur mp3 ergonomique (iPod), les tablettes (iPad) et le smartphone (iPhone).

Pour en arriver à cette conclusion, il faut opérer une simplification de la chaine d’innovation proprement stupéfiante. L’iPhone, qui dépend de dix inventions majeures financées par la recherche publique (dont Internet, le GPS, la technologie derrière l’écran tactile multipoint, Siri…), est souvent cité en exemple. Certes, Apple a eu la “vision” permettant leur intégration. Mais le rôle du gouvernement ne s’arrête pas à la recherche, puisque la firme californienne avait bénéficié d’un investissement public à ses tout débuts. Ce qui constitua un coup de pouce pour attirer les investisseurs privés.

Si personne ne nie la capacité d’Apple à innover, l’émergence de ses produits doit être replacée dans un contexte économique et une chaine d’innovation. L’Apple 1 fut créé par Wozniak avec “les meilleurs composants que je pouvais me payer”. Il résulte directement des progrès technologiques dans la micro-électronique. L’Apple 2, véritable premier produit d’Apple, sort après divers ordinateurs personnels, dont le Micral français (1973) et le premier Commodore, écoulé à un plus grand nombre d’exemplaires. La mise sur le marché des ordinateurs estampillés d’une pomme s’inscrit dans une continuité, pas une rupture.

De même, l’interface graphique et la souris qui équipera les premiers Macintosh avaient été inventées par les équipes de Douglas Engelbart au SRI de Stanford. Loin d’en faire un mystère, ils avaient été présentés publiquement lors de la célèbre “mother of all demos” diffusée en 1968. C’est au sein du laboratoire de Xerox, le PARC de Standord, que la vision d’Engelbart accouchera de l’Alto en 1973. Il s’agit du premier ordinateur personnel à interface graphique, alors à l’état de prototype. Xerox investit dans Apple, dans l’idée de se servir de l’agilité de la start-up pour pénétrer le marché de l’ordinateur personnel. Jobs visite le PARC, voit l’Alto et pousse Apple à développer son propre ordinateur à interface graphique en débauchant des ingénieurs de Xerox. C’est le projet LISA, qui accouchera d’un ordinateur trop cher et affaibli en interne par le projet Macintosh.

Pour développer l’iPod, premier succès majeur de la firme depuis l’Apple 2, Jobs recrute Tony Faden et lui achète son concept de baladeur à disque dur. Un design similaire avait été breveté dès 1979 par Ken Kramer, un ingénieur britannique, qui n’avait pu faire aboutir son idée du fait du cout prohibitif des composants. Loin de l’éclair de génie ayant pénétré Steve Jobs, on se retrouve confronté à une chaine d’innovation des plus classiques, où la chute des prix des composants explique qu’ils aient pu se retrouver assemblés au sein d’un même produit.

Depuis le décès de Steve Jobs, Apple a connu quelques succès (l’iWatch, Siri, les AirPods) et des déconvenues (le VisionPro, lancé en grande pompe, et le projet de voiture électrique abandonné après une dizaine de milliards d’investissements). Mais le mythe de la firme qui a “changé le monde” continue d’être répété comme une vérité indiscutable. Comme si aucune autre entreprise n’aurait pu accoucher du smartphone ou que cette innovation est comparable au moteur à induction et au transistor. La firme serait-elle si différente de ses concurrentes ?

Apple et le mythe du “think different”

Dès ses débuts, Apple a développé une image de firme rebelle et iconoclaste. Une stratégie qui peut s’expliquer par divers facteurs. L’influence de la contre-culture californienne des années 1960 et 1970 dans laquelle ont baigné Jobs et Wozniak, comme la majorité des acteurs de l’émergence de la micro-informatique, à l’exception notoire de Bill Gates. Puis la nécessité de justifier les tarifs premiums pratiqués par Apple face aux “Goliaths” incarnés par IBM et Microsoft.

La clientèle Apple a également justifié ce narratif. Outre les fans inconditionnels, Apple a fidélisé un marché dans certains corps de métiers (graphisme, édition, montage vidéo, photo) dès les années post Jobs, via la mise sur le marché d’une imprimante laser intégré au Mac, puis l’arrivée de logiciels optimisés pour les systèmes Apple (Photoshop, Final Cut Pro…). En ajoutant son lobbyisme pour cibler le secteur de l’éducation, Apple s’est retrouvé en position idéale pour cultiver cette image d’entreprise au service des créateurs et des artistes (en miroir de l’image qu’avait Steve Jobs de lui-même). Ce qui permettait de passer outre les nombreux défauts d’Apple (dont le manque de jeux et divers problèmes de compatibilité) pour imposer un contraste avec le PC soi-disant destiné aux comptables et ingénieurs. L’iPhone constituait aussi une réponse cool aux smartphones à stylets et au BlackBerry, destiné à un public de cadres supérieurs appréciant l’accès permanent à leurs emails.

Avec son environnement contrôlé, l’utilisateur d’Apple bénéficie également d’une meilleure protection contre les virus et la surveillance, au moins théoriquement. Ce qui explique pourquoi Apple a refusé de collaborer avec le FBI pour déverrouiller des iPhone, a rechigné à investir le marché du Big Data comme les autres GAFAM et longtemps résisté à la hype de l’IA générative.

Mais Apple n’est pas votre amie pour autant. L’entreprise finançait des lobbies climatosceptiques et effectue un lobbyisme important pour empêcher l’émergence d’App Stores alternatifs. Son PDG sert autant la soupe à Donald Trump que le reste des grands patrons de la Tech. L’empreinte écologique des produits Apple est désastreuse, même pour le secteur. Une conséquence du choix de l’obsolescence programmée de produits conçus pour être non évolutifs, non recyclables et pratiquement irréparables.

Le modèle d’Apple se place en porte à faux avec une autre conception de l’informatique, libre, partagée, collaborative, réparable, évolutive, interopérable, sobre. La firme incarne le consumérisme de masse et, au même titre que Microsoft, a toujours été obsédée par la propriété intellectuelle. L’usage des brevets comme arme juridique contre la concurrence et l’innovation est un autre aspect de la culture d’entreprise, au-delà de la protection des données clients.

Le modèle économique repose sur des rentes. Celle tirée de l’image de marque qui permet de pratiquer des marges outrancières. Celle du quasi-duopole du smartphone et des tablettes qui lui permet d’imposer une commission de 27 % aux développeurs d’applications sur l’App Store et de facturer à Google 20 milliards de dollars par an l’installation de son moteur de recherche par défaut dans le navigateur internet Safari. Et celle de sa base d’utilisateurs captifs, maintenus dans un environnement familier via une gamme de produits reconnus pour leur facilité d’usage et leur complémentarité.

Tout cela ne saurait être plus éloigné de l’image d’entreprise rebelle, de David contre Goliath et d’innovateur au service de l’émancipation.

27.03.2026 à 11:43

Quand l'IA déçoit : aperçu des dernières fissures du mythe technophile

Christophe @PoliticoboyTX

Texte intégral (5571 mots)

Si vous avez l’impression que l’IA est sur le point de vous remplacer et que 2027 sera l’année des robots, j’ai des nouvelles pour vous.

Contrairement à ce que suggère le torrent d’information anxiogène sur le sujet, tout n’est pas rose dans le secteur de la Tech. Ces dernières semaines, le programme de Robotaxis de Tesla a subi un revers, OpenAI a annulé son service de génération de vidéo « Sora » et les “agents” IA ont provoqué des dégâts considérables chez Facebook et Amazon. Des contrecoups qui interviennent dans un contexte inédit de baisse du rythme de déploiement des data centers aux États-Unis, signe supplémentaire de l’essouflement du secteur.

Si les annonces fracassantes peuvent donner l’impression d’un rouleau compresseur technologique, gardez à l’esprit que la Tech dépend des promesses fumeuses pour attirer les investisseurs et convaincre le grand public comme les entreprises d’acheter leurs produits. Pour se remettre les idées en place, je vous propose un petit tour d’horizon des récentes déconvenues du secteur.

Des robotaxis pas si autonomes

La promesse de la voiture autonome ne date pas d’hier. Des millions d’emplois (taxis, VTC, livreurs, conducteur de bus, chauffeur de poids lourds…) seraient menacés par une technologie qui risque également de concurrencer les transports en commun. En transformant les véhicules particuliers en taxis à bas cout, comme l’envisageait Musk dans son « Master Plan, part 2 », tout le parc automobile pourrait concurrencer Uber.

Malgré le retard à l’allumage, cette dystopie semble de plus en plus plausible. Les robotaxis de Waymo, filiale de Google, ont démontré la viabilité technique de leur solution. L’entreprise déploie son service dans un nombre croissant de mégalopoles américaines, avec un taux d’accident inférieur à la moyenne humaine par millions de kilomètres parcourus. Un succès qui provoque de nombreuses frictions.

Waymo fait l’objet de deux enquêtes administratives américaines suite à des difficultés manifestées par ses voitures pour gérer les conditions de circulation impliquant des bus de ramassage scolaire. En janvier, une enfant a ainsi été percutée par une voiture autonome. Cette affaire s’ajoute à des différents problèmes liés aux difficultés posés par les situations inhabituelles de circulations Récemment, une Waymo a bloqué des policiers mobilisés pour répondre à une fusillade de masse à Austin. Avant cela, une autre Waymo avait bloqué une ambulance en intervention. Il ne s’agit pas de cas isolés, mais d’un problème structurel. À San Fransisco, les pouvoirs publics se plaignent de devoir jouer les dépanneurs gratuits de robotaxis. En effet, les pompiers, policiers et agents de la circulation sont souvent contrain de venir en aide à une Waymo en difficultée, pour l’empêcher de bloquer trop longtemps la circulation.

Si ces difficultés ne semblent pas en mesure d’entraver l’expansion des Robotaxis, le le modèle commercial de Waymo présente d’autres limitations. Pour maintenir sa performance en matière de sécurité routière, la start-up déploie uniquement ses taxis autonomes sur des itinéraires balisés, après avoir acquis suffisamment d’expérience en phase de test. Chaque nouveau déploiement nécessite des investissements importants pour cartographier la nouvelle zone qui sera desservie et entrainer le système de conduite à l’emprunter.

Est-il moins cher d’employer un automate Waymo qu’un humain ? À en croire les prix pratiqués par l’entreprise, supérieurs aux courses Uber avec chauffeur, la réponse serait non. Une part des explications réside dans le cout des voitures, produites en moins grand nombre d’exemplaires et munies de capteurs additionnels onéreux. L’autre raison vient d’être confirmée par l’entreprise lors d’une audition devant le Sénat américain :

Les Waymo ne sont pas autonomes.

Plus exactement, des humains interviennent dans la boucle. Ils ne conduisent pas la voiture, mais surveillent la flotte et répondent aux requêtes de l’IA lorsque celle-ci se trouve confronté à une situation difficile. Le ratio humain/voiture tend à se réduire. Après avoir été longtemps évasif sur le sujet, Waymo vient de lâcher un chiffre : l’entreprise emploierait un téléopérateur pour 42 voitures. Un faible ratio, mais non négligeable.

Ces téléopérateurs ont un cout et posent divers problèmes. Certains sont localisés aux Philippines, sans être nécessairement en possession d’un permis de conduire américain. Outre les risques en matière de piratage informatique, le choix de sous-traiter à ce point montre une absence manifeste de contrôle et de régulation. Dans tous les cas, la nécessité de maintenir des humains dans la boucle introduit une limite à la croissance exponentielle du service. Ce qui nous amène aux déboires de Tesla.

Comme j’avais eu l’occasion de le détailler dans un article dédié, l’entreprise de Musk a opté pour une approche radicalement différente, au prix de dizaines de morts et centaines d’accidents. L’objectif initial consistait à rendre toutes les Tesla autonomes, dans le but de permettre aux propriétaires de convertir leurs véhicules en robotaxis occasionnels.

Face aux difficultés rencontrés, Tesla a changé son fusil d’épaule en démarrant en grande pompe un service de robotaxis inspiré de Waymo. La première phase de test, lancée dans la ville d’Austin à l’aide d’une vingtaine de véhicules, devait permettre de démontrer la fiabilité du système en vue d’un déploiement exponentiel. Pas besoin de produire des voitures spécifiques, pas besoin de passer des mois à cartographier une ville et à entrainer le modèle à la parcourir. Waymo n’avait qu’à bien se tenir. La requête déposée devant les autorités routières californiennes pour l’obtention d’une licence de robotaxis alimentait ce récit conquérant.

Hélas pour Musk, les choses ne se passent pas tout à fait comme prévu. Non seulement la phase de test a majoritairement été conduite avec un employé à bord du robotaxi. Mais en plus, Tesla a reconnu que ses robotaxis provoquaient trois fois plus de collisions qu’un conducteur humain.

Or, les données partagées par l’entreprise avec les autorités locales n’incluent pas les nombreuses violations du Code de la route constatées par des observateurs. Là où Waymo s’illustre par sa transparence, Tesla continue d’opérer dans la plus grande opacité, en refusant de fournir le moindre détail sur les circonstances de ses accidents. On ne sait pas davantage à quelle fréquence ses copilotes humains prennent le controle du vehicule ni quel est le ratio entre téléopérateurs et robotaxis. Tout ce que l’on sait, c’est que la firme avait retiré ses copilotes humains pendant deux jours, probablement pour rassurer les marchés financiers lors de la publication des résultats annuels, avant de les replacer derrière le volant.

Les nouvelles ne sont pas meilleures du côté de l’autopilote fourni en option sur toutes les Tesla. Le système FSD (pour « Full Self Driving ») qui permet au conducteur de lâcher le volant quelques secondes multiplie les dérapages. La propriétaire d’un Cybertruck vient d’attaquer Tesla en justice. Elle accuse la firme d’avoir provoqué un accident, l’autopilote conduisant son véhicule en plein dans la barrière en béton séparant deux bretelles d’autoroutes. Une autre Tesla a récemment tenté de traverser un lac.

Ce genre de problème n’afflige pas uniquement les voitures autonomes. Les robots livreurs connaissent également leur lot d’accidents. Lorsqu’ils ne sont pas interdits de circulation par des pouvoirs publics pliant face à la colère des riverains, ils ont tendance à détruire des jardins ou traverser des vitres d’abribus. On pourrait également citer la multiplication de cas impliquant des systèmes de vidéosurveillance ayant conduit à des arrestations injustifiés, voire des séjours prolongés en prison, suite à des erreurs d’identification.

De là à dire que les millions de robotaxis autonomes ne sont pas pour demain, il y a un pas que j’hésite à franchir. D’autres constructeurs automobiles ont mis au point des systèmes d’assistance à la conduite prometteurs et la technologie se perfectionne avec le temps. Mais le dernier « kilomètre » reste le plus dur à parcourir. Celui qui sépare un système d’assistance à la conduite d’une véritable voiture sans pilote capable d’opérer de manière plus fiable qu’un humain. Et, si possible, sans engendrer de multiples conséquences négatives pour les autres usagers.

Les “agents IA” générateurs de catastrophes

Dans le domaine de l’IA générative, tout le monde admet que l’approche reposant sur les larges modèles de langage se heurte à un mur, y compris les patrons de Google et d’OpenAI. Plutôt que de poursuivre leur quête d’une IA générale toute puissante, ils se focalisent désormais sur des applications plus spécifiques et susceptibles de leur permettre d’atteindre la rentabilité. D’où les efforts pour améliorer les fonctionnalités permettant d’écrire du code informatique et le déploiement hâtif de programmes appelés « agents ».

Ces “agents” sont capables de prendre le contrôle de votre ordinateur ou de certains logiciels pour effectuer des tâches de manière autonome (envoyer des courriels, mettre en ligne un site web, etc.). Si les dernières versions de ces programmes semblent plus prometteuses que les flops initiaux, des ratés monumentaux continuent de faire les gros titres.

Chez Facebook, un agent a provoqué un accident en postant des informations sur le site interne de l’entreprise. Dans un autre épisode non dénué d’ironie, la directrice de la sécurité IA de Meta a perdu tous ses courriels, effacés par un agent mal programmé.

Chez Amazon, l’usage immodéré des IA a provoqué l’arrêt temporaire de plusieurs serveurs indispensables au bon fonctionnement de la boutique en ligne. Les multiples problèmes ont entrainé la perte de millions de commandes et la suspension du site pendant plusieurs heures en Amérique du Nord, principal marché d’Amazon. Le média spécialisé The Information explique ainsi que le déploiement des Agents introduit de nombreuses failles de sécurité et des mécanismes de pannes logicielles inédits.

Dans la même veine, notre camarade Hubert Guillaud relate les conclusions d’une étude finlandaise illustrant pourquoi les déploiements de systèmes décisionnels reposant sur de l’IA générative se soldent souvent par des échecs opérationnels.

Ces exemples expliquent pourquoi Anthropic s’est préventivement déchargé de sa responsabilité concernant l’usage de Claude Cowork, son tout dernier agent. Si vous connaissez d’autres entreprises qui mettent des produits sur le marché en déclarant que les clients s’exposent à de graves dangers, faites-moi signe. De mémoire, on n’a jamais lu un chapeau d’article type : « Lustucru lance ses nouveaux spaghettis, cuits en deux minutes. La firme avertie que leur consommation peut entrainer des maladies graves ». Mais avec la Tech, tout est permis.

L’IA générative ne génère pas les gains de productivité escomptés

Non seulement l’usage intensif de l’IA rend idiot, mais elle pousse également les employés au burn-out. L’auteur d’une étude de Berkley, cité par le Wall Street Journal, explique que l’IA augmente le volume de travail attendu des employés, qui se sentent sous pression et profitent de ses outils pour effectuer plus de tâches, « aux dépens du temps de réflexion et des activités demandant une plus grande concentration ». Et de noter que « si cela peut paraitre bénéfique à l’employeur à court terme, à moyen terme cela peut conduire à des burn-out, des pertes d’aptitudes cognitives ou impacter négativement la prise de décision de qualité ».

La question des gains de productivité continue de faire débat. Selon une autre enquête menée auprès de 6000 PDG par le National Bureau of Economic Research, 90 % des grands patrons interrogés estiment que l’IA n’avait pas eu d’impact sur la productivité ou l’emploi dans leur entreprise. Tout en reconnaissant utiliser eux-mêmes ces outils seulement « moins de 1h30 par semaine ».

Ces enquêtes viennent nuancer le genre de récits et discours alarmistes qui prétendent que l’IA remplace des millions d’emplois. D’autres signaux pointent vers les limites de cette technologie, trop souvent présentée comme incontournable et inévitable.

OpenAI vient de mettre fin à deux produits importants. Le premier visait à instaurer une fonction de commerce en ligne dans ChatGPT. Puisque les utilisateurs du chatbot demandent souvent des conseils en matière de shopping, OpenAI pensait monétiser cet usage en mettant en relation ses usagers avec divers sites de vente en ligne. Seul problème, maintenir un tel service sans provoquer d’innombrables erreurs (prix pas à jour, produit non conforme à la description ou plus disponible) générant des retours clients ou empêchant la conclusion d’une transaction demande des quantités de données et une infrastructure gigantesque. Ce qu’OpenAI n’est pas en mesure de fournir à l’heure actuelle.

L’annonce de l’abandon de ce service a revigoré les cours boursiers des principales agences de voyages (Expedia, Booking,…) qui avaient peur que des « agents » reposant sur l’IA générative ne sapent leur modèle commercial.

Cet échec n’est pas le seul récemment acté par OpenAI. Le leader de l’IA générative vient d’annoncer la suppression de « Sora », son service de génération de vidéo qui avait défrayé la chronique. Pris de court, Walt Disney a annulé son investissement d’un milliard de dollars dans OpenAI. Le partenariat devait permettre à Sora d’utiliser gratuitement les personnages de Disney sans verser de droits d’auteur.

Les raisons de cette suppression ne sont pas claires. Elle constitue un élément supplémentaire suggérant qu’OpenAI traverse de graves difficultés, alors que ses produits sont dépassés par la concurrence et que son image s’est sérieusement dégradée. Pour Sora, on peut supposer que le service coutait trop cher à OpenAI, alors qu’il était utilisé principalement pour produire du contenu pornographique, de la désinformation et du slop plus ou moins manipulatoire. Loin d’avoir entrainé la mort d’Holywood, Sora n’a pas trouvé d’application commerciale convaincante.

AMC, principal opérateur de salles de cinémas aux États-Unis, vient de retirer en catastrophe de ses salles un court métrage réalisé par l’IA. Le spot, diffusé pendant les publicités d’avant séance, avait enragé les clients. AMC a pointé la responsabilité d’un sous-traitant chargé de gérer la régie publicitaire d’un tiers de ses cinémas pour tenter d’apaiser le public. Une preuve de plus du dégout qu’inspire l’usage de l’IA dans la production audiovisuelle.

Le déploiement des data centers en panne

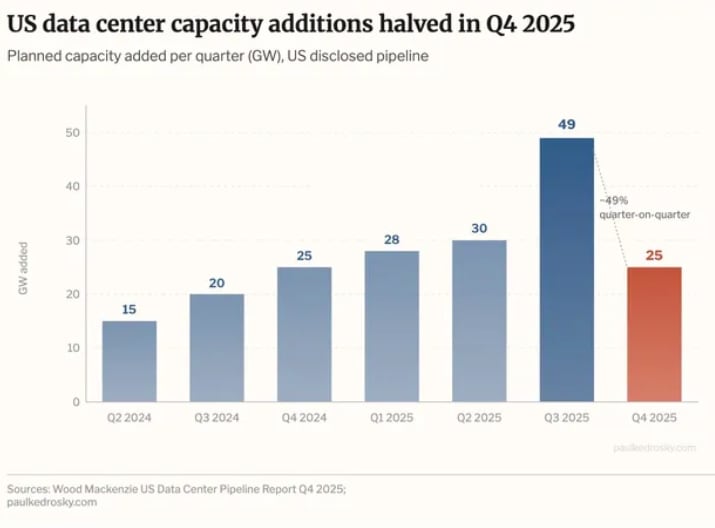

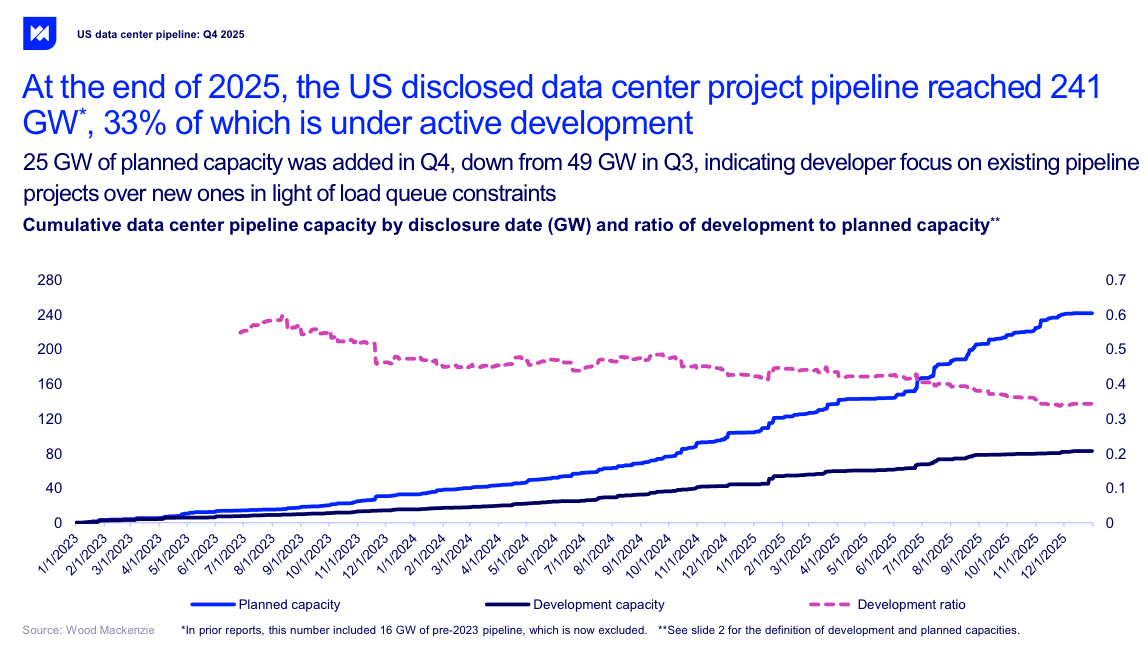

Comme le résume Ed Zitron dans sa newsletter, le dernier rapport du cabinet Wood Mackenzie révèle une baisse spectaculaire des projets de data centers au cours du dernier trimestre. Ce ralentissement intervient au momement où les difficultés pour mener à termes ces projets s’accumulent. Sur les 240GW de puissance promis aux USA (l’équivalent de la puissance requise lors des pics de consommation électrique du pays), seuls 33 % sont en cours de construction. La principale raison invoquée découle des difficultés à mettre en ligne un data center.

L’opposition à leur implantation est de plus en plus féroce, les riverains craignant les impacts en termes de consommation d’eau et de hausse du prix de l’électricité, alors que les emplois créés se comptent souvent sur les doigts de la main. De nombreux projets ont été annulés ou retardés. Et ceux qui sont autorisés butent parfois sur des problèmes d’approvisionnement en composants, lorsqu’ils ne rencontrent pas des difficultés à se raccorder au réseau ou à trouver leur propre source d’énergie. Ainsi, 58% des projets planifiés n’ont pas sécurisé leur accès à la puissance électrique nécessaire pour les faire tourner.

Mais le point essentiel à retenir est peut-être ailleurs : les chiffres ne concernent pas la mise en service des data centers, mais simplement les projets déclarés. La quantité de data centers qui sont effectivement mis en fonctionnement chaque trimestre est largement inférieure aux chiffres époustouflants repris par la presse. Une fois de plus, il existe un gouffre entre les promesses et la réalité.

Tous ces éléments mis bout à bout forment un panorama quelque peu différent de celui produit par notre système médiatique. En plus de buter sur des problèmes commerciaux et techniques, l’adoption massive de l’IA pourrait se heurter aux limites physiques induites par le caractère extrêmement énergivore de l’infrastructure sous-jacente. En attendant la publication d’un hypothétique ouvrage intitulé « Comment saboter un data center », il est possible de faire sa part en s’opposant activement à l’implantation de ces infrastructures autour de nous.

09.03.2026 à 07:24

L'IA au service de la guerre contre l'Iran

Christophe @PoliticoboyTX

Texte intégral (4853 mots)

Dès les premières heures de leur guerre contre l’Iran, les États-Unis et Israël ont commis un massacre d’ampleur historique. Comme je l’écrivais dans un article analysant leur guerre illégale :

Les fillettes de la petite ville de Minab venaient d’entamer leur semaine lorsque leur école a été bombardée par la coalition israélo-américaine. Plus de 140 enfants et les 26 enseignantes sont morts, en plus de la centaine de blessés graves, brûlés ou écrasés par les gravats, qui porteront à jamais le traumatisme de ce cataclysme. The Guardian décrit des scènes d’horreur absolue, où des bouts de bras d’enfants de six ans jouxtent des morceaux de cartables roses.

(…)

Ni Israël ni les États-Unis n’ont nié le crime, simplement qualifié de “tragédie, si avérée” par le ministre des affaires étrangères américain Marco Rubio. Une ancienne caserne des gardiens de la révolution iranienne se trouvait à proximité, mais n’est plus en service depuis une dizaine d’années. L’explication la plus généreuse consiste à supposer que la cible, choisie sur la base d’informations périmées, était cette ancienne base.

Depuis, le New York Times a attribué la responsabilité du massacre à l’armée américaine, qui a frappé l’école à deux reprises en moins d’une heure, aggravant dramatiquement le bilan initial et tuant une partie des premiers secouristes1.

Quel est le rapport avec l’IA et les Big Tech, me direz-vous ? Peut-être aucun. Mais en lisant les articles traitant de cette tragédie, je n’ai pas pu m’empêcher de faire le lien avec d’autres informations fuitées par le Pentagone à propos de l’usage de l’IA. Les États-Unis se vantent d’avoir été en mesure de frapper aussi rapidement des centaines de cibles grâce à un recours massif à l’Intelligence artificielle.

Les programmes conçus à partir des principes de “deep learning” et intégrés à de grands modèles de langage type GPT-5 permettent de traiter de grandes quantités de données et de réaliser des interpolations en vue de corréler certaines informations pour suggérer des listes de cibles à bombarder.

À Gaza, l’IA a été massivement employée par Israël pour sélectionner des cibles, en recoupant des masses d’informations incomplètes, avec un taux d’erreur de 10 % environ.

Comme le rapporte The Guardian, l’usage de l’IA compresse le temps d’analyse et de décision et permet de déterminer où bombarder “plus vite que la pensée humaine”. La “chaine de décision” (identification d’une cible suite au recoupement d’informations, évaluation de sa valeur stratégique, des risques de dommages collatéraux, de la légalité du bombardement, attribution des coordonnées, choix de l’armement et de l’unité qui sera chargée de mener la frappe, validation finale de la décision, etc.) est exécutée infiniment plus rapidement. Comme l’expliquent les experts cités par le Guardian “ces systèmes produisent plus d’options de cibles et plus rapidement”. Le risque évident est de commettre de nombreuses erreurs en plaçant une trop grande confiance dans l’aptitude des programmes d’IA à identifier les cibles légitimes ou militaires sans commettre d’erreurs. À Gaza, Israël avait estimé que ses outils se trompaient une fois sur dix, tout en considérant qu’il s’agissait d’un taux d’erreur acceptable. Qu’en est-il des seuils de tolérance américains ?

Le second problème découle de l’impact de cet usage sur les décideurs humains. Confrontés à un plus grand choix de cibles et mis sous pression pour valider plus rapidement ces dernières, ils seraient davantage susceptibles de commettre des erreurs.

Le massacre des écolières de Minab pourrait résulter d’une attribution erronée de la cible par une IA agrégeant des informations périmées et dont la recommandation n’avait pas fait l’objet d’une vérification suffisamment poussée par un humain. Il se peut également que le bombardement ait été réalisé sciemment, pour tester la réaction des médias occidentaux et de l’opinion publique face à ce massacre (dans ce cas, la réponse est claire : les médias et décideurs occidentaux ont pratiquement ignoré ce crime de masse, en particulier quand cela comptait le plus, au début du conflit). On peut également imaginer que l’IA se soit simplement trompée de coordonnées, que l’erreur d’attribution de la cible fut commise par un humain. Mais si on évacue l’hypothèse d’un massacre intentionnel, les chances pour que l’emploi de l’IA dans la sélection des cibles à bombarder soit responsable de cette tragédie semblent très élevées.

En effet, les États-Unis communiquent amplement sur l’emploi de leur système “Maven”, concu par la société de Peter Thiel Palantir et propulsé par l’IA d’Anthropic. On lui attribue le “succès” des bombardements qui ont permis de frapper plus de milles cibles dans les premières 48 heures de l’attaque. Cette utilisation massive de l’IA s’inscrit dans une tendance particulièrement inquiétante, qui ne fait pas l’unanimité au sein des employés de la Silicon Valley.

Anthropic vs Pentagone

Dans les jours qui ont précédé l’agression américaine non provoquée contre l’Iran, une polémique a secoué la Silicon Valley.

Depuis que le ministère de la Défense américain (rebaptisé ministère de la Guerre) souhaite intégrer directement les modèles d’IA générative au cœur de ses systèmes d’armement, sans exclure la prise de décisions létales sans intervention humaine, des voix se sont insurgées contre cette option inconsidérée. Dont Anthropic, le principal concurrent d’OpenAI, qui commercialise les modèles de langage “Claude”.

La firme californienne a mis son véto à l’utilisation de ses outils pour “conduire une surveillance de masse des Américains ou automatiser entièrement des systèmes d’armement” susceptibles de déployer une force létale sans l’intervention d’un être humain dans le processus décisionnel. Trump et son administration se sont révoltés contre cette exigence, menaçant Anthropic de résilier tous ses contrats militaires. Un bras de fer s’en est suivi, en partie justifié par la sortie d’un article devenu viral.

L’IA, générative d’Hiver nucléaire ?

Le journal “New Scientist” a publié un reportage décrivant des tests effectués par des chercheurs en IA à partir des modèles de langage de Google, Anthropic et OpenAI. Le but des chercheurs était de voir si les IA, chargées de prendre des décisions militaires et diplomatiques dans le cadre de simulations de conflits (“war games”), auraient recours à l’arme nucléaire. Le résultat a permis de produire de gros titres alarmistes :

“Dans 95 % des cas, l’IA a recours à l’arme nucléaire”

Bien sûr, ce genre de résultat n’est pas nouveau et ne dit pas grand-chose au sujet de l’IA. Cette dernière ne semble pas consciente du fait que le recours à l’arme nucléaire tactique reste largement un tabou moral et éthique. Ni ne semble mesurer le fait qu’un emploi stratégique de l’arme nucléaire provoquerait un “hiver nucléaire” apocalyptique, même si l’adversaire n’est plus en mesure de répliquer suite à l’attaque nucléaire initiale. Ce n’est pas parce que l’IA est immorale (elle l’est), mais simplement parce qu’elle a été programmée d’une manière qui l’a conduite à ce genre de conclusion. En particulier dans le cadre d’une simulation n’ayant pas suffisamment défini les conséquences d’une guerre atomique.

On pourrait même estimer que cet état de fait reflète assez bien le type de décisions que seraient capables de prendre les dirigeants américains actuels.

Néanmoins, le fait que l’IA ne soit pas intrinsèquement responsable de son usage systématique de l’arme nucléaire dans les simulations ne permet pas d’ignorer le problème sous-jacent. Les études de ce genre confirment le fait que la manière dont sont programmées les IA les plus avancées pose un risque civilisationnel en cas d’intégration trop poussée dans la chaine de commandement militaire.

Certes, les chances de voir le feu nucléaire confié à une IA restent faibles à court et moyen terme, malgré le fanatisme et l’hubris démontrés par le “ministre de la Guerre” de Trump, l’ancien présentateur de FoxNews Peter Hegseth. Mais le simple recours à l’IA par les décideurs militaires en situation de crise pourrait accroitre le risque qu’ils prennent des décisions inconsidérées, par foi aveugle dans un outil mal configuré ou en conséquence de l’influence négative de ce dernier.

Anthropic vs OpenAI

Dans ce contexte, Anthropic a certainement eu raison de tenir tête au Pentagone. Non seulement pour des questions morales et éthiques, mais également du point de vue de son intérêt commercial. Apparaitre comme l’IA responsable alors qu’OpenAI signe un accord avec Trump semble un calcul financièrement cohérent.

Rappelons que l’IA générative est un secteur non rentable, qui accumule les pertes financières pour des raisons structurelles, que nous avions détaillées précédemment.

En se positionnant comme un acteur responsable, Anthropic peut prendre des parts de marché à OpenAI sur le segment grand public, améliorer son image auprès des entreprises et attirer plus facilement les employés les plus talentueux dans ses laboratoires de recherche.

Mais la posture d’Anthropic doit être analysée comme de l’opportunisme. La société travail depuis longtemps avec l’armée américaine, en dépit des prétendues inquiétudes de sa direction. Le PDG Dario Amodei abreuve fréquemment la presse de prédictions et déclarations apocalyptiques au sujet de l’IA, tout en refusant d’en tirer les conséquences logiques (arrêter de produire ces IA, ne pas collaborer avec l’armée et militer pour une autre approche industrielle vis-à-vis de ces systèmes, par exemple).

Ironiquement, le clash d’Amodei avec l’administration Trump semble avoir conduit cette dernière à se venger d’Anthropic en fuitant à la presse des informations particulièrement détaillées sur l’implication des programmes basés sur Claude et utilisés pour planifier et gérer l’attaque américaine contre l’Iran. La rupture n’étant pas immédiate, le Pentagone avait vraisemblablement le droit de continuer à se servir des outils d’Anthropic, bien que le timing de la dispute, survenue quelques jours avant l’entrée en guerre des États-Unis, explique probablement pourquoi ce bras de fer semblait se dérouler de manière précipitée.

À l’arrivée, Anthropic se retrouve perdant des deux côtés : la firme risque d’être privée de ses contrats avec le ministère de la Défense, tout en voyant sa réputation endommagée par son implication dans les massacres en cours en Iran.

C’est peut-être pour tenter de sauver ses billes que la start-up a tenté un rétropédalage en publiant un communiqué qui semble avoir été écrit sous la menace d’un preneur d’otage. On peut y lire qu’Anthropic, accusé par l’administration Trump de mettre en danger les vies des soldats américains en plein conflit armé, est “particulièrement fier d’aider les combattants en première ligne avec nos outils”. Amodei insiste sur le fait qu’Anthropic “a bien plus en commun avec le ministère de la guerre qu’il n’a de désaccords” . Autrement dit, Anthropic assume pleinement de fournir des armes à un gouvernement qui commet des crimes de guerre et compte continuer “aussi longtemps que possible ou nécessaire” cette collaboration. Ceux qui s’imaginaient qu’il y avait de bonnes et de mauvaises entreprises d’IA en seront pour leurs frais.

Au-delà de l’IA, Big Tech vs Low Tech ?

Comme je l’écrivais dans mon article sur la guerre contre l’Iran, le conflit nourrit les intérêts de la Silicon Valley. Il pourrait affaiblir la Chine, notamment en réduisant au silence son allié iranien tout en mettant en péril son approvisionnement en pétrole. Mais cette guerre est aussi le théâtre d’un déploiement accru de technologies.

Côté iranien, on voit à quel point l’approche “low tech” reposant sur des drones bon marché et des missiles à longue portée permet de perturber significativement l’économie et la stabilité d’une région entière du monde. Ce qui risque de pousser de nombreux acteurs à investir dans des systèmes de défense susceptibles de contrer ce nouveau type de menaces. Le fait que des États en crise économique permanente et sous embargo depuis des années puissent développer des systèmes capables de menacer l’économie mondiale et de conduire des frappes de grandes précisions contre des chambres d’hôtel, bâtiments de la CIA et infrastructures militaires montre également le danger représenté par la guerre asymétrique.

Côté israélo-américain, on assiste à un nouvel éventail de prouesses technologiques, notamment en termes de renseignement et de guerre cybernétique.

On a ainsi appris que l’assassinat de Khamenei et de nombreux dirigeants civils iraniens dans l’opération initiale visant à décapiter le régime avait été rendu possible par la collecte d’une quantité délirante d’informations, analysées en temps réel par des systèmes intégrant des programmes d’IA dernier cri. Entre autres, Israël avait piraté le système de vidéo surveillance de la sécurité routière de Téhéran et utilisé l’IA pour traquer les allées et venues des gardes et employés des dirigeants iraniens.

Le piratage de systèmes civils à des fins militaires, dans le but de commettre des crimes de guerre, ne semble pas poser problème aux médias et observateurs occidentaux. La normalisation de telles pratiques, devenues fréquentes, pointe le risque posé par le déploiement de ces technologies de vidéosurveillance sur les populations que ces systèmes sont censés protéger.

Parier en ligne sur la fin du monde

Notre passage en revue des aspects technologiques du massacre en cours en Iran et au Liban ne saurait être complet sans la mention d’un nouveau phénomène inquiétant. L’émergence d’une industrie du pari en ligne via les plateformes non régulées comme Polymarket et Kalshi fait peser un nouveau risque géopolitique et sécuritaire. Il est désormais possible de miser sur la détonation d’une arme nucléaire d’ici une certaine date ou de parier sur le bombardement de personnalités ou infrastructures spécifiques. Or, une partie des cadres de la Maison-Blanche impliqués dans ce genre de décisions sont des habitués de ce genre de sites, donc potentiellement susceptibles de commettre des délits d’initiés en étant incités à prendre des décisions faisant l’objet de paris en ligne. On a ainsi répertorié des paris suspects placés quelques heures avant l’enlèvement de Maduro ou l’assassinat de Khamenei.

Le lien avec la Silicon Valley est bien plus sérieux qu’on pourrait l’imaginer. Ces sites utilisent les cryptomonnaies comme moyen de paiement et autorisent l’anonymat des parieurs. Suite à la dépression du secteur des cryptomonnaies, de nombreux acteurs de cette industrie se tournent vers le secteur des paris en ligne non régulés. Les investissements ne se limitent vraisemblablement pas à prendre des parts dans ces entreprises et à financer des campagnes de publicité, mais prennent également la forme de campagne de lobbying pour empêcher les régulateurs d’encadrer ce business particulièrement lucratif.

Et tant pis si cela encourage un responsable à déclencher une frappe nucléaire suite à la recommandation d’une IA mal “alignée”.

Une semaine plus tard, le Croissant Rouge avait identifié une dizaine d’autres écoles frappées par Israël et les États-Unis et un nombre équivalent de cliniques et hôpitaux, des gymnases et stades, aéroports civils et usines de production d’eau potable et infrastructures pétrolières…

13.02.2026 à 07:25

La Silicon Valley noyée dans l'affaire Epstein

Christophe @PoliticoboyTX

Texte intégral (7322 mots)

Bonjour à tous ! Ce début d’année est pour le moins sombre et agité, ce qui rend l’écriture d’autant plus difficile qu’il existe de nombreux sujets d’actualité méritant un éclairage technocritique.

L’attaque sanglante des États-Unis contre le Vénézuéla, suivie de la tentative d’annexion du Groenland et la présentation d’un “master plan” au forum de Davos pour transformer Gaza en une “riviera” sans les Palestiniens peuvent s’analyser sous le prisme du projet de network state des technofascistes gravitant autour de Trump. De même, les meurtres commis par la police de l’immigration américaine (ICE) impliquent les géants de la Tech à de multiples niveaux. Pendant que Google, Apple, Facebook et le nouveau TikTok censurent les opposants à ses rafles et combattent les initiatives citoyennes de défense civile, Palantir fournit l’infrastructure de surveillance numérique permettant d’organiser les raids. Malgré les erreurs tragiques commises par ces systèmes, la ICE veut utiliser les données commerciales collectées par les géants du numérique pour traquer les individus qu’elle souhaite interpeler. Autrement dit, la dystopie redoutée par ceux qui critiquent la collecte des données personnelles est déjà là.

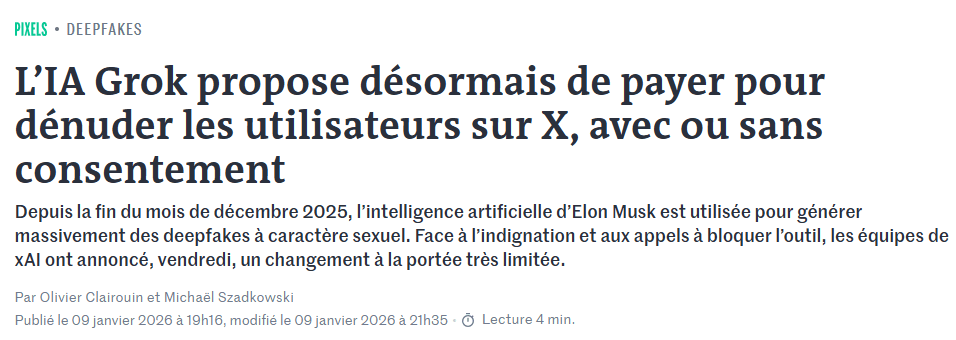

Il serait également intéressant de revenir sur les récentes annonces autour de la bulle de l’IA. Le fait qu’OpenAI cherche à nouveau des investisseurs et assume l’arrivée de l’érotisme et de la publicité sur ChatGPT témoigne des difficultés de l’entreprise à construire un modèle économique rentable, alors qu’un nombre croissant de leaders du secteur admettent publiquement que l’approche suivie pour développer les IA génératives ne permettra pas de mettre au point des IA “générales” ou super-humaines. Le rachat de xAI, autre entreprise qui perd des sommes record, par SpaceX, société dont Musk prépare l’entrée en bourse en dépit d’un modèle économique tout aussi questionnable, semble masquer une tentative désespérée d’injection de cash dans xAI. À ce propos, les délires sur la mise en orbite de data centers constituent un nouvel exemple de Fake Tech destinée à justifier la poursuite du développement inconsidéré des data centers ici, tout en permettant d’exciter les investisseurs avant l’introduction en bourse de SpaceX. Musk apparait plus que jamais embarqué dans la construction d’une gigantesque pyramide de Ponzi reposant sur la hype pour gonfler artificiellement les cours boursiers dont dépendent sa fortune et son pouvoir.

Enfin, la loi visant à interdire les réseaux sociaux aux mineurs de moins de 15 ans en France mériterait d’être abordée. Pour ma part, je serais favorable à la socialisation de ses plateformes, qui deviendraient la propriété des usagers et employés, et seraient gérées sur le principe des communs ou de coopératives à but non lucratif. Vu qu’on en est loin, l’interdiction pure et simple (à tout le monde, pour le coup) me parait défendable. Je ne suis pas convaincu par les arguments selon lesquels les avantages des réseaux sociaux (espace de liberté, source de diffusion d’information pour les médias indépendants, outil de mobilisation pour les luttes et les révolutions, outil de lien social) dépasseraient les inconvénients (plateformes dans les mains de milliardaires fascistes qui cherchent à nous rendre addicted pour voler nos données afin de mieux nous cibler avec de la publicité et permettre aux gouvernements de poursuivre leurs opposants ; problèmes sociaux, mentaux et psychologiques chez les enfants et les adultes; empreinte écologique, etc.). Des travaux ont démontré que les réseaux sociaux ont un impact négatif sur les mouvements contestataires et les révolutions. Si certains débutent via les RS, ou prennent de l’ampleur grâce à eux, ils sont également fréquemment affaiblis ou déjoués grâce aux réseaux sociaux par les gouvernements. L’autre faiblesse des mouvements spontanés partant des réseaux sociaux tient dans leur manque de structuration, ce qui les rend faciles à dégonfler une fois le choc initial passé.

Or, comme le rappelait très bien la patronne de la messagerie chiffrée Signal (société à but non lucratif) dans les matins de France Culture, les entreprises capitalistes ont une obligation légale de servir les intérêts financiers de leurs actionnaires, pas de s’opposer aux gouvernements autoritaires. Mais si l’interdiction totale des réseaux sociaux est inenvisageable (à part certains comme X, lorsqu’ils se transforment en machine à produire des contenus pédophiles), les interdire aux enfants pourrait sembler une bonne idée. Le problème tient dans les moyens mis en œuvre pour y parvenir : la proposition de loi française implique la fin de l’anonymat sur internet et la collecte de nos informations (pièce d’identité, images pour reconnaissance faciale, etc.) par des entreprises privées fréquemment sujettes à des fuites de données. Tout en n’empêchant pas les multiples moyens de contournements possibles. À ce titre, je vous renvoie à la série de notre camarade Huber Guillaud, ainsi qu’à l’article des amis de Frustration Magazine.

Bref, ce ne sont pas les sujets à traiter qui manquent, comme le montre le dernier numéro de l’excellente newsletter Synth. C’est pourquoi j’ai choisi de me concentrer sur un autre dossier dont vous avez surement entendu parler : l’affaire Epstein.

Les 3.5 millions de pages récemment publiées contiennent une densité d’information si vaste que le sujet mériterait une série d’articles. Pour éviter de trop m’écarter du thème de cette newsletter, je vous propose un résumé des enseignements de l’affaire, avant de creuser les liens entre Epstein et la Silicon Valley. Non content d’être un instrument du Mossad et un allié du trumpisme, le pédocriminel était un technofasciste pur souche, comme nous allons le voir.

1. Ce qu’il faut retenir de l’affaire Epstein

Si vous ne connaissez pas l’affaire Epstein, je vous suggère de lire mon dernier article pour le média Frustration. En résumé :

Jeffrey Epstein était un homme d’affaires américain au patrimoine estimé à plus de 500 millions de dollars. Sa fortune a majoritairement été obtenue illégalement, en arnaquant ses propres clients via des pyramides de Ponzi et vols purs et simples. Il a été retrouvé mort dans sa cellule quatre semaines après son inculpation pour trafic de mineurs. Il était suspecté d’avoir organisé un réseau pédophile d’esclaves sexuelles dont il faisait profiter une partie de son très large cercle de fréquentation. Epstein disposait de caméras dans ses résidences, ce qui laisse croire qu’il détenait des vidéos compromettantes. Le FBI a identifié plus de 1000 victimes, dont un grand nombre de mineurs. Il serait question de filles de 12 à 17 ans, de viols, sévices, séquestrations, menace de mort et harcèlement de témoins, voire de meurtre. Epstein a été condamné une première fois en 2008, mais avait passé un accord secret avec le procureur général pour plaider coupable de fait mineurs qui lui valurent une courte peine de prison aménagée. En 2018, le Miami Herald publie une enquête édifiante et un juge fédéral nullifie l’accord de plaider coupable, qui enfreignait le droit des victimes. L’affaire devient éminemment politique, du fait des potentiels complices et clients d’Epstein et des liens de ce dernier avec Bill Clinton et Donald Trump. Ironiquement, c’est l’instrumentalisation de l’affaire par les soutiens et militants de Trump qui a fini par contraindre ce dernier à accepter de rendre le dossier de l’enquête du FBI public. Plus exactement, les démocrates ont présenté une loi au Congrès, voté à contrecœur par les républicains, pour forcer le ministère de la Justice à publier ces documents.

Que retenir des millions de pages rendues publiques ? Sur la forme d’abord, je tiens à noter :

Tous les documents du dossier Epstein n’ont pas encore été publiés. Entre autres, les vidéos et photos les plus crues n’ont pas été rendues publiques, en théorie pour protéger les victimes.

Les documents publiés ont été caviardés par le ministère de la Justice de Trump, mais au lieu de noircir certains passages pour protéger les victimes (comme l’exigeait la loi votée au Congrès en octobre), ce sont souvent les complices et criminels potentiels qui ont été protégés.

Ces documents n’auraient jamais dû être rendus publics. Il a fallu l’incompétence de Trump et les obsessions de ses alliés pour provoquer la situation rendant politiquement impossible au Parti républicain de bloquer leur publication.

Le FBI et le ministère de la Justice américaine ont, depuis 1996, protégé Epstein et ses fréquentations au lieu de protéger les victimes et la société. Et ce, quel que soit le parti au pouvoir.

Le fait que l’administration Biden n’ait pas elle-même rendu public ce dossier en dit long sur l’incompétence politique du parti démocrate (ou sa propre corruption, préférant éviter d’embarrasser des alliés que de vaincre le trumpisme).

Les médias français et américains tentent majoritairement de minimiser l’affaire, lorsqu’ils ne se plaignent pas du “poison complotiste” distillé par la publication”brute” des documents.

Cela étant posé, que retenir du contenu des dossiers ?

Epstein n’a pas agi seul, il y a au moins 10 complices identifiés par le FBI.

Epstein faisait bien profiter une partie de ses contacts des filles qu’il séquestrait pour les abuser sexuellement, si on en croit sa correspondance.

Les crimes pédophiles semblent bien plus graves que précédemment imaginés. Certains enfants seraient morts des suites de sévices sexuels, à en croire certains éléments contenus dans le dossier.

Au-delà de la pédocriminalité, Epstein agissait comme intermédiaire dans de nombreux cercles politiques et milieux d’affaires, aidant à organiser des négociations et tractations en mettant en contact certaines personnes ou en organisant des rencontres, versements, faveurs et renvois d’ascenseur.

Epstein était un agent secret d’Israël (ou, au minimum, un informateur et allié).

Il s’était rapproché de Steve Bannon, l’éminence grise du mouvement MAGA pro-Trump.

Trump avait des liens bien plus étroits et fréquents avec Epstein que précédemment rapportés par la presse.

Des dirigeants français sont impliqués dans le dossier Epstein, dont Jack Lang et, potentiellement, Bruno Lemaire, BHL et des collaborateurs d’Emmanuel Macron et de Nicolas Sarkozy.

En résumé, on retiendra tout d’abord la spectaculaire tolérance de la classe bourgeoise dominante pour les violences et crimes sexuels. Après 2008, toutes les personnes fréquentant Epstein étaient nécessairement au courant des accusations portées contre lui. Certains ont continué à le fréquenter, y compris après 2018 et les révélations explosives de la presse.

Ensuite, le fonctionnement de cette classe, qui a produit la monstruosité Epstein puis l’a utilisée aussi bien pour son plaisir que pour les affaires. Tous les bords politiques sont touchés. Les fichiers font état d’une véritable mafia fonctionnant sur le principe de renvoi d’ascenseurs dans l’unique but d’acquérir plus de richesse et de pouvoir personnel.

Le fait qu’Epstein disposait de caméras dans toutes les pièces de ses résidences et qu’il entretenait des liens étroits avec les services secrets israéliens agite le spectre d’une compromission de Trump. Ce dernier serait susceptible de faire l’objet de chantage, à en croire la presse indépendante américaine. Les fichiers révèlent de nombreux comportements illégaux (vente de secrets d’affaires ou d’État, partage d’informations sensibles, tentatives d’ingérence dans des élections, de déstabilisation d’institutions démocratiques…). Mais pour des raisons évidentes, les questions de ce genre ne sont pas reprises par les grands médias états-uniens. Fin novembre, le New York Times titrait “Les emails d’Epstein révèlent une élite d’une autre époque” en expliquant sérieusement “le financier évoluait dans des cercles qui n’existent plus”. Le journal Le Monde parlait, lui, de “poison” à propos des révélations, pas de leur contenu. Sur FranceInter, la journaliste Sonia Devilers a carrément fait le procès de Fabrice Arfi (Médiapart), l’accusant d’attiser le complotisme en s’intéressant à l’affaire Epstein. À croire que la presse bourgeoise n’aime pas que l’on étale sur la place publique les crimes de ses plus célèbres représentants.

Voilà pour le survol de l’affaire. Je vous recommande notre article coécrit avec Nicolas Framont pour explorer les liens et compromissions spécifiques à la France. Et pour la Silicon Valley et les aspects proprement technofascistes du projet Epstein, ça se passe ici :

2. Epstein et les géants de la Tech : liaisons dangereuses

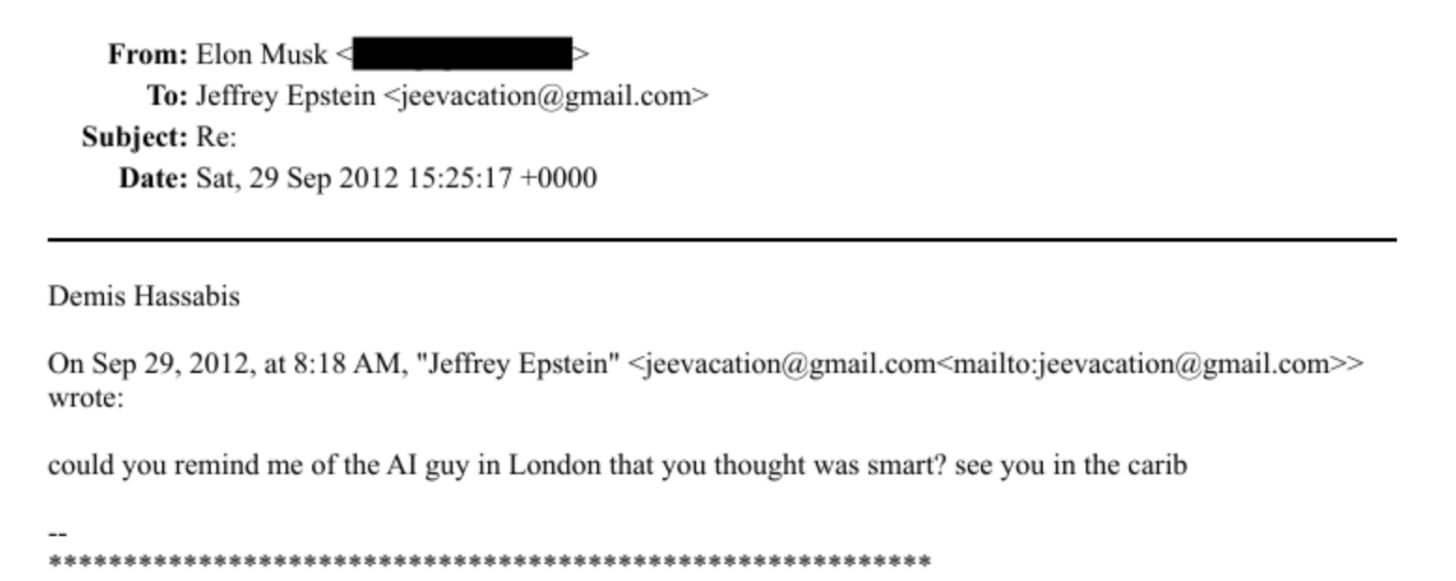

La plupart des grands noms de la Tech sont cités dans le dossier Epstein. Certains semblaient étroitement liés au pédocriminel, comme Bill Gates (son ex-femme a confirmé que ses liens ont joué dans son divorce). D’autres se seraient retrouvés sur son ile, dans une de ses résidences, ont participé à des diners en sa présence ou échangeaient par courriel avec lui. Y compris après sa première condamnation de 2008. C’est le cas des cofondateurs de Google Larry Page et Sergey Brin, du PDG de Meta Marc Zuckerberg, de Jeff Bezos, du patron de LinkedIn Reid Hoffman et d’Elon Musk.

Ce dernier voit sa réputation de nouveau abimée par le dossier Epstein. Les courriels rendus publics contiennent des échanges où il tente de s’inviter chez le pédocriminel en demandant quelles dates lui garantiraient les soirées les plus “déjantées”. Ces discussions n’auraient pas abouti à des rencontres, mais ne montrent pas Musk sous son meilleur jour. Il est également question de la venue d’Epstein aux bureaux de SpaceX et de filles présentées par Epstein à son frère et partenaire en affaire Kimbal Musk, entre autres messages peu reluisants.

Les liens entre patrons de la Tech et Epstein sont anciens. Le pédophile finançait le EDGE, un réseau de discussion et d’échange informel entre gros patrons de la Tech, piloté par le MediaLab du MIT. Dès 1999, il participe aux diners annuels du EDGE, ou se rend la plupart des fondateurs des GAFAM (cf. l’excellente série d’articles de Byline Times). Via ce véhicule, Epstein se rapproche de la Silicon Valley et finance diverses start up. Sa condamnation de 2008 ne le coupe pas de cet univers, au contraire. En 2011, les grands noms de la Tech sont de nouveau présents à un diner annuel du EDGE où figure le trafiquant d’être humain. Ils participent également à la mailing liste du groupe, dont Epstein devient le principal financier, avec des dons dépassant les 600 000 dollars (soit plus de 80% du budget total de ce réseau).

Epstein va également financer d’autres forums et initiatives, dont le MediaLab du MIT, un groupe de recherche de Harvard, et plusieurs organisations créées par des chercheurs proches de la Tech, à hauteur de centaines de milliers de dollars via des dons philanthropiques.

3. Technofascisme à la sauce Epstein

Epstein a-t-il participé à la radicalisation de la Tech ou bien s’est-il simplement trouvé en adéquation avec cet univers ? Via le EDGE, le pédocriminel rencontre divers individus proférant des vues associées au courant technofasciste. Dont le fameux Nick Bostrom.

Ce philosophe transhumaniste est considéré comme le père du Long termisme, une idéologie qui stipule qu’il peut être acceptable de sacrifier 1 milliard d’êtres humains maintenant pour permettre à des milliards de milliards d’êtres humains d’exister dans des ordinateurs dérivant dans l’Espace d’ici quelques millénaires. Bolstrom avait partagé des vues profondément racistes dans un courriel datant des années 1990. Il rejoint le EDGE en 2009. En 2018, il crée sa fondation transhumaniste human+, qu’Esptein finance à hauteur de 120 000 dollars la première année. De quoi payer le salaire du vice-président Ben Goertzel, un spécialiste de l’IA qui a joué un rôle important dans la définition du terme “AGI” (IA générale) et de la promotion de la quête de la singularité (création d’une IA supra-humaine toute puissante).

Le pédocriminel a également entretenu des liens particulièrement étroits avec Joscha Bach. Philosophe et théoricien de l’IA, professeur à Harvard et au MIT. Ce penseur, particulièrement influent dans le milieu de la recherche en intelligence artificielle, estimait que l’épuration ethnique par la crise climatique était “peut-être un mal nécessaire”. Comme le confirme une chaine de courriels échangés avec Epstein, Bach entretenait des vues eugénistes, racistes et sexistes. Pour lui, les noirs sont génétiquement inférieurs aux blancs sur le plan intellectuel, tout comme les femmes, du fait de l’évolution. Des idées démenties par la science, mais communément admises au sein de la Silicon Valley. Epstein n’aurait pas été étranger à leur diffusion, puisqu’il a financé leurs principaux théoriciens.

Lui-même témoignait d’un racisme et d’un sexisme qui se reflète jusque dans ses propres crimes. Or, le pédocriminel agissait activement pour façonner le monde en fonction de cette vision. Que ce soit en finançant l’armée d’occupation israélienne, en servant d’agent au Mossad, en traitant avec la Russie, en finançant les colonies israéliennes illégales ou, plus discrètement, en œuvrant à la création d’une internationale fasciste par le prisme de la technologie.

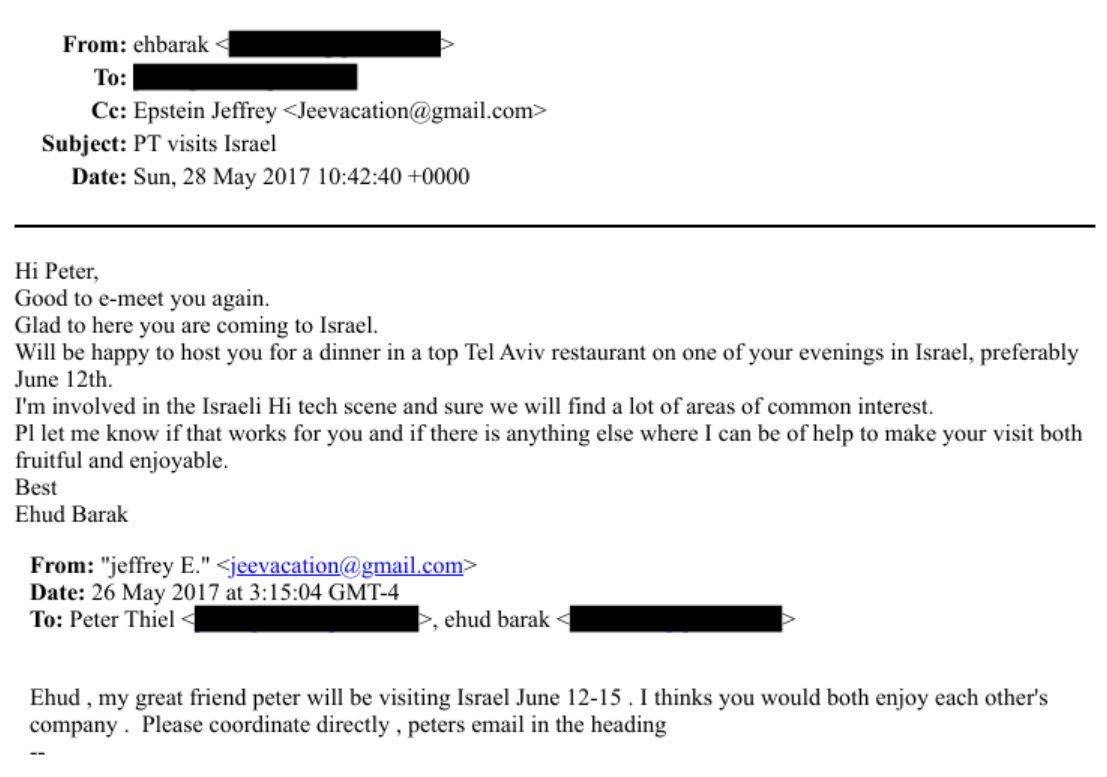

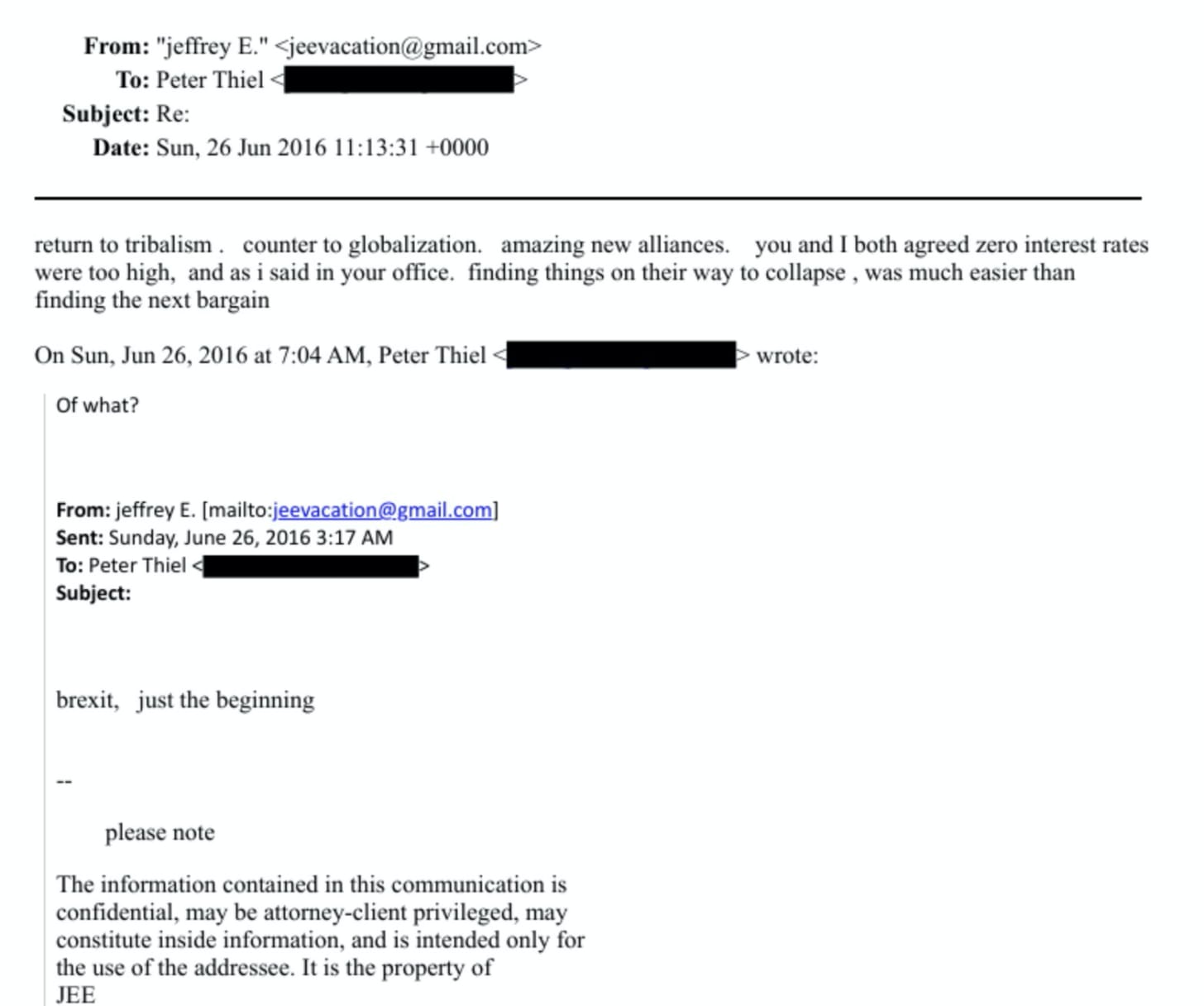

Peter Thiel, le patron de Palantir et capital-risqueur ultra-influant, occupe une place à part dans le dossier Epstein. Il semble échanger fréquemment avec le pédocriminel, en particulier autour des années 2014-2016. Epstein a investi dans un de ses fonds en capital-risque à hauteur de 40 millions de dollars et a joué un rôle déterminant dans l’adoption des logiciels de surveillance et de répression de Palantir par divers gouvernements et institutions, dont Israël et certains alliés de l’état hébreu.

Les liens ne sont pas uniquement financiers. Dans un mail à Thiel, Epstein semble se vanter de son rôle dans le Brexit et expose ses projets de renversement de l’ordre mondial néolibéral fondé sur la démocratie, la mondialisation et le droit international :

Pour Epstein, l’effondrement des démocraties et l’apparition de “failed states” à la place de dictatures clientes des USA est une opportunité pour faire des affaires. Et la lecture du dossier Epstein suggère qu’il déployait toute son influence vers ce but. Ce qui explique son rapprochement avec Steve Bannon, Peter Thiel et le mouvement “MAGA”.

Le projet décrit par Epstein ressemble à s’y méprendre à celui des technofascistes libertariens dont Peter Thiel constitue le représentant le plus connu. Comme maintes fois documenté, ce courant souhaite provoquer l’effondrement des démocraties libérales et affaiblir l’État pour permettre l’émergence d’un network state. Ces cités-États indépendantes et autonomes, gérées par des Roi-PDG élus par des actionnaires-citoyens sur le principe “un dollar égal une voix”.

4. Esptein, le bitcoin, 4chan et l’internationale fasciste

Epstein était un grand utilisateur et promoteur des cryptomonnaies, à la fois comme outil pour ses crimes et comme projet politique s’inscrivant dans sa vision d’un monde post-démocratique, comme le rapporte le journaliste Ryan Broderick. Pour le pédocriminel, le Bitcoin représentait un outil de subversion de la finance globalisée au service des élites.

Les courriels révèlent ainsi qu’Epstein a joué un rôle significatif dans le sauvetage du Bitcoin, en 2015, lorsque le protocole était menacé par des conflits au sein de l’équipe de programmeurs en charge du maintien du code source. L’argent et le réseau du pédocriminel ont permis à la cryptomonnaie de s’épanouir, tout en infiltrant les cercles de pouvoir et les institutions financières.

Epstein entretenait également des liens étroits avec Brock Pierce, cofondateur du Tether, un stablecoin (crypto-actif dont la valeur est adossée au dollar) qui sert de liquidité dans la sphère financière des cryptos. Epstein avait profité de ses liens pour investir tôt dans la plateforme de courtage en ligne Coinbase, à hauteur d’un million de dollars.

Plus effrayant, Epstein aurait également joué un rôle non négligeable dans la constitution d’une forme d’internationale fasciste. Non seulement par ses tentatives (réelles ou fantasmées) d’ingérence électorale et de soutien aux politiciens d’extrême droite européens, mais, également en participant aux efforts de radicalisation d’une génération de jeunes hommes via les forums en ligne, le jeu vidéo et la subculture procryptomonnaies. En particulier, il semblerait qu’Epstein soit lié à la mutation du forum de discussion 4chan, devenu la plaque tournante du complotisme d’extrême droite, de l’activisme et du masculinisme fascisant. Epstein a déployé des efforts importants pour rencontrer le gérant du site, qui aurait rouvert la partie du forum dédié à la politique suite à sa rencontre avec Epstein, et ainsi permis la radicalisation du forum. C’est là qu’a pris corps la théorie complotiste et véritable mouvement politique Qanon. Ironiquement, ce mouvement prétendant que le monde était dominé par une cabale de pédophiles satanistes affiliés au parti démocrate a été alimenté par l’affaire Epstein.

Or, QAnon a servi de carburant au saccage du Capitole et à la tentative de coup d’État de Donald Trump, comme en témoigne la photo du fameux “Chaman QAnon” hurlant depuis le Congrès des États-Unis suite à l’interruption de la procédure de certification des élections.

Il est tout à fait possible que Jeffrey Epstein n’ait joué aucun rôle significatif dans l’émergence de ces mouvances d’extrême droite, bien qu’il semble avoir financé divers influenceurs (y comprit un Youtubeur francophone) et a certainement essayé de peser sur ces tendances. Quelle que soit la portée de son ingérence, on ne peut que constater les liens étroits qui existent entre ses propres desseins et ceux des élites de la Tech.

Epstein partageait les vues eugénistes et racistes repeintes au sein de la Silicon Valley. Lui-même parlait de se cloner et de répandre son ADN en enfantant une progéniture à l’aide de mères porteuses. Des ressemblances troublantes avec un certain Elon Musk…

Sa correspondance lugubre ne se limite pas à des délires couchés sur courrier électronique. Comme l’a retracé le site d’investigation Dropsite.news, Epstein a également déployé des efforts considérables pour mettre en relation diverses équipes de recherche spécialisées dans le décodage du génome et les thérapies géniques, tout en essayant de recruter des spécialistes de la cryptographie et du hacking liés à diverses agences de renseignement. Le tout dans le but de les mettre en relation pour craquer le code génétique à des fins eugénistes et transhumanistes, en écho aux obsessions des barons de la Silicon Valley…

Quels que fussent les effets de ses efforts, une chose reste certaine. Les élites de la Tech n’ont pas rejeté Epstein. Elles ont entretenu avec lui des liens aussi étroits que “naturels”. Et ce, malgré les crimes épouvantables pour lesquels il avait déjà été inculpé.

16.01.2026 à 09:49

Le Grok Paradoxe

Christophe @PoliticoboyTX

Texte intégral (4374 mots)

Grok est un néologisme inventé par l’auteur de science-fiction américain Robert Heinlen pour son roman “En terre étrangère”. Le livre raconte le retour sur Terre d’un humain ayant été élevé par les Martiens. Dans l’histoire, le terme “grok” est issu de la langue martienne. L’Oxford English Dictionary explique qu’il signifie « comprendre intuitivement ou par empathie, établir un rapport avec ».

Malgré sa consonance désagréable, Elon Musk a retenu ce terme pour nommer le chatbot produit par xAI, son entreprise d’Intelligence artificielle. Grok a été lancé comme un produit intégré au réseau social X (anciennement Twitter) et comme application séparée, destinée à concurrencer ChatGPT et les autres programmes d’IA générative. Comme pour ses concurrents, il existe différentes versions (gratuite, abonnement pro à 29.99 dollars/mois et “super heavy” à 299 dollars/ mois).

On peut comprendre pourquoi les ingénieurs de xAI ont suggéré ce nom à Musk. Le patron de Tesla aime la SF, est obsédé par Mars et possède un sens de l’humour “particulier”. De plus, les chatbots comme ChatGPT sont configurés pour “comprendre intuitivement” “établir un rapport avec” les utilisateurs et faire preuve d’empathie.

Grok : IA raciste, antisémite et toxique

Premier paradoxe : Grok n’est pas emphatique. Depuis son lancement, Musk a insisté pour que son IA soit plus permissive et moins “woke”. Cela peut se défendre si l’on part du principe que le “wokisme” est une idéologie dangereuse (un “virus” qui menacerait l’humanité, selon le patron de Tesla). Mais “woke” veut simplement dire “conscient des discriminations” et du caractère systémique de ces dernières. ChatGPT et ses concurrents ont été programmés pour être plus “woke” que le corpus de données utilisé pour les entrainer, précisément parce que sans cette couche supplémentaire de sécurité, GPT régurgitait fréquemment des horreurs racistes, antisémites, eugénistes, homophobes et sexistes.