23.06.2025 à 12:27

La voiture autonome : too fast, too furious ?

Christophe @PoliticoboyTX

Texte intégral (10644 mots)

Avec ce qui se passe au Moyen-Orient, écrire sur des sujets de niche comme la voiture autonome peut paraitre futile. Mais chacun fait ce qu’il peut là où il est. Et malgré les apparences, ces sujets ne sont pas totalement déconnectés. L’article qui suit est une mise à jour d’un chapitre écrit à l’état de brouillon pour mon projet de livre. Si ce dernier a du plomb dans l’aile, l’article est plus que jamais pertinent. Bonne lecture !

Fast an Furious

Le 7 mai 2016, la Tesla modèle S de Joshua Brown percute une semi-remorque à pleine vitesse sur une autoroute de Floride. Le véhicule passe sous la remorque du camion qui empruntait une intersection, décapitant le conducteur sur le coup. La fonction « autopilote » était engagée et Brown regardait un film d’Harry Potter au moment de l’impact. Fan de Tesla habitué à poster des vidéos sur les réseaux sociaux où il filmait les prouesses de son bolide, le quadragénaire constitue la première victime d’un accident de la route impliquant une voiture « autonome ».

Dans la nuit du dimanche 18 mars 2018, sur une avenue de Tempe en Arizona, un prototype testé par Uber percute une cycliste à 60 km/h. Raphaela Vasquez, l’employée chargée de surveiller le «robotaxi », effectuait le même circuit pour la 73e fois en quelques semaines. Elle regardait son téléphone dans les secondes précédant l’impact, qui a débouché sur le premier décès d’un cycliste causé par une voiture « sans pilote ».

Le 2 octobre 2023, à San Francisco, une jeune femme traversant un passage piéton est percutée par un véhicule. Le choc la déporte sur l’autre voie. Dans les secondes qui suivent, un robotaxi opéré par la société Cruise renverse à son tour la victime. Le véhicule sans conducteur s’arrête quelques secondes, puis redémarre et poursuit sur une distance de six mètres en trainant la piétonne sous son châssis avant de s’immobiliser en bordure de route, une roue sur la jambe de la jeune femme. Elle sera dégagée à l’aide de vérins hydrauliques et passera des semaines à l’hôpital en soin intensif.

À première vue, le seul point commun entre ces trois accidents vient du fait qu’ils impliquent des voitures « autonomes » dont le système de conduite n’est pas parvenu à identifier l’obstacle, qu’il s’agisse d’un semi-remorque blanc s’engageant dans une intersection par ciel gris et lumineux, d’un cycliste traversant à pied un boulevard de nuit ou d’une piétonne surgissant sur la voie. Les conséquences ont été radicalement différentes pour les entreprises impliquées.

Suite à l’accident de son prototype, la société Uber s’est retrouvée au milieu d’un scandale révélant ses pratiques inconsidérées. Elle a été contrainte de revendre sa filiale chargée de développer les voitures autonomes. Depuis, son programme de Robotaxi est au point mort. La société Cruise, une startup rachetée par General Motors en 2016, s’est vue interdite d’opérer sa flotte de quelques 600 robotaxis en Californie et a suspendu ses opérations dans les autres États américains. Depuis, elle a plus ou moins mis la clé sous la porte. À l’inverse, Tesla a minimisé l’affaire sans en tirer de leçon, au point qu’un accident similaire a causé la mort d’un autre conducteur en 2018, la victime s’encastrant dans un poids lourd. Plus récemment, Bloomberg a publié la vidéo d’un autre accident mortel où une Tesla éblouie par le coucher de soleil a fauché une grand mère descendue de sa voiture pour porter assistance à un début d’embouteillage résultant d’une collision entre deux véhicules.

Ces trois accidents majeurs s’ajoutent à des centaines d’autres collisions impliquant des systèmes de conduite autonome. Les autorités américaines attribuent ainsi 14 décès et plus de 467 accidents aux véhicules Tesla opérants avec l’autopilote entre 2017 et 2024, dénonçant un système “aux multiples lacunes”.

La société Waymo a suivi une approche plus prudente et conservatrice, du moins selon sa propre communication. Profitant du laxisme des autorités californiennes, cette filiale de Google a développé pas à pas un service de robotaxis convaincant. Les multiples problèmes posés par les phases de test dans les rues de San Franscico n’ont pas débouché sur un accident grave susceptible de mettre un coup d’arrêt aux ambitions de la firme, qui étend désormais son service de manière exponentielle dans les métropoles américaines. Au point de faire de l’ombre à Elon Musk.

Acculé financièrement et technologiquement, Tesla lance à son tour un service de robotaxi dans les rues d’Austin. Pour l’instant, il s’agit surtout de gonfler le cours de l’action en démontrant la faisabilité d’un concept encore flou, à l’aide d’une dizaine de prototypes. Comme nous allons le voir, il s’agit autant d’un pari financier désespéré que d’un défi technologique des plus hasardeux.

Sommes-nous sur le point de vivre (enfin) la révolution de la voiture sans pilote, ou bien assiste-t-on à une accélération du déploiement d’une énième “Fake Tech” aussi nuisible qu’inutile ?

La course à l’autonomie : Tesla et l’origine du mal

Fin 2012, Tesla Motors se trouve en grave difficulté financière. Les surcoûts, délais de production et multiples rappels d’usines du modèle S, qui souffre d’importants problèmes de qualité sur sa chaine de production, plongent les comptes de l’entreprise dans le rouge. Comme le reconnaîtra Elon Musk, « le bouche-à-oreille était atroce ». L’entrepreneur s’en sort miraculeusement grâce aux subventions de l’État californien, une hausse des tarifications et un déstockage important qui permet de dégager un bénéfice artificiel sur un trimestre. Ce résultat propulse le cours boursier et entraîne le succès d’une levée de capital par émission d’actions. Après avoir été sauvée par le gouvernement fédéral et des investissements de Ford, Toyota et Chrysler en 2009, la startup californienne échappe de nouveau à la faillite.

Le plan B consistait à vendre l’entreprise à Google pour six petits milliards de dollars, le géant de l’internet imaginant des synergies après avoir lourdement investi dans le développement d’une voiture sans pilote. Si l’accord secret n’est plus d’actualité, Musk craint que les progrès de Google dans la voiture autonome ne lui volent la vedette. Il engage rapidement Tesla dans la course.

Depuis les années 1980 et jusqu’au milieu des années 2000, l’essentiel de la R et D portant sur la conduite autonome avait été financé par le DARPA, une branche du ministère de la Défense américain, avec de premiers développements encourageants. Via sa filiale Waymo, Google avait relancé l’intérêt de la Silicon Valley. Cruise est fondé en 2013 et de nombreux cadres issus des programmes financés par le DARPA sont recrutés dans les startups travaillant sur les véhicules sans pilote. Compte tenu du retard important de Telsa, Musk décide d’aborder le problème d’une autre façon : au lieu de viser une voiture 100 % autonome, le milliardaire table sur un premier objectif visant à couvrir 90 % des situations de conduite. Surtout, il renonce à l’usage de radars basés sur une technologie infrarouge (LIDAR) pour détecter les obstacles, préférant des caméras vidéo moins onéreuses. Pour lui, si un humain peut conduire avec ses yeux, une voiture peut devenir autonome simplement grâce à la reconnaissance visuelle permise par une caméra standard. Il s’agit surtout d’économiser des sous. Ce choix s’avère fatal : les accidents évoqués plus haut auraient été évités si les Teslas disposaient d’un radar en complément des caméras n’ayant pas été capable de reconnaître les obstacles. Mais l’approche permet de commercialiser immédiatement une option présentée comme autonome.

En 2013, les équipementiers automobiles disposent déjà de solutions, sous la forme d’une collection de systèmes : assistance au freinage (la voiture détecte automatiquement les obstacles et actionne le frein), régulateur de vitesse intelligent (qui s’adapte à la circulation) et assistance de trajectoire (qui actionne le volant pour éviter une sortie de route). Si les constructeurs traditionnels n’explorent pas davantage ces possibilités, c’est avant tout par souci de sécurité. Loin d’être présentés comme des systèmes de conduite autonome, ils sont généralement conçus pour se désengager dès que le conducteur lâche le volant. Musk les combine en une fonctionnalité unique, qu’il baptise « autopilote ». « Autonome évoque l’idée que votre voiture peut faire quelque chose qui vous déplaît , alors qu’auto pilote c’est un bon système pour les avions, et ça le sera pour les voitures », justifie-t-il à Bloomberg en 2013. Trompeuse, l’appellation constitue un joli coup marketing.

En proposant cette fonctionnalité en option, il espère utiliser ses clients comme bêta-testeurs plus ou moins volontaires et accumuler des millions d’heures de conduite permettant d’entraîner peu à peu l’algorithme. Car les limites du système sont davantage liées à la partie logicielle, qui doit apprendre à reconnaître les conditions de circulation et agir en fonction, qu’à la partie matérielle. De la même manière qu’un programme d’intelligence artificielle peut être entraîné à reconnaître des chats sur des photos, il peut apprendre à identifier des voitures sur une route et analyser les conditions de circulation. Dès 2014, Tesla bluff le grand public avec une vidéo montrant son système prendre en charge le véhicule sur plusieurs kilomètres. Il s’agit pourtant d’un film manipulatoire, les multiples interventions du conducteur étant coupées au montage. Mais le potentiel de la technologie impressionne et le cours boursier de Tesla s’envole. La fuite en avant peut commencer : Tesla va continuer d’exagérer les capacités de son système et promettre “un million de robotaxis d’ici l’année prochaine” tout en maintenant une opacité quasi criminelle sur les circonstances des différents accidents impliquant son autopilote. The show mush go on: comme Musk le reconnaîtra fin 2022 “sans la mise au point de la conduite autonome, la valeur de l’action Tesla est proche de zéro”.

Un casino sous le capot : le mirage de la voiture 100% autonome

La Society of Automobile Engineer (SAE) classe le niveau de sophistication d’un système en six catégories. Les niveaux 0 et 1 représentent une conduite assistée par des automates, comme le régulateur de vitesse, le freinage d’urgence, la boite automatique, etc. Le conducteur doit tenir le volant en permanence pour maintenir la trajectoire. Le niveau 2 inclut l’automatisation de la trajectoire, le conducteur pouvant relâcher le volant pendant de brefs intervalles de temps, à condition de conserver ses yeux sur la route. À partir du niveau 3, on ne parle plus de conduite assistée, mais de conduite autonome. Ce niveau permet de relâcher le volant et son attention en permanence. Cependant, le conducteur doit toujours être présent et capable d’intervenir en cas de signal. Le niveau 4 ne requiert pas de conducteur dans le véhicule, mais les itinéraires sont limités à des zones balisées et amplement testées (par exemple, un quartier de San Francisco). Le niveau 5 caractérise les voitures entièrement autonomes sur toutes les routes et par toutes conditions.

Le système proposé par Tesla se situe encore au niveau 2 selon la SAE et le régulateur américain, comme en témoigne la formule « Les fonctionnalités actuelles exigent une surveillance active de la part du conducteur et ne rendent pas le véhicule autonome » placée en dessous de l’option « autopilote amélioré : capacité de conduite entièrement autonome » proposée par le constructeur.

Des firmes comme Honda, BMW et Mercedes ont récemment mis au point des systèmes considérés de niveau 3. Celui de Mercedes a reçu l’autorisation d’opérer dans le comté de Los Angeles, mais sous certaines conditions : une vitesse maximale de 65 km/h, des conditions de météo optimales, la présence continue d’un véhicule devant la voiture autonome et un itinéraire connu du système. Autrement dit, l’applicabilité de cette révolution, qui permet au conducteur de quitter la route des yeux sur toute la durée du trajet, se limite à une conduite dans les embouteillages. Peut-on réellement parler de « niveau 3 » ? Comme Tesla, Mercedes entretient l’ambiguïté. Le manuel de la voiture précise qu’il incombe au conducteur de détecter les dégradations éventuelles des conditions de circulation. Ce qui entre en contradiction avec l’idée qu’il puisse regarder un film ou faire la sieste lorsque le pilote automatique est enclenché. De même, la question du désengagement pose de nombreux problèmes juridiques. À partir de quel moment est-il raisonnable d’estimer que la responsabilité de la conduite passe du système au conducteur ? Dix secondes après le signal sonore déclenché par la fin du bouchon sur une autoroute ? Mercedes ne clarifie pas ces points, préférant communiquer sur le fait qu’elle se porte responsable en cas de collision lorsque le pilote automatique est activé. De toute évidence, le conducteur doit rester vigilant puisque le système peut se désengager dès que la visibilité décroît ou que la circulation se fluidifie.

Passer du niveau 2 ou 3 au 4 n’est pas une simple formalité. Les robotaxis de Waymo et Cruise n’ont pas suivi la même stratégie de développement que le système « autopilote » de Tesla, désormais surpassé par plusieurs concurrents. Dans un cas, l’usage reste essentiellement destiné à améliorer le confort du propriétaire. Dans l’autre, il s’agit de concurrencer Uber et les taxis traditionnels. Les véhicules sont bourrés de capteurs – y compris radars et infrarouges – pour détecter tout type d’obstacle et de situation. Les algorithmes sont optimisés pour la conduite en ville sur des parcours prédéfinis sur lesquels ils ont été longuement entraînés. Et le cout du système s’en ressent.

Tesla, à l’inverse, est parti d’un système « niveau 1 » et l’a étendu au niveau 2 en commençant par la conduite sur autoroute et le parking dans les garages privés. Des situations bien plus prédictibles que les petites routes de campagne mal balisées et le chaos de la circulation en centre-ville. L’idée étant que les progrès techniques dans le hardware et surtout l’expérience acquise par l’algorithme permettront de passer au niveau 3 puis 4 et enfin 5. Mais cette chimère se heurte à la réalité : tout miser sur la reconnaissance visuelle d’une intelligence artificielle vous expose aux limites inhérentes à cette technologie.

Elle repose sur les mêmes principes que des programmes de reconnaissance faciale ou des chabots types ChatGPT. Au cœur du système, on retrouve les réseaux de neurones artificiels utilisant le principe du machine learning ou deep learning (apprentissage par renforcement). L’algorithme est confronté à d’innombrables situations définies par des montagnes de variables et doit déterminer la meilleure solution. Est-ce une photo de chat ou de chien ? Est-ce une voiture ou un piéton ? L’obstacle est-il en mouvement ou à l’arrêt ? Le programme donne une réponse définitive et agit en fonction. Mais il le fait à partir d’une approche probabiliste et discrétionnaire. Quelle est la probabilité qu’il s’agisse d’un piéton ou d’un reflet dans une flaque d’eau ? D’un obstacle ou d’un peu de fumée ? Pour améliorer la performance de l’IA, il faut la confronter à un maximum d’exemples.

Lorsqu’on a compris ce point précis, il devient évident qu’une voiture 100 % autonome est une chimère. Aucun système ne parviendra à être confronté suffisamment souvent à tous les types de problèmes imaginables pour devenir fiable à 100 %, sans parler du risque de panne d’un capteur critique. Il y a une contradiction philosophique entre l’approche probabiliste et discrétionnaire de la voiture sans conducteur et le fait que le réel est par essence continu, ambigu et ontologiquement ouvert. L’algorithme découpe le réel en état discret et leur assigne des probabilités alors que la réalité est bien plus fluide, chaotique et imprévisible.

Si l’autopilote des avions fonctionne relativement bien, c’est avant tout parce que la tâche à effectuer est bien plus simple. Dans les airs, les risques qu’un chat, un ballon de football, un sac poubelle ou une branche d’arbre surgisse à quelques mètres de l’appareil sont proches de zéro. Il n’y a pas de chantiers inopinés sur la chaussée ou de “modification récente de l’état des lieux” qui contredirait les données disponibles. Du reste, deux pilotes sont toujours présents à bord.

Les technophiles argueront que le système n’a pas besoin d’être parfait, il lui suffit d’être plus performant que le conducteur moyen. Les systèmes de conduite autonome ne boivent pas avant de prendre le volant, ils ne sont pas distraits par leurs téléphones, ne s’énervent pas quand on leur coupe la route, ni ne se fatiguent après des heures de conduite. Mais ils continuent de commettre des erreurs incroyablement stupides du point de vue d’un humain, comme d’écraser un piéton qu’ils viennent de renverser avant de s’immobiliser des heures durant sur sa jambe, faute d’être capables de descendre du véhicule pour inspecter la situation.

Aller vite en cassant des choses

L’adage culte des entrepreneurs de la Silicon Valley, « Moving fast and breaking things » s’applique particulièrement bien au cas de la voiture autonome, une technologie développée dans la hâte avec peu d’égards pour les multiples risques et conséquences.

Les accidents évoqués en début d’article sont instructifs. Le conducteur de la Tesla plaçait une confiance exagérée dans l’autopilote. Un humain aurait fait attention à l’approche de l’intersection et immédiatement identifié le camion. Mais Brown regardait un film. Un comportement encouragé par Elon Musk, qui avait personnellement partagé sur les réseaux sociaux une des vidéos postées par Brown où il vantait les prouesses du système.

Le prototype Uber essayait encore de déterminer si l’objet en approche était une voiture ou un vélo lorsqu’il a finalement pris la décision d’alerter le conducteur, deux dixièmes de secondes avant l’impact. La conductrice était distraite, mais ce type de comportement est précisément ce qu’on peut attendre d’un humain chargé d’observer la route plusieurs heures de suite sans intervenir. En prenant davantage soin de ses testeurs au lieu de les soumettre à des conditions de travail drastiques, Uber aurait pu éviter l’accident et préserver sa réputation. Mais quid d’un usager régulier ? Ironiquement, le prototype utilisé par Uber reposait sur une Volvo disposant d’un système de freinage d’urgence (niveau 1 sur l’échelle de maturation de la voiture autonome). Uber avait désactivé le système pour éviter les interférences avec sa propre technologie. Son programme était conçu pour enclencher le freinage seulement si le véhicule estimait pouvoir éviter l’impact à coup sûr, l’alternative étant de ralentir et alerter le conducteur. Comme l’ont démontré des simulations conduites par Volvo, son propre système aurait freiné plus tôt et réussi dans 17 cas sur vingt à prévenir la collision. Autrement dit, en essayant d’atteindre le niveau 4 de sophistication, Uber a fait moins bien qu’un système de niveau 1.

Waymo et Cruise ont convaincu les régulateurs qu’ils adoptaient une approche bien plus précautionneuse. Malgré cela, l’implémentation de leurs services de robotaxis à San Francisco a généré des retours d’expérience désastreux et la colère des riverains.

Waymo a tué un chien, conduit dans un trou de chantier et a été impliqué dans des dizaines de collisions, tout comme Cruise. Au-delà des accidents, les deux opérateurs provoquent de nombreux troubles à la circulation et à l’ordre public, causant des embouteillages et ralentissements dans des quartiers résidentiels, bloquant des ambulances et véhicules de pompiers en intervention, se garant devant des bouches à incendies ou s’immobilisant en pleine voie suite à un évènement non compris par l’algorithme.

L’accident du 2 octobre impliquant la société Cruise a également révélé un problème de culture du risque rappelant davantage Tesla et Uber que l’image projetée par Waymo et les grands constructeurs historiques. Les fuites de documents internes ont montré un manque d’égards pour la sécurité motivé par l’obsession de devancer Google dans la course aux robotaxis, comme Uber avait devancé Lyft dans la course aux taxis partagés. En particulier, l’objectif de Cruise était de parvenir à un niveau de sécurité comparable au chauffeur Uber moyen. Bien que les ingénieurs savaient que le système avait de grandes difficultés à détecter les enfants et les trous dans la route (« obstacle négatif » dans le jargon), le PDG de Cruise avait décidé d’accélérer le déploiement de sa flotte dans diverses villes des États-Unis. L’accident a provoqué son licenciement.

Tesla constitue un cas encore plus emblématique de cette course en avant au mépris des règles et du bien commun. Après avoir annoncé le développement de son « autopilote », Elon Musk a placé ce projet au cœur de sa stratégie d’entreprise dans son « Master plan, part deux ». Pour contrer Uber et Google, il promet l’arrivée imminente d’un système de conduite 100 % autonome qui permettra à chaque propriétaire de Tesla de sous-louer son véhicule comme robotaxi. La voiture autonome ne doit alors plus simplement réduire le nombre d’accidents de la route, qui font près de 40 000 morts aux USA chaque année, mais réduire le cout d’utilisation des voitures (en les sous-louant lorsqu’on ne les utilise pas) et diviser la circulation par deux ou quatre en faisant de chaque voiture un robotaxi capable d’emporter quatre personnes à la manière d’un service de covoiturage.

Par bien des aspects, ce projet reste peu crédible. Si Tesla parvenait à mettre au point des robotaxis avant ses concurrents, elle n’aurait aucune raison de vendre les voitures à des particuliers : autant opérer la flotte soi-même et empocher les bénéfices. Pour que les clients soient prêts à sous-louer en permanence leur véhicule de luxe réputé fragile et doté d’une batterie à durée de vie limitée, les revenus devront être conséquents.

Outre l’aspect commercial douteux, les choix technologiques placent Tesla face à une contradiction fondamentale. Convertir un véhicule personnel en robotaxi nécessite d’ajouter des équipements et services au cout non négligeable. Selon le New York Times, un véhicule Waymo coute 100 000 dollars par unité, plus du double d’une Tesla de même gabarit. L’ajout des capteurs a également un impact esthétique désastreux. Et opérer une flotte de robotaxis requiert une équipe conséquente en back-office pour intervenir en cas de besoin. Dans le cas de Cruise, le New York Times estimait qu’il fallait 3 techniciens pour deux véhicules en opération. Et on parle toujours de système de niveau 4 opérant dans des zones limitées, prédéfinies, longuement cartographiées et patiemment testées.

On arrête pas le progrès ! Vous pouvez désormais soutenir mon travail en m’offrant un café.

Pour son service de robotaxi, Tesla utiliseraient uniquement des caméras optiques. Le système repose sur un réseau de neurones “end to end”, ce qui signifie que les données d’entrées sont utilisés par l’algorithme de “deep learning” pour donner une réponse en sortie sans aucune intervention ou étape supplémentaire. Il n’est donc pas possible d’insérer des instructions additionnelles à suivre en cas de situation particulière, comme la présence d’un vehicule de police en bord de route. Avec cette approche, Musk espère réaliser (enfin) le bond technologique promis depuis 2013. En se passant des capteurs LIDARS, des équipes en back-office et des restrictions géographiques, il pourra commercialiser un système de niveau 5 disponible à tous les propriétaires de Tesla. La route risque d’être longue, voire impossible. Le premier test de robotaxis débuté à Austin connait des débuts chaotiques, malgré la mobilisation des équipes du back-office, la présence d’un employé sur le siège passager avant, la zone géographique restreinte et les semaines de tests intensifs.

La course aux robotaxis, pas à la rentabilité

Comment comprendre la mise en service précipitée des robotaxis Tesla ? Il s’agit probablement d’une manœuvre quelque peu désespérée pour sauver une entreprise dont les ventes s’effondrent au profit de la concurrence et à cause de la dégradation de l’image de la marque. La promesse des robotaxis, après celle des véhicules autonomes, permet de soutenir le cours boursier dont dépend la fortune d’Elon Musk et sa capacité à emprunter.

Mais il s’agit également de répondre à la montée en puissance de Waymo, qui étend son service à un nombre croissant de villes américaines et s’installe comme le leader de la voiture autonome. Au point de convaincre le gouvernement britannique de rejoindre la compétition en accélérant la procédure d’autorisation des robotaxis.

Tesla joue sa survie. Et mettre au point un faux système de robotaxis dans un environnement aussi peu réglementé que le Texas reste relativement aisé. Il suffit de ne pas rendre public le nombre de personnes présentes en back-office pour surveiller et contrôler les robotaxis à distance et ne pas publier les données relatives aux nombres d’interventions qu’ils pratiquent. Même si le service parvenait à s’étendre rapidement, de nombreuses questions resteraient en suspens. En particulier celui de la viabilité économique des robotaxis et leur utilité sociale.

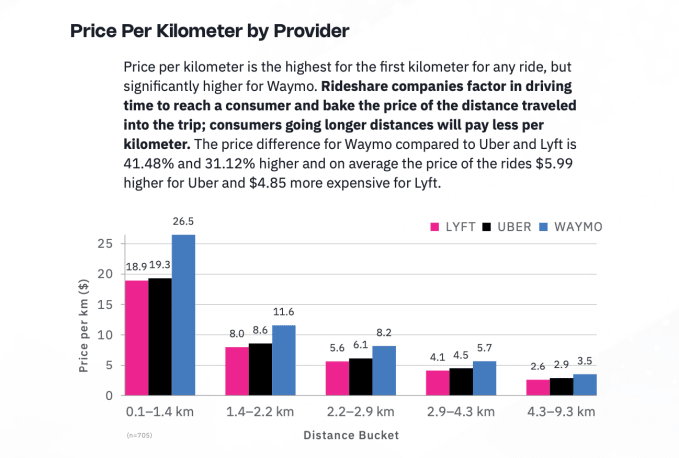

Quel problème cherchent-ils à résoudre ? Il ne s’agit pas de baisser le cout du transport : une course en Waymo coute 10 à 45 % de plus que le même trajet en Uber. Il n’est pas non plus question de réduire les embouteillages. Le succès d’Uber a augmenté le trafic routier en mettant davantage de véhicules sur les routes. Et les enquêtes d’opinions rapportées par TechCrunch envoient un autre signal inquiétant. Le fait que Waymo trouve des clients tout en étant plus cher qu’Uber serait essentiellement dû au fait que ses usagers apprécient d’être seul dans le véhicule, sans la “nuisance” du chauffeur. Outre le virage anthropologique que cela suggère, cet élément contredit l’idée que les robotaxis transporteront plusieurs passagers à la manière d’un taxi-brousse ou d’un service de covoiturage. À moins de pouvoir proposer des couts dix fois moindres, ce qui nécessiterait d’embarquer plus de passagers et de suivre des itinéraires fixes. La Silicon Valley serait-elle sur le point de réinventer l’autobus ?

Non, la principale utilité du service semble être de fabriquer des légions de chômeurs en remplaçant les chauffeurs ubérisés et, à terme, les chauffeurs routiers, par la conduite autonome. Pour y parvenir, le système doit être rentable. Ce qui n’a rien d’évident.

En 2024, Waymo aurait enregistré plus de 4 milliards de dollars des pertes financières du fait du coût de la R&D et de l’entretien, de l’opération et de l’élargissement de sa flotte. Une somme astronomique que seuls des géants comme Google peuvent se permettre de brûler à une telle vitesse. Avec 250 000 courses par semaine (contre 250 millions pour Uber), Waymo continue de perdre de l’argent sur chaque trajet qu’elle effectue. Et ce, malgré une tarification supérieur à celle pratiquée par ses deux principaux concurrents Uber et Lyft. Autrement dit, remplacer un conducteur de taxi uberisé par un robot ne permet pas d’économiser de l’argent, du fait du surcoût entraîné par le véhicule et la nécessité de payer une armée de techniciens pour superviser la flotte. Les couts de Waymo devraient diminuer avec les économies d’échelles, mais Uber et Lyft disposent également de marges confortables pour mener une guerre des prix.

Les impacts négatifs ne se limitent pas aux accidents, décès et embouteillages évoqués plus haut. La promesse des véhicules sans pilote sert également de justification pour décourager les pouvoirs publics à investir dans les transports en commun et autres solutions écologiques. Les Koch brothers, des multimilliardaires ayant fait fortune dans l’industrie pétrolière, ont mené des opérations de lobbying pour tuer de multiples projets de transports en commun en mobilisant l’argument de la voiture autonome et électrique. Ce n’est pas la première fois que les promesses de la Silicon Valley sont ainsi agitées pour freiner le progrès : Musk avait utilisé l’arnaque de son Hyperloop pour retarder la ligne de train à grande vitesse devant relier Los Angeles à San Francisco. De même, ses hypothétiques tunnels à Tesla ont servi à tuer des projets de tramways.

Enfin, notons que les voitures équipées pour la conduite plus ou moins autonome embarquent une multitude de capteurs redondants et de puissants microprocesseurs. Ils génèrent une masse de données conséquente. Ce qui augmente fortement le poids et l’impact environnemental de ces véhicules.

Encore une fois, la Tech cherche à imposer une solution que pas grand monde ne désire, qui ne résout aucun problème précis et présente de nombreuses externalités négatives. Dont le fait, en cas de succès, de décourager l’usage des transports en commun pour mettre davantage de véhicules sur les routes. Tout cela dans le but de construire un nouveau monopole permettant de concentrer la richesse et le pouvoir dans les mains de quelques-uns, sur le dos des travailleurs, de l’environnement et des usagers.

27.05.2025 à 11:47

Les cryptos États-Unis d'Amérique

Christophe @PoliticoboyTX

Texte intégral (7225 mots)

Le Congrès américain est en passe de voter une loi visant à assouplir la régulation des stablecoins1, ces actifs financiers servant de liquidité pour les transactions en cryptomonnaie. Écrit par les lobbies procryptos, le texte semble taillé pour Donald Trump. Même son titre (“Stable act”, pour la version de la Chambre des représentants et “GENIUS act” pour le Sénat) est un clin d’œil au président, qui s’était autoproclamé “Very Stable Genius” suite à un examen médical. Non seulement cette loi lui permettra de tirer un maximum de profit de ses nombreux investissements dans le secteur des cryptoactifs, mais elle ouvre aussi la voie à un nouveau type de corruption - y compris de la part des gouvernements et agents étrangers.

Le texte aurait pu être baptisé “légalisation de la corruption du Président”, mais il pose d’autres problèmes. Le cadre législatif proposé pour faciliter l’usage des stablecoins doit permettre leur montée en puissance. Les banques et la finance traditionnelle risquent d’être exposées au risque systémique des cryptoactifs, secteur connu pour sa volatilité et sujet à de multiples fraudes, arnaques, piratages, manipulations des cours, délits d’initiés, blanchiments d’argent et problèmes de financement des activités criminelles et terroristes. Combiné à de récents décrets présidentiels, le “GENIUS act” ouvre la voie à un usage des stablecoins par le gouvernement américain, qui pourrait ainsi contraindre les citoyens à recevoir ou effectuer des paiements en cryptoactifs. Tout en permettant par ailleurs à des entreprises privées de mettre au point leur propre monnaie, pour le plus grand bonheur de personnalités comme Elon Musk.

De quoi faire basculer le pays dans une situation inédite où la corruption généralisée s’étendrait à la privatisation de la monnaie, faisant des États-Unis un crypto-État dirigé par une clique de milliardaires baignant dans des conflits d’intérêts sans précédent. Le tout avec le soutien décisif du Parti démocrate, dont de nombreux sénateurs ont voté en faveur du texte porté par Donald Trump. Explications.

Trump écrase la régulation des cryptos et légalise les pratiques criminelles

En 2019, Trump déclarait “Je ne suis pas fan de Bitcoin et des autres cryptos, qui ne sont pas des monnaies et dont la valeur très volatile est basée sur du vent. Les cryptoactifs non régulés peuvent encourager les comportements illégaux, dont le trafic de drogue et autres crimes”. Il voyait cette technologie comme une menace face à l’hégémonie du dollar et un véhicule permettant de financer le terrorisme international et contourner les sanctions économiques américaines.

Sa position a évolué peu à peu, pour des raisons que nous avions détaillées dans un article précédent. En particulier, la campagne de Donald Trump a reçu plus de 20 millions de dollars de dons en provenance de l’industrie des cryptos, plus le soutien public de divers acteurs majeurs du secteur. Il leur a renvoyé l’ascenseur dès sa prise de fonction.

Outre la création d’une réserve fédérale en cryptomonnaie annoncée pour soutenir les cours, Trump a débuté une croisade contre les différentes agences fédérales engagées dans la régulation du secteur. La SEC (le gendarme des marchés financiers américains) a abandonné ou classé sans suite une dizaine de procédures judiciaires et enquêtes impliquant les principales firmes du secteur.

Depuis, avec l’aide des équipes d’Elon Musk qui opèrent au sein du DOGE (le Departement Of Gouvernement Efficiency), Trump a poursuivi dans cette voie. Le Consumer Financial Protection Bureau (CFPB), une agence fédérale conçue pour protéger les Américains des abus perpétués par le secteur bancaire, a été vidé de tous ses moyens. La section du FBI chargée de lutter contre les crimes financiers liés aux cryptos a été purement et simplement démantelée et, dans une directive remarquable, la Maison-Blanche a demandé au ministère de la Justice de cesser d’engager des poursuites contre les acteurs des cryptomonnaies s’il n’avait pas la preuve d’une volonté et conscience de violer la loi. Tout en ordonnant au département chargé des crimes financiers de “ne plus instruire de procédures visant le secteur des cryptoactifs”. Enfin, Trump vient de gracier une série d’individus affiliés à la société BitMEX et condamnés pour blanchiment d’argent.

Dans les faits, le secteur des cryptomonnaies n’a donc plus grand-chose à craindre du FBI, des procureurs fédéraux, du ministère de la Justice au sens large et de la SEC en particulier. Ce qui tombe bien, compte tenu de l’implication grandissante du président dans ce secteur.

Trump en passe de bâtir un crypto-empire pour faciliter sa propre corruption

En 2021, alors qu’il vient de perdre les élections, Trump lance une collection de cartes virtuelles à son effigie, sous forme de NFT2 ( “Non Fungible Token”) reposant sur une blockchain3. Elle fonctionne comme une pyramide de Ponzi, puisque la valeur des cartes est purement spéculative. Pour encourager ses fans à se porter acquéreurs, il organise un système de loterie donnant accès à des récompenses. Sa femme Melania avait également tenté de lancer sa propre série de NFT, sans grand succès.

Depuis qu’il s’est autoproclamé “Crypto-Président”, Trump va beaucoup plus loin. Après avoir fait la promotion du secteur pendant la campagne électorale et conduit une politique favorable à cette industrie depuis sa prise de pouvoir, il s’engage dans une série d’actions qui n’ont plus rien à voir avec le simple renvoi d’ascenseur évoqué plus haut.

Plus de 350 millions de profit via les “Memecoins”

Quelques heures avant sa prise de fonction, Trump a lancé un memecoin4 à son effigie baptisée $TRUMP et initialement proposé au prix de 18 centimes le jeton numérique. Le cours s’est très fortement apprécié (à 75 dollars le jeton) avant de chuter brutalement, suite à la vente des premiers acheteurs. La création de ce cryptoactif avait suscité de vives critiques, en particulier de la part de la communauté procrypto, qui y voyait une démarche purement opportuniste susceptible de faire du tort au secteur. En effet, Trump et ses proches ont encaissé plus de 350 millions de dollars après avoir revendu au plus haut une partie des jetons qu’ils avaient créés ex nihilo, dans ce qui s’apparente à un cas d’école de rug pull5. Le cours était retombé rapidement en dessous des 10 dollars, laissant la plupart des acheteurs dans le rouge.

La famille de Trump a reproduit la même chose avec un memecoin basé sur sa femme et baptisé $MELANIA, avec un succès plus modeste, mais respectable.

Depuis, Trump semble utiliser son $TRUMP coin comme support pour vendre un accès privilégié à la Maison-Blanche. Après s’être durablement effondrée, la valeur du token $TRUMP est repartie à la hausse suite à l’achat de vastes quantités de jetons par des acteurs étrangers, pour plusieurs centaines de millions de dollars. Le président a poursuivi dans cette voie en offrant des prix aux principaux investisseurs dans sa cryptomonnaie, dont un diner en sa présence dans sa résidence de Mar-a-lago aux 220 plus gros détenteurs et la promesse d’une entrevue préliminaire avec les 25 premiers de la liste. En moyenne, les 220 invités ont investi 1,8 million de dollars pour participer au diner. L’écrasante majorité de ces individus ne serait pas de nationalité américaine. Ironie du sort : Trump s’est contenté d’une brève apparition centrée autour d’un discours de 25 minutes, sans s’entretenir personnellement avec ses invités. Faut-il y voir le résultat du tollé provoqué par l’organisation de cet évènement, ou un signe de plus que Trump a parfaitement intégré l’esprit “crypto”, qui consiste à vendre la lune à des investisseurs crédules avant d’empocher le jackpot tout en les laissant sur le carreau ?

Une chose est sûre, ce type d’initiative viole la constitution américaine, qui interdit au président de recevoir des cadeaux en provenance de l’étranger moyennant des traitements de faveur. Or, cette opération ne permet pas uniquement d’augmenter le cours d’un actif comme le $TRUMP coin, encore majoritairement détenu par la famille Trump. Elle augmente aussi l’activité de trading associée à ce cryptoactif, ce qui génère des revenus supplémentaires via les frais de commission. Et ce type d’enrichissement n’est qu’une des avenues empruntées par Trump pour rentabiliser sa présidence.

La Trump organisation lance un Stablecoin, investit dans le minage de cryptos et le jeu vidéo basé sur cet écosystème

Non content de disposer de son memecoin, Trump a également lancé un stablecoin (“USD1”) via World Liberty Financial, une société contrôlée à 60 % par sa famille. Le lancement du token a rapporté 400 millions de dollars. Depuis, les Émirats arabes unis ont annoncé leur prise de participation à hauteur de 2 milliards de dollars dans la plateforme de courtage en ligne Binance, qui sera payée avec le stablecoin de Trump. Ce qui devrait lui permettre de récolter des commissions importantes, tout en offrant une légitimité à son “USD1”.

Avec ce stablecoin, Trump se place en situation idéale pour profiter du GENIUS act adopté par le Congrès, et dont une provision vise explicitement à permettre les investissements étrangers dans les stablecoins. Et ce, sans obligation de vérifier la provenance de l’argent ni la conformité avec les lois visant à empêcher le financement du terrorisme international. Autrement dit, la loi vise à légaliser les pratiques de corruption : Trump (et ses corrupteurs) ne pourront plus être poursuivis pour trafic d’influence si des investisseurs étrangers achètent des USD1 dans le simple but de s’attirer les faveurs de Donald Trump.

Cette décision n’est pas un cas isolé. Comme le détaille la journaliste spécialiste des cryptos, Molly White, la famille Trump investit également dans une société de minage de cryptomonnaie et se penche sur le lancement d’un jeu vidéo dont la monnaie virtuelle serait constituée de cryptoactifs. Deux investissements à la moralité douteuse.

Le minage de crypto est un processus consistant à faire tourner des milliers de processeurs informatiques pour réaliser les calculs complexes requis par les blockchains, un processus énergivore à l’impact environnemental désastreux. Quant aux jeux vidéos reposant sur les cryptomonnaies, ils débouchent parfois sur des écosystèmes où des enfants du tiers monde sont employés par de riches individus pour jouer à leur place et rapatrier une grande partie des gains, lorsqu’ils ne sont pas critiqués pour leurs mécanismes hautement addictifs qui provoquent des problèmes psychologiques chez les usagers traditionnels.

Enfin, Molly White rappelle que Trump et sa famille possèdent des investissements dans les cryptomonnaies et visent, via la création de diverses sociétés liées aux cryptos, à augmenter leur exposition financière à ces actifs dans l’espoir de réaliser des gains financiers importants. Un conflit d’intérêts d’autant plus saillant que l’autoproclamé « cryptoprésident » est directement impliqué dans la régulation de ce secteur.

Au Congrès, la loi procrypto “GENIUS act” en passe d’être adoptée grâce aux démocrates

Au cours de son premier mandat, Trump avait récolté plus de 8 millions de dollars en louant ses chambres d’hôtels et golfs à des diplomates et hommes d’affaires étrangers, qui utilisaient ces moyens pour se faire bien voir du président ou obtenir des entrevues.

Avec les cryptoactifs, Trump change drastiquement de braquet. Les sommes en jeu sont incomparablement plus élevées et les retombées potentielles quasi illimitées. Pourtant, les sénateurs démocrates ont voté le texte de loi promu par le Parti républicain pour accélérer cette dérive.

Il s’agit d’une faute politique majeure. Pendant que les sénateurs démocrates négociaient des amendements anecdotiques sur le texte, Trump faisait arrêter puis poursuivre en justice une parlementaire démocrate, faisait disparaitre sans passer devant un juge des immigrés en situation légale pour les déporter dans un goulag salvadorien, attaquait la liberté d’expression et les universités, menaçait de violer la constitution, engageait de multiples bras de fer avec la Cour suprême, détruisait les régulations environnementales, sabotait la transition écologique timidement entamée sous Joe Biden et perpétrait un génocide. Une politique qui enrage la base électorale démocrate. À l’exception de quelques élus, dont le duo de représentants de la gauche radicale Bernie Sanders et Alexandria Ocasio-Cortez, les élus démocrates refusent pourtant de s’opposer frontalement à Donald Trump.

Même s’ils pensaient sincèrement que le GENIUS Act était un bon texte, il aurait été normal qu’ils refusent de le voter sans obtenir des contreparties de la part de l’administration Trump sur d’autres sujets. Un parti d’opposition doit s’opposer, surtout lorsque le président voit sa cote de popularité s’affaisser dans des proportions historiques. Autrement, le Parti démocrate ne bénéficiera pas de l’impopularité de Trump et du Parti républicain, car il sera perçu comme complice et complaisant.

Ici, le travail de l’opposition démocrate est facilité par le fait que le texte est clairement critiquable : il organise un vaste système de corruption au profit de Donald Trump, mais, comme nous allons le voir, ouvre également la porte à divers risques financiers et conséquences potentiellement néfastes pour la société américaine.

Le premier risque est lié aux retombées attendues par les promoteurs du texte, qui estiment que la capitalisation boursière des stablecoins pourrait être multipliée par dix pour atteindre 2000 milliards de dollars. De pareilles sommes, qui plus est désormais intégrées à la sphère économique traditionnelle, risquent de provoquer de l’instabilité financière. En particulier en exposant des fonds de pension et banques systémiques au risque d’effondrement des cours. Rappelons que les cryptomonnaies ne sont pas régulées et qu’elles sont l’objet d’amples mouvements financiers, avec des outils spéculatifs à effet de levier qui peuvent provoquer des problèmes de liquidité poussant des acteurs à la faillite. Un évènement de ce genre, s’il se propageait à la sphère financière traditionnelle, pourrait entrainer une nouvelle crise financière majeure. Ce qui serait ironique lorsqu’on sait que les cryptomonnaies sont apparues en réponse à la crise des subprimes et à la perte de confiance dans le secteur bancaire traditionnel.

Le second risque concerne les consommateurs. Les cryptoactifs sont régulièrement la cible de larges fraudes et arnaques, mais également de piratages informatiques (depuis 2021, 78 milliards de dollars auraient ainsi été volés). En cas de perte ou de vol, les détenteurs de cryptos ne sont pas protégés par des mécanismes d’assurance comme le sont les dépôts bancaires ou les cartes de crédit. Les petits porteurs victimes de fraudes sont souvent condamnés à subir les pertes sans recours possibles. D’autant plus que les transactions en cryptos ne sont pas réversibles, contrairement aux virements bancaires et paiements par carte de crédit. Pire, le GENIUS act stipule qu’en cas de faillite d’un stablecoin, les investisseurs en cryptos devront être remboursés en premier, avant les acteurs financiers traditionnels et les clients (soit l’inverse d’une procédure de mise en faillite normale).

Comme le soulignait la sénatrice progressiste Elizabeth Warren dans son discours au congrès, encourager l’adoption des stablecoins risque aussi de drainer l’épargne américaine alimentant les banques locales et finançant collectivités et PME, avec des répercussions importantes sur certains territoires défavorisés. On ne le répète jamais assez, chaque dollar ou euro placé dans des cryptoactifs quitte l’économie réelle sans rien produire en retour. Un peu comme les investissements sur le marché secondaire d’action et d’obligation, bien que soutenir le cours de ces produits financiers produit des effets indirects sur l’économie réelle (baisse des taux d’intérêt, capacité d’investissement accrue des entreprises…).

La sénatrice du Massachusetts insistait aussi sur l’absence de mécanismes de contrôle ou de régulation pour prévenir les usages illégaux des stablecoins, qui sont déjà massivement utilisés pour financer le trafic d’êtres humains, d’armes et de stupéfiants, en plus du blanchiment d’argent, du terrorisme international, de la pédophilie, de la cybercriminalité et autres activités illicites. En officialisant les stablecoins sans leur appliquer les régulations auxquelles est assujetti le secteur financier traditionnel, le Congrès va créer un formidable outil au service du crime organisé et des “États voyous”.

Enfin, le “GENIUS act” facilite la création de stablecoins par les firmes américaines, qui ne seront plus bridées comme précédemment et auront enfin un accès comparable aux mécanismes de financement interbancaire dont bénéficient les établissements financiers traditionnels. De ce fait, les deux hommes les plus riches du monde (Elon Musk et Mark Zuckerberg) vont pouvoir mettre en œuvre leur rêve de monnaie privée en créant leur propre stablecoin lié à leurs réseaux sociaux et programmes d’Intelligence artificielle respectifs (X et Grok pour Musk, Facebook, Instagram et Llama pour Zuckerberg).

Si cela peut sembler être de la science-fiction, Donald Trump a déjà signé un décret pour permettre aux agences gouvernementales d’accepter les paiements et de procéder à des versements en cryptos. Et les équipes du DOGE d’Elon Musk ont obtenu les accès informatiques aux systèmes de paiement du gouvernement fédéral permettant de verser les pensions des retraités, vétérans et personnes éligibles aux diverses aides sociales. Tout en indiquant leur souhait de permettre d’effectuer ces versements avec des monnaies basées sur des blockchains. Autrement dit, les dispositions pour verser en cryptomonnaie les quelques cinq mille milliards d’aides sociales annuelles aux plus de cent millions d’Américains qui en dépendent ont déjà été prises. De plus, l’administration Trump a évoqué l’idée d’effectuer divers paiements en cryptos (3 milliards pour un projet de logements sociaux et plusieurs milliards pour l’aide au développement). Les Américains pourraient ainsi être contraints d’utiliser les stablecoins, qu’ils le veuillent ou non. Reste à savoir si ce sera ceux émis par Elon Musk, Trump, Mark Zuckerberg ou un panier des trois…

Outre la corruption sous-jacente et la concentration de pouvoir qu’un tel scénario produirait, cela reviendrait, pour le gouvernement américain, à se tirer une balle dans le pied en générant des concurrents privés du dollar. Mais ce ne serait pas la première fois que le système monétaire américain se retrouverait constitué d’une constellation de monnaies privées ni que l’administration Trump prendrait des décisions contraires aux intérêts du pays…

United states of Corruption (on n’arrête pas le progrès)

Deux sénateurs républicains (sur les 53 actuellement élus au Congrès) ont voté contre le GENIUS act. Ce type de texte doit recueillir une majorité qualifiée de 60 voix sur 100 pour être adopté. Compte tenu des arguments précédents, comment expliquer le fait que pas moins de 16 sénateurs démocrates aient voté le “GENIUS act”, alors que le soutien de 9 d’entre eux était suffisant pour faire adopter le texte ?

La première explication est la corruption pure et simple. Les lobbys procryptos ont été (de loin) le premier secteur en termes de dons aux campagnes électorales du cycle 2024, devant les énergies fossiles, big pharma, les industries de défense ou encore Wall Street. Cette injection de cash sans précédent a permis d’acheter de nombreux élus, qui doivent leur élection au soutien financier du lobby procrypto. Le sénateur de Californie Adam Schiff a ainsi vaincu l’élue progressiste Katie Porter grâce au soutien financier de ce secteur. Il a logiquement voté pour le GENIUS act, tout en se payant le luxe de tenir un discours de 30 minutes au Sénat pour détailler les “dix plus gros actes de corruptions commis par Trump” en 100 jours de mandat.

Le lobby procrypto pouvait aussi compter sur la sénatrice de New York Kirsten Gillibrand, qui s’était présentée à la primaire de l’élection présidentielle démocrate en 2020 sur un programme “progressiste et féministe”. Depuis, elle a été achetée par le lobby et a garni son cabinet d’anciens dirigeants de firmes spécialisés dans les cryptoactifs. Elle a ainsi justifié son soutien au texte par la formule tautologique “les cryptos ont fait la preuve qu’elles étaient là pour rester, il est donc inutile de s’y opposer”. En effet, tant que le pouvoir politique refuse de mettre des freins à cette technologie, elle continuera de croitre (et d’acheter les politiciens).

À la chambre des représentants et dans les commissions concernées, les élus démocrates se sont montrés plus sceptiques, allant jusqu’à envoyer des lettres officielles à la SEC pour s’inquiéter des risques de corruption entourant le président Trump. Mais c’est au Sénat que le Parti pouvait bloquer le texte. Ce qu’il s’est refusé à faire. Non seulement une partie des sénateurs a été arrosée par le lobby, mais le comité central du parti démocrate continue de courtiser le secteur des cryptos pour remplir les caisses destinées à financer les campagnes de 2026 et au-delà.

Cela constitue une erreur stratégique, tant l’univers des cryptos constitue un cheval de Troie pour les idéologies réactionnaires, mais également une faute morale. Ces actifs d’un genre nouveau n’ont toujours pas fait la preuve de leur utilité sociale. En plus de faciliter les crimes divers et de provoquer la ruine de nombreux investisseurs et petits porteurs, ils restent un outil dont les couts de fonctionnement (énergétique, commissions financières) sont bien plus élevés que le secteur traditionnel. Les rares personnes qui font fortune grâce aux cryptos sont de plus plus exposées à un risque supplémentaire inhérent à cette technologie : les attaques à leur domicile (enlèvement, tortures et violences) visant à leur subtiliser leurs clés de chiffrement donnant accès à leurs cryptos. Avec l’aide des démocrates et de Donald Trump, les patrons de la Tech qui poussent à l’adoption de cette “Fake Tech” sont en train de réinventer le Far West. On n'arrête pas le progrès.

Typiquement, un stablecoin est un crypto-actif dont la valeur est adossée au dollar par la société le mettant sur le marché (elle dispose ainsi d’autant d’actifs en dollars que du stablecoin en question, au moins théoriquement). Les stablecoins assurent le rôle essentiel des liquidités dans l’écosystème des cryptos actifs en permettant les achats/ventes sur les plateformes de courtage, mais sont opaques et, dans les faits, ne parviennent pas toujours à maintenir la parité avec le dollar. Les entreprises fournissant les stablecoins comme USDC ou Tether (les deux principaux, dont la capitalisation boursière s’élève à près de 200 milliards de dollars) ne publient pas de manière transparente leurs comptes et ne sont pas auditées de manière indépendante. Il est donc probable que la totalité des jetons ne soit pas convertible en dollars, contrairement à la promesse faite par leurs promoteurs.

Un NFT (non-fungible token ou jeton non fongible) est un mini programme informatique possédant un identifiant unique stocké et authentifié grâce à une blockchain. Ce certificat pointe vers un fichier informatique tiers (une image, un texte, etc) afin de certifier le caractère unique de l’objet numérique en question. Ce qui n’empêche pas de le copier ou de le déteriorer, puisque le fichier sous-jacent n’est pas lui même stocké sur la blockchain (seul le jeton de certification non fongible l’est). Si cela parait stupide et absurde, c’est normal.

La blockchain (chaine de blocs) est la technologie sous-jacente aux cryptomonnaies et cryptoactif. Elle consiste en une base de données informatiques comparable à un registre dont la sécurité est assurée par sa subdivision en blocs de données liés entre eux par des mécanismes numériques (équations à résoudre, procédure cryptographique ou autres) et distribués sur un réseau informatique.

Un memecoin est un crypto-actif ou “token” (jeton numérique) pouvant être acheté et vendu sur les plateformes de courtage en crypto monnaie et basé sur un meme internet, c’est-à-dire un visuel humoristique ou autre représentation numérique. Les memecoins possèdent une valeur purement spéculative reposant exclusivement sur celle que lui prêtent ses acheteurs.

Un rug pull, dans l’univers des cryptos, désigne la pratique consistant à mettre en circulation un nouveau crypto-actif (créer à partir de rien et promu via une campagne marketing) dans le but de vendre ensuite rapidement les jetons encore détenus par les créateurs du crypto-actif afin d’encaisser les gains. Cette vente brutale conduit à l’effondrement définitif du cours, ce qui laisse les investisseurs largement dans l’impossibilité de récupérer leur mise. Le terme Rug pull (tirer le tapis) évoque le fait de tirer le tapis sous les pieds de quelqu’un d’un coup sec afin de le récupérer, provocant la chute ou l’instabilité de la victime.

- Persos A à L

- Carmine

- Mona CHOLLET

- Anna COLIN-LEBEDEV

- Julien DEVAUREIX

- Cory DOCTOROW

- Lionel DRICOT (PLOUM)

- EDUC.POP.FR

- Marc ENDEWELD

- Michel GOYA

- Hubert GUILLAUD

- Gérard FILOCHE

- Alain GRANDJEAN

- Hacking-Social

- Samuel HAYAT

- Dana HILLIOT

- François HOUSTE

- Tagrawla INEQQIQI

- Infiltrés (les)

- Clément JEANNEAU

- Paul JORION

- Christophe LEBOUCHER

- Michel LEPESANT

- Persos M à Z

- Henri MALER

- Christophe MASUTTI

- Jean-Luc MÉLENCHON

- MONDE DIPLO (Blogs persos)

- Richard MONVOISIN

- Corinne MOREL-DARLEUX

- Timothée PARRIQUE

- Thomas PIKETTY

- VisionsCarto

- Yannis YOULOUNTAS

- Michaël ZEMMOUR

- LePartisan.info

- Numérique

- Blog Binaire

- Christophe DESCHAMPS

- Dans les Algorithmes

- Louis DERRAC

- Olivier ERTZSCHEID

- Olivier EZRATY

- Framablog

- Fake Tech (C. LEBOUCHER)

- Romain LECLAIRE

- Tristan NITOT

- Francis PISANI

- Irénée RÉGNAULD

- Nicolas VIVANT

- Collectifs

- Arguments

- Blogs Mediapart

- Bondy Blog

- Dérivation

- Économistes Atterrés

- Dissidences

- Mr Mondialisation

- Palim Psao

- Paris-Luttes.info

- Rojava Info

- X-Alternative

- Créatifs / Art / Fiction

- Nicole ESTEROLLE

- Julien HERVIEUX

- Alessandro PIGNOCCHI

- Laura VAZQUEZ

- XKCD