20.10.2025 à 12:06

Une brève histoire de la Silicon Valley (3/4)

Christophe @PoliticoboyTX

Texte intégral (12813 mots)

Bienvenue dans cette “Brève Histoire de la Silicon Valley”, une série en quatre articles pour comprendre comment cette région du monde est devenue le cœur du capitalisme contemporain. D’où vient la Tech et où nous conduit-elle ? Comment fonctionne l’innovation ? Nous tentons d’explorer ces questions et de nombreuses autres à travers ce long format. Le premier épisode est à découvrir ici et le second là. Le dernier sera publié lundi prochain via cette newsletter. Pour ne pas le manquer :

Si vous appréciez cette série ou souhaitez soutenir mon travail, vous pouvez m’offrir un café en cliquant sur ce lien. Partager mes articles autour de vous aide également énormément. Bonne lecture !

* Partie 3 : conquérir le monde (2000 -2015) *

1. Du BIG DATA à BIG BROTHER

Pour surfer sur les millions de pages qui fleurissent sur la toile, les moteurs de recherches deviennent rapidement incontournables. Ils sont construits à l’aide d’un type de programme d’un genre nouveau : les crawlers ( “rampants”) ou robots d’indexation. Ces logiciels peuvent lire des lignes de langage humain et les traduire en code tout en remontant le fil des hyperliens, page par page, en indexant ainsi les données. Ce processus de web scrapping ou moissonnage permet de télécharger une version locale des informations contenues sur le web. Pour autant, à la fin des années 1990, les moteurs de recherches restent peu performants. Après avoir référencé les pages web, ils dirigent les internautes à l’aide de recherches par mots clés (Lycos, AltaVista) lorsqu’ils ne se contentent pas de fonctionner comme de simples annuaires (Yahoo!). Les jeunes Sergey Brin et Larry Page vont changer la donne.

Tous deux fils de professeurs d’université en informatique et mathématiques, ils se retrouvent assez logiquement dans le département de sciences informatiques de Stanford pour effectuer leurs doctorats. Entre autres, ils sont chargés de travailler au développement d’une bibliothèque numérique. Leur recherche, financée par de l’argent public, les oriente vers un projet de cartographie du web. Avec l’aide de la gigantesque infrastructure de Stanford, qui a mis la moitié de sa bande passante à contribution, ils téléchargent plus de 70 millions de pages pour dessiner une carte du web.

Sergey Brin est fasciné par l’imbrication des pages web, dont les liens fonctionnent comme des citations de publications scientifiques. Le rapprochement entre leur projet de bibliothèque numérique et un moteur de recherche s’impose peu à peu. L’idée, construite conjointement avec leur professeur, consiste à reproduire le système de citation des publications scientifiques. Plus un article de recherche est cité par d’autres auteurs, plus il est jugé important, surtout s’il est cité par d’autres publications estimées. De même, plus un site web sera cité via des liens hypertextes, plus il aura des chances d’être pertinent. Classer les résultats d’une recherche par mot clé sur ces critères (plutôt que le nombre d’occurrences du mot en question) va permettre de révolutionner les moteurs de recherche. Page et Brin nomment leur algorithme “page rank”. Sa programmation est réalisée par un troisième étudiant de Stanford, Scott Hasan. Le principe sous-jacent s’inspire d’un algorithme similaire (RankDex) et son développement est le fruit d’une collaboration avec trois autres étudiants de Stanford. Le moteur de recherche ainsi créé est d’abord mis en ligne et hébergé sur les serveurs de l’Université. Scott Hasan quitte le projet quelque temps avant que Brin et Page décident de déposer les statuts de leur entreprise, qu’ils nomment Google, et de transférer le moteur de recherche sur un site privé, Google.com

Aidés par les réseaux Stanford et leurs parents, ils parviennent à lever un million de dollars et s’installent dans un garage de la Silicon Valley. Parmi les premiers investisseurs, on compte l’ancien cofondateur de Sun Microsystems passé par Stanford, Andy Bechtolsheim, ainsi qu’un certain Jeff Bezos. Les débuts restent délicats. Google ne dégage pas encore de revenus et nécessite des investissements importants pour faire face à la hausse spectaculaire du trafic. Les deux fondateurs tentent de revendre leur concept pour un million de dollars à Excite, un des principaux moteurs de recherche de l’époque, sans succès. Google survit à l’explosion de la bulle internet grâce aux quelque 25 millions de dollars apportés par les Venture Capitalist fin 1999, dont Sequoia Captial. Ce dernier exige l’embauche d’un PDG expérimenté pour gérer la jeune entreprise.

D’abord à contrecœur, Sergey Brin et Larry Page acceptent d’inclure de la publicité dans les résultats du moteur de recherche. L’entreprise rompt rapidement avec le modèle existant pour facturer les annonceurs au clic en mettant en place un système d’enchère, une innovation copiée sur un concurrent. La seconde rupture de Google vient de la décision de “scrapper” les données de ses utilisateurs, que ce soit les historiques de navigations ou les emails des clients, pour permettre un ciblage de plus en plus précis des publicités. Reproduisant la logique des crawlers, la firme enchaine les succès : son service de courrier électronique “gmail”, d’abord disponible sur invitation, est plébiscité par les clients qui louent la gratuité et le gigantisme de l’espace de stockage offert. Une générosité permise par le cash des investisseurs et les revenus générés par les publicités ciblées.

Google va ensuite scrapper l’ensemble des livres publiés (“google books”) puis des rues de toutes les villes (“google maps”, “street view”) et les photos aériennes (“google earth”) pour construire des outils grand public. Le succès va permettre de racheter YouTube, DeepMind et de nombreuses autres start-up et ainsi alimenter une croissance par acquisition. Une fois de plus, les mécanismes socio-économiques et la chaine continue d’innovation expliquent davantage le succès de Google que les aptitudes particulières de ses cofondateurs.

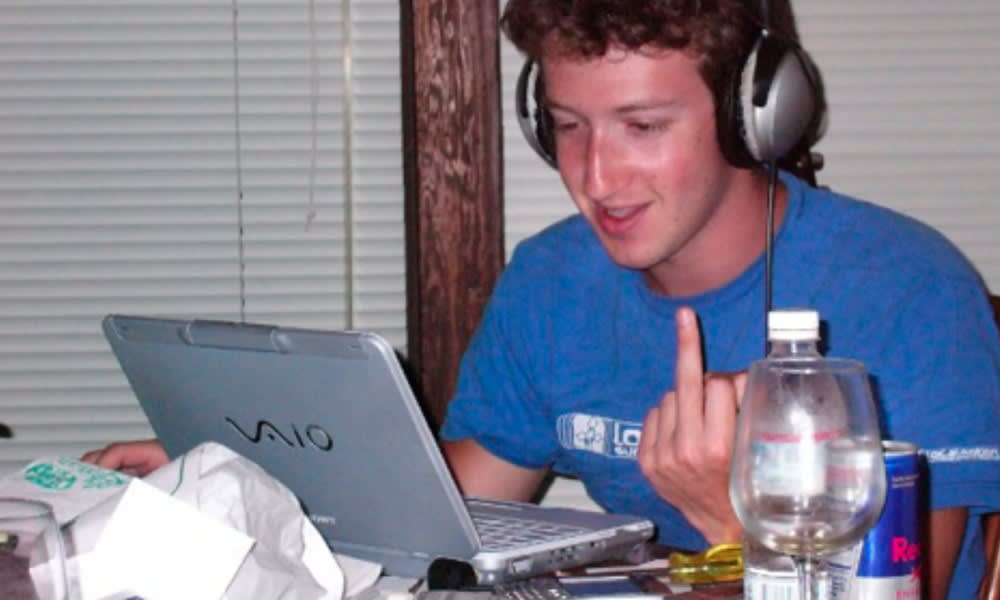

Au cours de la même décennie, un autre adepte des web crawler va incarner l’avènement du web 2.0. Mark Zuckerberg provient d’un milieu privilégié. Son père est un dentiste féru de technologie qui l’initie très tôt à l’informatique. Il lui offre un Atari avec des leçons de BASIC dès l’âge de dix ans puis lui paye des cours particuliers de programmation. Scolarisé dans un lycée privé prestigieux qui permet d’intégrer les grandes universités américaines, il suit les pas de sa sœur en étant à son tour admis à Harvard. Là, il expérimente avec les crawlers en scrappant le site web de l’Université où sont référencées les photos et identités des étudiants. Avec ses camarades de dortoir, il met en ligne Facemash, site douteux qui affiche aléatoirement deux images d’étudiant(e)s et propose au visiteur d’élire le plus attrayant(e). Le site est rapidement fermé et Zuckerberg convoqué en conseil de discipline.

Fort de ce succès, le jeune homme aurait été approché par deux autres étudiants de Harvard, les frères Winklevoss, pour programmer un réseau social reposant sur l’idée d’un annuaire numérique des étudiants de l’Université. Ces jumeaux deviendront eux-mêmes des pontes de la Silicon Valley en réinvestissant dans les cryptomonnaies l’argent touché suite à un procès pour plagiat intenté contre Facebook. Zuckerberg ne livre pas le travail, mais lance, avec quatre camarades de dortoir, son propre réseau social. The Facebook est en ligne en 2004. Initialement accessible uniquement à l’aide d’une adresse mail issue d’une université prestigieuse, il s’étend au-delà d’Harvard comme une trainée de poudre. Zuckerberg déménage logiquement dans la Silicon Valley où l’ancien fondateur du logiciel de partage en pair à pair Napster (ancêtre des sites de piratage type Pirate Bay, BitTorrent, etc.) le prend sous son aile. Un certain Peter Thiel investit un demi-million de dollars dans la start-up et aide Zuckerberg à lancer son entreprise.

Facebook n’était pas le premier réseau social ni même nécessairement le plus innovant. MySpace avait connu ses heures de gloire et d’autres réseaux avaient vu le jour dans des universités américaines (dont Stanford et même Harvard, si on compte le réseau des frères Winklevoss). Mais Zuckerberg a réalisé un “coup” en scrappant les adresses mail des contacts des premières centaines de milliers d’utilisateurs, ce qui lui a permis d’inonder leurs carnets d’adresses d’invitations. Le sentiment d’exclusivité initial a fait le reste. Si Facebook met en place diverses innovations, comme le “fil d’actualité”, c’est bien l’absence de scrupule pour monétiser les données de ses clients et l’argent des VC qui ont permis à Zuckerberg d’obtenir une position monopolistique et de racheter toute start-up susceptible de lui faire de l’ombre, dont Instagram et WhatsApp.

L’explosion de l’usage d’internet et l’émergence du Web 2.0 produisent des montagnes de données suscitant les convoitises. Une fois récupérées, elles permettent de bombarder les consommateurs de publicités ciblées. Cette petite révolution prend place dans un contexte de très forte augmentation des budgets publicitaires des grandes firmes. Un jeu à somme nulle pour l’économie qui s’explique par l’essoufflement du néolibéralisme, marqué par un ralentissement de la croissance et des gains de productivité. La crise de 2008 a aggravé ce constat, pour le plus grand bonheur de Facebook et Google. Sur les 160 milliards de chiffre d’affaires générés par Meta en 2024, plus de 97 % sont issus des revenus publicitaires, pour un bénéfice net de 65 milliards. La même année, Alphabet (la holding de Google) avait réalisé 350 milliards de chiffre d’affaires pour 100 milliards de dollars de bénéfices. Les trois quarts de ces revenus provenaient de la publicité.

La première victime de ce nouveau paradigme fut le journalisme. La migration des encarts publicitaires vers Google et Facebook prive les médias traditionnels d’une source majeure de revenus. La presse locale, pourtant essentielle d’un point de vue démocratique, voit des milliers de titres disparaitre. Pour ne pas subir le même sort, les grands journaux se font peu à peu racheter par des milliardaires acceptant de financer à perte des rédactions qu’ils transforment rapidement en organes d’influence.

La collecte et l’exploitation des données personnelles ne sont pas l’apanage des GAFAM. D’autres firmes se spécialisent dans ce commerce, dont le géant Axicom. Peu connus du grand public, ces acteurs construisent des profils extrêmement précis de tout individu susceptible d’intéresser une entreprise commerciale. Le pouvoir politique joue également un rôle important pour encadrer les pratiques, notamment via des décisions de justice rendues par les tribunaux américains et défendues par le ministère de la Justice. Le partage de fichier pair-à-pair qui menace l’industrie musicale via Napster est rapidement interdit, tandis que la collecte et monétisation des données privées est encouragée.

Une telle capacité de collecte d’information est exploitée par les gouvernements, à commencer par celui des États-Unis. Dans le contexte législatif et politique post 11 septembre et au nom de la lutte contre le terrorisme, la NSA construit un gigantesque système d’écoute et d’espionnage particulièrement intrusif, comme le révèlera le lanceur d’alerte Edward Snowden. Toutes les grandes firmes de la Silicon Valley participent activement à ce système.

Si le démocrate Bill Clinton et son vice-président Al Gore, qui siègera par la suite au Conseil d’administration d’Apple, ont joué un rôle significatif dans le mouvement d’ouverture et de privatisation d’Internet, l’administration Bush junior sera le fer de lance de l’appareil sécuritaire. La candidature Bush/Chenney avait été adoubée par les réseaux Hoover lors d’une rencontre déterminante à San Francisco en 2000. Après le 11 septembre, Larry Ellison (Oracle) tente de convaincre Washington de mettre en place une gigantesque base de données de fichage des Américains. Son projet n’est pas retenu, mais Oracle récupère de nombreux contrats avec la CIA et voit ses profits doubler en quelques années. Plus tard, ce sera au tour de Palantir et d’autres entreprises financées par Peter Thiel de se tailler la part du lion dans le gâteau de l’appareil sécuritaire.

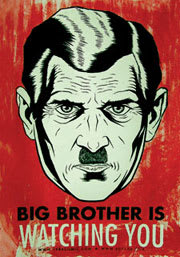

Dans les années 1970, l’avènement de l’informatique suscitait une méfiance aiguë du grand public, pour qui les ordinateurs évoquaient le roman 1984 et son télécran. Apple avait détourné cette image dans une publicité culte pour lancer son Macintosh, censé incarner l’anti Big Brother. Vingt ans plus tard, Larry Page et Sergey Brin firent inscrire leur devise “Don’t do Evil” sur le campus de Google juste avant son introduction en bourse. Pourtant, c’est bien la démocratisation des smartphones et de l’internet 2.0, propulsée par Google et Apple, qui va déboucher sur le “capitalisme de surveillance” bientôt augmenté par l’intelligence artificielle via la surveillance audio et vidéo (y compris privée, avec des appareils connectés comme les assistants “Alexa” et les interphones “Ring” popularisés par Amazon). Des marchés trop juteux pour être boudés par Google et ses pairs, devenus des fournisseurs de gouvernements toujours plus autoritaires. Pour autant, la sécurité et la publicité ne sont pas les seuls domaines où se déploient ces outils de surveillance. Le lieu de travail constitue une autre cible. À ce titre, aucune firme n’a été aussi loin qu’Amazon dans le flicage de ses employés.

2) Amazon et les data centers : la matérialisation du numérique

Fils d’ingénieurs, Jeff Bezos avait dix ans d’expérience dans la finance et la gestion de fonds spéculatifs lorsqu’il fonde Amazon avec son épouse. Impressionné par la croissance d’Internet, il cherchait à lancer un commerce en ligne et décide de débuter par les livres, pour des raisons purement pratiques. Ses parents investissent près de 300 000 dollars dans l’entreprise, qui débute les livraisons en 1994. Pour réaliser des économies d’échelles, Amazon investit rapidement dans ses propres entrepôts et circuits de distribution. Les levées de fonds successives lui permettent de racheter divers concurrents et de grandir par acquisition avant de réaliser une introduction en bourse prometteuse en 1997. Le cash ainsi obtenu et les premiers bénéfices sont systématiquement réinvestis dans toujours plus d’infrastructures, afin d’atteindre une taille critique et de s’attaquer à d’autres marchés (la musique, les DVD et de plus en plus d’objets). Pour mettre en place sa logistique, Bezos débauche de hauts responsables du géant de la grande distribution Walmart, qui attaquera Amazon en justice pour vol de secret commercial. Ces efforts n’empêchent pas la faillite de nombreuses filières d’Amazon pendant l’explosion de la bulle .com. Mais une vente d’obligations bien sentie à des investisseurs européens crédules, réalisée juste avant la crise internet, permet de maintenir l’entreprise à flot.

Passé la tempête, la croissance repart à la hausse et Amazon finalise son modèle de “distribution A à Z”, avec ses gigantesques entrepôts permettant d’acheminer en 24 heures à peu près n’importe quelle marchandise dans n’importe quelle banlieue aisée des États-Unis. L’abonnement à Amazon prime, service de livraison express, séduit jusqu’à 80 % des ménages américains disposant d’un revenu supérieur au salaire moyen, soit des dizaines de millions de clients payant un abonnement annuel de 100 dollars. Amazon.com devient une plateforme incontournable par laquelle transite quelque 30 % du commerce en ligne. Cette position dominante permet d’extraire une rente en fixant des prix élevés aux clients tout en exigeant de très larges commissions aux vendeurs.

Comment Bezos est-il parvenu à construire un tel monopole ? Décrit comme un manager brutal dont le rire serait “un croisement entre un éléphant en rut et une scie sauteuse”, Jeff est obsédé par l’optimisation. Les employés des centres de manutention d’Amazon sont soumis à des cadences infernales, calculées à l’aide des données collectées par une armée de capteurs, optimisées par l’Intelligence artificielle et imposées par des systèmes de commandes vocales. Le recours toujours plus important aux automates permet d’accélérer les cadences et de contraindre les employés à s’y plier. Certains témoignent d’expérience de sortie de corps similaires à celles vécues par les esclaves dans les champs de coton à la fin de leur journée d’exploitation. Résultat, le taux d’accident de travail est 45 % plus élevé que dans le reste du secteur et Amazon subit un turn-over de plus de 150 %. Cela signifie que la totalité de ses ouvriers est remplacée tous les huit mois. La firme déploie également des tactiques brutales et illégales reposant sur des outils de surveillance électronique pour empêcher l’implantation de syndicats dans ses centres de manutention. Tout est optimisé : les recrutements et licenciements sont automatisés (le taux d’erreur est compensé par les économies réalisées par la suppression de toute intervention humaine, selon un dirigeant de la firme). Les conducteurs des camionnettes sont recrutés via une plateforme de sous-traitance, ce qui permet à Amazon de se dégager de toute responsabilité face au taux d’accidents anormalement élevé. Les cadences sont si rapides que les chauffeurs ont pour habitude d’uriner dans des bouteilles en plastique pour gagner du temps. Un phénomène également observé dans les entrepôts.

Chez les cadres, le turn-over est à peine moindre et le taux de burn-out bat des records. “Tous les gens avec qui j’ai travaillé ont pleuré à leur bureau au moins une fois” témoignait un cadre de l’entreprise en 2021. Autrement dit, le succès d’Amazon tient moins dans son usage de la technologie que dans sa volonté d’user jusqu’à l’épuisement ses travailleurs, comme Leland Stanford usait ses pure-sang en 1880 et Steve Jobs provoquait des vagues de suicides chez ses sous-traitants.

Malgré son cout humain terrifiant, les marges de l’activité d’e-commerce restent modestes. La principale source de profit de la firme provient d’une autre activité liée aux infrastructures physiques. Et c’est par accident que Jeff Bezos va découvrir cette poule aux œufs d’or.

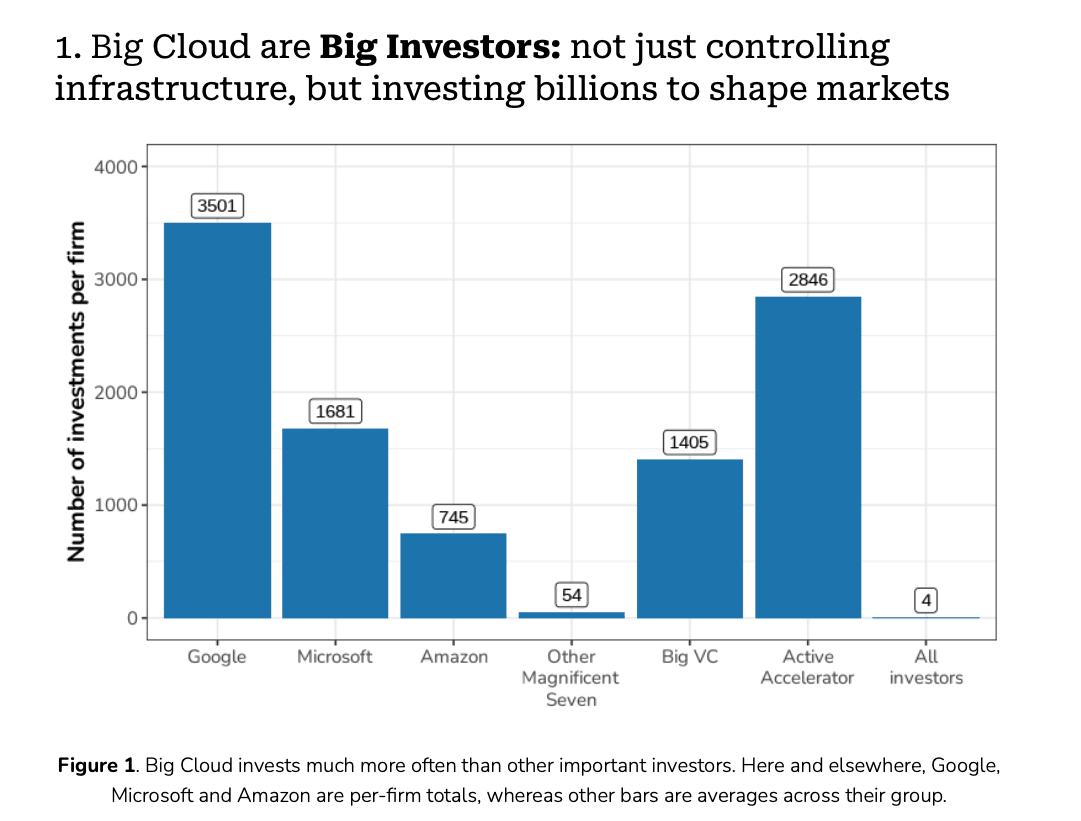

Pour faire fonctionner son gigantesque site web et faire tourner la plateforme logistique qui l’alimente, Amazon investit dès le début des années 2000 dans d’importantes infrastructures informatiques. Elle en fait profiter certains fournisseurs, par nécessité de les intégrer à son système de distribution. Amazon découvre ainsi l’appétit des entreprises pour ces services de could computing reposant sur de gigantesques data centers. La sous-traitance de l’infrastructure informatique (hébergement de sites web, serveurs, données, capacité de calcul) permet d’externaliser les couts associés au numérique et d’éviter aux PME d’avoir à développer leurs propres capacités informatiques. Amazon ouvre peu à peu ce service à toutes les entreprises et dépense des milliards de dollars pour construire l’infrastructure nécessaire. Baptisée AWS (Amazon Web Services), la filiale en charge de cette activité obtient progressivement une position de leader permettant de réaliser des économies d’échelle conséquentes.

En 2024, plus de la moitié des 60 milliards de bénéfices d’Amazon proviennent d’AWS, pour “seulement” 100 milliards de chiffres d’affaires sur les 640 milliards de la firme. Ce succès va permettre à Amazon et ses principaux concurrents (Microsoft Azure et Google Cloud) d’obtenir une position de force pour tirer profit du boom de l’Intelligence artificielle, particulièrement gourmande en data centers. Or, dans les années 2000 et 2010, ce pari effectué “par hasard” n’allait pas de soi. La tendance était plutôt à la précarisation accélérée du travail via un capitalisme de plateforme dont le porte-étendard allait donner son nom au phénomène en question.

3) De l’Ubérisation à l’enshitification: le capitalisme de plateforme

Depuis qu’ils avaient revendu leur start-up pour quelques millions de dollars, Travis Kalanick et Garret Camp passaient le plus clair de leur temps à fréquenter les cercles de riches entrepreneurs de la Tech à la recherche d’une nouvelle opportunité. Fatigué de payer des taxis à prix d’or pour se rendre en soirée, Camp imagine un service de mise en relation de chauffeurs privés permettant de partager la course avec d’autres clients. Il met au point une ébauche d’application et convainc Kalanick, généralement décrit comme un “connard” “à l’égo démesuré”, de l’aider à recruter un PDG et lancer l’entreprise. Les deux amis ne comptaient pas s’investir durablement dans le projet, comme le reconnaitra Kalanick : « Nous étions en mode “mec, je ne veux pas gérer une entreprise de limousine. Je veux juste une voiture qui puisse me transporter où je le souhaite. On doit trouver quelqu’un qui puisse s’installer dans une ville comme San Francisco et gérer le truc (…) pour que Garett puisse parader à travers la ville comme un pimp». UberCab voit le jour en 2010. La clientèle initialement visée se limite au cercle d’amis des cofondateurs : les jeunes entrepreneurs et cadres supérieurs de la Silicon Valley. Le mot d’ordre était “mieux qu’un taxi, moins cher qu’une limousine”.

Avec une approche diamétralement opposée, Logan Green et John Zimmer fondent Lyft en 2012. Green a grandi à Los Angeles et ses bouchons interminables. En voyage au Zimbabwe, il observe avec fascination un système de partage de taxis qu’on retrouve dans de nombreux pays en voie de développement. Au lieu de prendre un client à la fois, la majorité des véhicules sont continuellement occupés par plusieurs usagers se rendant à des destinations différentes, ce qui divise le prix de la course. De son côté, John Zimmer avait mis au point une première société d’aide au covoiturage en 2007, après avoir connu des difficultés à en trouver entre Santa Barbara et Los Angeles lorsqu’il était étudiant. En lançant Lyft, les deux hommes espèrent utiliser les fonctionnalités offertes par les smartphones pour reproduire ce que les taxis africains et les étudiants californiens font spontanément. Un mélange de taxi-brousse, covoiturage et autostop, en quelque sorte.

Malgré des points de départ radicalement différents, Uber et Lyft finissent par converger vers le même modèle économique : un service de taxis à prix cassés. Lyft est la première entreprise à recruter des chauffeurs ne disposant d’aucune licence professionnelle. Lorsqu’Uber réalise que les autorités laissent faire, Kalanick abandonne sa stratégie de VTC élitiste pour se ruer à l’assaut des “cartels de taxis”. Le nouveau PDG d’Uber dispose de deux atouts : un mépris total des lois et autorités locales et une capacité redoutable à lever des fonds auprès des VC. Peu importe le fait que sa première start-up, un service de partage de fichier de pair-à-pair à la légalité douteuse, n’ait jamais été rentable ni bénéficié à l’entreprise l’ayant rachetée en 2009. De même, le fait que StumbleUpon, un moteur de recherche aléatoire revendu par Garret Camp à eBay la même année, s’est avéré être un concept bidon ne gêne personne. L’important, du point de vue des Venture-Capitalists, c’est que les deux hommes aient enrichi leurs investisseurs. Avec Uber, nos jeunes entrepreneurs vont rapidement crouler sous les capitaux.

Leur principale innovation consiste à permettre de commander un taxi à l’aide d’un smartphone via le système de géolocalisation. La prise en charge et le paiement sont facilités, aussi bien du point de vue des clients que de celui des chauffeurs. Pourtant, ce n’est pas ce progrès qui explique les tarifs ultra-compétitifs d’Uber. Diverses études ont montré que les couts de fonctionnement d’un Uber sont supérieurs à ceux d’une entreprise de taxi traditionnel.

Ces dernières mutualisent de nombreuses charges : achat de carburant à prix de gros, entretien de la flotte, assurance maladie et sociale des chauffeurs, assurances des véhicules… Autant de couts transférés aux chauffeurs Uber opérants sous statut d’autoentrepreneur. Ces derniers doivent aussi absorber les charges fixes de la multinationale (salaires mirobolants et stock options du comité de direction, salaires à six chiffres des ingénieurs, bureaux flambants neufs dans de nombreuses villes, dépenses en R&D dans des projets non rentables comme la voiture autonome ou les véhicules volants). De plus, l’efficacité de l’application Uber en termes de prise en charge des clients n’est pas toujours significativement supérieure à celle d’un système d’allocation des courses d’une entreprise de taxi traditionnelle. Dans de nombreuses villes densément peuplées (New York, le centre de San Francisco, Chicago, Londres, Paris…), le temps d’attente d’un taxi conventionnel excédait rarement celui d’un Uber. Et ces sociétés ont rapidement adopté des applications similaires pour faire face à l’irruption du concurrent californien. En clair, ce n’est pas grâce à sa technologie qu’Uber s’est imposé face aux taxis.

Ceux-ci sont régulés pour des raisons historiques précises : permettre aux chauffeurs de gagner correctement leur vie et éviter une congestion des centres-ville en cas d’excès d’offre. Pour casser ces monopoles, Uber commence par inonder les villes de VTC afin de faire baisser les prix. Dans ce but, l’entreprise a recours à diverses tactiques révélées par la parution des Uber Files et autres enquêtes journalistiques : lobbyisme intense, études économiques truquées pour convaincre les politiciens et la presse de l’avantage de leur modèle en termes d’emplois et d’amélioration du transport urbain, choix conscient de violer les lois existantes en attendant que les autorités locales interviennent, décisions d’ignorer purement et simplement certaines injonctions, mise en place de systèmes informatiques pour tromper les autorités locales et échapper à leur contrôle, fausses promesses pour débaucher des chauffeurs de taxi. Selon l’adage “move fast and break things”, Uber débarque dans une ville sans en informer les autorités, attend qu’elles légifèrent pour répondre au chaos provoqué, ignore les nouvelles lois puis poursuit son lobbying pour convaincre le législateur de changer les régulations en sa faveur. Mais surtout, l’entreprise pratique la concurrence déloyale en subventionnant massivement les courses. En 2017, le prix payé par le client couvrait moins de 50 % du cout réel. Vendre à perte en prétendant que la tarification proposée découle d’avantages technologiques permet d’écraser la concurrence, en détruisant le niveau de vie et les emplois des chauffeurs de taxi conventionnels au passage. Cette attaque en règle a provoqué des vagues de suicides et de violence tout en ruinant d’innombrables chauffeurs qui s’étaient endettés pour acheter leurs licences ou comptaient sur leur revente pour payer leurs retraites.

Seul un flux continu de capitaux pouvait permettre à Uber de mener une telle guerre des prix tout en étendant ses opérations exponentiellement à travers le monde. Malgré des pertes records, la start-up a continué d’attirer les investisseurs, y compris en provenance de sources aussi contestables que la Russie ou les monarchies du Golf. Uber a également profité indirectement des subventions publiques, puisque le capital-risque californien bénéficie de diverses niches fiscales.

Plus de 33 milliards de dollars sont engloutis avant que l’entreprise devienne rentable. Les premiers bénéfices ne découlent pas des économies d’échelle, mais de la hausse graduelle du prix des courses et la baisse encore plus spectaculaire de la rémunération des chauffeurs. Selon la banque JP Morgan, leur rémunération avait déjà été divisée par deux entre 2013 et 2017. Une autre étude de 2018 a déterminé que 90% des travailleurs américains gagnaient plus qu’un chauffeur Uber. Depuis, la multinationale aurait adopté un système dynamique de détermination des prix basés sur le profil des clients et chauffeurs. Reposant sur la montagne de données collectées par l’application, il permet d’augmenter le prix pour les usagers susceptibles d’accepter des tarifs plus élevés et de baisser la rémunération d’une course pour un chauffeur docile. Une manière supplémentaire de comprimer les salaires tout en constituant un recul du point de vue des usagers. Aux États-Unis et depuis 2018, ces derniers ont vu Uber augmenter le prix des courses quatre fois plus vite que l’inflation. Tout cela pour des gains modestes du point de vue des investisseurs, les bénéfices actualisés d’Uber étant encore très largement inférieurs aux pertes engrangées pendant ses 13 premières années d’existence.

La technologie Uber devait permettre de générer des emplois et de réduire les embouteillages tout en diminuant les émissions de gaz à effet de serre en réduisant le nombre de véhicules sur les routes, selon les arguments déployés par les lobbyistes de la firme. En réalité, toutes les études s’accordent sur le fait qu’Uber a augmenté le nombre de kilomètres parcourus, le nombre de véhicules en circulation, les émissions de C02 et les embouteillages dans les centres urbains. Les usagers d’Uber sont majoritairement des personnes qui auraient autrement utilisé un transport en commun, le vélo ou la marche. Et 5 % d’entre eux ne se seraient tout simplement pas déplacés, selon une étude réalisée sur la ville de Boston.

Le succès d’Uber tient dans sa capacité à augmenter la demande de transport de type VTC au détriment des alternatives moins polluantes, tout en diminuant la productivité du secteur. Comme le détaille l’économiste Aaron Benanav, les travailleurs ubérisés parviennent à augmenter la demande pour leur service en baissant leurs salaires, sans que ce regain d’activité augmente la productivité ou profite au reste de l’économie. Uber a ainsi mis au point un modèle d’exploitation des travailleurs, nommé “ubérisation” en français, qui sera répliqué par de nombreuses entreprises dans de multiples secteurs liés aux services. Parmi les plus connus, citons Airbnb. L’entreprise a aggravé la crise du logement en augmentant le prix de l’immobilier tout en provoquant de nombreuses nuisances qui ont conduit diverses villes à limiter ou interdire sa présence.

Que ce soit pour livrer des repas, organiser des covoiturages, proposer des soins à domicile ou conduire des véhicules, les principes de bases sont les mêmes : exploiter la main-d’œuvre en convertissant des emplois salariés en statut d’autoentrepreneurs ne bénéficiant d’aucune protection sociale, salaire minimum ou représentation syndicale. Puis obtenir une position de monopole pour augmenter le prix payé par les usagers et baisser les revenus des travailleurs tout en détériorant le service (un phénomène plus largement commun au système de “plateforme” et désormais popularisé par le terme “d’enshitifcation” ou “merdification”).

Face à cette attaque en règle, de nombreux travailleurs luttent pour obtenir de meilleures conditions, avec des succès plus ou moins notables. À New York, ils ont obtenu le droit à un salaire horaire minimum. En Californie, le parlement avait voté la qualification des travailleurs ubérisés en salariés, avec tous les droits que cela octroie. Uber et ses concurrents ont dépensé une petite fortune pour déposer un référendum citoyen, la Proposition 22, visant à faire annuler cette loi. Les Californiens, trompés par les discours d’Uber et ses pairs, ont voté à 55 % en faveur d’Uber, entérinant l’ubérisation du travail dans ce qui constitue le recul le plus significatif des droits des travailleurs américains depuis la loi antisyndicale Taft-Hartey de 1947.

Si Uber a servi de support pour imposer cette régression, celle-ci ne résulte pas exclusivement de la volonté de ces cofondateurs, mais bien des forces économiques et historiques à l’œuvre. Interrogé sur les dizaines de milliards de dollars de capitaux levés par Uber, Kalanick avait répondu candidement “si nous ne l’avions pas fait, cela nous aurait placés en désavantage vis-à-vis de la concurrence, particulièrement lorsqu’on opère partout dans le monde (…) ce n’est pas ma manière préférée pour bâtir une entreprise, mais c’est indispensable lorsque ces sommes d’argent sont disponibles”. Autrement dit, si ce n’avait pas été Uber, cela aurait été Lyft ou une autre firme.

À la sortie de le la crise des subprimes et jusqu’en 2022, les taux d’intérêt historiquement bas ont généré un surplus de liquidités dans les sphères financières tout en diminuant les rendements des placements plus traditionnels. La Silicon Valley représentait le meilleur endroit pour placer du capital et trouver des rendements attrayants. Pour garantir ces derniers, les investisseurs ne peuvent compter que sur deux options : exploiter le travail ou augmenter la productivité par l’innovation. Or, cela fait longtemps que la Valley n’est plus capable de choisir la seconde option.

Dans les années 1980, l’économiste libéral Robert Solow avait formulé un paradoxe qui prendra son nom en notant “on observe les microordinateurs partout, sauf dans les chiffres de la productivité”. La révolution informatique puis numérique n’a pas permis de retrouver les taux de croissance de l’après-guerre ni de produire les gains de productivité induits par les révolutions industrielles précédentes. Depuis, le capitalisme de plateformes mis en place par Google, Facebook, Amazon, Uber et consort fait encore pire. Il agit essentiellement comme une machine à extraire de la rente au détriment du reste de l’économie, dans une forme de jeu à somme nulle que certains économistes qualifient de technoféodalisme. Si cette notion reste discutable, elle s’accompagne d’une radicalisation progressive de la Silicon Valley derrière un mouvement anti-démocratique et réactionnaire, tandis que les anciens leaders du secteur laissent place à une véritable mafia peuplée de charlatans et d’escrocs. Ce glissement vers le capitalisme de connivence et le technofascisme intervient en plein boom de l’Intelligence artificielle, laissant craindre le pire en termes de concentration de pouvoir et de libertés individuelles…

Ceci clôt la troisième partie de cette série. La dernière sera en ligne à partir de lundi sur mon site “faketech.fr”. Pour ne pas manquer sa publication, vous pouvez vous abonner gratuitement à cette newsletter. Et pour soutenir mon travail, pensez à m’offrir un café ici.

Pour les lecteurs les plus curieux ou pointilleux (je vous vois !), voici une liste non exhaustive de mes principales sources mobilisées au long de la série :

Anatomie d’une bulle, Dr Thomas Gerbaud, Dr Antoine Gerbaud. 2023

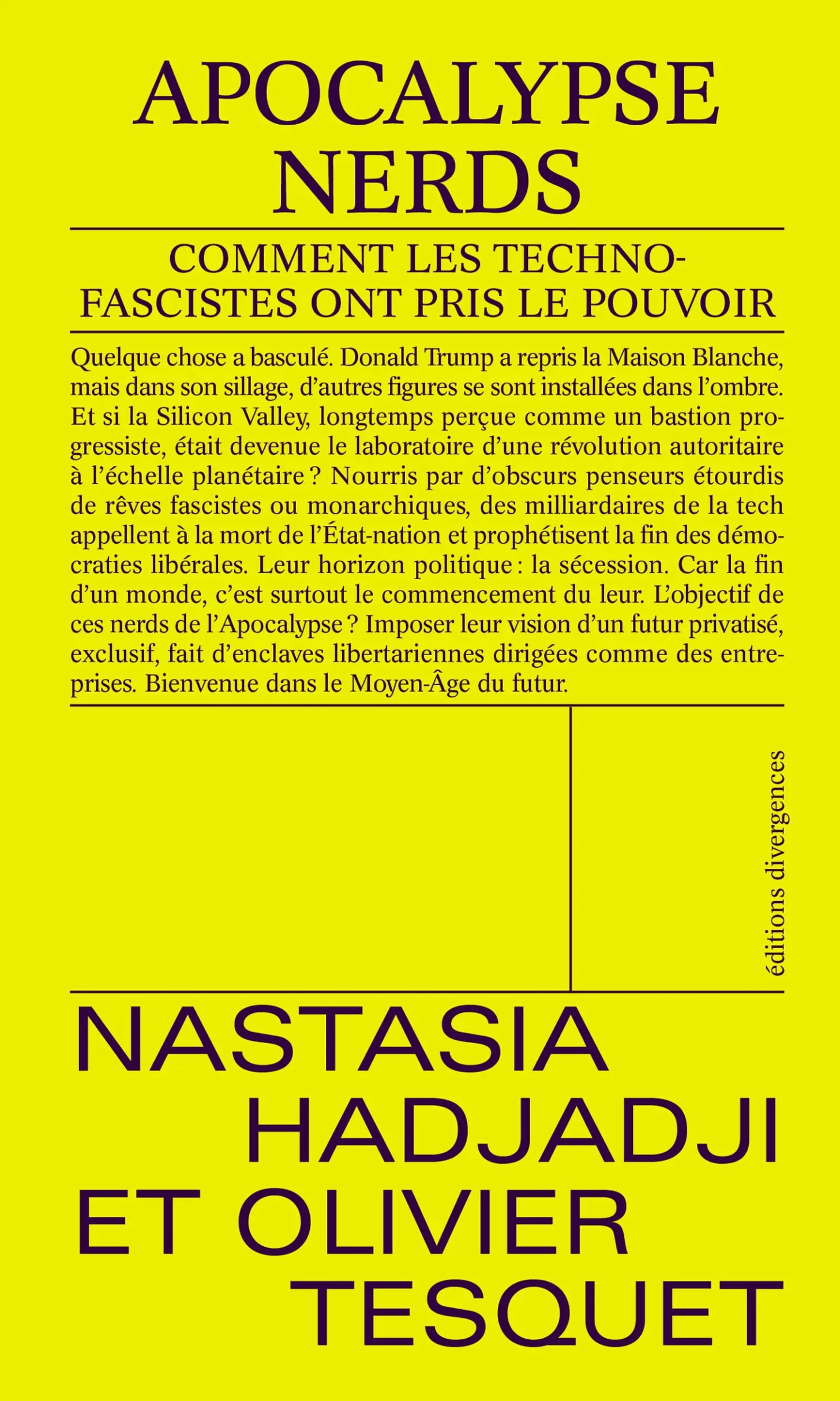

Apocalypse Nerds : Comment les technofascistes ont pris le pouvoir, Nastasia Hadjadji et Olivier Tesquet. Éditions Divergences, 187 pages, 2025.

A City on Mars : Can We Settle Space, Should We Settle Space, and Have We Really Thought This Through?, Kelly and Zach Weinersmith. Penguin Press, 448 pages, 2023.

A People’s History of the United States : 1492–Present, Howard Zinn. Harper Perennial Modern Classics, 784 pages, 2005.

Automation and the Future of Work, Aaron Benanav. Verso Books, 256 pages, 2020

Blood in the Machine, Brian Merchant (substack).

Character Limit : How Elon Musk Destroyed Twitter, Kate Conger et Ryan Mac.

Penguin Press, 430 pages, 2024.Davos Man - How the Billionaires Devoured the World, Peter S. Goodman, Mariner Books, 440 pages, 2022.

Elon Musk, Walter Isaacson. Simon & Schuster, 688 pages, 2023.

Elon Musk : Tesla, SpaceX, and the Quest for a Fantastic Future, Ashlee Vance. HarperCollins, 392 pages, 2015.

Empire of AI : Dreams and Nightmares in Sam Altman’s OpenAI, Karen Hao.

Penguin Press, 496 pages, 2025.En attendant les robots : enquête sur le travail du clic, Antonio A. Casilli.

Éditions du Seuil, 400 pages, 2019.Le mythe de l’entrepreneur : Défaire l’imaginaire de la Silicon Valley, Anthony Galluzzo.

Éditions La Découverte, 240 pages, 2023.Liftoff : Elon Musk and the Desperate Early Days That Launched SpaceX, Eric Berger.

William Morrow (HarperCollins), 288 pages, 2021.Ludicrous : The Unvarnished Story of Tesla Motors, Edward Niedermeyer.

BenBella Books, 288 pages, 2019.No Crypto : Comment Bitcoin a envoûté la planète, Nastasia Hadjadji.

Éditions Divergences, 220 pages, 2023.Palo Alto : A History of California, Capitalism, and the World, Malcolm Harris.

Little, Brown and Company, 720 pages, 2023.Road to Nowhere : What Silicon Valley Gets Wrong About the Future of Transportation, Paris Marx. Verso Books, 272 pages, 2022.

Steve Jobs, Walter Isaacson. Simon & Schuster, 656 pages, 2011.

Une histoire de la conquête spatiale : Des fusées nazies aux astrocapitalistes du New Space, Irénée Régnauld, Arnaud Saint-Martin. La Fabrique, 316 pages, 2024.

Un taylorisme augmenté - critique de l’intelligence artificielle, Juan Sebastián Carbonell, Éditions Amsterdam, 2025

Zero to One : Notes on Startups, or How to Build the Future, Peter Thiel et Blake Masters. (Penguin Random House), 224 pages, 2014.

Articles de presse divers (Jacobin, Wired, The New York Times…).

Wikipédia, articles de presse cités par Wikipédia.

13.10.2025 à 07:38

Une brève Histoire de la Silicon Valley (2/4)

Christophe @PoliticoboyTX

Texte intégral (11257 mots)

Bienvenue dans cette “Brève Histoire de la Silicon Valley”, une série en quatre articles pour comprendre comment cette région du monde est devenue le cœur du capitalisme contemporain. D’où vient la Tech et où nous amène-t-elle ? Comment fonctionne l’innovation ? Nous tentons d’explorer ces questions et de nombreuses autres à travers ce long format. Le premier épisode est à découvrir ici, le suivant là.

Pour soutenir mon travail, vous pouvez vous abonner à cette newsletter ici où m’offrir un café là. Sur ce, je vous souhaite une bonne lecture !

* Partie 2 : la révolution numérique n’aura pas lieu *

1) Steve Jobs et Bill Gates : de la contre-culture aux monopoles informatiques (1975-2000)

L’émergence des ordinateurs s’est accompagnée de mouvements de résistance, sabotage et protestation. Initialement caractérisées par de gigantesques unités centrales (“main frame”), les premières machines provoquaient la méfiance du grand public. Elles étaient associées à l’industrie de l’armement, aux grandes entreprises, agences gouvernementales et autres organisations nécessitant le traitement de larges quantités de données. Dans les campus californiens, des bâtiments abritant de tels équipements ont été brulés ou attaqués à la bombe par des étudiants protestant contre le rôle joué par leurs Universités dans le développement d’une technologie associée à la guerre et au contrôle.

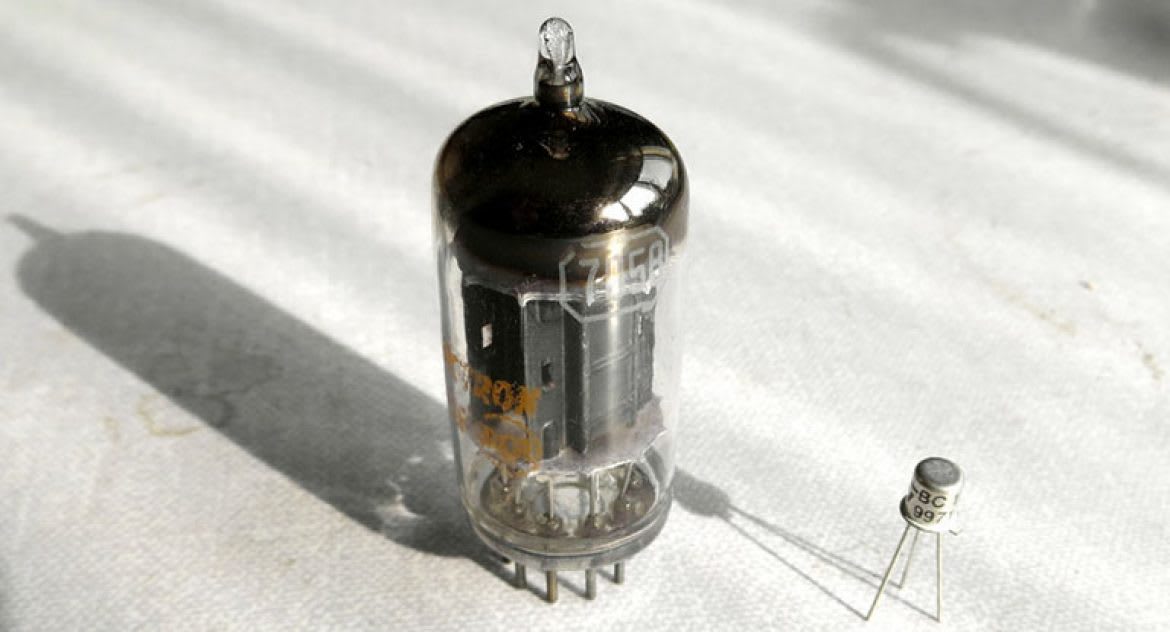

En 1974, le romancier Arthur C. Clark explique aux caméras d’ABC News que dans un futur proche, chaque famille disposera d’un petit ordinateur de bureau. Avec la miniaturisation progressive des composants et la chute de leurs prix, l’avènement de la micro-informatique était largement anticipé. Pourtant, IBM et les leaders du secteur n’imaginaient pas de débouchés pour ce type d’usage. En 1969, le visionnaire Gordon Moore (cofondateur d’Intel) avait rejeté un projet de mise au point d’un micro-ordinateur. Le seul usage personnel qu’il envisageait étant le stockage de recettes de cuisine. “Et je n’imaginais pas ma femme cuisiner en consultant un ordinateur”, expliquera-t-il plus tard.

Ce contexte explique pourquoi l’avènement de l’ordinateur personnel a été facilité par des individus ancrés dans la contre-culture hippie des années 1960. Des geeks, hackers et passionnés, parfois adeptes de trips sous acide. Pour eux, l’ordinateur pouvait être un instrument révolutionnaire, émancipateur et démocratique. L’usage de substances psychédéliques, qui avait également fait l’objet de recherches universitaires en Californie, s’inscrivait dans une logique similaire d’augmentation de l’homme et de libération de l’individu.

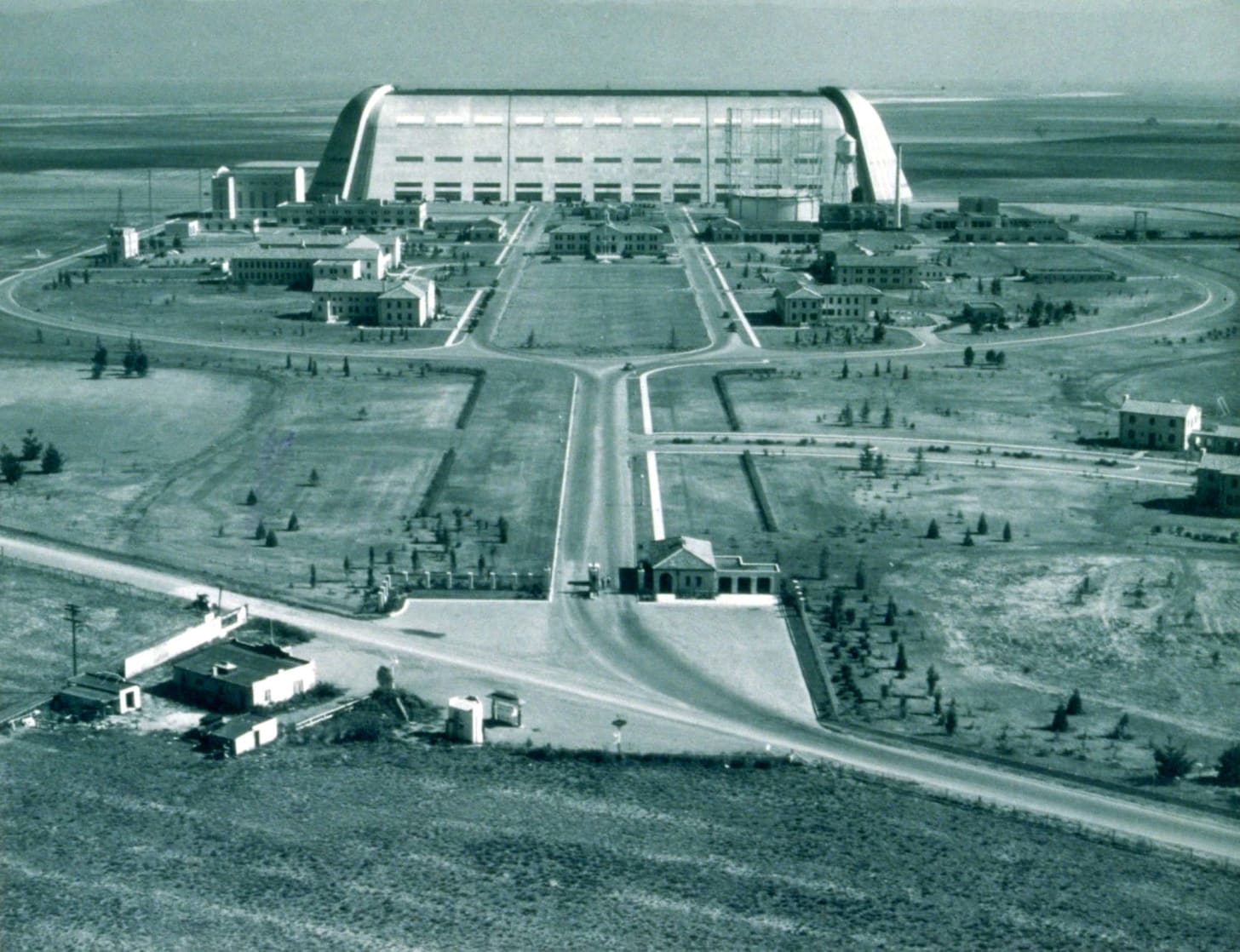

Dès 1965, une équipe d’étudiants et de chercheurs rejoint le SRI (Stanford Research Institute) pour travailler sur la micro-informatique. Financé par le DARPA (Defense Advanced Research Projects Agency - le programme de recherche du ministère de la Défense), le laboratoire est dirigé par un certain Douglas Engelbart. Diplômé de Berkley et fasciné par l’idée d’augmentation de l’homme par la machine, il a été influencé par les travaux de Joseph Licklider, psychologue au MIT, et les écrits de Venmar Bush, un haut fonctionnaire du ministère de la Défense. Engelbart avait attiré l’attention des décideurs qui le financeront en publiant un rapport sur le potentiel “d’un ordinateur comme outil personnel à l’usage individuel” pour le compte de la NASA. En 1968, au cours de ce qui sera surnommé la “mère de toutes les démos”, Engelbart fait la démonstration des inventions de ses équipes : une souris et une interface graphique permettant de réaliser la première visioconférence, d’envoyer le premier e-mail et d’effectuer du traitement de texte s’affichant directement sur un écran. Xerox débauche une partie de son équipe pour fonder le Xerox PARC à Palo Alto. Situé sur le campus de Stanford, une des missions de ce centre de recherche est le développement d’un ordinateur personnel. L’Alto voit le jour en 1973. Ce premier ordinateur doté d’une souris, d’un clavier et d’une interface graphique permettant de réaliser du traitement de texte reste très onéreux. Xerox refuse de le commercialiser : avec son système de revendeur, ses grands comptes professionnels, ses commerciaux aux salaires mirobolants et ses ouvriers syndiqués, la multinationale n’a pas la capacité organisationnelle pour distribuer un tel produit, dont le coût des composants reste prohibitif.

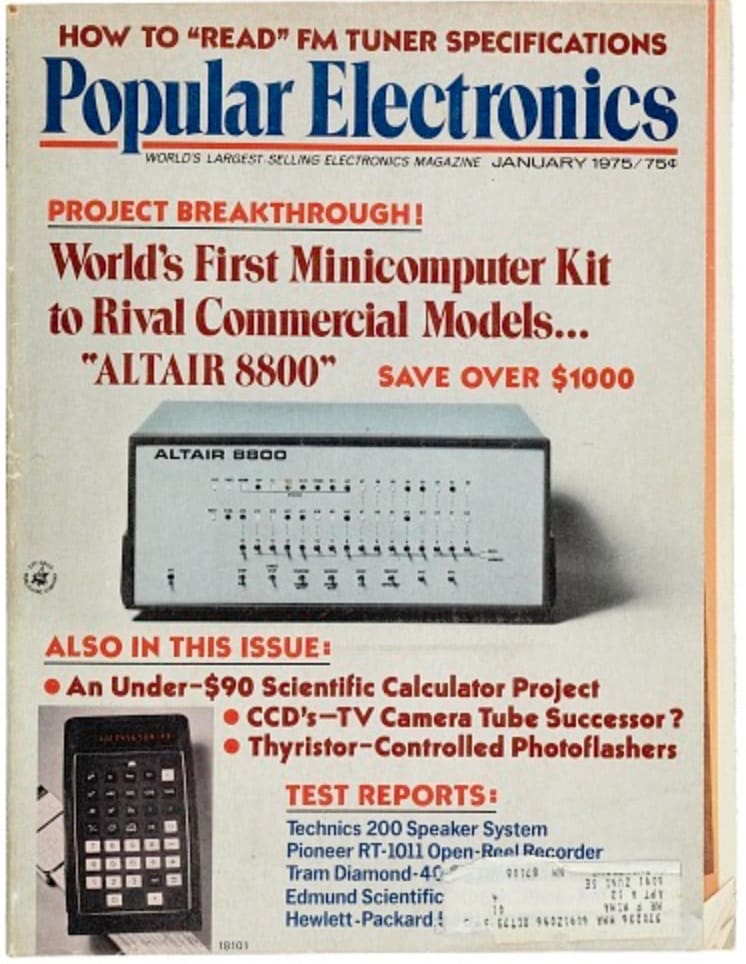

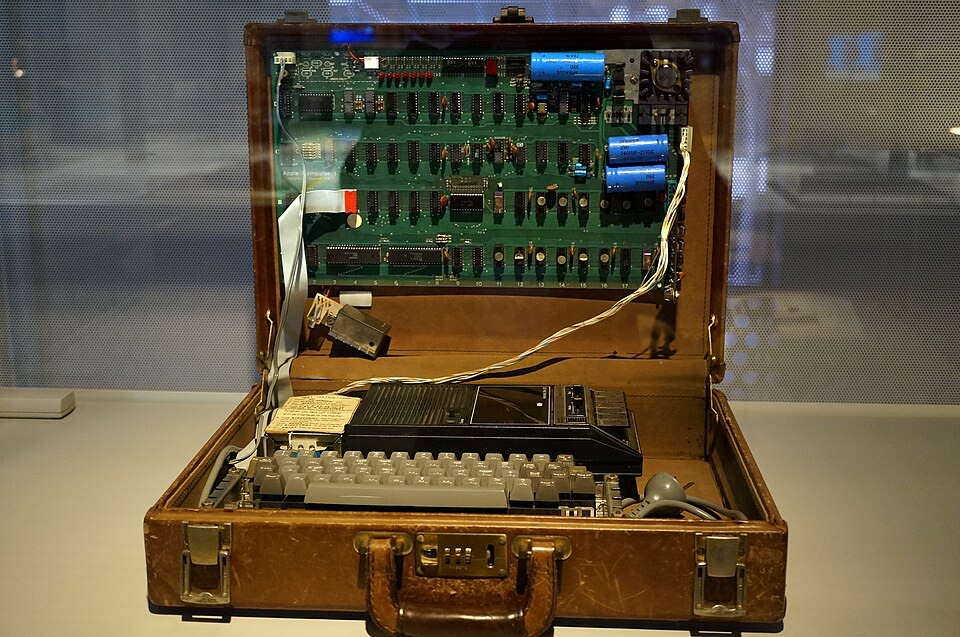

La même année, le Micral devient le premier ordinateur personnel piloté par un microprocesseur à être commercialisé. Il est mis au point par deux ingénieurs français, mais ne sera jamais produit à grande échelle, faute de capitaux. Quelques mois plus tard, MITS, une start-up basée à Albuquerque et spécialisée dans la vente de kits électroniques pour passionnés, sort le premier ordinateur en kit abordable : l’Altair 8800, basée sur le microprocesseur Intel 8800. Le lancement fait la couverture du magazine Popular Electronics. Il est vendu sans logiciel et ne peut pas faire grand-chose, mais suscite un enthousiasme considérable au sein de la communauté de hackers, geeks et passionnés.

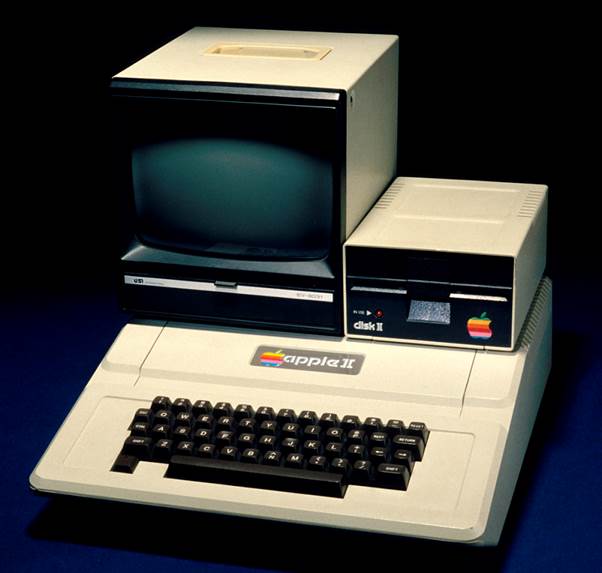

Un dénommé Steve Wozniack assiste à sa démonstration au sein du Homebrew Computer Club, une association de geeks de l’électronique qui se réunissent tous les mois dans un amphithéâtre de Stanford. Le club fonctionne sur le principe du partage et de la collaboration. Sa centaine de membres rassemble des étudiants, jeunes ingénieurs, geeks et activistes. Wozniack travaille chez HP. Après les heures de bureau, il passe ses soirées dans les labos de son employeur pour travailler à son propre projet de micro-ordinateur. Il le termine en 1976 et en fait la démonstration au Homebrew. Bidouilleur génial, “Woz” met au point un kit permettant de connecter un écran à la carte mère et d’afficher les instructions directement. On est à des années-lumière des limitations imposées par l’Altair, sans être aussi avancé que l’Alto, dont le prototype n’a pas été dévoilé au grand public. Woz compte partager librement ses plans avec les membres du Homebrew, mais son ami Steve Jobs le convainc de commercialiser les kits. Wozniak propose d’abord son invention à son employeur, qui refuse poliment de produire l’appareil, jugé trop empli de l’esprit hacker pour rejoindre la gamme HP. Libres de toute obligation, les deux Steve fondent Apple Computer pour commencer la production d’une centaine de kits depuis leur garage à Palo Alto. Pendant que Jobs tente de vendre le concept à des investisseurs, sans succès, Wozniack se lance dans le design d’une version améliorée : l’Apple 2.

Pour l’Apple 1, “j’ai utilisé les meilleurs composants que je pouvais me payer et écrit les bases du programme” expliquera Wozniack. L’Apple 2 a vocation à inclure des logiciels, un boitier et des composants plus puissants. Comme nous l’avons vu, sa mise sur le marché sera rendue possible par l’intervention du capital-risqueur Mike Markkula et de ses réseaux Fairchild/Intel.

Bien qu’un ordinateur concurrent (le Commandor) réalise de meilleures ventes les premières années, Apple va toucher de l’or grâce à un coup de pouce du destin. Une entreprise met au point un logiciel de comptabilité conçu exclusivement pour l’Apple 2 : Visicalc. Cet ancêtre d’Excel est plébiscité par les entreprises, faisant de l’Apple 2 la vache à lait de la firme pendant deux décennies. Ce qui permettra de survivre aux échecs commerciaux induits par l’impétueux Steve Jobs, dont le LISA et le premier Macintosh.

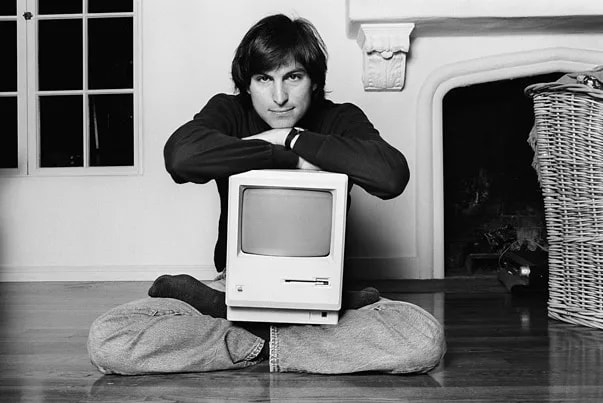

À la fin des années 1970, Apple détient 40 % des parts du marché de l’ordinateur personnel. Xerox investit dans la firme et reçoit Jobs et ses équipes au PARC, où l’entrepreneur assiste à la démonstration de l’Alto. L’interface graphique l’impressionne. Jobs recrute une partie de l’équipe du PARC et débute le développement du LISA, avant de se faire retirer le projet par le conseil d’administration, ses pratiques managériales étant jugées trop toxiques. Il se rabat sur le développement du Macintosh, une version grand public et minimaliste du LISA, dont le concept et le nom lui ont été soufflés par un ingénieur d’Apple. Avec ses obsessions et son perfectionnisme, Jobs retarde le développement et impose des choix de design désastreux : un microprocesseur trop lent et une absence de ventilateur qui expose l’ordinateur à des risques de surchauffe. L’équipe de développement démissionne, en burn-out, peu de temps après sa mise sur le marché.

Propulsé par une campagne de publicité d’ampleur inédite, le Macintosh sort en 1984. Il s’agit du premier micro-ordinateur grand public disposant d’une souris et de l’interface graphique avec laquelle nous sommes tous familiers. Plus besoin d’entrer des lignes de commandes pour effectuer des tâches. Mais entre temps, IBM a sorti son Personal Computer. L’approche du géant de la bureautique diffère radicalement de celle d’Apple. Au lieu de tout faire soit même, IBM se contente d’assembler un kit constitué des meilleurs composants du moment et confie le développement des logiciels à des sous-traitants.

Aidée par sa puissance industrielle et commerciale, l’approche de “Big blue” permet de casser les prix tout en offrant au micro-ordinateur la légitimité qui lui faisait encore défaut dans le monde de l’entreprise et auprès des cadres. Le PC écrase le marché, bien qu’il ne dispose pas des innovations présentes sur le Mac. Ironiquement, IBM n’en tire pas les bénéfices financiers escomptés. D’autres compagnies (dont Compaq, HP, Sun puis Dell) vont « cloner » ce modèle d’assemblage et livrer une guerre des prix, pour le plus grand bonheur des deux principaux sous-traitants rendus incontournables par IBM : Intel (pour le hardware) et Microsoft (pour le software).

Revenons en arrière. Pendant que Wozniack s’émerveillait devant les promesses de l’Altair, Bill Gates et Paul Allen se rendent à Albuquerque pour proposer un système d’exploitation à l’usage de l’Altair, reposant sur le langage BASIC développé par des universitaires. Fort de ce premier contrat, ces deux jeunes étudiants de Harvard fondent Microsoft. Leur programme se diffuse, mais les ventes stagnent. Bill Gates écrit alors au Home Brew Comptuer club une lettre ouverte qui fera date. Il s’y plaint du fait que de nombreuses personnes utilisent le code de Microsoft sans payer de royalties. Pour faire fortune, le futur milliardaire a besoin de vendre des licences, or l’éthos de hacker caractérisant la communauté des passionnés de micro-informatique va à l’encontre d’un modèle basé sur la propriété intellectuelle.

Une chance insolente va permettre à Microsoft d’écraser progressivement le modèle du logiciel libre. La mère de Bill Gates siège au Conseil d’administration d’IBM et l’aide à obtenir le contrat du siècle : la multinationale confie le développement du système d’exploitation de son premier PC à Microsoft, dont le cofondateur s’est taillé une petite notoriété suite à ses frictions avec le Homebrew.

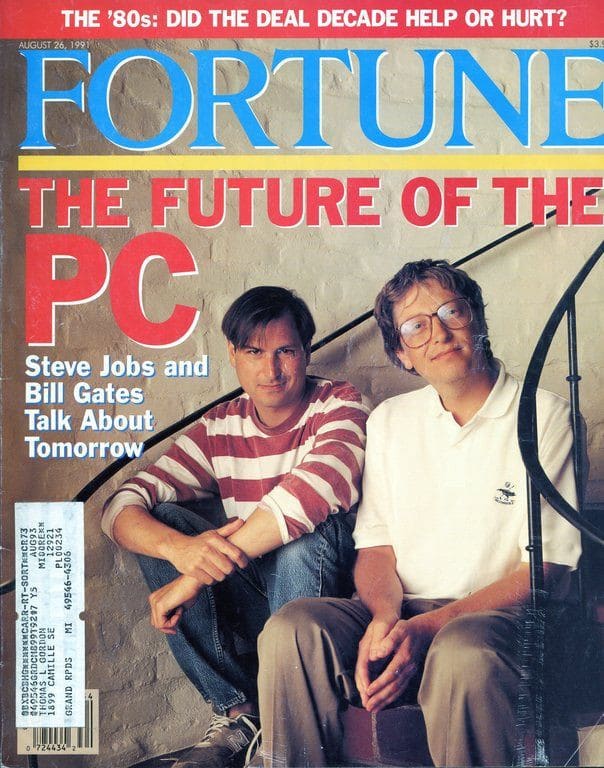

Pour honorer le contrat, Gates rachète QDOS, un système d’exploitation conçu par un ingénieur de Seattle et dont le sigle signifiait “Quick and Dirty Operating System” (Sytème d’exploitation vite fait mal fait). Renommé MSDOS, le programme est livré d’office avec tous les PC. Microsoft va utiliser cette position monopolistique pour écraser la concurrence via différentes tactiques plus ou moins légales. Guerre des prix, copie et vol d’idées, installation de programmes par défaut avec le système d’exploitation DOS… les pratiques iront jusqu’à introduire volontairement des bugs dans ce dernier pour empêcher les logiciels de traitement de textes et les tableurs des entreprises concurrentes de fonctionner convenablement. Le contentieux le plus médiatisé opposera Gates à Steve Jobs. Ce dernier avait confié à Microsoft le développement de certains programmes pour le Macintosh. Il est horrifié lorsque Microsoft sort Windows, un système d’exploitation à l’interface graphique inspiré du Mac et de l’Alto.

Pour le grand public, les années 1980 et 1990 sont ainsi dominées par le conflit entre Apple et Microsoft, repeint en David contre Goliath par le marketing d’Apple. Jobs bénéficie de l’image d’un génie visionnaire, artiste et rebelle, tandis que Gates incarne le nouveau Rockefeller, impitoyable monopoliste dont les produits mal finis sont truffés de bugs.

En réalité, ces deux figures majeures de la Silicon Valley partagent de nombreux points communs. L’un et l’autre sont connus pour leurs comportements exécrables, leurs accès de colère légendaires et leur attitude dénuée d’empathie envers leurs collaborateurs et employés, à la limite de la sociopathie. L’un et l’autre tentent de construire des monopoles (Jobs y parviendra dans les années 2000-2010, avec l’iPod, l’iPad et l’iPhone). Surtout, l’un et l’autre ont comme caractéristique de s’être trouvés au bon moment au bon endroit. Jobs et Wozniack ont grandi à Palo Alto, au cœur de la révolution informatique. Depuis les laboratoires d’HP, Woz a pu avoir accès aux meilleurs outils pour peaufiner son projet d’ordinateur. Le HomeBrew de Stanford a également été un lieu d’échanges et de rencontres indispensables au développement du projet Apple.

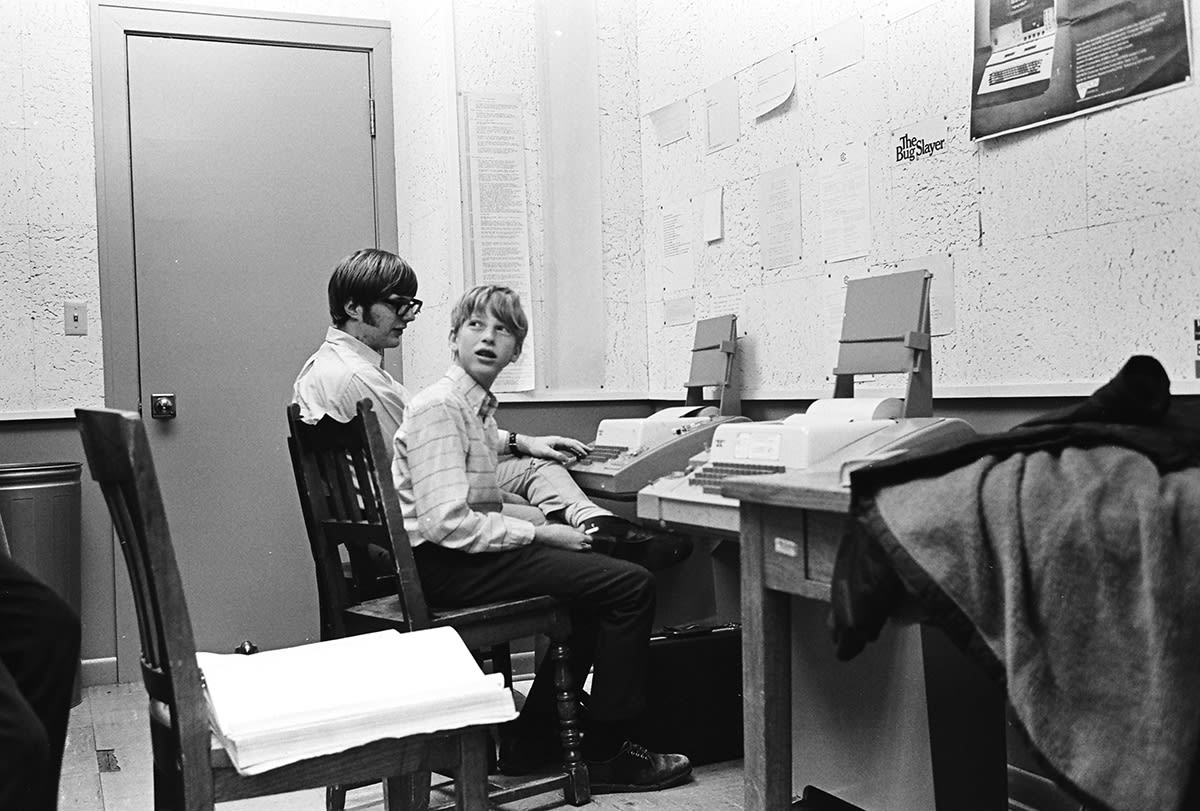

De son côté, Gates a étudié dans un des premiers lycées privés du pays doté d’un ordinateur, sur lequel il a pu apprendre très tôt les bases de la programmation en BASIC, avant d’être admis à Harvard et de bénéficier des réseaux de ses parents pour signer un contrat déterminant avec IBM.

Enfin, Jobs comme Gates ont permis à la Silicon Valley de tourner la page du keynésianisme financé par les dépenses militaires et étatiques pour entrer dans l’ère néolibérale et la consommation numérique de masse. Si Xerox a ouvert ses portes à Apple, c’est parce qu’elle comptait sur la start-up pour commercialiser son Alto, une chose qu’elle n’avait pas les capacités organisationnelles de faire elle-même. De même que Gates a joué un rôle majeur pour écraser le modèle du logiciel libre, Apple a innové par ses circuits de production. Les Macs étaient assemblés en Californie par un vaste réseau d’ateliers et usines employant des immigrés, souvent asiatiques, sous-payés, clandestins et non syndiqués. En 1984, Jobs reçoit Danielle Mitterrand, épouse du président français, dans l’usine dernier cri du Macintosh. Il s’agace des “préoccupations” de la première dame, qui l’interroge sur les conditions de travail des ouvriers, alors que lui vante les bienfaits de l’automatisation et du juste à temps pour réduire les coûts de main-d’œuvre.

Encore davantage que Gates, le PDG d’Apple est passé maître dans l’art de surexploiter les ingénieurs californiens à coup de semaine de 80 heures et de weekend marathon, en offrant des stock-options et le sentiment de “changer le monde” en guise de motivation. Ces “qualités” ne suffisent pas à faire le succès d’Apple, qui ne dépasse pas les 8% de part de marché lorsque la firme sort l’iPod, produit qui va lui permettre d’assoir sa domination.

Le concept du baladeur mp3 ne vient pas de Steve Jobs. Dès 1979, l’inventeur britannique Ken Kramer construit et brevète un prototype dont le design ressemble à s’y méprendre à l’iPod. Mais à l’époque, le prix des composants demeure prohibitif et leur puissance insuffisante. Le brevet expire en 1988. Comme avec l’Alto, il est encore trop tôt pour commercialiser l’idée. En 2000, Apple achète un concept de baladeur numérique développé par un ingénieur américain, Tony Faden, qui rejoint la firme avec pour mission de concevoir l’iPod. Le succès permet de lancer une gamme de produits (iPad puis iPhone) qui va enfin fournir à Apple une position monopolistique. Encore faut-il produire ces appareils en masse et à bas coût. Jobs recrute Tim Cook, logisticien passé par IBM et Compaq. Nommé responsable de production, il ferme les usines et entrepôts américains, délocalise en Chine, améliore la production en flux tendu et généralise la sous-traitance avec l’aide du spécialiste taiwanais Foxconn. Une vague de suicides provoqués par les conditions inhumaines imposées aux ouvriers pousse le sous-traitant d’Apple à installer des filets de sécurité pour empêcher les employés de se défenestrer. La presse relaie timidement cette face cachée du succès d’Apple, sans que les clients de la pomme se détournent de ses produits.

Si l’avènement de la micro-informatique était inévitable, la Silicon Valley a joué un rôle moteur en imposant un modèle parmi d’autres possibles. Il s’inscrit dans la contre-révolution néolibérale en reposant sur la sacro-sainte propriété intellectuelle, la délocalisation des usines et l’exploitation des ingénieurs. Des tendances qui allaient exploser avec l’arrivée d’internet et la privatisation de nos données. Car plus l’ordinateur s’imposait comme un outil incontournable, plus l’intérêt de connecter ces objets entre eux devenait évident.

2. De l’ARPANET au World Wide Web : vers la privatisation des communs

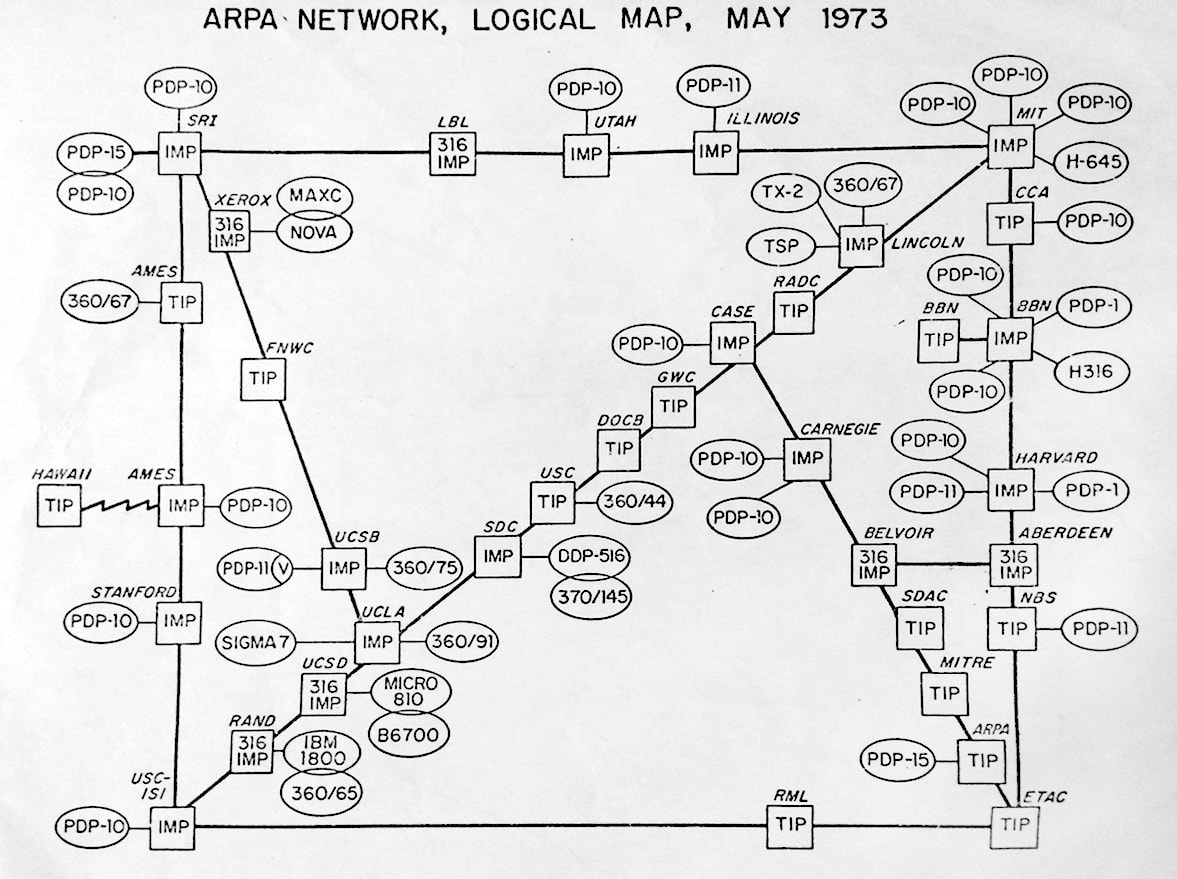

L’avènement d’internet constitue un exemple chimiquement pur des mécanismes socio-économiques à l’origine des révolutions technologiques ayant fait la gloire de la Silicon Valley. À la fin des années 1950, plusieurs équipes de chercheurs mettent au point un système de communication par le réseau téléphonique, en convertissant des signaux numériques en pulsions sonores (et inversement) à l’aide d’un modulateur - démodulateur, le fameux Modem. La seconde innovation cruciale consiste à mettre au point un mode de transmission des données par commutation de paquets, une rupture avec le système employé en téléphonie. Elle permet de stabiliser le réseau et de connecter de multiples terminaux entre eux. En 1965, deux équipes de chercheurs mettent au point cette invention indépendamment : Donald Davies, au National Physic Laboratory anglais (NPL) et Paul Baran à la RAND Corporation (un des plus gros consultants employés par l’armée américaine) avec l’aide de Leonard Kleinrock, du MIT. Des premiers réseaux voient le jour, dont l’ARPANET, qui connecte les universités de Stanford et UCLA dès 1968, puis 23 centres en 1971.

Son développement résulte de la création du “DARPA”, ce programme d’investissement public dans la recherche rattaché au ministère de la Défense. Ce département nait des suites du “moment Spoutnik” qui provoque une panique chez les dirigeants américains inquiets d’un potentiel retard technologique sur l’URSS. Le DARPA implante de nombreux superordinateurs dans les différentes universités américaines. La nécessité de les mettre en réseau pour permettre le partage de temps de calcul entre les centres de recherche serait le principal élément motivant les investissements dans la recherche et l’infrastructure qui accouche d’ARPANET, plutôt que l’idée de construire un réseau de communication décentralisé susceptible de résister à une attaque nucléaire.

Le réseau s’étend bientôt en Europe et se connecte à d’autres nœuds, dont un situé en Angleterre au NPL, un second en Norvège et un troisième en France, où le réseau Cyclade est mis au point par les équipes de Louis Pouzin. Ce dernier collabore étroitement avec les équipes d’ARPANET basées à l’université UCLA, dont le chercheur de Stanford Vincent Cerf. Cyclade perfectionne les protocoles de transmission de données et joue un rôle instrumental pour le bond technologique suivant : l’établissement d’un protocole pour mettre en relation les différents réseaux émergents. Baptisés Transmission Control Protocol et Internet Protocol (TCP/IP) ce système permet à chaque ordinateur de parler le même langage. Le TCP évite que les données transmises se perdent sur le réseau ou produisent des doublons, notamment via l’implémentation d’adresses numériques uniques (les fameuses adresses IP) assignées à chaque appareil. Pour faire fonctionner ce système, un nouveau type d’ordinateur appelé routeur fait son apparition. L’adoption du TCP/IP par ARPANET, en 1983, marque le début de l’International Network, abrégé en “inter-net”.

Dès 1981, la National Science Foundation (NSF), un organisme gouvernemental américain, fonde le réseau CSNET (Computer Science Network). Il doit permettre aux universités et institutions publiques de se raccorder au réseau ARPANET. En 1985, CSNET devient NSFNET, véritable colonne vertébrale du net. Des investissements colossaux permettent de mettre en place ce réseau reposant sur des millions de kilomètres de câbles et autres infrastructures électroniques majeures.

Les financements de la puissance publique permettent de poursuivre les innovations. En 1983, Elizabeth Feinler met au point, avec ses équipes du SRI, un annuaire permettant de convertir les adresses IP des ordinateurs connectés à ARPANET en simple nom de domaine. Feinler les classes en catégories en fonction des usages : .gov, .net, .org, .com… Un chercheur de la University of Southern California complète ce schéma en proposant un système décentralisé d’attribution des noms de domaines : le Domain Naming System ou DNS, encore utilisé aujourd’hui.

Malgré ces avancées, le gouvernement américain n’uniformise pas suffisamment rapidement le protocole TCP/IP. Dès les années 1980, d’autres protocoles et réseaux émergent de Stanford et du PARC. Ce qui permet à des start-up californiennes de capitaliser sur cette jungle pour mettre au point des terminaux permettant de connecter les différents protocoles entre eux. C’est le cas de 3Com, Cisco Systems puis de Sun Microsystems pour la partie “hardware”. Pour le software, d’autres acteurs émergent. Le jeune et flamboyant Larry Ellison (actuel seconde fortune mondiale) et deux collègues de la société Ampex sont mandatés par la CIA pour bâtir une base de données capable d’intégrer différents systèmes. Ils s’unissent pour fonder Oracle Systems, reprenant le nom du projet Oracle que leur avait confié la CIA. La société continue de croitre grâce aux contrats de l’agence de renseignement américaine, dont les ingénieurs aident à résoudre les bugs des premiers produits. Un membre de la CIA concèdera : “on a acheté ce projet tout en sachant qu’il ne fonctionnerait pas, nous achetions avant tout une idée”. Après plusieurs années, Oracle parvient à finaliser un produit fonctionnel et, avec l’aide du capital-risqueur Don Valentine et sa firme Sequoia Capital, réalise une entrée en bourse tonitruante. En 1999, un protégé d’Ellison nommé Mark Benioff lancera Salesforce, une société spécialisée dans les logiciels de marketing destinés à l’usage des entreprises. Elle possède désormais le plus grand gratte-ciel de San Franscico, où se situe son siège social.

Mais c’est du CERN, institution publique située en Suisse, que provient la dernière grande innovation ayant jeté les bases de l’internet moderne. Trouver et échanger des documents sur le réseau restait une tâche ardue sans connaitre leur localisation précise (adresse IP, nom du dossier, etc.). Tim Berners-Lee, un physicien et informaticien anglais, met au point un système permettant d’afficher les données sur des pages et de les télécharger via des liens hypertextes. Le système repose sur trois innovations : la création d’adresses web (URL), d’un protocole d’échange de données (HTTP ou Hyper Text Transfer Protocol) et un langage de programmation (HTML). Ce système est baptisé le World Wide Web (www) et est accessible via un programme nommé navigateur web. Opérationnel dès 1991, il est versé dans le domaine public en 1993. En parallèle, la NSF privatise le réseau NSFNET, de plus en plus encombré par l’explosion de la demande du secteur privé. Si bien qu’en 1993, l’internet devient totalement ouvert au grand public et aux entreprises. Un système conçu avec la recherche et l’argent publics va provoquer une nouvelle ruée vers l’or.

3. Netscape et le nouveau paradigme de la bulle.com

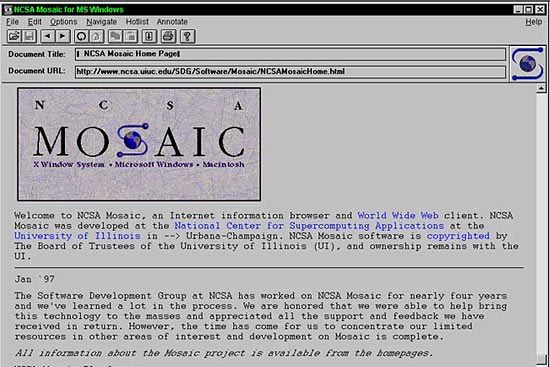

Toujours en 1993, une équipe d’étudiants-chercheurs de l’université de l’Illinois emmenée par un certain Marc Andreessen met au point un nouveau navigateur web baptisé Mosaic. Réalisé à partir des travaux de Tim Berners-Lee, le programme permet d’afficher textes, images et vidéos dans la même fenêtre via une interface grand public. Il est diffusé gratuitement sous licence par l’Université puis rapidement adopté dans le monde de l’éducation et de la recherche. Son diplôme d’ingénieur informatique en poche, Marc Andreessen est approché par Jim Clark, un entrepreneur de la Silicon Valley et ancien professeur d’informatique à Stanford. Avec ses réseaux, Clark est en mesure de financer le lancement d’une nouvelle entreprise qui reprend le nom de Mosaic pour commercialiser le navigateur. Suite aux plaintes de l’Université d’Illinois, ils rebaptisent leurs start-up “Netscape”. Ils mettent rapidement et gratuitement sur le marché leur “Navigator”, premier navigateur web grand public. La diffusion par bouche-à-oreille et via disquette génère un franc succès, mais des revenus insuffisants pour couvrir les frais de développement. Si les utilisateurs sont encouragés à faire un don et les entreprises sollicitées pour payer une licence, peu s’y résolvent.

Bien que la viabilité économique de Netscape restait plus qu’incertaine, le succès immédiat de son Navigator conduit à une introduction en bourse dès 1996. L’action s’arrache à prix d’or et permet à Jim Clark d’empocher plus de 100 millions de dollars. Un nouveau paradigme ébranle la Silicon Valley : pour faire fortune, il n’est plus nécessaire de dégager du profit ou d’être rentable. Démontrer un taux de croissance exponentiel de vos clients suffit. Même si ces derniers utilisent votre produit gratuitement.

Netscape est rapidement pris pour cible par Microsoft. L’entreprise de Bill Gates copie le navigateur d’Andreessen et installe son “Microsoft Explorer” par défaut sur tous les PC équipés de Windows. Cette concurrence déloyale ruinera la réputation de Gates lors du procès intenté par l’État fédéral américain contre la multinationale pour violation des lois antitrusts. Mais cela ne sauvera pas Netscape, racheté pour 4 milliards de dollars par AOL en 1999.

Andreessen va profiter de sa fortune et de sa réputation pour devenir un capital-risqueur très en vue. En 2009, il s’associe avec Ben Horrowitz pour fonder Andreessen Horrowitz (a16Z), un des principaux fonds d’investissement en capital-risque de la Silicon Valley, qui joue un rôle important dans le ralliement des pontes de la Tech derrière la candidature de Donald Trump en 2024.

Au-delà de l’histoire personnelle d’Andreessen, le succès initial de Netscape sert de modèle à un nouveau schéma d’enrichissement. Avec l’explosion d’internet, d’innombrables entrepreneurs tentent de capitaliser sur la bulle financière qui accompagne la croissance fulgurante du réseau. Il suffit de lancer une entreprise dont le nom se termine par .com pour espérer attirer les investisseurs. Ces premiers millions permettent de mettre au point un semblant de site web dont la croissance des utilisateurs peut suffire à propulser une introduction en bourse miraculeuse, alimentée par les capitaux transitant via Wall Street. Or, à la fin des années 1990, la chute de l’URSS et les dérégulations mises en place par les néolibéraux avaient libéré un flot de capitaux, qu’ils soient américains, européens, asiatiques ou plus spécifiquement issus des nouveaux oligarques originaires de l’ancien bloc de l’est. La Silicon Valley, avec ses taux de croissance délirants, représentait le réceptacle idéal pour cette masse d’argent frais.

L’éclatement de la bulle internet va produire une consolidation du secteur autour des entreprises ayant une activité solide. Des sites de commerce en ligne comme eBay et Amazon et des moteurs de recherche comme Yahoo! sortent renforcés de la crise. Mais les leçons ne sont pas retenues. Pendant cette période d’euphorie, de nombreux entrepreneurs au talent questionnable ont fait fortune via une introduction en bourse fructueuse ou en revendant leur start-up in extrémiste. Parmi cette nouvelle génération de patrons figurent Elon Musk, Peter Thiel, Mark Cuban, les cofondateurs d’Uber Travis Kalanick et Garret Camp ou - exemple encore plus parlant - le cofondateur de Theranos Sunny Balwami. Leur talent ne consiste pas à avoir mis au point des entreprises solides ou un produit remarquable - leurs premières start-up ayant fait faillite ou simplement disparu quelque temps après leur rachat - mais d’avoir enrichi leurs investisseurs. Forts de cette crédibilité et souvent convaincus de leur propre génie, ils vont incarner la nouvelle génération d’entrepreneurs de la Silicon Valley. Avant de revenir sur leur parcours, un détour par les années 2000-2015 s’impose.

Ceci clôt la seconde partie de cette série. La suite est à lire ici. Pour ne pas manquer mes prochaines publications, vous pouvez vous abonner gratuitement à cette newsletter. Et pour soutenir mon travail, vous pouvez m’offrir un café.

Pour les lecteurs les plus curieux ou pointilleux (je vous vois !), voici une liste non exhaustive de mes principales sources mobilisées au long de la série :

Anatomie d’une bulle, Dr Thomas Gerbaud, Dr Antoine Gerbaud. 2023

Apocalypse Nerds : Comment les technofascistes ont pris le pouvoir, Nastasia Hadjadji et Olivier Tesquet. Éditions Divergences, 187 pages, 2025.

A City on Mars : Can We Settle Space, Should We Settle Space, and Have We Really Thought This Through?, Kelly and Zach Weinersmith. Penguin Press, 448 pages, 2023.

A People’s History of the United States : 1492–Present, Howard Zinn. Harper Perennial Modern Classics, 784 pages, 2005.

Automation and the Future of Work, Aaron Benanav. Verso Books, 256 pages, 2020

Blood in the Machine, Brian Merchant (substack).

Character Limit : How Elon Musk Destroyed Twitter, Kate Conger et Ryan Mac.

Penguin Press, 430 pages, 2024.Elon Musk, Walter Isaacson. Simon & Schuster, 688 pages, 2023.

Elon Musk : Tesla, SpaceX, and the Quest for a Fantastic Future, Ashlee Vance. HarperCollins, 392 pages, 2015.

Empire of AI : Dreams and Nightmares in Sam Altman’s OpenAI, Karen Hao.

Penguin Press, 496 pages, 2025.En attendant les robots : Enquête sur le travail du clic, Antonio A. Casilli.

Éditions du Seuil, 400 pages, 2019.Le mythe de l’entrepreneur : Défaire l’imaginaire de la Silicon Valley, Anthony Galluzzo.

Éditions La Découverte, 240 pages, 2023.Liftoff : Elon Musk and the Desperate Early Days That Launched SpaceX, Eric Berger.

William Morrow (HarperCollins), 288 pages, 2021.Ludicrous : The Unvarnished Story of Tesla Motors, Edward Niedermeyer.

BenBella Books, 288 pages, 2019.No Crypto : Comment Bitcoin a envoûté la planète, Nastasia Hadjadji.

Éditions Divergences, 220 pages, 2023.Palo Alto : A History of California, Capitalism, and the World, Malcolm Harris.

Little, Brown and Company, 720 pages, 2023.Road to Nowhere : What Silicon Valley Gets Wrong About the Future of Transportation, Paris Marx. Verso Books, 272 pages, 2022.

Steve Jobs, Walter Isaacson. Simon & Schuster, 656 pages, 2011.

Une histoire de la conquête spatiale : Des fusées nazies aux astrocapitalistes du New Space, Irénée Régnauld, Arnaud Saint-Martin. La Fabrique, 316 pages, 2024.

Un taylorisme augmenté - critique de l’intelligence artificielle, Juan Sebastián Carbonell, Éditions Amsterdam, 2025

Zero to One : Notes on Startups, or How to Build the Future, Peter Thiel et Blake Masters. (Penguin Random House), 224 pages, 2014.

Articles de presse divers (Jacobin, Wired, The New York Times…).

Wikipédia, articles de presse cités par Wikipédia.

06.10.2025 à 18:35

Une brève Histoire de la Silicon Valley (1/4)

Christophe @PoliticoboyTX

Texte intégral (9467 mots)

Le terme “Silicon Valley” fait son apparition en 1971, en titre d’une enquête d’Electronic News détaillant la révolution numérique se déroulant au cœur de la vallée de Santa Clara. De la baie de San Francisco jusqu’à la ville de San Jose, cette bande de terre de quelque 50 km de long et cinq de large est plus qu’un lieu géographique et un centre économique. Berceau de l’industrie numérique et de la haute technologie, la Silicon Valley désigne aussi une culture particulière et, par abus de langage, l’industrie de la Tech.

Plus de 40 % du capital-risque américain y est investi chaque année. Sept des huit plus grandes capitalisations boursières mondiales (Apple, Google, Amazon, Microsoft, Facebook, Nvidia et Tesla) y possèdent leur siège social ou y sont étroitement liées. On pourrait également citer Uber, Airbnb, OpenAI, Oracle, Salesforce, PayPal, eBay, Intel, Palantir, Cisco, AMD, Adobe, Yahoo et Netflix, pour donner une idée de l’impact de ces multinationales sur notre quotidien. La région est la troisième plus riche au monde en termes de PIB par habitant et abrite la plus grande concentration de milliardaires et millionnaires du pays. Souvent imitée, jamais égalée, la Valley continue d’être à la pointe de l’innovation mondiale.

Son rayonnement s’expliquerait par un cocktail unique mêlant goût du risque, culture entrepreneuriale et travail acharné, porté par des self-made-men et génies visionnaires forcément anticonformistes. Héritiers d’un esprit pionnier enrichi par la contre-culture des années 1960-1970, leurs start-up peuplées d’ingénieurs travaillant 80 heures par semaine dans l’espoir de voir leurs stock-options se transformer en or seraient à la source des principales révolutions industrielles de ces dernières décennies.

Retracer l’histoire de cette “vallée du silicium” permet de remettre en cause ce récit trompeur. Et de comprendre le type de futur qu’elle cherche à nous imposer. C’est dans ce but que je vous propose cette “brève histoire de la Silicon Valley”. Elle sera divisée en quatre partie selon le plan détaillé plus bas. Vous lisez actuellement la première partie. Si vous y accédez par courriel, il est probable que le texte soit tronqué. Je vous recommande de le lire directement via sur mon site “faketech.fr”.

Ce long format sera publié à un rythme hebdomadaire et épousera le plan suivant :

Partie 1 : Aux origines du mal

De la ruée vers l’or à l’Université Stanford (1848-1889)

De l’eugénisme à l’électronique (1889-1945)

Des semi-conducteurs au Macintosh, les prémices de la révolution informatique (1951-1975)

Partie 2 : La révolution numérique n’aura pas lieu

De la contre-culture aux monopoles : Jobs, Gates et le mythe du self-made-man

D’ARPANET au World Wide Web : la privatisation des communs

De Netscape à la bulle.com : le triomphe du capital-risque

Partie 3 : Conquérir le monde

Du BIG DATA à BIG BROTHER

Amazon et la matérialisation du numérique

De l’ubérisation à l’enshittification du monde

Partie 4 : Vers le technofascisme et au-delà

De la “Paypal mafia” à la radicalisation de la Silicon Valley

Intelligence artificielle : vers l’âge des Fake Tech ?

Epilogue : vers le technofascisme et au-delà.

Un mot sur mes sources :

Je me suis largement inspiré de l’ouvrage “Palo Alto: A History of California, Capitalism, and the World” (Malcolm Harris, 2023, 923 pages, non traduit). En plus de ce matériaux extrêmement dense, j’ai puisé mes informations dans un vaste corpus de lectures complémentaires (articles de presse, biographies d’entrepreneurs, documentaires, livres, Wikipedia).

Pour ne pas alourdir le texte et compliquer ma tâche, j’ai pris le parti de ne pas citer directement les références. Les affirmations sont aisément vérifiables par de simples recherches Internet. Et Lorsque ce n’est pas le cas, j’ai indiqué ma source ou inséré un lien hypertexte vers celle-ci.

Il ne me reste plus qu’à vous souhaiter une bonne lecture et à vous encourager à partager ce travail autour de vous pour faire connaître cette publication et la “véritable” Histoire de la Silicon Valley.

* Une brève Histoire de la Silicon Valley *

** Partie 1 : Aux origines du mal **

1) De la ruée vers l’or à l’Université Stanford (1848-1889)

L’histoire de la Silicon Valley commence avec celle du génocide des Amérindiens Ohlone. Quelque 300 000 natifs coexistaient difficilement avec les Espagnols, la moitié d’entre eux ayant péri de maladies importées pendant la période coloniale allant de 1769 à 1846. Lorsque les États-Unis d’Amérique arrachent la région au Mexique, leurs premiers colons découvrent une terre d’abondance, sorte de paradis terrestre à la biodiversité époustouflante. Le nord de la Californie se prêtait à la culture des fruits et céréales, mais la main-d’œuvre faisait cruellement défaut. La piste passant à travers les montagnes Rocheuses était virtuellement impraticable. Les voyageurs y préféraient les voies maritimes qui contournaient le continent américain. Cette poignée de pionniers n’avait pas l’intention de se tuer à la tâche, préférant réduire les populations autochtones à une forme d’esclavage ou de travaux forcés pour cultiver la terre et faire fructifier les vergers luxuriants.

Les tribus indiennes résistaient à cette entreprise coloniale d’autant plus efficacement qu’elles pouvaient aisément subvenir à leurs besoins en vivant de la chasse et de la cueillette. La ruée vers l’or de 1849 causa leur perte. Un nombre croissant de colons arriva par la mer, bien décidé à chasser les Indiens de leurs terres pour y prospecter. L’historien Benjamin Madley qualifie le génocide californien de massacre autogéré et partant de la base, où les colons s’organisent en milices, avec le soutien législatif et financier de l’État fédéral pour perpétrer l’extermination des natifs. En l’espace de 20 ans, plus de 80 % d’entre eux périrent, ce qui fait de ce nettoyage ethnique un des génocides les plus rapides et drastiques de l’Histoire. Une culture extrêmement riche et complexe, comptant des dizaines de langues, ethnies et manières de vivre en harmonie avec la nature fut remplacée par des champs d’extraction aurifère à ciel ouvert exploités par des colons avides de métal précieux.

C’est à cette époque que le père de la Silicon Valley arriva depuis New York en Californie. Leland Stanford, le frère cadet d’une famille de quatre enfants, est décrit comme “peu remarquable” et “le moins brillant de la fratrie”. Après avoir difficilement terminé ses études dans des écoles médiocres, il s’établit dans le Wisconsin comme avocat, sans succès. Las, il rejoint ses frères à San Francisco et prend la direction d’une succursale de leur entreprise de quincaillerie. Son magasin se spécialise dans la vente de pelles et équipements de prospection. En pleine ruée vers l’or, le succès est au rendez-vous. Stanford profite de son statut de notable local pour s’engager en politique, dans le Parti républicain de Lincoln. Tous les mandats étant occupés par le Parti démocrate pro-esclavagiste, Stanford gravit sans problème les échelons au sein de l’opposition. Si bien que lorsque la guerre de Sécession débouche sur l’hégémonie du Parti républicain, il se retrouve propulsé candidat au poste de Gouverneur en tant que plus haut “gradé” de la modeste antenne californienne.

Il utilise l’influence conférée par ce poste pour obtenir, avec ses nouveaux associés, la construction d’une première ligne de chemin de fer chargée de relier la Californie à l’est du pays. Étant l’un des principaux actionnaires de la Pacific Railway, Stanford va amasser une immense fortune sur le dos des Amérindiens qu’il spolie de leurs terres pour valoriser la ligne de chemin de fer et des ouvriers chinois que sa compagnie paye une misère pour la construction. Son conglomérat, comparé à une pieuvre par la presse de l’époque, jouissait d’un monopole régional particulièrement lucratif.

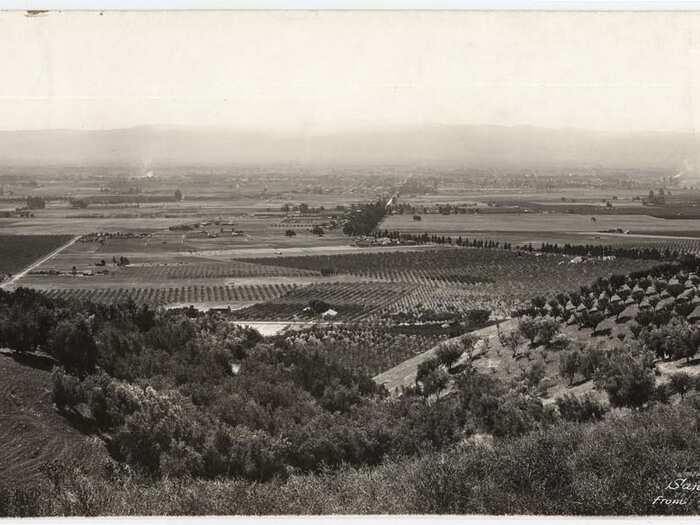

Devenu indésirable à San Francisco, où la populace vient fréquemment manifester sa colère devant les portes de sa villa, Leland Stanford va utiliser sa fortune à deux desseins. Le premier est une passion subite pour l’élevage des pur-sang. Il achète une immense propriété à quelques dizaines de kilomètres de San Francisco, qu’il nomme Palo Alto, du nom d’un grand arbre présent sur place. Il y implante la Palo Alto Stock Farm, dont les écuries vont mettre au point une nouvelle méthode de sélection génétique et de préparation des étalons, inédite pour l’époque. Elle consiste à entrainer dès le premier âge les trotteurs jusqu’ici jugés trop jeunes pour apprendre l’allure. En cette fin de XIXe siècle, la mécanisation de l’agriculture nécessite de plus en plus de chevaux, véritable carburant de l’économie. Augmenter leurs performances permettrait d’augmenter leur prix. L’entreprise s’avère lucrative et glorieuse, bien qu’elle nécessite d’infliger de nombreuses souffrances aux jeunes pur-sang et d’en tuer certains à la tâche.

Mais c’est à la mort prématurée de son fils unique, suite à une maladie contractée lors d’un voyage en Europe en 1884, que Stanford va réaliser l’œuvre de sa vie. Avec sa femme, le couple dévasté décide de rendre hommage à leur fils en créant de toutes pièces un musée et une grande université, destinés à concurrencer les plus grandes académies de la côte est. Construite sur les terres du ranch de Palo Alto, elle est baptisée du nom de leur fils : Leland Stanford Junior University.

L’établissement va recruter parmi les meilleurs professeurs et chercheurs de la nation, à l’aide de salaires mirobolants et promesses d’indépendance. L’accent est immédiatement mis sur une discipline encore peu prisée des grandes universités de la côte est : les sciences physiques et l’ingénierie, en particulier dans les domaines de l’extraction minière et de l’hydraulique. Dotée d’une superficie immense, elle va progressivement jouir d’un avantage indéniable sur ses concurrents en offrant l’espace nécessaire à l’accueil d’un écosystème de laboratoires et d’entreprises.

2) De l’eugénisme à l’électronique (1889-1945)