09.06.2026 à 16:20

La France du Nord et de l’Est victime de la mondialisation, celle du Sud et de l’Ouest en pleine dynamique

Arnaud Brennetot, Géographie politique, Université de Rouen Normandie

Texte intégral (3159 mots)

La fracture entre villes et campagnes s’est imposée comme l’une des principales clés de lecture des inégalités territoriales françaises. Pourtant, les dynamiques régionales dessinent une autre géographie. Héritée de la désindustrialisation, une ligne de partage séparant le Nord et l’Est du Sud et de l’Ouest continue de structurer l’économie et les trajectoires sociales du pays.

L’intégration de la France dans la mondialisation économique a eu pour corollaire une exposition accrue des entreprises et des régions à la concurrence internationale. À partir du milieu des années 1970, comme pour les autres pays membres de la Communauté économique européenne (CEE), cette situation s’est traduite par un ralentissement de la croissance économique, une augmentation du chômage, une réorganisation de la production et un développement sélectif du territoire. La délocalisation des tâches à faible valeur ajoutée vers les nouveaux pays industriels, l’externalisation d’une autre partie des fonctions vers les services et les progrès technologiques ont conduit à un processus de désindustrialisation et de tertiarisation de l’emploi.

En parallèle, l’élévation du niveau de vie a permis l’essor des activités de la sphère présentielle, c’est-à-dire destinées à une clientèle locale (la construction et les services à la personne).

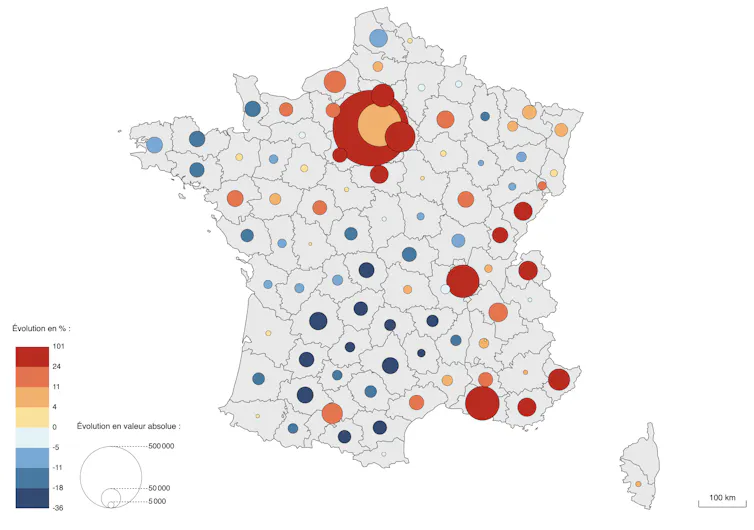

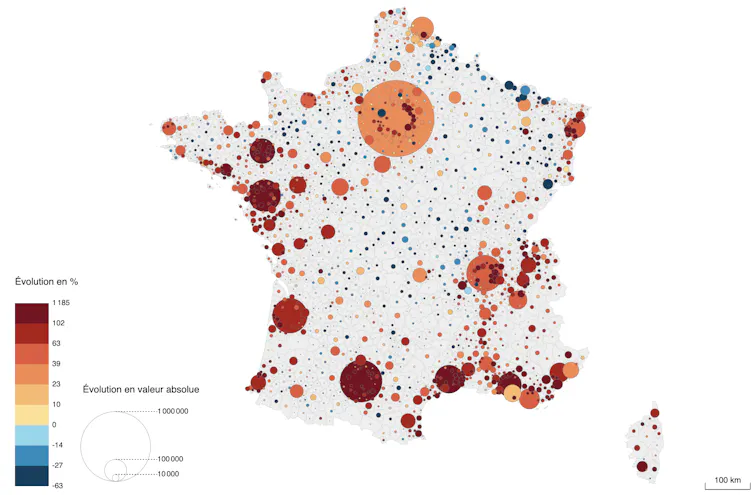

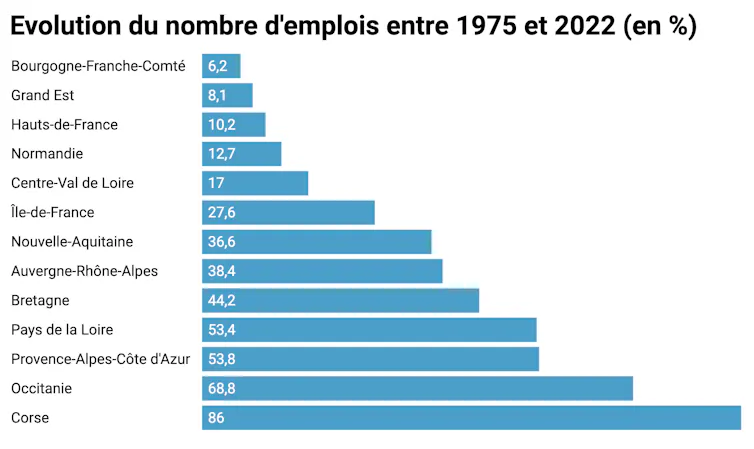

Ces transformations ont entraîné une inversion de l’organisation régionale du pays : alors que les phases de la révolution industrielle avaient entraîné une forte croissance économique de la moitié nord-est du pays, à l’est d’une ligne Le Havre-Marseille, la période de la mondialisation néolibérale s’est traduite par un ralentissement de cette partie du pays et, au contraire, par une forte croissance de la France du Sud et de l’Ouest.

Évolution du nombre d’emplois entre 1954 et 1975

Évolution du nombre d’emplois entre 1975 et 2022

En France, une inversion géographique des régions « qui gagnent »

Dans le Nord-Est et dans les régions périphériques du Bassin parisien, le déclin des industries lourdes et de montage a entraîné une baisse importante du nombre d’emplois productifs. Depuis un quart de siècle, cela a eu pour effet le départ d’une partie des ménages, entraînant un ralentissement de la croissance puis un déclin presque généralisé de la population. Cette régression s’est accompagnée d’une réduction de l’offre de services collectifs, une fragilisation des systèmes urbains, une dévalorisation du capital fixe (les logements, les usines, les commerces, les infrastructures…) et des difficultés à amortir les investissements.

Si les grandes villes ont mieux résisté à la récession que les villes petites et moyennes ou les espaces de faibles densités, leur croissance a été bien plus faible que dans les métropoles du Sud et de l’Ouest. Seules les régions parisienne et lyonnaise sont parvenues à compenser les pertes liées à la désindustrialisation par l’essor des fonctions métropolitaines.

Au contraire, la moitié Sud-Ouest, longtemps caractérisée par une économie traditionnelle et un fort exode rural, a connu un rattrapage spectaculaire. La conjugaison de la tertiarisation des activités productives, favorable aux métropoles, et les nouveaux tropismes résidentiels, caractérisés par un attrait pour les littoraux et l’ensoleillement, ont contribué à un afflux continu de nouvelles populations et à la croissance conjointe des emplois des sphères présentielle et productive. Si les métropoles du Sud et de l’Ouest ont bénéficié d’un essor souvent souligné dans le débat public, des territoires plus larges ont également connu une trajectoire de forte croissance : la Bretagne (l’Ouest intérieur excepté), la vallée de la Loire, la Vendée, la Charente, le bassin Aquitain, le Languedoc, le bassin du Rhône, la Corse et la vallée du Rhin. Même le sud de la « diagonale du vide » a connu un modeste regain démographique et économique. Les territoires les plus dynamiques sont confrontés depuis plusieurs décennies aux phénomènes d’étalement urbain, de hausse des prix de l’immobilier et de ségrégation sociorésidentielle.

L’occultation de la question régionale

Cette inversion macro-régionale, observable à partir du milieu des années 1970, n’a jamais été identifiée comme un enjeu public notable (à la différence des considérations légitimes dont ont régulièrement fait l’objet les territoires d’outre-mer). Malgré les difficultés induites pour les populations des régions fragilisées du Nord-Est, elle n’a donné lieu à aucune politique d’accompagnement ou de traitement différencié depuis la fin des années 1990, lorsque les politiques d’aménagement national ont été abandonnées.

Les grands objectifs de politiques publiques concernant le développement durable, la compétitivité et la cohésion des territoires, par exemple, ont été mis en œuvre sans tenir compte de l’inégalité des trajectoires régionales. Les mêmes instruments (transferts de compétences, appels à projets, contrats) ont été déployés, sans considération pour le fait qu’ils ne pouvaient pas générer des effets identiques dans des régions en pleine croissance et dans des régions en déclin.

Ce fut le cas par exemple des contrats de plans État-Régions, des pôles de compétitivité ou des modalités d’accompagnement des établissements d’enseignement supérieur et de recherche. Les différents marchés (emplois, immobilier, services) ont alors produit leurs effets géographiques sélectifs sans garde-fous politiques. Par exemple, entre 1999 et 2022, la croissance de l’emploi a été trois fois plus forte à Toulouse (+ 63 %) qu’à Lille (+ 22 %). Les instruments de coopération interrégionale (comités de massif, contrats de plan interrégionaux, stratégies de façades littorales) sont de leur côté restés faiblement dotés.

Ni les gouvernements successifs, ni les associations d’élus locaux ne se sont véritablement inquiétés des possibles problèmes engendrés par de telles divergences régionales, hormis pour les espaces de très faibles densités et les territoires d’outre-mer. Ces écarts ont exposé les populations des différentes régions à une inégalité des chances croissante en matière de cadre de vie et d’opportunités territoriales (pour l’accès aux services collectifs ou pour le dynamisme économique local, par exemple).

Aucun débat notable n’a eu lieu concernant les avantages et les inconvénients éventuels induits par ce grand schisme régional. Hormis quelques rares exceptions, celui-ci a été systématiquement occulté des diagnostics formulés par les différents acteurs de la gouvernance et de l’aménagement des territoires (responsables politiques, administrations, associations, entreprises et médias) et ceci depuis plusieurs décennies, laissant les dynamiques macro-régionales continuer à exercer leurs effets.

La montée du populisme territorial

L’état géographique du pays est cependant loin de désintéresser le public et encore moins de le satisfaire. Il est même devenu un objet récurrent de désapprobations. À partir de la fin des années 1990, la notion de « fracture territoriale » apparaît pour dénoncer les inégalités géographiques qui divisent le pays. Mais le décrochage macro-régional est occulté par la réactivation idéologique du vieux clivage villes/campagnes. Se cristallise un discours déplorant l’abandon des campagnes et des petites villes (alimenté par le recul des services publics et la fermeture de nombreux équipements) en contraste avec l’attention portée aux grandes villes, qu’il s’agisse de la crise des banlieues ou de grands projets urbains (le Grand Paris ou les métropoles régionales).

Dans les années 2010, cette déformation se systématise avec la notion de « France périphérique » qui réduit la transformation géographique de la France à un schéma binaire opposant des métropoles privilégiées à un ensemble de territoires hétéroclites habités par des « classes populaires » livrées à elles-mêmes. Cette caricature géographique est très largement adoptée par les médias comme par divers responsables politiques : le rejet des métropoles se présente alors comme une variante géographique du « dégagisme » politique en plein essor.

Cette focalisation du débat sur le clivage villes-campagnes n’a pas permis d’établir un diagnostic lucide de la réalité multiscalaire des inégalités et des vulnérabilités géographiques (entre quartiers et communes au sein des aires urbaines, entre villes et campagnes et entre ensembles régionaux). Si la réorganisation des activités induite par la mondialisation a renforcé le rôle des économies d’agglomération, profitant aux plus grandes des villes, les déclarations dénonçant la « fracture territoriale » ont majoritairement ignoré que, à population égale, les territoires du Nord-Est fragilisés par la désindustrialisation sont restés plus vulnérables que ceux du Sud-Ouest portés par une forte attractivité.

Cette réalité macro-régionale a fait l’objet d’un déni collectif, les élus du Nord-Est restant peu enclins à faire des difficultés subies par leur territoire un thème de revendication et de mobilisation politiques. Par ailleurs, bien des élus des territoires les moins peuplés ont eu intérêt à ce que le thème de la « France périphérique » reste vivace dans le débat public, permettant de justifier la perpétuation, sinon l’accentuation, du système de redistribution financière dont ils tirent profit. Par exemple, le programme Petites villes de demain, lancé en 2020 par l’Agence Nationale de la Cohésion des Territoires, n’a pas cherché à cibler particulièrement celles dont la population est la plus pauvre ou celles qui subissent des dynamiques de déclin. L’indifférence à l’égard de la concentration des difficultés socio-économiques dans la moitié nord-est du pays a eu pour effet de laisser les inégalités se creuser et les frustrations s’y accumuler, sans permettre aucune résolution ou avancée concrète.

Depuis plusieurs mois, dans une situation politique de plus en plus critique, les appels en faveur d’un réinvestissement du territoire national se multiplient. La recherche de solutions a même conduit à recréer un ministère de l’aménagement du territoire (disparu depuis 2010), lequel s’emploie actuellement à la définition d’une nouvelle stratégie nationale d’aménagement. Une telle ambition ne pourra aboutir à des solutions tangibles qu’à la condition de tenir compte de l’existence du clivage macro-régional qui structure la France métropolitaine depuis un demi-siècle.

Cet article a été réalisé dans le cadre du colloque « Penser le monde qui vient », organisé le 11 juin 2026 par la chaire « Prospective, imaginaires et politiques publiques » de CY Cergy Paris Université, Learning Planet Institute et l’association Le 106, en partenariat avec The Conversation. Si vous souhaitez y assister, vous pouvez vous inscrire en cliquant ici.

Arnaud Brennetot conseille différentes organisations (collectivités territoriales, agences publiques, think tanks).

09.06.2026 à 16:20

« La Coupe du monde sera une immense compétition de récits »

Cyrille Bret, Géopoliticien, Sciences Po

Texte intégral (2119 mots)

À quelques jours du début de la Coupe du monde 2026, organisée aux États-Unis, au Canada et au Mexique, nous avons interrogé le spécialiste des relations internationales Cyrille Bret sur les enjeux géopolitiques de la compétition. Pour lui, le tournoi constituera une vitrine des rapports de force contemporains… et une arène où s’affronteront les récits contradictoires des puissances.

The Conversation : Cette Coupe du monde est organisée par trois pays. Ce choix est-il uniquement logistique ou revêt-il une portée politique particulière ?

Cyrille Bret : La coorganisation des grandes compétitions sportives devient une tendance de fond. On l’a vu avec l’Euro 2008 en Suisse et en Autriche, l’Euro 2012 en Pologne et en Ukraine, plus encore avec l’Euro 2020, décalé à l’année suivante pour cause de Covid et tenu dans pas moins de onze pays hôtes. On le verra encore en 2030, quand la Coupe du monde se déroulera en Espagne, au Portugal et au Maroc, avec aussi trois matchs en Argentine, au Paraguay et en Uruguay.

En ce qui concerne l’édition 2026, le choix des États-Unis, du Canada et du Mexique, entériné par un vote de la FIFA en 2018 traduit une volonté de construire un grand événement continental. Cette formule répond aussi à des impératifs économiques : les trois pays vont partager les coûts d’organisation, mutualiser les infrastructures et limiter la construction de nouveaux équipements – des aspects d’autant plus importants qu’il s’agira de la plus grande Coupe du monde de l’histoire, avec pour la première fois 48 équipes engagées en phase finale, qui disputeront en tout 104 matchs. Les sept éditions précédentes, depuis celle en France en 1998, réunissaient 32 équipes, pour 64 matchs au total ; auparavant, c’était encore moins, avec 24 équipes de 1982 à 1994, et 16 équipes seulement avant cela. On mesure l’inflation, qui n’est peut-être pas terminée puisque la FIFA envisage de passer à 64 équipes au départ dès 2030 !

Quand on parle de cette Coupe du monde, on a un peu tendance à négliger le fait que le Mexique et le Canada l’accueillent, l’attention se portant essentiellement sur les États-Unis…

C. B. : C’est indéniable. La majorité des rencontres – 78 sur 104 – et donc de l’exposition médiatique, se déroulera sur le sol des États-Unis. En matière de « nation branding », c’est un avantage considérable : pendant un mois, les images diffusées dans le monde entier montreront avant tout les grandes villes états-uniennes.

Dans le contexte actuel, l’administration Trump cherchera naturellement à exploiter cette visibilité pour rappeler que la puissance dominante du continent nord-américain reste les États-Unis et, aussi, pour faire avancer l’agenda MAGA.

Le Canada et le Mexique peuvent-ils malgré tout tirer leur épingle du jeu ?

C. B. : Bien entendu, ils chercheront à démontrer qu’ils disposent du même niveau d’excellence en matière de sécurité, de transports et d’infrastructures. L’organisation d’une manifestation sportive d’ampleur souligne le sérieux d’un pays.

Mais ils pourront surtout se distinguer par leur image. Les quelques minutes montrant les villes hôtes, leurs paysages ou leur patrimoine sont extrêmement précieuses. Elles participent directement à la construction d’une réputation internationale – ce fameux nation branding que je viens d’évoquer.

Il existe aussi une véritable compétition de l’hospitalité. Les supporters du monde entier compareront l’accueil reçu dans chacun des trois pays. Sur ce terrain, le Canada et le Mexique disposent d’atouts importants et devraient d’ailleurs bénéficier d’une image plus chaleureuse que celle des États-Unis.

Justement, la politique migratoire de Donald Trump semble pour le moins en contradiction avec l’idée d’une Coupe du monde ouverte sur le monde…

C. B. : C’est toute l’ambiguïté du trumpisme. D’un côté, il recherche une visibilité universelle ; de l’autre, il défend une fermeture des frontières particulièrement stricte, ce qui empêche les ressortissants de plusieurs pays qualifiés pour la Coupe du monde de se rendre aux États-Unis pour soutenir leur sélection…

Sur le plan intérieur, cette fermeté lui est politiquement utile. Une image d’intransigeance sur la protection des frontières reste populaire auprès d’une partie importante de son électorat.

Certains craignent que les rassemblements de supporters, notamment de pays latino-américains, puissent servir de prétexte à des opérations contre les migrants clandestins. Ce scénario vous paraît-il crédible ?

C. B. : Avec Donald Trump, tout dépendra du contexte politique du moment. Si la priorité est d’afficher une ligne dure sur l’immigration, ce risque existe. À l’inverse, si l’administration souhaite préserver l’image d’un événement festif et rassembleur, elle pourra demander davantage de retenue à ses services.

Mais il y a aussi un risque politique pour la Maison Blanche : des opérations policières spectaculaires pourraient provoquer des contre-manifestations qui seraient, elles aussi, diffusées dans le monde entier. L’administration devra donc arbitrer entre bénéfice politique intérieur et coût d’image international.

La présence de la sélection nationale d’Iran est également très observée. Peut-elle devenir un enjeu diplomatique majeur ?

C. B. : Les grandes compétitions sportives ne créent pas les tensions internationales : elles les révèlent. Les modalités de la participation de l’Iran dépendront avant tout de l’état des relations entre Washington et Téhéran au moment du tournoi – des relations qui évoluent quasiment au jour le jour.

Cette question peut devenir, comme l’ont été dans le passé certains boycotts olympiques, un instrument de pression ou de négociation. On sait déjà que les Iraniens, qui disputeront leurs matchs sur le territoire des États-Unis, seront finalement basés au Mexique, à Tijuana, tout près de la frontière, et devront, chaque fois, faire l’aller-retour dans la journée. Mais la Coupe du monde n’est ici que le reflet d’un rapport de force qui lui préexiste.

Il en ira de même pour les éventuelles manifestations autour des droits humains ou des minorités. Les acteurs politiques et associatifs chercheront naturellement à profiter de la visibilité exceptionnelle de l’événement.

Justement, les fractures politiques internes des États-Unis risquent-elles aussi de s’inviter dans le tournoi ?

C. B. : Probablement. Beaucoup de grandes villes hôtes sont dirigées par des élus démocrates et entretiennent des relations très tendues avec Donald Trump. On pense à Los Angeles, à Seattle, à Boston ou encore à New York, où se déroulera la finale le 19 juillet, dirigée depuis peu par un maire qui incarne à peu près tout ce que Trump déteste, Zohran Mamdani…

La polarisation de la société américaine pourrait donc apparaître à travers les débats sur la sécurité, la gestion des manifestations – notamment celles organisées dans le cadre du « mois des fiertés », qui court jusqu’à fin juin – ou encore la politique migratoire. Les États-Unis sont une démocratie très décentralisée : le maintien de l’ordre dépend de plusieurs niveaux d’autorité qui peuvent être politiquement opposés.

Contrairement à des régimes plus autoritaires, où les grandes compétitions se déroulent dans un relatif silence politique, les États-Unis ne pourront pas occulter ces frictions au grand jour.

Peut-on s’attendre à voir émerger d’autres revendications politiques pendant la compétition ?

C. B. : Bien sûr. Une Coupe du monde rassemble un nombre considérable d’États, de peuples et de diasporas. Elle constitue donc une formidable caisse de résonance pour toutes sortes de causes : conflits régionaux, revendications identitaires ou manifestations de solidarité avec telle ou telle cause.

Mais il ne faut pas oublier l’autre dimension du sport. Ces événements peuvent aussi produire des images d’apaisement, de fraternité ou de rapprochement entre peuples. C’est tout leur paradoxe : ils mettent en scène la compétition tout en cherchant à rassembler.

Quel rôle la FIFA joue-t-elle dans cette dimension politique ?

C. B. : La FIFA revendique son apolitisme, mais elle entretient nécessairement des relations étroites avec les dirigeants politiques des pays organisateurs. Son objectif premier reste le développement et le financement du football mondial.

Gianni Infantino, qui préside la FIFA depuis 2016, s’apprête à vivre sa troisième Coupe du Monde à ce poste : après la Russie de Poutine en 2018 puis le Qatar en 2022, il chante désormais les louanges des États-Unis de Trump. On peut penser qu’il a parfaitement compris la personnalité de celui-ci et pratique à son égard une forme de diplomatie par la flatterie à laquelle le président américain est très sensible, aussi grossière soit-elle, comme on l’a vu avec l’invention par la FIFA d’un « prix de la paix » attribué à Trump quelques jours après l’annonce que, malgré ses espoirs, il n’avait pas reçu le Nobel de la paix…

Ce n’est d’ailleurs pas une nouveauté : les grandes organisations sportives ont toujours cultivé des relations ambiguës avec les pouvoirs politiques – que l’on pense aux mandats de Joao Havelange à la tête de la FIFA ou de Juan Antonio Samaranch au CIO, entre autres…

Leur logique est avant tout économique. Les compétitions internationales sont devenues des produits mondiaux dont les recettes permettent de financer une partie du sport professionnel.

Finalement, cette Coupe du monde sera-t-elle surtout celle de Donald Trump ?

C. B. : Donald Trump essaiera sans aucun doute d’en faire une vitrine de sa vision du monde. Mais, je le répète, le sport est un objet profondément ambigu : il peut servir des récits très différents, parfois opposés.

On peut y voir un symbole d’inclusion ou au contraire de compétition et de hiérarchie. Un même événement peut être utilisé pour promouvoir des valeurs universalistes ou des discours nationalistes.

Au fond, le sport est un espace parmi d’autres où s’affrontent des narratifs concurrents. C’est déjà le cas sur les véritables théâtres de crise, en Ukraine, à Gaza ou autour de l’Iran ; cela se prolonge dans les grands rendez-vous médiatiques mondiaux.

Cette Coupe du monde sera donc bien plus qu’un tournoi de football : elle sera une immense bataille de récits, où chaque acteur cherchera à imposer sa propre lecture du monde.

Propos recueillis par Grégory Rayko.

Cyrille Bret ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

09.06.2026 à 16:20

États-Unis : les raisons pour lesquelles les travailleurs votent moins qu’avant pour le parti démocrate

Nicholas Jacobs, Goldfarb Family Distinguished Chair in American Government, Colby College; Institute for Humane Studies

Texte intégral (2575 mots)

Voilà plusieurs années que les démocrates états-uniens cherchent la formule magique pour reconquérir les travailleurs, électorat qui leur semblait longtemps acquis. Pour cela, ils insistent sur les questions économiques. Mais les enquêtes montrent que, entre les travailleurs et le parti, le fossé n’a cessé de se creuser depuis un demi-siècle sur des questions comme le rapport à l’équité et à l’effort individuel, sur les valeurs sociétales ou encore sur la confiance dans les institutions.

Depuis l’élection présidentielle de 2016 – année où Donald Trump a brisé le « mur bleu » des démocrates en remportant de nombreux suffrages de la classe ouvrière dans plusieurs États du Midwest –, la gauche cherche désespérément à répondre à cette question : comment regagner le soutien de la classe des travailleurs (working class) ?

Les réponses apportées prennent différentes formes. Le chevronné sénateur du Vermont Bernie Sanders fait campagne dans les circonscriptions républicaines, dénonçant l’oligarchie et la cupidité des entreprises. Son homologue du Connecticut Chris Murphy martèle que « les démocrates doivent se réapproprier leur identité de parti de la classe des travailleurs ». On a également assisté à l’émergence d’une nouvelle génération de candidats : Alexandria Ocasio-Cortez a été serveuse dans un bar, Marie Gluesenkamp Perez a travaillé en tant que mécanicienne, Graham Platner est un vétéran de l’armée arborant de nombreux tatouages… Leurs parcours de vie sont brandis en étendard pour reconquérir un électorat que le parti a longtemps cru acquis.

Graham Platner, candidat au Sénat du Maine qui apparaît comme le dernier sauveur des démocrates issu des cols bleus, a exprimé cette théorie sans détour : « Nous sommes dans une forme de guerre des classes », affirme-t-il.

« Et si le parti démocrate veut avoir un avenir auprès des travailleurs, il doit se ranger du côté des travailleurs. »

Mais qui est un « travailleur », selon lui ? Réponse :

« Essentiellement toute personne qui ne tire pas l’intégralité de ses revenus d’une immense fortune. »

La théorie est toujours la même : il existe quelque part une majorité latente de travailleurs, unie par des revendications économiques communes, qui attend d’être politiquement mobilisée pour voter en faveur des démocrates. Franklin D. Roosevelt y est parvenu avec son New Deal : ses lointains successeurs peuvent donc y parvenir à nouveau.

Je suis politologue et j’ai beaucoup travaillé sur les communautés rurales et ouvrières des États-Unis. À mon sens, l’une des questions essentielles est de savoir si ces démocrates réformistes sont réellement déterminés à comprendre les électeurs appartenant à ces catégories. Car ces derniers, comme ils le disent eux-mêmes, n’attendent pas simplement d’être mobilisés par le bon programme, le bon messager, la bonne formule. Les inviter à « combattre l’oligarchie » ne suffira probablement pas.

Les électeurs de cette classe sociale ont une vision du monde. Depuis cinquante ans, celle-ci s’est progressivement éloignée de celle du parti démocrate – non pas parce que les travailleurs ont fondamentalement changé, mais parce que les démocrates ne sont plus les mêmes.

L’identité de la classe ouvrière

Depuis le début des années 1950, l’institut d’enquêtes American National Election Studies demande aux personnes interrogées si elles se considèrent comme appartenant à la classe des travailleurs. Cet article s’appuie sur mon analyse des réponses.

Alors que la proportion des électeurs disposant d’un diplôme a augmenté, de même que les revenus des ménages, la part des Américains qui se considèrent comme appartenant à la classe des travailleurs est restée remarquablement stable : environ 35 % des électeurs au cours des soixante-dix dernières années, 38 % en 2024.

L’identité de cette classe ne se résume pas au fait de ne pas disposer d’une immense fortune personnelle. Se considérer aujourd’hui comme travailleur, c’est une façon spécifique de voir le monde.

Il existe des manières conventionnelles de définir la classe des travailleurs, mais elles passent souvent à côté de la manière dont les gens perçoivent leur propre place dans la société. En 2024, par exemple, 21 % de ceux qui s’identifient à la classe des travailleurs sont titulaires d’un diplôme universitaire, seuls 5 % appartiennent à un syndicat du secteur privé et 37 % possèdent des actions. À l’inverse, la plupart des Américains sans diplôme universitaire ne s’identifient pas à cette classe.

Les travailleurs n’ont jamais constitué un groupe votant de façon écrasante pour le parti démocrate, pas même à l’apogée de la coalition du New Deal. D’après les données recueillies par l’American National Election Studies, la part des travailleurs parmi les électeurs démocrates a atteint un pic d’environ 56 % en 1960 et n’a cessé de baisser depuis, pour s’établir aujourd’hui à un peu plus de 30 %. Parallèlement, la part des électeurs relevant de cette classe qui s’identifient comme démocrates est en baisse depuis un demi-siècle : c’était le cas de la majorité d’entre eux en 1958, ce n’est plus le cas depuis.

Ces électeurs ne sont pas devenus républicains pour autant. Ce n’est qu’en 2020 et en 2024 – une première depuis que ces enquêtes sont conduites – qu’un plus grand nombre d’électeurs de la classe des travailleurs se sont identifiés comme républicains plutôt que démocrates – et encore, avec une marge très faible. Les données dressent le tableau d’une classe ouvrière politiquement sans attache, éloignée des démocrates, non ralliée aux républicains, coincée entre les deux et éprouvant un attachement de moins en moins marqué à l’un ou l’autre des partis.

L’abandon économique

Alors, qu’est-ce qui les a poussés à se détourner du « parti de l’âne » ?

Une partie de la gauche progressiste a une réponse toute prête : les démocrates ont abandonné les travailleurs sur le plan économique – notamment sur les dossiers des échanges commerciaux, des salaires et de la politique industrielle. Les électeurs ont alors réagi de manière rationnelle. « Réglez les problèmes économiques et la coalition reviendra ». C’est sur la question des échanges commerciaux avec les pays étrangers que l’argument est le plus pertinent. En 1988, environ les trois quarts aussi bien des électeurs démocrates que des travailleurs étaient favorables à la mise en place de restrictions sur les importations pour protéger les emplois américains.

En 2024, seuls 26 % des démocrates étaient favorables à ces restrictions, tandis qu’une majorité – 54 % – des travailleurs continuait de l’être. Contrairement à la plupart des démocrates, les travailleurs, le plus souvent, ne considèrent pas que la mondialisation est dans leur intérêt.

Parallèlement à cet écart sur la question du protectionnisme, on observe un fossé grandissant en matière de valeurs – un fossé qu’aucun droit de douane ne peut combler.

Ce qu’exige l’équité

En 1984, les démocrates et les travailleurs s’accordaient largement sur l’idée qu’un traitement plus équitable des personnes réduirait les problèmes sociaux. Des divergences sont apparues après 2008 et se sont accentuées après 2016, les démocrates étant désormais à 28 % plus enclins que les travailleurs à penser que l’égalité devrait être une priorité plus importante.

En 1986, la moitié des démocrates modérés et un pourcentage légèrement inférieur de travailleurs partageaient l’idée selon laquelle les Afro-Américains ne réussissaient pas parce qu’ils ne faisaient pas assez d’efforts. En 2024, ce pourcentage n’était plus que de 13 % chez les démocrates. Il avait également baissé chez les travailleurs, mais seulement jusqu’à 32 %.

Le fossé qui s’est creusé entre eux ne s’explique pas principalement par une montée du ressentiment racial au sein de la classe ouvrière. La raison première est le glissement rapide opéré, après 2008, par le Parti démocrate vers une vision du monde qui accorde beaucoup plus d’importance aux barrières structurelles et beaucoup moins à l’effort individuel et à la responsabilité personnelle. Les travailleurs, qui ont toujours appréhendé leur propre vie à travers le prisme du travail acharné et de la récompense méritée, n’ont pas évolué sur cette question dans les mêmes proportions.

De l’alignement à la division

Sur les questions sociétales, la tendance se confirme. Ce ne sont pas les travailleurs qui ont dérivé vers la droite dans un élan de révolte réactionnaire ; ce sont les démocrates qui ont nettement mis le cap à gauche. En 1986, une proportion similaire de démocrates et de travailleurs adhérait à l’affirmation suivante : « Ce pays aurait beaucoup moins de problèmes si l’on accordait davantage d’importance aux liens familiaux traditionnels. » En 2024, un écart de 25 points s’est creusé.

Sur l’importance de la religion dans leur vie, l’écart entre démocrates et travailleurs, quasi nul au début des années 1990, est passé à 17 points en 2024. Sur l’avortement, l’écart était de 3 points en 1980 et de 30 points en 2024. Quant à la question de savoir si les niveaux d’immigration devraient être augmentés, les deux groupes étaient pratiquement sur la même ligne en 2000 – avec un soutien d’environ 8 % à cette idée –, mais, en 2020, les démocrates étaient 48 % à y être favorables, contre 24 % pour les travailleurs.

Cependant, même lorsque les électeurs de la classe ouvrière sont en principe d’accord avec un objectif politique démocrate, ils ne font pas confiance à l’institution chargée de le mettre en œuvre – une méfiance qui s’est construite au fil des décennies.

Comment fonctionne le « système »

En 1958, les électeurs issus de la classe ouvrière et les démocrates n’étaient séparés que de 5 points d’écart sur la question de savoir si le gouvernement gaspillait une partie considérable de l’argent des contribuables. En 2024, cet écart avait atteint 27 points – non pas parce que les travailleurs e avaient basculé vers un extrémisme anti-gouvernemental, mais parce que les démocrates modérés avaient considérablement renforcé leur confiance dans le gouvernement en tant qu’instrument de changement social.

Les électeurs de la classe ouvrière sont à 17 % plus susceptibles que les démocrates de considérer que les gens comme eux n’ont pas leur mot à dire sur ce que fait le gouvernement. En 2024, 88 % des travailleurs et 75 % des démocrates ont déclaré que le gouvernement était dirigé par quelques grands groupes d’intérêts. Les deux groupes s’accordent donc à dire que le système est sous emprise. Pourtant, la réponse politique des démocrates consiste invariablement à étendre le système.

Sur cette question de l’extension du rôle de l’État – des soins de santé à l’emploi en passant par les programmes environnementaux –, les démocrates et les travailleurs ont vu leurs positions diverger considérablement depuis les années 1980. En 2024, on observait des écarts de 20 à 30 points en matière d’approbation concernant la mise en place d’une assurance maladie publique, les dépenses environnementales et un programme d’emploi garanti. Sur tous les grands axes du programme économique progressiste, les démocrates se situent désormais nettement plus à gauche que les travailleurs qu’ils prétendent défendre.

Ce n’est pas seulement une guerre des classes

Depuis soixante ans, les travailleurs ne cessent de répéter aux sondeurs que le système politique ne les écoute pas. Au cours de cette même période, les démocrates se sont de plus en plus accommodés des institutions dans lesquelles les travailleurs ont de moins en moins confiance. Cette méfiance est le résultat cumulé d’expériences spécifiques : la désindustrialisation qui s’est produite sous l’œil du gouvernement, les accords commerciaux approuvés par les économistes et payés par les travailleurs, une réponse à la crise financière de 2008 qui a sauvé les banques et saisi leurs maisons, une épidémie d’opioïdes que les régulateurs n’ont absolument pas vue venir.

C’est précisément ce que la nouvelle vague de candidats réformateurs affirme vouloir rectifier. L’argument selon lequel « le bon candidat peut faire pencher la balance » n’est pas absurde. La qualité des candidats a son importance. La confiance en une personne peut se substituer à la confiance dans les institutions, du moins dans une certaine mesure. Mais les revendications économiques ne représente qu’une infime partie de ce qui ressort des réponses données par les travailleurs aux sondeurs.

Les données montrent une divergence profonde, qui dure depuis des décennies, entre la façon dont les travailleurs et les démocrates traditionnels appréhendent l’équité, le gouvernement, la responsabilité individuelle et le changement social.

Ne parler que de « guerre des classes » enferme les travailleurs dans un programme progressiste tout fait, au lieu de prendre au sérieux ce qu’ils disent réellement.

Nicholas Jacobs ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

09.06.2026 à 16:19

Perdre son emploi à cause de l’IA ? Anticiper ne protège pas la santé mentale

Nicolas Herault, Professor, Bordeaux Schoool of Economics, Université de Bordeaux

Daniel Nettle, Professor of Community Wellbeing, Northumbria University, Newcastle

Texte intégral (1369 mots)

Un homme, ou une femme, averti en vaut-il, ou elle, vraiment deux quand on évoque l’impact d’un licenciement sur la santé mentale des personnes ? Rien n’est moins sûr, selon une étude menée pendant vingt ans en Australie. Si les résultats sont transposables, estimer ou non que l’IA détruira son emploi a peu d’impact. En revanche, retrouver vite un emploi contribue à la restauration du bien-être psychique des individus.

L’idée que l’intelligence artificielle va détruire des millions d’emplois s’est imposée dans le débat public. L’Organisation de coopération et de développement économiques (OCDE) estime que 27 % des emplois sont exposés à un risque élevé d’automatisation, et trois travailleurs sur cinq déclarent craindre de perdre leur emploi dans les dix prochaines années.

Voilà pour les chiffres, mais qu’en est-il de leur impact sur les personnes et leur santé ? Voir venir la perte de son emploi serait, en soi, une source importante de souffrance psychologique. Les mois passés à appréhender l’échéance pèseraient lourd sur la santé mentale, peut-être autant que la perte elle-même.

Dans une nouvelle étude publiée dans la revue Social Science & Medicine, nous comparons les trajectoires de santé mentale de personnes qui ont anticipé leur licenciement à celles qui ne l’avaient pas anticipé. Le résultat surprend : les deux groupes suivent des trajectoires très proches, avant comme après la perte d’emploi.

Il y a donc deux questions bien distinctes : l’effet de la perte d’emploi sur la santé mentale, et l’effet d’anticiper cette perte d’emploi. La première est bien documentée. Perdre son emploi dégrade la santé mentale, à la fois parce que le revenu chute et parce que le travail est souvent source d’accomplissement alors que le chômage reste socialement stigmatisant. La seconde est plus disputée. De nombreuses études observent un déclin de la santé mentale dans les mois précédant un licenciement et l’attribuent à un effet d’anticipation.

À lire aussi : L'IA générative ne détruira pas votre emploi mais elle va changer profondément votre métier

Dégradation des conditions de travail

Faute d’informations sur le niveau effectif des anticipations, jusque-là, ces études ignoraient si les individus anticipaient réellement leur licenciement. Or, le déclin de la santé mentale avant le licenciement peut aussi refléter des dynamiques antérieures – conditions de travail qui se détériorent, restructurations silencieuses, climat anxiogène – qui pèsent sur la santé mentale indépendamment de toute anticipation des individus vis-à-vis de leur propre emploi.

Nous mobilisons 22 vagues annuelles (2001–2022) de l’enquête HILDA, un panel représentatif qui suit les mêmes individus dans le temps en Australie. La santé mentale est mesurée à l’aide de l’indice SF-36, un outil clinique validé qui s’étend de 0 à 100. Notre échantillon comprend 14 195 personnes et 4 251 licenciements. L’enquête enregistre le trimestre exact du licenciement, ce qui permet d’examiner finement les trajectoires sur les trimestres précédant et suivant l’événement.

Surtout, HILDA demande chaque année aux personnes en emploi quelle probabilité, mesurée de 0 à 100 %, elles attribuent à la perspective d’être licenciées dans les douze mois suivants. Cette mesure subjective nous permet de distinguer ceux qui anticipent leur licenciement – c’est-à-dire qui déclarent une probabilité non nulle – de ceux qui ne l’anticipent pas, c’est-à-dire qui déclarent une probabilité nulle.

Notre démarche est comparative et non causale. Les personnes qui anticipent et celles qui n’anticipent pas peuvent différer sur des dimensions non observées, et les déclins observés avant le licenciement peuvent refléter des facteurs partagés, comme une dégradation de la situation de l’entreprise, plutôt que l’anticipation elle-même.

Avant et après : des trajectoires comparables

Dans les mois précédant le licenciement, les deux groupes affichent un déclin de santé mentale. Chez les personnes qui n’anticipaient pas, l’indice SF-36 baisse d’environ 2,1 points dans le trimestre précédant immédiatement la séparation. Chez celles qui anticipaient, la baisse est de 1,2 point sur la même période. Les ordres de grandeur sont proches, et les tests statistiques ne permettent pas de conclure à une différence significative entre les deux groupes.

Ce résultat invite à reconsidérer une interprétation courante : la dégradation de la santé mentale prélicenciement documentée dans la littérature ne traduit pas seulement une anticipation individuelle. Elle apparaît aussi chez des personnes qui, dans les mois précédant la perte, jugeaient leur risque de licenciement nul. D’autres mécanismes sont vraisemblablement à l’œuvre – dégradation des conditions de travail, tensions internes, restructurations précédant licenciement.

Une fois le licenciement intervenu, les trajectoires divergent fortement, non pas selon l’anticipation, mais selon le retour à l’emploi. Les personnes qui retrouvent rapidement un emploi voient leur santé mentale revenir à son niveau habituel en quelques trimestres, qu’elles aient anticipé leur licenciement ou non. Celles qui restent au chômage continuent en revanche à souffrir : leur indice SF-36 reste inférieur à son niveau habituel un an après la perte d’emploi.

Comment préparer la vague de l’IA ?

Là encore, l’anticipation ne change presque rien. Cumulée sur les quatre trimestres qui précèdent et ceux qui suivent la perte d’emploi, la baisse de l’indice SF-36 atteint 14 points pour celles qui n’avaient pas anticipé et 14,4 points pour celles qui avaient anticipé. Cet écart est trop faible pour qu’on puisse y voir une véritable différence. Les conclusions sont les mêmes pour les hommes et pour les femmes, et se retrouvent aussi quand on remplace l’indice SF-36 par une mesure de satisfaction de vie.

Notre étude porte sur des licenciements survenus dans l’Australie des deux dernières décennies, pas sur des licenciements liés à l’IA. Mais ses enseignements éclairent les inquiétudes actuelles. L’idée selon laquelle voir venir la perte de son emploi constituerait, en soi, le principal facteur de détresse psychologique ou, au contraire, serait propice à une meilleure préparation et donc à un rebond plus rapide, mérite d’être nuancée. Dans nos données, ce qui pèse le plus, c’est la perte elle-même et, surtout, la rapidité avec laquelle on retrouve un travail.

Cela suggère que les politiques visant à atténuer le coût psychologique des transformations technologiques gagneraient à mettre l’accent moins sur la gestion de l’angoisse anticipée et davantage sur les trajectoires de retour à l’emploi : formation, accompagnement, intermédiation. C’est dans la trajectoire d’emploi, plus que dans l’anticipation, que se joue la santé mentale des travailleurs licenciés.

Nicolas Herault a reçu des financements de l'Agence nationale de la recherche (ANR), du Ministère de l'Enseignement supérieur, de la Recherche, de l'IdEx Université de Bordeaux et du GPR HOPE.

Daniel Nettle a reçu des financements de l'Agence Nationale de la Recherche (ANR, France) ainsi que le National Institute for Health and Care Research (NUHR, UK).

09.06.2026 à 16:19

Que reste-t-il du réel et de notre capacité à le discerner ?

Carole Lipsyc, Epistémologue, Université Paris 8 – Vincennes Saint-Denis

Texte intégral (2494 mots)

Métapolitique, guerre des récits, guerre cognitive, bulles de filtres, complotisme, post-vérité… un arsenal de concepts est déployé au fil de l’actualité comme si, chacun depuis sa discipline, essayait de comprendre une catastrophe globale. Si les prismes varient, tous s’accordent à en retracer l’origine dans notre accès à l’information au travers des nouveaux médias et des technologies numériques : réseaux sociaux, Internet, algorithmes de curation de l’information, outils génératifs de contenu.

La révolution électronique, informatique et médiatique que nous connaissons depuis le siècle dernier aurait fourni au capitalisme et à la propagande l’opportunité de se renouveler et de se décupler, l’un sous la forme de l’économie de l’attention, l’autre de la cyberguerre narrative. Leurs intentions malveillantes fructifieraient grâce à nos biais cognitifs, notre narcissisme spéculaire, notre envie incessante de divertissement et notre abandon addictif aux stimulations sensationnelles.

Toutes ces explications sont amplement documentées. Elles sont justifiées. Cependant, une question reste en suspens : pourquoi en sommes-nous étonnés ? Que continuons-nous de croire de nous-mêmes et de notre prétendue préférence pour la rationalité ? Pourquoi – après Ricœur, Lacan, Castoriadis, Rosset, tant d’autres – oublions-nous que notre rapport au réel est toujours médié par le langage et le récit ? Nous sommes « l’espèce fabulatrice », comme nous nomme l’autrice Nancy Huston.

Fabriquer des récits

Certes, les Lumières ont exprimé l’ambition d’éclairer le réel pour tenter de le connaître, plutôt que d’y chercher la confirmation de nos mythes à la manière de Don Quichotte. Et en cela Foucault avait raison : Don Quichotte est bien le personnage qui pose la question de la modernité. Non pas dans l’abandon du mythe – car comment l’abandonner ? nous sommes humains – mais dans la volonté de le surveiller.

Cet horizon du désir de rationalité que nous avions cru acquis était celui de l’esprit critique : la promesse ou l’intention de révision de nos paradigmes quand le réel les contredit de son choc.

Car le réel existe même si c’est toujours « son double », sa « représentation » – la réalité – que nous utilisons pour nous situer dans le monde. Et c’est toujours la réalité que nous partageons avec les autres pour nous mettre d’accord, qu’il s’agisse d’organiser un piquenique, un régime politique ou un voyage sur Mars.

La réalité, n’est pas juste une interprétation ou un récit. C’est une fiction qui ne cesse de se renouveler, au fur et à mesure des événements du réel : un récit variable, un récit virtuel, un récit rendu possible par tout un univers qui le soutient et le génère.

En narratologie, l’univers qui rend possible un récit est désigné par le concept de « storyworld », très littéralement le « monde du récit ».

Faire « comme si »

Un storyworld ne correspond pas seulement à une manière de raconter une histoire – ce qu’on nomme communément le storytelling. Il fonctionne comme une « fabrique de récits » : un ensemble de règles et de repères (un modèle), capable de déployer indéfiniment sa propre cohérence, sa « vérité de fiction ».

Ainsi, personne ne croirait qu’Harry Potter utilise un sabre laser pour combattre Voldemort ou que Luke Skywalker affronte Dark Vador avec une baguette magique. Harry Potter et la Guerre des Étoiles sont deux storyworlds différents. Ils ont chacun leur propre vérité de fiction qui fait foi et loi. Et, quand nous plongeons dans ces storyworlds, nous établissons un pacte de vraisemblance temporaire avec leur vérité de fiction, le temps de la lecture ou du film.

Le philosophe Kendall Walton explique que nous établissons ce type de pacte par processus de « make-believe » : nous faisons « comme si », à l’exemple des enfants qui jouent aux pirates dans un parc. Pour ouvrir leur storyworld, un simple accessoire leur suffit : un toboggan devient une cascade, un bac à sable une île au trésor.

Don Quichotte employait le même procédé : les moulins étaient ses accessoires pour basculer dans son storyworld chevaleresque. Lui cependant ne refermait jamais ses livres ni leur pacte de vraisemblance. La vérité de fiction était devenue la seule qui fît sens. Il utilisait son storyworld chevaleresque pour traiter le réel et générer sa réalité.

Son storyworld chevaleresque était devenu performatif : il impactait et modifiait le réel. La bataille contre des géants était vraie, vraie selon sa vérité de fiction : un fait alternatif.

Et c’est bien ainsi qu’il faut comprendre la notion de « fait alternatif » proposée par Kellyane Conway, conseillère de l’administration Trump 1.

Les dangers très réels du « storyworld MAGA »

Dans le storyworld MAGA, la foule présente à l’investiture de Trump ne pouvait qu’être « la plus grande audience ayant jamais assisté à une investiture », tout comme les élections de 2020 ne pouvaient pas avoir été perdues. Faits alternatifs attestés par la vérité de fiction, acceptés par un pacte de vraisemblance collectif, générés par le modèle du storyworld MAGA, où tout ce que fait Trump est, par essence, toujours ce qu’il y a de plus grand et de plus beau.

Trump l’avait d’ailleurs déjà théorisé dans son livre l’Art du deal. Il y défendait l’« hyperbole véridique » : partir d’un détail vrai pour tisser le récit le plus flatteur possible et faire rêver. L’hyperbole véridique est la vérité de fiction qui s’appuie sur un accessoire pour stimuler la projection sur le réel d’un storyworld fantaisiste. Et si les gens y croient, disait-il, c’est parce qu’ils aiment rêver et voir grand… Ils veulent passer un pacte de vraisemblance avec une réalité plus merveilleuse que réaliste.

Trump et Don Quichotte ont en commun de ne pas prendre le réel comme référent mais comme accessoire pour générer un double du réel irréaliste, une réalité alternative et fictive. À la différence de Trump cependant, Don Quichotte ne partage pas sa vérité de fiction et son pacte de vraisemblance avec des adeptes. Il reste seul dans son storyworld.

Un storyworld performatif fictif qui est adopté par une communauté, c’est dangereux. Au contraire d’un storyworld performatif à ambition réaliste comme peut l’être un storyworld scientifique, il n’est pas confirmé par le réel : il ne tient que par le pacte de vraisemblance collectif de ses adeptes. Toute dissidence est alors réprimée. Et la répression va aussi loin que le pouvoir du storyworld.

Dans la cour de récréation, c’est la mise au ban. Sur les réseaux sociaux, c’est le bashing, la diffamation, le cancelling. À la tête d’un État, c’est la pénalisation et ses conséquences : amendes, emprisonnement, exécution. Pensons au sort des Russes qui ont osé braver l’interdiction de nommer le conflit en Ukraine « guerre », par exemple. Ou encore aux fins de coopération culturelles avec la Chine pour les établissements occidentaux qui refusent d’effacer le nom « Tibet » de leur signalétique et commentaires.

Ainsi, notre rapport au réel est toujours médié par nos storyworlds, de manière individuelle ou collective. Pour autant, tous les storyworlds performatifs ne sont pas équivalents. Certes, ils sont tous fictionnels puisqu’ils relèvent du niveau de la représentation et de la narration. Toutefois, certains prennent le réel comme référent, ils sont réalistes, d’autres sont autoréférentiels et utilisent le réel comme accessoire, ils sont fictifs. La frontière n’est pas totalement étanche. Il serait plus juste de parler de degré de proximité au réel, et surtout de mécanismes d’autosurveillance/autocorrection.

Certains storyworlds autorisent en effet le débat, la controverse et la remise en cause. D’autres non. Par exemple, le storyworld galiléen – pour qui le Soleil est situé au centre de l’Univers, les planètes gravitant autour de lui – soumettait les énoncés à la démonstration mathématique et à la confrontation avec l’expérience, tandis que face à lui le storyworld ecclésial requalifiait la dissidence doctrinale en hérésie et la traitait comme un écart appelant sanction. L’un acceptait les processus de révision, l’autre pas. Cependant, l’un comme l’autre créait des représentations mentales du réel, forcément de nature fictionnelle.

Et c’est justement le caractère fictionnel inévitable de nos représentations du réel, de la réalité, qui apporte une explication à l’appétence pour les faits alternatifs à laquelle nous assistons. Il existe bel et bien un lien entre le succès et la prolifération actuels des storyworlds performatifs fictifs et notre nouvel environnement médiatique et technique.

Jusqu’au siècle dernier, la réalité générée en continu par nos storyworlds performatifs demeurait principalement confinée à l’imaginaire et aux représentations mentales. Désormais, cette réalité issue de nos storyworlds a trouvé une matière pour se manifester directement à nos sens : la matrice médiatique créée par la révolution électronique et numérique.

Cette matrice constitue un véritable lieu de vie où nous travaillons, étudions, commerçons, militons, rencontrons les autres et l’amour, etc. Elle prolonge notre habitat. Ce nouvel habitat est un grand spectacle immersif : un monde-spectacle. Un monde-récit. Le Storyworld, cette fois avec un s majuscule.

Vivre en représentation permanente

Dans le Storyworld, deux phénomènes perturbent notre fragile capacité à accepter la prééminence du réel.

Tout d’abord, dans le Storyworld, on vit quelque part : on vit là où se diffusent nos storyworlds performatifs. Le Storyworld les manifeste à la fois par des mécanismes ordinaires – curation sélective des contenus, écho communautaire, affinités médiatiques – et par des procédés délibérés tels que la désinformation ou les deepfakes. Il existe dès lors une continuité et un renforcement mutuel entre nos storyworlds performatifs et le Storyworld que nous habitons. D’où le recours au même terme.

Or, cette continuité entraîne un changement de régime aux storyworlds et à la réalité qu’ils génèrent : pour la première fois de l’histoire, ils deviennent perceptibles. Nos sens les voient, les lisent, les entendent. Ils ont quitté l’espace mental pour s’incarner dans l’espace médiatique immersif.

Don Quichotte n’a plus des moulins devant lui, il a vraiment des géants. Il n’est plus vêtu d’un attirail de bric et de broc, il évolue vraiment dans une armure. C’est là, sous ses yeux.

Et c’est cela le deuxième phénomène : dans le Storyworld nous fonctionnons en état de représentation permanente, au travers de nos avatars, ces images-miroir de nous-mêmes toujours affichées quelque part sur l’écran. C’est troublant. La distance entre notre présence et notre représentation s’en trouve bousculée. Le miroir déformant remplace l’ontologie première.

Dans cet écrasement entre la présence et la représentation, au sein d’un storyworld que nous habitons vraiment, comment faire la différence entre le réel, sa représentation réaliste et sa représentation fictive ? Pourquoi préférer une réalité qui prend le réel pour référent plutôt qu’une réalité fictive autoréférentielle ? Pourquoi s’astreindre à cet effort, à cette douleur, à ce risque aussi – car notre sociabilité dépend de notre fidélité aux pactes de vraisemblance collectifs auxquels nous avons adhéré.

Il en résulte une crise anthropologique du rapport au réel dont l’enjeu n’est pas uniquement l’avenir de nos démocraties, mais aussi la préservation de notre lucidité, autrement dit de ce qui nous permet d’organiser le réel, de lui donner du sens par le langage – et nous distingue de l’algorithme.

Nous publions ce texte dans le cadre du colloque du 11 juin 2026 « Penser le monde qui vient », organisé le 11 juin 2026 par la chaire « Prospective, imaginaires et politiques publiques » de CY Cergy Paris Université, Learning Planet Institute et l’association Le 106, dont The Conversation est partenaire. Si vous souhaitez y assister, vous pouvez vous inscrire en cliquant ici.

Cet article reprend par ailleurs les travaux du livre de l’autrice : La Dérive du réel, Éditions de l’Aube (2025).

Carole Lipsyc a cofondé et dirige la recherche de l'Initiative contributive.

09.06.2026 à 16:19

Autoconsommation collective d’électricité : pourquoi il faut rendre le choix aux citoyens

Julien Jacqmin, Associate professor in economics, Neoma Business School

Isac Olave-Cruz, Maître de conférences en économie, Université de Rouen Normandie

Marco Gazel, Économiste, enseignant-chercheur en économie comportementale, Neoma Business School

Texte intégral (2197 mots)

La réforme de l’autoconsommation collective, actuellement envisagée en France, vise à faire évoluer les règles de répartition de l’électricité produite par les participants d’un projet collectif d’autoconsommation. Jusqu’alors, ces derniers pouvaient les définir et les faire évoluer comme ils l’entendaient. Demain, il s’agira avant tout de maximiser l’autoconsommation locale. Derrière ce qui semble être une simple question de calcul se joue pourtant une question politique : qui doit décider des règles de partage de l’énergie produite en commun ? La question est d’autant plus importante que le sujet a été récemment discuté à Bruxelles : l’Union européenne ne tire actuellement pas pleinement parti du potentiel de ces communautés énergétiques.

Le Conseil supérieur de l’énergie et la Commission de régulation de l’énergie (CRE), le régulateur français de l’énergie, ont récemment examiné un projet de décret visant à modifier les règles de l’autoconsommation collective.

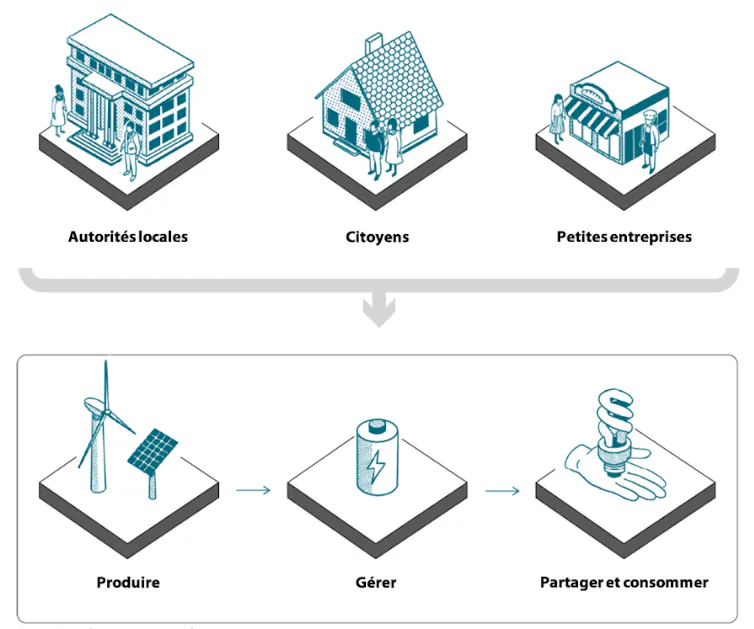

Rappelons d’abord ce qu’est l’autoconsommation collective. Début 2026, Enedis comptait près de 2 000 opérations en service, un chiffre en forte croissance. L’idée est simple : investir localement dans des dispositifs de production d’électricité, souvent solaire, et la partager entre plusieurs participants proches géographiquement comme une mairie, une école, des commerces ou des habitants, par exemple. L’autoconsommation collective ressemble ainsi à un circuit court de l’électricité.

L’objectif affiché de la réforme : éviter que certains acteurs ne modifient, après coup, les règles de répartition pour choisir, selon ce qui les arrange, entre autoconsommation collective et vente sur le marché.

Mais l’un des points du projet va plus loin. Il consacre un principe de maximisation de l’énergie autoconsommée, qui donne la priorité à l’utilisation de l’électricité locale par les participants. Ce choix soulève ainsi une question de gouvernance : jusqu’où le cadre réglementaire doit-il orienter les règles de partage, que les acteurs du projet pouvaient jusqu’alors choisir pour eux-mêmes ?

Le partage de l’électricité produite en commun, un enjeu de justice

L’électricité n’est pas un bien comme un autre : on ne peut pas partager pas une production solaire comme un gâteau, pour deux raisons.

D’abord parce qu’elle n’est pas produite à la demande mais dépend de l’ensoleillement.

Ensuite parce qu’une fois injectée dans le réseau, on ne peut pas suivre physiquement chaque électron depuis le panneau jusqu’au compteur d’un consommateur précis.

L’autoconsommation collective repose donc sur une convention comptable : toutes les quinze minutes, on observe la production et la consommation des participants. Une règle de partage attribue alors virtuellement une part de cette production locale à chacun. Cette règle n’est pas un simple détail administratif. Elle détermine qui bénéficie de l’électricité produite localement, à quel moment et dans quelle proportion.

Or, cette électricité est généralement moins chère que celle achetée auprès d’un fournisseur classique via le réseau. Le mode de répartition influence donc les factures, la rentabilité du projet, l’équilibre entre les participants et, parfois, la possibilité même de faire émerger le projet.

Lorsque les participants d’un collectif qui investit dans la production d’électricité choisissent une règle de partage, ils choisissent donc aussi une certaine conception de la justice.

À lire aussi : Communautés énergétiques : quand les citoyens bousculent le marché de l’électricité

En France, un partage au « prorata » par défaut

Dans un article scientifique publié dans la revue Energy Policy, nous avons étudié le cadre français actuel. Aujourd’hui, lorsqu’une opération d’autoconsommation collective ne choisit pas explicitement une autre règle, la production est répartie, par défaut, au prorata de la consommation de chaque participant, tous les quarts d’heure.

Les participants peuvent actuellement, en principe, lui préférer une autre clé de répartition. Mais une règle par défaut n’est jamais neutre. Elle donne l’impression d’un choix ouvert, tout en orientant fortement les pratiques vers l’option préétablie, selon ce que certains ont nommé paternalisme libertarien. C’est ce que l’on observe en France, où cette clé par défaut prévaut dans près des trois quarts des opérations actuellement en fonctionnement.

Cette règle a une qualité apparente : elle maximise mécaniquement le taux d’autoconsommation collective comptabilisé. La réforme conforterait ce principe. Du point de vue des indicateurs, c’est séduisant. Du point de vue de la gouvernance, c’est plus discutable.

À lire aussi : Peut-on subventionner les panneaux solaires de façon juste et efficace ?

Une règle qui pose problème à plusieurs niveaux

Le premier problème tient à l’équité du dispositif. Imaginons un glacier ouvert en journée et les habitants des logements situés au-dessus de son commerce. Les panneaux solaires produisent surtout lorsque le glacier consomme beaucoup pour ses équipements frigorifiques. Avec une règle au prorata de la consommation, il recevra une part importante de l’électricité locale, tandis que les habitants, qui consomment davantage le matin ou le soir, en recevront bien moins.

Ce résultat peut être efficace si l’objectif est uniquement de maximiser la consommation locale instantanée. Mais il peut être perçu comme injuste si le projet est financé collectivement à parts égales. À terme, le déséquilibre peut décourager des participants et compromettre l’existence de telles initiatives. En effet, si leur contribution financière est identique à celle des autres, mais qu’ils bénéficient de beaucoup moins d’électricité locale, le projet perd beaucoup de son intérêt financier à titre individuel.

Le deuxième problème touche à la gouvernance. Les communautés d’énergie sont censées donner aux citoyens, collectivités et acteurs locaux la capacité de participer activement à la transition énergétique. Or, une règle préétablie peut ici réduire cette capacité de choix. Elle présuppose qu’un objectif, celui de maximiser le taux d’autoconsommation, doit primer sur d’autres objectifs possibles : répartir les bénéfices plus équitablement, protéger certains ménages vulnérables ou tenir compte de l’investissement initial des participants.

Le troisième enjeu concerne les incitations. On pourrait penser qu’une règle fondée sur la consommation incitera les participants à déplacer leurs usages vers les périodes de production solaire, ce qui peut être souhaitable. Mais l’effet prix est loin d’être évident : le gain associé à un déplacement des consommations dépend aussi de la consommation des autres membres au même moment.

Or, à ce stade, il n’existe pas, à notre connaissance, de travaux empiriques démontrant cet effet. Il serait imprudent de maintenir, et plus encore de renforcer, une règle par défaut dont les effets comportementaux ne sont pas démontrés.

Une approche qui fragilise les projets citoyens

C’est pourquoi ce décret suscite des réserves. Lutter contre les arbitrages après coup est nécessaire. Mais cela ne doit pas conduire à entraver la liberté des participants de choisir des règles de partage adaptées à leur projet. En érigeant la maximisation de l’autoconsommation collective en objectif prioritaire, le texte risque de rendre encore plus difficile le choix d’une règle différente de celle prévue par défaut.

Cette approche risque de fragiliser des initiatives très diverses qui peuvent nécessiter des règles de partage différentes. Une opération portée par une collectivité pour alimenter plusieurs bâtiments publics ne soulève pas les mêmes questions qu’un projet citoyen associant ménages, commerces et associations. Un immeuble, une zone artisanale, un village ou un quartier populaire n’ont pas les mêmes profils de consommation, les mêmes contraintes, ni les mêmes objectifs.

Le paradoxe est que cette réforme intervient au moment où l’Europe affirme vouloir donner un rôle plus important aux citoyens et aux communautés énergétiques. La Commission européenne présente ces initiatives comme un moyen de restructurer le système énergétique en donnant aux citoyens la capacité de porter localement la transition et d’en retirer les bénéfices : efficacité énergétique, baisse des factures, lutte contre la précarité énergétique, indépendance énergétique, emplois locaux verts, etc. En France, cette ambition reste fragile. Les opérations progressent, mais elles demeurent complexes à monter.

Au-delà de la technique, le partage d’une ressource commune

Récemment, les prix de l’énergie ont fortement augmenté. Dans ce contexte, la gouvernance de l’énergie devrait être au cœur du débat public. Les règles de partage ne sont donc pas une simple question technique. Elles déterminent comment les bénéfices de la transition sont répartis, et quelle place est laissée aux acteurs locaux.

Une autre voie est possible. Le rôle de la puissance publique ne devrait pas être de choisir à la place des communautés, mais de leur donner les moyens de choisir en connaissance de cause. Cela suppose de présenter clairement les principales règles de partage possibles, leurs avantages, leurs limites et les types de projets auxquels elles sont le mieux adaptées.

L’autoconsommation collective n’est pas qu’une technique d’allocation d’électricité. C’est une manière locale de partager une ressource produite en commun. Maximiser le taux d’autoconsommation peut être utile, mais cela ne doit pas devenir le seul horizon réglementaire.

Julien Jacqmin a reçu des financements de la Métropole Rouen Normandie à travers le projet de recherche CER@R (Communautés d'Energies Renouvelables à Rouen: Evaluation et soutenabilité).

Isac Olave-Cruz et Marco Gazel ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur poste universitaire.

- GÉNÉRALISTES

- Ballast

- Fakir

- Interstices

- Issues

- Korii

- Lava

- La revue des médias

- Time France

- Mouais

- Multitudes

- Positivr

- Regards

- Slate

- Smolny

- Socialter

- UPMagazine

- Le Zéphyr

- Idées ‧ Politique ‧ A à F

- Accattone

- À Contretemps

- Alter-éditions

- Contre-Attaque

- Contretemps

- CQFD

- Comptoir (Le)

- Déferlante (La)

- Esprit

- Frustration

- Idées ‧ Politique ‧ i à z

- L'Intimiste

- Jef Klak

- Lignes de Crêtes

- NonFiction

- Nouveaux Cahiers du Socialisme

- Période

- ARTS

- L'Autre Quotidien

- Villa Albertine

- THINK-TANKS

- Fondation Copernic

- Institut La Boétie

- Institut Rousseau

- TECH

- April - Libre à lire

- Dans les algorithmes

- Framablog

- Goodtech.info

- Quadrature du Net

- Revue Eur. Médias et Numérique

- INTERNATIONAL

- Alencontre

- Alterinfos

- Gauche.Media

- CETRI

- ESSF

- Inprecor

- Guitinews

- MULTILINGUES

- Kedistan

- Quatrième Internationale

- Viewpoint Magazine

- +972 mag

- PODCASTS

- Arrêt sur Images

- Le Diplo

- LSD

- Thinkerview