ACCÈS LIBRE Une Politique International Environnement Technologies Culture

01.11.2025 à 10:03

Sécurité sociale, un compromis institutionnel bien français

Léo Rosell, Ater, Université Paris Dauphine – PSL

Texte intégral (2825 mots)

Créée en 1945, la Sécurité sociale répondait à un objectif ambitieux : mettre les Français à l’abri du besoin et instaurer un ordre social nouveau. Fruit d’un compromis entre l’État et le mouvement ouvrier, cette institution a profondément façonné la solidarité sociale en France. Retour sur l’histoire d’un système révolutionnaire, aujourd’hui confronté à des défis de gouvernance et de légitimité.

Cet article est publié en partenariat avec Mermoz, la revue du Cercle des économistes dont le dont le numéro 8 a pour thème « Notre modèle social, un chef-d’œuvre en péril »..

La Sécurité sociale fête ses quatre-vingts ans. Née en 1945, dans un pays où tout est à reconstruire, cette institution sociale affiche alors l’ambition de créer un « ordre social nouveau ». La Sécurité sociale vise à mettre l’ensemble de la population « à l’abri du besoin » et à la libérer de « la peur du lendemain ».

À la Libération, la solidarité en armes exprimée dans la Résistance devait, en quelque sorte, se transcrire dans une solidarité sociale. Cette idée caractérise le compromis institutionnel à l’origine de la Sécurité sociale, entre un État social émancipateur et un mouvement ouvrier puissant et organisé. Dans les décennies suivantes, la démocratie sociale originelle disparaît progressivement, d’abord au profit d’un paritarisme plus favorable au patronat, puis dans le sens d’une gouvernance reprise en main par l’État.

Une longue histoire

Commençons par rappeler que tout ne s’est pas créé en 1945. Le plan français de sécurité sociale est le fruit d’un processus qui s’inscrit dans le temps long, et l’on peut en faire remonter les origines philosophiques à la Révolution française, un moment important de « laïcisation de la charité religieuse » qui avait cours depuis le Moyen Âge et sous l’Ancien Régime. La Déclaration des droits de l’homme et du citoyen de 1793 pose ainsi pour la première fois le principe selon lequel « les secours publics sont une dette sacrée » de la nation. Après la chute des robespierristes, qui portaient cette aspiration, les expérimentations en matière de secours publics disparaissent.

Commence alors un XIXe siècle marqué par le refus de l’État d’intervenir directement dans les affaires économiques et sociales, mais aussi par le retour de la charité assistancielle. En parallèle, deux traditions se développent en matière de protection sociale : d’une part, une conception républicaine, qui revendique une solidarité nationale, et d’autre part, une tradition ouvrière, qui repose sur l’entraide collective au sein des caisses de secours mutuels et qui est attachée à une gestion par les travailleurs eux-mêmes. La fin du siècle est quant à elle marquée par le développement d’une philosophie, le solidarisme, inspirée de l’œuvre de Léon Bourgeois. Ce courant de pensée postule que la société doit être organisée autour de la solidarité nationale. Il inspire la « nébuleuse réformatrice » à l’origine de l’État social, à travers les premières lois sur les accidents du travail en 1898, sur les retraites ouvrières et paysannes en 1910 ou encore sur les assurances sociales en 1928-1930.

Mais ces anciennes législations sont imparfaites, car elles ne couvrent que les salariés les plus pauvres, elles dispensent des prestations jugées insuffisantes et on y adhère selon le principe de la « liberté d’affiliation ». Cela signifie que le système compte une multiplicité de caisses, d’origine patronale, mutualiste, confessionnelle, syndicale ou départementale, dont l’efficacité est inégale. Compte tenu de ce bilan critique, le programme du Conseil national de la résistance (CNR), adopté dans la clandestinité le 15 mars 1944, entend réformer cette ancienne législation, à travers « un plan complet de sécurité sociale ». Le Gouvernement provisoire de la République française va donc s’y atteler, une fois le territoire national libéré.

Une réforme révolutionnaire

Ce contexte a permis la réalisation d’une « réforme révolutionnaire ». La Sécurité sociale repose sur des mesures prises par le pouvoir politique : elle s’est construite à partir d’ordonnances, comme celles du 4 et du 19 octobre 1945 portant création de la Sécurité sociale, sur des lois, comme celle du 22 mai 1946 portant généralisation de la Sécurité sociale, ou encore sur de nombreux décrets. En revanche, elle n’en est pas moins révolutionnaire par sa portée, par son ambition, celle de créer un « ordre social nouveau », pour reprendre une expression du haut fonctionnaire Pierre Laroque, elle-même déjà présente chez Jean Jaurès. Le 23 mars 1945, Laroque proclame :

« C’est une révolution qu’il faut faire et c’est une révolution que nous ferons ! »

À lire aussi : Mesurer le non-recours pour éviter de dépenser « un pognon de dingue »

Si le rôle de l’institution est incarné par Pierre Laroque, premier directeur de la Sécurité sociale, celui du mouvement ouvrier l’est par Ambroise Croizat. Ancien ouvrier dès l’âge de treize ans, dirigeant de la Fédération des métaux de la Confédération générale du travail (CGT) et député communiste sous le Front populaire, Ambroise Croizat devient président de la commission du travail et des affaires sociales de l’Assemblée consultative provisoire à la Libération, puis ministre du travail et de la sécurité sociale, du 21 novembre 1945 au 4 mai 1947.

Avec Pierre Laroque, ils mettent en œuvre le régime général de la Sécurité sociale, qui repose sur quatre principes fondamentaux. Tout d’abord, il doit s’agir d’un régime universel : l’ensemble de la population, de la naissance à la mort, doit bénéficier de la Sécurité sociale. De plus, le millier de caisses qui existaient du temps des assurances sociales est remplacé par un système obligatoire reposant sur une seule caisse primaire par département, une caisse régionale et une caisse nationale, prenant en charge l’ensemble des risques sociaux.

Le financement par la cotisation sociale constitue le troisième principe. Renvoyant à la formule « de chacun selon ses moyens à chacun selon ses besoins », ce mode de financement par répartition permet au budget de la Sécurité sociale d’être autonome et donc de ne pas dépendre des arbitrages budgétaires de l’État. Enfin, le quatrième principe, sans doute le plus original, renvoie à la démocratie sociale : les caisses de la Sécurité sociale sont gérées « par les intéressés eux-mêmes ».

Des oppositions diverses

De nombreuses oppositions vont tenter de retarder, voire d’empêcher, cette réalisation. Dans les milieux patronaux d’abord, hostiles vis-à-vis de la cotisation patronale, de la caisse unique et de la gestion des caisses par les travailleurs. La Mutualité et les assurances privées craignent de perdre le rôle qu’elles avaient dans les anciennes assurances sociales. Les médecins libéraux ont peur d’être « fonctionnarisés » et de perdre leur liberté d’exercice, tandis que les cadres n’ont pas envie d’être associés au même régime que les salariés. Face à ces obstacles, Croizat et Laroque font preuve de pragmatisme, en donnant partiellement satisfaction à la Mutualité, ou encore aux cadres, avec la création d’un régime complémentaire, l’Agirc. Les artisans, commerçants, professions libérales et agriculteurs obtiennent la mise en place de régimes particuliers.

Entre 1945-1967, la gestion des caisses de la Sécurité sociale est donc organisée selon le principe de la démocratie sociale, en reconnaissant un pouvoir syndical fort. En effet, les conseils d’administration des caisses sont composés à 75 % par des représentants des salariés et à 25 % par ceux du patronat. Ces administrateurs sont d’abord désignés selon le principe de la représentativité syndicale. Le syndicat chrétien de la CFTC refuse alors de participer à la mise en œuvre du régime général car il perd la gestion de ses anciennes caisses confessionnelles, mais aussi parce qu’il craint de subir l’hégémonie de la CGT. Les militants cégétistes disposent de fait d’un quasi-monopole dans la mise en œuvre du régime général sur le terrain.

La Sécurité sociale à la française n’est donc pas un système étatique. Sur le plan juridique, les caisses primaires et régionales sont de droit privé, tandis que la caisse nationale est un établissement public à caractère administratif. L’État, à travers le ministère du travail et de la sécurité sociale – et la direction de la Sécurité sociale qui en dépend –, voit son pouvoir limité à certaines prérogatives, qui restent importantes : en plus du pouvoir normatif, qui s’exprime par la fixation du taux de cotisation et du montant des prestations, l’État dispose aussi d’une fonction de contrôle sur l’activité des caisses.

Une gestion ouvrière fragilisée

Au cours de l’année 1947, le changement de contexte politique a des conséquences directes sur la Sécurité sociale. Le 24 avril 1947, des « élections sociales » sont instaurées pour renforcer sa dimension démocratique et donnent lieu à une véritable campagne politique. La CGT obtient environ 60 % des voix, la CFTC 26 % et la Mutualité 10 %. Le 4 mai, les communistes sont exclus du gouvernement. L’entrée dans la logique de la guerre froide fragilise la gestion ouvrière de la Sécurité sociale, en particulier à la suite de la scission syndicale entre la CGT et Force ouvrière.

En 1958, l’instauration de la Ve République permet à l’État d’intervenir plus directement. Les ordonnances Debré instaurent la nomination des directeurs de caisses par l’exécutif, et non plus leur élection par les conseils d’administration. En 1960, les pouvoirs des directeurs augmentent, au détriment de ceux des conseils d’administration. Au cours de la même année, le corps de l’Inspection générale de la Sécurité sociale est créé, de même que le Centre d’études supérieures de la Sécurité sociale – devenue l’EN3S en 2004 –, participant à la professionnalisation du personnel des caisses.

À partir de 1967, la démocratie sociale disparaît, au profit d’un nouveau principe, le paritarisme. Instauré par les ordonnances Jeanneney, le paritarisme repose en théorie sur un partage du pouvoir entre partenaires sociaux, à parts égales entre syndicats de salariés et patrons. Dans les faits, ce nouveau mode de gestion renforce le pouvoir du patronat, qui joue de la division syndicale. De même, les élections sociales sont supprimées, et la caisse unique est divisée en quatre branches autonomes, chacune présidée par un haut fonctionnaire.

Tout se passe comme si le compromis de 1945 entre l’État social et les syndicats ouvriers s’était renversé au profit d’une nouvelle alliance entre la « technocratie » et le patronat. En tout cas, l’ensemble de ces mesures répond aux revendications du Conseil national du patronat français (CNPF).

La crise de l’État-providence

Les années 1980-1990 voient s’imposer un autre discours, celui sur la « crise de l’État-providence ». Un État réformateur, avec à sa tête le socialiste François Mitterrand depuis 1981, réalise certes la promesse d’une retraite à 60 ans et celle de restaurer les élections sociales. Mais l’affaiblissement des syndicats et le « tournant de la rigueur » de 1983 consacrent l’objectif de réduction des dépenses publiques, partagé par tous les gouvernements successifs.

L’instauration de la contribution sociale généralisée (CSG) en 1990-1991 participe quant à elle de la fiscalisation du financement de la Sécurité sociale, au détriment de la cotisation sociale, ce qui justifie politiquement une intervention accrue de l’État.

Une parlementarisation de la gestion de la Sécurité sociale se développe ainsi entre 1996 et 2004. Le rôle du Parlement et l’influence des directives européennes en matière budgétaire et réglementaire se traduisent par plusieurs mesures prises en 1996 : l’instauration par ordonnances d’une loi de financement de la Sécurité sociale votée chaque année, la suppression définitive des élections sociales et la création de deux outils de gouvernance budgétaire, l’objectif national des dépenses de l’Assurance maladie (Ondam) et la Caisse d’amortissement de la dette sociale (Cades). En 2000, c’est au tour du Conseil d’orientation des retraites (COR) d’être créé.

Néomanagement et logique comptable

Enfin, depuis 2004, s’est imposée une gouvernance managériale, fortement inspirée du « nouveau management public ». Cette évolution est symbolisée par la réforme de l’assurance-maladie et celle de l’hôpital public, avec l’instauration de la tarification à l’activité (T2A). Les différentes branches sont désormais gérées par des directeurs généraux aux pouvoirs élargis, tandis que des Conventions d’objectifs et de gestion (COG) sont contractées tous les quatre ans entre l’État et les branches, puis déclinées au niveau des caisses.

Une logique comptable de définition d’objectifs et d’évaluation des résultats s’impose donc devant l’exigence de répondre à des besoins et de garantir l’accès aux droits des bénéficiaires. Cette gouvernance managériale parvient parfois à mener des réformes impopulaires, comme la réforme des retraites de 2023 passée via l’usage de l’article 49.3 de la Constitution et le détournement d’un PLFSS rectificatif. Néanmoins, se pose dès lors la question du consentement populaire à ce mode de gestion, qui fragilise une institution centrale du pacte social républicain.

Les commémorations du 80e anniversaire de la Sécurité sociale ont ainsi été propices à la remise en cause d’une gouvernance, dénoncée comme étant antidémocratique, y compris parfois au sein même des élites de l’État social. Certains appellent à renouer avec les ambitions portées, en son temps, par Pierre Laroque, leur illustre prédécesseur, notamment en termes de démocratie sociale.

Cet article est publié en partenariat avec Mermoz, la revue du Cercle des économistes dont le numéro 8 a pour objet « Notre modèle social, un chef-d’œuvre en péril ». Vous pourrez y lire d’autres contributions.

Le titre et les intertitres sont de la rédaction de The Conversation France.

Léo Rosell ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

01.11.2025 à 10:02

Comment s’explique l’éternel retour du roller ?

Alexandre Chartier, Doctorant en Sciences et techniques des activités physiques et sportives, enseignant vacataire, Université de Bordeaux

Texte intégral (2222 mots)

Accessoires de spectacle dès le XVIIᵉ siècle, les patins à roulettes ont vu le jour en Europe, dans l’ombre du patinage sur glace. Aux grandes modes aristocratiques et mondaines à l’aube du XXᵉ siècle, ont succédé de multiples périodes d’engouements, aux formes et aux modalités renouvelées. Pourtant, le roller n’est jamais parvenu véritablement à s’installer en France comme « fait culturel ».

La pandémie de Covid-19 et les confinements ont déclenché un regain d’intérêt pour le roller. Entre 2020 et 2022, les ventes de patins ont bondi de 300 % aux États-Unis et ont suivi les mêmes tendances en France. À travers des influenceuses, telles qu’Ana Coto ou Oumi Janta, la génération TikTok a réinvesti les rues et les places. Les marques n’ont pas tardé à relancer des modèles au look à la fois vintage et modernisé.

Cet engouement récent ne surgit cependant pas du néant. Il s’inscrit dans une longue histoire de modes successives du patinage à roulettes en France et dans le monde. C’est en les reconvoquant, en questionnant le rôles des acteurs et leurs représentations que l’on peut mieux saisir pourquoi le roller peine encore à s’imposer comme un fait culturel durable et fonctionne donc par effraction, par mode.

Une première vague : la « rinkomanie » de 1876

La première grande mode du patinage à roulettes remonte aux alentours de 1876. La vogue du skating, incarnée par les patins à essieux de James Leonard Plimpton, traverse l’Atlantique et atteint l’Europe. Henry Mouhot dépeint cet engouement sans précédent dans son ouvrage la Rinkomanie (1875).

En France, près de 70 patinoires à roulettes, les skating-rinks, ouvrent leurs portes en l’espace de trois ans. Majoritairement fréquentés par l’aristocratie, la haute bourgeoisie et « l’élite voyageuse », ils deviennent des lieux incontournables de sociabilité urbaine et cosmopolite.

Le patinage à roulettes est alors considéré comme une alternative au patinage sur glace dont il reproduit les attitudes et les techniques corporelles. A contrario de son aïeul sur lames, il permet de pratiquer toute l’année.

Pourtant, malgré les aspirations hygiénistes, l’anglomanie et le caractère de nouveauté, la mode décroît rapidement sous l’influence de plusieurs facteurs : un matériel innovant mais largement perfectible demandant une maîtrise technique importante, la fragilité des entreprises commerciales, la mauvaise fréquentation des rinks, l’absence d’institutionnalisation ou encore la concurrence d’autres pratiques, telles que la vélocipédie.

1910 : de la pratique loisir mondaine à la « sportivisation »

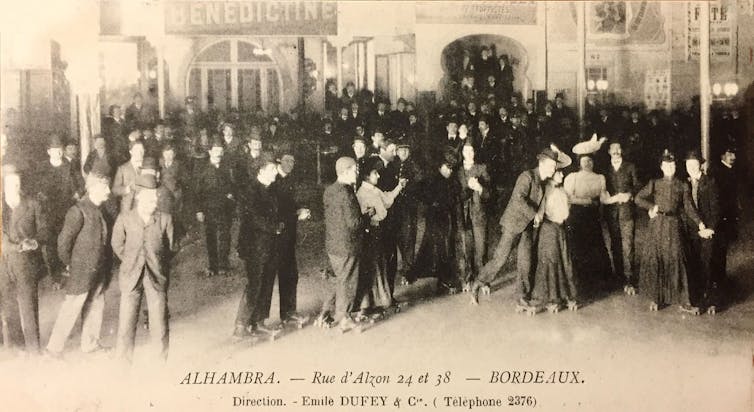

Une série d’innovations technologiques notables, tels que les roulements à billes, combinée à des conditions d’accès plus strictes aux patinoires, contribuent à relancer l’intérêt pour le patinage à roulettes à la veille de la Première Guerre mondiale. Sam Nieswizski (1991) avance que l’imminence du conflit a incité la bourgeoisie au divertissement. Près de 130 skating-rinks sortent de terre entre 1903 et 1914, à Paris et en province. Ils sont édifiés particulièrement sur la Côte Atlantique et dans les lieux de villégiature du tourisme britannique.

À l’instar du ping-pong, loisir mondain et élégant, le patinage à roulettes fonde ses premiers clubs de hockey sur patin à roulettes, de course et de figures. La « sportivisation » du patinage à roulettes en tant que « processus global de transformation des exercices physiques et des pratiques ludiques anciennes en sport moderne » a débuté à la fin du XIXe siècle. La Fédération des patineurs à roulettes de France voit le jour en 1910.

Dans le même temps, la pratique populaire et enfantine en extérieur se développe, non sans susciter la répression policière. À Paris, la préfecture tente de contenir le déferlement des patineurs sur la voie publique en prenant un arrêté qui interdit la pratique aux alentours du jardin du Luxembourg. Elle déclenche de vives réactions de journaux, comme le Matin ou l’Humanité, qui se mobilisent pour défendre la pratique populaire face à la conception bourgeoise du patinage en skating-rink.

La mode de 1910 s’avère pourtant structurante : elle amorce la popularisation et la sportivisation de la pratique qui se prolongent dans l’entre-deux-guerres avec la création de la fédération internationale et avec les premiers championnats d’Europe et du monde. Le déclenchement du conflit et les résistances institutionnelles pourraient pour partie expliquer qu’il n’ait pas existé en France une période d’ancrage culturel aussi profonde que celle observée durant la Roller Skate Craze américaine des années 1920-1950.

Des résurgences cycliques au cours du XXᵉ siècle

L’entre-deux-guerres voit l’émergence du roller-catch : l’ancêtre professionnel de l’actuel roller derby investit le Vélodrome d’hiver en 1939. Plus spectacle que sport, la pratique est rejetée par la fédération internationale, mue par les valeurs de l’amateurisme. Elle renaîtra sous une forme modernisée et féministe au début des années 2000.

Durant les années 1950 et jusqu’aux années 1980, clubs et compétitions se développent dans la confidentialité. En parallèle, la production à faible coût de patins à roulettes réglables en longueur favorise la pratique enfantine.

À la fin des années 1970, l’avènement des roues en uréthane rend la glisse plus confortable, fluide et ouvre de nouvelles perspectives techniques. Les roller-skates au look de chaussure sport d’un seul tenant accompagnent la vague roller-disco. Des films comme La Boum ou Subway montrent alors deux représentations antinomiques mais coexistantes du patinage à roulettes. À partir de 1981, les milliers de patineurs de Paris sur roulettes investissent dans les rues de la capitale, à tel point que les piétons demandent leur interdiction. Taxés de marginaux, ils préfigurent la conquête de la ville des années 1990-2000.

À l’aube du XXIe siècle, des marques emblématiques, comme Rollerblade, sont à l’initiative du boom du roller « inline » et rajeunissent l’image surannée du patin à essieux. Le roller devient cool, branché, écologique. Il s’inscrit dans la lignée des sports californiens et s’envisage même en tant que mode de transport : des grèves londoniennes de 1924 aux grèves de 1995, il n’y a qu’une poussée.

Il acquiert une dimension plus respectable, malgré les représentations négatives de sa dimension agressive (roller acrobatique et freestyle de rue) qui demeure incomprise, au même titre que le skateboard. Les autorités oscillent entre acceptation et répression dans un discours ambivalent. En Belgique, le roller trouve sa place dans le Code de la route, alors qu’en France, les préconisations du Livre blanc du Centre d’études sur les réseaux, les transports, l’urbanisme et les constructions publiques (Certu) restent lettre morte.

En 2010, le film Bliss/Whip it ! marque le renouveau du roller derby. Durant quelques années, les journaux scrutent avec intérêt la réappropriation de cette pratique par les femmes. Le patin à essieux y connaît une nouvelle jeunesse tout comme entre 2016 et 2018 poussé par le marketing mondial de Disney qui promeut la série adolescente Soy Luna.

Quatre ans plus tard, la même génération de pratiquantes se libère du confinement en réanimant la roller-dance, prolongement modernisé d’une roller-disco restée dans l’imaginaire collectif.

Pourquoi ces cycles se répètent-ils ?

Ainsi, lors de chaque mode, le patinage à roulettes repart avec force. À l’instar des vogues vestimentaires et dans une logique d’imitation/distinction, les pratiquants et pratiquantes se réapproprient les signes du passé pour mieux les détourner et affirmer leur singularité.

L’analyse historique et sociologique permet de dégager plusieurs ressorts d’émergence et d’alimentation des modes liés aux différents acteurs en lice dans le champ activités physiques et sportives : les innovations technologiques poussées par les fabricants (roulements, roues uréthane) et les distributeurs, le marketing et la communication (Soy Luna), les médias et les influenceurs (confinement), les aspirations des pratiquants, les techniques corporelles, des lieux de pratique adaptés ou encore l’influence des institutions étatiques et fédérales. Des facteurs inhibiteurs viennent toutefois perturber ces vogues et limiter leur ancrage sociétal durable, en particulier lorsque les objectifs des acteurs divergent.

Ainsi, l’histoire des modes du patinage à roulettes en France nous enseigne que l’enthousiasme ne suffit pas à en produire. Il faut un écosystème actif aux intérêts convergents : fabricants, médias, infrastructures, institutions. En d’autres termes : ce n’est pas seulement parce qu’on roule que l’on devient un fait culturel.

Je suis webmaster du site associatif rollerenligne.com.

31.10.2025 à 12:02

Higher education: why women in France are less likely to pursue science than men

Anne Boring, Associate professor, Erasmus University Rotterdam

Texte intégral (1524 mots)

Girls in France are much less inclined than boys to pursue scientific fields of study, and this is partly due to persistent gender stereotypes. But other factors also come into play. These explanations are based on a survey by the Chair for Women’s Employment and Entrepreneurship at Sciences Po.

How can we attract more women in France to higher education in science and technology? For several years, public authorities have been supporting initiatives aimed at promoting gender diversity in these fields of study, the most recent being the “Girls and Maths” action plan, launched by the ministry of national education, higher education, and research in May 2025.

There are two main reasons behind these initiatives. On the one hand, the aim is to reduce gender inequalities in the labour market, particularly the pay gap. On the other hand, the objective is to support economic growth in promising fields by training more people who can contribute to innovation in strategic sectors of activity.

Different choices

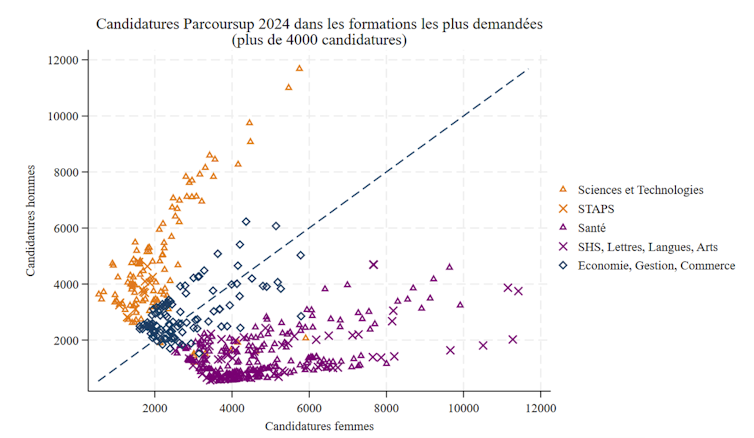

The differences in orientation between women and men remain very marked at the start of higher education. This is evident from the choices made by high school seniors on Parcoursup, the French platform for accessing post-baccalaureate programmes, as can be seen in the following graph based on data made available on Datagouv. It represents the number of applications for the most popular courses of study (more than 4,000 applications).

The points above the diagonal represent programmes with a predominance of male applicants, while those below represent programmes with a predominance of female applicants. Men account for approximately 70% of applicants to science and technology programmes, including STAPS (science and technology of physical education and sports).

The main exceptions concern courses in life and earth sciences, for which there are more female applicants. Programmes in economics, management, and business (in blue) tend to be more mixed. Finally, programmes in health, humanities, social sciences, literature, languages, and arts (in purple) are mainly favored by women, who account for around 75% of applicants.

Certain factors that may explain these differences in study choices, in particular the role of gender stereotypes, differences in academic performance in science subjects, and self-confidence, have already been analysed.

Passion as a determining factor

In order to better understand the current reasons for the differences between women and men in higher education choices, the Chair for Women’s Employment and Entrepreneurship at Sciences Po conducted a survey in partnership with Ipsos in February 2025 among a representative sample of the student population in France, with a total of 1,500 responses. The results of this survey were published by the Observatory of Well-Being of the Centre for Economic Research and its Applications (Cepremap).

One of the striking findings of the survey concerns the differences between women and men in the importance they attach to passion as a determining factor in their higher education choices.

Significantly more female students choose courses related to their passions, and they seem to do so fully aware that these choices may penalise them later on in the job market. In fact, 67% of women (compared to 58% of men) say they “prefer to study a subject they are passionate about, even if it does not guarantee a well-paid job”, while 33% of women (compared to 42% of men) say they “prefer to get a well-paid job, even if it doesn’t guarantee that they will study a subject they are passionate about”.

Women who prioritise passion are more likely to enrol in arts and humanities programmes, while those who prefer a well-paid job are more likely to enrol in economics, business, and commerce programmes, or in science and technology programmes.

The role of parents

Furthermore, the survey results highlight the fact that parents are more influential in determining their sons’ educational choices than their daughters’. In fact, female students receive more support from their parents, regardless of their chosen field of study, while male students are less likely to receive their parents’ approval, particularly for fields of study that lead to less lucrative careers in the job market (eg humanities, social sciences or arts) or that have become feminised (eg law or health).

Paradoxically, the lack of parental influence on girls’ choices may explain why they are more likely to follow their passion, finding themselves more constrained in the job market later on.

The results also show that preferences developed for different subjects in secondary school account for more than half of the differences between women and men in their higher education choices.

Women appear to have more diverse tastes, with a preference for mathematics accounting for only a small part (around 10%) of the difference in study choices. This partly explains why women tend to shy away from science and technology courses of study, which may be perceived as requiring them to give up other subjects they enjoy. More men than women enjoyed only science subjects in secondary school (29% of male students compared to 14% of female students).

Multidisciplinary programmes and role models

If the French economy needs more women with degrees in science and technology, how can we attract them to these fields? The main challenge lies in conveying a passion for science and technology to women.

This can be achieved through role models, such as high-achieving people who share their enthusiasm for their discipline before students make crucial choices. This can also involve the development of multidisciplinary courses that combine science, social sciences, and humanities, so as to offer young women (and young men) with varied interests the opportunity to pursue scientific studies without giving up other fields.

Finally, science programmes can adapt their educational offerings to make teaching more attractive to female students. By highlighting how science and technology can contribute to the common good and address the challenges of contemporary societies, a reformulation of course titles can, for example, highlight issues that are important to them.

Created in 2007 to help accelerate and share scientific knowledge on key societal issues, the Axa Research Fund – now part of the Axa Foundation for Human Progress – has supported over 750 projects around the world on key environment, health & socioeconomic risks. To learn more, visit the website of the AXA Research Fund or follow @ AXAResearchFund on LinkedIn.

The collection of data was funded by the Chair for Women's Employment and Entrepreneurship (Sciences Po, Paris).

30.10.2025 à 16:05

De Chirac à Macron, comment ont évolué les dépenses de l’État

François Langot, Professeur d'économie, Directeur adjoint de l'i-MIP (PSE-CEPREMAP), Le Mans Université

Fabien Tripier, Professeur d'économie, Université Paris Dauphine – PSL

Texte intégral (2115 mots)

Pour stabiliser la dette publique de la France, l’État doit réduire son déficit. Outre la hausse des prélèvements, il doit aussi de diminuer ses dépenses. Mais avant de les réduire, il importe de savoir comment ces dépenses ont évolué ces trente dernières années.

L’analyse historique des dépenses de l’État peut être utile pour prendre aujourd’hui des décisions budgétaires. Qu’ont-elles financé ? Les salaires des agents ? Des achats de biens et services ? Des transferts ? Quels types de biens publics ont-elles permis de produire (éducation, santé, défense…) ?

Le futur budget de l’État doit tenir compte de ces évolutions passées, des éventuels déséquilibres en résultant, tout en réalisant que ces choix budgétaires auront des impacts sur la croissance et les inégalités spécifiques à la dépense considérée.

Près de 30 milliards d’économies annoncées

Le projet de loi de finances actuellement discuté pour l’année 2026 prévoit 30 milliards d’euros d’économies, ce qui représente 1,03 % du PIB. Ces économies sont obtenues avec 16,7 milliards d’euros de réduction de dépenses (0,57 point de PIB), et 13,3 milliards d’euros de hausse de la fiscalité. Le déficit public, prévu à 5,6 % en 2025 (163,5 milliards d’euros pour 2025) ne serait donc réduit que de 18,35 %. Pour atteindre l’objectif de stabiliser la dette publique, il faudra amplifier cet effort les prochaines années pour économiser approximativement 120 milliards d’euros (4 points de PIB), soit quatre fois les économies prévues dans le PLF 2026.

Ces réductions à venir des dépenses s’inscrivent dans un contexte. En moyenne, dans les années 1990, les dépenses publiques représentaient 54 % du PIB. Dans les années 2020, elles avaient augmenté de 3 points, représentant alors 57 % du PIB, soit une dépense annuelle additionnelle de 87,6 milliards d’euros, ce qui représente plus de cinq fois les économies inscrites dans le PLF pour 2026. Depuis 2017, ces dépenses ont augmenté d’un point de PIB, soit une hausse annuelle de 29,2 milliards d’euros (1,75 fois plus que les économies du PLF 2026). Étant données ces fortes hausses passées, des réductions de dépenses sont possibles sans remettre en cause le modèle social français. Mais, quelles dépenses réduire ?

À lire aussi : L’endettement de l’État sous Chirac, Sarkozy, Hollande, Macron… ce que nous apprend l’histoire récente

De plus en plus de transferts sociaux

Chaque poste de dépense se compose d’achats de biens et services (B & S) utilisés par l’État (au sens large, c’est-à-dire l’ensemble des administrations publiques centrales, locales et de sécurité sociale) pour produire, de salaires versés aux agents, et de transferts versés à la population. Quel poste a fortement crû depuis 1995 ?

Le tableau 1 montre qu’en 1995, 40,2 % des dépenses étaient des transferts (soit 22,05 points de PIB), 35,5 % des achats de B & S (soit 19,45 points de PIB) et 24,3 % des salaires (soit 13,33 points de PIB). En 2023, 44,1 % étaient des transferts (+ 3,06 points de PIB), 34,5 % des achats de B & S (- 0,15 point de PIB) et 21,4 % des salaires (- 1,07 points de PIB). Le budget s’est donc fortement réorienté vers les transferts. Les dépenses consacrées aux salaires ont évolué moins vite que le PIB, le poids de ces rémunérations dans les dépenses baissant fortement.

Lecture : En 1995, les transferts représentaient 22,05 points de PIB, soient 40,2 % des dépenses totales. Le chiffre entre parenthèses indique la part de cette dépense dans les dépenses totales. Δ : différence entre 2023 et 1995 en points de PIB et le chiffre entre parenthèses l’évolution de la part.

L’État a donc contenu ces achats de B & S et réduit sa masse salariale, quand bien même les effectifs croissaient de plus de 20 % (données FIPECO). Simultanément, l’emploi salarié et non salarié du secteur privé augmentait de 27 % (données Insee). Des effectifs augmentant moins que dans le privé et une part de la production de l’État dans le PIB progressant révèlent une plus forte hausse de la productivité du travail du secteur public. Mais, ceci ne s’est pas traduit par une augmentation des rémunérations du public. Au contraire, l’écart de salaire entre le public et le privé s’est fortement réduit sur la période, passant de +11,71 % en 1996 en faveur du public (données Insee (1999) pour le public et Insee (1997) pour le privé), à 5,5 % en 2023 (données Insee (2024a) pour le privé et Insee (2024b) pour le public).

Cette première décomposition montre que l’organisation de la production de l’État (achat de B & S et salaires) n’a pas dérivé, mais que les hausses des dépenses de redistribution (+ 3,06 points de PIB en trente ans) ont fortement crû. Ces hausses de transferts correspondent aux trois quarts des économies nécessaires à la stabilisation de la dette publique.

De moins en moins d’argent pour les élèves et la défense

Les dépenses de l’État se décomposent en différents services, c'est-à-dire, en différentes fonctions (l'éducation, la défense, la protection sociale…). La figure 1 montre que les dépenses des services généraux, d’éducation et de la défense ont crû moins vite que le PIB depuis 1995 (surface rouge). En effet, leurs budgets en points de PIB ont respectivement baissé de 2,14 points, 0,78 point et 0,68 point de PIB. Si la baisse du premier poste peut s’expliquer, en partie, par la rationalisation liée au recours aux technologies de l’information, et la seconde par l’arrêt de la conscription, celle de l’éducation est plus surprenante.

Elle l’est d’autant plus que Aubert et al. (2025) ont montré que 15 % de ce budget incluait (soit 0,75 point de PIB) des dépenses de retraites qu’il « faudrait » donc réallouer vers les pensions pour davantage de transparence. La croissance constante de cette contribution aux pensions dans le budget de l’éducation indique que les dépenses consacrées aux élèves sont en forte baisse, ce qui peut être mis en lien avec la dégradation des résultats des élèves de France aux tests de type Pisa. Enfin, dans le contexte géopolitique actuel, la baisse du budget de la Défense peut aussi sembler « peu stratégique ».

Lecture : En 1995, les dépenses de protection sociale représentaient 21,41 points de PIB, dont 18,14 points de PIB en transferts, 1,16 point en salaires et 2,11 points en B&S ; en 2023, elles représentaient 23,33 points de PIB dont 20,16 points, 1,12 point en salaire et 2,0 points en B&S.

De plus en plus pour la santé et la protection sociale

La surface verte de la figure 1 regroupe les fonctions qui ont vu leurs budgets croître plus vite que le PIB, de la plus faible hausse (ordre public/sécurité, avec + 0,24 point de PIB) aux plus élevées (santé, + 1,72 point de PIB, et protection sociale, + 1,92 point de PIB). Ces deux postes de dépenses représentent 65,3 % des hausses. Viennent ensuite les budgets sport/culture/culte, environnement et logement qui se partagent à égalité 24 % de la hausse totale des dépenses (donc approximativement 8 % chacun). Enfin, les budgets des affaires économiques et de l’ordre public/sécurité expliquent les 10,7 % restant de hausse des dépenses, à hauteur de 6,4 % pour le premier et 4,3 % pour le second.

Si l’on se focalise sur les plus fortes hausses, c’est-à-dire, la santé et la protection sociale, les raisons les expliquant sont différentes. Pour la protection sociale, les dépenses de fonctionnement sont quasiment stables (B&S et salaires) alors que les prestations sont en forte hausses (+ 2 points de PIB). Les dépenses de santé voient aussi les prestations offertes croître (+ 1 point de PIB), mais se caractérisent par des coûts croissants de fonctionnement : + 0,6 point pour les B&S, et + 0,12 point de PIB pour les salaires des personnels de santé, alors que les rémunérations baissent dans le public, ceux des agents de l’éducation, par exemple, passant de 4,28 à 3,47 points de PIB (-0,81 points de PIB).

Dans la protection sociale, de plus en plus pour la maladie et les retraites

La protection sociale, premier poste de dépense (23,33 % du PIB), regroupe différentes sous-fonctions représentées dans la figure 2. À l’exception des sous-fonctions maladie/invalidité (+ 0,07 point de PIB), exclusion sociale (+ 0,43 point du PIB) et pensions (+ 2,41 points de PIB), les budgets de toutes les sous-fonctions de la protection sociale ont vu leur part baisser (surface en rouge). Les réformes des retraites ont donc été insuffisantes pour éviter que les pensions soient la dépense en plus forte hausse.

Enfin, si on ajoute aux dépenses de santé la partie des dépenses de protection sociale liée à la maladie et à l'invalidité (voir la figure 2), alors ces dépenses globales de santé ont crû de 1,79 point de PIB entre 1995 et 2023.

Quels enseignements tirer ?

Ces évolutions suggèrent que les budgets à venir pourraient cibler les économies sur les dépenses de santé et les pensions, ces deux postes ayant déjà fortement crû dans le passé. Évidemment, une partie de ces hausses est liée à l’inévitable vieillissement de la population. Mais une autre vient de l’augmentation des prestations versées à chaque bénéficiaire. Par exemple, la pension de retraite moyenne est passée de 50 % du salaire moyen dans les années 1990 à 52,3 % en 2023. Le coût de la prise en charge d’un infarctus du myocarde est passé de 4,5 Smic dans les années 1990 à 5,6 Smic dans les années 2020

En revanche, un rattrapage portant sur l’éducation et la Défense semble nécessaire au vu du sous-investissement passé et des défis à venir. Les rémunérations des agents du public doivent aussi être reconsidérées. Le tableau 2 montre que le PLF 2026 propose des mesures répondant en partie a ce rééquilibrage en réduisant les dépenses de protection sociale et en particulier les pensions. Enfin, le PLF 2026 prévoit une hausse du budget de la défense, alors que la réduction de 8,6 milliards d’euros des budgets des fonctions hors défense et ordre public épargne l’éducation.

Au-delà de ces arguments de rééquilibrage, les choix budgétaires doivent aussi reposer sur une évaluation d’impact sur l’activité (croissance et emploi). Les analyses de Langot et al. (2024) indiquent que les baisses de transferts indexés sur les gains passés (comme les retraites) peuvent avoir un effet positif sur la croissance, facilitant alors la stabilisation de la dette publique, au contraire des hausses des prélèvements.

Privilégier la production des biens publics aux dépens des transferts se justifie aussi au regard des enjeux géopolitiques et climatiques, et permet également de réduire les inégalités (voir André et al. (2023)).

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

30.10.2025 à 15:56

Bad Bunny au Super Bowl : une polémique emblématique des États-Unis de Donald Trump

Ediberto Román, Professor of Law, Florida International University

Ernesto Sagás, Professor of Ethnic Studies, Colorado State University

Texte intégral (1887 mots)

La présence de Bad Bunny à la mi-temps du Super Bowl 2026 suscite une levée de boucliers dans les rangs trumpistes. L’artiste, né à Porto Rico – territoire disposant d’un statut spécifique, dont les habitants sont citoyens des États-Unis mais ne peuvent pas voter à l’élection présidentielle et ne disposent pas de représentants au Congrès –, devient malgré lui le symbole d’un système qui célèbre la culture latino tout en la réprimant à ses marges. Au moment où les abus de la police de l’immigration (ICE) alimentent la peur parmi les Hispaniques, l’apparition du rappeur sur la scène la plus médiatisée du pays met en évidence les contradictions du rapport des États-Unis à cette large communauté.

La désignation du rappeur portoricain Bad Bunny par la National Football League (NFL) pour effectuer un court concert lors de la mi-temps du Super Bowl 2026, le 8 février prochain, a déclenché les foudres des médias conservateurs et de plusieurs membres de l’administration Trump.

Alors que le président a qualifié ce choix d’« absolument ridicule », la secrétaire à la sécurité intérieure, Kristi Noem, a promis que des agents de la police de l’immigration (ICE) « seraient présents partout au Super Bowl ». Le célèbre commentateur de droite Benny Johnson a déploré dans un tweet posté sur X que le répertoire du rappeur ne contienne « aucune chanson en anglais », tandis que la polémiste Tomi Lahren a déclaré que Bad Bunny n’était pas états-unien.

Bad Bunny, né Benito Antonio Martínez Ocasio, est une superstar et l’un des artistes les plus écoutés au monde. Et comme il est portoricain, il est également citoyen des États-Unis.

Il est certain que Bad Bunny coche de nombreuses cases qui irritent les conservateurs. Il a apporté son soutien à Kamala Harris pour la présidence en 2024. Il a critiqué les politiques anti-immigration de l’administration Trump. Il a refusé d’effectuer une tournée sur le continent américain, craignant que certains de ses fans ne soient pris pour cible et expulsés par l’ICE. Et ses paroles explicites – dont la plupart sont en espagnol – feraient frémir même les plus ardents défenseurs de la liberté d’expression. Sans même parler de sa garde-robe androgyne.

Et pourtant, en tant qu’experts des questions d’identité nationale et des politiques d’immigration des États-Unis, nous pensons que les attaques de Lahren et Johnson touchent au cœur même de la raison pour laquelle le rappeur a déclenché une telle tempête dans les rangs de la droite. Le spectacle d’un rappeur hispanophone se produisant lors de l’événement sportif le plus regardé à la télévision états-unienne constitue en soi une remise en cause directe des efforts déployés par l’administration Trump pour masquer la diversité du pays.

La colonie portoricaine

Bad Bunny est né en 1994 à Porto Rico, un « État libre associé » aux États-Unis, rattaché à ces derniers après la guerre hispano-américaine de 1898.

Cette terre est le foyer de 3,2 millions de citoyens états-uniens de naissance. Si le territoire était un État fédéré des États-Unis, il serait le 30e le plus peuplé par sa population, d’après le recensement de 2020.

Mais Porto Rico n’est pas un État ; c’est une colonie issue de l’époque révolue de l’expansion impériale américaine outre-mer. Les Portoricains n’ont pas de représentants votant au Congrès et ne peuvent pas participer à l’élection du président des États-Unis. Ils sont également divisés sur l’avenir de l’île. Une grande majorité souhaite soit que Porto Rico devienne un État états-unien, ou obtienne un statut amélioré par rapport à l’actuel, tandis qu’une minorité plus réduite aspire à l’indépendance.

Mais une chose est claire pour tous les Portoricains : ils viennent d’un territoire non souverain, avec une culture latino-américaine clairement définie – l’une des plus anciennes des Amériques. Porto Rico appartient peut-être aux États-Unis ; et de nombreux Portoricains apprécient cette relation privilégiée, mais l’île elle-même ne ressemble en rien aux États-Unis, ni dans son apparence ni dans son atmosphère.

Les plus de 5,8 millions de Portoricains qui résident dans les 50 États compliquent encore davantage le tableau. Bien qu’ils soient légalement citoyens des États-Unis, les autres États-Uniens ne les considèrent souvent pas comme tels. En effet, un sondage réalisé en 2017 a révélé que seuls 54 % des États-Uniens savaient que les Portoricains étaient citoyens du même pays qu’eux.

Le paradoxe des citoyens étrangers

Les Portoricains vivent dans ce que nous appelons le « paradoxe des citoyens étrangers » : ils sont citoyens des États-Unis, mais seuls ceux qui résident sur le continent jouissent de tous les droits liés à la citoyenneté.

Un rapport récent du Congrès américain a conclu que la citoyenneté états-unienne des Portoricains « n’est pas une citoyenneté égale, permanente et irrévocable protégée par le 14e amendement […] et le Congrès conserve le droit de déterminer le statut du territoire. » Tout citoyen états-unien qui s’installe à Porto Rico ne jouit plus des mêmes droits que les citoyens états-uniens du continent.

La désignation de Bad Bunny pour le spectacle de la mi-temps du Super Bowl illustre bien ce paradoxe. Outre les critiques émanant de personnalités publiques, il y a eu de nombreux appels parmi les influenceurs pro-Trump à expulser le rappeur.

Ce n’est là qu’un exemple parmi d’autres qui rappelle aux Portoricains, ainsi qu’aux autres citoyens latino-américains, leur statut d’« autres ».

Les arrestations par l’ICE de personnes semblant être des immigrants – une tactique qui a récemment reçu l’aval de la Cour suprême – illustre bien leur statut d’étrangers.

La plupart des raids de l’ICE ont eu lieu dans des communautés majoritairement latino-américaines à Los Angeles, Chicago et New York. Cela a contraint de nombreuses communautés latino-américaines à annuler les célébrations du Mois du patrimoine hispanique.

L’impact mondial de Bad Bunny

La vague de xénophobie contre Bad Bunny a poussé des responsables politiques comme le président de la Chambre des représentants Mike Johnson à réclamer son remplacement par une personnalité « plus appropriée » pour le Super Bowl, comme l’artiste de musique country Lee Greenwood, 83 ans, supporter de Donald Trump. À propos de Bad Bunny, Johnson a déclaré : « Il semble qu’il ne soit pas quelqu’un qui plaise à un large public. »

Mais les faits contredisent cette affirmation. L’artiste portoricain occupe la première place des classements musicaux mondiaux. Il compte plus de 80 millions d’auditeurs mensuels sur Spotify. Et il a vendu près de cinq fois plus d’albums que Greenwood.

Cet engouement mondial a impressionné la NFL, qui organise sept de ses rencontres à l’étranger cette saison et souhaite encore accroître ce nombre à l’avenir. De plus, les Latino-Américains représentent la base de fans qui connaît la plus forte croissance au sein de la ligue, et le Mexique est son plus grand marché international, avec 39,5 millions de fans selon les chiffres publiés.

La saga « Bad Bunny au Super Bowl » pourrait bien devenir un moment politique important. Les conservateurs, dans leurs efforts pour mettre en avant « l’altérité » de Bad Bunny – alors que les États-Unis sont l’un des premiers pays hispanophones au monde – ont peut-être involontairement sensibilisé les États-Uniens au fait que les Portoricains étaient leurs concitoyens.

Pour l’heure, les Portoricains et le reste de la communauté latino-américaine des États-Unis continuent de se demander quand ils seront acceptés comme des égaux sur le plan social.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

30.10.2025 à 15:52

Le cinéma d’horreur, miroir de nos angoisses contemporaines

Jean-Baptiste Carobolante, Professeur d'histoire et théorie de l'art, ESA / École Supérieure d'Art / Dunkerque - Tourcoing

Texte intégral (1976 mots)

Alors que nous traversons une époque de plus en plus troublée, un constat s’impose : le cinéma d’horreur, lui, se porte à merveille. Ce succès n’a rien d’anodin : il reflète la manière dont les inquiétudes sociétales, toujours plus prégnantes, trouvent dans l’horreur un terrain d’expression privilégié, un miroir révélateur de nos angoisses collectives.

Ces dernières années ont vu émerger nombre de films et de séries rencontrant un véritable engouement, tandis que certains réalisateurs – comme Jordan Peele, Ari Aster ou Jennifer Kent – sont devenus des auteurs plébiscités, voire des figures incontournables du genre.

Les racines du cinéma d’horreur actuel se trouvent dans les productions hollywoodiennes des années 1970. À ce sujet, le critique Jean-Baptiste Thoret relevait que le cinéma de l’époque fut déterminé par la généralisation de la télévision dans les foyers, et de son nouveau registre d’images. Les horreurs du monde extérieur étaient ainsi présentées tous les soirs dans les salons familiaux.

La guerre du Vietnam, les émeutes réprimées de manière sanglante – notamment les sept « émeutes de Watts » aux États-Unis en août 1965 –, les faits divers lugubres s’introduisaient dans le quotidien de tous les Américains, puis de tous les Occidentaux. Le cinéma de possession, l’Exorciste (William Friedkin, 1973), mais aussi les slashers et leurs tueurs barbares arpentant les paisibles zones pavillonnaires (la Dernière Maison sur la gauche, Wes Craven, 1972) en sont des exemples probants : les peurs de la destruction du soi intime et de l’espace domestique furent liées à cette obsession pour un « mal intérieur » que diffusait, incarnait et répandait l’écran de télévision.

Mais c’est aussi, bien sûr, le cinéma de zombies (la Nuit des morts-vivants, George A. Romero, 1968) au postulat très simple : les morts viennent harceler les vivants ; ou, en termes cinématographiques, le hors-champ vient déborder dans le champ. De fait, la décennie posa des bases horrifiques qui sont toujours valides aujourd’hui.

Le cinéma d’horreur est un registre qui tourne toujours autour d’un même sujet : les frontières (d’un monde, d’un pays, d’une maison, d’un corps) sont mises à mal par une puissance insidieuse, puissante, voire surnaturelle.

Le XXIᵉ siècle et la peur des images

Notre siècle se situe de fait dans la continuité des années 1970 qui ont posé les bases du genre. Nous pouvons définir quatre grandes peurs qui traversent toutes les productions horrifiques actuelles : la question du contrôle politique, de son efficience et de ses abus ; la question de l’identité et de la différence ; celle de la violence, de l’agression, voire de la torture ; et, enfin, la peur des médias et de la technologie.

La peur politique est au cœur de nombreuses productions horrifiques. C’est notamment le cas de la saga American Nightmare (James DeMonaco, 2013–2021) qui nous présente une société américaine fondamentalement dysfonctionnelle en raison de ses orientations politiques : une nuit par an, afin de « purger » la société, toutes les lois sont suspendues. Le troisième volet, The Purge : Election Year (James DeMonaco, 2016), ne s’y trompait pas en détournant la casquette du mouvement MAGA sur son affiche promotionnelle.

Mais l’horreur des choix politiques se trouve également au cœur des films apocalyptiques et postapocalyptiques. Qu’ils mettent en scène des zombies, des épidémies ou des extra-terrestres, l’horreur provient bien souvent de l’incapacité institutionnelle à répondre au mal, puis de la violence fondamentale avec laquelle les sociétés se reconstituent ensuite. C’est notamment le cas dans la série The Walking Dead (Frank Darabont, 2010–2022), qui nous présente tout un répertoire de modes de vie collective, en majorité profondément inégalitaires, voire cruelles.

Les questions identitaires, elles, relèvent de l’horreur politique lorsque les films prennent le racisme comme sujet. On retrouve cet aspect dans Get Out (Jordan Peele, 2017), dans lequel de riches Blancs s’approprient les corps d’Afro-Américains afin de s’offrir une seconde jeunesse. Mais c’est aussi le cas, de façon plus générale, du cinéma de possession, qui est toujours un cinéma traitant de problèmes identitaires, du rapport à soi, voire de folie ou de dépression. Possédée (Ole Bornedal, 2012), Mister Babadook (Jennifer Kent, 2014), ou encore Heredité (Ari Aster, 2018) mettent tous en scène des individus combattant un démon – ou une entité maléfique – pour retrouver un sens à leur vie et une stabilité identitaire.

La peur de la violence est peut-être la réponse cinématographique la plus directe aux faits divers qui ont envahi les médias depuis plusieurs décennies. Faits divers ayant même donné naissance à des sous-genres cinématographiques autonomes. Le « torture porn » – illustré par les sagas Saw (depuis 2004), Hostel (2005–2011) et The Human Centipede (Tom Six, 2009–2016), par exemple – est un type de film dont l’objet est la représentation de tortures physiques et/ou psychologiques infligées par un maniaque (ou un groupuscule puissant) à des individus malchanceux. Le « rape and revenge » (« viol et vengeance »), quant à lui, représente, comme son nom l’indique, de jeunes femmes violentées qui prennent leur revanche sur leurs agresseurs, souvent de manière sadique. C’est le cas de films comme Revenge (Coralie Fargeat, 2017) ou la saga I Spit on Your Grave (2010–2015).

Enfin, le dernier territoire que nous mentionnons a fini, selon nous, par englober tous les autres. À notre époque, toute peur est liée à la manière dont nous nous représentons le monde, l’Autre et nous-mêmes, sous la forme d’un simulacre ou via un dispositif technologique intercesseur.

Le réel s’offre à nous à travers des filtres technologiques. Ainsi, c’est toujours à l’écran – télévision, ordinateur ou smartphone – de « rendre réel », de définir ce qui est vrai, et de nous offrir des expériences. Or, nous courons toujours le risque que ces systèmes de représentation abusent de nous et deviennent, à leur tour, oppressants. C’est le postulat même du registre horrifique du « found footage », depuis le Projet Blair Witch (Daniel Myrick et Eduardo Sánchez, 1999), en passant par les sagas Paranormal Activity (2007–2021), REC (2007–2014), ou encore Unfriended (Levan Gabriadze, 2014). Ces films, prenant l’aspect et la forme d’archive retrouvée – bien souvent domestique ou policière –, peuvent centrer leurs récits aussi bien autour de spectres, de tueurs en série ou d’extra-terrestres, car c’est le dispositif d’image lui-même, plus que le monstre, qui crée la matière horrifique.

L’inéluctabilité du mal

Deux phénomènes nouveaux semblent, toutefois, se dégager depuis quelques années. Le premier, par son absence relative dans le cinéma d’horreur, et le second, par son omniprésence.

Il s’agit tout d’abord du cataclysme écologique, que l’on retrouve de façon prégnante dans le cinéma de science-fiction, mais très peu dans les films d’horreur. Cette absence, plutôt que de témoigner d’une incapacité de représentation, relève peut-être d’un enjeu trop mondial pour être abordé par un genre finalement plus attaché à des parcours intimes, à des trajectoires d’individus confrontés à l’horreur, plutôt qu’à des horreurs sociétales.

Bien sûr, le cinéma de zombies ou d’apocalypse traite déjà en substance de cet effondrement civilisationnel, mais il faut que ce soit l’humain qui meure, et non le vivant, la nature ou l’environnement, pour que l’horreur devienne manifeste.

Quelques films, comme le long métrage français la Nuée (Just Philippot, 2020), tentent toutefois de poser la question d’une horreur humaine à partir d’une bascule environnementale. Notons également que la pandémie de Covid-19 n’a pas laissé de trace significative dans le genre horrifique. L’horreur pandémique est déjà présente au cinéma depuis les zombies de la fin des années 1960, lorsque la peur et la paranoïa suscitée par le confinement sont déjà figurées au cinéma à travers le motif de la maison hantée qui nous présente toujours des individus prisonniers d’un espace domestique devenu oppressant, voire létal.

Enfin, l’omniprésence actuelle que nous évoquions est certainement celle de l’inéluctabilité du mal. Alors que le cinéma d’horreur des décennies précédentes était encore un cinéma globalement centré sur le monstre (tueur, démon, alien, spectre, etc.), tangible et donc affrontable, notre époque contemporaine présente des antagonistes qui ne sont rien d’autre qu’une puissance abstraite de destruction.

Des films sortis cette année, comme les Maudites (El Llanto, Pedro Martin-Galero, 2024) ou Vicious (Bryan Bertino, 2025), représentent le mal comme une volonté omniprésente, omnipotente, qui dépasse et qui détruit tous les cadres de protection. La société, la famille, le réel volent en éclats ; et nous, spectatrices et spectateurs, ne pouvons que contempler la longue descente aux enfers d’individus voués au néant.

Ce motif horrifique ne nous semble pas anecdotique, tant il dit quelque chose de notre époque, de ses peurs, voire de son désespoir. Comme dans le cinéma expressionniste allemand des années 1930, une puissance a pris le contrôle de la société, et le cinéma d’horreur actuel semble se résigner à le laisser dramatiquement triompher.

Cet article est publié dans le cadre de la série « Regards croisés : culture, recherche et société », publiée avec le soutien de la Délégation générale à la transmission, aux territoires et à la démocratie culturelle du ministère de la culture.

Jean-Baptiste Carobolante ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

- GÉNÉRALISTES

- Ballast

- Fakir

- Interstices

- Lava

- La revue des médias

- Le Grand Continent

- Le Diplo

- Le Nouvel Obs

- Lundi Matin

- Mouais

- Multitudes

- Politis

- Regards

- Smolny

- Socialter

- The Conversation

- UPMagazine

- Usbek & Rica

- Le Zéphyr

- Idées ‧ Politique ‧ A à F

- Accattone

- Contretemps

- A Contretemps

- Alter-éditions

- CQFD

- Comptoir (Le)

- Déferlante (La)

- Esprit

- Frustration

- Idées ‧ Politique ‧ i à z

- L'Intimiste

- Jef Klak

- Lignes de Crêtes

- NonFiction

- Nouveaux Cahiers du Socialisme

- Période

- Philo Mag

- Terrestres

- Vie des Idées

- ARTS

- Villa Albertine

- THINK-TANKS

- Fondation Copernic

- Institut La Boétie

- Institut Rousseau

- TECH

- Dans les algorithmes

- Framablog

- Gigawatts.fr

- Goodtech.info

- Quadrature du Net

- INTERNATIONAL

- Alencontre

- Alterinfos

- CETRI

- ESSF

- Inprecor

- Journal des Alternatives

- Guitinews

- MULTILINGUES

- Kedistan

- Quatrième Internationale

- Viewpoint Magazine

- +972 mag

- PODCASTS

- Arrêt sur Images

- Le Diplo

- LSD

- Thinkerview

- Fiabilité 3/5

- Slate

- Fiabilité 1/5

- Contre-Attaque

- Issues

- Korii

- Positivr