ACCÈS LIBRE Une Politique International Environnement Technologies Culture

02.11.2025 à 08:56

Les frappes des États-Unis contre des bateaux en mer des Caraïbes répondent-elles à une stratégie cohérente ?

Jeffrey Fields, Professor of the Practice of International Relations, USC Dornsife College of Letters, Arts and Sciences

Texte intégral (2307 mots)

Une quinzaine de bateaux supposément remplis de drogue et de trafiquants ont été détruits par des frappes conduites par les forces armées des États-Unis au cours de ces dernières semaines. Des opérations illégales au regard du droit international, que l’administration Trump justifie en affirmant que le trafic de drogue relève du terrorisme. Alors que le Venezuela de Nicolas Maduro n’est qu’un acteur secondaire dans l’afflux de drogue vers les États-Unis, Washington affirme que le régime de Caracas organise sciemment ce trafic et laisse entendre qu’une opération de changement de régime pourrait être prochainement menée à son encontre.

« Je pense que nous allons simplement tuer les personnes qui font entrer de la drogue dans notre pays. D’accord ? Nous allons les tuer. Vous savez, ils vont être, genre, morts », a déclaré Donald Trump fin octobre 2025 à propos des frappes militaires américaines contre des bateaux dans la mer des Caraïbes, au nord du Venezuela.

À ce jour, quatorze bateaux ont été frappés, ce qui a causé la mort de 43 personnes. L’administration a affirmé, sans en fournir la moindre preuve, que ces embarcations étaient exploitées par des trafiquants de drogue.

Le 24 octobre, Washington a lancé un renforcement militaire de grande envergure dans la région. Le Pentagone a déployé dans les Caraïbes le porte-avions USS Gerald-R.-Ford et une partie de son groupe aéronaval, ainsi que plusieurs autres navires de guerre, et a transféré à Porto Rico des avions de combat F-35. Il s’agit du plus important déploiement naval américain dans la mer des Caraïbes depuis la crise de Cuba en 1962.

Selon la Maison Blanche, ce renforcement naval et les frappes contre des bateaux dans les eaux internationales s’inscrivent dans les opérations de lutte contre le trafic de drogue. Les navires visés appartiendraient à des trafiquants de drogue vénézuéliens, bien que l’administration n’ait fourni aucune preuve de la présence de drogue à bord ni précisé de quelles drogues il s’agirait, Trump ayant seulement affirmé que du fentanyl pourrait être transporté par ce biais.

À plusieurs reprises, le président et certains de ses conseillers ont qualifié les exploitants et les occupants des bateaux de « narco-terroristes ». Mais ils n’ont jamais expliqué pourquoi ces personnes devraient être considérées comme des terroristes. Au-delà de la question de la lutte contre le trafic de drogue, Trump et son entourage ont également laissé entendre qu’ils cherchent à renverser le gouvernement de Nicolás Maduro au Venezuela.

Ancien analyste politico-militaire et ancien conseiller principal au département de la défense, je peine à discerner dans l’action de l’administration Trump une stratégie ou un objectif cohérent.

La lutte contre le trafic de drogue, une justification discutable

Les bateaux qui ont été interceptés provenaient tous du Venezuela ou avaient des liens avec ce pays, et tous ont été interceptés dans la mer des Caraïbes et dans le Pacifique au nord de la Colombie, ce qui rend cette opération particulièrement déroutante.

Le Venezuela n’est pas un grand producteur de fentanyl ou de cocaïne. Les principales routes du trafic de cocaïne se trouvent dans l’océan Pacifique, et non dans les Caraïbes.

En règle générale, c’est dans les eaux internationales que les garde-côtes états-uniens interceptent les navires soupçonnés de transporter de la drogue. En 2025, la garde côtière a intercepté une quantité record de drogues et de précurseurs chimiques dans les Caraïbes. Il est à noter que la quantité de précurseurs chimiques de la méthamphétamine interceptée dépasse de loin celle du fentanyl.

Après l’interception, les garde-côtes sont censés engager une procédure conforme aux contraintes légales, en interpellant l’équipage avant de le remettre à une agence états-unienne chargée de l’application de la loi.

Mais les frappes de Trump ont tué sans sommation la plupart des personnes se trouvant à bord des bateaux et ont vraisemblablement détruit toutes les drogues illicites présumées. De nombreux observateurs et experts juridiques estiment que ces meurtres équivalaient à des assassinats extrajudiciaires.

Le Venezuela dans le viseur de Donald Trump

Trump est obsédé depuis un certain temps par le gang vénézuélien Tren de Aragua, ce qui renforce l’intérêt que son administration porte au Venezuela.

En janvier, Washington a désigné Tren de Aragua comme organisation terroriste, au même titre que plusieurs autres cartels de la drogue. Mais le communiqué de la Maison Blanche annonçant cette désignation ne mentionnait aucun comportement ou activité constitutifs de terrorisme. En effet, la législation des États-Unis définit le terrorisme comme un acte de violence à motivation politique, visant généralement la population civile, dans le but de provoquer un changement politique.

La désignation d’un groupe, quel qu’il soit, comme « organisation terroriste étrangère » présente l’avantage de permettre au gouvernement de prendre des mesures telles que la saisie des avoirs et l’imposition de restrictions de voyage à l’encontre des personnes qui y sont associées.

Il reste qu’accoler cette qualification à un gang criminel dénué d’idéologie et d’objectifs politiques clairs donne une image erronée de Tren de Aragua, et invite à s’interroger sur les motivations de la Maison Blanche.

Et puis, il y a eu l’étrange incident de l’opération secrète qui ne fut pas si secrète que ça.

Début octobre, le New York Times a rapporté que Trump avait donné son aval à des opérations secrètes au Venezuela et autorisé la CIA à mener des « frappes meurtrières » à l’intérieur du pays.

Étonnamment, Trump a confirmé qu’il avait effectivement donné son feu vert à des opérations secrètes. Or, la caractéristique principale d’une opération secrète est normalement que le rôle du gouvernement qui l’ordonne demeure caché.

L’obsession de Trump pour le Venezuela remonte à son premier mandat, lorsqu’il avait déjà le régime de Maduro dans le collimateur. En mars 2020, son administration a accusé Maduro d’être à la tête du Cartel de los Soles – le cartel des soleils – un réseau criminel informel lié à de hauts responsables militaires vénézuéliens soupçonnés d’avoir organisé un trafic de drogue vers les États-Unis. Et en 2025, la Maison Blanche a affirmé que Maduro contrôlait Tren de Aragua.

Des observateurs indépendants affirment que le leader de l’opposition Edmundo González Urrutia a facilement remporté l’élection présidentielle de 2024. La commission électorale, contrôlée par le gouvernement, a toutefois déclaré Maduro vainqueur. Si la Maison Blanche entend favoriser un changement de régime au Venezuela, comme l’ont suggéré certains responsables anonymes, les récents propos de Trump ont sans doute incité Maduro à se préparer à une telle éventualité.

Aspects juridiques

Si l’objectif de l’administration est d’interdire les drogues dangereuses comme la cocaïne, la Colombie est une source beaucoup plus importante. Le Venezuela joue principalement un rôle de canal de transit mineur plutôt que celui de producteur.

En ce qui concerne l’atténuation des effets des drogues et des stupéfiants aux États-Unis, de nombreuses études menées au cours des dernières décennies ont montré que les mesures prises pour réduire la demande à l’intérieur du pays plutôt qu’à s’en prendre à l’offre sont plus efficaces en la matière.

En l’absence d’informations publiques suggérant l’existence d’une stratégie ou d’un objectif global, les problèmes juridiques liés aux frappes maritimes deviennent évidents.

Le secrétaire d’État Marco Rubio a déclaré que tout cela relevait d’« opérations de lutte contre le trafic de drogue ». Mais il est allé plus loin en affirmant qu’au lieu d’intercepter les bateaux, ceux-ci seraient détruits.

La méthode consistant à intercepter et détruire les bateaux et à tuer les personnes à bord pose de nombreux problèmes juridiques, notamment en ce qui concerne l’exécution de missions de maintien de l’ordre par les forces armées des États-Unis. Cela est interdit par la loi Posse Comitatus Act, qui interdit clairement aux forces armées fédérales d’exercer des activités de maintien de l’ordre.

En ce qui concerne les mesures visant le Venezuela, Trump a affirmé qu’il ne demanderait pas au Congrès de déclarer la guerre, mais qu’il l’informerait de toute opération terrestre.

Le War Powers Act (loi sur les pouvoirs de guerre, adoptée en 1973) qui oblige le président à informer le Congrès avant toute opération militaire et à lui rendre compte après coup, devrait s’appliquer à cette situation. Mais depuis son adoption, presque tous les présidents l’ont ignorée à un moment ou à un autre.

Bien que certains républicains au Congrès se soient opposés aux actions militaires menées jusqu’à présent, le Sénat a rejeté début octobre une résolution qui aurait empêché de nouvelles frappes dans les Caraïbes.

L’administration Trump continue de présenter ses activités dans les eaux internationales comme une opération militaire et les passeurs comme des combattants ennemis. La plupart des spécialistes du droit rejettent cette position et qualifient ces frappes d’exécutions extrajudiciaires.

En réponse à une réaction désinvolte du vice-président J. D. Vance au sujet de ces opérations, le sénateur républicain Rand Paul a écrit sur X : « S’est-il déjà demandé ce qui se passerait si les accusés étaient immédiatement exécutés sans procès ni représentation ? Quelle pensée méprisable et irréfléchie que de glorifier le fait de tuer quelqu’un sans procès. »

Sur les opérations liées au Venezuela, les déclarations éparses de Trump et de ses conseillers, tels que Marco Rubio et le secrétaire à la défense Pete Hegseth, laissent en suspens de nombreuses questions : à ce stade, rien ne justifie que les bateaux soient détruits et leurs occupants tués plutôt qu’interceptés et arrêtés.

Jeffrey Fields a reçu des financements de la Carnegie Corporation de New York.

02.11.2025 à 08:56

Du car scolaire aux rues piétonnes, repenser le chemin de l’école

Sylvain Wagnon, Professeur des universités en sciences de l'éducation, Faculté d'éducation, Université de Montpellier

Texte intégral (1893 mots)

Selon leur lieu d’habitation, les enfants et les adolescents peuvent rejoindre en quelques minutes à pied leur établissement scolaire ou passer une dizaine d’heures par semaine dans les transports. Penser ces trajets n’est pas seulement une question de logistique et d’écologie, mais aussi d’égalité.

Chaque jour, près de 13 millions d’élèves en France effectuent un trajet plus ou moins long entre leur domicile et leur établissement scolaire. Qu’il dure quelques minutes à pied ou plus d’une heure en car, ce temps invisible structure les journées, pèse sur le sommeil et influence la réussite éducative.

Longtemps négligée, cette mobilité quotidienne fait aujourd’hui l’objet d’une attention nouvelle. En septembre 2025, l’Agence de la transition écologique (Ademe) a publié la première étude nationale à grande échelle sur la mobilité des enfants et adolescents intégrant les chemins de l’école : le transport scolaire est désormais un enjeu de santé publique, d’égalité et d’écologie.

Cars scolaires et inégalités territoriales

Le transport scolaire a une histoire. C’est une réalité depuis les années 1960, quand les premiers services départementaux se sont organisés pour desservir les collèges et lycées éloignés. En 1963, on comptait environ 4 000 circuits de car scolaire ; dix ans plus tard, ils étaient déjà plus de 23 000, bien au-delà de la simple croissance démographique. Ce développement répondait à une exigence d’égalité d’accès à l’enseignement dans les territoires ruraux.

Aujourd’hui, la compétence relève des Régions depuis la réforme de 2017. Elles organisent le transport de plus de 2 millions d’élèves en zones non urbaines, auxquels s’ajoutent environ 2 millions d’élèves transportés par les réseaux urbains (bus, tram, métro).

Au total, près d’un tiers des jeunes scolarisés utilisent chaque jour un mode de transport collectif pour rejoindre leur établissement. La pénurie actuelle de conducteurs de bus scolaires fragilise l’égalité d’accès à l’école, surtout dans les zones rurales dépendantes de ce mode de transport. Elle révèle une fracture territoriale croissante : quand certains élèves bénéficient de transports réguliers, d’autres voient leurs trajets rallongés ou compromis.

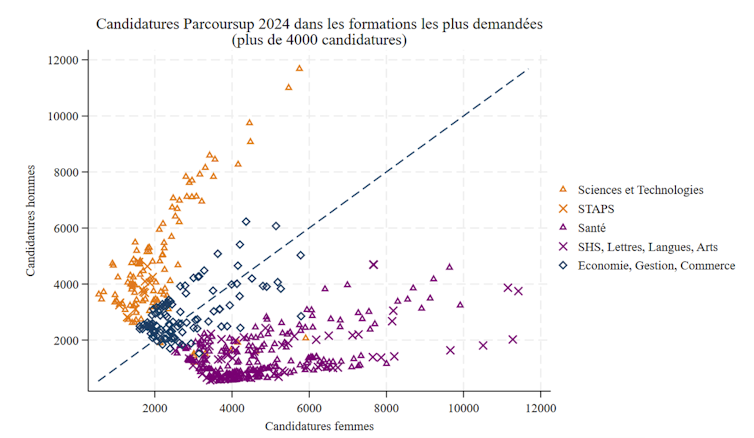

Quels moyens de transport pour aller à l’école ?

L’étude de 2025 de l’Ademe confirme la place centrale de la voiture dans les trajets domicile-école : un tiers des enfants l’utilisent chaque jour, et cette proportion grimpe à 54 % dans les DROM.

Les chiffres sont proches de ceux déjà relevés dans une étude de 2020 : la marche représente de son côté 25 % des déplacements, devant les transports collectifs urbains (19 %), le car scolaire (18 %) et le vélo (2 %). Si la marche reste dominante sur les trajets courts, son usage recule avec l’âge des élèves.

Toutefois, ces moyennes nationales masquent de fortes dynamiques locales : dans certaines villes, l’usage du vélo progresse de manière significative, porté par la création de pistes cyclables sécurisées. Ensuite, de multiples initiatives émergent pour favoriser les mobilités actives entre le domicile et l’école. Objet de plusieurs études, le pédibus, trajets encadrés à pied, organisés par des parents d’élèves et des bénévoles ou par les collectivités locales, demande une organisation et une réglementation, mais donnerait de réels résultats dans le domaine de la santé des élèves.

À lire aussi : Lutter contre la sédentarité des enfants : quel bilan pour les bus pédestres ?

De son côté, le vélobus, groupes d’enfants à vélo accompagnés par des adultes, connaît un réel succès, tout comme encore l’hippobus, calèche tirée par des chevaux expérimentée dans certaines communes. Ces dispositifs traduisent une volonté croissante des collectivités locales mais aussi des parents de repenser le trajet scolaire.

La géographie des trajets scolaires révèle de fortes disparités. Dans certains départements ruraux, un collégien peut passer jusqu’à deux heures par jour dans les transports, contre quelques minutes pour un élève de centre-ville.

À ces inégalités territoriales s’ajoutent des inégalités sociales : le coût des abonnements de transport peut peser lourdement sur les familles modestes, malgré les aides régionales ou départementales. Certaines collectivités pratiquent la gratuité, d’autres imposent des tarifs variables selon les revenus, ce qui nourrit un sentiment d’injustice.

L’étude de l’Ademe met également en lumière un recul de l’autonomie : l’âge du premier déplacement seul est aujourd’hui de 11,6 ans, contre 10,6 ans pour leurs parents. Les craintes parentales liées à la sécurité expliquent en partie ce recul, avec une différence marquée selon le genre. Les filles sont jugées plus vulnérables : 40 % des parents estiment qu’elles sont davantage exposées aux agressions, ce qui retarde leur autonomie.

Le poids du temps de trajet

Si le transport scolaire garantit l’accès à l’éducation, il pèse aussi sur le quotidien. Dans certains territoires, ce temps peut représenter jusqu’à dix heures hebdomadaires passées dans un car, réduisant le temps disponible pour les devoirs, pour les loisirs ou pour le repos.

Un élève qui passe plus d’une heure par jour dans les transports dort en moyenne une demi-heure de moins que ses camarades proches de l’école. Une enquête menée sur des lycéens a montré cette corrélation. Le transport scolaire n’est donc pas neutre : il conditionne directement la réussite éducative et le bien-être.

Une étude sur des adolescents montre que les longs trajets compromettent non seulement le sommeil, mais aussi les capacités cognitives, l’équilibre mental et les notes scolaires.

En Suisse, plusieurs travaux scientifiques ont déjà exploré la question du chemin de l'école comme espace d'apprentissage et d'accès à l'autonomie. Ces recherches ont montré que ce trajet quotidien constitue un tiers-lieu éducatif, au sein duquel les enfants développent des compétences sociales, cognitives et spatiales à travers l'expérience directe de leur environnement.

Les « rues scolaires » : des laboratoires d’innovation

Inspirées de la Grande-Bretagne et de la Belgique, les « rues scolaires » se développent en France depuis 2019. Le principe est simple : fermer temporairement à la circulation automobile la rue située devant une école aux heures d’entrée et de sortie scolaires. Les bénéfices observés sont nombreux : baisse mesurable de la pollution de l’air, réduction du bruit, amélioration du sentiment de sécurité et essor des mobilités actives.

À Paris, plus de 300 rues apaisées existent à cette rentrée 2025, couvrant près de la moitié des écoles primaires. Le mouvement s’étend désormais aux métropoles, mais aussi aux villes moyennes et aux villages, qui y voient un outil concret pour sécuriser et transformer les trajets domicile-école, mais aussi réduire leur pollution atmosphérique. Ces dispositifs contribuent également à renforcer l’autonomie des enfants, en leur permettant de se déplacer seuls ou entre pairs dans un environnement plus serein et moins anxiogène.

Les rues scolaires permettent de tester de nouvelles façons d’organiser l’espace public, tout en favorisant une appropriation collective de la rue par les enfants et les familles. Elles ne constituent pas seulement un aménagement technique, mais aussi une réflexion sociale et politique sur la place que l’on souhaite donner aux enfants dans la ville.

Transformer le trajet scolaire en moment éducatif

Ces expérimentations invitent à changer de regard sur le transport scolaire qui n’est pas un temps perdu, mais un espace d’apprentissage. Marcher ou pédaler vers l’école contribue à la santé physique et à l’autonomie. L’aménagement d’environnements sécurisés transforme le chemin de l’école en moment de socialisation entre parents, adultes et enfants. Dans certaines écoles, on l’intègre à des projets pédagogiques autour de la mobilité durable ou à des apprentissages sur l’espace local.

Le transport scolaire est donc bien plus qu’un dispositif technique : il structure le quotidien de millions d’élèves, il révèle les fractures territoriales et il influence directement la réussite éducative. Longtemps invisible, ce temps mérite d’être reconnu et repensé. Car l’expérience éducative ne se limite pas aux murs de la classe, elle commence dès le trajet et se prolonge dans la vie quotidienne des enfants.

Sylvain Wagnon n'a pas participé à l'étude de l'Ademe citée dans cet article.

02.11.2025 à 08:55

Pourquoi la France, malgré la dégradation de sa note par les agences financières, reste emprunteuse « sans risque » pour les régulateurs ?

Rémy Estran, CEO – Scientific Climate Ratings, EDHEC Business School

Texte intégral (1807 mots)

Malgré la dégradation de la note de la France de AA- à A+ en septembre 2025 par l’agence Fitch, puis en octobre 2025 par Standard & Poor’s, l’Hexagone est toujours considéré comme un emprunteur « sans risque » dans les bilans des banques et des assureurs. Pourquoi ce décalage ?

Vendredi 12 septembre 2025, Fitch a dégradé la note de la France de AA- à A+, après la clôture des marchés. Symboliquement, c’est un coup dur. Pour la première fois depuis plus de dix ans, la France a perdu son badge « double A ». Et pourtant, le lundi suivant, rien n’avait changé : le CAC 40 était en hausse et les spreads de crédit de la France étaient stables.

Rebelote un mois plus tard : le 18 octobre, Standard & Poor’s (S&P) abaisse à son tour la note de la France à A+. Là encore, aucune réaction notable des marchés – ni sur les spreads obligataires ni sur l’indice CAC 40. Le 24 octobre, Moody’s a pour sa part placé la note AA- de la France sous perspective négative.

L’explication courante ? Les marchés avaient déjà anticipé ces décisions. Mais est-ce vraiment toute l’histoire ?

Dans cet article, nous expliquons pourquoi, tant dans le cadre de la réglementation bancaire (Capital Requirements Regulation, CRR) relative aux exigences de fonds propres, que de la réglementation des assurances (Solvency II), la France est toujours considérée comme un emprunteur entrant dans la définition d’un pays « sans risque ».

Cela peut aider à comprendre l’impact limité jusqu’à présent des dégradations successives de Fitch et de Standard & Poor’s, tout en soulignant que les mécanismes bancaires et assurantiels à l’œuvre peuvent soudainement se transformer en couperet.

Notations vs échelons

Dans le cadre des approches standardisées, les réglementations prudentielles européennes (2024/1820 et 2024/1872 essentiellement) ne fonctionnent pas directement avec des notations alphabétiques, mais s’appuient sur des credit quality step (CQS), soit des échelons de qualité de crédit. Ces échelons sont des catégories générales qui regroupent plusieurs notations :

– CQS 0 : AAA (Solvency II uniquement ; le CRR ne comporte pas de niveau 0), comme l’Allemagne, la Suisse, le Danemark, les Pays-Bas ou la Suède.

– CQS 1 : AAA à AA- (CRR)/CQS 1 et AA+ à AA- (Solvency II), comme l’Autriche, la Finlande, l’Estonie, la Belgique ou la République tchèque.

– CQS 2 : A+ à A-, comme la Slovénie, la Slovaquie, la Pologne, la Lituanie ou la Lettonie.

– CQS 3 : BBB+ à BBB-, comme l’Italie, la Roumanie, la Bulgarie, la Croatie, ou la Hongrie.

– CQS 4-6 : notations spéculatives (BB+ et inférieures), comme la Serbie, le Monténégro, la Macédoine du Nord ou le Kosovo.

Techniquement, selon les réglementations bancaires et assurantielles, la dégradation de la note de la France par Fitch en septembre 2025 aurait pu la faire passer de CQS 1 à CQS 2. Mais ce n’est pas le cas.

Jusqu’en octobre 2025, date de la dégradation de la note française par Standard & Poor’s, ces deux cadres réglementaires continuaient de traiter la France comme un émetteur de très haute qualité, c’est-à-dire « AA » et non « A ». Cela tient à la manière dont les réglementations traitent les notes multiples : ni les banques ni les assureurs ne retiennent mécaniquement la note la plus basse.

Règle de la deuxième meilleure notation

En vertu de la réglementation bancaire et assurantielle européenne, la règle de la deuxième meilleure notation s’applique.

Par exemple, si un débiteur est noté par trois agences (S&P, Moody’s, Fitch), les notations la plus élevée et la plus basse sont écartées, et celle du milieu est retenue. Tant que deux des trois agences maintenaient la France dans la catégorie AA, la notation de référence aux fins du capital réglementaire restait CQS 1.

À lire aussi : Moody’s, Standard & Poor’s, Fitch… plongée au cœur du pouvoir des agences de notation

En d’autres termes, même après la dégradation par Fitch à A+, les régulateurs continuaient de classer la France comme « AA ». Ce n’est qu’après la dégradation par S&P, le 17 octobre 2025, que la France est effectivement passée en CQS 2. Moody’s, de son côté, a maintenu sa note AA-, mais l’a placée sous perspective négative le 24 octobre – un signal d’alerte, certes, mais sans conséquence réglementaire à ce stade.

Toutes les dégradations ne se valent pas. Certaines modifient immédiatement la manière dont les institutions financières européennes doivent traiter le risque. D’autres, en revanche, restent sans effet opérationnel. Et pourtant, aucune n’a véritablement fait réagir les marchés.

Illusion réglementaire de la sécurité

Pour la plupart des débiteurs, tels que les entreprises ou les institutions financières, le passage d’un échelon de qualité de crédit, ou credit quality step (CQS), à un autre a une incidence directe sur les exigences de fonds propres. Dans le cas particulier des États souverains européens, même un passage officiel au CQS 2 n’a guère d’importance.

En vertu des règles actuelles, les obligations souveraines de l’Union européenne libellées dans leur propre devise ont en effet une pondération de risque de 0 %. Pourquoi ?

Dans la pratique, les banques ne sont pas tenues de mettre de côté des fonds propres pour couvrir le risque de défaut des emprunts de la France libellés en euros, et ce, quelle que soit la note attribuée à cette dette par les agences de notation.

De même, les assureurs qui détiennent des obligations émises par les États de l’Union européenne (libellées dans leur propre monnaie) ne sont soumis à aucune exigence de capital pour se prémunir contre un éventuel défaut de paiement sur ces titres.

Les seules exigences de fonds propres pour ces obligations proviennent des risques dits « de marché » : le risque de taux d’intérêt, c’est-à-dire la perte potentielle liée à une hausse des taux, et le risque de change, en cas de variation défavorable des devises étrangères. Aucun capital n’est exigé au titre du spread de crédit, c’est-à-dire du risque que le marché exige une prime plus élevée pour prêter à l’État.

Les prêts à la France – ou à tout autre État souverain européen dans sa monnaie nationale – sont considérés comme sans risque de crédit. Ce cadre a été conçu pour éviter la fragmentation et traiter la dette publique de tout État membre européen comme la base du système financier, quelle que soit la situation individuelle de chaque pays.

Paradoxe systémique

Les marchés font bien sûr déjà la distinction entre les États souverains. Les écarts se creusent, les prix des credit defaut swaps (CDS) – qui permettent aux investisseurs de s’assurer contre le défaut d’un émetteur de dette – augmentent et les investisseurs exigent une prime pour les crédits les plus faibles, bien avant que la dégradation ne soit officielle.

Du point de vue des fonds propres réglementaires, le cadre existant ne laisse aucune place à une distinction progressive au sein de l’Union européenne. La conséquence est claire : les États souverains européens sont considérés comme « sûrs » par définition, jusqu’à ce qu’ils ne le soient plus…

Cela crée une sorte d’« effet de falaise » organique. Tant que la confiance institutionnelle reste suffisante, la réglementation atténue partiellement la reconnaissance du risque. Dès qu’un seuil est franchi – souvent un seuil de confiance, plutôt que purement comptable –, la correction devient brutale. Ce qui devrait être une réévaluation progressive se transforme en rupture systémique.

Il y a quinze ans, la crise de la dette publique en Grèce avait suffi à déclencher une crise à l’échelle européenne. Aujourd’hui, la France nous rappelle que l’architecture même de la réglementation européenne rend sa stabilité financière moins graduelle que binaire. Tant que les marchés y croient, tout tient. Mais si la confiance venait à se dérober, ce n’est pas seulement la France qui vacillerait – ce serait toute l’Europe.

Rémy Estran est président de l'EACRA (European Association of Credit Rating Agencies).

01.11.2025 à 19:48

Délibération budgétaire : le lent apprentissage de la démocratie parlementaire

Damien Lecomte, Chercheur associé en sciences politiques, Université Paris 1 Panthéon-Sorbonne

Texte intégral (1686 mots)

Avec le renoncement au 49.3, des discussions budgétaires inédites ont lieu entre groupes politiques à l’Assemblée nationale : le Parlement redevient un lieu de débats décisifs. Est-ce là une nouvelle étape dans le « réapprentissage » de la délibération parlementaire selon des standards européens ?

Après l’éclatement rapide de son gouvernement initial, le premier ministre Sébastien Lecornu est parvenu à survivre aux premières motions de censure déposées contre lui le 16 octobre en échange de deux engagements principaux envers la gauche – le Parti socialiste en particulier : la suspension de la réforme des retraites et le renoncement à l’article 49.3 de la Constitution.

Cette situation ouvre la voie à une vraie expérience de délibération parlementaire. De fait, les débats budgétaires à l’Assemblée nationale depuis le début de la session offrent un spectacle inhabituel : des députés mobilisés et nombreux, des chefs de partis très présents, des négociations pratiquées en pleine séance ou pendant les suspensions entre des blocs opposés… Le Parlement redevient un lieu de débats décisifs. Néanmoins, les chances de succès des discussions budgétaires sont minces et l’apprentissage du parlementarisme « à l’européenne » prend du temps.

Un budget dépendant des aléas de la délibération parlementaire

La décision de Sébastien Lecornu de renoncer à l’article 49.3 semblait s’imposer au premier ministre : en l’absence de majorité, cet article n’est plus une arme à toute épreuve pour le gouvernement, comme l’a démontré la censure de Michel Barnier en décembre 2024. Reste que la construction d’un compromis budgétaire par l’Assemblée nationale est très incertaine.

Le 49.3 offre en principe deux avantages principaux au premier ministre. D’une part, il dispense d’un vote sur le texte de loi lui-même – remplacé par un éventuel vote de censure. D’autre part, il lui permet de conserver le texte dans la version de son choix, avec les amendements déposés ou acceptés par lui. Il peut alors présenter à l’Assemblée nationale un choix de « tout ou rien », c’est-à-dire un budget à laisser passer tel quel ou à rejeter en bloc par la censure.

En l’absence de cette arme et pour la première fois depuis 2021, le projet de loi de finances (PLF) et le projet de loi de financement de la Sécurité sociale (PLFSS) dépendent donc des débats à l’Assemblée nationale. À partir du texte initial déposé par le gouvernement (rectifié pour inclure la suspension de la réforme des retraites), le texte final résultera des votes des députés sur chaque article et chaque amendement déposé. Cela implique de trouver une majorité de suffrages exprimés favorables à chaque disposition pour que celle-ci figure dans le texte de l’Assemblée nationale.

Le droit d’amendement des députés et les discussions parlementaires restent certes enserrés de contraintes, entre la recevabilité financière des amendements déposés par les élus (exigée par l’article 40 de la Constitution), la possibilité pour le gouvernement d’imposer un vote unique sur un ensemble de dispositions (procédure du « vote bloqué » de l’article 44.3) et la poursuite de la navette parlementaire à laquelle participera le Sénat. Il n’en reste pas moins que les députés auront le dernier mot et qu’une majorité de votes « pour » à l’Assemblée nationale sera nécessaire à l’adoption du texte. Autrement dit, l’adoption du PLF et du PLFSS par le Parlement nécessitera le vote « pour » d’au moins une partie des groupes d’opposition, et non pas seulement leur abstention.

Toute la difficulté est donc de trouver le point d’équilibre – s’il existe – qui fasse le moins mal possible à des groupes d’opposition pour leur permettre d’assumer de voter le texte – de revendiquer des victoires malgré les concessions.

Le risque est donc grand que les débats dans l’hémicycle aboutissent plutôt, que ce soit sur chaque article ou sur le texte final, à des majorités « négatives » qui coalisent les votes « contre » de plusieurs groupes, parfois pour des raisons opposées. Les différents blocs parlementaires pourraient donc rejeter mutuellement leurs propositions sans parvenir à un accord majoritaire – une issue fort vraisemblable.

L’absence persistante d’un vrai accord préalable

Devant la crise politique qui s’éternise depuis l’été 2024, les pratiques évoluent doucement. L’importance prise par les négociations entre Sébastien Lecornu et le Parti socialiste et les vraies concessions annoncées par le premier ministre vont bien plus loin que ce que François Bayrou avait pu tenter. Mais les pratiques françaises ne rejoignent pas encore les standards des pratiques européennes.

L’adoption des lois budgétaires nécessiterait un compromis global préalable, même a minima, entre le gouvernement, les groupes minoritaires – principalement LR – et une partie des groupes d’opposition – le PS étant a priori le plus ouvert à cet égard. Un tel compromis global devrait fixer les grands équilibres et les principales concessions que les parties prenantes s’engagent à se faire mutuellement, quitte à se faire violence.

Dans les régimes parlementaires européens plus habitués à la négociation parlementaire et à la construction de coalitions post-électorales – dont l’Allemagne est l’exemple le plus évident – la pratique la plus courante consiste à mettre au clair, avant les débats au Parlement proprement dits, un accord entre forces politiques. Les gouvernements de coalition les plus durables sont, sans surprise, ceux qui s’appuient sur un « contrat de coalition » le plus complet et détaillé possible. Dans ce cas, les parlementaires peuvent devoir voter des textes qui leur déplaisent, mais le font pour remplir leur part du « contrat de coalition », en échange de la même discipline de la part de leurs partenaires pour les dispositions qui leur tiennent à cœur.

Lorsque les partis partenaires ne parviennent pas à se mettre d’accord au préalable sur certains sujets plus clivants, ils se mettent d’accord sur un renvoi ultérieur du débat et sur des procédures pour trancher les désaccords – par exemple en prévoyant un « comité de coalition » réunissant les membres des directions partisanes et chargé d’arbitrer le moment venu lorsqu’une décision doit être prise. Des procédures visant à éviter les mauvaises surprises et ne pas s’en remettre à l’incertitude des rapports de force en assemblée ou à la cacophonie gouvernementale.

La France est encore loin d’avoir institutionnalisé un mode de fonctionnement parlementaire fondé sur la négociation et le compromis. Aucun accord formel et encore moins de contrat de législature n’existe entre le gouvernement et les groupes minoritaires et d’opposition – pas plus qu’il n’en a existé entre les partenaires de la défunte coalition du « socle commun ».

Une adoption du budget très improbable

À cet égard, il est très révélateur que l’annonce de la suspension de la réforme des retraites par le premier ministre, la plus importante concession faite au PS en échange de sa non-censure, n’engage pas automatiquement sa propre base parlementaire, puisque les députés Renaissance sont divisés sur le vote de ce compromis, mollement défendu par le président Macron, et que la position collective du groupe s’est orientée vers un refus de la voter, quitte à mettre en péril l’adoption du PLFSS.

Elle engage encore moins les parlementaires LR : le président du Sénat Gérard Larcher a déjà annoncé que la droite sénatoriale supprimerait la suspension de la réforme des retraites. À tout cela s’ajoute les désaccords apparemment irréductibles entre PS et LR sur la fiscalité et notamment la taxation des plus riches, alors qu’une version même « allégée » de la taxe Zucman est exigée par les socialistes.

L’absence d’accord de compromis préalable sur au moins quelques grandes mesures, acceptées par une majorité de groupes parlementaires, donne certes tout son intérêt à la délibération dans l’hémicycle, mais laisse très incertaine, pour ne pas dire très improbable, l’adoption d’un budget pour l’État et la Sécurité sociale. Le processus d’adaptation de la politique française à l’absence de majorité à l’Assemblée nationale est donc loin d’être terminé.

Damien Lecomte ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

01.11.2025 à 15:21

La course à la bombe : encore ?

Cyrille Bret, Géopoliticien, Sciences Po

Texte intégral (2338 mots)

L’arme nucléaire revient sur le devant de la scène internationale, avec les annonces successives, par Vladimir Poutine, du développement de nouveaux armements, et par Donald Trump de la reprise d’essais. Les traités de limitation des armements sont de plus en plus ignorés et cette nouvelle course entre les deux (anciens) Grands de la guerre froide pourrait, cette fois, inciter plusieurs nouveaux participants à entrer dans la compétition…

Depuis une semaine, l’actualité stratégique est devenue retro. Elle a repris une chorégraphie très « années 1950 » car elle a été bousculée par le retour du nucléaire au-devant de la scène internationale.

Le 26 octobre dernier, en treillis et en vidéo, Vladimir Poutine présente (à nouveau) le missile expérimental russe Bourevstnik (« annonceur de tempête »), doté d’une tête et d’un système de propulsion nucléaires. Quelques jours plus tard, c’est au tour d’un drone sous-marin à propulsion nucléaire, le Poséidon, déjà présenté il y a quelques années, d’avoir les honneurs des autorités russes qui proclament qu’il est indétectable et pourrait venir percuter les côtes ennemies et y faire exploser une charge nucléaire. Enfin, le 29 octobre, Donald Trump annonce sur le réseau Truth Social la reprise des essais pour « les armes nucléaires », une première depuis l’adoption du Traité sur l’interdiction des essais nucléaires en 1996.

Cette guerre des communiqués a déclenché l’onde de choc d’une bombe – médiatique, fort heureusement – dans les milieux stratégiques. En effet, depuis l’invasion de l’Ukraine par la Russie en 2022, la guerre d’Israël contre le Hamas dans la bande de Gaza, le bombardement de l’Iran par les États-Unis et la guerre Inde-Pakistan du début de l’année, l’attention des analystes militaires s’était portée sur les armements traditionnels (blindés, missiles, munitions, chasseurs) et sur les systèmes innovants (drones, artillerie mobile, munitions guidées, bombes perforatrices).

Dans cette séquence en Technicolor et en Mondovision, tout se passe comme si le célèbre Dr. Folamour du film de Stanley Kubrick (1964) faisait son grand retour : ce personnage de fiction, scientifique nazi employé par l’armée américaine, paraît comme rappelé à la vie par la nouvelle guerre froide que se livrent les grandes puissances militaires dotées de l’arme atomique, à savoir les États-Unis, la Fédération de Russie et la République populaire de Chine, respectivement pourvues d’environ 3700, 4200 et 600 ogives nucléaires. Ce parfum de course à la bombe fleure bon les années 1950, les Cadillac roses et les défilés sur la place Rouge.

Pourquoi la course aux armements nucléaires est-elle aujourd’hui relancée, du moins au niveau médiatique ? Et quels sont les risques dont elle est porteuse ?

Essais nucléaires américains et surenchères médiatiques

En annonçant la reprise des essais nucléaires sur le sol des États-Unis, Donald Trump s’est montré aussi tonitruant que flou. Dans ce domaine-là comme dans tous les autres, il a voulu claironner le Make America Great Again qui constitue son slogan d’action universelle pour rendre à l’Amérique la première place dans tous les domaines.

En bon dirigeant narcissique, il a voulu occuper seul le devant de la scène médiatique en répliquant immédiatement aux annonces du Kremlin. En bon animateur de reality show, il a volé la vedette atomique à son homologue russe. Invoquant les initiatives étrangères en la matière, il a endossé son rôle favori, celui de briseur de tabous, en l’occurrence le traité d’interdiction complète des essais nucléaires (TICEN) adopté en 1996 par l’Assemblée générale des Nations unies, avec le soutien des États-Unis de Bill Clinton, érigés en gendarme du monde.

Le message trumpien procède d’une surenchère évidente sur les annonces du Kremlin : comment Donald Trump aurait-il pu laisser toute la lumière à Vladimir Poutine en matière d’innovations nucléaires de défense ? Il lui fallait réagir par une annonce plus forte, plus choquante et plus massive. C’est tout le sens de la reprise des essais sur « les armements nucléaires ». Personne ne sait s’il s’agit de tester de nouvelles ogives, de nouveaux vecteurs, de nouveaux modes de propulsion ou de nouvelles technologies de guidage. Mais tout le monde retient que c’est le président américain qui a officiellement relancé et pris la tête de la course mondiale à la bombe. C’était le but visé. Examinons maintenant ses conséquences.

À moyen terme, cette déclaration n’a rien de rassurant : les États-Unis, première puissance dotée historiquement et deuxième puissance nucléaire par le nombre d’ogives, envoient par cette annonce un « signalement stratégique » clair au monde. Ils revendiquent le leadership en matière d’armes nucléaires (dans tous les domaines) en dépit du rôle essentiel qu’ils ont joué depuis les années 1980 pour le contrôle, la limitation et la réduction des armes nucléaires.

En effet, les différents traités signés et renouvelés par Washington – Traité sur les forces nucléaires à portée intermédiaire (1987), START I (1991), II (1993) et New START (2010), TICEN, etc. – avaient tous pour vocation de dire au monde que les États-Unis se donnaient comme horizon la dénucléarisation des relations internationales ainsi que de l’espace et même la suppression de l’arme comme le souhaitait le président Obama.

Avec cette annonce – qu’on espère réfléchie même si elle paraît compulsive –, les États-Unis changent de rôle mondial : ils cessent officiellement d’être un modérateur nucléaire pour devenir un moteur de la nucléarisation des relations internationales.

L’avenir du nucléaire : dissuasion ou suprématie ?

La tonalité qui se dégage de cette guerre des communiqués atomiques ressemble à s’y méprendre à la première guerre froide et à la course-poursuite à laquelle elle avait donné lieu. Après avoir conçu, produit et même utilisé l’arme atomique en 1945 contre Hiroshima et Nagasaki, les États-Unis avaient continué leur effort pour obtenir la suprématie nucléaire dans le domaine des vecteurs, des milieux (air, terre, mer) et des technologies de guidage. L’URSS de Staline avait, elle, d’abord cherché à briser le monopole américain sur l’arme nucléaire puis gravi tous les échelons technologiques pour devenir une puissance nucléaire à parité avec ce qu’on appelait alors le leader du monde libre.

Le pivot historique doit être noté, surtout s’il se confirme par une course aux armements. Jusqu’à la guerre d’Ukraine, les armes nucléaires faisaient l’objet de perfectionnements technologiques réguliers. Mais le cadre de leur possession restait inchangé : elles devaient constituer un outil de dissuasion. Autrement dit, elles devaient rester des armements à ne jamais utiliser. Les signalements stratégiques sont aujourd’hui sensiblement en rupture avec cette logique établie depuis les années 1980.

Depuis le début de la guerre d’Ukraine, le Kremlin laisse régulièrement entendre qu’un usage sur le champ de bataille (le fameux « nucléaire tactique ») n’est pas à exclure en cas de risque pour les intérêts vitaux russes. De même, les États-Unis viennent de faire comprendre que leur priorité n’est plus la lutte contre la prolifération nucléaire, qu’elle soit nord-coréenne ou iranienne. Si le message de Donald Trump sur Truth Social est suivi d’effets, la priorité nucléaire américaine sera la reconquête de la suprématie nucléaire en termes de quantité et de qualité.

Autrement dit, les anciens rivaux de la guerre froide relancent une course aux armements nucléaires au moment où les instruments internationaux de limitation et de contrôle sont démantelés ou obsolètes. Ils ne luttent plus pour se dissuader les uns les autres d’agir. Ils participent à la course pour l’emporter sur leurs rivaux. Le but n’est plus la MAD (Mutual Assured Destruction) mais la suprématie et l’hégémonie atomique.

L’effet d’imitation risque d’être puissant, donnant un nouvel élan aux proliférations.

De la compétition internationale à la prolifération mondiale ?

Si les annonces russo-américaines se confirment, se réalisent et s’amplifient sous la forme d’une nouvelle course aux armements nucléaires, trois ondes de choc peuvent frapper les relations stratégiques à court et moyen terme.

Premier effet de souffle, au sein du club des puissances officiellement dotées de l’arme nucléaire au sens du Traité de Non-Prolifération (TNP), la République populaire de Chine ne pourra pas se laisser distancer (quantitativement et qualitativement) par son rival principal, les États-Unis et par son « brillant second », la Russie. En conséquence, la RPC s’engagera progressivement dans un programme visant à combler son retard en nombre de têtes et dans la propulsion des vecteurs. Cela militarisera encore un peu plus la rivalité avec les États-Unis et « l’amitié infinie » avec la Russie. Il est à prévoir que de nouveaux armements nucléaires seront développés, adaptés à l’aire Pacifique et dans les espaces que la Chine conteste aux États-Unis : Arctique, espace, fonds marins… Il est également à prévoir que la Chine s’attachera à développer des systèmes de lutte contre ces nouveaux vecteurs à propulsion nucléaire.

Le deuxième effet sera, pour les Européens, une interrogation sur les ressources à consacrer à leurs propres programmes nucléaires, de taille réduite car ils sont essentiellement axés sur la dissuasion stratégique. S’ils refusent de s’y engager pour concentrer leurs ressources sur les armes conventionnelles, ils risquent un nouveau déclassement. Mais s’ils se lancent dans la compétition, ils risquent de s’y épuiser, tant leur retard est grand. Nucléarisés mais appauvris. Ou bien vulnérables mais capables de financer le réarmement conventionnel.

À lire aussi : Les défis du réarmement de l’Europe : réveil stratégique ou chaos organisé ?

Enfin, le troisième effet indirect des déclarations russo-américaines sur la reprise de la course aux armements sera la tentation, pour de nombreux États, de se rapprocher du seuil afin de garantir leur sécurité. Si l’Arabie saoudite, la Corée du Sud, la Pologne et même le Japon et l’Allemagne considèrent que leur sécurité nécessite des armes nucléaires et que le cadre du TNP est obsolète, alors la prolifération risque de reprendre de plus belle, à l’ombre des menaces nord-coréennes et iraniennes.

À lire aussi : Nouveau partenariat Arabie saoudite-Pakistan : quelles conséquences internationales ?

De Dr. Folamour à Dr. Frankenstein

Les annonces russes, américaines et, n’en doutons pas, bientôt chinoises sur les armements nucléaires présagent d’une nouvelle phase dans les affaires stratégiques, celle d’une compétition majeure sur toutes les technologies liées à ces armes complexes. Si la tendance se confirme, les armes nucléaires, leurs vecteurs, leurs usages et leurs doctrines seront de nouveau propulsés au premier plan du dialogue compétitif entre puissances. Et l’espace sera lui-même susceptible de devenir le nouvel espace de la compétition nucléaire.

Vivons-nous pour autant une régression historique vers la guerre froide ?

La donne est bien différente de celle des années 1950, quand le but des puissances communistes était de rattraper leur retard sur les armes américaines (acquisition de la bombe, passage au thermonucléaire). Et le débat stratégique est bien distinct de celui des années 1970, quand la compétition était quantitative (combien de têtes ? Combien de vecteurs ?).

Aujourd’hui, les risques liés aux armes nucléaires sont différents : démantèlement progressif des traités de limitation et de contrôle de ces armes, tentation retrouvée de se porter au seuil pour les puissances non dotées et surtout réflexion sur un usage (et non plus sur la dissuasion).

Ce n’est pas Dr. Folamour qui a connu une résurrection, c’est un nouveau Dr. Frankenstein qui s’est lancé dans des expérimentations.

Cyrille Bret ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

01.11.2025 à 15:19

Au Royaume-Uni, l'influence cachée des militaires derrière le nouvel engouement pour les petits réacteurs nucléaires

Phil Johnstone, Visiting Fellow, School of Global Studies, University of Sussex; University of Tartu; Utrecht University

Andy Stirling, Professor of Science & Technology Policy, SPRU, University of Sussex Business School, University of Sussex

Texte intégral (2170 mots)

Outre-Manche, les petits réacteurs modulaires sont présentés comme une solution énergétique, mais servent d'abord les besoins stratégiques des armées. En subventionnant le nucléaire civil, citoyens et consommateurs financent indirectement la puissance militaire.

La récente visite de Donald Trump au Royaume-Uni a donné lieu à un «partenariat historique» sur l'énergie nucléaire. Londres et Washington ont annoncé leur intention de construire 20 petits réacteurs modulaires et de développer également la technologie des microréacteurs – et ce alors qu'aucune de ces installations n'a encore été construite commercialement nulle part dans le monde.

Le premier ministre britannique, Keir Starmer, a promis que ces projets inaugureraient un «âge d'or» du nucléaire qui permettrait aussi de «faire baisser les factures». Pourtant, l'histoire de l'énergie nucléaire est faite de décennies de surenchère, de coûts faramineux et de retards à répétition. Partout dans le monde, les tendances vont dans la mauvaise direction.

Alors pourquoi un tel regain d'enthousiasme pour le nucléaire ? Les véritables raisons tiennent moins à la sécurité énergétique ou au changement climatique – et bien davantage à la puissance militaire.

À première vue, l'argument semble évident. Les partisans du nucléaire présentent les petits réacteurs modulaires, ou SMR, comme indispensables pour réduire les émissions et répondre à une demande croissante d'électricité, alimentée par les voitures et les centres de données. Les grandes centrales nucléaires étant désormais devenues trop coûteuses, les réacteurs de taille réduite sont promus comme une alternative enthousiasmante.

Mais aujourd'hui, même les analyses les plus optimistes de l'industrie reconnaissent que le nucléaire – y compris les SMR – a peu de chances de rivaliser avec les énergies renouvelables. Une étude publiée plus tôt cette année dans le New Civil Engineer concluait que les SMR sont «la source d'électricité la plus coûteuse par kilowatt produit, comparée au gaz naturel, au nucléaire traditionnel et aux renouvelables».

Des évaluations indépendantes – notamment celle de l'ex-pro-nucléaire Royal Society – montrent que des systèmes 100 % renouvelables surpassent tout système incluant du nucléaire en termes de coût, de flexibilité et de sécurité. Cela contribue à expliquer pourquoi des analyses statistiques mondiales révèlent que l'énergie nucléaire n'est généralement pas associée à une réduction des émissions de carbone, contrairement aux renouvelables.

En partie, l'enthousiasme pour les SMR s'explique par le fait que les voix institutionnelles les plus audibles ont souvent un mandat ou des intérêts pronucléaires : il s'agit de l'industrie elle-même et de ses fournisseurs, des agences nucléaires et des gouvernements dotés de programmes militaires nucléaires bien ancrés. Pour ces acteurs, la seule question est de savoir quels types de réacteurs développer, et à quelle vitesse. Ils ne se demandent pas s'il faut construire des réacteurs en premier lieu : la nécessité est considérée comme une évidence.

Au moins, les grandes centrales nucléaires ont bénéficié d'économies d'échelle et de décennies d'optimisation technologique. Beaucoup de conceptions de SMR ne sont encore que des «réacteurs PowerPoint», existant uniquement sous forme de diapositives et d'études de faisabilité. Les affirmations selon lesquelles ces projets non réalisés «coûteront moins cher» relèvent au mieux de la spéculation.

Les marchés financiers le savent. Si les investisseurs considèrent la frénésie autour des SMR comme une occasion de profiter de milliards de subventions publiques, leurs propres analyses se montrent nettement moins enthousiastes quant à la technologie elle-même.

Alors pourquoi, dès lors, un tel intérêt pour le nucléaire en général et pour les réacteurs de petite taille en particulier ? Il est évident que quelque chose d'autre se joue derrière cette mise en avant.

Le lien caché

Le facteur négligé est la dépendance des programmes militaires vis-à-vis des industries nucléaires civiles. Le maintien d'une marine nucléaire ou d'un arsenal nucléaire exige un accès constant à des technologies de réacteurs génériques, à une main-d'œuvre hautement qualifiée et à des matériaux spécifiques. Sans industrie nucléaire civile, les capacités militaires nucléaires deviennent beaucoup plus difficiles et coûteuses à entretenir.

Les sous-marins nucléaires occupent une place particulièrement centrale, car ils nécessiteraient très probablement l'existence d'industries nationales de réacteurs et de leurs chaînes d'approvisionnement même en l'absence d'un programme nucléaire civil. Déjà difficilement abordables pris individuellement, les sous-marins nucléaires deviennent encore plus coûteux si l'on prend en compte l'ensemble de cette «base industrielle sous-marine».

Rolls-Royce constitue un maillon essentiel de cette chaîne : l'entreprise construit déjà les réacteurs des sous-marins britanniques et doit produire les SMR civils récemment annoncés. Elle déclarait d'ailleurs ouvertement en 2017 qu'un programme de SMR civils permettrait de «décharger le ministère de la Défense du fardeau que représente le développement et le maintien des compétences et des capacités».

Ici, comme le soulignait Nuclear Intelligence Weekly en 2020, le programme de SMR de Rolls-Royce entretient une importante «symbiose avec les besoins militaires du Royaume-Uni». C'est cette dépendance qui permet aux coûts militaires (selon les termes d'un ancien dirigeant du constructeur de sous-marins BAE Systems) d'être «masqués» derrière des programmes civils.

En finançant les projets nucléaires civils, les contribuables et les consommateurs prennent en charge les usages militaires de l'énergie nucléaire par le biais de subventions et de factures plus élevées – sans que ces dépenses supplémentaires apparaissent dans les budgets de la défense.

Lorsque le gouvernement britannique nous a financés pour évaluer l'ampleur de ce transfert, nous l'avons estimé à environ 5 milliards de livres par an rien qu'au Royaume-Uni. Ces coûts échappent à la vue du public, car ils sont absorbés par les recettes provenant de factures d'électricité plus élevées et par les budgets d'agences gouvernementales supposément civiles.

Il ne s'agit pas d'un complot, mais plutôt d'une sorte de champ gravitationnel politique. Dès lors que les gouvernements considèrent l'arme nucléaire comme un marqueur de statut mondial, les financements et le soutien politique s'auto-entretiennent. Il en résulte une étrange forme de circularité : l'énergie nucléaire est justifiée par des arguments de sécurité énergétique et de coûts qui ne tiennent pas la route, mais elle est en réalité maintenue pour des raisons stratégiques qui demeurent inavouées.

Un schéma mondial

Le Royaume-Uni n'a rien d'exceptionnel, même si d'autres puissances nucléaires se montrent beaucoup plus franches. Le secrétaire américain à l'énergie, Chris Wright, a ainsi décrit l'accord nucléaire entre les États-Unis et le Royaume-Uni comme essentiel pour «sécuriser les chaînes d'approvisionnement nucléaires à travers l'Atlantique». Chaque année, environ 25 milliards de dollars (18,7 milliards de livres) transitent ainsi du nucléaire civil vers le nucléaire militaire aux États-Unis.

La Russie et la Chine sont elles aussi assez transparentes sur leurs liens indissociables entre civil et militaire. Le président français Emmanuel Macron l'a dit sans détour : «Sans nucléaire civil, pas de nucléaire militaire ; sans nucléaire militaire, pas de nucléaire civil».

Dans ces pays, les capacités nucléaires militaires sont perçues comme un moyen de rester à la «table des grands». Mettre fin à leur programme civil menacerait non seulement l'emploi et l'approvisionnement énergétique, mais aussi leur statut de grande puissance.

La prochaine frontière

Au-delà des sous-marins, le développement des «microréacteurs» ouvre de nouveaux usages militaires pour l'énergie nucléaire. Les microréacteurs sont encore plus petits et plus expérimentaux que les SMR. Bien qu'ils puissent tirer des profits en exploitant les budgets d'achats militaires, ils n'ont aucun sens d'un point de vue commercial pour l'énergie. Cependant, les microréacteurs sont considérés comme essentiels dans les plans américains pour l'alimentation sur le champ de bataille, les infrastructures spatiales et de nouvelles armes à haute puissance énergétique. Préparez-vous à les voir occuper une place croissante dans les débats «civils» – précisément parce qu'ils servent des objectifs militaires.

Quel que soit le regard porté sur ces évolutions militaires, il n'a aucun sens de prétendre qu'elles n'ont aucun lien avec le secteur nucléaire civil. Les véritables moteurs du récent accord nucléaire entre les États-Unis et le Royaume-Uni résident dans la projection de puissance militaire, et non dans la production civile d'électricité. Pourtant, cet aspect demeure absent de la plupart des débats sur la politique énergétique.

Il s'agit pourtant d'un enjeu démocratique essentiel : il faut de la transparence sur ce qui se joue réellement.

Phil Johnstone est professeur invité à l’Université de Tartu, chercheur postdoctoral à l’Université d’Utrecht et chercheur associé à l’Université du Sussex. Il est membre bénévole du Sussex Energy Group et du Nuclear Consultation Group, parrain du Nuclear Information Service, et siège au comité consultatif du Medact Nuclear Weapons group. Avec Andy Stirling, il a auparavant reçu des financements du Foreign, Commonwealth and Development Office (FCDO) du Royaume-Uni pour des recherches qui sous-tendent certaines des analyses présentées dans ce blog.

Andy Stirling est professeur émérite à l’Université du Sussex. Parmi ses nombreuses fonctions passées de conseil auprès de gouvernements et d’organisations intergouvernementales, il siège actuellement au sous-comité de sociologie du Research Excellence Framework 2029 du Royaume-Uni et au Conseil de recherche de l’Institut canadien de recherches avancées. Il est membre bénévole du Sussex Energy Group et du Nuclear Consultation Group, parrain du Nuclear Information Service et du Nuclear Education Trust, ainsi qu’administrateur de Greenpeace UK. Il a exercé en 2022-2023 comme expert-conseil pour l’évaluation officielle par le gouvernement britannique du programme d’innovation nucléaire du DESNZ et, avec Phil Johnstone, a reçu des financements du Foreign, Commonwealth and Development Office (FCDO) du Royaume-Uni pour des recherches qui sous-tendent certaines des analyses présentées dans ce blog.

01.11.2025 à 15:18

Pourquoi le missile nucléaire russe Bourevestnik change les règles du jeu militaire

Iain Boyd, Director of the Center for National Security Initiatives and Professor of Aerospace Engineering Sciences, University of Colorado Boulder

Texte intégral (1915 mots)

Le président russe Vladimir Poutine, vêtu d’un uniforme militaire, a annoncé le 26 octobre 2025 que la Russie avait testé avec succès un missile à propulsion nucléaire. Si cette information est avérée, une telle arme pourrait conférer à la Russie une capacité militaire unique, aux répercussions politiques plus larges.

Le missile, appelé Bourevestnik, aurait été testé avec succès au-dessus de l'océan Arctique après des années de développement et plusieurs vols d'essai initiaux, dont l'un a entraîné la mort de cinq scientifiques nucléaires.

Je suis ingénieur et j’étudie les systèmes de défense. Voici comment ces armes fonctionnent, les avantages qu'elles présentent par rapport aux systèmes de missiles conventionnels, et leur potentiel à perturber la stabilité stratégique mondiale.

Missiles à propulsion conventionnelle

Les missiles sont utilisés par les forces armées du monde entier depuis des siècles et se déclinent en une grande variété de modèles, caractérisés par leur mission, leur portée et leur vitesse. Ils servent à endommager et détruire une large gamme de cibles, notamment des installations terrestres comme des bases, des centres de commandement et des infrastructures enterrées en profondeur ; des navires ; des aéronefs ; et potentiellement des engins spatiaux. Ces armes sont lancées depuis le sol par l’armée de terre, depuis la mer par des bâtiments de la marine, et depuis les airs par des chasseurs et des bombardiers.

Les missiles peuvent être tactiques, avec des portées relativement courtes de moins de 800 km, ou stratégiques, avec des portées de plusieurs milliers de kilomètres. On distingue trois grandes catégories de missiles : balistiques, de croisière et hypersoniques.

Les missiles balistiques sont propulsés par des moteurs fusées. Après l’extinction de la poussée, le missile décrit un arc prévisible qui l’emmène hors de l’atmosphère, dans l’espace, puis de nouveau dans l’atmosphère en direction de sa cible.

Les missiles de croisière disposent d’un moteur additionnel qui s’allume après l’extinction de la fusée, permettant au missile de parcourir des trajectoires programmées, typiquement à basse altitude. Ces moteurs fonctionnent grâce à un mélange chimique ou à un carburant solide.

Les missiles hypersoniques volent à des vitesses supérieures à celle du son, mais pas aussi rapides que les missiles balistiques intercontinentaux (ICBM). Ils sont lancés par de plus petites fusées qui les maintiennent dans les couches supérieures de l’atmosphère. Le planeur hypersonique est propulsé jusqu’à une altitude élevée puis glisse vers sa cible en manœuvrant en cours de route. Le missile de croisière hypersonique, lui, est propulsé jusqu’à une vitesse hypersonique, puis utilise un moteur à air appelé scramjet pour maintenir cette vitesse.

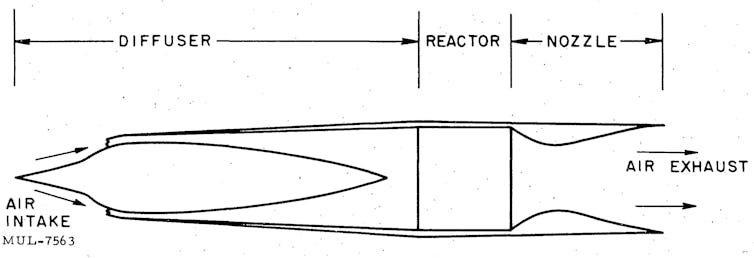

Comment fonctionnent les missiles à propulsion nucléaire

Les missiles à propulsion nucléaire sont une variante de missile de croisière. Les conceptions reposent généralement sur une forme de scramjet. Un système nucléaire thermique utilise la fission du combustible nucléaire pour ajouter de l’énergie à un flux d’air qui est ensuite accéléré dans une tuyère pour générer de la poussée. De cette manière, la fission du matériau nucléaire remplace la combustion chimique des moteurs de croisière traditionnels.

La densité d’énergie — la quantité d’énergie libérée par unité de masse de combustible — fournie par la fission nucléaire est des millions de fois supérieure à celle des propergols chimiques. Cette caractéristique signifie qu’une quantité relativement faible de combustible fissile peut propulser un missile pendant des périodes bien plus longues que ne le permettent les propergols chimiques.

Les États-Unis ont étudié le développement d’un missile à propulsion nucléaire dans les années 1960. Le programme, Project Pluto, a été abandonné en raison des progrès rapides réalisés à la même époque sur les ICBM, ainsi que des inquiétudes liées à la contamination environnementale associée aux systèmes nucléaires.

Avantages du vol à propulsion nucléaire

L’avantage principal des missiles à propulsion nucléaire réside dans l’énergie supplémentaire qu’ils génèrent, leur permettant de voler plus loin, plus longtemps, plus vite et plus bas dans l’atmosphère, tout en exécutant une large gamme de manœuvres. Pour ces raisons, ils représentent un défi considérable pour les meilleurs systèmes de défense antimissile.

L’armée russe affirme que le missile Bourevestnik a parcouru 8 700 miles à basse altitude sur une période de 15 heures. À titre de comparaison, un vol commercial entre San Francisco et Boston couvre 2 700 miles en six heures. Bien que le Bourevestnik ne vole pas particulièrement vite pour un missile, il est probablement manœuvrable, ce qui le rend difficile à intercepter.

Contraintes liées à l’utilisation de l’énergie nucléaire

L’immense quantité d’énergie libérée par la fission constitue le principal défi technique du développement de ces missiles. Ces niveaux d’énergie très élevés exigent des matériaux capables de résister à des températures atteignant plusieurs milliers de degrés Celsius, afin d’empêcher le missile de se détruire lui-même.

Sur le plan de la sécurité, la technologie nucléaire a trouvé des applications très limitées dans l’espace en raison des risques de contamination radioactive en cas d’incident, comme un lancement raté. Les mêmes inquiétudes s’appliquent à une arme à propulsion nucléaire.

De plus, de tels systèmes doivent pouvoir rester sûrs pendant de longues années avant leur utilisation. Une attaque ennemie contre une installation de stockage contenant des armes à propulsion nucléaire pourrait entraîner une fuite radioactive massive.

Le Bourevestnik russe et la stabilité mondiale

Le nouveau missile russe Bourevestnik est en développement depuis plus de vingt ans. Bien que peu de détails techniques soient connus, les responsables russes affirment qu’il peut manœuvrer afin de contourner les systèmes antimissiles et de défense aérienne.

Les armes nucléaires ont constitué la base de la dissuasion mutuelle entre l’Union soviétique et les États-Unis pendant la guerre froide. Les deux camps comprenaient qu’une première frappe de l’un entraînerait une riposte tout aussi dévastatrice de l’autre. La peur d’une destruction totale maintenait ainsi un équilibre pacifique.

Plusieurs évolutions menacent l’équilibre actuel des forces : l’amélioration des systèmes de défense antimissile, comme le Golden Dome prévu par les États-Unis, et les progrès réalisés dans les missiles hautement manœuvrables. Les systèmes de défense antimissile pourraient bloquer une frappe nucléaire, tandis que les missiles manœuvrant à basse altitude pourraient atteindre leur cible sans avertissement.

Ainsi, si une grande partie des réactions à l’annonce par la Russie de son nouveau missile à propulsion nucléaire s’est concentrée sur la difficulté de s’en défendre, la préoccupation majeure réside sans doute dans son potentiel à bouleverser complètement la stabilité stratégique mondiale.

Iain Boyd a reçu des financements du département américain de la Défense.

01.11.2025 à 10:04

Ce que la taille de votre signature révèle vraiment de vous

Richie Zweigenhaft, Emeritus Professor of Psychology, Guilford College

Texte intégral (1672 mots)

Et si la taille de votre signature trahissait votre personnalité ? Loin d’être anodines, ces quelques lettres griffonnées à la hâte sur un chèque ou sous un contrat permettent de mieux comprendre le pouvoir, l’estime de soi et les dérives narcissiques.

Depuis des années, la signature de Donald Trump – large, anguleuse et spectaculaire – attire l’attention du public. On a récemment découvert qu’elle figurait dans un livre offert à Jeffrey Epstein pour son cinquantième anniversaire, mais elle s’inscrit surtout dans la longue tradition d’autocélébration tapageuse de l’ancien président. « J’adore ma signature, vraiment », a-t-il déclaré, le 30 septembre 2025, devant des responsables militaires. « Tout le monde adore ma signature. »

Cette signature présente pour moi un intérêt particulier, en raison de ma fascination de longue date – et de mes recherches occasionnelles – sur le lien entre la taille des signatures et les traits de personnalité. Chercheur en psychologie sociale m’étant fait une spécialité des élites américaines, j’ai réalisé une découverte empirique involontaire il y a plus de cinquante ans, alors que j’étais encore étudiant. Le lien que j’avais observé à l’époque – et que de nombreuses recherches sont venues confirmer depuis – est que la taille d’une signature est liée au statut social et à la perception de soi.

Taille de la signature et estime de soi

En 1967, lors de ma dernière année d’université, je travaillais à la bibliothèque de psychologie de l’Université Wesleyan (Connecticut) dans le cadre d’un emploi étudiant. Quatre soirs par semaine, ma mission consistait à enregistrer les prêts et à ranger les livres rendus.

Quand les étudiants ou les professeurs empruntaient un livre, ils devaient inscrire leur nom sur une fiche orange, sans lignes, glissée à l’intérieur de l’ouvrage. À un moment, j’ai remarqué un schéma récurrent : les professeurs prenaient beaucoup de place pour signer, leurs lettres occupant presque toute la carte. Les étudiants, eux, écrivaient en petit, laissant largement de la place pour les lecteurs suivants. J’ai alors décidé d’étudier cette observation de façon plus systématique.

J’ai rassemblé au moins dix signatures pour chaque membre du corps enseignant, ainsi qu’un échantillon comparable de signatures d’étudiants dont les noms comptaient le même nombre de lettres. Après avoir mesuré la surface occupée – en multipliant la hauteur par la largeur de la zone utilisée –, j’ai constaté que huit professeurs sur neuf utilisaient nettement plus d’espace pour signer leur nom.

Afin de tester l’effet de l’âge autant que celui du statut, j’ai mené une autre étude : j’ai comparé les signatures de personnes occupant un emploi manuel – agents d’entretien, jardiniers, personnel technique de l’université – avec celles d’un groupe de professeurs et d’un groupe d’étudiants, toujours en égalisant le nombre de lettres et en utilisant cette fois des cartes vierges de 3 pouces sur 5 (7,6 cm sur 12,7 cm.). Le premier groupe prenait plus de place que les étudiants, mais moins que les enseignants. J’en ai conclu que l’âge jouait un rôle, mais aussi le statut social.

Quand j’ai raconté mes résultats au psychologue Karl Scheibe, mon professeur préféré, il m’a proposé de mesurer les signatures figurant dans ses propres livres – celles qu’il apposait depuis plus de dix ans, depuis sa première année d’université.

Comme on peut le voir sur le graphique, la taille de ses signatures a globalement augmenté au fil du temps. Elles ont connu un net bond entre sa troisième et sa dernière année d’études, ont légèrement diminué lorsqu’il est entré en doctorat, puis ont de nouveau grandi lorsqu’il a achevé sa thèse et rejoint le corps enseignant de Wesleyan.

J’ai ensuite mené plusieurs autres études et publié quelques articles, concluant que la taille de la signature était liée à l’estime de soi ainsi qu’à une mesure de ce que j’ai appelé la « conscience du statut ». J’ai constaté que ce schéma se vérifiait dans divers contextes, y compris en Iran, où l’écriture se lit pourtant de droite à gauche.

Le lien avec le narcissisme

Même si mes recherches ultérieures ont donné lieu à un livre sur les PDG des entreprises du classement Fortune 500, il ne m’était jamais venu à l’esprit d’étudier leurs signatures. Quarante ans plus tard, d’autres chercheurs y ont pensé. En mai 2013, j’ai reçu un appel de la rédaction du Harvard Business Review à propos de mes travaux sur la taille des signatures. Le magazine prévoyait de publier une interview de Nick Seybert, professeur associé de comptabilité à l’université du Maryland, sur le lien possible entre la taille des signatures et le narcissisme chez les PDG.

Seybert m’avait expliqué que ses recherches n’avaient pas permis d’établir de lien direct entre les deux, mais l’idée d’une possible corrélation qu’il avançait a tout de même éveillé ma curiosité. J’ai donc décidé de la tester auprès d’un échantillon de mes étudiants. Je leur ai demandé de signer une carte vierge comme s’ils rédigeaient un chèque, puis je leur ai fait passer un questionnaire de 16 questions couramment utilisé pour mesurer le narcissisme.

Et, surprise : Seybert avait raison de supposer un lien. Il existait bien une corrélation positive significative entre la taille de la signature et le narcissisme. Mon échantillon était certes modeste, mais ce résultat a incité Seybert à reproduire l’expérience auprès de deux autres groupes d’étudiants – et il a obtenu la même corrélation positive significative.

D’autres chercheurs ont rapidement commencé à utiliser la taille de la signature pour évaluer le narcissisme chez les PDG. En 2020, l’intérêt croissant pour le sujet a conduit le Journal of Management à publier un article qui recensait la taille de la signature parmi cinq indicateurs possibles du narcissisme chez les dirigeants d’entreprise.

Un champ de recherche en expansion

Aujourd’hui, près de six ans plus tard, les chercheurs utilisent la taille de la signature pour étudier le narcissisme chez les PDG et d’autres cadres dirigeants, comme les directeurs financiers. Ce lien a été observé non seulement aux États-Unis, mais aussi au Royaume-Uni, en Allemagne, en Uruguay, en Iran, en Afrique du Sud et en Chine.

Par ailleurs, certains chercheurs se sont penchés sur l’effet que produisent, sur les observateurs, des signatures plus grandes ou plus petites. Par exemple, dans un article récent du Journal of Philanthropy, des chercheurs canadiens ont rendu compte de trois expériences faisant varier systématiquement la taille de la signature d’une personne sollicitant des dons, afin d’évaluer si cela influençait le montant des contributions. Et c’était bien le cas : dans l’une de leurs études, ils ont montré qu’agrandir la signature de l’expéditeur générait plus du double de recettes.

Le retour inattendu des recherches utilisant la taille de la signature pour évaluer le narcissisme m’amène à plusieurs conclusions. D’abord, cette mesure de certains aspects de la personnalité s’avère bien plus solide que je ne l’aurais imaginé, lorsque je n’étais qu’un étudiant curieux travaillant dans une bibliothèque universitaire en 1967.

En réalité, la taille de la signature n’est pas seulement un indicateur de statut ou d’estime de soi, comme je l’avais conclu à l’époque. Elle constitue aussi, comme le suggèrent les études récentes, un signe de tendances narcissiques – du type de celles que nombre d’observateurs prêtent à la signature ample et spectaculaire de Donald Trump. Nul ne peut dire quelle direction prendra cette recherche à l’avenir – pas même celui qui, il y a tant d’années, avait simplement remarqué quelque chose d’intrigant dans la taille des signatures.

Richie Zweigenhaft ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

01.11.2025 à 10:03

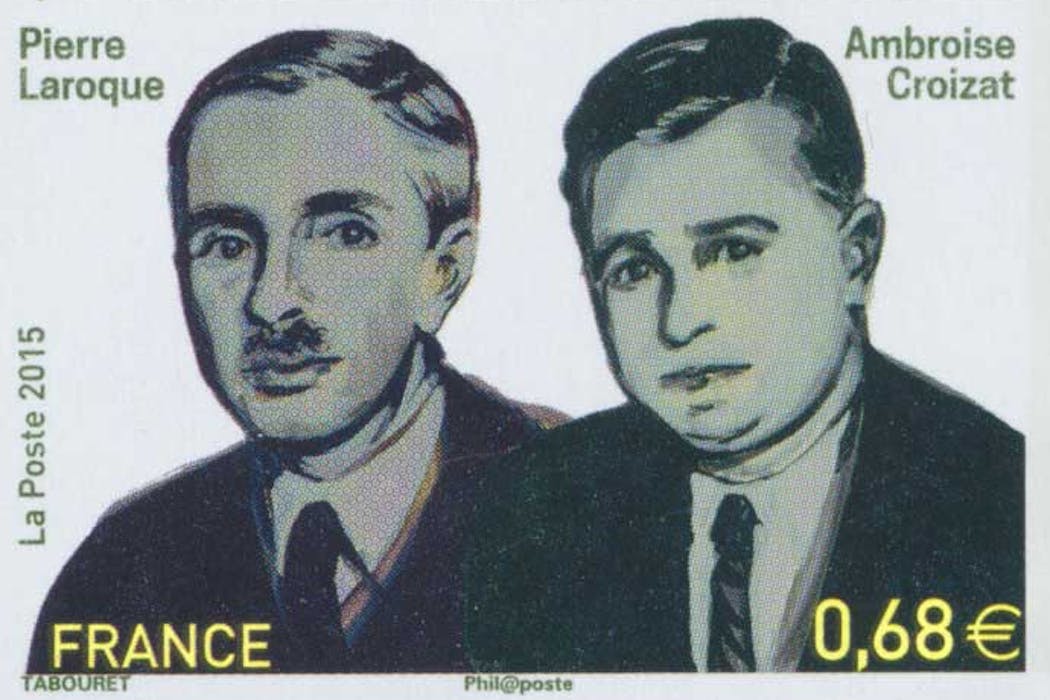

La grande histoire de la Sécurité sociale de 1945 à nos jours

Léo Rosell, Ater, Université Paris Dauphine – PSL

Texte intégral (2825 mots)

Créée en 1945, la Sécurité sociale répondait à un objectif ambitieux : mettre les Français à l’abri du besoin et instaurer un ordre social nouveau. Fruit d’un compromis entre l’État et le mouvement ouvrier, cette institution a profondément façonné la solidarité sociale en France. Retour sur l’histoire d’un système révolutionnaire, aujourd’hui confronté à des défis de gouvernance et de légitimité.

Cet article est publié en partenariat avec Mermoz, la revue du Cercle des économistes dont le dont le numéro 8 a pour thème « Notre modèle social, un chef-d’œuvre en péril »..

La Sécurité sociale fête ses quatre-vingts ans. Née en 1945, dans un pays où tout est à reconstruire, cette institution sociale affiche alors l’ambition de créer un « ordre social nouveau ». La Sécurité sociale vise à mettre l’ensemble de la population « à l’abri du besoin » et à la libérer de « la peur du lendemain ».

À la Libération, la solidarité en armes exprimée dans la Résistance devait, en quelque sorte, se transcrire dans une solidarité sociale. Cette idée caractérise le compromis institutionnel à l’origine de la Sécurité sociale, entre un État social émancipateur et un mouvement ouvrier puissant et organisé. Dans les décennies suivantes, la démocratie sociale originelle disparaît progressivement, d’abord au profit d’un paritarisme plus favorable au patronat, puis dans le sens d’une gouvernance reprise en main par l’État.

Une longue histoire

Commençons par rappeler que tout ne s’est pas créé en 1945. Le plan français de sécurité sociale est le fruit d’un processus qui s’inscrit dans le temps long, et l’on peut en faire remonter les origines philosophiques à la Révolution française, un moment important de « laïcisation de la charité religieuse » qui avait cours depuis le Moyen Âge et sous l’Ancien Régime. La Déclaration des droits de l’homme et du citoyen de 1793 pose ainsi pour la première fois le principe selon lequel « les secours publics sont une dette sacrée » de la nation. Après la chute des robespierristes, qui portaient cette aspiration, les expérimentations en matière de secours publics disparaissent.

Commence alors un XIXe siècle marqué par le refus de l’État d’intervenir directement dans les affaires économiques et sociales, mais aussi par le retour de la charité assistancielle. En parallèle, deux traditions se développent en matière de protection sociale : d’une part, une conception républicaine, qui revendique une solidarité nationale, et d’autre part, une tradition ouvrière, qui repose sur l’entraide collective au sein des caisses de secours mutuels et qui est attachée à une gestion par les travailleurs eux-mêmes. La fin du siècle est quant à elle marquée par le développement d’une philosophie, le solidarisme, inspirée de l’œuvre de Léon Bourgeois. Ce courant de pensée postule que la société doit être organisée autour de la solidarité nationale. Il inspire la « nébuleuse réformatrice » à l’origine de l’État social, à travers les premières lois sur les accidents du travail en 1898, sur les retraites ouvrières et paysannes en 1910 ou encore sur les assurances sociales en 1928-1930.

Mais ces anciennes législations sont imparfaites, car elles ne couvrent que les salariés les plus pauvres, elles dispensent des prestations jugées insuffisantes et on y adhère selon le principe de la « liberté d’affiliation ». Cela signifie que le système compte une multiplicité de caisses, d’origine patronale, mutualiste, confessionnelle, syndicale ou départementale, dont l’efficacité est inégale. Compte tenu de ce bilan critique, le programme du Conseil national de la résistance (CNR), adopté dans la clandestinité le 15 mars 1944, entend réformer cette ancienne législation, à travers « un plan complet de sécurité sociale ». Le Gouvernement provisoire de la République française va donc s’y atteler, une fois le territoire national libéré.

Une réforme révolutionnaire