ACCÈS LIBRE Une Politique International Environnement Technologies Culture

29.10.2025 à 15:49

Avec les restrictions d’âge sur les réseaux sociaux, Internet entre-t-il dans une nouvelle ère de contrôle moral ?

Alex Beattie, Lecturer, Media and Communication, Te Herenga Waka — Victoria University of Wellington

Texte intégral (1593 mots)

De l’Australie au Danemark, les projets d’interdire TikTok ou Instagram aux adolescents se multiplient. Derrière les arguments de protection des mineurs, ces restrictions d’âge sur les réseaux sociaux traduisent un tournant culturel et moral.

Une vague de projets d’interdictions des réseaux sociaux aux plus jeunes déferle à travers le monde, nourrie par l’inquiétude croissante face aux effets supposés de TikTok, Instagram ou Snapchat sur des esprits jugés vulnérables.

L’Australie a été la première à annoncer des restrictions visant les moins de 16 ans. La Nouvelle-Zélande pourrait bientôt emboîter le pas et au Danemark, la première ministre a déclaré vouloir interdire les réseaux sociaux aux moins de 15 ans, accusant téléphones et plateformes de « voler l’enfance de nos enfants ».

Le Royaume-Uni, la France (le rapport parlementaire, publié en septembre 2025, préconise d’interdire les réseaux sociaux aux moins de 15 ans ainsi qu’un couvre-feu numérique pour les 15-18 ans, de 22 heures à 8 heures, ndlt), la Norvège, mais aussi le Pakistan et les États-Unis envisagent ou mettent en place des mesures similaires, souvent conditionnées à un consentement parental ou à une vérification d’identité numérique.

À première vue, ces politiques visent à protéger la jeunesse des risques, pour la santé mentale, d’exposition à des contenus explicites ou de ceux de mécanismes addictifs. Mais derrière le vocabulaire de la sécurité se dessine autre chose : un basculement des valeurs culturelles.

Ces interdictions traduisent une inflexion morale, au risque de ressusciter des conceptions conservatrices qui précèdent Internet. Sommes-nous en train d’entrer dans une nouvelle ère victorienne du numérique, où la vie en ligne des jeunes serait remodelée non seulement par la régulation, mais aussi par un regain de contrôle moral ?

Un discours sur le déclin moral

L’époque victorienne se caractérisait par des codes sociaux rigides, une morale stricte et un contrôle serré des comportements, l’école jouant un rôle central dans la transmission des hiérarchies sociales et genrées. On en retrouve aujourd’hui des échos dans le discours sur le « bien-être numérique ». Applications de suivi du temps d’écran, cures de « détox digitale » ou téléphones simplifiés sont présentés comme des moyens de cultiver une vie connectée « saine » – souvent sur fond de morale implicite. L’utilisateur idéal est calme, concentré, mesuré ; l’utilisateur impulsif ou expressif est pathologisé.

Cette vision est notamment popularisée par le psychologue Jonathan Haidt, auteur de The Anxious Generation (2024), devenu une référence du mouvement en faveur des restrictions d’âge. Selon lui, les réseaux sociaux accentuent les comportements performatifs et la dysrégulation émotionnelle chez les jeunes. La vie numérique des adolescents est ainsi décrite comme un terrain de fragilisation psychologique, de polarisation accrue et d’effritement des valeurs civiques communes.

Vu sous cet angle, la vie numérique des jeunes se traduit par une résilience psychologique en déclin, par une polarisation croissante et par l’érosion des valeurs civiques communes, plutôt que par un symptôme de mutations complexes. Cela a contribué à populariser l’idée que les réseaux sociaux ne sont pas seulement nocifs mais corrupteurs.

Mais ces thèses font débat. De nombreux chercheurs soulignent qu’elles reposent sur des corrélations fragiles et sur des interprétations sélectives. Certaines études établissent un lien entre usage intensif des réseaux sociaux et troubles anxieux ou dépressifs, mais d’autres montrent des effets modestes, variables selon les contextes, les plateformes et les individus. Surtout, ces analyses négligent la marge de manœuvre des jeunes eux-mêmes, leur capacité à naviguer dans les espaces numériques de façon créative, critique et sociale.

En réalité, la vie numérique des jeunes ne se résume pas à une consommation passive. C’est un espace de littératie, d’expression et de connexion. Des plateformes, comme TikTok et YouTube, ont favorisé une véritable renaissance de la communication orale et visuelle.

Les jeunes assemblent des mèmes, remixent des vidéos et pratiquent un montage effréné pour inventer de nouvelles formes de récit. Il ne s’agit pas de signes de déclin, mais de narrations en évolution. Réglementer leur accès sans reconnaître ces compétences, c’est risquer d’étouffer la nouveauté au profit du déjà-connu.

Réguler les plateformes, pas les jeunes

C’est ici que la comparaison avec l’ère victorienne a toute son utilité. De la même façon que les normes victoriennes visaient à maintenir un ordre social particulier, les restrictions d’âge actuelles risquent d’imposer une vision étroite de ce que devrait être la vie numérique.

En apparence, des termes comme celui de « brain rot » (pourrissement du cerveau) semblent désigner les effets nocifs d’un usage excessif d’Internet. Mais en pratique, les adolescents les emploient souvent pour en rire et pour résister aux pressions de la culture de la performance permanente.

Les inquiétudes autour des habitudes numériques des jeunes semblent surtout enracinées dans la peur d’une différence cognitive – l’idée que certains usagers seraient trop impulsifs, trop irrationnels, trop déviants. Les jeunes sont fréquemment décrits comme incapables de communiquer correctement, se cachant derrière leurs écrans et évitant les appels téléphoniques. Pourtant, ces changements reflètent des mutations plus larges dans notre rapport à la technologie. L’attente d’une disponibilité et d’une réactivité constantes nous attache à nos appareils d’une manière qui rend la déconnexion véritablement difficile.

Les restrictions d’âge peuvent atténuer certains symptômes, mais elles ne s’attaquent pas au problème de fond : la conception même des plateformes, construites pour nous faire défiler, partager et générer toujours plus de données.

Si la société et les gouvernements veulent vraiment protéger les jeunes, la meilleure stratégie serait sans doute de réguler les plateformes numériques elles-mêmes. Le juriste Eric Goldman qualifie l’approche fondée sur les restrictions d’âge de « stratégie de ségrégation et de répression » – une politique qui punit la jeunesse plutôt que de responsabiliser les plateformes.

On n’interdit pas aux enfants d’aller dans les aires de jeux, mais on attend de ces espaces qu’ils soient sûrs. Où sont les barrières de sécurité pour les espaces numériques ? Où est le devoir de vigilance des plateformes ?

La popularité croissante des interdictions de réseaux sociaux traduit un retour en force de valeurs conservatrices dans nos vies numériques. Mais la protection ne doit pas se faire au prix de l’autonomie, de la créativité ou de l’expression.

Pour beaucoup, Internet est devenu un champ de bataille moral, où s’affrontent des conceptions opposées de l’attention, de la communication et de l’identité. Mais c’est aussi une infrastructure sociale que les jeunes façonnent déjà par de nouvelles formes de narration et d’expression. Les en protéger reviendrait à étouffer les compétences et les voix mêmes qui pourraient nous aider à construire un futur numérique plus riche et plus sûr.

Alex Beattie reçoit des financements de la Royal Society Te Apārangi. Il est lauréat d’une bourse Marsden Fast Start.

29.10.2025 à 15:35

Océans : les poissons, un puits de carbone invisible menacé par la pêche et le changement climatique

Gaël Mariani, Docteur en écologie marine, World Maritime University

Anaëlle Durfort, Doctorante en écologie marine, Université de Montpellier

David Mouillot, Professeur en écologie, laboratoire MARBEC, Université de Montpellier

Jérôme Guiet, Researcher in marine ecosystem modeling, University of California, Los Angeles

Texte intégral (3275 mots)

Les océans jouent un rôle majeur dans le stockage du carbone, notamment à travers la biomasse qu’ils abritent. Le cycle de vie des poissons contribue ainsi à piéger durablement le CO2 dans les abysses, mais la pêche industrielle a affaibli ce mécanisme essentiel, également menacé par le changement climatique. Restaurer les populations marines en haute mer pourrait renforcer ce puits de carbone naturel tout en limitant les conflits avec la sécurité alimentaire.

Lorsqu’on parle des puits de carbone naturels, ces systèmes naturels qui piègent plus de carbone qu’ils n’en émettent, on pense plus volontiers aux forêts et aux sols qu’aux océans. Pourtant, les océans représentent le second puits de carbone naturel.

L’impact des activités humaines (et en particulier la pêche) sur le stockage de carbone océanique n’avait été jusque-là que peu étudié, et cela alors que la macrofaune marine (notamment les poissons) représente environ un tiers du carbone organique stocké par les océans. Nos recherches, récemment publiées dans les revues Nature Communications et One Earth, ont voulu y remédier.

Nos résultats montrent que la pêche a d’ores et déjà réduit la séquestration de carbone par les poissons de près de moitié depuis 1950. D’ici la fin du siècle, cette baisse devrait atteindre 56 % sous l’effet combiné de la pêche et du changement climatique. De quoi plaider pour une gestion plus durable de l’océan, qui prendrait en compte l’impact de la pêche sur la séquestration de carbone.

Pourquoi s’intéresser à la séquestration de carbone dans les océans ?

Le Groupe d’experts intergouvernemental sur l’évolution du climat (Giec) le dit explicitement dans ses rapports : pour atteindre les objectifs climatiques, il faut d’abord réduire drastiquement et immédiatement nos émissions de gaz à effet de serre (chaque année, les activités humaines émettent environ 40 milliards de tonnes équivalent CO₂), puis développer les solutions climatiques fondées sur la nature.

Celles-ci intègrent l’ensemble des mesures de restauration, de protection et de meilleure gestion des écosystèmes qui piègent du carbone, comme les forêts. Ces mesures pourraient capturer 10 milliards de tonnes équivalent CO₂ par an, et doivent être mises en œuvre de façon complémentaire à des politiques de réduction des émissions.

Cependant, le carbone stocké par ces écosystèmes est de plus en plus menacé par le changement climatique. Par exemple, les feux de forêt au Canada ont émis 2,5 milliards de tonnes équivalent CO₂ en 2023 : la forêt n’est alors plus un puits de carbone, mais devient une source d’émissions.

À lire aussi : Comment une forêt peut-elle émettre plus de CO₂ qu’elle n’en capture ?

Face à ce constat, la communauté scientifique se tourne aujourd’hui vers les océans, à la recherche de nouvelles solutions qui permettraient d’y séquestrer davantage de carbone.

Mais, pour que cela soit possible, il faut d’abord comprendre comment la vie abritée par les océans interagit avec le cycle du carbone ainsi que l’influence du changement climatique, d’une part, et de la pêche, d’autre part.

Quel est le rôle joué par les poissons dans ce processus ?

La vaste majorité des 38 000 milliards de tonne de carbone stocké par l’océan l’est à travers des phénomènes physiques. Mais la biomasse des océans y contribue également, à hauteur d’environ 1 300 milliards de tonnes de carbone organique. Les poissons représentent environ 30 % de ce stock de carbone.

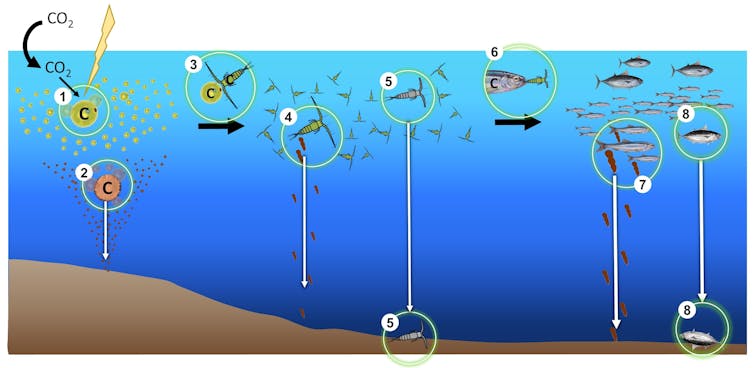

Ceci est rendu possible via leur contribution à ce qu’on appelle la pompe biologique du carbone, c’est-à-dire, la série de processus biologiques qui permettent de transporter le carbone des eaux de surface vers les fonds marins. C’est un élément majeur du cycle du carbone.

Cette pompe biologique commence par le phytoplancton, capable de transformer du CO2 en matière organique carbonée. À sa mort, une partie de ce carbone va couler dans les profondeurs de l’océan où il sera séquestré durablement, tandis que le reste sera ingéré par des prédateurs. À nouveau, c’est lorsque ce carbone va couler dans les profondeurs (pelotes fécales, carcasses des prédateurs morts…) qu’il sera durablement séquestré.

Les poissons jouent un rôle clé dans ce processus : leurs carcasses et pelotes fécales, plus denses, coulent bien plus rapidement que celles du plancton. Or, plus le carbone coule rapidement vers les profondeurs – et s’éloigne de l’atmosphère –, plus le temps qu’il mettra avant de retourner à l’atmosphère sera important : le carbone sera ainsi stocké de façon plus durable.

Notre étude, qui s’est spécifiquement intéressée aux espèces de poissons d’intérêt commercial (c’est-à-dire ciblées par la pêche), estime que ces derniers étaient en mesure de séquestrer 0,23 milliard de tonnes de carbone par an en 1950 (soit 0,85 tonne de CO2 par an).

À lire aussi : Éliminer le CO₂ grâce au puits de carbone océanique, une bonne idée ?

Un cercle vicieux du fait du changement climatique

Mais depuis 1950, les choses ont changé. D’abord du fait du changement climatique : à cause de la raréfaction des ressources alimentaires (moins de phytoplancton) et des changements de conditions environnementales (température, oxygène…), plus le changement climatique sera fort, plus la biomasse des espèces d’intérêt commercial – et par extension, leur capacité à piéger du carbone – vont diminuer.

Dans un scénario où l’augmentation moyenne des températures serait limitée à 1,5 °C (scénario de respect de l’accord de Paris), la biomasse baisserait d’environ 9 % d’ici la fin du siècle, soit une diminution de piégeage de carbone d’environ 4 %.

Dans le cas d’un scénario de statu quo où les températures augmenteraient de 4,3 °C, cette baisse atteindrait environ 24 % pour la biomasse, et près de 14 % pour le piégeage de carbone.

Nous avons donc à faire à ce que l’on appelle une boucle de rétroaction positive – autrement dit, un cercle vicieux : plus le changement climatique est important, moins les poissons séquestreront de carbone, ce qui va renforcer le changement climatique lui-même. C’est le serpent qui se mord la queue.

Une séquestration carbone déjà réduite de moitié par la pêche

L’impact du changement climatique dans le scénario d’un réchauffement à 1,5 °C (que nous sommes en passe de dépasser) reste donc faible, mais les effets de la pêche, eux, sont déjà visibles.

Aujourd’hui, les espèces de poissons commerciales ne piègent déjà plus que 0,12 milliard de tonnes de CO2 par an (contre 0,23 milliard de tonnes de carbone par an en 1950), soit une diminution de près de moitié.

D’autant plus que les effets de la pêche ne sont pas les mêmes selon la voie de séquestration considérée. Depuis 1950, la pêche a réduit la séquestration de carbone via les pelotes fécales d’environ 47 %. Pour la voie passant par les carcasses, cette diminution est d’environ 63 %.

Ceci est lié au fait que la pêche cible les plus gros organismes, soit ceux qui ont le moins de prédateurs – et donc ceux le plus susceptibles de mourir de vieillesse et de voir leur carcasse couler dans les abysses.

Cette diminution est aussi synonyme d’une réduction de l’arrivée de nourriture dans les abysses, les carcasses étant une ressource particulièrement nutritive pour les organismes qui y vivent.

Or, nous connaissons très peu de choses sur ces écosystèmes abyssaux, avec des millions d’espèces qui restent à découvrir. Nous n’avons pour l’instant observé que 0,001 % de la surface totale de ces écosystèmes. Nous sommes donc peut-être en train d’affamer une multitude d’organismes abyssaux que nous connaissons à peine.

Pour préserver le climat, restaurer les populations de poissons ?

Notre étude montre que si les populations de poissons étaient restaurées à leur niveau historique de 1950, cela permettrait de séquestrer 0,4 milliard de tonnes de CO2 supplémentaires par an, soit un potentiel comparable à celui des mangroves. Avec un atout : ce carbone serait séquestré pour environ six cents ans, soit plus longtemps que dans les mangroves, où seuls 9 % du carbone piégé l’est encore après cent ans.

Cependant, malgré ce potentiel notable, les solutions climatiques basées sur la restauration de la macrofaune marine, si elles étaient mises en œuvre seules, n’auraient qu’un impact mineur sur le climat, au regard des 40 milliards de tonnes de CO₂ émis chaque année.

D’autant plus que, ce domaine de recherche étant récent, plusieurs incertitudes subsistent. Par exemple, nos études ne tiennent pas compte des relations trophiques (c’est-à-dire, liées à la chaîne alimentaire) entre les prédateurs et leurs proies, lesquelles contribuent aussi à la séquestration de carbone. Or, si on augmente la biomasse des prédateurs, la biomasse des proies va mécaniquement diminuer. Ainsi, si la séquestration de carbone par les prédateurs augmente, celle des proies diminue, ce qui peut neutraliser l'impact des mesures visant à restaurer les populations de poissons pour séquestrer du carbone.

Ainsi, nos résultats ne doivent pas être vus comme une preuve suffisante pour considérer de telles mesures comme une solution viable. Ils illustrent néanmoins l’importance d’étudier l’impact de la pêche sur la séquestration de carbone et la nécessité de protéger l’océan pour limiter les risques d’épuisement de ce puits de carbone, tout en tenant compte des services rendus par l’océan à nos sociétés (sécurité alimentaire, emplois…).

Des conflits entre pêche et séquestration de carbone surtout en haute mer

En effet, les organismes marins participent directement à la séquestration de carbone, tout en bénéficiant aussi au secteur de la pêche. Or, ce secteur est une source d’emplois et de revenus économiques majeurs pour les populations côtières, contribuant directement au maintien et à l’atteinte de la sécurité alimentaire dans certaines régions.

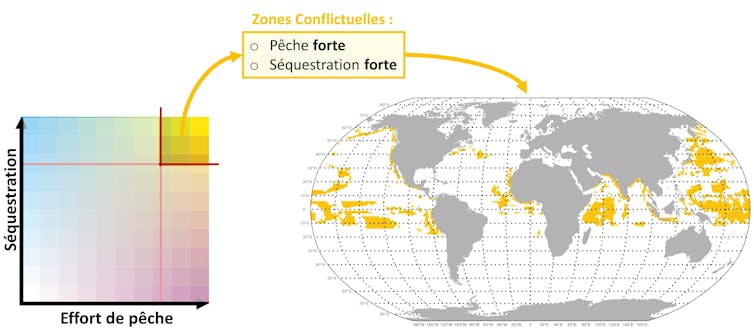

Des conflits entre la séquestration de carbone et les bénéfices socio-économiques de la pêche peuvent donc théoriquement apparaître. Si la pêche augmente, les populations de poissons et leur capacité à séquestrer du carbone vont diminuer, et inversement.

Toutefois, nous avons montré que seulement 11 % de la surface de l’océan est potentiellement exposée à de tels conflits. Il s’agit des zones où l’effort de pêche et la séquestration de carbone sont tous deux élevés.

De plus, une majorité (environ 60 %) de ces zones potentiellement conflictuelles sont situées en haute mer, là où les captures contribuent de façon négligeable à la sécurité alimentaire globale. Aussi, la pêche en haute mer est connue pour sa faible rentabilité et son subventionnement massif par les gouvernements (à hauteur de 1,5 milliard de dollars, soit plus de 1,2 milliard d’euros, en 2018).

Ces subventions gouvernementales sont vivement critiquées, car elles menacent la viabilité des pêcheries côtières artisanales, favorisent la consommation de carburant et augmentent les inégalités entre les pays à faibles et hauts revenus.

Ainsi, nos résultats apportent un argument supplémentaire en faveur de la protection de la haute mer. En plus d’éviter de multiples effets socio-économiques négatifs, cela permettrait également de protéger la biodiversité et, par la même occasion, de préserver la capacité des océans à séquestrer du carbone organique.

Le financement a été assuré par la bourse de doctorat de l'Université de Montpellier à G.M. et la bourse de la Fondation de la Mer. de Montpellier à G.M. Le travail de G.M. a été partiellement financé par l'Union européenne dans le cadre de l'accord de subvention n°101083922 (OceanICU). Les points de vue et les opinions exprimés sont ceux des auteurs et ne reflètent pas nécessairement ceux de l'Union européenne ou de l'Agence exécutive pour la recherche européenne. L'Union européenne et l'autorité qui a octroyé la subvention ne peuvent en être tenues pour responsables.

Anaëlle Durfort a participé à ce travail dans le cadre de son doctorat, financé par une bourse de thèse (publique) à l'université de Montpellier.

David Mouillot et Jérôme Guiet ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur poste universitaire.

29.10.2025 à 15:34

Redirection du commerce chinois vers l’Europe : petits colis, grand détour

Charlotte Emlinger, Économiste, CEPII

Kevin Lefebvre, Économiste, CEPII

Vincent Vicard, Économiste, adjoint au directeur, CEPII

Texte intégral (1389 mots)

À la suite des droits de douane mis en place par Donald Trump, on observe une réorientation significative du commerce chinois des États-Unis vers l’Union européenne à travers les… petits colis. Explication en chiffres et en graphiques.

La hausse spectaculaire des droits de douane imposée par les États-Unis aux importations en provenance de Chine (57,6 % fin août, après un pic à 135,3 % en avril d’après les calculs du Peterson Institute for International Economics) ferme largement le marché états-unien aux exportateurs chinois. La chute massive des exportations chinoises vers les États-Unis qui s’en est suivie, en recul de près de 25 % sur la période juin-août 2025 par rapport aux mêmes mois de 2024, témoigne de l’ampleur du choc.

Le risque est que, confrontés à la fermeture de l’un de leurs deux principaux marchés, les exportateurs chinois cherchent à réorienter leurs exportations, laissant planer le doute d’une redirection massive vers l’Union européenne (UE). Dans cette perspective, la Commission européenne a mis en place une surveillance du détournement des flux commerciaux pour identifier les produits faisant l’objet d’une hausse rapide des quantités importées et d’une baisse de prix, toutes origines confondues.

Dynamiques saisonnières

Le premier graphique montre que, depuis février, la baisse des exportations chinoises s’est accompagnée d’une hausse de celles vers l’Union européenne. Une analyse des évolutions passées révèle toutefois que la hausse observée au deuxième trimestre 2025 correspond en partie à un rebond saisonnier observé à la même époque les années précédentes et lié au Nouvel An chinois, que cela soit pour l’Union européenne, les États-Unis, le Vietnam, le Japon ou la Corée du Sud. Il est essentiel d’interpréter les évolutions récentes au regard des dynamiques saisonnières des années antérieures.

Observer une hausse des importations ne suffit pas à conclure à une redirection du commerce chinois des États-Unis vers l’Union européenne (UE).

Pour qu’un tel phénomène soit avéré, il faut que les mêmes produits soient simultanément concernés par une hausse des volumes d’exportations de la Chine vers l’UE et une baisse vers les États-Unis. Par exemple, une hausse des exportations de véhicules électriques chinois vers l’UE ne peut pas être considérée comme une réorientation du commerce puisque ces produits n’étaient pas exportés auparavant vers les États-Unis.

De la même manière, les produits faisant l’objet d’exceptions dans les droits mis en place par Donald Trump, comme certains produits électroniques, certains combustibles minéraux ou certains produits chimiques, ne sont pas susceptibles d’être réorientés. Cela ne signifie pas qu’une augmentation des flux d’importations de ces produits ne soulève pas des enjeux de compétitivité et de concurrence pour les acteurs français ou européens. Mais ces enjeux sont d’une autre nature que ceux liés à une pure redirection du commerce chinois consécutive à la fermeture du marché des États-Unis.

Deux critères complémentaires

Pour identifier les produits pour lesquels la fermeture du marché états-unien a entraîné une redirection du commerce chinois vers l’Union européenne (UE), nous combinons deux critères :

Si, d’une année sur l’autre, le volume des exportations d’un produit vers l’UE augmente plus vite que celui des trois quarts des autres produits chinois exportés vers l’UE en 2024.

Si, d’une année sur l’autre, le volume des exportations d’un produit vers les États-Unis diminue plus vite que celui des trois quarts des autres produits chinois exportés vers les États-Unis en 2024.

Seuls les produits pour lesquels les exportations chinoises vers les États-Unis étaient suffisamment importantes avant la fermeture du marché états-unien sont retenus. Soit les 2 499 produits pour lesquels la part des États-Unis dans les exportations chinoises dépassait 5 % en 2024. Pour 402 de ces produits, le volume des exportations chinoises a enregistré une forte baisse entre juin-août 2024 et juin-août 2025.

Près de 176 produits concernés

En combinant les deux critères, 176 produits sont concernés en juin-août 2025 (graphique 2), soit 44 % des produits dont les ventes ont nettement chuté sur le marché états-unien. Parmi eux, 105 concernent des produits pour lesquels l’Union européenne a un avantage comparatif révélé, c’est-à-dire pour lesquels la hausse des importations se fait sur une spécialisation européenne.

Moins de la moitié des 176 produits connaît simultanément une forte baisse de leur prix, suggérant qu’une partie de la redirection du commerce chinois entraîne une concurrence par les prix sur le marché européen.

En valeur, les 176 produits identifiés représentent 7,2 % des exportations chinoises vers l’Union européenne sur la dernière période disponible, et la tendance est clairement à la hausse (graphique 3). Cette progression s’explique pour beaucoup par la hausse des flux de petits colis redirigés vers l’UE depuis qu’en avril 2025, les États-Unis ont supprimé l’exemption de droits de douane sur les colis en provenance de Chine.

Secteurs des machines, chimie et métaux

Les produits sujets à redirection vers le marché européen sont très inégalement répartis entre secteurs (graphique 4). En nombre, on les retrouve concentrés dans les secteurs des machines et appareils (42 produits), de la chimie (31) et des métaux (22). En valeur cependant, les secteurs les plus concernés sont de très loin les petits colis (qui représentent 5,4 % du commerce bilatéral en juin-août 2025) et, dans une moindre mesure, les équipements de transport, les huiles et machines et appareils.

En comparaison, le Japon subit davantage la réorientation du commerce chinois puisque 298 produits sont identifiés en juin-août 2025 (graphique 5). Ces produits représentent une part beaucoup plus importante des exportations chinoises vers le Japon (16,2 % en juin-août 2025). Des dynamiques similaires sont observées en Corée du Sud (196 produits, représentant 2,7 % de son commerce bilatéral avec la Chine) et le Vietnam (230 produits, 6,5 % de son commerce bilatéral avec la Chine).

Fin du régime douanier simplifié

Consciente de la menace qu’ils représentent, la Commission européenne prévoit, dans le cadre de la prochaine réforme du Code des douanes, de mettre fin au régime douanier simplifié dont ces petits colis bénéficient actuellement. Cette réforme ne devrait pas entrer en vigueur avant 2027. D’ici là, certains États membres tentent d’aller plus vite.

En France, le gouvernement a récemment proposé, dans le cadre de son projet de loi de finance, d’instaurer une taxe forfaitaire par colis. Mais, sans coordination européenne, la mesure risque d’être contournée : les colis pourraient simplement transiter par un pays de l’UE à la taxation plus clémente.

Au-delà des petits colis, un certain nombre d’autres produits sont également soumis à des hausses rapides des quantités importées, susceptibles de fragiliser les producteurs européens, mais ils représentent une part limitée des importations européennes en provenance de Chine. Des tendances qui devront être confirmées dans les prochains mois par un suivi régulier.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

29.10.2025 à 15:33

Cancer du sein : l’allaitement maternel diminue le risque

Isabelle Romieu, Professeur d’épidémiologie, National Institute of Public Health of Mexico

Texte intégral (2326 mots)

Le cancer du sein demeure la première cause de mortalité par cancer chez les femmes. Outre le dépistage, la lutte contre la maladie passe également par la prise en compte des facteurs de risque modifiables sur lesquels il est possible d’agir. Si l’alcool, le tabac, le surpoids ou la sédentarité sont fréquemment mentionnés, on sait peut-être moins que le fait de ne pas avoir allaité en constitue aussi un.

En 2025, « Octobre rose » a fêté son 32ᵉ anniversaire. Chaque année, cette campagne mondiale de communication vise un double objectif : sensibiliser au dépistage du cancer du sein et récolter des fonds pour la recherche.

Cet événement, symbolisé par le ruban rose, est plus que jamais d’actualité. En effet, en France, le cancer du sein continue malheureusement à progresser. Il représente aujourd’hui à lui seul le tiers de l’ensemble des nouveaux cas de cancer chez la femme.

Si la survie des patients s’est améliorée, grâce à une détection plus précoce et à la mise au point de traitements plus efficaces, chaque année, plusieurs milliers d’entre elles décèdent encore de la maladie. Dans un tel contexte, la connaissance des facteurs de risque et, en particulier, de ceux sur lesquels il est possible d’agir, est extrêmement importante.

On sait aujourd’hui que la consommation d’alcool, le surpoids et l’obésité ou encore la sédentarité accroissent le risque de développer la maladie. Mais un autre facteur de risque est peut-être moins connu du public : le fait de ne pas avoir allaité au cours de sa vie. L’allaitement confère, en effet, un certain niveau de protection contre le cancer du sein.

Les scientifiques ont commencé à élucider les mécanismes qui en sont à l’origine. Voici ce qu’il faut en savoir.

Le cancer du sein, une incidence élevée en France

En France, le nombre de nouveaux cas de cancer du sein diagnostiqués chaque année a progressé de 0,3 % par an entre 2010 et 2023.

En 2023, 61 214 femmes se sont vues annoncer le triste diagnostic, tandis que 12 600 ont été emportées par la maladie. L’incidence de la maladie est particulièrement élevée dans notre pays, où l’on compte 99,2 cas pour 100 000 femmes. Selon les dernières données de Globocan (Global Cancer Observatory/Organisation mondiale de la santé), la France se situe en quatrième position en Europe derrière la Belgique, les Pays-Bas et le Luxembourg, et devant le Royaume-Uni, l’Italie, l’Allemagne et l’Espagne.

Point positif : entre 2011 et 2021, la mortalité due au cancer du sein a reculé de 1,3 % par an. Bien que la survie des patientes ait progressé au fil des ans, grâce à une détection plus précoce et à la mise au point de traitements plus efficaces, le cancer du sein reste le cancer féminin le plus fréquent ainsi que la première cause de mortalité par cancer chez la femme.

Le cancer du sein est néanmoins un cancer de bon pronostic. Entre 2005 et 2010, la survie nette à cinq ans était de 88 % (et de 76 % à dix ans). Afin de détecter précocement la maladie et d’en réduire la mortalité, un programme national de dépistage est organisé depuis 2004.

Comment est dépisté le cancer du sein en France ?

- À partir de l’âge de 50 ans et tous les deux ans (en l’absence de symptômes et de risque élevé), un courrier de l’Assurance maladie est adressé à chaque femme éligible l’invitant à réaliser un dépistage du cancer du sein.

- Le dépistage consiste en un examen clinique des seins (examen réalisé directement sur la patiente) et d’une mammographie (examen radiologique). Dans certaines situations, une échographie des seins est également nécessaire pour compléter la mammographie.

- À partir de l’âge de 25 ans, un examen clinique (observation et palpation) des seins est recommandé au moins une fois par an, quel que soit votre niveau de risque. Il peut être réalisé par un médecin généraliste, un gynécologue ou une sage-femme.

Dans ce cadre, toutes les femmes âgées de 50 ans à 74 ans se voient proposer un dépistage pris en charge à 100 %, tous les deux ans. Cependant, en 2023, seuls 48,2 % des femmes éligibles à ce programme avaient été dépistées. Seuls 60 % des cancers du sein étaient détectés à un stade précoce.

En parallèle du dépistage, il est donc également important d’agir sur les facteurs de risque de cancer du sein susceptible d’être modifiés. Selon le Centre international de recherche sur le cancer (CIRC), 37 % de l’ensemble des nouveaux cas de cancers seraient attribuables à des facteurs de risque modifiables, qu’ils soient comportementaux ou environnementaux. Parmi ceux-ci figurent non seulement la consommation d’alcool, le surpoids et l’obésité, la sédentarité ou le fait de fumer, mais aussi, dans le cas du cancer du sein, le fait de ne pas avoir allaité.

Effet protecteur de l’allaitement

L’effet protecteur de l’allaitement augmente avec la durée cumulée de l’allaitement, qui correspond à la durée d’allaitement d’une femme pour tous ses enfants.

Pour chaque douze mois cumulés d’allaitement, la réduction du risque de cancer du sein est estimée à 4,3 %. Cet effet protecteur s’ajoute à la protection associée à la parité (c’est-à-dire la réduction du risque de cancer du sein directement liée au fait d’avoir eu un enfant).

Dans ce contexte, une femme qui a deux enfants et qui nourrit chaque enfant au sein pendant douze mois aura une diminution de risque de cancer du sein de 8,6 %. Une femme qui a eu trois enfants et les a allaités chacun pendant cinq mois, soit un l’allaitement total de quinze mois, verra le risque de développer un cancer du sein diminuer de 6 %.

Recommandations sur l’allaitement

- L’Organisation mondiale de la santé (OMS) recommande l’allaitement exclusif pendant six mois et sa poursuite jusqu’à l’âge de 2 ans

- En France, le Programme national nutrition santé (PNNS) recommande, pour sa part, l’allaitement maternel des nourrissons jusqu’à l’âge de 6 mois si possible, pour que ces derniers en tirent un bénéfice santé.

En France, les données de l’Agence nationale de santé publique montre que le taux d’allaitement diminue avec le temps. Si, en 2021, le taux d’initiation à l’allaitement maternel était de 77 %, à l’âge de 2 mois seuls 54,2 % des enfants étaient encore allaités. À 6 mois, cette proportion tombe à 34 % des enfants encore allaités (dont 29 % tout en ayant commencé une diversification alimentaire). À 12 mois, seuls 18 % des enfants étaient encore allaités.

Cette situation contraste avec certains pays d’Europe, où le taux d’allaitement est nettement plus élevé. Ainsi, en Norvège, 98 % des enfants sont allaités à la naissance, 71 % des enfants sont encore allaités à l’âge de 6 mois et 35 % à 12 mois. En Suisse, 95 % des enfants sont allaités à la naissance, 52 % des enfants sont encore allaités à 6 mois et 20 % à 12 mois.

Comment l’allaitement peut-il diminuer le risque de cancer du sein ?

Divers travaux de recherche ont tenté d’éclaircir les mécanismes de protection. En l’état actuel des connaissances, il semblerait que l’allaitement joue un rôle protecteur contre le cancer du sein de plusieurs façons.

Lors de l’allaitement, la structure du sein se modifie, ce qui augmente la différenciation de l’épithélium mammaire et rend les cellules moins sensibles à la transformation maligne. Par ailleurs, l’allaitement retarde la reprise des cycles ovulaires après la grossesse et réduit le taux d’œstrogènes dans le sein, ce qui se traduit par une plus faible exposition du tissu mammaire aux hormones. Or, les hormones jouent un rôle important dans le risque de cancer du sein, car elles modulent la structure et la croissance des cellules épithéliales tumorales.

Enfin, au cours de la lactation, on constate une exfoliation plus importante du tissu mammaire (décrochage de cellules), ce qui pourrait entraîner une élimination de cellules du tissu canalaire mammaire potentiellement porteuses de lésions de l’ADN risquant de dégénérer en cancer.

Soulignons que le fait de tirer son lait confère également un certain niveau de protection, similaire à l’allaitement direct.

De multiples bénéfices pour la mère et l’enfant

Au-delà de la diminution du risque de cancer du sein, l’allaitement maternel présente également d’autres avantages majeurs pour la mère et l’enfant.

Pour la mère, l’allaitement maternel permettra de retrouver le poids d’avant la grossesse et de réduire la prise de poids à long terme. Les femmes d’âge moyen qui ont allaité sont moins susceptibles d’être en surpoids ou obèses.

Pour l’enfant, le lait maternel est le meilleur aliment pendant les six premiers mois de la vie. Il protège contre maladies infectieuses dès le plus jeune âge, principalement la diarrhée et les infections des voies respiratoires inférieures. Cette protection est due à la présence dans le lait maternel de plusieurs composés antimicrobiens, anti-inflammatoires et modulateurs de l’immunité ainsi que de modulateurs de croissance.

Enfin, des effets sur le développement cognitif de l’enfant ainsi que sur la croissance et la protection contre les maladies chroniques telles que l’asthme et l’obésité ont aussi été évoqués par certains travaux de recherche.

En cas de difficulté d’allaitement, que faire ?

De nombreuses mères rencontrent des difficultés d’allaitement, en général temporaires. Il s’agit principalement de crevasses, d’une perception de lait insuffisant, d’engorgements ou de douleurs.

Si ces difficultés persistent, un soutien professionnel adéquat peut être proposé. Il inclut la consultation d’une sage-femme ou d’une consultante en lactation, et peut être fourni par des maternités, des centres de protection maternelle et infantile (PMI), ou par l’intermédiaire d’associations comme l’Association française de consultants en lactation.

Dans certains cas, lorsque les difficultés pour allaiter persistent ou que des causes médicales sont impliquées, il est possible de recourir à des laits infantiles de qualité, sous la supervision d’un professionnel de santé, ou encore à des dons de lait maternel.

La protection conférée par l’allaitement est d’autant plus importante que les mois d’allaitement cumulés sont nombreux, mais soulignons que toute durée d’allaitement aura un effet protecteur.

Pour aller plus loin :

le guide de l’allaitement maternel de Santé publique France ;

les dossiers du réseau NACRe (réseau National alimentation cancer recherche) dédié au cancer du sein ;

Le site consacrée à Octobre rose, le mois de sensibilisation au dépistage du cancer du sein.

Isabelle Romieu a reçu des subventions de l’Institut national du cancer (INCA) et du « World cancer research fund » (WCRF) pour des travaux de recherche épidémiologique sur les facteurs de risques de cancer du sein.

29.10.2025 à 14:00

Le crime organisé est la première entreprise du Brésil et la menace la plus grave qui pèse sur le pays

Robert Muggah, Richard von Weizsäcker Fellow na Bosch Academy e Co-fundador, Instituto Igarapé

Texte intégral (1692 mots)

Le raid policier, mené le 28 octobre 2025, contre des narcotrafiquants dans les favelas de Rio de Janeiro est le plus meurtrier qu’ait connu la ville. Mais face à l’empire que le crime organisé a constitué au Brésil, les interventions spectaculaires ne suffisent plus : l’État doit inventer une réponse nationale.

Le 28 octobre, à Rio de Janeiro, des véhicules blindés de la police ont pénétré dans les complexes d’Alemão et de Penha pour interpeller des chefs de gangs. Des fusillades ont éclaté, des routes ont été bloquées, des bus ont été détournés, des écoles et des campus ont été fermés, et des drones ont largué des explosifs sur les forces de l’ordre. Le soir venu, l’État confirmait que « l’opération Contenção » s’était soldée par 124 morts, dont quatre policiers. Ce fut la confrontation la plus sanglante jamais enregistrée dans l’histoire de la ville.

L’économie criminelle du Brésil est sortie des ruelles pour investir désormais les salles de réunion, figurer dans les bilans financiers et s’infiltrer dans des chaînes d’approvisionnement essentielles. Au cours de la dernière décennie, le crime organisé brésilien s’est étendu à l’ensemble du pays et même à d’autres continents. Les plus grandes organisations de trafic de drogue, comme le Primeiro Comando da Capital (PCC) et le Comando Vermelho (CV), se trouvent au cœur de véritables réseaux franchisés. Les « milices » de Rio – groupes paramilitaires principalement composés de policiers et de pompiers ayant quitté leurs anciennes fonctions ou, pour certains, les exerçant toujours – monétisent le contrôle qu’elles exercent sur le territoire en se faisant payer pour des « services » de protection, de transport, de construction et autres services essentiels.

À mesure que ces groupes se sont professionnalisés, ils ont diversifié leurs activités, qui vont aujourd’hui du trafic de cocaïne à la contrebande d’or, aux paiements numériques et aux services publics. Lorsque les groupes armés du Brésil se disputent les marchés illicites, la violence peut atteindre des niveaux comparables à ceux de zones de guerre.

Rien n’illustre mieux le nouveau modèle économique que le commerce illégal de carburants. Comme je l’ai écrit dans The Conversation fin août, les autorités ont effectué environ 350 perquisitions dans huit États dans le cadre de l’opération Carbone Caché, qui visait à faire la lumière sur le blanchiment présumé de sommes colossales à travers des importations de dérivés du pétrole et un réseau de plus d’un millier de stations-service. Entre 2020 et 2024, environ 52 milliards de réaux (8,3 milliards d’euros) de flux suspects ont transité par des fintechs, dont l’une fonctionnait en tant que banque parallèle. Des fonds fermés auraient investi dans des usines d’éthanol, des flottes de camions et un terminal portuaire, donnant aux profits illicites un vernis de respectabilité.

Sur les marchés financiers, les investisseurs sont à présent conscients des dangers. Ces derniers mois, les fonds d’investissement ont enfin commencé à considérer l’infiltration criminelle comme un risque matériel, et les analystes cherchent plus qu’auparavant à déterminer quelles chaînes logistiques, quelles institutions de paiement et quels fournisseurs régionaux pourraient être exposés.

Gouvernance criminelle

Les équipes de sécurité des entreprises cartographient l’extorsion et le contrôle des milices avec la même attention que celle qu’elles accordent aux menaces cyber.

La réaction du marché aux opérations menées en août par la police dans le cadre de l’opération « Carbone Caché » a rappelé que le crime organisé ne génère pas seulement de la violence : il fausse la concurrence, pénalise les entreprises respectueuses des règles et impose une taxe cachée aux consommateurs. Il n’est donc pas surprenant qu’en septembre, le ministre des finances Fernando Haddad ait annoncé la création d’une nouvelle unité policière dédiée à la lutte contre les crimes financiers.

La « gouvernance criminelle » s’est propagée des prisons aux centres financiers. Dans leurs fiefs de Rio, les gangs et les milices opèrent comme des bandits traditionnels, contrôlant le territoire et les chaînes d’approvisionnement logistique. Pendant ce temps, des franchises du PCC et du CV sont apparues à l’intérieur des terres et en Amazonie, cherchant à engranger des profits plus élevés grâce à la contrebande d’or et de bois, ainsi qu’au transport fluvial illégal de marchandises.

Ces factions opèrent désormais au-delà des frontières, du pays en lien avec des organisations criminelles de Colombie, du Pérou et du Venezuela.

Les outils de contrôle n’ont pas suivi l’évolution du crime

Le bilan humain reste accablant, même si les chiffres nationaux agrégés se sont améliorés. En 2024, le Brésil a enregistré 44 127 morts violentes intentionnelles, son niveau le plus bas depuis 2012, mais cela représente encore plus de 120 homicides par jour. La géographie de l’intimidation s’est étendue : une enquête commandée par le Forum brésilien de la sécurité publique a révélé que 19 % des Brésiliens – soit environ 28,5 millions de personnes – vivent aujourd’hui dans des quartiers où la présence de gangs ou de milices est manifeste, soit une hausse de cinq points en un an.

Les outils de contrôle de l’État n’ont pas suivi l’évolution du modèle économique du crime organisé. Les incursions spectaculaires et les occupations temporaires font les gros titres et entraînent de nombreuses morts, mais perturbent peu le marché. Les polices des États, depuis longtemps considérées comme les plus létales du monde, démantèlent rarement les groupes criminels.

Les politiques étatiques et municipales sont elles aussi devenues de plus en plus vulnérables : le financement des campagnes, les contrats de travaux publics et les licences sont désormais des canaux investis par le pouvoir criminel. L’opération fédérale d’août a constitué une rare exception et a apporté la preuve de l’efficacité d’une répression visant l’argent du crime, et non seulement les porte-flingues.

Si les législateurs brésiliens sont sérieux, ils doivent traiter le crime organisé comme une défaillance du marché national et réagir à l’échelle nationale. Cela commence par placer le gouvernement fédéral à la tête de forces spéciales interinstitutionnelles permanentes réunissant police fédérale, procureur général, administration fiscale, cellules de renseignement financier, régulateurs du carburant et du marché, ainsi que Banque centrale.

Il faut davantage de condamnations

Ces équipes devront disposer d’un mandat clair pour agir au-delà des frontières des États et accomplir quatre tâches simples : suivre en temps réel les paiements à risque ; publier une liste fiable des propriétaires réels des entreprises qui contrôlent le carburant, les ports et d’autres actifs stratégiques ; connecter les données fiscales, douanières, de concurrence et de marchés afin qu’un signal d’alerte dans un domaine déclenche des vérifications dans les autres ; et se tourner vers des tribunaux au fonctionnement accéléré pour rapidement geler et saisir l’argent sale.

Les incitations doivent être modifiées afin que la police et les procureurs soient récompensés pour les condamnations et les saisies d’actifs, et non pour le nombre de morts. Et là où des groupes criminels ont pris le contrôle de services essentiels, comme les transports ou les services publics, ceux-ci doivent être placés sous contrôle fédéral temporaire et faire l’objet d’appels d’offres transparents et étroitement surveillés afin d’être, au final, remis à des opérateurs légaux.

Le Brésil a déjà prouvé qu’il pouvait mener de grandes opérations aux effets dévastateurs contre le crime. Le véritable défi est désormais de faire en sorte que le travail ordinaire de la loi – enquêtes, constitution de dossiers solides… – soit plus décisif que les interventions spectaculaires. Faute de quoi, il ne faudra pas longtemps pour qu’une grande ville brésilienne ne soit complètement paralysée.

Robert Muggah est affilié à l’Institut Igarapé et à SecDev.

29.10.2025 à 12:04

Combien de temps un moustique peut-il survivre sans piquer un humain ?

Claudio Lazzari, Professeur des Universités, Département de biologie animale et de génétique, Université de Tours

Texte intégral (809 mots)

La capacité d’un moustique à survivre sans piquer un humain dépend de plusieurs facteurs : son état de développement, son sexe, son espèce, son environnement et ses besoins physiologiques. Contrairement à ce que l’on pourrait penser, tous les moustiques ne se nourrissent pas de sang et même ceux qui le font n’en ont pas besoin en permanence pour survivre.

À leur naissance, tous les moustiques mènent une vie aquatique et se nourrissent de matière organique et de petits organismes. Cette période dure entre une et deux semaines, selon l’espèce, la température et la disponibilité en nourriture. Ils traversent quatre stades larvaires consacrés à l’alimentation et à la croissance, puis un stade de nymphe mobile au cours duquel une transformation corporelle profonde en moustique adulte a lieu, et durant lequel ils ne se nourrissent pas.

Au cours de leur vie, les moustiques occupent ainsi deux habitats complètement différents : l’eau et le milieu aérien, et utilisent des ressources différentes. À la différence d’autres insectes piqueurs, comme les punaises de lit ou les poux, qui se nourrissent de sang durant toute leur vie, les moustiques ne le font qu’à l’état adulte.

Moustiques mâles vs moustiques femelles

Il existe plus de 3 500 espèces de moustiques différentes, dont seule une petite fraction pique les humains, soit environ 200 espèces, dont 65 sont présentes en France hexagonale.

Les mâles ne piquent jamais. Ils se nourrissent exclusivement de nectar de fleurs et de jus de plantes, riches en sucres, qui leur fournissent toute l’énergie nécessaire à leur survie. Leur espérance de vie est généralement courte, de quelques jours à quelques semaines dans des conditions idéales.

Les femelles, en revanche, ont une double alimentation. Elles se nourrissent également de nectar pour vivre au quotidien. Cependant, lorsqu’elles doivent produire leurs œufs, elles ont besoin d’un apport en protéines que seul le sang peut leur fournir. Elles peuvent piquer des humains, mais aussi d’autres animaux, selon leurs préférences. Certaines espèces sont assez éclectiques en ce qui concerne leurs hôtes, piquant tout ce qui se présente à elles, tandis que d’autres montrent une préférence marquée pour le sang humain.

La plupart des moustiques se nourrissent du sang d’animaux à sang chaud, comme les oiseaux et les mammifères, y compris les êtres humains, mais certaines espèces peuvent aussi piquer des animaux à sang-froid, comme des grenouilles ou des chenilles de papillons.

Combien de temps une femelle peut survivre sans piquer ?

Une femelle moustique peut survivre plusieurs jours voire quelques semaines sans piquer pourvu qu’elle ait accès à une source de sucre, comme du nectar. Ce sont donc ses besoins reproductifs, et non sa survie immédiate, qui la poussent à piquer. Sans repas de sang, elle ne pourra pas pondre, mais elle ne mourra pas pour autant rapidement.

La femelle du moustique tigre Aedes albopictus, vecteur des virus de la dengue, du Zika ou du chikungunya, peut par exemple vivre environ un mois en tant qu’adulte dans des conditions optimales. Pendant cette période, elle peut survivre sans piquer, à condition de trouver une autre source de nourriture énergétique. Il en va de même pour Culex pipiens, le moustique le plus commun en France hexagonale, qui est également capable de transmettre certains virus responsables de maladies, telles que la fièvre du Nil occidental ou l’encéphalite japonaise.

Influence de l’environnement

La température, l’humidité et la disponibilité en nourriture influencent fortement leur longévité. Un milieu chaud et humide, avec de l’eau stagnante, des hôtes et du nectar à proximité, favorise une reproduction rapide et des repas fréquents. En revanche, une température relativement basse ralentit le métabolisme des insectes et leur permet d’espacer les repas.

Il est également à noter que certains moustiques entrent en diapause, une sorte d’hibernation, pendant les saisons froides et peuvent survivre plusieurs mois sans se nourrir activement. Selon l’espèce, les œufs, les larves, les nymphes ou les adultes peuvent subir cette forme de « stand-by physiologique » durant l’hiver. Si on ne les voit pas, ce n’est pas parce qu’ils sont partis, mais parce qu’ils sont cachés et plongés dans un profond sommeil.

Claudio Lazzari a reçu des financements de INEE-CNRS, projet IRP "REPEL".

- GÉNÉRALISTES

- Ballast

- Fakir

- Interstices

- Lava

- La revue des médias

- Le Grand Continent

- Le Diplo

- Le Nouvel Obs

- Lundi Matin

- Mouais

- Multitudes

- Politis

- Regards

- Smolny

- Socialter

- The Conversation

- UPMagazine

- Usbek & Rica

- Le Zéphyr

- Idées ‧ Politique ‧ A à F

- Accattone

- Contretemps

- A Contretemps

- Alter-éditions

- CQFD

- Comptoir (Le)

- Déferlante (La)

- Esprit

- Frustration

- Idées ‧ Politique ‧ i à z

- L'Intimiste

- Jef Klak

- Lignes de Crêtes

- NonFiction

- Nouveaux Cahiers du Socialisme

- Période

- Philo Mag

- Terrestres

- Vie des Idées

- ARTS

- Villa Albertine

- THINK-TANKS

- Fondation Copernic

- Institut La Boétie

- Institut Rousseau

- TECH

- Dans les algorithmes

- Framablog

- Gigawatts.fr

- Goodtech.info

- Quadrature du Net

- INTERNATIONAL

- Alencontre

- Alterinfos

- CETRI

- ESSF

- Inprecor

- Journal des Alternatives

- Guitinews

- MULTILINGUES

- Kedistan

- Quatrième Internationale

- Viewpoint Magazine

- +972 mag

- PODCASTS

- Arrêt sur Images

- Le Diplo

- LSD

- Thinkerview

- Fiabilité 3/5

- Slate

- Fiabilité 1/5

- Contre-Attaque

- Issues

- Korii

- Positivr