29.04.2026 à 09:31

Une anomalie au LHC laisse entrevoir une percée majeure en physique des particules

William Barter, UKRI Future Leaders Fellow, School of Physics and Astronomy, University of Edinburgh

Mark Smith, Research Fellow in Collider Physics, Faculty of Natural Sciences, Imperial College London

Texte intégral (1696 mots)

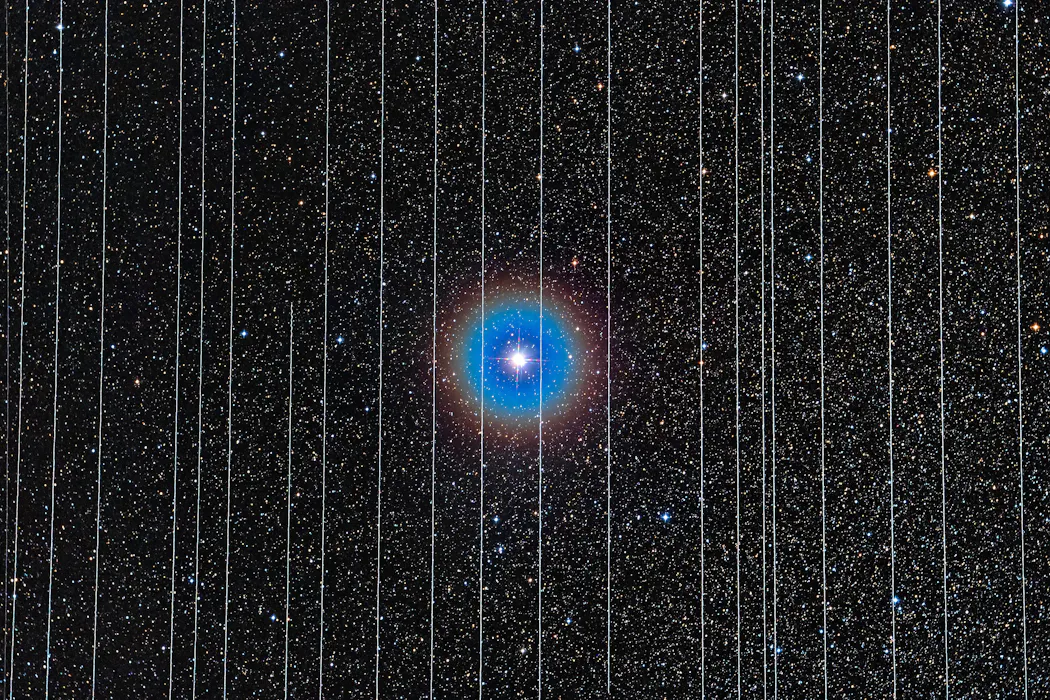

Des résultats obtenus au Large Hadron Collider, ou LHC, le grand collisionneur de hadrons du Cern, pourraient remettre en cause le modèle standard, pilier de la physique des particules depuis un demi-siècle.

Sommes-nous sur le point de détecter des signes d’une physique encore inconnue ? C’est ce que semblent suggérer les résultats récents des recherches que nous menons au grand collisionneur de hadrons du Cern (Large Hadron Collider ou LHC).

Si ces indices se confirmaient, ils remettraient en cause la théorie – appelée modèle standard (MS) – qui domine la physique des particules depuis cinquante ans. Les résultats indiquent, en effet, que le comportement de certaines particules subatomiques dans le LHC n’est pas conforme aux prédictions de ce modèle.

Les particules fondamentales sont les briques élémentaires de la matière : des particules subatomiques indivisibles (qui ne peuvent pas être décomposées en unités plus petites). Quatre forces fondamentales – la gravitation, l’électromagnétisme, l’interaction faible et l’interaction forte – régissent leurs interactions.

Le LHC est un immense accélérateur de particules installé dans un tunnel circulaire de 27 kilomètres sous la frontière franco-suisse. Son objectif principal est justement de mettre à l’épreuve le modèle standard.

Cette théorie constitue notre meilleure compréhension des particules et des forces fondamentales, mais elle n’est pas complète. Elle ne rend pas compte de la gravité ni de la matière noire – cette forme de matière invisible, encore jamais mesurée directement, qui représenterait environ 25 % de l’univers.

Au grand collisionneur de hadrons, des faisceaux de protons circulant en sens opposé sont mis en collision afin de déceler des indices d’une physique encore inconnue. Les nouveaux résultats proviennent de LHCb, une expérience du LHC consacrée à l’analyse de ces collisions.

Ce résultat repose sur l’étude de la désintégration – une forme de transformation – de particules subatomiques appelées mésons B. Nous avons analysé la manière dont ces mésons B se désintègrent en d’autres particules, et constaté que ce processus spécifique n’est pas conforme aux prédictions du modèle standard.

Une théorie élégante

Le modèle standard repose sur deux des avancées les plus révolutionnaires de la physique du XXᵉ siècle : la mécanique quantique et la relativité restreinte d’Einstein.

Les physiciens peuvent comparer les mesures réalisées dans des installations comme le LHC aux prédictions issues du modèle standard afin de tester rigoureusement cette théorie. Malgré son caractère incomplet, plus de cinquante ans de tests toujours plus exigeants n’ont encore révélé aucune faille dans ce cadre théorique. Du moins, jusqu’à aujourd’hui.

Notre mesure, acceptée pour publication dans la revue Physical Review Letters, met en évidence un écart de quatre écarts-types par rapport aux prédictions du modèle standard.

Concrètement, cela signifie que, après prise en compte des incertitudes liées aux résultats expérimentaux et aux prédictions théoriques, la probabilité qu’une fluctuation aléatoire des données produise un écart aussi important – si le modèle standard est correct – est d’environ 1 sur 16 000.

Même si ce résultat reste en deçà du standard ultime de la physique – ce que l’on appelle les cinq sigma, soit cinq écarts-types (environ une chance sur 1,7 million) – les indices commencent à s’accumuler. Cette hypothèse est renforcée par des résultats issus d’une autre expérience, CMS, publiés plus tôt en 2025.

Bien que les résultats de CMS soient moins précis que ceux de LHCb, ils sont en bon accord avec ces derniers, ce qui consolide l’ensemble. Nos nouveaux résultats proviennent de l’étude d’un type particulier de processus, appelé désintégration électrofaible « pingouin ».

Des événements rares

Le terme « pingouin » désigne un type particulier de désintégration (transformation) de particules de très courte durée de vie. Dans ce cas, nous étudions la manière dont le méson B se désintègre en quatre autres particules subatomiques – un kaon, un pion et deux muons.

Avec un peu d’imagination, la configuration des particules impliquées peut évoquer la silhouette d’un pingouin. Surtout, l’étude de cette désintégration permet d’observer comment un type de particule fondamentale, le quark bottom, peut se transformer en un autre, le quark étrange.

Cette désintégration « pingouin » est extrêmement rare dans le cadre du modèle standard : sur un million de mésons B, un seul se désintègre de cette manière. Nous avons analysé avec précision les angles et les énergies auxquels ces particules sont produites lors de la désintégration, et déterminé avec exactitude la fréquence du processus. Nos mesures de ces paramètres ne correspondent pas aux prédictions du modèle standard.

L’étude fine de ce type de désintégration constitue l’un des objectifs majeurs de l’expérience LHCb depuis sa création en 1994. Les processus « pingouin » sont particulièrement sensibles aux effets de nouvelles particules potentiellement très massives, qui ne peuvent pas être produites directement au LHC. De telles particules peuvent néanmoins exercer une influence mesurable sur ces désintégrations, en plus de la contribution attendue du modèle standard. Ce type d’observation indirecte n’est pas inédit. Par exemple, une forme de radioactivité a été découverte près de quatre-vingts ans avant que les particules fondamentales qui en sont responsables – les bosons W – ne soient observées directement.

Perspectives

L’étude de ces processus rares nous permet d’explorer des aspects de la nature qui ne deviendront peut-être accessibles autrement qu’avec des collisionneurs de particules dont on ne disposera au mieux que dans les années 2070. Un large éventail de nouvelles théories pourrait expliquer nos résultats. Beaucoup d’entre elles font intervenir de nouvelles particules appelées « leptoquarks », qui unifient deux types de constituants de la matière : les leptons et les quarks.

D’autres théories envisagent des particules plus massives, analogues à celles déjà décrites par le modèle standard. Ces nouveaux résultats permettent de contraindre ces modèles et d’orienter les recherches à venir.

Malgré notre enthousiasme, des questions théoriques ouvertes subsistent et nous empêchent d’affirmer avec certitude que nous avons observé une physique au-delà du modèle standard. La principale difficulté tient aux « pingouins charmants » (charming penguins), un ensemble de processus prévus par le modèle standard dont les contributions sont extrêmement difficiles à estimer. Les évaluations récentes suggèrent que leurs effets ne sont pas suffisamment importants pour rendre compte de nos données.

De plus, la combinaison d’un modèle théorique et des données expérimentales issues de LHCb indique que ces « pingouins charmants » – et donc le modèle standard – peinent à expliquer les résultats anormaux observés.

De nouvelles données, déjà collectées, devraient nous permettre de trancher dans les prochaines années : dans nos travaux actuels, nous avons analysé environ 650 milliards de désintégrations de mésons B enregistrées entre 2011 et 2018 pour identifier ces processus « pingouin ». Depuis, l’expérience LHCb a enregistré trois fois plus de mésons B.

D’autres avancées sont prévues dans les années 2030 afin de tirer parti des futures améliorations du LHC et de constituer un jeu de données 15 fois plus important. Cette étape décisive pourrait permettre d’apporter des preuves définitives – et, peut-être, d’ouvrir la voie à une nouvelle compréhension des lois fondamentales de l’Univers.

William Barter travaille pour l’Université d’Édimbourg. Il reçoit des financements de UKRI. Il est membre de la collaboration LHCb au CERN.

Mark Smith ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

29.04.2026 à 09:30

Masques à lumière rouge : que dit la science de leur efficacité ?

Coralie Thieulin, Enseignant chercheur en physique à l'ECE, docteure en biophysique, ECE Paris

Texte intégral (1823 mots)

La thérapie à la lumière rouge s’impose aujourd’hui comme une tendance majeure de la « beauty tech », portée par les influenceurs et rendue accessible au travers de dispositifs à domicile. Elle est associée à des effets séduisants tels que réduction des signes de l’âge, amélioration de l’acné ou encore accélération de la cicatrisation. Que savons-nous des effets avérés ou supposés de cette technologie ? Est-elle sans risques ?

Les dispositifs de thérapie à la lumière rouge destinés au grand public se présentent le plus souvent sous la forme de masques faciaux rigides ou souples, conçus pour épouser les contours du visage. Leur prix varie d’une centaine à environ mille euros. Ils intègrent un ensemble de diodes électroluminescentes (LED) disposées sur leur face interne, émettant une lumière visible rouge, parfois associée à du proche infrarouge. L’utilisateur porte ce masque pendant une durée déterminée (généralement quelques minutes), afin d’exposer uniformément la peau à cette lumière. D’autres formats existent également, tels que des panneaux lumineux ou des dispositifs portatifs ciblant des zones spécifiques du corps, mais le masque facial constitue aujourd’hui la forme la plus emblématique.

Cet intérêt croissant pour la thérapie à la lumière rouge repose sur plusieurs facteurs complémentaires. D’une part, les avancées technologiques ont permis la miniaturisation de systèmes LED, rendant possible leur utilisation hors des cabinets médicaux. Dans ces derniers, la lumière rouge est utilisée notamment en dermatologie, où elle est employée pour le traitement de l’acné, des plaies, des ulcères et des cicatrices. D’autre part, ces dispositifs sont souvent présentés comme des solutions non invasives, ce qui contribue à leur accessibilité et à leur adoption par le grand public. Enfin, les réseaux sociaux participent à leur visibilité, en diffusant des retours d’expérience et des contenus d’usage, qui s’ajoutent aux publications scientifiques et aux communications commerciales existantes.

Commençons par préciser ce que l’on appelle thérapie à la lumière rouge. Aussi appelée photobiomodulation, elle repose sur l’utilisation de longueurs d’onde spécifiques, généralement comprises entre 630 et 660 nm, parfois étendues au proche infrarouge (environ 800–900 nm). Ces longueurs d’onde peuvent pénétrer dans la peau jusqu’au derme sans provoquer d’échauffement significatif ou de dommages comparables aux UV.

Quels sont les effets biologiques de la photobiomodulation ?

Au niveau biologique, la photobiomodulation serait liée à plusieurs mécanismes cellulaires encore en cours d’étude. Le mécanisme principal évoqué dans les travaux repose sur une interaction avec les mitochondries (petites structures cellulaires qui produisent l’énergie – sous forme d’une molécule appelée adénosine triphosphate : ATP – à partir des nutriments et de l’oxygène), en particulier avec l’enzyme cytochrome c oxydase, un acteur clé de la chaîne respiratoire. Plusieurs travaux suggèrent que cette enzyme agit comme un chromophore capable d’absorber la lumière rouge, entraînant des modifications de son état redox (gain ou perte d’électrons) et une stimulation du métabolisme, notamment via une augmentation de la production d’ATP et l’activation de voies de signalisation intracellulaires.

Ces processus s’accompagnent de plusieurs effets biologiques principalement observés in vitro et dans des modèles animaux. Une augmentation de la production d’ATP a notamment été mesurée après exposition à ces longueurs d’onde. Par ailleurs, la lumière semble moduler le stress oxydatif, c’est-à-dire le déséquilibre entre la production de molécules réactives de l’oxygène et les systèmes de défense antioxydants de la cellule. Ce déséquilibre est susceptible d’endommager les lipides, protéines et l’ADN lorsqu’il est excessif, mais peut aussi jouer un rôle de signal biologique à faible niveau. Ce processus implique notamment une production contrôlée d’espèces réactives de l’oxygène (ROS) et de monoxyde d’azote, deux molécules impliquées dans les voies de signalisation cellulaire. Enfin, ces signaux biochimiques activent des cascades intracellulaires (kinases, facteurs de transcription) favorisant des processus de réparation et de régénération tissulaire.

Des effets modestes

Ces mécanismes restent encore débattus, notamment concernant le rôle exact du cytochrome c oxydase, dont l’implication directe n’est pas unanimement démontrée. Malgré ces incertitudes mécanistiques, la photobiomodulation a été largement étudiée sur le plan clinique, avec des résultats globalement positifs mais variables selon les indications.

Dans le cas du vieillissement cutané, plusieurs essais rapportent une légère amélioration des rides fines, de la texture et de l’élasticité de la peau après plusieurs semaines de traitement. Ces effets seraient liés à la stimulation des fibroblastes (cellules de base des tissus conjonctifs) et à l’augmentation de la production de collagène. Une revue souligne que les effets observés sont réels mais hétérogènes et encore mal standardisés.

Concernant la cicatrisation, les données suggèrent un potentiel effet, mais les preuves restent encore incomplètes et parfois contradictoires. La lumière rouge pourrait intervenir dans les différentes phases de la réparation tissulaire (inflammation, prolifération et remodelage) en stimulant l’activité de cellules clés comme les fibroblastes et les macrophages (cellules du système immunitaire). Elle favoriserait ainsi la production de collagène, la migration cellulaire et possiblement l’angiogenèse (formation de nouveaux vaisseaux sanguins à partir de vaisseaux existants), contribuant à la reconstruction du tissu lésé. Cependant, les données cliniques sont hétérogènes : certaines études montrent une accélération de la cicatrisation, tandis que d’autres ne retrouvent pas d’effet significatif.

Enfin, dans le traitement de l’acné, la lumière rouge agit principalement par des effets anti-inflammatoires et une modulation de l’activité des glandes sébacées (situées dans la peau et impliquées dans la synthèse et sécrétion du sébum). Les études rapportent une diminution des lésions inflammatoires et des rougeurs, avec des résultats globalement modérés et variables selon les protocoles. Elle est souvent plus efficace lorsqu’elle est combinée à d’autres thérapies lumineuses.

Un niveau de preuve limité

Malgré des résultats encourageants dans plusieurs domaines, la photobiomodulation reste une discipline en développement, dont le niveau de preuve est limité par plusieurs facteurs méthodologiques. De nombreuses études reposent sur des effectifs réduits, ce qui limite la robustesse statistique et la généralisation des résultats. Par ailleurs, l’hétérogénéité des protocoles expérimentaux (durée d’exposition, intensité lumineuse, fréquence des traitements) complique la comparaison entre études et peut expliquer certaines divergences observées.

Ces limites méthodologiques contrastent avec la diffusion rapide de dispositifs grand public (masques LED, panneaux, appareils portatifs), aux performances variables et peu standardisées. L’écart entre les conditions expérimentales (paramètres contrôlés, doses précises, suivi médical) et l’usage domestique peut conduire à une surestimation des effets, parfois amplifiée par des discours commerciaux optimistes.

En résumé, la photobiomodulation repose sur des mécanismes biologiques plausibles et des résultats expérimentaux et cliniques encore partiellement concordants. Le niveau de preuve reste à ce jour modéré, en raison notamment du nombre limité d’essais randomisés contrôlés de grande ampleur et de l’hétérogénéité des protocoles. Les données disponibles suggèrent des effets potentiels dans plusieurs indications dermatologiques, mais leur amplitude et leur reproductibilité varient selon les conditions d’utilisation. Cette technologie s’inscrit ainsi dans un champ de recherche en structuration, nécessitant des études complémentaires standardisées afin de préciser ses indications et ses paramètres optimaux.

Dans ce contexte, des effets indésirables restent rares mais possibles, principalement sous forme d’irritations cutanées transitoires ou d’inconfort oculaire en cas de mauvaise utilisation. Les données actuelles ne mettent pas en évidence de toxicité majeure aux paramètres utilisés en photobiomodulation, mais les effets d’un usage prolongé ou non encadré restent encore insuffisamment documentés. Certaines situations peuvent également nécessiter des précautions particulières, notamment chez les personnes présentant une sensibilité accrue à la lumière ou des pathologies dermatologiques spécifiques.

L’utilisation de dispositifs commerciaux de lumière rouge doit donc être envisagée avec prudence, en particulier en dehors d’un cadre médical. Il est recommandé de solliciter un avis médical ou dermatologique en cas d’usage à visée thérapeutique. Par ailleurs, les dispositifs disponibles sur le marché présentent une qualité variable : il convient de vérifier des paramètres tels que la longueur d’onde (généralement 630–660 nm pour le rouge), la puissance d’émission, ainsi que la présence de certifications de sécurité.

Coralie Thieulin ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

29.04.2026 à 09:30

Lessive : Peut-on passer de 50 à 5 ingrédients et toujours avoir un linge propre ?

Véronique Sadtler, Professeure, Université de Lorraine

Texte intégral (1884 mots)

Vous lancez une machine, versez une dose de lessive et attendez un linge propre : taches éliminées, fibres et couleurs préservées, même à basse température. Derrière ce geste quotidien se cache une chimie sophistiquée. Les formulations actuelles mobilisent souvent plus de 30 ingrédients, chacun jouant un rôle précis. Pourtant, on voit apparaître des lessives mettant en avant des listes plus courtes, parfois réduites à moins de 10 composants, portées par une demande de transparence et de moindre impact environnemental. Mais peut-on vraiment simplifier sans perdre en efficacité ?

Une lessive ne se contente pas de nettoyer. Elle doit simultanément décoller les salissures, préserver les tissus et fonctionner dans des eaux de qualité variable. Pour y parvenir, chaque ingrédient remplit un rôle précis. Les tensioactifs forment la colonne vertébrale de la formulation. Leur structure amphiphile – une tête hydrophile avec affinité pour l’eau et une chaîne hydrophobe attirant les graisses – leur permet de s’intercaler entre les salissures et les fibres, de les décoller et de les maintenir en suspension dans le bain de lavage.

Les enzymes complètent cette action en ciblant des taches spécifiques : les protéases décomposent les taches protéiniques (sang, œuf), les amylases s’attaquent aux amidons (sauces, pâtes, riz), tandis que les lipases hydrolysent graisses et huiles. Leur efficacité à basse température explique en grande partie pourquoi les lessives modernes peuvent nettoyer sans chauffer fortement l’eau. D’autres ingrédients assurent des fonctions complémentaires, comme l’efficacité du lavage en eau dure (une eau riche en ions calcium et magnésium, une eau calcaire), la stabilité de la formulation ou la limitation de la redéposition des salissures sur les fibres.

Cette complexité s’est construite au fil des décennies pour répondre à des exigences toujours plus élevées. Certaines fonctions restent difficiles à concilier : améliorer la blancheur peut altérer les couleurs vives, tandis que renforcer l’efficacité à basse température exige souvent des systèmes enzymatiques plus élaborés. Notons que la réglementation européenne n’impose pas l’affichage de la liste complète des ingrédients sur l’emballage, mais seulement des classes de composants avec des fourchettes de pourcentages. Obtenir la liste exhaustive reste souvent complexe pour le consommateur. Si la liste détaillée est théoriquement accessible en ligne, elle est en pratique plus ou moins facile à consulter, parfois dispersée dans des documents techniques.

Les deux moteurs de la simplification

Les formulations tendent aujourd’hui à se raccourcir sous l’effet de deux dynamiques. La première est réglementaire. Ainsi, les phosphates, autrefois largement utilisés comme agents séquestrants, ont été fortement limités puis pratiquement éliminés des lessives ménagères en Europe depuis 2013. Rejetés dans les eaux usées après le lavage, les phosphates contribuent à l’eutrophisation des milieux aquatiques, c’est-à-dire à un enrichissement excessif en nutriments. Ils favorisent ainsi la prolifération d’algues, qui appauvrit l’eau en oxygène et peut entraîner une perte de biodiversité.

La seconde dynamique est sociétale. Une demande croissante de transparence et de réduction de l’empreinte environnementale pousse les fabricants à proposer des formules plus courtes. Azurants optiques, qui donnent une impression de blancheur plus éclatante sans agir directement sur le nettoyage, parfums, conservateurs, remplissent des fonctions réelles, mais sont de plus en plus contestés pour leurs effets allergènes potentiels ou leur persistance dans l’environnement. Certains labels, comme l’Écolabel européen, vont au-delà de la réglementation en les excluant ou en les limitant strictement, privilégiant certains critères écologiques au détriment d’autres performances.

Simplifier, c’est arbitrer

Réduire le nombre d’ingrédients ne consiste pas à supprimer des composants sans conséquence. Il s’agit de recomposer un nouvel équilibre entre contraintes souvent contradictoires.

Le cercle de Sinner, cadre classique en chimie du lavage, illustre ces arbitrages. Il repose sur quatre paramètres interdépendants : action chimique, température de l’eau, temps de contact et action mécanique. Pour obtenir un niveau de propreté donné, ces facteurs se compensent : réduire l’un impose d’en renforcer un autre.

C’est exactement la logique des programmes « éco » des machines à laver : en abaissant la température à 30 ou 40 °C au lieu de 60 °C, ils allongent la durée du cycle. Si cette baisse de température permet de réduire la consommation d’énergie, elle peut rendre aussi le lavage moins efficace, ce qui nécessite des formulations souvent plus sophistiquées, capables d’agir à froid. Le lavage à basse température ne simplifie donc pas nécessairement les formules, et peut au contraire conduire à les complexifier.

Du bidon à la dosette : la complexité change de forme

L’évolution des formats de lessive illustre la manière dont la complexité est parfois redistribuée plutôt qu’éliminée. Les lessives liquides, aujourd’hui dominantes, sont pratiques et efficaces à basse température, mais transportent une part importante d’eau, souvent plus de la moitié de la formulation et nécessitent des conservateurs. Les formats concentrés ou solides visent à réduire l’emballage et l’impact du transport, mais nécessitent un dosage plus précis de la part du consommateur.

Dans ce contexte, le volume du flacon n’est pas toujours un bon indicateur : les fabricants indiquent généralement sur l’emballage le nombre de lavages, qui reflète mieux la concentration et facilite la comparaison entre produits.

Le surdosage reste fréquent : par habitude ou par crainte d’un résultat insuffisant, beaucoup de consommateurs versent plus que la dose recommandée. Au-delà d’un certain seuil, les tensioactifs supplémentaires n’améliorent plus le nettoyage ; ils sont simplement rejetés dans les eaux usées, augmentant inutilement la charge environnementale.

Les dosettes multi-compartiments offrent une autre réponse élégante : en séparant physiquement des ingrédients incompatibles (certaines enzymes et agents oxydants qui se neutraliseraient dans un mélange unique), elles préservent l’efficacité de chacun jusqu’au moment du lavage, tout en imposant une dose prédéfinie qui limite mécaniquement le surdosage. La complexité chimique n’a pas disparu ; elle a simplement été intégrée dans l’architecture du produit.

Performance maximale ou performance suffisante ?

Le véritable enjeu réside ici. Les lessives classiques sont conçues selon une logique de performance maximale : elles doivent venir à bout des situations les plus exigeantes – taches tenaces, eau très calcaire, textiles délicats – même si ces cas restent minoritaires dans la vie quotidienne.

Pourtant, l’Agence de l’environnement et de la maîtrise de l’énergie (Ademe) le rappelle : la très grande majorité du linge porté n’est que peu ou modérément sale, et il est recommandé d’espacer les lavages. Viser systématiquement la performance maximale revient à surdimensionner la formulation pour des usages qui ne le justifient pas. Dans la pratique, pour le linge du quotidien, des doses modérées et des cycles à basse température sont généralement suffisants. À l’inverse, pour des taches plus tenaces – vêtements de sport ou de travail –, il peut être plus pertinent d’avoir recours à des détachants ciblés plutôt que d’augmenter systématiquement les doses de lessive.

Adapter les formulations aux usages majoritaires implique donc de passer d’une approche universelle à une logique de performance suffisante, c’est-à-dire une efficacité adaptée à la grande majorité des lavages quotidiens. Ce n’est pas une régression technique, mais un choix de conception assumé qui rend enfin visibles les arbitrages. Les lessives pour linge blanc (avec agents de blanchiment et azurants optiques) et celles pour linge foncé (sans ces composants pour préserver les couleurs) en sont l’illustration parfaite : on ne peut pas optimiser simultanément ces deux objectifs.

Enfin, le prix joue un rôle important. Les lessives revendiquant une formulation plus simple ou un impact réduit sont souvent plus chères à l’achat que les produits classiques, en raison du coût plus élevé des ingrédients alternatifs d’origine végétale ou biodégradable, des volumes de production généralement plus faibles et des certifications spécifiques. Toutefois, ce surcoût à l’achat ne se traduit pas nécessairement par un coût plus élevé à l’usage. Grâce à une concentration souvent supérieure et à un dosage plus précis, le prix par lavage peut s’approcher, voire s’aligner sur celui des lessives classiques, notamment avec les marques de distributeurs écologiques qui offrent aujourd’hui un excellent rapport qualité-prix.

Au fond, la simplification ne change pas seulement les formules, elle interroge aussi nos habitudes d’usage. Et c’est peut-être là son véritable apport : non pas viser une performance maximale en toutes circonstances, mais ajuster le niveau de performance réellement nécessaire selon les situations.

Véronique Sadtler ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

28.04.2026 à 15:51

Comment se forment les gouttes de pluie ?

Auguste Gires, Ingénieur en chef des Eaux, Ponts et Forêts, chercheur au laboratoire Hydrology, Meteorology and Complexity (HM&Co), École Nationale des Ponts et Chaussées (ENPC)

Eleonora Dallan, Ingénieure en environnement et enseignante-chercheuse au département TESAF (Terre, Environnement, Agriculture et Forêts), University of Padua

Texte intégral (1383 mots)

Dans leur ouvrage Balade sous la pluie, paru en 2025 aux Presses des Ponts, Auguste Gires, ingénieur en chef du corps des Ponts, eaux et forêts, et chercheur au laboratoire Hydrologie, météorologie et complexité de l’École nationale des ponts et chaussées, et Eleonora Dallan, ingénieure en environnement et chercheuse au département Terre, environnement, agriculture et forêts, de l’Université de Padoue en Italie, nous emmènent en promenade pour découvrir un phénomène très courant, mais finalement peu connu : la pluie.

Pour la quatrième « escale » de ce livre-promenade, ils nous expliquent comment se forment physiquement les gouttes de pluie dans les nuages. Extrait.

N’est-il pas surprenant que tous ces cumulus (nuages cotonneux de basse altitude) semblent se former à la même altitude ? En réalité, cela est lié à la façon dont les nuages, et plus largement les précipitations, sont générés. Sur Terre, les conditions de température et de pression permettent à l’eau d’exister naturellement dans trois états : liquide (comme dans les océans, les rivières, ou l’eau du robinet), solide (tel que la glace, la neige, la grêle, la pluie verglaçante), et gazeuse, dans l’air sous forme de vapeur invisible. Les interactions entre ces trois états sont, entre autres, à l’origine de la pluie.

Les noms des nuages

-

La plupart des noms de nuages comportent des racines et qualificatifs latins,

dont l’association donne une indication sur le type de nuage désigné, notamment :

- STRATUS/STRATO : étendu, couche, continu ;

- CUMULUS/CUMULO : amas, moutonneux ;

- CIRRUS/CIRRO : filament, fin ;

- NIMBUS/NIMBO : porteur de pluie.

- ALTO : moyen (même si altus en latin signifie « haut ») Par exemple, un altocumulus, est un nuage moutonneux de moyenne altitude.

Tout commence par l’évaporation, c’est-à-dire qu’une partie de l’eau liquide présente à la surface de la Terre s’évapore sous l’action du soleil. La vapeur d’eau se mélange à l’air ambiant près de la surface. Cet air, réchauffé par le soleil, devient plus chaud que celui du dessus. Sa masse volumique devient plus faible que celle de l’air qui l’entoure (on dit qu’il est plus léger dans le langage courant), ce qui facilite sa montée. En effet, les molécules qu’il contient bougent plus vite sous l’effet de la chaleur et occupent alors plus de place, tout en gardant la même masse.

En raison de la baisse de la température avec l’altitude, généralement d’environ 6,5 °C tous les 1 000 mètres, l’air initialement chaud se refroidit progressivement en montant. Il s’avère que la quantité de vapeur d’eau que l’air peut contenir diminue avec sa température (environ 7 % par degré). Dans un air plus froid, les molécules sont plus proches les unes des autres, ce qui réduit l’espace disponible pour d’autres molécules de gaz comme la vapeur d’eau. C’est la relation de Clausius-Clapeyron.

Ainsi, à une altitude donnée, qui dépend de la température et de la quantité initiale de vapeur d’eau, l’air devient saturé et ne peut plus contenir autant de vapeur d’eau qu’au moment de l’évaporation, quand l’air était encore proche de la surface. Les spécialistes appellent cela le point de rosée. Une partie de l’eau se condense et retrouve sa forme liquide d’origine. La formation de ces gouttelettes de nuages se fait généralement autour de noyaux de condensation, comme une poussière, de la glace ou du sel. Elles sont beaucoup plus petites que les gouttes de pluie dont nous avons parlé précédemment, avec une taille proche de 0,02 millimètre. Ces gouttelettes sont si petites que les turbulences de l’air ambiant sont suffisamment fortes pour les maintenir en suspension dans l’air, les empêchant de tomber au sol. Cette concentration de gouttelettes dans l’air forme un nuage. Le processus peut également se produire à température négative, et dans ce cas, le nuage est constitué de petits cristaux de glace.

D’une certaine manière, vous êtes tous témoins de la formation de nuages au quotidien. Profitons justement des températures hivernales. Inspirez, expirez… Vous remarquerez qu’une sorte de petit nuage se forme en expirant. Oui, il s’agit bien d’un petit nuage ! L’air qui sort de vos poumons, chaud et humide, rencontre de l’air plus frais dans l’atmosphère extérieure. Une partie de la vapeur d’eau qu’il contient se condense et forme des gouttelettes.

Le même phénomène est à l’œuvre lorsque vous faites bouillir de l’eau. Juste au-dessus de l’eau chaude dans la casserole, l’air est très chaud et contient beaucoup de vapeur d’eau. En remontant, il rencontre de l’air plus frais et une partie de l’eau se condense en gouttelettes. Ce que vous voyez n’est donc certainement pas de la vapeur d’eau, qui est invisible, mais bien un petit nuage.

La quantité d’eau liquide contenue dans les nuages, soit la teneur en eau liquide, varie fortement en fonction du type de nuages. Elle est exprimée en masse d’eau liquide par unité de volume d’air, en gramme par mètre cube (g/m3). Elle présente une très grande variabilité d’un nuage à l’autre, voire au sein d’un même nuage. Les ordres de grandeur peuvent aller de 0,06 g/m3 pour des nuages non précipitants comme les cirrus, des nuages de haute altitude, à 0,4 g/m3 pour des nuages engendrant des pluies, tels que les stratocumulus,** **qui sont à plus basse altitude. Les valeurs sont plus élevées pour les cumulonimbus, dont il sera question lors de la prochaine escale.

Qu’en est-il de la pluie ? Pour qu’elle se forme, il faut que les gouttelettes contenues dans les nuages grossissent de façon à être suffisamment lourdes pour tomber. Cela se produit principalement grâce à deux processus.

Le premier, le processus Wegener-Bergeron-Findeisen, implique la croissance de cristaux de glace dans des nuages en phase mixte. Ces nuages, caractérisés par des températures négatives, contiennent simultanément de l’eau dans ses trois états : de la glace, de l’eau surfondue (de l’eau en dessous de 0 °C, mais pas encore solidifiée) et de la vapeur d’eau. Dans cet environnement sous-saturé en eau liquide, celle-ci s’évapore rapidement, tandis que la vapeur d’eau se dépose tout aussi vite dans les cristaux de glace, entraînant une croissance soudaine de ces derniers. Le deuxième est la coalescence. Dans les nuages contenant assez de gouttelettes, certaines d’entre elles entrent en collision au cours de leur mouvement, fusionnent et grossissent progressivement.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

27.04.2026 à 15:54

L’oxygène, cette molécule paradoxale, base de la vie et poison mortel : comment les microorganismes y font face

Alexandre Desparmet, Doctorant en Biologie Marine, Muséum national d’histoire naturelle (MNHN)

Cédric Hubas, Professor, Muséum national d’histoire naturelle (MNHN)

Texte intégral (2291 mots)

Les humains ainsi que bon nombre d’espèces vivantes ont besoin d’oxygène pour vivre. Pourtant cette molécule est chimiquement dangereuse, elle provoque ce que l’on appelle le « stress oxydant » (une altération des constituants de nos cellules comme les protéines ou l’ADN). Il faut donc pouvoir l’utiliser, mais également s’en protéger. Une nouvelle étude éclaire ces processus chez des microalgues.

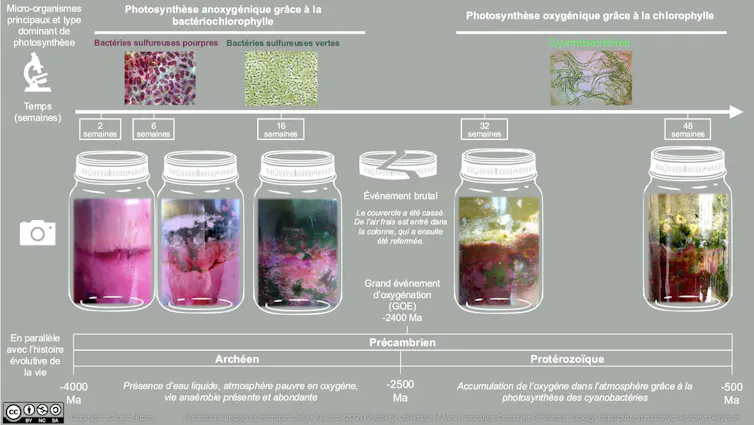

La relation entre la vie et l’oxygène est loin d’être simple. Pour la comprendre, il faut remonter aux origines de la vie sur Terre, à l’époque archéenne (entre -4 milliards et -2,5 milliards d’années). Les océans existaient déjà, mais l’atmosphère contenait très peu, voire pas du tout, d’oxygène libre.

Certaines bactéries réalisaient déjà une photosynthèse dite anoxygénique qui, contrairement à celle des plantes et des algues actuelles, ne libère pas d’oxygène mais produit des composés soufrés.

Il y a environ 2,4 milliards d’années survient un tournant majeur : la Grande Oxygénation. L’oxygène commence à s’accumuler dans l’atmosphère grâce à l’activité de bactéries photosynthétiques (les cyanobactéries) capables de réaliser la photosynthèse oxygénique, le même processus que celui utilisé aujourd’hui par les plantes et les algues.

Cette accumulation d’oxygène transforme profondément la biosphère. Pour la première fois, une molécule extrêmement réactive est produite en grande quantité par des organismes vivants. L’oxygène peut oxyder et endommager les structures cellulaires des organismes qui n’y sont pas adaptés. La vie se trouve alors confrontée à un paradoxe : devoir composer avec une molécule qu’elle produit elle-même mais qui représente un danger pour la majorité des formes de vie existantes.

Cette transition provoque une crise biologique majeure. De nombreuses espèces anaérobies sont repoussées vers des milieux pauvres en oxygène, comme les sédiments ou les profondeurs marines. Parallèlement, certaines lignées développent des mécanismes capables de neutraliser l’oxygène, puis de l’utiliser comme source d’énergie. La respiration oxygénique, bien plus efficace que les métabolismes anaérobies, permet ainsi l’émergence de formes de vie plus complexes.

Le paradoxe de l’oxygène

Bien que souvent associé à la vie, l’oxygène demeure chimiquement dangereux et peut provoquer ce que l’on appelle le stress oxydant. En effet, le dioxygène peut générer des espèces réactives de l’oxygène (ERO) – superoxyde, peroxyde d’hydrogène ou radical hydroxyle – capables d’endommager protéines, lipides et ADN.

Tous les organismes aérobies (y compris les humains) possèdent donc des systèmes enzymatiques permettant de neutraliser ces molécules : superoxyde dismutases, catalases ou peroxydases. Sans ces mécanismes de défense, l’oxygène serait rapidement létal. La vie moderne repose ainsi sur un équilibre délicat : utiliser l’oxygène pour produire de l’énergie tout en limitant ses effets toxiques.

Longtemps considérées uniquement comme des sous-produits nocifs impliqués dans le vieillissement ou certaines maladies, les ERO sont aujourd’hui reconnues comme des molécules de signalisation participant à la régulation de nombreux processus cellulaires (prolifération cellulaire ou régulation de certains gènes par exemple). Leur rôle exact reste cependant encore largement inexploré.

Le stress oxydant dans les environnements naturels

Le stress oxydant ne concerne pas seulement les organismes humains : il affecte l’ensemble du vivant. Il apparaît lorsque la production d’ERO dépasse les capacités de défense de la cellule. Ce phénomène est particulièrement marqué dans des environnements soumis à de fortes variations de conditions physiques ou chimiques.

Ces milieux extrêmes comme la mer morte, le désert du Sahara ou certains déserts d’altitude recevant un fort rayonnement solaire, possèdent des conditions très salées, très sèches ou fortement irradiées, mais abritent pourtant une biodiversité étonnante. Des organismes spécialisés, appelés extrêmophiles, y prospèrent grâce à des adaptations physiologiques remarquables. La notion d’environnement extrême dépend donc toujours de l’organisme considéré.

Même des milieux plus familiers peuvent imposer des contraintes importantes. Nos zones côtières, par exemple, connaissent des fluctuations rapides de lumière. L’intensité lumineuse y varie fortement au cours de la journée, ce qui influence directement l’activité photosynthétique.

Les organismes photosynthétiques sont particulièrement exposés à ce problème, car la capture d’énergie lumineuse favorise la formation d’espèces réactives de l’oxygène. Ainsi, si la lumière est indispensable à la photosynthèse, un excès d’énergie lumineuse peut perturber l’équilibre cellulaire et favoriser la formation d’ERO. Les organismes doivent donc exploiter la lumière tout en se protégeant de ses effets potentiellement toxiques.

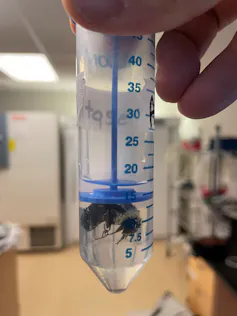

Les adaptations des microalgues aux variations journalières de lumière

Les diatomées, microalgues très abondantes dans les sédiments marins, ont développé plusieurs stratégies pour faire face à ces variations lumineuses. Des pigments protecteurs, notamment les xanthophylles, limitent la formation de radicaux libres. Les cellules peuvent également modifier l’organisation de leur appareil photosynthétique afin d’optimiser la capture de lumière tout en réduisant les dommages.

Ces microalgues possèdent aussi des photorécepteurs capables de détecter les variations lumineuses et de déclencher des réponses physiologiques rapides, comme l’activation de mécanismes de photoprotection ou l’expression de certains gènes.

L’une de leurs adaptations les plus remarquables est leur migration verticale dans le sédiment. Lorsque la lumière est modérée, les diatomées remontent vers la surface afin de maximiser la photosynthèse. Lorsque l’intensité devient trop forte, elles s’enfoncent légèrement dans le sédiment, comme pour se mettre à l’ombre. Ces déplacements sont synchronisés par une horloge circadienne interne qui permet d’anticiper les cycles jour-nuit.

ERO et diatomées : un dialogue plus complexe qu’on ne le croyait

Des travaux récents suggèrent que les espèces réactives de l’oxygène pourraient jouer un rôle plus actif qu’on ne le pensait. Au-delà de leur caractère potentiellement toxique, elles pourraient agir comme signaux déclenchant certaines réponses comportementales.

Notre dernière étude montre que les ERO participent notamment au contrôle de la migration verticale des diatomées, alors que l’on pensait jusqu’à présent que ces migrations servaient principalement à limiter leur production et leur accumulation au niveau cellulaire.

Deux mécanismes semblent donc se combiner : la migration permet de réduire l’exposition à des conditions génératrices d’ERO, mais ces mêmes molécules pourraient également agir comme signaux déclenchant la réponse lorsque leur concentration dépasse un certain seuil.

Ce système fonctionnerait ainsi comme un véritable dispositif de surveillance interne. Les variations du stress oxydant reflètent rapidement les changements de l’environnement et permettent aux cellules d’ajuster leurs réponses physiologiques et comportementales.

Les diatomées étant très diversifiées et largement distribuées à l’échelle globale, il est probable que ces capacités de détection, de traitement de l’information et de mise en place de réponses varient selon les espèces et le contexte environnemental. Cette diversité confère aux diatomées une forte capacité d’adaptation, jouant un rôle essentiel dans leur survie.

Ce travail montre, à travers un exemple frappant, que le vivant n’a pas seulement appris à se défendre contre l’oxygène et ses dérivés toxiques : il a aussi appris à les utiliser. Des déchets métaboliques oxygénés, autrefois considérés comme uniquement dangereux pour les cellules, peuvent devenir de véritables outils biologiques.

Cela rappelle que le rôle des ERO reste complexe et encore largement méconnu. Loin d’être de simples agents de stress, elles apparaissent aujourd’hui comme des molécules ambivalentes : des messagers subtils intégrés à des mécanismes fins de communication, d’adaptation cellulaire et de perception de l’environnement, notamment chez les diatomées.

Et comme souvent en sciences, ces découvertes ouvrent surtout de nouvelles questions… qui restent encore à explorer.

Nous remercions l’école doctorale DIVONA, la station marine de Concarneau (Finistère) et le laboratoire BOREA.

Alexandre Desparmet a reçu des financements de l'institut de l'Océan de l'Alliance Sorbonne Université.

Cédric Hubas a reçu des financements de l'institut de l'Océan de l'Alliance Sorbonne Université.

26.04.2026 à 09:15

Ce que les créatures des abysses voient dans le noir

Juliette Ravaux, Maître de conférences, Sorbonne Université

Sébastien Duperron, Professeur d'écotoxicologie microbienne, Muséum national d’histoire naturelle (MNHN)

Texte intégral (1699 mots)

Dans l’ouvrage Secrets de l’océan profond, tout juste publié aux éditions Quae, Juliette Ravaux, maîtresse de conférences à Sorbonne Université en biologie animale, et Sébastien Duperron, professeur au Muséum national d’histoire naturelle et spécialiste d’écologie microbienne, nous font découvrir des espèces animales mystérieuses et des ressources mal connues de l’océan profond. Leur but est de mieux comprendre ce bien commun, pour mieux le préserver. Dans cet extrait, ces spécialistes nous donnent à voir ce que perçoivent les curieuses espèces vivant dans les abysses, qu’ils ont tous deux pu observer lors de leurs plongées à bord du Nautile, sous-marin de la flotte scientifique à la fois unique… et exigu.

La vie dans l’océan profond s’accompagne d’un panel de contraintes environnementales, parmi lesquelles l’absence de lumière solaire et la rareté de la nourriture. À elles seules, ces deux conditions affectent des fonctions essentielles des organismes telles que l’orientation dans leur environnement à la recherche de nourriture ou de partenaires, mais aussi le métabolisme, la croissance et la reproduction. En conséquence, les espèces des profondeurs possèdent une vaste diversité d’adaptations dont certaines sont présentées ici, mais dont beaucoup restent encore à découvrir !

Descendons sur la dorsale de l’océan Atlantique, à plus de 2 000 mètres de fond, au plus près des fumeurs noirs qui crachent un fluide brûlant. Là, sur les parois des cheminées hydrothermales, des crevettes se rassemblent par milliers en nuées grouillantes. Ce sont des crevettes aveugles, Rimicaris exoculata, une espèce emblématique de ces environnements atlantiques. Les adultes ne possèdent pas les yeux pédonculés typiques des crevettes, ce qui leur vaut ce surnom. Et pourtant, elles possèdent bien des yeux, difficilement reconnaissables car ils sont très modifiés : ce sont des plaques rosées en forme de V qui se situent sur leur dos. Ces plaques ne leur permettent pas de voir leur environnement sous forme d’une image comme le font nos yeux.

Mais elles sont très sensibles à la lumière et détectent des sources lumineuses de très faible intensité, invisibles pour l’œil humain. Elles sont constituées d’une couche très épaisse de cellules photoréceptrices, sous laquelle se trouve une couche réfléchissante de cellules blanches qui renvoie la lumière vers les photorécepteurs, augmentant ainsi la quantité de lumière perçue.

Grâce à ces capteurs hypersensibles, les crevettes Rimicaris sont donc spécialisées dans la détection de lumière ténue. Reste encore à déterminer quels signaux lumineux elles perçoivent dans leur environnement parmi les sources potentielles, comme celle émise par le fluide hydrothermal sous forme de rayonnement thermique.

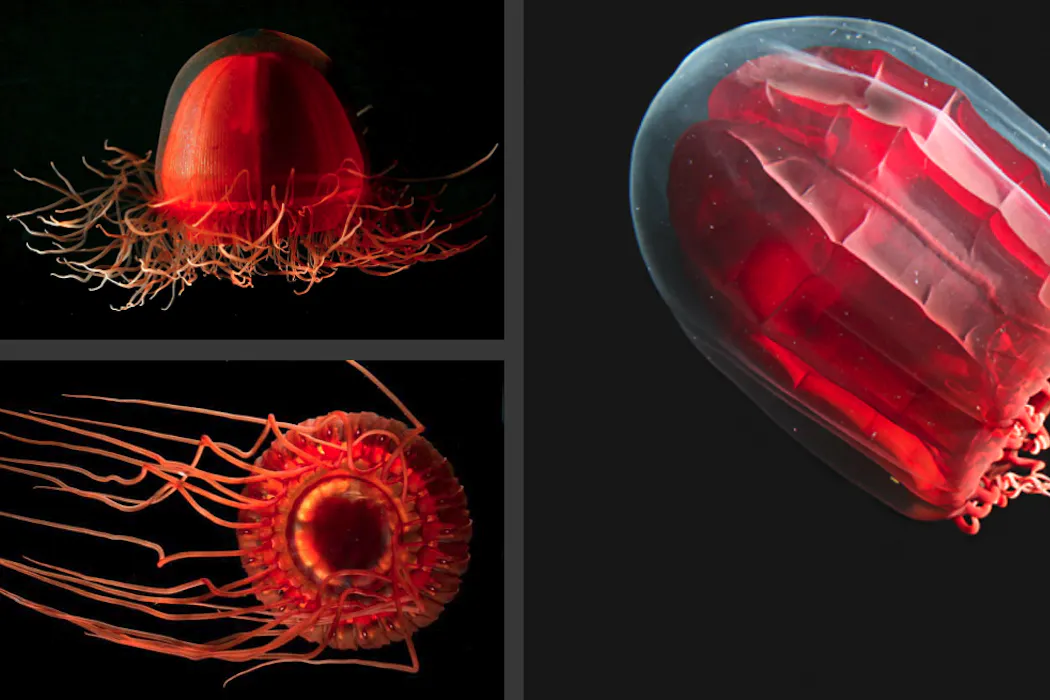

Les animaux bioluminescents, ou pourquoi il ne fait pas totalement noir dans les abysses

À l’instar de Rimicaris, les espèces abyssales évoluent dans des environnements obscurs dépourvus de lumière solaire. Il existe cependant une autre source lumineuse majeure : la bioluminescence. Plus faible que la lumière solaire, elle n’est apparente que la nuit dans les eaux de surface, mais elle est nettement visible en profondeur grâce au contraste avec le fond noir. Cette lumière émise par les organismes révèle la présence de partenaires, de prédateurs, de sources de nourriture, et peut aussi servir de défense, de leurre ou de camouflage. Dans la zone crépusculaire, diverses espèces arborent ainsi un ventre bioluminescent qui les rend moins visibles aux prédateurs et aux proies situés en dessous. Cette contre-illumination leur permet en effet de se fondre dans la faible luminosité provenant de la surface.

Au-delà de 1 000 mètres, la bioluminescence constitue la principale, sinon la seule, source de lumière. Elle apparaît de façon intermittente sous forme d’éclairs lumineux, le plus souvent de couleur bleue ou verte, qui durent quelques dixièmes de secondes à quelques secondes. Des observations menées au large de New York dans les années 1950 rapportent des fréquences de signaux bioluminescents allant jusqu’à 94 éclairs par minute dans le champ de vision du photomètre pour des profondeurs au-delà de 1 000 mètres. Dans les années 2000, un inventaire de la faune au large de la côte californienne, de la surface jusqu’à 3 900 mètres de profondeur, a révélé que plus de trois quarts des individus de la colonne d’eau émettent de la lumière. Les océans crépitent d’un feu d’artifice silencieux et le paysage lumineux des profondeurs se présente comme un fond noir piqueté d’étincelles bleutées.

Les yeux adaptés aux paysages obscurs

Dans ces paysages obscurs, les animaux sont-ils aveugles ? Les yeux des poissons téléostéens peuplant les profondeurs sont souvent décrits comme étant « régressés » ou « dégénérés ». Pourtant, ces yeux existent bel et bien et les poissons des profondeurs ne sont généralement pas aveugles, bien au contraire. Les yeux des poissons bathypélagiques présentent une grande variété de morphologies : ils sont parfois clairement régressé avec une rétine absente ou défectueuse, comme chez les « poissons-baleines » du genre Cetomimus, ou au contraire très grands et développés, comme ceux de l’alépocéphale à bec (Alepocephalus rostratus).

Dans l’ensemble, à quelques exceptions près, les yeux des espèces bathypélagiques ont toutefois tendance à être plus petits (par rapport à la taille du corps) que ceux de leurs cousins de la zone mésopélagique. Ils sont néanmoins parfaitement fonctionnels et particulièrement efficaces pour détecter des éclairs de bioluminescence ponctuels, grâce à deux caractéristiques notables : une large pupille et une rétine riche en photorécepteurs très sensibles à la lumière. Le record est actuellement détenu par la dirette argentée, une espèce abyssale qui possède un nombre exceptionnel de pigments responsables de la détection de faible luminosité, les rhodopsines. Alors que l’humain ne possède qu’un seul exemplaire de rhodopsine, la dirette en possède 38 ! Chacune de ces rhodopsines serait capable de détecter une couleur dans la gamme des bleus et des verts. Cet exceptionnel répertoire de pigments permet donc à la dirette de distinguer davantage de nuances de lumière bleue et de lumière verte que l’être humain, ce qui s’avère très utile pour identifier différentes sources de bioluminescence, et ainsi distinguer les prédateurs et les proies.

Comme la dirette, la majorité des poissons des grands fonds possède une vision limitée aux longueurs d’onde bleues et vertes. Ils ne peuvent percevoir les autres couleurs, et sont de ce fait daltoniens ! Les poissons bathypélagiques seraient en théorie capables de voir un flash bioluminescent à une distance pouvant aller jusqu’à 100 mètres dans une eau limpide. Cependant, cette distance est en réalité inatteignable pour la plupart des poissons pélagiques, qui n’ont pas l’énergie suffisante pour nager jusqu’à une source lumineuse à une telle distance en un laps de temps court. Ainsi, même si les poissons des profondeurs peuvent voir des éclairs lointains, ils ne réagissent probablement qu’à ceux produits à une distance plus proche.

Tout comme les poissons bathypélagiques, les crustacés de ces profondeurs présentent une grande variété de morphologie des yeux. Là encore, on retrouve des exemples d’yeux particulièrement sensibles à la lumière et adaptés à la détection de la bioluminescence. Le record revient probablement aux grands yeux de l’ostracode Gigantocypris muelleri, qui possèdent des réflecteurs qui ressemblent à des phares de voiture et des photorécepteurs géants qui lui confèrent une sensibilité à la lumière impressionnante. Il est ainsi capable de distinguer les silhouettes de proies et de prédateurs qui se profilent contre la faible lumière descendant dans la colonne d’eau au-dessus de lui, et il peut déjouer le camouflage en contre-illumination des espèces bioluminescentes de la zone crépusculaire. S’il est capable de détecter efficacement la bioluminescence, ce crustacé ne peut en revanche voir avec précision l’organisme qui la produit, car ses yeux possèdent une faible résolution, ce qui fait qu’il voit flou !

Dans les grands fonds, on trouve donc des espèces dont la vision s’est adaptée pour percevoir de très faibles intensités lumineuses, et dans un répertoire de couleurs spécialisé, plutôt que pour produire une image nette et détaillée de leur environnement.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

23.04.2026 à 16:14

Des manchots de l’Antarctique à l’explicabilité en IA. Bienvenue en prétopologie !

Guillaume Guérard, Enseignant-chercheur, Intelligence Artificielle, ESILV, Pôle Léonard de Vinci

Texte intégral (2074 mots)

La plupart des algorithmes performants actuels – notamment l’apprentissage profond (deep learning) et ses réseaux de neurones – fonctionnent comme des boîtes noires. On sait qu’ils donnent de bons résultats, mais impossible de comprendre leur logique interne. Ceci pose problème pour de nombreux domaines d’application (médecine, justice…), ce qui incite les régulateurs à exiger des systèmes « explicables ». Plusieurs pistes vers l’explicabilité existent. Zoom sur la « prétopologie ».

Imaginons un patient dont les résultats sanguins montrent un taux d’hémoglobine de 12,5 grammes par décilitres de sang. Un algorithme de détection précoce du cancer analyse ces chiffres, mais aussi ses antécédents familiaux (présents ou absents), son statut de fumeur (oui ou non), son niveau d’activité physique (faible, moyen, élevé). L’algorithme le classe dans un groupe à risque modéré. Mais quand son médecin lui demande pourquoi, le système ne peut pas répondre : c’est une boîte noire.

Et c’est évidemment un problème pour le patient, le médecin, l’assurance maladie, etc. C’est pour cela que l’AI Act européen, adopté en mars 2024, impose des obligations strictes aux organisations et entreprises opérant en Europe. D’ici 2026-2027, tous les systèmes d’IA dits à haut risque devront être « transparents » et « explicables », c’est-à-dire dont un humain puisse comprendre la logique. Les sanctions pourront atteindre 35 millions d’euros ou 7 % du chiffre d’affaires annuel mondial, car les domaines concernés peuvent avoir des effets importants.

Par exemple, en ressources humaines, les logiciels de tri de CV qui analysent à la fois des niveaux de diplômes, des années d’expérience et des compétences techniques doivent pouvoir justifier pourquoi un candidat est retenu et un autre écarté. Dans l’industrie énergétique, les systèmes de maintenance prédictive qui combinent données de capteurs (température, vibrations), historique de maintenance et type d’équipement doivent expliquer pourquoi une éolienne ou un autre équipement est signalé comme « à risque de panne ».

Pour contrer l’« effet boite noire » des systèmes d’IA actuels, nous proposons une méthode issue d’une discipline méconnue du grand public, la « pré-topologie », qui permet de rendre explicables les raisonnements faits sur des données mixtes (le taux d’hémoglobine est un chiffre tandis que la présence ou non d’antécédents familiaux ne se chiffre pas).

Qu’est-ce que la prétopologie ?

- La prétopologie, c’est l’art de dessiner des « zones d’influence » autour de chaque personne ou objet dans un réseau – comme les cercles d’amis sur les réseaux sociaux, où l’influence n’est pas forcément réciproque.

- Pour décrire une zone complexe, elle utilise une recette appelée forme normale disjonctive, qui assemble des blocs de base, puis calcule automatiquement tout ce qui « adhère » à cet assemblage, c'est-à-dire tout ce qui gravite naturellement autour de lui.

Les limites des méthodes actuelles pour rendre les systèmes d’IA « explicables »

Le clustering hiérarchique est aujourd’hui la méthode de référence pour regrouper automatiquement des observations similaires et donc pour rendre les données plus interprétables : en organisant les observations en une hiérarchie de groupes emboîtés (un dendrogramme), il permet à un expert de naviguer entre niveaux de granularité, d’identifier des profils types et d’expliquer pourquoi deux individus sont regroupés ensemble, sans avoir à ouvrir la “boîte noire” d’un modèle prédictif.

Son fonctionnement est simple et transparent. On mesure d’abord la distance entre chaque paire d’observations. Ensuite, on regroupe progressivement les observations les plus proches. Enfin, on obtient un arbre (appelé dendrogramme) qu’on peut couper à différents niveaux pour former des groupes.

Prenons l’exemple des manchots de l’archipel Palmer en Antarctique. Si on mesure la longueur de leur bec et leur masse corporelle, le clustering hiérarchique identifie automatiquement trois groupes qui correspondent aux trois espèces biologiques présentes : Adélie, Jugulaire et Papou. L’atout majeur est sa transparence : on visualise l’arbre, on suit les regroupements successifs, on comprend facilement comment les groupes se sont formés, la hauteur d’embranchement donne une idée de la « différence » entre deux groupes.

Le défi survient quand on mélange chiffres et catégories. Mesurer une distance entre deux chiffres est facile : si un patient a une glycémie de 5,5 millimoles par litres (une unité de concentration) et un autre de 6,2 millimoles par litres, la différence est de 0,7. Mais comment mesurer la distance entre deux « catégories » que l’on ne peut pas chiffrer, comme une réponse oui ou non (fumeur ou non-fumeur), ou encore la couleur d’un tissu biologique ?

Par exemple, dans notre exemple de détection précoce du cancer, si le patient A présente une concentration d’hémoglobine de 12,5 grammes par décilitres (chiffre), des antécédents familiaux (catégorie « oui ») et ne fume pas (catégorie « non ») ; tandis que le patient B présente une concentration d’hémoglobine de 13,1 grammes par décilitres, pas d’antécédents et fume… comment dire si ces deux patients sont « proches » ou « éloignés », en termes de risques ?

Les solutions existantes, comme le k-means, HDBSCAN et DIANA ont toutes des limites. Transformer les catégories en chiffres artificiels (« oui » = 1, « non » = 0) est arbitraire et fait perdre du sens. Plus précisément, ceci signifie que l’on introduit une relation d’ordre et une distance qui n’existent pas : coder « chat » = 1, « chien » = 2, « oiseau » = 3 suggère implicitement que chien est « entre » chat et oiseau, ou que la distance chat-chien est égale à chien-oiseau, ce qui peut biaiser tous les calculs de similarité en aval.

Ignorer les catégories pour ne garder que les chiffres, comme dans les méthodes citées précédemment, fait perdre des informations cruciales comme les antécédents familiaux. Les méthodes statistiques plus complexes sont souvent opaques ou nécessitent des hypothèses fortes sur la structure des données. C’est le cas de la distance de Gower ou de l’analyse des facteurs latents – le genre de structure qui peut se cacher derrière les grands modèles de langage (LLM).

C’est précisément dans la définition de ces voisinages – comment mesurer qu’un patient « ressemble » à un groupe malgré des données hétérogènes – que la prétopologie offre un cadre naturel : elle permet de construire des zones d’influence flexibles, sans imposer de distance artificielle ni d’hypothèses sur la structure des données.

Une solution en développement : mesurer la similarité autrement

Pour cela, au lieu de chercher à mesurer des distances, nous proposons de changer de perspective en définissant des « voisinages », construits via des formes normales disjonctives, ou DNF. Derrière ce nom se cachent des règles logiques simples du type : « Un patient appartient au voisinage d’un groupe si (il est diabétique ET âgé de plus de 60 ans) OU (il a des antécédents familiaux ET est hypertendu) ». Chaque condition entre parenthèses est un bloc ; le voisinage est l’union de ces blocs. Pas de chiffres, pas de distance : seulement des combinaisons de caractéristiques, comme des règles de décision lisibles.

Une fois les voisinages définis, on calcule pour chaque groupe l’ensemble de tous les patients qui lui « adhèrent » – c’est-à-dire qui tombent dans au moins un de ces blocs DNF. Ce calcul d’adhérence est itératif : à chaque étape, des patients rejoignent ou quittent un groupe, jusqu’à stabilisation. Le résultat est analogue à un dendrogramme : on obtient une hiérarchie de regroupements successifs, du plus local (blocs fins, peu de patients) au plus global (grands groupes stables), sans avoir jamais posé de distance artificielle entre catégories et chiffres.

Une analogie aide à comprendre. Sur une carte géographique, on mesure la distance entre Paris et Lyon en kilomètres. Mais on peut aussi dire que Dijon est voisine de Lyon parce qu’elles partagent des caractéristiques : région similaire, climat comparable, économie proche. Cette notion de « voisinage » par caractéristiques communes ne nécessite pas de calculer une distance précise.

Notre algorithme en accès libre pour des études pilotes

C’est le principe de base de PretopoMD, notre algorithme qui classe automatiquement des données mixtes (chiffres et catégories) tout en rendant explicite sa logique de regroupement. Pour les chiffres, deux valeurs sont voisines si elles tombent dans la même fenêtre : toutes les glycémies entre 5 et 7 mmol/L sont voisines. Pour les catégories, deux observations sont voisines si elles partagent la même modalité : deux patients sont voisins s’ils sont tous deux fumeurs, ou si tous deux ont des antécédents familiaux.

PretopoMD est d’ores et déjà disponible en accès libre pour permettre à des équipes en santé, RH ou maintenance de l’utiliser pour des études pilotes. À moyen terme, nous espérons que cette approche puisse aider les organisations européennes à répondre aux exigences de l’AI Act en proposant des classifications explicables par construction.

L’avantage clé est la traçabilité. Pour notre exemple médical, on peut dire :

« Les patients A et C sont dans le même groupe parce qu’ils partagent une glycémie dans la fenêtre 5-7 millimoles par litres (étape 1), tous deux ont des antécédents familiaux (étape 1), et tous deux ont un IMC entre 25-30 (étape 2). Le patient B les rejoint à l’étape 3 via un IMC similaire, malgré l’absence d’antécédents. »

Cette explication pas-à-pas répond directement aux exigences de l’AI Act. De plus, la structure hiérarchique est préservée, on peut identifier grands groupes et sous-groupes pertinents.

Néanmoins, notre algorithme possède des limites, puisqu’il faut choisir la taille des fenêtres et les seuils de similarité, faisant actuellement appel à un expert métier. Nous travaillons sur des méthodes pour automatiser ces choix.

Ainsi, la question reste ouverte : jusqu’où peut-on pousser la performance tout en conservant l’explicabilité ? Dans des domaines sensibles comme la santé ou le droit, ce compromis est-il acceptable ? Notre travail montre qu’on peut au moins explorer cette voie.

Guillaume Guérard ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

22.04.2026 à 16:01

Comment l’IA apprend le langage secret de l’ADN, et ce que la recherche y gagne

Julien Mozziconacci, Professeur en biologie computationelle, Muséum national d’histoire naturelle (MNHN)

Élodie Laine, Professeure en biologie computationnelle, Sorbonne Université

Texte intégral (2133 mots)

Plutôt que de produire des mots, le modèle d’intelligence artificielle Evo 2 est capable de prédire une base d’ADN en se fondant sur une séquence donnée. Lancé, il y a un peu plus d’un an, le modèle s’affine et permet aux scientifiques de mieux comprendre le langage de l’ADN. Sa puissance de calcul pose néanmoins des questions de ressources énergétiques.

Si vous avez déjà utilisé un modèle de langage comme ChatGPT ou Mistral, vous vous souvenez sans doute de la première impression : orthographe impeccable, grammaire fluide, phrases qui ont du sens. Pourtant, sous le capot, ces systèmes ne font qu’une chose très simple : prévoir dans une phrase le mot qui va suivre. Ils utilisent des statistiques apprises sur un immense corpus de textes, et c’est ainsi qu’ils « parlent » français, anglais et bien d’autres langues.

Une idée féconde a alors germé chez les généticiens : et si l’on entraînait la même classe de modèles pour apprendre le langage de la vie, la suite de lettres A, T, G, C, inscrite dans nos génomes ? C’est le pari des modèles de langage génomiques : ils apprennent la grammaire cachée de l’ADN et offrent à la recherche un allié précieux pour explorer, proposer et tester plus vite des hypothèses scientifiques.

Que fait un modèle d’IA ?

Un algorithme d’intelligence artificielle (IA) est, au fond, une machine à transformer des nombres. Les données d’entrée, qui peuvent être des images, des sons ou du texte, sont d’abord encodées en chiffres. Puis l’algorithme applique des opérations simples (additions et multiplications par des paramètres internes au réseau et seuillage) et renvoie les résultats (d’autres chiffres) en sortie. À grande échelle, cette mécanique très simple suffit à jouer au go, à conduire une voiture… ou à comprendre les génomes.

L’astuce, ce n’est pas seulement l’encodage : c’est surtout l’apprentissage. Le modèle ajuste ses paramètres internes à chaque exemple (association entre une entrée et une sortie cible), un peu comme on accorde un instrument : à chaque note jouée, on tend ou détend la corde jusqu’à ce que la mélodie sonne juste.

Les applications de ce principe simple sont multiples et variées. Au jeu de go, l’IA regarde la position des pierres (un tableau de chiffres) et propose le prochain coup ; dans une phrase, le modèle suggère le prochain mot. En génomique, il lit A T G C… et prédit la prochaine base. Si ses prédictions sont bonnes, c’est qu’il a appris quelque chose sur la structure cachée du problème qu’il résout.

Les premiers modèles de langages génomiques

C’est en suivant ce principe que les premiers modèles de langage génomiques ont été entraînés en utilisant des génomes à la place des corpus de texte. Une des versions les plus récentes, Evo 2, a été développée par une large équipe autour du centre de recherche Arc Institute, dans la Silicon Valley. Ce modèle a été entraîné sur de nombreux génomes, comptabilisant près de 10 000 milliards de bases (les fameuses lettres A,C,G,T) ce qui représente 3 000 fois la taille de notre génome.

Le modèle lit à chaque étape un million de bases et le calcul revient toujours à la même question très simple : parmi les quatre lettres possibles (A, C, G ou T), laquelle est la plus probable juste après celles que l’on vient de lire ? La taille gigantesque de sa « fenêtre de lecture » lui permet de saisir à la fois des règles locales et des dépendances lointaines (régulations des gènes à distance). Ce saut d’échelle n’est pas qu’une prouesse technique : il change la manière dont on peut poser des questions en biologie, notamment dans ces régions non codantes (celles qui ne sont pas traduites en protéines) qui restent souvent incomprises et constituent la « matière noire » du génome.

Dans la pratique, l’apprentissage ressemble à une partie de devinettes : à chaque fois que le modèle devine correctement une lettre masquée au sein d’une séquence, il renforce les chemins internes qui l’y ont mené ; lorsqu’il se trompe, il corrige ces chemins. À force, il repère des schémas récurrents : certains motifs précèdent souvent le début d’un gène, d’autres signalent la fin, et certains motifs de la séquence trahissent la façon dont la cellule découpe l’ARN (l’épissage) ou assemble la machinerie de traduction des ARN en protéines.

L’apprentissage se fait d’abord à l’échelle globale. Le modèle lit une grande diversité de génomes et apprend une grammaire générale du vivant. Ensuite, on peut éventuellement l’adapter à une famille d’organismes ou à une question précise (par exemple, en le spécialisant sur un groupe de virus ou de bactéries).

L’IA apprend la grammaire cachée de l’ADN

C’est ici que la recherche s’enthousiasme : en apprenant juste à compléter les séquences, les modèles reconnaissent des signatures biologiques sans qu’on les leur ait pointées du doigt.

Ils retrouvent la périodicité en trois lettres du code génétique : le texte du vivant se lit par triplets (les codons), et les modèles « entendent » ce rythme, comme une mesure en musique. Ils repèrent aussi les départs et arrêts de gènes, avec des contraintes fortes sur les lettres les plus importantes, où l’on s’attend à ce que l’erreur soit rare. Ils détectent des signaux utiles à la machinerie cellulaire : chez les bactéries, les sites de liaison du ribosome ; chez les eucaryotes, les frontières entre exons (conservés) et introns (séquences à retirer), comme si le modèle distinguait les paragraphes et les espaces dans un texte.

Plus étonnant, ils révèlent aussi les éléments mobiles (par exemple, des virus intégrés au génome au cours de l’évolution) et même des empreintes liées aux formes 3D des protéines (hélices α, feuillets β) et des ARN. Le modèle dessine alors les contours de la sculpture finale. Car c’est bien de sculpture qu’il s’agit.

Le génome ne contient pas seulement des instructions – il encode des formes. Une protéine, un ARN, ne sont pas de simples colliers de lettres : ils se replient, se tordent, se nouent dans l’espace pour adopter une architecture précise, dont dépend leur fonction. C’est cette forme qui permet à une molécule de reconnaître une autre, de s’y accrocher, de déclencher une réaction. Les contacts qui stabilisent cette forme se font parfois entre des régions très éloignées dans la séquence – et pourtant, les modèles semblent capables de les capturer, comme s’ils devinaient, à force de lire le texte, quelles lettres se correspondent malgré la distance qui les sépare.

Ce qui peut surprendre, c’est que ces découvertes n’ont pas été enseignées : elles émergent spontanément de l’apprentissage. Et parfois, paradoxalement, quand on essaie d’affiner le modèle en lui montrant des exemples bien connus, il perd une partie de ce qu’il avait trouvé seul. Comme si trop guider l’élève lui faisait oublier ce qu’il avait intuitivement compris.

Pour rendre cette « boîte noire » plus lisible, les chercheurs utilisent des « autoencodeurs clairsemés » qui décomposent les représentations internes du modèle en traits compréhensibles. Chaque trait s’allume comme une lampe au-dessus d’un élément de séquence (exon, motif, élément mobile). Ces traits servent de fil d’Ariane. Ils indiquent où le modèle a vu un signal, de quel type il est et comment il varie d’un organisme à l’autre. On peut même transférer ces traits vers des génomes peu étudiés, ouvrant la voie à des atlas fonctionnels multi‑espèces construits de manière plus rapide et moins coûteuse que par les approches classiques.

Dans nos propres recherches, Evo 2 est surtout un point de comparaison : il montre jusqu’où peut aller un très grand modèle quand on lui donne énormément de données et de puissance de calcul. Il faut aussi voir que cette démonstration a une dimension vitrine pour Nvidia, le plus gros fabricant de processeurs pour l’IA, qui a mis sa puissance de calcul au service de l’Arc Institute pour concevoir Evo 2. L’idée sous-jacente est de montrer qu’il faut des modèles gigantesques et des infrastructures de calcul hors normes pour déchiffrer le secret de la vie. Le résultat est impressionnant, mais ce n’est pas forcément le seul chemin possible pour faire avancer la biologie.

Nous avons justement lancé le projet PLANETOID, financé dans le cadre de France 2030, pour explorer une stratégie complémentaire : construire des modèles beaucoup plus petits, plus rapides, plus faciles à entraîner et à déployer dans des laboratoires académiques. L’objectif est d’exploiter des données de biodiversité riches, produites par nos partenaires – en particulier au Muséum national d’histoire naturelle et dans les stations marines – afin d’annoter des génomes et des métagénomes (des ensembles de génomes) à l’échelle de l’arbre du vivant, y compris pour des espèces dites « non modèles », qui représentent l’immense majorité du vivant, mais restent souvent mal comprises.

PLANETOID vise aussi à produire des ressources et des outils réutilisables, pour que ces approches ne restent pas réservées à quelques acteurs capables de mobiliser des moyens industriels, mais puissent irriguer la recherche publique, puis à terme la santé et l’environnement.

Le futur : estimer l’effet d’une mutation ou écrire de nouveaux génomes

Parce qu’un modèle de langage assigne une vraisemblance à chaque séquence, il devient possible de comparer la version de référence et une version mutée. Si la mutation fait chuter la vraisemblance, elle devient suspecte. Ce score agit comme une carte pour guider les chercheurs : il montre des zones où une variation risque de perturber une fonction et oriente les expériences à prioriser.

Une autre application a le vent en poupe : la génération de séquences « fonctionnelles » in silico. Les chercheurs ont montré qu’on peut composer du texte génétique qui a toutes les caractéristiques de génomes naturels. Toutefois cette pratique soulève d’importantes questions éthiques (risques eugénistes, possibilité de virus synthétiques…) et doit rester strictement encadrée – c’est un sujet de société plus qu’un enjeu immédiat de recherche.

Julien Mozziconacci est professeur au Muséum National d'Histoire Naturelle et membre junior de l'Institut Universitaire de France. Il a reçu des financements de l'Agence Nationale de la Recherche (ANR, France 2030, PostGenAI@Paris). Les points de vue et opinions exprimés sont toutefois ceux des auteurs uniquement et ne reflètent pas nécessairement ceux des instituts qui les ont financés.

Élodie Laine ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

20.04.2026 à 15:44

« StravaLeaks » : quand les traces numériques deviennent un enjeu de sécurité

Fabrice Lollia, Docteur en sciences de l'information et de la communication, chercheur associé laboratoire DICEN Ile de France, Université Gustave Eiffel

Texte intégral (1607 mots)

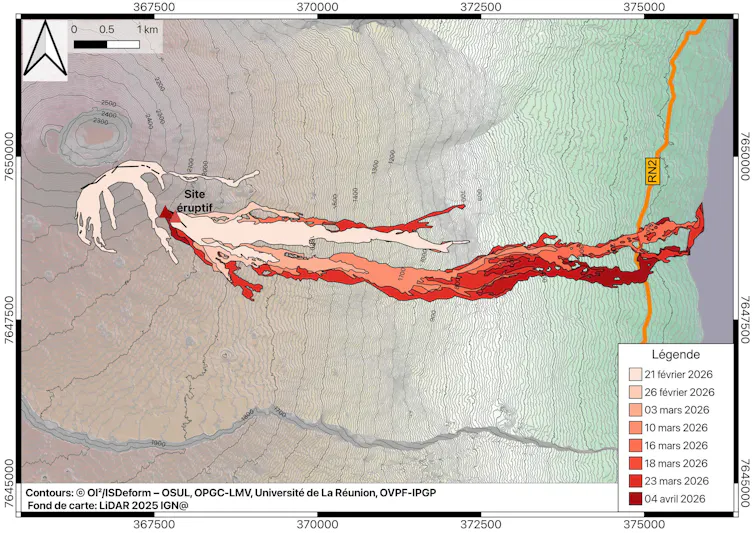

L’affaire « StravaLeaks » montre que, dans un monde saturé d’objets connectés et de données de localisation, les traces numériques ordinaires sont devenues un enjeu central de sécurité pour les environnements sensibles. De simples données de déplacement issues d’un footing, enregistrées et partagées par une application publique, ont pu être utilisées pour localiser des navires ou des bases militaires.

Un footing, en apparence, n’a rien de sensible. Pourtant, en mars 2026, une activité enregistrée sur Strava par un militaire français a permis de localiser en temps quasi réel le porte‑avions Charles-de-Gaulle en Méditerranée orientale. Dès 2018, la carte de chaleur mondiale de Strava – une visualisation agrégée des activités publiques enregistrées par ses utilisateurs – avait déjà révélé des bases militaires et des sites sensibles, et des enquêtes plus récentes ont montré que les pratiques sportives de gardes du corps pouvaient trahir des habitudes de déplacement de chefs d’État.

Le problème ne vient pas d’un piratage sophistiqué, mais d’un usage banal de montre connectée, compte public et trace GPS accessible en ligne. Ce cas illustre comment la sécurité d’aujourd’hui ne se limite plus à la protection physique, mais inclut aussi la maîtrise des traces numériques produites par nos comportements les plus ordinaires.

Quand une application déborde de son usage initial

Strava est une application conçue pour suivre et partager des performances sportives. Son usage premier relève du loisir, de la sociabilité numérique et du suivi de soi, non de la documentation d’activités sensibles. C’est pourtant là toute l’ambivalence de ce type d’outils car sans avoir été pensés pour la sécurité, ils peuvent produire des effets très concrets sur elle.

À mesure que les technologies de traçabilité s’installent dans les usages quotidiens, elles cessent d’apparaître comme des dispositifs de contrôle. Elles deviennent des outils familiers, associés au confort ou à l’optimisation des pratiques. Dès lors, une course, un itinéraire répété, un point de départ ou d’arrivée ou une activité enregistrée en mer peuvent révéler bien davantage qu’une simple pratique sportive. Une donnée de performance peut devenir un indice sur une routine, une présence ou une habitude de déplacement.

Le cas Strava n’est d’ailleurs pas isolé. À l’aéroport d’Heathrow (Londres), en 2014, des toilettes connectées ont été testées pour mesurer anonymement leur fréquentation, améliorer le nettoyage et mieux répartir les moyens de maintenance. L’exemple peut sembler éloigné, mais il montre que, au-delà des outils explicitement sécuritaires, des dispositifs connectés collectent eux aussi discrètement des traces numériques sur les comportements des usagers. En ce sens, la vulnérabilité ne naît plus seulement d’une attaque ou d’une fuite volontaire, mais aussi d’usages ordinaires dont les effets de visibilité sont souvent sous-estimés.

La sécurité ne se joue plus seulement sur le terrain

Longtemps, la sécurité a été pensée selon un modèle essentiellement physique. Il fallait protéger une personne, sécuriser un déplacement, contrôler un périmètre, anticiper une menace. Cette logique est toujours d’actualité mais, à l’ère numérique, elle ne suffit plus.

Dans un environnement saturé d’objets connectés, de plateformes et de données de localisation, la vulnérabilité peut désormais naître à la périphérie du dispositif de protection. Elle ne résulte plus forcément d’une intrusion ou d’une action malveillante. Elle peut venir d’un usage mal paramétré, d’une routine numérique non interrogée ou d’un outil utilisé sans conscience de ses effets de visibilité.

La sécurité d’un responsable politique, d’un chef d’entreprise, d’un diplomate ou d’un site sensible dépend donc aussi des traces numériques produites par son environnement humain et technique : assistants, chauffeurs, escortes, collaborateurs, militaires, objets connectés, applications de suivi ou réseaux de partage. Protéger une « personne sensible », une personnalité, aujourd’hui, ce n’est plus seulement protéger son corps ou son itinéraire. C’est aussi protéger l’écosystème informationnel qui l’entoure.