25.02.2026 à 17:08

Lever le voile sur les microbiotes inconnus des coraux du Pacifique à bord de « Tara »

Shinichi Sunagawa, Associate Professor at the Department of Biology, Swiss Federal Institute of Technology Zurich

Chris Bowler, Directeur du laboratoire de génomique des plantes et des algues à l'Institut de Biologie, École normale supérieure (ENS) – PSL; Centre national de la recherche scientifique (CNRS)

Texte intégral (1508 mots)

Depuis des décennies, nous voyons les récifs coralliens comme les « forêts tropicales aquatiques » : des écosystèmes colorés et complexes regorgeant de poissons, d’éponges et de coraux. Cependant, nos recherches récentes suggèrent que cette vision passe sous silence un aspect crucial des récifs coralliens. Au-delà de leurs couleurs si vivaces, ils abritent tout un monde microscopique. Cet univers caché se compose de nombreux ingénieurs chimistes, qui pourraient détenir les clés d’une prochaine génération de médicaments vitaux.

Nos travaux, publiés aujourd’hui dans Nature, fruit d’une collaboration internationale entre mon laboratoire et ceux des professeurs Paoli et Piel avec la Fondation Tara Océan, montrent que les coraux ne sont pas de « simples » animaux individuels, mais plutôt des « super-organismes ». On pourrait les imaginer comme des villes animées où le récif corallien fournit un habitat vivant à des milliards de microbes qui y accomplissent des fonctions vitales.

Ce que nous avons découvert au sein de ces communautés microscopiques nous a stupéfiés : en analysant 820 échantillons provenant de 99 récifs coralliens à travers le Pacifique, nous avons reconstitué le génome de 645 espèces microbiennes vivant dans les coraux… dont plus de 99 % étaient totalement inconnues.

Qui plus est, nos études génétiques montrent que ces minuscules résidents ne sont pas passifs, mais des ingénieurs chimistes prolifiques : ils abritent dans leur ADN une immense variété de « plans » biosynthétiques (qui visent la formation de composés chimiques par des êtres vivants, des bactéries par exemple). Cette variété est plus grande que ce qui a été documenté jusqu’à présent dans l’ensemble des océans du monde.

Comment avons-nous fait cette découverte ?

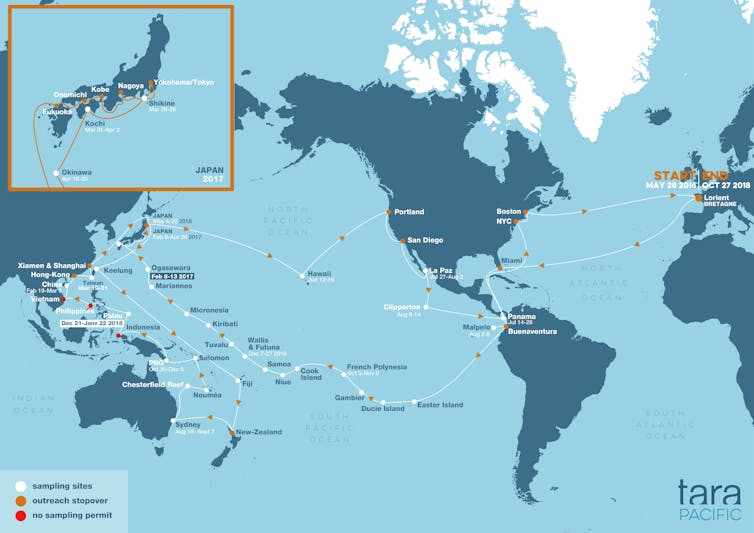

Notre découverte a commencé à bord de la goélette de recherche Tara, longue de 36 mètres et conçue pour résister à la glace arctique. Après avoir mené une exploration approfondie du plancton dans les océans du globe, Tara nous a servi de laboratoire flottant pour la mission Tara Pacific. Pendant plusieurs années, notre équipe a visité 99 récifs à travers le Pacifique. La vie à bord de Tara, c’est l’unique combinaison d’une navigation pas toujours paisible et d’une biologie high tech : tandis que l’équipage gérait le navire, des équipes de plongeurs collectaient des échantillons de coraux dans des archipels éloignés de plusieurs milliers de kilomètres.

De retour à terre, un vrai travail de détective a commencé. Le séquençage de l’ADN au Centre national de séquençage français (Genoscope) et la reconstruction des génomes à l’aide des supercalculateurs de l’ETH Zurich nous ont permis de décoder les informations génétiques des microbes coralliens.

Ainsi est apparue une carte des microbiomes coralliens du Pacifique, à une échelle inédite. Nous avons découvert que les microbes sont très spécifiques à leurs hôtes coralliens ; chaque espèce de corail possède sa propre empreinte microbienne façonnée au cours de millions d’années d’évolution.

En quoi cette découverte est-elle importante ?

La plupart des médicaments actuels ont été découverts dans la nature, le plus souvent à partir de bactéries du sol. Mais aujourd’hui, les bactéries résistantes aux antibiotiques constituent une menace mondiale croissante et nous sommes à court de nouvelles pistes dans le sol.

À lire aussi : De la médecine traditionnelle au traitement du cancer : le fabuleux destin de la pervenche de Madagascar

C’est là que les minuscules mais puissants « ingénieurs chimistes » des récifs coralliens prennent toute leur importance en termes d’applications potentielles. Dans leur ADN, ces microbes codent des ensembles de gènes biosynthétiques : des manuels d’instructions pour construire diverses molécules biochimiques, y compris des antibiotiques.

En effet, comme les microbes associés aux coraux vivent dans l’environnement hautement compétitif des récifs, ils ont développé des armes chimiques sophistiquées pour défendre leurs hôtes ou combattre leurs rivaux. En identifiant ces ensembles de gènes biosynthétiques, nous avons donc découvert une « bibliothèque moléculaire » écrite dans un langage que nous commençons seulement à traduire. Ces substances chimiques pourraient peut-être apporter des solutions aux défis biotechnologiques et aux maladies humaines.

Quelle est la prochaine étape ?

Notre découverte de nouvelles espèces microbiennes et de la diversité biochimique des coraux n’est qu’un début. L’expédition Tara Pacific n’a étudié qu’une poignée d’espèces de coraux, alors qu’au moins 1500 ont été décrites dans le monde entier, ce qui suggère un énorme potentiel de percées scientifiques.

Mais une tragédie est en train de se dérouler : à mesure que le changement climatique réchauffe les océans, les récifs coralliens meurent. Lorsqu’un récif disparaît, nous ne perdons pas seulement un magnifique écosystème, nous assistons à la « combustion » de cette bibliothèque, avant même d’avoir eu la chance d’en lire les livres.

Le voyage qui a commencé sur Tara est désormais une course contre la montre pour percer les secrets contenus dans les microbiomes des coraux et autres organismes récifaux avant qu’ils ne disparaissent à jamais. Il est essentiel de protéger les récifs, non seulement pour l’environnement et les millions de personnes qui en dépendent directement, mais aussi pour préserver la pharmacie biologique qui pourrait protéger la santé humaine pour les générations à venir.

Tout savoir en trois minutes sur des résultats récents de recherches, commentés et contextualisés par les chercheuses et les chercheurs qui les ont menées, c’est le principe de nos « Research Briefs ». Un format à retrouver ici.

Shinichi Sunagawa a reçu des financements de la Swiss National Science Foundation.

Chris Bowler ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

25.02.2026 à 16:48

Un singe star du Net, sa peluche et une expérience vieille de 70 ans : ce que Punch nous dit de la théorie de l’attachement

Mark Nielsen, Associate Professor, School of Psychology, The University of Queensland

Texte intégral (1554 mots)

La vidéo d’un petit singe blotti contre une peluche a ému la planète. Derrière l’émotion, elle rappelle une leçon majeure de la psychologie : on ne grandit pas seulement avec de la nourriture, mais avec du lien.

Sa quête de réconfort a ému des millions d’internautes. Punch, un bébé macaque, est devenu une célébrité d’Internet. Abandonné par sa mère et rejeté par le reste de son groupe, il s’est vu offrir par les soigneurs du zoo municipal d’Ichikawa, au Japon, une peluche d’orang-outan pour lui servir de mère de substitution. Les vidéos le montrant agrippé au jouet ont depuis fait le tour du monde.

Mais l’attachement de Punch à son compagnon inanimé ne se résume pas à une vidéo bouleversante. Il renvoie aussi à l’histoire d’une célèbre série d’expériences en psychologie, menées dans les années 1950 par le chercheur américain Harry Harlow.

Les résultats de ces travaux ont nourri plusieurs des principes fondamentaux de la théorie de l’attachement, selon laquelle le lien entre le parent et l’enfant joue un rôle déterminant dans le développement de ce dernier.

En quoi consistaient les expériences de Harlow ?

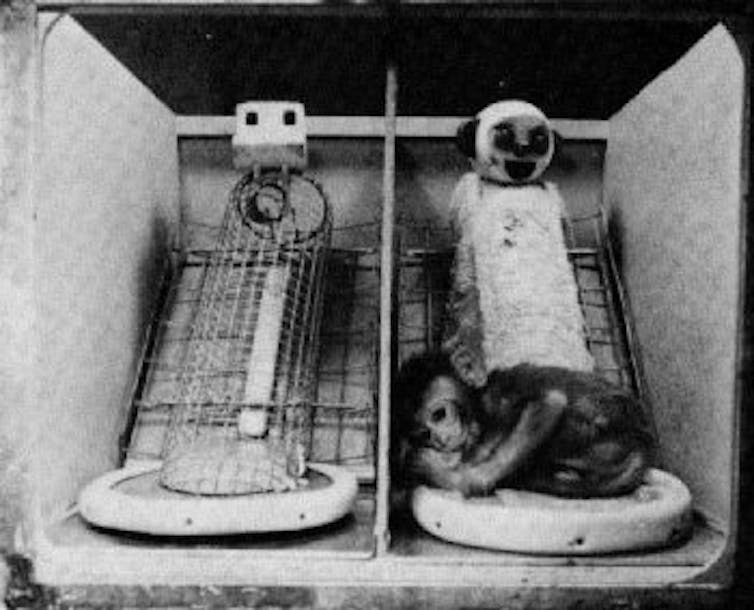

Harry Harlow a séparé des singes rhésus de leur mère dès la naissance. Ces petits ont ensuite été élevés dans un enclos où ils avaient accès à deux « mères » de substitution.

La première était une structure en fil de fer, à laquelle on avait donné la forme d’une guenon, équipée d’un petit dispositif permettant de fournir nourriture et boisson.

La seconde était une poupée en forme de singe, recouverte d’éponge et de tissu éponge. Douce et réconfortante, elle n’apportait pourtant ni nourriture ni eau : ce n’était guère plus qu’une silhouette moelleuse à laquelle le petit pouvait s’agripper.

On se retrouve donc avec, d’un côté, une « mère » qui offre du réconfort mais ni nourriture ni boisson, et, de l’autre, une structure froide, dure et métallique, qui assure l’apport alimentaire.

Ces expériences répondaient au béhaviorisme, courant théorique dominant à l’époque. Les béhavioristes soutenaient que les bébés s’attachent à celles et ceux qui satisfont leurs besoins biologiques, comme la nourriture et l’abri.

Harlow a ainsi battu en brèche cette théorie en affirmant qu’un bébé ne se construit pas seulement à coups de biberons : il a besoin de contact, de chaleur et d’attention pour s’attacher.

Selon une lecture strictement béhavioriste, les petits singes auraient dû rester en permanence auprès de la « mère » en fil de fer, celle qui les nourrissait. C’est l’inverse qui s’est produit. Ils passaient l’essentiel de leur temps agrippés à la « mère » en tissu, douce mais incapable de leur donner à manger.

Dans les années 1950, Harlow a ainsi démontré que l’attachement repose d’abord sur le réconfort et la tendresse. Face au choix, les bébés privilégient la sécurité affective à la simple satisfaction des besoins alimentaires.

En quoi cela a-t-il influencé la théorie moderne de l’attachement ?

La découverte de Harlow a marqué un tournant, car elle a profondément remis en cause la vision béhavioriste dominante à l’époque. Selon cette approche, les primates – humains compris – fonctionneraient avant tout selon des mécanismes de récompense et de punition, et s’attacheraient à celles et ceux qui répondent à leurs besoins physiques, comme la faim ou la soif.

Dans ce cadre théorique, la dimension affective n’avait pas sa place. En menant ses expériences, Harlow a renversé cette grille de lecture : il a montré que l’attachement ne se réduit pas à la satisfaction des besoins biologiques, mais repose aussi, et surtout, sur le lien émotionnel.

La préférence des petits singes pour la « nourriture émotionnelle » – en l’occurrence les câlins à la mère de substitution recouverte de tissu éponge – a posé les bases de la théorie de l’attachement.

Selon cette théorie, le développement harmonieux d’un enfant dépend de la qualité du lien qu’il tisse avec la personne qui s’occupe de lui. On parle d’attachement « sécurisé » lorsque le parent ou le proche référent apporte chaleur, attention, bienveillance et disponibilité. À l’inverse, un attachement insécure se construit dans la froideur, la distance, la négligence ou la maltraitance.

Comme chez les singes rhésus, nourrir un bébé humain ne suffit pas. Vous pouvez couvrir tous ses besoins alimentaires, mais sans affection ni chaleur, il ne développera pas de véritable attachement envers vous.

Que nous apprend le cas de Punch ?

Le zoo ne menait évidemment aucune expérience. Mais la situation de Punch reproduit, presque malgré elle, le dispositif imaginé par Harlow. Cette fois, ce n’est plus un laboratoire, mais un environnement bien réel – et pourtant, le résultat est étonnamment similaire. Comme les petits singes de Harlow qui privilégiaient la « mère » en tissu éponge, Punch s’est attaché à sa peluche Ikea.

Dans le cas du zoo, il manque évidemment un élément clé de l’expérience originale : il n’y a pas, en face, d’option dure mais nourricière avec laquelle comparer. Mais au fond, ce n’est pas ce que cherchait le singe. Ce qu’il voulait, c’était un refuge doux et rassurant – et c’est précisément ce que lui offrait la peluche.

Les expériences de Harlow étaient-elles éthiques ?

Aujourd’hui, une grande partie de la communauté internationale reconnaît aux primates des droits qui, dans certains cas, s’apparentent à ceux accordés aux humains.

Avec le recul, les expériences de Harlow apparaissent comme particulièrement cruelles. On n’envisagerait pas de séparer un bébé humain de sa mère pour mener une telle étude ; pour beaucoup, il ne devrait pas davantage être acceptable de l’infliger à des primates.

Il est frappant de voir à quel point ce parallèle avec une expérience menée il y a plus de 70 ans continue de fasciner. Punch n’est pas seulement la nouvelle star animale d’Internet : il nous rappelle l’importance du réconfort et du lien.

Nous avons tous besoin d’espaces doux. Nous avons tous besoin d’endroits où nous sentir en sécurité. Pour notre équilibre et notre capacité à avancer, l’amour et la chaleur humaine comptent bien davantage que la simple satisfaction des besoins physiques.

Mark Nielsen a reçu des financements de l'Australian Research Council.

24.02.2026 à 17:03

L’« IA edge », qu’est-ce que c’est et à quoi ça sert ?

Georgios Bouloukakis, Assistant Professor, University of Patras; Institut Mines-Télécom (IMT)

Texte intégral (2391 mots)

Pour analyser les énormes volumes de données, notamment ceux générés par les nombreux capteurs qui peuplent désormais nos vies – du lave-vaisselle à la voiture, sans parler de nos téléphones –, on les envoie sur le cloud. Pour permettre des calculs plus rapides et plus sécurisés, l’edge computing se développe. Son pendant IA est l’edge AI (en anglais), une manière de faire de l’IA sans recourir au cloud. Explications d’un spécialiste.

Les capteurs nous accompagnent partout : dans les maisons, dans les bureaux, à l’hôpital, dans les systèmes de transport et à la ferme. Ils offrent la possibilité d’améliorer la sécurité publique et la qualité de vie.

L’« Internet des objets » (IoT en anglais, pour Internet of Things) inclut les capteurs de température et de qualité de l’air qui visent à améliorer le confort intérieur, les capteurs portables pour surveiller la santé, les lidars et les radars pour fluidifier le trafic ainsi que les détecteurs permettant une intervention rapide lors d’un incendie.

Ces dispositifs génèrent d’énormes volumes de données, qui sont utilisées pour entraîner des modèles d’intelligence artificielle. Ceux-ci apprennent un modèle de l’environnement opérationnel du capteur afin d’en améliorer les performances.

Par exemple, les données de connectivité provenant des points d’accès wifi ou des balises Bluetooth déployés dans les grands bâtiments peuvent être analysées à l’aide d’algorithmes d’IA afin d’identifier les modèles d’occupation et de mouvement à différentes périodes de l’année et pour différents types d’événements, en fonction du type de bâtiment (par exemple, bureau, hôpital ou université). Ces modèles peuvent ensuite être exploités pour optimiser le chauffage, la ventilation, les évacuations, etc.

Combiner l’Internet des objets et l’intelligence artificielle s’accompagne de défis techniques

L’ « intelligence artificielle des objets » (AIoT, en anglais) combine l’IA et l’IoT. Il s’agit de mieux optimiser et automatiser les systèmes interconnectés, et d’ouvrir la voie à une prise de décision intelligente. En effet, les systèmes AIoT s’appuient sur des données réelles, à grande échelle, pour améliorer la précision et la robustesse de leurs prédictions.

Mais pour tirer des informations des données collectées par les capteurs IoT, celles-ci doivent être collectées, traitées et gérées efficacement.

Pour ce faire, on utilise généralement des « plateformes cloud » (par exemple, Amazon Web Services, Google Cloud Platform, etc.), qui hébergent des modèles d’IA à forte intensité de calcul – notamment les modèles de fondations récents.

Que sont les modèles de fondation ?

- Les modèles de fondation sont un type de modèles d’apprentissage automatique entraînés sur des données généralistes et conçus pour s’adapter à diverses tâches en aval. Ils englobent, sans s’y limiter, les grands modèles de langage (LLM), qui traitent principalement des données textuelles, mais aussi les modèles dits « multimodaux » qui peuvent travailler avec des images, de l’audio, de la vidéo et des données chronologiques.

- En IA générative, les modèles de fondation servent de base à la génération de contenus (textes, images, audio ou code).

- Contrairement aux systèmes d’IA conventionnels qui s’appuient sur des ensembles de données spécifiques à une tâche et sur un prétraitement approfondi, les modèles de fondation ont la capacité d’apprendre sur la base de peu ou pas d’exemples (on parle respectivement de « few-shot learning » et de « zero-shot learning »). Ceci leur permet de s’adapter à de nouvelles tâches et de nouveaux domaines avec un minimum de personnalisation.

- Bien que les modèles de fondation en soient encore à leurs débuts, ils ont un grand potentiel de création de valeur pour les entreprises de tous les secteurs : leur essor marque donc un changement de paradigme dans le domaine de l’intelligence artificielle appliquée.

Les limites du cloud pour traiter les données de l’IoT

L’hébergement de systèmes lourds d’IA ou de modèles de fondation sur des plateformes cloud offre l’avantage de ressources informatiques abondantes, mais il présente également plusieurs limites.

En particulier, la transmission de grands volumes de données IoT vers le cloud peut augmenter considérablement les temps de réponse des applications AIoT, avec des délais allant de quelques centaines de millisecondes à plusieurs secondes selon les conditions du réseau et le volume de données.

De plus, le transfert de données vers le cloud, en particulier d’informations sensibles ou privées, soulève des questions de confidentialité. On considère généralement que l’idéal pour la confidentialité est de traiter localement les données, à proximité des utilisateurs finaux, pour limiter les transferts.

Par exemple, dans une maison intelligente, les données provenant des compteurs intelligents ou des commandes d’éclairage peuvent révéler des habitudes d’occupation ou permettre la localisation à l’intérieur (par exemple, détecter qu’Hélène est généralement dans la cuisine à 8 h 30 pour préparer le petit-déjeuner). Il est préférable que ces déductions se fassent à proximité de la source de données afin de minimiser les retards liés à la communication entre l’edge et le cloud, et afin de réduire l’exposition des informations privées sur les plateformes cloud tierces.

À lire aussi : Calculs sur le cloud : comment stocker et exploiter les données de façon sûre… et pas trop onéreuse

Qu’est-ce que l’« edge computing » et l’« edge AI » ?

Pour réduire la latence et améliorer la confidentialité des données, l’edge computing est une bonne option, car il fournit des ressources informatiques (c’est-à-dire des appareils dotés de capacités de mémoire et de traitement) plus proches des appareils IoT et des utilisateurs finaux, généralement dans le même bâtiment, sur des passerelles locales ou dans des microcentres de données à proximité.

Cependant, ces ressources dites « périphériques » (edge) sont nettement plus limitées en termes de puissance de traitement, de mémoire et de stockage que les plateformes cloud centralisées, ce qui pose des défis pour le déploiement de modèles d’IA complexes dans des environnements distribués.

Le domaine émergent de l’edge AI, particulièrement actif en Europe, cherche à y remédier pour une exécution efficace de tâches d’IA sur des ressources plus frugales.

L’une de ces méthodes est le split computing, qui partitionne les modèles d’apprentissage profond entre plusieurs nœuds au sein d’un même espace (par exemple, un bâtiment), ou même entre différents quartiers ou villes.

La complexité augmente encore avec l’intégration des modèles de fondation, qui rendent la conception et l’exécution des stratégies de split computing encore plus difficile.

Quels changements cela implique-t-il en termes de consommation d’énergie, de confidentialité et de vitesse ?

L’edge computing améliore considérablement les temps de réponse en traitant les données plus près des utilisateurs finaux, éliminant ainsi la nécessité de transmettre les informations à des centres de données cloud éloignés. Cette approche améliore également la confidentialité, en particulier avec l’avènement des techniques d’edge AI.

Par exemple, l’apprentissage fédéré permet de former des modèles d’apprentissage automatique directement sur des appareils locaux, voire directement sur de nouveaux appareils IoT. En effet, ceux-ci sont dotés de capacités de traitement, garantissant ainsi que les données brutes restent sur l’appareil tandis que seules les mises à jour des modèles d’IA sont transmises aux plateformes edge ou cloud, où ils peuvent être agrégés et passer la dernière phase d’entraînement.

La confidentialité est également préservée pendant l’inférence. En effet, une fois entraînés, les modèles d’IA peuvent être déployés sur les ressources de calcul distribuées (à l’edge), ce qui permet de traiter les données localement sans les exposer aux infrastructures du cloud.

C’est particulièrement utile pour les entreprises qui souhaitent exploiter les grands modèles de langage au sein de leurs infrastructures. Par exemple, ceux-ci peuvent être utilisés pour répondre à des requêtes sur l’état de fonctionnement des machines industrielles, la prévision des besoins de maintenance à partir des données des capteurs – des points qui utilisent des données sensibles et confidentielles. Le fait de conserver les requêtes et les réponses au sein de l’organisation permet de protéger les informations sensibles et de se conformer aux exigences en matière de confidentialité et de conformité.

Comment ça marche ?

Contrairement aux plateformes cloud matures, comme Amazon Web Services et Google Cloud, il n’existe actuellement aucune plateforme bien établie pour prendre en charge le déploiement à grande échelle d’applications et de services edge.

Cependant, les fournisseurs de télécommunications commencent à exploiter les ressources locales existantes sur les sites d’antennes afin d’offrir des capacités de calcul plus proches des utilisateurs finaux. La gestion de ces ressources distribuées reste difficile en raison de leur variabilité et de leur hétérogénéité, impliquant souvent de nombreux serveurs et appareils de faible capacité.

À mon avis, la complexité de la maintenance est un obstacle majeur au déploiement des services d’edge AI. Mais le domaine progresse rapidement, avec des pistes prometteuses pour améliorer l’utilisation et la gestion des ressources distribuées.

Allocation des ressources à travers le continuum IoT-Edge-Cloud pour des applications AIoT sûres et efficaces

Afin de permettre un déploiement fiable et efficace des systèmes AIoT dans les espaces intelligents (tels que les maisons, les bureaux, les industries et les hôpitaux), notre groupe de recherche, en collaboration avec des partenaires à travers l’Europe, développe un cadre basé sur l’IA dans le cadre du projet Horizon Europe PANDORA.

PANDORA fournit des modèles d’« IA en tant que service » (AIaaS) adaptés aux besoins des utilisateurs finaux (par exemple, latence, précision, consommation d’énergie). Ces modèles peuvent être entraînés soit au moment de la conception, soit au moment de l’exécution, à l’aide des données collectées à partir des appareils IoT déployés dans les espaces intelligents.

PANDORA offre aussi des ressources informatiques en tant que service (CaaS) sur l’ensemble du continuum IoT-Edge-Cloud afin de prendre en charge le déploiement des modèles d’IA. Le cadre gère le cycle de vie complet du modèle d’IA, garantissant un fonctionnement continu, robuste et axé sur les intentions des applications AIoT pour les utilisateurs finaux.

Au moment de l’exécution, les applications AIoT sont déployées de manière dynamique sur l’ensemble du continuum IoT-Edge-Cloud, en fonction de mesures de performance, telles que l’efficacité énergétique, la latence et la capacité de calcul. Le CaaS alloue intelligemment les charges de travail aux ressources au niveau le plus approprié (IoT-Edge-Cloud), maximisant ainsi l’utilisation des ressources. Les modèles sont sélectionnés en fonction des exigences spécifiques au domaine (par exemple, minimiser la consommation d’énergie ou réduire le temps d’inférence) et sont continuellement surveillés et mis à jour afin de maintenir des performances optimales.

This work has received funding from the European Union’s Horizon Europe research and innovation actions under grant agreement No. 101135775 (PANDORA) with a total budget of approximately €9 million and brings together 25 partners from multiple European countries, including IISC and UOFT from India and Canada.

- GÉNÉRALISTES

- Ballast

- Fakir

- Interstices

- Issues

- Korii

- Lava

- La revue des médias

- Time [Fr]

- Mouais

- Multitudes

- Positivr

- Regards

- Slate

- Smolny

- Socialter

- UPMagazine

- Le Zéphyr

- Idées ‧ Politique ‧ A à F

- Accattone

- À Contretemps

- Alter-éditions

- Contre-Attaque

- Contretemps

- CQFD

- Comptoir (Le)

- Déferlante (La)

- Esprit

- Frustration

- Idées ‧ Politique ‧ i à z

- L'Intimiste

- Jef Klak

- Lignes de Crêtes

- NonFiction

- Nouveaux Cahiers du Socialisme

- Période

- ARTS

- L'Autre Quotidien

- Villa Albertine

- THINK-TANKS

- Fondation Copernic

- Institut La Boétie

- Institut Rousseau

- TECH

- Dans les algorithmes

- Framablog

- Gigawatts.fr

- Goodtech.info

- Quadrature du Net

- INTERNATIONAL

- Alencontre

- Alterinfos

- Gauche.Media

- CETRI

- ESSF

- Inprecor

- Guitinews

- MULTILINGUES

- Kedistan

- Quatrième Internationale

- Viewpoint Magazine

- +972 mag

- PODCASTS

- Arrêt sur Images

- Le Diplo

- LSD

- Thinkerview