09.06.2026 à 16:20

Ocean monitoring is in trouble: without the US, it’s up to Europe and Asia to avoid losing sight of the world’s deep-sea ecosystems

Sabrina Speich, Professeure en océanographie et sciences du climat, École normale supérieure (ENS) – PSL

John Abraham, Associate Professor, Mechanical Engineering, University of St. Thomas

Kevin Trenberth, Distinguished Scholar, NCAR; Affiliate Faculty, University of Auckland, Waipapa Taumata Rau

Lijing Cheng,, Professor at the Institute of Atmospheric Physics, Chinese Academy of Sciences

Texte intégral (2357 mots)

The world relies on a modest number of countries to keep watch over the ocean. That arrangement is starting to fail. Europe and Asia must now decide whether to let the system unravel, or to take it up together.

Right now, in every ocean basin on Earth, a global network of instruments measures the state of the sea.

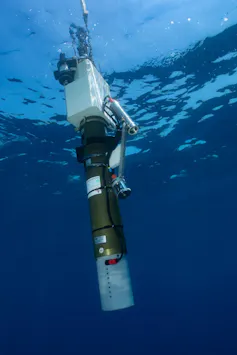

Research ships steam along oceanographic transects from surface to seafloor. Anchored buoys watch the tropical oceans for the first signs of El Niño or tropical cyclones and take the pulse of the thermohaline circulation. Some four thousand autonomous floats sink every ten days to two thousand metres before rising to transmit temperature and salinity to ground stations via satellite. Underwater gliders patrol continental margins, and drifting buoys ride the surface in the most remote waters. Hundreds of elephant seals carry miniaturised sensors beneath the polar sea ice…

Together, this network produces invaluable information that allows societies to anticipate and respond to a changing ocean and weather conditions, and protect the ocean in return.

It is also far more fragile than most people, and most governments realise. A new study published in Nature Climate Change has measured for the first time just how fragile the ocean watch network is.

The result is alarming. If observations from a single major contributor, the United States, were withdrawn from the Global Ocean Observing System (GOOS), the errors in our estimate of how fast the ocean is warming would jump by 163 percent. That is worse than randomly losing 80 percent of all global ocean data. The reason is geographical: US instruments cover every ocean basin and plug critical gaps that no other nation currently fills.

This is not a theoretical concern. Proposed cuts to National Oceanic and Atmospheric Administration (NOAA) and the National Science Foundation in the United States now threaten exactly this contribution. And the situation is barely better on the other side of the Atlantic.

The pressures are not confined to one side of the Atlantic, nor to the West. In China, scientists and policymakers are working to build a more resilient national contribution to ocean observation, but without the resources the moment requires. The marine monitoring system the world relies on is under strain almost everywhere.

An observing system, not a programme

Public conversations about ocean observations often focus on Argo floats.

Each Argo is essentially a sealed cylinder of pressurised electronics with a clever buoyancy chamber: it floods with seawater to sink and is evacuated to rise again. These autonomous robots have transformed ocean science this century.

However, Argo is just one component of GOOS and the complementarity of its parts matters.

Argo profiles the upper two kilometres of the open ocean.

Research vessels go deeper: GO-SHIP cruises survey from surface to seafloor along long repeated transects, providing the high-precision reference measurements that calibrate every other instrument and help validate climate models.

Moored buoys deliver continuous time series critical for monitoring El Niño, the Atlantic Meridional Overturning Circulation, and the conditions in which tropical cyclones form.

Underwater gliders target coastal currents, eddies and continental margins that floats cannot resolve.

Elephant seals carry sensors into under-ice regions of the polar oceans that no other instrument can reach.

Each platform answers questions the others cannot.

Remove any one of these ocean watch components, and the observing system’s ability to deliver reliable information degrades not in proportion to the volume of data lost, but in proportion to where the gaps appear.

What this network actually delivers

The Global Ocean Observing System is too often described as “climate monitoring,” but it does so much more.

Every operational weather forecast is built on these data. The numerical weather prediction systems run by the European Centre for Medium-Range Weather Forecasts, by Météo France, and by every other major weather service ingest ocean observations many times a day.

Without them, forecasts drift quickly out of skill.

The new artificial-intelligence-based forecast systems Pangu-Weather and GraphCast, despite their impressive performance, rely entirely on the same observational stream.

AI does not replace observations; it depends on them.

Sub-seasonal to seasonal forecasting, to help anticipate harvest seasons, energy demand and water availability weeks to months ahead, depends critically on knowledge about subsurface ocean heat and salinity.

Tropical cyclone track and intensity forecasts, central to early warning and evacuation decisions, depend on ocean heat content beneath the surface, not just sea surface temperature, because hurricanes draw their explosive energy from the warm layers down to at least 200m depth.

Marine heatwave warnings, now used routinely by fisheries managers worldwide, are impossible without sustained subsurface observation.

Sea-level projections used to design coastal infrastructure require decades of consistent measurements, and salinity adds the density information essential for determining all ocean currents, including the AMOC.

In short, GOOS underpins operational services from tomorrow’s storm warnings to next century’s adaptation plan. It is not a luxury but essential.

Why models and artificial intelligence alone cannot save us

There is a persistent misconception, amplified by the rise of AI, that sufficiently advanced models can substitute for direct observations. They cannot.

Every forecast model, whether traditional or AI- based, relies on data assimilation: a continuous nudged adjustment of the simulation toward real-world measurements. An AI model trained on a richly observed past will perform poorly in a sparsely observed present. In a world of rising extremes and shifting ocean states, historical patterns become less reliable.

An observation not made is lost forever. Satellite measurements of the sea surface cannot tell us what is happening hundreds or thousands of metres below, where heat accumulates, currents reorganise, and the precursors of the next season’s weather are already forming. To see beneath the surface, we need instruments in the water.

The cheapest insurance we have

The argument that ocean observation is too expensive collapses on contact with the numbers.

The total annual cost of the global system, across all platforms and personnel, runs on the order of one billion euros worldwide. The European share is a fraction of that.

Extreme weather events linked to ocean conditions caused tens of billions of euros in damage across Europe in 2024 alone.

A single major North Atlantic hurricane season can cost the United States hundreds of billions of dollars. Marine heatwaves have collapsed fisheries worth billions and triggered mass coral bleaching on every reef system on Earth. Failed seasonal forecasts cascade through agriculture, energy and humanitarian response, with consequences rarely tallied.

Every euro spent on ocean observation returns many times its value. It is one of the highest-return public investments available.

Europe’s choice

Europe needs to treat ocean observations as critical infrastructure, equivalent to satellite navigation or meteorological services. That means stable, multi-year funding for the operational backbone of the system: the floats, ships, moorings, gliders and data centres that process and deliver the data.

France has the second-largest Exclusive Economic Zone in the world but contributes around 5 percent of global ocean temperature profile data. Present in the Atlantic, Pacific and Indian Oceans, France has five departments and regions and seven overseas collectivities, which are home to 2.7 million French citizens.

Australia contributes more than three times as much.

The European Union contributes about 12 percent, less than a quarter of the American share. Europe, and France in particular, should substantially increase its contribution.

OceanObs’29, the decadal international conference set to be held this time in China, is an opportunity to negotiate a more balanced global system, reflecting economic capacity and maritime interests rather than historical accident.

Europe-China scientific cooperation should increase, as they have largely complementary observing footprints. Together, they would cover much of the global ocean.

The narrowing window

The danger is a gradual erosion of the information on which a growing share of human activity and the blue economy now depends.

Cyclone warnings become less reliable, seasonal forecasts less skilful, sea-level projections less precise. Each loss maybe individually tolerable. Together, they amount to flying blind into the most consequential transformation of the planet’s climate in human history.

The ocean observing system is a planetary public service, built over decades by many nations. France and Europe possess the institutions, expertise and the maritime interest to play a far larger role.

What is missing is the political decision to act, while the system can still be sustained. The loss of collaboration among nations would force a rebuild far more difficult and expensive than sustained investment in what already works.

The window remains open but is narrower than it was.

A weekly e-mail in English featuring expertise from scholars and researchers. It provides an introduction to the diversity of research coming out of the continent and considers some of the key issues facing European countries. Get the newsletter!

Sabrina Speich a reçu des financements de l'ERC, EU Horizon 2030, CNES TOSCA et ANR. Sabrina Speich est présidente du comité d'experts du "Ocean Observations for Physics and Climate" des programmes UN GOOS et GCOS.

John Abraham, Kevin Trenberth et Lijing Cheng, ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur poste universitaire.

09.06.2026 à 16:20

Maladies neurodégénératives, maladies inflammatoires chroniques, prévention santé… planifier la recherche pour répondre aux enjeux de demain

Franck Mouthon, Directeur exécutif de l’Agence de programmes de recherche en santé, Inserm

Texte intégral (1960 mots)

Planifier la recherche médicale s’impose. D’abord, pour faire face aux enjeux majeurs de demain, comme les maladies neurodégénératives ou les maladies inflammatoires chroniques, dont le poids médico-économique va s’alourdir. Ensuite, pour sortir de la logique de réaction permanente face aux crises sanitaires qui se succèdent. Enfin, pour construire un système de santé gouverné par l’impératif préventif et non curatif. Les missions de l’Agence de programmes de recherche en santé recouvrent ces objectifs.

Penser le monde qui vient est aussi nécessaire qu’évident. Car il est déjà à l’œuvre : acteurs victimes de l’abîme que cause le réchauffement climatique pour nos territoires et nos modes de vie, nous voyons progresser maladies chroniques, troubles psychiques, vulnérabilités sociales et fractures intergénérationnelles. La guerre reconquiert nos priorités stratégiques, nos terres et nos imaginaires. L’inquiétude gagne les jeunesses.

À lire aussi : Santé mentale des jeunes : chronique d’une crise annoncée

Dans les réflexions à mener, la santé occupe une place centrale. Dans ce domaine comme dans les autres, le monde qui vient ne sera souhaitable qu’à la condition de ne pas être subi : il doit être anticipé, débattu, construit et choisi ensemble. Ce tournant ne saurait réussir que s’il devient un véritable projet collectif, centré autour d’objectifs de santé partagés et appropriés par chacun.

C’est l’objet de l’Agence de programmes de recherche en santé, créée en 2024 et pilotée par l’Institut national de la santé et de la recherche médicale (Inserm), face aux incertitudes que représentent en particulier le domaine de la santé.

On citera parmi ses thématiques prioritaires la recherche sur les maladies neurodégénératives, les maladies inflammatoires chroniques, la transplantation, mais aussi la prévention en santé, la fin de vie ou encore l’amélioration de l’organisation de la recherche vaccinale en France.

Planifier pour sortir de la logique de réaction permanente

Amiante, maladie dite de la vache folle, Covid-19 hier, Ebola ou hantavirus aujourd’hui, nouvelle pandémie ou crise climatique demain… Depuis plusieurs années, c’est le rythme des crises visibles qui dicte la priorité accordée à la santé dans les agendas politiques. Il y là nécessité de sortir d’une logique politique de réaction permanente et de redonner à la puissance publique sa capacité stratégique.

À lire aussi : Ebola : Comment expliquer cette nouvelle flambée, malgré les vaccins qui ont amélioré la lutte contre les épidémies

Dans cette perspective, la recherche a une immense responsabilité. L’Agence de programmes de recherche en santé se donne ainsi pour mission de contribuer à cette capacité d’anticipation : en structurant une démarche de prospective collective, elle vise à éclairer les priorités scientifiques et les choix publics alignés avec les grands défis sociétaux en cours et à venir.

Son approche illustre un nouvel alignement stratégique entre puissance publique, recherche médicale et industrie, en orientant les investissements vers les grands défis contemporains afin de faire émerger une véritable planification sanitaire. Cela implique aussi de réinvestir la réciprocité science-État : aux décideurs publics de réinvestir le temps long indispensable à toute stratégie sanitaire cohérente, à la recherche de renforcer sa capacité d’anticipation, de surveillance, de réactivité, de programmation et de mobilisation face à l’accélération des transformations contemporaines afin d’éclairer la décision publique.

Un programme pour détecter précocement les maladies neurodégénératives

Mieux comprendre et prévenir les maladies neurodégénératives figure parmi les trois nouveaux programmes stratégiques confiés à l’Agence de programmes de recherche en santé.

Aujourd’hui déjà, les maladies neurodégénératives constituent un enjeu majeur pour notre système de santé et la politique de recherche. Les chiffres parlent d’eux-mêmes : en France, plus de 850 000 personnes sont touchées par la maladie d’Alzheimer (ou une maladie apparentée), plus de 200 000 sont atteintes de la maladie de Parkinson et plus de 100 000 sont affectées par la sclérose en plaques.

Les maladies neurodégénératives représentent un fardeau médico-économique pour la population. Des déterminants environnementaux contribuent au déclenchement et/ou à l’évolution de ce type de pathologies, sans que l’on connaisse précisément leur poids dans le développement de ces maladies.

L’Agence a impulsé un programme de recherche à l’échelle nationale (PRODROM-ND) d’identification précoce de l’entrée dans ces pathologies avant même que les signes cliniques apparaissent, de manière à pouvoir intervenir de manière plus efficace.

Identifier les déterminants responsables de la chronicisation des maladies inflammatoires

Les pathologies inflammatoires chroniques prises dans leur ensemble constituent également un enjeu majeur, même si les maladies inflammatoires chroniques de l’intestin comme la maladie de Crohn, la polyarthrite rhumatoïde, le psoriasis, le lupus érythémateux disséminé etc. sont moins connues du grand public. Toute intervention qui permettrait d’éviter que la maladie devienne chronique (on parle de chronicisation,) améliorerait considérablement la vie des patients, tout en soulageant le système de santé.

Une quinzaine de maladies inflammatoires vont être étudiées simultanément dans le cadre du programme TRANSCEND-ID et de manière transversale pour une meilleure compréhension des déterminants biologiques associés à la chronicisation de l’inflammation.

Passer du curatif au préventif en France

Enfin, notre modèle français répond à une logique curative, fondée sur la consommation de soins et la facturation des actes médicaux, pensée pour traiter des maladies déjà installées. Il s’agit de construire un système gouverné par l’impératif préventif, pensé pour préserver durablement la santé des populations. Environ 40 % des cancers et 80 % des maladies cardiovasculaires seraient évitables par des trajectoires de prévention adaptées.

Certains pays ont engagé ce tournant depuis plusieurs décennies : la Suède, notamment, a investi massivement dans des actions qui ciblent davantage les jeunes générations à savoir la santé mentale, la nutrition, la lutte contre les déterminants commerciaux de la santé en premier lieu tabac et l’alcool, l’activité physique, l’accès précoce aux soins primaires et la digitalisation des parcours de santé. Les résultats sont visibles : l’écart d’espérance de vie en bonne santé s’est creusé : en 2020, environ 72 ans en Suède contre 64 ans en France. Du reste, cela suppose d’intégrer précocement et pleinement les nouveaux besoins des personnes âgées, des hommes comme des femmes.

Pour sortir de la logique du curatif et entrer résolument dans celle de la prévention en santé, l’Agence de programmes de recherche en santé finalise un grand programme national de recherche en prévention articulé autour de quatre volets :

- la prévention dite « primaire » avec un focus sur la santé de l’enfant durant les 1 000 premiers jours jusqu’à l’entrée dans la vie active (alimentation, sommeil, comportements à risque, déterminants sociaux, déterminants commerciaux qui visent par exemple à inciter les jeunes à consommer de l’alcool ou à jouer en ligne…) ;

À lire aussi : Contre le tabagisme, l’alcoolisme, l’insécurité routière… le marketing social en santé est plus efficace que la communication

la prévention « secondaire » pour éviter la chronicisation des pathologies, autour du cancer et des maladies respiratoires ;

les risques épidémiques à travers le programme France Vaccin, avec une volonté de s’inscrire dans des dispositifs européens ;

la fin de vie (organisation des soins, inégalités territoriales autour de la prise en charge des parcours de fin de vie, de la souffrance de la personne concernée et de ses proches).

La santé, vecteur de cohésion sociale

Au-delà des missions de l’Agence de programmes de recherche en santé, préparer aujourd’hui la santé de demain revient donc à identifier précocement les vulnérabilités individuelles et collectives, de personnaliser les parcours de prévention, de capitaliser sur chaque contact avec un soignant, et de détecter des signaux faibles de dégradation sanitaire.

Cela nécessite aussi une implication réelle de l’ensemble de la population, notamment jeune et vulnérable, la santé étant un vecteur autour duquel il est possible de créer de la cohésion sociale et de réinvestir nos solidarités.

Cet article a été réalisé dans le cadre du colloque « Penser le monde qui vient », organisé le 11 juin 2026 par la chaire « Prospective, imaginaires et politiques publiques » de CY Cergy Paris Université, Learning Planet Institute et l’association Le 106, en partenariat avec The Conversation. Si vous souhaitez y assister, vous pouvez vous inscrire en cliquant ici.

Cet article a été coécrit avec Mahaut Chaudouët-Delmas, experte prospective en santé et cohésion sociale, Inserm.

Franck Mouthon ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

09.06.2026 à 16:20

La France du Nord et de l’Est victime de la mondialisation, celle du Sud et de l’Ouest en pleine dynamique

Arnaud Brennetot, Géographie politique, Université de Rouen Normandie

Texte intégral (3159 mots)

La fracture entre villes et campagnes s’est imposée comme l’une des principales clés de lecture des inégalités territoriales françaises. Pourtant, les dynamiques régionales dessinent une autre géographie. Héritée de la désindustrialisation, une ligne de partage séparant le Nord et l’Est du Sud et de l’Ouest continue de structurer l’économie et les trajectoires sociales du pays.

L’intégration de la France dans la mondialisation économique a eu pour corollaire une exposition accrue des entreprises et des régions à la concurrence internationale. À partir du milieu des années 1970, comme pour les autres pays membres de la Communauté économique européenne (CEE), cette situation s’est traduite par un ralentissement de la croissance économique, une augmentation du chômage, une réorganisation de la production et un développement sélectif du territoire. La délocalisation des tâches à faible valeur ajoutée vers les nouveaux pays industriels, l’externalisation d’une autre partie des fonctions vers les services et les progrès technologiques ont conduit à un processus de désindustrialisation et de tertiarisation de l’emploi.

En parallèle, l’élévation du niveau de vie a permis l’essor des activités de la sphère présentielle, c’est-à-dire destinées à une clientèle locale (la construction et les services à la personne).

Ces transformations ont entraîné une inversion de l’organisation régionale du pays : alors que les phases de la révolution industrielle avaient entraîné une forte croissance économique de la moitié nord-est du pays, à l’est d’une ligne Le Havre-Marseille, la période de la mondialisation néolibérale s’est traduite par un ralentissement de cette partie du pays et, au contraire, par une forte croissance de la France du Sud et de l’Ouest.

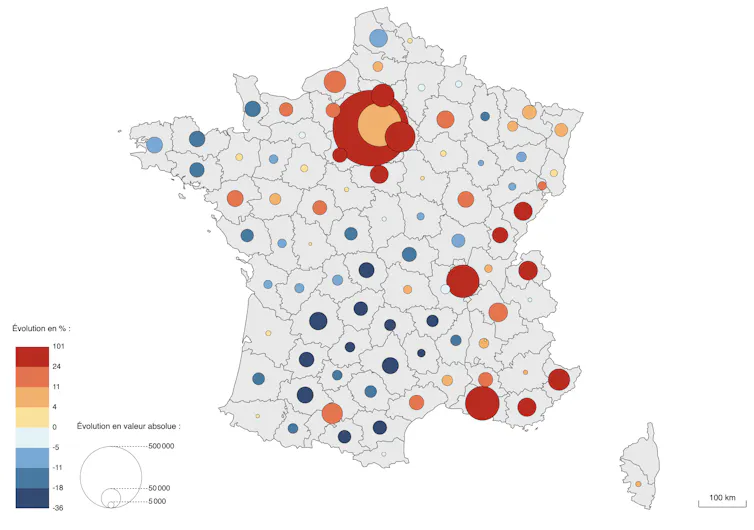

Évolution du nombre d’emplois entre 1954 et 1975

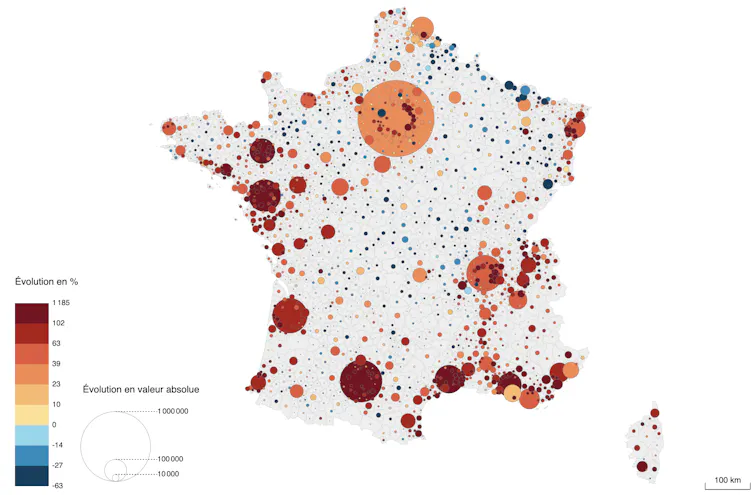

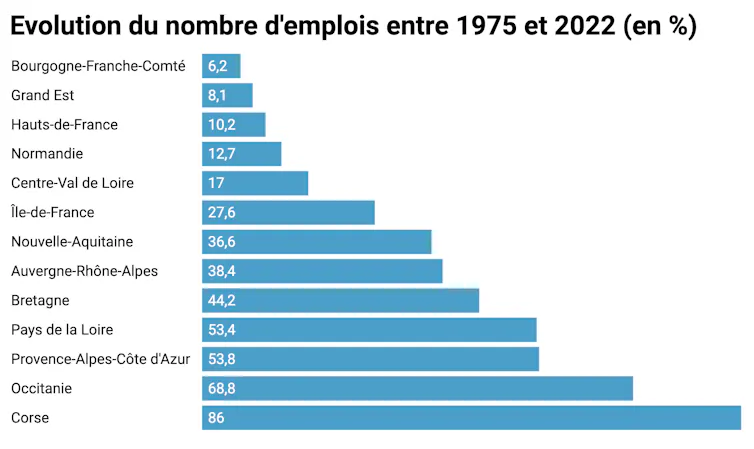

Évolution du nombre d’emplois entre 1975 et 2022

En France, une inversion géographique des régions « qui gagnent »

Dans le Nord-Est et dans les régions périphériques du Bassin parisien, le déclin des industries lourdes et de montage a entraîné une baisse importante du nombre d’emplois productifs. Depuis un quart de siècle, cela a eu pour effet le départ d’une partie des ménages, entraînant un ralentissement de la croissance puis un déclin presque généralisé de la population. Cette régression s’est accompagnée d’une réduction de l’offre de services collectifs, une fragilisation des systèmes urbains, une dévalorisation du capital fixe (les logements, les usines, les commerces, les infrastructures…) et des difficultés à amortir les investissements.

Si les grandes villes ont mieux résisté à la récession que les villes petites et moyennes ou les espaces de faibles densités, leur croissance a été bien plus faible que dans les métropoles du Sud et de l’Ouest. Seules les régions parisienne et lyonnaise sont parvenues à compenser les pertes liées à la désindustrialisation par l’essor des fonctions métropolitaines.

Au contraire, la moitié Sud-Ouest, longtemps caractérisée par une économie traditionnelle et un fort exode rural, a connu un rattrapage spectaculaire. La conjugaison de la tertiarisation des activités productives, favorable aux métropoles, et les nouveaux tropismes résidentiels, caractérisés par un attrait pour les littoraux et l’ensoleillement, ont contribué à un afflux continu de nouvelles populations et à la croissance conjointe des emplois des sphères présentielle et productive. Si les métropoles du Sud et de l’Ouest ont bénéficié d’un essor souvent souligné dans le débat public, des territoires plus larges ont également connu une trajectoire de forte croissance : la Bretagne (l’Ouest intérieur excepté), la vallée de la Loire, la Vendée, la Charente, le bassin Aquitain, le Languedoc, le bassin du Rhône, la Corse et la vallée du Rhin. Même le sud de la « diagonale du vide » a connu un modeste regain démographique et économique. Les territoires les plus dynamiques sont confrontés depuis plusieurs décennies aux phénomènes d’étalement urbain, de hausse des prix de l’immobilier et de ségrégation sociorésidentielle.

L’occultation de la question régionale

Cette inversion macro-régionale, observable à partir du milieu des années 1970, n’a jamais été identifiée comme un enjeu public notable (à la différence des considérations légitimes dont ont régulièrement fait l’objet les territoires d’outre-mer). Malgré les difficultés induites pour les populations des régions fragilisées du Nord-Est, elle n’a donné lieu à aucune politique d’accompagnement ou de traitement différencié depuis la fin des années 1990, lorsque les politiques d’aménagement national ont été abandonnées.

Les grands objectifs de politiques publiques concernant le développement durable, la compétitivité et la cohésion des territoires, par exemple, ont été mis en œuvre sans tenir compte de l’inégalité des trajectoires régionales. Les mêmes instruments (transferts de compétences, appels à projets, contrats) ont été déployés, sans considération pour le fait qu’ils ne pouvaient pas générer des effets identiques dans des régions en pleine croissance et dans des régions en déclin.

Ce fut le cas par exemple des contrats de plans État-Régions, des pôles de compétitivité ou des modalités d’accompagnement des établissements d’enseignement supérieur et de recherche. Les différents marchés (emplois, immobilier, services) ont alors produit leurs effets géographiques sélectifs sans garde-fous politiques. Par exemple, entre 1999 et 2022, la croissance de l’emploi a été trois fois plus forte à Toulouse (+ 63 %) qu’à Lille (+ 22 %). Les instruments de coopération interrégionale (comités de massif, contrats de plan interrégionaux, stratégies de façades littorales) sont de leur côté restés faiblement dotés.

Ni les gouvernements successifs, ni les associations d’élus locaux ne se sont véritablement inquiétés des possibles problèmes engendrés par de telles divergences régionales, hormis pour les espaces de très faibles densités et les territoires d’outre-mer. Ces écarts ont exposé les populations des différentes régions à une inégalité des chances croissante en matière de cadre de vie et d’opportunités territoriales (pour l’accès aux services collectifs ou pour le dynamisme économique local, par exemple).

Aucun débat notable n’a eu lieu concernant les avantages et les inconvénients éventuels induits par ce grand schisme régional. Hormis quelques rares exceptions, celui-ci a été systématiquement occulté des diagnostics formulés par les différents acteurs de la gouvernance et de l’aménagement des territoires (responsables politiques, administrations, associations, entreprises et médias) et ceci depuis plusieurs décennies, laissant les dynamiques macro-régionales continuer à exercer leurs effets.

La montée du populisme territorial

L’état géographique du pays est cependant loin de désintéresser le public et encore moins de le satisfaire. Il est même devenu un objet récurrent de désapprobations. À partir de la fin des années 1990, la notion de « fracture territoriale » apparaît pour dénoncer les inégalités géographiques qui divisent le pays. Mais le décrochage macro-régional est occulté par la réactivation idéologique du vieux clivage villes/campagnes. Se cristallise un discours déplorant l’abandon des campagnes et des petites villes (alimenté par le recul des services publics et la fermeture de nombreux équipements) en contraste avec l’attention portée aux grandes villes, qu’il s’agisse de la crise des banlieues ou de grands projets urbains (le Grand Paris ou les métropoles régionales).

Dans les années 2010, cette déformation se systématise avec la notion de « France périphérique » qui réduit la transformation géographique de la France à un schéma binaire opposant des métropoles privilégiées à un ensemble de territoires hétéroclites habités par des « classes populaires » livrées à elles-mêmes. Cette caricature géographique est très largement adoptée par les médias comme par divers responsables politiques : le rejet des métropoles se présente alors comme une variante géographique du « dégagisme » politique en plein essor.

Cette focalisation du débat sur le clivage villes-campagnes n’a pas permis d’établir un diagnostic lucide de la réalité multiscalaire des inégalités et des vulnérabilités géographiques (entre quartiers et communes au sein des aires urbaines, entre villes et campagnes et entre ensembles régionaux). Si la réorganisation des activités induite par la mondialisation a renforcé le rôle des économies d’agglomération, profitant aux plus grandes des villes, les déclarations dénonçant la « fracture territoriale » ont majoritairement ignoré que, à population égale, les territoires du Nord-Est fragilisés par la désindustrialisation sont restés plus vulnérables que ceux du Sud-Ouest portés par une forte attractivité.

Cette réalité macro-régionale a fait l’objet d’un déni collectif, les élus du Nord-Est restant peu enclins à faire des difficultés subies par leur territoire un thème de revendication et de mobilisation politiques. Par ailleurs, bien des élus des territoires les moins peuplés ont eu intérêt à ce que le thème de la « France périphérique » reste vivace dans le débat public, permettant de justifier la perpétuation, sinon l’accentuation, du système de redistribution financière dont ils tirent profit. Par exemple, le programme Petites villes de demain, lancé en 2020 par l’Agence Nationale de la Cohésion des Territoires, n’a pas cherché à cibler particulièrement celles dont la population est la plus pauvre ou celles qui subissent des dynamiques de déclin. L’indifférence à l’égard de la concentration des difficultés socio-économiques dans la moitié nord-est du pays a eu pour effet de laisser les inégalités se creuser et les frustrations s’y accumuler, sans permettre aucune résolution ou avancée concrète.

Depuis plusieurs mois, dans une situation politique de plus en plus critique, les appels en faveur d’un réinvestissement du territoire national se multiplient. La recherche de solutions a même conduit à recréer un ministère de l’aménagement du territoire (disparu depuis 2010), lequel s’emploie actuellement à la définition d’une nouvelle stratégie nationale d’aménagement. Une telle ambition ne pourra aboutir à des solutions tangibles qu’à la condition de tenir compte de l’existence du clivage macro-régional qui structure la France métropolitaine depuis un demi-siècle.

Cet article a été réalisé dans le cadre du colloque « Penser le monde qui vient », organisé le 11 juin 2026 par la chaire « Prospective, imaginaires et politiques publiques » de CY Cergy Paris Université, Learning Planet Institute et l’association Le 106, en partenariat avec The Conversation. Si vous souhaitez y assister, vous pouvez vous inscrire en cliquant ici.

Arnaud Brennetot conseille différentes organisations (collectivités territoriales, agences publiques, think tanks).

- GÉNÉRALISTES

- Ballast

- Fakir

- Interstices

- Issues

- Korii

- Lava

- La revue des médias

- Time France

- Mouais

- Multitudes

- Positivr

- Regards

- Slate

- Smolny

- Socialter

- UPMagazine

- Le Zéphyr

- Idées ‧ Politique ‧ A à F

- Accattone

- À Contretemps

- Alter-éditions

- Contre-Attaque

- Contretemps

- CQFD

- Comptoir (Le)

- Déferlante (La)

- Esprit

- Frustration

- Idées ‧ Politique ‧ i à z

- L'Intimiste

- Jef Klak

- Lignes de Crêtes

- NonFiction

- Nouveaux Cahiers du Socialisme

- Période

- ARTS

- L'Autre Quotidien

- Villa Albertine

- THINK-TANKS

- Fondation Copernic

- Institut La Boétie

- Institut Rousseau

- TECH

- April - Libre à lire

- Dans les algorithmes

- Framablog

- Goodtech.info

- Quadrature du Net

- Revue Eur. Médias et Numérique

- INTERNATIONAL

- Alencontre

- Alterinfos

- Gauche.Media

- CETRI

- ESSF

- Inprecor

- Guitinews

- MULTILINGUES

- Kedistan

- Quatrième Internationale

- Viewpoint Magazine

- +972 mag

- PODCASTS

- Arrêt sur Images

- Le Diplo

- LSD

- Thinkerview