18.05.2026 à 14:18

Rénovation, sobriété… Comment améliorer le bilan environnemental des immeubles français ?

Sylvain Bessonneau, Ingénieur bâtiment sur l'observation de la Transition Ecologique du secteur, Ademe (Agence de la transition écologique)

Texte intégral (2439 mots)

L’Agence de la transition écologique, ou Ademe, a lancé en 2025 un observatoire de la transition écologique du bâtiment, dénommé BâtiZoom. Son rôle est d’agréger et de suivre dans le temps les données sur les différentes dimensions de l’impact environnemental du parc immobilier français : consommation d’énergie, émissions de gaz à effet de serre, production de déchets, qualité de l’air, artificialisation des sols… Les leviers permettant de réduire ces impacts, tels que la rénovation énergétique, le décarbonation, la sobriété, la circularité des matériaux, etc., sont également suivis.

L’Ademe a en outre publié, fin 2025, un baromètre portant spécifiquement sur l’année 2024, qui permet de faire un état des lieux. Quelles en sont les principales leçons ? Entretien avec Sylvain Bessonneau, responsable de l’observatoire BâtiZoom au sein du service bâtiment de l’Ademe.

The Conversation France : Quel poids le parc immobilier français pèse-t-il dans l’empreinte environnementale du pays ?

Sylvain Bessonneau : Le parc immobilier pris en compte par BâtiZoom englobe le parc résidentiel et le parc tertiaire, excluant ainsi les bâtiments agricoles et industriels. À l’échelle nationale, les parcs résidentiel et tertiaire couvrent une surface de 4 200 millions de mètres carrés, dont 77 % consacrés au logement. Ces deux parcs représentent 45 % de la consommation d’énergie française totale, répartis entre 30 % pour le résidentiel et 15 % pour le tertiaire.

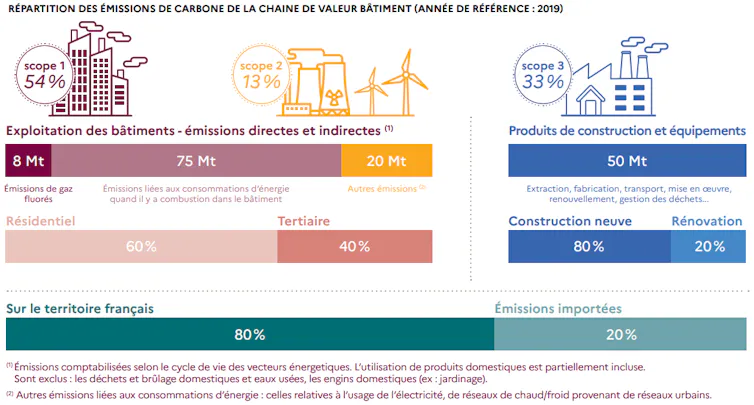

On pense spontanément à l’énergie utilisée pour se chauffer en hiver ou au fonctionnement d’une climatisation en été, mais cet impact ne se limite pas à l’énergie consommée en phase d’exploitation. Les derniers chiffres de 2019 sur les émissions de gaz à effet de serre du secteur du bâtiment, sur l’ensemble de sa chaîne de valeur, montrent que l’usage des bâtiments est certes responsable d’environ 67 % des émissions totales, mais que la construction et la rénovation – par ailleurs sources de déchets et d’artificialisation des sols – pèsent pour les 33 % restants.

Dans ce contexte, la rénovation énergétique constitue un levier central. Toutefois, il convient d’agir sur d’autres leviers, par exemple en produisant des capacités de logement au travers de nouvelles initiatives, comme la lutte contre la sous-occupation des logements, la mutualisation des usages, etc.

L’ensemble du parc résidentiel compte, en effet, 10 % de résidences secondaires, 8 % de logements vacants et 56 % de bâtiments sous-occupés par rapport à leur surface. La mobilisation de ces leviers constitue une opportunité pour répondre aux besoins de logements et de locaux tertiaires tout en respectant les objectifs environnementaux.

Pourquoi y a-t-il urgence à faire baisser cet impact environnemental à l’avenir ?

S. B. : Les enjeux sont nombreux. En premier lieu, les émissions de gaz à effet de serre engendrées par les activités humaines, y compris par le secteur du bâtiment, conduisent à un changement climatique d’une ampleur inédite qui menace la pérennité de nos sociétés modernes. Pour limiter ce dérèglement, il est essentiel d’atteindre les objectifs de long terme de baisse des émissions, que le projet de troisième Stratégie nationale bas carbone, soumis à consultation du public fin 2025, a confirmés.

C’est, en outre, un enjeu d’adaptation : le changement climatique engendre déjà des risques croissants de sinistres sur les bâtiments, en lien avec des sécheresses, des vagues de chaleur et des inondations de plus en plus intenses et fréquentes.

En février 2026, les tempêtes Nils et Pedro ont provoqué en France des inondations majeures. Sur les biens matériels, les dégâts associés sont estimés à 1,2 milliard d’euros. Dans ce contexte, la présidente de France Assureurs a d’ailleurs appelé à « la mobilisation collective en matière de prévention des inondations afin que toutes les parties prenantes se préparent à affronter des évènements naturels à la fois plus fréquents et plus intenses du fait du dérèglement climatique ».

Il y a aussi une nécessité sociale à contenir la consommation d’énergie de notre parc immobilier : entre 2021 et 2024, le prix de l’énergie s’est envolé, avec une hausse pour les ménages de 45 % pour l’électricité et de 70 % pour le gaz. Cela a fait progresser la précarité énergétique, et rappelle l’urgence de donner aux Français les moyens de maîtriser leur facture énergétique.

Le dernier enjeu, enfin, est géopolitique. La baisse des consommations d’énergie et de matière ainsi que leur décarbonation permettraient de limiter notre dépendance aux pays producteurs d’énergies fossiles et de réduire notre vulnérabilité vis-à-vis des fluctuations des prix.

À lire aussi : Pourquoi le prix de l’essence à la pompe ne baisse pas aussi vite qu’il monte

De quels leviers disposons-nous pour progresser, et de quelles réglementations pour les mobiliser ?

S. B. : La France dispose de quatre grands leviers pour atténuer l’empreinte de notre parc immobilier et s’est dotée, pour les mobiliser, d’un ensemble d’instruments réglementaires ambitieux, complets et complémentaires.

Le premier à activer est la sobriété, à la fois au niveau des usages – fondée sur l’adoption d’écogestes, susceptibles de réduire d’environ 10 % la consommation énergétique globale – ou au niveau de l’optimisation de l’occupation du parc existant, en mobilisant la part vacante et en réduisant la sous-occupation.

Le deuxième levier est l’efficacité énergétique, qui repose en partie sur la rénovation énergétique, aussi bien dans le résidentiel que dans le tertiaire. L’Ademe estime que, pour respecter nos objectifs climatiques, 80 à 90 % des logements devraient avoir un diagnostic de performance énergétique (DPE) A et B d’ici à 2050, ce qui implique un rythme d’environ un million de rénovations performantes par an. La stratégie nationale bas-carbone (SNBC) 3 en consultation propose un scénario alternatif davantage porté sur l’électrification de logements au moyen des pompes à chaleur.

Pour le tertiaire, la trajectoire de baisse de la consommation d’énergie s’appuie sur le dispositif Éco Énergie Tertiaire, réglementation qui fixe des objectifs de réduction de la consommation en 2030, en 2040 et en 2050 aux propriétaires et aux occupants.

Côté construction, la filière progresse et produit des bâtiments neufs plus performants énergétiquement et moins émetteurs de gaz à effet de serre. Ces évolutions sont notamment le fruit de l’application de la Réglementation environnementale RE2020, une réglementation ambitieuse sur le neuf dont les exigences sont progressives, ce qui conduit la filière à faire évoluer ses pratiques au fur et à mesure.

Le troisième levier porte sur la réduction des déchets. Il s’agit d’en diminuer la production et d’encourager le recyclage des matériaux et des produits du secteur, dans une logique d’économie circulaire. Celle-ci est encadrée par la responsabilité élargie du producteur (REP) « Produits et matériaux de construction du bâtiment », qui fixe des objectifs de collecte et de traitement des déchets du bâtiment.

Cette REP permet le financement des opérateurs pour la collecte, le tri et le traitement des déchets. Ce financement permet la reprise gratuite des déchets triés pour les entreprises de travaux, encourageant ainsi le tri à la source.

À lire aussi : Réemploi des matériaux : Pourquoi est-ce si compliqué dans le bâtiment ?

Quel rôle peut jouer l’électrification des usages ? Comment décarboner les consommations d’énergie des bâtiments ?

S. B. : La décarbonation de l’énergie constitue le quatrième levier essentiel. En 2025, d’après les données provisoires, 33 % de la consommation d’énergie du bâtiment provenait des énergies fossiles, essentiellement du gaz pour le chauffage. Le développement des réseaux de chaleur, alimentés majoritairement par des énergies renouvelables, est une des solutions à promouvoir.

En parallèle, l’électrification des usages, en parallèle avec l’installation d’équipements plus efficaces, est indispensable. Une récente campagne de mesures a notamment montré que les performances réelles des pompes à chaleur air/eau sont conformes aux attentes, avec un coefficient de performance proche de 3, ce qui signifie que pour 1 kilowattheure (kWh) d’électricité consommé, 3 kWh de chaleur sont produits.

Comment a évolué l’empreinte du parc immobilier ces cinq dernières années et comment analyser ces évolutions ?

S. B. : Le parc immobilier français a connu une baisse significative de sa consommation d’énergie entre 2021 et 2023, du fait notamment des mesures de sobriété prises durant cette période en réponse à la hausse des prix de l’énergie. Pour certains ménages, ces mesures de sobriété se sont traduites par des restrictions, avec pour conséquence une bascule dans la précarité énergétique.

En 2024, la consommation d’énergie a légèrement augmenté, caractérisant un coup d’arrêt dans la baisse amorcée les deux années précédentes. Cette hausse traduit une dynamique insuffisante vis-à-vis des objectifs de réduction nationaux. À ce stade, les éléments disponibles ne permettent pas encore d’identifier clairement les facteurs susceptibles d’expliquer ce ralentissement ni d’anticiper son inscription dans la durée. À titre d’hypothèse, il est toutefois possible que les économies d’énergie liées aux efforts de sobriété d’usage aient atteint un premier palier.

En 2025, les données provisoires indiquent une baisse des consommations qui compense la hausse observée en 2024.

Sur d’autres aspects, des progrès sont à noter : on a déjà évoqué l’amélioration de la performance énergétique et environnementale du neuf permise par la RE2020, mais également la structuration de la filière REP pour encourager la circularité en matière de déchets. Pour le verre et le plâtre, les bénéfices de la filière REP sont déjà visibles : elle a permis de déployer rapidement des filières de collecte séparée et de préparation des matières recyclées, ce qui a répondu à une forte demande de la part des producteurs de plaques de plâtre et de menuiseries vitrées.

Enfin, en matière de rénovation, le nombre de logements ayant bénéficié d’une rénovation d’ampleur aidée par l’Agence nationale de l’habitat (Anah) a connu une augmentation importante en 2024 et en 2025, il s’élève à 120 300 logements en 2025, soit une hausse de 68 % par rapport à 2023. Cette évolution positive montre que, avec ce dispositif ambitieux et incitatif, la demande des ménages est au rendez-vous et que l’augmentation attendue des rénovations peut être enclenchée.

Propos recueillis par Nolwenn Jaumouillé.

Sylvain Bessonneau ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

16.05.2026 à 11:23

Comment des arbres africains ont conquis les forêts d’Asie du Sud-Est

Nicolas Gentis, Docteur en Paléobotanique, Muséum national d’histoire naturelle (MNHN)

Texte intégral (3128 mots)

Les Dipterocarpaceae sont une famille d’arbres emblématiques d’Asie du Sud-Est qui dominent les canopées et servent souvent de refuge aux orangs-outans. Leur origine a longtemps été mystérieuse, jusqu’à ce que l’étude approfondie des fossiles, mêlée à celle de la tectonique des plaques et des données génétiques, révèle leur provenance africaine. Mais alors comment ces arbres ont-ils pu arriver jusqu’en Asie ?

Les forêts d’Asie du Sud-Est figurent parmi les écosystèmes les plus riches de la planète : sur à peine 3 % des terres émergées, elles abritent plus de 20 % des espèces végétales connues, dont une grande partie est endémique, c’est-à-dire présente nulle part ailleurs. Parmi leurs habitants les plus spectaculaires figurent les Dipterocarpaceae, une famille d’arbres tropicaux aux fruits ailés (d’où leur nom, du grec di « deux », pteron « aile » et karpós « fruit ») qui peuvent atteindre près de 100 mètres de hauteur, soit l’équivalent d’un immeuble de 30 étages.

Ces géants se distinguent par leur architecture caractéristique avec des branches étagées en forme de chou-fleur, et dominent jusqu’à 80 % de la canopée. Certains individus évitent tout contact avec les branches de leurs voisins, un phénomène appelé « timidité des cimes ».

Au-delà de leur allure impressionnante, ils jouent un rôle écologique majeur : ils structurent la forêt et conditionnent l’existence de nombreuses autres espèces, en fournissant par exemple le gîte aux emblématiques orangs-outangs ou une source de nourriture abondante pour les insectes avec leurs fruits.

Mais un des aspects les plus surprenants tient sans doute à leur origine : ces arbres emblématiques d’Asie du Sud-Est viendraient en réalité d’Afrique. Alors, comment expliquer la présence de groupes africains sur un autre continent ?

À première vue, rien ne prédestinait les Dipterocarpaceae à un tel voyage : leurs graines doivent germer rapidement et toute virée maritime est à proscrire, l’eau salée étant fatale à l’embryon.

Pour comprendre leur histoire, il faut donc changer d’échelle : quitter celle de l’espace, pour entrer dans celle du temps, et remonter plusieurs dizaines de millions d’années.

Comment retrace-t-on l’historique des groupes de plantes ?

C’est ce que tâche de faire la biogéographie, soit la discipline qui étudie la répartition des êtres vivants dans l’espace et au cours du temps. Pour reconstituer l’histoire évolutive d’un groupe, les scientifiques croisent plusieurs sources d’informations.

Les relations de parenté entre espèces, appelées phylogénies, sont établies à partir de données génétiques et de caractères morphologiques (principalement des fleurs et des fruits). À partir des phylogénies il est possible de formuler des hypothèses sur les aires d’origine des organismes.

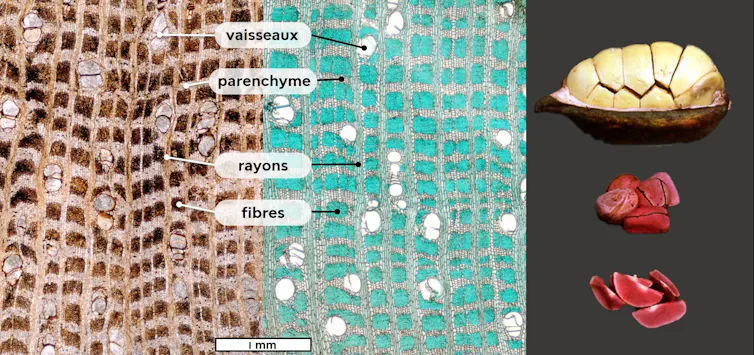

Celles-ci sont ensuite confrontées au registre fossile, c’est-à-dire l’ensemble des fossiles connus et répertoriés, qui fournit des preuves directes de la présence passée de ces organismes. Les fossiles utilisés peuvent être très variés : bois pétrifiés, feuilles, fruits ou encore grains de pollen. Ces derniers sont particulièrement précieux, car ils se conservent bien dans les sédiments. Les fossiles sont datés, notamment par des méthodes radiométriques et identifiés en s’appuyant sur des outils d’imagerie allant de la microscopie classique à la tomographie à rayons X, permettant d’observer des structures anatomiques fines.

Il faut enfin tenir compte de la tectonique des plaques : au fil des temps géologiques, les continents se sont déplacés, si bien que les coordonnées géographiques d’un fossile ne correspondent pas nécessairement à son emplacement d’origine, au moment où l’organisme vivait. C’est en combinant toutes ces informations que l’on peut reconstruire la répartition des végétaux à tout instant de l’histoire et ainsi suivre leur évolution.

Les fossiles sont les meilleures preuves empiriques

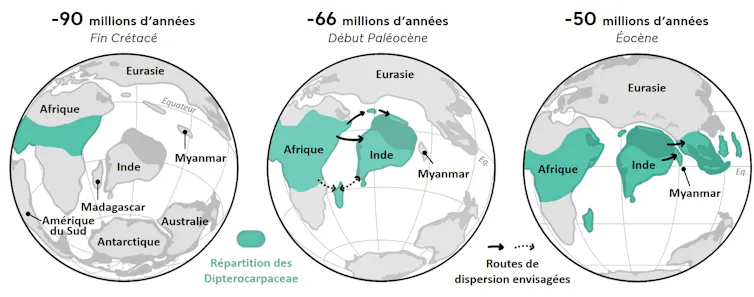

Dans le cas des Dipterocarpaceae, les plus anciens fossiles connus proviennent d’Afrique : ce sont des grains de pollen datés de la fin du Crétacé (entre -72 et -66 millions d’années), découverts en 2022 dans l’actuel Soudan du Sud. Or, à la même période et au début de l’ère suivante, le cénozoïque, aucun fossile de Dipterocarpaceae n’est recensé en Asie.

Cette observation contraste avec la distribution actuelle de la famille : environ 500 espèces en Asie du Sud-Est, contre une vingtaine seulement en Afrique et une seule en Amérique du Sud. Pendant longtemps, ce constat a laissé suggérer une origine asiatique, mais cette hypothèse expliquait mal la présence de la famille sur d’autres continents et restait contestée.

Ce n’est vraiment qu’au cours trente dernières années, portée par les progrès des analyses génétiques et l’accumulation de preuves fossiles, que l’hypothèse alternative d’une origine africaine s’est imposée. Ou plus précisément d’une origine sur le Gondwana, un ancien supercontinent de l’hémisphère sud qui regroupait notamment l’Afrique, l’Amérique du Sud, l’Inde, l’Antarctique et l’Australie il y a plus de 160 millions d’années et qui s’est fragmenté par la suite.

La grande traversée sur une Inde en dérive

« Je ne peux le porter pour vous, mais je peux vous porter, vous ! » disait le hobbit Sam Gamegie à propos de l’anneau unique, à son ami Frodon bien affaibli dans Le Seigneur des Anneaux.

De façon analogue, les Dipterocarpaceae n’ont pas pu franchir par eux-mêmes les plus vastes étendues océaniques, mais ont été transportées par le continent qui les portait. Lors de la fragmentation du Gondwana, l’Inde s’est détachée de l’Afrique durant le Crétacé, et a entamé une remontée vers le nord, à travers la Néo-Thétys, un océan aujourd’hui disparu.

Elle a d’abord rencontré une partie du Myanmar, puis l’Asie autour de – 50 millions d’années, entraînant la formation de l’Himalaya. Les Dipterocarpaceae ont ainsi pu passer de l’Afrique à l’Inde lorsque les deux masses continentales étaient encore proches et situées près de l’équateur, puis de l’Inde à l’Asie du Sud-Est à l’approche de la collision finale. Ce scénario a été introduit dès les années 1950 mais s’est considérablement affiné ces 20 dernières années au fil des nombreuses études géologiques et paléontologiques traitant de la collision Inde-Asie. Il a le mérite de rendre compte à la fois des données fossiles et de la distribution actuelle des espèces.

Une success-story pour certains

L’histoire de la famille est ensuite un cas d’école en biogéographie : bien qu’originaires d’Afrique, les Dipterocarpaceae se sont surtout diversifiées sur le sous-continent indien pendant sa traversée, puis après la collision. Elles ont ensuite colonisé avec succès l’Asie du Sud-Est, au même titre que d’autres arbres d’origine gondwanienne comme certains palmiers, les familles des kakis, des durians ou des figues.

Cette réussite des Dipterocarpaceae tient probablement à plusieurs facteurs : une reproduction prolifique où les arbres produisent des quantités massives de fruits de manière synchrone, une croissance compétitive qui leur permet de dominer rapidement la canopée, ou encore une association symbiotique avec des champignons mycorhiziens.

La fin du voyage pour d’autres

Cependant, toutes les lignées végétales ayant suivi des trajectoires similaires n’ont pas connu le même succès. La traversée « Indo‑Myanmar » représente parfois une impasse. Des bois fossiles découverts au Myanmar, datés de -45 à -30 millions d’années, attestent de la présence ancienne d’autres groupes d’origine gondwanienne, comme des proches parents des Eucalyptus ou des arbres du genre Cola, qui a donné son nom à la célèbre boisson.

Pourtant, aucun de ces arbres ne semble avoir réussi à coloniser l’Asie du Sud-Est : ils ont localement disparu de la région, un phénomène appelé extirpation, probablement à la suite de modifications climatiques drastiques survenues au Miocène, entre -23 et -5 millions d’années.

Les grandes lignes sont là, mais les détails de l’histoire restent dans l’ombre

Si nous avons aujourd’hui pu lever certains mystères, fouiller dans le passé est une entreprise longue et minutieuse, et de nombreuses incertitudes subsistent encore. La reconstitution des trajectoires et temporalités précises des dispersions, des rythmes de diversification et des interactions avec les changements climatiques restent des défis majeurs. D’autres échanges de flore, notamment entre l’Australie et l’Asie, dits Sunda-Sahul, ont aussi façonné ces forêts. Il reste donc beaucoup d’indices à trouver pour comprendre pourquoi certains groupes se sont maintenus en Asie tandis que d’autres non.

Fait intéressant, les animaux semblent eux avoir suivi des trajectoires différentes : dans de nombreux cas, les échanges se sont surtout faits de l’Eurasie vers les autres continents. Ainsi, plusieurs groupes de mammifères, comme les ancêtres des rhinocéros, des girafes, des zèbres, des félins ou de nombreux primates, ont colonisé l’Afrique depuis l’Eurasie ; seule la lignée des éléphants est d’origine africaine.

En Europe, un événement majeur appelé « Grande Coupure », survenu il y a environ 34 millions d’années, correspond à un renouvellement majeur de la faune lié à l’arrivée d’espèces asiatiques. La quasi-totalité de primates disparaissent ainsi qu’un grand nombre de mammifères endémiques tandis qu’on voit l’arrivée de rhinocéros, de proches parents des hippopotames, de rongeurs tels que les hamsters ou les castors, ainsi que de petits carnivores comme le hérisson.

Comprendre ces distributions passées ne relève pas seulement de la curiosité scientifique : cela permet d’identifier les facteurs qui favorisent, ou limitent, le succès des espèces à long terme. Dans un contexte de changement climatique rapide, ces connaissances sont précieuses pour anticiper la réponse des écosystèmes et orienter les stratégies de conservation.

Dans les cas des Dipterocarpaceae, plus de 65 % des espèces sont aujourd’hui menacées par les activités humaines, notamment par la déforestation pour l’exploitation de leur bois ou la plantation de palmiers à huile. La préservation de ces arbres assure ainsi la préservation de tous les êtres vivants qui en dépendent.

Nicolas Gentis ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

14.05.2026 à 12:20

Quand les villes montrent la voie en matière de climat, les citoyens suivent

Corinne Faure, Professor of Marketing, Co-coordinator of Chaire Européenne de la Transition du Territoire, GEM

Joachim Schleich, Professor of Energy Economics, co-coordinator of the Chaire Européenne de la Transition du Territoire, GEM

Texte intégral (1837 mots)

Une étude inédite vient faire mentir l’idée selon laquelle les citoyens se reposeraient sur les efforts faits par les collectivités en matière de politiques climatiques. Réalisé à Grenoble, ce travail montre au contraire que les citoyens sont d’autant plus prêts à s’engager dans la lutte contre le changement climatique quand ils savent que les pouvoirs locaux s’y investissent.

Plus les effets du réchauffement climatique deviennent visibles, plus la lutte contre le changement climatique devient locale. Le dernier rapport du Groupe d’experts intergouvernemental sur l’évolution du climat (GIEC) l’a clairement indiqué : les initiatives locales et municipales telles que la rénovation des bâtiments publics, le développement des transports en commun et la création de pistes cyclables sont essentielles pour limiter l’augmentation de la température du globe. Les actions locales prennent encore plus d’importance alors que, dans de nombreux pays, notamment aux États-Unis, on observe un fort backlash climatique au niveau national.

Mais lorsqu’une municipalité prend l’initiative de devenir un leader en matière de climat, comment ses citoyens réagissent-ils ?

En économie, il existe une théorie bien établie appelée « l’effet d’éviction ». Cette théorie suggère que lorsque le gouvernement fournit un bien public comme la protection du climat, les citoyens peuvent avoir le sentiment qu’ils n’ont plus besoin de contribuer.

Cependant, nos récentes recherches publiées dans la revue Climate Policy suggèrent une réalité plus optimiste. Lorsqu’une ville met activement en avant son rôle de pionnière en matière de climat, cela n’incite pas les citoyens à se reposer sur leurs lauriers. Au contraire, cela les incite à investir dans la lutte contre le changement climatique.

L’expérience de Grenoble

Pour comprendre comment les initiatives municipales en faveur du climat influencent les comportements individuels, nous nous sommes intéressés à l’agglomération de Grenoble, en France. Si la ville elle-même compte environ 150 000 habitants, la zone urbaine autour en dénombre environ 700 000.

Grenoble est une ville pionnière en matière de durabilité urbaine : elle a été la première municipalité française à adopter un plan climat dès 2005, a été une des premières villes au monde à rendre son réseau de transport en commun entièrement accessible aux personnes à mobilité réduite, a abandonné l’usage de produits chimiques pour l’entretien des espaces verts dès 2008, et est aujourd’hui la deuxième métropole en France pour l’usage du vélo. En récompense de ces succès, Grenoble a reçu en 2022 le prix de « Capitale Verte Européenne ». Ce prix est délivré chaque année par la Commission européenne pour récompenser et encourager une ville européenne qui se distingue par ses actions en faveur de l’environnement et de la qualité de vie de ses habitants.

Juste avant que Grenoble ne lance ses activités dans le cadre du programme « Capitale Verte », nous avons mené une expérience aléatoire auprès de plus de 600 citoyens de l’agglomération grenobloise.

Nous les avons répartis en deux groupes :

Le groupe témoin n’a reçu aucune information spécifique sur les réalisations de la ville en matière de climat.

Le groupe d’intervention a reçu un bref « coup de pouce » l’informant que Grenoble avait été désignée Capitale Verte Européenne 2022, soulignant que la ville avait déjà réduit ses émissions de gaz à effet de serre de 49 % depuis 2005.

Nous avons ensuite posé une question simple aux participants des deux groupes : quel est le montant maximal que vous seriez prêt à payer à titre privé pour compenser les émissions de gaz à effet de serre que vous avez produites l’année dernière ?

L’effet d’entraînement fonctionne

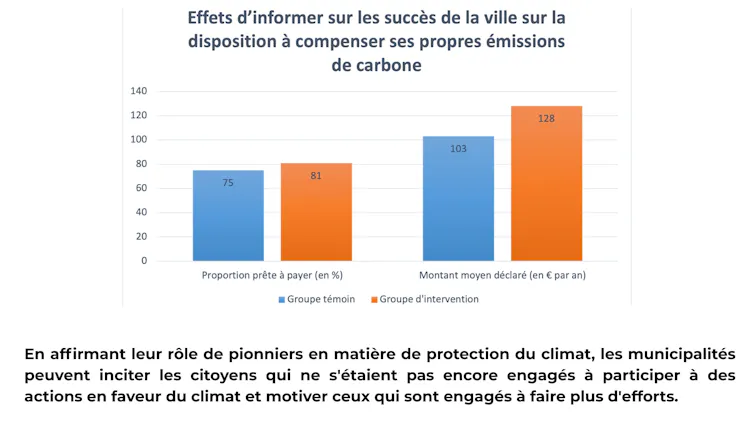

Les résultats étaient frappants. Le simple fait d’informer les citoyens sur le rôle de pionnier de leur ville en matière de climat a eu un effet d’entraînement considérable sur leur volonté déclarée personnelle d’agir.

Les participants à qui l’on avait rappelé les réalisations écologiques de Grenoble ont déclaré être prêts à débourser en moyenne environ 128 € par an pour compenser leur empreinte carbone. Ceux qui n’avaient pas reçu ces informations n’étaient prêts à payer qu’environ 103 € en moyenne. Cela représente une différence de 25 €, soit une augmentation de 25 % de l’engagement financier, simplement grâce à la lecture de quelques phrases sur les succès de leur ville en matière de politique climat.

En analysant les données plus en détail, nous avons constaté que cette forte augmentation de l’engagement climatique s’est produite de deux manières distinctes :

Attirer de nouvelles personnes : communiquer sur les réalisations de Grenoble en matière de climat a fait passer de 75 à 81 % le nombre de personnes déclarant être prêtes à payer quelque chose (plutôt que rien). Ce rappel a donc réussi à transformer des citoyens non engagés en participants actifs.

Motiver les personnes déjà engagées à en faire davantage : pour ceux qui ont déclaré être prêts à payer pour compenser leurs émissions, le fait de découvrir le rôle de premier plan joué par la ville les a motivés à augmenter leur contribution de 16 € en moyenne.

Sur qui cet effet d’entraînement est-il le plus fort ?

Nous souhaitions également savoir si certaines catégories démographiques étaient plus réceptives à ce type de message. Nos analyses ont révélé que ce « coup de pouce » s’avérait particulièrement efficace auprès de groupes spécifiques.

Tout d’abord, l’effet était le plus marqué chez les jeunes citoyens. Recevoir l’information sur le succès de la ville en matière de lutte contre le réchauffement climatique a considérablement renforcé la disposition déclarée à payer pour compenser leurs propres émissions de carbone chez les participants âgés de moins de 40 ans, qui représentaient environ 60 % de notre échantillon. Au-delà de 40 ans, l’impact du leadership climatique de la ville sur l’engagement financier personnel a commencé à s’estomper.

Deuxièmement, le message a trouvé un écho particulièrement fort auprès des ménages à revenus moyens (ceux gagnant entre 2 000 et 3 500 € net par mois). Il est intéressant de noter que nous n’avons constaté aucune différence significative dans la manière dont les hommes et les femmes ont réagi, et que les attitudes environnementales préexistantes des citoyens n’ont pas non plus influencé l’efficacité du message.

Implications pour les municipalités et les pouvoirs publics

Depuis des décennies, la théorie économique classique met en garde contre le risque que des citoyens égoïstes « se reposent » sur les efforts environnementaux publics. Notre étude suggère que, dans le contexte de l’action climatique locale, c’est l’inverse qui se produit : le leadership municipal favorise la participation citoyenne.

Pour les municipalités, les implications sont claires : il ne suffit pas de mener à bien le travail difficile de la protection du climat ; il faut également mettre en avant ce travail.

Le récent rapport du Haut Conseil pour le Climat) met en avant la nécessité de politiques climatiques plus ambitieuses et mieux mises en œuvre au niveau des collectivités territoriales. Pour les villes les plus actives, remporter des prix tels que celui de Capitale Verte Européenne, rejoindre des réseaux tels que la Convention Mondiale des Maires pour le Climat et l’Energie ou atteindre les objectifs d’émissions sont en soi des réalisations impressionnantes. Mais leur valeur est décuplée lorsque les villes communiquent activement ces succès à leurs habitants. Que ce soit par le biais des réseaux sociaux, de tableaux de bord en temps réel, de festivals sur le développement durable ou de rapports d’avancement, tenir les citoyens informés des victoires climatiques municipales semble établir une norme sociale puissante.

Lorsqu’une ville prouve qu’elle prend la crise climatique au sérieux, elle envoie à ses habitants le message que leurs actions individuelles comptent aussi. Dans la lutte contre le réchauffement climatique, montrer l’exemple n’est pas seulement une belle intention : c’est un outil politique efficace.

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur organisme de recherche.

- GÉNÉRALISTES

- Ballast

- Fakir

- Interstices

- Issues

- Korii

- Lava

- La revue des médias

- Time France

- Mouais

- Multitudes

- Positivr

- Regards

- Slate

- Smolny

- Socialter

- UPMagazine

- Le Zéphyr

- Idées ‧ Politique ‧ A à F

- Accattone

- À Contretemps

- Alter-éditions

- Contre-Attaque

- Contretemps

- CQFD

- Comptoir (Le)

- Déferlante (La)

- Esprit

- Frustration

- Idées ‧ Politique ‧ i à z

- L'Intimiste

- Jef Klak

- Lignes de Crêtes

- NonFiction

- Nouveaux Cahiers du Socialisme

- Période

- ARTS

- L'Autre Quotidien

- Villa Albertine

- THINK-TANKS

- Fondation Copernic

- Institut La Boétie

- Institut Rousseau

- TECH

- April - Libre à lire

- Dans les algorithmes

- Framablog

- Gigawatts.fr

- Goodtech.info

- Quadrature du Net

- INTERNATIONAL

- Alencontre

- Alterinfos

- Gauche.Media

- CETRI

- ESSF

- Inprecor

- Guitinews

- MULTILINGUES

- Kedistan

- Quatrième Internationale

- Viewpoint Magazine

- +972 mag

- PODCASTS

- Arrêt sur Images

- Le Diplo

- LSD

- Thinkerview