01.04.2026 à 11:14

Décoloniser notre rapport aux animaux pour inventer un nouveau rapport au monde

Cédric Sueur, Professeur des Universités en éthologie, primatologie et éthique animale, Université de Strasbourg

Texte intégral (3501 mots)

L’humain s’est placé au-dessus de toutes les autres espèces animales. Comment changer notre relation avec elles pour sortir d’une logique de domination et aller vers des formes de coexistence et de coopération ?

Chaque année, des milliards d’animaux sont élevés, transportés et abattus pour répondre aux besoins alimentaires, scientifiques ou industriels des sociétés humaines. Cette utilisation intensive du vivant pose une double question. Elle est d’abord éthique, car elle implique la souffrance et la mise à mort d’êtres vivants sensibles. Elle est aussi environnementale et sanitaire : la déforestation pour l’élevage intensif, la pollution conséquente et la proximité accrue entre espèces favorisent les déséquilibres écologiques et l’émergence de maladies.

Le concept de One Health (une seule santé) et la crise du Covid-19 rappellent que la santé humaine dépend étroitement de celle des animaux et des écosystèmes. Ces crises ne sont pas indépendantes. Elles révèlent un même rapport au vivant, fondé sur l’exploitation et la mise à distance physique et émotionnelle. Comprendre ce rapport est une condition nécessaire pour le transformer.

Une domination héritée : spécisme et colonisation

Les recherches en éthologie ont profondément renouvelé notre regard sur les animaux. De nombreuses espèces manifestent des émotions, des capacités d’apprentissage, des formes de coopération et des relations sociales complexes. Chez certains primates, mais aussi chez des éléphants, des corvidés ou des cétacés, on observe des comportements qui suggèrent des formes de conscience, d’empathie, de culture et de deuil.

Pourquoi, malgré ces connaissances, continuons-nous à exploiter les animaux à grande échelle ? Une partie de la réponse tient à notre héritage culturel. Les sociétés occidentales modernes se sont construites sur une séparation entre l’humain et le reste du vivant, associée à une hiérarchisation qui place l’homme au sommet.

Le concept de « spécisme », inventé par Richard Ryder en 1970, désigne cette discrimination fondée sur l’espèce. Il conduit à considérer que les intérêts des humains priment systématiquement sur ceux des autres êtres qui souffrent tout autant. Dans sa structure, ce mécanisme n’est pas sans analogie avec le racisme ou le sexisme : il repose sur une différence érigée en critère de domination.

Le spécisme décrit cependant avant tout une attitude morale, un biais cognitif et éthique dans la manière dont nous évaluons les intérêts des différentes espèces. La notion de « colonisation animale », que je développe dans Décoloniser notre rapport aux animaux (Odile Jacob, 2026), cherche à aller plus loin en désignant les structures concrètes qui organisent et perpétuent cette domination.

Là où le spécisme interroge les représentations, la colonisation animale pointe les dispositifs institutionnels, économiques et culturels qui les rendent opératoires : les animaux sont appropriés, contrôlés, transformés en ressources économiques et symboliques. Le droit les protège partiellement en tant qu’êtres vivants sensibles, tout en les maintenant dans le régime des biens. L’économie en fait des marchandises et tend à invisibiliser les violences qui leur sont infligées. Ces dimensions se renforcent mutuellement et stabilisent un système de domination qui dépasse la seule question des représentations pour s’incarner dans des pratiques, des lois et des rapports de pouvoir.

D’autres ontologies du vivant

Cette manière de penser n’est pourtant pas universelle. De nombreuses sociétés non occidentales, comme les Achuar d’Amazonie, les aborigènes d’Australie ou les Japonais, envisagent les relations entre humains et non-humains autrement. Plutôt que de séparer radicalement les êtres, elles insistent sur les continuités, les interdépendances et les relations.

Les travaux de l’anthropologie, en particulier de Philippe Descola (les Lances du crépuscule, 1993) ou de Bruno Latour (Enquête sur les modes d’existence, 2012), ont ainsi montré l’existence de différentes « ontologies », c’est-à-dire des manières de définir et de se représenter ce qui existe et comment les êtres sont liés. Ces sociétés ou ethnies sont, par exemple, animistes et attribuent aux animaux une intériorité – autrement dit une vie intérieure faite d’intentions, d’émotions, de perceptions et de subjectivité propre, comparable à celle que nous reconnaissons aux humains – ou les considèrent comme des partenaires inscrits dans des réseaux de relations.

Sans idéaliser ces perspectives, elles offrent des ressources pour sortir d’une vision strictement utilitariste du vivant. Elles invitent à penser une coexistence fondée non sur la domination, mais sur la réciprocité et l’attention aux interdépendances.

Transformer nos pratiques quotidiennes

Décoloniser notre rapport aux animaux suppose d’abord de transformer nos pratiques les plus ordinaires. L’alimentation constitue un levier central : réduire la consommation de produits animaux permet de limiter à la fois la souffrance animale et l’impact environnemental.

Au-delà, il s’agit de repenser la manière dont nous partageons les espaces. L’urbanisation a longtemps exclu les autres espèces. Une approche « zooinclusive » développée par la chercheuse Émilie Dardenne propose au contraire d’intégrer leurs besoins dans la conception des villes : favoriser la présence d’oiseaux, d’insectes ou de petits mammifères, aménager des continuités écologiques ou encore adapter les bâtiments pour accueillir d’autres formes de vie.

Cette approche trouve déjà des traductions concrètes. Certaines villes européennes, comme Vienne, Bruxelles ou Londres, ont ainsi intégré des nichoirs et des gîtes à chauves-souris dans les façades de bâtiments rénovés. D’autres ont aménagé des passages fauniques sous les axes routiers pour permettre les déplacements des mammifères sauvages, ou encore maintenu des toitures végétalisées favorisant la biodiversité des pollinisateurs. À Singapour, la politique des « corridors verts » cherche explicitement à reconnecter des fragments d’habitats naturels au sein du tissu urbain. En France, la trame verte et bleue, inscrite dans la législation depuis le Grenelle de l’environnement, constitue une tentative institutionnelle d’intégrer ces continuités écologiques à l’échelle du territoire.

Ces transformations ne relèvent pas seulement de choix individuels, mais aussi de décisions collectives en matière d’aménagement et de politiques publiques.

Repenser la conservation de la faune sauvage

La protection des animaux sauvages s’inscrit souvent dans une logique de gestion : il s’agit de réguler, contrôler, parfois éliminer certaines populations jugées problématiques. Les carnivores sont particulièrement visés. En France, le loup cristallise les tensions entre éleveurs et défenseurs de la nature depuis son retour naturel dans les Alpes dans les années 1990. En Afrique, le lion fait l’objet de conflits similaires : lorsqu’il s’attaque au bétail des communautés rurales, il est perçu comme une menace directe pour la survie économique des familles, ce qui conduit à des empoisonnements ou des abattages, parfois tolérés voire encouragés par les autorités locales.

Les grands herbivores ne sont pas épargnés : en Afrique australe et orientale, les éléphants, dont les populations se sont reconstituées dans certaines zones protégées, provoquent des destructions massives de cultures, écrasent des habitations, tuent des êtres humains. Ces conflits humains-éléphants poussent des communautés à réclamer des abattages, voire à tolérer le braconnage comme seule réponse à une menace perçue comme existentielle. Le braconnage lui-même, souvent présenté uniquement sous l’angle criminel, s’alimente parfois de cette exaspération locale, même s’il est également structuré par des réseaux internationaux aux enjeux économiques considérables. Cette approche gestionnaire prolonge, sous d’autres formes, une relation de domination du vivant, ce que l’historien Guillaume Blanc nomme un nouveau colonialisme vert : des décisions prises depuis l’extérieur, au nom de la nature, sans tenir compte des réalités vécues par les populations locales.

Décoloniser la conservation consiste à reconnaître davantage l’autonomie des animaux, leur « souveraineté sauvage », comme la définissent les philosophes Donaldson et Kymlicka, et à respecter leurs habitats. Cela implique de passer d’une logique de contrôle à une logique de coexistence, en cherchant des formes de médiation entre les intérêts humains et non humains. Des initiatives de terrain, comme le projet Cibel dans la forêt du bassin du Congo, montrent qu’il est possible de concilier activités humaines et présence de la faune sauvage, à condition d’accepter la complexité de ces relations.

Décoloniser les sciences

La science elle-même n’échappe pas à ces enjeux. Les animaux y sont souvent considérés comme des objets d’étude ou des modèles expérimentaux. Intégrer leur « agentivité animale », c’est-à-dire leur capacité à agir et à influencer les situations, conduit à repenser les protocoles de recherche vers une coopération humain – non humain plutôt que vers des sacrifices animaux.

En primatologie, par exemple, certaines approches cherchent à limiter les contraintes imposées aux animaux et à mieux prendre en compte leurs comportements spontanés. Lancée par l’éthologue Tetsuro Matsuzawa, cette approche d’observation participante est une collaboration humanimale. Plus largement, le développement de méthodes alternatives permet de réduire le recours à l’expérimentation animale. Décoloniser les sciences ne signifie pas renoncer à la recherche, mais en interroger les présupposés et les finalités des utilisations animales.

L’expérimentation animale constitue un point de tension majeur. Si certains travaux sont justifiés par des enjeux de santé, d’autres apparaissent plus discutables au regard des souffrances infligées. Des outils comme le « cube de Bateson » proposent d’évaluer les recherches en fonction de leurs bénéfices attendus, de leur probabilité de réussite et des dommages causés aux animaux. Mais dans la pratique, la réflexion éthique reste souvent limitée. Décoloniser l’expérimentation suppose de renforcer ces exigences, de développer des alternatives et de questionner la légitimité même de certaines recherches.

Vers une coexistence

Décoloniser notre rapport aux animaux, c’est finalement transformer en profondeur notre manière d’habiter le monde. Il ne s’agit pas de supprimer toute relation avec eux, mais de sortir d’une logique de domination pour aller vers des formes de coexistence et de coopération, ce qui est nommé le « capital animal ». Les animaux ne sont plus de simples matériaux pour manger ou se vêtir, mais sont des aides sociales, des passeurs culturels (ils nous transmettent des informations sur notre environnement) et des managers écosystémiques (ils nous aident à gérer nos écosystèmes).

Ce changement est à la fois éthique, écologique et politique. Il implique de reconnaître que les humains ne sont pas extérieurs au vivant, mais en font partie. Dans un contexte de crises multiples, repenser nos relations avec les autres espèces apparaît non comme un luxe, mais comme une nécessité pour la survie de tous dont l’humanité.

Cédric Sueur est l'auteur de l'ouvrage « Décoloniser notre rapport aux animaux » publié aux Editions Odile Jacob dont l'article fait mention.

01.04.2026 à 11:14

L’ADN a parlé : la culture de la vigne en France date de plus de 4 000 ans

Rémi Noraz, Doctorant en Archéobiologie et Paléoécologie, Université de Montpellier

Texte intégral (1244 mots)

Des pépins de raisin retrouvés sur des sites archéologiques peuvent sembler anodins. Pourtant, l’analyse de leur ADN donne accès à l’histoire plurimillénaire de la vigne cultivée.

Nous avons séquencé le génome de pépins vieux de plusieurs millénaires, révélant une histoire déjà entrevue par l’archéologie : celle de l’introduction de la viticulture en France, des échanges de cépages à l’échelle européenne et de pratiques agricoles anciennes qui ont laissé des traces jusqu’à aujourd’hui.

Nos résultats, publiés tout récemment dans Nature communications, montrent notamment que certains cépages emblématiques, comme le pinot noir variété phare de Bourgogne, étaient déjà présents au Moyen Âge.

Comment avons-nous analysé l’ADN de pépins de raisin vieux de 4 000 ans ?

L’histoire de la vigne s’est longtemps appuyée sur l’étude morphologique des pépins. Cette puissante approche a permis de distinguer de grandes tendances, notamment sur le caractère sauvage ou domestique des pépins, et retracer les débuts de la viticulture.

Cependant, certaines questions restaient difficiles à trancher : origine géographique des cépages, relations de parenté, ou encore les modes de multiplication (croisement ou reproduction clonale) et circulation des plants. L’ADN ancien pouvant être préservé au cœur même des pépins apporte ici une aide particulièrement décisive, comme témoin des relations entre les vignes du passé et celles d’aujourd’hui.

Nous avons ainsi analysé 49 pépins provenant de différents sites archéologiques, majoritairement français, et couvrant près de 4 000 ans, de l’âge du Bronze à la fin du Moyen Âge. Ces pépins gorgés d’eau ont été préservés dans des contextes spécifiques, humides, ayant contribué à une bonne préservation de leur ADN.

L’ADN a été extrait dans le laboratoire spécialisé en ADN ancien du Centre d’anthropobiologie et de génomique de Toulouse, conçu pour isoler et manipuler les molécules aussi rares que dégradées qui ont traversé les époques dans les restes archéologiques. Cet ADN ancien a pu être décrypté grâce à des technologies de séquençage de pointe jusqu’à en lire la totalité de l’information génétique, soit ici un texte génétique d’environ 500 millions de lettres.

Ces données permettent d’établir les relations génétiques entre individus, d’identifier les origines des cépages et de retrouver les techniques de propagations passées : soit par croisement, mélangeant des variétés d’origine ou de qualités distinctes ; soit par reproduction clonale (par bouturage, marcottage ou greffe) pour maintenir à l’identique dans le temps une variété qui leur était particulièrement précieuse.

Notre découverte prouve l’ancienneté de la viticulture

Les premières vignes cultivées apparaissent en France aux alentours de -600 avant notre ère, avec le développement des échanges méditerranéens, notamment du vin. Elles coexistent avec des vignes sauvages locales, et des croisements entre ces deux types contribuent à la diversité des cépages.

Les analyses génétiques confirment également l’existence de circulations à longue distance dès cette période. Des influences venues d’Ibérie, des Balkans ou du Proche-Orient témoignent des échanges des plants et de savoir-faire à l’échelle de la Méditerranée et, plus généralement, de l’Europe.

Autre point important : la multiplication clonale apparaît comme une pratique ancienne et commune, déjà en place dès l’âge du Fer. Elle a permis de maintenir certaines variétés d’intérêt sur de longues périodes et de les diffuser sur de longues distances.

C’est dans ce cadre que nous avons identifié un pépin médiéval considéré comme étant génétiquement identique au pinot noir actuel, illustrant la continuité de certains cépages sur plusieurs siècles.

Quelles perspectives pour ces recherches ?

L’apport de l’ADN ancien ne se limite pas à confirmer des scénarios existants : il ouvre aussi de nouvelles pistes.

En combinant données anciennes et modernes, il devient possible d’aller plus loin dans la caractérisation des vignes du passé. Des approches récentes permettraient par exemple d’inférer certaines caractéristiques des raisins anciens, comme la couleur des baies ou certains traits liés au goût.

Ces méthodes pourraient aussi permettre de mieux comprendre les adaptations des cépages aux environnements du passé, ou encore les choix opérés par les sociétés anciennes dans leurs pratiques agricoles.

À terme, ces recherches contribuent à mieux documenter la diversité génétique de la vigne et son évolution, un enjeu important dans le contexte actuel de changements climatiques.

Tout savoir en trois minutes sur des résultats récents de recherches, commentés et contextualisés par les chercheuses et les chercheurs qui les ont menées, c’est le principe de nos « Research Briefs ». Un format à retrouver ici.

Rémi Noraz a reçu des financements de l'ANR MICA (ANR-22-CE27-0026).

01.04.2026 à 11:13

Eau, biosignature et éclair : ce que nous a appris le rover Perseverance après cinq ans sur Mars

Agnès Cousin, Astronome adjoint, Responsable scientifique de SuperCam, IRAP, Centre national d’études spatiales (CNES); Université de Toulouse

Magali Bouyssou, Responsable des opérations instruments, Centre national d’études spatiales (CNES)

Olivier Gasnault, Chargé de recherche au CNRS, Institut de Recherche en Astrophysique et Planétologie, Centre national d’études spatiales (CNES)

Valérie Mousset, Cheffe de projet de la participation française au projet Mars Science Laboratory, Centre national d’études spatiales (CNES)

Texte intégral (2810 mots)

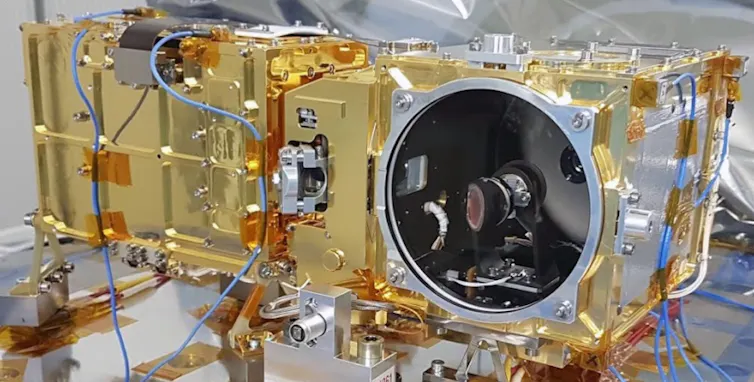

Depuis cinq ans, le rover Perseverance nous en apprend plus sur la géologie de Mars, et ainsi sur les anciennes conditions de la Planète rouge. Aurait-elle pu abriter la vie par le passé ? Les études se succèdent, la dernière en date venant de sortir en mars 2026. On dresse le bilan des découvertes permises par SuperCam, l’un des instruments principaux du rover.

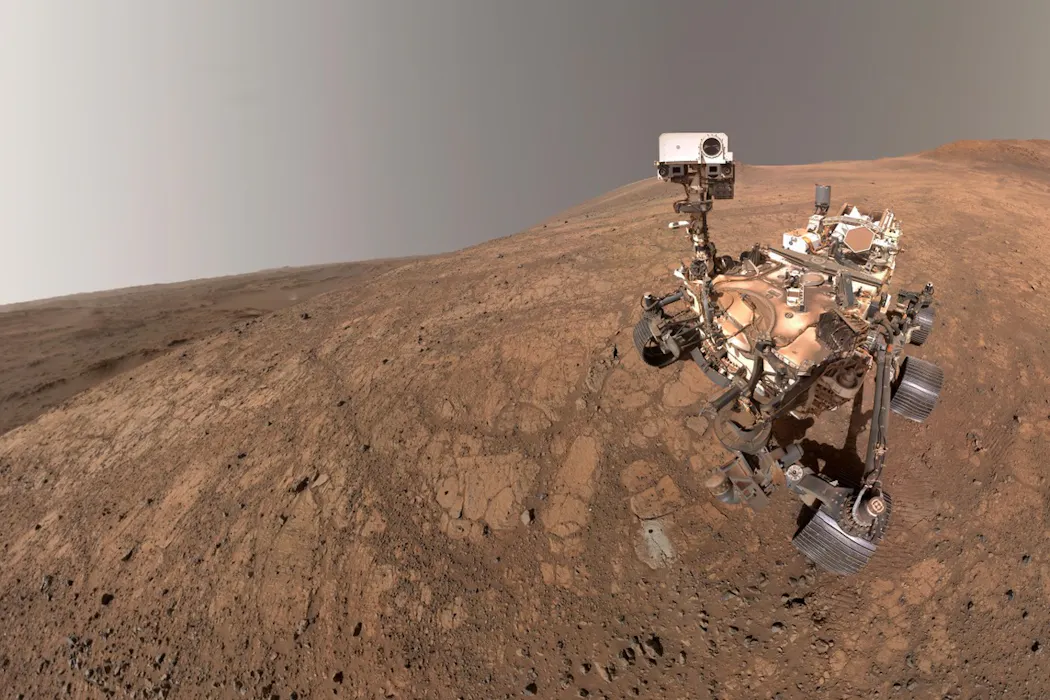

Le 18 février 2026, nous avons fêté les cinq ans de l’atterrissage du rover Perseverance sur Mars, dans le cratère de Jezero. À la suite du succès du précédent rover Curiosity, qui explore toujours la Planète rouge depuis son atterrissage en août 2012, la Nasa a lancé la mission « Mars 2020 ». Après plus de six mois de voyage, Perseverance se pose sur Mars avec en son bord de nombreux instruments, dont le nôtre, appelé SuperCam. C’est le début d’une nouvelle ère d’exploration martienne : la recherche de potentielles traces de vie ancienne et la collecte d’échantillons qui devraient un jour revenir sur Terre !

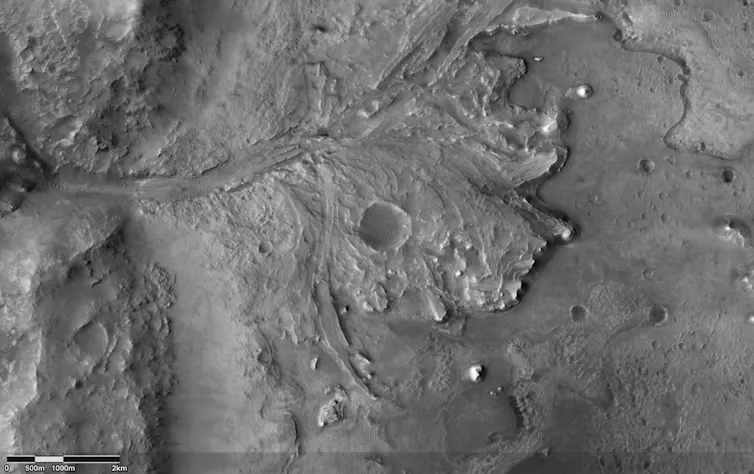

Bien sûr, nous nous intéressons aussi à la géologie et au climat de Mars. Le cratère Jezero n’a pas été sélectionné par hasard comme site d’atterrissage : les observations orbitales y montrent un ancien delta de rivière très bien préservé, ainsi que des signatures de carbonates, des minéraux qui se forment lorsque des roches interagissent avec de l’eau et du CO₂. Ce sont donc de précieux témoins des conditions qui régnaient lors de leur apparition sur Mars. Ces observations orbitales démontrent donc que l’eau a joué un rôle important dans l’histoire de ce site.

Sur Terre, les environnements des lacs et des deltas sont aussi les meilleurs pour piéger et préserver des molécules organiques, qui se retrouvent mélangées aux sédiments très fins transportés par la rivière, puis enfouies dans le delta où ils se déposent. Le site de Jezero fournit donc l’enregistrement d’un environnement passé propice à la conservation de molécules organiques et est, de ce fait, un bon endroit pour chercher des conditions favorables à l’émergence de la vie.

Durant les trois premiers mois de la mission, chacun des instruments et des sous-systèmes du rover ont pu se mettre en marche et commencer à fournir de précieuses informations. En particulier, cette période est marquée par le premier vol historique du drone Ingenuity, le 19 avril 2021. Ce démonstrateur technologique a prouvé la faisabilité de vols motorisés dans l’atmosphère ténue de Mars, ouvrant alors une nouvelle dimension de l’exploration martienne.

Explorer le fond d’un ancien lac martien

Parmi les sept instruments embarqués par Perseverance, on trouve SuperCam, qui constitue la « tête » du rover. Il a été développé en collaboration entre la France et les États-Unis. Cet instrument combine plusieurs spectromètres, des appareils capables d’analyser la composition chimique et minéralogique de la surface de Mars. En plus des spectromètres, SuperCam embarque une caméra, afin de documenter le contexte géologique des lieux où sont réalisées les analyses, et un microphone, qui permet d’étudier l’atmosphère de Mars. En France, nous sommes 13 instituts impliqués dans cette aventure martienne.

Très rapidement après l’atterrissage, SuperCam a acquis un panorama d’une butte, nommée Kodiak, qui nous a permis de confirmer la nature du delta dans Jezero, à savoir qu’il est formé de sédiments charriés par une rivière se jetant dans un lac. Un tel système permet de reconstruire l’histoire passée de l’eau dans cette région. Ces observations nous ont montré que le niveau du lac fluctuait, mais qu’il s’agissait d’un lac fermé la plupart du temps, c’est-à-dire sans cours d’eau qui en ressort, contrairement à ce que les observations orbitales avaient suggéré auparavant.

Quinze mois plus tard, Perseverance est arrivé au pied du delta dont l’exploration a confirmé ces premières observations et a permis de mieux comprendre l’évolution du lac au cours du temps. Plus récemment, sur la bordure du cratère, SuperCam a découvert du quartz pour la première fois de manière certaine sur Mars ! Le quartz n’est pas rare lorsqu’il est observé dans une roche magmatique, du granite par exemple. Mais dans le cas de cette observation, le contexte est très différent, sans relation avec du volcanisme. Cette roche est probablement liée à un impact de météorite qui aurait facilité la circulation et la remontée d’eau chaude en fracturant la roche, créant un système hydrothermal et des conditions propices à la formation de quartz.

Entre la première photographie de Kodiak et l’arrivée au delta, la première campagne scientifique a débuté en juin 2021 en explorant deux types d’environnements géologiques du fond du cratère. Perseverance a d’abord trouvé des roches volcaniques. Pour se repérer sur Mars, les géologues donnent des noms informels aux zones étudiées. Ainsi la première formation de roches volcaniques a été appelée « Màaz ». Il s’agit d’une succession de coulées de lave à la surface. La seconde (appelée « Seítah ») correspond à un cumulât d’olivines, des roches constituées de gros grains obtenus en cristallisant un minéral, l’olivine, en profondeur sous la surface. Ces roches ont été très peu altérées par l’eau.

Les modèles suggèrent que ces deux environnements géologiques ne proviennent pas de la même source magmatique, mais de deux volcans différents ou de deux chambres magmatiques différentes sous un même volcan. Des échantillons de ces roches, s’ils reviennent sur Terre, nous permettront de dater ces terrains et de mieux comprendre leur mise en place par rapport à la formation du lac présent sur le site.

Mars, anciennement habitable, voire habitée ?

C’est en bordure de cet ancien lac que Perseverance a détecté, en 2024, les carbonates dont nous parlions plus haut, en grande quantité, confirmant les détections orbitales. Il est important de déterminer leur abondance in situ, car ces sédiments ont pu piéger le carbone de l’atmosphère, qui devait être plus épaisse dans le passé. L’analyse minutieuse de ces roches nous a permis de comprendre leur processus de formation : il s’agirait de roches magmatiques ayant longuement interagi avec l’eau du lac et du système hydrothermal, enrichie par le CO2 dissout dans l’eau.

La prise en compte de ce processus dans le cycle du carbone martien donne une nouvelle perspective au devenir du carbone et de l’habitabilité passée de cette planète. En effet, la communauté recherchait jusque-là des carbonates similaires aux calcaires des anciens fonds océaniques terrestres. Or, comme nous l’avons vu, les observations de Perseverance montrent qu’un autre processus de formation des carbonates a eu lieu sur Mars. Il faut donc le prendre en compte pour étudier le cycle du carbone martien et son influence sur les conditions climatiques passées, lesquelles déterminent combien de temps l’eau a pu rester liquide à la surface de Mars, qui en est dépourvue aujourd’hui. La présence d’eau étant nécessaire pour rendre la planète habitable, c’est ce qui rend cette découverte importante.

C’est d’ailleurs dans le même secteur, dans la vallée de l’ancienne rivière se déversant dans le lac, que Perseverance a détecté des traces potentielles de biosignatures. La présence simultanée de matière organique et de phosphate et sulfure de fer rappelle des réactions chimiques qui, sur Terre, sont parfois utilisées par les microorganismes dans des processus biologiques. Seule l’analyse sur Terre de ces échantillons pourra trancher sur l’origine de ces composés et répondre à la question de l’habitabilité passée de Mars.

Une étude récente, menée grâce au radar à bord du rover, a pu mettre en évidence la présence d’un environnement fluvial enfoui sous le delta actuel, démontrant que de l’eau circulait déjà il y a plus de 3,7 milliards d’années. Ces observations sont particulièrement importantes pour l’habitabilité passée de la planète et les recherches de biosignatures anciennes.

Écouter l’atmosphère sur une autre planète

Perseverance, depuis cinq ans, a aussi scruté l’atmosphère martienne. SuperCam et un autre instrument, MastCam-Z ont observé une aurore diffuse, comme une aurore boréale, mais qui ne se limite pas aux pôles, pour la première fois depuis la surface martienne. Mais c’est le microphone de SuperCam qui s’est nous a permis de sonder l’atmosphère de la planète, en dressant pour la première fois le paysage sonore martien. Ces écoutes permettent de déduire des propriétés importantes de l’atmosphère comme la vitesse du son qui varie selon la nature de l’atmosphère. Les bruits enregistrés sont aussi sensibles à la turbulence atmosphérique, ce qui permet d’étudier ces petits flux d’air proche de la surface.

Toujours grâce au microphone, nous avons récemment pu mettre en évidence des décharges électriques, de sortes de petits éclairs qui apparaissent dans des tourbillons qui soulèvent la poussière dans l’atmosphère. Cette détection permet d’apporter de nouvelles informations, car la dynamique des poussières dans l’atmosphère influe sur sa température et donc sur le climat. Ces petits éclairs pourraient aussi jouer un rôle insoupçonné dans la chimie atmosphérique et à la surface, par exemple en interagissant avec les composants chlorés pour former de nouvelles molécules, ou en cassant certaines molécules déjà existantes.

Après 43 km parcourus, et près de 1 500 roches martiennes analysées par SuperCam, Perseverance est désormais sorti du cratère de Jezero et explore sa bordure. Cette région expose des terrains vieux de plus de 3,8 milliards d’années, c’est-à-dire antérieurs à l’impact qui a formé le cratère, voire même à la formation du grand bassin régional Isidis dans lequel il se trouve. Ces roches sont les plus anciennes jamais étudiées in situ par un rover martien et offrent donc une fenêtre unique sur les premiers millions d’années de l’histoire de Mars. Les analyses en cours devraient révéler les conditions environnementales qui régnaient sur la planète rouge à cette époque reculée. Jezero tient bien ses promesses en termes de richesses des terrains, et de nombreuses découvertes nous attendent encore !

Agnès Cousin a reçu des financements du CNES, pour le projet Mars2020/SuperCam. Son laboratoire de recherche (IRAP) a aussi pour tutelle l'université de Toulouse et le CNES.

Olivier Gasnault a reçu des financements du CNES pour le projet Mars2020/SuperCam ; il est salarié du CNRS. Son laboratoire de recherche (IRAP) a aussi pour tutelle l'université de Toulouse.

Magali Bouyssou et Valérie Mousset ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur poste universitaire.

01.04.2026 à 10:45

L’intelligence en essaim, de la nature aux algorithmes

Antoine Dutot, Maître de conférence en informatique, Université Le Havre Normandie

Damien Olivier, Professeur des universités en informatique, directeur du laboratoire LITIS (Laboratoire d’Informatique, du Traitement de l’Information et des Systèmes), Université Le Havre Normandie

Jean-Luc Ponty, Maître de conférences, Université Le Havre Normandie

Yoann Pigné, Professeur en informatique, Université Le Havre Normandie

Texte intégral (1996 mots)

Fourmis, étourneaux, lucioles… sans centre de décision unique, ces collectifs accomplissent des tâches complexes à partir d’informations strictement locales. Ils convergent vers de bons trajets, se synchronisent, se déplacent en nuées denses sans collision. Pour cela, il suffit en fait de règles simples, combinées à des rétroactions, où l’action de chaque individu modifie légèrement l’environnement ou l’état du groupe et où cette modification influence en retour les actions suivantes. Cette logique inspire aujourd’hui des algorithmes pour piloter des systèmes distribués, des robots aux réseaux de capteurs, par exemple.

On associe spontanément l’intelligence à un organe central, un cerveau, une tour de contrôle, un « grand modèle » qui verrait tout et déciderait pour tous. Pourtant, une bonne partie du vivant fait exactement l’inverse. Il n’y a pas de contrôle centralisé et, malgré tout, on observe des comportements collectifs remarquables.

Un murmure d’étourneaux au crépuscule forme des nuages mouvants, fluides, sans collisions apparentes. Une colonne de fourmis en quête de nourriture trouve des chemins efficaces sans vision globale. Certaines espèces de lucioles finissent par clignoter ensemble, comme si un métronome invisible donnait le tempo.

Dans ces exemples, la nature coordonne sans commander. Le point commun n’est pas l’absence de hiérarchie au sens social (une fourmilière a des rôles), mais l’absence de calcul et de prise de décision centralisés. La coordination émerge de règles locales, de signaux partagés, d’interactions et de rétroactions. C’est l’intuition au cœur de l’intelligence en essaim (swarm intelligence), obtenir un comportement global cohérent à partir de règles locales simples. Un algorithme en essaim en est la traduction informatique : une population d’agents simples explore collectivement une solution sans contrôleur central, à partir d’informations locales et de boucles de rétroaction.

Pour comprendre ce qui se passe, un bon réflexe en science est de chercher si un même schéma se dégage : une règle locale donne un effet global, qui peut être traduit au sein d’une algorithmique… et déboucher sur un usage concret.

Passons en revue trois cas significatifs : trois mécanismes simples observés dans la nature, qui ont donné trois familles d’algorithmes.

La trace des fourmis et des termites, ou la « stigmergie »

Règle locale. Un individu modifie son environnement en laissant une trace chimique, une structure, un marquage.

Effet global. Les actions futures sont orientées par ces traces ainsi certaines pistes se renforcent, d’autres disparaissent. C’est une communication indirecte, via l’environnement, qui a été appelée stigmergie pour expliquer la coordination chez les termites.

Traduction algorithmique. Cette idée a été reprise en informatique, notamment pour les algorithmes de type « colonie de fourmis ».

Usage concret. Optimiser des trajets, répartir des flux, résoudre des problèmes combinatoires. Pour cela, on explore plusieurs solutions, puis on renforce progressivement les meilleures (un peu comme si les bonnes pistes « sentaient plus fort » au fil des itérations).

Nuance utile : la reine n’est pas un « chef calculateur ». Elle a un rôle biologique central, la reproduction, mais la décision (au sens algorithmique) reste distribuée : aucune entité ne détient le plan d’ensemble.

Le mouvement des oiseaux et des poissons, ou le « flocking » (ou agrégation)

Règle locale. Je m’aligne avec mes voisins, je garde une distance de sécurité, je reste dans le groupe.

Effet global. Des formations fluides, adaptatives, robustes aux perturbations.

Traduction algorithmique. En informatique, le modèle « Boids » a popularisé l’idée qu’un mouvement collectif réaliste peut émerger de quelques règles de voisinage simples.

Ce que la recherche a affiné. Pour les étourneaux, une idée clé est que l’interaction semble surtout topologique, c’est-à-dire que chaque oiseau « suit » un nombre à peu près constant de voisins (plutôt qu’une distance fixe), ce qui aide à garder la cohésion quand la densité varie brutalement (attaque d’un prédateur, par exemple).

Usage concret. Modéliser des foules, coordonner des robots, concevoir des contrôleurs distribués qui restent stables quand l’environnement bouge vite ou encore faire voler des essaims de drones autonomes en formation serrée sans GPS centralisé, comme l’ont démontré des équipes de recherche récentes.

Battre à l’unisson, ou la synchronisation collective des lucioles

Règle locale. J’ai une horloge interne. Si je vois mon voisin clignoter, je l’ajuste légèrement.

Effet global. Petit à petit, les ajustements se propagent et le groupe se synchronise.

Traduction algorithmique. C’est la logique des oscillateurs couplés : un cadre mathématique classique (famille des oscillateurs de « Kuramoto ») pour expliquer comment un ensemble d’unités faiblement couplées peut finir par battre à l’unisson.

Ancrage biologique. Des travaux de synthèse sur la synchronisation des lucioles décrivent les mécanismes, les hypothèses et les limites de ce phénomène dans le vivant.

Usage concret. Ce principe est utile chaque fois qu’un grand nombre d’objets doivent agir ensemble au bon moment, sans chef d’orchestre. Par exemple, dans un réseau de capteurs dispersés dans une forêt pour détecter un départ de feu, il faut que les appareils se réveillent, mesurent et transmettent leurs données de façon coordonnée afin d’économiser leur batterie et de ne pas saturer les communications. Le même mécanisme peut aussi servir à faire travailler ensemble une flotte de petits robots ou de drones qui doivent avancer au même rythme malgré des échanges imparfaits. L’idée générale est simple : obtenir un comportement collectif synchronisé même lorsque chaque unité ne dispose que d’une information locale et de signaux parfois bruités.

Rendre visible l’émergence : mettre le collectif en scène

Les modèles d’essaim se présentent souvent sous forme d’équations et de simulations, comme dans la vidéo ci-dessus. Mais on les comprend parfois mieux… en les voyant « vivre ». Dans les projets de médiation LED it be et Arduiciole, des collaborations entre fab Lab et laboratoire de recherche où nous utilisons des matrices de LED, d’objets lumineux ou des ballons gonflés à l’hélium, chaque lumière suit une règle locale simple : clignoter, attendre, se caler sur ses voisins, ou réagir à une « trace » dans son environnement. Ce ne sont pas de simples ampoules, mais des pixels qui s’éveillent à la vie artificielle. Le dispositif rend visible l’invisible : il simule des automates cellulaires ou des modèles de synchronisation inspirés des lucioles.

Ce que le public observe alors n’est pas un code, mais une dynamique : propagation d’un motif, stabilisation, bascule, synchronisation. La démonstration est double : le modèle n’est pas le réel, mais un outil pour isoler un mécanisme ; la complexité collective est une propriété liée aux interactions, et non à chaque individu pris séparément.

Des essaims dans nos technologies… et deux écueils à éviter

Ces principes de coordination distribuée intéressent les ingénieurs et les scientifiques pour une raison simple, ils offrent souvent trois avantages simultanés : robustesse, passage à l’échelle, adaptabilité. C’est exactement la promesse de la robotique en essaim, qui s’inspire explicitement de l’auto-organisation du vivant, mais aussi des algorithmes en essaim.

On retrouve ces principes dans une grande variété de systèmes. Ils sont particulièrement utiles lorsqu’il faut identifier de bonnes configurations dans un ensemble de possibilités immense, comme en logistique, en calibration ou en réglage de paramètres, car ils permettent de faire émerger progressivement des solutions efficaces sans pilotage central.

Ils servent aussi à organiser l’exploration collective, qu’il s’agisse de répartir des robots, des drones ou des entités logicielles pour couvrir une zone, cartographier un environnement, détecter des signaux ou parcourir un espace de recherche.

Enfin, ils offrent un cadre robuste pour maintenir la cohérence d’un système distribué en synchronisant les comportements, en assurant une coordination locale et en préservant le fonctionnement global malgré la perte ou la défaillance de certaines unités.

Ces systèmes ne sont pourtant ni spontanément stables ni naturellement sûrs. Hors des environnements idéalisés, les perceptions sont imparfaites, les échanges sont retardés et la communication entre agents reste souvent partielle. Dans ces conditions, une règle locale élégante en simulation peut devenir fragile en situation réelle. De plus, dès lors que la coordination dépend de signaux partagés, qu’il s’agisse d’une trace, d’un rythme commun ou d’une information sur un meilleur état collectif, la fiabilité de ces signaux devient un enjeu central. Un signal erroné, perturbé ou manipulé peut suffire à désorganiser l’ensemble. La décentralisation n’élimine donc pas le risque ; elle impose de penser autrement la robustesse, en la ramenant au niveau des interactions.

L’intelligence en essaim invite à l’humilité. Elle montre que la force d’un collectif ne vient pas toujours d’un chef, mais de la qualité des interactions entre ses membres. À partir de règles simples, un groupe peut faire émerger une organisation efficace, souple et robuste. La puissance réside alors dans la capacité à agir ensemble. Ce passage du « je » au « nous » offre un modèle de résilience fondé sur la coopération et l’adaptation.

Damien Olivier a reçu des financements de l'ANR et de la commission Européenne.

Yoann Pigné a reçu des financements de l'Agence Nationale de la Recherche.

Antoine Dutot et Jean-Luc Ponty ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'ont déclaré aucune autre affiliation que leur poste universitaire.

31.03.2026 à 17:07

Question de goût : les néandertaliens aimaient-ils vraiment les femmes « sapiens » ?

Ludovic Slimak, Archéologue et chercheur au CNRS, Auteurs historiques The Conversation France; Université de Toulouse

Texte intégral (2984 mots)

Un article récent paru dans Science a été largement lu comme s’il révélait une préférence des hommes néandertaliens pour les femmes sapiens. Cette lecture, séduisante pour nos imaginaires contemporains, nous maintient dans une zone de confort où l’altérité se laisse encore penser dans les termes du désir et de l’attirance. Mais dès que l’on restitue les chromosomes à l’épaisseur des sociétés, en croisant génétique, archéologie et anthropologie culturelle, une autre image se dessine, plus dérangeante, qui touche à quelque chose de plus nu dans l’humain : des groupes structurés par des règles de circulation, des réciprocités inégales, des frontières, des alliances et peut-être des violences dont nous commençons à peine à mesurer la profondeur.

À lire les titres de presse, l’affaire semble entendue. El País annonce que les hommes néandertaliens « choisissaient » les femmes sapiens. Science évoque une « partner preference ». National Geographic imagine déjà les « Roméos de la préhistoire ». The Telegraph laisse entendre que les Néandertaliens « avaient des vues sur » les femmes sapiens.

En quelques heures, une analyse statistique est devenue un récit de désirs. La « vie sexuelle » de nos ancêtres était enfin à portée de clics. Le glissement n’a rien d’anodin. Il transforme une asymétrie de transmission génétique en récit d’affects, en attirances et en romances passées. On fabrique une scène où le Roméo néandertalien remporte le cœur de la Juliette sapiens. Le discours sur nos origines devient roman-photo.

Or, l’étude parue dans Science ne raconte rien de tel. Les auteurs interrogent un motif bien connu. Chez les humains modernes non africains, les traces d’ADN néandertalien ne sont pas réparties uniformément et sont plus fréquentes dans les chromosomes non sexuels que sur le chromosome X, qui en est fortement appauvri.

Pour expliquer ce contraste, les auteurs confrontent plusieurs hypothèses, sélection naturelle, biais démographiques liés au sexe ou préférence de partenaire. Leur conclusion reste prudente : une préférence de partenaire est un mécanisme parcimonieux possible, mais elle n’exclut ni des biais démographiques ni des scénarios plus complexes.

L’étude ne montre donc ni une attirance observée ni une préférence vécue. Elle propose quelque chose de beaucoup plus étroit : dans l’espace de modèles qu’elle teste, certains scénarios rendent plus plausible une asymétrie de type mâles néandertaliens/femelles sapiens. Dans un tel schéma, l’ADN néandertalien peut se transmettre largement dans les chromosomes ordinaires, tandis que le chromosome X néandertalien circule plus difficilement, puisqu’un père ne le transmet qu’à ses filles. Ce n’est pas rien. Mais ce n’est pas non plus l’observation directe d’une attirance entre populations, et montrer qu’un modèle statistique peut produire un motif génétique n’est pas prouver que ce modèle est historiquement vrai.

Ce que le chromosome X ne dit pas de la vie sociale

Dès que l’on passe des données génétiques à leurs implications historiques et sociales, les lectures deviennent fragiles. Les chromosomes ne transmettent pas la mémoire fidèle de la vie sociale de nos ancêtres. Le fait que l’ADN néandertalien soit rare sur le chromosome X ne permet pas, en soi, de reconstituer les organisations sociales du Paléolithique ni les préférences sexuelles de ces populations.

Lorsque deux groupes proches se croisent, les chromosomes sexuels ne se comportent pas comme les autres. Ils sont souvent plus sensibles aux incompatibilités et à la sélection naturelle. Prenons le cas d’un père néandertalien et d’une mère sapiens. Leur enfant reçoit bien de l’ADN néandertalien dans beaucoup de ses chromosomes. Mais le chromosome X du père ne passe pas aux garçons, seulement aux filles. Il circule donc moins facilement d’une génération à l’autre. De plus, dans les hybridations entre groupes proches, les mâles sont souvent les plus fragiles biologiquement, avec davantage de problèmes de survie ou de fertilité. C’est pourquoi les chromosomes sexuels, et en particulier le chromosome X, peuvent perdre plus vite l’ADN venu de l’autre groupe. Un appauvrissement du chromosome X en ADN néandertalien peut ainsi relever d’un phénomène biologique classique, et non du souvenir d’un choix amoureux.

Le signal observé aujourd’hui peut donc avoir plusieurs causes. Les auteurs eux-mêmes ne présentent pas la « préférence de partenaire » comme une preuve directe, mais comme l’explication la plus parcimonieuse dans leur modèle statistique. Ils précisent qu’elle n’exclut ni des biais démographiques liés au sexe, ni des scénarios plus complexes où sélection naturelle, migrations différenciées et asymétries sexuées auraient agi ensemble.

La génétique détecte des transmissions. Elle ne reconstitue pas une société. Elle ne dit ni si ces unions relevaient d’alliances, de captures, d’échanges asymétriques, de violence ou de choix, ni qui décidait, ni sous quelles contraintes circulaient femmes et hommes entre les groupes. Entre un patron chromosomique et une scène de vie, il manque encore tout un monde, celui des constructions sociales, des règles de résidence, des hiérarchies, des conflits et des asymétries entre collectifs.

Les gènes, malgré tout leur pouvoir, ne parlent pas des amours passés. Ils parlent seulement de ce qui a survécu.

Ce qu’El Sidrón change dans la discussion

C’est ici que l’archéologie et l’anthropologie culturelle redeviennent décisives, car les gènes ne suffisent pas à reconstituer la scène sociale des rencontres entre Néandertal et Sapiens. Il faut alors quitter le seul article de Science pour revenir à d’autres données et tenter malgré tout d’accéder, indirectement, à la structure des groupes néandertaliens. Le site d’El Sidrón, dans le nord de l’Espagne, fournit à cet égard un point d’appui particulièrement fort.

Les auteurs de l’étude y ont identifié des ossements appartenant à au moins 12 néandertaliens. Le point le plus frappant concerne les adultes. Trois mâles portent la même lignée mitochondriale, alors que trois femelles présentent chacune une lignée différente. Or, l’ADN mitochondrial ne se transmet que par les mères. Les chercheurs en ont tiré une lecture simple et lourde d’implications : les hommes seraient restés dans leur groupe, tandis que les femmes auraient davantage circulé entre groupes. En d’autres termes, El Sidrón serait compatible avec un système patrilocal.

L’idée est décisive. Toute population humaine a besoin d’échanges avec l’extérieur pour se reproduire sur la durée. Dans de très nombreuses sociétés humaines, cette circulation passe d’abord par les femmes, qui quittent plus souvent leur groupe d’origine que les hommes. Plus généralement la dispersion féminine et le maintien des mâles dans leur groupe constituent aussi un schéma prédominant chez les grands singes. Voir apparaître chez Néandertal un signal compatible avec une plus forte mobilité féminine relève donc d’une tendance comportementale profonde, que l’on retrouve des primates aux sociétés humaines, et la mobilité féminine entre groupes est ici l’explication la plus plausible du motif observé. Pour une fois, nous disposons donc d’un point d’appui concret sur l’organisation sociale néandertalienne.

Et cette tendance profonde à la dispersion féminine change beaucoup de choses car dès lors tout un monde social devient pensable : échanges de femmes entre groupes, intégrations asymétriques, circulations réciproques ou non, alliances, captures, ou formes plus dures encore de relations intergroupes. À partir de là, la question n’est plus seulement de savoir quel chromosome a survécu, mais dans quel type de société ces transmissions ont eu lieu. Et cette seule possibilité suffit déjà à déplacer la lecture du papier de Science, car l’asymétrie génétique observée pourrait alors relever d’un monde social, encore inexploré, structuré par des règles de résidence, de circulation et d’échange.

« Néandertal, “Sapiens” : je t’aime, moi non plus »

Intégrer les contraintes de l’anthropologie culturelle aux lectures biomoléculaires permet d’autres basculements. En Belgique, le site de Goyet a livré les ossements de quatre néandertaliennes et de deux immatures. Les traces de découpe y sont nettes sur cinq d’entre eux. Le profil démographique de cet assemblage apparaît trop singulier pour relever d’une mortalité ordinaire. Les signatures isotopiques suggèrent une origine géographique non locale. Les auteurs avancent l’hypothèse d’un cannibalisme lié au conflit, une prédation ciblant les femelles des groupes voisins. Si cette interprétation est juste, elle dit quelque chose de brutal. Ici les relations entre groupes néandertaliens ne relevaient pas d’un monde sentimental mais de la capture, de la mise à mort et de la consommation de l’autre.

Les données peuvent effectivement être lues ainsi, mais ce dossier oblige aussi à la prudence. Le corpus est réduit. Les fouilles sont anciennes. Les données spatiales manquent. L’identité du groupe local prédateur n’est pas directement observée. Ici encore, les traces ne parlent pas d’une seule voix.

C’est alors qu’un renversement devient possible. Si l’on quitte un instant le seul regard biomoléculaire pour revenir au social, une société patrilocale change profondément le sens des corps. Les femmes viennent d’autres groupes, mais dans des mondes où la mobilité féminine est un schéma commun, des grands singes jusqu’aux sociétés humaines, l’interprétation de ce signal devient immédiatement plus subtile.

Le constat d’un cannibalisme affectant des femmes provenant de régions voisines peut donc se lire comme la simple prédation sur des étrangères. Mais il ne peut exclure une autre lecture, celle d’un traitement interne, ritualisé, de femmes venues d’ailleurs, mais désormais pleinement intégrées au groupe. La biologie et la génétique ne peuvent nous dire si un individu né ailleurs reste un étranger ou devient un membre plein et entier de mon propre monde social.

Retournons alors à l’étude de Science. C’est ici qu’il faut être très précis sur ce qu’elle démontre réellement. Le signal d’ascendance sapiens mobilisé par les auteurs renvoie à un épisode très ancien, autour de 250 000 ans. Leur démonstration ne repose donc pas sur l’observation directe du principal métissage qui a laissé sa trace chez les humains actuels. Elle suppose que le même mécanisme génétique aurait été encore à l’œuvre 200 000 ans plus tard, au moment des ultimes contacts entre Sapiens et Néandertal.

Si l’on considère la très forte tendance à la mobilité des femelles, un paradoxe apparaît et met profondément en tension l’extrapolation proposée par l’article de Science. Si des femmes sapiens entraient réellement et régulièrement dans des groupes néandertaliens, on s’attendrait à voir persister, chez les derniers néandertaliens, un signal génétique récent d’ascendance sapiens. Or, ce n’est pas ce que montrent les données disponibles. Chez les premiers Sapiens anciens d’Eurasie, l’héritage néandertalien est constant. En revanche, les génomes néandertaliens exploités jusqu’alors ne documentent aucun apport récent sapiens au sein des dernières populations néandertaliennes. Le flux génétique reconnu au moment des contacts fonctionne donc dans une seule direction, de Néandertal vers Sapiens.

Une autre hypothèse anthropologique devient alors pensable. Dans un monde patrilocal, la circulation des femmes ne règle pas seulement la reproduction mais structure les alliances entre groupes. Si l’échange cesse d’être réciproque, c’est toute la relation qui change. La formule est rude, mais elle dit bien ce paradoxe :

« Je prends ta sœur, mais je ne te donne pas la mienne. »

Il ne s’agit pas d’en faire une description mécanique de chaque croisement, mais cette formule nomme une structure possible : celle d’un rapport inégal entre ces humanités, voire d’une dissymétrie sociale durable entre groupes néandertaliens et sapiens. C’est ce lien entre flux génétique à sens unique, patrilocalité et non-réciprocité de l’échange qui m’avait conduit, dans Néandertal nu en 2022, à relever ce paradoxe singulier : « Néandertal, Sapiens, je t’aime, moi non plus. »

Replacé dans ce cadre, le sens des signatures moléculaires bascule. L’asymétrie ne se lit plus comme la trace fossile d’une préférence, mais comme l’un des effets possibles d’un rapport structurellement inégal entre populations humaines. Ajoute-t-on à cela le fait que les chromosomes sexuels éliminent plus vite certains apports génétiques, et le tableau change encore. Ce que l’on croyait lire comme un roman du désir pourrait bien relever, plus profondément, de structures sociales asymétriques.

Ce que les gènes ne savent pas des humains

Projeter sur la très longue histoire de l’humanité nos récits de désir, de goût et de préférence nous permet de rester dans notre zone de confort. Mais la confrontation à l’altérité est toujours plus rude. Nos valeurs n’ont aucune universalité spontanée. Elles ne peuvent servir de socle pour penser les mondes disparus. Les rencontres entre Néandertal et Sapiens ne se laissent réduire ni à des amours passées ni à des guerres simplement transposées depuis nos imaginaires modernes. Ce que les chercheurs tentent d’approcher, ce sont des structures sociales, des formes d’échange, des frontières entre groupes, la qualité des alliances, des manières de faire monde.

Pour cela, aligner des chromosomes ou des isotopes ne suffit pas. La paléoanthropologie doit retrouver son sens plein. Elle n’est pas seulement science des os mais étude éthologique, culturelle et sociale des sociétés humaines du passé.

La difficulté n’est donc pas de choisir entre des disciplines certaines et d’autres fragiles, mais d’apprendre à faire dialoguer des champs de savoir qui travaillent tous, chacun à leur manière, sur des traces incomplètes.

La vraie leçon est peut-être là. Les chromosomes ne nous racontent pas une petite histoire d’amour entre populations. Ils ouvrent vers des questions bien plus vastes. Qui entre dans le groupe. À quelles conditions. Selon quelles règles de circulation. Sous quelle réciprocité ou non-réciprocité. Avec quelle violence, parfois. Et surtout avec quelle transformation du statut des personnes.

Le corps, sa peau, ses os, ses gènes, ses isotopes, ne nous diront jamais rien de la réalité de l’individu dans un corps social. L’humain est cette créature qui n’est pas réductible à sa matière.

Chez les humains, l’étranger ne naît que du regard qui l’exclut.

Alors oui, la question est bien une question de goût. Mais pas forcément au sens où l’ont entendu les grands médias. Ce que les journaux ont transformé en affaire de préférence sentimentale pourrait bien relever, en réalité, de quelque chose de beaucoup plus profond et, parfois, dans certaines formes de cannibalisme, de beaucoup plus littéral…

Les illustrations de cet article sont extraites de la bande dessinée Néandertal nu, de Frédéric Bihel et Ludovic Slimak, publiée chez Odile Jacob, 2026.

Ludovic Slimak ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

31.03.2026 à 14:03

Cinquante ans d’Apple : huit moments clés qui ont changé notre monde

Nick Dalton, Associate Professor in the School of Computer Science, Northumbria University, Newcastle

Texte intégral (2129 mots)

De la démocratisation de l’ordinateur personnel à l’invention de l’écosystème des applications, Apple a souvent imposé de nouvelles manières d’utiliser la technologie. Voici quelques-unes des innovations les plus marquantes de l’entreprise depuis un demi-siècle.

Au début des années 1970, l’idée qu’une personne ordinaire puisse posséder un ordinateur semblait absurde. À l’époque, les ordinateurs ressemblaient davantage à des porte-avions ou à des centrales nucléaires qu’à des appareils domestiques : d’immenses machines installées dans des centres de données, exploitées par des équipes de spécialistes au service de gouvernements, d'universités et de grandes entreprises.

Puis vint Apple.

Fondée le 1er avril 1976 par deux « décrocheurs universitaires », les fameux « college dropouts » Steve Jobs et Steve Wozniak, la start-up de la Silicon Valley n’a pas inventé l’informatique. Mais elle a sans doute accompli quelque chose de plus important : contribuer à transformer l’informatique en technologie personnelle.

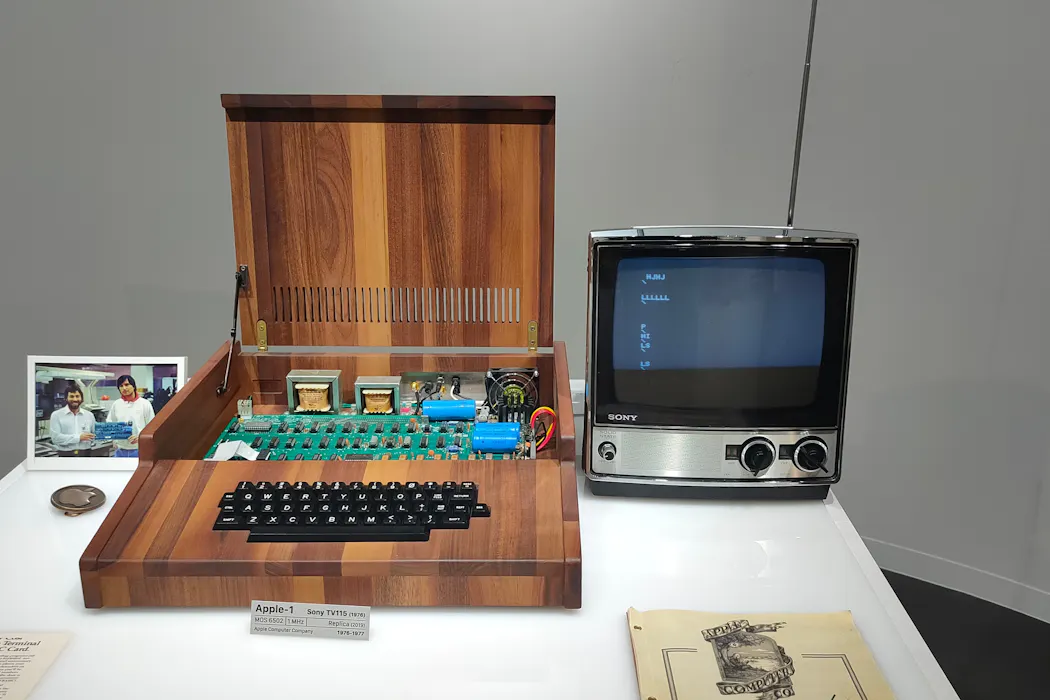

Avant Apple, les ordinateurs étaient le plus souvent vendus sous forme de kits à assembler. Jobs a compris que les gens préféraient des machines déjà montées, prêtes à fonctionner. Les tout premiers Apple I, dotés de boîtiers en bois de koa fabriqués à la main, se vendent aujourd’hui aux enchères pour plusieurs centaines de milliers de dollars.

En tant qu’utilisateur précoce d’Apple et développeur d’applications, voici ma sélection personnelle des réalisations technologiques les plus marquantes de l’entreprise – et de Steve Jobs – au cours des 50 dernières années.

Apple II – beige et unique en son genre

Les premiers ordinateurs personnels relevaient davantage de la curiosité que de l’outil réellement utile. L’Apple II, lancé en juin 1977, introduisit quelque chose de nouveau : le style. Même sa couleur – beige ! – était originale, contrastant avec les boîtiers métalliques noirs courants à l’époque.

L’affichage en couleurs était nouveau et enthousiasmant, et le clavier offrait une sensation agréable à l’usage. Un simple haut-parleur, doté d’une sortie d’un seul bit, était ingénieusement exploité pour produire des tonalités et même des sons ressemblant à la parole. Le design était révolutionné jusqu’à l’emballage : Jerry Manock, premier designer salarié d'Apple, installa la machine dans un boîtier en plastique moulé à l’allure élégante et professionnelle.

La souris – une nouvelle manière d’interagir

En 1979, Steve Jobs, alors âgé de 24 ans et convaincu que le géant technologique IBM était en train de rattraper Apple, se mit en quête de la prochaine grande innovation. L’entreprise de photocopieurs Xerox, qui souhaitait obtenir des actions Apple avant même son entrée en bourse, lui proposa en échange une visite de ses laboratoires de recherche voisins. Jobs comprit alors que des chercheurs du centre de recherche de Xerox à Palo Alto, comme Alan Kay, étaient en train d’inventer la prochaine génération d’interfaces informatiques.

Au cœur de cette révolution se trouvait un dispositif mis au point au milieu des années 1960 par le mentor d'Alan Kay, Douglas Engelbart, à l’université Stanford, et surnommé « la souris ». La vision de Douglas Engelbart, qui voyait l’ordinateur comme une machine destinée à augmenter les capacités de l’esprit humain, inspira Alan Kay et ses collègues, qui conçurent des interfaces graphiques dans lesquelles les utilisateurs interagissaient avec des barres de défilement, des boutons, des menus et des fenêtres.

Macintosh – la naissance du lancement de produit moderne

Steve Jobs pensait que n’importe qui devait pouvoir utiliser un ordinateur. En janvier 1984, le premier Apple Mac poussa cette idée à un niveau inédit. Fini les commandes informatiques sibyllines et les manuels qui les accompagnaient. Les premiers utilisateurs, dont je faisais partie, avaient l’impression de savoir instinctivement comment tout faire.

Mais le lancement du Mac ne se résume pas à ce saut technologique. Il inspira aussi ce qui est devenu un moment culturel désormais ancré dans nos vies : le lancement de produit. Après une publicité aguicheuse diffusée lors du Super Bowl et réalisée par Ridley Scott, Steve Jobs mit en scène dans un théâtre de 1 500 places un lancement de produit centré sur un présentateur charismatique et seul en scène. Il sortit d’un sac un petit ordinateur carré – encore beige – alors appelé Macintosh, qui se mit à parler de lui-même sous les applaudissements enthousiastes de la salle.

Pixar – le projet parallèle de Jobs

Au cours de sa première décennie, Apple connut une croissance exceptionnelle – mais frôla aussi la faillite à plusieurs reprises. Des difficultés qui conduisirent l’entreprise à l’un des épisodes les plus spectaculaires de son histoire lorsque, en mai 1985, Apple força Jobs à quitter la société.

Un an plus tard, alors qu’il dirige la start-up NeXT Inc, Steve Jobs rachète une division de la société de production de George Lucas, qu’il rebaptise rapidement Pixar. Son logiciel RenderMan permettait de générer des images en répartissant les calculs entre plusieurs machines travaillant simultanément.

Pixar, souvent décrit avec humour comme le « projet parallèle » de Jobs, deviendra l’un des studios d’animation les plus influents – et les plus rentables – au monde, en produisant notamment le premier long métrage entièrement animé par ordinateur, Toy Story (1995).

IMac – la rencontre de deux visions

Après une tentative infructueuse de développer un nouveau système d’exploitation avec IBM, Apple finit par racheter la société NeXT de Steve Jobs. En septembre 1997, celui-ci revient alors comme PDG par intérim alors que l’entreprise se trouve, selon ses propres mots, à « deux mois de la faillite ». Si ce retour est salué par de nombreux utilisateurs d’Apple, il inquiète une partie des salariés. Jobs commence en effet rapidement à licencier du personnel et à fermer les produits jugés défaillants.

Au cours de cette restructuration, il visite le studio de design d’Apple et s’entend immédiatement avec un jeune designer britannique, Jony Ive. De cette rencontre naît en 1998 l’iMac translucide aux couleurs acidulées. Essentiellement des machines NeXT plus petites et moins chères, les iMac (le « i » signifiant Internet) inaugurent aussi une autre innovation d’Apple, aujourd'hui devenue une habitude : abandonner les technologies vieillissantes. Le lecteur de disquettes est supprimé au profit d’un lecteur de CD – un choix très critiqué à l’époque, mais largement imité par la suite.

IPod – 1 000 chansons dans votre poche

Pour Apple, l’informatique n’a jamais consisté uniquement à faire de l’informatique. En 2001, l’entreprise commence à s’intéresser au traitement du son et de la vidéo, et plus seulement du texte et des images. En novembre de la même année, elle lance l’iPod – un baladeur capable de stocker « 1 000 chansons dans votre poche », contre au maximum 20 à 30 par cassette sur un Walkman de Sony.

L’iPod se pilote grâce à une élégante « click wheel » permettant de naviguer à l’écran. La musique est synchronisée via une nouvelle application appelée iTunes. Dès 2005, les utilisateurs s’en servent aussi pour gérer des fichiers audio téléchargés automatiquement depuis Internet grâce à un système appelé RSS. C’est ce qui donnera le « pod » de podcast.

IPhone – un ordinateur dans toutes les mains

En 2007, de nombreux fabricants de téléphones mobiles avaient approché Apple pour fusionner l’iPod avec leurs appareils. Steve Jobs choisit une autre voie. Le 9 janvier, il dévoile le produit le plus ambitieux jamais lancé par Apple : un appareil combinant téléphone, lecteur de musique et ordinateur Mac – le tout au format d’un simple combiné, sans clavier physique et doté d’un large écran.

La plupart des « experts » des médias, de TechCrunch au Guardian, prédisaient un échec. Steve Ballmer, alors PDG de Microsoft, se moquait du prix de 500 dollars, affirmant que personne n’achèterait un tel appareil. En réalité, 1,4 million d’iPhone furent vendus avant même la fin de l’année – et plus de 3 milliards depuis. Pour la première fois, un véritable ordinateur se retrouvait dans toutes les mains – ouvrant la voie aux réseaux sociaux tels que nous les connaissons aujourd’hui.

La révolution logicielle de l’App Store

À la mi-2008, l’iPhone offre à tous les développeurs la possibilité de créer une multitude vertigineuse de nouvelles applications. Dans le même temps, l’App Store – lancé le 10 juillet 2008 – résout l’un des problèmes les plus complexes : la distribution et la commercialisation de ces « apps ». Historiquement, les logiciels étaient souvent copiés et diffusés librement. L’App Store change la donne en utilisant un chiffrement robuste pour garantir que la copie achetée ne puisse être utilisée que par l’utilisateur concerné, réduisant ainsi le piratage.

En lançant le premier App Store au sens moderne du terme, Apple a transformé la manière dont les utilisateurs découvrent et achètent des logiciels. Cela déclenche une explosion du nombre d’applications et impose une idée simple mais puissante : quoi que vous souhaitiez faire, quelqu’un, quelque part, a déjà créé l’application pour le faire. Apple résume cette évolution dans un slogan devenu célèbre : « There’s an app for that » (« Il y a une application pour ça »).

À maintes reprises, cette entreprise hors norme a anticipé l’intérêt d’ouvrir l’informatique au plus grand nombre. Joyeux anniversaire, Apple !

Nick Dalton ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.

- GÉNÉRALISTES

- Ballast

- Fakir

- Interstices

- Issues

- Korii

- Lava

- La revue des médias

- Time [Fr]

- Mouais

- Multitudes

- Positivr

- Regards

- Slate

- Smolny

- Socialter

- UPMagazine

- Le Zéphyr

- Idées ‧ Politique ‧ A à F

- Accattone

- À Contretemps

- Alter-éditions

- Contre-Attaque

- Contretemps

- CQFD

- Comptoir (Le)

- Déferlante (La)

- Esprit

- Frustration

- Idées ‧ Politique ‧ i à z

- L'Intimiste

- Jef Klak

- Lignes de Crêtes

- NonFiction

- Nouveaux Cahiers du Socialisme

- Période

- ARTS

- L'Autre Quotidien

- Villa Albertine

- THINK-TANKS

- Fondation Copernic

- Institut La Boétie

- Institut Rousseau

- TECH

- Dans les algorithmes

- Framablog

- Gigawatts.fr

- Goodtech.info

- Quadrature du Net

- INTERNATIONAL

- Alencontre

- Alterinfos

- Gauche.Media

- CETRI

- ESSF

- Inprecor

- Guitinews

- MULTILINGUES

- Kedistan

- Quatrième Internationale

- Viewpoint Magazine

- +972 mag

- PODCASTS

- Arrêt sur Images

- Le Diplo

- LSD

- Thinkerview