12.03.2026 à 14:29

Carburants : à Bercy, les distributeurs ne s’accordent pas sur une baisse globale des prix à la pompe

Réunis par Bercy jeudi matin, seulement certains distributeurs de carburants se sont engagés à des baisses ou des plafonnements des prix. « Aucune décision n’a été prise sur un encadrement (…) du prix », a fait savoir le président du syndicat professionnel Mobilians, Francis Pousse.

Réunis par Bercy jeudi matin, seulement certains distributeurs de carburants se sont engagés à des baisses ou des plafonnements des prix. « Aucune décision n’a été prise sur un encadrement (…) du prix », a fait savoir le président du syndicat professionnel Mobilians, Francis Pousse.

12.03.2026 à 14:17

Jeux paralympiques 2026 : quatrième médaille à Milan-Cortina pour Aurélie Richard, en bronze sur le slalom géant debout

Après trois médailles d’argent, la Française de 20 ans a ajouté le bronze à son palmarès, jeudi à Cortina d’Ampezzo (Italie), sur le slalom géant debout, portant à dix le total des récompenses tricolores.

Après trois médailles d’argent, la Française de 20 ans a ajouté le bronze à son palmarès, jeudi à Cortina d’Ampezzo (Italie), sur le slalom géant debout, portant à dix le total des récompenses tricolores.

12.03.2026 à 13:56

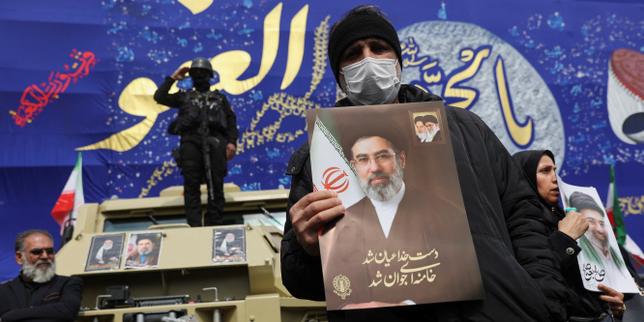

Donald Trump déclare qu’empêcher l’Iran de se doter d’armes nucléaires est « beaucoup plus important » que les prix du pétrole

Le président américain, Donald Trump, a de son côté affirmé qu’il est « beaucoup plus important » à ses yeux d’empêcher l’Iran de se doter de l’arme nucléaire que de se soucier des prix du pétrole, qui flambent avec la guerre au Moyen-Orient.

Le président américain, Donald Trump, a de son côté affirmé qu’il est « beaucoup plus important » à ses yeux d’empêcher l’Iran de se doter de l’arme nucléaire que de se soucier des prix du pétrole, qui flambent avec la guerre au Moyen-Orient.

- GÉNÉRALISTES

- Le Canard Enchaîné

- La Croix

- Le Figaro

- France 24

- France-Culture

- FTVI

- HuffPost

- L'Humanité

- LCP / Senat

- Le Media

- La Tribune

- Time France

- EUROPE ‧ RUSSIE

- Courrier Europe Ctrale

- Desk-Russie

- Euractiv

- Euronews

- Toute l'Europe

- Afrique ‧ Asie ‧ Proche-Orient

- Haaretz

- Info Asie

- Inkyfada

- Jeune Afrique

- Kurdistan au féminin

- L'Orient - Le Jour

- Orient XXI

- Rojava I.C

- INTERNATIONAL

- Courrier International

- Equaltimes

- Global Voices

- Infomigrants

- I.R.I.S

- The New-York Times

- OSINT ‧ INVESTIGATION

- OFF Investigation

- OpenFacto°

- Bellingcat

- Disclose

- G.I.J

- I.C.I.J

- OPINION

- Au Poste

- Cause Commune

- CrimethInc.

- Hors-Serie

- L'Insoumission

- Là-bas si j'y suis

- Les Jours

- LVSL

- Politis

- Quartier Général

- Rapports de force

- Reflets

- Reseau Bastille

- StreetPress

- OBSERVATOIRES

- Armements

- Acrimed

- Catastrophes naturelles

- Conspis

- Culture

- Curation IA

- Extrême-droite

- Human Rights Watch

- Inégalités

- Information

- Justice fiscale

- Liberté de création

- Multinationales

- Situationnisme

- Sondages

- Street-Médics

- Routes de la Soie